Musterlösung 5 - D-MATH

Werbung

D-ITET

Wahrscheinlichkeitstheorie und Statistik

Prof. A.-S. Sznitman

FS 2016

Musterlösung 5

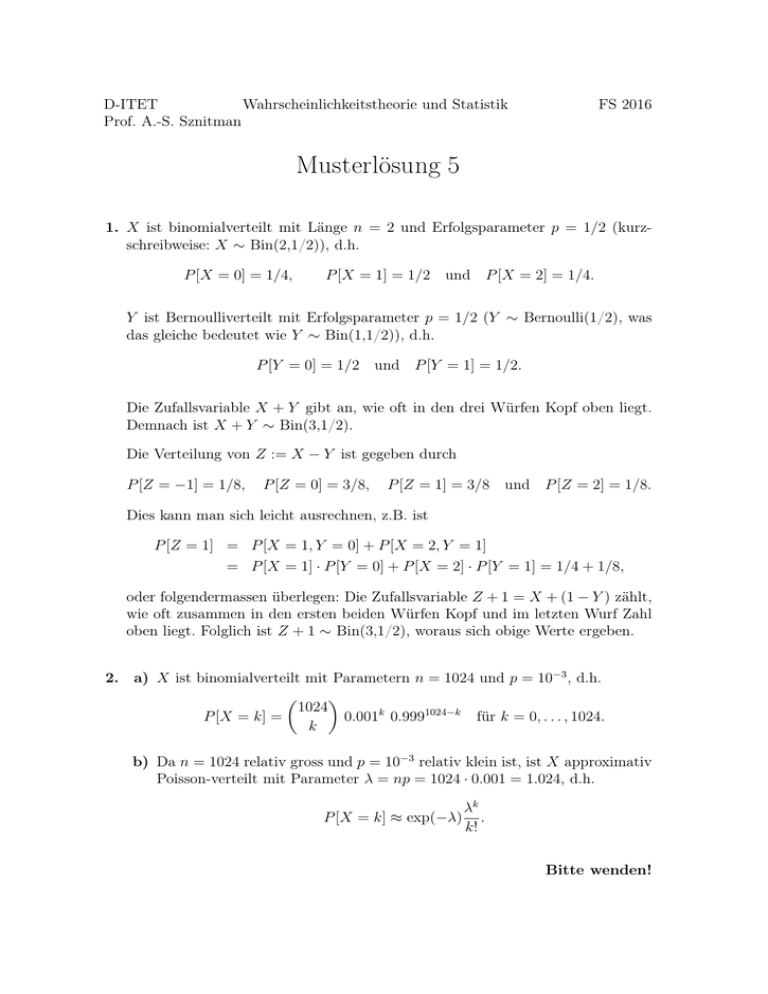

1. X ist binomialverteilt mit Länge n = 2 und Erfolgsparameter p = 1/2 (kurzschreibweise: X ∼ Bin(2,1/2)), d.h.

P [X = 0] = 1/4,

P [X = 1] = 1/2 und P [X = 2] = 1/4.

Y ist Bernoulliverteilt mit Erfolgsparameter p = 1/2 (Y ∼ Bernoulli(1/2), was

das gleiche bedeutet wie Y ∼ Bin(1,1/2)), d.h.

P [Y = 0] = 1/2 und P [Y = 1] = 1/2.

Die Zufallsvariable X + Y gibt an, wie oft in den drei Würfen Kopf oben liegt.

Demnach ist X + Y ∼ Bin(3,1/2).

Die Verteilung von Z := X − Y ist gegeben durch

P [Z = −1] = 1/8,

P [Z = 0] = 3/8,

P [Z = 1] = 3/8 und P [Z = 2] = 1/8.

Dies kann man sich leicht ausrechnen, z.B. ist

P [Z = 1] = P [X = 1, Y = 0] + P [X = 2, Y = 1]

= P [X = 1] · P [Y = 0] + P [X = 2] · P [Y = 1] = 1/4 + 1/8,

oder folgendermassen überlegen: Die Zufallsvariable Z + 1 = X + (1 − Y ) zählt,

wie oft zusammen in den ersten beiden Würfen Kopf und im letzten Wurf Zahl

oben liegt. Folglich ist Z + 1 ∼ Bin(3,1/2), woraus sich obige Werte ergeben.

2. a) X ist binomialverteilt mit Parametern n = 1024 und p = 10−3 , d.h.

1024

P [X = k] =

0.001k 0.9991024−k für k = 0, . . . , 1024.

k

b) Da n = 1024 relativ gross und p = 10−3 relativ klein ist, ist X approximativ

Poisson-verteilt mit Parameter λ = np = 1024 · 0.001 = 1.024, d.h.

λk

P [X = k] ≈ exp(−λ) .

k!

Bitte wenden!

Diese Nährung hat den Vorteil, dass sie sich, besonders für grosses k, leichter

berechnen lässt als der exakte Wert. Die Wahrscheinlichkeit dafür, dass ein

Codewort richtig dekodiert wird, ist somit

P [X ≤ 3] =

3

X

P [X = k] ≈ exp(−λ) 1 + λ +

k=0

λ2 λ3 +

= 0.97950487 . . .

2

6

c) Die Anzahl Y falsch dekodierter Wörter ist (mit der in Aufgabe b) vorgenommenen Nährungen) Bin(10, 1 − 0.9795) verteilt. Also ist die gesuchte

Wahrscheinlichkeit gleich

10

P [Y ≥ 1] = 1 − P [Y = 0] ≈ 1 −

0.02050 0.979510 = 0.187 . . .

0

3. a)

E[M ] =

3

X

kP [M = k] = 0 + 1 · 3 ·

k=0

=

4·3·6

4·3·2

4·6·5

+2·3

+3

10 · 9 · 8

10 · 9 · 8

10 · 9 · 8

1 3

1

6

+ +

= .

2 5 10

5

b)

P [genau zwei aufeinander folgende Personen wählen Typ A] = 2 ·

P [M = 2] = 3 ·

4 3 6

1

· · =

10 9 8

5

3

6 4 3

· · =

10 9 8

10

c)

E[Anzahl Abstürze] = E[Anzahl Abstürze auf A] + E[Anzahl Abstürze auf B]

1

1

= E[Anzahl Personen auf A] + E[Anzahl Personen auf B]

2

3

1

1

= E[Anzahl Personen auf A] + (3 − E[Anzahl Personen auf A])

2

3

1

6

a)

= 1 + E[Anzahl Personen auf A] =

6

5

4. Für beliebige Ereignisse A1 , . . . , An gilt:

1{A1 ∪...∪An } = 1 − 1{A1 ∪...∪An }c = 1 − 1{Ac1 ∩...∩Acn }

n

Y

= 1−

1Aci = 1 − Πni=1 (1 − 1Ai ).

i=1

Siehe nächstes Blatt!

Wir multiplizieren nun das Produkt auf der rechten Seite aus in eine Summe.

Bemerke, dass wir genau einen Summanden gleich 1 haben. Zudem haben wir n

Summanden der Form 1Ai für i = 1, . . . , n. Weiter haben wir Summanden der

Form 1Ai 1Ai0 für alle 1 ≤ i < i0 ≤ n, usw. Unter Berücksichtigung der Vorzeichen

erhalten wir schliesslich

1{A1 ∪...∪An } = 1 − Πni=1 (1 − 1Ai )

n

X

= 1− 1+

(−1)k

=

(−1)k+1

k=1

1Ai1 · . . . · 1Aik

1≤i1 <...<ik ≤n

k=1

n

X

!

X

X

1Ai1 · . . . · 1Aik .

1≤i1 <...<ik ≤n

Nehme Erwartungswert auf beiden Seiten:

E[1{A1 ∪...∪An } ] = P [A1 ∪ . . . ∪ An ]

= 1 − E[Πni=1 (1 − 1Ai )]

n

X

X

=

(−1)k+1

E[1Ai1 · . . . · 1Aik ]

=

k=1

n

X

k=1

1≤i1 <...<ik ≤n

(−1)k+1

X

1≤i1 <...<ik ≤n

P [Ai1 ∩ . . . ∩ Aik ]

(1)