I. Grundlagen

Werbung

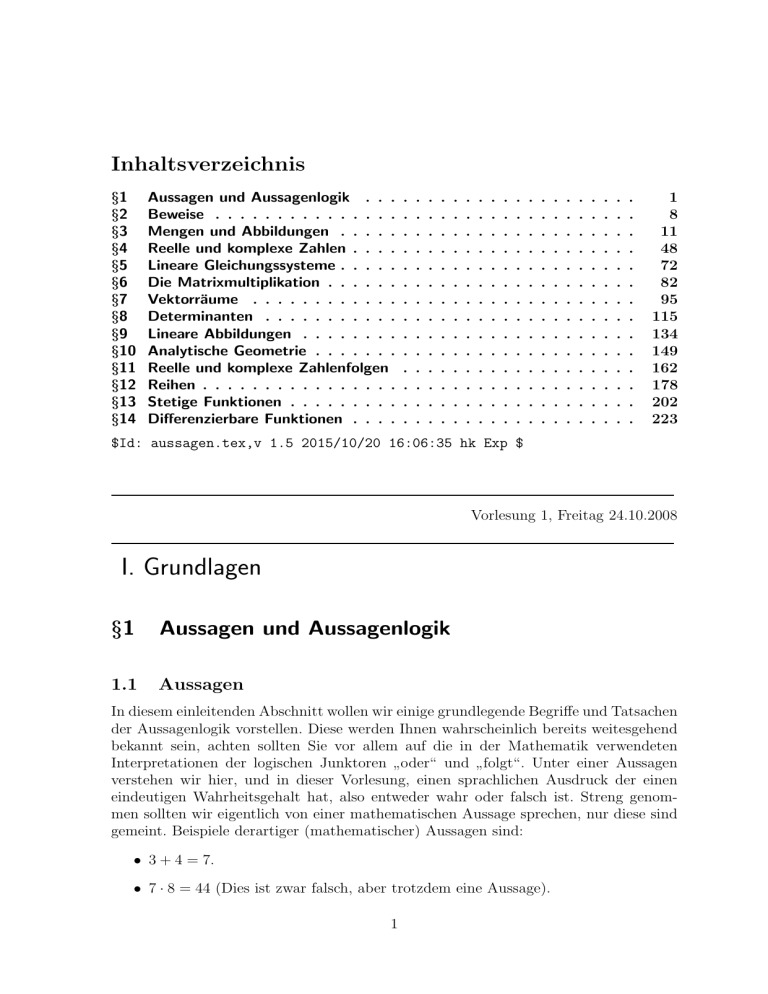

Inhaltsverzeichnis

§1

§2

§3

§4

§5

§6

§7

§8

§9

§10

§11

§12

§13

§14

Aussagen und Aussagenlogik . . .

Beweise . . . . . . . . . . . . . . .

Mengen und Abbildungen . . . . .

Reelle und komplexe Zahlen . . . .

Lineare Gleichungssysteme . . . . .

Die Matrixmultiplikation . . . . . .

Vektorräume . . . . . . . . . . . .

Determinanten . . . . . . . . . . .

Lineare Abbildungen . . . . . . . .

Analytische Geometrie . . . . . . .

Reelle und komplexe Zahlenfolgen

Reihen . . . . . . . . . . . . . . . .

Stetige Funktionen . . . . . . . . .

Differenzierbare Funktionen . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

1

8

11

48

72

82

95

115

134

149

162

178

202

223

$Id: aussagen.tex,v 1.5 2015/10/20 16:06:35 hk Exp $

Vorlesung 1, Freitag 24.10.2008

I. Grundlagen

§1

Aussagen und Aussagenlogik

1.1

Aussagen

In diesem einleitenden Abschnitt wollen wir einige grundlegende Begriffe und Tatsachen

der Aussagenlogik vorstellen. Diese werden Ihnen wahrscheinlich bereits weitesgehend

bekannt sein, achten sollten Sie vor allem auf die in der Mathematik verwendeten

Interpretationen der logischen Junktoren oder“ und folgt“. Unter einer Aussagen

”

”

verstehen wir hier, und in dieser Vorlesung, einen sprachlichen Ausdruck der einen

eindeutigen Wahrheitsgehalt hat, also entweder wahr oder falsch ist. Streng genommen sollten wir eigentlich von einer mathematischen Aussage sprechen, nur diese sind

gemeint. Beispiele derartiger (mathematischer) Aussagen sind:

• 3 + 4 = 7.

• 7 · 8 = 44 (Dies ist zwar falsch, aber trotzdem eine Aussage).

1

Mathematik für Ingenieure I, WS 2008/2009

Freitag 24.10.2008

• Die 5-te Nachkommastelle von π ist 9.

Alle diese Ausdrücke sind definitiv, und ohne jeden Verhandlungsspielraum jeweils wahr

oder falsch. Definitiv keine Aussagen in unserem Sinn sind dagegen Ausdrücke wie

• Dieses Gebäude müsste dringend gestrichen werden.

• Diese Vorlesung ist langweilig.

• Die Tafel ist grün.

Die ersten beiden dieser Beispiele sind reine Meinungsäußerungen, diese haben zwar für

eine gegebene Person zu einem bestimmten Zeitpunkt einen gewissen Wahrheitswert,

dieser ist aber sicher nicht definitiv festgelegt. Das dritte Beispiel ist dagegen bereits

von einer etwas objektiveren Natur. Trotzdem werden derartige von realen, physikalischen Objekten handelnde Aussagen üblicherweise nicht als mathematische Aussagen

behandelt, da ihr Wahrheitsgehalt stark vom Kontext abhängt. Man kann fragen was

den grün“ bedeutet, ob die Tafel selbst grün ist oder nur ihre Reflexion unter Licht”

einstrahlung grün ist, ob die Tafel bei völliger Dunkelheit noch immer grün ist, und so

weiter. Wir wollen uns auf Aussagen beschränken, die nur von mathematischen Objekten handeln. Im Rahmen der Mathematik ist dies eine sinnvolle Einschränkung, da wir

Aussagen wirklich im mathematischen Sinne beweisen wollen. Dies ist für Aussagen

über physikalische Objekte schlichtweg nicht möglich. Vielleicht ändern sich ja morgen die Naturgesetze schlagartig, das ist keine sehr realistische Befürchtung, aber rein

logisch immer denkbar.

In einer anderen Hinsicht sind wir dagegen recht großzügig, es ist nicht nötig zu

wissen ob eine mathematische Aussage nun wahr oder falsch ist, es kommt nur darauf

an, daß sie eines von beiden ist. Beispiele solcher zweifelsfrei mathematischen Aussagen,

deren Wahrheitsgehalt wir zur Zeit nicht kennen sind:

• Die 104000 -te Nachkommastelle von π ist eine 7.

n

• Es gibt eine Fermat-Primzahl (das sind Primzahlen der Form 22 + 1), die größer

als 65537 = 216 + 1 ist.

• Es gibt beliebig große natürliche Zahlen n so, dass unter den ersten n Nachkommastellen von π die 7 genauso oft wie die 3 vorkommt.

Welche dieser Aussagen wahr oder falsch sind ist nicht bekannt. Für die dritte Aussage

können wir uns sogar ziemlich sicher sein, das man das nie wissen wird. Trotzdem

sind alle drei Aussagen auch mathematische Aussagen in unserem Sinn, denn entweder

wahr oder falsch sind sie allemal, auch wenn wir nicht wissen welche dieser beiden

Möglichkeiten nun zutrifft.

Außerdem dürfen Aussagen auch von freien Parametern abhängen. Zum Beispiel

können wir die Aussage x2 = 4 betrachten, in der x für eine reelle Zahl steht. Ob diese

Aussage wahr oder falsch ist, hängt vom konkreten Wert von x ab, aber wahr oder

falsch ist sie immer, unabhängig von x.

2

Mathematik für Ingenieure I, WS 2008/2009

Freitag 24.10.2008

Wir nennen zwei Aussagen A und B äquivalent wenn entweder A und B beide wahr

sind oder A und B beide falsch sind. Alternativ sagen wir auch, A genau dann wenn

”

B“, oder A und B sind gleichbedeutent“, und so weiter. In Formelnotation wird die

”

Äquivalenz der beiden Aussagen A und B als A ⇔ B geschrieben.

1.2

Logische Junktoren

Es gibt verschiedene Konstruktionen aus bereits gegebenen Aussagen A, B, . . . neue

Aussagen zusammenzusetzen. Diese werden gelegentlich als aussagenlogische Junktoren

bezeichnet. Der einfachste dieser Junktoren ist die Verneinung. Ist A eine Aussage, so

ist die Verneinung von A die Aussage ¬A, die genau dann wahr ist wenn A falsch ist.

Ebenfalls ohne Überraschungen ist die Konjuktion, oder simpler die und“, Aussage.

”

Bei dieser sind zwei Aussagen A, B gegeben, und man bildet die neue Aussage A ∧ B,

gesprochen als A und B, die genau dann wahr ist wenn beide Aussagen A und B wahr

sind.

Diese Festlegungen sollten nicht besonders überraschend sein. Der nächste unserer

Junktoren wird nun die Disjunktion, beziehungsweise oder“ Aussage, sein. Hier gibt es

”

ein kleines Detail zu beachten, die Bedeutung der Disjunktion weicht gelegentlich etwas

von der sonst üblichen Verwendung dieses Wortes ab. Sind A, B wieder zwei Aussagen,

so ist die Disjunktion A ∨ B, gesprochen als A oder B, genau dann wahr wenn eine der

beiden Aussagen A, B wahr ist. Hierbei ist immer der Fall erlaubt, dass sogar beide

Aussagen A, B wahr sind. In der umgangssprachlichen Verwendung des Wortes hängt

es dagegen gelegentlich vom vorliegenden Kontext ab, ob auch die Gültigkeit beider

Aussagen möglich ist. Beachte weiter, dass mit eine der beiden Aussagen“ implizit

”

mindestens eine der beiden Aussagen“ gemeint ist. Dies ist die übliche Konvention,

”

bei derartigen Zahlangaben ist immer implizit mindestens“ gemeint. Sagen wir bei”

spielsweise, dass zwei der drei natürlichen Zahlen a, b, c gerade sind. so ist ebenfalls

erlaubt das sogar alle drei Zahlen gerade sind.

Wollen wir dagegen sagen, dass eine, aber nicht alle beide, der Aussagen A, B wahr

sind, so sagen wir das genau eine der beiden Aussagen A, B wahr ist. Dies ist dann

das sogenannte ausschließende, oder exklusive, oder. Dieses kommt innerhalb der Mathematik relativ selten vor, und es hat daher auch kein allgemein verwendetes Symbol.

Gelegentlich ist es klarer logische Junktoren in Form sogenannter Wahrheitstabellen zu

beschreiben. Die Tabellen für Konjunktion und Disjunktion haben dabei die folgende

Form:

@A

A ∨ B: B

@ 0 1

0 0 1

1 1 1

A

A ∧ B: @

B @ 0 1

0 0 0

1 0 1

In diesen Tabellen schreiben wir 0 für falsch“ und 1 für wahr“. Dies soll nicht etwa

”

”

bedeuten, dass die Zahlen 0 und 1 irgendetwas mit wahr“ und falsch“ zu tun haben,

”

”

es handelt sich nur um Symbole für diese Begriffe. Alternativ könnten wir auch f

3

Mathematik für Ingenieure I, WS 2008/2009

Freitag 24.10.2008

und w anstelle von 0 und 1 schreiben. Bei Formeln in denen mehr als zwei Aussagen

vorkommen ist diese simple Form einer Wahrheitstabelle nicht mehr möglich. Man

behilft sich dann mit einer tabellarischen Auflistung etwa der folgenden Form (in diesem

Beispiel für A ∨ (B ∧ C) mit drei Aussagen A, B, C):

A B C

0 0 0

0 0 1

0 1 0

0 1 1

1 0 0

1 0 1

1 1 0

1 1 1

A ∨ (B ∧ C)

0

0

0

1

1

1

1

1

Zur Illustration der Verwendung dieser logischer Junktoren, sowie als ein erstes kleines Beispiel eines Beweises, wollen wir nun die sogenannten de Morganschen Regeln

beweisen. Diese beschreiben den Zusammenhang der Verneinung mit Konjuktion und

Disjunktion, und dürften Ihnen wahrscheinlich bekannt.

Satz 1.1 (De Morgansche Regeln)

Seien A, B zwei Aussagen. Dann gelten:

(a) Es ist ¬(A ∨ B) ⇐⇒ (¬A) ∧ (¬B).

(b) Es ist ¬(A ∧ B) ⇐⇒ (¬A) ∨ (¬B).

Beweis: (a) Die Aussage ¬(A ∨ B) ist genau dann wahr, wenn A ∨ B falsch ist, d.h.

wenn A und B beide falsch. Dies bedeutet aber gerade, dass ¬A und ¬B beide wahr

sind, und dies besagt (¬A) ∧ (¬B).

(b) Dieses könnten wir analog zu (a) beweisen, da es uns hier aber um ein Beispiel eines

Beweises, und nicht um die De Morganschen Regeln selbst, geht, führen wir hier einen

anderen Beweis vor, der (b) auf den bereits bewiesenen Teil (a) des Satzes zurückführt.

Wir haben nämlich die folgende Kette von Äquivalenzumformungen:

¬(A ∧ B) ⇐⇒ ¬((¬¬A) ∧ (¬¬B))

⇐⇒ ¬¬((¬A) ∨ (¬B))

(a)

⇐⇒ (¬A) ∨ (¬B),

wobei wir Teil (a) auf die beiden Aussagen ¬A und ¬B anstelle von A und B anwenden.

Alternativ können wir Teil (a), und natürlich auch (b), auch mit Hilfe unserer Wahrheitstafeln einsehen. Zu diesem Zweck wird für beide Seiten der zu beweisenden Äquivalenz die jeweilige Wahrheitstafel aufgestellt, und überprüft das die beiden so entstehenden Tafeln identisch sind. Dies zeigt dann, dass die eine Aussage genau dann

4

Mathematik für Ingenieure I, WS 2008/2009

Freitag 24.10.2008

wahr ist, wenn auch die andere wahr ist, und dies bedeutet genau die Äquivalenz der

betrachteten Aussagen. Für die erste der beiden de Morganschen Regeln hätten wir

dabei die Tafeln

¬(A ∨ B) :

(¬A) ∧ (¬B) :

0 1

0 1 0

1 0 0

0 1

0 1 0

1 0 0

Die Verwendung von Wahrheitstafeln sieht so aus, als wäre es eine eigenständige Beweismethode, aber in Wahrheit ist es nur eine kompakte Darstellung eines direkten

Beweises. Im Grunde machen wir dort ja nur eine vollständige Fallunterscheidung, und

könnten die Tabelle durch einen Text der Form Sind A und B beide falsch, so sind

”

auch ¬(A ∨ B) und (¬A) ∧ (¬B) beide wahr. Sind A wahr aber B falsch, so ...“ ersetzen. In diesem Stil kann ein Beweis durch Wahrheitstafeln rein mechanisch in einen

gewöhnlichen textlichen Beweis überführt werden.

1.3

Die Implikation

Der letzte noch zu diskutierende logische Junktor ist die Implikation oder auch Folgerung. Sind A, B zwei Aussagen, so ist die Aussage A ⇒ B, gesprochen als aus A

”

folgt B“ oder A impliziert B“, wahr wenn mit A auch B stets wahr ist. In Form einer

”

Wahrheitstafel soll diese Festlegung gerade

A

A ⇒ B: @

B @ 0 1

0 1 0

1 1 1

bedeuten. Beachte das die Implikation A ⇒ B insbesondere immer dann wahr ist

wenn die Voraussetzung A der Implikation falsch ist. Anders gesagt soll aus einer

falschen Aussage jede beliebige andere Aussage folgen. Dies erscheint zunächst als eine

etwas merkwürdige Festlegung, aber dieser Eindruck sollte bei näherer Betrachtung

verfliegen. Umgangssprachlich würde man eine Aussage der Form Wenn morgen das

”

Hörsaalgebäude einstürzt, so fällt die Vorlesung aus“, als wahr betrachten unabhängig

davon ob das Gebäude morgen noch steht, selbst dann wenn die Vorlesung trotz eines

in bestem Zustand befindlichen Hörsaals ausfällt.

Ein weiterer Grund für die angegebene Interpretation der Implikation, der für die

Mathematik auch erheblich schwerwiegender ist, sind Aussagen in denen noch freie

Variablen vorkommen. Steht x beispielsweise für eine reelle Zahl, so sollte die Aussage

x2 = 4 =⇒ x = 2 ∨ x = −2

immer wahr sein, unabhängig davon welchen konkreten Wert x jetzt hat.

In der nächsten Sitzung werden wir den Implikationsbegriff noch etwas genauer

besprechen.

5

Mathematik für Ingenieure I, WS 2008/2009

Dienstag 28.10.2008

Vorlesung 2, Dienstag 28.10.2008

Der folgende Satz zeigt nun, dass sich die Implikation auch durch und“ und oder“

”

”

ausdrücken läßt.

Satz 1.2: Seien A, B zwei Aussagen. Dann gelten:

(a) Es ist ¬(A ⇒ B) ⇐⇒ A ∧ (¬B).

(b) Es ist (A ⇒ B) ⇐⇒ (¬A) ∨ B.

Beweis: (a) Die Verneinung ¬(A ⇒ B) ist genau dann wahr, wenn A ⇒ B falsch ist,

also wenn A wahr aber B falsch ist. Letzteres bedeutet aber genau die Gültigkeit von

A ∧ (¬B).

(b) Mit Teil (a) und den de Morganschen Regeln Satz 1 haben wir die folgende Kette

von Äquivalenzumformungen:

(A ⇒ B) ⇐⇒

⇐⇒

⇐⇒

⇐⇒

¬¬(A ⇒ B)

¬(A ∧ (¬B))

(¬A) ∨ (¬¬B)

(¬A) ∨ B.

Insbesondere scheint die Implikation damit auf derselben inhaltlichen Stufe wie und“

”

und oder“ zu stehen, was Sie zumindest irritieren sollte. Dieser Eindruck täuscht auch

”

in gewisser Weise, denn der in Satz 2 verwendete Implikationsbegriff ist rein formaler

Natur. Es kommt dort nur auf den Wahrheitswert der Aussagen A und B an, nicht

aber auf die inhaltliche Bedeutung dieser Aussagen. Diesen Implikationsbegriff sollte

man nicht mit dem inhaltlichen Folgerungsbegriff verwechseln, dass also eine Aussage B

durch logsiches Schließen aus einer Aussage A folgt. Bei letzterem kommt es tatsächlich

auf die Bedeutung von A und B an. Die formale Untersuchung des Folgerungsbegriffs

gehört zur mathematischen Logik, beziehungsweise zur sogenannten Beweistheorie, und

wird nicht Gegenstand dieser Vorlesung sein. Wir wollen hier nur darauf hinweisen,

dass diese Fragen gelegentlich sogar eine gewisse praktische Bedeutung haben, zum

Beispiel für Dinge wie formale Korrektheitsbeweise für Computerprogramme in der

(theoretischen) Informatik.

Zum Abschluss dieses Abschnitts wollen wir noch kurz das sogenannte Kontrapositionsprinzip herleiten.

Satz 1.3 (Kontrapositionsprinzip)

Seien A, B zwei Aussagen. Dann ist A ⇒ B zu (¬B) ⇒ (¬A) äquivalent.

6

Mathematik für Ingenieure I, WS 2008/2009

Dienstag 28.10.2008

Beweis: Dies können wir leicht auf den vorherigen Satz 2 zurückführen. Wir haben

nämlich die Äquivalenzen:

A ⇒ B ⇐⇒ (¬A) ∨ B ⇐⇒ (¬¬B) ∨ (¬A) ⇐⇒ (¬B) ⇒ (¬A).

1.4

Modellierung

Bei unserer Einführung mathematischer Aussagen haben wir uns ausdrücklich auf Aussagen beschränkt, die nur von mathematischen Objekten handeln. Andere Aussagetypen, etwa über reale physikalische Gegenstände, sollen dagegen nicht Gegenstand der

Mathematik sein. Auch später in dieser Vorlesung werden wir uns in ähnlichen Situationen immer auf diesen strikten Standpunkt stellen. Dies vereinfacht zwar unsere

Diskussion, man könnte aber den Eindruck gewinnen die Mathematik wäre nur ein

nicht besonders nützliches Puzzlespiel.

Dieser Eindruck täuscht natürlich, tatsächlich sind weite Teile der Mathematik

sogar ausdrücklich zur Lösung konkreter physikalischer und anderer angewandter Probleme entwickelt worden. Man kann sich die Anwendung mathematischer Methoden

auf konkrete Probleme im Prinzip als in drei Phasen aufgeteilt denken. Zuerst wird

die gegebene Anwendungssituation modelliert, d.h. den realen Gegenstände und Konzepten werden sie repräsentierende mathematische Objekte zugeordnet, und die Beziehungen zwischen ihnen werden in Beziehungen zwischen diesen mathematischen Objekten übertragen. Dieser Modellierungsprozess ist kein Teil der Mathematik sondern

ein Thema der für die jeweilige Anwendungssituation zuständigen Theorie. Nachdem

diese Modellierung erfolgt ist, wird die entstandene Situation innerhalb der Mathematik untersucht und ausgewertet. Nur dieser Teil ist Mathematik im eigentlichen Sinn,

und damit Gegenstand dieser Vorlesung. Zum Abschluß werden dann die erhaltenen

Resultate für das vorliegende konkrete Problem ausgewertet, und gegebenenfalls weiter

untersucht, etwa durch Messungen oder andere empirische Methoden.

Dies ist natürlich eine idealisierte Beschreibung, in realen Beispielen werden die

obigen drei Schritte natürlich miteinander vermischt werden und in einem iterativen

Prozess mehrfach wiederholt und verfeinert werden. Wir wollen hier kurz ein Beispiel

beschreiben, bei dem sich die Trennung in Modellierung und mathematische Beschreibung ungewöhnlich deutlich vornehmen läßt. Als solch ein Beispiel wollen wir hier die

Bewegung der Planeten um die Sonne verwenden.

Die Zeit modellieren wir hier wie eigentlich immer durch eine reelle Zahl. Der zu betrachtende Planet wird zum Zeitpunkt t durch einen Punkt p(t) im Raum sowie durch

eine weitere Zahl m, die seine Masse angibt, beschrieben. Wie immer in solchen Fällen

werden die meisten Details der Situation ignoriert, in Wahrheit ist ein Planet ja kein

Punkt, er hat keine zeitlich konstante Masse und so weiter. Welche Details zu berücksichtigen und welche zu vernachlässigen sind, ist eine Entscheidung der Physik und

7

Mathematik für Ingenieure I, WS 2008/2009

Dienstag 28.10.2008

kein mathematisches Problem. Ebenso beschreiben wir die Sonne durch eine Position

s(t) und eine Masse M . Das Gravitationsgesetz übersetzen wir nun in die Definition

der Funktion

mM

F (t) := −γ

(p(t) − s(t)).

||p(t) − s(t)||3

Schließlich übersetzt sich das Bewegungsgesetz in die Differentialgleichung mp00 (t) =

F (t) und analog ergibt sich eine Differentialgleichung für s(t). Damit ist die Modellierung abgeschlossen, als mathematische Objekte haben wir die Zahlen γ, m, M und die

beiden Funktionen p(t), s(t), und unsere Differentialgleichungen geben die Beziehungen

zwischen diesen Objekten an.

Damit sind wir in der rein mathematischen Phase Zwei, die hier in der Lösung unserer Differentialgleichung besteht. Natürlich kann es heuristisch nützlich sein, sich über

das unterliegende physikalische Problem im klaren zu sein, aber im Prinzip haben wir

hier eine mathematische Aufgabe. Die Lösungsdetails wollen wir hier nicht diskutieren,

diese kennen Sie vielleicht aus der Schule oder aus Ihrer Physikvorlesung. Als Ergebnis

erhalten wir jedenfalls, bei geeigneten Anfangsbedingungen und Werten von m und

M , die üblichen Ellipsenbahnen. In der Auswertungsphase können wir dann hieraus

beispielsweise die Keplerschen Gesetze herleiten. Beachte das es sich hierbei keinesfalls

um einen mathematischen Beweis der Keplerschen Gesetze handelt, unsere ursprüngliche Differentialgleichung ist ja nicht mathematisch sondern physikalisch begründet

worden.

Umgekehrt bedeutet ein nicht mit der Realität übereinstimmendes Ergebnis der

mathematischen Untersuchung nicht notwendig, dass diese fehlerhaft ist. Ebensogut

kann die verwendete Modellierung der Sitaution nicht angemessen sein. Zur detaillierteren Beschreibung der Bahnen von Jupiter und Saturn reicht unser obiges Modell

zum Beispiel nicht aus, da es die Anziehung zwischen diesen beiden Planeten völlig

ignoriert. Ebenso scheitert unser Modell beispielsweise an der Beschreibung von Satelietenbahnen um die Erde, hier ist die Modellierung der Erde durch einen Punkt nicht

mehr angemessen, die exakte Form der Erde sowie ihre inhomogene Masseverteilung

spielen hier eine Rolle, die von unserem simplen Modell nicht berücksichtigt wird.

$Id: beweise.tex,v 1.3 2009/02/25 08:58:56 hk Exp $

§2

Beweise

Die Aussagen der Mathematik werden in Form sogenannter Sätze beschrieben. Dabei verwenden wir das Wort Satz“ hier als einen Oberbegriff, einige Sätze werden

”

gerne auch mit Namen wie Lemma“, Theorem“, Hilfssatz“ und so weiter versehen,

”

”

”

und auch andere Resultate wie etwa Rechenverfahren und Algorithmen interpretieren

wir hier als mathematische Sätze. Jeder mathematische Satz besteht aus einer oder

8

Mathematik für Ingenieure I, WS 2008/2009

Dienstag 28.10.2008

mehreren Voraussetzungen und einer Behauptung. Zur Begründung eines solchen Satzes wird dann ein Beweis angegeben, dies ist eine Kette logischer Folgerungen, die aus

den Voraussetzungen des Satzes auf seine Behauptung schließt. Das Wort Beweis“

”

wird hierbei wesentlich enger als im normalen Sprachgebrauch verwendet, Plausibilitätsbetrachtungen und heuristische oder empirische Begründungen reichen keinesfalls

aus. Ein Beweis muss eine vollständige logische Folgerungskette sein. Je nach intendierten Leserkreis wird ein mathematischer Beweis oft nicht in dieser Vollständigkeit

wirklich hingeschrieben, dies ist aber nicht wesentlich, es muss nur klar sein, dass man

die fehlenden Teile der Folgerungskette nötigenfalls hinzufügen könnte.

Ein Beweis verfolgt hauptsächlich zwei Zwecke. Zum einen begründet er überhaupt

die Gültigkeit eines mathematischen Satzes, empirische oder heuristische Argumente

reichen hierzu, wie bereits bemerkt, nicht aus. Auf der anderen Seite soll ein Beweis seinen Satz natürlich auch erklären. Insbesondere kann es durchaus sinnvoll sein, verschiedene Beweise ein und desselben Satzes zu kennen, wenn diese Beweise den fraglichen

Satz von verschiedenen Gesichtspunkten aus begründen.

Es gibt im wesentlichen zwei Grundtypen von Beweisen. Der erste, und auch wichtigste, Typ ist dabei der sogenannte direkte Beweis. Hier wird die Aussage des Satzes

durch eine direkte Folgerungskette aus den Voraussetzungen hergeleitet. Gerade in dieser Vorlesung bestehen viele dieser direkten Folgerungen auch aus Gleichungsketten.

Als ein simples Beispiel eines direkten Beweises wollen wir hier einmal die Ihnen aus

der Schule bekannte binomische Formel (a + b)2 = a2 + 2ab + b2 für alle reellen Zahlen

a, b, behandeln. Aufgeteilt in Voraussetzung, Behauptung und Beweis, können wir dies

wie folgt hinschreiben:

Vor: Seien a, b zwei reelle Zahlen.

Beh: Es gilt (a + b)2 = a2 + 2ab + b2 .

Bew: Es gilt

(a + b)2 =

=

=

=

(a + b) · (a + b)

a · (a + b) + b · (a + b)

a2 + ab + ba + b2

a2 + 2ab + b2 .

Diese explizite Aufteilung in Voraussetzung und Behauptung ist ein bei der Bearbeitung von Übungsaufgaben beliebter Stil, in normalen Texten werden diese beiden

normalerweise zusammengefasst.

Wir kommen nun zum zweiten Beweistyp, dem sogenannten Widerspruchsbeweis.

In diesem ist eine Aussage A zu beweisen, und wir nehmen anstelle dessen an, dass

ihre Verneinung ¬A wahr ist. Dann wird aus der angenommenen Gültigkeit von ¬A

eine andere Aussage B hergeleitet, und weiter gezeigt das aus ¬A auch die Verneinung

¬B von B folgt. Wäre also ¬A wahr, so müssten gleichzeitig B und ¬B gelten, was

natürlich nicht möglich ist. Damit hat die Annahme von ¬A zu einem Widerspruch

9

Mathematik für Ingenieure I, WS 2008/2009

Dienstag 28.10.2008

geführt. Andererseits ist die mathematische Aussage A ja entweder wahr oder falsch,

und da ¬A nicht wahr, also A nicht falsch, sein kann, muss A wahr sein.

Dies wird klarer wenn wir es an einem

konkreten Beispiel betrachten. Der klassi√

sche Widerspruchsbeweis zeigt, dass 2 keine rationale Zahl, also kein Bruch

zweier

√

natürlicher Zahlen sein kann. Unsere Aussage A ist hier die Aussage

2 ist keine

”

rationale Zahl“.√Für einen Widerspruchsbeweis müssen wir ¬A annehmen, d.h. wir

nehmen √

an das 2 doch eine rationale Zahl ist. Dann gibt es zwei natürliche Zahlen

p, q mit 2 = p/q. Durch eventuelles Auskürzen können wir dabei annehmen, dass p

und q keinen gemeinsamen Teiler haben. Dies ist dann unsere Aussage B, also p und

”

q sind teilerfremd“. Nun rechnen wir

p2

=

q2

2

√ 2

p

= 2 = 2,

q

d.h. es ist p2 = 2q 2 . Somit ist p2 gerade und damit muss auch p gerade sein. Folglich ist

r := p/2 eine natürliche Zahl mit p = 2r, und setzen wir dies in die gerade bewiesene

Formel ein, so ergibt sich

2q 2 = p2 = (2r)2 = 4r2 ,

also ist auch q 2 = 2r2 gerade. Damit ist aber auch q gerade, d.h. p und q haben den

gemeinsamen Teiler 2. Also ist auch die Verneinung ¬B eingesehen,

und wir haben einen

√

Widerspruch. Dieser Widerspruch beweist dann, dass 2 tatsächlich keine rationale

Zahl ist.

Damit haben wir beide Grundtypen von Beweisen, den direkten und den indirekten, oder Widerspruchsbeweis, vorgestellt. Komplizierte Beweise sind dann oftmals

Mischformen dieser beiden Typen. In diesem wird die eigentliche Aussage in mehreren

Teilschritten bewiesen, die dann ihrerseits direkte oder indirekte Beweise sind.

Gelegentlich wird noch der sogenannte Beweis durch Kontraposition als ein eigener, dritter, Grundtyp angesehen. Bei einem Beweis durch Kontraposition ist eine

Aussage der Form A ⇒ B zu zeigen, und man zeigt anstelle dessen die Implikation

(¬B) ⇒ (¬A). Nach dem Kontrapositionsprinzip §1.Satz 3 sind diese beiden Implikationen zueinder äquivalent. Insbesondere ist ein Beweis durch Kontraposition eigentlich

ein direkter Beweis, dessen letzte Aktion in der Anwendung des Kontrapositionsprinzips besteht. Oftmals wird ein Kontrapositionsbeweis auch als Widerspruchsbeweis

verkauft, das ist zwar nicht falsch aber etwas unelegant. Das Vorgehen ist dann wie

folgt: Zu zeigen ist die Aussage A ⇒ B, und wir nehmen ¬(A ⇒ B) an. Nach Satz

2 bedeutet dies, dass wir A ∧ (¬B) annehmen. Dann wird der Beweis der Aussage

(¬B) ⇒ (¬A) durchgeführt, und da ¬B vorausgesetzt ist, haben wir dann den Widerspruch ¬A. Wird bei der Herleitung von ¬B die Aussage A tatsächlich verwendet, so

handelt es sich um einen echten Widerspruchsbeweis. Andernfalls liegt ein als Widerspruchsbeweis verpackter Beweis durch Kontraposition vor.

$Id: mengen.tex,v 1.8 2015/10/20 16:10:51 hk Exp $

10

Mathematik für Ingenieure I, WS 2008/2009

Freitag 31.10.2008

Vorlesung 3, Freitag 31.10.2008

§3

Mengen und Abbildungen

3.1

Mengen

Eine Menge fasst eine Gesamtheit mathematischer Objekte zu einem neuen Objekt

zusammen. Die klassische informelle Definition einer Menge geht auf Cantor zurück,

und lautet wie folgt: Unter eine Menge“ verstehen wir jede Zusammenfassung M von

”

bestimmten wohlunterschiedenen Objekten unserer Anschauung oder unseres Denkens,

welche die Elemente von M genannt werden, zu einem Ganzen. Für die Mathematik ist

der Mengenbegriff von grundlegender Bedeutung, in der Tat kann die gesamte Mathematik vollständig aus dem Begriff einer Menge und einigen wenigen anderen Grundbegriffen aufgebaut werden. Für die Zwecke dieser Vorlesung ist dies allerdings ohne jede

Bedeutung, für uns wird der Mengenbegriff einfach eine bequeme Schreibweise sein.

Wie schon aus §1 gewohnt, werden wir auch den Mengenbegriff wesentlich enger

interpretieren als es die obige Definition nahelegt. Wir wollen ausschließlich mathematische Objekte, also beispielsweise die verschiedenen Sorten von Zahlen, Funktionen

und so weiter, als Elemente einer Menge zulassen. Insbesondere betrachten wir keine

Mengen, die abstrakte Konzepte oder auch reale physikalische Gegenstände als Elemente enthalten. Ersteres wäre für unsere Zwecke sinnlos, und die Betrachtung physikalischer Objekte führt wieder auf Fragen, die in der Mathematik nichts zu suchen

haben. Beispielsweise kann man sich streiten inwieweit verschiedene Elektronen wohlunterschiedene Objekte sind, in einem gewissen Sinne sind alle Elektronen gleich und

unterscheiden sich nur in Bezug auf externe Objekte. All dies können wir vermeiden

indem wir ausschließlich mathematische Objekte als Elemente von Mengen erlauben,

und daher werden wir uns im Folgenden auf diesen Standpunkt stellen. Beachte dabei

das Mengen selbst dann mathematische Objekte sind, und somit als Elemente anderer

Mengen zugelassen sind, d.h. Mengen können andere Menge als Elemente enthalten.

Sind M eine Menge und x ein mathematisches Objekt, so schreiben wir x ∈ M wenn

x ein Element von M ist, d.h. die Formel x ∈ M steht für die Aussage x ist ein Ele”

ment von M“. Ist x dagegen kein Element von M , so notieren wir dies als x ∈

/ M . Die

Aussage x ∈

/ M ist also die Verneinung ¬(x ∈ M ) von x ∈ M . Wie alle mathematischen

Objekte sind Mengen vollständig statische Gebilde, Elemente können eine Menge nicht

verlassen und andere Objekte können nicht als neue Elemente hinzukommen. Natürlich

können wir zu einer gegebenen Menge M durch Entfernen oder Hinzufügen von Ele11

Mathematik für Ingenieure I, WS 2008/2009

Freitag 31.10.2008

menten eine neue Menge N bilden, aber diese ist von M verschieden. Mengen sind

eben keine Containerobjekte wie man sie aus einigen Programmiersprachen gewohnt

ist. Eine Menge ist durch ihre Elemente vollständig bestimmt und besitzt keine darüber

hinausgehende, eigenständige Identität. Dies ist das sogenannte Extensionalitätsprinzip, zwei Mengen M, N sind genau dann gleich M = N wenn für jedes mathematische

Objekt x genau dann x ∈ M gilt wenn auch x ∈ N ist. In anderen Worten ist genau

dann M = N wenn die Aussagen x ∈ M und x ∈ N für mathematische Objekte x

äquivalent sind.

Wir wollen nun die üblichen Methoden zur Beschreibung von Mengen diskutieren.

Die einfachste Art eine Menge festzulegen ist durch explizite Angabe ihrer Elemente.

Die hierfür übliche Notation schließt die aufgelisteten Elemente in Klammern {“ und

”

}“ ein, also beispielsweise

”

M = {1, 2, 3}, M = {1, 2, {3, 4}}.

Dies sind beides Mengen mit jeweils 3 Elementen, im zweiten Beispiel ist die Menge

{3, 4} eines dieser drei Elemente von M . In dieser Notation ist es durchaus erlaubt ein

und dasselbe Element mehrfach aufzuführen, beispielsweise

M = {1, 2, 1} = {1, 2}.

Ein mathematisches Objekt x ist entweder ein Element einer Menge M oder nicht,

es kann nicht mehrfach Element von M sein. Natürlich ist ein Ausdruck wie {1, 2, 1}

nicht besonders sinnvoll, aber in anderen Fällen ist es sehr nützlich das mehrfache

Auflisten von Objekten in {. . .} zuzulassen. Angenommen wir haben beispielsweise

drei reelle Zahlen x, y, z, die wir noch nicht explizit kennen. Dann können wir einfach

M := {x, y, z} schreiben, ohne uns vorher zu überlegen welche Gleichheiten unter

den Zahlen x, y, z auftreten können. Hätten wir auf verschiedene Elemente in einem

Ausdruck {. . .} bestanden, so müßten wir Dinge wie Ist x = y = z, so sei M := {x},

”

ist x = y 6= z, so sei M := {x, z}, . . .“ schreiben. Die von uns verwendete Konvention

dient also der Bequemlichkeit, und nicht dazu tatsächlich {1, 2, 1} zu schreiben. Man

muss sich allerdings damit abfinden das eine Menge {x, y, z} nur höchstens 3 Elemente

hat, sie könnte auch 2 oder nur ein Element haben, je nachdem welche Gleichheiten

zwischen x, y, z auftreten. Als ein Randfall ist es auch zugelassen, dass überhaupt kein

Element vorkommt, also { }. Dies ist die sogenannte leere Menge, die eindeutige Menge

ohne Elemente. Diese Menge kommt so häufig vor, das sie ein eigenes, für sie reserviertes

Symbol, erhält.

Definition 3.1: Die Menge ∅ := { } heißt die leere Menge.

Ist M eine beliebige Menge, so sagen wir auch M ist leer“ für die Aussage M = ∅, d.h.

”

wenn M keine Elemente hat. Beachte übrigens das dies die erste Stelle in diesem Skript

ist, die wir explizit als eine Definition bezeichnen. Dies hat auch einen guten Grund,

alle unsere bisherigen Definitionen“ waren keine Definitionen im in der Mathematik

”

üblichen Sinn, sondern sie dienten allesamt nur der Einführung von Grundbegriffen.

12

Mathematik für Ingenieure I, WS 2008/2009

Freitag 31.10.2008

Eine Definition in der Mathematik ist im wesentlichen eine Abkürzung, die einen neuen

Begriff auf bereits vorhandene Konzepte zurückführt.

Es gibt einige weitere Mengen, die derart wichtig sind, das sie eigene, nur für sie

verwendete, Symbole erhalten. Dies sind im wesentlichen die folgenden Mengen:

N

N0

Z

Q

R

C

−

−

−

−

−

−

die

die

die

die

die

die

Menge

Menge

Menge

Menge

Menge

Menge

der

der

der

der

der

der

natürlichen Zahlen 1, 2, 3, . . .,

natürlichen Zahlen mit Null 0, 1, 2, . . .,

ganzen Zahlen . . . , −2, −1, 0, 1, 2, . . .,

rationalen Zahlen, also Brüche ganzer Zahlen,

reellen, also etwa aller auch unendlichen Dezimalbrüche,

komplexen Zahlen.

Die komplexen Zahlen C werden wir bald behandeln. Als natürliche Zahlen werden

gelegentlich auch alle Zahlen 0, 1, 2, . . . bezeichnet, ob 0 als natürliche Zahl zählt oder

nicht wird nicht ganz einheitlich gehandhabt.

Wir kommen nun zu einer kleinen Erweiterung der Schreibweise {. . .}. Bei dieser wird eine Menge definiert, indem ihre Elemente durch die Elemente einer bereits

vorhandenen Menge indiziert werden. Beispiele hierfür sind

M := {2k − 1|k ∈ N}

für die Menge 1, 3, 5, . . . der ungeraden, natürlichen Zahlen,

M := {a2 + b2 |a, b ∈ N}

für die Menge aller natürlichen Zahlen, die sich als Summe zweier Quadrate schreiben

lassen, also 2, 5, 8, 10, 13, 18, . . .. Mit dieser Notation können wir die rationalen Zahlen

beispielsweise als

p Q=

p ∈ Z, q ∈ N

q

schreiben. Eine weitere Notation bewirkt die Auswahl gewisser Elemente aus einer

gegebenen großen Menge heraus. Seien hierzu eine Menge M und eine Aussage A(x)

mit einer freien Variablen x gegeben. Dann bezeichnet

{x ∈ M |A(x)}

die Menge all derjenigen Elemente x von M , für die die Aussage A(x) wahr ist. Ist also

N := {x ∈ M |A(x)}, so sind für jedes Element x ∈ M die Aussagen x ∈ N und A(x)

äquivalent. Ein Beispiel für diese Notation ist etwa

{x ∈ N|x ist ungerade}

für die Menge der ungeraden natürlichen Zahlen. Als eine kleine Erweiterung lassen wir

auch die Notation {x|A(x)} zu, wenn wir aus der Bedingung A(x) eine größtmögliche

Menge M ablesen können, die alle mathematischen Objekte x mit A(x) enthält. Dann

13

Mathematik für Ingenieure I, WS 2008/2009

Freitag 31.10.2008

ist {x|A(x)} eine alternative Schreibweise für {x ∈ M |A(x)}. Ein sehr einfaches Beispiel

für diese erweiterte Notation ist etwa {x|x ∈ M ∧ A(x)}. Unsere eingangs gegebene

Definition“ einer Menge läßt auch eine völlig freie Mengenbildung {x|A(x)} zu, also

”

die Menge absolut aller mathematischen Objekte x mit A(x) zu betrachten. Diese

harmlos aussehende Bildung führt allerdings geradewegs in verheerende Widersprüche.

Der bekannteste dieser Widersprüche ist die sogenannte Russelsche Antinomie. Diese

betrachtet die folgende Menge

R := {M |M ist eine Menge mit M ∈

/ M }.

Dann ist entweder R selbst ein Element von R oder nicht. Gehen wir diese beiden

Möglichkeiten einmal durch. Zunächst nehme die erste Möglichkeit an, es sei also R ∈

R. Dies bedeutet aber das R eine Menge mit R ∈

/ R ist, was natürlich nicht geht.

Also muss wohl die zweite Möglichkeit zutreffen, d.h. es sollte R ∈

/ R sein. Dann ist R

aber eine Menge mit R ∈

/ R und nach unserer Definition von R ist somit R ∈ R. Dies

ist erneut ein Widerspruch. Damit haben wir einen Widerspruch in der Mathematik

selbst.

Es darf also nicht erlaubt so etwas wie die Menge R zu definieren. Daher bestehen

wir in unserer Notation {x ∈ M |A(x)} darauf, dass nur Elemente aus einer vorgegebenen, bereits vorhandenen, Menge M ausgewählt werden dürfen. Die freie Mengenbildung, die alle mathematischen Objekte x mit einer Bedingung A(x) zusammenfasst,

ist bei uns nicht erlaubt. Damit können wir die obige Menge R gar nicht sinnvoll

hinschreiben und haben den mit ihr verbundenen Widerspruch vermieden. Natürlich

könnte es einen raffinierteren Widerspruch geben, der mit Mengen der erlaubten Form

{x ∈ M |A(x)} auskommt, aber ein solcher ist nicht bekannt, und es rechnet auch niemand ernsthaft mit dieser Möglichkeit. Die Konstruktion der Menge {x ∈ M |A(x)}

legt den folgenden Teilmengenbegriff nahe.

Definition 3.2: Seien M und N zwei Mengen. Die Menge M heißt eine Teilmenge von

N , geschrieben als M ⊆ N , wenn jedes Element x ∈ M von M auch ein Element von

N ist. Weiter heißt M eine echte Teilmenge von N , geschrieben als M ( N , wenn

M ⊆ N und M 6= N ist.

Mit diesem Begriff ist dann {x ∈ M |A(x)} ⊆ M für jedes Menge M und jede Aussage

A(x). Viele Autoren verwenden auch das Symbol M ⊂ N , und je nach Autor meint

dies M ⊆ N oder M ( N . Die in diesem Skript verwendete Notation sollte dagegen

keine Mißverständnisse zulassen. Für können die Teilmengenbeziehung auch in Termen

des Implikationsbegriffs für Aussagen formulieren. Für zwei gegebene Mengen M, N

bedeutet M ⊆ N gerade, dass die Aussage (x ∈ M ) ⇒ (x ∈ N ) für jedes mathematische Objekt x wahr ist. Einige Beispiele für Teilmengenbeziehungen haben wir in der

folgenden Inklusionskette

N ( N0 ( Z ( Q ( R ( C.

Dagegen ist etwa {3, 4} 6⊆ {1, 2, {3, 4}}, denn beispielsweise ist 3 kein Element der

rechten Menge.

14

Mathematik für Ingenieure I, WS 2008/2009

Freitag 31.10.2008

Es gibt einen besonderen Randfall, der gelegentlich zu Verwirrungen führt. Ist beispielsweise die leere Menge eine Teilmenge von {1, 2, 3}, gilt also ∅ ⊆ {1, 2, 3}? Definitionsgemäß bedeutet dies, dass jedes Element x der leeren Menge auch ein Element von

{1, 2, 3} ist, und dies ist tatsächlich wahr obwohl es überhaupt keine Elemente in der

leeren Menge gibt. Dies kann man auf verschiedene Arten begründen, am einfachsten

ist es auf Zweifel zu fragen wo denn ein Element x ∈ ∅ sei, für das nicht x ∈ {1, 2, 3}

gilt? Etwas formaler können wir uns auch daran erinnern, dass ∅ ⊆ {1, 2, 3} bedeutet

das die Aussage (x ∈ ∅) ⇒ (x ∈ {1, 2, 3}) für jedes mathematische Objekt wahr ist, und

dies trifft tatsächlich zu, denn für jedes mathematische Objekt ist x ∈ ∅ falsch, also ist

die Implikation (x ∈ ∅) ⇒ (x ∈ {1, 2, 3}) wie in §1 festgelegt tatsächlich wahr. Dieselbe

Argumentation zeigt natürlich ∅ ⊆ M für überhaupt jede Menge M . Zum Abschluß

dieses Abschnitts wollen wir den folgenden sehr einfachen, aber oft verwendeten, Satz

einsehen:

Satz 3.1 (Kennzeichnung der Gleichheit durch Inklusion)

Seien M, N zwei Mengen. Dann ist genau dann M = N wenn M ⊆ N und N ⊆ M

gelten.

Beweis: ”=⇒” Ist M = N , so ist offenbar insbesondere M ⊆ N und N ⊆ M .

”⇐=” Nehme M ⊆ N und N ⊆ M an. Sei x ein mathematisches Objekt. Ist dann

x ∈ M , so ist wegen M ⊆ N auch x ∈ N . Ist andererseits x ∈ N , so ist wegen N ⊆ M

auch x ∈ M . Damit haben M und N dieselben Elemente, und dies bedeutet M = N .

3.2

Operationen mit Mengen

Aus bereits vorhandenen Mengen können auf verschiedene Weisen neue Mengen gebildet werden. Die grundlegendensten dieser Konstruktionen sind dabei die Vereinigung,

der Durchschitt und das relative Komplement. Wir werden sehen, dass die ersten beiden dieser Operationen in gewissen Sinne den logischen Junktoren oder“ sowie und“

”

”

entsprechen. Daher werden für sie auch die Symbole ∪“ und ∩“ verwendet, die an

”

”

die entsprechenden logischen Symbole ∨“ und ∧“ erinnern sollen.

”

”

Definition 3.3: Seien M und N zwei Mengen. Die Vereinigung von M und N , geschrieben als M ∪ N , ist dann die Menge aller mathematischen Objekte x, die in einer

der beiden Mengen M oder N liegen. Der Durchschnitt von M und N , geschrieben

als M ∩ N ist die Menge all derjenigen mathematischen Objekte, die sowohl in M als

auch in N liegen. Das relative Komplement von N in M , geschrieben als M \N , ist

schließlich die Menge aller Elemente x von M , die nicht in der Menge N liegen.

15

Mathematik für Ingenieure I, WS 2008/2009

Freitag 31.10.2008

In unser oben eingeführten Notation {. . . | . . .} können wir diese drei Mengen auch als

M ∪ N = {x|x ∈ M ∨ x ∈ N },

M ∩ N = {x|x ∈ M ∧ x ∈ N },

M \N = {x ∈ M |x ∈

/ N}

schreiben. Gelegentlich spricht man auch einfach von Komplement einer Menge N ,

dies meint dann das relative Komplement von N in einer aus dem Kontext heraus

gegebenen festen Obermenge M . Dagegen gibt es kein absolutes Komplement von N ,

da der Ausdruck {x|x ∈

/ N } eine jener freien Mengenbildungen ist, die wir ja nicht

zugelassen haben. Die Analogie zwischen ∪“ und oder“ sowie zwischen ∩“ und und“

”

”

”

”

wird noch deutleicher, wenn wir Vereinigungen und Schnitte von durch Bedingungen

A(x) und B(x) aus einer Menge M gebildeten Teilmengen betrachten. Sind M eine

Menge und A(x), B(x) zwei Aussagen jeweils mit einer freien Variablen x, so haben

wir offenbar

{x ∈ M |A(x)} ∪ {x ∈ M |B(x)} = {x ∈ M |A(x) ∨ B(x)},

{x ∈ M |A(x)} ∩ {x ∈ M |B(x)} = {x ∈ M |A(x) ∧ B(x)}.

Die eben eingeführten Grundoperationen zwischen Mengen erfüllen eine Vielzahl einfacher Gleichungen, die wir hier nicht alle auflisten wollen. Einige davon, wie beispielsweise die beiden Distributivgesetze

A ∪ (B ∩ C) = (A ∪ B) ∩ (A ∪ C),

A ∩ (B ∪ C) = (A ∩ B) ∪ (A ∩ C),

werden wir als Übungsaufgaben behandeln. An dieser Stelle wollen wir nur exemplarisch

die sogenannten de Morganschen Regeln für Mengen notieren und beweisen.

Satz 3.2 (De Morgansche Regeln für Mengen)

Seien M, A, B drei Mengen. Dann gelten:

(a) Es ist M \(A ∪ B) = (M \A) ∩ (M \B).

(b) Es ist M \(A ∩ B) = (M \A) ∪ (M \B).

Beweis: Mit der entsprechenden de Morganschen Regel §1.Satz 1 für Aussagen haben

wir

M \(A ∪ B) =

=

=

=

=

=

=

{x ∈ M |x ∈

/ (A ∪ B)}

{x ∈ M |¬(x ∈ A ∪ B)}

{x ∈ M |¬(x ∈ A ∨ x ∈ B)}

{x ∈ M |(¬x ∈ A) ∧ (¬x ∈ B)}

{x ∈ M |x ∈

/ A∧x∈

/ B}

{x ∈ M |x ∈

/ A} ∩ {x ∈ M |x ∈

/ B}

(M \A) ∩ (M \B).

16

Mathematik für Ingenieure I, WS 2008/2009

Dienstag 4.11.2008

Diese Gleichungskette beweist Teil (a) des Satzes, und Teil (b) folgt analog.

Die letzte noch zu diskutierende Mengenoperation ist von etwas anderer Natur als die

bisher beschriebenen Konstruktionen.

Definition 3.4: Seien M, N zwei Mengen. Das cartesische Produkt von M und N ,

geschrieben als M × N , ist dann die Menge aller Paare

M × N = {(x, y)|x ∈ M, y ∈ N }.

Analog können wir auch für endlich viele gegebene Mengen M1 , . . . , Mn ein cartesisches

Produkt von M1 , . . . , Mn als eine Menge von sogenannten n-Tupeln

M1 × · · · × Mn = {(x1 , . . . , xn )|x1 ∈ M1 , . . . , xn ∈ Mn }

definieren. Im speziellen Fall M1 = . . . = Mn =: M schreiben wir dann auch

M n := M

· · × M} .

| × ·{z

n mal

In der Tupelsprechweise ist ein Paar (x, y) dann ein 2-Tupel. Weiter werden 3-Tupel

(x, y, z) gelegentlich als Tripel und 4-Tupel (x, y, u, v) als Quadrupel bezeichnet. Entsprechend haben wir dann auch Quintupel und so weiter, aber bereits die Bezeichnung

Quadrupel wird eher selten verwendet. Für uns besonders wichtige Beispiele cartesischer Produkte sind die Menge

R2 = R × R = {(x, y)|x, y ∈ R}

der Punkte der Ebene sowie die Menge

R3 = R × R × R = {(x, y, z)|x, y, z ∈ R}

der Punkte des Raumes. Durch Kombination von cartesischen Produkten und Teilmengenbildung können wir nun auch kompliziertere geometrische Gebilde als Mengen

hinschreiben, etwa

2

y2

2 x

E := (x, y) ∈ R 2 + 2 = 1

a

b

die Ellipse mit Hauptachsen der Längen a, b > 0 (hier wird nur die Kurve selbst, nicht

aber ihr Inneres als Ellipse bezeichnet) oder die Einheitskugel

{(x, y, z) ∈ R3 |x2 + y 2 + z 2 ≤ 1}

im Raum R3 . Derartige Dinge werden wir aber erst später in diesem Semester diskutieren, insbesondere ist es an dieser Stelle nicht weiter tragisch wenn ihnen die geometrischen Interpretationen der eben beschriebenen Mengen nicht geläufig sind.

17

Mathematik für Ingenieure I, WS 2008/2009

Dienstag 4.11.2008

Vorlesung 4, Dienstag 4.11.2008

Zusammenfassend haben wir damit die folgenden Operationen für Mengen definiert:

3.3

Vereinigung

M ∪N

{x|x ∈ M ∨ x ∈ N }

Durchschnitt

M ∩N

{x|x ∈ M ∧ x ∈ N }

Komplement

M \N

{x ∈ M |x ∈

/ N}

Produkt

M ×N

{(x, y)|x ∈ M, y ∈ N }

Abbildungen und Relationen

Definition 3.5: Seien n ∈ N eine natürliche Zahl und M1 , . . . , Mn gegebene Mengen.

Eine Relation R auf M1 , . . . , Mn ist eine Teilmenge R ⊆ M1 × · · · × Mn .

Wir sprechen auch von einer n-stelligen Relation, da R aus n-Tupeln besteht. Beachte

das die Angabe der Mengen M1 , . . . , Mn etwas willkürlich ist, wir können jederzeit zu

größeren Mengen M10 ⊇ M1 , . . . , Mn0 ⊇ Mn übergehen und R ist dann offenbar auch

eine Relation auf M10 , . . . , Mn0 . Insbesondere können wir immer M1 = . . . = Mn = M

annehmen, d.h. das alle Mengen M1 , . . . , Mn gleich sind, indem wir etwa zu M =

M1 ∪. . .∪Mn übergehen. Weiter könnten wir eine n-stellige Relation damit auch einfach

als eine Menge von n-Tupeln definieren, ohne von den Mengen M1 , . . . , Mn überhaupt

zu sprechen. Allerdings gibt es oftmals eine aus dem Kontext heraus gegebene Wahl

der Mengen M1 , . . . , Mn so, dass es sinnvoll erscheint, diese auch in der Definition einer

Relation zu bennenen.

Wir wollen nun einige Beispiele von Relationen durchgehen. Dabei beginnen wir

mit für die Mathematik typischen Relationen, und diese sind in der Regel zweistellig,

d.h. in unserer obigen Definition haben wir n = 2. Die Ordnung der reellen Zahlen

ergibt eine Relation

R := {(x, y) ∈ R2 |x ≤ y} ⊆ R2 .

Tatsächlich pflegt man in der Mathematik den Ordnungsbegriff dem allgemeinen Relationsbegriff unterzuordnen, d.h. man definiert die Ordnung der reellen Zahlen überhaupt

als die obige Relation R und fasst die Notation x ≤ y einfach als eine Schreibweise für

(x, y) ∈ R auf. Dann wird R =≤ die Ordnung der reellen Zahlen. Eine andere nützliche Relation, die Sie wahrscheinlich noch aus der Schule kennen, ist die Kongruenz

18

Mathematik für Ingenieure I, WS 2008/2009

Dienstag 4.11.2008

von Dreiecken. In diesem Fall sind M = M1 = M2 beides die Menge der Dreiecke in

der Ebene, und wir haben die sogenannte Kongruenzrelation

R = {(∆1 , ∆2 ) ∈ M × M |∆1 und ∆2 sind zwei kongruente Dreiecke}.

Diese Relation ist hilfreich, da kongruente Dreiecke ja in vielerlei Hinsicht dieselben

geometrischen Eigenschaften haben.

Wir wollen nun noch ein Beispiel eines etwas anderen Typs einer Relation betrachten, das zwar in der Mathematik keine Rolle spielt, aber außerhalb dieser von

Bedeutung ist. Außerdem ermöglich es uns dieses Beispiel die Verwendung kartesischer

Produkte in der in §1 diskutierten mathematischen Modellierung zu demonstrieren. Wir

werden kurz an einem Beispiel die Verwendung des Relationenbegriffs in sogenannten

relationalen Datenbanken“ beschreiben, natürlich ohne allzu sehr auf technische De”

tails einzugehen. Konkret wollen wir hier eine Menge von Studenten als eine Relation

betrachten. Wir bereits bemerkt, stellen wir uns immer auf den Standpunkt keine Mengen realer, physikalischer Objekte zu erlauben, und daher können wir nicht direkt eine

Menge von Studenten einführen. Anstelle dessen gehen wir zu einer mathematischen

Beschreibung über, d.h. wir führen eine Modellierung wie in §1 geschildert, durch. Dies

deckt sich mit dem Vorgehen bei der Verwendung realer Datenbanken, die Erfassung

der relavanten Daten über die zu beschreibenden Objekte, in unserem Beispiel also die

Studenten, ist ein spezieller Fall einer mathematischen Modellierung.

Wie wollen wir nun einen Studenten beschreiben? Wie wählen hier die einfachste

Methode und beschreiben einen jeden Studenten durch einen Datensatz

(Id,Matrikelnummer,Name,Geburtsdatum,Semester,Studiengang).

Dabei interpretieren wir die Einträge Matrikelnummer und Semester als natürliche

Zahlen, also als Elemente von N. Den Eintrag Studiengang interpretieren wir ebenfalls

als eine natürliche Zahl, etwa indem wir alle möglichen Studiengänge einfach durchnumerieren. Der Name des Studenten Name entstammt einer Menge S von Strings, also

Zeichenketten, die wir uns hier der Einfachheit halber als vorgegeben denken. Das Geburtsdatum interpretieren wir dagegen als eine natürliche Zahl, etwa indem wir ein

jedes Datum durch die Anzahl der Tage seit dem ersten Januar des Jahres 1900 beschreiben, dies sollte ausreichen alle derzeit lebenden Studenten zu erfassen. Der letzt

Eintrag Id ist einfach eine natürliche Zahl, die diesen Studenten eindeutig kennzeichnet.

Je nach geplanten Verwendungszweck könnten wir hierfür auch die Matrikelnummer

verwenden, eine davon unabhängige Nummer erlaubt es uns aber auch beispielsweise

nicht mehr immatrikulierte Studenten zu erfassen. Die gesamte Beschreibung eines Studenten, also das volle oben angegebene 6-Tupel ist dann ein Element des kartesischen

Produkts

N × N × S × N × N × N.

Technische Details ignorieren wir hierbei, in realen Datenbanken müsste man sich über

die erlaubten Wertebereiche der verschiedenen auftretenden Zahlen Gedanken machen,

19

Mathematik für Ingenieure I, WS 2008/2009

Dienstag 4.11.2008

man sollte sich für eine Stringcodierung sowie für eine maximale Namenslänge entscheiden, und so weiter. Eine Menge von Studenten, beziehungsweise genauer von Beschreibungen von Studenten, wird nun eine Teilmenge S ⊆ N × N × S × N × N × N des

obigen kartesischen Produkts, also eine sechsstellige Relation. Notiert denken wir uns

diese üblicherweise in einer Tabelle, etwa wie folgt

1

2

3

.

.

.

456123

673961

987543

Burg, Klemens

Haf, Herbert

Wille, Friedrich

26123

27467

25939

3

2

1

1

2

1

Die Reihenfolge in der die Zeilen dieser Tabelle aufgelistet werden spielt keine Rolle,

es handelt sich um eine Menge von Studenten, und nicht um eine irgendwie geordnete

Liste. Es darf in der Tabelle keine zwei identischen Zeilen geben. Diese Einschränkung

gibt es übrigens auch in den Tafeln einer realen, relationalen Datenbank, die Tafeln

repräsentieren eben Mengen und keine Listen.

Die mit dieser Tabellensichtweise verbundene Vorstellung ist es sich ein Tupel, also

ein Element eines kartesischen Produktes, als einen Datensatz vorzustellen, also als

eine Zeile in einer Tabelle, und Relationen werden dann zu Tabellen. Diese Vorstellung

können wir auch in anderen Situation verwenden, zum Beispiel können wir uns einen

Punkt (1, 2, −1) ∈ R3 im Raum auch als eine Beschreibung {x = 1, y = 2, z = −1}

interpretieren. Für die Mathematik ist diese Vorstellung aber in der Regel nicht sehr

hilfreich.

Unsere mengentheoretischen Operationen, also Vereinigen, Schneiden, das Bilden

von Teilmengen und so weiter treten nun tatsächlich bei der Verwendung relationaler Datenbanken auf. Haben wir beispielsweise eine Menge Studenten von Studenten

gegeben und interessieren uns für die Teilmenge aller dieser Studenten, die im ersten

oder zweiten Semester sind, also in mengentheoretischer Notation

{(i, m, n, d, s, f ) ∈ Studenten|s ∈ {1, 2}},

so können wir diese mathematische Notation in der üblichen Abfragesprache (SQL),

auch als

SELECT * FROM Studenten WHERE semester <= 2

formulieren. Die Formulierung SELECT * FROM Studenten“ ist dabei die Aufforde”

rung eine Teilmenge der Relation Studenten zu bilden, und hinter dem Schlüsselwort

WHERE“ wird die, die Teilmenge definierende Bedingung angegeben. In unserer obigen

”

Beispieltabelle wäre die Antwort

2

3

.

.

.

673961

987543

Haf, Herbert

Wille, Friedrich

20

27467

25939

2

1

2

1

Mathematik für Ingenieure I, WS 2008/2009

Dienstag 4.11.2008

Suchen wir dagegen beispielsweise alle Studenten im Studiengang Elektrotechnik, so

können wir diese durch eine zu obigem Kommando analoge Anfrage SELECT * FROM

”

Studenten WHERE fach=1“ erhalten, wobei angenommen sei, dass der Srudiengang

Elektrotechnik die Nummer 1 erhalten hat. In unserem Beispiel sind dies

1

3

.

.

.

456123

987543

Burg, Klemens

Wille, Friedrich

26123

25939

3

1

1

1

Wollen wir nun alle Studenten, die beide Bedingungen erfüllen, also Studenten der

Elektrotechnik im ersten oder zweiten Semester, so müssen wir den mengentheoretischen Durchschnitt der beiden eben erhaltenen Mengen bilden. Wir hatten bereits die

Beziehung

{x ∈ M |A(x)} ∩ {x ∈ M |B(x)} = {x ∈ M |A(x) ∩ B(x)}

zwischen Durchschnitt und dem logischen Junktor und“ festgehalten, und unter Ver”

wendung dieser Beziehung erhalten wir die Abfrage

SELECT * FROM Studenten WHERE semester <= 2 AND fach = 1

mit Ergebnistabelle

3

.

.

.

987543

Wille, Friedrich

25939

1

1

Wir werden dieses Beispiel später noch etwas fortsetzen. Wir kommen nun zu den

Operationen wie Hintereinanderausführung und Inversion von Relationen. Diese sind

hauptsächlich für zweistellige Relationen von Interesse, und zu ihrem Verständnis ist

eine weitere Veranschaulichung speziell zweistelliger Relationen hilfreich. Wir können

uns eine Relation R ⊆ M × N als eine Menge von Pfeilen von Elementen von M zu

Elementen von N vorstellen, indem wir jedes Element (x, y) ∈ R ⊆ M × N als einen

Pfeil von x nach y interpretieren. Haben wir zum Beispiel M = N = {1, 2, 3, 4}, so

veranschaulicht

21

Mathematik für Ingenieure I, WS 2008/2009

Dienstag 4.11.2008

die Relation

R = {(1, 1), (2, 1), (2, 2), (3, 4), (4, 4)}

wobei wir uns die vier Elemente von M beziehungsweise N von oben nach unten durchnumeriert denken.

Definition 3.6: Sei R ⊆ M × N eine Relation. Dann heißt die Menge

R−1 := {(y, x)|(x, y) ∈ R} ⊆ N × M

die zu R inverse Relation.

In unserem Pfeilbild entspricht das Bilden der Inversen einer Relation einfach dem

Umdrehen aller Pfeile, in unserem obigen Beispiel ist etwa

R−1 = {(1, 1), (1, 2), (2, 2), (4, 3), (4, 4)},

und im Pfeilbild ist dies

Die andere Operation auf Relationen ist das Bilden der Hintereinanderausführung:

Definition 3.7: Seien A, B, C drei Mengen und R ⊆ A × B, S ⊆ B × C Relationen.

Die Hintereinanderausführung von R und S ist dann die Relation

S ◦ R := {(a, c) ∈ A × C|Es gibt ein b ∈ B mit (a, b) ∈ R und (b, c) ∈ S} ⊆ A × C.

Alternativ spricht man auch vom Produkt oder der Komposition von R und S.

Diese Definition wird im Pfeilbild klarer. Wir betrachten die folgende Situation:

22

Mathematik für Ingenieure I, WS 2008/2009

R

A

Dienstag 4.11.2008

S

C

B

Dabei ist A = B = {1, 2, 3, 4}, C = {1, 2, 3}, R ist wieder die schon oben als Beispiel

verwendete Relation und S ist die Relation S = {(2, 1), (3, 1), (3, 2), (4, 3)}. Die Elemente von S ◦ R sind jetzt alle Paare (a, c) ∈ A × C = {1, 2, 3, 4} × {1, 2, 3}, so dass

es zunächst einen Pfeil von a zu einem Punkt b ∈ B = {1, 2, 3, 4} gibt, und es weiter

auch einen Pfeil von b nach c gibt. Wir setzen also auf alle möglichen Weisen Pfeile

aus S an Pfeile aus R und gucken uns dann nur noch die Start- und Endpunkte dieser

kombinierten Pfeile an. In unserem Beispiel sind dies

R

A

S

B

C

und die Hintereinanderausführung von R und S wird zu

S ◦ R = {(2, 1), (3, 3), (4, 3)}.

Die Bedeutung der Hintereinanderausführung für unsere Zwecke wird erst im Zusammenhang mit Abbildungen klar werden. Die verschiedenen Operationen auf Relationen

haben allerdings auch einige durchaus praktische Anwendungen, beispielsweise im Zusammenhang mit den bereits oben als Beispiel verwendeten relationalen Datenbanken.

Wir wollen unser obiges Beispiel der Studenten Tabelle weiter ausbauen, wir brauchen

23

Mathematik für Ingenieure I, WS 2008/2009

Dienstag 4.11.2008

ja mehrere Relationen um Beispiele von Hintereinanderausführungen zu diskutieren.

Wir denken uns eine weitere Tafel Vorlesungen zur Beschreibung von Vorlesungen

gegeben. Für die Zwecke unseres Beispiels wollen wir eine Vorlesung durch ein 4-Tupel

(Id,Name,Zeit,Raum)

beschreiben. Wir könnten beispielsweise die folgende Tabelle vorliegen haben

1

2

.

.

.

Elektrotechnik I

Mathematik I

Di. 16.15--17.45

Do. 14.15--15.45

CAP3, Raum 1

Audimax H

Natürlich sollte nun auch erfasst werden, welche Studenten welche Vorlesung besuchen.

Dies können wir beispielsweise durch Einrichten einer weiteren, diesmal zweistelligen,

Relation Teilnehmer erreichen, die einfach Paare

(Vorlesung.Id,Student.Id)

enthält. Besuchen beispielsweise die Studenten Burgm Klemens und Wille, Friedrich

die Vorlesung Elektrotechnik I und Burg, Klemens sowie Haf, Herbert die Vorlesung Mathematik I, so wird unsere Teilnehmer Relation zu

1

1

2

2

1

3

1

2

Nehmen wir nun an, wir möchten einen vollständigen Stundenplan aller Studenten

aufstellen, d.h. für jeden der vorhandenen Studenten auflisten zu welcher Zeit sie oder

er sich in welchem Raum befindet, oder zumindest befinden sollte. Wir wollen also eine

Tabelle von Tripeln

(Student.Name,Vorlesung.Raum,Vorlesung.Zeit)

konstruieren, wobei ein solcher Eintrag bedeutet, dass sich der Student mit dem Namen

Student.name zur Zeit Vorlesung.Zeit im Raum Vorlesung.Raum befindet. Solch ein

Tripel wird in unsere Liste aufgenommen, wenn die Tafel Teilnehmer einen Eintrag

(Vorlesung.Id,Student.Id) enthält, denn diese Tafel listet ja gerade die Teilnehmer

der verschiedenen Vorlesungen auf. Was hat das mit der Hintereinanderausführung von

Relationen zu tun? Zu diesem Zweck denken wir uns die Relation Studenten als eine

Teilmenge des kartesischen Produkts N × M indem wir die hinteren fünf Einträge in

einem einzigen 5-Tupel zusammenfassen, also M = N × S × N × N × N. Ebenso denken

24

Mathematik für Ingenieure I, WS 2008/2009

Dienstag 4.11.2008

wir uns Vorlesung als eine Teilmenge des kartesischen Produkts N × N , wobei N für

die hinteren drei Komponenten einer Vorlesung steht. Sind s ein Student und v eine

Vorlesung, geschrieben als s =(s.Id,s.M) und v =(v.Id,v.N), wobei s.M und v.N für

die hinteren fünf beziehungsweise drei Komponenten von s beziehungsweise v stehen,

so müssen wir (s, v) genau dann in usere Liste aufnehmen, wenn es einen Eintrag

t = (n, m) in Teilnehmer gibt so, daß s.Id= m und v.Id= n ist. Wir brauchen also

einen zusammengesetzten Pfeil, wie im folgenden Bild angedeutet

−1

Vorlesung

N

Teilnehmer

IN

Studenten

IN

M

Wir müssen also die Relation

Student ◦ Teilnehmer ◦ Vorlesung−1

bilden. Für unser konkretes Beispiel müssen anschließend noch die zur Anzeige vorgesehenen Spalten unserer Tabellen ausgewählt werden. Ein SQL Kommando um all dies

zu erreichen wäre etwa

SELECT

FROM

WHERE

Student.Name, Raum, Zeit

Student,Vorlesungen,Teilnehmer

Teilnehmer.vorlesung id = Vorlesung.Id

AND Teilnehmer.student id = Student.Id

Als Ausgabe für unsere Beispieldaten ergibt sich

Burg, Klemens

Wille, Friedrich

Burg, Klemens

Haf, Herbert

.

.

.

CAP3, Raum 1

CAP3, Raum 1

Audimax H

Audimax H

Di.

Di.

Do.

Do.

16.15-17.45

16.15-17.45

14.15-15.45

14.15-15.45

Dabei wollen wir die Beispiele für Relationen beenden und uns nun dem Abbildungsbegriff zuwenden. Dabei ist das Wort Abbildung“ einfach ein Synonym für das et”

was vertrautere Wort Funktion“. Die Ihnen wahrscheinlich aus der Schule bekannte

”

Definition einer Funktion f erklärt diese als eine Abbildungsvorschrift, die jedem Element x des Definitionsbereichs der Funktion ein Element f (x) des Wertebereichs der

Funktion zuordnet. Allerdings ist die Funktion dann doch nicht wirklich gleich der

25

Mathematik für Ingenieure I, WS 2008/2009

Freitag 7.11.2008

Abbildungsvorschrift sondern der durch sie gegebenen Wirkung, zwei völlig verschiedene aussehende Abbildungsvorschriften können ja exakt dieselben Werte liefern, und

sollten damit natürlich auch dieselbe Funktion sein. Beispielsweise werden Sie als eine

Übung einsehen, dass die beiden für n ∈ N erklärten Abbildungsvorschriften

f (n) = 12 + 22 + . . . + n2

und

n(n + 1)(2n + 1)

6

genau dieselbe Funktion beschreiben. Die Abbildungsvorschrift selbst zur Funktion zu

ernennen scheint also ein etwas unpassender Ansatz zu sein. Ein weiteres Argument das

gegen diese Idee spricht, ist, dass wir dann den Begriff einer Abbildungsvorschrift als

einen weiteren Grundbegriff akzeptieren müssten. Das kann man natürlich tun, aber

wie sich herausstellt ist dies überhaupt nicht nötig. Die seit inzwischen fast 100 Jahren

in der Mathematik verwendete Definition einer Funktion, oder Abbildung, erwähnt das

Konzept einer Abbildungsvorschrift nicht einmal mehr, sondern interpretiert Funktionen als eine spezielle Sorte zweistelliger Relationen.

g(n) =

Definition 3.8: Seien M, N zwei Mengen. Eine Abbildung f von M nach N , geschrieben

als f : M → N , ist eine zweistellige Relation f ⊆ M × N , die die folgende Bedingung

erfüllt: Für jedes x ∈ M gibt es genau ein Element y ∈ N mit (x, y) ∈ f . Wir schreiben

dann auch f (x) für dieses eindeutige Element y ∈ N .

Mit der Schreibweise f (x) für x ∈ M ist dann

f = {(x, f (x))|x ∈ M } ⊆ M × N.

Natürlich spielt die Idee einer Abbildungsvorschrift weiter eine Rolle, aber nicht mehr

in der Definition einer Abbildung, sondern bei der Beschreibung konkret gegebener

Funktionen. Bezeichnet F (x) eine Abbildungsvorschrift mit freier Variablen x, also

beispielsweise eine Formel in der x als freie Variable vorkommt, so bezeichnen wir mit

f : M → N ; x 7→ F (x)

die Funktion f := {(x, F (x))|x ∈ M }, d.h. diejenige Funktion, deren Werte f (x) sich

gemäß der gegebenen Formel als f (x) = F (x) berechnen. Beispielsweise steht

f : R → R; x 7→ x2

für die Funktion f = {(x, x2 )|x ∈ R} ⊆ R2 .

In unserer Pfeilinterpretation einer zweistelligen Relation, bedeutet die eine Abbildung definierende Eigenschaft gerade, dass von jedem Punkt der linken Seite genau ein

Pfeil zur rechten Seite startet.

In der nächsten Sitzung werden wir uns noch einige weitere Beispiele anschauen

und den Abbildungsbegriff näher untersuchen.

26

Mathematik für Ingenieure I, WS 2008/2009

Freitag 7.11.2008

Vorlesung 5, Freitag 7.11.2008

Die eine Funktion definierende Abbildungsvorschrift braucht nicht eine einfache Formel zu sein, auch kompliziertere Konstruktionsvorschriften sind zugelassen. Betrachte

beispielsweise die folgende Abbildung

(

q, Es ist 0 6= x = pq mit teilerfremden p ∈ Z, q ∈ N,

f : Q → N; x 7→

1, x = 0.

Eine gegebene rationale Zahl x 6= 0 müssen wir also als ausgekürzten Bruch x = p/q

schreiben, wobei die Vorzeichen von p und q so normiert sind das p ∈ Z und q ∈ N ist.

In dieser Darstellung sind der Zähler p sowie der Nenner q eindeutig durch x festgelegt,

und damit ist f (x) = q ein ein eindeutig definierter Funktionswert. Beispielsweise sind

1

4

f (1) = 1, f (2) = 2, f −

= 2, f

= 3,

2

12

wobei letzterer Wert zustande kommt da 1/3 die ausgekürzte Form von 4/12 ist. Gelegentlich werden Funktionen tatsächlich direkt als Mengen von Paaren definiert. Betrachte zum Beispiel die Menge

f := {(x, y) ∈ R2 |xy = 1} ⊆ R2 .

Dann ist f ⊆ (R\{0}) × R und für jedes 0 6= x ∈ R gibt es genau ein y ∈ R mit

(x, y) ∈ f , d.h. mit xy = 1, nämlich y = 1/x. Also ist f gleich der Funktion

f : R\{0} → R; x 7→

1

.

x

Wir wollen nun noch einige kleine im Zusammenhang mit Funktionen, und auch mit

Relationen, auftretende Schreibweisen einführen. Wir beginnen mit dem Bild einer

Teilmenge unter einer Relation.

Definition 3.9: Seien M, N zwei Mengen und R ⊆ M × N eine Relation. Ist dann

A ⊆ M eine Teilmenge, so definieren wir das Bild von A unter R als die Teilmenge

R(A) := {y ∈ M |Es gibt ein x ∈ A mit (x, y) ∈ R} ⊆ N.

Im Pfeilbild betrachten wir also alle Pfeile in R, die bei einem Element aus A starten,

und die Gesamtheit der Endpunkte all dieser Pfeile ist das Bild R(A) ⊆ N .

27

Mathematik für Ingenieure I, WS 2008/2009

Freitag 7.11.2008

R

R(A)

A

M

N

In diesem Beispiel sind M = N = {1, 2, 3, 4}, R = {(1, 1), (2, 1), (2, 2), (4, 3), (4, 4)}

und A = {1, 2}. Bei Elementen aus A startende Pfeile sind dann (1, 1), (2, 1) und

(2, 2), d.h. die Bildmenge von A unter R ist in diesm Fall R(A) = {1, 2}. Bildmengen

und Hintereinanderausführungen von Relationen sind gut miteinander verträglich, wie

durch den folgenden Satz gezeigt wird:

Satz 3.3: Seien A, B, C drei Mengen und R ⊆ A × B, S ⊆ B × C zwei Relationen.

Für jede Teilmenge U ⊆ A ist dann

(S ◦ R)(A) = S(R(A)).

Beweis: Sei U ⊆ A eine Teilmenge. Dann gilt:

(S ◦ R)(U ) =

=

=

=

{c ∈ C|Es gibt ein a ∈ U mit (a, c) ∈ S ◦ R}

{c ∈ C|Es gibt a ∈ U und b ∈ B mit (a, b) ∈ R und (b, c) ∈ S}

{c ∈ C|Es gibt ein b ∈ R(U ) mit (b, c) ∈ S}

S(R(U )).

Für Bilder unter Funktionen vereinfacht sich die Definition der Bildmenge wesentlich.

Sind f : M → N eine Funktion und A ⊆ M eine Teilmenge, so haben wir

f (A) = {y ∈ N |Es gibt ein x ∈ A mit (x, y) ∈ f }

= {y ∈ N |Es gibt ein x ∈ A mit y = f (x)}

= {f (x)|x ∈ A}.

Insbesondere folgt für jedes x ∈ M damit f ({x}) = {f (u)|u ∈ {x}} = {f (x)}. Sind

also f : M → N und g : N → P zwei Abbildungen, so folgt für jedes x ∈ M mit dieser

28

Mathematik für Ingenieure I, WS 2008/2009

Freitag 7.11.2008

Beobachtung und Satz 3

(g ◦ f )({x}) = g(f ({x})) = g({f (x)}) = {g(f (x))}.

Da andererseits (g ◦ f )({x}) die Menge aller z ∈ P mit (x, z) ∈ g ◦ f ist, ist g ◦ f somit

wieder eine Abbildung mit (g ◦ f )(x) = g(f (x)) für alle x ∈ M . Die Hintereinanderausführung zweier Abbildungen ist also wieder eine Abbildung, deren Abbildungsvorschrift durch Zusammensetzen der Abbildungsvorschriften von f und g entsteht.

Damit ist die Hintereinanderausführung ◦“ eine Konstruktion aus bereits vor”

handenen Abbildungen neue zu bilden. Wir wollen hier noch eine weitere solche Konstruktionsmethode festhalten, die sogenannte Einschränkung. Bei dieser haben wir eine

Abbildung f : M → N zwischen zwei Mengen M und N gegeben und betrachten außerdem eine Teilmenge A ⊆ M von M . Dann erhalten wir eine neue Funktion indem

wir uns nur noch anschauen wie f die Elemente der Teilmenge A abbildet. Dies ist die

sogenannte Einschränkung, oder auch Restriktion, von f auf A geschrieben als

f |A : A → N ; x 7→ f (x).

Noch einfacher, aber etwas geheimnisvoller aussehend, wird dies wenn wir die betreffenden Abbildungen einfach als Mengen hinschreiben, dann ist nämlich f |A = f ∩(A×N ).

Zum Abschluss dieses Abschnitts wollen wir nun einige im Zusammenhang mit

Abbildungen verwendete Begriffe festhalten:

Definition 3.10: Seien M, N zwei Mengen und f : M → N eine Abbildung. Dann

nennen wir die Menge

dom(f ) := M = {x|Es gibt ein y mit (x, y) ∈ f }

den Definitionsbereich von f . Gelegentlich sprich man auch vom Urbildbereich von f .

Weiter heißt

Bild(f ) := f (M ) = {f (x)|x ∈ M } ⊆ N

das Bild von f . Im allgemeinen ist Bild(f ) ( N eine echte Teilmenge von N , und wir

nennen die Abbildung f surjektiv wenn Bild(f ) = N ist, d.h. wenn jedes Element von

N tatsächlich als Wert der Funktion f auftritt. Weiter heißt f injektiv, wenn für alle

x, y ∈ M mit x 6= y stets auch f (x) 6= f (y) ist. Schließlich nennen wir f bijektiv, wenn

f sowohl surjektiv als auch injektiv ist.

Streng genommen müßten wir von der Surjektivität der Abbildung f bezüglich N

reden, denn f selbst legt zwar die Urbildmenge M , nicht aber die Menge N , eindeutig

fest. Die Injektivität einer Abbildung bedeutet, dass die Aussage x 6= y ⇒ f (x) 6= f (y)

für alle x, y ∈ M wahr ist. Verwenden wir das Kontrapositionsprinzip §1.Satz 3, so

sehen wir das man gleichwertig auch f (x) = f (y) ⇒ x = y für alle x, y ∈ M verlangen

kann. Die Surjektivität einer Abbildung f : M → N bedeutet dagegen, dass es für

jedes y ∈ N ein x ∈ M mit f (x) = y gibt. Insgesamt ist f : M → N damit genau

dann bijektiv, wenn es für jedes y ∈ N genau ein x ∈ M mit y = f (x) gibt. In anderen

29

Mathematik für Ingenieure I, WS 2008/2009

Freitag 7.11.2008

Worten soll also die Gleichung f (x) = y für jedes gegebene y ∈ N eindeutig nach

x ∈ M auflösbar sein.

Surjektivität, Injektivität und Bijektivität einer Abbildung lassen sich auch gut in

unserem Pfeilbild verstehen. Wir hatten bereits bemerkt, dass die definierende Eigenschaft einer Abbildung Für jedes x ∈ M existiert genau ein y ∈ N mit (x, y) ∈ f“ im

”

Pfeilbild bedeutet das von jedem Punkt der linken Seite genau ein Pfeil startet. Dass

f : M → N surjektiv ist bedeutet definitionsgemäß das für jedes y ∈ N ein x ∈ M

mit y = f (x) existiert. Letzteres bedeutet (x, y) ∈ f also das f einen Pfeil von x nach

y enthält. Also ist f genau dann surjektiv, wenn jedes Element der rechten Seite von

einem Pfeil getroffen wird:

nicht

surjektiv

surjektiv

Wir kommen zur Beschreibung der Injektivität einer Abbildung im Pfeilbild. Wir hatten bereits festgehalten, dass f genau dann injektiv ist, wenn für alle x, y ∈ M aus

f (x) = f (y) stets x = y folgt. Äquivalent hierzu ist, dass für jedes z ∈ N für alle

x, y ∈ M mit f (x) = f (y) = z stets x = y ist, d.h. das es höchstens ein x ∈ M mit

f (x) = z gibt. Da weiter f (x) = z nach Definition einfach (x, z) ∈ f bedeutet, können

wir die letztgenannte Bedingung auch so aussprechen, dass jedes Element x ∈ N der

rechten Seite von höchstens einem Pfeil getroffen wird:

nicht

injektiv

injektiv

Eine bijektive Abbildung ist nun gleichzeitig injektiv und surjektiv, und im Pfeilbild

bedeutet dies das unsere Pfeile eine umkehrbar eindeutige Zuordnung der Elemente der

30

Mathematik für Ingenieure I, WS 2008/2009

Freitag 7.11.2008

linken Seite zu den Elementen der rechten Seite vermitteln. In den Übungen werden

Sie auch einige Beispiele zu Injektivität und Surjektivität für durch Formeln gegebene

Funktionen durchrechnen.

3.4

Vollständige Induktion und endliche Mengen

Die sogenannte vollständige Induktion ist Beweisverfahren für Aussagen über natürliche

Zahlen. Abstrakt können wir diese Methode wie folgt beschreiben. Gegeben ist eine

Aussage A(n) für natürliche Zahlen n ∈ N, und wir wollen zeigen, dass diese für

alle n ∈ N zutrifft. Statt A(n) direkt zu beweisen werden dann die folgenden beiden

Teilbehauptungen bewiesen:

Induktionsanfang: Die Aussage A(1) ist wahr.

Induktionsschluß: Ist n ∈ N eine natürliche Zahl und ist A(n) wahr, so ist auch die

Aussage A(n + 1) wahr.

Haben wir diese beiden Aussagen bewiesen, treffen also Induktionsanfang und Induktionsschluß beide zu, so besagt das Prinzip der vollständigen Induktion, dass unsere

Aussage A(n) tatsächlich für jedes n ∈ N wahr ist. Dies wird klarer wenn wir die

vollständige Induktion an einem konkreten Beispiel vorführen. Wir wollen zeigen, daß

für jedes n ∈ N die Summe der ersten n natürlichen Zahlen gleich n(n + 1)/2 ist, d.h.

das

n(n + 1)

(∗) 1 + 2 + . . . + n =

2

gilt. Unsere Behauptung ist hier also die Aussage

A(n) = Es gilt 1 + 2 + . . . + n =

”

n(n + 1)

“

2

für natürliche Zahlen n ∈ N. Dann prüfen wir der Reihe nach, dass Induktionsanfang

und Induktionsschluß beide wahr sind:

Induktionsanfang: Wegen 1 =

ist wahr.

1·2

2

stimmt unsere Behauptung für n = 1, d.h. A(1)

Induktionsschluß: Sei nun n ∈ N gegeben und nehme an, dass A(n) wahr ist, das

also unsere Behauptung für n zutrifft. Es ist also bereits 1 + . . . + n = n(n + 1)/2.

Dann rechnen wir:

1 + . . . + (n + 1) = 1 + . . . + n + (n + 1)

n(n + 1)

=

+n+1

2

n(n + 1) + 2(n + 1)

=

2

(n + 1)(n + 2)

=

,

2

31

Mathematik für Ingenieure I, WS 2008/2009

Freitag 7.11.2008

und dies bedeutet das die behauptete Formel auch für n + 1 wahr ist, also das

die Aussage A(n + 1) ebenfalls wahr ist.

Per vollständiger Induktion ist (∗) damit allgemein für jedes n ∈ N bewiesen.

In sehr vielen Induktionsbeweisen ist es aus der jeweiligen Behauptung unmittelbar

klar, welche Aussage für A(n) verwendet wird, und in diesen Fällen verzichten wir

meist darauf A(n) explizit einzuführen. Die oben durchgeführte explizite Trennung

von Induktionsanfang und Induktionsschluß ist ein hauptsächlich bei der Bearbeitung

von Übungsaufgaben verwendeter Stil. Normalerweise wird der obige Beweis eher im

folgenden Stil notiert: Wegen 1 · 2/2 = 1 gilt (∗) für n = 1. Ist nun n ∈ N mit (∗)

”

gegeben, so gilt auch . . ., d.h. (∗) trift auch für n + 1 anstelle von n zu. Per Induktion

ist (∗) damit für jedes n ∈ N bewiesen“.

Wir wollen nun kurz die Frage behandeln warum die vollständige Induktion überhaupt ein zulässiges Beweismittel ist. Eine heuristische Begründung, die auch bereits

ausreichen sollte Sie von der Induktionsmethode zu überzeugen, kann man wie folgt

beschreiben. Nach unserem Induktionsanfang wissen wir, dass zumindest A(1) zutrifft.