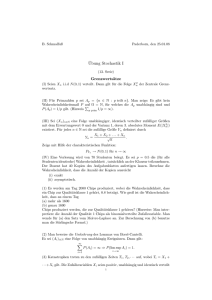

Einf¨uhrung in die Stochastik - staff.uni

Werbung