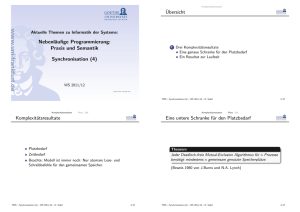

Aktuelle Themen zu Informatik der Systeme: Nebenläufige

Werbung