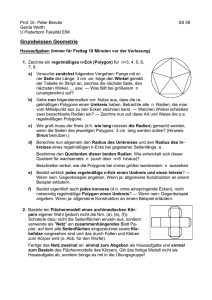

struierter Gebäudegeometrie

Werbung