6.1.8 Wahrscheinlichkeitsverteilung von mehreren Zufallsvariablen

Werbung

44

6.1.8

Wahrscheinlichkeitsverteilung von mehreren Zufallsvariablen

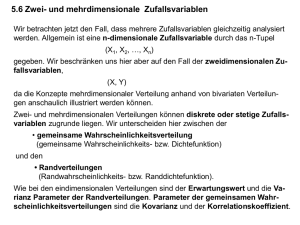

6.1.8.1 Wahrscheinlichkeitsfunktion und -verteilung von zwei Zufallsvariablen

Bislang haben wir uns nur für ein Merkmal der Zufallsexperimente interessiert. Wir wollen

jetzt Zufallsexperimente zulassen, die sich in mehreren Merkmalen unterscheiden. Stellvertretend für eine generelle "mehrdimensionale" Abhandlung wollen wir zunächst Zufallsexperimente mit zwei Merkmalen behandeln. Beobachten oder messen wir zwei Merkmale, so können wir diesen reelle Zahlen zuordnen und dadurch zwei Zufallsvariable X und Y

zuordnen. Diese fassen wir dann zu einer zweidimensionalen Zufallsvariablen (X,Y) zusammen.

Zunächst erklären wir die Begriffe Wahrscheinlichkeitsfunktion, Verteilungsfunktion und

Randverteilung für Zufallsexperimente mit einer diskreten zweidimensionalen Zufallsvariablen.

Die Wahrscheinlichkeit, dass wir bei einem Zufallsexperiment mit zweidimensionalen Zufallsvariablen gleichzeitig die Variablenwerte xi und yk beobachten, beschreiben wir durch

den Ausdruck pik. Als Wahrscheinlichkeitsfunktion formulieren wir dann den folgenden

Ausdruck.

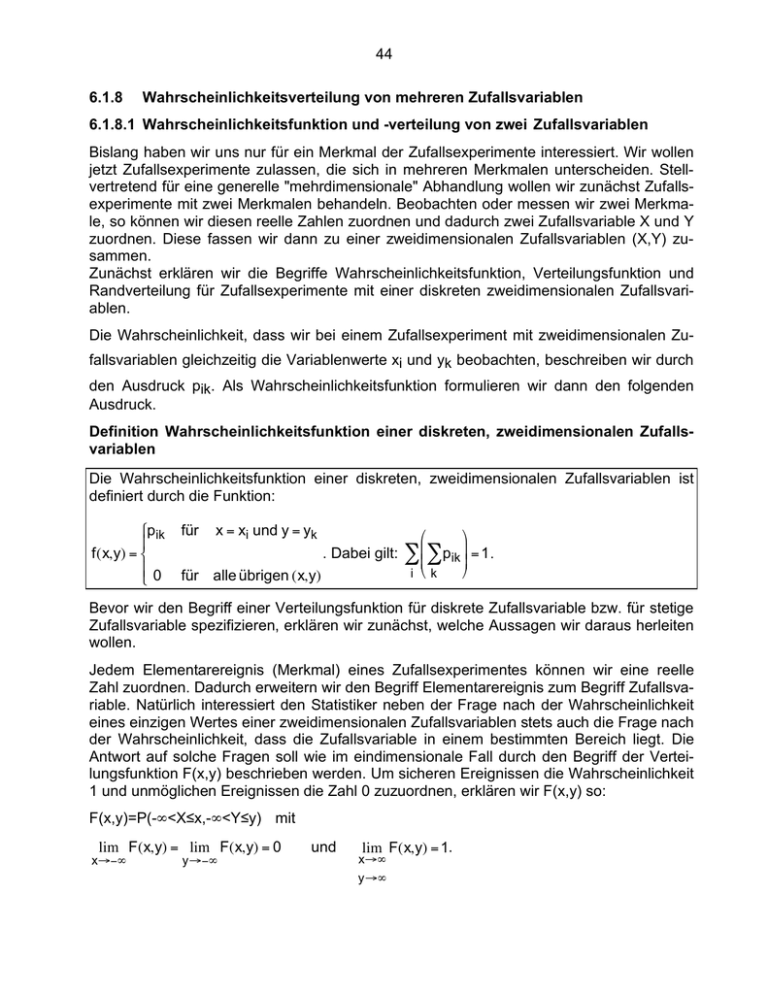

Definition Wahrscheinlichkeitsfunktion einer diskreten, zweidimensionalen Zufallsvariablen

Die Wahrscheinlichkeitsfunktion einer diskreten, zweidimensionalen Zufallsvariablen ist

definiert durch die Funktion:

"pik

$

f(x,y) = #

$0

%

!

für

x = xi und y = yk

#

&

%

. Dabei gilt: " "pik ( = 1.

%

(

'

i $k

für alle übrigen (x,y)

Bevor wir den Begriff einer Verteilungsfunktion für diskrete Zufallsvariable bzw. für stetige

Zufallsvariable spezifizieren, erklären wir zunächst, welche Aussagen wir daraus herleiten

!

wollen.

Jedem Elementarereignis (Merkmal) eines Zufallsexperimentes können wir eine reelle

Zahl zuordnen. Dadurch erweitern wir den Begriff Elementarereignis zum Begriff Zufallsvariable. Natürlich interessiert den Statistiker neben der Frage nach der Wahrscheinlichkeit

eines einzigen Wertes einer zweidimensionalen Zufallsvariablen stets auch die Frage nach

der Wahrscheinlichkeit, dass die Zufallsvariable in einem bestimmten Bereich liegt. Die

Antwort auf solche Fragen soll wie im eindimensionale Fall durch den Begriff der Verteilungsfunktion F(x,y) beschrieben werden. Um sicheren Ereignissen die Wahrscheinlichkeit

1 und unmöglichen Ereignissen die Zahl 0 zuzuordnen, erklären wir F(x,y) so:

F(x,y)=P(-∞<X≤x,-∞<Y≤y) mit

lim F(x,y) = lim F(x,y) = 0

x"#$

und

y"#$

!

!

lim F(x,y) = 1.

x"#

y"#

45

Sind von der Zufallsvariablen Werte gefordert, die zwischen x1≤X≤x2 und y1≤Y≤y2 liegen, so ist die Wahrscheinlichkeit für dieses Ergebnis gegeben durch die Rechteckformel:

P(x1≤X≤x2,y1≤Y≤y2)=F(x2,y2)+F(x1,y1)-F(x1,y2)-F(x2,y1).

Im diskreten Fall werden diese gewünschten Eigenschaften erzielt, wenn wir F(x,y) so definieren.

Definition Wahrscheinlichkeitsfunktion bzw. Wahrscheinlichkeitsverteilung einer

diskreten zweidimensionalen Zufallsvariablen

Die Wahrscheinlichkeitsverteilung einer diskreten zweidimensionalen Zufallsvariablen

(X,Y) lässt sich beschreiben durch die normierte Wahrscheinlichkeitsfunktion:

"pik

x = xi, y = yk

$

f(x,y) = #

für

$0

alle übrigen (x,y)

%

oder durch die zugehörige Verteilungsfunktion

!

F(x,y) =

# # f(x,y) .

xi "x y k "y

In den Formeln bedeutet pik die Wahrscheinlichkeit dafür, dass die zweidimensionale Zufallsvariable (X,Y) den Zufallswert ( xi,yk ) annimmt.

!

Jeder zweidimensionalen Verteilung lassen sich sogenannte Randverteilungen zuord!

nen. Die Randverteilungen

der Zufallsvariablen erhält man, wenn man eine Komponente

der zweidimensionalen Zufallsvariablen

!

festhält, und die Wahrscheinlichkeiten der zweiten, variablen Komponente summiert. Im Fall einer diskreten Verteilung sieht das so aus:

Definition Randverteilung

Die Randverteilungen einer zweidimensionalen Verteilung sind definiert durch:

# p

%" ik

%k

f1( x) = $

% 0

%

&

für

#"p

ik

%

i

%

bzw. f2 (y) = $

% 0

sonst

%

&

x = xi

für y = yk

sonst

Wir veranschaulichen uns die angesprochenen Begriffe an einem Beispiel.

!

Beispiele

1

In einem Behälter sind 6 schwarze, 6 weiße und 6 graue Kugeln. Die Kugeln mit gleicher

Farbe sind durchnumeriert von 1 bis 6. Wir haben also zwei Merkmale: Farbe und Zahl.

Unser Zufallsexperiment heißt: "Ziehen einer numerierten, farbigen Kugel". Wir haben

insgesamt 18 Elementarereignisse mit jeweils zwei Merkmalen. Indem wir den Farben

Schwarz bzw. Weiß bzw. Grau die Zahlen 1 bzw. 2 bzw. 3 zuordnen, erhalten wir 18 unterscheidbare zweidimensionale Zufallsvariable: (1,1); (1,2); (1,3); (1,4); (1,5); (1,6);

46

(2,1); ... ; (2,6); (3,1);...; (3,6), worin die erste Zahl die Farbe beschreibt und die zweite

Zahl die Nummer. Offensichtlich handelt es sich bei der zufälligen Ziehung einer Kugel

um ein Laplace- Experiment, denn alle 18 Zufallsvariablen sind gleichwahrscheinlich.

Die Wahrscheinlichkeitsfunktion für das Ereignis " X=x; Y=y" heißt dann:

"1

$18

$

f(x,y) = P(X = x,Y = y) = #

$0

$%

für

x = 1,2,3;y = 1,2,3,4,5,6

.

für alle anderen Paare (x,y)

Im Bild sieht f(x;y) so aus: Jedem Punkt der x-y-Ebene ist

ein

(Wahrscheinlichkeits-)

Funktionswert zugeordnet. An

den

18

möglichen

Zufallsvariablenwerten

(gelb)

sind diese 0.0555 (blau); an

allen anderen Stellen sind sie

Null.

!

In der Excel Darstellung (Bild

darunter) sind die von Null

verschiedenen 18 Funktionswerte als dünne Säulen dargestellt.

Die Wahrscheinlichkeitsverteilung einer diskreten zweidimensionalen Zufallsvariablen

(X,Y) können wir aus f(x,y) ableiten:

F(x,y) =

# # f(xi,yk ) . Der Wert von F(X=x,Y=y) ist also definiert durch die Summe

xi "x y k "y

!

47

aller Wahrscheinlichkeiten, in denen die diskreten Zufallsvariablen xi und yk gleichzeitig

Werte kleiner gleich x und y annehmen. Z.B ist

6 1

F(2,3) = f(x1,y1) + f(x1,y2 ) + f(x1,y3 ) + f(x2,y1) + f(x2,y2 ) + f(x2,y3 ) =

= .

18 3

In unserem Beispiel heißen die Zufallsvariablen Farbe X={s=1,w=2,g=3} und Zahl

Y={1,2,3,4,5,6} und damit ist F(x,y)=F(Farbe, Zahl).

!

Zahl} "

Farbe

123

#

1 (schwarz)

2 (rot)

3 (gelb)

1

2

1 1

18 9

1

4

9 18

1

1

6

3

3

4

5

6

1 4

5 1

6 18 18 3 Tabelle der Vereilungsfunktion F(X,Y)

1 4

5

2

3 9

9

3

1 2

5

1

2 3

6

!

Bild: Verteilungsfunktion F(x,y)=F(Farbe,Zahl) als Grafik, (Mathematica).

Für die Randverteilungen F1(x) und F2(y) gilt:

6

#

%pi = "pij = pi1 + pi2 + ...+ pi6 = 6 = 1 für x = xi = 1,2,3

FFarbe = F1(x) = $ 1

18 3

j=1

%

für alle übrigen x, und

&0

!

!

3

#

%p j = "pij = p1j + p2j + p3j = 3 = 1 für y = y j = 1,2,3,4,5,6

FZahl = F2 (y) = $ 2

18 6

i=1

%

für alle übrigen y, und

&0

48

2

Eine französische und eine russische Biathlonläuferin kommen gleichzeitig an den letzten Schießstand. Die Französin hat eine Treffsicherheit von 85%, die Russin von 90%.

Wie groß ist die Wahrscheinlichkeit, dass die Französin i- mal und die Russin j- mal treffen, 0≤i, j≤5. Wie groß ist die Wahrscheinlichkeit dass die Russin häufiger, gleich häufig,

weniger häufig trifft als die Französin?

Die Tabelle für die Wahrscheinlichkeiten pf bzw. pr von x Treffern der Französin bzw.

Russin sieht so aus (Binomialverteilung):

i

0

1

2

3

4

5

pr 0.001 0.045 0.810 7.290 32.81 59.05

pf 0.008 0.215 2.438 13.82 39.15 44.37

!

Die Tabelle für die Wahrscheinlichkeiten pf mal pr, mit der gleichzeitig dieFranzösin imal und die Russin j- mal treffen, sieht so aus:

i/ j # 0

1

2

3

4

5

"

0

1

2

3

4

5

!

7 $10%7

2 $10%5

0.0002

0.0014

0.0039

0.0044

3 $10%5

0.0010

0.0110

0.0622

0.1762

0.2000

0.0006

0.0174

0.1975

1.1192

3.1712

3.5940

0.0055

0.1568

1.7776

10.073

28.541

32.346

0.0249

0.7058

7.9993

45.329

128.43

145.56

0.0448

1.2705

14.399

81.593

231.18

262.00

Aus dieser Tabelle berechnen wir die Wahrscheinlichkeit, dass die Russin häufiger, weniger, gleich viel trifft aus

'

(

(

5$ n

5 % i#1

5 % i#1

&

)

'

*

'

#& # pfi " prj ) * 0.385 , $' $ pfi " prj * + 0.215 und $' $ pfi " prj ** + 0.400 .

i=0% j=i+1

i=0& j=0

i=0& j=0

(

)

)

(

!

)

(

!

Bild für die

)

(

!

)

49

Grafik der Wahrscheinlichkeit

für gleichzeitiges Eintreffen von

i Treffern der Französin und j

Treffern der Russin

Wenn wir die

Schusszahl auf

n=50

erhöhen

und die Trefferwahrscheinlichkeit

auf

beispielsweise

pr=55%

und

pf=50% senken,

so

verschiebt

sich der „Wahrscheinlichkeitsturm“ in die

Mitte, (s. Bild).

50

Wir werden jetzt die Begriffe Wahrscheinlichkeitsdichte, Verteilungsfunktion und Randverteilung für Zufallsexperimente mit einer stetigen, zweidimensionalen Zufallsvariablen diskutieren. Wie im diskreten Fall ist das Zufallsexperiment sowohl durch die Wahrscheinlichkeitsdichte wie auch durch die Wahrscheinlichkeitsverteilung eindeutig bestimmt. Im stetigen Fall ist die Wahrscheinlichkeit, daß f einen Wert f(x,y) annimmt, gleich Null, aber offensichtlich deshalb trotzdem nicht unmöglich. Weil aber jeder Wert (x,y) stets die Wahrscheinlichkeit p(x,y) = 0 besitzt, macht es keinen Sinn eine Wahrscheinlichkeitsfunktion zu

definieren, die dann ja überall Null sein müßte. Stattdessen definiert man die Wahrscheinlichkeitsdichte f(x,y) und beschreibt damit die Wahrscheinlichkeit, mit der ein gewisses

Ereignis des Zufallsexperimentes Werte innerhalb des Teilbereichs x1≤X≤x2, y1≤Y≤y2 der

X-Y Ebene liegt. Mathematisch drücken wir das dann so aus:

x2 y 2

" " f(x,y) dydx = P(x1 < X # x2,y1 < Y # y2 ) .

x1 y1

Analog zum zweidimensionalen, diskreten Fall stellen wir die stetige Wahrscheinlichkeitsverteilung mittels f(x,y) so dar.

!

Definition stetige, zweidimensionale Wahrscheinlichkeitsverteilung

Eine stetige, zweidimensionale Wahrscheinlichkeitsverteilung ist so definiert:

x y

F(x,y) =

& & f(",#) d#d"

$%$%

mit

(x y

+

*

lim F(x,y) = lim & & f(",#) d#d"- = 1 .

x'%

x'% *

-,

)$%$%

y'%

y'%

Die Wahrscheinlichkeitsverteilung beschreibt die Wahrscheinlichkeit, mit der eine zweidimensionale Zufallsvariable einen Wert annimmt, bei dem gleichzeitig X≤x und Y≤y ist.

!

Für die stetigen Randverteilungen F1(x) von X und F2(y) von Y gelten:

Definition stetige Randverteilung

Die stetigen Randverteilungen sind so definiert

#

F1(x) =

$ f(x,y) dy

Randverteilung von X

"#

#

F2 (y) =

!

$ f(x,y) dx

"#

Randverteilung von Y

.

Es sind F1(x) die Dichtefunktion der Zufallsvariablen X, F2(y) die Dichtefunktion der Zufallsvariablen Y.

!

Alle Aussagen lassen sich offensichtlich analog in einen höherdimensionalen Fall übertragen. Wir veranschaulichen die eingeführten Begriffe an einem zweiten Beispiel.

51

Beispiel 2

Das zweite Beispiel zeigt eine stetige Dichtefunktion f(X,Y) mit der zweidimensionalen,

normalverteilten Zufallsvariablen (X,Y). Darin wurden die Erwartungswerte µ und die

Streuungen σ an die Binomialverteilung der Biathlonschützinnen (Beispiel 1) mit n=50,

pf=0.5 und pr=0.55 angepasst. Dies ergibt

µ f = n " pf = 50 " 0.5 = 25, µR = n " pr = 50 " 0.55 = 27.5, # f = n " pf (1$ pf ) = 3.5355 und #r = 3.5178 :

!

f(x,y) =

2

2/

,

1 & x%µ f ) & x%µr ) 1

% .(

+

+ (

+

2.-' " f * ' " r * 10

1

e

" f # "r # 2$

=

2

2

1,& x%25 ) & y%27.5 ) /

% .(

+ +(

+ 1

2.-' 3.5355 * ' 3.5178 * 10

1

e

78.146

, % 2 < x < 2,%2 < y < 2.

Die stetige Verteilungsfunktion sieht dann so aus (s. auch das Bild):

!

F(x,y) =

1

78.146

2

2

1)# x"25 & # y"27.5 & ,

( +%

( .

x y " +%

2+*$ 3.5355 ' $ 3.5178 ' .-

0 0e

dydx .

"/"/

Eine geschlossene Form existiert nicht für die Verteilungsfunktion.

!

Grafisch können wir f(x,y) als zweidimensionale Oberfläche im dreidimensionalen Raum darstellen. Im Bild ist zusätzlich ein Rechteck eingezeichnet, das einen gewissen Trefferbereich

<2

x <428

<2

y<

der Wettkämpferinnnen markiert, z.B. der Trefferbereich 18

14

3, 20

14

430

3 . Das Volumen

Französin

Russin

über diesem Rechteck stellt die Wahrscheinlichkeit dar mit der diese Trefferzahlen eintreffen.

Mit Mathematica berechnen wir dafür numerisch:

P(18 < X " 28,20 < Y " 30) =

!

1

78.146

28 30

1

2

2.

1+% x$25

! (* +%' y$27.5 (* 0

$ -'

2-,& 3.5355 ) & 3.5178 ) 0/

1 1 24# e

18 20

dydxy = 0.5795.

52

Die beiden Randverteilungen sind:

f1(x) =

=

1

3.5355 " 3.5178 " 2#

1

3.5355 " 2#

2

2

1+% x$25 ( % y$27.5 ( .

* +'

* 0

1 $ -'

2-,& 3.5355 ) & 3.5178 ) 0/

2e

$1

1% x$25 (2

$ '

*

" e 2 & 3.5355 )

dy

%

(2

1 $ 1 ' y$27.5 *

e 2 & 3.5178 ) dy =

1

2

3.5178 " 2# $1

144444

42444444

3

1

3.5355 " 2#

1 % x$25 (2

$ '

*

" e 2 & 3.5355 )

und

1

!

f2 (y) =

=

1

3.5355 " 3.5178 " 2#

1

3.5178 2#

+

.

1 % x$25 (2 % y$27.5 (2

1 $ 2-'& 3.5355 *) +'& 3.5178 *) 0

0/

,-

2e

$1

2

1 % y$27.5 (

$ '

*

" e 2 & 3.5178 )

dx

%

(2

1 $ 1' x$25 *

e 2 & 3.5355 ) dx =

1

2

3.5355 2# $1

1444442444443

1

3.5178 2#

1% y$27.5 (2

$ '

*

" e 2 & 3.5178 ) .

.

=1

!

Man beachte, dafl f1(x) in der Tat nur von x abh‰ngt, weil die Variable y heraus integriert wird, und dass umgekehrt f2(y) entsprechend nur von y abh‰ngt, weil die Variable x durch die Integration verschwindet.

Das Bild links zeigt die stetige zweidimensionale, normalverteilte Funktion f(x,y)

zusammen mit der diskreten,

zweidimensionalen Binomialverteilung für das Zufallsexperiment: Schießen von

zwei Athletininnen mit n=50

Schuss und der Treffsicherheit von 50% bzw. 55%. Wir

erkennen aus dem Verlauf

der Randverteilungen der

Binomialverteilung dass die

Randverteilungen

der

Gaussfläche, also f1(x) und

f2(y),

eindimensionale

Gausskurven darstellen.

53

6.1.8.2 Stochastisch unabhängige - abhängige Zufallsvariablen

Beobachten wir verschiedene Merkmale an Zufallsexperimenten und erklären dazu durch

die Zuordnung reeller Zahlen die Zufallsvariablen, z.B. X und Y, so können diese beiden

Merkmale voneinander abhängen oder auch unabhängig voneinander sein. Wir überlegen

uns zu jedem Begriff der Abhängigkeit ein Beispiel.

1

Zufallsexperiment: Würfeln mit zwei unterscheidbaren Würfeln

Die Merkmale beim Würfel 1 sind die 6 unterscheidbaren Punktzahlen auf der Würfelfläche. Indem wir die Augenzahlen auf der Würfelfläche des ersten Würfels als Zufallsvariable X und die Augenzahlen auf der Würfelfläche des zweiten Würfels als Zufallsvariable Y einführen, erhalten wir eine zweidimensionale Zufallsvariable (X,Y).

Offensichtlich sind die Ergebnisse der Komponenten X und Y der Zufallsvariablen

(X,Y) voneinander unabhängig. Die gemeinsame Verteilungsfunktion F(x,y) zur zweidimensionalen Zufallsvariable (X,Y) sieht so aus:

F(x,y) =

# #pik

z.B. F(2,3) = p11 + p12 + p13 + p21 + p22 + p23 =

xi "x y k "y

6 1

= .

36 6

Zwei Beispiele der eindimensionalen Verteilungsfunktionen F1(x) bzw. F2(y) sind:

!

12 1

F1(2)=p11+p12+...+p16+p21+p22+ ...+p26=

= und

36 3

!

F2(3)=p11+p21+...+p61+p12+p22+...+ p62+p13 +...+p63=

18 1

= .

36 2

! 1

Offensichtlich gilt: F(2,3)=F1(2)·F2(3)= .

6

Wir definieren aus diesem Beispiel heraus den Begriff!der stochastischen Unabhängigkeit

Definition stochastische Unabhängigkeit von Zufallsvariablen

!

Die Zufallsvariablen X und Y mit den Verteilungsfunktionen F1(x) und F2(y) und der gemeinsamen Verteiungsfunktion F(x,y) heißen stochastisch unabhängig, wenn die Bedingung

F(x,y)=F1(x)·F2(y) für alle (x,y) erfüllt ist.

Als Gegenstück zum Beispiel 1 betrachten wir nun das folgende Beispiel 2.

2

Zufallsexperiment "Roulett (ohne zero)".

Zu diesem Zufallsexperiment können wir zwei eindimensionale Zufallsvariable erklären, X=Zahl, Y=Farbe mit den Merkmalen Rot=0 und Schwarz=1. Für beide Zufallsvariable beschreiben wir problemlos die Verteilungsfunktionen F1(x) und F2(y), worin

x insgesamt 36 diskrete Zahlenwerte annehmen kann und y insgesamt 2 Zahlenwer1

te. Beispielsweise besitzt F1(1) die Wahrscheinlichkeit

und F2(0) die Wahr36

!

54

1

; andererseits besitzt F(1,0) aber die Wahrscheinlichkeit Null und

2

1

nicht die Wahrscheinlichkeit

, weil die Zahl 1 im Roulett eine schwarze Farbe be72

sitzt und somit die Konstellation Zahl 1 und gleichzeitig Farbe Rot unmöglich ist. Es

! auch in diesem Beispiel durchaus Konstellationen in denen die Regel für

gibt aber

stochastische Unabhängigkeit anwendbar ist: F(x,y) = F1(x) " F2 (y) gilt, z.B.

! 1

1

F(18,1) = F1(18) " F2 (1) = "1= . Dennoch sind in diesem Beispiel X und Y nicht sto2

2

chastisch unabhängige Variable, weil die obige Regel nicht für alle x und für alle y gilt.

!

scheinlichkeit

! 6.1.8.3 Maßzahlen von Zufallsvariablen Z, die sich als Summe oder Produkt von

zwei stochastisch unabhängigen Zufallsvariablen X und Y gewinnen lassen

Ausgehend von zwei Zufallsvariabeln können wir weitere neue Zufallsvariable gewinnen.

Im Beispiel des Zufallsexperiments "Würfeln mit zwei unterscheidbaren Würfeln" können

wir aus den Zufallsvariablen X und Y weitere durch Z=X+Y oder Z=X·Y gewinnen. Die

Wahrscheinlichkeitsverteilung der neuen Zufallsvariablen ließe sich dabei anhand der Verteilungsfunktion F(Z) eindeutig beschreiben. Dabei stellt sich die Frage, wie man F(Z) gewinnt und welcher Zusammenhang zwischen den Eigenschaften (Maßzahlen) von F(Z)

einerseits bzw. F(X) und F(Y) andererseits besteht. Wir wollen diese Fragen exemplarisch

am Würfelbeispiel und einem Roulettbeispiel untersuchen.

Offensichtlich sind im Würfelbeispiel für Z=X+Y insgesamt n=11 verschiedene Werte (Zufallsvariable) möglich. Die Wahrscheinlichkeit der einzelnen Werte errechnen wir, indem

wir die Gesamtzahl aller unterscheidbaren Würfelkonstellationen mit zwei Würfeln abzählen (36), und dann für jeden Summenwert z∈Z die Anzahl g von Konstellationen bestimg

men, deren Summe den Wert z ergeben. Der Quotient f(z) = dieser beiden Zahlen defin

niert die Wahrscheinlichkeitsfunktion f(z). Aus f(z) ermitteln wir anschließend auch die

Verteilungsfunktion F(z). Das Ergebnis sieht so aus:

Z

2

3

4

5

6

7

(1,1) (1,2) (1,3) (3,2) (1,5) (1,6)

(2,1) (2,2) (4,1) (2,4) (2,5)

(3,1) (2,3) (3,3) (3,4)

(1,4) (4,2) (4,3)

(5,1) (5,2)

(6,1)

g

1

2

3

4

5

6

1

2

3

4

5

6

f(z)

36 36 36

36

36

36

1

3

6

10

15

21

F(z)

36 36 36

36

36

36

!

!9

8

10

11

12

(2,6) (3,6) (4,6) (5,6) (6,6)

(3,5) (4,5) (5,5) (6,5)

(4,4) (5,4) (6,4)

(5,3) (6,3)

(6,2)

5

5

36

26

36

4

4

36

30

36

3

3

36

33

36

2

2

36

35

36

1

1

36

36

36

Im Roulettbeispiel reduzieren wir wegen der einfacheren Übersicht die Anzahl der Felder

auf 4. Die Zufallsvariablen X (Zahlen 1,2,3,4) sind darin mit den Zufallsvariablen Y (Farben

55

Rot=0 und Schwarz=1) in einer zweidimensionalen Zufallsvariablen (X,Y) so verknüpft:

{(1,1),(2,0),(3,1),(4,0)}. Durch die Zuordnung dieser zweidimensionalen Zufallsvariablen

mittels Summe erhalten wir die Zufallsvariable Z, bestehend aus den Zahlen 2 und 4. Die

Wahrscheinlichkeitsfunktion f(z) und die Verteilungsfunktion F(z) sehen dann so aus, (s.

auch Tafel auf den folgenden Seiten):

"$0.5 für z = 2

"$0

für z < 2

f(z) = #0.5 für z = 4 und F(z) = #0.5 für 2 & z < 4 .

$% 0

$%1

sonst

für z ' 4

Wir wollen nun darstellen, wie die Maßzahlen der Zufallsvariablen Z mit den Maßzahlen

von X und Y zusammenhängen. Dabei wollen wir uns auf Summe Z=X+Y und Produkt

Z=X·Y beschränken, andererseits aber auch den höherdimensionalen Fall mit beschreiben. Wir beginnen mit dem

!

Additionssatz für Mittelwerte

Der Mittelwert einer aus n Zufallsvariablen X1,X2, ... ,Xn gebildeten Zufallsvariablen

Z=X1+X2+...+Xn ist gleich der Summe der Mittelwerte der einzelnen Zufallsvariablen, falls

diese existieren:

E(Z)=E(X1+X2+...+Xn)=E(X1)+E(X2)+...+E(Xn).

Beispiele

1

Würfelbeispiel: Summe Z=X+Y zweier Würfelzahlen X,Y.

X/Y # 1 2 3 4

5

6

1

2 3 4 5

6

7

2

3

4

5

6

3

4

5

6

7

7

8

9

10

11

8

9

10

11

12

"

2

!

4

5

6

7

8

5

6

7

8

9

6

7

8

9

10

Es sind E(X)=3.5 und E(Y)=3.5. Den Mittelwert E(Z)

für Z=X+Y errechnen wir aus der Summe aller

Tabellenwerte dividiert durch deren Anzahl:

E(Z)=7=E(X+Y)=E(X)+E(Y)=3.5+3.5=7.

Damit ist der obige Satz bestätigt.

Im reduzierten Roulettbeispiel mit 4 Elementarereignissen {(1,1),(3,1),(2,0),(4,0)} gilt:

1+ 2 + 3 + 4

0+1 1

= 2.5, E(Y) =

= ,

4

2

2

also E(X) + E(Y) = 3.

X/Y # 1 2 3 4

"

0

2

4

1

2 gilt: 4

Andererseits

4

E(X) =

8

E(Z) = E( X + Y ) = $ (i!" f(i)) + $ ((i # 3) " f(i # 3)) = 1" 0 + 2 "

!

i=1

i=5

1

1

1

1

+ 3" 0 + 4" + 2" + 4" + 5" 0 = 3.

4

4

4

4

Damit ist der Additionssatz auch in diesem Beispiel bestätigt.

!

56

Eine Erweiterung des Additionssatzes für Mittelwerte heißt so:

Für eine aus n Zufallsvariablen X1,X2,...,Xn gebildete Linearform

Z=a1X1+a2X2+...+anXn folgt:

E(Z)=E(a1X1+a2X2+...+anXn)=a1·E(X1)+a2·E(X2)+...+an·E(Xn).

Anstelle der Addition können wir auch die Multiplikation verwenden, um neue Zufallsvariable zu schaffen: Z=X·Y.

Allerdings läßt sich dann eine entsprechende Regel wie oben nicht aufstellen. Generell gilt

nämlich:

E(Z)=E(X·Y)≠E(X)·E(Y).

Sind die Zufallsvariablen X und Y jedoch stochastischer Natur, dann dürfen wir die Additionsregel auf die Multiplikation übertragen und folgenden Sachverhalt formulieren:

Produktsatz für Mittelwerte von stochastisch unabhängigen, diskreten oder stetigen

Zufallsvariablen

Der Mittelwert E(Z)=µZ einer Zufallsvariable Z, die als Produkt aus n stochastisch unabhängigen Zufallsvariablen X1,X2,X3,...,Xn formuliert wurde, ist gleich dem Produkt der

Mittelwerte der einzelnen Zufallsvariablen:

E(X1·X2·X3,...·Xn)=E(X1)·E(X2)·E(X3)·...·E(Xn).

Im Würfelbeispiel haben wir stochastisch unabhängige Zufallsvariable X und Y. Durch die

Produktbildung erhalten wir folgende Zuordnungen:

Wir sehen, daß die Zufallsvariable Z=X·Y insgesamt

X/Y # 1 2 3 4 5 6

18 verschiedene Werte zwischen 1 und 36 annimmt.

"

Einige Werte treten mehrfach auf, z.B. 2 und 3 zwei1

1 2 3 4 5 6

2

2 4 6 8 10 12 mal, 4 dreimal, u.s.w.. Durch Abzählen entwickeln wir

aus der Tabelle die Wahrscheinlichkeitsfunktion und

3

3 6 9 12 15 18 die Verteilungsfunktion. Der Mittelwert E(Z) ist die

4

4 8 12 16 20 24 Summe aller Tabellenwerte dividiert durch die Anzahl

5

5 10 15 20 25 30 der Tabellenwerte: E(Z) = 441 = 49 .

36

4

6

6 12 18 24 30 36

7

und damit E(Z)=E(X·Y)=E(X)·E(Y).

2

!

Im Beispiel Reduziertes Roulett sind die Variablen nicht stoX/Y # 1 2 3 4

chastisch unabhängig. Jetzt erhalten wir aus der Produktbildung

"

0

0

0 nebenstehende

! Tabellenwerte:

Wie im Würfelbeispiel ermitteln wir die Wahrscheinlichkeitsfunkti1

1

3

on f(z) und die Verteilungsfunktion F(z) durch Abzählen der Häufigkeiten. Als Mittelwert errechnen wir:

Andererseits ist der Mittelwert von E(X)=E(Y)=

!

!

57

E(Z) =

1+ 0 + 3 + 0

= 1.

4

Der Mittelwert der Zufallsvariablen X ist E(X)=2.5, der Mittelwert der Zufallsvariablen Y ist

E(Y)=0.5. Danach gilt:

!

1=E(Z)=E(X·Y)≠E(X)·E(Y)=1.25.

Es existiert für stochastisch abhängige Variablen X und Y kein Produktsatz für Mittelwerte.

Einen Satz, der dem Additionssatz für Mittelwerte entspricht, können wir für die Varianzen von Z=X+Y nur herleiten, wenn die Zufallsvariablen X und Y stochastisch unabhängig sind. Ansonsten gilt die etwas kompliziertere Aussage:

Für die Varianz "2Z einer Summe Z=X+Y gilt die Beziehung

"2Z = "2X + "2Y + 2" XY , worin " XY = E(X # Y) $ E(X) # E(Y) die Kovarianz bedeutet.

!

Beispiele

!

1

Würfelbeispiel

!

Die Zufallsvariablen X und Y sind stochastisch unabhängig. Für die Varianzen gilt jetzt:

"2X = 2.916, "2Y = 2.916 und " XY = E(X # Y) $ E(X) # E(Y) = 0 .

! 2

Für die Varianz der Summe gilt: "2Z = 5.83 . Damit ist die Formel für die Varianz bestätigt.

Reduziertes Roulett

Die Zufallsvariablen X und Y sind stochastisch nicht unabhängig. Für die einzelnen Varianzen gilt: "2X = 1.25; "!2Y = 0.25 und " XY = E(X # Y) $ E(X) # E(Y) = 1$1.25 = $ 0.25 .

Für die Varianz der Summe gilt: "2Z = 1.0 . Damit ist die allgemeine Formel für die Varianzen

! bestätigt: 1.0=1.25+0.25-2·0.25 .

Anmerkung

!

Wegen E(X·Y)=E(X)·E(Y) für stochastisch unabhängige Zufallsvariable gilt in diesem Fall:

"2Z = "2X + "2Y .

!

58

6.1.8.3 Stochastisch unabhängige und normalverteilte Zufallsvariable

Seien nun

X1,X2,...,Xn n normalverteilte und stochastisch unabhängige Zufallsvariable

mit den Mittelwerten

E(X1) = µ1, µ 2, ... ,µn und den Varianzen "12,"22 ,...,"2n .

Dann gelten für die Zufallsvariable Z=X1+X2+...+Xn, die wir aus der Addition der einzelnen Zufallsvariablen errechnen, folgende Eigenschaften:

!

1

Z ist gleichfalls normalverteilt.

2

Der Mittelwert von Z ist E(Z)= µ 1+ µ 2+...+ µ n.

3

Die Varianz von Z ist Var( Z) = "2Z = "12 + "22 + ...+ "2n .

Ein wichtiger Sonderfall liegt vor, wenn die stochastisch unabhängigen und normalverteilten Zufallsvariablen Xi denselben Mittelwert µ=µ i und dieselbe Varianz σi besitzen, 1≤i≤ n.

!

Dann hat die normalverteilte Zufallsvariable Z den Mittelwert µ Z = n " µ und die Varianz den

Wert "2Z = n # "2 .

Anmerkung

!

Die Aussagen über Summen von Zufallsvariablen lassen

sich auch auf ihre Linearformen

! übertragen:

Z=a1X1+a2X2+...+anXn.

Beispiele

1

Seien X1,X2,...,Xn n normalverteilte und stochastisch unabhängige Zufallsvariable mit

2

demselben Mittelwert µ und dergleichen Varianz σ . Zu diesen Zufallsvariablen bilden

wir den arithmetischen Mittelwert:

X + X2 + ...Xn 1

1

X= 1

= ( X1 + X2 + ...+ Xn ) = Z .

n

n

n

!

1

Zwischen X und der Summe Z besteht danach der lineare Zusammenhang X = Z .

n

Gemäß den vorhergehenden Anmerkungen gilt dann:

1

1

1

µ!

X = E(X) = E( n Z) = n E(Z) = n nµ = µ

und

# 1 & # 1&2

1

1

"2 = Var(X) = Var% Z( = % ( ) Var(Z) = 2 n"2 = ) "2 .

X

$n ' $n'

n

n

( )

!

!

!

59

Der Ausdruck X besitzt also denselben Mittelwert wie die einzelnen Xi, aber nur den

1

" ten Teil der Varianz. Dieses Ergebnis ist bedeutsam für die Fehler und

n

Ausgleichsrechnung.

2

!

Eine Isolierwand sei aus 10 Schichten Xi, 1≤i≤10, vom Material A und 9 Verbindungsschichten Yi, 1≤i≤ 9, vom Material B zusammengesetzt. Alle Xi und Yi seien dabei voneinander unabhängige, normalverteilte Zufallsgrößen mit den folgenden statistischen

Kenngrößen:

Xi : E( Xi ) = µ Xi = 0.1m, " Xi = 0.025m, 1# i # 10,

Yi : E( Yi ) = µ Yi = 0.02m, " Yi = 0.004m, 1# i # 9.

Gefragt ist nach den Werten µZ=E(Z) und σZ für die Wahrscheinlichkeitsverteilung der

10

!

Dicke Z der gesamten Isolierschicht: Z = " Xi + " Yi :

10

i=1

"2Z

i=1

9

E(Z) = "E(Xi ) +

!

9

10

= Var(Z) = #

i=1

i=1

"E(Yi ) = 10 # E(Xi ) + 9 # E(Yi ) = 10 # 0.1m + 9 # 0.02m = 1.18m ,

i=1

"2X

i

9

+#

i=1

"2Y

i

!

= 10 $ 0.025m + 9 $ 0.004m = 0.286m.

!

Die drei Normalverteilungen f(Xi), rot, f(Yi), blau, und f(Z), magenta.

60

6.1.8.4 Zentraler Grenzwertsatz der Wahrscheinlichkeitsrechnung

Im Abschnitt 6.1.8.3 haben wir aus einer Summe von normalverteilten, stochastisch unabhängigen Zufallsgrößen mit vorgegebenen Verteilungsfunktionen (definiert durch µ und σ)

eine neue normalverteilte Zufallsgröße und deren Verteilungsfunktion berechnet. In der

Praxis werden wir z.B. in der Theorie der Meßfehler mit einer solchen Situation konfrontiert. Ein Meßfehler einer technischen Meßgröße kann als Zufallsgröße aufgefaßt werden,

die sich ihrerseits zusammensetzt aus der Summe vieler voneinander unabhängiger, zufälliger Einzelfehler. Anders als in der theoretischen Abhandlung im letzten Abschnitt ist

die Verteilung der Einzelfehler unbekannt. Der sogenannte Zentrale Grenzwertsatz der

Wahrscheinlichkeitsrechnung gibt uns für die weitere Berechnung solcher praktischer

Probleme die Information, daß wir unter bestimmten Voraussetzungen diese als annähernd normalverteilt betrachten können. Er lautet

Zentraler Grenzwertsatz der Wahrscheinlichkeitsrechnung

Seien X1,X2,...,Xn stochatisch unabhängige Zufallsvariable, die alle die gleiche Vertei2

lungsfunktion mit dem Mittelwert µ und der Varianz σ besitzen. Dann konvergiert die Verteilungsfunktion der Zufallsvariablen

Un =

(X1 + X2 + ...+ Xn ) " nµ

n#$

im Grenzfall n→∞ gegen die Verteilungsfunktion Φ(ξ) der Standardnormalverteilung:

2

!

lim Fn($) = %($) =

n"#

$ 'u

e 2

1

(

2& '#

du .

Dieser Satz besagt:

!

Z " nµ

Für hinreichend großes n ist Un = n

mit Zn = X1 + X2 + ...+ Xn eine annähernd stann#$

dardnormalverteilte Zufallsvariable. Dann ist aber auch Zn = X1 + X2 + ...+ Xn für hinreichend großes n eine annähernd normalverteilte Zufallsvariable mit dem

!

Mittelwert E( Zn) = n " µ und der Varianz Var( Zn) !

= n " #2 .

Wir haben für den Grenzwertsatz vorausgesetzt, daß alle Summanden Xi der gleichen

Verteilungsfunktion

genügen. Wir

! wollen diese vereinfachende Voraussetzung jetzt fallen

!

lassen und stochastisch unabhängige Zufallsvariablen Xi mit verschiedenen Mittel2

werten E(Xi)=µi und verschiedenen Varianzen Var(Xi)= !i zulassen.

Der Additionssatz für stochastisch unabhängige Zufallsvariable Zn=X1+X2+...+Xn ergibt

zwei Aussagen für den Mittelwert µn bzw. die Varianz σn von Zn:

E(Zn) = µ Z = µ1 + µ2 + ... + µn bzw. Var( Zn) = "2Z = "12 + "22 + ...+ "2n .

n

n

!

!

61

Z "µ

Fast immer gilt dann, daß die Verteilungsfunktion Fn(ξ) von Un = n n im Grenzfall

#

n→∞ gegen die Standardnormalverteilung Φ(u) konvergiert:

u2

$

'

1

2 du . Also gilt für hinreichend

!

lim [Fn ($)] = %($) =

e

großes n Faustregel (n > 30):

(

2& '#

n"#

Es ist die Zufallsvariable

!

Z "µ

Un = n

#

annähernd standardnormalverteilt und die Zufallsvariable

Zn=X1+X2+...+Xn

annähernd normalverteilt

Mittelwert E(Zn) = µ = µ1 + µ2 + ...+ µn

!

und der Varianz

mit dem

"2 = "12 + "22 + ...+ "2n .

Beispiele

1

2

!

Messfehler lassen sich als Summe Z einer großen Anzahl von unabhängigen Einzelfeh!

lern Xi formulieren, worin jeder Anteil Xk, 1≤k≤n, nur einen geringen Anteil am Gesamtfehler ausmacht. Dannach kann der Gesamtfehler Z als annähernd normalverteilt betrachtet werden.

Besteht unser Zufallsexperiment aus einer Anzahl n voneinander unabhängiger Stichprobenwerte X1, X2,...,Xn so ist das arithmetische Mittel

X + X2 + ...+ Xn

X= 1

n

eine annähernd normalverteilte Zufallsvariable. DieStichproben

2

haben alle die gleiche Verteilungsfunktion mit dem Mittelwert µ und der Varianz σ .

"2

µ + µ + ...+ µn

Also besitzt X den Mittelwert µ = E(X) = 1 2

und die Varianz Var(X) =

,

n

n

mit "2 = "12 + "22 + ...+ "2n .

!

3

!

a

Mittelwerte

von Zufallszahlen sind ein Werkzeug, um die Theorie der Messwerte in ana!

lytische Berechnungen!zu übertragen und bildlich darzustellen. In!den folgenden Abbildungen wurden 5000 Zufallszahlen zwischen -10 und 10 in drei Varianten ausgewertet:

Wir teilen das Intervall [-10,10] in 20 Teilintervalle und berechnen die absoluten und relativen Häufigkeiten der Stichprobenwerte pro Intervall.

b

Wir gewinnen jeden einzelnen der 5000 Zufallsvariablenwerte als Mittelwerte aus seinerseits n=100 Zufallsgrößen zwischen -10 und 10. Für diesen Stichprobenumfang (s.

Kapitel 6.2) berechnen wir Mittelwert und Standardabweichung. Wir bemerken, dass

sich die Standardabweichung in guter Näherung um den Faktor n = 100 = 10 reduziert hat. Aus dem Bild erkennen wir, dass sich die Stichprobenwerte als GaussNormalkurve darstellen lassen.

c

Wir mitteln die Mittelwerte nochmals, wobei wir den doppelten

Mittelwert aus 100 einfa!

chen Mittelwerten gewinnen. Wir erkennen, dass sich die Standardabweichung gegenüber a um den Faktor

!

n2 = 10000 = 100 reduziert.

62

Das Bild zeigt die Varianten b und c. Offensichtlich können Mittelwerte von Zufallszahlen

generell durch eine Normalverteilung (orangene Kurve) dargestellt werden, s.a. Kapitel 6.2

in dem auch die Variante a dargestellt ist. Die grüne Kurve stellt die Normalverteilung dar,

wenn die Ergebnisse der orangenen Kurve nochmals gemittelt werden.