12 Die Normalverteilung

Werbung

12

Die Normalverteilung

Die Normalverteilung ist eine der wichtigsten Wahrscheinlichkeitsverteilungen in der Praxis, weil aufgrund des sogenannten zentralen Grenzwertsatzes in vielen Situationen angenommen werden kann, dass experimentell gewonnene Messwerte zumindest näherungsweise als Werte von normalverteilten Zufallsvariablen aufgefasst werden können.

12.1

Die Dichtefunktion

Die eindimensionale Verteilung mit der Dichte

1 2

1

ϕ(x) = √ e− 2 x ,

2π

x∈R

heißt die standardisierte Normalverteilung oder N (0, 1)-Verteilung.

Die Funktion ϕ ist positiv und im Lebesgueschen wie im uneigentlich-Riemannschen Sinn

integrierbar (sie wird für betragsmäßig große x durch 1/x2 majorisiert).

R ∞ Zur Berechnung

des Integrals benötigt man einen kleinen Trick. Man berechnet nicht −∞ ϕ(x) dx sondern

Z

∞

−∞

2 Z

ϕ(x) dx =

∞

−∞

Z

ϕ(x) dx ·

∞

ϕ(y) dy

−∞

=

Z

∞

−∞

Z

∞

ϕ(x)ϕ(y) dy

−∞

dx.

Nach dem Satz von Fubini ist das letzte Integral gleich dem Bereichsintegral über den

gesamten R2 :

Z

Z

1

2

2

1

e− 2 (x +y ) d(x, y).

ϕ(x)ϕ(y) d(x, y) =

2π R2

R2

Dieses Bereichsintegral wandeln wir durch Übergang zu Polarkoordinaten um:

x = r cos(φ) = x(r, φ),

y = r sin(φ) = y(r, φ).

Der Integrationsbereich wird dadurch die Menge

M = {(r, φ) : 0 ≤ r < ∞, 0 ≤ φ < 2π} = [0, ∞) × [0, 2π).

Die Funktionaldeterminante ist

∂(x, y)

= ∂(r, φ)

∂x

∂r

∂y

∂r

∂x

∂φ

∂y

∂φ

= r.

Wegen x2 + y 2 = r 2 sin2 (φ) + cos2 (φ) = r 2 erhält man dadurch

Z

Z

1

1

1 2

− 12 (x2 +y 2 )

e

d(x, y) =

re− 2 r d(r, φ)

2π R2

2π M

89

und weiter durch Übergang zum iterierten Integral

Z ∞ Z 2π

Z ∞

Z 2π

Z ∞

1

1

1

1 2

− 12 r 2

− 12 r 2

dφ dr =

dr ·

1 dφ =

re

re

· 2π

re− 2 r dr.

2π 0

2π 0

2π

0

0

0

Der Integrand des letzten Integrals besitzt die Stammfunktion

1 2

−e− 2 r

R

2

R∞

∞

so dass endlich −∞ ϕ(x) dx = 1 bzw. −∞ ϕ(x) dx = 1.

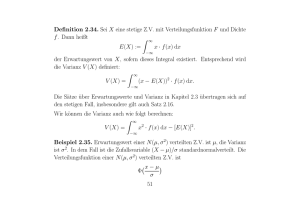

12.2

Erwartungswert und Varianz der Zufallsvariable mit der

standardisierten Normalverteilung

Sei X eine Zufallsvariable mit der standardisierten Normalverteilung N (0, 1).

Die Dichte dieser Verteilung

1 2

1

ϕ(x) = √ e− 2 x

2π

konvergiert für x → ±∞ so schnell gegen Null, dass die Funktionen x 7→ xk ϕ(x) für

alle k = 1, 2, 3, . . . im Lebesgueschen und im uneigentlich-Riemannschen Sinn integrierbar

sind.

Die Funktion h(x) = xϕ(x) ist eine ungerade Funktion, d.h. h(−x) = −h(x). Das Integral

einer derartigen Funktion über ein zum Nullpunkt symmetrisches Intervall (−a, a) ist

stets Null, so dass

Z

E(X) =

und die Varianz V (X) gleich E (X 2 ) ist.

∞

−∞

x · ϕ(x) = 0

Zur Berechnung des E (X 2 ) wenden wir die Regel der partiellen Integration auf den Integranden

2

2

x2 e−x /2 = x xe−x /2

an, wobei der Term in runden Klammern die Stammfunktion

−e−x

2 /2

besitzt. Damit ist

h Z ∞ Z ∞

i∞

1

1

2

−x2 /2

−x2 /2

−x2 /2

x xe

dx = √

x −e

−

−e

dx .

E X =√

−∞

2π −∞

2π

−∞

Wie oben angemerkt, konvergiert die Funktion in eckigen Klammern für x → ±∞ gegen

Null, so dass

Z ∞

Z ∞

1

2

−x2 /2

E X = √

e

dx =

ϕ(x) dx = 1,

2π −∞

−∞

denn das Integral einer Dichte über den gesamten Ergebnisraum hat stets den Wert 1.

90

12.3

Die Verteilungsfunktion der standardisierten Normalverteilung

Die Verteilungsfunktion der standardisierten Normalverteilung erhält nahezu einheitlich

in der Literatur das Symbol Φ:

Z x

1 2

1

Φ(x) = P (X ≤ x) = √

e− 2 t dt.

2π −∞

Dieses uneigentliche Integral ist jedoch nicht elementar lösbar, d.h. die Funktion Φ ist

nicht durch endlich viele algebraische Konstruktionen elementarer Funktionen darstellbar.

Die Werte dieser Funktion müssen daher mit speziellen Näherungsmethoden berechnet

werden.

Heutzutage findet

die sog. Gaußsche

R

erf :

x

man z.B. in MAPLE, MAXIMA und in anderen Software-Toolboxen

Fehlerfunktion (error function):

−→ [−1, 1]

2

7 → erf(x) = √

−

π

Z

∞

2 X

x2k+1

2

e−t dt = √

(−1)k

.

π k=0

(2k + 1)k!

−∞

x

und auch die Funktion erfc(x) = 1 − erf(x).

Mit ihr kann man durch eine simple Variablentransformation die Verteilungsfunktion Φ

1

x

Φ(x) = · 1 + erf √

2

2

berechnen.

Früher benutzte man eine Tabelle mit den auf das Intervall x ≥ 0 beschränkten Funktionswerten der Verteilungsfunktion. Aus solcher Tabelle lassen sich dann die benötigte

Funktionswerte von Φ mit Hilfe der folgenden Eigenschaften ablesen:

❶ Φ(0) = 21 .

❷ Für x ≥ 0 kann der Funktionswert Φ(x) direkt aus der Tabelle entnommen werden.

Es gilt dabei stets Φ(x) ≥ 0.5.

❸ Die Berechnung des Funktionswertes Φ(−x) für x > 0 erfolgt nach der Formel

(Spiegelsymmetrie)

Φ(−x) = 1 − Φ(x).

❹ P (|X| ≤ x) = 2Φ(x) − 1 = erf √x2 .

Wegen der Eigenschaft

1 ≥ P (|X| ≤ 4) = 2Φ(4) − 1 = erf

4

√

2

≥ 0.99 993 665

ist die Tabellierung meist nur auf 4 Stellen genau bis x = 3.99

91

12.4

Die allgemeine Normalverteilung

Wenn die Zufallsvariable Y die standardisierte Normalverteilung N (0, 1) besitzt, dann

hat die Zufallsvariable X = σ · Y + µ mit reellen Parametern σ 6= 0 und µ die Verteilung

PX mit der Dichtefunktion

(x−µ)2

1

x−µ

1

f (x) =

·ϕ

= √

e− 2σ2 .

|σ|

σ

2πσ 2

Diese Verteilung heißt die Normalverteilung mit Parametern µ und σ 2 oder N (µ, σ 2 )Verteilung.

Die Gestalt der Dichtefunktion erinnert an eine Glocke. Man spricht daher auch häufig

von der Gaußschen Glockenkurve.

• Der Graph von f ist achsensymmetrisch bezüglich der Geraden x = µ, der Graph

von der entsprechenden Verteilungsfunktion F ist punktsymmetrisch zu P (µ, 0.5).

• Das einzige Maximum liegt im Punkt x = µ mit dem Wert σ√12π . Die beiden Wendepunkte liegen symmetrisch zum Maximum an den Stellen x = µ ± σ.

• Während der Parameter µ die Lage des Maximums festlegt, bestimmt der zweite

Parameter σ Breite und Höhe der Glockenkurve. Dabei gilt: Je kleiner σ ist, umso

höher liegt das Maximum und umso steiler fällt die Dichtekurve nach beiden Seiten

ab.

Den Erwartungswert und die Varianz von X berechnen wir über den Erwartungswert und

die Varianz der N (0, 1)-verteilten Zufallsvariablen Y :

E(X) = E(σ · Y + µ) = σ · E(Y ) + µ = µ

und

V (X) = V (σ · Y + µ) = σ 2 · V (Y ) = σ 2 .

Die in der Dichtefunktion auftretenden Parametr σ und µ sind also zugleich Kennwerte

dieser allgemeinen Normalverteilung.

Eine normalverteilte Zufallsvariable X mit den Parameter µ und σ läßt sich dabei stets

mit Hilfe der linearen Transformation (Substitution)

Y =

1

(X − µ)

σ

in die Zufallsvariable Y mit der standardisierten Normalverteilung überführen (sog. Standardisierung oder Umrechnung in Standardeinheiten). Umgekehrt, die Familie der Normalverteilungen ist aus der standardisierten Normalverteilung durch die lineare Transformation X = σY + µ erzeugbar.

Genau diese für andere Verteilungsfamilien oft nicht erfüllte Eigenschaft macht die Handhabung der Normalverteilung besonders einfach, da nur die Funktionen Φ und ϕ erforderlich sind.

92

Bei einer normalverteilten Zufallsvariable X mit dem Erwartungswert µ und der Varianz

σ 2 lassen sich die Wahrscheinlichkeiten wie folgt mit Hilfe der Verteilungsfunktion Φ der

Standardnormalverteilung berechnen:

❶ P (X ≤ x) = F (x) = Φ

x−µ

σ

;

❷ P (X ≥ x) = 1 − P (X ≤ x) = 1 − F (x) = 1 − Φ x−µ

;

σ

− Φ a−µ

.

❸ P (a ≤ X ≤ b) = F (b) − F (a) = Φ b−µ

σ

σ

Wir berechnen noch die beideseitigen Ein-, Zwei,- und Drei-Sigma-Bereiche (zum Erwartungswert symmetrische Konfidenzintervalle zu den Konfidenzniveaus 2Φ(k) − 1, k =

1, 2, 3) für die N (µ, σ 2)-verteilte Zufallsvariable X:

P (|X − µ| ≤ kσ) = P (|Y | ≤ k) = Φ(k) − Φ(−k) = Φ(k) − (1 − Φ(k)) =

für k = 1,

0.682689

k

√

0.954500

für k = 2,

= 2Φ(k) − 1 = erf 2 ≈

0.997300

für k = 3.

Damit liegen bei allen normalverteilten Zufallsvariablen etwa 68%, 95.5% bzw. 99.7% aller

Realisierungen in den Ein-, Zwei, bzw. Drei-Sigma-Bereich9 .

12.5

Der Zentrale Grenzwertsatz

Sei X1 , X2 , X3 , . . . eine Folge von Zufallsvariablen auf einem Wahrscheinlichkeitsraum

(Ω, A, P ) mit Verteilungsfunktionen Fn (x) = P (Xn ≤ x). Konvergieren diese Verteilungsfunktionen für alle Argumente x gegen die Verteilungsfunktion der N (0, 1)-Verteilung:

lim Fn (x) = Φ(x)

n→∞

so sagt man, dass für die Folge dieser Zufallsvariablen der Zentrale Grenzwertsatz gilt.

Diese Art von Konvergenz bedeutet also nicht, dass die Funktionen Xn in irgendeiner Weise gegen eine normalverteilte Grenzfunktion X konvergieren. Es bedeutet für die praktischen Anwendungen nur, dass man bei genügend großem n” annehmen kann, dass die

”

Verteilung der Zufallsvariable Xn näherungsweise die standardisierte Normalverteilung

ist.

Der klassische Fall einer Folge, für die der zentrale Grenzwertsatz gilt, sind die normierten

Partialsummen einer Folge X1 , X2 , X3 , . . . von stochastisch unabhängigen Zufallsvariablen, die alle die gleiche Verteilung besitzen. Die Partialsummen sind die Zufallsvariablen

S n = X1 + X2 + · · · + Xn .

9

Bei Auswertung von Messreihen genügt es in der Regel, mit dem Zwei-Sigma-Bereich zu arbeiten. Der

Ein-Sigma-Bereich ist oft mit zu großen Unsicherheiten behaftet Um auch kleinere Risiken auszuschliessen,

kann man den Dre-Sigma-Bereich verwenden

93

Da die Xk alle die gleiche Verteilung besitzen, haben sie auch alle den gleichen Erwartungswert und die gleiche Varianz:

E (Xk ) = µ

und

V (Xk ) = σ 2 .

Für die Partialsummen folgt daraus

µn = E (Sn ) = E (X1 ) + E (X2 ) + · · · + E (Xn ) = nµ

und wegen der stochastischen Unabhängigkeit

σn2 = V (Sn ) = V (X1 ) + V (X2 ) + · · · + V (Xn ) = nσ 2 .

Von einer Folge von Zufallsvariablen mit unbeschränkt wachsenden Erwartungswerten

und Varianzen kann man keine wie auch immer geartete Konvergenz erwarten. Sie lassen

sich aber durch die schon bekannte lineare Transormation normieren. Die Zufallsvariablen

Sn∗ =

Sn − nµ

Sn − µ n

√

=

σn

σ n

heißen die normierten Partialsummen der Xk , und zwar deshalb, weil sie die Erwartungswerte

E (Sn ) − µn

E (Sn∗ ) =

= 0

σn

und die Varianzen

2

1

∗

V (Sn ) =

V (Sn ) = 1

σn

besitzen, also alle den gleichen Erwartungswert und die gleiche Varianz wie die N (0, 1)Verteilung.

Für die Praxis, etwa bei der Fehlerrechnung, kann man diese mathematischen Aussagen salopp auf den gemeinsamen Nenner bringen, dass ein Messfehler immer dann näherungweise

als normalverteilt angenommen werden darf, wenn er aus der Überlagerung vieler kleiner unabhängiger und nicht-systematischer Fehlerursachen resultiert, wobei keine dieser

Ursachen dominierend ist.

12.6

Approximation der Binomialverteilung durch die Normalverteilung

Eine Binomialverteilung B(n, p) mit n Einzelexperimenten mit Wahrscheinlichkeit p läßt

sich, für große Werte von n und p-Werte, die sich deutlich von 0 und 1 unterscheiden,10

durch die allgemeine Normalverteilung N (µ, σ 2 ) mit den Parametern

p

√

µ = np

und

σ = npq = np(1 − p)

10

für p-Werte in der Nähe von 0 und 1 kann man die Binomialverteilung durch die Poisson-Verteilung

näherungsweise ersetzen (vgl. Satz 7.15)

94

approximieren. Diese Approximation ist gut für σ 2 = np(1 − p) > 9 und wird mit zunehmenden n immer besser.

Eine in der Praxis häufig verwendete Formel lautet:

n k

p (1 − p)n−k ≈ F (k + 0.5) − F (k − 0.5) = Φ

k

oder

X n

pk (1−p)n−k ≈ F (b+0.5)−F (a−0.5) = Φ

k

a≤k≤b

k + 0.5 − np

p

np(1 − p)

!

!

−Φ

b + 0.5 − np

p

−Φ

np(1 − p)

k − 0.5 − np

p

np(1 − p)

a − 0.5 − np

p

np(1 − p)

!

!

,

wobei F die Verteilungsfunktion der N (µ, σ 2 )-Verteilung und Φ die Verteilungsfunktion

der Standardnormalverteilung ist.

Dabei wurde eine sog. Stetigkeitskorrektur (Verschiebung um jeweils 0.5 Einheiten nach

außen) vorgenommen. Die binomialverteilte Zufallsvariable ist nämlich eine diskrete Größe, erscheint jedoch in der Näherung durch die Normalverteilung als eine stetige Variable.

95