Statistik - Hochschule Esslingen

Werbung

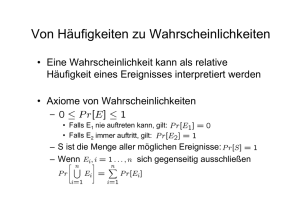

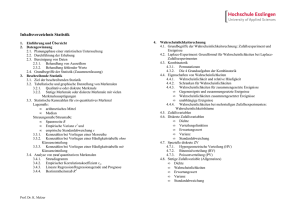

Statistik Prof. Dr. K. Melzer [email protected] http://www.hs-esslingen.de/de/mitarbeiter/karin-melzer.html Inhaltsverzeichnis 1 Einleitung und Übersicht 3 2 Datengewinnung (kurzer Überblick) 2.1 Planungsphase einer statistischen Untersuchung . . . . . . . . . . . . . . 2.1.1 Festlegung des Untersuchungsziels . . . . . . . . . . . . . . . . . 2.1.2 Festlegung der Grundgesamtheit und der statistischen Einheiten 2.1.3 Festlegung der zu erhebenden Merkmale . . . . . . . . . . . . . . 2.1.4 Festlegung von Art und Methode der Erhebung . . . . . . . . . . 2.2 Durchführung der Erhebung . . . . . . . . . . . . . . . . . . . . . . . . . 2.3 Datenbereinigung . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 2.3.1 Behandlung von Ausreißern . . . . . . . . . . . . . . . . . . . . . 2.3.2 Behandlung fehlender Werte . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 3 3 3 3 3 4 4 4 4 5 3 Beschreibende Statistik 3.1 Tabellarische und grafische Darstellung eines Merkmals . . . . . . . . . . . . . 3.1.1 Darstellung eines qualitativen Merkmals . . . . . . . . . . . . . . . . . . 3.1.2 Darstellung eines quantitativen Merkmals . . . . . . . . . . . . . . . . . 3.2 Statistische Kennzahlen für ein quantitatives Merkmal . . . . . . . . . . . . . . 3.2.1 Berechnung von Kennzahlen bei Vorliegen einer Messreihe . . . . . . . . 3.2.2 Berechnung von Kennzahlen bei Vorliegen einer Häufigkeitstabelle . . . 3.2.3 Kennzahlen bei Vorliegen einer Häufigkeitstabelle mit Klasseneinteilung 3.3 Zusammenhang zwischen zwei quantitativen Merkmalen . . . . . . . . . . . . . 3.3.1 Grafische Darstellung . . . . . . . . . . . . . . . . . . . . . . . . . . . . 3.3.2 Empirischer Korrelationskoeffizient . . . . . . . . . . . . . . . . . . . . . 3.3.3 Lineare Regression/Ausgleichsgerade . . . . . . . . . . . . . . . . . . . . 3.3.4 Bestimmtheitsmaß . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 3.3.5 Alternative Formeln zur Berechnung von m und r . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 5 5 6 6 6 6 7 8 8 8 8 9 9 10 4 Wahrscheinlichkeitsrechnung und Kombinatorik 4.1 Grundbegriffe der Wahrscheinlichkeitsrechnung . . . . . . . . . . . . . . . . . . 4.2 Berechnung von Wahrscheinlichkeiten . . . . . . . . . . . . . . . . . . . . . . . 4.2.1 Grundformel für Wahrscheinlichkeiten bei Laplace-Zufallsexperimenten 4.2.2 Kombinatorik . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . Permutationen . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . Die vier Grundaufgaben der Kombinatorik . . . . . . . . . . . . . . . . Gegenereignis und zusammengesetzte Ereignisse . . . . . . . . . . . . . Wahrscheinlichkeiten zusammengesetzter Ereignisse . . . . . . . . . . . Mehrstufige Zufallsexperimente . . . . . . . . . . . . . . . . . . . . . . 4.3 Zufallsvariable . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . Überblick – Typen von Zufallsvariablen . . . . . . . . . . . . . . . . . . Berechnung von Wahrscheinlichkeiten mit der Verteilungsfunktion . . . Kennzahlen von Verteilungen . . . . . . . . . . . . . . . . . . . . . . . . 4.3.1 Diskrete Zufallsvariable . . . . . . . . . . . . . . . . . . . . . . . . . . . Hypergeometrische Verteilung . . . . . . . . . . . . . . . . . . . . . . . Binomialverteilung . . . . . . . . . . . . . . . . . . . . . . . . . . . . . Poissonverteilung . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 4.3.2 Stetige Zufallsvariable . . . . . . . . . . . . . . . . . . . . . . . . . . . . Berechnung von Wahrscheinlichkeiten bei stetigen ZV . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 10 10 11 11 11 11 11 12 12 13 13 14 14 14 15 15 16 16 17 17 1 . . . . . . . . . . . . . . . . . . . . . . . . . . . INHALTSVERZEICHNIS . . . . . . . . . . . . . . . . . . . . . . . . . . . 18 18 18 19 19 19 20 20 20 5 Schließende Statistik 5.1 Punktschätzer . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 5.2 Hypothesentests . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 5.2.1 Generelles Vorgehen beim Testen von Hypothesen . . . . . . . . . . . . . 5.2.2 Tabellen für statistische Tests . . . . . . . . . . . . . . . . . . . . . . . . . Gauß-Test: Test für µ bei bekannter Standardabweichung σ . . . . . . . . t-Test: Test für µ bei unbekannter Standardabweichung σ . . . . . . . . . Zweistichproben-t-Test . . . . . . . . . . . . . . . . . . . . . . . . . . . . Test für eine unbekannte Wahrscheinlichkeit/einen unbekannten Anteil p 5.3 Vertrauensbereiche . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 5.3.1 Unterschied zwischen Zufallsstreubereich und Vertrauensbereich . . . . . 5.3.2 Tabellen für Vertrauensbereiche zur Vertrauenswahrscheinlichkeit 1 − α . Vertrauensbereich für µ bei bekannter Standardabweichung σ . . . . . . Vertrauensbereich für µ bei unbekannter Standardabweichung σ . . . . . Vertrauensbereich für die Differenz zweier Erwartungswerte µ1 − µ2 . . Vertrauensbereich für eine unbekannte Wahrscheinlichkeit p . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 21 21 22 22 23 23 23 24 24 25 25 25 25 25 26 26 4.3.3 6 Tabellen Normalverteilung . . . . . . . . . . . . . . . . . . . . . . . . . Berechnung von Wahrscheinlichkeiten für Normalverteilungen Quantile der Normalverteilung . . . . . . . . . . . . . . . . . . Zufallsstreubereiche (ZSB) . . . . . . . . . . . . . . . . . . . . Summen von Zufallsvariablen . . . . . . . . . . . . . . . . . . . Summen von normalverteilten Zufallsvariablen . . . . . . . . . Zentraler Grenzwertsatz . . . . . . . . . . . . . . . . . . . . . Stetigkeitskorrektur . . . . . . . . . . . . . . . . . . . . . . . . Näherungen für Verteilungen von Zufallsvariablen . . . . . . . 2 . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 26 1 EINLEITUNG UND ÜBERSICHT 1 3 Einleitung und Übersicht Wichtiger Hinweis: Diese Dateien werden für Studierende ausschließlich zur Nutzung im Rahmen ihres Studiums an der Hochschule Esslingen bereitgestellt. Jede weitergehende Nutzung, insbesondere Vervielfältigung jeder Art oder Weitergabe an Dritte, ist untersagt. Eine Definition von Statistik: Die Statistik befasst sich mit der Gewinnung und Auswertung von Daten. Ziel ist die Vorbereitung von Entscheidungen. Phasen einer statistischen Untersuchung und Kapitel der Vorlesung Planung ↓ Erhebung Datengewinnung (Kurzer Überblick in Kapitel 2) ↓ Bereinigung ↓ Darstellung (Kapitel 3: Beschreibende Statistik) ↓ Auswertung Analyse, Interpretation (Kapitel 5: Schließende Statistik) ↓ Entscheidung Hilfsmittel für Kapitel 5: Kapitel 4 (Wahrscheinlichkeitsrechnung) 2 Datengewinnung (kurzer Überblick) 2.1 Planungsphase einer statistischen Untersuchung Überblick: 2.1.1 Festlegung 2.1.2 Festlegung 2.1.3 Festlegung 2.1.4 Festlegung 2.1.1 des Untersuchungsziels der Grundgesamtheit und der statistischen Einheiten der zu erhebenden Merkmale von Art und Methode der Erhebung Festlegung des Untersuchungsziels Fragen formulieren! 2.1.2 Festlegung der Grundgesamtheit und der statistischen Einheiten Die zu untersuchende Grundgesamtheit muss präzise abgegrenzt werden in räumlicher, zeitlicher und sachlicher Hinsicht, d. h. es muss definiert werden, welche statistischen Einheiten (man sagt auch: „Merkmalsträger“ oder „Objekte“) dazugehören und welche nicht. 2.1.3 Festlegung der zu erhebenden Merkmale Arten von Merkmalen und ihre möglichen Ausprägungen: 1. Quantitative Merkmale: • Die Ausprägungen sind Zahlen aus Messungen oder Zählungen. • Differenzen zwischen zwei Ausprägungen haben eine Bedeutung (z. B. ein Werkstück ist um 0, 3 mm länger als ein anderes). (a) Quantitativ-stetige Merkmale: • Mögliche Ausprägungen sind alle Werte in einem Intervall. • Stetige Merkmale treten vorzugsweise bei Messungen auf. 2 DATENGEWINNUNG (KURZER ÜBERBLICK) 4 • Beispiele: Länge, Gewicht, Temperatur, Geldbeträge in Euro (!) (b) Quantitativ-diskrete Merkmale: • • • • Mögliche Werte sind nur einzelne Punkte auf dem Zahlenstrahl. Diskrete Merkmale treten vorzugsweise bei Zählungen auf. Als Ausprägungen sind dann nur 0, 1, 2, . . . möglich. Beispiel: Anzahl der Defektstücke in einer Lieferung. 2. Qualitative Merkmale: • Beschreiben Eigenschaften, die sich nicht durch Messen oder Zählen ermitteln lassen. • Können gelegentlich mit Hilfe von Zahlen codiert sein; dann haben aber die Differenzen der Codes keine Bedeutung. Z. B. bei Verschlüsselung 3 = „gelb“, 6 = „grün“ ergibt es keinen Sinn zu sagen, Farbe „grün“ sei doppelt so groß wie Farbe „gelb“. (a) Ordinale Merkmale: • Die Ausprägungen stehen in einer natürlichen Rangfolge. • Beispiel: Merkmal „Interesse an Statistik-Vorlesung“ mit Ausprägungen „sehr groß“ / „groß“ / „mittel“ / „gering“ / „sehr gering“. (b) Nominale Merkmale: • Die Ausprägungen lassen sich nicht in eine Rangfolge bringen. • Beispiel: Merkmal „Farbe“. 2.1.4 Festlegung von Art und Methode der Erhebung Arten von Erhebungen: • Totalerhebung (auch: „Vollerhebung“) • Teilerhebung (Stichprobe) Einige wichtige Methoden zur Durchführung von Stichprobenuntersuchungen sind: • Reine Zufallsstichprobe • Systematische Auswahl (z. B. jeder hundertste produzierte Gegenstand) • Schichtenstichprobe (Einteilung der Grundgesamtheit in Schichten, die bezüglich des Untersuchungsmerkmals möglichst homogen sind. Anschließend wird aus jeder Schicht eine bestimmte Anzahl von Stichprobenstücken gezogen. Der Anteil der in die Stichprobe aufgenommenen Objekte kann von Schicht zu Schicht unterschiedlich sein.) • Klumpenstichprobe (Wenn sich die Grundgesamtheit in „Klumpen“ zerlegen lässt, die möglichst ähnlich wie Grundgesamtheit zusammengesetzt sind. Oft sind Klumpen geographisch definiert, z. B. Kreise, Stadtbezirke, Planquadrate, . . . ) • Quotenverfahren (Durch Vorgabe von Quoten wird sichergestellt, dass die Stichprobe bei bestimmten Merkmalen wie z. B. Frau/Mann, Alter, Berufsgruppe, . . . die gleichen Anteile enthält wie die Grundgesamtheit → repräsentative Stichprobe) 2.2 Durchführung der Erhebung Eine Erhebung wird technisch durchgeführt z. B. durch Befragung (Fragebogen, Internet, . . . ), Beobachtung oder Experiment. Die Nutzung von bereits vorhandenem (evtl. früher für andere Zwecke erhobenem) Datenmaterial bezeichnet man als „Sekundärerhebung“. 2.3 2.3.1 Datenbereinigung Behandlung von Ausreißern Als „Ausreißer“ bezeichnet man Daten, die offenbar viel zu groß oder viel zu klein sind. Vorgehen: 1. Ausreißer identifizieren; 2. überprüfen, ggf. berichtigen; 3 BESCHREIBENDE STATISTIK 5 3. wenn die Ausreißer nicht berichtigt werden können, (a) Datensatz streichen oder (b) fehlerhafte Daten abändern (z. B. Ersetzen durch den Mittelwert der nicht fraglichen Daten) oder (c) Datensatz unverändert beibehalten. Die Möglichkeiten 3b) und 3c) sollten nur mit größter Zurückhaltung angewendet werden. Im Zweifelsfall wende man Möglichkeit 3a) an. Ähnlich wie bei Ausreißern geht man bei Werten vor, die zwar keine Ausreißer sind, die aber aus sonstigen Gründen unmöglich oder unplausibel sind. 2.3.2 Behandlung fehlender Werte Das Vorgehen bei fehlenden Werten entspricht sinngemäß dem bei Ausreißern: 1. Fehlende Werte identifizieren; 2. überprüfen, ggf. ergänzen; 3. wenn die fehlenden Werte nicht ergänzt werden können, (a) Datensatz streichen oder (b) einen Ersatzwert für die fehlende Daten berechnen (z. B. Mittelwert der nicht fehlenden Daten). Es ist wichtig, dass alle Phasen der Datengewinnung mit größter Sorgfalt durchgeführt werden. Im schlimmsten Fall können sonst die gewonnenen Daten nutzlos sein. 3 Beschreibende Statistik Ziel der beschreibenden Statistik Sachverhalte aufzeigen, die sonst nicht oder nicht so leicht ersichtlich wären. 3.1 Tabellarische und grafische Darstellung eines Merkmals Vorbemerkung zur Objektivität bei Grafiken: Auch ein Diagramm muss die darzustellenden Größen objektiv wiedergeben. Hierzu gehören u. a. auch folgende Regeln, die hier aufgeführt werden, weil gegen sie besonders oft verstoßen wird: 1. Proportionalität von Fläche und darzustellendem Wert. Bei den meisten Diagrammtypen (z. B. den unten genannten: Kreisdiagramm, Säulendiagramm, Histogramm) müssen die Flächen im Diagramm proportional zu den darzustellenden Werten sein. Z. B. wäre es nicht korrekt, zwei Werte, von denen der zweite doppelt so groß ist wie der erste, grafisch durch zwei Quadrate wiederzugeben, von denen das zweite eine doppelt so große Seitenlänge wie das erste hat (denn die Fläche wäre dann viermal so groß wie die erste statt richtig doppelt so groß). 2. Skalierung der Achsen. Bei einem Säulendiagramm wird auf der y-Achse ein quantitatives Merkmal aufgetragen. Nach der Regel 1) oben müssen (bei konstanter Säulenbreite) die Höhen der Säulen proportional zu den darzustellenden Werten sein. Insbesondere darf daher die yAchse nicht verzerrt sein und muss bei 0 beginnen. Sollte es ausnahmsweise erforderlich sein, die Achse nicht bei 0 beginnen zu lassen, muss dies deutlich kenntlich gemacht werden. Sinngemäß das gleiche gilt natürlich auch für die x-Achse (sofern hier ein quantitatives Merkmal aufgetragen wird) und für andere Diagrammtypen. 3 BESCHREIBENDE STATISTIK 3.1.1 6 Darstellung eines qualitativen Merkmals Es wird die Häufigkeit des Auftretens der verschiedenen Ausprägungen dargestellt. Hier gibt es u. a. folgende Möglichkeiten: • Häufigkeitstabelle. Wichtig: korrekte Beschriftung der Kopfzeile und der ersten Spalte; ggf. ist eine Summenzeile sinnvoll. • Säulendiagramm (auch: „Stabdiagramm“). • Kreisdiagramm (auch: „Tortendiagramm“). Achtung: Stellt man mehrere Datenreihen in je einem Kreisdiagramm dar, sollte die Fläche eines Kreises proportional zur Anzahl der dargestellten Datenwerte sein (d. h., der Radius eines Kreises proportional zur Wurzel aus der Anzahl der Datenwerte). Vgl. dazu oben Regel 1). 3.1.2 Darstellung eines quantitativen Merkmals • Bei einem diskreten Merkmal stehen grundsätzlich die gleichen Darstellungsmöglichkeiten wie bei einem qualitativen Merkmale zur Verfügung. • Bei einem stetigen Merkmal (oder bei einem diskreten Merkmal mit vielen Ausprägungen) müssen die Messwerte zunächst zu Klassen zusammengefasst werden. • Anschließend können die in Klassen eingeteilten Messwerte in einem Histogramm dargestellt werden. Histogramm = Säulendiagramm, bei dem die Säulen über den entsprechenden Klassenintervallen gezeichnet werden und daher an den Klassengrenzen aneinanderstoßen. • Folgende Regeln sind bei Histogrammen sinnvoll: – Klassen so wählen, dass keine Messwerte auf den Klassengrenzen liegen. – Gleiche Klassenbreite wählen, damit die Höhen der Säulen proportional zu den Häufigkeiten der Klassen sind. √ – Anzahl der Klassen k ≈ n , wobei n = Anzahl der Messwerte. Neben den in 3.1.1 und 3.1.2 genannten Diagrammtypen gibt es viele weitere Darstellungsmöglichkeiten, die je nach Ziel der statistischen Untersuchung ebenfalls sinnvoll oder sogar besser geeignet sein können. 3.2 Statistische Kennzahlen für ein quantitatives Merkmal Lagemaße: Geben an, wo die Messwerte im Mittel liegen, z. B. arithmetischer Mittelwert oder empirischer Median (Wo liegen die Daten? → Punkte) Streuungsmaße: Geben an, wie breit die Messwerte um den Mittelwert herum streuen, z. B. empirische Varianz, empirische Standardabweichung, Spannweite (Wie breit streuen die Daten? → Abstände) Ist die empirische Standardabweichung (bzw. empirische Varianz) klein, liegen also viele Messwerte in der Nähe des Mittelwertes. Ist sie groß, sind die Messwerte weiter vom Mittelwert entfernt. 3.2.1 Berechnung von Kennzahlen bei Vorliegen einer Messreihe Es ist eine Messreihe x1 , . . . , xn gegeben, n = Anzahl der Messwerte. 3 BESCHREIBENDE STATISTIK 7 n Arithmetischer Mittelwert Empirische Varianz Empirische Standardabweichung 1X 1 (x1 + x2 + · · · + xn ) = xi n n i=1 n 1 X 2 s2 = (xi − x) oder n − 1 i=1 " n ! # X 1 2 2 2 s = xi − n · x n−1 v i=1 u n √ u 1 X 2 s = s2 = t (xi − x) oder n − 1 i=1 v " n ! # u X u 1 √ 2 2 2 t s= s = xi − n · x n−1 i=1 x= Die zweite Formel für s2 ist einfacher anzuwenden; hier muss man aber x mit großer Genauigkeit berechnen! Die empirische Varianz gibt also die mittlere quadratische Abweichung von x an. Die empirische Standardabweichung hat dieselbe Dimension wie die gegebenen Messwerte. Sind beispielsweise die Messwerte in der Einheit „Gramm“ angegeben, so gilt die empirische Standardabweichung auch die Einheit „Gramm“. Nur in Ausnahmefällen wird man die Berechnung von x, s2 oder s tatsächlich mit den oben genannten Formeln durchführen. Viel kürzer ist es, die Datenreihe x1 , x2 , . . . , xn nur ein einziges Mal in den Taschenrechner (TR) einzugeben und anschließend sowohl x als auch s über die eingebauten TR-Funktionen abzurufen. Dabei ist die empirische Standardabweichung s auf dem TR oft mit dem Symbol σn−1 oder gelegentlich mit σx,n−1 o. ä. bezeichnet. (Die empirische Varianz erhält man dann, indem man den mit σn−1 abgerufenen Wert quadriert.) Beachten Sie hierzu ggf. auch die auf der Internetseite von Prof. Plappert bereitgestellten Taschenrechner-Bedienungsanleitungen. Für diese Bedienungsanleitungen wird keine Gewähr übernommen! Daher bitte anhand von Beispielen überprüfen. Empirischer Median x̃ = Messwert, der bei Sortierung der Messreihe nach der Größe in der Mitte steht (bei gerader Anzahl von Messwerten: arithmetisches Mittel der beiden Messwerte in der Mitte). Spannweite R = größter Messwert − kleinster Messwert = xmax − xmin 3.2.2 Berechnung von Kennzahlen bei Vorliegen einer Häufigkeitstabelle Es liegen Messwerte x1 , x2 , . . . , xk mit zugehörigen Häufigkeiten vor. Der Messwert x1 wurde f1 -mal Pk beobachtet, der Messwert x2 wurde f2 -mal beobachtet usw. Es sei n = i=1 fi die Summe aller Häufigkeiten = Gesamtzahl aller Messungen. In den Formeln für x bzw. s müssen hier alle Summanden mit der jeweiligen Häufigkeit gewichtet (= multipliziert) werden. k 1X Arithmetischer Mittelwert x= fi · xi n i=1 k 1 X 2 fi · (xi − x) oder Empirische Varianz s2 = n − 1 i=1 " k ! # X 1 2 2 s2 = fi · xi − n · x n−1 i=1 √ Empirische Standardabweichung s = s2 Die zweite Formel für s2 ist einfacher anzuwenden; hier muss man aber x mit großer Genauigkeit berechnen! Auch die Kennzahlen zu 3.2.2 kann man am kürzesten mit Hilfe der eingebauten TRFunktionen erledigen. Leider ist die Art der Dateneingabe der Häufigkeiten f1 , f2 , . . . bei verschiedenen TR-Typen unterschiedlich. 3 BESCHREIBENDE STATISTIK 3.2.3 8 Kennzahlen bei Vorliegen einer Häufigkeitstabelle mit Klasseneinteilung Es ist eine Häufigkeitstabelle (z. B. entstanden durch Klasseneinteilung eines stetigen Merkmals) gegeben. Es seien P k = Anzahl der Klassen, fi = Häufigkeit der i-ten Klasse, mi = Mittelpunkt der k i-ten Klasse, n = i=1 fi die Summe aller Häufigkeiten. Hier rechnet man so, als ob alle Messwerte in der Mitte der jeweiligen Klasse liegen, und verwendet dann die 3.2.2 entsprechenden Formeln, wobei nur xi durch mi ersetzt werden muss. k 1X x≈ fi · mi Arithmetischer Mittelwert n i=1 k 1 X 2 Empirische Varianz s2 ≈ fi · (mi − x) oder n − 1 i=1 " k ! # X 1 2 2 2 s ≈ fi · mi − n · x n−1 i=1 √ Empirische Standardabweichung s ≈ s2 Die zweite Formel für s2 ist einfacher anzuwenden; hier muss man aber x mit großer Genauigkeit berechnen! 3.3 Zusammenhang zwischen zwei quantitativen Merkmalen Werden an jedem Untersuchungsobjekt gleichzeitig zwei Merkmale gemessen, so erhält man eine Messreihe aus n Wertepaaren (x1 ; y1 ), (x2 ; y2 ), . . . , (xn ; yn ). Zwei Fragen sind von Interesse : • Kann man den Grad der Abhängigkeit zwischen den Zufallsgrößen durch eine geeignete Kennzahl „quantifizieren“ ; Korrelationsrechnung • Kann man einen (näherungsweisen) funktionalen Zusammenhang zwischen X und Y mathematisch formulieren ; Regressionsrechnung (Empirische) Regression bedeutet: eine Gerade oder eine Kurve „möglichst gut“ durch eine gegebene „Punktewolke“ legen. Im Falle einer Geraden spricht man von „linearer Regression“, sonst von „nichtlinearer Regression“ (z. B. von „quadratischer Regression“, wenn die Regressionskurve eine quadratische Parabel ist). 3.3.1 Grafische Darstellung Streudiagramm (Scatterplot) → „Punktewolke“ 3.3.2 Empirischer Korrelationskoeffizient Beschreibt die Stärke und Richtung des linearen Zusammenhangs. Empirischer Korrelationskoeffizient ! n X xi yi − n · x · y i=1 v r= v ! ! u n u n u X u X 2 t 2 2 t xi − n · x · yi − n · y 2 i=1 i=1 • Werte von r: −1 ≤ rxy ≤ 1 • Linearer Zusammenhang spiegelt sich in der Aussage „Je größer x, desto [größer/kleiner] ist tendenziell y“. • Falls |r| ≈ 1 , gibt es einen starken linearen Zusammenhang. (Aber nicht unbedingt einen ursächlichen Zusammenhang zwischen den x- und y-Werten!) • Falls r ≈ 0, gibt es keinen linearen Zusammenhang. (Aber in manchen Fällen einen Zusammenhang anderer Art, z. B. quadratisch!) • Falls r > 0, steigt die „beste Gerade“, falls r < 0 fällt sie. 3 BESCHREIBENDE STATISTIK 9 • rxy = 1: alle Punkte (xi ; yi ) liegen auf einer Geraden mit positiver Steigung • rxy = −1: alle Punkte (xi ; yi ) liegen auf einer Geraden mit negativer Steigung rxy > 0: positive (gleichsinnige) Korrelation; großen Werten entsprechen überwiegend große Werte rxy < 0: negative (gegensinnige) Korrelation; großen Werten entsprechen überwiegend kleine Werte rxy ≈ 0: unkorreliert 3.3.3 Lineare Regression/Ausgleichsgerade • Gegeben: Stichprobe mit n Datenpunkten (x1 ; y1 ), (x2 ; y2 ), . . . , (xn ; yn ). Dabei wird angenommen, dass nur die y-Werte größeren (z. B. zufälligen) Schwankungen unterliegen können und die x-Werte fest (oder sehr genau bestimmbar) sind. • Gesucht: „Beste Gerade“ durch die zugehörige (xi | yi )-Punktwolke • Methode der kleinsten Quadrate (MKQ): n X e2i soll minimal werden. i=1 Dabei ist ei = yi − ŷi der Abstand in y-Richtung zwischen dem y-Wert des i-ten Datenpunktes yi und dem zu xi gehörenden y-Wert auf der Regressionsgeraden ŷi . [Das Dach-Symbol bei ŷi steht für „geschätzer Wert“. ei heißt „Error“ oder „Residuum“.] • Die MKQ führt zu folgender Gleichung der empirischen Regressionsgeraden: ! n X xi yi − n · x · y i=1 ! y = mx + k mit m= und k =y−m·x n X 2 2 xi − n · x i=1 3.3.4 Bestimmtheitsmaß Für alle Regressionstypen (auch quadratische usw.) wird als Gütemaß das Bestimmtheitsmaß R2 verwendet, d.h. wie gut die Gerade/Kurve die Punktwolke beschreibt (nicht verwechseln mit der Spannweite R einer Messreihe!) Für das Bestimmtheitsmaß R2 gilt a) 0 ≤ R2 ≤ 1 b) Falls R2 ≈ 1 verläuft die Regressionsgerade (oder -kurve) gut durch die „Punktewolke“. Falls R2 ≈ 0 gibt die Regressionsgerade (oder -kurve) die „Punktewolke“ nicht gut wieder. c) R2 beschreibt den Anteil an der Varianz der y-Werte, der durch die Regression erklärt werden kann. Während a), b), c) auch für nichtlineare Regressionen gelten, ist die Gleichung R2 = r2 nur im Falle der linearen Regression richtig. (Der empirische Korrelationskoeffizient r bezieht sich nämlich ausschließlich auf die lineare Regression.) Bemerkung zur Berechnung von m und r bei linearer Regression Viele TR haben eine eingebaute Berechnungsmöglichkeit für die Parameter m und k der empirischen Regressionsgeraden und für den empirischen Korrelationskoeffizienten r nach Eingabe aller x- und y-Werte. Wer einen Taschenrechner besitzt, bei dem das so nicht möglich ist, benutzt am besten das gezeigte Berechnungsschema. Die angegebenen Formeln sind für die Berechnung „von Hand“ – also wenn im TR Regression und Korrelation nicht implementiert sind – am einfachsten anzuwenden. Bei der Berechnung von m und r müssen x und y aber mit großer Genauigkeit bestimmt werden! 4 WAHRSCHEINLICHKEITSRECHNUNG UND KOMBINATORIK 3.3.5 10 Alternative Formeln zur Berechnung von m und r Leichter zu merkende alternative Formeln für m und r verwenden folgende Größen: " n ! # X 1 2 2 2 empirische Varianz der x-Werte sx = xi − n · x n−1 i=1 " n ! # X 1 2 2 2 yi − n · y empirische Varianz der y-Werte sy = n−1 i=1 " n # ! X 1 empirische Kovarianz sxy = xi · yi − n · x · y n−1 i=1 empirische Standardabweichungen Damit ist 4 m= sxy s2x und r= sx = p s2x , sy = q s2y sxy sx · sy Wahrscheinlichkeitsrechnung und Kombinatorik 4.1 Grundbegriffe der Wahrscheinlichkeitsrechnung Zufallsexperiment: ein (prinzipiell) beliebig oft wiederholbares Experiment, dessen Ergebnis aufgrund von Zufallseinflüssen nicht vorhersehbar ist. Realisierung eines Zufallsexperiments: das Ergebnis der tatsächlichen Durchführung eines Zufallsexperiments. Ergebnisraum Ω: umfasst alle möglichen Ergebnisse eines Zufallsexperiments. Ereignis: Teilmenge von Ω, enthält ein Ergebnis oder mehrere Ergebnisse, oder auch alle Ergebnisse oder gar kein Ergebnis. Wahrscheinlichkeit P (A) eines Ereignisses A: beschreibt, wie groß die Chance des Eintretens von A ist. Relative Häufigkeit eines Ereignisses A: Wird ein Zufallsexperiment n-mal realisiert, und tritt dabei das Ereignis A genau k-mal ein, so heißt hn (A) = k/n die relative Häufigkeit von A. Zusammenhang und Unterschied zwischen relativer Häufigkeit und Wahrscheinlichkeit: • Die Wahrscheinlichkeit P (A) ist eine (mathematische) Konstante. Die relative Häufigkeit hn (A) hingegen hängt von Zufall (von der konkreten Realisierung) ab. • Im Allgemeinen ist daher P (A) 6= hn (A). Falls n groß ist, gilt aber das Gesetz der großen Zahlen P (A) ≈ hn (A). • Wenn man P (A) nicht ausrechnen kann, aber eine Realisierung des Zufallsexperiments vom Umfang n vorliegen hat, kann man P (A) unter Benutzung von hn (A) schätzen; siehe Kapitel 5. Nach dem Gesetz der großen Zahlen wird diese Schätzung um so besser sein, je größer n ist. • Eine Definition von Wahrscheinlichkeit: Wahrscheinlichkeiten sind Voraussagen für relative Häufigkeiten des Eintretens von Ereignissen auf lange Sicht (für den Grenzfall einer gegen Unendlich strebenden Anzahl von Versuchsdurchführungen). Schranken für Wahrscheinlichkeiten: • Es gilt 0 ≤ P (A) ≤ 1. • P (A) = 0 gilt für ein unmögliches Ereignis. Beispiel Würfelwurf: A = „Augenzahl größer als 7“; hier ist P (A) = 0. • P (A) = 1 gilt für ein mit Sicherheit eintretendes Ereignis. Beispiel Würfelwurf: A = „Augenzahl kleiner als 7“; hier ist P (A) = 1. 4 WAHRSCHEINLICHKEITSRECHNUNG UND KOMBINATORIK 4.2 4.2.1 11 Berechnung von Wahrscheinlichkeiten Grundformel für Wahrscheinlichkeiten bei Laplace-Zufallsexperimenten P (A) = |A| Anzahl der Ergebnisse inA = |Ω| Anzahl aller möglichen Ergebnisse Achtung: Diese Formel gilt nur für die Berechnung von Wahrscheinlichkeiten bei Laplace- Zufallsexperimenten, d. h. falls die beiden folgenden Bedingungen erfüllt sind: 1. Bei dem Zufallsexperiment sind nur endlich viele Ergebnisse möglich. 2. Alle Ergebnisse in Ω sind gleich wahrscheinlich. Falls eine dieser beiden Bedingungen nicht erfüllt ist, also wenn Ω unendlich viele Elemente enthält oder wenn es in Ω Ergebnisse mit unterschiedlichen Wahrscheinlichkeiten gibt, muss man die Methoden aus Kapitel 5 anwenden, um P (A) zu schätzen. 4.2.2 Kombinatorik Für die Berechnung von P (A) unter der Laplace-Annahme muss man in der Lage sein, |A| auszurechnen, also die in einem Ereignis enthaltenen Ergebnisse abzuzählen. Die „Lehre vom Abzählen“ heißt „Kombinatorik“. Definitionen Fakultät: n! = 1 · 2 · · · · · n (lies: „n Fakultät“) 0! = 1 (Definition) Berechnung mit dem Taschenrechner bis mindestens 69! möglich. n n! (lies: „n über k“) Binomialkoeffizient: n über k: := k!(n − k)! k Berechnung des Binomialkoeffizienten: • Auf vielen Taschenrechnern gibt es eine eigene Taste hierfür. n n! := • Mit Hilfe der Definition k k!(n − k)! • Wenn k klein ist: als Bruch. Bei dem Bruch stehen im Zähler k Faktoren, die bei n beginnen und immer um 1 kleiner werden. Im Nenner stehen ebenfalls k Faktoren, die bei 1 beginnen und immer um 1 größer werden. 17 17! 17 · 16 · 15 Beispiel: = = = 680; 3 3!(14)! 1·2·3 hier stehen jeweils k = 3 Faktoren in Zähler (17 · 16 · 15) und im Nenner (1 · 2 · 3). Permutationen 1. Permutation ohne Wiederholung: Gegeben: n verschiedene Elemente. Wie viele Möglichkeiten gibt es, n Objekte anzuordnen? Anzahl an Möglichkeiten (alle) n Elemente in eine Reihenfolge zu bringen: n! 2. Permutation mit Wiederholung: Gegeben: n Elemente. Unter den n Elementen gibt es aber nur k verschiedene Elemente mit Anzahlen n1 , . . . , nk . D. h. von Objekt 1 gibt es n1 (gleiche) Exemplare, von Objekt 2 gibt es n2 (gleiche) Exemplare, . . . von Objekt k gibt es nk (gleiche) Exemplare. Auf wie viele Arten kann man die n = n1 + n2 + · · · + nk Objekte anordnen? n! Anzahl Möglichkeiten, diese n Elemente in eine Reihenfolge zu bringen: n1 ! · n2 ! · · · nk ! Die vier Grundaufgaben der Kombinatorik Grundoperationen: • Auswählen einer Teilmenge aus einer Grundmenge („Ziehen“) • Anordnen der Elemente einer Menge 4 WAHRSCHEINLICHKEITSRECHNUNG UND KOMBINATORIK 12 Grundaufgabe: Aus n verschiedenen Objekten werden k ausgewählt. Wie viele Möglichkeiten gibt es? Die Antwort auf diese Frage hängt davon ab, • ob die Reihenfolge des Auswählens eine Rolle spielt („geordnet“, „mit Beachtung der Reihenfolge“’) oder nicht („ungeordnet“, „ohne Beachtung der Reihenfolge“); • ob ein Objekt mehrfach ausgewählt werden darf („mit Wiederholung“, „Ziehen mit Zurücklegen“) oder nicht. Stichprobenauswahl/Ziehe k aus n geordnet/mit Beachtung der Reihenfolge ungeordnet/ohne Beachtung der Reihenfolge n+k−1 k mit Zurücklegen n ohne Zurücklegen n! (n − k)! n k ohne Mehrfachbesetzung mit unterscheidbaren Kugeln nicht unterscheidbare Kugeln Verteilen von k Kugeln auf n Zellen k mit Mehrfachbesetzung Gegenereignis und zusammengesetzte Ereignisse Man kann Ereignisse miteinander verknüpfen, um andere/komplexere Ereignisse zu erhalten. A und B seien Ereignisse. A = „nichtA“ = Ω\A = A tritt nicht ein = Gegenereignis von A A ∩ B = „A und B“ = A und B treten beide ein = sowohl A als auch B tritt ein = „und-Ereignis“ A ∪ B = „A oder B“ = A tritt eine oder B tritt ein oder beide treten ein = „oder-Ereignis“ Tipp: Benutzen Sie die drei obigen Verknüpfungen/Operationen, um Text in Formeln umzuwandeln. Beispiel: Ein Würfel wird zweimal geworfen, A sei das Ereignis „im ersten Wurf eine 6“, B sei das Ereignis „im zweiten Wurf eine 6“. A = „im ersten Wurf keine 6“, d. h. im ersten Wurf eine 1, 2, 3, 4 oder 5. A ∪ B = „im ersten und im zweiten Wurf eine 6“ = zwei Sechsen. A ∩ B = „im ersten oder im zweiten Wurf (oder in beiden) eine 6“ = mindestens eine 6. Wahrscheinlichkeiten zusammengesetzter Ereignisse • Wahrscheinlichkeit des Gegenereignisses A von A: P (A) = 1 − P (A) • P (A ∩ B) – Berechnung mit dem Multiplikationssatz: – Multiplikationssatz allgemein: P (A ∩ B) = P (A) · P (B|A)[= P (B) · P (A|B)] – Multiplikationssatz für unabhängige Ereignisse: P (A ∩ B) = P (A) · P (B) Dabei ist P(B|A) (lies: „Wahrscheinlichkeit von B unter der Bedingung A“) die (bedingte) Wahrscheinlichkeit, dass B eintritt, wenn sicher ist, dass A eintritt bzw. eingetreten ist. Wenn sich zwei Ereignisse (definitiv) nicht beeinflussen, spricht man von unabhängigen Ereignissen, dann gilt P (B|A) = P (B). Beispiel für bedingte Wahrscheinlichkeiten: Aus einem Skatspiel (32 Karten) wird zweimal ohne Zurücklegen gezogen. A sei das Ereignis „im ersten Zug wird eine Zehn gezogen“, B das 4 WAHRSCHEINLICHKEITSRECHNUNG UND KOMBINATORIK 13 3 Ereignis „im zweiten Zug eine Zehn“. Dann ist P (B|A) = 31 die Wahrscheinlichkeit, im zweiten 4 Zug eine Zehn zu ziehen, wenn man im ersten Zug eine Zehn gezogen hat. P (B|A) = 31 ist die Wahrscheinlichkeit, im zweiten Zug eine Zehn zu ziehen, wenn im ersten Zug keine Zehn gezogen wurde. Beispiel für abhängige/unabhängige Ereignisse: Zum Beispiel sind die Ereignisse A = „im ersten Zug eine Zehn“ und B = „im zweiten Zug eine Zehn“ unabhängig, wenn aus einem Skatspiel mit Zurücklegen (und neuem Mischen) gezogen wird. Wird ohne Zurücklegen gezogen, so sind die Ereignisse abhängig (s.o.). • P (A ∪ B) – Berechnung mit dem Additionssatz: P (A ∪ B) = P (A) + P (B) − P (A ∩ B) – Additionssatz allgemein: – Additionssatz für unvereinbare Ereignisse: P (A ∪ B) = P (A) + P (B) Falls A und B nicht beide eintreten können, so heißen A und B unvereinbar (A und B schließen sich gegenseitig aus), dann ist A ∩ B 6= ∅. Nur in diesem Spezialfall (A und B können nicht beide eintreten) gilt dann also der Additionssatz in der Form P (A ∪ B) = P (A) + P (B) . Mehrstufige Zufallsexperimente Wir betrachten Zufallsexperimente, die sich aus 2 Einzelversuchen aufbauen lassen, die nacheinander oder gleichzeitig durchgeführt werden. Zur Beschreibung solcher zusammengesetzter Zufallsexperimente eignen sich Baumdiagramme oder Wahrscheinlichkeitsbäume. Berechnung von Wahrscheinlichkeiten im Baumdiagramm: • Wahrscheinlichkeit eines Pfades = Produkt der Wahrscheinlichkeiten längs des Pfades (Multiplikationsregel oder Pfadregel). „Entlang der Pfade wird multipliziert“ • Wahrscheinlichkeit für ein Ereignis = Summe der Wahrscheinlichkeiten aller zu diesem Ereignis führenden Pfade (Additionsregel oder Summenregel). „Entlang der Äste wird addiert“ Knoten Pfade 4.3 ... ... (zufällige) Ereignisse (bedingte) Wahrscheinlichkeiten auftragen, Die Summe der Wahrscheinlichkeiten aller Verzweigungen ist gleich Eins. Zufallsvariable Eine Zufallsvariable X beschreibt, welche Ausprägungen eines quantitativen Merkmals in einem Zufallsexperiment mit welchen Wahrscheinlichkeiten auftreten. Man spricht von einer diskreten Zufallsvariablen, falls es sich um ein quantitativ-diskretes Merkmal handelt, und von einer stetigen Zufallsvariablen, falls es sich um ein quantitativ-stetiges Merkmal handelt. ZV = zufällige Zahl (für alle praktischen Fälle) 4 WAHRSCHEINLICHKEITSRECHNUNG UND KOMBINATORIK 14 Überblick – Typen von Zufallsvariablen ZV X stetig (kann alle Werte in Intervall annehmen) ; messen diskret (nur einzelne Werte) ; zählen Normalverteilung: X ∼ N (µ; σ 2 ) Exponentialverteilung: X ∼ Exp(λ) t-Verteilung: X ∼ tn Hypergeom. Verteilung: X ∼ H(n; N ; M ) Binomialverteilung: X ∼ B(n; p) Poissonverteilung: X ∼ P o(λ) „sonstige“ diskrete Verteilungen Dichte f (x) = F 0 (x) (nichtneg. Funktion mit Fläche 1) Wahrscheinlichkeitsverteilung/diskrete Dichte P (X = xi ) = f (xi ) (Liste aller Wahrscheinlichkeiten) Verteilungsfunktion R x F (x) = P (X ≤ x) = −∞ f (x) stetige Funktion Verteilungsfunktion P F (x) = P (X ≤ x) = xi ≤x P (X = xi ) Treppenfunktion Ziel: Berechnung von Wahrscheinlichkeiten (bei gegebenen Situationsbeschreibungen). „Mit welcher Wahrscheinlichkeit tritt das Ereignis . . . ein?“ 1. „Situationsbeschreibung“ / Experiment ; bestimmt den „Typ“ der Verteilung. 2. Berechnung von Wahrscheinlichkeiten ; mit der zugehörigen Verteilungsfunktion (diskret: mit Dichte). Die Verteilung einer ZV ist die zugrunde liegende (statistische) Gesetzmäßigkeit hinter einer ZV. (Welche Werte kommen – statistisch gesehen – mit welcher Wkt. vor?) Berechnung von Wahrscheinlichkeiten mit der Verteilungsfunktion Für beliebige Werte a,b ∈ IR gilt f (a) bei diskreten ZV falls a ein Wert ist, den X annimmt P (X = a) = 0 bei stetigen ZV P (X ≤ a) = P (a < X ≤ b) = F (b) − F (a) P (X > a) = F (a) 1 − F (a) (Verteilungsfunktion an der Stelle a) [= P (X ≤ b) − P (X ≤ a)] [= 1 − P (X ≤ a)] Bei diskreten ZV: Achtung – Ungleichheitszeichen beachten. Bei stetigen ZV: ≤ darf durch < und ≥ durch > (und andersherum) ersetzt werden (im Gegensatz zu diskreten ZV). Kennzahlen von Verteilungen x s2 s Stichprobe (Daten) Merkmal arithm. Mittelwert Empirische Varianz/ Stichprobenvarianz Empirische Standardabweichung/ Standardabweichung der Stichprobe Verteilung/ZV (Modell) Zufallsvariable X µ = E(X) Erwartungswert σ 2 = V ar(X) Varianz σ Standardabweichung Zusammenhang und Unterschied zw. Erwartungswert µ und arithm. Mittel x: • Der Erwartungswert µ ist für jede Zufallsvariable eine (mathematische) Konstante. Der arithmetische Mittelwert x dagegen hängt vom Zufall ab, nämlich von der jeweiligen Messreihe x1 , x2 , x3 , . . . , xn , d.h. den Realisierungen der Zufallsvariablen X. • Im Allgemeinen gilt daher: µ 6= x. Falls n groß ist, gilt aber das „Gesetz der großen Zahlen“, das besagt, dass x ≈ µ. 4 WAHRSCHEINLICHKEITSRECHNUNG UND KOMBINATORIK 15 • Wenn man µ nicht kennt, aber eine Realisierung vom Umfang n des (durch X beschriebenen) Zufallsexperiments vorliegen hat, kann man µ unter Benutzung von x schätzen (siehe Kapitel 5). Nach dem Gesetz der großen Zahlen wird diese Schätzung um so besser sein, je größer n ist. Zusammenhang und Unterschied zw. Varianz σ 2 und empirischer Varianz s2 : • Die Varianz σ 2 einer Zufallsvariablen X ist eine (mathematische) Konstante. Die empirische Varianz s2 hingegen hängt von Zufall ab, nämlich von der konkreten Messreihe x1 , x2 , x3 , . . . , xn , (= Realisierung der Zufallsvariablen X) • Im Allgemeinen gilt daher: σ 2 6= s2 . Falls n groß ist, gilt aber das „Gesetz der großen Zahlen“, das besagt, dass s2 ≈ σ 2 . • Wenn man σ 2 nicht kennt, aber eine Realisierung vom Umfang n des (durch X beschriebenen) Zufallsexperiments vorliegen hat, kann man σ 2 unter Benutzung von s2 schätzen (siehe Kapitel 5). Nach dem Gesetz der großen Zahlen wird diese Schätzung um so besser sein, je größer n ist. 4.3.1 Diskrete Zufallsvariable Eine diskrete Zufallsvariable kann nur einzelne Punkte auf dem Zahlenstrahl als Ausprägungen annehmen, z. B. k = 0, 1, .... Die Liste, welche Ausprägung k mit welcher Wahrscheinlichkeit angenommen wird, heißt „diskrete Dichte“. Mit anderen Worten: Diskrete Dichte = Liste aller Wahrscheinlichkeiten P (X = k) Darstellung der diskreten Dichte: Liste, Tabelle oder Formel, grafisch als Stab-/Säulendiagramm Verteilungsfunktion von X Funktion F (x) = P (X ≤ x) für alle x ∈ IR P µ = E(X) = k · P (X = k) P 2 σ 2 = V ar(X) = k · P (X = k) − µ2 √ p σ = σ 2 = V ar(X) Erwartungswert Varianz Standardabweichung Hypergeometrische Verteilung X ∼ H(n; N ; M ) Beschreibung: Ziehen ohne Zurücklegen: Gegeben sind N Objekte (z. B. eine Lieferung von Bauteilen oder Kugeln in einer Urne). M gebe die Anzahl der Objekte mit einer bestimmten Eigenschaft A an (z. B. defektes Bauteil bzw. rote Kugel). Unter den Objekten wird n-mal eines zufällig ausgewählt; das gezogene Objekt wird nicht zurückgelegt. Das Ergebnis der folgenden Ziehung ist also von den vorherigen Ziehungen abhängig. X gebe an, wie viele der gezogenen Objekte die Eigenschaft A haben (z. B. Anzahl der Defektstücke bzw. Anzahl der roten Kugeln). X ist dann hypergeometrisch verteilt. Kurz: • Endliche Grundgesamtheit (GG) aus N Elementen, • M Elemente der GG haben eine spezifische Eigenschaft A (alternativ: p % der Elemente haben eine spezifische Eigenschaft A) • entnommen wird eine Stichprobe ohne Zurücklegen vom Umfang n X = Anzahl der gezogenen Elemente mit Eigenschaft A in der Stichprobe Dann gilt X ∼ H(n; N ; M ) d. h. X ist hypergeometrisch verteilt mit Parametern n, N , M . Achtung: in machen Büchern wird die Reihenfolge der Parameter anders angegeben. 4 WAHRSCHEINLICHKEITSRECHNUNG UND KOMBINATORIK Diskrete Dichte Erwartungswert Varianz 16 M N −M k n−k , k = 0, 1, 2, . . . , min{n, M } P (X = k) = N n M M E(X) = µ = n · = n · p mit p = N N M M N − n N −n V ar(X) = σ 2 = n · 1− = n · p · (1 − p) N N N −1 N −1 Binomialverteilung X ∼ B(n; p) Beschreibung: • Ein Zufallsexperiment wird n-mal identisch durchgeführt (unabhängig voneinander). • Bei jeder der Durchführungen tritt ein Ereignis A („Erfolg“) mit der Wahrscheinlichkeit p ein. • Die Zufallsvariable X gebe an, wie oft bei den n Durchführungen das Ereignis A aufgetreten ist. X heißt dann binomialverteilt. Beispiele: • n Einheiten werden aus der laufenden Produktion (Ausschussanteil p) gezogen; X = Anzahl der Defektstücke. • Ziehen mit Zurücklegen: Gegeben ist bestimmte Anzahl von Objekten (z. B. eine Lieferung von Bauteilen oder Kugeln in einer Urne). p gebe den Anteil der Objekte mit einer bestimmten Eigenschaft A an (z. B. defektes Bauteil bzw. rote Kugel). Unter den Objekten wird n-mal eines zufällig ausgewählt; dann wird das ausgewählte wieder zurückgelegt und es wird neu gemischt. (Nur dann sind die n Ziehungen unabhängig voneinander!) X gebe an, wie viele der gezogenen Objekte die Eigenschaft A haben (z. B. Anzahl der Defektstücke bzw. Anzahl der roten Kugeln). X = Anzahl „Erfolge“ beim n-maligen Durchführen des Experiments Dann gilt X ∼ B(n; p) d. h. X ist binomialverteilt mit Parametern n, p. n k Diskrete Dichte P (X = k) = p · (1 − p)n−k , k = 0, 1, . . . , n k Erwartungswert E(X) = µ = n · p Varianz V ar(X) = σ 2 = n · p · (1 − p) Anwendung: Als Näherung für die Hypergeometrische Verteilung falls N groß ist und n nicht zu groß n ist, d.h. der Anteil der gezogenen Elemente klein ist (Faustregel: = 0, 1). Dann kann man die N hypergeometrische Verteilung H(n; N ; M ) annähern durch die Binomialverteilung B(n; p), wobei M p= zu setzen ist. N Poissonverteilung X ∼ P o(λ) „Verteilung seltener Ereignisse“. Beschreibung: • Gegeben ist eine Betrachtungseinheit (Intervall) wie z. B. Länge, Zeit oder Fläche. • Die mittlere Anzahl λ (lambda) von Vorkommnissen pro Betrachtungseinheit ist bekannt. X = Anzahl des (tatsächlichen) Auftretens des betrachteten Ereignisses pro Betrachtungseinheit Dann gilt X ∼ P o(λ) d. h. X ist poissonverteilt mit Parameter λ. 4 WAHRSCHEINLICHKEITSRECHNUNG UND KOMBINATORIK Erwartungswert λk −λ e , k! E(X) = µ = λ Varianz V ar(X) = σ 2 = λ P (X = k) = Diskrete Dichte 17 k = 0, 1, 2, 3, . . . Die Poissonverteilung wird insbesondere in folgenden Fällen angewendet: 1. Als Näherung für die Binomialverteilung, wenn n groß und p klein ist (Faustregel: n ≥ 30 und p ≤ 0, 1). In diesem Fall kann man die Binomialverteilung annähern durch eine Poissonverteilung P o(λ), wobei λ = n · p ist. 2. Bei Binomialverteilung und hypergeometrischer Verteilung wird gezählt, wie viele Einheiten eine bestimmte Eigenschaft haben (z. B. defekt). Will man statt dessen die Anzahl der Fehler an einer Einheit beschreiben, eignet sich nur die Poissonverteilung. Man muss dann aber λ, die „mittlere Anzahl der Fehler pro Einheit“ kennen. 3. Auch in anderen Fällen, bei denen als Parameter nur eine „mittlere Anzahl“ bekannt ist, eignet sich die Poissonverteilung. Beispiel: In einer Telefonzentrale gehen im Mittel 3 Gespräche innerhalb von 5 Minuten ein. Dann ist zur Beschreibung der zufälligen Anzahl der in 5 Minuten eingehenden Gespräche eine Poissonverteilung mit λ = 3 anwendbar. Stellt X ∼ P o(λ) eine zufällige „mittlere Anzahl pro Einheit“ dar, wie bei 2) und 3) oben erläutert, so lässt sich die „mittlere Anzahl auf n Einheiten zusammen“ beschreiben durch eine Zufallsvariable mit Verteilung P o(n · λ). Im Beispiel Telefonzentrale von oben lässt sich also die zufällige Anzahl von Anrufen in 10 Minuten durch eine Zufallsvariable beschreiben, die P o(6)-verteilt ist. 4.3.2 Stetige Zufallsvariable Stetige Verteilungen sind i. d. Regel Modelle für das Verhalten von stetigen Zufallsvariablen. Beobachtet man bei einer ZV ein bestimmtes Verhalten, so ordnet man ihr ein passendes Modell, d.h. die entsprechende Verteilung zu und schätzt die Parameter. Bei stetigen Zufallsvariablen tritt an die Stelle der diskreten Dichte eine Dichtefunktion. Wo bei diskreten Variablen eine Summe auftritt, hat man hier ein Integral. Z ∞ Dichte = Funktion f (x) ≥ 0 mit f (x) dx = 1 −∞ Wahrscheinlichkeiten werden (theoretisch) berechnet als Fläche unter der Dichte Z b P (a ≤ X ≤ b) = f (x) dx a Verteilungsfunktion von X oder (praktisch) mit Hilfe der Verteilungsfunktion F (x) von X. Z x Funktion F (x) = P (X ≤ x) = f (t) dt für alle x ∈ IR −∞ Erwartungswert Varianz Standardabweichung „Fläche unter der Dichte links von x“ Z ∞ µ = E(X) = x · f (x) dx −∞ Z ∞ σ 2 = V ar(X) = x2 · f (x) dx − µ2 −∞ √ p 2 σ = σ = V ar(X) Berechnung von Wahrscheinlichkeiten bei stetigen ZV Bei stetigen ZV gilt für beliebige Werte a, b ∈ IR P (X = a) = 0 P (X ≤ a) = F (a) P (a ≤ X ≤ b) = F (b) − F (a) [= P (X ≤ b) − P (X ≤ a)] P (X > a) = 1 − F (a) [= 1 − P (X ≤ a)] 4 WAHRSCHEINLICHKEITSRECHNUNG UND KOMBINATORIK 18 Dabei darf ≤ durch < und ≥ durch > ersetzt werden (im Gegensatz zu diskreten ZV). Normalverteilung X ∼ N (µ, σ 2 ) Modell für viele stetige Zufallsvariablen. Wenn eine Zufallsvariable normalverteilt ist, schreibt man hierfür auch X N (µ; σ 2 ), wobei µ und σ 2 Erwartungswert bzw. Varianz bezeichnen. Achtung: In der Statistik-Literatur wird als zweiter Parameter in der Klammer häufig statt dessen die Standardabweichung angegeben. Hier müssen µ und σ 2 entweder bekannt sein, oder es muss eine Stichprobe vorliegen, so dass man diese beiden Größen durch den arithmetischen Mittelwert bzw. die empirische Varianz der Stichprobe schätzen kann (Punktschätzer, siehe Abschnitt 5.1). Im zweiten Fall ist µ̂ = x, σ̂ 2 = s2 . f (x) = √ Dichte 1 1 − e 2 x−µ σ 2 Erwartungswert („Gauß’sche Glockenkurve“) 2πσ 2 E(X) = µ bestimmt die Lage der Dichtekurve Varianz V ar(X) = σ 2 bestimmt die Form der Dichtekurve Dichte der Normalverteilung: Gauß’sche Glockenkurve, • Symmetrieachse: x = µ, • Lage der Wendepunkte x = µ ± σ. Berechnung von Wahrscheinlichkeiten für Normalverteilungen Standardnormalverteilung: Z ∼ N (0; 1) Spezielle normalverteilte Zufallsvariable mit Erwartungswert 0 und Varianz bzw. Standardabweichung 1. Für die Standardnormalverteilung liegt die Verteilungsfunktion Φ(z) = P (Z ≤ z) als Tabelle vor (s. Anhang). (Weil die Verteilungsfunktion so wichtig ist, bekommt sie einen eigenen „Namen“.) Berechnung von Wahrscheinlichkeiten für X ∼ N (µ; σ 2 ) Eine beliebige Normalverteilung X ∼ N (µ; σ 2 ) muss zunächst standardisiert werden. Es gilt nämlich: X −µ ∼ N (0; 1) (Standardisierung) Z= σ Das führt zu folgenden Formeln: P (X = x) = 0 x−µ P (X ≤ x) = Φ σ b−µ a−µ P (a ≤ X ≤ b) = Φ −Φ [= P (X ≤ b) − P (X ≤ a)] σ σ a−µ P (X > a) = 1−Φ [= 1 − P (X ≤ a)] σ In Excel: Verteilungsfunktion bzw. Dichte von beliebigen Normalverteilungen über Funktion NORMVERT. Quantile der Normalverteilung Quantile der Standardnormalverteilung: Die Zahl z mit P (Z ≤ z) = 0, 95 heißt das 95%-Quantil der (Standard-)Normalverteilung. Der Zahlenwert dieses Quantils ist 1, 645; man schreibt hierfür z0,95 = 1, 645 Entsprechend sind das 99 %-Quantil und weitere Quantile definiert. Die wichtigsten Quantile stehen in einer Tabelle zur Verfügung. 4 WAHRSCHEINLICHKEITSRECHNUNG UND KOMBINATORIK 19 Quantile für beliebige Normalverteilungen: Für eine Zufallsvariable X ∼ N (µ; σ 2 ) heißt die Zahl q0,95 = µ + z0,95 · σ das 95%-Quantil dieser Normalverteilung. Es gilt: P (X ≤ q0,95 ) = 0, 95 Entsprechend kann man durch Ersetzen der Quantile der Standardnormalverteilung andere Quantile berechnen. Allgemein: α-Quantil: qα = µ + zα · σ mit P (X ≤ qα ) = α In Excel: Berechnung von Quantilen von Normalverteilungen über die Funktion NORMINV. Zufallsstreubereiche (ZSB) Zufallsstreubereich oder Prognoseintervall einer normalverteilten Zufallsvariable X: ein Intervall um den Erwartungswert µ, in dem sich die Ausprägungen von X mit einer Wahrscheinlichkeit p (z. B. p = 90%, 98%, 99%) befinden. Die Ausprägungen von X befinden sich außerhalb des Zufallsstreubereiches mit einer Wahrscheinlichkeit von α = 1 − p. Zufallsstreubereiche für eine normalverteilte Zufallsvariable X ∼ N (µ; σ 2 ): = µ − z1− α2 · σ ; µ + z1− α2 · σ Zweiseitig q α2 ; q1− α2 Einseitig nach oben beschränkt (−∞ ; q1−α ] = (−∞ ; µ + z1−α · σ] Einseitig nach unten beschränkt [qα ; ∞) = [µ − z1−α · σ ; ∞) Für einen zweiseitigen Zufallsstreubereich benötigt man das z1− α2 -Quantil der Normalverteilung, z. B. also für einen zweiseitigen 99%-Zufallsstreubereich z0,995 = 2, 576. Wegen zα = −z1−α genügt es, eine Tabelle mit Quantilen der Standardnormalverteilung für „hohe“ Wahrscheinlichkeiten (> 0, 5) zu haben. Zufallsstreubereiche für X Das durch X beschriebene Zufallsexperiment soll jetzt nicht nur einmal durchgeführt werden, sondern n-mal unabhängig wiederholt werden. In welchem Bereich wird der arithmetische Mittelwert der n Daten liegen? Ein solcher Bereich heißt ein Zufallsstreubereich für X. Die entsprechenden Formeln lauten: Zweiseitig Einseitig nach oben beschränkt Einseitig nach unten beschränkt σ σ µ − z1− α2 · √ ; µ + z1− α2 · √ n n σ −∞ ; µ + z1−α · √ n σ µ − z1−α · √ ; ∞ n Benutzt man die Formeln mit n = 1, so erhält man natürlich wieder die Formeln der Zufallsstreubereiche für X selbst. 4.3.3 Summen von Zufallsvariablen Summen von normalverteilten Zufallsvariablen Voraussetzung: X1 , X2 , . . . , Xn sind unabhängig (!) normalverteilt mit Erwartungswerten µ1 , µ2 , . . . , µn und Varianzen σ12 , σ22 , . . . , σn2 . Dann gilt: Die Summe X1 +X2 +· · ·+Xn ist ist ebenfalls normalverteilt mit Erwartungswert µ1 +µ2 +· · ·+µn und Varianz σ12 + σ22 + · · · + σn2 ; also X1 + X2 + · · · + Xn ∼ N µ1 + µ2 + · · · + µn ; σ12 + σ22 + · · · + σn2 (1) 4 WAHRSCHEINLICHKEITSRECHNUNG UND KOMBINATORIK 20 Spezialfälle: X1 + X2 ∼ N µ1 + µ2 ; σ12 + σ22 X1 − X2 ∼ N µ1 − µ2 ; σ12 + σ22 (2) (3) Haben X1 , X2 , . . . , Xn alle die gleiche Normalverteilung N (µ; σ 2 ), dann gilt (bei Unabhängigkeit) für die Summe S = X1 + X2 + · · · + Xn ∼ N nµ; nσ 2 (4) 2 X1 + X2 + · · · + Xn σ ∼ N µ; (5) für den arithmetischen Mittelwert X = n n Besonders zu beachten sind das Pluszeichen bei der Varianz in Gleichung 3 und der Nenner der Varianz in Gleichung 5. Zentraler Grenzwertsatz – Summen von nicht normalverteilten Zufallsvariablen Voraussetzung: Es sind X1 , X2 , . . . , Xn Zufallsvariablen, die n unabhängige Durchführungen desselben Zufallsexperiments beschreiben und die den gleichen Erwartungswert µ und die gleiche Varianz σ 2 haben. Dann gilt, falls n groß ist, für die Summe S = X1 + X2 + · · · + Xn ≈ N nµ; nσ 2 (6) 2 X1 + X2 + · · · + Xn σ ≈ N µ; (7) für den arithmetischen Mittelwert X = n n Insbesondere bedeutet das, dass eine Summe vieler unabhängiger Größen näherungsweise normalverteilt ist, selbst wenn die einzelnen Summanden nicht normalverteilt sind. Stetigkeitskorrektur Wird eine diskrete Zufallsvariable X, die nur ganzzahlige Werte annehmen kann, durch eine Normalverteilung N (µ; σ 2 ) approximiert, sollten Wahrscheinlichkeiten mit den Formeln b − µ +0, 5 a − µ −0, 5 P (a ≤ X ≤ b) ≈ Φ −Φ σ σ b − µ +0, 5 P (X ≤ b) ≈ Φ σ a − µ −0, 5 P (a ≤ X) = P (X ≥ a) ≈ 1 − Φ σ berechnet werden. Achtung: Bei diesen Formeln darf „≤“ nicht durch „<“ ersetzt werden. Die Summanden „+0, 5“ bzw. „−0, 5“ nennt man „Stetigkeitskorrektur “. Sie sind erforderlich, wenn eine diskrete Zufallsvariable X mit ganzzahligen Werten durch eine stetige Zufallsvariable (Normalverteilung) angenähert wird. Näherungen für Verteilungen von Zufallsvariablen (Zusammenfassung) Approximation von HV durch BV durch P V (Hypergeom. Verteilung −→ Binomialverteilung) X ∼ H(n; N ; M ) ≈ B n; M N • Näherung o.k. wenn N groß und n nicht zu groß ist, d. h. wenn der Anteil der gezogenen Elemente nicht zu groß ist. n Faustregel: N ≤ 0, 1. • Dann: p := M N X ∼ B(n; p) ≈ P o(np) (Binomalverteilung −→ Poissonverteilung) • wenn n groß und p klein. Faustregel: n ≥ 30 und p ≤ 0, 1. • Dann: λ := np 5 SCHLIEßENDE STATISTIK 21 Approximation von HV, BV und PV durch die Normalverteilung X ∼ H(n; N ; M ) ≈ N (µ; σ 2 ) (Hypergeom. Verteilung −→ Normalverteilung) • Faustregel: Näherung o.k. falls • Dann: µ := n · M N n N ≤ 0, 1 und n · p · (1 − p) ≥ 9. = n · p und σ 2 = n · p · (1 − p) · N −n N −1 wobei p = M N ist. X ∼ B(n; p) ≈ N (µ; σ 2 ) (Binomialverteilung −→ Normalverteilung) • Faustregel: Näherung o.k. falls n · p · (1 − p) ≥ 9 • Dann: µ := np und σ 2 := n · p · (1 − p) X ∼ P o(λ) ≈ N (µ; σ 2 ) (Poissonverteilung −→ Normalverteilung) • wenn n groß und λ hinreichend groß Faustregel: Näherung o.k. falls λ ≥ 9 • Dann: µ := λ und σ 2 := λ Die Faustregeln für die Approximation durch die NV bedeuten σ 2 ≥ 9. (In der Literatur gibt es verschiedene Faustregeln.) Bei der Approximation durch die NV ist in allen drei Fällen die Stetigkeitskorrektur zu beachten. 5 Schließende Statistik 5.1 Punktschätzer Oft ist der Verteilungstyp bekannt, aber die entsprechenden Parameter nicht. Beispiele: Zufallsvariable Verteilung zu schätzende Parameter Messfehler, Produktionsfehler, . . . Normalverteilung µ, σ Bernoulli-Schema (Erfolg – Misserfolg) Binomialverteilung p (bzw. µ = np) seltene Ereignisse Poissonverteilung µ Diese Parameter können aus einer Stichprobe geschätzt werden. Berechnet man für die unbekannte Größe aus der Stichprobe einen Zahlenwert als Näherung, so spricht man von einer Punktschätzung. Wichtige Beispiele: Unbekannter Parameter Punktschätzer Wahrscheinlichkeit p eines Ereignisses p̂ = nk (relative Häufigkeit, d. h. bei der Stichprobe vom Umfang n trat das gesuchte Ereignis k-mal auf) Erwartungswert µ µ̂ = x (arithmetischer Mittelwert der Stichprobe) Varianz σ 2 σˆ2 = s2 (empirische Varianz der Stichprobe) Standardabweichung σ σ̂ = s (empirische Standardabweichung der Stichprobe) • Nach dem Gesetz der großen Zahlen liegt bei einer großen Stichprobe der aus der Stichprobe berechnete konkrete Schätzwert „in der Nähe“ des wahren (unbekannten) Parameters; aber eine kleine Differenz wird es normalerweise trotzdem geben. • Bei einer kleinen Stichprobe muss man von deutlich größeren Abweichungen zwischen dem Punktschätzer und dem wahren (unbekannten) Parameter ausgehen. In beiden Fällen wird man versuchen, die möglichen Abweichungen zwischen dem geschätzten Wert und dem unbekannten wahren Wert zu quantifizieren. Dazu wird man z. B. für den Fall einer unbekannten Wahrscheinlichkeit p Fragen wie die folgenden stellen: 5 SCHLIEßENDE STATISTIK 22 1. Kann man bestimmte Werte von p ausschließen, z. B. kann man ausschließen, dass gilt p ≤ 0, 5? 2. Kann man einen Bereich angeben, in dem p liegen kann, etwa in der Form „p liegt im Intervall [0, 63; 0, 67]“? Auf solche Fragen kann es keine sinnvollen Antworten geben, die mit 100-prozentiger Sicherheit richtig sind. Es gibt aber Verfahren, die mit großer Wahrscheinlichkeit richtige Antworten liefern: 1. Tests ; Abschnitt 5.2 2. Vertrauensbereiche ; Abschnitt 5.3 5.2 Hypothesentests Ein statistischer Test ist ein Verfahren, um bestimmte Hypothesen über einen unbekannten Parameter auszuschließen. 5.2.1 Generelles Vorgehen beim Testen von Hypothesen 1. Hypothesen aufstellen (s.u.) 2. Signifikanzniveau α festlegen, z. B. α = 0, 05, α = 0, 01 oder α = 0, 001. 3. Berechnung des Zufallsstreubereichs (nach Tabelle) Falls H0 zutrifft, sollte die Teststatistik mit großer Wahrscheinlichkeit 1 − α in diesem Zufallsstreubereich liegen. 4. Berechnung der Teststatistik aus der Stichprobe Teststatistiken: x bzw. x − y bzw. nk 5. Testentscheidung: Teststatistik ∈ ZSB (=Annahmebereich) =⇒ H0 kann nicht verworfen werden/wird beibehalten Teststatistik ∈ / ZSB =⇒ H0 wird (zu Gunsten von H1 ) verworfen/abgelehnt 6. Antwortsatz d. h. „Übersetzen“ der Testentscheidung in das konkrete Anwendungsproblem Falls die Stichprobendaten der Nullhypothese nicht widersprechen, braucht man den ZSB nicht zu berechnen; z. B. wenn die Nullhypothese H0 : µ ≥ 1000 lautet und x = 1000, 7 ist. In einem solchen Fall wird die Nullhypothese nie verworfen; µ ≥ 1000 kann natürlich nicht ausgeschlossen werden. Ergänzung: Aufstellen der Hypothesen für Parametertests H0 beinhaltet den für den unbekannten Parameter auszuschließenden Wert (bzw. die auszuschließenden Werte), H1 das „Gegenteil“ von H0 , also die zu bestätigenden Werte. Beispiele für Signalwörter im Text: . . . gleich . . . = . . . ungleich, weicht ab, . . . 6= . . . höchstens, nicht mehr als . . . ≤ . . . größer, mehr als, . . . > . . . mindestens, nicht weniger als . . . ≥ . . . kleiner, weniger als, . . . < H0 H1 H0 immer = , ≤ oder ≥ („. . . gleich“ steht vorne) H1 immer = 6 , < oder >. Wahl des Signifikanzniveaus α Das Signifikanzniveau α ist immer eine kleine Wahrscheinlichkeit. Sie kann frei gewählt werden und gibt die Irrtumswahrscheinlichkeit beim Beibehalten der Nullhypothese (Wahrscheinlichkeit für den Fehler 1. Art) an. 5 SCHLIEßENDE STATISTIK 23 Mögliche Fehler bei statistischen Tests H0 wird verworfen H0 wird nicht verworfen H0 trifft zu Fehler 1. Art (α-Fehler) Wahrscheinlichkeit: höchstens α Richtige Entscheidung H1 trifft zu Richtige Entscheidung Fehler 2. Art (β-Fehler) Wahrscheinlichkeit: β Falls H0 verworfen wird, gilt H1 als statistisch nachgewiesen. Man sagt auch, H1 sei „signifikant“ bei Signifikanzniveau α. α ist die Wahrscheinlichkeit, dass man sich irrt (deshalb auch: Irrtumswahrscheinlichkeit), d.h. H1 gilt mit Wahrscheinlichkeit 1 − α. Im Allgemeinen liefert nur das Verwerfen von H0 eine statistisch abgesicherte Aussage. Kann H0 nicht verworfen werden, so können die in H0 aufgeführten Möglichkeiten nicht ausgeschlossen werden; H1 ist nicht nachgewiesen. Über die Wahrscheinlichkeit, mit der die Nullhypothese gilt, kann man keine Aussage treffen. 5.2.2 Tabellen für statistische Tests Allgemeiner Hinweis zu den Tabellen auf den folgenden Seiten: Bei den zweiseitigen Tests ist das 1 − α2 -Quantil der Normalverteilung (bzw. t-Verteilung) zu benutzen. Ist zum Beispiel α = 5%, so muss bei der Normalverteilung das Quantil z1− α2 = z0,975 = 1, 96 benutzt werden. 1. Gauß-Test: Test für µ bei bekannter Standardabweichung σ zum Signifikanzniveau α Test (zum Signifikanzniveau α) einer Nullhypothese über den unbekannten Erwartungswert µ, z. B. (erster Eintrag in der Tabelle) die Hypothese, dass µ gleich einer vorgegebenen festen Zahl µ0 (etwa einem Sollwert oder dem bisherigen Wert) ist. Gegeben: Stichprobe x1 , x2 , . . . , xn . Die Messwerte sind Realisierungen von n unabhängigen N (µ, σ 2 )- verteilten Zufallsvariablen mit unbekanntem Erwartungswert µ, aber bekannter Varianz σ 2 . H0 H1 µ = µ0 µ 6= µ0 µ ≥ µ0 µ < µ0 µ ≤ µ0 µ > µ0 Zufallsstreubereich für X, falls H0 zutrifft σ σ µ0 − z1− α2 · √ ; µ0 + z1− α2 · √ n n σ µ0 − z1−α · √ ; ∞ n σ −∞ ; µ0 + z1−α · √ n H0 verwerfen falls x∈ / ZSB x∈ / ZSB x∈ / ZSB 2. t-Test: Test für µ bei unbekannter Standardabweichung σ zum Signifikanzniveau α Gegeben: Stichprobe x1 , x2 , . . . , xn . Die Messwerte sind Realisierungen von n unabhängigen N (µ, σ 2 )-verteilten Zufallsvariablen mit unbekanntem Erwartungswert µ, und unbekannter Varianz σ 2 . −→ Schätze σ durch s aus der Stichprobe. Deshalb müssen die Quantile der t-Verteilung (mit n − 1 Freiheitsgraden) statt der Normalverteilung benutzt werden. 5 SCHLIEßENDE STATISTIK H0 H1 24 Zufallsstreubereich für X, falls H0 zutrifft µ = µ0 µ 6= µ0 µ ≥ µ0 µ < µ0 µ ≤ µ0 µ > µ0 H0 verwerfen falls s s α α µ0 − tn−1;1− 2 · √ ; µ0 + tn−1;1− 2 · √ n n s µ0 − tn−1;1−α · √ ; ∞ n s −∞ ; µ0 + tn−1;1−α · √ n x∈ / ZSB x∈ / ZSB x∈ / ZSB s: Standardabweichung der Stichprobe, tn−1;1−α : (1 − α)-Quantil der t-Verteilung mit n − 1 Freiheitsgraden 3. Zweistichproben-t-Test Test (zum Signifikanzniveau α) über die Differenz zweier Erwartungswerte µ1 − µ2 zweier Grundgesamtheiten bei unbekannter aber gleicher Standardabweichung σ. Zum Test werden zwei Stichproben vom Umfang m und n mit den arithmetischen Mitteln x und y und mit den empirischen Standardabweichungen s1 und s2 gezogen. r q m+n 2 2 Berechne zunächst die Hilfsgröße sd = (m − 1) · s1 + (n − 1) · s2 · m · n · (m + n − 2) Zufallsstreubereich für X − Y , falls H0 zutrifft H0 verwerfen falls µ1 − µ2 6= 0 −tm+n−2;1− α2 · sd ; tm+n−2;1− α2 · sd x−y ∈ / ZSB µ1 − µ2 ≥ 0 µ1 − µ2 < 0 [−tm+n−2;1−α · sd ; ∞) x−y ∈ / ZSB µ1 − µ2 ≤ 0 µ1 − µ2 > 0 (−∞ ; tm+n−2;1−α · sd ] x−y ∈ / ZSB H0 H1 µ1 − µ2 = 0 4. Test für eine unbekannte Wahrscheinlichkeit/einen unbekannten Anteil p einer Grundgesamtheit zum Signifikanzniveau α Bei einer Stichprobe vom Umfang n sei das gesuchte Ereignis k-mal eingetreten. H0 H1 p = p0 p 6= p0 p ≥ p0 p < p0 k Zufallsstreubereich für , n falls H0 zutrifft √ p0 ·(1−p0 ) √ α − p0 − z1− 2 · n √ 0,5 n ; p0 p > p0 +z 1− α 2 √ p0 ·(1−p0 ) √ p0 − z1−α · − n √ p ≤ p0 H0 verwerfen falls 0 ; p0 + z1−α · p0 ·(1−p0 ) √ n · p0 ·(1−p0 ) √ n 0,5 n ;1 + 0,5 n + 0,5 n k ∈ / ZSB n k ∈ / ZSB n k ∈ / ZSB n wobei p̂ = nk : Anteil/relative Häufigkeit in einer Stichprobe vom Umfang n, wenn das gesuchte Ereignis k-mal aufgetreten ist. 5 SCHLIEßENDE STATISTIK 5.3 25 Vertrauensbereiche Intervallschätzer für die unbekannten Parameter. 5.3.1 Unterschied zwischen Zufallsstreubereich und Vertrauensbereich Die folgenden Beispiele sollen den Unterschied zwischen einem Zufallsstreubereich und einem Vertrauensbereich verdeutlichen. Beide Beispiele gehen von Normalverteilung mit bekannter Varianz σ 2 = 20 aus. 1. Es ist µ = 1000 bekannt. In welchem Intervall liegt das arithmetische Mittel x einer Stichprobe vom Umfang 10 mit Wahrscheinlichkeit 95%? ; Zufallsstreubereich für x. 2. µ ist nicht bekannt. Bei einer Stichprobe vom Umfang n = 10 ergab sich x = 998, 74. In welchem Intervall könnte µ liegen? ; Vertrauensbereich für µ. Also bei 1) Schluss von µ auf x, hingegen bei 2) umgekehrt Schluss von x auf µ. 1. µ = 1000 ; Zufallsstreubereich für x; 2. x = 998, 74 ; Vertrauensbereich für µ. Der Zufallsstreubereich bei 1) und der Vertrauensbereich bei 2) haben zwar unterschiedliche Mittelpunkte, nämlich µ = 1000 bei 1) und x = 998, 74 bei 2), aber die gleiche Länge 2 · z0,975 · √σ10 ≈ 2 · 2, 77 = 5, 54. 5.3.2 Tabellen für Vertrauensbereiche zur Vertrauenswahrscheinlichkeit 1 − α Die Voraussetzungen sind die gleichen wie im Abschnitt 5.2.2 bei den statistischen Tests. 1. Vertrauensbereich für µ bei bekannter Standardabweichung σ zum Vertrauensniveau 1 − α Der Vertrauensbereich wird auf Basis einer Stichprobe x1 , x2 , . . . , xn berechnet, deren arithmetischer Mittelwert x ist. Vertrauensbereich für µ Art des Vertrauensbereichs zweiseitig h x − z1− α2 · h einseitig nach unten begrenzt √σ n ; x + z1− α2 · x − z1−α · √σ n ; ∞ −∞ ; x + z1−α · einseitig nach oben begrenzt √σ n i √σ n i 2. Vertrauensbereich für µ bei unbekannter Standardabweichung σ zum Vertrauensniveau 1 − α Der Vertrauensbereich wird auf Basis einer Stichprobe x1 , x2 , . . . , xn berechnet, deren arithmetischer Mittelwert x und deren empirische Standardabweichung s ist. Vertrauensbereich für µ Art des Vertrauensbereichs zweiseitig einseitig nach unten begrenzt einseitig nach oben begrenzt h x − tn−1;1− α2 · h √s n ; x + tn−1;1− α2 · x − tn−1;1−α · √s n ; ∞ −∞ ; x + tn−1;1−α · √s n i √s n i 6 TABELLEN 26 3. Vertrauensbereich für die Differenz zweier Erwartungswerte µ1 − µ2 zum Vertrauensniveau 1−α Es werden zwei Stichproben vom Umfang m und n mit den arithmetischen Mittelnx und y und mit den empirischen Standardabweichungen s1 und s2 gezogen. r q m+n 2 2 Berechne zunächst die Hilfsgröße sd = (m − 1) · s1 + (n − 1) · s2 · m · n · (m + n − 2) Art des Vertrauensbereichs zweiseitig Vertrauensbereich für µ1 − µ2 x − y − tm+n−2;1− α2 · sd ; x − y + tm+n−2;1− α2 · sd einseitig nach unten begrenzt [x − y − tm+n−2;1−α · sd ; ∞) einseitig nach oben begrenzt (−∞ ; x − y + tm+n−2;1−α · sd ] 4. Vertrauensbereich für eine unbekannte Wahrscheinlichkeit/einen unbekannten Anteil p einer Grundgesamtheit zum Vertrauensniveau 1 − α Tritt bei einer Stichprobe vom Umfang n das gesuchte Ereignis k-mal auf, verwendet man als Punktschätzer für die unbekannte Wahrscheinlichkeit die relative Häufigkeit p̂ = k n Der Vertrauensbereich zum Vertrauensniveau 1 − α berechnet sich dann als Vertrauensbereich für p Art des Vertrauensbereichs zweiseitig einseitig nach unten begrenzt q p̂) p̂ − z1− α2 · p̂·(1− − n 0,5 n q p̂) p̂ − z1−α · p̂·(1− − n einseitig nach oben begrenzt 6 Tabellen ; p̂ + z 1− α 2 0 ; p̂ + z1−α · q · 0,5 n p̂·(1−p̂) n + q p̂·(1−p̂) n ; 1 0,5 n + 0,5 n 6 Verteilungsfunktion Φ(z) der Standard-Normalverteilung N (0; 1) 0 0,5000 0,5398 0,5793 0,6179 0,6554 0,6915 0,7257 0,7580 0,7881 0,8159 0,8413 0,8643 0,8849 0,9032 0,9192 0,9332 0,9452 0,9554 0,9641 0,9713 0,9772 0,9821 0,9861 0,9893 0,9918 0,9938 0,9953 0,9965 0,9974 0,9981 0,9987 1 0,5040 0,5438 0,5832 0,6217 0,6591 0,6950 0,7291 0,7611 0,7910 0,8186 0,8438 0,8665 0,8869 0,9049 0,9207 0,9345 0,9463 0,9564 0,9649 0,9719 0,9778 0,9826 0,9864 0,9896 0,9920 0,9940 0,9955 0,9966 0,9975 0,9982 0,9987 2 0,5080 0,5478 0,5871 0,6255 0,6628 0,6985 0,7324 0,7642 0,7939 0,8212 0,8461 0,8686 0,8888 0,9066 0,9222 0,9357 0,9474 0,9573 0,9656 0,9726 0,9783 0,9830 0,9868 0,9898 0,9922 0,9941 0,9956 0,9967 0,9976 0,9982 0,9987 4 0,5160 0,5557 0,5948 0,6331 0,6700 0,7054 0,7389 0,7704 0,7995 0,8264 0,8508 0,8729 0,8925 0,9099 0,9251 0,9382 0,9495 0,9591 0,9671 0,9738 0,9793 0,9838 0,9875 0,9904 0,9927 0,9945 0,9959 0,9969 0,9977 0,9984 0,9988 5 0,5199 0,5596 0,5987 0,6368 0,6736 0,7088 0,7422 0,7734 0,8023 0,8289 0,8531 0,8749 0,8944 0,9115 0,9265 0,9394 0,9505 0,9599 0,9678 0,9744 0,9798 0,9842 0,9878 0,9906 0,9929 0,9946 0,9960 0,9970 0,9978 0,9984 0,9989 6 0,5239 0,5636 0,6026 0,6406 0,6772 0,7123 0,7454 0,7764 0,8051 0,8315 0,8554 0,8770 0,8962 0,9131 0,9279 0,9406 0,9515 0,9608 0,9686 0,9750 0,9803 0,9846 0,9881 0,9909 0,9931 0,9948 0,9961 0,9971 0,9979 0,9985 0,9989 7 0,5279 0,5675 0,6064 0,6443 0,6808 0,7157 0,7486 0,7794 0,8078 0,8340 0,8577 0,8790 0,8980 0,9147 0,9292 0,9418 0,9525 0,9616 0,9693 0,9756 0,9808 0,9850 0,9884 0,9911 0,9932 0,9949 0,9962 0,9972 0,9979 0,9985 0,9989 8 0,5319 0,5714 0,6103 0,6480 0,6844 0,7190 0,7517 0,7823 0,8106 0,8365 0,8599 0,8810 0,8997 0,9162 0,9306 0,9429 0,9535 0,9625 0,9699 0,9761 0,9812 0,9854 0,9887 0,9913 0,9934 0,9951 0,9963 0,9973 0,9980 0,9986 0,9990 9 0,5359 0,5753 0,6141 0,6517 0,6879 0,7224 0,7549 0,7852 0,8133 0,8389 0,8621 0,8830 0,9015 0,9177 0,9319 0,9441 0,9545 0,9633 0,9706 0,9767 0,9817 0,9857 0,9890 0,9916 0,9936 0,9952 0,9964 0,9974 0,9981 0,9986 0,9990 Werte für negatives z mit der Formel Φ(−z) = 1 − Φ(z), z. B. Φ(−1, 55) = 1 − 0, 9394 = 0, 0606 27 Ablesebeispiel: Φ(0, 92) = 0, 8212 3 0,5120 0,5517 0,5910 0,6293 0,6664 0,7019 0,7357 0,7673 0,7967 0,8238 0,8485 0,8708 0,8907 0,9082 0,9236 0,9370 0,9484 0,9582 0,9664 0,9732 0,9788 0,9834 0,9871 0,9901 0,9925 0,9943 0,9957 0,9968 0,9977 0,9983 0,9988 TABELLEN z 0,0 0,1 0,2 0,3 0,4 0,5 0,6 0,7 0,8 0,9 1,0 1,1 1,2 1,3 1,4 1,5 1,6 1,7 1,8 1,9 2,0 2,1 2,2 2,3 2,4 2,5 2,6 2,7 2,8 2,9 3,0 6 TABELLEN 28 Quantile tm;q der t-Verteilung mit m Freiheitsgraden und Quantile zq der Standard-Normalverteilung (NV) m 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 30 35 40 45 50 60 70 80 90 100 200 500 q 0,8 1,376 1,061 0,978 0,941 0,920 0,906 0,896 0,889 0,883 0,879 0,876 0,873 0,870 0,868 0,866 0,865 0,863 0,862 0,861 0,860 0,859 0,858 0,858 0,857 0,856 0,856 0,855 0,855 0,854 0,854 0,852 0,851 0,850 0,849 0,848 0,847 0,846 0,846 0,845 0,843 0,842 0,9 3,078 1,886 1,638 1,533 1,476 1,440 1,415 1,397 1,383 1,372 1,363 1,356 1,350 1,345 1,341 1,337 1,333 1,330 1,328 1,325 1,323 1,321 1,319 1,318 1,316 1,315 1,314 1,313 1,311 1,310 1,306 1,303 1,301 1,299 1,296 1,294 1,292 1,291 1,290 1,286 1,283 0,95 6,314 2,920 2,353 2,132 2,015 1,943 1,895 1,860 1,833 1,812 1,796 1,782 1,771 1,761 1,753 1,746 1,740 1,734 1,729 1,725 1,721 1,717 1,714 1,711 1,708 1,706 1,703 1,701 1,699 1,697 1,690 1,684 1,679 1,676 1,671 1,667 1,664 1,662 1,660 1,653 1,648 0,975 12,706 4,303 3,182 2,776 2,571 2,447 2,365 2,306 2,262 2,228 2,201 2,179 2,160 2,145 2,131 2,120 2,110 2,101 2,093 2,086 2,080 2,074 2,069 2,064 2,060 2,056 2,052 2,048 2,045 2,042 2,030 2,021 2,014 2,009 2,000 1,994 1,990 1,987 1,984 1,972 1,965 0,99 31,821 6,965 4,541 3,747 3,365 3,143 2,998 2,896 2,821 2,764 2,718 2,681 2,650 2,624 2,602 2,583 2,567 2,552 2,539 2,528 2,518 2,508 2,500 2,492 2,485 2,479 2,473 2,467 2,462 2,457 2,438 2,423 2,412 2,403 2,390 2,381 2,374 2,368 2,364 2,345 2,334 0,995 63,656 9,925 5,841 4,604 4,032 3,707 3,499 3,355 3,250 3,169 3,106 3,055 3,012 2,977 2,947 2,921 2,898 2,878 2,861 2,845 2,831 2,819 2,807 2,797 2,787 2,779 2,771 2,763 2,756 2,750 2,724 2,704 2,690 2,678 2,660 2,648 2,639 2,632 2,626 2,601 2,586 0,999 318,289 22,328 10,214 7,173 5,894 5,208 4,785 4,501 4,297 4,144 4,025 3,930 3,852 3,787 3,733 3,686 3,646 3,610 3,579 3,552 3,527 3,505 3,485 3,467 3,450 3,435 3,421 3,408 3,396 3,385 3,340 3,307 3,281 3,261 3,232 3,211 3,195 3,183 3,174 3,131 3,107 NV 0,842 1,282 1,645 1,960 2,326 2,576 3,090 Ablesebeispiele: t20;0,975 = 2, 086; z0,995 = 2, 576 Werte für q < 0, 5 mit den Formeln tm;1−q = −tm;q und z1−q = −zq . Beispiele: t30;0,1 = −t30;0,9 = −1, 310; z0,01 = −z0,99 = −2, 326.