Von Häufigkeiten zu Wahrscheinlichkeiten

Werbung

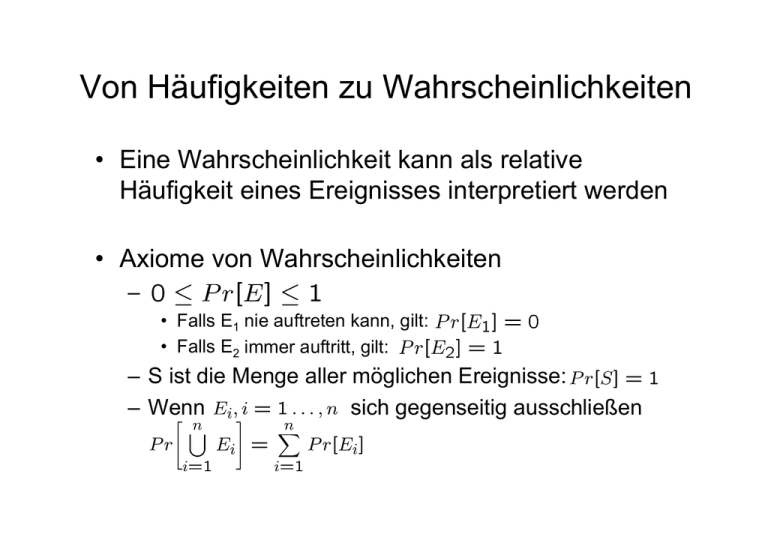

Von Häufigkeiten zu Wahrscheinlichkeiten • Eine Wahrscheinlichkeit kann als relative Häufigkeit eines Ereignisses interpretiert werden • Axiome von Wahrscheinlichkeiten – • Falls E1 nie auftreten kann, gilt: • Falls E2 immer auftritt, gilt: – S ist die Menge aller möglichen Ereignisse: – Wenn sich gegenseitig ausschließen Bedingte Wahrscheinlichkeiten • Sei die Wahrscheinlichkeit für das Ereignis E, vorausgesetzt dass das Ereignis F schon eingetreten ist. • Bayesche Regel: (invertieren von gegebenen Whr.) Zufallsvariablen • Eine Zufallsvariable ist eine Funktion, die jedem Ereignis aus S eine Zahl zuweist. • Wahrscheinlichkeitsverteilungsfunktion einer Zufallsvar. – X ist diskret • Wahrscheinlichkeitsmassenfunktion – X ist kontinuierlich • Wahrscheinlichkeitsdichtefunktion mit Verbundverteilung und Dichte • Beziehung zwischen zwei oder mehreren Zufallsvariablen • Verbundverteilung • Randverteilung – Diskret – Kontinuierlich • Bedingte Verteiltungen Bayesche Regel für Zufallsvariablen • Bayesche Regel • Interpretation Erwartungswert • Der Erwartungswert einer Zufallsvariable X ist E[X] und gibt den durchschnittlichen Wert von X bei vielen Experimentwiederholungen an. • Rechenregeln • Für reelle Funktionen g() gilt Varianz • Varianz gibt an, wie stark X um den Erwartungswert variiert • Varianz ist das zweite Moment minus das Quadrat des ersten Moments • Kovarianz beschreibt die Beziehung zwischen zwei Zufallsvariablen • Korrelation ist normalisiert und zwischen -1 und 1 Schwache Gesetz der großen Zahlen • Sei eine Menge von unabhängigen Zufallsvariablen mit identischer Verteilung (iid), alle mit Erwartungswert und endlicher Varianz dann gilt für jedes • Der Durchschnitt konvergiert gegen den Erwartungswert bei großen N Bestimmen von Parametern aus Stichproben • Modelle für Wahrscheinlichkeitsverteilungen können durch Dichtefunktionen mit Parametern beschrieben werden – Bespiele: Gauß-, Bernoulli-, Binomial-Verteilung, ... • Stichprobe kann als Trainingsdatensatz genutzt werden, um die unbekannten Parameter zu bestimmen • Schätzmethoden – Eingabe: Stichprobe – Ausgabe: Parameterschätzung – Beispiele: Maximum Likelihood, Bayes, Maximum Aposteriory, ... Maximum Likelihood Schätzung • Sei eine unabhängige, identisch verteilte Stichprobe (iid), deren Instanzen bezüglich einer Dichte mit unbekanntem Parameter verteilt sind • Ziel: finde die Parametereinstellung, s.d. die Stichprobe am wahrscheinlichsten erzeugt wurde • Likelihood der Stichprobe • Logarithmus ändert das Maximum nicht

![Blatt 7 Stochastik für Lehramt an Beruflichen Schulen [MA9943]](http://s1.studylibde.com/store/data/010547176_1-c9bc80fa04b88adb532e1b0dc44e7563-300x300.png)