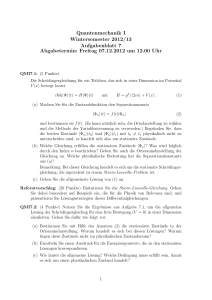

QUANTENMECHANIK I

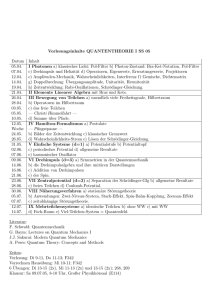

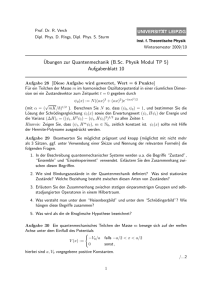

Werbung