14. Mai 2014

Werbung

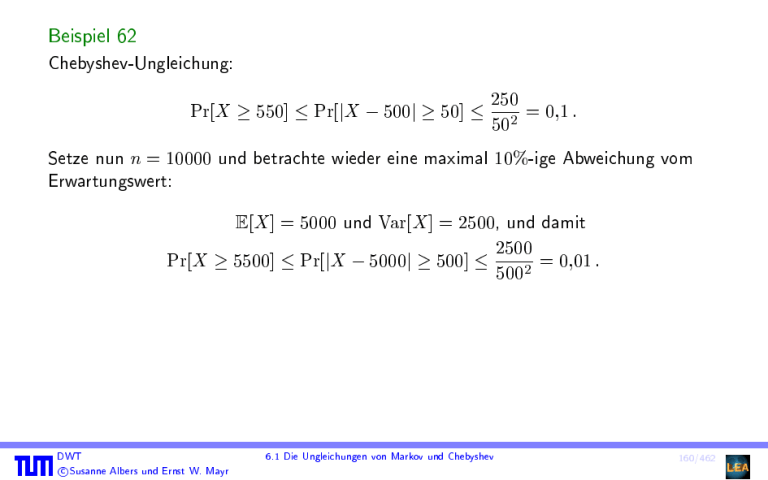

Beispiel 62

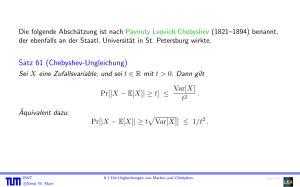

Chebyshev-Ungleichung:

Pr[X 550] Pr[jX 500j 50] 250

502 = 0;1 :

Setze nun n = 10000 und betrachte wieder eine maximal 10%-ige Abweichung vom

Erwartungswert:

E[X ] = 5000 und Var[X ] = 2500, und damit

Pr[X 5500] Pr[jX 5000j 500] 2500

5002 = 0;01 :

DWT

c Susanne Albers und Ernst W. Mayr

6.1 Die Ungleichungen von Markov und Chebyshev

160/462

6.2 Gesetz der groen Zahlen

Wir haben diskutiert, wie Wahrscheinlichkeiten als Grenzwerte von relativen

Haugkeiten aufgefasst werden konnen.

Satz 63 (Gesetz der groen Zahlen)

Gegeben sei eine Zufallsvariable X . Ferner seien "; > 0 beliebig aber fest. Dann gilt

X]

fur alle n Var[

"2 :

Sind X1 ; : : : ; Xn unabhangige Zufallsvariablen mit derselben Verteilung wie X und

setzt man

X + : : : + Xn

Z := 1

;

so gilt

DWT

c Susanne Albers und Ernst W. Mayr

n

Pr[jZ E[X ]j ] ":

6.2 Gesetz der groen Zahlen

161/462

Beweis:

Fur Z gilt

1

1

E[Z ] = (E[X1 ] + : : : + E[Xn ]) = n E[X ] = E[X ];

n

n

sowie

Var[Z ] = n12 (Var[X1 ] + : : : + Var[Xn ]) = n12 n Var[X ] = Var[nX ] :

Mit der Chebyshev-Ungleichung erhalten wir

Z ] Var[X ]

Pr[jZ E[X ]j ] = Pr[jZ E[Z ]j ] Var[

= n2 ";

2

nach Wahl von n.

DWT

c Susanne Albers und Ernst W. Mayr

6.2 Gesetz der groen Zahlen

162/462

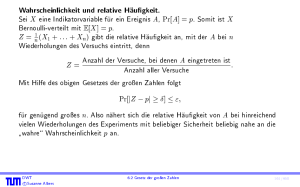

Wahrscheinlichkeit und relative Haugkeit.

Sei X eine Indikatorvariable fur ein Ereignis A, Pr[A] = p. Somit ist X

Bernoulli-verteilt mit E[X ] = p.

Z = n1 (X1 + : : : + Xn ) gibt die relative Haugkeit an, mit der A bei n

Wiederholungen des Versuchs eintritt, denn

Z=

Anzahl der Versuche, bei denen A eingetreten ist

:

Anzahl aller Versuche

Mit Hilfe des obigen Gesetzes der groen Zahlen folgt

Pr[jZ pj ] ";

fur genugend groes n. Also nahert sich die relative Haugkeit von A bei hinreichend

vielen Wiederholungen des Experiments mit beliebiger Sicherheit beliebig nahe an die

wahre\ Wahrscheinlichkeit p an.

"

DWT

c Susanne Albers und Ernst W. Mayr

6.2 Gesetz der groen Zahlen

163/462

Die obige Variante eines Gesetzes der groen Zahlen geht auf Jakob Bernoulli zuruck,

der den Satz in seinem Werk ars conjectandi zeigte.

Es soll betont werden, dass das Gesetz der groen Zahlen die

P

relative Abweichung j 1

Xi pj

i

n

und nicht die

absolute Abweichung j

P

i Xi

npj

abschatzt!

DWT

c Susanne Albers und Ernst W. Mayr

6.2 Gesetz der groen Zahlen

164/462

6.3 Cherno-Schranken

6.3.1 Cherno-Schranken fur Summen von 0{1{Zufallsvariablen

Die hier betrachtete Art von Schranken ist nach Herman Cherno ( 1923) benannt.

Sie nden in der komplexitatstheoretischen Analyse von Algorithmen eine sehr hauge

Verwendung.

Satz 64

Seien X1 ; : : : ; Xn unabhangige Bernoulli-verteilte

Zufallsvariablen mit Pr[P

Xi = 1] = pi

P

und Pr[Xi = 0] = 1 pi . Dann gilt fur X := ni=1 Xi und := E[X ] = ni=1 pi ,

sowie jedes > 0, dass

Pr[X (1 + )] DWT

c Susanne Albers und Ernst W. Mayr

e

(1 + )1+

6.3 Cherno-Schranken

:

165/462

Beweis:

Fur t > 0 gilt

Pr[X (1 + )] = Pr[etX et(1+) ] :

Mit der Markov-Ungleichung folgt

[etX ] :

Pr[X (1 + )] = Pr[etX et(1+) ] Et(1+

)

e

Wegen der Unabhangigkeit der Zufallsvariablen X1 ; : : : ; Xn gilt

"

E[etX ] = E

exp

n

X

i=1

Weiter ist fur i 2 f1; : : : ; ng:

E[etXi ] = et1 pi + et0 (1

DWT

c Susanne Albers und Ernst W. Mayr

!#

tXi

"

=E

n

Y

i=1

#

etXi

=

n

Y

i=1

E[etXi ]:

pi ) = et pi + 1 pi = 1 + pi (et 1) ;

166/462

Beweis (Forts.):

und damit

Pr[X (1 + )] =

Qn

t

i=1 (1 + pi (e

et(1+)

Qn

t

i=1 exp(pi (e

et(1+)

Pn

exp( i=1 pi (et

et(1+)

1))

1))

1)) = e(et

1)

et(1+)

=: f (t) :

Wir wahlen nun t so, dass f (t) minimiert wird, namlich

t = ln(1 + ) :

Damit wird

DWT

c Susanne Albers und Ernst W. Mayr

e(et 1)

e

f (t) = t(1+) =

:

e

(1 + )(1+)

6.3 Cherno-Schranken

166/462

Beispiel 65

Wir betrachten wieder das Beispiel, dass wir eine faire Munze n-mal werfen und

abschatzen wollen, mit welcher Wahrscheinlichkeit Kopf\

"

n

2 (1 + 10%)

oder ofter fallt.

n

1000

10000

n

DWT

c Susanne Albers und Ernst W. Mayr

Chebyshev

0;1

0;01

1

4

n

(0;1 12 n)2

Cherno

0;0889

0;308 10

e0;1

(1+0;1)1+0;1

6.3 Cherno-Schranken

10

1n

2

167/462

Satz 66

Seien X1 ; : : : ; Xn unabhangige Bernoulli-verteilte

Zufallsvariablen mit Pr[P

Xi = 1] = pi

Pn

und Pr[Xi = 0] = 1 pi . Dann gilt fur X := i=1 Xi und := E[X ] = ni=1 pi ,

sowie jedes 0 < < 1, dass

e

Pr[X (1 )] (1 )1

:

Beweis:

Analog zum Beweis von Satz 64.

Bemerkung: Abschatzungen, wie sie in Satz 64 und Satz 66 angegeben sind, nennt

man auch tail bounds, da sie Schranken fur die tails, also die vom Erwartungswert weit

entfernten Bereiche angeben. Man spricht hierbei vom upper tail (vergleiche Satz 64)

und vom lower tail (vergleiche Satz 66).

Die Cherno-Schranken hangen exponentiell von ab!

DWT

c Susanne Albers und Ernst W. Mayr

6.3 Cherno-Schranken

168/462

Lemma 67

Fur 0 < 1 gilt

(1 )1 e

+2 =2

und

(1 + )1+ e+ =3 :

Beweis:

Wir betrachten

2

1

2

f (x) = (1 x) ln(1 x) und g(x) = x + x2 :

Es gilt fur 0 x < 1:

sowie

g0 (x) = x 1 ln(1 x) 1 = f 0 (x)

f (0) = 0 = g(0) ;

also im angegebenen Intervall f (x) g (x).

Die Herleitung der zweiten Ungleichung erfolgt analog.

DWT

c Susanne Albers und Ernst W. Mayr

6.3 Cherno-Schranken

169/462

Korollar 68

Seien X1 ; : : : ; Xn unabhangige Bernoulli-verteilte Zufallsvariablen mit Pr[P

Xi = 1] = pi

und Pr[Xi = P

0] = 1 pi . Dann gelten folgende Ungleichungen fur X := ni=1 Xi und

:= E[X ] = ni=1 pi :

2

1 Pr[X (1 + )] e =3

fur alle 0 < 1,

2

2 Pr[X (1

)] e =2 fur alle 0 < 1,

3

4

5

Pr[jX j ] 2e =3 fur alle 0 < 1,

(1+)

Pr[X (1 + )] 1+e und

Pr[X t] 2 t fur t 2e.

DWT

c Susanne Albers und Ernst W. Mayr

2

6.3 Cherno-Schranken

170/462

Beweis:

1 und 2 folgen direkt aus Satz 64 bzw. 66 und Lemma 67.

Aus 1 und 2 zusammen folgt 3.

Die Abschatzung 4 erhalten wir direkt aus Satz 64, da fur den Zahler gilt

e e(1+) :

5 folgt aus 4, indem man t = (1 + ) setzt, t 2e:

e

1+

DWT

c Susanne Albers und Ernst W. Mayr

(1+)

e

t=

t

6.3 Cherno-Schranken

t

12 :

171/462

Beispiel 69

Wir betrachten wieder balls into bins und werfen n Balle unabhangig und gleichverteilt

in n Korbe. Sei

Xi := Anzahl der Balle im i-ten Korb

fur i = 1; : : : ; n, sowie X := max1in Xi .

Fur die Analyse von Xi (i 2 f1; : : : ; ng beliebig) verwenden wir Aussage 5 von

Korollar 68, mit p1 = : : : = pn = n1 , = 1 und t = 2 log n. Es folgt

Pr[Xi 2 log n] 1=n2 :

Daraus ergibt sich

Pr[

X

2 log

n] = Pr[X1 2 log n _ : : : _ Xn 2 log n] n 2

n

1

Es gilt also mit Wahrscheinlichkeit 1

DWT

c Susanne Albers und Ernst W. Mayr

=

1

n

:

1=n, dass X < 2 log n ist.

6.3 Cherno-Schranken

172/462

Literatur:

Torben Hagerup, Christine Rub:

A guided tour of Cherno bounds

Inf. Process. Lett. 33, pp. 305{308 (1990)

DWT

c Susanne Albers und Ernst W. Mayr

6.3 Cherno-Schranken

173/462

7. Erzeugende Funktionen

7.1 Einfuhrung

Denition 70

Fur eine Zufallsvariable X mit WX

Funktion deniert durch

GX (s) :=

N0 ist die (wahrscheinlichkeits-)erzeugende

1

X

k=0

Pr[X = k] sk = E[sX ] :

Die obige Denition gilt fur allgemeine s 2 R, wir werden uns aber auf s 2 [

konzentrieren.

1; 1]

Eine wahrscheinlichkeitserzeugende Funktion ist also die (gewohnliche) erzeugende

Funktion der Folge (fi )i2N0 mit fi := Pr[X = i].

DWT

c Susanne Albers und Ernst W. Mayr

7.1 Einfuhrung

174/462

Bei wahrscheinlichkeitserzeugenden Funktionen haben wir kein Problem mit der

Konvergenz, da fur jsj < 1 gilt

jGX (s)j =

DWT

c Susanne Albers und Ernst W. Mayr

1

X

Pr[X

k=0

1

X

k=0

= k] sk Pr[X = k] jsk j 7.1 Einfuhrung

1

X

k=0

Pr[X = k] = 1 :

175/462

Beobachtung:

Sei Y := X + t mit t 2 N0 . Dann gilt

GY (s) = E[sY ] = E[sX +t ] = E[st sX ] = st E[sX ] = st GX (s) :

Ebenso lasst sich leicht nachrechnen, dass

1

X

0

GX (s) = k Pr[X = k] sk 1 , also

k=1

0

GX (0) = Pr[X = 1], sowie

G(i) (0) = Pr[X = i] i!, also

X

G(i) (0)=i! = Pr[X

X

DWT

c Susanne Albers und Ernst W. Mayr

= i] :

7.1 Einfuhrung

176/462

Satz 71 (Eindeutigkeit der w.e. Funktion)

Die Dichte und die Verteilung einer Zufallsvariablen X mit WX

wahrscheinlichkeitserzeugende Funktion eindeutig bestimmt.

N sind durch ihre

Beweis:

Folgt aus der Eindeutigkeit der Potenzreihendarstellung.

DWT

c Susanne Albers und Ernst W. Mayr

7.1 Einfuhrung

177/462

Bernoulli-Verteilung

Sei X eine Bernoulli-verteilte Zufallsvariable mit Pr[X = 0] = 1 p und

Pr[X = 1] = p. Dann gilt

GX (s) = E[sX ] = (1 p) s0 + p s1 = 1 p + ps :

Gleichverteilung auf f0; : : : ; ng

Sei X auf f0; : : : ; ng gleichverteilt, d.h. fur 0 k n ist Pr[X = k] = 1=(n + 1).

Dann gilt

GX (s) = E[sX ] =

DWT

c Susanne Albers und Ernst W. Mayr

n

X

1 sk = sn+1 1 :

n+1

(n + 1)(s 1)

k=0

7.1 Einfuhrung

178/462

Binomialverteilung

Fur X Bin(n; p) gilt nach der binomischen Formel

GX

(s) = E[sX ] =

n

X

n k

p (1 p)n

k

k=0

k sk

= (1 p + ps)n :

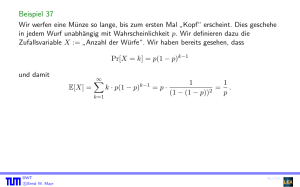

Geometrische Verteilung

Sei X eine geometrisch verteilte Zufallsvariable mit Erfolgswahrscheinlichkeit p. Dann

gilt

GX (s) = E[sX ] =

1

X

k=1

= ps DWT

c Susanne Albers und Ernst W. Mayr

p(1 p)k 1 sk

1

X

((1 p)s)k 1 = 1 (1ps p)s :

k=1

7.1 Einfuhrung

179/462

Poisson-Verteilung

Fur X Po() gilt

GX

(s) = E[sX ] =

DWT

c Susanne Albers und Ernst W. Mayr

1

X

k=0

e

k

k!

sk = e

7.1 Einfuhrung

+s

= e(s 1) :

180/462

Beispiel 72

Sei X binomialverteilt mit X

GX (s) = 1

Bin(n; =n), Fur n ! 1 folgt

s

+

n n

n

= 1 + (sn 1)

n

! e(s 1) :

Man kann beweisen, dass aus der Konvergenz der wahrscheinlichkeitserzeugenden

Funktion die Konvergenz der Verteilung folgt.

DWT

c Susanne Albers und Ernst W. Mayr

7.1 Einfuhrung

181/462

7.1.1 Zusammenhang zwischen der w.e. Funktion und den Momenten

Da

gilt

GX (s) :=

1

X

k=0

Pr[X = k] sk = E[sX ] ;

1

X

0

GX (1) = k Pr[X = k] = E[X ] :

k=1

DWT

c Susanne Albers und Ernst W. Mayr

7.1 Einfuhrung

182/462

Beispiel 73

Sei X binomialverteilt mit X

Bin(n; p), also

GX (s) = (1 p + ps)n :

Dann gilt

G0X (s) = n (1 p + ps)n 1 p

und somit

E[X ] = G0X (1) = np :

DWT

c Susanne Albers und Ernst W. Mayr

183/462

Beispiel 73

Ebenso ergibt sich

E[X (X 1) : : : (X k + 1)] = G(Xk) (1) ;

also etwa

Var[X ] = E[X (X 1)] + E[X ] E[X ]2

= G00X (1) + G0X (1) (G0X (1))2 :

Andere Momente von X kann man auf ahnliche Art und Weise berechnen.

DWT

c Susanne Albers und Ernst W. Mayr

7.1 Einfuhrung

183/462

Momenterzeugende Funktionen

Denition 74

Zu einer Zufallsvariablen X ist die momenterzeugende Funktion gema

MX (s) := E[eXs ]

deniert.

Es gilt

MX

und

(s) = E[eXs ] = E

"

1

X

#

1 E[X i ]

(Xs)i = X

si

i

!

i

!

i=0

i=0

MX (s) = E[eXs ] = E[(es )X ] = GX (es ) :

DWT

c Susanne Albers und Ernst W. Mayr

7.1 Einfuhrung

184/462

7.2 Summen von Zufallsvariablen

Satz 75 (Erzeugende Funktion einer Summe)

Fur unabhangige Zufallsvariablen X1 ; : : : ; Xn und die Zufallsvariable

Z := X1 + : : : + Xn gilt

GZ (s) = GX1 (s) : : : GXn (s) :

Ebenso gilt

MZ (s) = MX1 (s) : : : MXn (s) :

Beweis:

Wegen der Unabhangigkeit von X1 ; : : : ; Xn gilt

GZ (s) = E[sX1 +:::+Xn ] = E[sX1 ] : : : E[sXn ] = GX1 (s) : : : GXn (s):

DWT

c Susanne Albers und Ernst W. Mayr

7.2 Summen von Zufallsvariablen

185/462

Beispiel 76

Seien X1 ; : : : Xk mit Xi Bin(ni ; p) unabhangige Zufallsvariable und

Z := X1 + : : : + Xk . Dann gilt

GZ (s) =

und somit

k

Y

i=1

(1 p + ps)ni = (1 p + ps)

Z Bin(

k

X

i=1

Pk

i=1 ni

ni ; p)

(vgl. Satz 56).

Seien X1 ; : : : ; Xk Po() unabhangige Zufallsvariablen. Dann folgt fur

Z := X1 + : : : + Xk

k

Y

GZ (s) = e(s 1) = ek(s 1)

i=1

und somit Z Po(k) (vgl. Satz 59).

DWT

c Susanne Albers und Ernst W. Mayr

7.2 Summen von Zufallsvariablen

186/462

7.2.1 Zufallige Summen

Wir betrachten die Situation, dass Z := X1 + : : : + XN , wobei N ebenfalls eine

Zufallsvariable ist.

Satz 77

Seien X1 ; X2 ; : : : unabhangige und identisch verteilte Zufallsvariablen mit der

wahrscheinlichkeitserzeugenden Funktion GX (s). N sei ebenfalls eine unabhangige

Zufallsvariable mit der wahrscheinlichkeitserzeugenden Funktion GN (s). Dann besitzt

die Zufallsvariable Z := X1 + : : : + XN die wahrscheinlichkeitserzeugende

Funktion GZ (s) = GN (GX (s)).

DWT

c Susanne Albers und Ernst W. Mayr

7.2 Summen von Zufallsvariablen

187/462

Beweis:

Nach Voraussetzung ist WN

N0. Deshalb folgt mit Satz 36

GZ (s) =

=

=

=

1

X

n=0

1

X

n=0

1

X

n=0

1

X

n=0

E[sZ j N = n] Pr[N = n]

E[sX +:::+Xn ] Pr[N = n]

1

E[sX ] : : : E[sXn ] Pr[N = n]

1

(GX (s))n Pr[N = n]

= E[(GX (s))N ]

= GN (GX (s)) :

DWT

c Susanne Albers und Ernst W. Mayr

7.2 Summen von Zufallsvariablen

188/462

8. Formelsammlung

8.1 Gesetze zum Rechnen mit Ereignissen

Im Folgenden seien A und B , sowie A1 ; : : : ; An Ereignisse. Die Notation A ] B steht

fur A [ B und zugleich A \ B = ; (disjunkte Vereinigung). A1 ] : : : ] An = bedeutet

also, dass die Ereignisse A1 ; : : : ; An eine Partition der Ergebnismenge bilden.

Pr[;] = 0

0 Pr[A] 1

Pr[A] = 1 Pr[A]

A B =) Pr[A] Pr[B ]

DWT

c Susanne Albers und Ernst W. Mayr

8.1 Gesetze zum Rechnen mit Ereignissen

189/462

8i 6=Sj : Ai \ APj = ; =)

Pr [

n A]=

i=1 i

Additionssatz

n Pr[A ]

i

i=1

Pr[A [ B ] = Pr[A] + Pr[B ] Pr[A \ B ] Inklusion/Exklusion,

allgemeine Form: siehe Satz 9

Sn

Pr [

i=1 Ai ] Boolesche

Ungleichung

Pn

i=1 Pr[Ai ]

Pr[AjB ] = Pr[Pr[AB\B] ] fur Pr[B ] > 0

DWT

c Susanne Albers und Ernst W. Mayr

Siebformel

Def. bedingte Ws.

8.1 Gesetze zum Rechnen mit Ereignissen

190/462

B A1 ]P: : : ] An =)

Pr[B ] = ni=1 Pr[B jAi ] Pr[Ai ]

Satz von der totalen

Wahrscheinlichkeit

Pr[B ] > 0, B A1 ] : : : ] An =)

B jAi ]Pr[Ai ]

Pr[Ai jB ] = PniPr[Pr[

B jAi ]Pr[Ai ]

Satz von Bayes

=1

Pr[A1 \ : : : \ An ] = Pr[A1 ] Pr[A2 jA1 ] Multiplikationssatz

: : : Pr[An jA1 \ : : : \ An 1 ]

A und B unabhangig

()

Pr[A \ B ] = Pr[A] Pr[B ]

DWT

c Susanne Albers und Ernst W. Mayr

Denition

Unabhangigkeit

8.1 Gesetze zum Rechnen mit Ereignissen

191/462

8.2 Erwartungswert und Varianz diskreter Zufallsvariablen

Sei X eine diskrete Zufallsvariable. Fur Erwartungswert und Varianz gelten die folgenden

Formeln (sofern E[X ] und Var[X ] existieren).

E[X ] =

=

Var[X ]

=

X

x 2W X

X

! 2

1

X

i=1

x Pr[X = x]

X (!) Pr[!]

Pr[X i]; falls WX N0

Erwartungswert

= E[(X E[X ])2 ]

= x2WX Pr[X = x] (x E[X ])2

P

DWT

c Susanne Albers und Ernst W. Mayr

Varianz

8.2 Erwartungswert und Varianz diskreter Zufallsvariablen

192/462

8.3 Gesetze zum Rechnen mit Zufallsvariablen

Seien a, b, a1 , . . . , an 2 R, f1 ; : : : ; fn : R ! R.

X1 ; : : : ; Xn unabhangig

()

fur alle (a1 ; : : : ; an ):

Pr[X1 = a1 ; : : : ; Xn = an ]

= Pr[X1 = a1 ] : : : Pr[Xn = an ]

X1 ; : : : ; Xn unabhangig =) f1 (X1 ); : : : ; fn (Xn ) unabhangig

E[a X + b] = a E[X ] + b

DWT

c Susanne Albers und Ernst W. Mayr

8.3 Gesetze zum Rechnen mit Zufallsvariablen

193/462

X (!) Y (!) fur alle ! 2 =)

E[X ] E[Y ]

E[X ] =

Monotonie des

Erwartungswerts

Pn

i=1 E[X jAi ] Pr[Ai ]

Var[X ] = E[X 2 ] E[X ]2

Var[a X + b] = a2 Var[X ]

DWT

c Susanne Albers und Ernst W. Mayr

8.3 Gesetze zum Rechnen mit Zufallsvariablen

194/462

E[a1 X1 + : : : + an Xn ]

= a1 E[X1 ] + : : : + an E[Xn ]

Linearitat des

Erwartungswerts

X1 ; : : : ; Xn unabhangig =)

E[X1 : : : Xn ] = E[X1 ] : : : E[Xn ]

Multiplikativitat des

Erwartungswerts

X1 ; : : : ; Xn unabhangig =)

Var[X1 + : : : + Xn ] = Var[X1 ] + : : : + Varianz

einer Summe

Var[Xn ]

DWT

c Susanne Albers und Ernst W. Mayr

8.3 Gesetze zum Rechnen mit Zufallsvariablen

195/462

X 0 =)

Pr[X t] E[X ]=t fur t > 0

Markov

Pr[jX E[X ]j t]

Var[X ]=t2 fur t > 0

Chebyshev

siehe Satz 63

Gesetz der

groen Zahlen

DWT

c Susanne Albers und Ernst W. Mayr

8.3 Gesetze zum Rechnen mit Zufallsvariablen

196/462