Identifikation bei Rekursiven vs

Werbung

Nagl, Modelle mit latenten Variablen, Identifikation von nichtrekursiven und rekursiven Systemen

Seite 1

Identifikation bei rekursiven und nichtrekursiven Gleichungssystemen

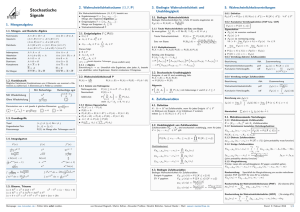

Bei folgenden Überlegungen wird vorausgesetzt, dass die Varianzen und Kovarianzen der latenten Variablen

bereits eindeutig berechnet werden konnten. Nun soll in einem zweiten Schritt die Identifikation der Strukturgleichungen untersucht werden.

Die Identifikation der Gleichungssysteme bedeutet wiederum: Auf Grund der Varianzen und Kovarianzen der

Variablen sollen die Parameter des Modells (d.h. , und ) eindeutig bestimmt werden können. Dabei werden zwei ‚Idealtypen’ von Gleichungssystemen unterschieden, das ‚rekursive’ und ‚nicht-rekursive’. Das rekursive System hat dabei einen sehr einfachen Aufbau der Abhängigkeiten (im Gegensatz zum nicht-rekursiven).

Rekursive Gleichungs-Systeme

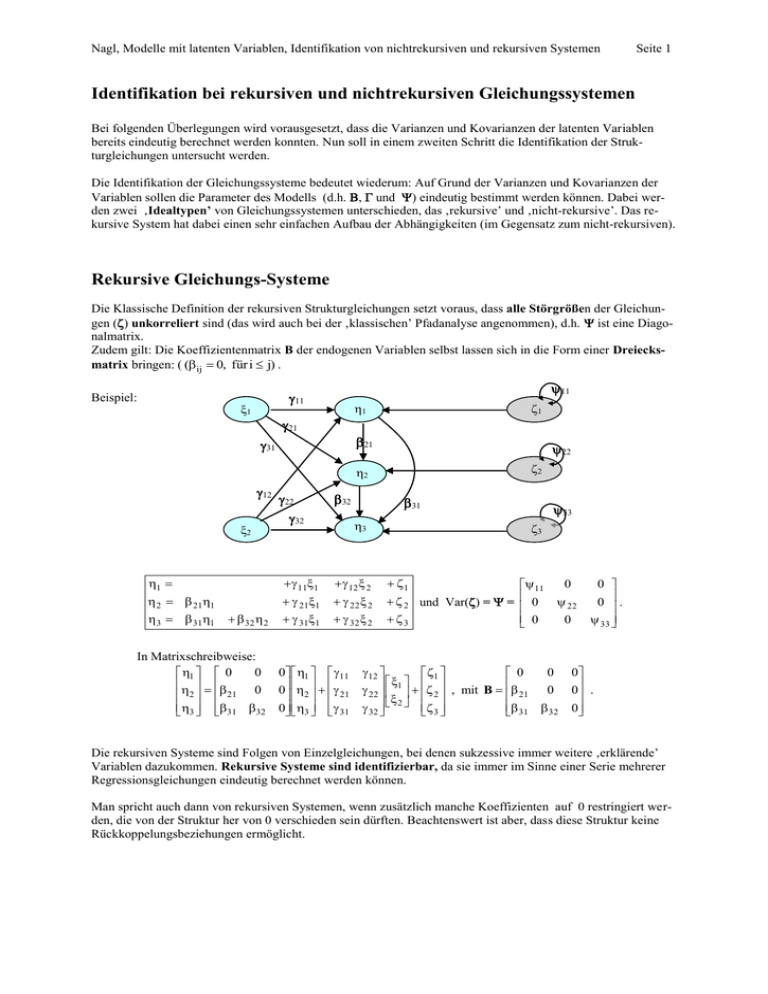

Die Klassische Definition der rekursiven Strukturgleichungen setzt voraus, dass alle Störgrößen der Gleichungen () unkorreliert sind (das wird auch bei der ‚klassischen’ Pfadanalyse angenommen), d.h. ist eine Diagonalmatrix.

Zudem gilt: Die Koeffizientenmatrix B der endogenen Variablen selbst lassen sich in die Form einer Dreiecksmatrix bringen: ( ( ij 0, für i j) .

Beispiel:

11

11

1

1

1

21

1

21

31

22

2

2

12

2

1

22

32

32

31

3

33

3

1

1

2 211

3 311

32 2

In Matrixschreibweise:

0

1 0

2 21 0

3 31 32

111

211

12 2

22 2

311

32 2

1

2 und Var() = =

3

0

11

0

22

0

0

0 1 11 12

0

1

0

0 2 21 22 1 2 , mit B 21 0

31 32

0 3 31 32 2 3

0

0 .

33

0

0 .

0

Die rekursiven Systeme sind Folgen von Einzelgleichungen, bei denen sukzessive immer weitere ‚erklärende’

Variablen dazukommen. Rekursive Systeme sind identifizierbar, da sie immer im Sinne einer Serie mehrerer

Regressionsgleichungen eindeutig berechnet werden können.

Man spricht auch dann von rekursiven Systemen, wenn zusätzlich manche Koeffizienten auf 0 restringiert werden, die von der Struktur her von 0 verschieden sein dürften. Beachtenswert ist aber, dass diese Struktur keine

Rückkoppelungsbeziehungen ermöglicht.

Nagl, Modelle mit latenten Variablen, Identifikation von nichtrekursiven und rekursiven Systemen

Seite 2

Nichtrekursive Gleichungssysteme

Beispiele:

1

1

11

22

1

1

1

1

12

1

21

12

1

12

2

11

21

12

2

2

1

2

23

32

2

1

2

32

3

13

3

1

Die Störgrößen dürfen hier korrelieren: für keine Korrelation wird eine Restriktion auf 0 vorausgesetzt. Zudem

können die Effekte eventuell ‚Rückkoppelungen’ enthalten. Das ist gegenüber rein rekursiven Systemen eine

erhebliche Erweiterung. Diese Erweiterung erfordert allerdings zusätzliche Forderungen an die Modellparameter.

m

Allgemeine Charakterisierung:

m

Strukturform der Gleichungen: = + +

Reduzierte Form der Gleichungen:

= + e,

=

n

+

(I -) = +

= A-1 + A-1,

+

mit A := I -.

mit: := A-1 und e := A-1.

Die reduzierte Form mit den Regressionskoeffizienten ist immer eindeutig lösbar. Die Störgrößen e seien

multivariat (normal-)verteilt; die Varianz-Kovarianz-Matrix der der Störgrößen (=e) ist nicht restringiert (die

reduzierte Form entspricht einer multiplen multivariaten Regression, die -Koeffizienten sind die eindeutig

berechenbaren Regressionskoeffizienten).

Die Koeffizientenmatrix ist aber nur als Zwischenergebnis interessant. Aus dieser Matrix sollen in einem zweiten Schritt die beiden Matrizen und errechnet werden. Das ist nur dann möglich, wenn einige Restriktionen

eingeführt werden.

OBdA soll die Lösung für die 1. Gleichung betrachtet werden.

Die Elemente der Gleichungen werden so umgruppiert, dass alle endogenen Variablen, die nicht in der 1. Gleichung vorkommen als erste geschrieben werden (daher sind die entsprechenden Koeffizienten 0). Auch die exogenen Variablen werden so umgruppiert, dass die nicht in der 1. Gleichung vorkommenden exogenen Variablen

als erste stehen (daher sind die entsprechenden Koeffizienten 0).

m

n

n

0

n1

m0 m1

Allgemein: (I -) = + bzw. A = +

mit A:= (I -).

0’

0’ ’

’

m

A0

A1

m0: Anzahl der endogenen Variablen, die nicht in der 1. Gleichung vorkommen.

m1: Anzahl der endogenen Variablen, die in der 1. Gleichung vorkommen.

n0: Anzahl der exogenen Variablen, die nicht in der 1. Gleichung vorkommen.

=

0 1

+

Nagl, Modelle mit latenten Variablen, Identifikation von nichtrekursiven und rekursiven Systemen

m

Mit dieser Bezeichnung gilt: := A-1.

bzw. A :=

entsprechend strukturiert:

Seite 3

n

m0

m1

0’

’

A0

A1

m

m1

n

n0

n1

*

*

0 1

’ 0 =

’ 1 =

daraus folgen die beiden Gleichungen:

=

n0

n1

0’

’

0

1

0’

’

Die Gleichungen können genau dann eindeutig gelöst werden (d.h. und eindeutig berechnet werden), wenn

der Rang von 0 gleich m1-1 ist (eine nur notwendige Bedingung der Identifikation ist: n0 >= (m1-1)).

Denn: OBdA kann vorausgesetzt werden, dass 1=1 ist (Wegen der Struktur von A=(I-B)), d.h.

α 1 α 0

So kann 0 als aus 2 Teilen bestehend gesehen werden (als 1. Zeile: ’ und als restliche m1-1 Zeilen 00:

π

Π0

). Die Gleichungen ’ 0 = 0’ lauten nun: π α 0 Π 00 0 bzw. α0 Π 00 π .

Π

00

α 0 Π 00 π ist ein inhomogenes System von m1-1 Gleichungen in den m1-1 unbekannten: 0. Das inhomogene Gleichungssystem kann genau dann eindeutig gelöst werden, wenn der Rang von 00 gleich (m1-1) ist.

Zudem hat 0 ebenfalls den Rang (m1-1), da die erste Zeile ja eine Linearkombination aus den restlichen Zeilen

ist. Das setzt voraus, dass n0 >= (m1-1) ist. Ist bekannt, kann mit der Gleichung ’ 1 = ’ berechnet werden. Qed.

Bedingung für die strukturelle Form (Ökonometrie-Identifikationssatz):

Eine notwendige und hinreichende Bedingung für die Identifikation der 1. Gleichung ist, dass der Rang der zusammengesetzten Matrix: A0, 0 (= Rang(A0, 0)) gleich m -1 ist.

m0

0’

Beweis:

m

n0

m0

0’

A-1

=

A0

0

n0

m0

I

*

m1

0

0

Der Rang der Matrix (A0, 0) = m0 + Rang(0). Laut Identifikationsbedingung für die reduzierte Form ist der

Rang(0) = (m1- 1). Daher ist der Rang von (A0, 0) = m0 + (m1- 1) = m-1. qed.

n

n0

Überlegungen zur Definition der Teilmatrizen:

Zum rechten Teil (Spalten mit 0):

*

A

Das Produkt A = wurde bereits oben formuliert (hier ohne die Strukturierung von A):

n

n0

n1

*

m1 0 1

0’

n1

’

0

1

=

n

n0

Danach mit der Inversen A-1 von links multiplizieren; Ablesen der Teile liefert die Gleichheit der

Teile für 0 mit Hilfe von 0 , wie oben formuliert.

.

*

n

n0

n1

*

m1 0 1

=

0’

n1

’

0

1

A-1

Nagl, Modelle mit latenten Variablen, Identifikation von nichtrekursiven und rekursiven Systemen

Zum linken Teil (Spalten mit I und 0):

Seite 4

m

Die Matrix A wurde ebenfalls partitioniert. Mit

der Inversen vormultipliziert ergibt als Produkt

die Einheitsmatrix, die aber entsprechend A

partitioniert werden kann. Das veranschaulicht

die Darstellung im linken Teil der Matrix.

.

A-1

m0

m1

0’

’

I

0

0

I

=

m

A0

A1

Beispiel (Identifikation der Parameter in simultanem Gleichungssystem mit 3 endogenen Variablen):

11

1

1

1

1

12

12

21

12

2

2

1

32

32

2

13

23

3

3

1

Als einzelne Gleichungen geschrieben:

1 12 2

2 211

111

3 32 2

32 2

1

211

12 2

2

32 2

1

2

1

12 2

oder 2 211

3

32 2

3

111

3

In Matrixschreibweise:

12 0 1 11

1

1

0 2 0

21

0

32 1 3 0

32 2

111

1

2

32 2

oder

3

1

2 .

3

1

12 0

1

11 0

1 mit A

1

0 und Γ 0

0 .

2

21

0

2

32 1

3

32

0 32

0

0

Zur Identifikation der 1. Gleichung: In der A-Matrix werden die Spalten gesucht, die in der 1. Zeile eine Null

Null

Null

0

0

haben: 0 . Daher ist A 0 . In der -Matrix ebenfalls: 0 . Daher ist Γ 0 . Die Matrix

1

32

1

32

A 0 , Γ 0

0 0

. Sie hat aber nur einen Rang von 1. Daher ist die erste Gleichung nicht identifiziert.

1 32

Zur Identifikation der 2. Gleichung: In der A-Matrix werden die Spalten gesucht, die in der 2. Zeile eine Null

0

0

11

0

11 0

haben: Null . Daher ist A 0 . In der -Matrix ebenfalls: Null Null . Daher ist Γ 0

.

1

0 32

32

1

0

Nagl, Modelle mit latenten Variablen, Identifikation von nichtrekursiven und rekursiven Systemen

0 11

Die Matrix A 0 , Γ 0

1 0

Gleichung identifiziert.

Seite 5

0

. Sie hat einen Rang von 2, falls 11 nicht 0 ist. Daher ist die zweite

32

Zur Identifikation der 3. Gleichung: In der A-Matrix werden die Spalten gesucht, die in der 3. Zeile eine Null

1

11

1

haben: 21 . Daher ist. A 0

und entsprechend Γ 0 0 . Der Rang von

21

Null

A 0 , Γ 0

1

21

11

ist gleich 2. Daher ist die 3. Gleichung identifiziert.

0

Beispiel: (Identifikation der Parameter in simultanem Gleichungssystem mit2 endogenen Variablen):

1

11

1

12

12

2

1

1

21

22

12

2

2

1

Die Anzahl der endogenen Variablen = Anzahl der Gleichungen = m = 2.

Als einzelne Gleichungen geschrieben:

1

2

12 2

211

111

22 2

1

2

oder

1

211

12 2

2

111

22 2

1

2

In Matrixschreibweise:

12 1 11

1

1 2 0

21

0 1 1

1

mit A

22 2 2

21

12

und Γ 11

1

0

0

.

22

Zur Identifikation der 1. Gleichung: In der A-Matrix werden die Spalten gesucht, die in der 1. Zeile eine Null

haben; solche Spalten gibt es hier nicht. In der -Matrix werden ebenfalls die Spalten gesucht, die in der 1. Zeile

Null

eine Null haben:

. Daher ist Γ 0 22 . Die Matrix A 0 , Γ 0 22 .

22

Diese Matrix hat aber einen Rang von 1 (falls 22 ≠ 0); das ist m - 1 = 1. Daher ist die erste Gleichung identifiziert.

Zur Identifikation der 2. Gleichung: In der A-Matrix werden die Spalten gesucht, die in der 2. Zeile eine 0 haben. Daher ist A 0 wiederum leer.

11

Nun werden in der -Matrix die Null-Position in der 2. Zeile gesucht:

. Daher ist Γ 0 11 . Die

Null

Matrix A 0 , Γ 0 11 . Sie hat einen Rang von 1, falls 11 nicht 0 ist. Daher ist auch die zweite Gleichung

identifiziert.

Nagl, Modelle mit latenten Variablen, Identifikation von nichtrekursiven und rekursiven Systemen

Seite 6

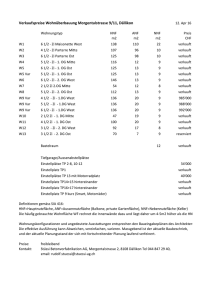

1 0.5 0.25

1 0.8 0

2 0

10 5

0.6 1 0 , Γ 0 0 .

Beispiel-Anhang: Sei = 0.5 1 0.5 , Φ

,

A

(

I

B

)

0.25 0.5 1

0

0 1

5 10

0.7 1

10

1

1

2

1

1

1

0.8

0.6

1 0.5

0

2

2

5

0.25

1

-0.7

10

2

1

0.5

1

3

3

1

Auf Grund der Gleichung für = A-1 + A-1 können die Varianzen und Kovarianzen nach den folgenden

Formeln berechnet werden:

Φ

ξ

ΦΓ A 1

Var( ) = 1

, mit Var()= und A:= I-B.

1

1

A ΓΦ A (ΓΦΓ Φ) A

η

PROC IML;

psi={1 0.5 0.25, 0.5 1 0.5, 0.25 0.5 1};

phi={10 5,5 10};A={1 -0.8 0, -0.6 1 0, 0 0.7 1}; gamma={2 0,0 0,0 1};

vareta=A**(-1)*(gamma*phi*gamma`+psi)*(A**(-1))`;

covxieta=phi*gamma`*(a**(-1))`;

covxy=(phi||covxieta)//(covxieta`||vareta);

print covxy;

quit;

Das Ergebnis der der Varianzen bzw. Kovarianzen ist:

xi1

xi2

eta1

eta2

eta3

xi1

10.000

5.000

38.462

23.077

-11.154

xi2

5.000

10.000

19.231

11.538

1.923

eta1

38.462

19.231

156.953

96.672

-47.189

eta2

23.077

11.538

96.672

60.503

-29.564

eta3

-11.154

1.923

-47.189

-29.564

22.743

Mit Hilfe eines Programms (CALIS) wurden auf Grund der Varianzen und Kovarianzen nun die Parameter geschätzt. Frage: Welche Schätzer entsprechen den vorgegebenen Parametern, welche nicht?

data cmat(type=cov);_type_='cov';input _name_ $

cards;

xi1

10

5 38.461538 23.076923

xi2

5

10 19.230769 11.538462

eta1

38.461538 19.230769 156.95266 96.671598

eta2

23.076923 11.538462 96.671598 60.502959

eta3

-11.15385 1.9230769 -47.18935 -29.56361

;

proc calis cov data=cmat omethod=nr edf=100 se;

title3 "Model-Beispiel, Startwerte 1";

lineqs

eta1= b12 (0.8) eta2+ g11 (2) xi1 +

eta2= b21 (0.7) eta1

+

eta3= b32 (0.9) eta2 + g32 xi2

+

std

cov

e1-e3=psi1-psi3 (3 * 1);

e1 e2=psi12 (.2),

e1 e3=psi13 (.2 ),

e2 e3=psi23 (.2 )

; run;

xi1 xi2 eta1 eta2 eta3;

-11.15385

1.9230769

-47.18935

-29.56361

22.74260

e1,

e2,

e3;

Nagl, Modelle mit latenten Variablen, Identifikation von nichtrekursiven und rekursiven Systemen

eta1

=

Std Err

eta2

=

Std Err

eta3

=

Std Err

1.0181*eta2

0.0148 b12

0.6000*eta1

0.00822 b21

-0.7000*eta2

0.0153 b32

+

1.4966*xi1

0.0358 g11

+

1.0000*xi2

0.0316 g32

+

1.0000 e1

+

1.0000 e2

+

1.0000 e3

Variances and Covariances of Exogenous Variables

Variable Parameter

Schätzwerte

xi1

phi11

10.00000

xi2

phi12 phi22

5

10.00000

e1

e2

e3

psi1

psi12

psi13

psi2

psi23

0.42203

-0.04532

-0.02266

psi3

1.00000

0.50000 1.00000

Anpassungs-chi**2 = 0 (optimal!)

Hier mit anderen Startwerten:

proc calis cov data=cmat omethod=nr edf=100 se;

title3 "Model-Beispiel, Startwerte 2";

lineqs

eta1= b12 (0.2) eta2 + g11 (2) xi1 + e1,

eta2= b21 (0.7) eta1

+ e2,

eta3= b32 (0.9) eta2 + g32 xi2

+ e3;

std

cov

e1-e3=psi1-psi3 (3 * 3.);

e1 e2=psi12 (.2),

e1 e3=psi13 (.3 ),

e2 e3=psi23 (.5 )

; run;

eta1

= -2.1722*eta2

Std Err

0.2320 b12

eta2

=

0.6000*eta1

Std Err

0.00822 b21

eta3

= -0.7000*eta2

Std Err

0.0153 b32

+

+

8.8589*xi1

0.6036 g11

1.0000*xi2

0.0316 g32

Varianzen und Kovarianzen:

Variable Parameter

x1

phi11

x2

phi12 phi22

e1

e2

e3

psi1

psi12

psi13

psi2

psi23

+

1.0000 e1

+

1.0000 e2

+

1.0000 e3

Schätzwerte

10.00000

5

10.00000

77.60790

7.93050

3.96529

psi3

1.00000

0.50000 1.00000

Anpassungs-chi**2 = 0 (optimal!)

10

1

8.86

77.6

1

1

1

-2.17

0.6

2

2

5

1 7.9

3.96

1

-0.7

10

2

1

3

0.5

1

3

1

Seite 7

Nagl, Modelle mit latenten Variablen, Identifikation von nichtrekursiven und rekursiven Systemen

Seite 8

Identifikation blockrekursiver Systeme

Das Konzept der ‚blockrekursiven Systeme’ wurde von STROTZ and WOLD (1960) eingeführt als Synthese zwischen rekursiven und nichtrekursiven Systemen.

Dabei werden endogene Variablen genau dann zu Gruppen (=Blöcke) zusammengefasst, wenn zwischen ihnen

nichtrekursive Beziehungen (Rückkoppelung oder Korrelation der Störgrößen) existieren.

Falls mehrere Blöcke (mit nichtrekursiven Beziehungen zwischen den Variablen) existieren, sind die Beziehungen zwischen den Blöcken rekursiv.

Da rekursive Systeme immer identifiziert sind, ist daher nur noch die Identifikation innerhalb der Blöcke zu

untersuchen. Sind alle Blöcke identifiziert, so ist das Gesamtsystem identifiziert.

Für die Identifikation der Gleichungen eines Blockes sind jeweils nur die innerhalb eines Blockes durch die

Gleichungen ‚determinierten’ Variablen als blockspezifisch endogen anzusehen (alle andern Variablen können

als blockspezifisch exogen betrachtet werden).

Beispiele: Die obigen Systeme können nicht in rekursive Blöcke unterteilt werden, weil die

Störgrößen kovariieren.

Bbr2

11

1

1

1

21 31

12

2

2

2

1

2

1

32

32

1

3

3

1

Block 2

Block 1

1

21

2

2

31

CRONIN UND TAYLOR (1992) haben

das (identifizierte) Dreigleichungsmodell geschätzt.

1

1

12

1

32

3

3

1

Block 2

Bbr3

Block 1

12 12

Da hier die Störgrößen nur teilweise kovariieren, kann das System in

zwei nichtrekursive Blöcke unterteilt werden, die selbst rekursiv

sind (Das Modell ist nicht identifiziert). Es ist mit den gestrichelten

Pfeilen bekannt geworden als

DUNCANs Modell (1975)

Bbr1

1

11

Das von RIGDON modifizierte Modell von ANDERSON J.G. (1978) ist identifizierbar

Block 1

11

1

12

23

1

1

12

2

23

3

22

1

1

51

4

31

43

3

12

2

2

Block 3

Block 2

32

3

1

33

4

52

54

45

1

5

5

1

45

Nagl, Modelle mit latenten Variablen, Identifikation von nichtrekursiven und rekursiven Systemen

Seite 9

Der Vorteil der Betrachtung blockrekursiver Systeme besteht darin, dass dadurch relativ komplexe Systeme in

einfachere zerlegt werden können. RIGDON E. (1995) hat für den Fall, dass die Blöcke nicht mehr als 2 blockendogene Variablen enthalten, sogar notwendige und hinreichende Bedingungen der Identifikation von strukturellen Gleichungssystemen eingeführt.

RIGDON’s vollständige Charakterisierung von Blöcken mit zwei blockendogenen Variablen.

Identifiziert

Nicht identifiziert

Fall 1

Fall 2

2

1

Fall 3

1

2

1

2

Fall 4

2

1

Fall 5

Fall 6

2

1

2

1

entweder

entweder

ODER

ODER

Fall 7

Fall 8 Neuklassifikation (gleiche Prädiktoren für Endogene V.)

2

1

1

2

BEIDE

In dieser schematischen Darstellung der Systeme wurden keine Symbole für die Störgrößen eingezeichnet. Konstrukte und Beziehungen, die

für die Identifikation irrelevant sind, wurden mit gestrichelten Linien gezeichnet.

Begründungen der Fälle.

Zu Fall 1.) ‚Null-B-Regel’: strukturelle Modelle, bei denen kein Beta-Effekt-Koeffizient vorhanden ist, sind

identifiziert.

Begründung: Die Gleichungssysteme (ohne eine exogene Variable) sind

1

2

1

. Als Bekannt vorausge 2

setzt werden darf die Matrix der Varianzen und Kovarianzen der Etas (Var(1), Cov(1,2), Var(2) ) ; gesucht

sind die Unbekannten Varianzen und Kovarianz zwischen den Störgrößen (11, 12, 22). Auf Grund der Berechnung der Varianz- Kovarianzmatrix der Variablen (ausgedrückt in Modellparametern) ergibt sich die folCov (1 , 2 ) 11 12

Var (1 )

gende Matrixgleichung:

, aus der alle Parameter des Modells beCov

(

,

)

Var (1 ) 12 22

1

2

rechnet werden können: (11, 12, 22).

Nagl, Modelle mit latenten Variablen, Identifikation von nichtrekursiven und rekursiven Systemen

Seite 10

Zu Fall 2.)

Die erste Begründung kann auf dem Ökonometrie-Identifikationssatz aufbauen. Die Gleichungen sind:

1

1

0

1

, in Matrixform: A

. Die erste Gleichung ist dabei identifiziert, die 2. aber

2 211 2

21 1

nicht (sie würde auch nicht identifiziert werden, wenn zusätzliche xi-Variablen als Prädiktoren für 2 hinzukämen).

Die zweite Begründung kann auf der Berechnung der Varianzen und Kovarianzen der eta’s aufbauen:

12 21 11

Var (1 ) Cov (1 , 2 ) 11

2 2 . Nun müssten die Parameter des Modells auf

Var

(

)

2

21 11

21 12

22

Grund dieser 3 Gleichungen (wegen der Symmetrie sind es nur 3 verschiedene Gleichungen) berechnet werden können. Da aber 4 Parameter (11, 12, 22 und 21) berechnet

werden sollten, ist keine eindeutige Lösung dieser Gleichungen möglich. Daher ist das

Modell nicht identifiziert.

1

1

1

12

2

1

21

2

1 12

Inwiefern könnte ein Effekt einer xi-Variable auf die Ziel-Variable 2 die Identifikationsmöglichkeiten verbessern? Eine zusätzliche Variable erhöht die Anzahl der Kovarianzen:

0

12 11

Var (1 ) Cov (1 , 1 ) Cov (1 , 2 ) 11

.

Var (1 )

Cov (1 , 2 ) 11

12 21 11

Var ( 2 )

221 11 2 21 12 22

Man sieht, dass die Hinzunahme einer xi-Variable keine Gleichungen liefert, die die ursprünglichen Parameter

identifizieren helfen. Durch die Hinzunahme können gerade die zusätzlichen Parameter (11, 12). Verantwortlich

dafür ist die Tatsache, dass die Kovarianz zwischen 1 und 1 gleich 0 ist; diese Gleichung liefer so keine zusätzlichen Informationen.

Zu Fall 3.)

Die erste Begründung kann auf dem Ökonometrie-Identifikationssatz aufbauen. Die Gleichungen sind:

1 111 1

0

11

1

, in Matrixform: A

und 0 . Die erste Glei 2 211 2

1

21

chung ist dabei identifiziert, die 2. ebenfalls, falls 11 nicht 0 ist.

1

1

1

12

2

1

21

11

2

1

Die direkte Untersuchung der Varianzen und Kovarianzen liefert 6 Gleichungen in 6 Unbekannten:

1111

21 1111

Var (1 ) Cov (1 , 1 ) Cov (1 , 2 ) 11

2

2

Var

(

)

Cov

(

,

)

(

)

1

1

2

11 11

11

21 11 11

11

12

2

Var ( 2 )

221 ( 11

11 11 ) 2 21 12 22

Die Lösungen für die Parameter auf Grund der Gleichungen sind:

11

12

Cov (1, 1 ) 2

Var (1 )

12

Var (1 )

22

Var (1 )Cov (1, 2 )

Cov (1, 2 )

Cov (1, 1 )

11 Var (1 ),

11

Cov (1, 1 )

,

Var (1 )

21

Var (1 )Cov (1, 2 )

Cov (1, 1 )

Cov (1, 2 ) 2 Var (1 ) 2Cov (1, 1 )Cov (1, 2 )Cov (2 , 1 )

Var (2 )

Cov (1, 1 ) 2

Cov (1, 2 )

.

Cov (1, 1 )

Cov (1, 2 )

Nagl, Modelle mit latenten Variablen, Identifikation von nichtrekursiven und rekursiven Systemen

Zu Fall 5.)

Mit dem Ökonometrie-Identifikationssatz kann hier nicht begründet werden. Denn dort

wird Kovarianz der Störgrößen zugelassen. Daher würde nur eine hinreichende, aber

keine notwendige Begründung für die Identifikation geliefert werden.

Seite 11

1

2

1

1

21

2

12

1

11

1

Die direkte Untersuchung der Varianzen und Kovarianzen liefert 6 Gleichungen in 6 Unbekannten:

1111

21 1111

11

1 2112

1 2112

Var (1 ) Cov (1 , 1 ) Cov (1 , 2 )

2

2

2

1111 11 12 22 21 ( 1111 11 ) 12 22

Var (1 )

Cov (1 , 2 )

2

2

(

1

)

(

1

)

21

12

21

12

Var ( 2 )

2

2

(

)

21 11 11

11

22

(1 2112 ) 2

Die Lösungen für die Parameter auf Grund der Gleichungen sind:

11

Var ( 2 )Cov (1 , 1 ) 2 2Cov (1 , 1 )Cov (1 , 2 )Cov (1 , 2 ) Cov (1 , 2 ) 2 Var (1 )

Var (1 )( Cov (1 , 1 )Var ( 2 ) Cov (1 , 2 )Cov (1 , 2 ))

12

Cov (1 , 1 )Cov (1 , 2 ) Var (1 )Cov (1 , 2 )

,

Var ( 2 )Cov (1 , 1 ) Cov (1 , 2 )Cov (1 , 2 )

21

Cov (1 , 2 )

,

Cov (1 , 1 )

11 Var (1 ),

22

Var ( 2 )Cov (1 , 1 ) 2 2Cov (1 , 1 )Cov (1 , 2 )Cov (1 , 2 ) Cov (1 , 2 ) 2 Var (1 )

Cov (1 , 1 )

11 sehr komplizier ter Ausdruck!!

2

1

Das Hinzufügen einer 2. xi-Variablen.

1

Durch das Hinzufügen einer zusätzlichen xi-Variablen, die einerseits mit der 1. xiVariablen korreliert und andererseits einen Effekt auf die 2. Eta-Variable hat, erhöht

sich die Zahl der Gleichungen auf 10 (4 Varianzen und 6 Kovarianzen). Die Anzahl

der Parameter erhöht sich auf 9 ( 11 , 22 , 11 , 12 , 22 , 12 , 21 , 11 , 22 ).

1

11

1

1

21

2

12

22

12

2

Hier liegt die Situation vor, in der weniger Parameter als Gleichungen vorhanden sind

(ÜBER-identifiziertes System):

Var (1 ) Cov (1 , 2 ) Cov (1 , 1 ) Cov (1 , 2 )

Var ( 2 )

Cov ( 2 , 1 ) Cov ( 2 , 2 )

Var (1 )

Cov (1 , 2 )

Var ( 2 )

1111 12 22 12

11 12

1 2112

1112 12 22 22

22

1 2112

2

2

11

11 11 12

( 22 222 11 ) 2 1112 22 12

(1 2112 ) 2

21 1111 22 12

1 2112

21 1112 22 22

1 2112

2

21 ( 11

11 11 )

2

22 22

12 ( 22 22 222 ) 12 21 11 22 12

(1 2112 ) 2

2

2

2

21 ( 1111 11 ) 22 22 22 2 11 21 22 12

(1 2112 ) 2

Nagl, Modelle mit latenten Variablen, Identifikation von nichtrekursiven und rekursiven Systemen

Seite 12

Bei 10 Gleichungen für 9 Parameter genügen 9 Gleichungen. Im vorliegenden Fall sind die Gleichungen eindeutig lösbar, wenn bestimmte Gleichungen weggelassen werden, also etwa:

a.) die Gleichung für Var (1 ) ,

b.) die Gleichung für Var ( 2 ) oder

c.) die Gleichung für Cov (1 , 2 ) .

Im vorliegenden Fall erhält man für 5 Parameter jeweils die gleichen Lösungen, egal welcher der obigen StreiCov ( 2 , 2 )Cov (1 , 1 ) Cov ( 2 , 1 )Cov (1 , 2 )

11

Var (1 )Cov ( 2 , 1 ) Cov (1 , 1 )Cov (1 , 2 )

22

chungsvorschläge befolgt wird: 12

21

Cov ( 2 , 2 )Cov (1 , 1 ) Cov ( 2 , 1 )Cov (1 , 2 )

Cov (1 , 2 )Cov ( 2 , 1 ) Cov (1 , 1 )Var ( 2 )

Var (1 )Cov ( 2 , 1 ) Cov (1 , 1 )Cov (1 , 2 )

,

Var (1 )Cov ( 2 , 2 ) Cov (1 , 2 )Cov (1 , 2 )

Cov (1 , 2 )Cov ( 2 , 2 ) Cov (1 , 2 )Var ( 2 )

,

Cov (1 , 2 )Cov ( 2 , 1 ) Cov (1 , 1 )Var ( 2 )

11 Var (1 ), 12 Cov (1 , 2 ), 22 Var ( 2 )

Für die restlichen Parameter 11 , 22 entstehen sehr komplizierte Ausdrücke, die zudem auch nicht alle die

gleichen Lösungen haben, falls es sich um Gleichungen handelt, mit deren Hilfe die Parameter geschätzt werden

sollen.

12

Nagl, Modelle mit latenten Variablen, Identifikation von nichtrekursiven und rekursiven Systemen

Seite 13

Identifikation erweitert-rekursiver Modelle

Die üblichen rekursiven Modelle sind so definiert, dass auch die Störgrößen nicht korrelieren. Unter erweitertrekursiven Modellen sollen diejenigen verstanden werden, bei denen die gerichteten Pfade zwar eine rekursive

Struktur bilden (und die Koeffizienten daher in Form einer Dreiecksmatrix dargestellt werden können) wie beim

üblichen rekursiven Modell: zusätzlich dürfen aber die Störgrößen korrelieren. (Formal: Die Koeffizientenmatrix

B der endogenen Variablen selbst lassen sich in die Form einer Dreiecksmatrix bringen: ( ij 0, für i j) .

Manche Störgrößen der Gleichungen () können korrelieren).

Diese erweitert-rekursiven Modelle sind i.a. nicht identifizierbar. Für eine Teilmenge dieser Modelle (die bogenfreien Modelle) haben BRITO C. & PEARL J. (2002) eine hinreichende Bedingung der Identifikation gefunden

und bewiesen.

Bogenfreie Modelle sind solche, bei denen kein Paar von Variablen durch einen direkten Pfadkoeffizienten

verbunden sind, wenn gleichzeitig ihre Störgrößen korrelieren. In bogenfreien Modellen gilt: falls zwei Störgrößen i und j korrelieren, d.h. (ij ≠ 0), dann ist der entsprechende Koeffizient 0 (ij = 0 und ji= 0) (bzw. umgekehrt); der Strukturkoeffizient und die Korrelation dürfen nicht zugleich von null verschieden sein.

Modell mit Bogen

1

1

1

12

21

Bogenfreies Modell: M3

13

2

1

2

1

1

1

2

1

21

2

3

32

1

3

Beispiel M3:

Die direkte Untersuchung der Varianzen und Kovarianzen für M3 liefert 6 Gleichungen in 6 Unbekannten:

21 11

Var (1 ) Cov (1 , 2 ) Cov (1 , 3 ) 11

2

Var ( 2 )

Cov ( 2 , 3 ) 21 11 22

Var ( 3 )

21 11 32 13

2

( 21 11 22 ) 32 2113

2

2

221 32

11 2 21 32 13 32

22

33

Auf Grund der ersten 3 Gleichungen (links oben):

11 Var (1 ), 21 Cov(1 , 2 ) / 11 , 22 Var (2 ) 22111.

Aus den Gleichungen Cov(1 , 3 ) 2111 32 13 und Cov(2 , 3 ) ( 22111 22 ) 32 2113

folgt:

Cov ( 2 , 3 ) 21Cov (1 , 3 )

, 13 Cov (1 , 3 ) 32 Cov (1 , 2 ) . Aus der letzten Gleichung kann

Var ( 2 ) 21Cov (1 , 2 )

33 berechnet werden.

32

An Hand des Beispiels M3 wird deutlich, dass für das Finden der Lösungen zwar die üblichen Voraussetzungen

erfüllt sein müssen, aber keine speziell schwierigen. Es gilt der Satz (BRITO C. & PEARL J. (2002), S 464):

(Hinreichende Bedingung für die Identifikation der Modellparameter: Bogenfreies erweitert-rekursives Modell)

Sei M ein bogenfreies erweitert-rekursives Modell, dann können die Modellparameter (-Strukturkoeffizienten

und die Varianzen und Kovarianzen der Störgrößen) auf Grund der Varianzen und Kovarianzen der Variablen

fast immer eindeutig berechnet werden.