Höhere Mathematik I, Weihenstephan

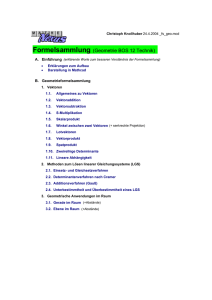

Werbung

Höhere Mathematik I, Weihenstephan

Christina Kuttler

29. Oktober 2009

Inhaltsverzeichnis

1 Mathematische Grundbegriffe

1.1 Mengen . . . . . . . . . . . .

1.2 Zahlen . . . . . . . . . . . . .

1.2.1 Natürliche Zahlen . .

1.2.2 Ganze Zahlen . . . . .

1.2.3 Rationale Zahlen . . .

1.2.4 Reelle Zahlen . . . . .

1.2.5 Komplexe Zahlen . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

4

4

5

5

6

6

7

9

2 Lineare Algebra

2.1 Vektoren und Matrizen . . . . . . . . . . . . . . .

2.1.1 Matrizenrechnung . . . . . . . . . . . . .

2.1.2 Inverse einer quadratischen Matrix . . . .

2.1.3 Rang einer Matrix . . . . . . . . . . . . .

2.2 Lineare Gleichungssysteme . . . . . . . . . . . . .

2.2.1 Allgemeiner Fall . . . . . . . . . . . . . .

2.2.2 Lösung linearer n × n-Gleichungssysteme

2.3 Eigenvektoren und Eigenwerte . . . . . . . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

11

11

17

21

21

22

22

24

26

3 Folgen und Reihen

3.1 Folgen - Grundbegriffe . . . . . . . . . . .

3.1.1 Monotone und beschränkte Folgen

3.1.2 Konvergenz . . . . . . . . . . . . .

3.2 Rekursive Folgen . . . . . . . . . . . . . .

3.2.1 Beispiel: Medikamenteneinnahme .

3.3 Reihen . . . . . . . . . . . . . . . . . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

30

30

31

31

33

34

34

4 Elementare Funktionen

4.1 Funktionsbegriff . . . . . . . . . . . . . . . . . .

4.2 Lineare Funktionen . . . . . . . . . . . . . . . . .

4.2.1 Umkehrfunktion . . . . . . . . . . . . . .

4.2.2 Abschnittsweise definierte Funktionen . .

4.3 Potenzfunktion . . . . . . . . . . . . . . . . . . .

4.4 Polynome . . . . . . . . . . . . . . . . . . . . . .

4.5 Rationale Funktionen . . . . . . . . . . . . . . .

4.6 Exponentialfunktion . . . . . . . . . . . . . . . .

4.6.1 Exponentialfunktion zur Basis e . . . . .

4.6.2 Anwendungen der Exponentialfunktion .

4.7 Logarithmusfunktion . . . . . . . . . . . . . . . .

4.7.1 Logarithmische Größen, Beispiel: pH-Wert

4.7.2 Logarithmische Skalen . . . . . . . . . . .

4.8 Trigonometrische Funktionen . . . . . . . . . . .

4.8.1 Definition Sinus und Cosinus . . . . . . .

4.8.2 Trigonometrische Funktionen . . . . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

37

37

38

39

41

41

42

43

45

45

46

47

49

49

50

50

53

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

1

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

5 Grundbegriffe Analysis

5.0.3 Grenzwerte von Funktionen . . . . . . . . .

5.1 Stetigkeit . . . . . . . . . . . . . . . . . . . . . . .

5.1.1 Wichtige Eigenschaften stetiger Funktionen

5.2 Differenzierbarkeit . . . . . . . . . . . . . . . . . .

5.2.1 Eigenschaften differenzierbarer Funktionen

5.2.2 Differentiationsregeln . . . . . . . . . . . . .

5.2.3 Beispiele Teil I . . . . . . . . . . . . . . . .

5.2.4 Rekursive Folgen und graphische Iteration .

5.2.5 Höhere Ableitungen . . . . . . . . . . . . .

5.2.6 Beispiele Teil II . . . . . . . . . . . . . . . .

5.3 Integral . . . . . . . . . . . . . . . . . . . . . . . .

5.3.1 Integral und Flächeninhalt . . . . . . . . .

5.3.2 Integration und Differentiation . . . . . . .

5.4 Approximation von Funktionen . . . . . . . . . . .

5.4.1 Taylorpolynom und Taylorreihe . . . . . . .

5.4.2 Newtonmethode . . . . . . . . . . . . . . .

5.5 Gewöhnliche Differentialgleichungen . . . . . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

56

56

56

58

59

61

61

62

62

66

66

66

66

67

69

69

71

71

A Zusätzliches Material

A.1 Polynomdivision . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

72

72

B Tabellen etc.

B.1 Weitere Notationen . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

Das griechische Alphabet . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

B.2 Einheiten und Dimensionen . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

73

73

73

73

Literature

73

Index

75

2

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

Dieses Skript versucht, die wichtigsten Inhalte aus der Vorlesung zusammenzufassen. Es ersetzt nicht

den Besuch der Vorlesung und auch nicht die eigenständige Beschäftigung mit dem Stoff, den Übungsaufgaben etc.

Zur verwendeten Literatur: Das Skript basiert nicht nur auf einem Buch, sondern ist eher bunt zusammengewürfelt, aus den jeweils schönsten Teilen aus verschiedenen Büchern. Sofern die Quelle eindeutig

zugeordnet werden kann, ist dies im Skript angegeben. Hinten findet sich eine komlette Liste der verwendeten Literatur - was nicht heißen soll, dass andere Bücher ungeeignet sein müssen.

3

Kapitel 1

Mathematische Grundbegriffe

1.1

Mengen

Die präzise mathematische Definition einer Menge (eingeführt von Cantor, 1845-1918) lautet wie folgt:

Definition 1 (Menge) Eine Menge ist eine Zusammenfassung bestimmter

wohlunterschiedener Objekte. Diese Objekte heißen Elemente der Menge.

Mengen werden in der Regel mit Großbuchstaben bezeichnet: A, B, C, . . .

Die leere Menge wird mit {} (oder auch mit ∅) bezeichnet.

Beispiel: Menge der Dinge im Studentenrucksack:

M = { Schreibblock, Buch, Kuli, Kaugummi, Handy }.

Dann gilt z.B.:

Kuli ∈ M (dies bedeutet: ein Kuli ist Element der Menge M , also darin enthalten)

Banane ∈

/ M (dies bedeutet: eine Banane ist nicht Element von M , also nicht darin enthalten).

Zwei Mengen A und B sind gleich (Bezeichnung: A = B), wenn sie genau dieselben Elemente enthalten. Dies bedeutet: Aus x ∈ A folgt x ∈ B (und umgekehrt).

A ist eine Teilmenge von B (Bezeichnung: A ⊂ B; “A ist in B enthalten”), wenn aus x ∈ A folgt x ∈ B,

aber nicht unbedingt umgekehrt.

Beispiel:

A =

B =

{ Brot }

{x | x = Lebensmittel },

dann gilt offenbar A ⊂ B (Brot gehört zu den Lebensmitteln), aber nicht B ⊂ A (nicht jedes Lebensmittel

ist ein Brot). (Merke: Es müssen nicht die Elemente einer Menge einzeln aufgezählt werden).

Die wichtigsten Mengenoperationen:

• Vereinigung zweier Mengen A und B:

C =A∪B

( Gesamtheit aller Elemente ausA und B)

• Schnitt zweier Mengen A und B:

C = A∩B

( bestehend aus den Elementen, die in A und in B enthalten sind)

• Das Komplement von A in U :

B =U \A

( die Elemente von U , die nicht in A liegen)

4

Beispiel: Seien A = {Fische, Amphibien, Reptilien}, B = {Reptilien, Vögel, Säugetiere} und U die Menge der Wirbeltiere. Dann gilt:

A∪B

=

A∩B =

U \A =

1.2

{ Fische, Amphibien, Reptilien, Vögel, Säugetiere}

{ Reptilien }

{ Vögel, Säugetiere }.

Zahlen

Typische Beispiele für Mengen sind die verschiedenen Zahlenmengen, die wir nun im folgenden etwas

genauer betrachten werden.

1.2.1

Natürliche Zahlen

Die natürlichen Zahlen kennt sicherlich jeder, damit kann man Zählen:

N = {1, 2, 3, . . .}

(Achtung: je nach Buch wird die 0 zu den natürlichen Zahlen hinzugenommen und nicht).

Ein sogenannter Index kann dazu benutzt werden, um verschiedene, aber analoge Dinge zu bezeichnen.

Beispiel: Seien x1 , x2 , . . . , xn die Anzahl der Wildschweine im Waldstück 1, 2 . . . , n.

Damit kann man weitere praktische Bezeichnungen einführen:

Definition 2 (Summenzeichen) Für m, n ∈ N mit m ≤ n definiert man das

Summenzeichen als

n

X

xk := xm + xm+1 + . . . + xn .

k=m

Dies wird genannt die Summe von k gleich m bis n über xk .

Pn

(Wieder zurück zum Beispiel: Die Zahl der Wildschweine im gesamten Wald entspricht dann k=1 xk )

Ein paar wichtige Eigenschaften für diese Art der Summation:

n

X

k=m

xk +

n

X

yk

k=m

n

X

axk

k=m

n

X

xk

=

(xk + yk )

k=m

n

X

=

a

=

k=m

p

X

k=m

Man setzt

n

X

xk

xk +

k=p+1

k=m

n

X

n

X

xk = 0

xk

( falls m ≤ p ≤ n)

falls m > n.

k=m

Analog kann man auch ein Kurzschreibweise für Produkte einführen:

5

Definition 3 (Produktzeichen) Das Produktzeichen wird wie folgt definiert:

n

Y

k=m

xk := xm · xm+1 · ... · xn−1 · xn ,

falls n < m definiert man

n

Y

xk := 1.

k=m

Und noch eine Definition:

Definition 4 (Fakultät) Die Fakultät wird wie folgt definiert:

n! := 1 · 2 · . . . · n =

n

Y

k

k=1

(lies “n Fakultät”), wobei man 0! := 1 setzt.

Vollständige Induktion

Die natürlichen Zahlen haben eine “einfache”, aber wichtige Eigenschaft: Wenn man bei 0 beginnt und

immer um eins weiterzählt, wird (über kurz oder lang) jede natürliche Zahl erfasst. Dasselbe Prinzip kann

man für den Wahrheitsgehalt von Aussagen verwenden.

Sei A(n) eine (sinnvolle) Aussage für jede natürliche Zahl n ∈ N. Wenn diese Aussage für n = 0 richtig

ist und beim Weiterzähen wahr bleibt, so gilt sie “automatisch” für alle n ∈ N. Etwas formaler gilt also:

Satz 1 (Prinzip der vollständigen Induktion) Gilt A(0) (der Induktionsanfang) und “A(n) ⇒ A(n + 1)” (der Induktionsschritt), so gilt A(n) für alle

n ∈ N.

Damit kann man z.B. beweisen, dass n! die Anzah der möglichen Anordnungen von n Elementen angibt.

Sei also

A(n) := “n Elemente lassen sich auf genau n! verschiedene Weisen anordnen”.

Induktionsanfang: A(1) is richtig (ein Element kann man auf genau eine Weise anordnen)

Induktionsschritt: Nun möchten wir zeigen, dass aus der Tatsache, dass A(n) für irgendein n richtig ist,

folgt, dass auch A(n + 1) richtig ist. Dies bedeutet hier: Wir nehmen an, dass für ein n ∈ N gilt, dass sich

n Elemente auf n! Weisen anordnen lassen. Jetzt möchten wir ein Element hinzufügen (d.h. dann hätten

wir tatsächlich n + 1 Elemente). Für das Einfügen gibt es genau n + 1 mögliche Stelle: ganz am Anfang,

zwischen Element 1 und Element 2, zwischen 2 und 3, und so weiter, oder ganz am Ende. Die gesuchte

Anzahl möglicher Anordnungen ist dann offenbar (n + 1) · n! = (n + 1)! und mit Hilfe der vollständigen

Induktion haben wir dann gezeigt, dass die Aussage für wirklich alle n ∈ N gilt, nicht nur für ein Beispiel.

1.2.2

Ganze Zahlen

Auch die ganzen Zahlen sind uns natürlich schon bekannt:

Z = {0, +1, −1, +2, −2, +3, −3, . . .}.

Im Gegensatz zu den natürlichen Zahlen können wir in diesem Zahlenraum auch uneingeschränkt subtrahieren. Was noch “fehlt”, ist eine Möglichkeit zu dividieren (ohne Rest). Dies funktioniert dann im

Raum der rationalen Zahlen:

1.2.3

Rationale Zahlen

Die rationalen Zahlen bestehen aus den (gekürzten) Brüchen ganzer Zahlen:

a

Q = { |a, b ∈ Z teilerfremd, b > 0}.

b

6

Hier kann man nun endlich uneingeschränkt die Grundrechenarten (Addition, Subtraktion, Multiplikation und Division) durchführen (bis auf die Division durch 0), mitsamt der bekannten Rechenregeln

(Assoziativ- und Kommutativgesetzte, Distributivgesetz).

1.2.4

Reelle Zahlen

Möchte man den “kompletten” Zahlenstrahl zur Verfügung haben, benötigt man die reellen Zahlen R.

Diese erlauben weitere Rechenoperationen, wie z.B. Wurzelziehen (aus nichtnegativen Zahlen), und beinhalten weitere Zahlen wie e, π usw.

Bemerkung 1 (Unendlich) Achtung: die “Zahlen” +∞ (plus unendlich) und

−∞ (minus unendlich) gehören nicht zu den rellen Zahlen dazu!

Mittelwerte

Oft hat man viele Daten, z.B. von einem Experiment, und möchte den Mittelwert berechnen.

Definition 5 (Mittelwert - arithmetisches Mittel) Der

Mittelwert von Zahlen x1 , . . . , xn ∈ R wird definiert als

(arithmetische)

n

x̄ =

1X

xk .

n

k=1

Dies ist nicht die einzige Möglichkeit, einen Mittelwert zu definieren! Es gibt noch viele andere - je nach

Problemstellung muss man auswählen, welche Art von Mittelwert am geeignetsten ist. Beispielsweise gibt

es noch ein sogenanntes “geometrisches Mittel”:

Definition 6 (Mittelwert - geometrisches Mittel) Für positive Zahlen

x1 , . . . , xn ist das geometrische Mittel wie folgte definiert:

x̄geo :=

n

Y

k=1

xk

!1/n

√

(Erinnerung: x1/n = n x, also die n-te Wurzel)

Beispiele: Zahl der Äpfel, die von Testpersonen innerhalb einer Woche verzehrt wurde: x1 = 0, x2 = 5,

x3 = 2, x4 = 10, x5 = 3. P

5

Arithemisches Mittel: n1 k=1 xk = 20

5 =4

Mit dem geometrischen Mittel kann man z.B. einen mittleren Wachstumsfaktor berechnen. Wachstumsfaktor einer Bakterienkultur am Tag k, k=1, . . . , 7: x1 = 5, x2 = 4, x3 = 3, x4 = 3, x5 = 2, x6 = 2,

x7 = 2. Der Bestand nach sieben Tagen kann man also wie folgt berechnen:

Anfangsbestand · 5 · 4 · 3 · 3 · 2 · 2 · 2 = Endbestand.

Stattdessen kann man auch mit Hilfe des geometrischen Mittels den Endbestand berechnen. Dabei benutzt

man:

√

√

7

7

x̄geo = 5 · 4 · 3 · 3 · 2 · 2 · 2 = 1440 ≈ 2, 83,

und erhält also

Anfangsbestand · x̄7geo = Endbestand.

Dies bedeutet: Man erhält das selbe Ergebnis, wenn man von einem tägliche Wachstum um das 2,83-fache

(eben dem geometrischen Mittel) ausgeht.

7

Ungleichungen und Absolutbetrag

Für zwei reelle Zahlen a, b ∈ R gilt genau eine der folgenden drei Beziehungen (auch “Relationen”

genannt):

a < b oder a = b oder a > b

Auf der Zahlengeraden ist klar, was dies bedeutet:

b

a<b

a=b

a>b

a ≤ b bedeutet: es gilt a < b oder a = b; analog wird a ≥ b eingeführt (“ größer gleich”). Man kann

verschiedene Umformungen benutzen:

• a < b ist äquivalent zu b − a positiv, also b − a > 0.

(Äquivalenz wird oft mit solch einem Doppelpfeil notiert: ⇔)

• a<b ⇔ b>a

• Die Negation von a < b lautet a ≥ b (nicht a < b)

• Die Ungleichheitszeichen besitzen die Eigenschaft der “Transitivität”, z.B.:

Aus a < b und b < c folgt a < c.

(Analog für die anderen Ungleichheitszeichen)

Weitere Regeln für das Rechnen mit Ungleichungen:

• Aus a < b folgt: a + c < b + c für alle c ∈ R

(Addition einer beliebigen Zahl auf beiden Seiten erhält die Ungleichung). Bemerkung: “folgt” kann

auch mit solche einem Pfeil notiert werden: ⇒

•

a<b

a<b

⇒ a·c< b·c

⇒ a·c> b·c

für c > 0

für c < 0

Dies bedeutet: Multiplikation auf beiden Seiten mit einer positiven Zahl erhält die Ungleichung;

Multiplikation auf beiden Seiten mit einer negativen Zahl dreht das Ungleichheitszeichen um.

Beispiel: Für welche x ∈ R ist folgende Ungleichung erfüllt?

−x − 7 ≤

⇔

−x ≤

⇔

−3x ≤

⇔

x ≥

2x + 2

2x + 9

9

|+7

| − 2x

1

| · (− )

3

−3

Der (Absolut-)Betrag einer reellen Zahl x wird mit |x| bezeichnet und wie folgt definiert:

x

für x ≥ 0

|x| :=

−x für x < 0

Auf der Zahlengeraden entspricht der Betrag einer Zahl ihrem Abstand vom Nullpunkt.

Oft gebraucht wird die sogenannte Dreiecksungleichung:

|a + b| ≤ |a| + |b|

Sie besagt: Der Betrag einer Summe ist nicht größer als die Summe der absoluten Beträge der Summanden.

8

1.2.5

Komplexe Zahlen

Auch in den reellen Zahlen gibt es Rechenoperationen, die aus diesem Zahlensystem herausführen, z.B. ist

√

−1 sicher keine reelle Zahl. (Oder etwas allgemeiner: Wenn wir die Nullstellenqeines Polynoms zweiter

2

Ordnung, x2 + px + q suchen, benutzen wir die Mitternachtsformel x1,2 = − p2 ± p4 − q; auch hier kann

unter der Wurzel etwas negatives auftreten). Angenommen, ein Zahlensystem besäße ein Element i mit

der Eigenschaft i2 = −1, so kann man damit immer auch für jedes Polynom zweiter Ordnung mindestens

eine Nullstelle finden:

r

p2

p2

p

falls

− q < 0.

x1,2 = − ± i − + q

2

4

4

(Hierzu später noch mehr)

Wir suchen also ein Zahlensystem (es soll C genannt werden, komplexe Zahlen) mit einem Element i ∈ C,

so dass i2 = −1.

Die Menge der komplexen Zahlen wird folgendermaßen definiert:

C = {z = x + iy | x, y ∈ R},

d.h. eine komplexe Zahl z ∈ C besteht aus einem Realteil x = Re(z) und einem Imaginärteil y = Im(z)

(diese sind jeweils “ganz normale” relle Zahlen).

So eine komplexe Zahl kann man sich auch als Vektor in der Ebene (R2 ) vorstellen - die sogenannte

“Gauß’sche Zahlenebene”:

y=Im(z)

z=3+2i

2

1

1

2

3

x=Re(z)

Die Zahl z = x + iy entspricht also dem Punkt mit den Koordinaten (x, y).

Nun müssen wir noch wissen, wie man komplexe Zahlen addiert und multipliziert:

Addition:

(x1 + iy1 ) + (x2 + iy2 ) = (x1 + x2 ) + i(y1 + y2 )

(diese kann man dann als Vektoraddition interpretieren; genaueres hierzu später)

Multiplikation:

(x1 + iy1 )(x2 + iy2 ) = (x1 x2 − y1 y2 ) + i(x1 y2 + x2 y1 )

Beispiel:

(1 + 2i) + (3 − i) =

(1 + 2i) · (3 − i) =

4+i

3 − i + 6i − 2i2 = 5 + 5i

Weitere wichtige charakteristische Größen komplexer Zahlen:

Konjugierte:

z̄ := x − iy

(beim Imaginärteil wird das Vorzeichen umgekehrt; dies entspricht Spiegeln an der x-Achse in der

Gauß’schen Zahlenebene:

9

y=Im(z)

z

x=Re(z)

z

Absolutbetrag:

|z| :=

p

x2 + y 2

(entspricht dem Abstand zum Ursprung in der Gauß’schen Zahlenebene, Pythagoras!)

y=Im(z)

z

|z|

y

.

x

Beispiel:

1 +¯ 2i =

|1 + 2i| =

1 − 2i

p

√

12 + 22 = 5

10

x=Re(z)

Kapitel 2

Lineare Algebra

2.1

Vektoren und Matrizen

Viele Größen beinhalten auch eine Richtung (z.B. in der Physik: Kraft, Geschwindigkeit, elektrische

Feldstärke ...). Diese können mit Hilfe von Vektoren beschrieben werden. (Im Gegensatz dazu spricht

man bei einer “ungerichteten Größe” von einem Skalar; Beispiele sind Temperatur, Gewicht, Alter eines

Individuums ...).

Vektoren werden im allgemeinen wie folgt bezeichnet:

a1

a2

~a = . ∈ Rn

..

an

(die Notation mit Pfeil ist insbesondere in der Physik üblich; je nach Buch oder wenn der Zusammenhang

klar ist, kann dieser auch fehlen).

In den Spezialfällen n = 2 bzw. n = 3 kennt man auch die geometrische Vorstellung des Vektors als Pfeil

in der Ebene oder im dreidimensionalen Raum.

Die einzelnen Einträge a1 , a2 , . . . im Vektor werden Komponenten oder auch Koordinaten des Vektors

genannt.

Zwei Vektoren sind genau dann gleich, wenn die sich jeweils entsprechenden Komponenten gleich sind,

also

a1

b1

a2 b 2

.. = .. ⇔ a1 = b1 und a2 = b2 und an = bn .

. .

an

bn

Beispiel: Altersklassenvektor eines Waldbestandes

8 ha

31−40jähr.

5

2

7 ha

7

21−30jähr.

8

5 ha

1−10jähr.

2 ha

11−20jähr.

11

Auch die Summe zweier Vektoren in Rn wird komponentenweise definiert:

a1

b1

a1 + b 1

a2 b 2 a2 + n 2

.. + .. =

..

. .

.

an

bn

an + b n

Auf diese Weise kann man zwei Baumbestände (aus dem Beispiel des Waldbestandes mit Altersklassenvektor) zu einem zusammenfassen:

8 ha

4 ha

31−40jähr.

11 ha

8 ha

1−10jähr.

7 ha

21−30jähr.

31−40jähr.

4 ha

11−20jähr.

21−30jähr.

5 ha

2 ha

1−10jähr.

11−20jähr.

also

11

5

2 4

+

7 4

8

8

16

6

=

11 ,

16

das Ergebnis beinhaltet die Altersklassenstruktur der Gesamtfläche.

Allgemein gelten für Vektoren folgende Rechenregeln:

• Kommutativgesetz: ~a + ~b = ~b + ~a

• Assioziativgesetz: (~a + ~b) + ~c = ~a + (~b + ~c)

• neutrales Element: ~a + ~0 = ~a, wobei ~0 der sogenannte Nullvektor ist:

0

0

~0 =

.. ∈ Rn

.

0

• inverses Element: für jeden Vektor ~a ∈ Rn gibt es einen Vektor (−~a) ∈ Rn , so dass gilt: ~a +(−~a) = ~0.

Bei letzterem fragt man sich vielleicht: Was bedeutet −~a?

Anschaulich kann man es sich einfach vorstellen: Der Vektorpfeil zeigt einfach in die genau umgekehrte

Richtung:

a

−a

a+(−a)=0

12

Hier kann man auch gleich verstehen, was Vektorsubtraktion beduetet:

~a − ~b = ~a + (−~b)

a

−b

a −b

b

~a − ~b stellt also einen “Verbindungsvektor” von ~b nach ~a dar.

Man kann einen Vektor auch mit einem Skalar multiplizieren (Achtung: dies hat nichts mit dem sogenannten Skalarprodukt zu tun, das wir später noch kennenlernen werden). Auch dies funktioniert

komponentenweise, für m ∈ R und ~a ∈ Rn ist definiert:

a1

m · a1

a2

m · a2

m · ~a = m · . :=

∈ Rn .

..

..

.

m · an

an

Geometrisch bedeutet dies: Der Vektor ~a wird um den Faktor m gestreckt bzw. gestaucht (je nachdem,

ob der Betrag von m größer oder kleiner als 1 ist):

Wir sehen auch: das Vorzeichen des Skalars gibt an, ob die Richtung des Vektorpfeils umgekehrt wird

(bei negativem m).

Ein paar Spezialfälle hierzu:, es gilt z.B.:

1 · ~a

0 · ~a

= ~a

= ~0

(−1) · ~a = −~a

m · ~0 = ~0

Aus m · ~a = ~0 folgt m = 0 oder ~a = ~0.

Für die skalare Multiplikation gelten die Distributivgesetze:

m · (~a + ~b) = m · ~a + m · ~b

(m1 + m2 ) · ~a

= k · ~a + m · ~a

13

(wobei m1 , m2 ∈ R ebenfalls Skalare seien).

Oft betrachtet man eine Summe von mehreren Vektoren, die jeweils noch einen skalaren Vorfaktor besitzen

können, also Terme der Form

m1 · a~1 + m2 · a~2 + . . . + mk · a~k =

k

X

i=1

mi mi · a~i ,

wobei mi ∈ R und a~i ∈ Rn . Dies wird Linearkombination der Vektoren a~1 , . . . , a~k genannt, mi heißen die

Koeffizienten.

Wenn man dies geometrisch interpretieren will, bedeutet es, die Vektoren (jeweils um den zugehörigen

Vorfaktor gestreckt bzw. gestaucht), aneinander dran zu hängen.

Nun betrachten wir eine Definition:

Definition 7 (Lineare Abhängigkeit) Zwei Vektoren ~a und ~b heißen linear

abhängig, wenn es Skalare m1 und m2 gibt (von denen mindestens eins 6= 0 ist),

so daß gilt:

(2.1)

m1~a + m2~b = ~0.

Kann man diese Bedingung nur mit m1 = 0, m2 = 0 erfüllen, so heißen dne

Vektoren ~a und ~b linear unabhängig.

Was bedeutet das? Angenommen, m1 6= 0, dann können wir die Gleichung (2.1) auf beiden Seiten mit

1

a = λµ~b. Dies bedeutet aber: die zwei Vektoren sind parallel.

m1 multiplizieren und erhalten ~

Dieses Konzept läßt sich auch auf den Fall von n Vektoren verallgemeinern:

Definition 8 (Lineare Abhängigkeit, n Vektoren) Die

Vektoren

a~1 , a~2 , . . . , a~n heißen linear abhängig, wenn Skalare m1 , m2 , . . . , mn existieren,

die nicht alle gleich Null sind, so daß gilt:

m1 a~1 + m2 a~2 + . . . + mn a~n = ~0.

Ist diese Gleichung nur für m1 = m2 = . . . = mn = 0 erfüllbar, so heißen die n

Vektoren linear unabhängig.

Beispiel: Wir betrachten drei Vektoren in der Ebene R2 , diese sind in jedem Fall linear abhängig - dies

bedeutet: man kann den dritten Vektor durch eine Linearkombination der anderen beiden darstellen; oder

(äquivalent; wie es die Definition sagt)

2a

c

−c

b

b

a

Unter dem Betrag eines Vektors ~a, bezeichnet mit |~a|, verstehen wir zunächst einfach die (Pfeil-)Länge

des Vektors. Beispiel: der Geschwindigkeitsvektor, dieser besteht aus einer Richtung und die Länge gibt

ein Maß für die “Größe der Geschwindigkeit” an:

it

gke

lli

hne

r Sc

fü

aß

M

14

In Koordinatenschreibweise: Der Betrag eines Vektors ~a =

|~a| :=

a1

a2

..

.

an

q

a21 + a22 + . . . + a2n

ist folgendermaßen definiert:

√

(dies entspricht offensichtlich der Wurzel des Skalarprodukts von ~a mit sich selbst, also |~a| = ~a · ~a.)

Im Spezialfall n = 2 (Vektoren in der Ebene) kann man mit Hilfe des Satzes von Pythagoras leicht sehen,

wie man darauf kommt:

2

|a|

a2

a1

Skalarprodukt

Anstatt einen Vektor mit einem Skalar zu multiplizieren, kann man auch zwei Vektoren multiplizieren.

Diese multiplikative Verknüpfung zweier Vektoren ~a und ~b wird folgendermaßen definiert:

Definition 9 (Skalarprodukt) Das Skalarprodukt (oder auch: innere Produkt) zweier Vektoren ~a und ~b ist definiert als

~a · ~b = |~a| · |~b| · cos α,

wobei α der von ~a und ~b eingeschlossene Winkel ist.

Der Name “Skalarprodukt” kommt daher, dass das Ergebnis ein Skalar ist.

Auch für das Skalarprodukt gelten einige nützliche Rechenregeln:

• Kommutativgesetz: ~a · ~b = ~b · ~a

• Distributivgesetz: ~a · (~b + ~c) = ~a · ~b + ~a · ~c

• noch ein Gesetz: m(~a · ~b) = (m~a) · ~b = ~a · (m~b)

Das Vorzeichen des Skalarprodukts liefert sofort eine Information darüber, wie groß der Winkel ist (bzw.

umgekehrt): Für ~a, ~b 6= ~0 gilt:

> 0 für 0 ≤ α < π2

~

= 0 für α = π2

~a · b

< 0 für π2 < α ≤ π

(kleine Bemerkung am Rand: in der Mathematik mißt man Winkel in der Regel im sogenannten Bogenmaß - 2π entsprechen den üblichen 360◦ eines vollen Kreises; hierzu später noch mehr.)

Also gilt: Wenn das Skalarprodukt 0 ergibt, ist entweder einer der Vektoren ~a oder ~b der Nullvektor

~0, oder die Vektoren stehen senkrecht aufeinander (man sagt auch: die Vektoren sind orthogonal).

Wenn die Vektoren in Koordinaten dargestellt sind, also z.B.

a1

b1

a2

b2

~b =

~a = . ,

..

..

.

an

bn

15

∈ Rn ,

kann man das Skalarprodukt wie folgt berechnen:

~a · ~b =

n

X

ai b i

i=1

1

2

Beispiel: Wir berechnen das Skalarprodukt von

und

:

2

−3

1

2

·

= 2 − 6 = −4

2

−3

Da das Vorzeichen negativ ist, ist der Winkel zwischen den beiden Vektoren offenbar größer als

größer als 90◦ ).

π

2

(also

Betrachten wir den Spezialfall ~a · ~a. Hier gilt wegen cos α = cos 0 = 1:

~a · ~a = |~a| · |~a| · cos α = |~a|2

Anwendung des Skalarprodukts (aus Storrer)

Wir betrachten einen Massenpunkt, der sich längs einer Geraden bewegt, und auf den eine Kraft wirkt.

Aus der Physik kennt man folgende Formel:

Arbeit = Kraft mal zurückgelegter Weg

Achtung: Dies gilt so nur, wenn die Kraft parallel zur Fortbewegungsrichtung wirkt. Betrachten wir z.B.

eine Situation wie folgt:

F

α

x

(F~ ist die Kraft, ~x die gerichtete Strecke, die vom Massenpunkt zurückgelegt wurde).

Nun spielt der “Anteil” der Kraft eine Rolle, der in Richtung von ~x zeigt (man nennt dies auch: Betrag

der Projektion auf die Richtung von ~x), diese Kraft ist dann |F~ | · cos α. Also findet man tatsächlich für

die geleistete Arbeit W :

W = |F~ | · cos α · |~x| = F~ · ~x,

was sich per Skalarprodukt einfach ausdrücken läßt.

Vektorprodukt

Es gibt noch eine weitere Möglichkeit, zwei Vektoren zu verknüpfen: das sogenannte Vektorprodukt (auch

Kreuzprodukt oder äußeres Produkt genannt). Allerdings kann es nur für Vektoren im dreidimensionalen

Raum R3 definiert werden.

Definition 10 (Vektorprodukt) Seien ~a und ~b Vektoren im R3 , mit Zwischenwinkel α. Das Vektorprodukt ~a × ~b ist der Vektor mit folgenden Eigenschaften:

• ~a × ~b steht senkrecht auf ~a und ~b, so daß ~a, ~b und ~a × ~b ein Rechtssystem

bilden (so wie Daumen, Zeigefinger und Mittelfinger der rechten Hand).

• Der Betrag von ~a × ~b ist

|~a × ~b| = |~a| · |~b| · sin α.

Bemerkungen:

Man kann sich den Betrag vorstellen als die Fläche des Parallelogramms, das von ~a und ~b aufgespannt

wird.

16

b

α

a

Es gilt: ~a × ~a = ~0 (der Zwischenwinkel α ist dann 0, daher auch der Sinus). Analog gilt ~a × ~b = ~0, wenn

~a und ~b parallel sind oder einer der Vektoren der Nullvektor ist.

Rechenregeln:

• Antikommutativität: ~b × ~a = −(~a × ~b)

• Distributivgesetz: (~a + ~b) × ~c = ~a × ~c + ~b × ~c

und

~a × (~b × ~c) = ~a × ~b + ~a × ~c

• mit Skalar: (m~a) × ~b = ~a × (m~b) = m(~a × ~b), wobei m ∈ R.

Koordinatendarstellung des Vektorprodukts:

a2 b 3 − a3 b 2

b1

a1

~a × ~b = a2 × b2 = a3 b1 − a1 b3

a1 b 2 − a2 b 1

b3

a3

Beispiel: Mal wieder eine Anwendung aus der Physik, die Lorentz-Kraft: Auf eine elektrische Ladung q,

~ die Lorentz-Kraft. Wie vielleicht schon

die sich mit der Geschwindigkeit ~v bewegt, wirkt im Magnetfeld B

bekannt ist, wirkt die Lorentz-Kraft senkrecht zur Bewegungsrichtung und senkrecht zur Richtung des

Magnetfeldes. Dies läßt sich nun also ganz bequem mit Hilfe des Vektorprodukts darstellen:

~

F~Lorentz = q · ~v × B

Hier als Beispiel die Flugbahn eines Elektrons im Magnetfeld:

B

v

F

v

F

(Das Magnetfeld schaut aus dem Blatt heraus). Achtung: die Ladung eines Elektrons ist negativ! (D.h.

man muß das Vorzeichen umdrehen, oder die linke Hand verwenden)

2.1.1

Matrizenrechnung

Quelle: [5, 6]

In der folgenden Tabelle befinden sich die Nährstoffmengen eines Schweineschnitzels Wiener Art (in

[g] angegeben):

Eiweiß

Fett

Kohlenhydrate

Fleisch

20

50

0

Mehl

0.5

0.05

4

17

Ei

1.5

1.5

0.1

Semmelbrösel

1

0

9

Kokosfett

0.2

20

0

Man kann, wenn die Bedeutung der Zahlen klar ist, das ganze auch in Form einer Matrix, die zunächst

nichts anderes als ein Zahlen-Rechteck ist, schreiben:

20 0.5 1.5 1 0.2

W = 50 0.05 1.5 0 20

0

4

0.1 9 0

(hier Nährstoffmatrix W genannt). Allgemein besteht eine n × m Matrix aus n Zeilen und m Spalten.

Definition 11 (Matrix) Eine n × m Matrix (n, m ∈ N) ist ein rechteckiges

Zahlenschema

a11 a12 . . . a1m

a21 a22 . . . a2m

A= .

..

.. .

..

.

.

an1 an2 . . . anm

aik heißt (i, k)-tes Element von A.

Kurzbezeichnung: A = (aik )n×m = (aik ).

Eine Zeile (bestehend aus m Elementen) ist dann eine (1 × m)-Matrix und wird auch Zeilenvektor genannt.

Eine Spalte (bestehend aus n Elementen) ist eine (n × 1)-Matrix und wird auch Spaltenvektor genannt.

Im obigen Beispiel der Nährstoffmatrix entspricht z.B. die zweite Zeile einem Zeilenvektor, in dem die

Fettmengen der fünf verschiedenen Lebensmittel eingetragen sind.

Spezielle Matrizen

Ein paar besondere Matrizen haben auch besondere Bezeichnungen:

• Die sogenannte Nullmatrix besteht ausschließlich aus Elementen = 0:

0 0 ... 0

0 0 ... 0

0= . .

..

.. ..

.

0

0 ... 0

• Wenn eine Matrix gleich viele Zeilen wie Spalten besitzt, wird sie quadratisch genannt. (Wenn die

Anzahl beispielsweise n ist, so ist dies also eine n × n Matrix).

• Ein Spezialfall einer quadratischen Matrix ist eine sogenannte Diagonalmatrix. Diese hat nur in der

sogenannten Hauptdiagnoale (von links oben nach rechts unten) Einträge, die 6= 0 sind:

d11 0 . . .

0

..

0 d22 . . .

.

.

D=

..

..

..

.

.

.

0

0

. . . 0 dnn

• Die sogenannte Einheitsmatrix ist wiederum ein Spezialfall einer Diagonalmatrix, sie hat ausschließlich 1 in der Hauptdiagonalen:

1 0 ... 0

.

0 1 . . . ..

.

I= .

.. . . . . . . 0

0 ... 0 1

18

• Ein weiterer Spezialfall einer quadratischen Matrix ist eine “obere Dreiecksmatrix”. Hier sind alle

Elemente unterhalb der Hauptdiagonalen gleich 0, d.h. die Matrix hat folgende Form:

r11 r12 . . . . . . r1n

0 r2 2 . . . . . . r2n

..

..

..

..

.

.

R=

.

.

.

.

.

.

.. ..

..

..

0

. . . . . . 0 rnn

Entsprechend kann man auch eine “untere Dreiecksmatrix” einführen, bei der alle Elemente oberhalb der Hauptdiagonalen gleich 0 sind.

Rechenregeln für Matrizen

Wie bei den entsprechenden Rechenoperationen bei Vektoren, werden auch bei Matrizen Addition, Subtraktion und skalare Multiplikation elementweise definiert:

• Addition: Die Summe der Matrizen A = (aik )n×m und B = (bik )n×m wird definiert durch

A + B := (aik + bik )n×m

Achtung: es können nur Matrizen mit gleichen Dimension, also gleich vielen Zeilen und gleich vielen

Spalten, addiert werden!

• Das Negative einer Matrix A = (aik )n×m ist

−A := (−aik )n×m

Subtraktion A − B kann dann also durch Additon des Negativen von B durchgeführt werden:

A − B = A + (−B)

• Skalare Multiplikation: Für λ ∈ R und A = (aik )n×m wird die skalare Multiplikation (Multiplikation

einer Matrix mit einer Zahl) wie folgt definiert:

λ · A := (λ · aik )n×m

Beispiel: Auf diese Art und Weise kann man dann z.B. die Nährstoffmengen von λ Schnitzeln Wiener Art

berechnen.

Für die hier eingeführten Rechenoperationen gelten folgende Rechenregeln:

• Kommutativgesetz:

• Assoziativgesetz:

A+B =B+B

(A + B) + C = (a + (b + C) = A + B + C

• Rechenregeln zur Nullmatrix:

0+A=a+0 =

A + (−a) =

A

0

• Rechenregeln zur skalaren Multiplikation (λ, λ1 , λ2 ∈ R, A und B seien n × m Matrizen):

(λ1 · λ2 ) · A

λ(A + B)

(λ1 + λ2 )A = λ1 A + λ2 A

19

= λ1 · (λ2 · A)

= λA + λB

Nun soll noch das Produkt zweier Matrizen definiert werden.

Definition 12 (Matrizenmultiplikation) Seien r, n, m ∈ N. Für A =

(aik )r×n und B = (bkj )n×m , wobei i = 1, . . . , r und j = 1, . . . , m, wird das

Produkt folgendermaßen definiert:

cij

n

X

:=

aik bkj ,

k=1

A · B := C

:=

(cij )r×m

Bemerkung 2 () Das (i, j)-te Element der Produktmatrix C ist also das Produkt der i-ten Zeile von A mit der j-ten Spalte von B,

b1j

b2j

cij = (ai1 ai2 . . . ain ) · . .

..

bnj

Auch beim Produkt müssen die Matrix-Dimensionen passen: A · B ist genau

dann definiert, wenn die Anzahl der Spalten von A gleich der Anzahl der Zeilen

von B ist.

Die Rechenregeln für Matrizen im Zusammenhang mit Multiplikation lauten wie folgt:

(A · B) · C

A · (λB) = (λA) · B

(A + B) · C

=

=

=

A · (B + C) =

A · (B · C)

λ(A · B)

A·C +B·C

A·B+A·C

Für die Einheitsmatrix (mit passender Dimension n) und n × k Matrizen A und k × n Matrizen B gilt:

I·A=A

und

B · I = B.

All diese Rechenregeln kann man aus den Definitionen für Addition, Multiplikation und skalarer Multiplikation herleiten, sie sind also nicht “vom Himmel gefallen”. Wir betrachten hier nur aus Zeitgründen

nicht alle diese Details.

Nochmals Achtung: Für (n × n)-Matrizen A und B darf man im allgemeinen nicht die Reihenfolge der

Multiplikation vertauschen, d.h. es gilt NICHT

Beispiel: A =

3

0

1

2

und B =

A·B =

0

1

1

0

A·B = B·A

, dann gilt

1 3

2 0

,

aber B · A =

2

1

an1

an2

..

.

0

3

Transponierte Matrix

a11

a1m

a12

.. , dann heißt AT =

..

.

.

an2 . . . anm

a1m

trix. Sie hat die Dimension m × n.

a11

..

Sei A = .

an1

a12

..

.

...

...

...

. . . anm

die zu A transponierte Ma

Anschaulich bedeutet dies: die Matrix wird an der Hauptdiagonalen “gespiegelt”.

Auf diese Weise kann man z.B. auch einen Spaltenvektor in die Form eines Zeilenvektors bringen und

umgekehrt.

Oder man kann die einzelnen Elemente anschauen: Element aTik von AT entspricht dem Element aki von

A.

20

2.1.2

Inverse einer quadratischen Matrix

Quelle: [5]

Bei reellen (oder auch rationalen) Zahlen r 6= 0 ist es gar kein Problem, eine reelle Zahl r−1 zu finden, so daß r · r−1 = r−1 · r = 1 gilt. r−1 wird dann auch Inverse zu r genannt. Bei Matrizen ist dies

nicht so einfach, eine inverse Matrix zu finden, so daß das Produkt der Ausgangsmatrix mit der zugehörigen inversen Matrix die Einheitsmatrix ergibt. Für manche Matrizen klappt es, für andere wiederum nicht!

Beispiele:

1. A =

1 1

2 0

und B =

0 0, 5

1 −0, 5

. Für diese Matrizen gilt:

A · B = I und B · A = I

1 0

. Für diese Matrix finden wir keine 2 × 2 Matrix, die multipliziert mit C (egal ob

2 0

von links oder recht) die Einheitsmatrix I ergeben würde.

2. C =

Um die Eigenschaften einer Matrix in diesem Zusammenhang zu beschreiben, führen wir folgende Bezeichnungen ein:

Definition 13 () Inverse Matrix Sei A eine quadratische n × n Matrix. Existiert zu A eine n × n-Matrix A−1 , für die gilt

A · A−1 = A−1 · A = I,

dann wird A regulär (oder nicht-singulär) genannt. A−1 ist dann die inverse

Matrix (oder kurz: Inverse) von A.

Existiert eine solche Inverse nicht, dann wird A singulär genannt.

Man kann sich ganz leicht überlegen: Die Inverse von A−1 ist wiederum A!

Falls eine Inverse existiert, so ist sie eindeutig bestimmt. Auch das kann man ganz leicht sehen:

Sei B eine Inverse zu A, d.h. es gilt A · B = B · A = I. Angenommen, es existiert eine weitere Inverse

C zu A (für die gilt: C 6= B), dann gilt nach Definition auch A · C = C · A = I. Jetzt nehmen wir die

Gleichung A · B = I und multiplizieren sie von links mit C durch, dies liefert:

C ·A·B = C ·I

Da C auch Inverse zu A ist ist, gilt C · A = I, also folgt I · B = C · I. Nach Definition der Einheitsmatrix

bedeutet dies aber B = C = A−1 . Es macht also Sinn, von “der Inversen” zu sprechen, nicht nur von

“einer Inversen”.

2.1.3

Rang einer Matrix

Quelle: [5]

Der Rang einer Matrix ist z.B. wichtig, wenn wir später die Lösbarkeit bzw. die Lösungsmenge eines

linearen Gleichungssystems betrachten.

Um den Rang zu definieren, kann man die n Spalten, die in einer m × n-Matrix stehen, als System von n

Spaltenvektoren auffassen. Der Rang einer Matrix A ist die maximale Anzahl linear unabhängiger Spaltenvektoren in A.

Äquivalent dazu kann man den Rang auch über die Zeilenvektoren einführen, als maximale Anzahl linear

unabhängiger Zeilenvektoren in A. Das Ergebnis ist beidesmal dasselbe (dies kann man beweisen).

Beispiel:

1 2

A= 0 6

0 3

21

3

4

2

Seien a1 , a2 , a3 die Spaltenvektoren von A. Für die lineare Unabhängigkeit von a1 , a2 , a3 betrachten wir

also

1

2

3

m 1 a1 + m2 a2 + m3 a3 = m1 0 + m2 6 + m3 4 .

0

3

2

Man finden hier, daß z.B.

m1 = 5,

n2 = 2,

m3 = −3

obige Bedingung erfüllen. Die drei Spaltenvektoren sind also linear abhängig.

Betrachten wir nur a1 und a2 , so finden wir ganz offenbar keine Kombination von m1 und m2 (außer

m1 = m2 = 0), die m1 a1 + m2 a2 = 0 erfüllt, d.h. zwei linear unabhängige Spaltenvektoren gibt es auf

jeden Fall. Nach Definition ist dann der Rang der Matrix A 2.

2.2

Lineare Gleichungssysteme

Quelle: [5]

2.2.1

Allgemeiner Fall

Unter einem linearen Gleichungssystem (kurz: LGS) versteht man im allgemeinen Fall ein System von m

Gleichungen mit n Variablen (genannt xi , wobei i = 1, . . . , n) in der folgenden Art:

a11 x1 + a12 x2 + . . . + a1n xn

a21 x1 + a22 x2 + . . . + a2n xn

..

..

..

.

.

.

am1 x1 + am2 x2 + . . . + amn xn

= b1

= b2

..

.

= bm

Man kann auch alle Koeffizienten aij in einer Matrix zusammenfassen, sowie die Variablen xi und die

“rechten Seiten” bi (i = 1, . . . n) jeweils in einen Vektor schreiben, dies ergibt folgende (äquivalente)

Schreibweise:

a11 . . . a1n

x1

b1

..

.. .. = ..

.

. . .

am1

. . . amn

xn

{z

} | {z }

Matrix A

Vektor x

oder in ganz kompakter Matrizenschreibweise also

|

bn

| {z }

Vektor b

A · x = b.

A wird hier “Koeffizientenmatrix” genannt. Oft verwendet man (als praktische Schreibweise) die sogenannte erweiterte Koeffizientenmatrix:

a11 . . . a1n b1

..

..

..

.

.

.

am1

. . . amn

bm

Hier fügt man zur Koeffizientenmatrix A noch eine Spalte mit der rechten Seite b hinzu (die Angabe der

Variablen ist für die Festlegung des LGS nicht nötig). Die Kurzschreibweise hiervon lautet: (A|b)

Das LGS heißt “homogen, wenn alle rechten Seiten bi = 0 sind; sonst heißt es “inhomogen”.

Im folgenden möchten wir uns mit der Lösbarkeit von linearen Gleichungssystemen beschäftigen.

Hierzu betrachten wir erst einmal drei Beispiele (in Matrizenschreibweise):

5

3 1

x1

=

•

4

x2

0 2

1

x1

=

Dieses LGS hat eine einzige Lösung: x =

.

2

x2

22

−2 1

1

x

1

• 1 1

= 0

x2

0 2

1

Dieses LGS hat überhaupt keine Lösung (dies kann man einfach sehen: aus der untersten Zeile

folgt x2 = 12 ; dies in die zweite Zeile eingesetzt ergibt x1 = − 21 , dann ist aber in der ersten Zeile

−2x1 + x2 = 2 6= 1, wie gefordert wäre)

2 1

x1

1

•

=

4 2

2

x2

t

Hier findet man: Jeder Vektor x der Form x =

(wobei t ∈ R) ist eine Lösung des

−2t + 1

LGS, d.h. es gibt unendlich viele Lösungen.

Daraus sehen wir: es ist nicht von vornherein klar, ob ein LGS eine Lösung besitzt, und falls ja, wie viele.

Man kann die Gleichung A · x = b wie folgt interpretieren: b ist eine Linearkombination der Spalten(vektoren) von A. Angenommen, die Matrix A besitzt Rang r (also r linear unabhängige Spalten). Das

LGS A·x = b ist genau dann lösbar, wenn b als Linearkombination von den r linear unabhängigen Spalten

von A dargestellt werden kann (die übrigen n − r Spalten von A spielen hier keine Rolle, weil sie ja selbst

Linearkombinationen von den r linear abhängigen Spalten sind).

Also müssen b und die r linear unabhängigen Spalten von AA linear abhängig sein. Dies bedeutet in der

Formulierung der erweiterten Koeffizientenmatrix: (A|b) muss denselben Rang (nämlich r) besitzen wie

A. Das ganze als Satz formuliert:

Satz 2 (Lösbarkeit LGS) Ein lineares Gleichungssystem Ax = b ist lösbar

genau dann, wenn A und (A|b) denselben Rang haben.

Was folgt nun hieraus?

• Man kann zeigen: Eine reguläre n × n Matrix A hat maximalen Rang, also n. Also ist ein LGS mit

regulärer Koeffizientenmatrix A immer lösbar (auch der Rang der erweiterten Matrix ist n, kann

nicht größer werden). In diesem Fall ist die Lösung sogar eindeutig; sie kann im Prinzip mit Hilfe

der inversen Matrix berechnet werden: x = A−1 b.

• Ein homogenes LGS ist immer lösbar, denn offensichtlich wird der Rang der Koeffizientenmatrix

nicht vergrößert, wenn man den Nullvektor bei der erweiterten Koeffizientenmatrix hinzunimmt. Die

triviale Lösung ist stets der Nullvektor (der Dimension n). Wenn der Rang der Koeffizientenmatrix

A schon maximal ist, also n, dann existiert auch nur diese triviale Lösung (der Umkehrschluß gilt

ebenfalls!). Aber wenn der Rang < n ist, so gibt es unendlich viele Lösungen: Zu jeder Lösung x 6= 0

ist auch jedes skalare Vielfache λx eine Lösung des homogenen LGS.

• Im Fall, dass ein LGS weniger Gleichungen als Variablen hat (in Matrixschreibweise: Zahl der Zeilen

¡ Zahl der Spalten), und der Rang der Koeffizientenmatrix der Zahl der Gleichungen entspricht (in

unserer Notation: der Rang von A ist m, dann ist das LGS stets lösbar. (Auch das kann man sich

leicht überlegen: Es gilt nämlich Rang(A|b) ≤ min(m, n + 1) = m und Rang(A|b) ≥ Rang(A) = m,

also folgt automatisch Rang(A|b) = Rang(A) = m.)

Der folgende Satz faßt dies nochmals zusammen:

Satz 3 (Lösungsmenge LGS) Ein LGS Ax = b ist eindeutig lösbar, wenn

der gemeinsame Rang von A und (A|b) der Zahl der Variablen entspricht. Ist

dieser Rang kleiner als die Anzahl der Variablen, so hat das LGS unendlich viele

Lösungen.

⇔ Rang(A|b) = Rang(A) = n

−2 3

−8

Beispiel: Wir betrachten das LGS Ax = b mit A =

und b =

. Man sieht direkt:

1 −1

3

Die Spaltenvektoren von A sind nicht linear abhängig, also ist der Rang von A = 2. Dies ist der volle

Rang, also ist der Rang der erweiterten Matrix (A|b) automatisch auch = 2. Das LGS ist also eindeutig

lösbar!

Ax = b ist eindeutig lösbar

23

2.2.2

Lösung linearer n × n-Gleichungssysteme

Ziel: Wir möchten ein lineares Gleichungssystem lösen:

a11 x1 + a12 x2 + . . . + a1n xn

= b1

a21 x1 + a22 x2 + . . . + a2n xn

..

..

..

.

.

.

= b2

..

.

an1 x1 + an2 x2 + . . . + ann xn

= bn

Dies läßt sich auch mit Hilfe einer sogenannten Koeffizientenmatrix A = (aij )nm darstellen, dann ganz

kurz: A · x = b

Man kann nachprüfen: Das Vertauschen von zwei Zeilen oder die Addition (oder Subtraktion) von Vielfachen einer Zeile lassen die Lösung unverändert. Also ist das Ziel, mit Hilfe solcher Operationen das LGS

in eine einfachere Form zu bringen, so daß man die Lösung ganz leicht bestimmen kann. Dies ist z.B. der

Fall, wenn das LGS folgende Form hat:

r11 x1 + r12 x2 + . . . + r1,n−1 xn−1 + r1n xn

=

y1

0 · x1 + r22 x2 + . . . + r2,n−1 xn−1 + r2n xn

..

..

..

..

.

.

.

.

=

y2

..

.

0 · x1 + 0 · x2 + . . . + rn−1,n−1 xn−1 + rn−1,n xn

0 · x1 + 0 · x2 + . . . + 0 · xn−1 + rnn xn

=

=

yn−1

yn

(dann muß man nur in der untersten Zeile die Lösung ausrechnen, also xn = yn /rnn , in die nächsthöhere

einsetzen, wieder Lösung berechnen, einsetzen, usw.!). Aber wie kommt man zu dieser Form des LGS?

Die Vorgehensweise wird einem “Algorithmus” (eine Art Rezept, dessen Anweisungen man folgen muss,

um zum gewünschten Ergebnis zu kommen) beschrieben, wir benutzen hier den Gauß-Algorithmus und

betrachten den Fall eines linearen nicht-singulären n × n Gleichungssystems, Ax = b. Dieses wollen wir

in die gewünschte Dreiecksform bringen:

1. Zwischenziel / Schritt: Die Matrix (A, b) wird in eine Matrix (A′ , b′ ) transformiert, deren erste Spalte

überall Nullen enthält, außer a′11 6= 0:

′

a11 a′12 . . . a′1n b′1

0 a′22 . . . a′2n b′2

′

′

′

(A′ , b′ ) = 0 a32 . . . a3n b3

..

..

..

..

.

.

.

.

0

a′n2

. . . a′nn

b′n

Als Voraussetzung hierfür benötigen wir a11 6= 0. Wenn dies nicht der Fall ist, müssen wir die erste

Zeile mit einer anderen Zeile (Nummer i) vertauschen, deren erstes Element ai1 6= 0 erfüllt, also

kein echtes Problem.

i1

Damit a′i1 = 0 wird (für i = 2 . . . n) muss man das − aa11

-fache der ersten Zeile zur i-ten Zeile

′ ′

addieren. Die Matrix (A , b ) wird also auf folgende Weise gebildet:

• die erste Zeile von (A′ , b′ ) wird im Vergleich zu (A, b) nicht verändert, also

a′1k = a1k

(k = 1, 2, . . . , n) und b′1 = b1

• für die i-te Zeile: berechne die Hilfsgrößen li1 =

a′ik = aik − li1 a1k

(für i = 2, . . . , n und k = 2, . . . , n)

24

ai1

a11

(i = 2, . . . , n) und damit

und b′i = bi − li1 b1

2. Zwischenziel / Schritt: Die Matrix A′ , b′ = wird in eine Matrix (A′′ , b′′ ) transformiert, die auch in

der zweiten Spalte unterhalb der Diagonalen nur Nullen enthält, wobei aber a′22 6= 0 sein muß, also

′

a11 a′12 a′13 . . . a′1n b′1

0 a′22 a′23 . . . a′2n b′2

′′ ′′

0 a′′33 . . . a′′′

b′′3

3n

(A , b ) = 0

..

..

..

..

.

.

.

.

0

a′′n3

0

. . . a′nn

b′′n

Merke: Die Vorgehensweise ist wieder dieselbe:

• erste und zweite Zeile von (A′′ , b′′ ) werden im Vergleich zu (A′ , b′ ) nicht verändert:

a′′1k = a1k ;

a′′2k = a′2k

(k = 1, 2, . . . , n) und b′′1 = b1 , b′′2 = b′2

• für die i-te Zeile berechne die Hilfsgröße

′

li2

=

a′i2

a′22

(i = 3, . . . , n)

und damit

′ ′

a′′ik = a′ik − li2

a2k

′ ′

und b′′i = b′i − li2

b2

(für i = 3, . . . , n und k = 3, . . . , n)

Fortsetzung: In der selben Weise führt man diese Transformationen für die verbleibende “Restmatrix”

Schritt für Schritt durch, bis man nach n − 1 Schritten die Dreiecksform erreicht hat.

Abschluß: Die Lösung erhält man dann durch “rückwärts einsetzen”, wie oben beschrieben.

Bezeichnung: Die Elemente a11 , a′22 , a′′33 , . . ., die 6= 0 erfüllen müssen, werden Pivot-Elemente genannt.

Beispiel: Aloisius möchte sich ausschließlich von Weißbier, Brezn und Weißwürsten ernähren. Die

folgende Tabelle gibt den Nährstoffgehalt der einzelnen Lebensmittel sowie den gesamten Tagesbedarf

an:

1/2 l Weißbier

1 Breze

1 Weißwurst

Tagesbedarf

Eiweiß

3.2

3.6

7.6

66

Kohlenhydrate

28

27

0

165

Fett

0

0

15

90

Frage: Wieviel muß / darf Aloisius von den einzelnen Lebensmitteln essen und in welcher Kombination,

um genau seinen Tagesbedarf zu decken?

Wir können diese Fragestellung als lineares Gleichungssystem formulieren und lösen: Sei x1 die Anzahl

der Weißbiere, x2 die Anzahl der Brezn und x3 die Anzahl der Weißwürste. In Matrix-Schreibweise lautet

das LGS also:

3.2 3.6 7.6

66

x1

28 27

0 x2 = 165

0

0

15

x3

90

Wir können das LGS noch einfacher schreiben, mit Hilfe der erweiterten Koeffizientenmatrix (auch GaußSchema genannt) lautet das LGS:

3, 2 3, 6 7, 6 66

28 27

0 165

0

0

15 90

Um ganzzahlige Koeffizienten zu haben, wird die 1.Zeile mit 2.5 multipliziert (nicht notwendig, dies zu

tun, erleichtert nur das Kopfrechnen), dies liefert:

8 9 19 165

28 27 0 165

0 0 15 90

25

Wir berechnen die Hilfsgrößen

l21 =

a21

28

0

a31

=

= = 0,

= 3, 5 und l31 =

a11

8

a11

8

damit können wir die neuen Einträge in der 2. und der 3. Zeile berechnen, mit

a′ik = aik − li1 a1k und b′i = bi − li1 b1

für i = 2, 3 und k = 2, 3.

Dies bedeutet: Von der 2. bzw. 3. Zeile subtrahieren wir die mit l21 bzw. l31 multiplizierte 1. Zeile. Das

Ergebnis lautet also (in der dritten Zeile ändert sich nichts, wegen l31 = 0):

165

8

9

19

0 −4, 5 −66, 5 −412, 5

0

0

15

90

Im Prinzip sind wir nun schon fertig, weil praktischerweise in der dritten Zeile schon Nullen an den

gewünschten Stellen sind. (Das ist glücklicher Zufall, nicht die Regel!).

Aus der letzten Zeile folgt nun:

15x3 = 90 ⇔ x3 = 6.

Dies wird in die zweite Zeile eingesetzt, wir erhalten:

−4, 5x2 − 66, 5 · 6 = −412, 5

⇔

−4, 5x2 = −13, 5

⇔

x2 = 3

Diese beiden Ergebnisse wieder setzen wir in die erste Zeile ein, dies liefert:

8x1 + 9 · 3 + 19 · 6 = 165

⇔

8x1 = 24

⇔

x1 = 3

Die Lösung lautet also insgesamt: x1 = 3 Weißbiere, x2 = 3 Brezeln und x3 = 6 Weißwürste decken genau

den Tagesbedarf ab.

2.3

Eigenvektoren und Eigenwerte

Quelle: [3, 6]

Wir betrachten im folgenden eine (quadratische) Matrix der Dimension n × n.

Definition 14 (Eigenvektor, Eigenwert) Ein Vektor ~x 6= 0 heißt Eigenvektor von A zum Eigenwert λ, wenn gilt:

A · ~x = λ · ~x

Dies bedeutet also: Ein Eigenvektor ist ein Vektor, der von A auf ein Vielfaches

von sich selbst abgebildet wird.

Man kann sich das graphisch wie folgt vorstellen:

Fall 1:

x

Fall 2:

ist kein Eigenvektor

x ist Eigenvektor

Ax

Ax

x

x

26

Im rechten Fall wird ~x von A um den Faktor λ gestreckt.

Beispiel:

2

12

18

12

3

1

0 2 = 3 = 2

4

2

3

3

0 4 0

1

1

2

12

1 2 2

Wir stellen also fest: ~x = 2 ist Eigenvektor der Matrix A = 41 0 0 zum Eigenwert λ = 23 .

1

0 34 0

1

2

0

Bemerkung: Man kann eine Matrix A auch als lineare Abbildung f verstehen, in dem man betrachtet:

f : Rn → Rn , ~x 7→ f (~x) = A~x

Man spricht dann im oben genannten Kontext vom Eigenvektor λ von f .

Wie kann man Eigenwerte und Eigenvektoren finden? Mit Hilfe der Rechenregeln für Matrizen kann

man folgende Äquivalenzumformungen machen:

A~x

⇔

⇔

⇔

A~x − λ~x

A~x − λI~x

(A − λI)~x

= λ~x

= ~0

(Nullvektor)

= ~0

= ~0.

(I : n × n Einheitsmatrix )

Dies kann man (für gegebenes λ) als homogenes lineares Gleichungssystem für ~x, mit der Koeffizientenmatrix (A − λI) auffassen. Wie wir bereits gelernt haben, ist ~x = ~0 immer eine (triviale) Lösung für ein

homogenes LGS, allerdings ist das hier uninteressant. Es gibt nichttriviale Lösungen genau dann, wenn

(A − λI) singulär ist.

λ ist also ein Eigenwert, wenn (A − λI) singulär ist. Hierfür gibt es verschiedene, auch numerische, Berechnungsmethoden (z.B. über die “Determinante”) für den Fall n, dies führt hier aber zu weit.

Wir betrachten hier noch den Spezialfall n = 2, mit

a11 a12

.

A=

a21 a22

(Dabei nehmen wir an, dass A regulär ist).

Nun müssen wir überprüfen, wann (für welche λ) die Matrix

a11 − λ

a12

a21

a22 − λ

singulär wird. Dies ist der Fall, wenn wir beim linearen Gleichungssystem

(a11 − λ)x1 + a12 x2

a21 x1 + (a22 − λ)x2

=

0

=

0

eine nichttriviale Lösung finden (mit x1 , x2 6= 0).

Wenn a21 = 0, sieht man direkt: λ = a11 und λ = a22 ergeben eine singuläre Matrix, d.h. sind hier also

Eigenwerte.

Wenn a21 6= 0, können wir z.B. die zweite Gleichung nach x1 auflösen,

x=−

(a22 − λ)

x2 ,

a21

dies in die erste Gleichung eingesetzt ergibt:

(a22 − λ)

) + a12 x2 = 0

(a11 − λ) · (−

a21

27

Für eine nicht-triviale Lösung muss der vordere Term in der Klammer = 0 sein, wir multiplizieren dazu

mit a21 durch:

⇔

(a11 − λ) · (a22 − λ) − a12 a21

λ2 − (a11 + a22 )λ + a11 a22 − a12 a21

=

0

=

0

Mit der Mitternachtsformel erhalten wir dann als Eigenwerte:

p

a11 + a22 ± (a11 + a22 )2 − 4(a11 a22 − a12 a21 )

λ1,2 =

2

Beispiel:

A=

1

3

4

1

0

Nach unserer Formel müssten die Eigenwerte lauten:

q

1 + 0 ± (1 + 0)2 − 4(1 · 0 −

λ1,2 =

2

1

1 1√

1 + 3 = ± 1.

±

=

2 2

2

3

4

· 1)

also λ1 = 23 , λ2 = − 21 .

Nun berechnen wir die zugehörigen Eigenvektoren:

x1

3

, der folgende Bedingung erfüllt:

• Zu λ1 = 2 : Gesucht wird ein Vektor ~x =

x2

0

⇔

⇔

0

1

− x1 + x2

2

3

3

x1 − x2

4

2

= (A − λ1 I)~x

1

−2

1 − 32

1

x1

=

=

3

3

3

x

−

2

4

2

4

1

− 23

x1

x2

= 0

= 0.

Man sieht schnell: Jeder Vektor, für den x1 = 2x2 gilt, erfüllt beide Gleichungen (so soll es auch

sein). Ein Eigenvektor ist also z.B.

2

~x =

(und alle Vielfachen hiervon)

1

• Entsprechend zu λ2 =

− 21 :

Gesucht wird ein Vektor ~x =

0 =

⇔

⇔

0 =

3

x1 + x2

2

1

3

x1 + x2

4

2

x1

x2

, der folgende Bedingung erfüllt:

(A − λ2 I)~x

3

1

x1

2

3

1

x2

4

2

=

0

=

0.

Man sieht: Jeder Vektor, für den x1 = − 32 x2 gilt, erfüllt beide Gleichungen; Eigenvektor ist also

2 −3

~x =

(und alle Vielfachen)

1

28

Eigenwerte und Eigenvektoren werden in ganz verschiedenen Zusammenhängen benutzt und gebraucht!

Es macht also durchaus Sinn, sich damit zu beschäftigen.

Noch eine Bemerkung: Eigenwerte müssen nicht immer reell sein; auch komplexe Eigenwerte können

auftreten (obwohl die Matrix rein reell ist), Beispiel:

0 1

A=

−1 0

;

λ1m2

=

0±

=

±i.

p

0 − 4(−(−1) · 1)

1√

−4

=±

2

2

Dies kann man geometrische natürlich nicht mehr so einfach als Streckung interpretieren.

29