Statistik I für WInf und WI Prof. Dr. Wilhelm Stannat

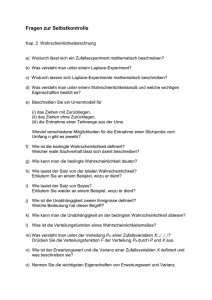

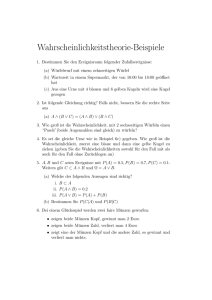

Werbung