Kurs 01306 - FernUniversität in Hagen

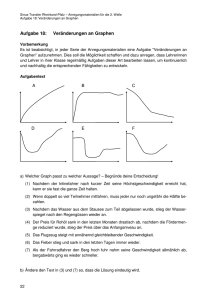

Werbung