Einstichprobenprobleme

Werbung

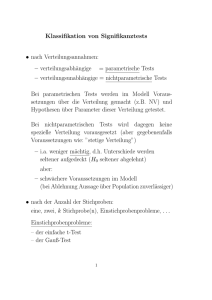

Klassifikation von Signifikanztests

Nach Verteilungsannahmen:

verteilungsabhängig: parametrischer [parametric] Test

verteilungsunabhängig: nichtparametrischer

[non-parametric] Test

Bei parametrischen Tests werden im Modell

Voraussetzungen über die Verteilung des interessierenden

Merkmals in der Grundgesamtheit gemacht

(z.B. Normalverteilung) und Hypothesen über Parameter

dieser Verteilung getestet. Bei nichtparametrischen Tests

wird dagegen keine spezielle Verteilung vorausgesetzt (aber

ggf. Voraussetzungen wie: stetige Verteilung).

1

Nichtparametrische Tests

– sind i.a. weniger mächtig als parametrische, d.h.

Unterschiede (Abweichungen von der Nullhypothese)

werden seltener aufgedeckt (H0 wird seltener abgelehnt),

– erfordern jedoch schwächere Voraussetzungen im Modell

(bei Ablehnung H0 von ist eine Aussage über die

Population zuverlässiger).

2

Nach der Anzahl der Stichproben:

eine Stichprobe: Einstichprobenproblem

zwei Stichproben: Zweistichprobenproblem

k Stichproben: Mehrstichprobenproblem (k ≥ 2)

Nach der Art der Erhebung der Stichproben:

abhängige (gepaarte [paired samle], verbundene)

Stichproben

unabhängige [independent] Stichproben

3

Abhängige (gepaarte, verbundene) Stichproben:

An jedem Objekt (Probanden) werden mehrere Merkmale

untersucht. Damit betrachten wir 2 (oder mehr) Zufallsvariablen über der gleichen Grundgesamtheit gemeinsam.

(X1 , Y1 ), . . . , (Xn , Yn ) zwei verbundene Stichproben vom

Umfang n

Beispiele:

– Blutdruck von PatientInnen vor und nach der Behandlung

mit einem Medikament

– Einkommen einer Person in den Jahren 2003, 2004, 2005

– Bildung und Einkommen einer Person

4

Unabhängige Stichproben:

An jedem Objekt (Probanden) wird nur ein Merkmal

untersucht. Untersucht werden verschiedene, disjunkte (sich

nicht überschneidende) Gruppen von Probanden (z.B. zwei

Gruppen mit n1 und n2 Mitgliedern) aus verschiedenen

Schichten der Grundgesamtheit (Subpopulationen).

Gesamte Stichprobe mit Stichprobenumfang n1 + n2 :

(X1 , . . . , Xn1 , Y1 , . . . , Yn2 )

Geschichtete Stichproben:

1. Schicht mit Stichprobenumfang n1 : (X1 , . . . , Xn1 )

2. Schicht mit Stichprobenumfang n2 : (Y1 , . . . , Yn2 )

Die beiden geschichteten Stichproben sind unabhängig.

5

Beispiele:

– Blutdruck von PatientInnen aus zwei unterschiedlich

behandelten Gruppen mit unterschiedlichen Personen

– Einkommen von Männern, Einkommen von Frauen

6

Einstichprobenprobleme

Einfacher t–Test (t–Test bei einer Stichprobe)

siehe Einführungsbeispiel [t-test, Student´s test ]

Binomialtest (Test einer Wahrscheinlichkeit)

[testing about a population proportion]

Anliegen: Sei A ein zufälliges Ereignis mit unbekannter

Wahrscheinlichkeit P (A) = ϑ, ϑ ∈ [0, 1]. Überprüfung einer

Hypothese über diese Wahrscheinlichkeit ϑ anhand von n

unabhängigen Versuchen und der daraus ermittelten

absoluten Häufigkeit des Eintretens von A.

7

Die mathematische Stichprobe

(X1 , X2 , . . . , Xn )

beschreibt, in welchen der n Versuche das Ereignis A

eingetreten ist (Bernoulli–Schema):

Xi =

1,

falls A im i–ten Versuch eintritt

0,

falls A im i–ten Versuch nicht eintritt

8

Hypothesen:

H0 : ϑ = ϑ0

HA : ϑ 6= ϑ0

(1)

HA : ϑ < ϑ0

(2)

HA : ϑ > ϑ0

(3)

Testgröße:

T

=

n

X

Xi

i=1

(absolute Häufigkeit des Eintretens von A)

Unter H0 ist T binomialverteilt mit den Parametern n und ϑ0 .

9

p–Wert:

p=

X

P (T = k)

bei (1)

k∈{0,...,n} mit

P (T =k)≤P (T =t)

p = P (T ≤ t) =

t

X

P (T = k)

bei (2)

P (T = k)

bei (3)

k=0

p = P (T ≥ t) =

n

X

k=t

Entscheidungsregel:

Ablehnung von H0 , falls p ≤ α.

10

SPSS berechnet bei Anwendung des Binomialtest die

Überschreitungswahrscheinlichkeit für die zweiseitige

Alternativhypothese (1) nur im Spezialfall ϑ0 = 1/2.

In diesem Fall ergeben sich auf Grund der Symmetrie der

Verteilung die p–Werte für die einseitigen Alternativen durch

halbieren des p–Wertes für die zweiseitige Alternative.

Für ϑ0 6= 1/2 gibt SPSS nur die p–Werte für eine der

einseitigen Alternativen aus, und zwar

– im Fall t/n < ϑ0 für die Alternative (2) und

– im Fall t/n > ϑ0 für die Alternative (3).

11

Für große n (n > 30) werden die Überschreitungswahrscheinlichkeiten nicht exakt mit Hilfe der Binomialverteilung

berechnet, sondern näherungsweise mit Hilfe der

Normalverteilung (Zentraler Grenzwertsatz).

12

Beispiel:

Im Beispiel Verkehrsmittel (n = 100) wurde 53 mal PKW als

Verkehrsmittel angegeben. Also ist t = 53. Beim Test der

Nullhypothese H0 : ϑ = ϑ0 = 0.4 gegen die

Alternativhypothese HA : ϑ > ϑ0 = 0.4 errechnet SPSS (nach

(3)) die Überschreitungswahrscheinlichkeit

P100

p = P (T ≥ 53) = k=53 P (T = k) = 0.006. Bei einem

gewählten Signifikanzniveau von α = 0.05 wird die

Nullhypothese also abgelehnt.

Bemerkung: Für dieses Beispiel hatten wir für den Anteil in

der Grundgesamtheit das Konfidenzintervall [0.432, 0.628]

zum Konfidenzniveau 0.95 = 1 − 0.05 berechnet.

13

χ2 –Anpassungstest [goodness of fit test]

Anliegen: Nichtparametrischer Test zum Überprüfen der

(parametrischen) Modellannahme, dass eine gegebene

konkrete Stichprobe (x1 , x2 , . . . , xn ) aus einer

Grundgesamtheit mit einer bestimmten Verteilung FX = F0

stammt. Dabei bezeichnet FX die Verteilung des

interessierenden Merkmales X in der Grundgesamtheit.

Der Test wird z.B. auch zum Prüfen von Voraussetzungen für

andere (parametrische) Tests verwendet.

Hypothesen:

H0 : FX = F0

HA : FX 6= F0

14

Vorgehen: Falls keine kategorialen Daten vorliegen,

zunächst Klasseneinteilung für die Daten in k Klassen

(vgl. Histogramme)

Ki = (ai , ai+1 ]

pi = P0 (X ∈ Ki ) = F0 (ai+1 ) − F0 (ai )

Hi

:

absolute Klassenhäufigkeit

Dann ist npi die theoretische, unter der Nullhypothese

erwartete Häufigkeit und Hi die beobachtete Häufigkeit der

i–ten Klasse.

15

Testgröße:

T =

k

X

(Hi − npi )2

npi

i=1

Unter H0 ist T asymptotisch, d.h. näherungsweise für

hinreichend große Stichproben, χ2 –verteilt mit k − 1

Freiheitsgraden.

Enthält F0 noch r unbekannte Parameter (z.B. Normalverteilung r = 2: falls Erwartungswert µ und Varianz σ 2

unbekannt), so sind diese aus der Stichprobe, basierend auf

der Klasseneinteilung, zu schätzen. Die χ2 –Verteilung besitzt

dann k − r − 1 Freiheitsgrade.

16

p–Wert:

p = P (T ≥ t)

Entscheidungsregel:

Ablehnung von H0 , falls p ≤ α.

17

Achtung:

– Beim Testen von Modellannahmen will man eigentlich H0

annehmen, dann bleibt der i.a. unbekannte Fehler 2. Art.

– Mit genügend großen Datenmengen sollte jede

Modellannahme widerlegbar sein.

– Man sollte also zunächst gute Gründe für die

Modellannahme haben und will sich mit dem Test lediglich

vor Fehlinterpretationen schützen.

18

Bemerkungen:

– Für die Asymptotik, also für eine gute Näherung durch die

χ2 –Verteilung, Klasseneinteilung so, dass npi ≥ 5 gilt; also

ggf. Klassen zusammenfassen, Randklassen beachten.

– SPSS bietet auch die Möglichkeit, exakte

Überschreitungswahrscheinlichkeiten zu berechnen.

– Klasseneinteilung willkürlich, Möglichkeit zur

Manipulation (vgl. Histogramme)

– Für sehr große n fast immer Ablehnung von H0 .

19

Kolmogorov–Smirnov–Test

Anliegen: wie beim χ2 –Anpassungstest

Voraussetzungen:

Verteilungsfunktion FX von X

– ist stetig und

– unter H0 vollständig bekannt (keine Parameter zu

schätzen)

Hypothesen:

H0 : FX = F0

HA : FX 6= F0

20

Testgröße:

T = sup |Fn (x) − F0 (x) |

x∈R

(größte Abweichung der empirischen Verteilungsfunktion Fn

von F0 )

Unter H0 ist T Kolmogorov–verteilt mit n Freiheitsgraden.

p–Wert:

p = P (T ≥ t)

Entscheidungsregel:

Ablehnung von H0 , falls p ≤ α.

21

Bemerkungen:

– Test ist von Hand praktisch nicht durchführbar →

Computer.

– Sind Parameter zu schätzen → Korrektur der p–Werte

(z.B: Lilliefors–Test für Test auf Normalverteilung)

– Für den Test auf Normalverteilung existieren bessere

spezielle Tests (z.B. Shapiro–Wilk–Test)

22