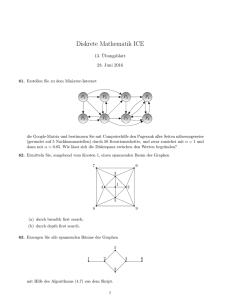

Graphen - Computer Science

Werbung