15 Hamiltonsche Mechanik

Werbung

15 Hamiltonsche Mechanik

Wie bereits an anderer Stelle kurz erwähnt, stellt das Wirkungsprinzip so etwas wie das Bindeglied zwischen der klassischen Physik und der Quantenphysik her. Wenn man für ein bestimmtes mechanisches

System ein Wirkungsprinzip angeben kann, dann lässt sich dasselbe System auch im Rahmen der Quantenmechanik konsistent beschreiben.

Wie dieser Übergang von der klassischen zur Quantenmechanik aussieht, ist natürlich nicht Inhalt dieser

Vorlesung. Man kann den Übergang jedoch bereits im Rahmen der klassischen Physik vorbereiten und ihn

damit sowohl technisch als auch konzeptuell erleichtern. Wir formulieren dazu das Wirkungsprinzip aus

dem letzten Kapitel ein wenig um, und gelangen so zur Hamiltonschen Formulierung der Bewegungsgleichungen für ein mechanisches System.

Unabhängig von ihrer Bedeutung für die Quantenmechanik haben die Bewegungsgleichungen in dieser

Form auch in der klassischen Mechanik einige sehr nützliche Eigenschaften. So können wir zum Beispiel

die Zeitentwicklung eines Systems in einer geometrisch sehr anschaulichen Art und Weise darstellen.

Darüber hinaus können wir einige Sätze über Erhaltungsgrößen beweisen, die das Auffinden von Lösungen

erleichtern.

Die Wirkung erster Ordnung

Ein Extremalproblem, das von mehreren Variablen abhängt, kann man schrittweise lösen. Ist zum Beispiel

das Minimum einer Funktion (x, y) 7→ h(x, y) gesucht, so können wir zuerst x als Konstante betrachten

und das Minimum der Funktion y 7→ h(x, y) suchen. Nehmen wir an, diese Funktion hätte ein Minimum

bei y = ymin (x), wobei der Wert von ymin im allgemeinen von x abhängen wird. Im zweiten Schritt

betrachten wir dann die Funktion x 7→ h(x, ymin (x)). Wenn diese Funktion bei x = x0 ein Minimum hat,

so liegt das gesuchte Minimum der Funktion (x, y) 7→ h(x, y) bei x = x0 und y = ymin (x0 ).

Wir können auch umgekehrt vorgehen, also zuerst y als Konstante betrachten und die Funktion x 7→

h(x, y) minimieren. Nehmen wir wieder an, das Minimum dieser Funktion befinde sich bei x = x min (y).

Dann müssen wir nur noch die Funktion y 7→ h(xmin (y), y) minimieren, um das gestellte Extremalproblem

zu lösen. Wenn das Minimum dieser Funktion bei y = y0 liegt, so finden wir das Minimum der Funktion

h(x, y) diesmal bei x = xmin (y0 ) und y = y0 . Da das Ergebnis in beiden Fällen dasselbe sein muss, gilt

natürlich x0 = xmin (y0 ) bzw. y0 = ymin (x0 ).

Ein typisches Beispiel für ein Extremalproblem dieser Art ist, die kürzeste Verbindung zwischen zwei

Teilmengen eines metrischen Raumes zu finden. Ist x ein Punkt in der ersten Teilmenge, y ein Punkt in

der zweiten Teilmenge, so ist der Abstand dieser Punkte eine Funktion d(x, y) der beiden Punkte. Man

findet den minimalen Abstand der beiden Teilmengen, indem man zuerst für jeden Punkt x in der einen

Teilmenge den nächsten Punkt y in der zweiten Teilmenge sucht, und anschließend denjenigen Punkt x

auswählt, für den dieser minimale Abstand wiederum minimal wird.

Eigentlich ist es aber nicht diese Lösungsstrategie für spezielle Extremalprobleme, die uns an dieser Stelle interessiert, sondern ein ganz anderer Aspekt, der sich aus diesen Überlegungen ergibt. Betrachten wir noch einmal die jeweils im zweiten Schritt auftretenden, zu minimierenden Funktionen

x 7→ h(x, ymin (x)) bzw. y 7→ h(xmin (y), y). Beides sind Funktion, die von jeweils einer reellen Variablen abhängen. Es sind jedoch im allgemeinen völlig andere Funktionen, denen man unter Umständen

gar nicht mehr ansieht, dass sie sich auf die dargestellte Art und Weise aus einer Funktion h(x, y) ableiten

lassen. Trotzdem sind die beiden durch diese Funktionen definierten Extremalprobleme in einem gewissen

Sinne äquivalent. Beide lösen dasselbe, ursprünglich gestellte Extremalproblem, das von zwei Variablen

abhing.

Nehmen wir nun an, der Ausgangspunkt sei gar nicht dieses Problem, sondern das Extremalproblem für

die Funktion x 7→ h(x, ymin (x)). Dann können wir dieses Extremalproblem auf ein äquivalentes Problem

139

abbilden, nämlich auf das für die Funktion y 7→ h(xmin (y), y), indem wir gewissermaßen einen “Umweg”

über das Extremalproblem für (x, y) 7→ h(x, y) machen. Unter Umständen kann dieser Umweg nützlich

sein, etwa wenn das äquivalente Extremalproblem eine sehr viel einfachere Lösung besitzt.

Auf dieser Idee beruht im wesentlichen die Hamiltonsche Formulierung der Bewegungsgleichungen

eines mechanisches Systems, die wir im folgenden herleiten wollen. Man geht von dem bekannten Wirkungsprinzip aus, und ersetzt dieses durch ein anderes, äquivalentes Wirkungsprinzip, aus dem man

schließlich eine neue, etwas einfachere Darstellung der Bewegungsgleichungen erhält.

Es sei also ein mechanisches System gegeben mit einem Konfigurationsraum Q und einer LagrangeFunktion L(q, v, t), mit q ∈ Q und v ∈ T Q. Die Wirkung einer Bahn q(t) mit den Randbedingungen

q(t1 ) = q1 und q(t2 ) = q2 ist dann

S[q] =

Z

t2

t1

L q(t), q̇(t), t dt,

(15.1)

und das Wirkungsprinzip verlangt, dass dieses Funktional für die physikalische Bahn stationär wird.

Da wir im folgenden zwischen der Geschwindigkeit als Argument der Lagrange-Funktion und der Geschwindigkeit als Ableitung einer Bahn nach der Zeit unterscheiden müssen, verwenden wir für das Argument der Lagrange-Funktion ein anderes Symbol. Wir schreiben also L(q, v, t), um deutlich zu machen, dass die Lagrange-Funktion von einem Punkt q ∈ Q im Konfigurationsraum und von einem Vektor

v ∈ T Q im Tangentenraum abhängt. Zwischen diesen Argumenten besteht zunächst kein Zusammenhang.

Erst, wenn wir die Lagrange-Funktion entlang einer Bahn q(t) auswerten, so wie dies in (15.1) geschieht, ist es sinnvoll, für q den Punkt q(t) und für v die Zeitableitung q̇(t) einzusetzen. Diesen Umstand

haben wir bisher durch eine etwas verkürzte Notation verschleiert. Es sollte aber klar sein, dass es erst

dann einen Sinn hat, von einer Geschwindigkeit als Zeitableitung des Ortes zu sprechen, wenn dieser eine

Funktion der Zeit ist.

Man kann nun dieses “Einsetzen” der Bahn in die Lagrange-Funktion und das anschließende Berechnen der Wirkung noch auf eine andere Art und Weise beschreiben. Wir betrachten dazu das erweiterte

Wirkungsfunktional, das sich ergibt, wenn wir die Funktionen q(t) und v(t) als voneinander unabhängig

betrachten. Wir verlangen also nicht, dass v(t) = q̇(t) ist. Wir bekommen dann ein Funktional, dass von

zwei Funktionen abhängt, nämlich

S[q, v] =

Z

t1

t2

L q(t), v(t), t dt.

(15.2)

Das Wirkungsprinzip besagt nun, dass die physikalisch realisierte Bahn dieses Funktional stationär macht,

allerdings nicht um Raum aller Funktionen q(t) und v(t), sondern in einem Teilraum davon, nämlich in

demjenigen Unterraum, der durch die Beziehung v(t) = q̇(t) bestimmt wird.

Das ist eine an die Argumente des Funktionals gestellte Nebenbedingung, die wir mit Hilfe von

Lagrange-Multiplikatoren berücksichtigen können. Die Gleichung v(t) = q̇(t) muss zu jedem Zeitpunkt

erfüllt sein, und sie setzt sich als Vektorgleichung aus dim Q Komponenten v µ (t) = q̇ µ (t) zusammen. Wir

brauchen deshalb für jeden Zeitpunkt t und für jeden Wert des Index µ einen Multiplikator. Wir bezeichnen diese Multiplikatoren mit pµ (t) und fassen die Komponenten zu einem dualen Vektor p(t) zusammen,

der selbst wieder zu einer Funktion der Zeit wird.

Dann lässt sich das Wirkungsprinzip wie folgt formulieren. Wir betrachten alle möglichen Bahnen q(t)

von q(t1 ) = q1 nach q(t2 ) = q2 , sowie alle glatten Funktionen v(t) und p(t) für t1 ≤ t ≤ t2 , an die

wir keine weiteren Randbedingungen stellen müssen. Als Funktional davon definieren wir die erweiterte

140

Wirkung

S[q, v, p] =

Z t2

t1

µ

µ

L q(t), v(t), t + pµ (t) q̇ (t) − v (t)

dt.

(15.3)

Schließlich verlangen wir, dass die physikalische Bahn diejenige ist, für die dieses Funktional stationär

wird, und zwar bei einer gleichzeitigen Variation aller Argumente, also der Funktionen q(t), v(t) und

p(t).

Obwohl es sich eigentlich aus der Konstruktion ergibt, wollen wir zeigen, dass aus diesem Wirkungsprinzip tatsächlich wieder auf die ursprünglichen Bewegungsgleichungen folgen. Wir variieren zuerst die

Funktion p(t). Das ergibt unmittelbar

δS[q, v, p] =

Z

t2

t1

δpµ (t) q̇ µ (t) − v µ (t) dt.

(15.4)

Die Wirkung ist genau dann bei einer beliebigen Variation δpµ (t) der Lagrange-Multiplikatoren pµ (t) stationär, wenn die Geschwindigkeiten v µ (t) die Zeitableitungen der Koordinatenfunktionen q µ (t) sind. Das ist

natürlich nicht weiter überraschend, denn genau das hatten wir als Nebenbedingung gefordert, und dafür

die Funktionen pµ (t) als Lagrange-Multiplikatoren eingeführt. Aus dem erweiterten Wirkungsprinzip folgt

also

v µ (t) = q̇ µ (t).

(15.5)

Als nächstes betrachten wir eine Variation der Funktion v(t). Für diese gilt

δS[q, v, p] =

Z

t2

δv µ (t)

t1

∂L

q(t),

v(t),

t

−

p

(t)

dt.

µ

∂v µ

(15.6)

Dieser Ausdruck verschwindet genau dann für alle δv µ (t), wenn

pµ (t) =

∂L

µ q(t), v(t), t

∂v

(15.7)

ist. Wenn L, wie es üblicherweise für ein mechanisches System der Fall ist, durch T − V gegeben ist, und

wenn nur die kinetische Energie T von der Geschwindigkeit abhängt, so stehen auf der rechten Seite dieser

Gleichung die verallgemeinerten Impulse, die wir ursprünglich als Ableitungen der kinetischen Energie

nach den Komponenten der Geschwindigkeit definiert hatten.

Es liegt deshalb nahe, diese Definition noch weiter zu verallgemeinern, und die Größen p µ (t) auch dann

als Impulse zu bezeichnen, wenn die Lagrange-Funktion nicht von der speziellen Form L = T − V ist. Wir

ändern unsere Definition aus Kapitel 11 ab, indem wir den Impuls nicht mehr als Ableitung der kinetischen

Energie nach der Geschwindigkeit definieren, sondern statt dessen von der Lagrange-Funktion ausgehen.

Der Impuls eines mechanischen Systems ist die Ableitung der Lagrange-Funktion nach der

Geschwindigkeit.

Das erklärt auch, warum es sinnvoll war, die Multiplikatoren pµ (t) zu einem dualen Vektor p(t) zusammenzufassen. Da L ein Skalar ist und v µ die Komponenten eines Vektors sind, sind pµ = ∂L/∂v µ die

Komponenten eines dualen Vektors. Der in (15.3) unter dem Integral gebildete Ausdruck ist das Produkt

des dualen Vektors p(t) mit dem Vektor v(t) − q̇(t), also wieder ein Skalar. Die erweiterte Wirkung ist somit unabhängig davon, in welchem Koordinatensystem wir sie ausrechnen, wenn wir alle dort auftretenden

Größen entsprechend transformieren.

141

Nun müssen wir noch zeigen, dass die erweiterte Wirkung auch tatsächlich die richtigen Bewegungsgleichungen liefert. Wir müssen dazu noch eine Variation der Bahn q(t) betrachten. Das ergibt

δS[q, v, p] =

Z t2

δq µ (t)

t1

∂L

µ

q(t),

v(t),

t

+

δ

q̇

(t)

p

(t)

dt.

µ

∂q µ

(15.8)

Im Gegensatz zu den beiden vorherigen Variationen müssen wir hier eine partielle Integration durchführen,

um die Zeitableitung von der Variation δ q̇ µ (t) zu entfernen. Es tritt also ein Randterm auf,

h

µ

δS[q, v, p] = δq (t) pµ (t)

i t2

t1

+

Z

t1

t2

∂L

δq (t)

q(t), v(t), t − ṗµ (t) dt.

∂q µ

µ

(15.9)

Der Randterm verschwindet jedoch, da wir an die Bahn q(t) die üblichen Randbedingungen stellen, also

die Anfangs- und Endkonfiguration festgelegen. Daher verschwindet δq µ (t) bei t = t1 und t = t2 . Es

bleibt schließlich die Gleichung

∂L

(15.10)

ṗµ (t) = µ q(t), v(t), t .

∂q

Fassen wir das Ergebnis noch einmal wie folgt zusammen. Die erweiterte Wirkung (15.3) ist genau dann

stationär, wenn die Funktionen q(t), v(t) und p(t) den Gleichungen

v µ (t) = q̇ µ (t),

pµ (t) =

∂L

µ q(t), v(t), t ,

∂v

ṗµ (t) =

∂L

µ q(t), v(t), t

∂q

(15.11)

genügen. Dass diese Gleichungen zu den ursprünglichen Bewegungsgleichungen äquivalent sind, sieht

man nun sehr leicht. Man muss nur die Funktionen v(t) und p(t) eliminieren, indem man die ersten beiden

Gleichungen in die dritte Gleichung einsetzt. Das führt unmittelbar auf die Euler-Lagrange-Gleichung

∂L

d ∂L

µ q(t), q̇(t), t −

µ q(t), q̇(t), t = 0.

dt ∂ q̇

∂q

(15.12)

Aufgabe 15.1 Man wiederhole die einzelnen Schritte in diesem Kapitel f ür den speziellen Fall eines mechanisches Systems mit einem Freiheitsgrad mit L(q, v) = m v 2 /2 − V (q).

Aufgabe 15.2 Bei der Herleitung der Bewegungsgleichungen aus der erweiterten Wirkung sind wir

schrittweise vorgegangen, indem wir zuerst nur die Funktion p(t) variiert haben, dann nur die Funktion v(t), und schließlich nur die Funktion q(t). Das Wirkungsprinzip verlangt jedoch, dass die Wirkung

unter einer gleichzeitigen Variation aller Argumente stationär ist. Genau genommen haben wir aber nur

sehr spezielle Richtungsableitungen des Funktionals (15.3) berechnet und von diesen verlangt, dass sie

Null sind. Warum führt dieses Vorgehen trotzdem zum richtigen Resultat?

Die Hamilton-Funktion

Was haben wir mit diesem nochmaligen Umschreiben der Bewegungsgleichungen nun eigentlich gewonnen? Sind die neuen Gleichungen (15.11) nicht viel komplizierter als die alten Euler-LagrangeGleichungen (15.12)? In einem gewissen Sinne schon, da sie von mehr Funktionen abhängen, aber in

einem anderen Sinne sind sie auch einfacher. Sie bilden nämlich ein System von Differenzialgleichungen

erster Ordnung. Es kommen nur noch die ersten Ableitungen der gesuchten Funktionen nach der Zeit vor,

und die Gleichungen sind sogar nach diesen aufgelöst.

142

Die mittlere der drei Bewegungsgleichungen ist darüber hinaus noch nicht einmal eine echte Differenzialgleichung. Wir werden dies jetzt benutzen, um eine der beiden Hilfsfunktionen wieder zu eliminieren.

Dazu benutzen wir die am Anfang beschriebene Methode. Ein Variationsproblem können wir schrittweise

lösen. Wir betrachten zuerst nur eine Variation der Funktion v(t), während wir die Funktionen q(t) und

p(t) festhalten. Wie wir gesehen haben, führt dies auf die Gleichung

pµ (t) =

∂L

µ q(t), v(t), t .

∂v

(15.13)

Sie stellt eine Beziehung zwischen den Größen p(t), v(t) und q(t) her, die zu jedem Zeitpunkt t gelten

muss. Es treten dabei keine Zeitableitungen auf, so dass die Gleichung zu jedem Zeitpunkt unabhängig

von den Gleichungen zu allen anderen Zeitpunkten ist.

Wir nehmen nun an, dass diese Gleichung nach v(t) auflösbar ist. Mit anderen Worten, wir können

v(t) als Funktion von q(t) und p(t) darstellen. Für typische mechanische Systeme, wie wir sie bisher

kennen gelernt haben, ist dies immer der Fall. Die Geschwindigkeit ist immer eindeutig durch den Impuls

bestimmt, wobei der Zusammenhang aber vom Ort abhängen kann, zum Beispiel wenn wir ein krummliniges Koordinatensystem benutzen oder Zwangsbedingungen vorliegen. Für Systeme mit zeitabhängigen

Zwangsbedingungen kann der Zusammenhang auch zeitabhängig sein.

Wenn diese Voraussetzung erfüllt ist, können wir die Geschwindigkeit v(t) immer so bestimmen, dass

das Funktional S[q, v, p] bezüglich einer Variation von v(t) stationär ist. Es bleibt dann noch ein reduziertes Funktional

S[q, p] =

Z t2

t1

h

i

pµ (t) q̇ µ (t) − pµ (t) v µ (t) − L q(t), v(t), t

= ( , ,t)

dt,

(15.14)

das nur noch von den Funktionen q(t) und p(t) abhängt, und dessen Variation bezüglich dieser Funktionen

für die physikalischen Bahnen verschwinden muss.

In der eckigen Klammer müssen wir für v(t) die in (15.13) gefundene Lösung einsetzen, was durch die

etwas verkürzte Notation v = v(q, p, t) angedeutet werden soll. Wir wollen uns diesen Ausdruck etwas

genauer ansehen. Es handelt sich um eine Funktion, die nur von q(t), p(t) und t abhängt, nicht aber von

den Ableitungen dieser Größen oder ihren Werten zu anderen Zeitpunkten. Das folgt aus der Tatsache,

dass die Gleichung (15.13), die v(t) als Funktion von q(t) und p(t) bestimmt, zwar im allgemeinen von

der Zeit t abhängen kann, aber keine Zeitableitungen enthält und alle drei Größen nur zu einem Zeitpunkt

eingehen.

Man nennt den Ausdruck in der eckigen Klammer die Hamilton-Funktion des mechanischen Systems.

Eine sehr elegante Art und Weise, die Hamilton-Funktion darzustellen, ist

HamiltonFunktion

H(q, p, t) = Ext pµ v µ − L(q, v, t) ,

(15.15)

wobei Ext für das Extremum im Raum aller Geschwindigkeiten v steht. Wie wir gleich sehen werden,

handelt es sich typischerweise um ein Maximum, aber darauf kommt es nicht an. Tatsächlich liefert das

Extremum des Ausdrucks (15.15) bis auf ein Vorzeichen genau die eckige Klammer in (15.14). Das Extremum liegt nämlich bei der Geschwindigkeit v, für die pµ = ∂L/∂v µ ist.

Am besten machen wir uns dies an ein paar Beispielen klar. Zunächst betrachten wir ein Teilchen in einer

Raumrichtung, das sich in einem Potenzial bewegt. Seine Lagrange-Funktion ist L(q, v) = m v 2 /2−V (q).

Sie hängt nicht explizit von der Zeit ab, so dass auch die Hamilton-Funktion nicht zeitabhängig ist. Man

findet

p2

m 2

+ V (q).

(15.16)

H(q, p) = Ext p v − v + V (q) =

v

2

2m

143

Hier haben wir verwendet, dass der Ausdruck in der Klammer sein Extremum bei v = p/m annimmt

und dies dann für v eingesetzt. Wie man leicht sieht, ist die Hamilton-Funktion in diesem Fall gerade die

Gesamtenergie des Teilchens, ausgedrückt als Funktion von Ort und Impuls.

Das gilt sogar ganz allgemein. Wenn nämlich L = T − V ist, und T eine quadratische Funktion der

Geschwindigkeit ist, die wir durch eine symmetrische Massenmatrix darstellen können, während V nur

vom Ort abhängt, so findet man

1

∂L

Mµν (q) v µ v ν − V (q) ⇒ pµ = µ = Mµν (q) v ν .

(15.17)

2

∂v

Für mechanische Systeme ist die kinetische Energie immer positiv, also ist die Massenmatrix invertierbar.

Wie bezeichnen die inverse Matrix mit M µν (q), und können dann die Geschwindigkeit als Funktion des

Ortes und des Impulses darstellen,

L(q, v) =

M µν (q) Mνρ (q) = δ µρ

⇒

v µ = M µν (q) pν .

(15.18)

Nun können wir die Hamilton-Funktion berechnen. Es ist

1

1

H(q, p) = Ext pµ v µ − Mµν (q) v µ v µ + V (q) = M µν (q) pµ pν + V (q).

(15.19)

2

2

Der erste Summand ist, wie man sich leicht überzeugt, wieder die kinetische Energie, jetzt allerdings dargestellt als Funktion des Ortes q und des Impulses p. Und der zweite Summand ist natürlich die potenzielle

Energie.

Der Übergang von der Lagrange-Funktion, die eine Funktion von Ort und Geschwindigkeit ist, zur

Hamilton-Funktion als Funktion von Ort und Impuls, bewirkt in diesem Fall, dass sich das relative Vorzeichen von kinetischer und potenzieller Energie umkehrt. Allerdings gilt dieser Zusammenhang nur dann,

wenn sich die Lagrange-Funktion in der Form L = T − V darstellen lässt, und T quadratisch von der

Geschwindigkeit abhängt. Dann ist H = T + V, also die Gesamtenergie.

Wenn die Lagrange-Funktion nicht von dieser speziellen Form ist, ist es trotzdem sinnvoll, die HamiltonFunktion mit der Energie des Systems zu identifizieren. In diesem Fall ist nämlich die Größe Energie noch

gar nicht definiert. Die einzige Stelle, an der wir diesen Begriff bisher im Rahmen der Lagrangeschen

Mechanik verwendet haben, war die Definition der Lagrange-Funktion als Differenz von kinetischer und

potenzieller Energie. Wir nehmen uns daher die Freiheit, den Begriff Energie auf diese Weise zu verallgemeinern.

Die Hamilton-Funktion repräsentiert die Gesamtenergie eines mechanischen Systems als

Funktion von Ort und Impuls.

Warum das sinnvoll ist, werden wir in den nächsten Abschnitten sehen. Unter bestimmten Voraussetzungen

ist nämlich die Hamilton-Funktion eine Erhaltungsgröße, und zwar unabhängig davon, ob L = T − V

und somit H = T + V ist oder nicht. Dies führt auf eine Verallgemeinerung des Energieerhaltungsatzes,

wenn man den Begriff der Energie entsprechend verallgemeinert.

Fassen wir an dieser Stelle noch einmal kurz zusammen, was wir bisher getan haben. Ausgehend von

der Lagrange-Funktion und dem daraus abgeleiteten Wirkungsprinzip (15.1) sind wir zu einer alternativen,

aber äquivalenten Formulierung übergegangen, bei dem die Wirkung durch (15.14) oder

S[q, p] =

t2

Z

t1

µ

pµ (t) q̇ (t) − H q(t), p(t), t

dt

(15.20)

als Funktional der Funktionen q(t) und p(t) gegeben ist. Die Hamilton-Funktion H(q, p, t) ergibt sich

dabei durch (15.15) aus der Lagrange-Funktion L(q, v, t). Jetzt müssen wir nur noch verlangen, dass

diese Wirkung stationär wird, um die physikalischen Bahnen zu finden.

144

Aufgabe 15.3 Der Übergang von der Lagrange- zur Hamilton-Funktion wird in der Mathematik als

Legendre-Transformation bezeichnet. Sie ist, ähnlich wie die Fourier-Transformation, eine Abbildung

zwischen Funktionen, die von verschiedenen Argumenten abh ängen. Man zeige, dass die Umkehrung

der Legendre-Transformation wieder eine solche Transformation ist. Man kann also aus der HamiltonFunktion H(q, p, t) wieder die Lagrange-Funktion L(q, v, t) bestimmen, indem man das Extremum

(15.21)

L(q, v, t) = Ext pµ v µ − H(q, p, t)

bildet. Die Transformation L(q, v) ↔ H(q, p) ist in diesem Sinne symmetrisch. Man verifiziere dies

explizit am Beispiel eines Teilchens im Potenzial in einer Raumdimension.

Aufgabe 15.4 Wenn der Konfigurationsraum Q des mechanischen Systems eine glatte Mannigfaltigkeit

ist, so hatten wir am Ende von Kapitel 13 gezeigt, dass die Lagrange-Funktion L eine reelle Funktion, also ein skalares Feld auf dem Tangentenbündel T(Q) ist. Auf welchem Raum ist in diesem Fall die

Hamilton-Funktion H eine reelle Funktion? Warum ist sie unabhängig von dem in der Definition (15.15)

verwendeten Koordinatensystem?

Aufgabe 15.5 Bekanntlich ist die Lagrange-Funktion eines geladenen Teilchens im elektromagnetischen

Feld durch den Ausdruck (11.77) gegeben,

L(r, v) =

1

q

m v · v + A(r, t) · v − q φ(r, t),

2

c

(15.22)

wobei A(r, t) das magnetische Vektorpotenzial und φ(r, t) das elektrische Potenzial sind. Wie sieht die

Hamilton-Funktion aus? Welcher Zusammenhang besteht zwischen dem Impuls p und der Geschwindigkeit

v?

Bewegungsgleichungen und Phasenraum

Nun kommen wir zurück zu den eigentlichen Bewegungsgleichungen des mechanischen Systems. Wie

wir gerade gezeigt haben, ergeben sie sich aus dem Wirkungsprinzip (15.20), das heißt das dort definierte

Funktional muss für physikalische Bahnen stationär sein. Als Randbedingungen geben wir wieder die

Konfigurationen q(t1 ) = q1 am Anfang und q(t2 ) = q2 am Ende des Zeitintervalls vor. An die Impulse

p(t1 ) und p( t2 ) müssen wir keine Einschränkungen machen.

Die Bewegungsgleichungen, die sich daraus ergeben, haben eine sehr einfache Form. Variieren wir

zuerst wieder die Funktion p(t), so finden wir

δS[q, p] =

Z

t2

t1

∂H

δpµ (t) q̇ (t) −

q(t), p(t), t dt.

∂pµ

µ

(15.23)

Entsprechend ergibt eine Variation von q(t), nachdem wir die übliche partielle Integration durchgeführt

haben,

Z t2

∂H

(15.24)

δS[q, p] = − δq µ (t) ṗµ (t) + µ q(t), p(t), t dt.

∂q

t1

Damit die Wirkung stationär ist, müssen die folgenden Bewegungsgleichungen erfüllt sind.

Hamiltonsche

Bewegungsgleichungen

q̇ µ =

∂H

,

∂pµ

145

ṗµ = −

∂H

.

∂q µ

(15.25)

Dies ist ein System von Differenzialgleichungen erster Ordnung, die bereits nach den Ableitungen der

Funktionen q(t) und p(t) aufgelöst sind. Einfacher lassen sich die Bewegungsgleichungen für ein mechanisches System eigentlich nicht mehr darstellen.

Viele typische Eigenschaften von mechanischen Systemen können wir aus diesen Hamiltonschen Bewegungsgleichungen sofort ablesen. So zum Beispiel die Eigenschaft, dass die Zeitentwicklung eines Systems eindeutig festgelegt ist, wenn wir zu irgendeinem Zeitpunkt t 0 sowohl den Ort q(t0 ) = q0 als auch

den Impuls p(t0 ) = p0 kennen. In diesem Sinne ist der Zustandsraum des Systems, also die Menge aller

Bewegungszustände, die das System annehmen kann und die die Zeitentwicklung eindeutig festlegen, nun

der Raum aller Orte q und Impulse p. Man nennt diesen Raum den Phasenraum.

Der Phasenraum P eines mechanischen Systems ist der Menge aller Bewegungszust ände,

dargestellt durch den Ort q ∈ Q und den Impuls p ∈ T Q.

Ist der Konfigurationsraum Q des System ein affiner Raum, so ist der Ort q ∈ Q ein Punkt in diesem

Raum und der Impuls ein dualer Vektor p ∈ T∗ Q. Folglich ist der Phasenraum der Produktraum P =

Q × T∗ Q. Dies ist wieder ein affiner Raum, wobei dim P = 2 dim Q ist. Der Phasenraum hat also für

jeden Freiheitsgrad zwei Dimensionen.

Wenn der Konfigurationsraum Q kein affiner Raum ist, sondern nur eine glatte Mannigfaltigkeit, so

müssen wir zusätzlich beachten, dass der duale Vektor p ein Vektor am Bezugspunkt q ist, also im Kotangentenraum T ∗ Q. Der Phasenraum ist dann die Menge aller Paare (q, p) mit q ∈ Q und p ∈ T ∗ Q. Das

ist das Kotangentenbündel P = T∗ (Q) des Konfigurationsraum, also der zu dem am Ende von Kapitel 13

eingeführten Tangentenbündel T(Q) duale Raum.

Auf jeden Fall ist der Phasenraum ein 2 N -dimensionaler Raum, wenn das System N Freiheitsgrade

besitzt. Zu jedem Koordinatensystem {q µ } auf Q gehört ein Satz von verallgemeinerten Impulsen {pµ },

die die Komponenten eines dualen Vektors bilden. Man bezeichnet die Größen {p µ } in der Hamiltonschen

Mechanik auch als die den Koordinaten {q µ } zugeordneten kanonisch konjugierten Impulse.

Gemeinsam bilden die Ortskoordinaten und die konjugierten Impulse ein kanonisches Koordinatensystem ({q µ }, {pµ }) auf dem Phasenraum P. Jeder Bewegungszustand wird auf diese Weise eindeutig durch

eine Satz von 2 N reelle Zahlen festgelegt.

Ein kanonisches Koordinatensystem auf dem Phasenraum P eines mechanischen Systems

besteht aus den Ortskoordinaten {q µ } auf dem Konfigurationsraum Q und den konjugierten

Impulsen {pµ }, die die Komponenten eines dualen Vektors bilden.

Wenn wir zu einem anderen Koordinatensystem {q µ } auf dem Konfigurationsraum übergehen, so müssen

wir auch die Impulskomponenten {pµ } und die Hamilton-Funktion entsprechend transformieren. Verwenden wir die Notation aus Kapitel 13 und bezeichnen das “alte” Koordinatensystem mit {q (m)µ } und das

“neue” mit {q(n)ν }, so besteht zwischen den “alten” Impulsen {p(m)µ } und den “neuen” Impulsen {p(n)ν }

der Zusammenhang

∂q(n)ν

∂q(m)µ

p

⇔

p

=

p(n)ν .

(15.26)

p(n)ν =

(m)µ

(m)µ

∂q(n)ν

∂q(m)µ

Es treten die üblichen Übergangsmatrizen bei der Transformation eines dualen Vektors auf. Für die Zeitableitung der Koordinaten entlang einer Bahn gilt natürlich wieder die Kettenregel,

∂q(n)ν

∂q(m)µ

µ

µ

q̇(n)ν =

q̇

⇔

q̇

=

q̇(n)ν .

(15.27)

(m)

(m)

∂q(m)µ

∂q(n)ν

Daraus folgt, dass die Wirkung (15.20) in jedem Koordinatensystem durch den gleichen Ausdruck dargestellt wird. Wir können sie auch ganz koordinatenfrei in der Form

t2

Z

p(t) · q̇(t) − H q(t), p(t), t dt

(15.28)

S[q, p] =

t1

146

darstellen, um deutlich zu machen, dass der Integrand ein Skalar ist. Der Punkt bezeichnet wieder wie

üblich das Produkt eines dualen Vektors mit einem Vektor.

Aus dieser Überlegung folgt sofort, dass auch die Hamiltonschen Bewegungsgleichungen in jedem kanonischen Koordinatensystem die Form (15.25) annehmen. Denn sie ergeben sich aus der Forderung, dass

die Wirkung (15.28) für die physikalische Bahn stationär sein muss. Und wenn diese Wirkung, wie gerade

gezeigt, von der Wahl des Koordinatensystems unabhängig ist, dann sind es natürlich auch die Bewegungsgleichungen.

Genau wie die Lagrangeschen oder d’Alembertschen Bewegungsgleichungen beschreiben auch die Hamiltonschen Bewegungsgleichungen die Dynamik des Systems in einer “geometrischen” Sprache, die vom

Koordinatensystem unabhängig ist. Tatsächlich wird sich später herausstellen, dass wir sogar noch sehr

viel allgemeinere Koordinatentransformationen zulassen können als die hier betrachteten, unter denen die

Hamiltonschen Bewegungsgleichungen ihre Form beibehalten. In diesem Sinne ist die Hamiltonsche Formulierung der Bewegungsgleichen noch allgemeiner als die Lagrangesche Form.

Außerdem sind die Hamiltonschen Bewegungsgleichungen in ihrer Struktur sehr viel einfacher als die

Lagrangeschen Gleichungen. Es sind, wie wir bereits betont haben, Differenzialgleichungen erster Ordnung, die zudem schon nach den Ableitungen aufgelöst sind, während die Euler-Lagrange-Gleichungen

Differenzialgleichungen zweiter Ordnung sind, in denen die Zeitableitungen zudem noch etwas verschachtelt sind.

Es stellt sich daher die Frage, warum wir eigentlich nicht gleich diese Form der Bewegungsgleichungen

verwendet haben, um mechanische Systeme im allgemeinen zu beschreiben. Die Antwort ist recht einfach.

Es lassen sich nur ganz spezielle Systeme mit einer Hamilton-Funktion beschreiben. In der Herleitung

haben wir zwei Annahmen gemacht, die nicht für alle mechanischen Systeme erfüllt sind.

Zum einen sind wir davon ausgegangen, dass es überhaupt eine Lagrange-Funktion für das System gibt.

Es dürfen also keine Reibungs- oder anderen Kräfte auftreten, die sich nicht aus einer Lagrange-Funktion

ableiten lassen. Auch dürfen keine anholonomen Zwangsbedingungen vorliegen, die ja im wesentlichen

auch Reibungskräfte sind. Der Konfigurationsraum Q kann der reduzierte Konfigurationsraum eines Systems mit holonomen Zwangsbedingungen sein, aber es dürfen keine weiteren Einschränkungen an die

Bewegungsfreiheit vorliegen.

Zum anderen geht ganz entscheidend in die Herleitung ein, dass sich die Gleichung (15.13) nach der Geschwindigkeit v als Funktion von q und p auflösen lässt. Oder äquivalent dazu, das Extremum in (15.15)

muss existieren existiert und es muss eindeutig sein. Nur dann existiert überhaupt eine Hamilton-Funktion.

Systeme, die diese Bedingung erfüllen, heißen Hamiltonsche oder kanonische mechanische Systeme. Im

wesentlichen kann man sagen, dass alle mechanischen Systeme kanonisch sind, in denen keine Reibungskräfte und keine anholonomen Zwangsbedingungen auftreten.

Die zweite Forderung bedeutet für typische mechanische Systeme keine Einschränkung, solange die

kinetische Energie in der Geschwindigkeit quadratisch und positiv ist. Auf sie kann man im Prinzip sogar

verzichten, was auf eine verallgemeinerte Version der Hamiltonschen Mechanik führt. Darauf werden wir

allerdings nicht weiter eingehen. Wir gehen hier stets davon aus, dass der Konfigurationsraum Q der reduzierte Konfigurationsraum des Systems ist, also alle holonomen Zwangsbedingungen bereits eliminiert

wurden, und die Geschwindigkeit eine eindeutige Funktion des Impulses ist.

Aufgabe 15.6 Die Hamiltonschen Bewegungsgleichungen lassen sich auch ohne Umweg über das Variationsprinzip direkt aus den Lagrangeschen Bewegungsgleichungen herleiten. Man geht von den Gleichungen

d ∂L

∂L

=0

(15.29)

µ −

dt ∂ q̇

∂q µ

für die Koordinaten q µ (t) aus. Um dieses System von Differenzialgleichungen zweiter Ordnung in ein

System erster Ordnung zu verwandeln, führt man die kanonischen Impulse als Hilfsfunktionen ein, indem

147

man

pµ =

∂L

∂ q̇ µ

(15.30)

setzt. Die Hamilton-Funktion definiert man durch

H(q, p, t) = pµ q̇ µ − L(q, q̇, t),

(15.31)

wobei man für q̇ µ auf der rechten Seite die Lösung von (15.30) einsetzt, so dass die Geschwindigkeit eine

Funktion von Ort und Impuls wird. Man zeige, dass sich so auch die Hamiltonschen Bewegungsgleichungen (15.25) ergeben, und dass sie zu den Lagrangeschen Gleichungen äquivalent sind.

Aufgabe 15.7 Für welche mechanischen Systeme aus den Abbildungen in Kapitel 12 existiert eine

Hamilton-Funktion, für welche nicht? Man bestimme die Hamilton-Funktionen für diejenigen Systeme,

die dies zulassen, leite daraus die Bewegungsgleichungen ab und zeige, dass sie zu den Lagrangeschen

Bewegungsgleichungen äquivalent sind.

Einfache Beispiele

Wir beginnen mit dem einfachsten denkbaren mechanischen System, einem freien Teilchen im einer

Raumdimension. Es sei q die Ortskoordinate, v die Geschwindigkeit und p der Impuls. Dann ist

L(q, v) =

m 2

v

2

⇒

m p2

H(q, p) = Ext p v − v 2 =

.

v

2

2m

(15.32)

Daraus lassen sich unmittelbar die Hamiltonschen Bewegungsgleichungen ablesen. Sie lauten

q̇ =

p

∂H

= ,

∂p

m

ṗ = −

∂H

= 0.

∂q

(15.33)

Also ist p(t) = p0 konstant und q(t) = q0 + p0 t/m beschreibt eine gleichförmige Bewegung. Wir sehen

außerdem, dass H wieder die Energie des Teilchens ist, die in diesem Fall allein aus der kinetischen

Energie besteht.

Ein anderes, ebenfalls sehr einfaches Beispiel ist der harmonischer Oszillator. Er wird uns später noch

eine Weile verfolgen, denn an ihm lassen sich sehr viele wichtige Eigenschaften der Hamiltonschen Mechanik einfach und klar darstellen. Die Lagrange-Funktion ist in diesem Fall

L(q, v) =

m 2 κ 2

v − q .

2

2

(15.34)

Die es sich um eine Funktion der Form L = T − V handelt, und die kinetische Energie in der Geschwindigkeit quadratisch ist, ergibt sich die Hamilton-Funktion zu H = T + V. Allerdings müssen wir sie als

Funktion von q und p darstellen, wobei p = ∂L/∂v = m v wieder der gewöhnliche Impuls ist. Es gilt

daher

m

κ κ q2

p2

H(q, p) = Ext p v − v 2 + q 2 =

+

.

(15.35)

v

2

2

2m

2

Für die Hamiltonschen Bewegungsgleichungen ergibt sich

q̇ =

∂H

p

= ,

∂p

m

ṗ = −

∂H

= −κ q.

∂q

(15.36)

Die zweite Gleichung ist nichts anderes als die Newtonsche Bewegungsgleichung, wonach die Zeitableitung des Impulses die Kraft ist, und diese wiederum als Ableitung des Potenzials gegeben ist. Und die

148

erste Gleichung ist eigentlich redundant, da sie nur noch einmal die bereits bekannte Beziehung zwischen

Impuls und Geschwindigkeit herstellt.

Wir sehen also, dass wir immer noch “dieselbe Mechanik” betreiben. Nur unsere Begriffe haben sich

etwas verändert. Die Lösungen der Bewegungsgleichungen sind natürlich immer noch die gleichen. Die

allgemeinen Lösungen von (15.36) lassen sich sofort angeben. Es gilt

q(t) = a sin(ω t + ϕ),

p(t) = m ω a cos(ω t + ϕ),

(15.37)

wobei a und ϕ Integrationskonstanten sind, die durch die Anfangsbedingung festgelegt werden, und ω 2 =

κ/m die Eigenfrequenz des Oszillators ist.

Um die Dynamik eines ebenen Pendels zu beschreiben, können wir ganz ähnlich vorgehen. Wir benutzen als Ortskoordinate q die Auslenkung des Pendels, also die Stecke, die das Pendel vom Ruhepunkt aus

zurückgelegt hat. Da sich ein Pendel auf einem Kreis bewegt, ist dies eine periodische Koordinate. Bei

einer Pendellänge ` gilt q ≡ q + 2π `. Der Konfigurationsraum ist die Mannigfaltigkeit Q = S 1 , also eine

eindimensionale Sphäre.

Wie sieht dann der Phasenraum aus? Da der Konfigurationsraum eindimensional ist, ist sein Kotangentenraum an jeder Stelle q ∈ Q ein eindimensionaler Vektorraum Tq∗ Q. Der Impuls wird folglich durch

eine reelle Zahl p dargestellt. Der Phasenraum ist die Vereinigung aller dieser Vektorräume, also das Kotangentenbündel T∗ (S1 ). Wenn wir an jeden Punkt auf der Kreislinie einen eindimensionalen Vektorraum

anheften, so bekommen wir einen Zylinder. Der Phasenraum eines Pendels ist folglich ein Zylinder. Die

Ortskoordinate q ist periodisch, und der konjugierte Impuls p dient als zweite, nicht periodisch Koordinate.

Um die Hamilton-Funktion zu bestimmen, gehen wir wieder von der Lagrange-Funktion aus. Die kinetische Energie ist weiterhin T = m v 2 /2, wobei v = q̇ die Zeitableitung der Auslenkung ist. Für die

potenzielle Energie müssen wir V = −m g ` cos(q/`) setzen, wenn der Ruhepunkt bei q = 0 liegen soll.

Dann ist L = T − V, und T ist in v quadratisch. Also gilt H = T + V. Um die kinetische Energie als

Funktion des Impulses p darzustellen, benötigen wir nur noch die übliche Beziehung p = ∂L/∂v = m v.

Wir bekommen dann die Hamilton-Funktion

p2

p2

m g q2

− m g ` cos(q/`) ≈

+

− m g.

(15.38)

2m

2m

2`

Bis auf eine Konstante, die sich auf die Bewegungsgleichungen nicht auswirkt, stimmt sie für kleine

Auslenkungen näherungsweise mit der Hamilton-Funktion eines harmonischen Oszillators überein. Wir

müssen nur für die Federkonstante κ = m g/` setzen, so dass sich für die Eigenfrequenz der bekannte

Ausdruck ω 2 = κ/m = g/` ergibt. Die Bewegungsgleichungen lauten schließlich

H(q, p) =

q̇ =

∂H

p

= ,

∂p

m

ṗ = −

∂H

mgq

= −m g sin(q/`) ≈ −

.

∂q

`

(15.39)

Aufgabe 15.8 Wie sieht die Hamilton-Funktion für das Pendel aus, wenn man als Ortskoordinate statt der

Auslenkung q den Auslenkwinkel ϑ = q/` verwendet? Was ist dann der konjugierte Impuls, und welche

Bewegungsgleichungen ergeben sich?

Koordinatentransformationen

Als nächstes betrachten wir ein System mit zwei Freiheitsgraden, um zu zeigen, was bei einer Koordinatentransformation geschieht, und wie sich dabei die Hamiltonschen Bewegungsgleichungen transformieren.

Das einfachste System mit zwei Freiheitsgraden ist ein Teilchen in einer Ebene. Es soll sich dort in einem

zeitunabhängigen Potenzial bewegen, für das wir der Einfachheit halber wieder das eines harmonischen

Oszillators einsetzen. Ist (x, y) ein kartesischen Koordinatensystem in der Ebene, so ist die LagrangeFunktion

κ 2

m

(v x )2 + (v y )2 −

x + y 2 ).

(15.40)

L(x, y, v x , v y ) =

2

2

149

Der Zusammenhang zwischen den Geschwindigkeiten (vx , vy ) und den konjugierten Impulsen (px , py ) ist

wieder der übliche,

∂L

∂L

px = x = m v x ,

py = y = m v y .

(15.41)

∂v

∂v

Da die Lagrange-Funktion wieder von der Form L = T − V ist, und T eine quadratische Funktion der

Geschwindigkeiten ist, gilt für die Hamilton-Funktion H = T + V, wobei wir die kinetische Energie als

Funktion der Impulse schreiben müssen. Das ergibt

py 2

κ x2 κ y 2

px 2

+

+

+

.

H(x, y, px , py ) =

2m 2m

2

2

(15.42)

Die Hamiltonschen Bewegungsgleichungen lauten

ẋ =

px

∂H

= ,

∂px

m

ẏ =

∂H

py

= ,

∂py

m

ṗx = −

∂H

= −κ x,

∂x

ṗy = −

∂H

= −κ y.

∂y

(15.43)

Es handelt sich einfach um zwei voneinander unabhängige harmonische Oszillatoren mit der Eigenfrequenz ω 2 = κ/m. Dass die Bewegungen in die beiden Richtungen unabhängig ablaufen, ergibt sich auch

daraus, dass die Lagrange-Funktion als Summe von zwei Funktionen dargestellt werden kann, wobei die

eine nur von x und v x , die andere nur von y und v y abhängt. Offenbar gilt in diesem Fall dasselbe für die

Hamilton-Funktion, die ebenfalls eine Summe von zwei Funktionen ist. Hier hängt der eine Summand nur

von x und px ab,. der andere nur von y und py .

Aufgabe 15.9 Man finde die allgemeine Lösung von (15.43). Welche spezielle Lösung ergibt sich für die

Anfangsbedingungen x(0) = a, y(0) = 0, px (0) = 0, py (0) = b?

Nun wollen wir dieselben Bewegungsgleichungen in einem anderen Koordinatensystem darstellen. Der

Konfigurationsraum Q des Teilchens ist eine Euklidische Ebene. Wie führen dort ein Polarkoordinatensystem (r, ϕ) ein, so dass wie üblich x = r cos ϕ und y = r sin ϕ gilt. Es gibt dann mehrere Stellen in

der gerade durchgeführten Herleitung, an der wir diese Koordinatentransformation einsetzen können. Wir

können zum Beispiel ganz von vorne beginnen, und zuerst die Lagrange-Funktion umrechnen. Das ergibt

L(r, ϕ, v r , v ϕ ) =

κ

m

(v r )2 + r 2 (v ϕ )2 − r 2 ,

2

2

(15.44)

wobei (v r , v ϕ ) die Komponenten der Geschwindigkeit in Polarkoordinaten sind, also die radiale und die

Winkelgeschwindigkeit. Diesen Ausdruck für die Lagrange-Funktion hatten wir schon mehrmals benutzt,

so dass wir ihn hier nicht mehr herleiten müssen. Die konjugierten Impulse sind nun

pr =

∂L

= m vr ,

∂v r

pϕ =

∂L

= m r2 v ϕ.

∂v ϕ

(15.45)

Der zur Koordinate r kanonisch konjugierte Impuls pr ist die Komponente des Impulses in radiale Richtung, und der zur Koordinate ϕ kanonisch konjugierte Impuls p ϕ ist der Drehimpuls, oder genauer dessen

z-Komponente, wenn wir uns die Ebene im Raum eingebettet denken. Da weiterhin L = T − V ist, gilt

für die Hamiltonfunktion auch hier H = T + V, also

pϕ2

κ r2

pr2

+

+

.

H(r, ϕ, pr , pϕ ) =

2 m 2 m r2

2

(15.46)

Eine andere Möglichkeit, sich diese Hamilton-Funktion zu verschaffen, geht direkt von der Darstellung

(15.42) aus. Der Phasenraum P des Teilchens ist ein vierdimensionaler Raum, auf dem durch (x, y, p x , py )

150

ein kanonisches Koordinatensystem definiert wird. Nun führen wir eine Koordinatentransformation durch,

indem wir

x = r cos ϕ,

y = r sin ϕ

(15.47)

setzen. Dann müssen wir auch die Impulse transformieren, und zwar wie die Komponenten eines dualen

Vektors,

∂y

∂x

px +

py = cos ϕ px + sin ϕ py ,

pr =

∂r

∂r

∂y

∂x

px +

py = −r sin ϕ px + r cos ϕ py .

(15.48)

pϕ =

∂ϕ

∂ϕ

Die neuen Koordinaten (r, ϕ, pr , pϕ ) bilden dann ebenfalls ein kanonisches Koordinatensystem auf P.

Um die Hamilton-Funktion in diesen Koordinaten darzustellen, müssen wir nur die Beziehungen (15.47)

und (15.48) in (15.42) einsetzen. Das Ergebnis ist natürlich wieder (15.46). Wir müssen also nur dieselbe

Funktion H in den neuen Koordinaten darstellen.

Die Bewegungsgleichungen können wir nun ebenso gut in diesem Koordinatensystem bestimmen. Es

gilt

ṙ =

∂H

pr

= ,

∂pr

m

ϕ̇ =

pϕ

∂H

=

,

∂pϕ

m r2

ṗr = −

pϕ2

∂H

=

− κ r,

∂r

m r3

ṗϕ = −

∂H

= 0.

∂ϕ

(15.49)

In der Bewegungsgleichung für pr tritt nun ein effektives Potenzial auf, das wir auch schon aus anderen

Herleitungen von Bewegungsgleichungen in Polarkoordinaten kennen.

Man kann sich leicht davon überzeugen, dass diese Bewegungsgleichungen zu (15.43) äquivalent sind.

Sie sind zwar nun miteinander gekoppelt. Wir sehen daher nicht mehr sofort, dass die es sich um zwei

unabhängige Oszillatoren handelt. Aber wir können statt dessen aus der letzten Gleichung sofort ablesen,

dass der Drehimpuls pϕ eine Erhaltungsgröße ist. Damit lässt sich auch dieses Gleichungssystem leicht

auflösen.

Aufgabe 15.10 Man finde die allgemeine Lösung von (15.49). Wie stellt sich die Anfangsbedingung aus

Aufgabe 15.9 in Polarkoordinaten dar, und welche spezielle L ösung ergibt sich daraus?

Aufgabe 15.11 Für ein N -Teilchen-System im dreidimensionalen Euklidischen Raum bezeichnen wir die

Orte der Teilchen wie üblich mit rα , α ∈ {1, . . . , N }, und ihre Koordinaten mit rα,i , i ∈ {x, y, z}. Entsprechend sind vα bzw. vα,i die Geschwindigkeiten. Liegt eine paarweise, nur vom Abstand abh ängige

Wechselwirkung der Teilchen vor, so hat die Lagrange-Funktion die Form

1X

1X

mα vα2 −

Vα,β (|rα − rβ |)

L {rα }, {vα } =

2 α

2

(15.50)

α6=β

Die kanonischen Impulse werden mit pα , bzw. ihre Komponenten mit pα,i bezeichnet. Man bestimme die

Beziehungen zwischen den Impulsen und den Geschwindigkeiten, die Hamilton-Funktion H({r α }, {pα }),

und die daraus resultierenden Bewegungsgleichungen.

Aufgabe 15.12 Ein Teilchen im dreidimensionalen Raum bewege sich in einem kugelsymmetrischen Potenzial V = V (r). Die Lagrange-Funktion in Kugelkoordinaten ist folglich

L(r, ϑ, ϕ, v r , v ϑ , v ϕ ) =

m

(v r )2 + r 2 (v ϑ )2 + r 2 sin2 ϑ (v ϕ )2 − V (r).

2

Welche Hamilton-Funktion H(r, ϑ, ϕ, pr , pϑ , pϕ ) ergibt sich daraus?

151

(15.51)

Zeitabhängige Systeme

Um zu zeigen, dass die Hamiltonsche Methode auch dann noch funktioniert, wenn die Lagrange-Funktion,

und damit auf die Hamilton-Funktion explizit zeitabhängig ist, betrachten wir als drittes Beispiel ein ebenes Pendel mit veränderlicher Länge. Es handelt sich um ein System mit holonomen, aber zeitabhängigen

Zwangsbedingungen. Wir verwenden als reduzierte Koordinate eine Winkelkoordinate ϑ, so dass sich das

Pendel in der x-z-Ebene an der Stelle x = ` sin ϑ und z = −` cos ϑ befindet, wobei die Pendellänge

` = `(t) als Funktion der Zeit vorgegeben ist.

Die Lagrange-Funktion bestimmen wir wie üblich, indem wir die kinetische und potenzielle Energie

berechnen. Das ergibt

m

m

m 2

ẋ + ż 2 = `2 ϑ̇2 + `˙2 ,

T =

2

2

2

V = m g z = −m g ` cos ϕ.

(15.52)

Bezeichnen wir die Winkelgeschwindigkeit ϑ̇ mit ω, so ist

L(ϑ, ω, t) =

˙ 2

m `(t)2 2 m `(t)

ω +

+ m g `(t) cos ϑ.

2

2

(15.53)

˙ hängt die Lagrange-Funktion also explizit

Über die vorgegebene Funktion `(t) und deren Ableitung `(t)

von der Zeit ab. Um die Hamilton-Funktion zu finden, bestimmen wir erst den Zusammenhang zwischen

der Winkelgeschwindigkeit ω und dem zugehörigen Impuls, von dem wir ja bereits wissen, dass es der

Drehimpuls ist. Wir bezeichnen ihn daher mit

l=

∂L

= m `(t)2 ω.

∂ω

(15.54)

Der Zusammenhang zwischen ω und l ist ebenfalls explizit von der Zeit abhängig. Das ändert aber nichts

an der Definition der Hamilton-Funktion die sich aus (15.15) ergibt. Es gilt

˙ 2

l2

m `(t)

H(ϑ, l, t) = Ext l ω − L(ϑ, ω, t) =

−

− m g `(t) cos ϑ,

ω

2

2 m `(t)2

(15.55)

wobei wir das Extremum gefunden haben, indem wir für ω die Lösung der Gleichung (15.54) eingesetzt

haben.

˙ explizit von der Zeit ab. Außerdem können

Auch die Hamilton-Funktion hängt nun über `(t) und `(t)

wir noch die folgende wichtige Feststellung machen. Sie ist nicht von der Form H = T + V, denn der

˙ 2 proportional ist, hat das falsche Vorzeichen. Das liegt daran, dass dieser Term in der

Term, der zu `(t)

Lagrange-Funktion (15.53) einen Anteil der kinetischen Energie repräsentiert, aber keine quadratische

Funktion der Geschwindigkeit ω ist.

In diesem Sinne ist H nicht die Größe, die wir üblicherweise als Gesamtenergie bezeichnen würden. Das

steht ein wenig mit der Definition im Widerspruch, die wir weiter oben für die physikalische Interpretation

von H gegebenen haben. Die Hamilton-Funktion liefert hier einen anderen Ausdruck für die Gesamtenergie des Systems als die Summe aus potenzieller und kinetischer Energie. Waren wir also zu voreilig, als

wir die Hamilton-Funktion als eine Verallgemeinerung des Begriffes “Energie” definiert haben? Was ist

hier die “richtige” Definition von Energie?

Wir müssen uns entweder für die “physikalisch intuitive” Definition E = T + V entscheiden, oder für

die “formale” Definition E = H. Im Grunde ist es aber völlig egal, welche Größe wir in diesem Fall

Energie nennen. Wir können mit ihr nämlich gar nichts weiter anfangen. Da es sich um ein System mit

zeitabhängigen Zwangsbedingungen handelt, leisten diese Arbeit am System, so dass die Energie, wie

152

auch immer definiert, keine Erhaltungsgröße ist. Wir können sie nicht wie sonst üblich zur Lösung der

Bewegungsgleichungen verwenden.

Aus diesem Grund können wir gut mit dem Umstand zurecht kommen, dass die Energie eines Systems,

die sich aus der Hamilton-Funktion ergibt, nicht immer mit dem übereinstimmt, was wir uns intuitiv unter

Energie vorstellen. Wichtiger als die Frage, welche Größe wir Energie nennen, ist die Frage nach Erhaltungsgrößen, die uns helfen, die Bewegungsgleichungen zu lösen. Damit werden wir uns gleich näher

befassen und sehen, dass es stets die Hamilton-Funktion, also die formale Definition der Energie ist, die

zu einer solchen Erhaltungsgröße führt.

Unabhängig von der Frage nach der Bedeutung des Begriffes Energie können wir jedoch aus (15.38)

die Bewegungsgleichungen ableiten. Da ϑ nun die Ortskoordinate und l der kanonisch konjugierte Impuls

ist, bekommen wir

∂H

l

∂H

ϑ̇ =

=

l˙ = −

= −m g `(t) sin ϑ.

(15.56)

2,

∂l

∂ϑ

m `(t)

Der fragliche Term mit dem falschen Vorzeichen geht in die Bewegungsgleichungen gar nicht ein, da

er weder von ϑ noch von l abhängt. Wie immer ergibt sich ein Satz von Differenzialgleichungen erster

˙

Ordnung, aufgelöst nach den Ableitungen ϑ̇(t) und l(t).

Das einzig neue ist, dass nun die Koeffizienten

dieser Gleichungen explizit von t abhängen, über die vorgegebene Funktion `(t).

Aufgabe 15.13 Man löse die Bewegungsgleichungen (15.56) des Pendels für g = 0, also im schwerelosen

Raum.

Der Hamiltonsche Fluss

Wir wollen uns nun die Hamiltonschen Bewegungsgleichungen (15.25) etwas genauer ansehen. Wie bereits erwähnt, wird durch die Vorgabe eines Anfangszustandes q(0) = q 0 und p(0) = p0 die Zeitentwicklung des Systems eindeutig festgelegt. Wir kennen also die Funktionen q(t) und p(t), sobald wir ihre

Werte zu einem bestimmten Zeitpunkt, zum Beispiel t = 0, kennen.

Eine Kurve (q(t), p(t)) im Phasenraum, die auf diese Weise bestimmt wird, nennt man eine Trajektorie.

Eine Trajektorie im Phasenraum ist das Analogon zu einer Bahn q(t) im Konfigurationsraum. Beide beschreiben die zeitliche Entwicklung des Systems als parametrisierte Kurve. Während die Bahn jedoch zu

jedem Zeitpunkt nur den Ort des Systems im Konfigurationsraum festlegt, können wir auf der Trajektorie

im Phasenraum gleichzeitig den Ort und den Impuls ablesen.

Eine Trajektorie ist eine Bahn (q(t), p(t)) im Phasenraum, die den Hamiltonschen Bewegungsgleichungen genügt.

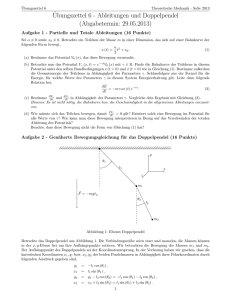

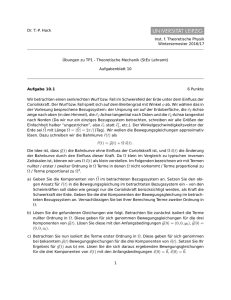

Für zwei sehr einfache mechanische Systeme sind in Abbildung 15.1 ein paar Trajektorien dargestellt. Die

Abbildung (a) zeigt den Phasenraum eines harmonischen Oszillators, aufgespannt durch die kanonischen

Koordinaten (q, p). Wir wählen als Anfangszustand einen Punkt auf der positiven p-Achse. Das System

soll sich zum Zeitpunkt t = 0 am Ruhepunkt q0 = 0 befinden und einen Impuls p0 > 0 haben. Die

zugehörige Lösung entnehmen wir aus (15.37),

q(t) = a0 sin(ω t),

p(t) = p0 cos(ω t),

mit a0 =

p0

.

mω

(15.57)

Im Phasenraum ergibt sich eine Ellipse mit den Halbachsen p0 und a0 , wobei p0 der Anfangsimpuls und

a0 die daraus resultierende Amplitude der Schwingung ist. Der Oszillator schlägt zuerst in die positive qRichtung aus, so dass die Ellipse im Uhrzeigersinn durchlaufen wird, wenn man die Darstellung so wie in

der Abbildung wählt, also q nach rechts und p nach oben aufträgt. Für einige ausgewählte Werte von p 0 sind

die entsprechenden Trajektorien, jeweils für ein bestimmtes Zeitintervall 0 ≤ t ≤ τ , in Abbildung 15.1(a)

eingezeichnet.

153

p

p

replacements

q

q

(a)

(b)

(c)

(d)

Abbildung 15.1: Der Hamiltonsche Fluss eines harmonischen Oszillators (a) und eines Pendels (b). Die

Trajektorien des harmonischen Oszillators sind Ellipsen, die alle mit der gleichen Kreisfrequenz ω durchlaufen werden. Beim Pendel gibt es oszillierende und sich überschlagende Trajektorien. Die gestrichelten

Linien sind die Niveaulinien der Hamilton-Funktion.

Die Trajektorien im Phasenraum haben zwei wichtige Eigenschaften. Die erste beruht auf der Tatsache,

dass die Hamilton-Funktion in diesem Fall nicht explizit von der Zeit abhängt. Damit hängen auch die

Bewegungsgleichungen nicht explizit von der Zeit ab. Folglich ist mit t 7→ (q(t), p(t)) auch jede in der

Zeit verschobene Kurve t 7→ (q(t − t0 ), q(t − t0 )) eine Trajektorie. Es spielt keine Rolle, zu welchem

Zeitpunkt wir das System in den gegeben Anfangszustand versetzen. Es wird immer die gleiche Trajektorie

durchlaufen, nur eben zu einer früheren oder späteren Zeit.

Die zweite Eigenschaft ergibt sich aus der Tatsache, dass die Bewegungsgleichungen die Zeitentwicklung eindeutig festlegen. Daher geht durch jeden Punkt im Phasenraum genau eine Trajektorie. Die Trajektorien bilden eine Schar von Kurven, die den Phasenraum vollständig ausfüllen, sich dabei aber niemals

schneiden. Denn durch den Schnittpunkt würden dann mehrere Trajektorien verlaufen.

Beim harmonischen Oszillator können wir uns das recht einfach klar machen. Egal, welchen Anfangszustand wir vorgeben, das System kehrt immer nach einer Periode T = 2π/ω in diesen Zustand zurück.

Die Trajektorien sind geschlossen Kurven, die alle die gleiche Periode T haben. Es sind Ellipsen, die

den Ursprung, also den Ruhepunkt des Oszillators bei q = 0 und p = 0 im Uhrzeigersinn umlaufen. Es

gibt nur eine spezielle, “entartete” Trajektorie, die nur aus einem Punkt besteht. Sie beschreibt den in der

Gleichgewichtslage ruhenden Oszillator.

Ein etwas anderes Bild ergibt sich, wenn wir statt eines harmonischen Oszillators ein ebenes Pendel

betrachten. Wie wir bereits gezeigt haben, ist der Phasenraum in diesem Fall ein Zylinder. Die Pendellänge

sei wieder `. Als kanonische Koordinaten verwenden wir die periodische Ortskoordinate q ≡ q + 2π `, also

die Auslenkung, und den konjugierten Impuls p. Die Hamilton-Funktion nimmt dann die Form (15.38) an.

In Abbildung 15.1(b) ist dieser Phasenraum grafisch dargestellt. Wir müssen uns die Abbildung zu einem

Zylinder aufgerollt denken, so dass die gestrichelte Linie am rechten Rand bei q = π ` mit der am linken

Rand bei q = −π ` identifiziert wird.

Als Anfangszustand wählen wir wieder einen Punkt auf der positiven p-Achse. Natürlich gilt auch hier,

dass von jedem Punkt genau eine Trajektorie ausgeht, die wir durch Lösen der Bewegungsgleichen (15.39)

berechnen können. Wohin diese Trajektorie läuft, hängt nun jedoch vom Wert des Anfangsimpulses ab. Für

kleine Impulse oszilliert das Pendel um die Ruhelage und verhält sich dabei näherungsweise wie der har154

monische Oszillator. In der Nähe des Koordinatenursprungs ergibt sich in den Abbildungen 15.1(a) und (b)

ein sehr ähnliches Bild. Jede Trajektorie kehrt nach einer gewissen Zeit, die für kleine Auslenkungen der

Eigenperiode T = 2π/ω entspricht, in den Ausgangszustand zurück.

Für große Impulse überschlägt sich das Pendel. Es kehrt dann auch nach einer gewissen Zeit zum Anfangszustand zurück, jedoch wickelt sich die Trajektorie dabei um den Zylinder, statt den Koordinatenursprung zu umrunden. Als Grenzfall zwischen diesen beiden Klassen von Trajektorien gibt es die Kriechbahn, bei der das Pendel nach unendlicher langer Zeit den oberen, instabilen Gleichgewichtspunkt erreicht.

Diese spezielle Lösung der Bewegungsgleichungen wurde bereits in Aufgabe 5.16 diskutiert. Schließlich

gibt es noch zwei spezielle Trajektorien, die jeweils nur aus einem Punkt bestehen, nämlich die stabile

Gleichgewichtslage bei q = 0 und p = 0, sowie die instabile Gleichgewichtslage bei q = ±π ` und p = 0.

Wir werden nun dieses Verhalten von Trajektorien im Phasenraum etwas allgemeiner beschreiben. Der

Einfachheit halber nehmen wir dazu an, dass die Hamilton-Funktion, so wie in den beiden gerade diskutierten Beispielen, nicht explizit von der Zeit abhängt. Dann können wir wie folgt eine Abbildung des

Phasenraumes auf sich selbst definieren. Wir geben irgendeinen Anfangszustand (q 0 , p0 ) vor. Wir versetzen das System in diesen Zustand und warten eine Zeitspanne τ . Dann ist das System in einem Zustand

(qτ , pτ ). Für jedes τ wird auf dieser Weise eine Abbildung

χH (τ ) :

P → P,

(q0 , p0 ) 7→ (qτ , pτ ).

(15.58)

definiert. Man nennt diese Schar von Abbildung den Hamiltonschen Fluss. Er gibt für jedes τ ∈ R an,

wie sich das System innerhalb einer Zeitspanne τ entwickelt. Jedem Anfangszustand wird ein Endzustand

zugeordnet.

Der Hamiltonsche Fluss ist für jedes τ ∈ R eine bijektive Abbildung des Phasenraumes auf sich selbst.

Das ergibt sich aus der Tatsache, dass wir die Bewegungsgleichungen natürlich auch benutzen können,

um die Trajektorie in die Vergangenheit fortzusetzen. Da die Bewegungsgleichungen nicht explizit von

der Zeit abhängen sollen, gilt sogar ganz allgemein die Beziehung

χH (τ1 ) ◦ χH (τ2 ) = χH (τ1 + τ2 ).

(15.59)

Wenn sich das System erst über eine Zeitspanne τ1 entwickelt und dann über eine Zeitspanne τ2 , dann ist

das Ergebnis das gleiche als würde es sich gleich über eine Zeitspanne τ 1 + τ2 entwickeln.

Setzen wir in (15.59) τ2 = 0, so ergibt sich χH (0) = id, was auch anschaulich klar ist. Wenn wir

dem System gar keine Zeit geben, sich zu entwickeln, so ist der Endzustand gleich dem Anfangszustand.

Setzen wir schließlich τ1 = τ und τ2 = −τ , so finden wir χH (τ )−1 = χH (−τ ). Die inverse Abbildung

bekommen wir, indem wir das System in die jeweils umgekehrte Zeitrichtung entwickeln lassen.

Eine Schar von bijektiven Abbildungen eines Raumes auch sich selbst, die durch eine reelle Zahl parametrisiert werden, und die zudem die Eigenschaft (15.59) haben, nennt man im allgemeinen einen Fluss.

Dahinter steckt die anschauliche Vorstellung von einer strömenden Flüssigkeit. Verfolgt man die einzelnen

Teilchen in einer strömenden Flüssigkeit über ein bestimmte Zeitspanne, so wird auch dadurch eine Abbildung des Raumes, in dem die Strömung stattfindet, auf sich selbst definiert. Wenn die Strömung station är

ist, als zeitunabhängig, so gilt für diese Abbildungen die Gleichung (15.59).

Wir können uns den Hamiltonschen Fluss im Phasenraum, also die Zeitentwicklung eines mechanischen

Systems, in diesem Sinne wie die Strömung einer Flüssigkeit vorstellen. Die in Abbildung 15.1 gezeigten

Trajektorien ergeben sich, wenn man einzelne Teilchen in dieser Flüssigkeit markiert und dann ihren Weg

verfolgt.

Die Zeitentwicklung eines mechanischen System wird durch einen Fluss im Phasenraum beschrieben.

155

Beim harmonischen Oszillator bildet der Fluss einen einzigen großen Wirbel um den Koordinatenursprung. Alles strömt gleichmäßig auf elliptischen Kurven. Wir können den Fluss sogar relativ leicht explizit angeben. Gibt man als Anfangszustand (q0 , p0 ) vor, so ist die eindeutige Lösung der Bewegungsgleichung

q(t) = q0 cos(ω t) +

p0

sin(ω t),

mω

p(t) = p0 cos(ω t) − m ω q0 sin(ω t).

Die Abbildung (15.58) sieht also explizit wie folgt aus,

p

χH (τ ) : (q, p) 7→

q cos(ω τ ) +

sin(ω τ ) , p cos(ω t) − m ω q sin(ω t) .

mω

(15.60)

(15.61)

Man kann sich leicht davon überzeugen, dass diese Schar von Abbildungen die Eigenschaft (15.59) hat.

Beim Pendel sieht der Fluss ein wenig komplizierter aus und lässt sich nicht mehr in geschlossener Form

angeben. Wir können aber weiterhin das Bild einer strömenden Flüssigkeit verwenden. Auf dem zylinderförmigen Phasenraum, der in Abbildung 15.1(b) dargestellt ist, verläuft die Strömung im oberen Bereich nach rechts um den Zylinder herum, und im unteren Bereich nach links um den Zylinder herum.

Dies entspricht dem Pendel, das sich entweder rechts- oder linksrum überschlägt. In der Mitte um den

Koordinatenursprung bildet sich ein Wirbel, in dem das Pendel um die Ruhelage oszilliert.

Aufgabe 15.14 Wie sieht der Hamiltonsche Fluss für ein freies Teilchen im dreidimensionalen Raum aus?

Aufgabe 15.15 Kann man den Hamiltonschen Fluss auch dann noch definieren, wenn die HamiltonFunktion explizit von der Zeit abhängt?

Die Poisson-Klammer

Wir werden von nun an stets die Annahme machen, dass die Hamilton-Funktion nicht explizit von der Zeit

abhängt. Wir betrachten also nur solche mechanischen Systeme, die nicht “von außen” über zeitabhängige

Zwangsbedingungen gesteuert werden. Über solche autonomen Systeme macht die Hamiltonsche Formulierung der Bewegungsgleichungen einige sehr interessante Aussagen. Zwar lassen sich viele dieser

Aussagen verallgemeinern, so dass sie auch für Systeme mit zeitabhängiger Dynamik gelten. Dies führt

aber nicht zu sehr viel tieferen Erkenntnissen.

Eine der wichtigsten Eigenschaften der Hamiltonschen Mechanik ist, dass sie eine sehr elegante Antwort

auf die Frage gibt, ob ein System Erhaltungsgrößen besitzt und welche Größen das gegebenenfalls sind.

Unter einer Erhaltungsgröße verstehen wir dabei eine Funktion des Bewegungszustands, deren Wert sich

zeitlich nicht ändert. Beispiele für solche Größen kennen wir bereits aus der Newtonschen Mechanik

von Punktteilchen, etwa den Gesamtimpuls oder den Gesamtdrehimpuls eines N -Teilchen-System. Diese

Größen sind zeitlich konstant, wenn die Wechselwirkungen zwischen Teilchen bestimmte Eigenschaften

haben. Diesen Zusammenhang wollen wir nun systematisch untersuchen.

In der Hamiltonschen Formulierung ist der Bewegungszustand ein Paar (q, p), also ein Punkt im Phasenraum P. Folglich wird eine Erhaltungsgröße durch eine Phasenraumfunktion A : P → R dargestellt, die

jedem Bewegungszustand (q, p) eine reelle Zahl A(q, p) zuordnet. Als Beispiel für eine Phasenraumfunktion kennen wir bereits die Hamilton-Funktion H. Wenn sie nicht explizit von der Zeit abhängt, handelt es

sich um eine Abbildung H : P → R. Wir kennen auch schon ihre physikalische Interpretation. Es ist die

Gesamtenergie des Systems.

Wir wollen uns nun ganz allgemein fragen, wie sich der Wert einer Phasenraumfunktion mit der Zeit

ändert, wenn das System sich gemäß seinen Bewegungsgleichungen entwickelt. Dazu müssen wir den

Wert der Funktion A entlang einer Trajektorie (q(t), p(t)) auswerten. Das ergibt eine Funktion A(t) =

156

A(q(t), p(t)). Sie beschreibt die zeitliche Entwicklung der Größe A aus der Sicht des Systems, das sich

entlang der Trajektorie bewegt. Für die Ableitung dieser Größe nach der Zeit gilt

Ȧ =

∂A

∂A

dA

= q̇ µ µ + ṗµ

.

dt

∂q

∂pµ

(15.62)

Wie üblich steht der Punkt bzw. d/dt für die totale Zeitableitung, also die Ableitung der Funktion

t 7→ H(q(t), p(t)), während mit ∂/∂q µ bzw. ∂/∂pµ die partiellen Ableitungen nach den Phasenraumkoordinaten bezeichnet werden, die in diesem Fall selbst wieder Funktionen der Zeit sind.

Nun setzen wir in (15.62) die Hamiltonschen Bewegungsgleichungen ein. Das ergibt

dA

∂H ∂A

∂H ∂A

=

.

µ −

dt

∂pµ ∂q

∂q µ ∂pµ

(15.63)

Wenn man sich den Ausdruck auf der rechten Seite genauer anschaut, stellt man fest, dass es sich wieder

um eine Phasenraumfunktion handelt. Sie wird in einer speziellen Art und Weise aus den partiellen Ableitungen von A und H gebildet. Während auf der linken Seite die Ableitung entlang einer Trajektorie steht,

steht also auf der rechten Seite wieder eine Phasenraumfunktion.

Das hat folgenden einfachen Grund. Wenn wir wissen, in welchem Bewegungszustand sich das System

zu einem Zeitpunkt befindet, dann wissen wir auch, in welche Richtung es sich von dort aus im Phasenraum

bewegen wird. Folglich wissen wir auch, wie sich eine gegebene Funktion A(q, p) zeitlich entwickeln

wird, ohne die Trajektorie selbst kennen zu müssen.

Wir können nun ein sehr einfaches Kriterium dafür angeben, wann eine Phasenraumfunktion eine Erhaltungsgröße ist, ohne dass wir uns dazu die Bewegungsgleichungen näher anschauen müssen. Eine Funktion

A(q, p) ist genau dann eine Erhaltungsgröße, wenn

∂H ∂A

∂H ∂A

=0

µ −

∂pµ ∂q

∂q µ ∂pµ

(15.64)

ist. Da solche Ausdrücke im folgenden öfters auftreten, ist es nützlich, dafür eine spezielle Schreibweise

einzuführen. Es seien A, B : P → R zwei Phasenraumfunktionen. Dann ordnen wir ihnen eine dritte

Phasenraumfunktion C : P → R zu, die wie folgt definiert ist

PoissonKlammer

C = {A, B} =

∂A ∂B

∂A ∂B

µ −

∂pµ ∂q

∂q µ ∂pµ

(15.65)

Die Funktion C heißt Poisson-Klammer von A und B. Man bezeichnet sie üblicherweise mit einer geschweiften Klammer, in die man die beiden Funktionen A und B als Argumente einträgt.

Die Poisson-Klammer ordnet jedem Paar von Phasenraumfunktionen A und B eine neue

Phasenraumfunktion {A, B} zu.

Mit Hilfe dieser Notation können wir für die Zeitentwicklung einer beliebigen Phasenraumfunktion ganz

einfach als

Ȧ = {H, A}

(15.66)

schreiben. Zu beachten ist hierbei nur, dass die Gleichung erst dann sinnvoll zu interpretieren ist, wenn

wir sowohl die Phasenraumfunktion A links als auch Phasenraumfunktion {H, A} rechts entlang einer

Trajektorie auswerten. Denn erst dann ist der Punkt, also die totale Zeitableitung, ein sinnvolle Operation.

Nehmen wir nun an, die Phasenraumfunktion A sei eine Erhaltungsgröße. Dann gilt auf jeder Trajektorie

Ȧ = 0. Folglich hat auf die Funktion auf der rechten Seite von (15.66) auf jeder Trajektorie den Wert Null.

157

Da durch jeden Punkt im Phasenraum genau eine Trajektorie geht, verschwindet also die Funktion {H, A}

identisch.

Umgekehrt, wenn die Phasenraumfunktion {H, A} identisch verschwindet, dann folgt aus (15.66), dass

auf jeder Trajektorie Ȧ = 0 ist, also ist A eine Erhaltungsgröße. Wir haben damit den folgenden Satz

bewiesen:

Eine Phasenraumfunktion A ist genau dann eine Erhaltungsgröße, wenn {H, A} = 0 ist.

Die Gleichung {H, A} = 0 ist ein System von partiellen Differenzialgleichungen für die Koordinatendarstellung A({q µ }, {pµ }) der Phasenraumfunktion A. Wir haben also die Suche nach Erhaltungsgrößen

auf das Lösen dieser Differenzialgleichungen zurückgeführt. Allerdings wäre es sehr mühsam, dies für ein

gegebenes System explizit durchzuführen, um alle möglichen Erhaltungsgrößen zu finden. Wir werden daher zunächst ein paar Sätze über die Poisson-Klammer beweisen, die diese Suche nach Erhaltungsgrößen

erheblich vereinfachen.

Aufgabe 15.16 Auch die Ortskoordinaten q µ und die konjugierten Impulse pµ sind reellwertige Phasenraumfunktionen. Man zeige, dass sich für sie die folgenden Poisson-Klammern ergeben,

{q µ , q ν } = 0,

{q µ , pν } = −δ µν ,

{pµ , q ν } = δµ ν ,

{pµ , pν } = 0.

(15.67)

Die Poisson-Klammern dieser speziellen Funktionen sind also sehr einfache Phasenraumfunktionen,

nämlich konstante Funktionen mit dem Werten 0, 1 oder −1.

Aufgabe 15.17 Wir fassen die Phasenraumkoordinaten q µ und pµ zu einem einzigen Satz von Koordinaten

xm zusammen, wobei der Index m 2 N Werte annimmt, wenn das System N Freiheitsgrade hat. Man zeige,

dass die Bewegungsgleichungen des Systems dann wie folgt geschrieben werden k önnen,

ẋm = {H, xm }.

(15.68)

In dieser Form gelten die Bewegungsgleichungen auch dann noch, wenn x m beliebige krummlinige Koordinaten auf dem Phasenraum sind, also irgendwelche Funktionen von q µ und pµ , die einen Zustand eindeutig

festlegen. Wie kann man das beweisen, ohne eine längere Rechnung durchführen zu müssen?

Aufgabe 15.18 Es seien (x, y, z) die Ortskoordinaten eines Teilchens im dreidimensionalen Raum und

(px , py , pz ) die kanonisch konjugierten Impulse. Auf dem sechsdimensionalen Phasenraum P, der durch

die Koordinaten (x, y, z, px , py , pz ) aufgespannt wird, betrachten wird die Funktionen

A = p x 2 + py 2 + z 2 ,

B = p y 2 + p z 2 + x2 ,

C = p z 2 + px 2 + y 2 .

(15.69)

Man berechne die Poisson-Klammern {A, B}, {B, C} und {C, A}.

Aufgabe 15.19 Man beweise die folgende Kettenregel für Poisson-Klammern. Sind Ak (q, p), mit k ∈

{1, . . . , K}, irgendwelche differenzierbaren Phasenraumfunktion, und ist F (a 1 , . . . , aK ) eine Funktion

mit K reellen Argumenten, so ist F (q, p) = F (A1 (q, p), . . . , Ak (q, p)) wieder eine Phasenraumfunktion.

Für die Poisson-Klammer dieser Funktion mit einer anderen gilt

{F (A1 , . . . , Ak ), B} =

X ∂F

{Ak , B}.

∂A

k

k

(15.70)

Dieser Regel ist völlig analog zur Kettenregel für partielle Ableitungen und gilt natürlich auch im zweiten

Argument der Poisson-Klammer.

158

Die Poisson-Algebra

Die Poisson-Klammer definiert ein Produkt auf dem Raum aller beliebig oft differenzierbaren Phasenraumfunktionen. Bezeichen wir diesen Raum wie in der Mathematik üblich mit C ∞ (P), so wird das Produkt durch die Abbildung

{, } :

C ∞ (P) × C ∞ (P) → C ∞ (P),

(A, B)

7→ {A, B}

(15.71)

definiert. Die Bezeichnung “Produkt” ist deshalb gerechtfertigt, weil die Poisson-Klammer die üblichen

Eigenschaften eines Produktes hat, nämlich linear in beiden Argumenten zu sein. Der Raum C ∞ (P) ist ein

Vektorraum, das heißt wir können Phasenraumfunktionen addieren und mit reellen Zahlen multiplizieren.

Es gilt dann für alle A, B, C ∈ C ∞ (P) und alle u ∈ R

Linearität

{A + B, C} = {A, C} + {B, C},

{u A, B} = u {A, B}.

(15.72)

Dasselbe gilt natürlich für das zweite Argument, was sich auch unmittelbar aus der folgenden Eigenschaft

ergibt. Die Poisson-Klammer ist antisymmetrisch, das heißt für alle A, B ∈ C ∞ (P) gilt

Antisymmetrie

{A, B} = −{B, A}.

(15.73)

Diese beiden Eigenschaften der Poisson-Klammer lassen sich sehr leicht aus der Definition (15.65) ablesen. Die folgende Eigenschaft ist nicht sofort offensichtlich, lässt sich aber durch explizites Nachrechnen

überprüfen. Für drei Phasenraumfunktionen A, B, C ∈ C ∞ (P) gilt die Jacobi-Identität

JacobiIdentität

{A, {B, C}} + {B, {C, A}} + {C, {A, B}} = 0.

(15.74)

Diese werden wir im folgenden einige Male benutzen, um Sätze über Erhaltungsgrößen zu beweisen.

Ein Produkt mit diesen drei Eigenschaften nennt man Lie-Produkt, und ein Vektorraum, auf dem ein LieProdukt definiert ist, heißt Lie-Algebra. Der Vektorraum C ∞ (P) wird also durch die Poisson-Klammer zu

einer Lie-Algebra.

Nun gibt es auf diesem Raum aber noch ein zweites Produkt, nämlich das gewöhnliche, punktweise

definierte Produkt von zwei Funktionen (A, B) 7→ A B. Setzen wir ein solches Produkt von zwei Funktionen in die Poisson-Klammer ein, so finden wir nach einer kurzen Rechnung, dass für je drei Funktionen

A, B, C ∈ C ∞ (P) die Leibniz- oder Produktregel gilt,

LeibnizRegel

{A B, C} = {A, C} B + A {B, C}.

(15.75)

Das ist im wesentlichen die Produktregel für Ableitungen. Die Poisson-Klammer wirkt auf jedes ihrer

Argumente wie ein Ableitungsoperator. Es gelten formal die gleichen Rechenregeln wie für das Ableiten

von Funktionen.

Auf dem Vektorraum C ∞ (P) sind folglich zwei Produkte definiert, die gewöhnliche, punktweise Multiplikation von zwei Funktionen, und die Poisson-Klammer. Sie sind im Sinne der Leibniz-Regel miteinander verträglich. Man kann das Bilden der Poisson-Klammer mit der gewöhnlichen Multiplikation in der

Reihenfolge vertauschen, wenn man Leibniz-Regel beachtet. Ein Vektorraum, auf dem in dieser Art und

Weise zwei Produkte definiert sind, heißt Poisson-Algebra.

Der Funktionenraum C ∞ (P) aller beliebig oft differenzierbaren Phasenraumfunktionen ist

eine Poisson-Algebra.

159

Aufgabe 15.20 Man beweise die Jacobi-Identität und die Leibniz-Regel durch Einsetzen der Definition

der Poisson-Klammer und direktes Nachrechnen.

Aufgabe 15.21 Wir kennen bereits ein ganz anderes Lie-Produkt, n ämlich das Kreuzprodukt auf einem

dreidimensionalen metrischen Vektorraum. Man überzeuge sich davon, dass dadurch tatsächlich eine LieAlgebra definiert wird. Warum handelt es sich nicht um eine Poisson-Algebra?

Aufgabe 15.22 Auf dem zweidimensionalen Phasenraum eines mechanischen Systems mit einen Freiheitsgrad seien die folgenden drei Funktionen definiert,

A1 = p 2 + q 2 ,

A2 = 2 p q,

A 3 = p2 − q 2 ,

(15.76)

wobei (q, p) ein kanonisches Koordinatensystem ist. Man berechne die Poisson Klammern dieser Funktionen untereinander und verifiziere die Jacobi-Identität.

Aufgabe 15.23 Für ein Teilchen im dreidimensionalen Euklidischen Raum seien ri die Ortskoordinaten

und pi die konjugierten Impulse. Die Komponenten des Drehimpulses sind dann

li = εijk rj pk .

(15.77)

Man berechne ihre Poisson-Klammern und zeige

{li , lj } = −εijk lk .

(15.78)

Wenn das Teilchen in freies Teilchen ist, dann gilt H = pi pi /(2 m). Man zeige, dass der Drehimpuls dann

eine Erhaltungsgröße ist.

Aufgabe 15.24 Man beweise folgenden Satz. Sind A und B zwei Erhaltungsgr ößen eines mechanischen

Systems, so ist auch C = {A, B} eine Erhaltungsgröße.

Der Energieerhaltungsatz

Was können wir nun mit der Poisson-Klammer und ihren Eigenschaften konkret anfangen? Wie bereits

gezeigt, haben wir mit der Poisson-Klammer ein zumindest prinzipiell sehr einfaches Verfahren zur Hand,

mit dem wir testen können, ob eine gegebene Phasenraumfunktion A eine Erhaltungsgröße ist oder nicht.

Wir müssen nur die Poisson-Klammer {H, A} ausrechnen. Wenn sie identisch verschwindet, dann ist A

eine Erhaltungsgröße, sonst nicht.

Eine ganz spezielle Erhaltungsgröße können wir sofort angeben. Es ist die Hamilton-Funktion selbst.

Wegen der Antisymmetrie gilt nämlich immer {H, H} = 0. Die einzige Voraussetzung, die wir bei der

ganzen Überlegung gemacht haben, ist, dass das System autonom ist, seine Hamilton-Funktion also nicht

explizit von der Zeit abhängt.

Ist die Hamilton-Funktion eines mechanischen System nicht explizit zeitabhängig, so ist sie

eine Erhaltungsgröße.

Das ist der Energieerhaltungsatz in der Hamiltonschen Mechanik. Er ergibt sich aus einer bestimmten

Symmetrie des betrachteten Systems, nämlich der Symmetrie unter einer Zeitverschiebung. Ein System ist

symmetrisch unter Zeitverschiebung, wenn es unabhängig davon, wann wir einen bestimmten Anfangszustand herstellen, stets die gleiche Trajektorie durchläuft. Genau das wird durch die Zeitunabhängigkeit der

Hamilton-Funktion zum Ausdruck gebracht.

Wir hatten diese Tatsache bereits anhand der Beispiele in Abbildung 15.1 diskutiert. Wir betrachten nun

die dort eingezeichneten Trajektorien noch einmal etwas genauer. Der Energieerhaltungsatz besagt, dass

160

der Wert der Funktion H auf jeder Trajektorie konstant ist. Also folgen die Trajektorien den Niveaulinien

von H, die in der Abbildung als gestichelte Linien eingezeichnet sind. Für den harmonischen Oszillator

sind dies Ellipsen, für das Pendel ergeben sich etwas komplizierte Linien. In beiden Fällen folgen die

Trajektorien dem Verlauf dieser Linien.

Für ein System mit nur einem Freiheitsgrad, dessen zweidimensionaler Phasenraum durch die kanonischen Koordinaten (q, p) aufgespannt wird, hat dies eine interessante Konsequenz. Wir können nämlich

allein aus dem Verlauf der Niveaulinien von H bereits auf die möglichen Bewegungsformen des System

schließen. Tatsächlich haben wir eine ganz ähnlich Diskussion bereits in Kapitel 7 im Rahmen der Newtonschen Mechanik durchgeführt, um die Bewegungen eines Systems mit nur einem Freiheitsgrad qualitativ

zu beschreiben. Auch dort beruhte das Vorgehen auf dem Energieerhaltungsatz.

Betrachten wir zum Beispiel den Phasenraum des Pendels in Abbildung 15.1(b), so erkennen wir, dass es

im wesentlichen zwei Typen von Niveaulinien gibt, nämlich solche, die sich um den Zylinder wickeln, und

solche, die der Ursprung umrunden. Folglich gibt es auch zwei Bewegungsformen des Pendels, nämlich

das sich überschlagende und das oszillierende Pendel. Dazwischen liegt die Kriechbahn als Grenzfall. Sie

entspricht der speziellen Niveaulinien, die die beiden Bereiche des Phasenraumes voneinander trennt.

An den zwei Gleichgewichtslagen bei q = 0 und p = 0 unten, sowie bei q = ±π` und p = 0 oben,

weisen die Niveaulinien jeweils eine Besonderheit auf. Am stabilen Gleichgewichtspunkt unten bilden sie

kleine Kreise, oder genauer Ellipsen. Wie man sich leicht überzeugt, besitzt die Hamilton-Funktion des