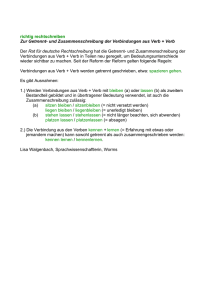

Zur Analyse der scheinbar mehrfachen Vorfeldbesetzung

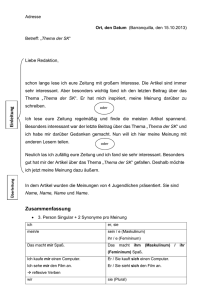

Werbung