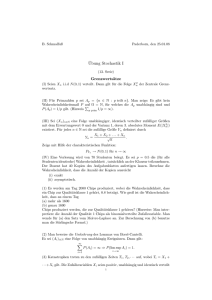

1. ¨Ubungsblatt - Math.Uni

Werbung

Markus Reiß

Vorlesung

Wahrscheinlichkeitstheorie

Wintersemester 2005/06

1. Übungsblatt

1. Zeige, dass folgende Mengensysteme M ebenfalls die Borel-σ-Algebra BRn des

Rn erzeugen:

(a) M := {A ⊆ Rn | A abgeschlossen}

(b) M := {K ⊆ Rn | K kompakt}

Q

(c) M := { nk=1 [ai , bi ] | ai , bi ∈ R}

Q

(d) M := { nk=1 [ai , bi ] | ai , bi ∈ Q}

2. Beweise folgenden Satz:

Eine Funktion f = (f1 , . . . , fn ) : F → Rn ist genau dann (F, BRn )-messbar,

wenn alle Koordinatenfunktionen fi , 1 6 i 6 n, (F, BR )-messbar sind.

Hinweis: Benutze für eine Richtung den Erzeuger aus 1(c).

3. Algebren und Prämaße:

(a) Bestimme die kleinste Algebra A über R, die folgendes Mengensystem

umfasst:

I := {(a, b] | a, b ∈ R ∪{−∞}}.

Bemerkung: I besitzt die Struktur eines sogenannten Halbrings.

(b) Konstruiere ein Prämaß µ auf A, so dass µ((a, b]) = b − a für a < b gilt.

Ist µ eindeutig bestimmt?

4. Es seien (Xn )n>1 unabhängige {0, 1}-wertige Zufallsvariablen auf einem Wahrscheinlichkeitsraum (Ω, F, P) mit P(X = 0) = P(X = 1) = 1/2. Setze

Y :=

∞

X

Xk 2−k .

k=1

(a) Begründe, weshalb Y eine Zufallsvariable ist.

(b) Bestimme P(Y 6 m2−n ) für beliebige n ∈ N und m = 0, 1, . . . , 2n .

(c) Schließe, dass die Verteilungsfunktion von Y mit der Verteilungsfunktion

der gleichmäßigen Verteilung auf [0, 1] übereinstimmt (d.h. Y ist U [0, 1]verteilt).

Abgabe in der Vorlesung am Donnerstag, dem 27.10.05.

Markus Reiß

Vorlesung

Wahrscheinlichkeitstheorie

Wintersemester 2005/06

2. Übungsblatt

1. Es sei F eine σ-Algebra über X. Jede σ-additive Funktion µ : F → R heißt

endliches signiertes Maß. Zeige:

(a) Für jedes endliche signierte Maß µ gilt kµkT V := supA∈F |µ(A)| < ∞.

(b) Die endlichen signierten Maße bilden einen Vektorraum M und die Wahrscheinlichkeitsmaße eine konvexe Teilmenge von M . k•kT V ist eine Norm

(Total-Variationsnorm) auf diesem Raum.

(c) Sind P und Q Wahrscheinlichkeitsmaße auf (R, BR ) mit Dichten f bzw.

g, so gilt mit B = {x : f (x) > g(x)}

Z

1 ∞

kP − QkT V = P(B) − Q(B) = Q(B C ) − P(B C ) =

|f (x) − g(x)| dx.

2 −∞

2. Der Messraum (Ω, F) eines zweifachen Münzwurfs sei durch Ω = {0, 1}2 , F =

P(Ω) modelliert. M bestehe aus allen Ereignissen, die von höchstens einem

der Münzwürfe abhängen:

M = ∅, {(0, 0), (0, 1)}, {(1, 0), (1, 1)}, {(0, 0), (1, 0)}, {(0, 1), (1, 1)}, Ω .

(a) Zeige, dass M die σ-Algebra F erzeugt, jedoch nicht ∩-stabil ist.

(b) Finde zwei Wahrscheinlichkeitsmaße, die auf M übereinstimmen, jedoch

nicht auf F.

Tipp: Betrachte unabhängige bzw. identische Münzwürfe.

3. Es sei P ein Wahrscheinlichkeitsmaß auf (R2 , BR2 ). Zeige folgende Eigenschaften der zugehörigen Verteilungsfunktion F (x, y) := P((−∞, x] × (−∞, y]):

(a) Durch die Angabe von F ist P eindeutig bestimmt.

(b) Es gilt für alle a1 6 b1 , a2 6 b2 (Skizze!)

F (b1 , b2 ) − F (a1 , b2 ) − F (b1 , a2 ) + F (a1 , a2 ) = P (a1 , b1 ] × (a2 , b2 ] > 0.

(k)

(c) Für x(k) ∈ R2 mit xi

↓ xi , i = 1, 2, für k → ∞ folgt F (x(k) ) ↓ F (x).

(d) limk→∞ F (k, k) = 1, limk→−∞ F (k, k) = 0.

Bemerkung: Wie im eindimensionalen Fall kann man umgekehrt zeigen, dass

jede Funktion F mit den Eigenschaften (b)-(d) ein zugehöriges Wahrscheinlichkeitsmaß P auf BR2 generiert.

4. Aus der Vorlesung ist bekannt, dass auf der Menge Ω = {0, 1}N der 0-1-Folgen

das System der Zylindermengen A = {Tn × {0, 1}N | n > 1, Tn ⊆ {0, 1}n } eine

Algebra bildet. Zu gegebenem p ∈ [0, 1] setze für jedes Tn ⊆ {0, 1}n

X

p i ai (1 − p)n− i ai .

µ(Tn × {0, 1}N ) :=

P

P

(a1 ,...,an )∈Tn

(a) Zeige, dass µ : A → [0, 1] additiv ist, d.h. µ(A ∪ B) = µ(A) + µ(B) für

A ∩ B = ∅ gilt.

(b) Weise nach, dass µ sogar σ-additiv ist, und schließe, dass sich µ eindeutig

zu einem Wahrscheinlichkeitsmaß P auf (Ω, σ(A)) fortsetzen lässt.

(c) Zeige: die Projektionen Xn : Ω → R mit Xn (ω) = ωn sind unabhängige

Zufallsvariablen mit P(Xn = 1) = p, P(Xn = 0) = 1 − p.

Abgabe in der Vorlesung am Donnerstag, dem 3.11.05.

Markus Reiß

Vorlesung

Wahrscheinlichkeitstheorie

Wintersemester 2005/06

3. Übungsblatt

1. Es sei F : R → [0, 1] gegeben durch

F (x) =

∞

X

2−n 1[1/n,∞) (x).

n=1

Zeige, dass es sich um die Verteilungsfunktion eines Wahrscheinlichkeitsmaßes

P auf BR handelt, und berechne folgende Wahrscheinlichkeiten

P([1, ∞)), P([1/10, ∞), P({0}), P((−5, 1/2)), P(Q).

2. Zufallsvariablen X1 , . . . , Xn auf

Qn (Ω, F, P) heißen bekanntlich unabhängig, falls

P(X1 ∈ A1 , . . . , Xn ∈ An ) = i=1 P(Xi ∈ Ai ) für alle Ai ∈ BR gilt. Zeige:

(a) X

Q1n, . . . , Xn sind bereits unabhängig, falls P(X1 6 x1 , . . . , Xn 6 xn ) =

i=1 P(Xi 6 xi ) für alle xi ∈ R gilt.

Tipp: Betrachte P(X1 ,...,Xn ) und einen ∩-stabilen Erzeuger von BRn .

(b) Besitzen X und Y Dichten f X bzw. f Y und sind X und Y unabhängig,

so hat (X, Y ) eine Dichte f (X,Y ) , die durch f (X,Y ) (x, y) = f X (x)f Y (y)

gegeben ist.

(c) Gilt allgemein, dass (X, Y ) eine zweidimensionale Dichte besitzt, sofern

X und Y jeweils eine eindimensionale Dichte besitzen?

R

3. Zeige, dass die Definition des Integrals f dµ für Treppenfunktionen f ∈ T +

unabhängig von der Zerlegung ist, also aus

m

X

k=1

bk 1Bk (x) =

n

X

c` 1C` (x) ∀ x ∈ X

`=1

Pm

Pn

b

µ(B

)

=

k

k

k=1

`=1 c` µ(C` ) folgt. Was kann man auf Grund der Eigenschaft

R

f dµ = 0 über die Menge {f > 0} aussagen?

4. Für M ⊆ N setze µ(M ) := |M | (Kardinalität von M ). Beweise:

(a) µ ist ein σ-endliches Maß auf (N, P(N)) (Zählmaß ).

(b) Jede Funktion a : N → [0, ∞) ist messbar, und es gilt

Z

X

a dµ =

a(n).

n∈N

Abgabe in der Vorlesung am Donnerstag, dem 10.11.05.

Markus Reiß

Vorlesung

Wahrscheinlichkeitstheorie

Wintersemester 2005/06

4. Übungsblatt

1. Beweise: Ist f : [a, b] → R eine Borel-messbare und Riemann-integrierbare

Funktion, so ist f Lebesgue-integrierbar, und Riemann- und Lebesgue-Integral

stimmen überein. Beweisschritte:

(a) Für jede Zerlegung a = x0 < x1 < · · · < xn = b lassen

R sich OberU

O

und

R Untersummen schreiben als Lebesgue-Integrale Sn = On dλ, Sn =

Un dλ mit

On =

n X

i=1

sup

x∈[xi−1 ,xi ]

f (x) 1[xi−1 ,xi ] ,

Un =

n X

i=1

inf

x∈[xi−1 ,xi ]

f (x) 1[xi−1 ,xi ] .

(n)

(b) Für jede Folge von feiner werdenden Zerlegungen (xi )06i6n gilt (On −

Un ) ↓ g mit einer Funktion g ∈ M+ .

(c) Mit dem Lemma von Fatou folgt

Z

0 6 g dλ 6 lim (SnO − SnU ) = 0,

n→∞

so dass g = 0 λ-fast überall und Un ↑ f λ-fast überall gilt.

(d) Unter Benutzung einer unteren

Schranke für (Un )n>1 folgt mittels monoR

toner Konvergenz SnU ↑ f dλ und damit die Behauptung.

2. REs seien (Ω, F, µ) ein beliebiger Maßraum, f : R Ω → [0, ∞] messbar mit

f dµ = 1 (f ist Dichtefunktion) sowie P(A) := A f dµ das erzeugte Wahrscheinlichkeitsmaß auf F. Beweise, dass für alle X ∈ L1 (Ω, F, P) gilt

Z

Z

Z

E[X] := X d P = Xf dµ := X(ω)f (ω) µ(dω).

Tipp: Betrachte zunächst X ∈ T + und X ∈ M+ .

3. Gilt E[|X|p ] < ∞ für eine Zufallsvariable X, so schreibt man X ∈ Lp , p > 0,

und setzt kXkLp = E[|X|p ]1/p . Beweise, dass für Zufallsvariablen Xn aus kXn −

XkLp → 0 folgt Xn → X in Wahrscheinlichkeit (Tipp: Markov-Ungleichung),

aber im Allgemeinen nicht die Umkehrung.

Bemerkung: Es gilt Lp ⊆ Lq für p > q, und für p > 1 ist k•kLp eine Seminorm

auf dem Vektorraum Lp .

4. Es sei (Xn )n>1 eine Folge nicht-negativer Zufallsvariablen. Beweise:

E

∞

hX

n=1

∞

i X

Xn =

E[Xn ].

n=1

Zeige anhand eines Gegenbeispiels, dass im Falle allgemeiner Zufallsvariablen

diese Identität nicht erfüllt sein muss.

Abgabe in der Vorlesung am Donnerstag, dem 17.11.05.

Markus Reiß

Vorlesung

Wahrscheinlichkeitstheorie

Wintersemester 2005/06

5. Übungsblatt

1. Beweise folgendes Lemma von Scheffé:

Es seien (X, F, µ) ein beliebiger Massraum sowie f und fn , n > 1, Wahrscheinlichkeitsdichten auf X bezüglich µ. Dann folgt aus limn→∞ fn (x) = f (x) für

alle x ∈ X die Konvergenz limn→∞ kfn − f kL1 = 0.

Schließe, dass für σn → σ > 0 und µn → µ ∈ R die Normalverteilungen

N (µn , σn2 ) in Totalvariationsnorm (vgl. Übung 2.1) gegen N (µ, σ 2 ) konvergieren.

R

R

Hinweis: Benutze (fn − f )− 6 f , dominierte Konvergenz und fn dµ = f dµ.

2. Es seien X eine Menge, (Si , Si ) Messräume und gi : X → Si beliebige Funktionen für i ∈ I. Dann wird mit σ(gi , i ∈ I) die kleinste σ-Algebra über X

bezeichnet, bezüglich der alle Funktion gi messbar sind. Zeige:

(a) σ(gi , i ∈ I) ist wohldefiniert.

(b) Im Fall I = {1, . . . , n} und (Si , Si ) = (R, BR ) gilt unter Verwendung von

g = (g1 , . . . , gn ) : X → Rn

σ(g1 , . . . , gn ) = {g −1 (B) | B ∈ BRn }.

(c) Es bezeichne G die Menge aller Borel-messbaren Funktionen g : R → R

mit g(−x) = g(x) für alle x ∈ R. Dann erzeugt G die σ-Algebra der

symmetrischen Borelmengen auf R:

σ(g ∈ G) = {B ∈ BR | {−x | x ∈ B} = B}.

3. Auf den Messräumen (Xi , Fi ) sei jeweils Ei ein Erzeuger von Fi , i ∈ I. Weise

nach, dass dann

n

o

[

Y

πi−1 (Ei ) = Ei ×

Xj i ∈ I, Ei ∈ Ei

i∈I

ein Erzeuger der Produkt-σ-Algebra

BRn = BRm+n ?

j6=i

N

i∈I

Fi ist. Wieso impliziert dies BRm ⊗

4. Es seien X und U unabhängige Zufallsvariablen und U möge gleichmäßig auf

[0, 2π] verteilt sein. Zeige mit

PNHilfe des Satzes von Fubini, dass E[sin(X +U )] =

0 gilt. Berechne ebenso E[ k=1 Xk ] für eine N-wertige Zufallsvariable N , die

unabhängig von (Xk )k>1 ist, wobei E[N ] = µN < ∞ und E[Xk ] = µX ∈ R für

alle k gelten möge.

Abgabe in der Vorlesung am Donnerstag, dem 24.11.05.

Markus Reiß

Vorlesung

Wahrscheinlichkeitstheorie

Wintersemester 2005/06

6. Übungsblatt

1. Ein Affe, der rein zufällig auf einer Computertastatur tippt, wird irgendwann

”

einmal auch Goethes Faust schreiben“. Formalisiere diese Weisheit und gib eine

exakte mathematische Begründung mittels des Lemmas von Borell-Cantelli

dafür, dass er dies mit Wahrscheinlichkeit Eins sogar unendlich oft tun wird

(so er unendlich lange lebt).

2. Beweise oder widerlege für Ereignisse (An ) die Relationen lim inf n An ⊆

lim supn An , (lim supn An )C = lim inf n (AC

n ), P(lim supn An ) > lim supn P(An ).

3. Durch P

(Sn )n>1 sei eine zufällige Irrfahrt auf Z gegeben, d.h. S0 := 0,

n

Sn :=

k=1 Xk mit unabhängigen {−1, +1}-wertigen Zufallsvariablen (Xk )

mit P(Xk = +1) = p ∈ [0, 1]. Beweise mit Begründung für jeden einzelnen

Schritt:

(a) Für p 6= 1/2 folgt unter Verwendung der Stirling-Formel

(siehe z.B. BauP

P(S

=

0) < ∞ sowie

er) und des Lemmas von Borel-Cantelli

2n

n>1

P(lim supn→∞ {Sn = 0}) = 0.

(b) Nun sei p = 1/2. Setzt man Ac := {lim inf n n−1/2 Sn < −c}, Bc :=

{lim supn n−1/2 Sn > c} für c > 0, so ergibt sich mittels zentralem Grenzwertsatz und der Formel lim supn P(Yn > α) 6 P(lim supn Yn > α)

P(Ac ) = P(Bc ) > lim sup P n−1/2 Sn > c > 0.

n→∞

Weil Ac und Bc terminale Ereignisse bezüglich (Xn ) sind, folgt

Sn

Sn

P lim inf √ = −∞, lim sup √ = ∞ = lim P(Ac ∩ Bc ) = 1,

n→∞

c→∞

n

n

n→∞

also insbesondere P(lim supn→∞ {Sn = 0}) = 1.

Beachte: lim supn→∞ {Sn = 0} ist i.A. kein terminales Ereignis bezüglich (Xn ).

4. Es sei (Ω, P(Ω), P) ein diskreter Wahrscheinlichkeitsraum. Weise nach, dass

für Zufallsvariablen auf diesem Raum P-fast sichere und P-stochastische Konvergenz übereinstimmen.

Abgabe in der Vorlesung am Donnerstag, dem 1.12.05.

Markus Reiß

Vorlesung

Wahrscheinlichkeitstheorie

Wintersemester 2005/06

7. Übungsblatt

P

1. Betrachte Tn = nk=1 ηk k1 , wobei (ηk )k>1 eine Folge unabhängiger Zufallsvariablen mit P(ηk = +1) = P(ηk = −1) = 21 ist.

(a) Zeige, dass (Tn )n>1 eine Cauchyfolge in L2 ist.

(b) Schliesse, dass Tn P-stochastisch gegen eine Zufallsvariable T∞ in L2 konvergiert.

(c) Bestimme Erwartungswert und Varianz von T∞ .

2. Folgere aus dem in der Vorlesung bewiesenen Satz der dominierten Konvergenz

folgende Verallgemeinerungen:

(a) Konvergieren Zufallsvariablen (Xn )n>1 P-fast sicher gegen eine Zufallsvariable X und gilt P(|Xn | 6 Y ) = 1 für ein Y ∈ L1 , so folgt

limn→∞ E[|Xn − X|] = 0.

(b) Konvergieren Zufallsvariablen (Xn )n>1 P-stochastisch gegen eine Zufallsvariable X und gilt P(|Xn | 6 Y ) = 1 für ein Y ∈ L1 , so folgt ebenfalls

limn→∞ E[|Xn − X|] = 0.

Tipp: Benutze für (b) das Teilteilfolgenkriterium.

3. Untersuche, ob für n → ∞ die Wahrscheinlichkeitsmaße Pn mit folgenden

Lebesguedichten fn auf R in Totalvariation, schwach oder in keinem der beiden

Sinne konvergieren, und bestimme gegebenenfalls den Grenzwert:

fn (x) = ne−nx 1[0,∞) (x),

fn (x) =

n+1 1/n

1[0,1] (x),

n x

fn (x) = n1 1[0,n] (x).

4. Es seien a ∈ R, (Xn )n>1 und X Zufallsvariablen auf einem Wahrscheinlichd

P

keitsraum sowie P(X = a) = 1. Beweise: Xn −

→ X ⇐⇒ Xn −

→ X.

Abgabe in der Vorlesung am Donnerstag, dem 8.12.05.

Markus Reiß

Vorlesung

Wahrscheinlichkeitstheorie

Wintersemester 2005/06

8. Übungsblatt

d

→ X sowie

1. Es seien Xn , n > 1, und X reellwertige Zufallsvariablen mit Xn −

mit stetigen, streng monoton wachsenden Verteilungsfunktionen Fn bzw. F .

Zeige:

(a) Für die Umkehrfunktionen gilt limn→∞ Fn−1 (u) = F −1 (u) für alle u ∈

(0, 1).

(b) Ist U eine gleichmäßig auf (0, 1) verteilte Zufallsvariable, so sind Xn

und Fn−1 (U ) sowie X und F −1 (U ) jeweils identisch verteilt, und es gilt

Fn−1 (U ) → F −1 (U ) P-fast sicher.

d

Bemerkung: Dies ist ein Spezialfall der Skorokhod-Darstellung: Gilt Xn −

→X

für Zufallsvariablen mit Werten in einem separablen metrischen Raum, so kann

man einen Wahrscheinlichkeitsraum (Ω0 , F 0 , P0 ) und Zufallsvariablen Yn , Y auf

d

d

P0 -f.s.

diesem Raum so konstruieren, dass Yn = Xn , Y = X und Yn −−−→ Y gilt.

2. Es sei (Xn )n>1 eine Folge unabhängiger identisch verteilter Zufallsvariablen in

L4 . Zeige:

P

(a) X̄n := n1 ni=1 Xi ist eine konsistente Schätzung für µ := E[Xn ].

1 Pn

2

2

(b) Sn2 := n−1

i=1 (Xi − X̄n ) ist eine konsistente Schätzung für σ :=

Var(Xn ).

√

(c) Schließe mit dem zentralen Grenzwertsatz, dass n(X¯n − µ)/Sn in Verteilung gegen die Standardnormalverteilung konvergiert.

(d) Das Konfidenzintervall In = [X̄n − n−1/2 Sn zα , X̄n + n−1/2 Sn zα ] für µ mit

1−Φ(zα ) = α (Verteilungsfunktion Φ von N (0, 1)) hat das asymptotische

Niveau 1 − 2α:

lim P(µ ∈ In ) = 1 − 2α.

n→∞

(e) freiwillig: Führe jeweils 1000 Simulationen für N (0, 1)- und Exp(1)verteilte Zufallsvariablen Xi , 1 6 i 6 n, durch, um P(µ ∈ In ) in (d)

mit α = 0, 025 für n = 10, 20, 50, 100 approximativ zu bestimmen.

3. Beweise mittels Markov-Ungleichung: Ist (Xi )i∈I eine Familie reellwertiger Zufallsvariablen, so impliziert supi E[|Xi |p ] < ∞ für ein p > 0, dass die Verteilungen (PXi )i∈I straff sind. [kurz: Lp -Beschränktheit ⇒ Straffheit]

4. Eine Folge (Xn )n>1 von Zufallsvariablen, deren Verteilungen straff sind, heißt

beschränkt in Wahrscheinlichkeit, in Zeichen: Xn = OP (1). Man schreibt Xn =

oP (1), falls Xn = Rn Yn gilt mit Zufallsvariablen Yn = OP (1) und Rn → 0 Pstochastisch. Weise folgende Regeln nach:

P

→0

(a) Xn = oP (1) ⇐⇒ Xn −

(b) oP (1) + oP (1) = oP (1)

(c) oP (1) + OP (1) = OP (1)

(d) oP (1)OP (1) = oP (1)

Die Regeln sind symbolisch zu verstehen, unter Verwendung von (a) bedeutet

P

P

P

→ 0.

→ 0 ⇒ Xn + Yn −

→ 0, Yn −

z.B. (b): Xn −

Abgabe in der Vorlesung am Donnerstag, dem 15.12.05.

Markus Reiß

Vorlesung

Wahrscheinlichkeitstheorie

Wintersemester 2005/06

9. Übungsblatt

1. Beweise den Poissonschen Grenzwertsatz mit Hilfe charakteristischer Funktionen in folgenden Schritten:

(a) Zeige, dass die charakteristischen Funktionen der Binomialverteilung

Binn,pn mit npn → λ > 0 für n → ∞ gegen die charakteristische Funktion

der Poissonverteilung mit Parameter λ konvergiert.

(b) Weise nach, dass die Folge (Binn,pn )n>1 straff ist, falls npn → λ gilt,

und folgere die schwache Konvergenz der Verteilungen Binn,pn gegen die

Poissonverteilung mit Parameter λ.

(c) Zeige, dass bei Verteilungen auf N0 schwache Konvergenz die Konvergenz

der Zähldichten impliziert. [Es gilt sogar Äquivalenz]

2. Mit Γ(α, λ) wird die Gamma-Verteilung auf R+ mit Lebesguedichte

fα,λ (x) =

λα α−1 −λx

x

e

,

Γ(α)

x > 0, (Γ: Gamma-Funktion)

und Parametern α, λ > 0 bezeichnet.

(a) Begründe, weshalb fα,λ eine Wahrscheinlichkeitsdichte bezüglich dem Lebesguemaß ist, und zeige (z. B. durch Potenzreihenentwicklung von eiux ),

dass die charakteristische Funktion gegeben ist durch

ϕα,λ (u) =

λα

,

(λ − iu)α

u ∈ R.

(b) Bestimme Erwartungswert und Varianz einer Γ(α, λ)-verteilten Zufallsvariablen.

(c) Weise Γ(α1 , λ) ∗ Γ(α2 , λ) = Γ(α1 + α2 , λ) nach.

(d) Mit χ2 (p) wird die Verteilung von |X|2 für einen p-dimensionalen standardnormalverteilten Zufallsvektor X bezeichnet. Zeige, dass χ2 (p) =

Γ(p/2, 1/2) gilt.

3. (freiwillig) Es sei X eine Zufallsvariable mit Werten in N0 . Dann ist ihre erzeugende Funktion definiert als GX (z) = E[z X ]. Für welche komplexen Werte z ist

GX stets wohldefiniert? Leite für die erzeugende Funktion analoge Resultate

wie für charakteristische Funktionen her (Momente, Faltung, Eindeutigkeit,

Grenzwertsatz).

4. (freiwillig) Betrachte die Menge Ωn aller n! Permutationen von {1, . . . , n} mit

der Laplaceverteilung Pn . Für jedes j = 1, . . . , n definiere die Zufallsvariable

Xn,j (ω) := |{k | 1 6 k 6 j − 1, ω(k) > ω(j)}|,

ω ∈ Ωn ,

d.h. Xn,j zählt die durch j implizierten Inversionen in der Permutation ω.

Zeige:

(a) Xn,1 , . . . , Xn,n sind unabhängige Zufallsvariablen mit Pn (Xn,j = m) =

1/j, m = 0, . . . , j − 1.

(b) Xn,j hat Erwartungswert (j − 1)/2 und Varianz (j 2 − 1)/12.

P

(c) Ist Sn = nj=1 Xn,j die Gesamtzahl der Inversionen, so gilt asymptotisch

Sn − n2 /4 d

−

→ N (0, 1).

n3/2 /6

Abgabe in der Vorlesung am Donnerstag, dem 12.1.06.

Markus Reiß

Vorlesung

Wahrscheinlichkeitstheorie

Wintersemester 2005/06

10. Übungsblatt

1. Es sei (X, Y ) ein zweidimensionaler Zufallsvektor mit Lebesguedichte f X,Y .

(a) REs sei B ⊆ R eine Borelmenge und x ∈ R mit f X (x) > 0 (f X (x) =

f X,Y (x, η) dη). Unter welcher Voraussetzung an f X,Y gilt

Z

Z

f X,Y (x, y)

Y |X=x

lim P(Y ∈ B | X ∈ [x, x + h]) =

f

(y) dy :=

dy ?

h↓0

f X (x)

B

B

(b) Zeige, dass für Y ∈ L2 und jede Lebesguedichte f X,Y gilt, dass

Z

ϕy (x) = yf Y |X=x (y) dy1{f X (x)>0}

den Ausdruck E[(Y − ϕ(X))2 ] minimiert, d.h. ϕy (X) = E[Y | X] gilt.

S

2. Es sei Ω = n∈N Bn eine messbare, abzählbare Partition der Grundmenge in

(Ω, F, P). Setze B := σ(Bn , n ∈ N). Zeige:

P

(a) Jede B-messbare Zufallsvariable X läßt sich schreiben als X = n αn 1Bn

mit geeigneten αn ∈ R.

R

P

(b) Für X ∈ L1 gilt E[X | B] = n: P(Bn )>0 P(B1 n ) Bn X d P 1Bn .

(c) Nun sei Ω = [0, 1) mit der Borel-σ-Algebra, P die gleichmäßige Verteilung (also Lebesguemaß auf [0, 1)) und X(ω) := ω, ω ∈ [0, 1). Bestimme

E[X | σ([(k − 1)/n, k/n), k = 1, . . . , n)] für n = 1, 3, 5, 10 und zeichne die

bedingten Erwartungen zusammen mit X in ein Koordinatensystem ein.

3. Es seien X und Y gemeinsam normalverteilte Zufallsvariablen.

2 =

(a) Für welche α ∈ R sind X und Y − αX unkorreliert? (Verwende σX

Var(X), σY2 = Var(Y ), ρ = Cor(X, Y ))

(b) Schließe, dass X und Y − (αX + β), für diese Werte α sowie β ∈ R beliebig, unabhängig sind und daher αX + β mit geeignetem β eine bedingte

Erwartung E[Y |X] ist.

Bemerkung: in diesem Fall ist die bedingte Erwartung also linear!

4. Beweise den Satz von der monotonen Konvergenz für bedingte Erwartungen:

Xn > 0, Xn ↑ X ⇒ E[Xn | G] ↑ E[X | G] P −f.s.

Abgabe in der Vorlesung am Donnerstag, dem 19.1.06.

Markus Reiß

Vorlesung

Wahrscheinlichkeitstheorie

Wintersemester 2005/06

11. Übungsblatt

1. Die Funktion ϕ : R → R sei konvex, d.h. ϕ(ax+(1−a)y) 6 aϕ(x)+(1−a)ϕ(y)

gilt für alle x, y ∈ R, a ∈ [0, 1]. Zeige:

(a) D(x, y) := ϕ(y)−ϕ(x)

, x 6= y, ist monoton wachsend in x und y, woraus

y−x

folgt, dass ϕ rechtsseitig und linksseitig differenzierbar sowie stetig ist.

(b) Mit der rechtsseitigen Ableitung ϕ0+ gilt:

∀ x, y ∈ R :

ϕ(y) > ϕ(x) + ϕ0+ (x)(y − x),

∀x ∈ R :

ϕ(y) = sup ϕ(x) + ϕ0+ (x)(y − x) .

x∈Q

(c) Sind Y, ϕ(Y ) ∈ L1 , so gilt E[ϕ(Y ) | G] > ϕ(x) + ϕ0+ (x)(E[Y | G] − x) für

alle x ∈ R.

(d) Es gilt die Jensensche Ungleichung für bedingte Erwartungen.

2. Für Y ∈ L2 definiert man die bedingte Varianz von Y gegeben X als

Var(Y |X) := E[(Y − E[Y | X])2 | X].

(a) Begründe, weshalb Var(Y |X) wohldefiniert ist.

(b) Zeige: Var(E[Y | X]) = Var(Y ) − E[Var(Y |X)] 6 Var(Y ).

(c) Begründe mittels (b) für unabhängige Zufallsvariablen (Zk )k und N in

L2 mit (Zk ) identisch verteilt und N N-wertig:

Y (ω) :=

PN (ω)

k=1

Zk (ω) ⇒ Var(Y ) = E[Z1 ] Var(N ) + E[N ] Var(Z1 ).

3. Verdopplungsstrategie: In jeder Runde wird eine faire Münze geworfen, bei

Kopf erhält der Spieler seinen doppelten Einsatz zurück, bei Zahl verliert er

seinen Einsatz. Der Spieler startet mit dem Anfangskapital K0 = 0. In Runde

n > 1 verfährt er wie folgt: Ist bereits einmal Kopf erschienen, so setzt er

nichts mehr; verliert er aber, so setzt er 2n+1 Euro für die (n + 1)-te Runde.

(a) Begründe, weshalb sich das Kapital Kn nach der n-ten Runde modellieren

lässt mit (Xi ) unabhängig, P(Xi = 1) = P(Xi = −1) = 1/2, als

(

−(2n − 1), X1 = · · · = Xn = −1,

Kn =

1,

sonst.

(b) Stelle Kn äquivalent als diskretes stochastisches Integral dar und schließe,

dass (Kn ) ein Martingal (bzgl. kanonischer Filtration) ist.

(c) Beweise, dass limn→∞ Kn = 1 P-fast sicher gilt.

4. Es sei T eine N0 -wertige Zufallsvariable und Sn := 1{n>T } , n > 0. Zeige:

(a) Die kanonische Filtration erfüllt FnS = σ({T = k}, k = 0, . . . , n).

(b) (Sn ) ist ein Submartingal bezüglich (FnS )n mit

E[Sn+1 | FnS ] = 1{Sn =1} + P(T = n + 1 | T > n + 1)1{Sn =0} P-f.s.

(c) Bestimme die Doobzerlegung von (Sn ). Skizziere für den Fall, dass T

geometrisch verteilt ist (P(T = k) = (1−p)pk ), (Sn ), seinen Kompensator

und ihre Differenz als Funktion von n.

Abgabe in der Vorlesung am Donnerstag, dem 26.1.06.

Markus Reiß

Vorlesung

Wahrscheinlichkeitstheorie

Wintersemester 2005/06

12. Übungsblatt

1. Beweise:

(a) Für jedes n ∈ N ist die Funktion τ (ω) = n, ω ∈ Ω, eine Stoppzeit.

(b) Sind σ und τ Stoppzeiten, so sind auch σ ∧ τ , σ ∨ τ und σ + τ Stoppzeiten.

Was ist mit σ − τ falls σ > τ ?

2. Es sei (FnX )n>0 die kanonische Filtration eines Prozesses (Xn )n>0 . Zeige für

eine endliche Stoppzeit τ bezüglich (FnX ), dass gilt

Fτ = σ(τ, Xτ ∧n , n > 0).

Hinweis: ’⊇’: zeige Fτ ∧n ⊆ Fτ . ’⊆’: schreibe A ∈ Fτ als A =

Freiwillig: Zeige sogar Fτ = σ(Xτ ∧n , n > 0).

S

nA

∩ {τ = n}.

3. Beweise die Höffding-Ungleichung: Für ein Martingal (Mn ) mit M0 = 0 und

|Mn (ω) − Mn−1 (ω)| 6 Kn , ω ∈ Ω, n > 1, gilt

x2

P(|Mn | > x) 6 2 exp − Pn

,

2 i=1 Ki2

x > 0.

Anleitung:

(a) Ist E[Z] = 0 und |Z| 6 1, so gilt eηZ 6 cosh(η) + Z sinh(η) und damit

2

E[eηZ ] 6 cosh(η) 6 eη /2 für alle η ∈ R.

(b) Es folgt E[exp(ηMn ) | Fn−1 ] 6 exp(ηMn−1 + η 2 Kn2 /2).

P

(c) Daraus ergibt sich induktiv E[exp(ηMn )] 6 exp(η 2 ni=1 Ki2 /2).

(d) Die verallgemeinerte Markov-Ungleichung und Optimierung über η liefern

das Ergebnis.

4. Es sei (Xk )k>1 eine Folge unabhängiger, identisch verteilter und {−1, +1}wertiger Zufallsvariablen. Unter der Hypothese H0 gelte P0 (Xk = +1) = p0

mit p0 ∈ (0, 1), unter der Alternative H1 gelte P1 (Xk = +1) = p1 mit p1 6= p0 .

(a) Begründe, weshalb der Likelihoodquotient nach n Beobachtungen

X1 , . . . , Xn gegeben ist durch

(n+Sn )/2

Ln =

(1−p1 )(n−Sn )/2

(n+Sn )/2

(1−p0 )(n−Sn )/2

p0

p1

mit Sn =

Pn

k=1 Xk .

(b) Zeige, dass der Likelihood-Prozess (Ln )n>0 (setze L0 := 1) ein nichtnegatives Martingal bezüglich der kanonischen Filtration unter der Hypothese

H0 (d.h. unter P0 ) ist.

(c) Ein sequentieller Likelihood-Quotiententest, basierend auf der Wahl von

0 < A < 1 < B und auf der Stoppzeit

τA,B := inf{n > 1 | Ln > B oder Ln 6 A},

lehnt H0 ab, falls LτA,B > B, und akzeptiert H0 , falls LτA,B 6 A. Bestimme die Fehler erster und zweiter Art dieses Tests für p0 = 0.4, p1 = 0.6,

A = (2/3)5 , B = (3/2)5 und berechne die im Mittel benötigte Zahl von

Beobachtungen E[τA,B ].

Abgabe in der Vorlesung am Donnerstag, dem 2.2.06.

Markus Reiß

Vorlesung

Wahrscheinlichkeitstheorie

Wintersemester 2005/06

13. Übungsblatt

1. Beweise: Zufallsvariablen (Xi )i∈I in L1 sind genau dann gleichgradig integrierbar, wenn gilt: supi∈I kXi kL1 < ∞ und

∀ ε > 0 ∃ δ > 0 : P(A) < δ ⇒ sup E[|Xi |1A ] < ε.

i∈I

P

2. Es sei fn (x) = (3/2)n k∈{0,2}n 1I(k,n) (x), x ∈ [0, 1], mit den Intervallen

P

P

I(k, n) := [ ni=1 ki 3−i , ni=1 ki 3−i + 3−n ]. Zeige:

(a) (fn )n>1 ist ein Martingal auf ([0, 1], B[0,1] , λ, (Fn )) mit Lebesguemaß λ

auf [0, 1] und Fn := σ(I(k, n), k ∈ {0, 1, 2}n ).

(b) (fn ) konvergiert λ-fast sicher, aber nicht in L1 ([0, 1], B[0,1] , λ) (Skizze!).

(c) Jedes fn ist die Dichte eines Wahrscheinlichkeitsmaßes Pn . Es gibt ein

w

Wahrscheinlichkeitsmaß P∞ , so dass Pn −

→ P∞ (P∞ heißt Cantormaß).

Es gibt eine Borelmenge C ⊆ [0, 1] mit P∞ (C) = 1, λ(C) = 0.

3. Es seien (T, T ) ein Messraum, E ein Erzeuger von T und f : S → T eine

beliebige Abbildung. Beweise mit dem Prinzip der guten Mengen, dass dann

die Urbilder aus dem Erzeuger f −1 (E) die Urbild-σ-Algebra f −1 (T ) erzeugen.

4. Es seien X und Y unabhängige reellwertige Zufallsvariablen mit Lebesguedichten f X und f Y . Berechne E[(Y − X)+ | X]. Was ergibt sich im Fall

X, Y ∼ N (0, 1)?

5. Es sei Exp(λ) die Exponentialverteilung zum Parameter λ > 0. Diese hat

charakteristische Funktion ϕλ (u) = λ/(λ − iu).

w

(a) Schließe für λn → λ > 0 auf die schwache Konvergenz Exp(λn ) −

→

Exp(λ).

(b) Konvergiert Exp(λn ) ebenfalls schwach für λn → 0 bzw. λn → ∞?

(c) Untersuche, wann in (a) und (b) sogar Konvergenz in Totalvariationsnorm

vorliegt.

6. Hat das Wahrscheinlichkeitsmaß Q eine Dichte fQ,P bezüglich dem Wahrscheinlichkeitsmaß P, so wird die Kullback-Leibler-Divergenz definiert als

Z

KL(Q | P) = log(fQ,P (x)) Q(dx).

(a) Zeige, dass x 7→ x log(x) konvex ist, und schließe für den Fall

log(fQ,P )fQ,P ∈ L1 (P):

Z

log(fQ,P (x))fQ,P (x) P(dx) > 0.

KL(Q | P) =

Rd

(b) Beweise unter der Voraussetzung in (a) für Produktmaße:

KL(Q⊗n | P⊗n ) = n KL(Q | P).

Aufgaben 1 und 2 sind Pflicht, Aufgaben 3 bis 6 dienen der Klausurvorbereitung.

Abgabe von maximal 4 Aufgaben in der Vorlesung am Donnerstag, dem 9.2.06.