Sozialwissenschaftliche Methoden und Statistik I

Werbung

Sozialwissenschaftliche Methoden und Statistik I

Universität Duisburg – Essen

Standort Duisburg

Integrierter Diplomstudiengang Sozialwissenschaften

Skript zum SMS I Tutorium

Von

Mark Lutter

Stand: April 2004

Teil II

„Wahrscheinlichkeitsrechnung und Inferenzstatistik“

Mark Lutter

SMS I Tutorium

Teil II „Inferenzstatistik“

Inhaltsverzeichnis

Seite 2 von 52

Seite

1. Wahrscheinlichkeitstheorie .............................................................. 04

1.1 Grundbegriffe ..................................................................................................... 04

• Zufallsexperiment

• Wahrscheinlichkeit

• Stichprobenraum Ω

• Elementarereignis ω

• Ereignis

• Spezielle Ereignisse: das leere & das sichere Ereignis

• Komplementäres Ereignis

1.2 Verknüpfung von Ereignissen ........................................................................... 06

• Durchschnittsbildung (A ∩ B)

• Vereinigung (A ∪ B)

• Unvereinbarkeit von Ereignissen

• Differenz von Ereignissen

1.3 Empirischer Wahrscheinlichkeitsbegriff: Bernoulli Theorem ....................... 07

1.4 Theoretischer Wahrscheinlichkeitsbegriff: Laplace Experiment ................... 08

1.5 Axiome der Wahrscheinlichkeitstheorie ......................................................... 09

1.6 Wahrscheinlichkeitsrechnung: .......................................................................... 10

1.6.1 Additionssatz: ................................................................................................ 10

• Additionstheorem A

• Additionstheorem B

1.6.2

•

•

•

1.6.3

1.6.4

Bedingte Wahrscheinlichkeit ........................................................................ 11

Stochastische Unabhängigkeit

Multiplikationstheorem für abhängige Ereignisse

Multiplikationstheorem für unabhängige Ereignisse

Satz von der totalen Wahrscheinlichkeit ..................................................... 13

Theorem von Bayes ....................................................................................... 15

2. Kombinatorik .................................................................................... 16

2.1 Permutationen ..................................................................................................... 16

2.2 Kombinationen .................................................................................................... 17

2.3 Das Urnenmodell ................................................................................................. 20

3. Zufallsvariablen & Wahrscheinlichkeitsverteilungen ................... 21

•

•

•

•

Definition Zufallsvariable

Diskrete vs. Stetige Zufallsvariablen

Wahrscheinlichkeitsfunktion

Verteilungsfunktion

Mark Lutter

SMS I Tutorium

Teil II „Inferenzstatistik“

Seite 3 von 52

3.1 diskrete vs. stetige Wahrscheinlichkeitsverteilungen ...................................... 24

3.1.1 diskrete Verteilungsformen ........................................................................... 24

• diskrete Gleichverteilung

• Binomialverteilung

• Hypergeometrische Verteilung

• Poissonverteilung

3.1.2

•

•

stetige Verteilungsformen ............................................................................. 27

Normalverteilung

Standardnormalverteilung

4. Stichprobe & Grundgesamtheit ....................................................... 32

•

•

Die Stichprobenkennwerteverteilung

Zentraler Grenzwertsatz

Wichtige Begriffe

• Statistik

• Schätzer

• Erwartungswert

• Erwartungstreue

• Standardfehler (des Mittelwertes)

4.1 Bestimmung von Konfidenzintervallen .............................................................. 35

5. Die Überprüfung statistischer Hypothesen / Testverfahren ......... 37

•

•

•

•

•

•

•

•

6.

Hypothesenarten

Fehlerarten

Signifikanz

z-Test

t-Test

F-Test

Chi-Quadrat-Test

Interpretation der SPSS-Outputs

Literaturverzeichnis .......................................................................... 52

Mark Lutter

SMS I Tutorium

Teil II „Inferenzstatistik“

Seite 4 von 52

1. Wahrscheinlichkeitstheorie

1.1 Grundbegriffe

Zufallsexperiment (auch: zufälliger Versuch)

• Ist ein beliebig oft wiederholbarer Vorgang

• Wird nach einer genau festgelegten Vorschrift durchgeführt

• Führt zu genau einem Ergebnis aus einer Menge möglicher Ergebnisse

• die Menge aller möglichen Ergebnisse lässt sich genau angeben

• Welches Ergebnis aber eintritt, hängt vom Zufall ab

• Daher: Das Ergebnis eines Zufallsexperiments lässt sich nicht mit

Sicherheit vorherbestimmen, stattdessen lässt sich angeben, mit welcher

Wahrscheinlichkeit jedes mögliche Ergebnis eintreten wird

Beispiele für Zufallsexperimente sind

• Das Werfen einer Münze

• Das Werfen eines Würfels

• Das Roulettespiel

• Die zufällige Entnahme eines Produkts aus einer laufenden Produktion und die

Kontrolle auf Fehlerhaftigkeit

Ebenso sind die folgenden Vorgänge Beispiele für Zufallsexperimente (und hier findet sich

der Knüpfpunkt zur empirischen Sozialforschung):

• Die Befragung einer zufällig ausgewählten Person nach dem Lebensalter, nach dem

Geschlecht, nach dem Einkommen usw.

Wahrscheinlichkeit (engl.: probability)

• Eine Wahrscheinlichkeit gibt die Chance des Auftretens eines zufälligen

Ereignisses (oder: Ergebnis eines Zufallsexperiment) an

• Eine Wahrscheinlichkeitsangabe wird immer mit einem Zahlenwert

zwischen 0 und 1 (bzw. als Prozentangabe zwischen 0% und 100%)

angegeben

Stichprobenraum Ω [lies: „Omega“] (auch: Ergebnismenge, Ereignisraum)

• Die Menge aller möglichen Ergebnisse eines Zufallsexperiments heißt

Stichprobenraum und wird mit Ω bezeichnet

Bsp.:

Werfen eines Würfels: Ω = {1,2,3,4,5,6}

Werfen einer Münze: Ω = {Wappen, Zahl}

Werfen zweier Münzen: Ω = {WW, ZZ, WZ, ZW}

Mark Lutter

SMS I Tutorium

Teil II „Inferenzstatistik“

Seite 5 von 52

Elementarereignisse ω [lies: „klein Omega“]

• Die einzelnen Elemente ω aus Ω werden Elementarereignisse genannt

Bsp.:

Zufallsexperiment: „Werfen eines Würfels“

Mögliche Elementarereignisse: 1, 2, 3, 4, 5, 6

Zufallsexperiment: „Werfen einer Münze“

Mögliche Elementarereignisse: „Wappen“, „Zahl“

(zufälliges) Ereignis

• Eine Teilmenge A des Stichprobenraumes Ω heißt (zufälliges) Ereignis

• Ist das Ergebnis eines Zufallsexperiments ein Element von A, dann sagt

man: „das (zufällige) Ereignis A ist eingetreten.“

• Ein Ereignis A tritt also genau dann ein, wenn ein Element ω aus Ω zur

Teilmenge A gehört

• Ereignisse werden mit Großbuchstaben bezeichnet

Bsp.:

Beim Zufallsexperiment „Werfen mit einem Würfel“ ist die Teilmenge

{2,4,6} das Ereignis A „gerade Augenzahl“ und die Teilmenge {1,3,5}

das Ereignis B „ungerade Augenzahl“

Spezielle Ereignisse

• Besondere Teilmengen von Ω sind a) das sichere Ereignis und b) das

unmögliche Ereignis:

Das sichere Ereignis E = {Ω} enthält die Menge aller

Elementarereignisse (= Ω) und tritt daher immer ein

Das unmögliche Ereignis E = {φ} enthält die leere Menge (= φ)

und tritt daher niemals ein

Komplementäres Ereignis

• Ein Ereignis A, welches aus nicht zu A gehörenden Elementarereignissen

besteht, sondern aus allen anderen Elementen ω aus Ω, heißt das zu A

komplementäre Ereignis A .

• Im obigem Beispiel ist Ereignis A „gerade Augenzahl“ das

komplementäre Ereignis zu B „ungerade Augenzahl“ (und umgekehrt)

• Oder: das zum leeren Ereignis komplementäre Ereignis ist das sichere

Ereignis

• Die Menge A ist also das Genaue Gegenteil von A

Mark Lutter

1.2

SMS I Tutorium

Teil II „Inferenzstatistik“

Seite 6 von 52

Verknüpfung von Ereignissen

1. Durchschnittsbildung

• A ∩ B („A und / geschnitten B“)

• A und B treten gleichzeitig ein, d.h. das nach Durchführung eines

Zufallsexperiment eingetretene Ergebnis ω aus Ω gehört gleichzeitig sowohl in die Teilmenge A als auch in die Teilmenge B

2. Vereinigung

• A ∪ B („A oder / vereinigt B“)

• A oder B tritt ein, d.h. das Element ω kann zur Teilmenge A oder

zur Teilmenge B gehören

Bsp.:

Zwei Ereignisse A und B haben die folgenden Teilmengen:

A = {1,2,3,6}

B = {1,4,5,6}

Dann ist:

A ∩ B = { 1,6 }

A ∪ B = { 1,2,3,4,5,6 }

Unvereinbarkeit (auch: Unverträglichkeit) von Ereignissen

• Zwei Ereignisse heißen unvereinbar, wenn gilt: A ∩ B = φ

• D.h. die Mengen A und B enthalten keine gleichen Elemente

• Bsp.: Die Ereignisse A: „gerade Augenzahl“ und B: „ungerade Augenzahl“ sind unvereinbar

• Bei Unvereinbarkeit kann immer nur ein Ereignis auftreten, niemals beide

gleichzeitig!

Differenz von Ereignissen

• Die Differenz A \ B („A ohne B“; auch: „A minus B“) tritt dann ein, wenn

A, aber nicht B eintritt

Mark Lutter

SMS I Tutorium

Teil II „Inferenzstatistik“

Seite 7 von 52

Graphisch dargestellt (die schraffierte Fläche zeigt jeweils den Bereich, in dem

das Element ω liegt):

1.3

Empirische Wahrscheinlichkeit: Bernoulli Theorem (auch: Gesetz der

großen Zahl)

• Nach dem Bernoulli Theorem lassen sich Wahrscheinlichkeiten für

zufällige Ereignisse empirisch anhand ihrer Auftretenshäufigkeit (bei

hinreichend großer Anzahl von Wiederholungen des Zufallsexperiments)

ermitteln

• Merke: die relative Häufigkeit eines Ereignisses stellt (für eine

hinreichend große Anzahl von Versuchen) einen Schätzwert für die

Wahrscheinlichkeit des Ereignisses dar.1

•

1

Die Wahrscheinlichkeit für das Auftreten eines Ereignisses A wird mit

P(A) bezeichnet. P steht für das englische Wort probability =

Wahrscheinlichkeit

vgl. dazu die Ausführungen in Dürr/Mayer, a.a.O., Kap.: 2.5 (S.26ff.) oder die entsprechenden Ausführungen

im Faulbaum-Skript

Mark Lutter

1.4

SMS I Tutorium

Teil II „Inferenzstatistik“

Seite 8 von 52

Theoretische (klassische) Wahrscheinlichkeit: Laplace – Experiment

• Nach Laplace kann die Wahrscheinlichkeit für ein Ereignis a priori

bestimmt werden, d.h. ohne empirische Überprüfung der relativen

Häufigkeit eines Ereignis (Bernoulli-Theorem), sondern auf

theoretischem Weg!

Def.: Laplace Experiment:

• Ein Zufallsexperiment mit endlich vielen, gleichwahrscheinlichen

Ergebnissen heißt Laplace – Experiment

Beispiele für Laplace – Experimente sind:

• Das Werfen eines (idealen) Würfels

• Das Werfen einer (idealen) Münze

• Das Ziehen von Kugeln aus einer (idealen) Urne

Die Wahrscheinlichkeit eines Ereignisses A lässt sich nach Laplace mit

folgender Formel bestimmen:

Anzahl günstiger Fälle

Anzahl der Elemente von A

P(A) = =

Anzahl möglicher Fälle

Anzahl der Elemente von Ω

Bsp.:

1. Werfen einer Münze. Wie groß ist die Wahrscheinlichkeit für das

Eintreten des Ereignisses E = {„Wappen“} ?

Da:

E = {„Wappen“} => 1 Element

Ω = {W,Z}

=> 2 Elemente

P(„Wappen“) = ½

2. Werfen eines Würfels. Wie groß ist die Wahrscheinlichkeit für das

Auftreten des Ereignisses E = {6}?

Da:

E = {6}

=> 1 Element

Ω = {1,2,3,4,5,6} => 6 Elemente

P(Augenzahl = 6) =

1

6

Mark Lutter

SMS I Tutorium

Teil II „Inferenzstatistik“

Seite 9 von 52

3. Werfen zweier Würfel. Wie groß ist die Wahrscheinlichkeit für das

Auftreten des Ereignisses E = {Augensumme ≥ 10}?

Da:

E = {(4,6); (5,5); (5,6); (6,5); (6,4); (6,6)} => 6 Elemente

Ω = {(1,1);(1,2);(1,3);(1,4);(1,5);(1,6);

(2,1);(2,2);(2,3);(2,4);(2,5);(2,6);

(3,1);(3,2);(3,3);(3,4);(3,5);(3,6);

(4,1);(4,2);(4,3);(4,4);(4,5);(4,6);

(5,1);(5,2);(5,3);(5,4);(5,5);(5,6);

(6,1);(6,2);(6,3);(6,4);(6,5);(6,6)}

P(Augensumme ≥ 10) =

Anmerkung:

1.5

=> 36 Elemente

6

36

Bei den obigen Beispielen können die entsprechenden Anzahlen aufgrund der (Noch-)

Überschaubarkeit durch Abzählen leicht bestimmt werden – bei komplexeren Mengen

ist dies nicht mehr möglich. Dann bedient man sich der Kombinatorik (näheres dazu

in Kapitel 2)

Axiome (=Grundsätze) der Wahrscheinlichkeitstheorie

•

•

•

•

P(Ω) = 1

P(φ) = 0

P( A ) = 1 – P(A)

P(A \ B) = P(A) – P(A ∩ B)

vgl. hierzu Beispiel 2.8 in Dürr/Mayer, S. 31

Mark Lutter

SMS I Tutorium

Teil II „Inferenzstatistik“

Seite 10 von 52

1.6 Wahrscheinlichkeitsrechnung:

1.6.1 Additionssatz:

Variante 1:

Falls zwei voneinander unabhängige Ereignisse vereinbar sind, d.h.

falls gilt P(A ∩ B) ≠ φ

dann gilt Additionstheorem A:

P(A ∪ B) = P(A) + P(B) – P(A ∩ B)

Variante 2:

Falls jedoch zwei voneinander unabhängige Ereignisse unvereinbar

sind, d.h. falls gilt: P(A ∩ B) = φ

dann gilt Additionstheorem B:

P(A ∪ B) = P(A) + P(B)

Bsp.:

Wie hoch ist die Wahrscheinlichkeit, aus einem Skatspiel (32 Karten) eine

schwarze Karte oder einen König zu ziehen?

Diese Frage bezieht sich auf Additionstheorem A

Es gibt insgesamt 32 Karten (16 rote, 16 schwarze) mit 4 Königen (2 sind rot, 2

sind schwarz). Auftreten kann eine schwarze Karte (Ereignis A) oder ein

König (Ereignis B). Formal haben wir hier zwei voneinander unabhängige

Ereignisse, die sich nicht gegenseitig voneinander ausschließen (eine schwarze

Karte kann gleichzeitig auch ein König sein und umgekehrt)

Daher:

P(A ∪ B) = P(A) + P(B) – P(A ∩ B)

Die Wahrscheinlichkeiten können wir mit Laplace ermitteln:

16

4

2

9

P(A ∪ B)

=

+

−

=

32

32

32

16

Anmerkung: Durch die Addition von P(A)+P(B) werden zunächst 2 schwarze Könige doppelt

gezählt, anschließend werden sie mit P(A ∩ B) wieder subtrahiert.

Wie hoch ist die Wahrscheinlichkeit, beim Würfeln mit einem idealen Würfel

eine 2 oder eine 4 zu würfeln?

Diese Frage bezieht sich auf Additionstheorem B

Hier haben wir zwei voneinander unabhängige Ereignisse, die sich gegenseitig

ausschließen (es gilt: P(A ∩ B ) = φ).

1 1 1

Daher:

P(A ∪ B) = P(A) + P(B) = + =

6 6 3

Mark Lutter

SMS I Tutorium

Teil II „Inferenzstatistik“

Seite 11 von 52

1.6.2 Bedingte Wahrscheinlichkeit / stochastische Unabhängigkeit /

Multiplikationstheorem

• Die Wahrscheinlichkeit für das Ereignis A unter der Bedingung, dass

Ereignis B bereits eingetreten ist, heißt bedingte Wahrscheinlichkeit

• Man schreibt: P(AB)

Hierbei geht es um die Frage, ob das Eintreten von B die Wahrscheinlichkeit für

das Auftreten von A

(1) verändert oder

(2) nicht verändert

(1)

Hat das Eintreten von B einen Einfluss auf die Wahrscheinlichkeit für das

Auftreten von A, dann sind beide Ereignisse voneinander abhängig.

In diesem Falle gilt die Formel für die bedingte Wahrscheinlichkeit:

P(AB) =

P( A ∩ B)

P( B)

Aus dieser Formel lässt sich das Multiplikationstheorem für abhängige

Ereignisse ableiten:

P(A ∩ B) = P(AB) ⋅ P(B)

(2)

bzw.

P(A ∩ B) = P(BA) ⋅ P(A)

Hat das Eintreten von B keinen Einfluss auf die Wahrscheinlichkeit für

das Auftreten von A, dann sind A und B voneinander unabhängig.

Zwei Ereignisse sind insbesondere dann unabhängig voneinander, wenn

das Multiplikationstheorem für unabhängige Ereignisse gilt:

P(A ∩ B) = P(A) ⋅ P(B)

bzw. P(A ∩ B ∩ C) = P(A) ⋅ P(B) ⋅ P(C)

Für die bedingte Wahrscheinlichkeit bedeutet dies, dass es keine bedingte

Wahrscheinlichkeit gibt, d.h. es gilt:

P(AB) = P(A)

bzw.

P(BA) = P(B)

Mark Lutter

SMS I Tutorium

Beispielaufgaben:

Teil II „Inferenzstatistik“

Seite 12 von 52

(weitere Aufgaben: Dürr/Mayer, a.a.O., S. 38/39)

- bedingte Wahrscheinlichkeit:

Für eine Untersuchung der Rauchgewohnheiten bei Männern und Frauen hat

eine Zufallsstichprobe von 300 Personen folgende (absolute) Häufigkeiten

ergeben:

Mann

Frau

∑

Raucher

40

60

100

NichtRaucher

∑

100

100 200

140

160 300

Wie groß ist die Wahrscheinlichkeit, dass eine aus der gleichen Population

zufällig ausgewählte Person männlich ist, unter der Bedingung, dass sie zur

rauchenden Bevölkerung gehört?

Die relativen Häufigkeiten können nach dem Bernoulli-Theorem als Schätzwerte für

die Wahrscheinlichkeiten genommen werden.

Wir definieren folgende Ereignisse: A: Person ist männlich;

B: Person ist Raucher

Gesucht ist:

P(AB) = P( A ∩ B)

P( B)

Es ergeben sich folgende Wahrscheinlichkeiten:

P(A ∩ B) (=„Person ist männlich und Raucher“) = 40/300

P(B) (=„Person ist Raucher“) = 100/300

Dann ist:

P(AB) =

40 100 40

=

= 0,4

/

300 300 100

- Multiplikationstheorem für unabhängige Ereignisse:

Wie hoch ist die Wahrscheinlichkeit, beim 3maligen Würfeln mit einem

idealen Würfel beim ersten Wurf eine 6, beim zweiten Wurf eine gerade

Augenzahl und beim dritten Wurf eine ungerade Augenzahl zu würfeln?

Da die Ereignisse voneinander unabhängig sind gilt:

P(A ∩ B ∩ C) = P(A) ⋅ P(B) ⋅ P(C) =

1 3 3 1

⋅ ⋅ =

6 6 6 24

Mark Lutter

SMS I Tutorium

Teil II „Inferenzstatistik“

Seite 13 von 52

- Multiplikationstheorem für abhängige Ereignisse

Eine gutdurchgemischte Urne enthalte 20 rote und 25 weiße Kugeln. Es wird

zweimal jeweils eine Kugel ohne Zurücklegen gezogen. Wie groß ist die

Wahrscheinlichkeit, erst eine rote und dann eine weiße Kugel zu ziehen?

Wir definieren folgende Ereignisse: A: die erste Kugel ist rot

B: die zweite Kugel ist weiß

Gesucht ist:

P(A ∩ B). Da wir „ohne Zurücklegen“ ziehen, sind beide Ereignisse

voneinander abhängig, deswegen gilt: P(A ∩ B) = P(A) ⋅ P(BA)

Die Wahrscheinlichkeiten ermitteln wir nach Laplace:

P(A) = 20/45 (20 rote Kugeln von insgesamt 45 beim ersten Zug)

P(BA) = 25/44 (25 weiße Kugeln von nur noch 44 Kugeln beim zweiten Zug)

P(A ∩ B) = 20/45 • 25/44 = 25/99

Demnach:

Dieser Fall kann beliebig erweitert werden:

Wie groß ist die Wahrscheinlichkeit, dass die erste Kugel rot, die zweite weiß, die dritte rot

und die vierte wieder weiß ist (jeweils ohne Zurücklegen)?

Wir definieren folgende 4 Ereignisse:

A: erste Kugel rot

C: dritte Kugel rot

Gesucht ist:

P(A ∩ B ∩ C ∩ D)

B: zweite Kugel weiß

D: vierte Kugel weiß

= P(A) · P(B A) · P(C A ∩ B) ⋅ P(D A ∩ B ∩ C)

=

20 25 19 24

⋅ ⋅ ⋅ = 0,063760528

45 44 43 42

1.6.3 Satz von der totalen Wahrscheinlichkeit

• Der Satz von der totalen Wahrscheinlichkeit stellt im Prinzip nichts

anderes dar als eine Erweiterung des Multiplikationssatzes für

abhängige Ereignisse.

• Genauer: Es können beliebig viele Multiplikationssätze (für

abhängige Ereignisse) additiv (d.h. nach Additionstheorem B)

miteinander verknüpft werden.

Er ist definiert als:

P(B) = P(B ∩ A1) + P(B ∩ A2) + … + P(B ∩ Ai)

= P(A1) · P(B A1) + P(A2) · P(B A2) + … + P(Ai) · P(B Ai)

n

oder vereinfacht geschrieben:

P(B) =

∑ P( A ) ⋅ P( B Ai)

i =1

i

Mark Lutter

SMS I Tutorium

Teil II „Inferenzstatistik“

Seite 14 von 52

Ein Anwendungsbeispiel bietet die Erweiterung obiger Beispielaufgabe (vgl.

S.13):

Wie groß ist die Wahrscheinlichkeit, beim zweimaligen Ziehen ohne

Zurücklegen erst eine rote, (und) dann eine weiße Kugel oder erst eine weiße,

(und) dann eine rote Kugel zu ziehen?

Nach dem Satz der totalen Wahrscheinlichkeit ergibt sich:

20 25 25 20

⋅

+

⋅ = 0,5050505

45 44 45 44

Den Unterschied zwischen Satz der totalen Wahrscheinlichkeit und Multiplikationstheorem für abhängige Ereignisse verdeutlicht auch folgende

Aufgabe:

Ein Unternehmen hat insgesamt 3 Produktionsstandorte mit unterschiedlich

großer Anzahl an Arbeitern. An jedem der 3 Standorte müssen Arbeiter

entlassen werden.

Standort:

Anteil der

Arbeiter an

der

Gesamtzahl

Anteil der

Arbeiter, die

am Standort

entlassen

werden

S1

S2

S3

50%

25%

25%

10%

15%

2%

Aus der Gesamtarbeiterschaft wird ein Arbeiter zufällig ausgewählt.

a)

Wie groß ist die Wahrscheinlichkeit, dass dieser Arbeiter zu S1 gehört und

nicht entlassen wird?

b)

Wie groß ist die Wahrscheinlichkeit, dass dieser Arbeiter nicht entlassen

wird, wobei er zu allen 3 Standorten gehören kann?

Wir definieren zunächst folgende Ereignisse:

A: Arbeiter wird nicht entlassen

A : Arbeiter wird entlassen

Si: Arbeiter stammt aus Standort Si , wobei i = 1, 2, 3.

Aufgabe a) bezieht sich aufs Multiplikationstheorem für abhängige Ereignisse:

Gesucht ist: P(S1 ∩ A) = P(A S1) · P(S1) = 0,9 · 0,5 = 0,45

Antwort: Mit einer Wahrscheinlichkeit von 45% gehört er zu S1 und wird nicht entlassen.

Aufgabe b) bezieht sich auf den Satz der totalen Wahrscheinlichkeit:

Gesucht ist P(B), wobei B das Ereignis: „Ein Arbeiter, ausgewählt aus der Gesamtarbeiterschaft, wird nicht entlassen“ ist. Dann ergibt sich nach dem Satz der totalen

Wahrscheinlichkeit: P(B) = 0,9 · 0,5 + 0,85 · 0,25 + 0,98 · 0,25 = 0,9075.

Antwort: Ein (zufällig ausgewählter) Arbeiter dieser Firma hat eine 91%tige Chance, nicht

entlassen zu werden.

Mark Lutter

SMS I Tutorium

Teil II „Inferenzstatistik“

Seite 15 von 52

1.6.4 Theorem von Bayes2

• Das Bayes-Theorem ist nun eine Verknüpfung der bedingten Wahrscheinlichkeit mit dem Multiplikationstheorem für abhängige Ereignisse

und der totalen Wahrscheinlichkeit:

Die Formel für die bedingte Wahrscheinlichkeit lautet:

P(AB) =

P( A ∩ B)

P( B)

P(AiB) =

P( Ai ∩ B)

P( B)

Für P( Ai ∩ B) wird die Formel für das Multiplikationstheorem eingesetzt;

für P(B) wird die Formel für die totale Wahrscheinlichkeit eingesetzt;

daraus ergibt sich das Bayes – Theorem:

P(AiB) =

P( Ai ) ⋅ P( B Ai )

n

∑ P( A ) ⋅ P( B A )

i =1

i

i

• Mit dem Bayes - Theorem lässt sich nun die bedingte Wahrscheinlichkeit

ermitteln, wie groß der Wahrscheinlichkeitsanteil der Schnittmenge

P ( Ai ∩ B) an P(B) ist - wobei P(B) die Gesamt-(totale)-Wahrscheinlichkeit

ist

Bezogen auf obige Beispielaufgabe („Arbeiter“, vgl. S. 14) ist man mit dem

Bayes - Theorem in der Lage, folgende Frage zu klären:

c) Angenommen, der ausgewählte Arbeiter gehört zu denen, die nicht

entlassen werden. Mit welcher Wahrscheinlichkeit stammt er aus

Standort S1?

Gesucht ist also die Wahrscheinlichkeit, mit der ein Arbeiter aus S1 stammt, unter der

Bedingung, dass er zu denen gehört, die nicht entlassen werden.

Dann gilt:

P(S1 A)

=

=

2

P ( A S 1 ) ⋅ P ( S1 )

P( B)

=

vgl. Teilaufgabe a)

vgl. Teilaufgabe b)

0,45

≈ 0,496

0,9075

Das Theorem von Bayes und der Satz von der totalen Wahrscheinlichkeit wird im Dürr/Mayer nicht

behandelt. Neben den entsprechenden Ausführungen im Faulbaum Skript sind sie sehr gut erklärt in: Clauß, G.

et al., a.a.O., Kap.3; insbes. Kap.: 3.1.5 sowie Kap.: 3.1.7. Auch sehr gut: Bamberg/Baur, a.a.O., Kap.:

7.3.5ff. Hinweis: Das gesamte Kapitel 3 des Buches von Clauß et. al. ist meiner Meinung nach mit die beste,

weil verständlichste Darstellung der Wahrscheinlichkeitstheorie; daher absolut empfehlenswert!

Mark Lutter

2.

SMS I Tutorium

Teil II „Inferenzstatistik“

Seite 16 von 52

Kombinatorik

• Mithilfe der Kombinatorik ist es möglich, die Menge der möglichen

Ergebnisse eines Zufallsexperiments, also Ω, zu bestimmen

• genauer formuliert: Es kann die Menge verschiedener Anordnungsmöglichkeiten von Elementen bestimmt werden

Unterschieden wird zwischen Permutationen und Kombinationen:

2.1

Permutation von n Elementen

• Jede Zusammenstellung / Anordnung, die dadurch entsteht, dass man n

gegebene Elemente in irgendeiner Reihenfolge nebeneinander setzt, heißt

Permutation der gegebenen Elemente

• Dabei unterscheidet man (a) ob alle Elemente verschieden sind, oder

(b) ob es Elemente gibt, die in Klassen gleicher

Elemente zerfallen

(a)

Alle n Elemente sind verschieden

Dann gilt: Die Anzahl der Permutation von n verschiedenen Elementen

wird berechnet mit n! (lies: n Fakultät)3

Bsp.: Wie viele verschiedene `Worte´ lassen sich unter Verwendung des Wortes

MAYER bilden?

• Jeder Buchstabe - also jedes Element - des Wortes MAYER ist

verschieden

• Daher: n!

• Hier: 5 Elemente, also 5! = 5⋅4⋅3⋅2⋅1 = 120 verschiedene Anordnungsmöglichkeiten

(b)

Es gibt n Elemente, die in k Klassen von einander gleichen Elementen

zerfallen

Dann gilt: Die Permutation wird berechnet mit

3

n!

n1!n 2 !...n k !

Unter n! versteht man das Produkt der ersten n natürlichen Zahlen. Bsp.: 4! = 1⋅2⋅3⋅4 = 24 oder 8! =

1⋅2⋅3⋅4⋅5⋅6⋅7⋅8 = 40320. Ferner wird definiert: 0! = 1

Mark Lutter

SMS I Tutorium

Teil II „Inferenzstatistik“

Seite 17 von 52

Bsp.: Wie viele verschiedene `Worte´ lassen sich unter Verwendung des Wortes

MUELLER bilden?

• Insgesamt gibt es 7 Elemente, davon sind 2 Elemente gleich

n!

n 1 ! n 2 !... n

k

!

=

7!

5040

=

1 !1 !1 ! 2 ! 2 !

4

= 1260

• Erläuterung: Im Zähler steht 7! , da es insgesamt 7 Buchstaben gibt. Im

Nenner stehen die Klassen von Elementen: Es gibt drei Klassen von

Buchstaben (M,U,R) mit jeweils einem Element (deswegen dreimal 1!)

Des weiteren gibt es zwei Klassen von Buchstaben (E,L) mit jeweils zwei

Elementen (deswegen zweimal 2!)

2.2

Kombinationen k-ter Ordnung von n Elementen

• Bildet man nun aus einer Menge von n verschiedenen Elementen eine

Zusammenstellung, die aus k Elementen besteht, so nennt man dies

Kombination k-ter Ordnung von n Elementen

• Dabei unterscheidet man 4 Möglichkeiten:

mit / ohne Berücksichtigung der Reihenfolge und mit / ohne Zurücklegen

Die Anzahl der Kombinationen k-ter Ordnung von n Elementen berechet man

mit folgenden vier Formeln:

Mit

Berücksichtigung der

Reihenfolge

Ohne

Berücksichtigung der

Reihenfolge

EXKURS:

n

Es gilt: =

k

n

k

Ohne Zurücklegen

Mit Zurücklegen

n!

( n − k )!

nk

n

k

n + k − 1

k

ist der sog. Binomialkoeffizient (lies: „n über k“).

n!

(für k ≤ n)

k!(n − k )!

Wobei: n = n (für n ≥ 0)

1

n

= 1

n

n

= 1 (für n ≥ 0)

0

n

= 0 (für k > n)

k

Mark Lutter

SMS I Tutorium Teil II „Inferenzstatistik“

Seite 18 von 52

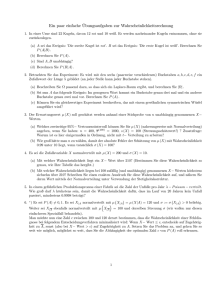

Beispiel für die vier Kombinationsregeln:

Aus 3 Elementen (a, b, c) sollen Kombinationen 2-ter Ordnung erstellt werden:

Ohne Zurücklegen4

Mit Zurücklegen5

Mit

Berücksichtigung der

Reihenfolge

ab ac bc

ba ca cb

ab ac bc

ba ca cb

aa bb cc

(d.h.: es können Dopplungen

auftreten, also ab ≠ ba)6

3!

=6

(3− 2)!

Ohne Berücksichtigung

der Reihenfolge

(d.h.: es treten keine

ab ac bc

Dopplungen auf, also ab =

ba )7

3

= 3

2

32 = 9

ab ac bc

aa bb cc

4

= 6

2

Beispielaufgaben (vgl. Dürr/Mayer, a.a.O., S.47f.)

1. Beim Pferderennen sollen jeweils die 3 schnellsten Pferde eines

bestimmten Rennens mit ihrer Reihenfolge des Eintreffens ins Ziel

vorhergesagt werden. Insgesamt gehen 20 Pferde an den Start. Wie viel

verschiedene Tipplisten gibt es?

Kombination 3-ter Ordnung von 20 Elementen

Mit Berücksichtigung der Reihenfolge / Ohne Zurücklegen

20!

n!

Daher:

= 6840 verschiedene Tipplisten.

(n − k )! (20 − 3)!

2. Wie viel verschiedene Tippreihen gibt es beim Lotto (6 aus 49)?

Kombination 6-ter Ordnung von 49 Elementen

Ohne Berücksichtigung der Reihenfolge / Ohne Zurücklegen

n 49

Daher: = = 13983816 verschiedene Tippreihen

k 6

4

„Ohne Zurücklegen“ bedeutet, dass ein einmal gezogenes Element nicht nocheinmal gezogen werden kann.

Deswegen sind die drei Kombinationen aa, bb, cc nicht möglich

5

„Mit Zurücklegen“ bedeutet, dass ein einmal gezogenes Element wieder gezogen werden kann, deswegen sind

die Kombinationen aa, bb und cc möglich

6

„Mit Berücksichtigung der Reihenfolge“ bedeutet, das die unterschiedliche Anordnung von Elementen eine

Rolle spielt. Deswegen werden Kombinationen wie ab und ba als ungleich aufgefasst und mitgezählt.

7

Hier spielt die Anordnung der Elemente keine Rolle. Solange also zwei Kombinationen die gleichen Elemente

besitzen, werden sie nur 1mal gezählt.

Mark Lutter

SMS I Tutorium Teil II „Inferenzstatistik“

Seite 19 von 52

3. Ein Zigarettenautomat hat 6 Fächer. Insgesamt hat der Händler 10 Sorten

zur Verfügung. Es können mehrere Fächer mit der gleichen Sorte belegt

werden. Die Reihenfolge der Belegung der 6 Fächer soll keine Bedeutung

haben. Wie viel verschiedene Möglichkeiten gibt es, den Automaten zu

füllen?

Kombination 6-ter Ordnung von 10 Elementen

Ohne Berücksichtigung der Reihenfolge / Mit Zurücklegen

n + k − 1 15

= = 5005 verschiedene Anordnungsmöglichkeiten

Daher:

k

6

4. Wie viel verschiedene dreistellige Zahlen kann man aus den Ziffern

1,2,3,4,5,6,7,8,9 bilden?

Kombination 3-ter Ordnung von 9 Elementen

Mit Berücksichtigung der Reihenfolge / Mit Zurücklegen

Daher: n k = 93 =729 verschiedene Ziffern

Mithilfe der Kombinatorik können auch Wahrscheinlichkeiten ermittelt

werden:

Bsp.: Wie groß ist die Wahrscheinlichkeit 6 Richtige beim Lotto (6 aus 49) zu

erhalten, wenn man eine Tippreihe abgibt?

Mit Laplace können wir die Wahrscheinlichkeit bestimmen: Das

Ereignis „Eine richtige Tippreihe (6 Richtige)“ hat 1 Element. Der

Stichprobenraum Ω (alle möglichen Tippkombinationen) hat – wie

oben bereits ermittelt – 13983816 Elemente. Damit beträgt nach

Laplace die Wahrscheinlichkeit für eine richtige Tippreihe aus

13983816 möglichen Tippreihen:

P(„6 Richtige“) =

1

= 0,000000075112

13983816

Mark Lutter

2.3

SMS I Tutorium Teil II „Inferenzstatistik“

Seite 20 von 52

Das Urnenmodell

• Das Urnenmodell stellt eine Verallgemeinerung der Kombinationen k-ter

Ordnung von n Elementen ohne Berücksichtigung der Reihenfolge und

ohne Zurücklegen dar.

• Dieses Modell gestattet es, Wahrscheinlichkeiten direkt zu berechnen

Eine Urne enthalte N Kugeln, davon W weiße und S schwarze (W + S = N).

Es werden n Kugeln nacheinander ohne Zurücklegen gezogen. Dann lässt

sich die Wahrscheinlichkeit, dass sich unter den n Kugeln w weiße und s

schwarze Kugeln befinden (Ereignis A), folgendermaßen berechnen:

W S

w s

P ( A) =

N

n

Bsp.:

Eine Urne (N = 10) enthalte 4 weiße und 6 schwarze Kugeln. 3 Kugeln

werden nacheinander (ohne Zurücklegen; ohne Berücksichtigung der

Reihenfolge) gezogen.

Dann ergeben sich für die Ereignisse A = {„3 weiße Kugeln werden

gezogen“} und B = {„2 weiße und 1 schwarze werden gezogen“}

folgende Wahrscheinlichkeiten:

W S 4 6

3 0

w s

1

P( A) = = =

30

10

N

3

n

W S 4 6

w s

2 1

3

P( B) = = =

10

N

10

n

3

Das Urnenmodell lässt sich auf viele Anwendungsbereiche übertragen.8

Beispielsweise kann die Wahrscheinlichkeit für 6 Richtige im Lotto auch mit

dem Urnenmodell ermittelt werden:

W S

w s

P(„6 Richtige“) = =

N

n

8

6 43

1

6 0 = 1 ⋅ 1 =

= 0,000000075112

49

49 13983816

6

6

Vgl. dazu Beispiel 3.15 in Dürr/Mayer, a.a.O., S.50.

Mark Lutter

SMS I Tutorium Teil II „Inferenzstatistik“

Erläuterung: Im Nenner steht

49 ,

6

Seite 21 von 52

da es insgesamt in der „Urne“ 49 Kugeln gibt,

von denen 6 gezogen werden. Das macht

49 =

6

13983816

verschiedene Möglichkeiten, 6 Zahlen aus 49 ohne Zurücklegen

und ohne Berücksichtigung der Reihenfolge anzuordnen. Im Zähler

steht 6 43 , da von den 6 Richtigen genau diese 6 und von den 43

6 0

Falschen genau 0 gezogen werden sollen.

Wie groß ist demnach die Wahrscheinlichkeit für 4 Richtige im Lotto?

6 43

4 2

15 ⋅ 903

P(„4 Richtige“) = =

= 0,00096862

13983816

49

6

Weitere Übungsaufgaben: Dürr/Mayer, a.a.O., S. 51.

3.

Zufallsvariablen und Wahrscheinlichkeitsverteilungen

Zufallsvariable (auch: Zufallsgröße)

• Eine Variable, deren Merkmalsausprägungen durch Ergebnisse eines

Zufallsexperiments realisiert werden, heißt Zufallsvariable

• eine Zufallsvariable ist also eine Variable, deren Werte vom Zufall

abhängen

• Eine Zufallsvariable ist dabei eine eindeutige Abbildung (Funktion), die

jedem Ergebnis der Ergebnismenge Ω eines Zufallsexperiments Werte aus

einem Wertebereich, z.B. reelle Zahlen, zuordnet

Eine mögliche diskrete Zufallsvariable, abgeleitet aus dem

Zufallsexperiment „Werfen mit zwei Würfeln“, wäre die

Zufallsvariable „Augensumme“; ihre Werte sind diskret, weil sie

abzählbar und diskontinuierlich sind

Wenn wir Personen aus einer Population zufällig auswählen und

jede ausgewählte Person nach ihrem Geschlecht zuordnen, dann ist

die Variable „Geschlecht“ ebenfalls eine diskrete Zufallsvariable

stetige Zufallsvariablen ergeben sich aus Zufallsexperimenten, in

denen kontinuierliche Größen erfasst werden, wie z.B. ZeitLängen- oder Gewichtsmessungen. Der Ereignisraum besteht hier

aus unendlich vielen möglichen Elementarereignissen.

Mark Lutter

SMS I Tutorium Teil II „Inferenzstatistik“

Seite 22 von 52

Wahrscheinlichkeitsfunktion

• Die Wahrscheinlichkeitsverteilung einer Zufallsvariablen ist durch ihre

Wahrscheinlichkeitsfunktion f(a) definiert. Sie gibt an, wie wahrscheinlich

die einzelnen Ergebnisse eines Zufallsexperiments sind

• Eine eindeutige Zuordnung (Funktion), welche jedem Wert einer

Zufallsvariablen die Wahrscheinlichkeit des Auftretens jeden Wertes

zuordnet, heißt Wahrscheinlichkeitsfunktion: f(ai) = pi

Bsp.:

• Aus dem Zufallsexperiment „Werfen mit zwei Würfeln“ betrachten wir die

diskrete Zufallsvariable „Augensumme“. Der Wertebereich, d.h. die

Werte, die die Variable annehmen kann, liegt zwischen 2 und 12.

• Jetzt ordnen wir jedem Wert – nach Laplace – seine Auftretenswahrscheinlichkeit zu:

Wahrscheinlichkeitsverteilung der Zufallsvariable „Augensumme“ f(ai) = pi

Augensumme (ai)

2

3

4

5

6

7

8

9

10

11

12

Wahrscheinlichkeit

(pi)

1

36

2

36

3

36

4

36

5

36

6

36

5

36

4

36

3

36

2

36

1

36

•

•

Die Augensumme 2 und 12 hat jeweils die geringste Auftretenswahrscheinlichkeit, da

jeweils nur 1 Ereignis [(1,1) bzw. (6,6)] aus 36 möglichen Ereignissen zutreffen kann.

Mit 6/36 hat Augensumme 7 die höchste Wahrscheinlichkeit, weil genau 6 günstige

Ereignisse aus 36 möglichen zutreffen [(6,1); (1,6); (4,3); (3,4); (5,2); (2,5)]

Graphisch dargestellt:

Verteilungsfunktion

• Aus einer Wahrscheinlichkeitsfunktion f(a) lässt sich durch Summation

der einzelnen Wahrscheinlichkeiten ihre Verteilungsfunktion F(a) =

Σf(pi) bilden: (man beachte: Die Summe aller Wahrscheinlichkeiten ist immer 1)

Verteilungsfunktion von „Augensumme“

Augensumme (ai) 2

Wahrscheinlichkeit 1

(pi)

36

3

4

5

6

7

8

9

10

11

12

3

36

6

36

10

36

15

36

21

36

26

36

30

36

33

36

35

36

36

=1

36

Mark Lutter

SMS I Tutorium Teil II „Inferenzstatistik“

Seite 23 von 52

Beispielaufgaben zur diskreten Wahrscheinlichkeitsverteilung

Wie hoch ist die Wahrscheinlichkeit beim Werfen zweier Würfel...

1. ...Augensumme 2 oder 12 zu würfeln?

2. ...höchstens Augensumme 4 zu würfeln?

3. ...eine Augensumme kleiner als 5 zu würfeln?

4. ...mindestens Augensumme 4 zu würfeln?

5. ...eine Augensumme größer als 3 zu würfeln?

6. ...eine Augensumme zwischen 4 und 8 zu würfeln?

7. ...eine Augensumme größer als 12 zu würfeln?

8. ...eine Augensumme kleiner als 2 zu würfeln?

Lösung:

1.

2.

3.

4.

5.

6.

7.

8.

P(AS = 2 ∪ 12) = 1/36 + 1/36 = 1/18

P(AS ≤ 4) = 6/36

P(AS < 5) = P(AS ≤ 4) = 6/36

P(AS ≥ 4) = 1 – P(AS ≤ 3) = 1 – 3/36 = 11/12

P(AS > 3) = 1 – P(AS ≤ 3) = 11/12

P(4 ≤ AS ≤ 8) = P(AS ≤ 8) – P(AS ≤ 3) = 26/36 – 3/36 = 23/36

P(AS > 12) = 0

P(AS < 2) = 0

Unterschied zur stetigen Zufallsvariablen:

• Bei stetigen Zufallsvariablen heißt die Wahrscheinlichkeitsfunktion auch

Dichtefunktion

• Dadurch, dass die stetige Zufallsvariable einen kontinuierlichen

Wertebereich hat, entsteht durch die Dichtefunktion eine Kurve

• Betrachtet werden nicht einzelne Ereignisse, sondern Ereignisintervalle ,

da der Wertebereich stetig ist (also z.B. Körpergröße zwischen 170cm

und 180cm). Der Flächenanteil unter der Kurve eines Intervalls ist dann

die Wahrscheinlichkeit für das Eintreten eines Wertes aus diesem

Intervall.

• Auch die stetige Verteilungsfunktion hat die Eigenschaft, dass die Summe

aller Wahrscheinlichkeiten immer 1 ergibt.

• Demnach ist die Gesamtfläche unter der Kurve der Dichtefunktion 1

Die wichtigste stetige Wahrscheinlichkeitsdichteverteilung ist die

Normalverteilung (s.u.)

Mark Lutter

3.1

SMS I Tutorium Teil II „Inferenzstatistik“

Seite 24 von 52

Diskrete vs. stetige Wahrscheinlichkeitsverteilungen

3.1.1 Diskrete Wahrscheinlichkeitsverteilungen

• Basieren auf diskreten Zufallsvariablen (d.h. ihr Wertebereich ist endlich

oder abzählbar unendlich)

• Beispiele für diskrete Zufallsvariablen sind:

Augensumme (s.o.)

Anzahl Wappen

Anzahl der Personen in einem Haushalt

Wichtige diskrete Verteilungsformen:

Diskrete Gleichverteilung

• Alle Werte der Zufallsvariablen treten mit gleicher Wahrscheinlichkeit

auf

Beispiel Münzwurf: Die möglichen Ereignisse „Wappen“ u. „Zahl“

treten beide mit gleicher Wahrscheinlichkeit von ½ auf

Binomialverteilung

• Es liegt ein Zufallsexperiment vor, bei dem immer nur zwischen zwei

Ergebnissen unterschieden wird:

Ereignis A, sowie das zu A komplementäre Ereignis A

Bsp.:

bei einer Qualitätskontrolle von Waren wird unterschieden

zwischen „fehlerhaft“ und „fehlerfrei“

beim Werfen eines Würfels interessiert man sich für die Ereignisse

„Sechs“ und „Nicht-Sechs“

Allgemein formuliert:

• Man interessiert sich für die Wahrscheinlichkeit, dass bei n-maliger

Durchführung eines Zufallsexperiments das Ereignis A

genau / höchstens / mindestens k-mal auftritt

• Die Wahrscheinlichkeit von A ist p

• Die Wahrscheinlichkeit von A ist 1 – p

• Die Formel für die Wahrscheinlichkeitsfunktion der Binomialverteilung,

kurz B(n;p) – Verteilung, lautet:

n

f (k ) = P( X = k ) = ⋅ p k ⋅ (1 − p ) n − k

k

Mark Lutter

SMS I Tutorium Teil II „Inferenzstatistik“

Seite 25 von 52

Bsp.:

1. Wie hoch ist die Wahrscheinlichkeit, dass bei einem 5-maligen Münzwurf

genau 3-mal Wappen eintritt?

Dann ist die Zufallsvariable X „Anzahl Ereignis Wappen“

binomialverteilt mit n = 5

p = 0,5

k=3

Daraus folgt:

5

P(X =„3mal Wappen“ = k = 3) = ⋅ 0,5 3 ⋅ (1 − 0,5) 5−3 = 0,3125

3

2. Wie hoch ist die Wahrscheinlichkeit, dass bei einem 5-maligen Münzwurf

höchstens 3-mal Wappen eintritt?

P(„höchstens 3mal Wappen“ = k ≤ 3)

= P(0mal Wappen) + P(1mal Wappen) + P(2mal Wappen) + P(3malWappen)

= P(k = 0) + P(k = 1) + P(k = 2) + P(k = 3)

5

5

5

5

= ⋅ 0,5 0 ⋅ (1 − 0,5) 5−0 + ⋅ 0,51 ⋅ (1 − 0,5) 5−1 + ⋅ 0,5 2 ⋅ (1 − 0,5) 5− 2 + ⋅ 0,5 3 ⋅ (1 − 0,5) 5−3

0

1

2

3

= 0,8125

3. Wie hoch ist die Wahrscheinlichkeit, dass bei einem 5-maligen Münzwurf

mindestens 3-mal Wappen eintritt?

P(„mindestens 3mal Wappen“ = k ≥ 3)

= 1 – P(„höchstens 2mal Wappen“)

5

0

5

1

= 1 – P(k ≤ 2)

5

2

= 1 – ( ⋅ 0,5 0 ⋅ (1 − 0,5) 5−0 + ⋅ 0,51 ⋅ (1 − 0,5) 5−1 + ⋅ 0,5 2 ⋅ (1 − 0,5) 5− 2 )

= 0,5

Erwartungswert (Mittelwert) und Varianz der Binomialverteilung:

E(X) = µx = n⋅p

Var(X) = σ2 = n⋅p⋅(1-p)

Dies bedeutet, dass z.B. bei einem 5maligem Münzwurf durchschnittlich mit

einem Erwartungswert von E(X = Anzahl Wappen) = µx = n⋅p = 5 ⋅ 0,5 = 2,5 mal

Wappen gerechnet werden kann.

Mark Lutter

SMS I Tutorium Teil II „Inferenzstatistik“

Seite 26 von 52

Hypergeometrische Verteilung

• Knüpft unmittelbar an das Urnenmodell an (s.o.) – bzw.: es ist nichts

anderes als das Urnenmodell

• Wie bei der Binomialverteilung werden nur die Ereignisse A und A

unterschieden

• Vergleicht man beide Verteilungen mit dem Urnenmodell wäre die

Binomialverteilung das Ziehen mit Zurücklegen und die

Hypergeometrische Verteilung das Ziehen ohne Zurücklegen

• Für die Wahrscheinlichkeitsfunktion f(k) einer H(N;K;n) – verteilten

Zufallsvariablen X gilt:

K N − K

k

n

k

−

f (k ) = P ( X = k ) = H ( N ; K ; n) =

N

n

• Die Übereinstimmung mit dem Urnenmodell wird deutlich, wenn wir uns

obiges Lottobeispiel noch einmal verdeutlichen:9

Wie hoch ist die Wahrscheinlichkeit für 4 Richtige im Lotto?

Lösung:

Von den N = 49 Zahlen werden n = 6 gezogen. Gleichzeitig haben

von allen 49 Zahlen K = 6 die Eigenschaft „richtig“ und N – K =

43 die Eigenschaft „falsch“ zu sein.

Von den n = 6 gezogenen Zahlen sollen k = 4 die Eigenschaft

„richtig“ , sowie n – k = 2 die Eigenschaft „falsch“ besitzen.

Demnach ergibt sich die Wahrscheinlichkeit für das Ereignis k = 4 richtige

Zahlen der H(49;6;6)-verteilten Zufallsvariablen X = Anzahl der richtigen

Zahlen folgendermaßen:

6 49 − 6

4 6 − 4

15 ⋅ 903

=

= 0,00096862

P ( X = 4) =

13983816

49

6

9

Vgl. S. 17 hier im Skript

Mark Lutter

SMS I Tutorium Teil II „Inferenzstatistik“

Seite 27 von 52

Poissonverteilung

• Allgemein: Ein Ereignis A tritt in einem gegebenen Zeitraum

durchschnittlich µ - mal ein. Man interessiert sich dann für die

Wahrscheinlichkeit, dass das Ereignis E in einem Zeitraum genau /

höchstens / mindestens k – mal eintritt. Die Zufallsvariable X „Anzahl der

pro Zeiteinheit eintretenden Ereignisse A“ ist dann poissonverteilt. Die

Wahrscheinlichkeitsfunktion ist definiert mit:

f (k ) = P( X = k ) =

µk

k!

e −µ

Man kann zeigen, dass bei seltenen Ereignissen (p → 0; n → ∞)

die Binomialverteilung in eine Poissonverteilung übergeht

Erwartungswert und Varianz der Poissonverteilung sind beide gleich µ

E(X) = Var(X) = µ

Die Poissonverteilung findet Anwendung bei Problemen der folgenden Art:

• In einem Callcenter kommen im Durchschnitt 5 Anrufe pro Minute an.

Interessiert ist man an der Wahrscheinlichkeit, dass pro Minute genau /

höchstens / mindestens 7 Anrufe eingehen

• Im Durchschnitt gibt es bundesweit jährlich 10 Neuinfektionen an einer

seltenen Krankheit. Wie hoch ist dann die Wahrscheinlichkeit, dass sich

in einem Monat genau / höchstens / mindestens eine Person ansteckt?

Aufgabe: Versucht an die Lösung eigenständig zu gelangen,

und/oder:

vgl. Beispiel 5.8 in Dürr/Mayer, a.a.O., S.77

sowie: Übungsaufgaben in Dürr/Mayer, S.78

3.1.2 Stetige Wahrscheinlichkeitsverteilungen

• Die wichtigste stetige Wahrscheinlichkeitsverteilung ist die

Normalverteilung10

• Weitere wichtige stetige Verteilungen sind aus der Normalverteilung

abgeleitet: die Chi-Quadrat-Verteilung, die t-Verteilung, die F-Verteilung

10

Vgl. hierzu die Abhandlung in Bortz, a.a.O., S.72ff. über die Bedeutsamkeit der Normalverteilung (insbes. S.

75f.)

Mark Lutter

SMS I Tutorium Teil II „Inferenzstatistik“

Seite 28 von 52

Normalverteilung (auch: „Gauß´sche Glockenkurve“)

Die Normalverteilung hat folgende Eigenschaften:

•

•

•

•

•

•

Die Verteilung ist symmetrisch und glockenförmig

Modalwert, Median und Mittelwert (=µ) fallen zusammen

Die Verteilung nähert sich asymptotisch der x-Achse

Das Maximum liegt bei µ

Die Wendepunkte liegen bei µ ± 1⋅σ

Die Fläche, die von der Dichtefunktion der Normalverteilung zwischen

x1 = µ + z⋅σ und x1 = µ - z⋅σ eingeschlossen wird ist immer gleich groß:

• Eine Normalverteilung hat einzig und allein die Parameter µ und σ

• Kurzschreibweise: N(µ;σ)

z

1

2

3

Intervallgrenzen Anteil der

Teilfläche

68,27 %

µ ± 1⋅σ

95,44 %

µ ± 2⋅σ

99,73 %

µ ± 3⋅σ

4

1,64

1,96

µ ± 4⋅σ

µ ± 1,64⋅σ

µ ± 1,96⋅σ

99,99 %

90 %

95 %

2,58

2,81

µ ± 2,58⋅σ

µ ± 2,81⋅σ

99 %

99,5 %

Bsp.:

Gegeben sei eine N(100;25) – verteile Zufallsvariable (d.h. sie sei

normalverteilt mit µ = 100 und σ = 25). In welchem Intervall liegen 95%

der Fälle?

µ ± 1,96⋅σ = 0,95

Demnach:

⇔

100 ± 1,96⋅25 = 0,95

Untere Intervallsgrenze = 51

⇔

100 ± 49= 0,95

Obere Intervallsgrenze = 149

95% der Fälle liegen in dem Intervall zwischen 51 und 149.

Mark Lutter

Graphisch dargestellt:

SMS I Tutorium Teil II „Inferenzstatistik“

Seite 29 von 52

Formel für die Dichtefunktion

der Normalverteilung:

Die Verteilungsfunktion zur Normalverteilung sieht folgendermaßen aus:

Mark Lutter

SMS I Tutorium Teil II „Inferenzstatistik“

Seite 30 von 52

Standardnormalverteilung

• Unter den theoretisch unendlich vielen Normalverteilungen ist die

Standardnormalverteilung diejenige, bei der gilt:

µ=0

σ=1

• Die Standardnormalverteilung ist also eine N(0;1) – Verteilung

• Mittels Z-Transformation einzelner Messwerte xi → zi =

xi − µ

σ

lässt sich

jede Normalverteilung in eine Standardnormalverteilung überführen

Tabelle zur Standardnormalverteilung

• Die Verteilungsfunktion zur Standardnormalverteilung liegt in

tabellierter Form vor11

zur

• Es

reicht

aus,

nur

die

Verteilungsfunktion

F0(x)

Standardnormalverteilung zu tabellieren, da man Werte der

Verteilungsfunktion F(x) einer beliebigen Normalverteilung durch

folgende Transformationsregel durch Werte der Verteilungsfunktion der

Standardnormalverteilung ersetzen kann:

x−µ

F ( x) = F0

σ

• Damit lassen sich Wahrscheinlichkeiten dafür ermitteln, dass ein Wert

einer normalverteilten Zufallsvariablen in einem bestimmten Intervall

liegt bzw. dass ein Wert höchstens / mindestens eine bestimmte Größe

annimmt.

Vgl. hierzu die Beispiel 6.1, 6.2 und 6.3 in Dürr/Mayer, a.a.O.,

S.83f.

• Auch können die anhand der Tabelle abgelesenen z-Werte mit der Formel

für die Z-Transformation wieder in ihre ursprünglichen xi – Werte

umgerechnet werden:

zi =

xi − µ

σ

⇔ xi = zi ⋅σ + µ

Damit können Aufgaben der folgenden Art gelöst werden:

11

vgl. Bortz, a.a.O., Tabelle B, S.694ff.

Mark Lutter

SMS I Tutorium Teil II „Inferenzstatistik“

Seite 31 von 52

1. Die Zeit, die Studierende pro Semesterwoche in der Vorlesungszeit für die

Vorbereitung von Seminaren aufwenden sei normalverteilt mit µ = 10 und σ = 6.

Bestimmen Sie, wie viele Stunden sich ein Studierender mindestens vorbereiten

muss, um zu den 5% der Studierenden zu gehören, die sich am längsten

vorbereiten.

Lösung:

Lt. Tabelle zur Verteilungsfunktion der Standardnormalverteilung

ermitteln wir für eine Anteilsfläche von 95% einen z-Wert von 1,65

(genauer: 0,9505 = 1,65). Über diesem z-Wert liegen die eifrigsten 5%

der Studenten. Da wir nun aber einen z-Wert aus der Verteilungsfunktion der Standardnormalverteilung erhalten haben, müssen wir

diesen z-Wert wieder in den ursprünglichen xi - Wert umwandeln:

zi =

xi − µ

σ

⇔ xi = zi ⋅ σ + µ

x i = 1, 65 ⋅ 6 + 10 = 19 ,9

Ein Studierender muss sich also mindestens 19,9 Stunden pro Woche

vorbereiten, um zu den eifrigsten 5% zu gehören.

2. Es sei unterstellt, der Intelligenzquotient sei normalverteilt mit µ = 100; σ = 10.

Wenn man insgesamt 10% der Population mit den extremsten Werten (jeweils

5% an beiden Enden) nicht berücksichtigt, in welchem Bereich wird der IQ dann

noch variieren?

Lösung:

Gesucht sind also zwei xi – Werte, deren Intervall die mittleren 90%

Anteilsfläche markieren. Da wir wiederum nur die Möglichkeit haben,

in der Tabelle zur Verteilungsfunktion der Standardnormalverteilung

nachzusehen, ermitteln wir statt unserer gesuchten xi -Werte zunächst ztransformierte xi – Werte, nämlich z-Werte:

Lt. Tabelle ermitteln wir:

Untere Grenze z = -1,65 (für Fläche 0,0495 ≈ 5%)

Obere Grenze z = + 1,65 (für Fläche 0,9505 ≈ 95%)

Wiederum müssen unsere z-Werte in ihre ursprünglichen xi – Werte

umgewandelt werden mit:

x 1 = − 1, 65 ⋅ 10 + 100 = 83 ,5

x 2 = + 1, 65 ⋅ 10 + 100 = 116 ,5

Demnach variiert der IQ, wenn man nur die mittleren 90% der

Population berücksichtigt, zwischen 83,5 und 116,5.

Zusatzfrage: Wie wahrscheinlich ist das Auftreten eines IQs zwischen 100 und

108?

Lösung:

Zu berechnen ist demnach die Fläche zwischen 100 und 108.

Damit der Flächenanteil und somit die Wahrscheinlichkeit zu ermitteln

ist, müssen die xi – Werte 100 bzw. 108 zunächst in ihre z-Werte

transformiert werden: z1 = 100 − 100 = 0 z = 108 − 100 = 0,8

10

2

10

Lt. Tabelle ergibt sich bis z = 0,8 ein Flächenanteil von 0,7881. Davon

wird die Fläche bis z = 0 (Fläche= 0,5) abgezogen, um den Flächenanteil für das relevante Intervall zu erhalten: 0,7881 – 0,5 = 0,2881.

Mit einer Wahrscheinlichkeit von ca. 28% wird der IQ in diesem

Intervall liegen.

Mark Lutter

SMS I Tutorium Teil II „Inferenzstatistik“

Seite 32 von 52

4.

Stichprobe und Grundgesamtheit12

(a)

Die Stichprobenkennwerteverteilung (engl.: „sampling distribution“)

Die Logik der Stichprobenkennwerteverteilung ist für das Verständnis der

gesamten schließenden Statistik von zentraler Bedeutung.

Diese Logik wird deutlich anhand folgendem Gedankenexperiment:

1. Gegeben sei eine bestimmte Grundgesamtheit

2. Wir ziehen aus dieser Grundgesamtheit eine genügend große Stichprobe

(n>30) und berechnen einen statistischen Kennwert, z.B. den Mittelwert13

eines Merkmals. Anschließend legen wir die für die Stichprobe

ausgewählten Elemente wieder zurück in die Grundgesamtheit.

3. Dann wiederholen wir Schritt 2 sehr oft (z.B. unendlich oft). Jedesmal

notieren wir uns den berechneten (Stichproben-) Mittelwert.

4. aus allen berechneten Mittelwerten erstellen wir eine Häufigkeitsverteilung – dies ist dann die Stichprobenkennwerteverteilung (des

Mittelwertes, in diesem Fall)14

5. berechnen wir dann aus allen einzelnen Stichprobenkennwerten den

Durchschnitt – quasi den Mittelwert aller Mittelwerte – dann ergibt sich

der Erwartungswert (s.u.)

6. berechnen wir nach gleicher Logik aus allen Stichprobenkennwerten die

Standardabweichung, dann ergibt sich der Standardfehler (s.u.)

Eigenschaften der Stichprobenkennwerteverteilung:15

• Diese „Häufigkeitsverteilung der Stichprobenkennwerte“ (hier:

Mittelwerte) wird immer die Form einer Normalverteilung annehmen,

• Denn: nach dem Zentralen Grenzwertsatz (s.u.) konvergiert diese

Verteilung mit wachsender Wiederholung der Ziehung bei genügend

großer Stichprobe (z.B. n>30 für die Mittelwerteverteilung) gegen eine

Normalverteilung – und zwar unabhängig davon, wie das Merkmal sonst

in der Population verteilt ist

Die Stichprobenkennwerteverteilung ist also N( µ ; σ )-verteilt!

12

zum tieferen Verständnis der folgenden Thematik empfehle ich die Lektüre des 3. Kapitels „Stichprobe

und Grundgesamtheit“ in Bortz, a.a.O., S.83ff sowie Dürr/Mayer, a.a.O., Kapitel 9.4, S.109ff.

13

Prinzipiell sind auch andere Kennwerte denkbar, z.B. der Median, die Varianz, die Standardabweichung, etc.

14

Je nachdem, welcher Kennwert zugrundegelegt wird, sind Stichprobenkennwerteverteilungen verschiedener

Kennwerte denkbar, so z.B. die des Medians, der Varianzen, etc. Vgl. dazu näheres z.B. im Faulbaum-Skript.

Generell folgen alle Stichprobenkennwerteverteilungen der gleichen Logik & haben die gleichen Eigenschaften

(wobei die eine schneller, die andere langsamer gegen eine Normalverteilung konvergiert).

15

Die Logik der Stichprobenkennwerteverteilung, sowie die von Konfidenzintervallen wird sehr gut deutlich mit

dem Programm „Sampling-Sim“, einer Simulations-Software, die o. g. „Gedankenexperiment“ anschaulich

simuliert und damit sehr gut zum Verständnis der gesamten schließenden Statistik beiträgt.

Kostenloser Download unter: http://www.gen.umn.edu/research/stat_tools/stat_tools_software.htm

Mark Lutter

SMS I Tutorium Teil II „Inferenzstatistik“

Seite 33 von 52

In diesem Zusammenhang wichtige Begriffe:

Stichprobenkennwert (auch: „Statistik“)

• Ein Stichprobenkennwert ist ein aus einer Stichprobe berechneter

statistischer Kennwert, wie z.B. der Mittelwert, Median, Modus,

Varianz, Standardabweichung, die Differenz zweier Mittelwerte, etc.

Schätzer

• Ein Schätzer ist ein Stichprobenkennwert, der als Schätzer für den

dahinterstehenden, wahren Populationsparameter fungiert.

• In diesem Sinne ist z.B. der Stichprobenmittelwert ein Schätzer für den

tatsächlichen, wahren Populationsmittelwert

Erwartungswert

• Das arithmetische Mittel der Stichprobenkennwerteverteilung heißt

Erwartungswert. Der Erwartungswert des Mittelwertes ist also nichts

anderes als der „Mittelwert aller (Stichproben-)Mittelwerte“

Erwartungstreue (auch: Unverzerrtheit)

• entspricht der Erwartungswert genau dem tatsächlichen, wahren

Populationswert, dann ist der verwendete statistische Kennwert

„erwartungstreu“ bzw. „unverzerrt“ (engl.: unbiased)

• „Erwartungstreue“ heißt also: der statistische Kennwert trifft im Mittel

den tatsächlichen Populationswert

• der verwendete Kennwert ist dann also ein „erwartungstreuer

Schätzer“ des wahren Wertes16

Standardfehler

• Die Standardabweichung der Stichprobenkennwerteverteilung heißt

Standardfehler. So ist z.B. der Standardfehler des Mittelwertes nichts

anderes als die „Standardabweichung aller (Stichproben-)Mittelwerte“

• Der Standardfehler gibt somit Auskunft über die durchschnittliche

Abweichung der Stichprobenkennwerte vom Erwartungswert

• Liegt genau eine Stichprobe und ein Schätzer vor, dann ist er ein

Kriterium für die Güte einer Schätzung, denn er sagt etwas aus über

die (wahrscheinliche) Streuung eines Kennwertes von Stichprobe zu

Stichprobe: Denn ist der Standardfehler eines Schätzers gering, so ist

es wahrscheinlich, dass der Schätzer nur gering vom Erwartungswert

abweicht. Ist er dagegen hoch, so wird ein Schätzer aller Vorrausicht

nach sehr ungenau sein, da eben die „sample-to-sample-variation“

groß ist, und es somit sein kann, dass eine einzelne Schätzung stark

vom tatsächlichen Wert abweicht.

16

In der Statistik sind alle uns bekannten Kennwerte erwartungstreu oder zumindest: annähernd erwartungstreu.

Mark Lutter

SMS I Tutorium Teil II „Inferenzstatistik“

Seite 34 von 52

Der Standardfehler des Mittelwertes (= σ x ) berechnet sich

mit:

σx =

wobei:

σ

n

σ

ist die Standardabweichung des Merkmals in der

Population; dieser Wert ist oft oder fast immer unbekannt.

In diesem Fall gilt: σ wird durch die Standardabweichung

des Merkmals in der Stichprobe (s) geschätzt:

σ as

s=

∑ (x

i

− x)2

n

Daraus ergibt sich der geschätzte Standardfehler des

Mittelwertes (deswegen mit ^ versehen):

σ̂ x =

s

n

(b) Der Zentrale Grenzwertsatz

Der Zentrale Grenzwertsatz besagt, wann eine Zufallsvariable normalverteilt ist!

Definition:

Eine Zufallsvariable X, die sich als Summe von n Zufallsvariablen X1,

X2, ... Xn ergibt, ist näherungsweise normalverteilt, wenn

• die Anzahl n der Zufallsvariablen X1, X2, ... Xn hinreichend groß ist (n>30)

• die Zufallsvariablen X1, X2, ... Xn unabhängig voneinander sind

• nicht eine bzw. einige wenige Zufallsvariablen gegenüber den übrigen

Zufallsvariablen stark dominieren

Der Zentrale Grenzwertsatz besagt im wesentlichen Folgendes:

• eine Normalverteilung liegt genau dann vor, wenn viele einzelne

Zufallseinflüsse additiv und unabhängig voneinander auf eine Variable

einwirken

• Für die Stichprobenkennwerteverteilung bedeutet dies: egal wie eine

Variable in der Population verteilt ist, die Verteilung des

Stichprobenkennwertes wird die Form einer Normalverteilung haben

(unter den entsprechenden Vorraussetzungen, die im Zentralen

Grenzwertsatz formuliert sind, wie z.B. n>30)

Mark Lutter

4.1

SMS I Tutorium Teil II „Inferenzstatistik“

Seite 35 von 52

Bestimmung von Konfidenzintervallen (auch: Vertrauensintervall)

Zunächst die Unterscheidung zweier Begriffe:

Punktschätzung

• es handelt sich um eine Punktschätzung, wenn ein Stichprobenkennwert

als Schätzer (s.o.) für den dahinterstehenden, wahren Populationswert

fungiert

Intervallschätzung

• Eine Schätzung durch Angabe von zwei Zahlen, von denen angenommen

wird, dass der Populationsparameter zwischen ihnen liegt, heißt Intervallschätzung.

• Hierfür konstruiert man Konfidenzintervalle, in die der unbekannte

Parameter mit einer bestimmten Überdeckungs- oder Sicherheitswahrscheinlichkeit (1 - α) fällt. Während 1 - α die Wahrscheinlichkeit

(z.B.: 0,95, also 95%) angibt, mit der der gesuchte Populationsparameter

in dem Intervall liegt, ist α die Irrtumswahrscheinlichkeit (z.B. 0,05, also

5%), die angibt, mit welcher Wahrscheinlichkeit die Intervallschätzung

fehlerbehaftet ist.

Bestimmung von Konfidenzintervallen für den Mittelwert

• Für die Bestimmung von Konfidenzintervallen macht man sich die

Tatsache zunutze, dass die Stichprobenkennwerteverteilung nach dem

Zentralen Grenzwertsatz normalverteilt ist. D.h., wir kennen die

Verteilung aller möglichen Stichproben-Mittelwerte und können

deswegen die Grenzen berechnen, die einen beliebig vorgebbaren (meist

90, 95 oder 99%) Flächenanteil (= 1 - α) unter der Normalverteilungskurve der Stichprobenkennwerteverteilung des Mittelwertes markieren:

Obere Grenze: x + zσ x

Untere Grenze: x − zσ x

Setzten wir für z = 1,96 ein, dann markieren die Grenzen ein 95%

Konfidenzintervall; für z = 1,64 ein 90% Intervall, etc.17

Da 1 - α der entsprechende Flächenanteil ist und σ x der Standardfehler

des Mittelwertes, ergibt sich als Berechnungsformel:

17

Vgl. dazu noch einmal die Ausführungen über die Eigenschaften der Normalverteilung, S. 28 hier im Skript.

Mark Lutter

SMS I Tutorium Teil II „Inferenzstatistik“

P( x − z

σ

n

≤µ≤x+z

σ

n

Seite 36 von 52

) = 1−α

Bzw. falls σ unbekannt, wird σ durch s geschätzt:

P( x − z

s

s

≤µ≤x+z

) = 1−α

n

n

• Haben wir aufgrund einer konkreten Stichprobe einen Stichprobenmittelwert berechnet und möchten ein Konfidenzintervall berechnen, gilt

es zunächst die Fläche festzulegen, die das Intervall einschließen soll.

Legen wir z.B. 95% als Flächenanteil fest, dann entspricht dies jenem

Anteil aller Mittelwerte, die innerhalb dieser Intervallgrenzen liegen

• Ein 95% Konfidenzintervall bedeutet also, dass das Intervall in 95% aller

gezogenen Stichproben zur Überdeckung des wahren Parameters

führt.

• Der durch die Intervallgrenzen markierte Flächenanteil stellt somit die

Überdeckungswahrscheinlichkeit (engl.: „coverage probability“) dar,

mit der das berechnete Intervall den wahren Parameter trifft

Bsp.: (vgl. Dürr/Mayer, a.a.O., Beispiel 10.5, S.129)

Eine Untersuchung von n = 50 Hähnchen auf ihren Kaloriengehalt ergab einen

Stichproben-Mittelwert von x = 215,48, sowie eine Standardabweichung von s =

33,14. Wie lauten die Intervallgrenzen bei 95% Überdeckungswahrscheinlichkeit?

Für ein 95% - Vertrauensintervall erhalten wir z = 1,96:

215,48 − 1,96

⇔

33,14

50

≤ µ ≤ 215,48 + 1,96

33,14

50

206,29 ≤ µ ≤ 224,67

Mit 95%tiger Überdeckungswahrscheinlichkeit wird der wahre Populationswert µ

innerhalb der Grenzen von 206,29 und 224,67 liegen.

Achtung:

Bei kleinen Stichproben (n ≤ 30) sind die Stichprobenmittelwerte nicht mehr

normalverteilt, sodass dann die z-Werte (als t-Werte) in der Tabelle für die tVerteilung für n – 1 Freiheitsgrade (df) ermittelt werden müssen.18

18

Vgl. Tabelle D in Bortz, a.a.O., S.701

Mark Lutter

SMS I Tutorium Teil II „Inferenzstatistik“

Seite 37 von 52

Wichtig:

Konfidenzintervalle können z.B.: auch für Anteilswerte (Prozentwerte)

gebildet werden. Die Vorgehensweise ist dabei ähnlich, vgl. dazu die

Ausführungen in Dürr/Mayer, a.a.O., S.131ff. oder Bortz, a.a.O., S.99f.

Generell gilt:

• Die Länge des Konfidenzintervalls hängt ab von σ, n und 1 - α

• Hat also das untersuchte Merkmal eine große Streuung, so erhält man ein

entsprechend großes Intervall. Wird die Sicherheitswahrscheinlichkeit

erhöht, so verlängert sich auch das Vertrauensintervall. Das bedeutet, es

verringert sich damit die Genauigkeit der Intervallschätzung. Umgekehrt

gilt: je geringer die Sicherheitswahrscheinlichkeit gewählt wird, desto

kleiner wird das Vertrauensintervall und desto größer wird die

Genauigkeit. Jedoch: Durch Verkleinerung der Sicherheitswahrscheinlichkeit 1 - α erhöht sich die Irrtumswahrscheinlichkeit α.

• Soll die Länge des Intervalls verkürzt werden und damit die Genauigkeit

der Intervallschätzung erhöht werden, so muss der Stichprobenumfang

n vergrößert werden. Dabei gilt:

Eine Halbierung der Intervalllänge erfordert eine Vervierfachung des

Stichprobenumfangs

weitere Übungsaufgaben:

5.

Dürr/Mayer, a.a.O., S.140f.

Bortz, a.a.O., S.102f.

Die Überprüfung statistischer Hypothesen / Testverfahren19

Mithilfe von statistischen Testverfahren lassen sich (sozial-)wissenschaftliche

Hypothesen überprüfen.

Beispiele für Hypothesen

• H1: Männer haben eine geringere Lebenserwartung als Frauen

• H2: Je länger die Arbeitslosigkeit einer Person andauert, desto geringer ist

ihre Bereitschaft zur politischen Partizipation

Hypothesen solcher Art lassen sich zunächst auf deskriptiver Basis mit den

bekannten Verfahren überprüfen.20

19

Vgl. zum tieferen Verständnis die Ausführungen in Bortz, a.a.O., Kap. 4, S.104ff., sowie Kap. 5, S. 128ff.

z.B.: H1 durch einen Vergleich der durchschnittlichen Lebenserwartung bei Männern und Frauen, H2 durch

eine Korrelationsrechnung zwischen den Variablen „Dauer der Arbeitslosigkeit“ und „Bereitschaft zur polit.

Partizipation“

20

Mark Lutter

SMS I Tutorium Teil II „Inferenzstatistik“

Seite 38 von 52

(Sozial-)Wissenschaftliche Hypothesen werden zwecks Überprüfung

umformuliert in statistische Hypothesen. Statistische Hypothesen sind Aussagen

über Parameter in der Population.

Die Hypothesenformulierung kann unterschieden werden zwischen

• Zusammenhangshypothesen (z.B.: Chi-Quadrat-Test)

hier wird überprüft, ob ein Zusammenhang zwischen zwei Variablen

signifikant ist

• Unterschiedshypothesen (z.B.: z-Test; t-Test, F-Test)

hier wird überprüft, ob sich Parameter (z.B. Mittelwerte) signifikant

unterscheiden

Statistische Hypothesen:

Alternativhypothese (H1):

• Die Alternativhypothese ist die präzise Formulierung der Vermutung des

Forschers über einen bestimmten Sachverhalt

• Deshalb wird H1 gelegentlich auch wissenschaftliche Hypothese genannt

Nullhypothese (H0):

• Die Nullhypothese ist die Verneinung der Alternativhypothese.

• Damit ist sie die genaue Verneinung der Vermutung des Forschers

Fehlermöglichkeiten:

Fehler 1. Art (auch: α - Fehler)

• Angenommen, die H0 ist in Wirklichkeit wahr, wir lehnen sie dennoch

ab. Dies ist der Fehler 1. Art: Das Ablehnen einer (eigentlich richtigen)

Nullhypothese. Das Signifikanzniveau α ist die Wahrscheinlichkeit für

den Fehler 1. Art (Irrtumswahrscheinlichkeit oder α- Risiko genannt)

Fehler 2. Art (auch β - Fehler)

• Angenommen, die H0 ist in Wirklichkeit nicht wahr, wir nehmen sie

dennoch an. Dies ist der Fehler 2. Art: Das Ablehnen einer (eigentlich

richtigen) Alternativhypothese. Die Wahrscheinlichkeit einen Fehler 2.

Art zu begehen, wird β - Risiko genannt

Mark Lutter

SMS I Tutorium Teil II „Inferenzstatistik“

Seite 39 von 52

Überblick über klausurrelevante Testverfahren

z-Test (auch: „Gauß-Test“ oder bei SPSS: „t-test bei einer Stichprobe“)

• Überprüft, ob sich ein Stichprobenmittelwert signifikant von einem

vorgegebenen (z.B. bekannt aus einer früheren Erhebung) „Populations-“

Mittelwert unterscheidet

t-Test (für abhängige oder unabhängige Stichproben)

• Überprüft, ob sich zwei Stichprobenmittelwerte signifikant unterscheiden

F-Test (wird hier im Einzelnen nicht behandelt, vgl. Bortz, a.a.O., Kap. 5.1.5)

• Überprüft, ob sich zwei Stichprobenvarianzen signifikant unterscheiden

Chi-Quadrat-Test

• Überprüft, ob der Zusammenhang zwischen zwei nominalskalierten

variablen signifikant ist (also ob Chi-Quadrat signifikant von Null

verschieden ist)

Zum Begriff der Signifikanz (= Überzufälligkeit o. Bedeutsamkeit)

• Erweist sich ein Unterschied oder Zusammenhang als signifikant,

bedeutet dies, der Zusammenhang ist so stark oder der Unterschied so

groß, dass er nicht aufgrund von Zufallseinflüssen entstanden sein kann.

Zur Durchführung der Tests

z-Test (bei SPSS: t-test bei einer Stichprobe; sonst auch: Gauss-Test)21

• der z-Test vergleicht einen Stichprobenmittelwert (mit µ bezeichnet) mit

einem (bekannten oder erwarteten) Populationsmittelwert (mit µ0

bezeichnet)

• hierbei wird die Hypothese überprüft, ob sich ein Stichprobenmittelwert

signifikant von einem Populationsmittelwert unterscheidet

Folgende Parameter müssen also gegeben sein: µ ( x ), µ0, σ x ( σ̂ x )

21

Beispielaufgaben zu den Testverfahren finden sich in den Übungsklausuren

Mark Lutter

SMS I Tutorium Teil II „Inferenzstatistik“

Seite 40 von 52

I. Schritt: Hypothesenformulierung

Die Hypothesen werden je nach Fragestellung unterschiedlich formuliert:

1. zweiseitige Fragestellung (d.h. es wird danach gefragt, ob die

Mittelwerte gleich oder ungleich sind)

H0: µ = µ0

H1: µ ≠ µ0

Die Mittelwerte sind gleich

Die Mittelwerte sind nicht gleich

2. einseitige Fragestellung (d.h. es wird danach gefragt, ob der

Stichprobenmittelwert kleiner oder größer geworden ist)

Variante 1: Postuliert wird, dass der Stichprobenmittelwert kleiner

geworden ist:

H0: µ ≥ µ0

H1: µ < µ0

µ ist nicht kleiner geworden

µ ist kleiner geworden

Variante 2: Postuliert wird, dass der Stichprobenmittelwert größer

geworden ist:

H0: µ ≤ µ0

H1: µ > µ0

µ ist nicht größer geworden

µ ist größer geworden

II. Schritt: Berechnung des empirischen z-Wertes:

• Ist die Standardabweichung der Population σ bekannt, dann gilt:

z emp =

x − µ0

σx

=

x − µ0

σ

=

x − µ0

σ

⋅ n

n

• Ist die Standardabweichung der Population σ unbekannt, dann wird sie

durch die der Stichprobe (s) geschätzt. In diesem Fall gilt:

z emp =

x − µ0 x − µ0 x − µ0

=

=

⋅ n

s

s

σˆ x

n

Mark Lutter

SMS I Tutorium Teil II „Inferenzstatistik“

Seite 41 von 52

III. Schritt: Ermitteln des theoretischen z-Wertes anhand der Tabelle:

• Der theoretische z-Wert wird anhand der Tabelle „Verteilungsfunktion der

Standardnormalverteilung“ (Tabelle B in Bortz, a.a.O.) nachgesehen und

ist abhängig vom festgelegtem Signifikanzniveau. Er markiert das

Intervall des Annahmebereichs der Nullhypothese. Berücksichtigt werden

muss hier die zugrundegelegte Fragestellung:

1. bei zweiseitiger Fragestellung nachsehen bei 1 −

α

2

sowie

α

2

2. bei einseitiger Fragestellung nachsehen bei 1 − α für H0: µ ≤ µ0

oder bei α für H0: µ ≥ µ0

Merke:

Für kleine Stichproben (n ≤ 30) sind die Stichprobenmittelwerte nicht

mehr normalverteilt. In diesem Falle muss das Merkmal selber

normalverteilt sein. Dann muss der theoretische z-Wert (als t-Wert) in der

t-Tabelle (Tabelle D in Bortz, a.a.O.) für n-1 Freiheitsgrade abgelesen

werden.

IV. Schritt:

Ergebnisinterpretation

1. bei zweiseitiger Fragestellung

• die Nullhypothese wird angenommen, wenn zemp im Intervall

[±ztheoret.] liegt

• die

Nullhypothese

wird

abgelehnt

zugunsten

der

Alternativhypothese, wenn zemp außerhalb dieses Intervalls liegt

2. bei einseitiger Fragestellung

• die Nullhypothese wird angenommen, wenn der Betrag von zemp

kleiner ist als der Betrag von ztheoret., wenn also gilt: z emp ≤ z theoret

• die Nullhypothese wird abgelehnt, wenn gilt:

z emp > z theoret

Mark Lutter

SMS I Tutorium Teil II „Inferenzstatistik“

Seite 42 von 52

Z- Test mit SPSS

• der z-Test findet sich unter der Prozedur „t-Test für eine Stichprobe“

• dort muss manuell ein Testwert vorgegeben werden, der dem erwarteten

Populationsmittelwert µ0 entspricht. Dieser wird dann mit einem

Stichprobenmittelwert verglichen.

Bsp.:

Man geht davon aus, dass sich bei der ALLBUS - Variable „Politische

Selbsteinstufung /Links; Rechts“ der Populationsmittelwert µ0 genau in der Mitte

befinden wird. Auf einer Skala von 0 = ganz links bis 10 = ganz rechts erwarten

wir also ein µ0 von 5.5. Dies ist der Testwert, der nun mit dem tatsächlichen

Mittelwert der Stichprobe (= 5,02) verglichen werden soll:

Statistik bei einer Stichprobe

N

LINKS-RECHTS-SELBS

TEINSTUFUNG, BEFR.

Mittelwert

Standardab

weichung

Standardfe

hler des

Mittelwertes

5,02

1,63

2,95E-02

3056

Der Stichprobenumfang beträgt N = 3056 Befragte, der Mittelwert der Variable

„Politische Selbsteinstufung“ liegt bei 5,02 mit einer Standardabweichung von 1,63

und einem (geschätzten) Standardfehler des Mittelwertes von

σˆ x =

s

n

=

1,63

3056

= 0,0295 = 2,95E − 02

Nun wird geprüft, ob sich dieser Stichprobenmittelwert von 5,02 signifikant von

dem erwarteten Populationsmittelwert (Testwert = 5,5) unterscheidet. Wie müssten

dazu die Hypothesen formuliert werden?

Test bei einer Sichprobe

Testwert = 5.5

T

LINKS-RECHTS-SELBS

TEINSTUFUNG, BEFR.

-16,213

df

3055

Sig. (2-seitig)

Mittlere

Differenz

,000

-,48

95% Konfidenzintervall

der Differenz

Untere

Obere

-,54

-,42

Sichtbar ist hier zunächst der empirische T-Wert von -16,213, die Freiheitsgrade

df = n - 1 = 3055.

Daneben steht die Signifikanzzahl von 0,000 (Sig. 2-seitig). Dies bedeutet, der

Unterschied zwischen den Mittelwerten ist hochsignifikant.

Mark Lutter

SMS I Tutorium Teil II „Inferenzstatistik“

Seite 43 von 52

D.h. wir können mit fast 100%tiger Sicherheit davon ausgehen,

dass die Mittelwerte in der Grundgesamtheit nicht gleich sind. Die

Nullhypothese: „Die Mittelwerte sind gleich“ kann abgelehnt

werden.

Das Ergebnis ist signifikant, solange die Signifikanzzahl das

zulässige (vorgegebene) Signifikanzniveau (von meist 5%) nicht

überschreitet

Achtung:

• Bei einseitiger Fragestellung muss der Wert der Signifikanz (Sig. 2-seitig)

halbiert werden.

t-Test: Vergleich zweier Stichprobenmittelwerte

• t-Test für unabhängige Stichproben

• t-Test für abhängige Stichproben

Unterschied zwischen abhängigen und unabhängigen Stichproben

Abhängige Stichproben (auch: verbundene o. gepaarte Stichprobe)

• Abhängige Stichproben liegen vor, wenn jedem Wert der einen

Stichprobe auf sinnvolle und eindeutige Weise genau ein Wert der

anderen Stichprobe zugeordnet werden kann

Bsp.: Alkoholtest

Die Reaktionszeit einer Person wird gemessen vor und nach dem

Konsum von Alkohol

Gesundheitstest

Der Gesundheitszustand wird vor und nach einer Behandlung untersucht

• Hier liegen jeweils zwei Messungen vor, die anhand der gleichen

Stichprobe durchgeführt werden, wobei die Elemente beider

Messzeitpunkte jeweils paarweise zugeordnet werden können

Unabhängige Stichproben

• Unabhängige Stichproben liegen vor, wenn zwischen beiden Stichproben

keine eindeutige Wertezuordnung möglich ist

Bsp.: In einer Umfrage sind Personen aus Ost- und Westdeutschland befragt

worden. Dann stellen die Personen aus Ost- sowie Westdeutschland

jeweils zwei unabhängige Stichproben dar.

Mark Lutter

SMS I Tutorium Teil II „Inferenzstatistik“

Seite 44 von 52

t-Test für unabhängige Stichproben

Gegeben sind 2 unabhängige Stichproben des Umfangs n1 und n2; sowie

deren Stichprobenmittelwerte x1 und x 2 eines erhobenen Merkmals X

Der t-Test für unabhängige Stichproben prüft nun die Nullhypothese, dass

beide

Stichproben

aus

Populationen

stammen,

deren

Populationsmittelwerte identisch sind.

I. Schritt: Formulierung der Hypothesen

Auch hier wird wieder nach Fragestellung unterschieden:

1. zweiseitige Fragestellung (Es wird danach gefragt, ob die Mittelwerte

gleich sind)

H0: µ1 = µ2

H1: µ1 ≠ µ2

2. einseitige Fragestellung

Variante 1: Es wird danach gefragt, ob µ1 größer ist

H0: µ1 ≤ µ2