Das Sammelbilderproblem - publish.UP

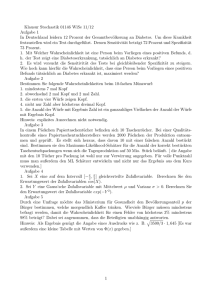

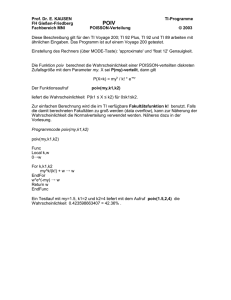

Werbung