ABSOLUT STETIGE VERTEILUNGEN

Werbung

KAPITEL

14

DIE WICHTIGSTEN

WAHRSCHEINLICHKEITSVERTEILUNGEN

(ABSOLUT STETIGE VERTEILUNGEN)

In diesem Kapitel beschreiben wir die wichtigsten Wahrscheinlichkeitsverteilungen, die eine Dichte besitzen. Für jede von ihnen geben wir die wesentlichen

Eigenschaften an und skizzieren ihren Anwendungsbereich.

1. Die Gleichverteilung auf [0, 1]

Definition. — Eine Zufallsvariable U mit Werten in [0, 1] heisst gleichverteilt auf [0, 1], wenn sie absolut stetig ist und

f (x) = I[0,1] (x)

als Dichte hat. Die Verteilung mit der Dichte f heisst Gleichverteilung auf

[0, 1].

Die folgenden Eigenschaften sind leicht zu zeigen:

E[U ] =

g(u) = E[euU ] =

1

;

2

eu − 1

(u = 0),

u

Var U =

1

;

12

g(0) = 1 ;

L(U ) = L(1 − U ).

Die Gleichverteilung spielt eine grosse Rolle bei der Simulation von beliebigen

Wahrscheinlichkeitsverteilungen, was im folgenden Satz von P. Lévy zum

Ausdruck kommt.

Theorem 1.1. — Es sei F : R → [0, 1] eine monoton wachsende

und rechtsseitig-stetige Funktion mit F (−∞) = 0 und F (+∞) = 1. Mit

h : ]0, 1[→ R bezeichnet man ihre verallgemeinerte Inverse, die mittels

h(ω) = inf{x : F (x) ≥ ω}

(ω ∈]0, 1[ )

definiert ist. Sei nun U eine auf [0, 1] gleichverteilte Zufallsvariable. Dann

hat die Zufallsvariable X = h ◦ U gerade F als Verteilungsfunktion.

212

KAPITEL 14: DIE WICHTIGSTEN VERTEILUNGEN

Beweis. — Aus der Definition von h ergibt sich unmittelbar die Äquivalenz

ω ≤ F (x) ⇔ h(ω) ≤ x. Damit gilt aber für jedes reelle x

P{X ≤ x} = P{h ◦ U ≤ x} = P{U ≤ F (x)} = F (x).

Dies zeigt aber gerade, dass X die Funktion F als Verteilungsfunktion hat.

2. Die Gleichverteilung auf [a, b]

Definition. — Eine Zufallsvariable X mit Werten im Intervall [a, b]

(−∞ < a < b < +∞) heisst gleichverteilt auf [a, b], wenn sie absolut stetig

ist und die Dichte

1

I[a,b] (x)

f (x) =

b−a

hat. Die Verteilung mit der Dichte f heisst Gleichverteilung auf [a, b].

Die folgenden Eigenschaften lassen sich ebenfalls leicht nachweisen:

a+b

(a − b)2

;

Var X =

;

2

12

1 ebu − eau

(u = 0),

g(0) = 1.

g(u) = E[euX ] =

b−a

u

sh u

Für a = −1, b = +1 hat man g(u) =

(u = 0),

g(0) = 1,

u

und allgemein ist für a = −l, b = +l und l > 0

sh lu

(u = 0),

g(0) = 1.

g(u) =

lu

E[X] =

3. Die Normalverteilung oder Gauss-(Laplace)-Verteilung

3.1. Die reduzierte Normalverteilung

Definition. — Eine Zufallsvariable X mit Werten in R heisst reduziert

normalverteilt, wenn sie absolut stetig ist und als Dichte die Funktion

x2 1

√

exp −

f (x) =

2

2π

(x ∈ R)

hat. Die Verteilung mit der Dichte f heisst reduzierte Normalverteilung und

wird mit N (0, 1) notiert.

Es folgt nun eine Liste der wichtigsten Eigenschaften dieser klassischen

Verteilung:

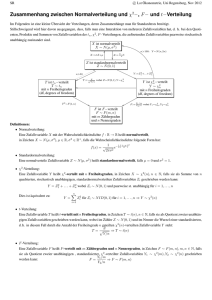

a) Der Graph (cf. Fig. 1) der Dichte f hat die Form einer ziemlich

abgeflachten Glockenkurve. Um das zu sehen, genügt es festzustellen, dass

213

3. DIE NORMALVERTEILUNG

√

f gerade ist, ein Maximum (vom Wert f (0) = 1/ 2π ≈ 0, 399) bei x = 0

annimmt und dass f (x) = 0 genau für x = ±1 gilt.

b) Es bezeichne Φ die Verteilungsfunktion von X, also

x

t2 1

Φ(x) = √

dt (x ∈ R).

exp −

2

2π −∞

Deren Graph ist eine ziemlich gestreckte Kurve, die symmetrisch

zum Punkt

√

(0, 1/2) ist und deren Steigung in diesem Punkt gleich 1/ 2π ist.

c) Es gilt E[X] = 0 und Var X = 1. Aus diesem Grund wird die

Verteilung als zentriert und reduziert bezeichnet und mit N (0, 1) notiert.

2

d) Es gilt g(u) = E[euX ] = eu /2 (u ∈ R).

√1

2π

−1

+1

1

2

−1

+1

Fig. 1

Beweis. — Gemäss Definition ist

2

1

eux e−x /2 dx.

g(u) = √

2π R

Wegen

ux − x2 /2 = −(x − u)2 /2 + u2 /2

kann man

u2 /2

g(u) = e

1

√

2π

2

e−(x−u)

/2

dx

R

schreiben und erhält mittels der Variablentransformation x−u = t schliesslich

2

2

u2 /2 1

√

g(u) = e

e−t /2 dt = eu /2 .

2π R

214

KAPITEL 14: DIE WICHTIGSTEN VERTEILUNGEN

2

e) Die Funktion g(u) = eu /2 ist für alle reellen u definiert und lässt

sich auf der ganzen reellen Achse in eine Potenzreihe entwickeln. X besitzt

alle Momente beliebiger Ordnung. Das Moment n-ter Ordnung (n ≥ 0) tritt

als Koeffizient von un /n! in der Entwicklung von g um den Ursprung in

Erscheinung. Aus

2

g(u) = eu

/2

=

1 u2 n 1 1

(2n)! 1 u2n

2n

=

u

=

n! 2

n! 2n

n! 2n (2n)!

n≥0

n≥0

n≥0

erhält man somit als Werte für die Momente:

1 (2n)!

= 1 × 3 × · · · × (2n − 3) × (2n − 1)

2n n!

(n ≥ 0).

E[X 2n+1 ] = 0

E[X 2n ] =

(n ≥ 1) ;

2r/2 r + 1 r

.

f) Für jedes r > −1 ist E[ |X| ] = √ Γ

π

2

Beweis. — Es ist ja

∞

2

1

2

r −x2 /2

E[ |X| ] = √

|x| e

dx = √

xr e−x /2 dx ;

2π R

2π 0

daraus erhält man durch die Variablentransformation x2 /2 = u

2r/2 ∞ (r−1)/2 −u

2r/2 r + 1 r

u

e du = √ Γ

E[ |X| ] = √

.

2

π 0

π

r

3.2. Die allgemeine Normalverteilung

Definition. — Wir betrachten eine N (0, 1)-verteilte Zufallsvariable Y und

zwei reelle Zahlen µ und σ > 0. Die Zufallsvariable X = µ + σY heisst

N (µ, σ)-normalverteilt (oder N1 (µ, σ 2 )-normalverteilt in der Notation von

Kap. 12, § 5).

Die Verteilung von X hängt von zwei Parametern ab, nämlich von µ und

σ, deren Interpretation offensichtlich ist: E[X] = µ und Var X = σ 2 . Also

σ(X) = σ.

Die wichtigsten Eigenschaften der allgemeinen Normalverteilung werden

nun beschrieben.

a) Die Dichte von X ist durch

f (x) =

1 x − µ 2 1

√ exp −

(x ∈ R)

2

σ

σ 2π

gegeben. Will man den Graphen zeichnen, so ist zu beachten, dass f√symmetrisch zu x = µ ist, in x = µ sein Maximum (vom Wert f (µ) = 1/(σ 2π))

215

4. DIE LOG-NORMALE VERTEILUNG

annimmt, sowie dass f (x) = 0 genau für x = µ ± σ gilt. Es handelt sich

also um eine Glockenkurve, die symmetrisch zur Achse x = µ ist, mit ausgeprägter Spitze für kleines σ und abgeflacht für grosses σ.

b) Die Verteilungsfunktion von X ist durch

x − µ

x − µ

F(x) = P{X ≤ x} = P Y ≤

=Φ

σ

σ

(x ∈ R)

gegeben. Deren Graph ist symmetrisch √

bezüglich des Punktes (µ, 1/2) und

die Steigung in diesem Punkt ist 1/(σ 2π). Daraus ergibt sich, dass der

Graph die Form eine S-Kurve hat, die für kleine σ sehr steil und für grosses

σ sehr gedehnt ist.

c) Die erzeugende Funktion der Momente ist durch

σ 2 u2 g(u) = E[euX ] = exp µu +

2

(u ∈ R)

gegeben.

d) Aus der Form der erzeugenden Funktion ergibt sich sofort, dass

für ein Paar (X1 , X2 ) von unabhängigen Zufallsvariablen mit Verteilungen

N (µ1 , σ1 ), N (µ2 , σ2 ), wobei µ1 , µ2 reell und σ1 > 0, σ2 > 0 sind, die Summe

X = X1 + X2 die Verteilung N (µ, σ) mit µ = µ1 + µ2 und σ 2 = σ12 + σ22 hat.

Auftreten der Normalverteilung. — Die Erfahrung hat gezeigt, dass viele

physikalische, biometrische, u. dgl. (Mess-)Grössen normalverteilt sind. Eine

Erklärung für dieses Phänomen liefert der zentrale Grenzwertsatz , der

in Kapitel 18 behandelt wird. Es gibt allerdings auch Situationen, wo

die Anwendung der Normalverteilung zur Beschreibung eines Phänomens

geradezu kontra-indiziert ist. Beispielsweise kann man verifizieren, dass für

eine normalverteilte Zufallsvariable X die Variable Y = 1/X nicht einmal

einen Erwartungswert besitzt (d.h. E[1/ |X| ] = +∞). Betrachten wir etwa

das Ohmsche Gesetz I = V /R und nehmen an, die Spannung V habe eine

feste und bekannte Grösse, der Widerstand R dagegen sei normalverteilt

(was auf den ersten Blick vernünftig erscheint). Das hätte zur Folge, dass die

Stromstärke eine Zufallsgrösse wäre, die keinen Erwartungswert besitzt (was

für einen Ingenieur schwer zu akzeptieren wäre). Daher ist die Hypothese,

dass R normalverteilt sei, unrealistisch.

4. Die Log-normale Verteilung

Definition. — Eine Zufallsvariable X mit Werten in ]0, +∞[ heisst Lognormal-verteilt mit Parametern (µ, σ) (µ reell, σ > 0), wenn Y = Log X

N (µ, σ)-verteilt ist.

216

KAPITEL 14: DIE WICHTIGSTEN VERTEILUNGEN

Eigenschaften.

a) Die Verteilungsfunktion von X ist

Log x − µ Φ

, falls x > 0;

F(x) =

σ

0,

sonst.

b) Die Dichte von X ist

1 Log x − µ 2 1 1

f (x) = √

I]0,+∞[ (x).

exp −

2

σ

σ 2π x

2

2

2

c) Es gilt E[X] = eµ+σ /2 und Var X = e2µ+σ (eσ − 1).

d) Ist X Log-normal-verteilt mit Parametern (µ, σ), so ist X r (r > 0)

Log-normal-verteilt mit Parametern (rµ, rσ).

Bemerkung. — Aus c) und d) folgt, dass für alle r > 0 das Moment E[X r ]

2 2

endlich ist, wobei genau E[X r ] = erµ+(r σ )/2 .

e) Die Funktion g(u) = E[euX ] ist für kein u > 0 definiert. Anders

formuliert, die Log-normale Verteilung hat keine erzeugende Funktion, die in

einem offenen Intervall um den Punkt u = 0 definiert ist. Gleichwohl hat X

Momente jeder positiven ganzzahligen Ordnung.

Beweis.

a) Für jedes x > 0 gilt

F(x) = P{X ≤ x} = P{Y ≤ Log x}

Log x − µ Y − µ

Log x − µ ≤

=Φ

.

=P

σ

σ

σ

b) Die Dichte erhält man durch Ableiten von F(x).

c) Es sei X = eσY +µ mit L(Y ) = N (0, 1). Aus dem Transportsatz erhält

man

2

2

1

1

σx+µ −x2 /2

e

e

dx = √

e−(x−σ) /2+σ /2+µ dx

E[X] = √

2π R

2π R

2

2

1

= eµ+σ /2 √

e−(x−σ) /2 dx,

2π R

woraus sich mittels der Variablentransformation

x−σ = t

2

2

2

1

e−t /2 dt = eµ+σ /2

E[X] = eµ+σ /2 √

2π R

ergibt. Eine entsprechende Rechnung liefert den Ausdruck für die Varianz.

d) Es ist Log X r = r Log X. Wenn Log X gemäss N (µ, σ) verteilt ist,

ist also r Log X gemäss N (rµ, rσ) verteilt.

e) Das ist offensichtlich.

5. DIE EXPONENTIALVERTEILUNG

217

Auftreten der Log-normalen Verteilung. — Der Log-normalen Verteilung

begegnet man in einem überraschenden Zusammenhang, nämlich in der

Linguistik: die Anzahl der Wörter pro Satz (d.h. die Länge eines Satzes wird

durch die Anzahl der Wörter gemessen) ist in etwa Log-normal-verteilt.1

5. Die Exponentialverteilung

Definition. — Es sei λ eine positive Zahl; eine Zufallsvariable X mit

Werten in ]0, +∞[ heisst exponential-verteilt mit Parameter λ, wenn sie

absolut stetig ist und die Dichte

f (x) = λe−λx I]0,+∞[ (x)

hat. Die Verteilung mit der Dichte f heisst Exponentialverteilung mit Parameter λ (λ > 0) und wird mit E(λ) notiert.

Es folgen einige Eigenschaften der Exponentialverteilung.

a) Die Verteilungsfunktion von X ist

1 − e−λx , falls x > 0;

F(x) =

0,

sonst.

Es ist oft zweckmässig, mit der Überlebensfunktion (oder Zuverlässigkeitsfunktion) zu arbeiten, die durch r(x) = 1 − F(x) = P{X > x} definiert ist

und explizit dargestellt wird durch

e−λx , für x > 0;

r(x) =

1,

sonst.

b) Es gilt E[X] = 1/λ, Var X = 1/λ2 , sowie L(λX) = E(1).

c) Die erzeugende Funktion der Momente ist

g(u) = E[euX ] =

1

λ

=

u

λ−u

1−

λ

Beweis. — Es ist

g(u) = λ

∞

(u ∈] − ∞, λ[).

e−x(λ−u) dx.

0

Das Integral auf der rechten Seite konvergiert genau dann, wenn λ − u > 0

ist. In diesem Fall führt die Variablentransformation x(λ − u) = t auf

∞

λ

1

dt =

.

e−t

g(u) = λ

λ−u

λ−u

0

1

Williams (C.B.). — Studies in the history of probability and statistics: a note on a early

statistical study of literary style, Biometrika, t. 43, , p. 248–356.

218

KAPITEL 14: DIE WICHTIGSTEN VERTEILUNGEN

d) Die Funktion g(u) = 1/(1 − (u/λ)) ist im Intervall ] − ∞, λ[ definiert,

das wegen λ > 0 eine offene Umgebung des Ursprungs ist. Es handelt sich

also um die erzeugende Funktion der Momente von X, die für alle u aus

dem Intervall ] − λ, +λ[ in eine Potenzreihe entwickelt werden kann. Die

Zufallsvariable X hat Momente beliebiger Ordnung und das Moment n-ter

Ordnung (n ≥ 0) ist der Koeffizient von un /n! in der Reihenentwicklung

von g um den Ursprung. Es ist aber

u n n! un

1

=

=

g(u) =

,

(u ∈] − λ, +λ[)

u

λ

λn n!

1−

n≥0

n≥0

λ

so dass man

n!

(n ≥ 0)

E[X n ] = n

λ

als Werte für die Momente erhält.

e) Für jedes r > −1 gilt E[X r ] =

Beweis. — Es gilt

E[X ] = λ

r

Γ(r + 1)

.

λr

∞

xr e−λx dx

0

und die Variablentransformation

= u liefert

λx

∞

1

Γ(r + 1)

E[X r ] = r

ur e−u du =

.

λ 0

λr

Dieser Ausdruck ist genau dann endlich, wenn r + 1 > 0 ist.

f) Ist X E(λ)-verteilt, so hat der ganzzahlige Anteil Y = [X] die

Verteilung: P{Y = n} = pq n (n ≥ 0), wobei q = e−λ , p = 1 − q

ist. Mit anderen Worten, Y = [X] ist geometrisch verteilt. In diesem

Sinne ist die geometrische Verteilung n≥0 pq n n die diskrete Version der

Exponentialverteilung.

Beweis. — Ist X gemäss E(λ) verteilt (λ > 0) und setzt man q = e−λ , so

gilt für jede ganze Zahl n ≥ 0

−λ n+1

−λ(n+1)

= e

= q n+1 .

P{[X] > n} = P{X ≥ n + 1} = e

g) Ist X gemäss E(λ) verteilt, so ist U = e−λX auf ]0, 1[ gleichverteilt.

Beweis. — Für u aus dem Intervall ]0, 1[ gilt

Log u P{U ≤ u} = P{−λX ≤ Log u} = P X > −

λ

Log u = exp Log u = u.

= exp −λ −

λ

219

5. DIE EXPONENTIALVERTEILUNG

Bemerkung. — Aus g) folgt umgekehrt, dass für eine auf ]0, 1[ gleichverteilte Zufallsvariable U die Variable X = −(1/λ) Log U , λ > 0, E(λ)-verteilt

ist. Diese Eigenschaft kann man dazu verwenden, die Verteilung E(λ) zu

simulieren.

h) Die Gedächtnisfreiheit

Definition. — Eine Zufallsvariable X mit positiven Werten und mit

r(x) = P{X > x} > 0

für alle x ≥ 0 heisst gedächtnisfrei, wenn die Gleichheit

(5.1)

P{X > x + y | X > y} = P{X > x}

für alle x, y ≥ 0 gilt.

Betrachten wir als Zufallsvariable X die Lebensdauer eines Individuums A.

Dann drückt die Eigenschaft aus, dass A nicht altert. Wenn nämlich A mindestens y Zeiteinheiten gelebt hat, so wird es noch weitere x Zeiteinheiten mit

der gleichen Wahrscheinlichkeit leben, die ein neugeborenes Individuum vom

gleichen Typ wie A für diese Zeitspanne hat. Die Eigenschaft (5.1) drückt also

ein Nicht-Altern oder das Fehlen eines Gedächtnisses aus (das Individuum A

erinnert sich nicht daran, gealtert zu sein). Es ist bemerkenswert, dass die

Eigenschaft einer Zufallsvariablen, gedächtnisfrei zu sein, äquivalent dazu ist,

exponential-verteilt zu sein.

Theorem 5.1. — Es sei X eine absolut stetige Zufallsvariable mit

positiven Werten und mit

r(x) = P{X > x} > 0

(x > 0).

Dann sind die beiden folgenden Aussagen äquivalent:

(a) X ist exponential-verteilt.

(b) X ist gedächtnisfrei .

Beweis. — Wir stellen zunächst fest, dass die Aussage (b) zu der Aussage

(b )

∀ x, y ≥ 0

r(x + y) = r(x)r(y)

äquivalent ist. Es genügt also, die Äquivalenz (a) ⇔ (b ) zu beweisen.

(a) ⇒ (b ). Ist X gemäss E(λ) (λ > 0) verteilt, so gilt r(x) = e−λx für

jedes x > 0 und daraus folgt (b ) unmittelbar.

(b ) ⇒ (a). Die Gleichung (b ) ist die Funktionalgleichung der Exponentialfunktion. Da die Funktion r(x) rechtsseitig stetig ist, muss sie von der

Form r(x) = eαx (α ≥ 0, x > 0) sein (cf. Aufgabe 1). Da r(x) monoton

fallend sein muss, folgt α = −λ (λ ≥ 0). Da der Fall λ = 0 nicht dem einer

Zufallsvariablen entspricht, bleibt λ > 0 übrig.

220

KAPITEL 14: DIE WICHTIGSTEN VERTEILUNGEN

Auftreten der Exponentialverteilung

1) Man nimmt mit guten Gründen an, dass die Lebensdauer X eines

Gerätes (eines Organismus, einer Glühbirne, eines radioaktiven Atomkerns,

usw.) exponential-verteilt ist. Betrachten wir den Augenblick, zu dem ein

solches Gerät in Betrieb genommen wird. Dann ist r(x) = P{X > x}

(x > 0) als die Wahrscheinlichkeit zu interpretieren, dass dieses Gerät zum

Zeitpunkt x noch funktioniert (Überlebensfunktion). Man kann auch von der

Wahrscheinlichkeit sprechen, dass man sich bis zu diesem Zeitpunkt auf das

Gerät verlassen kann (Zuverlässigkeitsfunktion). Man sollte aber im Blick

behalten, dass die Annahme, X sei exponential-verteilt, mit der Eigenschaft

des Nicht-Alterns oder der Gedächtnisfreiheit äquivalent ist. Eine Verteilung,

die die Realität solcher Beispiele etwas besser wiedergibt, ist die GammaVerteilung mit Parametern (p, λ), wobei p > 1 und λ > 0 ist (cf. Aufgabe 7).

2) Es sei (X1 , X2 ) ein Paar von unabhängigen Zufallsvariablen, von

denen jede einzelne N (0, 1)-verteilt ist. Dann ist die Zufallsvariable Y =

X12 + X22 ( χ-Quadrat mit zwei Freiheitsgraden) E(1/2)-verteilt.

6. Die (erste) Laplace-Verteilung

Definition. — Eine Zufallsvariable X mit reellen Werten folgt der ersten

Laplace Verteilung, wenn sie absolut stetig ist mit der Dichte

1 −|x|

e

(x ∈ R).

2

Diese Verteilung hat folgende Eigenschaften.

1

a) Es gilt g(u) = E[euX ] =

(−1 < u < +1).

1 − u2

Beweis. — In der Tat, für −1 < u < +1, ist

0

"

1

1 ! ∞ −(1−u)x

ux−|x|

g(u) =

e

dx =

e

dx +

e(1+u)x dx

2 R

2 0

−∞

∞

∞

!

"

1

e−(1−u)x dx +

e−(1+u)x dx

=

2 0

0

!

"

1

1

1

1

+

.

=

=

2 1−u 1+u

1 − u2

f (x) =

b) Die Zufallsvariable X hat Momente jeder positiven ganzzahligen

Ordnung; das Moment n-ter Ordnung (n ≥ 0) ist der Koeffizient von un /n!

in der Reihenentwicklung von g um den Ursprung. Aus

1

u2n

g(u) =

(−1 < u < +1)

=

(2n)!

1 − u2

(2n)!

n≥0

folgt

E[X 2n ] = (2n)! ,

E[X 2n+1 ] = 0

(n ≥ 0).

221

7. DIE CAUCHY-VERTEILUNG

1

1

1

für −1 < u < +1 und der

=

1 − u2

1−u1+u

Tatsache, dass 1/(1 − u) die erzeugende Funktion der Momente einer E(1)verteilten Zufallsvariablen Y ist, sieht man, dass die Symmetrisierte von Y

Laplace-verteilt ist.

c) Wegen g(u) =

Auftreten der ersten Laplace-Verteilung. — Diese Verteilung, die anfänglich von Laplace2 vorgeschlagen worden war, um Fehler bei Experimenten

zu beurteilen, wurde dann in der Folge von der Normalverteilung (auch

zweite Laplace-Verteilung genannt) abgelöst. Von daher ist es interessant,

die Dichten beider Verteilungen miteinander zu vergleichen.

Satz 6.1. — Es sei

2

1

f (x) = √ e−x /2 ,

2π

Dann gilt für jedes reelle x

f (x) ≤ c g(x)

g(x) =

1 −|x|

e

2

,

mit c =

(x ∈ R).

2e

.

π

Beweis. — Wegen

1

x2

1

1

x2

2

(|x| − 1) =

+ − |x| ist −

≤ − |x|

2

2

2

2

2

und daher

2

1

1

f (x) = √ e−x /2 ≤ √ e((1/2)−|x|) =

2π

2π

,

2e 1 −|x|

e

= c g(x).

π 2

7. Die Cauchy-Verteilung

Definition. — Eine Zufallsvariable X mit reellen Werten bezeichnet man

als C(0, 1)-Cauchy-verteilt, wenn sie absolut stetig ist, mit der Dichte

f (x) =

1 1

π 1 + x2

(x ∈ R).

Es folgen einige Eigenschaften der Cauchy-Verteilung.

a) Der Graph von f ähnelt dem der Dichte der Normalverteilung, aber

nähert sich der x-Achse so langsam an, dass der Erwartungswert von X nicht

existiert.

b) Bedeutung der Notation C(0, 1). — Die Zahlen 0 und 1 beziehen sich

hier nicht auf den Erwartungswert und die Standardabweichung (die beide

nicht existieren), sondern lassen sich wie folgt deuten:

2

Laplace (Pierre-Simon, marquis de). — Théorie analytique des Probabilités. — Paris,

.

222

KAPITEL 14: DIE WICHTIGSTEN VERTEILUNGEN

M = 0 ist ein Median von X; in der Tat ist P{X ≤ 0} = P{X ≥ 0} = 1/2.

Q1 = −1 bzw. Q3 = +1 sind das erste bzw. das dritte Quartil von X; es

gilt nämlich P{X ≤ −1} = P{X ≥ +1} = 1/4. Hier ist der Quartilabstand

Q3 − Q1 = 2 ein Mass für die Dispersion.

c) Die Variable X hat keine erzeugende Funktion der Momente; der

Ausdruck

1

eux

g(u) =

dx

π R 1 + x2

nimmt nämlich für kein reelles u = 0 einen endlichen Wert an. Hier greift

man also zur charakteristischen Funktion, die durch ϕ(t) = e−|t| (t ∈ R)

gegeben ist. Man stellt fest, dass sie im Punkt t = 0 nicht differenzierbar ist,

was den pathologischen Charakter der Verteilung C(0, 1) unterstreicht.

d) Es sei Y eine C(0, 1)-verteilte Zufallsvariable und es seien α, β reelle

Zahlen mit β > 0. Man bezeichnet dann die Variable X = α+βY als Cauchyverteilt mit der Verteilung C(α, β). Deren Dichte ist durch

f (x) =

1

πβ

1+

1

x−α

β

2

(x ∈ R)

gegeben. Die Parameter α und β lassen sich folgendermassen interpretieren:

M = α ist ein Median von X; ausserdem sind Q1 = α−β bzw. Q3 = α+β das

erste erste bzw. dritte Quartil von X; Q3 − Q1 = 2β ist der Quartilabstand

von X.

e) Die charakteristische Funktion der Verteilung C(α, β) ist

ϕ(t) = eitα−β|t|

(t ∈ R).

Aus der Form der charakteristischen Funktion folgt sofort, dass für ein Paar

(X1 , X2 ) von unabhängigen Zufallsvariablen mit Verteilungen C(α1 , β1 ),

C(α2 , β2 ) (α1 , α2 , β1 , β2 reell und β1 > 0, β2 > 0) ihre Summe X = X1 + X2

C(α, β)-verteilt ist mit Parametern α = α1 + α2 , β = β1 + β2 .

Diese Eigenschaft hat eine überraschende Konsequenz. Ist X eine C(α, β)verteilte Zufallsvariable und ist (X1 , . . . , Xn ) ein System von n unabhängigen

Zufallsvariablen, die alle die gleiche Verteilung wie X haben, so hat die

Summe X1 + · · · + Xn die gleiche Verteilung wie n X, d.h. das arithmetische

Mittel X = (X1 + · · · + Xn )/n hat die gleiche Verteilung wie X.

Auftreten der Cauchy-Verteilung

Satz 7.1. — Es sei V eine auf dem Intervall ]−π/2, +π/2[ gleichverteilte

Zufallsvariable. Dann ist X = tg V gemäss C(0, 1) verteilt.

7. DIE CAUCHY-VERTEILUNG

223

Beweis. — Für jedes reelle x gilt

1

1

1 π

+ Arctg x = + Arctg x ,

P{X ≤ x} = P{V ≤ Arctg x} =

π 2

2 π

1 1

.

und daraus folgt durch Ableiten f (x) =

π 1 + x2

Bemerkung. — Man zeigt problemlos, dass 1/ tg V die gleiche Verteilungsfunktion wie tg V hat. Daraus ergibt sich, dass für eine C(0, 1)-verteilte Zufallsvariable X auch die reziproke Zufallsvariable 1/X gemäss C(0, 1) verteilt

ist.

Bemerkung. — Ist Y gemäss C(0, 1) verteilt, so bezeichnet man die

Verteilung von X = |Y | in der physikalischen Literatur als LorentzVerteilung.

8. Die Gamma-Verteilung. — Wir erinnern zunächst an Eulers Definition der Gamma-Funktion. Für reelles p > 0 sei

∞

Γ(p) =

e−x xp−1 dx .

0

Diese Funktion hat die elementaren Eigenschaften:√Γ(p + 1) = p Γ(p) (p > 0);

Γ(n) = (n − 1)! (n ganz ≥ 1); Γ(1) = 1; Γ(1/2) = π.

Mit Hilfe der Gamma-Funktion kann man eine Familie von Wahrscheinlichkeitsverteilungen definieren, die von zwei positiven Parametern abhängen

und deren Anwendungsbereich ausserordentlich umfangreich ist.

Definition. — Eine Zufallsvariable X mit Werten in [0, +∞[ ist Γ(p, λ)verteilt (Gamma-verteilt mit Parametern p > 0, λ > 0), wenn sie absolut

stetig ist und als Dichte

λ −λx

e

(λx)p−1 , falls x ≥ 0;

f (x) = Γ(p)

0,

sonst

hat. Für p = 1 erkennt man in Γ(1, λ) die Verteilung E(λ) wieder.

Die Gamma-Verteilung hat folgende Eigenschaften:

p

p

a) E[X] = , Var X = 2 .

λ

λ λ p

uX

(u ∈] − ∞, λ[ ).

b) g(u) = E[e ] =

λ−u

Beweis. — In der Gleichung

λ

g(u) =

Γ(p)

0

∞

e−x(λ−u) (λx)p−1 dx

224

KAPITEL 14: DIE WICHTIGSTEN VERTEILUNGEN

ist das Integral genau für λ − u > 0 konvergent. In diesem Fall führt man die

Variablentransformation x(λ − u) = t durch und erhält

∞

λt p−1 dt

λ p 1 ∞

λ

−t

e

e−t tp−1 dt

g(u) =

=

Γ(p) 0

λ−u

λ−u

λ − u Γ(p) 0

λ p

=

.

λ−u

c) Aus der Form der erzeugenden Funktion der Momente ergibt sich die

folgende Aussage: Ist (X1 , X2 ) ein Paar von unabhängigen Zufallsvariablen

mit den Verteilungen Γ(p1 , λ) und Γ(p2 , λ) (p1 , p2 , λ > 0, mit gleichem λ),

so ist die Summe X1 + X2 gemäss Γ(p1 + p2 , λ) verteilt.

Betrachten wir nun einige Fälle der Gamma-Verteilung für spezielle Wahl

der Parameter p und λ.

1) Die Verteilung Γ(1, λ) (λ > 0) stimmt mit der Verteilung E(λ)

überein.

2) Die Verteilung Γ(n, λ) (n ganz > 0, λ > 0) stimmt mit der Verteilung

einer Summe von n unabhängigen Zufallsvariablen überein, die alle E(λ)verteilt sind.

3) Ist Y eine N (0, 1)-verteilte Zufallsvariable, so ist ihr Quadrat X = Y 2

gemäss Γ(1/2, 1/2) verteilt.

Beweis. — Die erzeugende Funktion der Momente von X ist

g(u) = E[e

uX

1

]= √

2π

+∞

uy 2 −y 2 /2

e

−∞

2

dy = √

2π

∞

e−(y

2

/2)(1−2u)

dy.

0

Das Integral auf der rechten Seite konvergiert genau dann, wenn√1 − 2u > 0

ist. In diesem Fall ergibt sich aus der Variablentransformation y 1 − 2u = t

2

1

√

g(u) = √

1 − 2u 2π

∞

0

2

e−t

/2

dt = √

1

1 − 2u

(u ∈] − ∞, 1/2[),

und dies ist gerade die erzeugende Funktion der Momente der Γ(1/2, 1/2)Verteilung.

4) Es sei (Y1 , . . . , Yn ) ein System von n unabhängigen und N (0, 1)verteilten Zufallsvariablen. Dann ist X = Y12 + · · · + Yn2 gemäss Γ(n/2, 1/2)

verteilt. Diese Verteilung wird als χ-Quadrat-Verteilung mit n Freiheitsgraden bezeichnet und mit χ2n notiert. Im Fall n = 2 handelt es sich um die

Γ(1, 1/2)-Verteilung, die ja mit der E(1/2)-Verteilung übereinstimmt. Man

erkennt auch: ist (X1 , X2 ) ein Paar von unabhängigen Zufallsvariablen, die

χ2n1 - bzw. χ2n2 -verteilt sind, wobei n1 , n2 positive ganze Zahlen sind, so ist

9. DIE BETA-VERTEILUNG

225

die Summe X1 + X2 gemäss χ2n1 +n2 verteilt (Additionssatz für χ-QuadratVerteilungen).

Auftreten der Gamma-Verteilung. — Wir haben gesehen, dass es gute

Gründe dafür gibt, anzunehmen, dass die Lebensdauer eines Organismus

(eines Gerätes, eines radioaktiven Atomkerns, usw.) exponential-verteilt ist.

Unrealistisch an dieser Hypothese ist, dass damit implizit die Abwesenheit

eines Alterungsprozesses des Organismus (des Gerätes, des radioaktiven

Atomkerns, usw.) angenommen wird. Eine realistischere Hypothese besteht

darin, dass man annimmt, die Lebensdauer sei Γ(p, λ)-verteilt, wobei p etwas

grösser als 1 ist und λ > 0 (cf. Aufgabe 7).

9. Die Beta-Verteilung. — Die Eulersche Beta-Funktion B(r, s) wird

für Paare (r, s) positiver reeller Zahlen durch das Integral

1

xr−1 (1 − x)s−1 dx

B(r, s) =

0

definiert. Sie hängt mit der Gamma-Funktion folgendermassen zusammen:

B(r, s) =

Γ(r)Γ(s)

.

Γ(r + s)

Insbesondere erkennt man B(r, s) = B(s, r).

Definition. — Eine Zufallsvariable X mit Werten in [0, 1] heisst B(r, s)verteilt (Beta-verteilt mit Parametern r > 0, s > 0), wenn sie absolut stetig

ist mit der Dichte

1

xr−1 (1 − x)s−1 I[0,1] (x).

f (x) =

B(r, s)

Für r = s = 1 stimmt die Verteilung B(1, 1) mit der Gleichverteilung auf

[0, 1] überein.

Der Erwartungswert und die Varianz sind durch

rs

r

,

Var X =

E[X] =

2

r+s

(r + s) (r + s + 1)

gegeben. Man bemerkt, dass Var X < E[X][1 − E[X] ] gilt.

Auftreten der Beta-Verteilung. — Ist (X1 , . . . , Xn ) ein System von n

unabhängigen Zufallsvariablen, die alle auf dem Intervall [0, 1] gleichverteilt

sind, dann sind die Zufallsvariablen

Y = min(X1 , . . . , Xn ),

Z = max(X1 , . . . , Xn )

B(1, n)- bzw. B(n, 1)-verteilt (cf. Aufgabe 5). Die zu diesem System gehörigen Ordnungsstatistiken sind ebenfalls Beta-verteilt.

226

KAPITEL 14: DIE WICHTIGSTEN VERTEILUNGEN

1

1 +

I]0,1[ (x),

10. — Es sei g(x) = exp −

x 1−x

g(x)

.

f (x) = g(t) dt

R

Dann ist f die Dichte einer Zufallsvariablen mit Werten in ]0, 1[, die zur

Klasse C ∞ in ganz R gehört.

11. Die Arcussinus-Verteilungen

1

1

$

(0 <

π x(1 − x)

x < 1) heisst Arcussinus-Verteilung , was sich durch die √

Tatsache erklärt,

dass ihre Verteilungsfunktion durch F(x) = (2/π) Arc sin( x) (0 < x < 1)

gegeben ist. Sie ist von grosser Bedeutung in der Fluktuationstheorie.

b) Es gibt noch andere Verteilungen, die mit dem Arcussinus zusammenhängen, die wir im Folgenden mit (A1 ), (A2 ) bezeichnen werden. Dies

kommt in der folgenden Definition zum Ausdruck.

a) Die Verteilung B(1/2, 1/2) mit der Dichte f (x) =

Definition. — Eine Zufallsvariable X mit Werten in ] − 1, +1[ heisst (A1 )verteilt, wenn sie absolut stetig ist und als Dichte die Funktion

fX (x) =

1

1

√

π 1 − x2

(−1 < x < +1)

(A1 )

hat. Die Zufallsvariable |X| hat dann Werte in ]0, 1[ und sie hat die Dichte

f|X| (x) =

1

2

√

π 1 − x2

(0 < x < +1).

(A2 )

Dies nennt man die Dichte der (A2 )-Verteilung.

Auftreten der Verteilungen (A1 ) und (A2 ). — Die folgenden Zufallsvariablen sind (A1 )-verteilt:

sin U , wenn U in ] − π/2, +π/2[ gleichverteilt ist;

cos U , wenn U in ]0, π[ gleichverteilt ist;

sin U , cos U , wenn U in ]0, 2π[ gleichverteilt ist.

Da die Verteilung (A1 ) symmetrisch ist, hat jede dieser Zufallsvariablen die

gleiche Verteilung wie die entgegengesetzte Variable.

Die folgenden Zufallsvariablen sind (A2 )-verteilt:

sin U , wenn U in ]0, π[ gleichverteilt ist;

cos U , wenn U in ] − π/2, +π/2[ gleichverteilt ist.

Diese Beispiele zeigen, wenn es denn überhaupt noch erforderlich sein sollte,

dass verschiedene Zufallsvariable die gleiche Verteilung haben können.

Ist U eine in ]0, 2π[ gleichverteilte Zufallsvariable, dann sind sowohl

X = cos U als auch Y = sin U gemäss (A1 ) verteilt. Wegen X 2 − Y 2 =

ERGÄNZUNGEN UND ÜBUNGEN

227

cos2 U − sin2 U = cos(2U ) und 2XY = 2 sin U cos U = sin(2U ) sind auch

diese Variablen (A1 )-verteilt. Wegen X 2 + Y 2 = 1 ist die Zufallsvariable

X −Y

Z =X −Y = 2

=

X +Y2

2

2

2

2

1−

Y 2

1 − tg2 U

X

Y 2 =

1 + tg2 U

1+

X

(A1 )-verteilt. Da U in ]0, 2π[ gleichverteilt ist, ist die Zufallsvariable T = tg U

Cauchy-verteilt mittels C(0, 1). Damit wurde gezeigt:

Ist T eine C(0, 1)-verteilte Zufallsvariable, so ist die

1 − T2

gemäss (A1 ) verteilt.

Zufallsvariable Z =

1 + T2

Satz 11.1. —

ERGÄNZUNGEN UND ÜBUNGEN

1. — Die einzigen Lösungen r(·) der Funktionalgleichung

r(x + y) = r(x)r(y)

(x, y ≥ 0),

die rechtsseitig stetig und nicht identisch gleich Null sind, haben die Form

r(x) = eαx (α ∈ R).

2. Die Pareto-Verteilung. — Ist Y eine mit E(λ) (λ > 0) exponentialverteilte Zufallsvariable, so heisst die Zufallsvariable X = eY Pareto-Variable

mit der Pareto-Verteilung P(λ, 1).

x−λ, falls x ≥ 1;

a) Die Überlebensfunktion von X ist durch r(x) =

1,

falls x < 1

gegeben und die Dichte ist

λ/xλ+1 , falls x ≥ 1;

f (x) =

0,

sonst.

λ

, falls λ > 1 ist, sowie E[X] = +∞, falls λ ≤ 1.

λ−1

c) Für jedes ganze k ≥ 1 berechne man E[X k ] mittels der Überlebensfunktion von X k . Man folgere daraus, dass eine Pareto-verteilte Zufallsvariable keine erzeugende Funktion der Momente hat.

b) Es gilt E[X] =

3. Die Weibull-Verteilung. — Eine reellwertige Zufallsvariable X heisst

Weibull-verteilt mit Parametern (α, λ) (α > 0, λ > 0), wenn die Variable

228

KAPITEL 14: DIE WICHTIGSTEN VERTEILUNGEN

X α mit Parameter λ > 0 exponential-verteilt ist. Ihre Überlebensfunktion

α

ist durch r(x) = e−λx für x ≥ 0 und 1 für x < 0 gegeben; ihre Dichte ist

α

f (x) = αλe−λx xα−1 für x ≥ 0 und 0 für x < 0; der Erwartungswert ist

schliesslich E[X] = (1/λ1/α )Γ(1 + (1/α)).

4. Die logistische Standard-Verteilung. — Eine reellwertige Zufallsvariable X hat die logistische Standard-Verteilung, wenn sie von der Form

X = − Log(eY − 1) ist, wobei Y eine exponential-verteilte Zufallsvariable mit Parameter 1 ist. Für jedes reelle x ist F (x) = 1/(1 + e−x ) ihre

Verteilungsfunktion, r(x) = e−x /(1 + e−x ) ihre Überlebensfunktion und

f (x) = F (x)r(x) = 12 (1 + cosh x) ihre Dichte; f (x) ist gerade. Man zeige,

dass Log f (x) konkav ist.

5. — Es sei (X1 , . . . , Xn ) ein System von n unabhängigen und im Intervall

[0, 1] gleichverteilten Zufallsvariablen. Dann sind die Zufallsvariablen Y =

min(X1 , . . . , Xn ) bzw. Z = max(X1 , . . . , Xn ) gemäss B(1, n) bzw. B(n, 1)

verteilt.

r

6. Das geometrische Mittel. — Es sei X eine Zufallsvariable mit E[ |X| ] <

+∞ für alle r im Intervall [0, r0 [ (r0 > 0). Für jedes r im offenen Intervall

r

]0, r0 [ kann man die Abweichung er = (E[ |X| ])1/r betrachten. Aus den

Ungleichungen über die verschiedenen Mittelwerte folgt, dass die Funktion

r → er monoton wachsend ist. Dann existiert also ihr Limes limr↓0 er und ist

endlich; er wird mit e0 bezeichnet und geometrisches Mittel von X genannt.

a) Man berechne das geometrische Mittel für eine N (0, 1)-verteilte

Zufallsvariable X.

b) Man berechne das geometrische Mittel für eine E(λ)-verteilte Zufallsvariable X.

c) Man zeige, dass eine C(0, 1) Cauchy-verteilte Zufallsvariable X ein

geometrisches Mittel besitzt.

d) Man konstruiere die Verteilung einer Zufallsvariablen, die kein

geometrisches Mittel besitzt.

7. — Es sei X eine absolut-stetige Zufallsvariable mit Werten in [0, +∞[

und Dichte f , für welches die Überlebensfunktion r(x) =P{X >x} für alle

x > 0 positiv ist. Als Nichterfüllungsrate (“failure rate”) von X bezeichnet man die Funktion ρ(x) = f (x)/r(x). Es sei nun X eine Γ(p, λ)-verteilte

Zufallsvariable (p, λ > 0). Man zeige, dass ihre Nichterfüllungsrate streng

monoton wachsend bzw. konstant bzw. streng monoton fallend ist, je nachdem ob p > 1 bzw. p = 1 bzw. 0 < p < 1 ist. Man beachte, dass der Fall

p = 1 der Verteilung E(λ) entspricht.

ERGÄNZUNGEN UND ÜBUNGEN

229

8. — Es sei X eine Γ(p, λ)-verteilte Zufallsvariable (p, λ > 0). Man zeige,

dass für jedes r mit p + r > 0 gilt:

E[X r ] =

1 Γ(p + r)

.

λr Γ(p)

9. a) Es sei X eine Zufallsvariable mit der ersten Laplace-Verteilung, d.h.

mit der Dichte f (x) = (1/2) exp(− |x|) (x ∈ R). Man berechne die

erzeugende Funktion von |X| und leite daraus ihre Verteilung ab.

b) Es sei (X1 , X2 ) ein Paar von unabhängigen und E(1)-verteilten Zufallsvariablen. Man berechne die erzeugenden Funktionen der Zufallsvariablen X1 + X2 , X1 − X2 , |X1 − X2 | und bestimme auf diesem

Weg die Verteilungen.

c) Die erste Laplace-Verteilung L hat als erzeugende Funktion g(u) =

1/(1 − u2 ) (|u| < 1). Diese Funktion kann man auf zwei verschiedene

Arten faktorisieren:

2

1

1

1

1

1

;

β)

α)

=

= √

.

1 − u2

1−u1+u

1 − u2

1 − u2

α) Man zeige, dass L die Symmetrisierte einer Zufallsvariablen mit

Verteilung E(1) ist.

β)

dass L die Verteilung von X1 X2 + X3 X4 (oder von

Man zeige,

X1 X2 X3 X4 ) ist, wobei (X1 , X2 , X3 , X4 ) ein System von vier unabhängigen und N (0, 1)-verteilten Zufallsvariablen ist (cf. Aufgabe 9 von

Kap. 13).

Man stösst hier auf ein Phänomen, das bei der Normalverteilung nicht

auftritt: eine Normalverteilung hat keine Faktoren , die nicht selber

Normalverteilungen sind. Dies ist ein zusätzliches Argument dafür, in

der Fehlertheorie anstelle der ersten Laplace-Verteilung die zweite Laplace-Verteilung, i.e. die Normalverteilung, zu verwenden.

10. a) Es sei (X, Y ) ein Paar von unabhängigen Zufallsvariablen mit positiven

Werten, wobei Y gemäss E(λ) exponential-verteilt ist (λ > 0). Es

bezeichne L(u) die Laplace-Transformierte von X, d.h. L(u) = E[e−uX ]

(u ≥ 0). Man zeige, dass P{Y > X} = L(λ) gilt.

b) Es sei nun (X1 , . . . , Xn , Y ) ein System von (n + 1) unabhängigen

Zufallsvariablen mit positiven Werten wobei Y gemäss E(λ) (λ > 0)

verteilt ist. Man zeige

P{Y > X1 + · · · + Xn } = P{Y > X1 } . . . P{Y > Xn }.

Spezialfall. — Für n = 2 hat man

(1)

P{Y > X1 + X2 } = P{Y > X1 }P{Y > X2 }.

230

KAPITEL 14: DIE WICHTIGSTEN VERTEILUNGEN

Wegen P{Y > X} = L(λ) > 0 ist Aussage (1) äquivalent zu

P{Y > X1 + X2 | Y > X2 } = P{Y > X1 }.

(2)

Ist also (X1 , X2 , Y ) ein System von unabhängigen Zufallsvariablen

mit positiven Werten, wobei Y exponential-verteilt ist, so bringt (2)

die Eigenschaft der Gedächtnisfreiheit in verallgemeinerter Form zum

Ausdruck.

c) Es sei (X1 , . . . , Xn ) ein System von unabhängigen Zufallsvariablen, die

alle E(λ)-verteilt

sind (λ > 0). Es sei M = max1≤k≤n Xk . Man berechne

n

P{M > k=1 Xk − M }.

11. — Es sei X eine in [0, 1] gleichverteilte Zufallsvariable. Man berechne

ihre Abweichung r-ter Ordnung er bezogen auf den Ursprung. Daraus leite

man ihr geometrisches Mittel e0 ab.

12. — Es sei (Y1 , . . . , Yn ) ein System von n unabhängigen Zufallsvariablen,

die alle N (0, 1)-verteilt sind. Die Zufallsvariable X 2 = Y12 + · · · + Yn2 ist

1/2), deren Dichte hier mit g

χ2n -verteilt, d.h. sie hat die Verteilung Γ(n/2,

$

bezeichnet sei. Die Zufallsvariable X = Y12 + · · · + Yn2 hat dann die Dichte

f (x) = 2xg(x2 ) =

1

2(n/2)−1

2

1

xn−1 e−x /2

Γ(n/2)

(x ≥ 0).

$

2

Y12 + Y22 die Dichte f (x) = xe−x /2

a) Für n = 2 hat X =

(x ≥ 0) (Rayleigh-Verteilung). Sie stimmt mit der Weibull-Verteilung mit

Parametern α = 2, λ = 1/2 überein.

,

$

2 2 −x2 /2

x e

b) Für n = 3 hat X = Y12 + Y22 + Y32 die Dichte f (x) =

π

(x ≥ 0) (Maxwell-Verteilung).

c) Die gemeinsame Dichte von (Y1 , . . . , Yn ) ist

y2 + · · · + y2 2

1

1

n

exp − 1

e−x /2 ,

h(y1 , . . . , yn ) = √

= √

n

n

2

( 2π)

( 2π)

wobei x2 = y12 + · · · + yn2 gesetzt wurde. Man erkennt, dass h(y1 , . . . , yn ) nur

von x ≥ 0 abhängt; man kann also h(x) schreiben. Bezeichne nun An (x) die

Oberfläche Sn (0, x) einer n-dimensionalen Kugel mit Radius x (x > 0). Dann

ist f (x) = An (x)h(x), d.h.

1

2(n/2)−1

2

2

1

1

xn−1 e−x /2 = An (x) n/2 n/2 e−x /2 ,

Γ(n/2)

2 π

ERGÄNZUNGEN UND ÜBUNGEN

231

und daher

An (x) = 2

π n/2 n−1

x

.

Γ(n/2)

Das Volumen Vn (x) der Kugel Bn (0, x) (x > 0) erhält man also unmittelbar:

Vn (x) =

0

x

π n/2

An (t) dt =

xn .

Γ(1 + n/2)

13. a) Es sei (X1 , X2 ) ein Paar von unabhängigen und auf [0, 1] gleichverteilten Zufallsvariablen. Man berechne die Dichte und die charakteristische

Funktion von X = X1 − X2 und von 2X.

b) Es sei (Y1 , Y2 ) ein Paar von unabhängigen und auf [−1, +1]

gleichverteilten Zufallsvariablen. Für Y = Y1 + Y2 zeige man L(Y ) = L(2X).

232

KAPITEL 14: DIE WICHTIGSTEN VERTEILUNGEN

http://www.springer.com/978-3-7643-6169-3