Skript (Teil 2) zur Vorlesung Mathematik

Werbung

Hochschule für Technik und Wirtschaft Dresden

Fakultät Informatik/Mathematik

Prof. Dr. B. Jung

Skript (Teil 2) zur Vorlesung Mathematik

für den Studiengang Produktionstechnik (053)

Stoffgebiete:

5. Integralrechnung für Funktionen einer reellen Variablen - Fortsetzung

(ab Abschnitt 5.3)

6. Differentialrechnung für Funktionen mehrerer reeller Variabler

7. Grundlagen der Wahrscheinlichkeitsrechnung

8. Wahrscheinlichkeitsverteilungen

Inhaltsverzeichnis

5

6

7

8

Integralrechnung für Funktionen einer reellen Variablen (Fortsetzung)

5.3 Einige Anwendungen der Integralrechnung . . . . . . . . . . . . . .

5.3.1 Flächeninhalt ebener Bereiche . . . . . . . . . . . . . . . . .

5.3.2 Bogenlänge einer ebenen Kurve . . . . . . . . . . . . . . . .

5.3.3 Volumen und Mantelfläche von Rotationskörpern . . . . . . .

5.3.4 Schwerpunkt homogener ebener Bereiche . . . . . . . . . . .

5.3.5 Mechanische Arbeit (Arbeit einer Kraft) . . . . . . . . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

3

3

3

4

4

5

5

Differentialrechnung für Funktionen mehrerer reeller Variabler

6.1 Einführung . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

6.2 Partielle Ableitungen . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

6.2.1 Grenzwert, Stetigkeit, partielle Ableitungen 1. Ordnung . . . . . . .

6.2.2 Partielle Ableitungen höherer Ordnung . . . . . . . . . . . . . . . .

6.2.3 Differentiation nach einem Parameter (verallgemeinerte Kettenregel)

6.3 Das totale Differential einer Funktion . . . . . . . . . . . . . . . . . . . . .

6.3.1 Definition und Anwendung in der Fehlerrechnung . . . . . . . . . .

6.3.2 Implizite Differentiation . . . . . . . . . . . . . . . . . . . . . . . .

6.4 Extrema von Funktionen mehrerer Variabler . . . . . . . . . . . . . . . . . .

6.4.1 Begriff des Extremums . . . . . . . . . . . . . . . . . . . . . . . . .

6.4.2 Extrema ohne Nebenbedingungen . . . . . . . . . . . . . . . . . . .

6.4.3 Extrema mit Nebenbedingungen . . . . . . . . . . . . . . . . . . . .

6.5 Ausgleichsrechnung . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

6.6 Weitere räumliche Koordinatensysteme . . . . . . . . . . . . . . . . . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

6

6

9

9

10

12

12

12

13

14

14

14

16

19

21

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

Grundlagen der Wahrscheinlichkeitsrechnung

7.1 Hilfsmittel aus der Kombinatorik . . . . . . . . . . . . . . . . . . . . . . .

7.2 Grundbegriffe der Wahrscheinlichkeitsrechnung . . . . . . . . . . . . . . .

7.2.1 Das Zufallsexperiment und weitere Grundbegriffe . . . . . . . . .

7.2.2 Verknüpfungen von Ereignissen . . . . . . . . . . . . . . . . . . .

7.3 Der Begriff der Wahrscheinlichkeit . . . . . . . . . . . . . . . . . . . . . .

7.3.1 Laplace-Experimente, absolute und relative Häufigkeit . . . . . . .

7.3.2 Wahrscheinlichkeitsaxiome und Schlussfolgerungen . . . . . . . .

7.3.3 Additionssatz, bedingte Wahrscheinlichkeit und Multiplikationssatz

7.3.4 Baumdiagramme, totale Wahrscheinlichkeit von Ereignissen . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

23

23

24

24

25

27

27

27

28

31

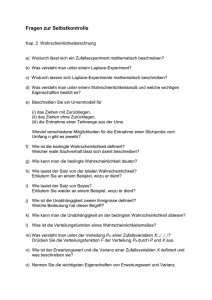

Wahrscheinlichkeitsverteilungen

8.1 Stetige und diskrete Zufallsvariable (ZV) . . . . . . . . . . . . . . .

8.2 Verteilungsfunktion einer ZV . . . . . . . . . . . . . . . . . . . . . .

8.2.1 Verteilungsfunktion einer diskreten ZV (diskrete Verteilung) .

8.2.2 Verteilungsfunktion einer stetigen ZV (stetige Verteilung) . .

8.3 Kennwerte einer Wahrscheinlichkeitsverteilung . . . . . . . . . . . .

8.4 Spezielle Wahrscheinlichkeitsverteilungen . . . . . . . . . . . . . . .

8.4.1 Binomialverteilung . . . . . . . . . . . . . . . . . . . . . . .

8.4.2 Poisson-Verteilung und Poisson-Prozess . . . . . . . . . . . .

8.4.3 Stetige Gleichverteilung (Rechteckverteilung) . . . . . . . . .

8.4.4 Dreiecksverteilung (Simpsonsche Verteilung) . . . . . . . . .

8.4.5 Betaverteilung . . . . . . . . . . . . . . . . . . . . . . . . .

8.4.6 Exponentialverteilung . . . . . . . . . . . . . . . . . . . . .

8.4.7 Weibull-Verteilung . . . . . . . . . . . . . . . . . . . . . . .

8.4.8 Gaußsche Normalverteilung . . . . . . . . . . . . . . . . . .

8.5 Aussagen über Summen und Produkte von Zufallsvariablen . . . . . .

8.5.1 Kennwerte von Summen und Produkten von Zufallsvariablen

8.5.2 Zentraler Grenzwertsatz . . . . . . . . . . . . . . . . . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

33

33

33

34

35

36

38

38

39

41

42

44

45

46

48

51

51

52

2

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

5

Integralrechnung für Funktionen einer reellen Variablen (Fortsetzung)

5.3

Einige Anwendungen der Integralrechnung

5.3.1

Flächeninhalt ebener Bereiche

Im Abschnitt 5.1.2 (siehe Skript Teil 1) wurde das bestimmte Integral als Flächeninhalt A zwischen der Kurve einer Funktion f (x) und der x-Achse in einem vorgegebenen Intervall [a, b] definiert. Dabei wurde jedoch zunächst

vorausgesetzt, dass diese Funktion in [a, b] nur positive Werte annimmt, d.h. dass ihre Kurve vollständig oberhalb

der x-Achse verläuft. Betrachtet man nun eine Funktion, deren Kurve in dem betrachteten Intervall vollständig

ˆb

unterhalb der x-Achse liegt, so würde das bestimmte Integral

f (x) dx

a

einen negativen Wert haben und daher nicht der Maßzahl des Flächeninhaltes zwischen der Funktionskurve

von f (x) und der x-Achse entsprechen. In solchen Fällen kann der Flächeninhalt wie folgt berechnet werden:

b

ˆ

ˆb

A = |f (x)| dx = f (x) dx (74)

a

a

(anschaulich: die Fläche wird an der x-Achse gespiegelt).

Im folgenden werden weitere Fälle betrachtet, wo bestimmte Integrale zur Berechnung von Flächeninhalten

angewendet werden können.

Flächeninhalt eines ebenen Bereiches, der von zwei Kurven begrenzt wird

Seien f1 (x) und f2 (x) auf dem Intervall [a, b] integrierbare Funktionen und es gelte f1 (x) ≤ f2 (x).

Der Bereich B sei gegeben durch: B = {a ≤ x ≤ b ; f1 (x) ≤ y ≤ f2 (x)} (siehe Bild 5.4).

Dann gilt für den Flächeninhalt dieses Bereiches:

ˆb

[ f2 (x) − f1 (x)] dx .

AB =

(75)

a

y 6

y 6

f2 (x)

f1 (x)

BB

B

f2 (x)

f1 (x)

-

0

a

b

-

0

x

x1

a

Bild 5.4

x2

x3 b

x

Bild 5.5

Die Voraussetzung, dass die Differenz f2 (x) − f1 (x) nicht negativ werden darf, wird nun fallengelassen. Mit

Hilfe der Formel (74) erhält man für den Fall, dass der Bereich B durch die Geraden x = a und x = b sowie die

Kurven der (auf [a, b] integrierbaren) Funktionen f1 (x) und f2 (x) begrenzt wird:

b

x

x

ˆ

ˆ1

ˆ2

(76)

AB = [ f2 (x) − f1 (x)] dx + [ f2 (x) − f1 (x)] dx + . . . + [ f2 (x) − f1 (x)] dx .

a

xn

x1

Dabei sind mit x1 , x2 , . . . , xn die Abszissen der im Intervall [a, b] gelegenen Schnittpunkte der Kurven von

f1 (x) und f2 (x) bezeichnet, siehe Bild 5.5.

Beispiel 5.16:

3

5.3.2

Bogenlänge einer ebenen Kurve

Eine weitere wichtige Anwendung der Integralrechnung ist die Berechnung der Länge einer im Intervall [a, b]

gegebenen Funktionskurve.

Berechnung der Bogenlänge einer ebenen Kurve

Seien f (x) und ihre erste Ableitung f 0 (x) im Intervall [a, b] stetig. Dann kann die Länge S

der Kurve y = f (x) nach der Formel

S=

ˆb p

1+

[f 0 (x)]2 dx

ˆb q

=

1 + y 0 2 dx

a

(77)

a

berechnet werden.

Falls die Kurve in Parameterdarstellung: x = x(t), y = y(t), t1 ≤ t ≤ t2 (siehe dazu Abschnitt 3.2.1

im Skript Teil 1) gegeben ist, gilt:

S=

ˆt2 p

[ẋ(t)]2

+

[ẏ(t)]2 dt

ˆt2 p

=

ẋ2 + ẏ 2 dt ,

t1

(78)

t1

wobei x(t) und y(t) sowie ihre ersten Ableitungen als stetig vorausgesetzt werden und außerdem

[ẋ(t)]2 + [ẏ(t)]2 6= 0 für alle t ∈ [t1 , t2 ] gelten muss.

(Für eine Herleitung dieser Formeln sei auf die folgende Literaturstelle verwiesen: A. F ETZER , H. F R ÄNKEL.

Mathematik 2: Lehrbuch für ingenieurwissenschaftliche Studiengänge, 6. Auflage, S. 22-24.)

Beispiel 5.17:

Ergänzend sei bemerkt, dass die Integrale in (77) bzw. (78) auf Grund des auftretenden Wurzelausdrucks häufig

nicht auf elementarem Weg lösbar sind. Als Ausweg dienen dann die im Abschnitt 5.2.4 (siehe Skript Teil 1)

eingeführten Methoden zur numerischen Integration.

5.3.3

Volumen und Mantelfläche von Rotationskörpern

y 6

Während bei sehr einfachen Rotationskörpern (wie z.B. Kreiszylinder, Kreiskegel, Kreiskegelstumpf) eine Berechnung des

Volumens und der Mantelfläche mittels elementarer Formeln

möglich ist, muss bei allgemeineren rotationssymmetrischen

Körpern auf die Integralrechnung zurückgegriffen werden.

Zunächst wird die Situation betrachtet, dass die Kurve einer

Funktion y = f (x) in einem gewissen Intervall um die x-Achse

rotiert (vgl. Bild 5.6).

f (x)

a

b

x

Bild 5.6

Berechnung des Volumens eines Rotationskörpers

Durch Rotation der Fläche zwischen der Kurve der Funktion y = f (x) und den Geraden x = a sowie

x = b um die x-Achse entsteht ein Rotationskörper mit dem Volumen

ˆb

ˆb

[f (x)]2 dx = π ·

Vx = π ·

a

y 2 dx .

(79)

a

Berechnung der Mantelfläche eines Rotationskörpers

Die Mantelfläche des entstehenden Rotationskörpers lässt sich mit Hilfe der folgenden Formel berechnen:

ˆb

AM x = 2π ·

ˆ

q

p

f (x) · 1 + [f 0 (x)]2 dx = 2π · y · 1 + y 0 2 dx .

b

a

a

4

(80)

Eine Herleitung der genannten Formeln findet man z.B. in: L. PAPULA . Mathematik für Ingenieure und Naturwissenschaftler (Band 1), 12. Auflage, S. 513 - 514 und S. 521 - 522.

Beispiel 5.18:

Bemerkung:

Wenn eine Fläche, welche von der Kurve x = g(y) und den Geraden y = c sowie y = d begrenzt wird, um die

y-Achse rotiert, dann entsteht ein Rotationskörper mit dem Volumen

ˆd

ˆd

[ g(y)]2 dy = π ·

Vy = π ·

c

x2 dy .

(81)

c

Die Mantelfläche dieses Rotationskörpers kann nach der Formel

ˆd

AM y = 2π ·

ˆ

p

p

g(y) · 1 + [ g 0 (y)]2 dy = 2π · x · 1 + x0 2 dy

d

(82)

c

c

berechnet werden.

Wenn die Gleichung der rotierenden Kurve in der Form y = f (x) vorliegt, dann muss zunächst eine Auflösung

dieser Gleichung nach x vorgenommen werden, um die Formeln (81) und (82) anwenden zu können.

5.3.4

Schwerpunkt homogener ebener Bereiche

Im weiteren wird vorausgesetzt, dass die betrachteten Bereiche homogen sind, d.h. eine konstante Dichte besitzen. Dann fällt der Massenschwerpunkt mit dem Flächenschwerpunkt (d.h. dem geometrischen Schwerpunkt)

zusammen.

Berechnung des Schwerpunktes eines homogenen ebenen Bereiches

Der ebene Bereich B sei gegeben durch: B = {a ≤ x ≤ b ; f1 (x) ≤ y ≤ f2 (x)} , wobei auf dem

gesamten Intervall [a, b] gelte: f1 (x) ≤ f2 (x) (siehe dazu auch Bild 5.4).

Die Koordinaten xS und yS des Schwerpunktes dieses Bereiches können nach den folgenden Formeln

berechnet werden:

1

xS =

·

AB

ˆb

x · [ f2 (x) − f1 (x)] dx ,

a

1

·

yS =

2AB

ˆb

[ (f2 (x))2 − (f1 (x))2 ] dx .

(83)

a

Dabei bezeichnet AB den Flächeninhalt des Bereiches B, welcher gemäß (75) zu ermitteln ist.

Beispiel 5.19:

5.3.5

Mechanische Arbeit (Arbeit einer Kraft)

Die Berechnung der von einer Kraft verrichteten Arbeit ist auf elementare Weise möglich, wenn es sich um eine

konstante Kraft handelt, die entlang eines geradlinigen Weges wirkt. Ist die Kraft jedoch ortsabhängig (bzw.

wegabhängig), erfolgt die Berechnung der geleisteten Arbeit mit Hilfe der Integralrechnung.

Berechnung der mechanischen Arbeit

Die Kraft F~ wirke in Richtung eines geradlinigen Weges und ihr Betrag F sei darstellbar als eine stetige

Funktion F = F (x) (x: Abstand des Angriffspunktes der Kraft von einem festen Punkt 0). Dann gilt für

die Arbeit, die von der Kraft auf dem Weg von x = a nach x = b geleistet wird:

ˆb

W = F (x) dx .

(84)

a

(Für eine Herleitung dieser Formel sei auf die folgende Literaturstelle verwiesen: A. F ETZER , H. F R ÄNKEL.

Mathematik 2: Lehrbuch für ingenieurwissenschaftliche Studiengänge, 6. Auflage, S. 82-83.)

Beispiel 5.20:

5

6

Differentialrechnung für Funktionen mehrerer reeller Variabler

6.1

Einführung

In zahlreichen physikalischen und technischen Anwendungen treten Größen auf, die von mehr als einer Variablen abhängen. Das Ziel dieses Kapitels ist es, den Begriff der Funktion entsprechend zu erweitern sowie die

Differentialrechnung für Funktionen mehrerer Variabler kennenzulernen.

Beispiel 6.1:

a) Wurfweite beim schrägen Wurf

Ein Körper wird mit der Geschwindigkeit v0 unter einem Winkel α abgeworfen. Die Wurfweite sW hängt

sowohl von der Abwurfgeschwindigkeit v0 als auch von dem Abwurfwinkel α ab. Es besteht der funktionale

Zusammenhang:

sW = sW (v0 , α) =

v02 · sin(2α)

g

(g : Erdbeschleunigung).

b) Gesamtwiderstand eines Stromkreises

Der Gesamtwiderstand Rges des hier dargestellten Stromkreises

hängt von den drei Widerständen R1 , R2 und R3 ab. Es besteht

der funktionale Zusammenhang:

Rges = Rges (R1 , R2 , R3 ) = R1 +

R2 · R3

.

R2 + R3

R3

R1

R2

c) Produktionsfunktionen1

Das Produktionsergebnis x (Output; hier zunächst bezogen auf eine Ein-Produkt-Fertigung) hängt von den

Einsatzmengen verschiedener Produktionsfaktoren (Input; z.B. sind dies Werkstoffe, Betriebsmittel, Arbeitsleistung) ab. Dieser Zusammenhang kann durch die Gleichung

x = f (r1 , r2 , . . . , rn )

beschrieben werden, wobei f als Produktionsfunktion bezeichnet wird und r1 , r2 , . . . , rn die Einsatzmengen

der Produktionsfaktoren sind. Im Beispiel 6.3c) wird eine konkrete Produktionsfunktion betrachtet.

Definition 6.1:

Funktionen von n reellen Variablen sind Abbildungen vom Raum Rn in die Menge der reellen Zahlen, d.h.

einem Vektor ~x = (x1 , x2 , . . . , xn ) wird in eindeutiger Weise eine Zahl y = f (~x) = f (x1 , x2 , . . . , xn )

zugeordnet. Dabei gelten die folgenden Bezeichnungen:

x1 , x2 , . . . , xn :

unabhängige Variable

f (x1 , x2 , . . . , xn ) : Funktionswert

Es ist zu beachten, dass im Zusammenhang mit Funktionen mehrerer reeller Variabler die Vektoren aus dem

Raum Rn stets als Zeilenvektoren geschrieben werden (im Abschnitt 2.6, siehe Skript Teil 1, wurden Vektoren

aus dem Raum Rn als Spaltenvektoren eingeführt).

Definitionsbereich und Wertebereich von Funktionen mehrerer reeller Variabler

Sei f (~x) = f (x1 , x2 , . . . , xn ) eine Funktion mehrerer reeller Variabler.

Der Definitionsbereich Df der Funktion f umfasst die Menge aller Vektoren ~x = (x1 , x2 , . . . , xn ),

denen durch f ein Funktionswert y zugeordnet werden kann (vgl. Definition 6.1).

Unter dem Wertebereich Wf der Funktion f versteht man die Menge derjenigen Werte y ∈ R, für die

es (mindestens) ein ~x gibt mit y = f (~x).

Beispiel 6.2:

1

Quelle: J. T IETZE . Einführung in die angewandte Wirtschaftsmathematik, 14. Auflage.

6

Von der bisher verwendeten Bezeichnungsweise: f (x1 , x2 , . . . , xn ) für eine Funktion von n reellen Variablen

wird häufig abgewichen, wenn n = 2 oder n = 3 gilt.

Schreibweise für Funktionen von zwei oder drei reellen Variablen (n = 2 oder n = 3)

Für Funktionen mit zwei unabhängigen Variablen wird anstelle von y = f (x1 , x2 ) häufig z = f (x, y)

geschrieben.

Für Funktionen mit drei unabhängigen Variablen ist anstatt von y = f (x1 , x2 , x3 ) auch die Schreibweise

u = f (x, y, z) üblich.

Im weiteren sollen verschiedene Möglichkeiten zur Darstellung von Funktionen zweier reeller Variabler aufgezeigt werden.

Darstellungsformen von Funktionen zweier unabhängiger Variabler:

1) Funktionsgleichung

Bei der Darstellung in Form einer Funktionsgleichung (siehe dazu Definition 6.1) wird noch die folgende

Unterscheidung getroffen:

explizite Darstellung (d.h. aufgelöst nach z): z = f (x, y),

z.B.: z = 2x + y − 4 oder z = x2 − y 2

implizite Darstellung:

F (x, y, z) = 0,

z.B.: x2 + y 2 + z 2 − 1 = 0 oder 6x + y − z + 5 = 0

2) Funktionstabelle (Wertetabelle)

Die Wertetabelle einer Funktion von zwei Variablen hat die Gestalt einer Matrix, da jeweils Paare (x, y)

gebildet werden und dann der entsprechende Funktionswert zugeordnet wird. Als Beispiel wird die Wertetabelle der Funktion z = 2x + y − 4 für x = 0, 1, 2 und y = 0, 1, 2 angegeben.

y

0

1

2

-4

-2

0

-3

-1

1

-2

0

2

x

0

1

2

3) Darstellung als Fläche im Raum R3

Während die Veranschaulichung von Funktionen einer reellen Variablen in einem ebenen kartesischen Koordinatensystem erfolgt, muss zur grafischen Darstellung von Funktionen zweier reeller Variabler ein räumliches kartesisches Koordinatensystem verwendet werden. Der Funktionswert z besitzt dann die Bedeutung

einer Höhenkoordinate, und das Bild der Funktion ist eine Fläche im Raum R3 .

Beispiel 6.3:

a) Der linearen Funktion ax+by+cz +d = 0 (a, b, c, d ∈ R) entspricht im räumlichen Koordinatensystem

eine Ebene.

b) Grafische Darstellung der Funktion

z = f (x, y) = −16xy(1 − x)(1 − y)

für 0 ≤ x ≤ 1, 0 ≤ y ≤ 1

f (x, y)

y

7

x

c) Grafische Darstellung der Funktion

z = f (x, y) = x0.25 · y 0.75

für 1 ≤ x ≤ 10, 1 ≤ y ≤ 10

f (x, y)

y

x

Funktionen vom Typ f (x, y) = xα · y β (oder mit anderen Bezeichnungen der Variablen) werden z.B. in

der Produktionstheorie angewendet. Ein bekanntes Beispiel ist die Cobb-Douglas-Funktion:

P = f (A, K) = c · Aα · K β mit geeigneten positiven Parametern c, α und β (meistens gilt:

α + β = 1). Mit P wird das Produktionsergebnis (Output) bezeichnet, A bzw. K sind die Arbeitskräfte

bzw. das für Produktionsmittel aufgewendete Kapital (Input).

4) Veranschaulichung mit Hilfe von Niveaulinien

Die Menge der Punkte in der (x, y)-Ebene, an denen eine Funktion f (x, y) einen konstanten Wert

f (x, y) = c hat, heißt Niveaulinie von f . Eine Niveaulinie entsteht als Projektion der Schnittkurve der Ebene z = c mit der Fläche z = f (x, y) in die (x, y)-Ebene.

Beispiel 6.4:

Durch Rotation der Normalparabel z = x2 um die z-Achse entsteht ein Rotationsparaboloid (siehe Bild 6.1a)).

Die Mantelfläche dieses Rotationsparaboloids hat die Funktionsgleichung

z = f (x, y) = x2 + y 2 .

Die Niveaulinien dieses Rotationsparaboloids sind:

z = f (x, y) = const. = c ,

d.h. x2 + y 2 = c .

√

⇒ Für jeden positiven Wert des Parameters c erhält man als Niveaulinie einen Kreis mit dem Radius c

um den Koordinatenursprung. Bild 6.1b) zeigt einige Niveaulinien der Funktion z = f (x, y) = x2 + y 2 .

y6

z

6

q

Niveaulinien für z = 1,

z = 2, z = 3, z = 4, z = 5

z = x2 + y 2

q

H

H

x

H Schnittkurve der Ebene

z = c mit der Fläche

z = x2 + y 2

x

)

y

Bild 6.1a)

Bild 6.1b)

Bemerkung:

Bei einer Funktion, die von 3 Variablen abhängt, sind durch die Gleichung f (x, y, z) = const. = c die

Niveauflächen gegeben.

8

6.2

Partielle Ableitungen

6.2.1

Grenzwert, Stetigkeit, partielle Ableitungen 1. Ordnung

Zunächst werden die Begriffe Grenzwert“ und Stetigkeit“ für Funktionen mehrerer reeller Variabler formuliert.

”

”

Dabei werden Funktionen von zwei reellen Variablen betrachtet, d.h. z = f (x, y). Die Aussagen lassen sich

sinngemäß auf Funktionen von n Variablen (n ≥ 3) übertragen.

Bei der Untersuchung von Grenzwerten von einer Funktion einer reellen Variablen2 (d.h. y = f (x)) wurde das

Verhalten der Funktionswerte bei Annäherung an eine Stelle x0 des Definitionsbereiches von f (x) untersucht.

Jetzt muss das Verhalten der Funktionswerte bei Annäherung an eine Stelle (x0 , y0 ) ∈ Df für z = f (x, y)

betrachtet werden.

Es gilt: limn→∞ (xn , yn ) = (x0 , y0 ), wenn zugleich die Zahlenfolge {xn } gegen x0 und die Zahlenfolge {yn } gegen y0 strebt. Dabei ist es nicht von Bedeutung, welche Folgen {(xn , yn )} das Variablenpaar

durchläuft (anschaulich: eine Folge von Punkten mit den Koordinaten (xn , yn ) in der (x, y)-Ebene kann

sich entlang verschiedener Kurven dem Punkt (x0 , y0 ) nähern).

Damit kann der Begriff des Grenzwertes für eine Funktion zweier reeller Variabler eingeführt werden.

Definition 6.2: Eine Funktion z = f (x, y) sei in einer Umgebung der Stelle (x0 , y0 ) definiert.

Gilt dann für jede Folge {(xn , yn )}, (xn , yn ) ∈ Df , mit limn→∞ (xn , yn ) = (x0 , y0 ) :

lim f (xn , yn ) = g ,

n→∞

dann heißt g der Grenzwert von f an der Stelle (x0 , y0 ).

Schreibweise: lim(x,y)→(x0 ,y0 ) f (x, y) = g

Mit Hilfe des Grenzwertbegriffes kann nun auch die Stetigkeit einer Funktion zweier reeller Variabler definiert

werden.

Definition 6.3: Eine in (x0 , y0 ) und in einer gewissen Umgebung von (x0 , y0 ) definierte Funktion

z = f (x, y) ist an der Stelle (x0 , y0 ) stetig, wenn der Grenzwert lim(x,y)→(x0 ,y0 ) f (x, y) existiert und

lim(x,y)→(x0 ,y0 ) f (x, y) = f (x0 , y0 ) gilt. Eine Funktion, die an jeder Stelle ihres Definititionsbereiches

stetig ist, wird als stetige Funktion bezeichnet.

Beispiel 6.5:

Die bereits im Beispiel 6.4 betrachtete Funktion z = f (x, y) = x2 + y 2 ist eine stetige Funktion.

Beispiel 6.6: (Beispiel für eine Funktion, die an einer Stelle unstetig ist)

4xy

für (x, y) 6= (0, 0)

x2 + y 2

Sei f (x, y) =

0

für (x, y) = (0, 0) .

Diese Funktion ist in (0, 0) zwar definiert, aber

nicht stetig, da sie dort keinen Grenzwert hat.

Um diese Aussage zu begründen, wird die Funktion f (x, y) zunächst längs der x-Achse (d.h. für

y = 0) betrachtet. Dort gilt:

f (x, 0) =

f (x, y)

4·x·0

= 0 für x 6= 0 ⇒ lim f (x, 0) = 0 .

x→0

x2 + 0 2

Längs der Geraden x = y gilt jedoch:

x

4·x·x

f (x, x) = 2

= 2 für x 6= 0 ⇒ lim f (x, x) = 2 .

x→0

x + x2

2

siehe Abschnitt 3.3.1 im Skript Teil 1

9

y

Nun soll der Begriff der Ableitung auf Funktionen mehrerer reeller Variabler übertragen werden. Dies führt zur

Definition der partiellen Ableitung.

Definition 6.4: Unter den partiellen Ableitungen 1. Ordnung einer Funktion z = f (x, y) an der Stelle

(x0 , y0 ) versteht man die folgenden Grenzwerte (falls sie existieren):

∂f

f (x0 + ∆x, y0 ) − f (x0 , y0 )

(x0 , y0 ) = fx (x0 , y0 ) = lim

∆x→0

∂x

∆x

(85)

(partielle Ableitung 1. Ordnung nach x)

∂f

f (x0 , y0 + ∆y) − f (x0 , y0 )

(x0 , y0 ) = fy (x0 , y0 ) = lim

∆y→0

∂y

∆y

(86)

(partielle Ableitung 1. Ordnung nach y).

Es sei darauf hingewiesen, dass bei Funktionen von mehreren reellen Variablen für die Ableitungen niemals das

Symbol d“, sondern immer das Symbol ∂ “ (wie in Definition 6.4) zu verwenden ist.

”

”

Im Abschnitt 4.1.1 (siehe Skript Teil 1) wurde die erste Ableitung einer Funktion von einer reellen Variablen als

Anstieg der Kurventangente in dem betreffenden Kurvenpunkt gedeutet. Auch die partiellen Ableitungen einer

Funktion z = f (x, y) lassen eine geometrische Deutung zu. Die partielle Ableitung dieser Funktion nach der

Variablen x (bzw. y) entspricht dem Anstieg der Flächentangente im Flächenpunkt P (x0 , y0 , z0 ) in der positiven

x- (bzw. y-) Richtung.

Berechnung der partiellen Ableitungen 1. Ordnung einer Funktion f (x, y)

Berechnung der Ableitung

∂f

: Die Variable y wird als Konstante betrachtet und dann werden die

∂x

Ableitungsregeln für Funktionen einer reellen Variablen angewendet.

Berechnung der Ableitung

∂f

: Die Variable x wird als Konstante betrachtet und dann werden die

∂y

Ableitungsregeln für Funktionen einer reellen Variablen angewendet.

Beispiel 6.7:

Völlig analog zu Definition 6.4 können die partiellen Ableitungen 1. Ordnung für eine Funktion von n reellen

Variablen (d.h. für f (x1 , x2 , . . . , xn )) eingeführt werden. Bei der Berechnung der partiellen Ableitung fxi

(i = 1, 2, . . . , n) werden alle Variablen außer xi als Konstante betrachtet, dann kommen wieder die Ableitungsregeln für Funktionen einer reellen Variablen zur Anwendung.

Beispiel 6.8:

Partielle Differenzierbarkeit

Eine Funktion f (x1 , x2 , . . . , xn ) heißt partiell differenzierbar, wenn alle partiellen Ableitungen fxi

(i = 1, 2, . . . , n) existieren.

Ergänzung zu Beispiel 6.8:

Die in diesem Beispiel betrachteten Funktionen sind partiell differenzierbar, da jeweils die partiellen Ableitungen

nach allen Variablen existieren.

6.2.2

Partielle Ableitungen höherer Ordnung

Falls die partiellen Ableitungen fxi einer Funktion f (x1 , x2 , . . . , xn ) nochmals differenzierbar sind, kann man

partielle Ableitungen 2. Ordnung bilden (und, falls möglich, durch weitere Differentiation: partielle Ableitungen

k-ter Ordnung, k ≥ 3).

10

Die partiellen Ableitungen 2. Ordnung einer Funktion f (x, y)

∂ ∂f

∂2f

∂ ∂f

∂2f

=

f

=

=

fxx =

yy

∂x2

∂x ∂x

∂y 2

∂y ∂y

∂2f

∂2f

∂ ∂f

∂ ∂f

fxy =

fyx =

=

=

∂x∂y

∂y ∂x

∂y∂x

∂x ∂y

Für Funktionen f (x1 , x2 , . . . , xn ) gilt analog: fxi xj =

∂2f

∂

=

∂xi ∂xj

∂xj

∂f

.

∂xi

Beispiel 6.9:

Bei der Bildung partieller Ableitungen 3. Ordnung gibt es für eine Funktion zweier Variabler bereits 23 = 8

Möglichkeiten. Aus diesem Grund wird nur ein Beispiel für eine partielle Ableitung 3. Ordnung aufgeführt:

∂3f

∂

fxxy = 2 =

∂x ∂y

∂y

∂2f

∂x2

Nun soll noch eine weitere wichtige Eigenschaft von partiellen Ableitungen höherer Ordnung behandelt werden.

Die Ableitungen der im Beispiel 6.9 betrachteten Funktion besitzen offensichtlich die Eigenschaft: fxy = fyx .

Dies ist kein Zufall, denn es gilt der folgende Satz.

Satz von Schwarz (Vertauschbarkeit der Differentiationsreihenfolge)

Bei partiellen Ableitungen k-ter Ordnung (k ≥ 2) darf die Reihenfolge der einzelnen Differentiationsschritte

vertauscht werden, wenn die partiellen Ableitungen stetige Funktionen sind.

Beispiel 6.10:

Sei f (x, y) = x3 sin y + e2y cos x.

11

6.2.3

Differentiation nach einem Parameter (verallgemeinerte Kettenregel)

Sei z = f (x, y) eine Funktion der beiden unabhängigen Variablen x und y, die wiederum von einem reellen

Parameter abhängen: x = x(t), y = y(t) (t1 ≤ t ≤ t2 ). Durch Einsetzen dieser Parametergleichungen in die

Funktionsgleichung z = f (x, y) entsteht eine zusammengesetzte (verkettete) Funktion des Parameters t:

z = z(t) = f (x(t), y(t)) .

(87)

Die Berechnung der Ableitung dieser Funktion nach der Variablen t erfolgt mit Hilfe der verallgemeinerten

Kettenregel.

Verallgemeinerte Kettenregel

Die Funktionen x(t) und y(t) seien stetig differenzierbar nach der Variablen t und die Funktion f (x, y)

besitze stetige partielle Ableitungen nach den Variablen x und y. Dann ist die Funktion z aus (87) stetig

differenzierbar nach t und ihre Ableitung ż =

ż =

dz

dt

wird wie folgt berechnet:

dz

∂z dx ∂z dy

=

·

+

·

= zx · ẋ + zy · ẏ

dt

∂x dt

∂y dt

(88)

Es ist zu beachten, dass in der Formel (88) die Ableitungen von z nach x bzw. y als partielle Ableitungen

geschrieben werden, die Ableitungen von x bzw. y nach t jedoch als gewöhnliche“ Ableitungen (da die Funk”

tionen x und y jeweils nur von einer Variablen, nämlich t, abhängen).

Die verallgemeinerte Kettenregel wird z.B. dann angewendet, wenn die Ableitung einer Funktion längs einer in

Parameterdarstellung gegebenen Kurve zu berechnen ist.

Beispiel 6.11:

Bemerkung:

Die Aussage von Formel (88) kann auf Funktionen von n reellen Variablen verallgemeinert werden. Die VariadF

blen x1 , x2 , . . . , xn seien selbst wieder Funktionen des reellen Parameters t. Dann gilt für die Ableitung

dt

der Funktion F (t) = f (x1 (t), x2 (t), . . . , xn (t)):

dF

∂f dx1

∂f dx2

∂f dxn

=

·

+

·

+ ... +

·

.

dt

∂x1 dt

∂x2 dt

∂xn dt

6.3

6.3.1

Das totale Differential einer Funktion

Definition und Anwendung in der Fehlerrechnung

Definition 6.5: Unter dem totalen (oder vollständigen) Differential einer partiell differenzierbaren Funktion f (x1 , x2 , . . . , xn ) versteht man den Ausdruck

df =

∂f

∂f

∂f

dx1 +

dx2 + . . . +

dxn = fx1 dx1 + fx2 dx2 + . . . + fxn dxn .

∂x1

∂x2

∂xn

(89)

Mit Hilfe des totalen Differentials kann geschätzt werden, wie sich eine geringfügige Änderung der unabhängigen Variablen x1 , x2 , . . . , xn auf eine daraus abgeleitete Größe auswirkt. Seien ∆x1 , ∆x2 , . . . , ∆xn die

(sehr kleinen) Änderungen der Argumente x1 , x2 , . . . , xn der Funktion f , dann kann ∆x1 = dx1 ,

∆x2 = dx2 , . . . , ∆xn = dxn gewählt werden, und es gilt: ∆f ≈ df , wobei ∆f die Änderung des Funktionswertes von f bezeichnet.

Beispiel 6.12:

12

Die soeben beschriebene Eigenschaft des totalen Differentials begründet dessen Anwendung in der Fehlerrechnung, da die geringfügigen Änderungen“ der Argumente x1 , x2 , . . . , xn auch Messfehler sein können. Es gilt

”

die folgende Aussage:

Lineares Fehlerfortpflanzungsgesetz

Wird eine Größe y berechnet aus y = f (x1 , x2 , . . . , xn ) und sind die Eingangsgrößen x1 , x2 , . . . , xn

mit den Fehlern ∆x1 , ∆x2 , . . . , ∆xn behaftet, so lässt sich der Fehler ∆y der abgeleiteten Größe y

wie folgt schätzen:

|∆y| ≤ |fx1 | · |∆x1 | + |fx2 | · |∆x2 | + . . . + |fxn | · |∆xn | .

(90)

Beispiel 6.13:

Beispiel 6.14:

Bemerkung:

Mit Hilfe der Ungleichung (90) wird der maximale absolute Fehler berechnet (rechte Seite dieser Ungleichung).

Es ist aber auch möglich, den mittleren absoluten Fehler zu ermitteln. Dieser sei mit ∆ym bezeichnet, dann gilt:

p

|∆ym | = (fx1 · ∆x1 )2 + . . . + (fxn · ∆xn )2 .

6.3.2

Implizite Differentiation

Eine Funktionskurve sei in der impliziten Darstellung F (x, y) = 0 gegeben (vgl. Abschnitt 6.1). Unter den

Voraussetzungen, dass in der Umgebung eines Punktes P (x, y) stetige partielle Ableitungen Fx und Fy existieren

sowie Fy (x, y) 6= 0 gilt, kann die Ableitung y 0 in diesem Punkt nach der folgenden Formel berechnet werden:

dy

Fx (x, y)

= y0 = −

.

dx

Fy (x, y)

(91)

Begründung für die Formel (91):

Unter den gegebenen Voraussetzungen beschreibt die implizite Darstellung F (x, y) = 0 in der Umgebung des

betrachteten Punktes P (x, y) tatsächlich eine differenzierbare Funktion f : y = f (x). Die Funktionsgleichung

F (x, y) = 0 wird nun als Sonderfall der Funktionsgleichung z = F (x, y) mit z = 0 betrachtet. Für das totale

Differential dz gilt dann einerseits dz = 0 und andererseits (vgl. Formel (89)): dz = Fx (x, y)dx + Fy (x, y)dy.

Nach Gleichsetzen und Umstellen ergibt sich die Beziehung (91).

Die Bedeutung der Formel (91) liegt darin, dass die Differentiation einer Funktion auch dann möglich ist, wenn

diese nicht in der expliziten Form y = f (x) darstellbar ist bzw. die Auflösung nach y sehr aufwändig wäre.

So kann z.B. der Anstieg einer Kurventangente auch dann berechnet werden, wenn die Funktion nicht in der

expliziten Darstellung vorliegt. Eine solche Situation wird in dem folgenden Beispiel betrachtet.

Beispiel 6.15:

y

6

-

x

13

6.4

6.4.1

Extrema von Funktionen mehrerer Variabler

Begriff des Extremums

Definition 6.6: Eine Funktion f (x1 , x2 , . . . , xn ) besitzt an der Stelle (x∗1 , x∗2 , . . . , x∗n ) ein lokales

Maximum (bzw. ein lokales Minimum), wenn in einer gewissen Umgebung dieser Stelle stets gilt:

f (x∗1 , x∗2 , . . . , x∗n ) > f (x1 , x2 , . . . , xn )

(bzw. f (x∗1 , x∗2 , . . . , x∗n ) < f (x1 , x2 , . . . , xn )), (92)

wobei (x1 , x2 , . . . , xn ) 6= (x∗1 , x∗2 , . . . , x∗n ).

Wenn die Ungleichung (92) an jeder Stelle (x1 , x2 , . . . , xn ) des Definitionsbereiches Df erfüllt ist, dann

liegt ein globales Maximum (bzw. ein globales Minimum) vor.

Maxima und Minima werden unter dem Begriff Extrema“ zusammengefasst.

”

Für eine Funktion zweier Variabler (d.h. z = f (x, y)), welche als Fläche im Raum R3 dargestellt werden kann,

ist die folgende anschauliche Interpretation möglich: einem lokalen Maximum (bzw. Minimum) entspricht ein

Punkt dieser Fläche, welcher höher“ (bzw. tiefer“) liegt als alle anderen in der Umgebung befindlichen Punkte

”

”

der Fläche.

Beispielsweise besitzt die im Bild 6.1a) (siehe Abschnitt 6.1) dargestellte Funktion z = x2 + y 2 an der Stelle (0, 0) ein lokales Minimum mit dem Funktionswert z = 0. Die Überlegung, dass x2 + y 2 ≥ 0 für alle

(x, y) ∈ R2 gilt und insbesondere x2 + y 2 = 0 nur für x = y = 0 möglich ist, führt zu der Aussage, dass an der

Stelle (0, 0) sogar ein globales Minimum der betrachteten Funktion vorhanden ist.

Allgemeine Verfahren zur Berechnung lokaler Extrema werden in den nachfolgenden Abschnitten erläutert.

Dabei werden ausschließlich Funktionen zweier Variabler, d.h. z = f (x, y), betrachtet.

6.4.2

Extrema ohne Nebenbedingungen

Wie auch bei Funktionen einer reellen Variablen (siehe Abschnitt 4.2.2 im Skript Teil 1) werden notwendige und

hinreichende Bedingungen für das Vorhandensein lokaler Extrema bei Funktionen mehrerer reeller Variabler

formuliert.

Notwendige Bedingungen für das Vorliegen eines lokalen Extremums

Die notwendigen Bedingungen für das Vorliegen eines lokalen Extremums einer partiell differenzierbaren

Funktion f (x, y) an der Stelle (x∗ , y ∗ ) lauten:

fx (x∗ , y ∗ ) = 0 und

fy (x∗ , y ∗ ) = 0 .

(93)

Eine Stelle, für die die Bedingungen (93) erfüllt sind, wird als stationäre Stelle bezeichnet.

Die Bedingungen (93) können wie folgt anschaulich interpretiert werden: ein lokales Extremum einer Funktion

zweier Variabler kann nur dort vorliegen, wo die Tangentialebene3 an die Fläche z = f (x, y) parallel zur (x, y)Ebene verläuft. Die genannten Bedingungen sind jedoch nicht hinreichend, wie das folgende Beispiel zeigt.

Beispiel 6.16:

Für die Funktion z = f (x, y) = x2 − y 2 (siehe Bild 6.2)

gilt zwar: fx (0, 0) = fy (0, 0) = 0, aber an der Stelle (0, 0)

liegt kein lokales Extremum vor.

Begründung: Es werden die Werte der Funktion f in der

Umgebung der Stelle (0, 0) betrachtet, und zwar speziell:

f (0, y) (d.h. x = 0 fest, y 6= 0 variabel). Es gilt:

f (0, y) = 02 − y 2 = −y 2 < 0 ⇒ wegen f (0, 0) = 0

kann an der Stelle (0, 0) kein lokales Minimum vorliegen.

Andererseits ist f (x, 0) = x2 − 02 = x2 > 0 ⇒ an der

Stelle (0, 0) kann somit auch kein lokales Maximum vorliegen. An der Stelle (0, 0) liegt eine Sattelstelle vor. Die

Fläche z = x2 − y 2 besitzt die Form eines Sattels und

Bild 6.2

wird daher auch als Sattelfläche bezeichnet.

3

Die Tangentialebene an die Fläche z = f (x, y) im Punkt P0 (x0 , y0 , f (x0 , y0 )) berührt diese Fläche in P0 und enthält alle Tangenten, die in P0 an diese Fläche gelegt werden können.

14

Zur Formulierung hinreichender Bedingungen für das Vorliegen eines lokalen Extremums wird noch die HesseMatrix der Funktion f benötigt. Diese wird aus den partiellen Ableitungen 2. Ordnung gebildet.

Definition 6.7: Unter der Voraussetzung, dass die partiellen Ableitungen zweiter Ordnung der Funktion

f (x, y) existieren, lautet die Hesse-Matrix Hf (x, y) dieser Funktion:

fxx (x, y) fxy (x, y)

Hf (x, y) =

.

fyx (x, y) fyy (x, y)

Hinreichende Bedingungen für das Vorliegen eines lokalen Extremums

Die hinreichenden Bedingungen für das Vorliegen eines lokalen Extremums der Funktion f (x, y)

an der Stelle (x∗ , y ∗ ) lauten:

(I) Die Bedingung (93) ist erfüllt, d.h. (x∗ , y ∗ ) ist eine stationäre Stelle.

(II) Die Determinante der Hesse-Matrix Hf (x, y) hat an der Stelle (x∗ , y ∗ ) einen positiven Wert,

d.h. es gilt: ∆ = det Hf (x∗ , y ∗ ) > 0.

Die Entscheidung, ob es sich um ein lokales Maximum oder ein lokales Minimum handelt, kann mit Hilfe der

Ableitung fxx an der Stelle (x∗ , y ∗ ) getroffen werden. Es gilt die folgende Aussage:

Entscheidung über die Art des lokalen Extremums

Die hinreichenden Bedingungen für ein lokales Extremum der Funktion f (x, y) seien an einer Stelle (x∗ , y ∗ )

erfüllt.

Gilt dann: fxx (x∗ , y ∗ ) < 0 , so liegt in (x∗ , y ∗ ) ein lokales Maximum vor.

In dem Fall fxx (x∗ , y ∗ ) > 0 liegt in (x∗ , y ∗ ) ein lokales Minimum vor.

Wenn an einer Stelle (x∗ , y ∗ ) nur die o.g. Bedingung (I) erfüllt ist, aber ∆ < 0 gilt, dann handelt es sich um

eine Sattelstelle. Dies bedeutet, dass die betrachtete Funktion an dieser Stelle einen Sattelpunkt besitzt.

Wenn an einer Stelle (x∗ , y ∗ ) die o.g. Bedingung (I) erfüllt ist sowie ∆ = 0 gilt, kann noch keine Entscheidung

bzgl. des Vorhandenseins eines lokalen Extremums getroffen werden. Auf diesen Fall wird hier nicht näher

eingegangen.

Bei der Berechnung lokaler Extrema ist zu beachten, dass das Aufstellen der Bedingung (93) häufig auf ein

nichtlineares Gleichungssystem mit den beiden Variablen x und y führt, dessen Auflösung sich möglicherweise

schwierig gestaltet (ggf. kann der solve-Befehl des Taschenrechners genutzt werden).

Beispiel 6.17:

a) Das Vorhandensein eines lokalen Minimums der Funktion z = f (x, y) = x2 + y 2 an der Stelle (0, 0)

wurde im Abschnitt 6.4.1 anschaulich begründet. Nun soll diese Funktion rechnerisch auf lokale Extrema

und Sattelpunkte untersucht werden.

Überprüfung der Bedingung (I): wegen fx = 2x und fy = 2y liegt genau eine stationäre Stelle vor, nämlich

(x∗ , y ∗ ) = (0, 0).

Überprüfung der Bedingung (II): die noch benötigten Ableitungen lauten: fxx = 2, fxy = fyx = 0 sowie

fyy = 2. Damit lautet die Hesse-Matrix:

Hf (x, y) =

2 0

0 2

.

(In diesem speziellen Fall besitzt Hf für alle (x, y) ∈ R2 den gleichen Wert!)

Somit gilt ∆ = det Hf (0, 0) = 4 > 0, d.h. in (0, 0) liegt tatsächlich ein lokales Extremum vor. Wegen

fxx = 2 > 0 handelt es sich um ein lokales Minimum, der zugehörige Funktionswert ist

f (0, 0) = 02 + 02 = 0.

Aus den obigen Überlegungen folgt weiterhin, dass die betrachtete Funktion kein lokales Maximum und

keinen Sattelpunkt besitzt.

b) Berechnung der lokalen Extrema der Funktion z = f (x, y) = 3xy − x3 − y 3

15

6.4.3

Extrema mit Nebenbedingungen

Bei den bisherigen Betrachtungen wurden die lokalen Extrema im gesamten Definitionsbereich der Funktion

gesucht, d.h. die unabhängigen Variablen x und y unterlagen keinen zusätzlichen Einschränkungen (Nebenbedingungen).

Die Modellierung von Praxisproblemen führt jedoch häufig auf Funktionen, bei denen die unabhängigen Variablen durch eine Neben- oder Kopplungsbedingung miteinander verbunden sind, d.h. zusätzlich zur Funktionsgleichung liegt eine weitere Gleichung vor. Bei der Lösung derartiger Problemstellungen sind zwei verschiedene Herangehensweisen möglich: die Eliminationsmethode (siehe Abschnitt 6.4.3.1) und die Lagrange-Methode

(siehe Abschnitt 6.4.3.2).

6.4.3.1 Die Eliminationsmethode

Bei der Eliminationsmethode wird - wie der Name schon vermuten lässt - eine der vorkommenden Variablen

aus der Funktion beseitigt“. Dies geschieht, indem die gegebene Nebenbedingung (NB) nach einer Variablen

”

aufgelöst wird. Anschließend wird diese Variable in der Funktion, deren Extrema gesucht sind, ersetzt (d.h. die

Anzahl der Variablen wird um 1 verringert). Die Durchführung dieser Methode wird anhand der beiden nachfolgenden Beispiele verdeutlicht.

Beispiel 6.18:

In diesem Beispiel konnte die Berechnung eines Extremums einer Funktion mit zwei Variablen auf Grund der

zu erfüllenden NB auf die Ermittlung eines Extremums einer Funktion mit einer Variablen (vgl. auch Abschnitt 4.2.2 im Skript Teil 1) zurückgeführt werden.

In dem nun folgenden Beispiel ist ein Extremum einer Funktion mit drei Variablen unter einer NB gesucht. Die

Elimination einer dieser Variablen führt auf die Bestimmung eines Extremums einer Funktion mit zwei Variablen

(vgl. Abschnitt 6.4.2).

Beispiel 6.19:

Bei der Herstellung quaderförmiger, nach oben offener Behälter mit

einem Fassungsvermögen von V = 4 l soll möglichst wenig Material verbraucht werden, d.h. die Oberfläche AO eines Quaders ohne

Deckfläche bei fest vorgegebenem Volumen ist zu minimieren.

z

x

16

y

6.4.3.2 Die Lagrange-Methode (Lagrangesche Multiplikatorenmethode)

Die Lagrange-Methode kommt zur Anwendung, wenn die Eliminationsmethode nicht durchführbar ist, d.h. wenn

- die Auflösung der NB nach einer Variablen nicht möglich oder zu aufwändig ist

oder

- die Elimination einer Variablen zu einer sehr komplizierten Funktion führt.

Das Grundprinzip der Lagrange-Methode besteht in der Einführung einer zusätzlichen Variablen λ, Lagrangescher Multiplikator genannt. Diese wird in eine Hilfsfunktion eingebracht, deren Extrema bestimmt werden.

Durchführung der Lagrange-Methode

Gegeben sei die Funktion z = f (x, y).

Zu ermitteln sind die Extrema dieser Funktion unter der NB: ϕ(x, y) = 0.

Dazu wird wie folgt vorgegangen:

1) Einführung der Hilfsvariablen λ (Lagrangescher Multiplikator) und Aufstellen der Hilfsfunktion

F (x, y, λ) = f (x, y) + λϕ(x, y)

2) Berechnung der Koordinaten (x, y) der extremwertverdächtigen Stellen aus dem (i.allg. nichtlinearen)

Gleichungssystem

Fx (x, y, λ) = fx (x, y) + λϕx (x, y) = 0

Fy (x, y, λ) = fy (x, y) + λϕy (x, y) = 0

Fλ (x, y, λ) =

(94)

ϕ(x, y) = 0

Um dann zu entscheiden, ob tatsächlich ein Extremum vorliegt (und um ggf. die Art des Extremums festzustellen), kommen die folgenden Möglichkeiten in Frage:

- In manchen Fällen kann aus der Problemstellung heraus entschieden werden, ob ein Extremum vorliegt.

- Die Frage, ob es sich um ein Minimum oder um ein Maximum handelt, kann ggf. anschaulich mit Hilfe eines

Niveauliniendiagramms (siehe Abschnitt 6.1) geklärt werden.

- Wenn gilt: Fxx ϕ2y − 2Fxy ϕx ϕy + Fyy ϕ2x < 0 , dann liegt ein Maximum vor.

In dem Fall Fxx ϕ2y − 2Fxy ϕx ϕy + Fyy ϕ2x > 0 liegt ein Minimum vor.

17

Beispiel 6.20:

Beispiel 6.21: Berechnung der maximalen Beleuchtungsstärke4

Ein fester Punkt A einer ebenen Bühne wird durch eine

punktförmige, in der Höhe h verstellbare Lichtquelle mit der

konstanten Lichtstärke I0 beleuchtet. Die im Punkt A erzeugte

Beleuchtungsstärke B genügt dem Lambertschen Gesetz:

h

x Lichtquelle

Q

Q

α Q

Q

Q

Q

Q

I0 cos α

B = B(α, r) =

r2

Q r

Q

Q

Q

a (fest)

(α: Einfallswinkel des Lichtes, r: Abstand zwischen

Lichtquelle und Punkt A).

Q

Q A

Qt

0

Bühne

Bild 6.3

Die Fragestellung lautet: Unter welchem Winkel α wird der Punkt A maximal beleuchtet?

Zur Beantwortung dieser Frage wird der Sachverhalt wie folgt mathematisch formuliert:

Gesucht ist das Maximum der Funktion B(α, r) unter der Nebenbedingung ϕ(α, r) = r sin α − a = 0

a

(Beziehungen im rechtwinkligen Dreieck: sin α = , siehe Bild 6.3).

r

Bei Anwendung der Lagrange-Methode wird zunächst die Hilfsfunktion F (r, α, λ) gebildet:

F (r, α, λ) = B(α, r) + λ · ϕ(α, r) =

I0 cos α

+ λ · (r sin α − a) .

r2

Analog zu (94) wird das Gleichungssystem aufgestellt:

2I0 cos α

+ λ sin α = 0

r3

I0 sin α

Fα = −

+ λr cos α = 0

r2

Fλ =

r sin α − a = 0

Fr = −

(I)

(II)

(III)

Die Gleichungen (I) und (II) werden jeweils nach λ umgestellt und gleichgesetzt:

I0 sin α

2I0 cos α

= 3

⇒ 2 cos2 α = sin2 α ⇒ 2 = tan2 α .

r3 sin α

r cos α

√

Die letztgenannte Gleichung

hat die beiden Lösungen α1 = arctan( 2) = 0.955

√

und α2 = arctan(− 2) = −0.955 , wobei α2 (wegen α2 < 0) sofort entfällt. Nach Umwandlung von α1 in

das Gradmaß erhält man: α1 = 54.74◦ .

Für α1 kann gezeigt werden, dass tatsächlich ein Maximum der Funktion B(α, r) vorliegt.

⇒ Ergebnis: Bei einem Winkel von α = 54.74◦ wird der Punkt A maximal beleuchtet, die Beleuchtungsstärke

beträgt in diesem Fall Bmax =

4

0.385I0

a2

.

Quelle: L. PAPULA. Mathematik für Ingenieure und Naturwissenschaftler, Band 2, 12. Auflage (2009), S. 257-258

18

Bemerkungen:

- Der Wert der Hilfsvariablen λ wird für die Berechnung der Extrema selbst nicht benötigt. Aus diesem Grund

kann es sinnvoll sein, diese Variable bei der Auflösung des Gleichungssystems (94) zu eliminieren (wie im

Beispiel 6.21).

- Bei Berechnungen mit betriebswirtschaftlichem Hintergrund kann mit Hilfe des Lagrangeschen Multiplikators λ näherungsweise beschrieben werden, wie sich Änderungen der Nebenbedingungen auf den Extremwert

auswirken (für detailliertere Informationen sei auf die folgende Literaturstelle verwiesen:

B. L UDERER , U. W ÜRKER . Einstieg in die Wirtschaftsmathematik, 6. Auflage, S. 370-372).

- Die Lagrange-Methode ist sinngemäß auch anwendbar für Funktionen von n Variablen x1 , x2 , . . . , xn mit

m Nebenbedingungen ϕi (x1 , x2 , . . . , xn ) = 0, i = 1, 2, . . . , m, wobei m < n. Dann müssen insgesamt m

Hilfsvariable λ1 , λ2 , . . . , λm eingeführt werden. Analog zu (94) sind dann die Ableitungen der Hilfsfunktion

F (x1 , x2 , . . . , xn , λ1 , λ2 , . . . , λm ) nach sämtlichen Variablen, von denen sie abhängt, zu bilden und gleich

Null zusetzen.

6.5

Ausgleichsrechnung

In der Praxis tritt häufig die folgende Problemstellung auf: mit n verschiedenen Eingangsdaten xi (i = 1, 2, . . . , n)

wird ein Versuch durchgeführt, wodurch die Versuchsergebnisse yi (i = 1, 2, . . . , n) entstehen. Gesucht ist der

funktionale Zusammenhang y = f (x) zwischen den Größen x und y, d.h. eine Funktion f ist so zu bestimmen,

dass die Versuchsergebnisse möglichst gut wiedergegeben werden. Ein solches Experiment könnte z.B. die Messung der Längenänderung eines Stabes in Abhängigkeit von der Temperatur sein.

Nur selten wird die Situation eintreten, dass alle n Punkte mit den Koordinaten (xi , yi ) (i = 1, 2, . . . , n) exakt

auf einer Funktionskurve im ebenen kartesischen Koordinatensystem liegen5 . Aus diesem Grund bedient man

sich zur Lösung der beschriebenen Problemstellung der Ausgleichsrechnung. Ein klassisches Verfahren der Ausgleichsrechnung ist die Methode des Gaußschen Fehlerquadratminimums. Diese Methode wird im folgenden

beschrieben am Beispiel des Ausgleichs durch eine Gerade.

Gegeben seien n Punkte mit den kartesischen Koordinaten (xi , yi ), i = 1, 2, . . . , n, mit n ≥ 3 sowie xi 6= xj

für i 6= j. Nun soll eine Gerade y = f (x) = a1 x + a0 so in diese Punktmenge eingepasst werden, dass der

Trend“ in der Anordnung der Punkte möglichst gut wiedergegeben wird (siehe Bild 6.4a)). Diese Gerade wird

”

als Ausgleichsgerade bezeichnet. Als Kriterium für die Güte dieser Ausgleichsgeraden dient die Summe aller

Fehlerquadrate d2i (i = 1, 2, . . . , n) mit d2i = [f (xi ) − yi ]2 (zur Veranschaulichung siehe Bild 6.4b)), d.h. die

unbekannten Größen a1 und a0 sind so zu bestimmen, dass diese Summe minimal wird.

Für die Summe S der Fehlerquadrate gilt:

S = S(a1 , a0 ) =

n

X

d2i =

i=1

n

X

[f (xi ) − yi ]2 =

i=1

n

X

[a1 xi + a0 − yi ]2 .

(95)

i=1

In die Berechnung von S gehen die Werte a1 , a0 , xi und yi (i = 1, 2, . . . , n ) ein, wobei xi und yi jeweils aus

dem Versuch bekannt sind. Lediglich die Werte von a1 und a0 sind bislang unbekannt, d.h. S ist eine Funktion

nur von diesen beiden Variablen.

y 6

y

6

r r f (x) = a1 x + a0

r r r r r

r r

r

r

yi

f (xi )

x

0

f (x) = a1 x + a0

r 0

Bild 6.4a)

xi

x

Bild 6.4b)

5

Wenn z.B. zwischen zwei physikalischen Größen ein linearer Zusammenhang besteht, dann wird die grafische Darstellung der

Versuchsdaten in der Regel nur annähernd eine Gerade ergeben.

19

Die notwendigen Bedingungen für das Vorhandensein eines Extremums der Funktion S(a1 , a0 ) sind

(vgl. Abschnitt 6.4.2):

∂S

∂a1

= 0 sowie

∂S

∂a0

= 0. Unter Einbeziehung von (95) erhält man:

n

X

∂S

=2

[a1 xi + a0 − yi ] · xi = 0

∂a1

⇒

a1

n

X

i=1

i=1

n

n

X

X

∂S

=2

[a1 xi + a0 − yi ]

∂a0

=0

i=1

⇒

a1

i=1

x2i

+ a0

n

X

xi =

i=1

xi

+ a0 n

n

X

xi yi

i=1

=

n

X

(96)

yi ,

i=1

d.h. es ist ein lineares Gleichungssystem zur Berechnung von a1 und a0 entstanden.

In Matrizenschreibweise lautet dieses lineare Gleichungssystem:

P

P

n

n

n

P

x2i

xi

x i yi

a1

i=1

i=1

i=1

.

=

n

n

P

a0

P

xi

n

yi

i=1

(97)

i=1

Zur Lösung von (97) kann z.B. die Cramersche Regel (siehe Abschnitt 2.12.3 im Skript Teil 1) oder der rrefBefehl des Taschenrechners verwendet werden.

Berechnung einer Ausgleichsgeradena

Gegeben seien n Punkte mit den Koordinaten (xi , yi ), i = 1, 2, . . . , n, wobei n ≥ 3 sowie xi 6= xj

für i 6= j gilt. Die Werte von a1 und a0 für die Ausgleichsgerade y = f (x) = a1 x + a0 werden

als Lösung des linearen Gleichungssystems (96) bzw. (97) berechnet.

Unter den genannten Voraussetzungen ist das lineare Gleichungssystem stets eindeutig lösbar.

a

Anstelle des Begriffs Ausgleichsgerade“ sind auch die Begriffe Regressionsgerade“ oder empirische Ausgleichsgerade“

”

”

”

gebräuchlich.

Zudem kann nachgewiesen werden, dass für die aus (96) bzw. (97) berechneten Werte von a1 und a0 tatsächlich

ein Minimum der Funktion S(a1 , a0 ) (siehe (95)) vorliegt.

Beispiel 6.22:

Der Widerstand eines metallischen Leiters in Abhängigkeit von der Temperatur T wird durch die folgende Gleichung beschrieben:

RT = R0 + R0 · β · T

(RT : Widerstand bei der Temperatur T , R0 : Widerstand bei der Temperatur 0◦ C, β: Temperaturkoeffizient).

Um eine Berechnung der unbekannten Größen R0 und β vornehmen zu können, wurden die folgenden Messwerte aufgenommen:

T [◦ C]

20

40

60

80

RT [Ω]

1.66

1.76

1.86

2.00

Gesucht ist die zugehörige Ausgleichsgerade.

20

Es ist nicht in jedem Fall sinnvoll, nach einem linearen Zusammenhang zwischen den Größen x und y zu suchen

(nach Einzeichnen der Punkte mit den Koordinaten (xi , yi ), i = 1, . . . , n, in ein ebenes Koordinatensystem

könnte anhand der Lage dieser Punkte z.B. auch ein quadratischer Zusammenhang zwischen x und y vermutet

werden). Allgemein gilt:

Wenn anstelle der Ausgleichsgeraden ein Ausgleichspolynom m-ten Grades (m ≥ 2) berechnet werden soll, ist

ein Ansatz der Form

y = f (x) = am xm + am−1 xm−1 + . . . + a1 x + a0

mit unbekannten Koeffizienten am , . . . , a0 zu wählen. Die weiteren Arbeitsschritte verlaufen ähnlich wie bei

der Berechnung der Ausgleichsgeraden: Zunächst muss eine zu (95) analoge Beziehung, jetzt mit

S = S(a0 , . . . , am ), aufgestellt werden. Dann sind die notwendigen Bedingungen für ein Minimum dieser

Funktion zu formulieren, was auf ein lineares Gleichungssystem zur Berechnung der m Unbekannten a0 , . . . , am

führt.

Für detailliertere Ausführungen zur Berechnung von Ausgleichspolynomen vom Grad m = 2 (Ausgleichsparabeln) sei auf die folgende Literaturstelle verwiesen:

L. PAPULA. Mathematik für Ingenieure und Naturwissenschaftler, Band 3, 5. Auflage, S. 710-714.

6.6

Weitere räumliche Koordinatensysteme

Für die Darstellung von Funktionen zweier unabhängiger Variabler (siehe Abschnitt 6.1) wurde bisher stets ein

räumliches kartesisches Koordinatensystem verwendet. Besitzt die zu beschreibende Funktion bzw. Punktmenge gewisse Symmetrieeigenschaften, kann eine Darstellung mittels krummliniger Koordinaten (Zylinderkoordinaten oder Kugelkoordinaten) vorteilhaft sein.

1) Zylinderkoordinaten

Wenn eine rotationssymmetrische Punktmenge (z.B. ein gerader Kreiszylinder) dargestellt werden soll, empfiehlt sich der Übergang zu Zylinderkoordinaten.

Der Zusammenhang zwischen kartesischen Koordinaten (x, y, z) und Zylinderkoordinaten (r, ϕ, z) ist gegeben durch:

x = r · cos ϕ , y = r · sin ϕ , z = z

(r ≥ 0, 0 ≤ ϕ < 2π).

(98)

Die Koordinaten r und ϕ können wie folgt anschaulich interpretiert werden (siehe dazu auch Bild 6.5a)):

Durch orthogonale Projektion der Strecke OP auf die (x, y)-Ebene entsteht die Strecke OP 0 . Dann bezeichnet r die Länge der Strecke OP 0 (d.h. den Abstand des Punktes P 0 vom Koordinatenursprung) und ϕ den

(mathematisch positiv orientierten) Winkel zwischen der x-Achse und der Strecke OP 0 .

z 6

z 6

r P (x, y, z)

z

O

ϕ

6

r

r P (x, y, z)

r

ϑ

j

*y

r P 0 (x, y, 0)

O

*y

r P 0 (x, y, 0)

ϕ

6

j

x

j

x

Bild 6.5a)

Bild 6.5b)

Beispiel 6.23:

21

2) Kugelkoordinaten

Der Übergang zu Kugelkoordinaten ist z.B. dann zweckmäßig, wenn die betrachtete Punktmenge eine Kugel

oder ein Kugelausschnitt ist. Der Zusammenhang zwischen kartesischen Koordinaten (x, y, z) und Kugelkoordinaten (r, ϕ, ϑ) wird durch die folgenden Gleichungen beschrieben:

x = r · cos ϕ · sin ϑ , y = r · sin ϕ · sin ϑ , z = r · cos ϑ

(r ≥ 0, 0 ≤ ϕ < 2π, 0 ≤ ϑ ≤ π).

(99)

Die Koordinaten r, ϕ und ϑ können wie folgt anschaulich interpretiert werden (siehe dazu auch Bild 6.5b)):

Sei OP 0 wiederum die Strecke, welche durch orthogonale Projektion der Strecke OP auf die (x, y)-Ebene

entsteht . Dann bezeichnet r die Länge der Strecke OP (d.h. den Abstand des Punktes P vom Koordinatenursprung) und ϕ den (mathematisch positiv orientierten) Winkel zwischen der x-Achse und der Strecke OP 0 .

Der Winkel zwischen der z-Achse und der Strecke OP heißt ϑ.

Beispiel 6.24:

22

7

Grundlagen der Wahrscheinlichkeitsrechnung

7.1

Hilfsmittel aus der Kombinatorik

Definition 7.1:

Als Permutationen von n Elementen ohne Wiederholung bezeichnet man Anordnungen dieser n verschiedenen Elemente, die sich nur durch die Reihenfolge dieser Elemente unterscheiden.

Eine Permutation von n Elementen mit Wiederholung liegt vor, wenn nicht alle n Elemente voneinander

verschieden sind.

Für die Berechnung der Permutationen (d.h. die Anzahl der möglichen Anordnungen) gelten die folgenden

Formeln.

Permutationen von n Elementen ohne Wiederholung:

P (n) = n · (n − 1) · (n − 2) · . . . · 1 = n!

Permutationen von n Elementen, unter denen

sich jeweils n1 , n2 , . . . , nk einander gleiche befinden:

P (n; n1 , n2 , . . . , nk ) =

n!

n1 ! · n2 ! · . . . · nk !

mit n1 + n2 + . . . nk = n

Beispiel 7.1:

Definition 7.2:

Unter Variationen von n Elementen zur k-ten Klasse ohne Wiederholung versteht man Teilmengen von

je k Elementen, die unter Berücksichtigung der Anordnung aus n gegebenen Elementen ausgewählt werden

(1 ≤ k ≤ n).

Eine Variation von n Elementen zur k-ten Klasse mit Wiederholung liegt vor, wenn die ausgewählten

Elemente mehrfach auftreten dürfen.

Variationen von n Elementen zur k-ten Klasse

ohne Wiederholung:

V (n; k) = n · (n − 1) · . . . · (n − (k − 1)) =

mit Wiederholung:

VW (n; k) = nk

Beispiel 7.2:

23

n!

(n − k)!

(mit 1 ≤ k ≤ n)

Definition 7.3:

Als Kombinationen von n Elementen zur k-ten Klasse ohne Wiederholung bezeichnet man Teilmengen von

je k Elementen, die ohne Berücksichtigung der Anordnung aus n gegebenen Elementen ausgewählt werden

(1 ≤ k ≤ n).

Eine Kombination von n Elementen zur k-ten Klasse mit Wiederholung liegt vor, wenn die ausgewählten

Elemente mehrfach auftreten dürfen.

Kombinationen von n Elementen zur k-ten Klasse

n

n!

ohne Wiederholung: C(n; k) =

=

(Binomialkoeffizient)

k

k! · (n − k)!

n+k−1

mit Wiederholung: CW (n; k) =

k

Bei den Kombinationen ohne Wiederholung muss gelten: 1 ≤ k ≤ n.

Beispiel 7.3:

7.2

Grundbegriffe der Wahrscheinlichkeitsrechnung

7.2.1

Das Zufallsexperiment und weitere Grundbegriffe

Definition 7.4:

Das Zufallsexperiment ist ein Versuch, bei dem die folgenden Bedingungen (Voraussetzungen) erfüllt sind:

1) Der Versuch lässt sich unter den gleichen äußeren Bedingungen beliebig oft wiederholen.

2) Bei der Durchführung des Versuchs sind mehrere sich gegenseitig ausschließende Ergebnisse möglich.

3) Das Ergebnis einer konkreten Durchführung des Versuchs lässt sich dabei nicht mit Sicherheit voraussagen, sondern ist zufallsbedingt.

Beispiel 7.4:

Definition 7.5:

Die möglichen, sich gegenseitig ausschließenden Ergebnisse eines Zufallsexperiments heißen

Elementarereignisse.

Schreibweise: ω1 , ω2 , ω3 , . . . .

Die Menge aller Elementarereignisse heißt Ergebnismenge Ω.

24

Beispiel 7.5:

Die Teilmengen der Ergebnismenge Ω beschreiben Versuchsausgänge, die bei der Durchführung des Versuchs

eintreten können, aber nicht unbedingt eintreten müssen. Dies gibt Anlass zur Definition des Begriffes Ereignis.

Definition 7.6:

Eine Teilmenge A der Ergebnismenge Ω eines Zufallsexperiments wird Ereignis genannt.

Die Menge aller Ereignisse, die aus der Ergebnismenge eines Zufallsexperiments gebildet werden können,

heißt Ereignisraum oder Ereignisfeld.

Nach den Gesetzmäßigkeiten der Mengenlehre sind sowohl die leere Menge ∅ als auch die Ergebnismenge Ω

selbst Teilmengen von Ω. Sie stellen Ereignisse mit folgender Bedeutung dar:

∅:

unmögliches Ereignis (ein Ereignis, das nie eintreten kann)

Ω:

sicheres Ereignis

(ein Ereignis, das immer eintritt).

Ein Ereignis A ist somit entweder

- das unmögliche Ereignis ∅ (siehe oben; A enthält dann kein Element von Ω)

oder

- ein Elementarereignis (siehe Definition 7.5; A enthält genau ein Element von Ω)

- eine Menge mehrerer Elementarereignisse (A enthält mehrere Elemente von Ω)

oder

oder

- das sichere Ereignis Ω (siehe oben; A enthält alle Elemente von Ω, d.h. A = Ω).

Beispiel 7.6:

7.2.2

Verknüpfungen von Ereignissen

Gemäß Definition 7.6 sind Ereignisse als Teilmengen der Ergebnismenge Ω anzusehen, d.h. es handelt sich

um Mengen. Somit kann man bei Ereignissen - ebenso wie bei Mengen - Verknüpfungen betrachten. Auf der

nachfolgenden Seite wird eine Übersicht über Verknüpfungen von Ereignissen gegeben. Die Veranschaulichung

erfolgt jeweils mit Hilfe von Mengendiagrammen.

25

Mit A und B sind Ereignisse im Sinne der Definition 7.6 bezeichnet.

Verknüpfung

Bedeutung

Teilereignis: A ⊆ B

A zieht B nach sich

Vereinigung (Summe): A ∪ B

mindestens eines der Ereignisse A, B

tritt ein (d.h.: A oder B)

A

B

sowohl A als auch B tritt ein

(d.h.: A und B)

A

B

A

B

Durchschnitt (Produkt): A ∩ B

Differenz: A \ B

Darstellung im Diagramm

A tritt ein, jedoch nicht gleichzeitig B

A B

Für die Verknüpfungen von Ereignissen gelten - wie auch für die Verknüpfungen von Mengen - Gesetzmäßigkeiten wie Kommutativgesetze, Assoziativgesetze, Distributivgesetze sowie die D E M ORGANschen Formeln.

Die entsprechenden Formeln werden an dieser Stelle nicht angegeben, sie sind beipielsweise (für Mengen) zu

finden in: H.-J. BARTSCH . Taschenbuch mathematischer Formeln für Ingenieure und Naturwissenschaftler,

21. Auflage, S. 42ff.

Das zu A komplementäre Ereignis tritt genau dann ein, wenn A nicht eintritt.

Bezeichnung: Ā; es gilt: Ω \ A = Ā

Die Ereignisse A und B heißen disjunkt (oder unvereinbar), wenn gilt: A ∩ B = ∅.

Beispiel 7.7:

Definition 7.7:

Die Ereignisse Ai (i = 1, 2, . . . , n) heißen Zerlegung des Ereignisses A, wenn gilt:

n

[

Ai = A

und Ai ∩ Aj = ∅ für alle i, j mit i 6= j .

i=1

Sie bilden ein vollständiges System zufälliger Ereignisse, wenn gilt:

n

[

Ai = Ω

und Ai ∩ Aj = ∅ für alle i, j mit i 6= j

(Zerlegung des sicheren Ereignisses).

i=1

Ein vollständiges System zufälliger Ereignisse A1 , A2 , . . . , An besitzt die folgende Eigenschaft: als Ergebnis

eines zufälligen Versuches muss genau eines von ihnen eintreten.

Beispiel 7.8:

26

7.3

Der Begriff der Wahrscheinlichkeit

7.3.1

Laplace-Experimente, absolute und relative Häufigkeit

Definition 7.8:

Ein Zufallsexperiment mit der endlichen Ergebnismenge Ω = {ω1 , ω2 , . . . , ωm } heißt

Laplace-Experiment, wenn alle Elementarereignisse ωi die gleiche Wahrscheinlichkeit besitzen:

P ({ωi }) = p(ωi ) =

1

m

(i = 1, 2, . . . , m).

Die Wahrscheinlichkeit eines Ereignisses A ist dann gegeben durch:

P (A) =

g(A)

m

,

wobei g(A) : Anzahl der für das Ereignis A günstigen Fälle (d.h. der Fälle, in denen das Ereignis A eintritt)

m : Anzahl der insges. möglichen Fälle (Anzahl der gleichwahrscheinlichen Elementarereignisse)

Hinweis: Dies wird auch als klassische Definition der Wahrscheinlichkeit bezeichnet (nur anwendbar für LaplaceExperimente !).

Beispiel 7.9:

Bei dem Zufallsexperiment Wurf eines homogenen Würfels“ treten alle 6 möglichen Augenzahlen (Elementar”

ereignisse) mit der gleichen Wahrscheinlichkeit auf:

p(i) =

g(i)

m

=

1

6

für i = 1, 2, . . . , 6.

Beispiel 7.10:

Für die Festlegung unbekannter Wahrscheinlichkeiten in der Praxis (siehe Abschnitt 7.3.2) werden noch die

Begriffe der absoluten und relativen Häufigkeit benötigt.

Definition 7.9:

Wird ein Zufallsexperiment n-mal durchgeführt und tritt dabei das Ereignis A genau n(A)-mal ein, so wird

n(A)

hn (A) =

als absolute Häufigkeit des Ereignisses A

n(A)

n

und

als relative Häufigkeit des Ereignisses A

bezeichnet.

Die absolute Häufigkeit eines Ereignisses kann somit durch einfaches Abzählen“ ermittelt werden.

”

7.3.2

Wahrscheinlichkeitsaxiome und Schlussfolgerungen

Wie im vorigen Abschnitt bereits ausgeführt wurde, ist der klassische Wahrscheinlichkeitsbegriff ausschließlich auf Laplace-Experimente anwendbar. In der modernen Wahrscheinlichkeitsrechnung wird der Begriff der

Wahrscheinlichkeit eines zufälligen Ereignisses“ mit Hilfe gewisser Axiome6 eingeführt. Diese heißen (nach

”

ihrem Begründer) Wahrscheinlichkeitsaxiome von Kolmogoroff und werden im folgenden aufgeführt.7

6

Ein Axiom ist ein nicht aus anderen Aussagen abgeleiteter Grundsatz, welcher nicht bewiesen wird. Aus Axiomen werden weitere

Sätze eines Wissensgebietes hergeleitet.

7

Quelle: L. PAPULA. Mathematik für Ingenieure und Naturwissenschaftler, Band 3, 5. Auflage, S. 282-283

27

Wahrscheinlichkeitsaxiome von Kolmogoroff

Jedem Ereignis A eines Zufallsexperiments mit der Ergebnismenge Ω wird eine reelle Zahl P (A),

genannt: Wahrscheinlichkeit des Ereignisses A, so zugeordnet, dass die folgenden Axiome erfüllt sind:

Axiom 1:

P (A) ist eine nichtnegative Zahl, die höchstens gleich 1 ist: 0 ≤ P (A) ≤ 1 .

Axiom 2:

Für das sichere Ereignis (Ergebnismenge) Ω gilt: P (Ω) = 1.

Axiom 3:

Für paarweise sich gegenseitig ausschließende Ereignisse A1 , A2 , A3 , . . . gilt:

P (A1 ∪ A2 ∪ A3 ∪ . . .) = P (A1 ) + P (A2 ) + P (A3 ) + . . . .

Man beachte: Die Wahrscheinlichkeitsaxiome beinhalten keinerlei Aussagen darüber, wie man bei einem konkreten Zufallsexperiment die Wahrscheinlichkeiten der auftretenden Ereignisse ermitteln kann. Sie stellen aber

in gewisser Hinsicht Rechenregeln für Wahrscheinlichkeiten dar.

Folgerungen aus den Wahrscheinlichkeitsaxiomen von Kolmogoroff

1) Für das unmögliche Ereignis gilt: P (∅) = 0 .

2) Für das zum Ereignis A komplementäre Ereignis gilt: P (Ā) = 1 − P (A) .

3) Für zwei sich gegenseitig ausschließende Ereignisse A und B folgt aus Axiom 3:

P (A ∪ B) = P (A) + P (B) .

Bei praktischen Sachverhalten ist es häufig so, dass die Zufallsexperimente nicht als Laplace-Experimente angesehen werden können und die Wahrscheinlichkeiten von Elementarereignissen nicht von vornherein bekannt oder

berechenbar sind. In solchen Fällen bedient man sich statistischer (oder empirischer) Wahrscheinlichkeitswerte.

Dazu sei n die (hinreichend große!) Anzahl der Einzelversuche einer Versuchsreihe und A ein zufälliges Ereignis, welches als Versuchsergebnis auftreten kann. Dann wird die relative Häufigkeit hn (A) (vgl. Definition 7.9)

des Ereignisses A festgestellt und

P (A) ≈ hn (A)

für die unbekannte Wahrscheinlichkeit P (A) angenommen (d.h. die ermittelte relative Häufigkeit von A dient

als Schätzwert für die unbekannte Wahrscheinlichkeit P (A)).

Beispiel 7.11:

Statistische Wahrscheinlichkeitswerte können z.B. angewendet werden für

- die Wahrscheinlichkeit für eine Jungen- oder Mädchengeburt

- die Wahrscheinlichkeit des Ausfalls eines Maschinenelementes während einer vorgegebenen Laufzeit.

7.3.3

Additionssatz, bedingte Wahrscheinlichkeit und Multiplikationssatz

Wenn A und B disjunkte Ereignisse sind (d.h.: A ∩ B = ∅), dann gilt nach dem Wahrscheinlichkeitsaxiom 3

(siehe Abschnitt 7.3.2): P (A ∪ B) = P (A) + P (B). Falls die Voraussetzung, dass die Ereignisse disjunkt sind,

nicht erfüllt ist, ist der folgende Satz anzuwenden:

Additionssatz für beliebige Ereignisse

Seien A und B zwei beliebige Ereignisse eines Ereignisraumes, dann gilt:

P (A ∪ B) = P (A) + P (B) − P (A ∩ B) .

(100)

Beispiel 7.12:

28

Wenn A und B Ereignisse ein und desselben Ereignisraumes sind, kann man bedingte Wahrscheinlichkeiten

betrachten, und zwar:

- die bedingte Wahrscheinlichkeit von A unter der Bedingung B

(d.h. es wird vorausgesetzt, dass das Ereignis B bereits eingetreten ist)

oder

- die bedingte Wahrscheinlichkeit von B unter der Bedingung A

(es wird vorausgesetzt, dass A bereits eingetreten ist).

Die Schreibweise für die genannten Wahrscheinlichkeiten ist: P (A | B) bzw. P (B | A) .

Die Berechnung bedingter Wahrscheinlichkeiten wird mit Hilfe der nachfolgenden Formeln durchgeführt.

Berechnung bedingter Wahrscheinlichkeiten

Bedingte Wahrscheinlichkeit von A unter der Bedingung B:

P (A | B) =

P (A ∩ B)

P (B)

(wobei P (B) 6= 0 gelten muss)

(101)

Bedingte Wahrscheinlichkeit von B unter der Bedingung A:

P (B | A) =

P (A ∩ B)

P (A)

(wobei P (A) 6= 0 gelten muss)

(102)

Beispiel 7.13:

Als unmittelbare Schlussfolgerung aus den Formeln für die bedingte Wahrscheinlichkeit erhält man die folgende

Aussage.

Multiplikationssatz (für beliebige Ereignisse)

Die Wahrscheinlichkeit für das gleichzeitige Eintreten der beiden Ereignisse A und B wird berechnet

nach der Formel:

P (A ∩ B) = P (A) · P (B | A).

(103)

Hinweis: In (103) bedeutet P (A) die Wahrscheinlichkeit für das Eintreten von A (ohne jede Bedingung!) und

P (B | A) die Wahrscheinlichkeit für das Eintreten von B unter der Bedingung, dass A bereits eingetreten ist.

29

Beispiel 7.14:

Ausgehend von den bedingten Wahrscheinlichkeiten können aber auch die Fälle:

P (A | B) = P (A)

bzw.

P (B | A) = P (B)

in Betracht gezogen werden.

In dem ersten Fall gilt: Die Wahrscheinlichkeit des Eintretens von A unter der Bedingung B ist gleich der Wahrscheinlichkeit des Eintretens von A (ohne Bedingung). Dies kann so interpretiert werden, dass das Eintreten des

Ereignisses B keinen Einfluss auf das Eintreten des Ereignisses A hat. Oder, anders ausgedrückt: Das Ereignis A

ist (stochastisch) unabhängig von dem Ereignis B.

Analog dazu bedeutet der zweite der o.g. Fälle, dass das Ereignis B (stochastisch) unabhängig von dem Ereignis A ist.

In dem speziellen Fall stochastisch unabhängiger Ereignisse kann der o.g. Multiplikationssatz wie folgt formuliert werden.

Multiplikationssatz für stochastisch unabhängige Ereignisse

Wenn die Ereignisse A und B stochastisch unabhängig sind, dann gilt:

P (A ∩ B) = P (A) · P (B).

(104)

Die Formel (104) entsteht aus (103), indem dort P (B | A) = P (B) gesetzt wird. Diese Beziehung ist auf Grund

der vorausgesetzten Unabhängigkeit der Ereignisse A und B stets gültig.

Die Formel (104) kann auch auf den Fall von n Ereignissen verallgemeinert werden. Wenn die Ereignisse

A1 , A2 , . . . , An ein vollständiges System stochastisch unabhängiger Ereignisse bilden, dann gilt:

!

n

n

\

Y

P

Ai = P (A1 ) · P (A2 ) · . . . · P (An ) =

P (Ai ).

(105)

i=1

i=1

Mit dieser Formel lässt sich die Wahrscheinlichkeit für das gleichzeitige Eintreten von n stochastisch unabhängigen Ereignissen berechnen, falls die Wahrscheinlichkeiten für das Eintreten jedes einzelnen Ereignisses bekannt

sind.

Beispiel 7.15:

Bemerkungen:

- Wenn die Ereignisse A und B stochastisch unabhängig sind, dann sind auch die Ereignisse A und B stochastisch unabhängig, ebenso die Ereignisse A und B sowie die Ereignisse A und B.

- Für drei beliebige Ereignisse A, B, C lautet der Additionssatz:

P (A ∪ B ∪ C) = P (A) + P (B) + P (C) − P (A ∩ B) − P (A ∩ C) − P (B ∩ C) + P (A ∩ B ∩ C).

Für eine Verallgemeinerung des Additionssatzes auf n beliebige Ereignisse sei auf die folgende Literaturstelle

verwiesen: W. VOSS (Hrsg.): Taschenbuch der Statistik, 1. Auflage (2000), S. 305.

30

7.3.4

Baumdiagramme, totale Wahrscheinlichkeit von Ereignissen

Wenn mehrere gleichartige Zufallsexperimente nacheinander durchgeführt werden, spricht man auch von einem

mehrstufigen Zufallsexperiment.

Ergänzung zu Beispiel 7.14:

Es wurde die Ziehung zweier Kugeln aus einer Urne ohne Zurücklegen betrachtet. Dies kann als 2-stufiges

Zufallsexperiment aufgefasst werden, wenn man die Ziehung einer Kugel als einfaches“ Zufallsexperiment

”

ansieht.