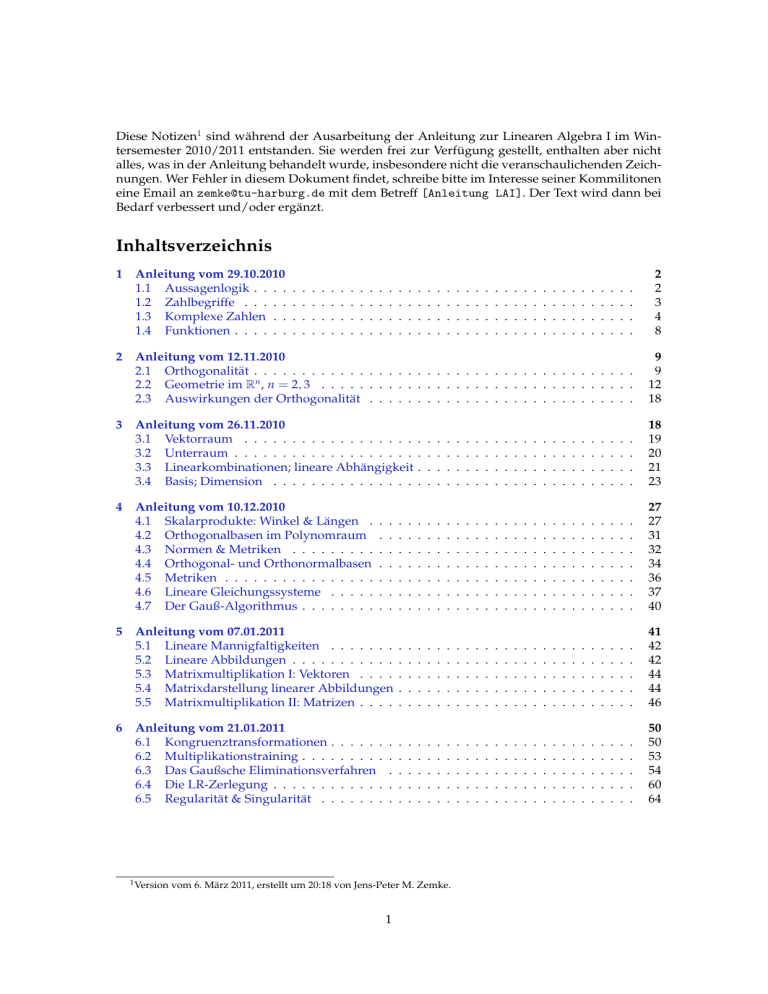

Notizen zur Anleitung zur Vorlesung Lineare Algebra I

Werbung