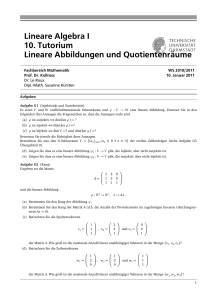

MLAE1 Mathematik: Lineare Algebra für Ingenieure 1

Werbung

MLAE1

Mathematik: Lineare Algebra für Ingenieure 1

Christoph Kirsch

28. Dezember 2015

Inhaltsverzeichnis

0 Überblick

1

1 Grundlagen

1.1 Mengenlehre . . . . . . . . . . . . . . . . .

1.2 Zahlen . . . . . . . . . . . . . . . . . . . .

1.2.1 Zahlenmengen und Operationen .

1.3 Funktionen . . . . . . . . . . . . . . . . .

1.4 Der Körper (R, +, · ) . . . . . . . . . . . .

1.4.1 Auflösen von linearen Gleichungen

1.5 Der Vektorraum (Rn , +, · ) . . . . . . . .

1.6 Matrizen . . . . . . . . . . . . . . . . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

2 Lineare Gleichungssysteme

2.1 Einführung . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

2.2 Allgemeine Form und Matrixform . . . . . . . . . . . . . . . . . .

2.3 Lineare Gleichungssysteme in Zeilenstufenform . . . . . . . . . .

2.4 Gausssches Eliminationsverfahren . . . . . . . . . . . . . . . . . .

2.5 Zusammenfassung: Verfahren zur Lösung eines linearen Gleichungssystems . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

2.6 Gauss-Jordan-Algorithmus und inverse Matrix . . . . . . . . . .

2

2

5

5

6

7

10

11

17

26

26

27

28

35

40

42

3 Vektorräume und lineare Abbildungen

52

3.1 Vektorräume, Basis, Dimension . . . . . . . . . . . . . . . . . . . 52

3.2 Lineare Abbildungen, Darstellungsmatrizen . . . . . . . . . . . . 68

0

Überblick

In diesem ersten Teil einer zweisemestrigen Vorlesung über Lineare Algebra

für Ingenieure sollen Sie das Rechnen mit Vektoren, Matrizen und komplexen

Zahlen sowie Grundlagen der analytischen Geometrie erlernen.

1

1

GRUNDLAGEN

2

Zuerst betrachten wir die bekannte Addition und Multiplikation von reellen

Zahlen und stellen fest, dass die Menge R (der reellen Zahlen) zusammen mit

diesen Verknüpfungen einen Körper bildet. Durch Einführung von Vektoren erhalten wir den Vektorraum Rn , der sich für n = 2, 3 bequem veranschaulichen

lässt. Danach führen wir Matrizen als rechteckige Zahlenschemen ein. Eine Matrix kann mit einem Vektor multipliziert werden, was einen neuen Vektor ergibt.

Dies führt auf lineare Gleichungssysteme, für die wir einen direkten Lösungsalgorithmus (das Gausssche Eliminationsverfahren) kennen lernen.

Nach dieser Einführung untersuchen wir algebraische Strukturen wie Gruppen, Körper oder Vektorräume allgemeiner. Dabei werden auch die komplexen

Zahlen eingeführt, die u. a. bei der Lösung von quadratischen Gleichungen eine

Rolle spielen. Wir lernen den Begriff der Basis eines Vektorraums kennen und

überzeugen uns davon, dass sich lineare Abbildungen auf Vektorräumen mit

Hilfe von Matrizen darstellen lassen.

Diese allgemeineren Betrachtungen finden Anwendung in der analytischen

Geometrie, wo Methoden aus der linearen Algebra verwendet werden, um z. B. Geraden und Ebenen im dreidimensionalen Raum R3 zu beschreiben.

Die in dieser Vorlesung besprochenen Inhalte sollten in Ihrer Vorlesung

PHEMS1 direkte Anwendung finden.

1

Grundlagen

1.1

Mengenlehre

Definition 1 (nach Georg Cantor, 1895) Eine Menge ist eine Zusammenfassung von bestimmten wohlunterschiedenen Objekten unserer Anschauung oder

unseres Denkens zu einem Ganzen. Die Objekte einer Menge heissen Elemente.

Bemerkungen:

• Für ein Element x einer Menge M schreiben wir x ∈ M und sagen “x ist

Element von M ”.

• Weil die in einer Menge zusammengefassten Objekte gemäss Def. 1 “wohlunterschieden” sein müssen, kann eine Menge nicht zwei gleiche Elemente

enthalten.

Definition 2 (Teilmenge) Eine Menge A heisst Teilmenge einer Menge B,

wenn jedes Element von A auch Element von B ist.

Bemerkungen:

• Wir schreiben A ⊆ B, wenn A eine Teilmenge von B ist.

• Wir werden Mengen immer als Teilmengen einer Grundmenge G (eines

Universums) betrachten. G ist eine Menge aus allen in einem bestimmten Zusammenhang betrachteten Objekten. Alle in diesem Zusammenhang

betrachteten Mengen sind dann Teilmengen von G.

1

GRUNDLAGEN

3

• Ist x kein Element von M , so schreiben wir x 6∈ M . Beachten Sie aber,

dass immer noch x ∈ G gelten muss (das Universum kann nicht verlassen

werden)!

Beispiele:

1. G: Menge aller Früchte, B : Menge aller Apfelfrüchte, dann gilt für A :=

{Apfel, Birne, Quitte}: A ⊆ B. Es gelten auch die Aussagen Apfel ∈ A,

Birne ∈ B, Vogelbeere ∈ B, Vogelbeere 6∈ A. Insbesondere gilt A 6= B,

denn wir haben ein Element von B gefunden, das kein Element von A ist.

2. G: Menge aller Musikinstrumente, Ω : Menge aller Streichinstrumente,

dann gilt M := {Violine, Viola, Violoncello, Kontrabass} ⊆ Ω. Es gilt

{Violine, Viola} ⊆ M , Erhu ∈ Ω, Erhu 6∈ M , Querflöte 6∈ Ω.

3. Im Beispiel 1 ist der Ausdruck “Violine 6∈ B” unzulässig, weil die Violine

kein Element der dort betrachteten Grundmenge aller Früchte ist. Die

Aussage “Banane 6∈ B” ist hingegen zulässig, denn die Banane ist eine

Frucht.

4. “{Violine, Violine, Kontrabass}” ist keine Menge, weil die beiden Objekte

Violine nicht unterscheidbar sind. Dagegen ist {Violine, {Violine} , Kontrabass}

eine Menge, denn das Element Violine ist verschieden von der Menge mit

dem Element Violine.

5. Die leere Menge, ∅ oder {}, ist eine Menge, die keine Elemente enthält.

In diesen Beispielen haben wir bereits zwei Darstellungsformen von Mengen

kennen gelernt:

• die aufzählende Form, wie z. B. A = {Apfel, Birne, Quitte}. Hier werden

die Elemente einer Menge explizit aufgezählt, wobei die Reihenfolge keine

Rolle spielt.

• die beschreibende Form, wie z. B. “Ω ist die Menge aller Streichinstrumente”. Hier werden die Elemente einer Menge über ihre Eigenschaften

beschrieben. Formal schreiben wir auch

M = {x ∈ G | x hat die Eigenschaft E} ,

d. h. M enthält sämtliche Elemente der Grundmenge G, die die Eigenschaft E haben. Zum Beispiel lässt sich die Menge aller Streichinstrumente

im Universum G aller Musikinstrumente schreiben als

Ω = {x ∈ G | x ist ein Streichinstrument}.

Für die Definition der folgenden Mengenoperationen verwenden wir die folgenden Symbole aus der Aussagenlogik (s. MAE1):

• ∧: Konjunktion (UND)

• ∨: Disjunktion (ODER)

1

GRUNDLAGEN

4

Definition 3 (Mengenoperationen) Seien A und B Mengen. Dann definieren

wir die folgenden Mengen über ihre Eigenschaften:

• Komplement von A: Ac := {x ∈ G | x 6∈ A},

• Schnittmenge (Durchschnitt) von A und B: A∩B := {x ∈ G | x ∈ A ∧ x ∈ B},

• Vereinigungsmenge (Vereinigung) von A und B: A∪B := {x ∈ G | x ∈ A ∨ x ∈ B},

• Differenz von A und B: A \ B := {x ∈ G | x ∈ A ∧ x 6∈ B} = A ∩ B c .

Bemerkung: Mengenoperationen lassen sich mit Hilfe von Venn-Diagrammen

(nach J. Venn, 1834–1923) grafisch darstellen.

Definition 4 (Mengenprodukt) Für zwei Mengen A und B ist das Mengenprodukt definiert durch die Menge

A × B := {(a, b) | a ∈ A, b ∈ B} .

(1)

Bemerkungen:

• (a, b) bezeichnet ein geordnetes Paar. Hier ist die Reihenfolge der Elemente

wesentlich, und es gilt das Paaraxiom (G. Peano, 1897)

(a, b) = (c, d)

⇔

a=c ∧ b=d

(2)

(⇔ ist das Bikonditional aus der Aussagenlogik (“genau dann, wenn”)).

• Die Definition des Mengenprodukts lässt sich auf eine beliebige Anzahl von

Mengen verallgemeinern: Für ein n ∈ N seien M1 , M2 , . . . , Mn Mengen,

dann ist das Mengenprodukt gegeben durch

M1 ×M2 ×· · ·×Mn := {(x1 , x2 , . . . , xn ) | x1 ∈ M1 , x2 ∈ M2 , . . . , xn ∈ Mn } .

Hierbei bezeichnet (x1 , x2 , . . . , xn ) ein geordnetes n-Tupel.

• Für M1 = M2 = · · · = Mn = M schreiben wir auch

M n := M × M × · · · × M .

|

{z

}

(3)

n-mal

Beispiele:

1. Das Mengenprodukt der dreielementigen Mengen A := {1, 2, 3} und B :=

{x, y, z} ist gegeben durch die neunelementige Menge

A × B = {(1, x), (1, y), (1, z), (2, x), (2, y), (2, z), (3, x), (3, y), (3, z)} .

2. Später werden wir den Vektorraum Rn antreffen, ein n-faches Mengenprodukt der Menge der reellen Zahlen. Die Elemente von Rn (geordnete

n-Tupel) werden (n-dimensionale) Vektoren genannt. Ihre Einträge kann

man als Koordinaten von Punkten in einem n-dimensionalen Raum auffassen.

1

GRUNDLAGEN

1.2

5

Zahlen

Was sind und was sollen die Zahlen? [. . . ] die Zahlen sind freie Schöpfungen des menschlichen Geistes, sie dienen als ein Mittel, um die

Verschiedenheit der Dinge leichter und schärfer aufzufassen. Durch

den rein logischen Aufbau der Zahlen-Wissenschaft und durch das

in ihr gewonnene stetige Zahlen-Reich sind wir erst in den Stand

gesetzt, unsere Vorstellungen von Raum und Zeit genau zu untersuchen, indem wir dieselben auf dieses in unserem Geiste geschaffene

Zahlen-Reich beziehen.

(Richard Dedekind, 1893)

1.2.1

Zahlenmengen und Operationen

Die Menge R der reellen Zahlen entspricht der Menge aller Punkte auf der

Zahlengeraden. Wichtige Teilmengen von R sind:

• die natürlichen Zahlen N := {1, 2, 3, . . . }, N0 := {0, 1, 2, . . . },

• die ganzen Zahlen Z := {. . . , −2, −1, 0, 1, 2, . . . },

m, n ∈ Z, n 6= 0 .

• die rationalen Zahlen Q := m

n

Es gibt auch Erweiterungen der reellen Zahlen, z. B. die komplexen Zahlen

C := {a + ib | a, b ∈ R} ,

mit der imaginären Einheit i ∈ C \ R, i2 = −1. Es gilt N ⊆ Z ⊆ Q ⊆ R ⊆ C.

Diese Zahlenmengen enthalten im Unterschied zu den in Kap. 1.1 betrachteten

Mengen unendlich viele Elemente.

Bemerkung: Die fünf oben erwähnten Zahlenmengen N, Z, Q, R, C sind alle voneinander verschieden. Dies kann man z. B. zeigen, indem man Elemente aus den

paarweisen Differenzen angibt. So gelten z. B. −1 ∈ Z \ N, 32 ∈ Q \ Z, und

oben hatten wir bereits i ∈ C \ R gesehen. Beispiele für sog. irrationale Zahlen

(Elemente von R \ Q) sind

√

• 2 ' 1.414 . . . (Irrationalität bewiesen von Euklid, 3. Jh. v. Chr.),

• e ' 2.718 . . . (Irrationalität bewiesen von L. Euler, 1737),

• π ' 3.141 . . . (Irrationalität bewiesen von J. H. Lambert, 1761).

Auf den Zahlen können wir die Verknüpfungen Addition und Multiplikation mit

den bekannten Rechenregeln einführen. Die rationalen und die reellen Zahlen

bilden zusammen mit diesen Verknüpfungen jeweils einen Körper, wie wir später

in dieser Vorlesung sehen werden.

1

GRUNDLAGEN

1.3

6

Funktionen

Definition 5 (Funktion, Abbildung) Eine Funktion (oder Abbildung) ordnet

jedem Element x aus einer Menge D genau ein Element y aus einer Menge Z

zu:

f : D → Z, x 7→ y = f (x).

Bemerkungen:

• Wir nennen D die Definitionsmenge und Z die Zielmenge der Funktion f (manchmal schreibt man auch Df und Zf ). Das Element x ∈ D

heisst Argument der Funktion oder unabhängige Variable, das Element

y = f (x) ∈ Z heisst Funktionswert oder abhängige Variable. Wir sagen

auch, x werde durch f auf y abgebildet.

• Die Menge Gf := {(x, f (x)) | x ∈ D} ⊆ D × Z heisst der Graph der Funktion f .

Beispiele:

1. D := {1, 2, 3}, Z := {a, b, c}, f : D → Z definiert durch

f (1) := b,

f (2) := c,

f (3) := b,

ist eine Funktion. Beachten Sie, dass a ∈ Z kein Funktionswert von

f ist und dass b ∈ Z der Funktionswert von mehreren Elementen aus

D ist: f (1) = f (3) = b. Der Graph von f ist gegeben durch Gf =

{(1, b), (2, c), (3, b)}.

2. D := {1, 2, 3}, Z := {a, b, c}, f : D → Z definiert durch

f (1) := b,

f (1) := c,

f (2) := a

ist keine Funktion, weil dem Element 3 ∈ D kein Element in Z zugewiesen

wird, und weil das Element 1 ∈ D mehreren Elementen in Z zugewiesen

wird.

3. Durch die Abbildungsvorschrift x 7→ y = x2 wird eine Funktion f : R → R

definiert, deren Graph eine Parabel ist. Einige Funktionswerte von f sind

√

4

x

−3 0

2 2 3 π

1

7

f (x)

9

0 16

1

2

4 9 π2

49

(Wertetabelle). f hat bei x = 0 eine sog. Nullstelle: f (0) = 0.

4. D := {a, b} × {1, 2, 3} = {(a, 1), (a, 2), (a, 3), (b, 1), (b, 2), (b, 3)}, Z :=

{x, y, z}, g : D → Z definiert durch

g(a, 1) := x,

g(a, 2) := x,

g(b, 1) := y,

g(b, 2) := z,

g(a, 3) := z,

g(b, 3) := x

ist eine Funktion, deren Argumente geordnete Paare sind. Es ist üblich zu

sagen, g sei eine Funktion von zwei Argumenten.

1

GRUNDLAGEN

7

Für eine Menge M nennen wir jede Abbildung f : M × M → M eine innere

zweistellige Verknüpfung. Beispiele für solche Verknüpfungen sind die Addition

und die Multiplikation von Zahlen:

5. (Addition von rationalen Zahlen) + : Q × Q → Q definiert durch

(r, s) 7→ r + s

ist eine innere zweistellige Verknüpfung.

Mini-Aufgabe: Diskutieren Sie, ob für zwei beliebige rationale Zahlen r, s ∈

Q tatsächlich r + s ∈ Q gilt.

6. (Multiplikation von reellen Zahlen) · : R × R → R definiert durch

(x, y) 7→ x · y

ist eine innere zweistellige Verknüpfung.

Bemerkung: Bei der “Multiplikation mit Buchstaben” wird der Punkt oft

weggelassen, d. h. wir schreiben z. B. xy anstatt x · y.

Bemerkung: Beachten Sie, dass bei Anwendung einer inneren zweistelligen Verknüpfung die Menge M nicht verlassen wird. So ist z. B. das Ergebnis der

Addition von zwei natürlichen Zahlen (Elemente von N) wieder eine natürliche

Zahl.

1.4

Der Körper (R, +, · )

Wir betrachten die Menge R der reellen Zahlen (die Menge aller Punkte auf der

Zahlengeraden) zusammen mit den bekannten Grundrechenarten Addition und

Multiplikation.

• Die Addition ist eine innere zweistellige Verknüpfung + : R × R → R,

(x, y) 7→ x + y. Sie hat die folgenden Eigenschaften:

(A1) Assoziativität: (x + y) + z = x + (y + z), ∀ x, y, z ∈ R,

(A2) Existenz des neutralen Elements der Addition (Nullelement), 0 ∈ R:

x + 0 = 0 + x = x, ∀ x ∈ R,

(A3) Für jedes Element x ∈ R existiert das inverse Element der Addition

(Gegenzahl), −x ∈ R, mit x + (−x) = (−x) + x = 0,

(A4) Kommutativität: x + y = y + x, ∀ x, y ∈ R.

• Die Multiplikation ist eine innere zweistellige Verknüpfung · : R × R → R,

(x, y) 7→ x · y. Sie hat die folgenden Eigenschaften:

(M1) Assoziativität: (x · y) · z = x · (y · z), ∀ x, y, z ∈ R,

(M2) Existenz des neutralen Elements der Multiplikation (Einselement),

1 ∈ R: x · 1 = 1 · x = x, ∀ x ∈ R,

1

GRUNDLAGEN

8

(M3) Für jedes Element x ∈ R \ {0} existiert das inverse Element der

Multiplikation (Kehrwert), x−1 ∈ R \ {0}, mit x · x−1 = x−1 · x = 1,

(M4) Kommutativität: x · y = y · x, ∀ x, y ∈ R.

• Im Zusammenspiel der Addition mit der Multiplikation gelten die

(D) Distributivgesetze:

x · (y + z)

= x · y + x · z,

(x + y) · z

= x · z + y · z,

∀ x, y, z ∈ R.

Wenn eine Menge M mit einer Addition + und einer Multiplikation · versehen

wird, und wenn diese Verknüpfungen die Eigenschaften (A1)–(A4), (M1)–(M4),

sowie (D) erfüllen (wobei natürlich überall R durch M ersetzt werden muss),

dann nennen wir das Tripel (M, +, · ) einen Körper. Oft sagen wir auch einfach, M sei ein Körper, und nehmen dabei an, dass es klar ist, mit welchen

Verknüpfungen + und · die Menge M versehen ist.

Richard Dedekind schreibt über den Namen “Körper” (1893):

Dieser Name soll, ähnlich wie in den Naturwissenschaften, in der

Geometrie und in der menschlichen Gesellschaft, auch hier ein System bezeichnen, das eine gewisse Vollständigkeit, Vollkommenheit,

Abgeschlossenheit besitzt, wodurch es als ein organisches Ganzes,

als eine natürliche Einheit erscheint.

Bemerkungen:

• Die neutralen Elemente aus (A2) und (M2) (Nullelement, Einselement)

sind eindeutig bestimmt, d. h. es gibt keine weitere reelle Zahl mit diesen

Eigenschaften. Wir zeigen dies hier für das Nullelement 0 ∈ R: Sei 00 ∈ R

ein weiteres Nullelement; es gelten also (A2)

x = x + 0,

0

0 + x = x,

(4)

∀ x ∈ R,

(4)

∀ x ∈ R.

(5)

(5)

Dann gilt 00 = 00 + 0 = 0.

• Für jedes x ∈ R gelten

(A2)

(D)

(A2)

(D)

x · 0 = x · (0 + 0) = x · 0 + x · 0,

0 · x = (0 + 0) · x = 0 · x + 0 · x.

Wegen der Eindeutigkeit des Nullelements gilt also

x · 0 = 0 · x = 0,

∀ x ∈ R.

(6)

1

GRUNDLAGEN

9

• Die neutralen Elemente 0, 1 ∈ R erfüllen 1 6= 0. Wir führen einen Widerspruchsbeweis und nehmen an, diese Aussage sei falsch, d. h. es gelte

tatsächlich 1 = 0. Dann gilt für jedes x ∈ R:

(M2)

x = x·1

Annahme

=

(6)

x · 0 = 0.

Wir können aber ein x ∈ R mit x 6= 0 wählen, also ist dies ein Widerspruch!

Die Aussage 1 6= 0 muss also wahr sein.

• Die inversen Elemente aus (A3) und (M3) (Gegenzahl, Kehrwert) sind

eindeutig bestimmt, d. h. es gibt keine weitere reelle Zahl mit diesen Eigenschaften.

• Mit Hilfe des (eindeutigen) inversen Elements der Addition (Gegenzahl)

(A4)

definieren wir die Subtraktion x − y := x + (−y) = (−y) + x, x, y ∈ R.

• Mit Hilfe des (eindeutigen) inversen Elements der Multiplikation (Kehrwert) definieren wir die Division

x

y

(M4)

:= x · y −1 = y −1 · x, x, y ∈ R, y 6= 0.

• Im Fall x = 1 erhalten wir

1 Def. Division

(M2)

=

1 · y −1 = y −1 ,

y

d. h.

1

y

(7)

ist der Kehrwert von y ∈ R \ {0}.

• Mit der Gegenzahl −1 ∈ R des Einselements 1 ∈ R erhalten wir

(M2)

(D)

(A3)

(6)

x + (−1) · x = 1 · x + (−1) · x = (1 + (−1)) · x = 0 · x = 0,

für alle x ∈ R. Wegen der Eindeutigkeit der Gegenzahl gilt daher

−x = (−1) · x,

∀ x ∈ R,

(8)

d. h. (−1) · x ist die Gegenzahl von x ∈ R.

In der folgenden Tabelle geben wir für verschiedene Zahlenmengen (Kap. 1.2.1),

versehen mit der üblichen Addition und Multiplikation, an, welche Körpereigenschaften erfüllt sind und welche nicht.

M

N

N0

Z

Q

R

C

(A1)

X

X

X

X

X

X

(A2)

(A3)

X

X

X

X

X

X

X

X

X

(A4)

X

X

X

X

X

X

(M1)

X

X

X

X

X

X

(M2)

X

X

X

X

X

X

(M3)

X

X

X

(M4)

X

X

X

X

X

X

(D)

X

X

X

X

X

X

Gemäss dieser Tabelle sind die Tripel (Q, +, · ), (R, +, · ) und (C, +, · ) Körper,

die Tripel (N, +, · ), (N0 , +, · ) und (Z, +, · ) hingegen nicht.

Bemerkung: Die Addition und Multiplikation von komplexen Zahlen (Elemente

von C) führen wir in MLAE2 ein.

1

GRUNDLAGEN

1.4.1

10

Auflösen von linearen Gleichungen

Mit Hilfe der Körpereigenschaften (A1)–(A4), (M1)–(M4) und (D) können wir

lineare Gleichungen lösen. In Ihrer Schulzeit haben Sie schon oft Gleichungen

gelöst, aber vielleicht ohne genauer über die dabei verwendeten Rechenregeln

nachzudenken. Dies wollen wir hier nachholen.

Seien z. B. drei reelle Zahlen a, b, c ∈ R gegeben, dann können wir die lineare

Gleichung

(a · x) + b = c

(9)

betrachten. Wir nennen a, b, c die Koeffizienten der Gleichung und wollen diese

nach der Unbekannten x ∈ R auflösen. Wir betrachten zunächst die linke Seite

der Gleichung (9): gemäss der Klammersetzung werden zuerst die reellen Zahlen

a und x miteinander multipliziert – dies ergibt die (unbekannte) reelle Zahl

a · x. Zu dieser reellen Zahl wird die reelle Zahl b addiert, und das (unbekannte)

Ergebnis (a · x) + b ist wieder eine reelle Zahl. Gesucht sind jetzt Werte von x, so

dass diese reelle Zahl gleich c ist. Jede derartige Zahl x ∈ R ist eine Lösung der

Gleichung (9). Die Lösungsmenge der Gleichung (9) enthält sämtliche Lösungen:

L = {x ∈ R | x ist Lösung von (9)} = {x ∈ R | (a · x) + b = c} ⊆ R.

Mit der üblichen Konvention “Punkt vor Strich” können wir die Klammer auf

der linken Seite auch weglassen: a · x + b bedeutet (a · x) + b und nicht etwa

a · (x + b)!

Durch Anwenden der Subtraktion (Addition der Gegenzahl) formen wir die

Gleichung (9) um zu

a·x

(A2)

=

(9)

=

(A3)

(A1)

a · x + 0 = a · x + (b + (−b)) = (a · x + b) + (−b)

c + (−b)

Def. Subtraktion

=

c − b.

Weil c − b für reelle Zahlen b, c wieder eine reelle Zahl ist, genügt es, wenn wir

die lineare Gleichung

a·x=b

(10)

für gegebene reelle Zahlen a, b ∈ R nach x auflösen können (wobei i. A. die

Werte von b in (9) und (10) verschieden sind!): in einer Lösung von (10) muss

lediglich b durch c − b ersetzt werden, um eine Lösung von (9) zu erhalten.

Beispiel: Die Gleichung

3x − 1 = 4

(11)

ist von der Form (9) mit a = 3, b = −1 und c = 4 (wobei wir den Punkt für die

Multiplikation weggelassen haben). Durch Subtraktion von −1 (Addition der

Gegenzahl 1) auf beiden Seiten bringen wir (11) zuerst in die Form (10):

(11)

3x = 3x − 1 + 1 = 4 + 1 = 5.

(12)

Die Gleichung (12) ist von der Form (10) mit a = 3 und b = 5. Sie hat genau

eine Lösung, nämlich x = 35 ∈ Q ⊆ R. Derselbe Wert von x ist natürlich auch

die (einzige) Lösung der Gleichung (11).

1

GRUNDLAGEN

11

Wir betrachten jetzt die allgemeine Lösung der linearen Gleichung (10),

d. h. für beliebig vorgegebene reelle Zahlen a, b ∈ R. Wir unterscheiden dabei

zwei Fälle:

a 6= 0: In diesem Fall hat die Gleichung (10) genau eine Lösung, die wir durch

Division durch a auf beiden Seiten (Multiplikation mit dem Kehrwert von

a) bestimmen:

(M2)

(M3)

(M1)

(10)

x = 1 · x = (a−1 · a) · x = a−1 · (a · x) = a−1 · b

Def. Division

=

b

.

a

(6)

a = 0: In diesem Fall lautet die Gleichung (10): 0 = 0 · x = b. Die Lösungsmenge

der Gleichung hängt jetzt vom Wert des Koeffizienten b ab:

b = 0: In diesem Fall hat die Gleichung (10) unendlich viele Lösungen; die

Gleichung b = 0 ist nämlich erfüllt für jede beliebige reelle Zahl x.

b 6= 0: In diesem Fall hat die Gleichung (10) keine Lösung; es gibt keinen

Wert x ∈ R, für den die Gleichung b = 0 erfüllt ist.

Wir fassen diese Erkenntnisse im folgenden Satz zusammen:

Satz 1 Für gegebene Koeffizienten a, b ∈ R ist die Lösungsmenge der linearen

Gleichung

a·x=b

gegeben durch

b

(genau eine Lösung)

a , a 6= 0

L=

R,

a = 0, b = 0 (unendlich viele Lösungen) .

∅,

a = 0, b =

6 0 (keine Lösung)

(13)

Später werden wir sehen, dass die drei Fälle “genau eine Lösung”, “unendliche

viele Lösungen” und “keine Lösung” auch bei linearen Gleichungssystemen wieder auftreten. Dazu müssen wir zuerst Vektorräume und Matrizen definieren.

1.5

Der Vektorraum (Rn , +, · )

Sei (K, +, · ) ein Körper (Kap. 1.4) und n ∈ N eine natürliche Zahl, dann betrachten wir das n-fache Mengenprodukt

K n = K × K × · · · × K = {(v1 , v2 , . . . , vn ) | v1 ∈ K, v2 ∈ K, . . . , vn ∈ K}

|

{z

}

n-mal

der geordneten n-Tupel von Elementen in K. Die Elemente von K n heissen

Vektoren (daher auch der Buchstabe v). Versehen wir K n mit den zweistelligen

Verknüpfungen

• Vektoraddition + und

1

GRUNDLAGEN

12

• Skalarmultiplikation · (nicht zu verwechseln mit dem Skalarprodukt, das

erst später eingeführt wird!)

(die natürlich gewisse Eigenschaften erfüllen müssen), so erhalten wir einen Koordinatenraum der Dimension n. Dieser Koordinatenraum ist ein Spezialfall

eines Vektorraumes, und seine Elemente heissen Koordinatenvektoren. In diesem Kapitel wollen wir uns auf den vermutlich aus der Mittelschule bekannten

Fall K = R (mit der bekannten Addition und Multiplikation) beschränken. Die

Vektoren des R2 (n = 2) lassen sich besonders leicht grafisch darstellen.

Für eine natürliche Zahl n ∈ N betrachten wir also das Mengenprodukt

(Def. 4)

Rn = R × R × · · · × R = {(v1 , v2 , . . . , vn ) | v1 ∈ R, v2 ∈ R, . . . , vn ∈ R}

{z

}

|

n-mal

der geordneten n-Tupel (Vektoren) von reellen Zahlen. In der Regel verwenden

wir Spaltenvektoren, d. h. wir schreiben die Einträge (oder Komponenten) der

Vektoren untereinander:

v1

v2

v ∈ Rn ⇒ v = . , v1 , v2 , . . . , vn ∈ R

..

vn

(⇒ bezeichnet die Implikation/das Konditional aus der Aussagenlogik (“wenn,

dann”)). Für den i-ten Eintrag des Vektors v schreiben wir manchmal auch (v)i .

Für zwei Vektoren v, w ∈ Rn gilt

v=w

⇔ vi = wi ,

∀ i ∈ {1, 2, . . . , n}

⇔ v1 = w1 ∧ v2 = w2 ∧ · · · ∧ vn = wn .

Beispiel: Im Fall n = 3 gilt

10 + 3

13

7 = 2 + 5 ,

4

−2 + 6

(14)

aber

7

13

4 =

6 7 .

13

4

Auf Rn führen wir jetzt zwei Verknüpfungen ein:

• Die Vektoraddition ist eine innere zweistellige Verknüpfung

+ : Rn × R n → Rn ,

v1 + w1

v2 + w2

(v, w) 7→ v+w :=

, also (v+w)i = vi + wi ,

..

.

vn + wn

(15)

für i = 1, 2, . . . , n. Dabei bezeichnen v1 , v2 , . . . , vn ∈ R die Einträge des

Vektors v ∈ Rn und w1 , w2 , . . . , wn ∈ R die Einträge des Vektors w ∈ Rn .

1

GRUNDLAGEN

13

Beachten Sie, dass wir auf beiden Seiten von (15) dasselbe Symbol +

verwenden; auf der linken Seite haben wir jedoch eine Vektoraddition,

hingegen auf der rechten Seite eine Addition reeller Zahlen (Kap. 1.4).

Zur Unterscheidung verwenden wir in diesem Kapitel (!) unterschiedliche

Farben für die beiden Additionen.

Die Vektoraddition hat die folgenden Eigenschaften:

(V1) Assoziativität: (u+v)+w = u+(v+w), ∀ u, v, w ∈ Rn ,

(V2) Existenz des neutralen Elements der Vektoraddition (Nullvektor),

0 ∈ Rn : v+0 = 0+v = v, ∀ v ∈ Rn ,

(V3) Für jedes Element v ∈ Rn existiert das inverse Element der Vektoraddition, −v ∈ Rn , mit v+(−v) = −v+v = 0,

(V4) Kommutativität: v+w = w+v, ∀ v, w ∈ Rn .

• Die Skalarmultiplikation ist eine äussere zweistellige Verknüpfung (d. h. eines der beiden Argumente kommt “von ausserhalb”, nämlich in diesem Fall

aus R und nicht aus Rn ) · : R × Rn → Rn ,

α · v1

α · v2

(α, v) 7→ α·v :=

(16)

, also (α·v)i = α · vi ,

..

.

α · vn

für i = 1, 2, . . . , n, wobei v1 , v2 , . . . , vn ∈ R die Einträge des Vektors

v ∈ Rn bezeichnen. Wieder verwenden wir auf beiden Seiten von (16)

dasselbe Symbol · ; auf der linken Seite haben wir jedoch eine Skalarmultiplikation, hingegen auf der rechten Seite eine Multiplikation reeller

Zahlen (Kap. 1.4). Zur Unterscheidung verwenden wir in diesem Kapitel

(!) unterschiedliche Farben für die beiden Multiplikationen. Wie bei der

Multiplikation reeller Zahlen wird auch bei der Skalarmultiplikation der

Punkt oft weggelassen, man schreibt also αv anstatt α·v.

Die Skalarmultiplikation hat die folgenden Eigenschaften:

(S1) Kompatibilität der Skalarmultiplikation und der Multiplikation (auch

gemischtes Assoziativgesetz genannt):

α· (β·v) = (α · β) ·v, ∀ α, β ∈ R, ∀ v ∈ Rn ,

(S2) Das neutrale Element der Multiplikation (Einselement) 1 ∈ R ist auch

das neutrale Element der Skalarmultiplikation: 1·v = v, ∀ v ∈ Rn ,

(S3) Distributivität der Skalarmultiplikation bzgl. der Vektoraddition:

α·(v+w) = (α·v)+(α·w), ∀ α ∈ R, ∀ v, w ∈ Rn ,

(S4) Distributivität der Skalarmultiplikation bzgl. der Addition:

(α + β)·v = (α·v)+(β·v), ∀ α, β ∈ R, ∀ v ∈ Rn .

Das Tripel (Rn , +, · ) erfüllt also die Eigenschaften (V1)–(V4) und (S1)–(S4),

und wir nennen es daher einen Vektorraum.

1

GRUNDLAGEN

14

Bemerkungen:

• Im Fall n = 1 sind die Vektoren des R1 reelle Zahlen. In diesem Fall sind

die Vektoraddition + und die Addition reeller Zahlen + identisch. Genauso

sind in diesem Fall die Skalarmultiplikation · und die Multiplikation reeller

Zahlen · identisch. Daher unterscheiden wir in der Regel nicht zwischen

dem Vektorraum (R1 , +, · ) und dem Körper (R, +, · ).

• Im Fall n > 1 sind die folgenden Operationen nicht definiert im Vektorraum (Rn , +, · ):

– Die Addition einer Zahl und eines Vektors sowie

– die Multiplikation von Vektoren.

• Im Fall n = 2 lassen sich die Vektoren des R2 als Ortsvektoren in der euklidischen Ebene darstellen. Beachten Sie, dass die Einträge der Vektoren

von der Wahl des Koordinatensystems abhängen! Auch die Vektoraddition

und die Skalarmultiplikation lassen sich in diesem Fall grafisch in der Ebene darstellen. In der analytischen Geometrie werden wir auf diese Dinge

genauer eingehen. Zuerst machen wir hier aber mit der Algebra weiter.

• Das neutrale Element aus (V2) (Nullvektor) ist eindeutig bestimmt, d. h. es

gibt keinen weiteren Vektor mit dieser Eigenschaft: Sei 00 ∈ R ein weiterer

Nullvektor; es gelten also (V2)

v = v+0,

0

0 +v = v,

(17)

∀ v ∈ Rn ,

(17)

∀ v ∈ Rn .

(18)

(18)

Dann gilt 00 = 00 +0 = 0.

• Mit der Aussage (14) über die Gleichheit von Vektoren gilt

v1 + 0 1

v1

01

v2 + 02 (15) v2 02

(V2)

= .. + .. = v+0 = v =

..

.

.

.

vn + 0 n

vn

0n

v1

v2

..

.

vn

genau dann, wenn vi + 0i = vi , ∀ i ∈ {1, 2, . . . , n}. Daraus folgt wegen der

Eindeutigkeit des Nullelements 0 ∈ R: 0i = 0, i = 1, 2, . . . , n. Die Einträge

des Nullvektors 0 ∈ Rn sind also die Nullelemente 0 ∈ R:

0

0

0 = . .

(19)

..

0

1

GRUNDLAGEN

15

• Auf die gleiche Weise berechnen wir die Einträge von −v ∈ Rn für einen

gegebenen Vektor v ∈ Rn : Es gilt

0

(−v)1

v1

v1 + (−v)1

v2 + (−v)2 (15) v2 (−v)2

(V3)

(19) 0

= v+(−v) = 0 = ..

= .. +

..

..

.

.

.

.

0

(−v)n

vn

vn + (−v)n

genau dann, wenn vi + (−v)i = 0, ∀ i ∈ {1, 2, . . . , n}. Daraus folgt wegen

der Eindeutigkeit der Gegenzahl: (−v)i = −vi , i = 1, 2, . . . , n. Die Einträge von −v ∈ Rn sind also die Gegenzahlen der Einträge von v ∈ Rn :

−v1

(−1) · v1

−v2 (8) (−1) · v2 (16)

−v = . =

(20)

= (−1)·v.

..

..

.

−vn

(−1) · vn

• Wir definieren die Subtraktion von Vektoren mit Hilfe der Vektoraddition

und des inversen Elements der Vektoraddition als

(V4)

v−w := v+(−w) = (−w)+v, v, w ∈ Rn .

• Wir definieren die Division eines Vektors durch eine reelle Zahl mit Hilfe

der Skalarmultiplikation und des Kehrwerts als

v

−1

·v, α ∈ R \ {0}, v ∈ Rn .

α := α

√

Beispiel: (n = 3) Es seien α = 2, β = − 3 und

0

u = π ,

7

3

1

,

v = −5

√

2

2

e

w=

13

4

∈

R3 .

4

3

Gesucht seien die Einträge des Vektors x := α· (u+β·v) − w

α ∈ R . Zur Berechnung gehen wir schrittweise vor (wenn Sie die einzelnen Schritte in einer

solchen Berechnung verstanden haben, dann müssen Sie natürlich nicht mehr

jeden einzelnen Schritt aufschreiben):

1.

√

√

−

1

3·1

−√ 3

√

(16)

− 3 · (−5) = 5 3 ,

β · v = − 3 · −5

=

√

√

√ √

2

− 3 · 22

− 26

2

√

2.

√

√

√

0 + (−√ 3)

−√ 3

− √

3

0

(15)

u+β·v = π + 5 √3 = π + 5 √3 = π + 5√ 3 ,

7

6

7

6

7

− 26

3

3 + − 2

3 − 2

1

GRUNDLAGEN

16

3.

√

√

√

2 · (− √

3)

− √

3

−2 3√

(16)

,

α· (u+β·v) = 2· π + 5√ 3 = 2 · (π

+ 5√ 3)

= 2π + 10

√ 3

6

7

14

6

7

2· 3 − 2

6

3 −

3 − 2

4.

e

e

w

1

(7)

(16)

= · 13

=

= α−1 ·w = 2−1 · 13

4

4

α

2

4

4

5.

=

e

2

13

8

,

2

− 2e

w

(20)

,

= − 13

− = −

8

α

2

−2

e

2

13

8

1

2 ·e

1 13

2 · 4

1

2 ·4

6.

α· (u+β·v) −

w

α

=

(15)

=

√

−2 3√

− 2e

w

α· (u+β·v) + −

= 2π + 10

3 + − 13

8

√

α

14

−2

6

3 −

√

√

e

3 + −2 −2 √

3 − 2e

−2 √

2π + 10 3 + − 13 = 2π + 10 3 − 13 .

8

8

√

√

8

14

6 + (−2)

6

3 −

3 −

Alternativ können wir auch alle Rechnungen für den i-ten Eintrag machen und

am Schluss einsetzen:

w (15)

w

w

= α· (u+β·v) + −

= (α· (u+β·v))i + −

xi

=

α· (u+β·v) −

α i

α i

α i

1

(16), (20)

(15), (7)

=

α · (u+β·v)i − α−1 ·w i = α · (ui + (β·v)i ) −

·w

α

i

1

1

(16)

(D)

=

α · (ui + β · vi ) − · wi = α · ui + α · β · vi − · wi , i = 1, 2, 3.

α

α

Erst jetzt setzen wir Zahlen ein:

i=1:

i=2:

i=3:

√

√

w1

1

e

= 2 · 0 + 2 · (− 3) · 1 − · e = −2 3 − ,

α

2

2

√

w2

1 13

x2 = αu2 + αβv2 −

= 2 · π + 2 · (− 3) · (−5) − ·

α

2 4

√

13

= 2π + 10 3 − ,

8

√

√

w3

7

2 1

8 √

x3 = αu3 + αβv3 −

= 2 · + 2 · (− 3) ·

− · 4 = − 6.

α

3

2

2

3

x1 = αu1 + αβv1 −

Wie erwartet erhalten wir also dieselben Einträge wie oben.

1

GRUNDLAGEN

1.6

17

Matrizen

Definition 6 (Matrix) Sei (K, +, · ) ein Körper, und seien m, n ∈ N natürliche

Zahlen. Eine (m × n)-Matrix über K ist eine rechteckige Anordnung (Schema,

Tabelle) von Elementen aus K mit m Zeilen und n Spalten. Die Menge aller

(m × n)-Matrizen über K bezeichnen wir mit K m×n .

Bemerkungen:

• Es gilt

A ∈ K m×n

⇒

a11

a21

..

.

a12

a22

..

.

···

···

..

.

a1n

a2n

..

.

am1

am2

···

amn

A=

,

mit mn Einträgen a11 , a12 , . . . , a1n , . . . , am1 , am2 , . . . , amn ∈ K. Für den

ij-ten Eintrag der Matrix A schreiben wir aij oder (A)ij . Wir werden vor

allem den Fall K = R (reelle (m × n)-Matrizen) betrachten.

• Im Fall n = 1 erhalten wir (m × 1)-Matrizen. Für m = 1 sind dies reelle

Zahlen, für m > 1 Spaltenvektoren der Länge m. Zum Beispiel ist

√

2

−3

2

3

eine reelle (3 × 1)-Matrix oder ein Spaltenvektor der Länge 3 (Kap. 1.5).

• Zwei Matrizen A, B ∈ K m×n sind gleich, wenn alle ihre Einträge gleich

sind:

A=B

⇔

aij = bij , ∀ i ∈ {1, 2, . . . , m}, ∀ j ∈ {1, 2, . . . , n}

⇔

a11 = b11 ∧ a12 = b12 ∧ · · · ∧ a1n = b1n ∧ · · · ∧ amn = bmn .

(21)

wobei aij die Einträge der Matrix A bezeichnen und bij die Einträge der

Matrix B, i = 1, 2, . . . , m, j = 1, 2, . . . , n. Zwei Matrizen mit unterschiedlicher Zeilen- oder Spaltenzahl können niemals gleich sein.

Beispiel: Es gelten

1.2

7

3

und

1.2

7

3

√

− 3

5

√

− 3

5

2

−2

2

−2

6=

5

7

3

−2

1.2

1.2

√

6 − 3

=

2

Auf K m×n führen wir jetzt zwei Verknüpfungen ein:

2

√

− 3

7

3

5 .

−2

1

GRUNDLAGEN

18

• Die Matrizenaddition ist eine innere zweistellige Verknüpfung

+ : K m×n × K m×n → K m×n ,

a11 + b11

a12 + b12 · · · a1n + b1n

a21 + b21

a22 + b22 · · · a2n + b2n

(A, B) 7→ A+B :=

..

..

..

..

.

.

.

.

am1 + bm1 am2 + bm2 · · · amn + bmn

,

(22)

also (A+B)ij := aij + bij , für i = 1, 2, . . . , m, j = 1, 2, . . . , n. Dabei

bezeichnen die Elemente aij ∈ K die Einträge der Matrix A und die

Elemente bij ∈ K die Einträge der Matrix B. Auf der rechten Seite wird

die Addition + aus dem Körper (K, +, · ) verwendet.

Die Matrizenaddition hat die folgenden Eigenschaften:

– Assoziativität: (A+B) +C = A+ (B+C), ∀ A, B, C ∈ K m×n ,

– Existenz des neutralen Elements der Matrizenaddition (Nullmatrix),

0 ∈ K m×n : A+0 = 0+A = A, ∀ A ∈ K m×n ,

– Für jedes Element A ∈ K m×n existiert das inverse Element der

Matrizenaddition, −A ∈ K m×n , mit A+ (−A) = (−A) +A = 0,

– Kommutativität: A+B = B+A, ∀ A, B ∈ K m×n .

• Die Skalarmultiplikation (für Matrizen) ist eine äussere zweistellige Verknüpfung · : K × K m×n → K m×n ,

α · a11 α · a12 · · · α · a1n

α · a21 α · a22 · · · α · a2n

(α, A) 7→ α·A :=

(23)

,

..

..

..

..

.

.

.

.

α · am1

α · am2

···

α · amn

also (α·A)ij = α · aij , für i = 1, 2, . . . , m, j = 1, 2, . . . , n. Dabei bezeichnen

die Elemente aij ∈ K die Einträge der Matrix A. Auf der rechten Seite

wird die Multiplikation · aus dem Körper (K, +, · ) verwendet.

Die Skalarmultiplikation hat die folgenden Eigenschaften:

– Kompatibilität der Skalarmultiplikation und der Multiplikation (gemischtes Assoziativgesetz ):

α· (β·A) = (α · β) ·A, ∀ α, β ∈ K, ∀ A ∈ K m×n ,

– Das neutrale Element der Multiplikation (Einselement) 1 ∈ K ist

auch das neutrale Element der Skalarmultiplikation: 1·A = A, ∀ A ∈

K m×n ,

– Distributivität der Skalarmultiplikation bzgl. der Matrizenaddition:

α· (A+B) = (α·A) + (α·B), ∀ α ∈ K, ∀ A, B ∈ K m×n ,

– Distributivität der Skalarmultiplikation bzgl. der Addition:

(α + β) ·A = (α·A) + (β·A), ∀ α, β ∈ K, ∀ A ∈ K m×n .

1

GRUNDLAGEN

19

Bemerkungen:

• Durch einen Vergleich mit Kap. 1.5 stellen wir fest, dass die oben erwähnten Eigenschaften der Matrizenaddition + ähnlich sind wie jene der Vektoraddition, (V1)–(V4). Genauso sind die oben erwähnten Eigenschaften

der Skalarmultiplikation (für Matrizen) · ähnlich wie jene der Skalarmultiplikation (für Vektoren), (S1)–(S4). Daher haben wir hier auch dieselben

Symbole verwendet. Ausserdem nennen wir daher das Tripel (K m×n , +, · )

ebenfalls einen Vektorraum. Um Verwirrung zu vermeiden, nennen wir seine Elemente aber nicht Vektoren, sondern eben Matrizen.

• Im Fall n = 1 sind die (m × 1)-Matrizen in K m×1 Spaltenvektoren der

Länge m. In diesem Fall ist die Matrizenaddition (22) identisch mit der

Vektoraddition (15), und die Skalarmultiplikation (für Matrizen) (23) ist

identisch mit der Skalarmultiplikation (für Vektoren) (16). Wir unterscheiden daher in der Regel nicht zwischen dem Vektorraum (K m×1 , +, · ) der

(m × 1)-Matrizen und dem Vektorraum (K m , +, · ) der Spaltenvektoren

der Länge m (Kap. 1.5).

Gilt ausserdem m = 1, so unterscheiden wir nicht zwischen den Vektorräumen (K 1×1 , +, · ), (K 1 , +, · ) und dem Körper (K, +, · ).

• Im Fall n > 1 lassen sich (m × n)-Matrizen nicht wie Vektoren als Pfeile

im Raum darstellen. Wir verwenden Matrizen jedoch zur Darstellung von

sog. linearen Abbildungen zwischen Vektorräumen. Solche Abbildungen,

z. B. Spiegelungen, Drehungen und Streckungen, lassen sich geometrisch

darstellen.

• Wir berechnen die Einträge der Nullmatrix (neutrales Element der Matrizenaddition) mit Hilfe der Gleichung

a11 + 011

a12 + 012 · · · a1n + 01n

a21 + 021

a22 + 022 · · · a2n + 02n

..

..

..

..

.

.

.

.

am1 + 0m1 am2 + 0m2 · · · amn + 0mn

a11 a12 · · · a1n

011 012 · · · 01n

a22 · · · a2n

(22) a21

021 022 · · · 02n

= .

+

..

..

.

..

..

..

..

..

.

.

.

. ..

.

.

am1

···

am2

=

a11

a21

A+0 = A = .

..

am1

amn

0m1

a12

a22

..

.

···

···

..

.

a1n

a2n

..

.

am2

···

amn

0m2

···

0mn

.

Sie gilt gemäss (21) genau dann, wenn aij + 0ij = aij , ∀ i = 1, 2, . . . , m,

∀ i = 1, 2, . . . , n. Daraus folgt wegen der Eindeutigkeit des Nullelements

1

GRUNDLAGEN

20

0 ∈ K: 0ij = 0, i = 1, 2, . . . , m, j = 1, 2, . . . , n. Die Einträge der Nullmatrix 0 ∈ K m×n sind also die Nullelemente 0 ∈ K:

0 0 ··· 0

0 0 ··· 0

.

(24)

0= . . .

. . ...

.. ..

0 0 ··· 0

• Auf die gleiche Weise berechnen wir die Einträge von −A ∈ K m×n für

eine gegebene Matrix A ∈ K m×n : Es gilt

a11 + (−A)11

a12 + (−A)12 · · · a1n + (−A)1n

a21 + (−A)21

a22 + (−A)22 · · · a2n + (−A)2n

..

..

..

..

.

.

.

.

am1 + (−A)m1 am2 + (−A)m2 · · · amn + (−A)mn

a11 a12 · · · a1n

(−A)11 (−A)12 · · · (−A)1n

(−A)21 (−A)22 · · · (−A)2n

a22 · · · a2n

(22) a21

= .

..

.. +

..

..

..

..

..

..

.

.

.

.

.

.

.

· · · amn

0 0

0 0

A+ (−A) = 0 = . .

.. ..

am1

=

am2

0

0

···

···

..

.

···

0

0

..

.

(−A)m1

(−A)m2

···

(−A)mn

0

genau dann, wenn aij +(−A)ij = 0, ∀ i ∈ {1, 2, . . . , m}, ∀ j ∈ {1, 2, . . . , n}.

Daraus folgt wegen der Eindeutigkeit der Gegenzahl: (−A)ij = −aij , i =

1, 2, . . . , m, j = 1, 2, . . . , n. Die Einträge von −A ∈ K m×n sind also die

Gegenzahlen der Einträge von A ∈ K m×n :

−a11 −a12 · · · −a1n

−a21 −a22 · · · −a2n

−A =

(25)

..

..

..

..

.

.

.

.

−am1 −am2 · · · −amn

(−1) · a11 (−1) · a12 · · · (−1) · a1n

(−1) · a21 (−1) · a22 · · · (−1) · a2n

(8)

=

..

..

..

..

.

.

.

.

(−1) · am1

(23)

=

(−1) · am2

···

(−1) · amn

(−1)·A.

• Wir definieren die Subtraktion von Matrizen mit Hilfe der Matrizenaddition und des inversen Elements der Matrizenaddition als

A−B := A+ (−B) = (−B) +A, A, B ∈ K m×n .

1

GRUNDLAGEN

21

• Wir definieren die Division einer Matrix durch ein Körperelement mit

Hilfe der Skalarmultiplikation (für Matrizen) und des Kehrwerts als A

α :=

α−1 ·A, α ∈ K \ {0}, A ∈ K m×n .

√

Beispiel: (K = R) Seien α = 2, β = 43 und

5 √

0 e2 −1

3 0

√

7

A=

, B=

∈ R2×3 .

2

7

0 −π 4

− 23

3

2

2×3

Wir wollen die Matrix (α·A) + B

berechnen.

β ∈R

1. Wir berechnen die Matrix

√

√

0 e2 −1

2·0

(23)

√

√

α·A =

2·

=

2

2

7

−

2

· 73

3

3

2

√ !

√ 2

2e

− 2

0

√

√

∈ R2×3 .

=

7 2

−232

1

3

√

2 · e2

√

2 · − 23

!

√

2 · (−1)

√ √2

2· 2

2. Wir berechnen die Matrix

B

β

=

(16)

=

5 √

1

4

3 0

7

β ·B = ·B = ·

0 −π 4

β

3

√

4 5

√

4

4

4 3

20

3

3 · 7

3 ·

3 ·0

21

3

=

4

4

4

0 − 4π

3 ·0

3 · (−π)

3 ·4

3

(7)

−1

0

16

3

∈ R2×3 .

3. Wir berechnen die Summe

B

(α·A) +

β

=

(22)

=

=

√

√ ! √

4 3

20

− 2

0

21

3

+

16

7 2

0 − 4π

−232

1

3

3

3

!

√ 2 4√3

√

20

0√+ 21

2e + 3

− 2+0

√

7 2

2 2

4π

1 + 16

3 +0 − 3 + − 3

3

!

√

√

√

20

2e2√+ 4 3 3 − 2

21

√

∈ R2×3 .

7 2

2 2+4π

19

−

3

3

3

0

√

2

2e

√

Im Kap. 1.5 hatten wir bereits bemerkt, dass wir zwei Vektoren nicht miteinander multiplizieren können. Genauso können wir bisher auch zwei Matrizen nicht

miteinander multiplizieren. Wir führen jetzt eine neue Operation ein, um dies

zu ermöglichen.

Definition 7 (Matrizenmultiplikation) Für `, m, n ∈ N ist die Matrizenmultiplikation eine zweistellige Verknüpfung · : K `×m × K m×n → K `×n , (A, B) 7→

A·B. Die Einträge des Matrizenprodukts A·B ∈ K `×n sind dabei definiert als

(A·B)ik :=

m

X

j=1

aij · bjk ,

i = 1, 2, . . . , `, k = 1, 2, . . . , n,

(26)

1

GRUNDLAGEN

22

wobei aij ∈ K, i = 1, 2, . . . , `, j = 1, 2, . . . , m, die Einträge der Matrix A ∈

K `×m bezeichnen und bjk ∈ K, j = 1, 2, . . . , m, k = 1, 2, . . . , n, die Einträge

der Matrix B ∈ K m×n .

Bemerkungen:

• Wir verwenden in diesem Kapitel (!) drei verschiedene Farben für die Matrizenmultiplikation · , die Skalarmultiplikation (für Matrizen) · und für

die Multiplikation · im Körper K. Auch der Punkt für die Matrizenmultiplikation wird oft weggelassen, man schreibt also AB anstatt A·B.

• Das Matrizenprodukt A·B ist genau dann definiert, wenn die Anzahl der

Spalten von A gleich der Anzahl der Zeilen von B ist. Die Anzahl der

Zeilen von A·B ist dann gleich der Anzahl der Zeilen von A, und die

Anzahl der Spalten von A·B ist gleich der Anzahl der Spalten von B.

• Das Symbol

m

X

bezeichnet eine Summe der nachfolgenden Grössen mit

j=1

einem Summationsindex j, dessen Wert alle natürlichen Zahlen von 1 bis

m annimmt. Der Ausdruck in (26) ist daher eine Abkürzung:

m

X

aij · bjk = (ai1 · b1k ) + (ai2 · b2k ) + (ai3 · b3k ) + · · · + (bim · bmk ),

j=1

für i = 1, 2, . . . , `, k = 1, 2, . . . , n.

Beispiele: (K = R)

1. (` = 2, m = n = 3) Wir betrachten die reellen Matrizen

1

0 3.5

√

π −1 √0

A=

∈ R2×3 , B = 2 −3 34 ∈ R3×3 .

2 34

3

0

2

0

Das Matrizenprodukt A·B ∈ R2×3 ist eine reelle (2 × 3)-Matrix. Das Produkt B·A hingegen ist nicht definiert, denn die Anzahl der Spalten von B

ist nicht gleich der Anzahl der Zeilen von A! Wir berechnen exemplarisch

zwei Einträge des Matrizenprodukts A·B ∈ R2×3 gemäss Def. 7 (26):

√

√

(A·B)11 = (π · 1) + ((−1) · 2) + (0 · 0) = π − 2,

√

4 3

(A·B)23 = (2 · 3.5) +

·

+ ( 3 · 0) = 7 + 1 = 8.

3 4

Nachdem wir alle sechs Einträge des Matrizenprodukts A·B berechnet

haben, erhalten wir

√

π − √2

3

3.5π − 34

√

A·B =

∈ R2×3 .

2 + 34 2 2 3 − 4

8

1

GRUNDLAGEN

23

2. (` = 1, m = n = 2) Wir betrachten die reellen Matrizen

0 √43

A = 1 3 ∈ R1×2 , B =

∈ R2×2 .

−2

2

Das Matrizenprodukt A·B ∈ R1×2 ist eine reelle (1 × 2)-Matrix:

0 √34

1 3 ·

A·B =

−2

2

√ =

1 · 0 + 3 · (−2) 1 · 43 + 3 · 2

√ =

−6 34 + 3 2 ∈ R1×2 .

Das Matrizenprodukt B·A ist nicht definiert, denn die Anzahl der Spalten

von B ist nicht gleich der Anzahl der Zeilen von A.

Die Matrizenmultiplikation hat die folgenden Eigenschaften:

• Assoziativität:

(A·B) ·C = A· (B·C), ∀ A ∈ K `×m , ∀ B ∈ K m×n , ∀ C ∈ K n×p .

• Kompatibilität der Matrizenmultiplikation und der Skalarmultiplikation

für Matrizen (gemischtes Assoziativgesetz):

α· (A·B) = (α·A) ·B, ∀ α ∈ K, ∀ A ∈ K `×m , ∀ B ∈ K m×n ,

• Distributivität der Matrizenmultiplikation bzgl. der Matrizenaddition:

A· (B+C)

=

(A·B) + (A·C) ,

∀ A ∈ K `×m , ∀ B, C ∈ K m×n ,

(A+B) ·C

=

(A·C) + (B·C) ,

∀ A, B ∈ K `×m , ∀ C ∈ K m×n .

Im Fall ` = m = n ist das Matrizenprodukt · : K n×n × K n×n → K n×n eine

innere zweistellige Verknüpfung, d. h. das Matrizenprodukt von zwei (sog. quadratischen) (n × n)-Matrizen ist wieder eine (n × n)-Matrix. In diesem Fall gilt

zusätzlich die

– Existenz des neutralen Elements der Matrizenmultiplikation (Einheitsmatrix), I ∈ K n×n : I·A = A·I = A, ∀ A ∈ K n×n .

Wir berechnen die Einträge der Einheitsmatrix aus den Gleichungen

((I)i1 · a1k ) + ((I)i2 · a2k ) + · · · + ((I)ii · aik ) + · · · + ((I)in · ank )

n

X

=

(I)ij · ajk = (I·A)ik = (A)ik = aik , ∀ i, k ∈ {1, 2, . . . , n}.

j=1

Daher muss gelten: (I)ii = 1 und (I)ij = 0, falls j 6= i. Dies schreiben wir mit

dem Kronecker-Delta δij (nach L. Kronecker, 1823–1891) als

1, i = j

(I)ij = δij :=

, i, j = 1, 2, . . . , n.

0, i 6= j

1

GRUNDLAGEN

24

Die Einheitsmatrix ist also eine sog. Diagonalmatrix, die auf der Hauptdiagonalen das Einselement und sonst überall das Nullelement des Körpers (K, +, · )

enthält:

1 0 ··· 0

0 1 ··· 0

n×n

I= . . .

.

(27)

.. ∈ K

.

.

.

. .

. .

0 0 ··· 1

Bemerkung: Für quadratische Matrizen A, B ∈ K n×n sind immer beide Matrizenprodukte A·B ∈ K n×n und B·A ∈ K n×n definiert. Diese sind jedoch im

Allgemeinen nicht gleich, A·B 6= B·A (s. z. B. Serie 3, Aufg. 3c, d), d. h. das

Matrizenprodukt ist nicht kommutativ.

Wir wollen jetzt einige Spezialfälle von Matrizenmultiplikationen betrachten.

Dazu führen wir noch den Begriff der transponierten Matrix ein:

Definition 8 (Transposition) Die Transposition ist eine Funktion

>

: K m×n → K n×m ,

A 7→ A> .

(28)

Die Einträge der transponierten Matrix A> ∈ K n×m sind gegeben durch

A>

:= (A)ji , i = 1, 2, . . . , n, j = 1, 2, . . . , m.

(29)

ij

Bemerkungen:

• Die i-te Zeile von A> ist die i-te Spalte von A,

A> ist die j-te Zeile von A, d. h.

a11 a12 · · · a1n

a21 a22 · · · a2n

A= .

..

..

..

..

.

.

.

⇒

am1 am2 · · · amn

a11 a21 · · · am1

a12 a22 · · · am2

A> = .

..

..

..

..

.

.

.

a1n a2n · · · amn

und die j-te Spalte von

∈ K m×n

∈ K n×m .

• Im Fall n = 1 wird aus dem Spaltenvektor der Länge m, v ∈ K m×1 , durch

Transposition der Zeilenvektor der Länge m, v > ∈ K 1×m :

v1

v2

v = . ∈ K m×1 ⇒ v > = v1 v2 · · · vm ∈ K 1×m .

..

vm

1

GRUNDLAGEN

25

Beispiel: Aus der reellen (2 × 3)-Matrix

√

1

3

A=

0

− 53

π

0

∈ R2×3

erhalten wir durch Transposition die reelle (3 × 2)-Matrix

1 − 53

√

A> = 3 0 ∈ R3×2 .

π

0

Zeilenvektor mal Spaltenvektor Im Fall ` = n = 1 ist das Matrizenprodukt eines Zeilenvektors der Länge m, v > ∈ K 1×m , und eines Spaltenvektors der

Länge m, w ∈ K m×1 , gegeben durch das Körperelement v > ·w ∈ K 1×1 ≡ K,

v > ·w = v > ·w

11

=

m

X

v1j · wj1 = (v1 · w1 ) + (v2 · w2 ) + · · · + (vm · wm ).

j=1

Daher können wir im allgemeinen Fall den Eintrag (A·B)ik auch auffassen als

das Produkt der i-ten Zeile von A (Zeilenvektor der Länge m) und der k-ten

Spalte von B (Spaltenvektor der Länge m).

Spaltenvektor mal Zeilenvektor Im Fall m = 1 ist das Matrizenprodukt

eines Spaltenvektors der Länge `, v ∈ K `×1 , und eines Zeilenvektors der Länge

n, w> ∈ K 1×n , gegeben durch die (` × n)-Matrix v·w> ∈ K `×n ,

v·w>

ik

=

1

X

vij · wjk = vi1 · w1k = vi · wk ,

i = 1, 2, . . . , `, k = 1, 2, . . . , n.

j=1

Der ik-te Eintrag des Matrizenprodukts v·w> ∈ K `×n ist also gegeben durch

das Produkt des i-ten Eintrags des Spaltenvektors v ∈ K `×1 und des k-ten

Eintrags des Zeilenvektors w> ∈ K 1×n .

Matrix mal Spaltenvektor Im Fall `, m > 1, n = 1, ist das Produkt der

(` × m)-Matrix A ∈ K `×m und des Spaltenvektors der Länge m, v ∈ K m×1 ,

gegeben durch den Spaltenvektor der Länge `, A·v ∈ K `×1 . Die Einträge dieses

Vektors sind gegeben durch

(A·v)i = (A·v)i1 =

m

X

aij · vj1 =

j=1

m

X

aij · vj ,

i = 1, 2, . . . , `.

j=1

Wir schreiben manchmal auch

A·v =

m

X

j=1

vj · (A)· j ∈ K `×1 ,

wobei

(A)· j :=

a1j

a2j

..

.

a`j

die j-te Spalte der Matrix A bezeichnet, j = 1, 2, . . . , m.

∈ K `×1

2

LINEARE GLEICHUNGSSYSTEME

26

Zeilenvektor mal Matrix Im Fall ` = 1, m, n > 1, ist das Produkt des

Zeilenvektors der Länge m, v > ∈ K 1×m , und der (m × n)-Matrix A ∈ K m×n

gegeben durch den Zeilenvektor der Länge n, v > ·A ∈ K 1×n . Die Einträge dieses

Vektors sind gegeben durch

v > ·A

k

= v > ·A

1k

=

m

X

v1j · ajk =

j=1

Wir schreiben manchmal auch

m

X

v > ·A =

vj · (A)j · , wobei

m

X

vj · ajk ,

k = 1, 2, . . . , n.

j=1

aj1

(A)j · :=

aj2

···

ajn

∈ K 1×n

j=1

die j-te Zeile der Matrix A bezeichnet, j = 1, 2, . . . , m.

2

2.1

Lineare Gleichungssysteme

Einführung

Wir beginnen mit einer typischen Textaufgabe, die auf ein lineares Gleichungssystem führt:

Ein Hotel verfügt über eine Kapazität von 400 Betten in insgesamt

216 Zimmern, darunter Ein- und Zweibettzimmer. Wieviele Zimmer

von jeder Kategorie gibt es in diesem Hotel?

Wir definieren als Unbekannte die Zahlen

x1 : Anzahl der Einbettzimmer,

x2 : Anzahl der Zweibettzimmer.

Jetzt stellen wir aus den Informationen im Text zwei lineare Gleichungen auf:

(I)

(II)

x1 + 2x2

=

400 (Anzahl der Betten),

x1 + x2

=

216 (Anzahl der Zimmer).

Dies ist ein lineares Gleichungssystem mit zwei Gleichungen und zwei Unbekannten. Durch Subtraktion der zweiten Gleichung von der ersten erhalten wir

eine neue zweite Gleichung (symbolisch II ← I − II), in der x1 nicht mehr

vorkommt:

x1 + 2x2

=

400,

x2

=

184.

Damit haben wir das lineare Gleichungssystem auf Zeilenstufenform gebracht.

Dieses können wir durch Rückwärtseinsetzen lösen: wir setzen den Wert x2 =

184 in die erste Gleichung ein und erhalten

x1 + 2 · 184 = x1 + 368 = 400

⇔

x1 = 400 − 368 = 32.

Die Lösung der Textaufgabe von oben lautet also:

In dem Hotel gibt es 32 Einbettzimmer und 184 Zweibettzimmer.

2

LINEARE GLEICHUNGSSYSTEME

2.2

27

Allgemeine Form und Matrixform

Sei (K, +, · ) ein Körper, und seien m, n ∈ N. Jedes lineare Gleichungssystem

mit m Gleichungen und n Unbekannten kann in die allgemeine Form

a11 x1

a21 x1

..

.

+

+

..

.

a12 x2

a22 x2

..

.

am1 x1

+

am2 x2

+ ···

+ ···

.. . .

.

.

+ ···

+

+

..

.

a1n xn

a2n xn

..

.

=

=

..

.

b1 ,

b2 ,

..

.

+

amn xn

= bm ,

(30)

gebracht werden mit aij , bi , xj ∈ K, i = 1, 2, . . . , m, j = 1, 2, . . . , n.

Beispiel: (K = R, m = 2, n = 3) Das lineare Gleichungssystem

3

3(x1 − x2 ) + x3

4

4x1 + x2 − 4

=

x1 + 5,

=

4(x1 − 2) −

√

2x3 ,

ist nicht in der allgemeinen Form (30), kann aber durch elementare Umformungen auf diese gebracht werden: Wir bringen alle Terme, die Unbekannte

enthalten, auf die linke Seite und alle Terme ohne Unbekannte auf die rechte

Seite. Damit erhalten wir das lineare Gleichungssystem in der allgemeinen Form

(30),

3

2x1 − 3x2 + x3

4

√

x2 + 2x3

=

5,

= −4.

Im Folgenden nehmen wir an, dass unser lineares Gleichungssystem bereits in

der allgemeinen Form (30) vorliegt.

Für ein gegebenes lineares Gleichungssystem in allgemeiner Form (30) fassen

wir die Koeffizienten aij ∈ K, i = 1, 2, . . . , m, j = 1, 2, . . . , n, in der Koeffizientenmatrix zusammen:

a11 a12 · · · a1n

a21 a22 · · · a2n

m×n

A := .

.

..

.. ∈ K

..

..

.

.

.

am1

am2

···

amn

Ausserdem fassen wir die Unbekannten x1 , x2 , . . . , xn sowie die Einträge der

rechten Seite b1 , b2 , . . . , bm in den Vektoren

x1

b1

x2

b2

x := . ∈ K n , b := . ∈ K m

.

.

.

.

xn

bm

zusammen. Damit erhalten wir das lineare Gleichungssystem in der Matrixform,

Ax = b.

(31)

2

LINEARE GLEICHUNGSSYSTEME

Auf der linken

vektor) Ax =

a11 a12

a21 a22

..

..

.

.

am1

|

28

Seite von (31) steht das Matrizenprodukt (Matrix mal Spalten···

···

..

.

a1n

a2n

..

.

am2 · · ·

{z

amn

m×n

}|

x1

x2

..

.

Def. 7

=

xn

{z }

n×1

|

a11 x1 + a12 x2 + · · · + a1n xn

a21 x1 + a22 x2 + · · · + a2n xn

..

.

,

am1 x1 + am2 x2 + · · · + amn xn

{z

}

m×1

und dies sind genau die Ausdrücke auf der linken Seite des linearen Gleichungssystems in der allgemeinen Form (30). Aus der Definition der Gleichheit von

Vektoren (14) wissen wir, dass

Ax = b

⇔

ai1 x1 + ai2 x2 + · · · ain xn = bi , ∀ i ∈ {1, 2, . . . , m},

und daher sind die allgemeine Form (30) und die Matrixform (31) eines linearen

Gleichungssystems tatsächlich äquivalent.

Später werden wir oft mit der erweiterten Koeffizientenmatrix arbeiten, die

entsteht, indem man zur Koeffizientenmatrix A die rechte Seite b als Spalte

hinzufügt:

a11 a12 · · · a1n b1

a21 a22 · · · a2n b2

m×(n+1)

.

(A | b) = .

.. ∈ K

..

..

..

..

.

.

.

.

am1

2.3

am2

···

amn

bm

Lineare Gleichungssysteme in Zeilenstufenform

In diesem Kapitel sei (K, +, · ) ein Körper, und m, n ∈ N. Die folgenden Definitionen gelten zunächst für beliebige Matrizen A ∈ K m×n . Erst später nehmen

wir an, dass es sich dabei um die Koeffizientenmatrix eines linearen Gleichungssystems mit m Gleichungen und n Unbekannten (Kap. 2.2) handelt.

Definition 9 (Nullzeile, Leitkoeffizient) Seien A ∈ K m×n und i ∈ {1, 2, . . . , m}.

• Die i-te Zeile der Matrix A ist eine Nullzeile, falls aij = 0, ∀ j ∈ {1, 2, . . . , n}.

• Ist die i-te Zeile der Matrix A keine Nullzeile (also eine Nichtnullzeile),

so heisst der Eintrag aiji 6= 0 mit ji := min{j ∈ {1, 2, . . . , n} | aij 6= 0} der

Leitkoeffizient dieser Zeile.

Beispiel: Wir betrachten die Matrix

0

π

A :=

0

0

2

0

0

0

−1

√

2

∈ R4×3 .

0

1

2

LINEARE GLEICHUNGSSYSTEME

29

Offensichtlich ist die dritte Zeile dieser Matrix eine Nullzeile. Die übrigen Zeilen

sind Nichtnullzeilen, und wir finden die Leitkoeffizienten

i=1: 2

i=2: π

i=4: 1

(j1 = 2),

(j2 = 1),

(j4 = 3).

Definition 10 (Matrix in Zeilenstufenform, Rang) Die Matrix A ist in Zeilenstufenform, falls sie die beiden folgenden Eigenschaften erfüllt:

1. Alle Nichtnullzeilen liegen oberhalb aller Nullzeilen und

2. der Leitkoeffizient jeder Nichtnullzeile liegt weiter rechts als der Leitkoeffizient der darüberliegenden Zeile.

Der Rang einer Matrix in Zeilenstufenform (!) ist die Anzahl ihrer Nichtnullzeilen (oder ihrer Leitkoeffizienten).

Bemerkungen:

• Den Rang einer Matrix A ∈ K m×n in Zeilenstufenform bezeichnen wir

mit rang(A). Es gilt rang(A) ∈ {0, 1, 2, . . . , min{m, n}} und rang(A) = 0

⇔ A = 0 (die Nullmatrix 0 ist die einzige Matrix mit Rang 0).

• Wir werden später in dieser Vorlesung den Rang einer Matrix für beliebige

Matrizen definieren. Die obige Definition des Rangs gilt nur für Matrizen

in Zeilenstufenform!

Beispiele:

1. Die Matrix

0 2 0

A := 0 0 0

0 0 0

√1

2

0

0

−2 ∈ R3×5

0

ist in Zeilenstufenform mit j1 = 2, j2 = 4 und rang(A) = 2.

2. Die Matrix

A :=

π

0

0

0

0

0

2

0

0

0

1

−1

√

2

0

0

∈ R5×3

ist in Zeilenstufenform mit j1 = 1, j2 = 2, j3 = 3 und rang(A) = 3.

3. Die Matrizen

0 −1

A := 0 0

0 0

√

2

0

2

3

4

3

0 ∈ R3×4

π

3

und B := √0

2

1

−1 ∈ R3×2

2

2

LINEARE GLEICHUNGSSYSTEME

30

sind nicht in Zeilenstufenform: In der Matrix A liegt eine Nichtnullzeile

unterhalb einer Nullzeile, und in der Matrix B liegt der Leitkoeffizient der

dritten Zeile nicht weiter rechts als der Leitkoeffizient der zweiten Zeile

(j1 = 1, j2 = 2, j3 = 1 < j2 ).

Definition 11 (lineares Gleichungssystem in Zeilenstufenform) Das lineare Gleichungssystem Ax = b mit m Gleichungen und n Unbekannten ist in Zeilenstufenform, falls seine erweiterte Koeffizientenmatrix (A | b) ∈ K m×(n+1) in

Zeilenstufenform ist.

Bemerkung: Ist die erweiterte Koeffizientenmatrix (A | b) in Zeilenstufenform,

so ist auch die Koeffizientenmatrix A in Zeilenstufenform, und es gilt rang(A) ≤

rang(A | b). Dies lesen wir aus der grafisch aus der Gestalt der erweiterten Koeffizientenmatrix ab (mit r = rang(A)): (A | b) =

0 ···

0 | a1j1 · · · · · ·

···

··· ···

···

· · · · · · · · · a1n

0 ··· ···

·

·

·

·

·

·

0

|

a

·

·

·

·

·

·

·

·

·

·

· · · · · · · · a2n

2j

2

.. . .

..

.

.

.

.

.

.

.

.

.

.. ... ...

..

..

..

..

..

..

..

..

.

.

.

0 ··· ···

·

·

·

·

·

·

·

·

·

·

·

·

·

·

·

0

|

a

·

·

·

·

·

·

·

·

·

a

rj

rn

r

0 ··· ···

···

··· ···

···

··· ···

···

··· ··· ···

0

0 ··· ···

·

·

·

·

·

·

·

·

·

·

·

·

·

·

·

·

·

·

·

·

·

·

·

·

·

·

·

·

·

·

0

. .

..

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

···

0

···

···

···

···

···

···

···

···

···

···

···

0

Es gilt

r = rang(A) = rang(A | b)

⇔

br+1 = br+2 = · · · = bm = 0.

Falls bi 6= 0 für ein i ∈ {r + 1, r + 2, . . . , m}, so gilt r = rang(A) < rang(A | b).

Beispiele:

1. Die erweiterte Koeffizientenmatrix des linearen Gleichungssystems aus Serie 5, Aufg. 5, ist gegeben durch

2 −5

−6√

4

(A | b) := 0 −2 1 − 2 0 ∈ R3×(3+1) .

(32)

0 0

7

2

Sie ist in Zeilenstufenform, also ist auch das zugehörige lineare Gleichungssystem in Zeilenstufenform. Es gilt rang(A) = rang(A | b) = 3.

2. Die erweiterte Koeffizientenmatrix

0 2 0 √1

(A | b) := 0 0 0

2

0 0 0 0

0

−2

0

3

4

0 ∈ R3×(5+1)

0

ist in Zeilenstufenform mit rang(A) = rang(A | b) = 2.

(33)

b1

b2

..

.

br

br+1

br+2

..

.

bm

2

LINEARE GLEICHUNGSSYSTEME

3. Die erweiterte Koeffizientenmatrix

π 0 1

0 2 −1

√

A :=

2

0 0

0 0 0

0 0 0

31

√

2

−3

0

1

0

∈ R5×(3+1)

(34)

ist in Zeilenstufenform mit 3 = rang(A) < rang(A | b) = 4.

Lösbarkeitskriterium Der folgende Satz über die Lösbarkeit von linearen

Gleichungssystemen in Zeilenstufenform geht auf die drei Mathematiker G. Fontené (1848–1923), E. Rouché (1832–1910) und F. G. Frobenius (1849–1917) zurück:

Satz 2 (Lösbarkeit eines linearen Gleichungssystems in Zeilenstufenform) Ein

lineares Gleichungssystem Ax = b mit m Gleichungen und n Unbekannten in

Zeilenstufenform (!) ist genau dann lösbar, wenn rang(A) = rang(A | b). Gilt

zusätzlich rang(A | b) = n, so hat das lineare Gleichungssystem genau eine Lösung.

Bemerkung: Für ein lineares Gleichungssystem Ax = b mit m Gleichungen und

n Unbekannten in Zeilenstufenform erkennen wir dieselben drei Fälle wie für

lineare Gleichungen ax = b, a, b ∈ K (Satz 1 im Kap. 1.4.1):

• genau eine Lösung, falls rang(A) = rang(A | b) = n

• unendlich viele Lösungen, falls rang(A) = rang(A | b) < n

• keine Lösung, falls rang(A) < rang(A | b)

Für m = n = 1 erhalten wir in der Tat genau die Fälle aus Satz 1, denn in

diesem Fall ist die Koeffizientenmatrix gegeben durch A = (a) ∈ K 1×1 und die

rechte Seite durch b = (b) ∈ K 1 . Die erweiterte Koeffizientenmatrix ist daher

gegeben durch (A | b) = (a | b) ∈ K 1×(1+1) . Es gelten

1, a 6= 0

1, a 6= 0 ∨ b 6= 0

rang(A) =

, rang(A | b) =

.

0, a = 0

0, a = 0 ∧ b = 0

Damit erhalten wir die drei Fälle

• rang(A) = rang(A | b) = 1, falls a 6= 0 (genau eine Lösung),

• rang(A) = rang(A | b) = 0 < 1, falls a = 0 ∧ b = 0 (unendlich viele

Lösungen),

• 0 = rang(A) < rang(A | b) = 1, falls a = 0 ∧ b 6= 0 (keine Lösung).

2

LINEARE GLEICHUNGSSYSTEME

32

Beispiele:

1. Für die erweiterte Koeffizientenmatrix (32) gilt

rang(A) = rang(A | b) = 3 = n,

also hat das zugehörige lineare Gleichungssystem Ax = b genau eine

Lösung.

2. Für die erweiterte Koeffizientenmatrix (33) gilt

rang(A) = rang(A | b) = 2 < 5 = n,

also hat das zugehörige lineare Gleichungssystem Ax = b unendlich viele

Lösungen.

3. Für die erweiterte Koeffizientenmatrix (34) gilt

3 = rang(A) < rang(A | b) = 4,

also hat das zugehörige lineare Gleichungssystem Ax = b keine Lösung. In

der vorletzten Zeile steht nämlich 0x1 +0x2 +0x3 = 1, und diese Gleichung

kann für kein x = (x1 , x2 , x3 )> ∈ R3 erfüllt sein.

Lösung durch Rückwärtseinsetzen Die Lösungsmenge des linearen Gleichungssystems Ax = b mit m Gleichungen und n Unbekannten ist gegeben

durch

L = {x ∈ K n | Ax = b} ⊆ K n .

Ist das Gleichungssystem in Zeilenstufenform, so gilt gemäss Satz 2: L = ∅,

falls rang(A) < rang(A | b). In diesem Fall ist nichts mehr zu tun. Wir nehmen

deshalb im Folgenden an, dass rang(A) = rang(A | b); in diesem Fall gilt L 6= ∅,

d. h. das lineare Gleichungssystem Ax = b hat mindestens eine Lösung. Wir

definieren wieder r = rang(A) ∈ {0, 1, 2, . . . , min{m, n}}, und wir betrachten

die Menge J := {j1 , j2 , . . . , jr } der Spaltenindizes der Leitkoeffizienten in jeder

Nichtnullzeile. Es gibt k := n − r ≥ 0 Variablen xj mit j 6∈ J. Diesen ordnen

wir beliebige Werte λ1 , λ2 , . . . , λk ∈ K zu.

Bemerkung: Die Zahl k = n − r heisst der Defekt der Koeffizientenmatrix A.

Die Werte der restlichen Variablen xj mit j ∈ J können jetzt durch Rückwärtseinsetzen eindeutig als Funktionen von λ1 , λ2 , . . . , λk angegeben werden.

Wir geben hier einen Algorithmus (in Pseudocode) zur Lösung eines linearen

Gleichungssystems mit m Gleichungen und n Unbekannten in Zeilenstufenform

an:

Bestimme die Menge J := {j1 , j2 , . . . , jr } der Spaltenindizes der Leitkoeffizienten jeder Nichtnullzeile der erweiterten Koeffizientenmatrix

if k := n − r > 0

` = 0 (Zähler für die Spaltenindizes, die nicht in J liegen)

2

LINEARE GLEICHUNGSSYSTEME

33

for j = 1, 2, . . . , n

if j 6∈ J

`=`+1

xj = λ` ∈ K

end

end

(am Ende dieser Schleife gilt ` = k)

end

for i = r, r − 1, . . . , 1

bi −

xji = a−1

iji

n

X

aij xj

j=ji +1

end

Beispiele:

1. Für die erweiterte Koeffizientenmatrix aus

2 −5

−6√

(A | b) = 0 −2 1 − 2

0 0

7

(32),

4

0 ∈ R3×(3+1) ,

2

gilt m = n = 3 und J = {1, 2, 3}, also r = 3 und damit k := n − r = 0.

Wir können also den ersten Teil des obigen Pseudocodes überspringen und

direkt zum zweiten Teil gehen:

1

2

i = 3: (j3 = 3) x3 = a−1

·2=

33 (b3 − 0) =

7

7

3

X

b2 −

a2j xj = a−1

i = 2: (j2 = 2) x2 = a−1

22 (b2 − a23 x3 )

22

j=3

√

1− 2

=

7

3

X

b1 −

i = 1: (j1 = 1) x1 = a−1

a1j xj = a−1

11

11 (b1 − a12 x2 − a13 x3 )

1

=

−2

1

=

2

√

2

0 − (1 − 2)

7

√

j=2

1− 2

2

4 − (−5)

− (−6)

7

7

!

=

√

45 − 5 2

14

Die Lösungsmenge des zu dieser erweiterten Koeffizientenmatrix gehörigen

Gleichungssystems ist also gegeben durch

√

2

45−5

1−14√2

3

L=

⊆R .

7

2

7

2

LINEARE GLEICHUNGSSYSTEME

34

2. Für die erweiterte Koeffizientenmatrix

0 2 0 √1

(A | b) = 0 0 0

2

0 0 0 0

aus (33),

3

0

4

−2 0 ∈ R3×(5+1) ,

0 0

gilt m = 3, n = 5 und J = {2, 4}, also r = 2 und damit k := n−r = 3 > 0.

Wir müssen also beide Teile des obigen Pseudocodes durchführen. Der

erste Teil verläuft wie folgt:

`=0

j = 1: 1 6∈ J

`=1

x1 = λ1 ∈ R

j = 2: 2 ∈ J

j = 3: 3 6∈ J

`=2

x3 = λ2 ∈ R

j = 4: 4 ∈ J

j = 5: 5 6∈ J

`=3

x5 = λ3 ∈ R

Im zweiten Teil folgt das Rückwärtseinsetzen:

5

X

b2 −

a2j xj = a−1

i = 2: (j2 = 4) x4 = a−1

24 (b2 − a25 x5 )

24

j=5

√

1

= √ (0 − (−2)λ3 ) = 2λ3

2

5

X

b1 −

i = 1: (j1 = 2) x2 = a−1

a1j xj = a−1

12

12 (b1 − a13 x3 − a14 x4 − a15 x5 )

j=3

1

=

2

√

3

− 0λ2 − 1 2λ3 − 0λ3

4

1

=

2

3 √

− 2λ3

4

√

3

2

= −

λ3

8

2

Die Lösungsmenge des zu dieser erweiterten Koeffizientenmatrix gehörigen

Gleichungssystems ist also gegeben durch

λ√1

2

3

8 − 2 λ3

L = √λ2

λ1 , λ2 , λ3 ∈ R ⊆ R5 .

2λ3

λ3

2

LINEARE GLEICHUNGSSYSTEME

35

Mit Hilfe der Vektoraddition und der Skalarmultiplikation (für Vektoren)

können wir die Lösungsmenge auch in der folgenden Form schreiben:

0√

0

0

1

3

− 2

0

0

8

2

L = 0 + λ1 0 + λ2 1 + λ3 √0 λ1 , λ2 , λ3 ∈ R .

0

0

0

2

0

0

0

1

2.4

Gausssches Eliminationsverfahren

Im Kap. 2.3 haben wir gesehen, dass wir für ein lineares Gleichungssystem in

Zeilenstufenform leicht entscheiden können, ob es mindestens eine Lösung hat.

Ist dies der Fall, so können wir sämtliche Lösungen durch Rückwärtseinsetzen

bestimmen.

In diesem Kapitel lernen wir nun das Gausssche Eliminationsverfahren (nach

C. F. Gauss, 1777–1855) kennen, mit dem wir jedes beliebige lineare Gleichungssystem auf Zeilenstufenform bringen können. Eine Kombination dieses Verfahrens mit dem Rückwärtseinsetzen erlaubt uns schliesslich die Lösung jedes beliebigen linearen Gleichungssystems (sofern es eine Lösung hat).

Bemerkung: Oft wird diese Kombination der beiden Verfahren (nicht nur das

hier vorgestellte Verfahren zum Erreichen der Zeilenstufenform) als Gausssches

Eliminationsverfahren bezeichnet.

Wir nehmen im Folgenden an, dass ein lineares Gleichungssystem mit m

Gleichungen und n Unbekannten bereits in der Matrixform Ax = b vorliegt

(Kap. 2.2), und wir arbeiten mit der erweiterten Koeffizientenmatrix (A | b) ∈

K m×(n+1) .

Das Verfahren verwendet die folgenden elementaren Zeilenumformungen, um

die erweiterte Koeffizientenmatrix auf Zeilenstufenform zu bringen:

1. Vertauschen zweier Zeilen,

2. Multiplikation einer Zeile mit einem Skalar ungleich Null,

3. Addition eines Vielfachen einer Zeile zu einer anderen Zeile.

Wie im Kap. 1.6 bezeichnen wir die i-te Zeile der erweiterten Koeffizientenmatrix

mit

(A | b)i · := ai1 ai2 · · · ain bi ∈ K 1×(n+1) , i ∈ {1, 2, . . . , m}.

Die dazugehörige lineare Gleichung lautet ai1 x1 + ai2 x2 + · · · ain xn = bi . Die

elementaren Zeilenumformungen lassen sich damit auch schreiben als

1. (A | b)i1 · ↔ (A | b)i2 · , i1 , i2 ∈ {1, 2, . . . , m}, i1 6= i2 ,

2. (A | b)i · ← α(A | b)i · , i ∈ {1, 2, . . . , m}, α ∈ K \ {0},

3. (A | b)i1 · ← (A | b)i1 · + α(A | b)i2 · , i1 , i2 ∈ {1, 2, . . . , m}, i1 6= i2 , α ∈ K.

2

LINEARE GLEICHUNGSSYSTEME

36

Satz 3 Die elementaren Zeilenumformungen 1.–3. verändern die Lösungsmenge des linearen Gleichungssystems nicht.

Bemerkung: Mit Hilfe von Satz 3 können wir beliebig viele elementare Zeilenumformungen auf die erweiterte Koeffizientenmatrix anwenden, und es so – wie wir

anschliessend an den Beweis sehen werden – auf Zeilenstufenform bringen. Dieses

lineare Gleichungssystem in Zeilenstufenform hat dann dieselbe Lösungsmenge

wie das ursprüngliche lineare Gleichungssystem.

Beweis von Satz 3: