Bonitätsklassifikation kleiner Unternehmen mit Linearer

Werbung

Bonitätsklassifikation kleiner Unternehmen mit multivariater

linearer Diskriminanzanalyse und Neuronalen Netzen

J. Jacobs

G. Weinrich

Lüneburg, 2.5.2001

Bonitätsklassifikation kleiner Unternehmen mit multivariater

linearer Diskriminanzanalyse und Neuronalen Netzen

1 Problemstellung

Die Beurteilung der wirtschaftlichen Lage von Unternehmen erfolgt

traditionell vor allem durch die Analyse von Kennzahlen, die aus Bilanzund Jahresabschlussdaten gewonnen werden. Anhand seiner

Kennzahlenwerte wird ein Unternehmen entweder der Klasse der kritischen

(insolvenzgefährdeten) oder der Klasse der guten (nicht

insolvenzgefährdeten) Unternehmen zugeordnet. Die Festlegung geeigneter

Kennzahlen und Kennzahlenwerte mit hoher Trennfähigkeit bezüglich

beider Klassen erfolgt durch Auswertung einer Lernstichprobe. Dies sind

Bilanz- und Jahresabschlussdaten von Unternehmen, für welche die

Klassenzugehörigkeit bekannt ist.

Für die empirische Analyse sind in der Vergangenheit statistische Verfahren

- vor allem die multivariate lineare Diskriminanzanalyse - mit Erfolg

eingesetzt worden. Übereinstimmend für die meisten

Untersuchungsergebnisse ist eine recht gute Klassifikationsgüte (75% bis

80%) durch Verwendung von wenigen (in der Regel 3 bis 4) Kennzahlen

(vgl. /HAU95/).

In jüngerer Zeit finden zunehmend auch Neuronale Netze Berücksichtigung.

Mit dem Einsatz von Neuronalen Netzen als Untersuchungsmethode werden

hohe Erwartungen verbunden, weil dadurch Nichtlinearitäten im

Datenmaterial abgebildet werden können. Eine der ersten Untersuchungen

zur Kreditwürdigkeitsprüfung mit Neuronalen Netzen wurde im Jahre 1990

von M. D. Odom und R. Sharda veröffentlicht (vgl. /ODO90/). Ein

Vergleich mit den Ergebnissen der Diskriminanzanalyse zeigte eine

Überlegenheit der Neuronalen Netze. Die geringsten Fehlerraten ergaben

beim Fehler 1. Art (2. Art) ca. 19% (17%) für das Neuronale Netz bzw. 30%

(14%) für die Diskriminanzanalyse. Als Fehler 1. Art (oder Alpha-Fehler)

bezeichnet man dabei die Klassifikation eines gefährdeten als nicht

gefährdetes Unternehmen. Als Fehler 2. Art (oder Beta-Fehler) wird die

Klassifikation eines nicht gefährdeten als gefährdetes Unternehmen

bezeichnet.

1

Ähnliche Resultate ergaben sich bei einer Untersuchung französischer

Unternehmen. Mit einer Trefferquote von etwa 85% (3 Jahre vor Insolvenz)

übertraf das Neuronale Netz das Ergebnis der Diskriminanzanalyse um 6%

(vgl. /KER94/).

Untersuchungen für deutsche Unternehmen wurden am Institut für

Revisionswesen (IRW) der Universität Münster mit dem wohl

umfangreichsten Datenmaterial (11 427 Jahresabschlüsse) durchgeführt. Das

Ergebnis fiel nicht so deutlich zugunsten Neuronaler Netze aus. Bei einem

auf 8,75% fixierten Alpha-Fehler ergab sich mit einem Neuronalen Netz ein

Beta-Fehler von 33,55% gegenüber 34,76% mit Hilfe der

Diskriminanzanalyse.

Während sich die bisherigen Forschungen vorwiegend auf mittlere und

große Unternehmen bezogen, haben eigene Untersuchungen gezeigt, dass

die Kreditwürdigkeitsprüfung kleinerer mittelständischer Unternehmen

besondere Schwierigkeiten bereitet, und dass sich veröffentlichte Ergebnisse

auf der Basis von Datenmaterial mittlerer und großer Unternehmen nicht

ohne weiteres auf kleine Unternehmen übertragen lassen (/JAC97/): Eine

Diskriminanzanalyse für kleine Unternehmen ergab unter Verwendung

derselben Kennzahlen, die für mittlere und große Unternehmen gute

Ergebnisse lieferten (Alpha-Fehler: 8,7%; Beta-Fehler: 37,43%), einen

deutlich größeren Alpha-Fehler von 32,29% bei einem ähnlich großen BetaFehler von 36,65% (/BAE96/).

In der vorliegenden Arbeit soll überprüft werden, ob die enttäuschenden

Klassifikationsergebnisse für kleine Unternehmen auf die verwendeten

Kennzahlen oder die verwendete Methode der Diskriminanzanalyse

zurückzuführen sind und ob sich die Ergebnisse durch den Einsatz

Neuronaler Netze verbessern lassen.

2 Verwendetes Datenmaterial

Die in die Untersuchung einbezogenen Unternehmen sind Firmenkunden

von Banken im gesamten Bundesgebiet. Zur Klasse der kritischen

Unternehmen wurden alle Firmen gezählt, bei denen eines der folgenden

Probleme bei der Kreditabwicklung aufgetreten war:

- Einzelwertberichtigung wegen drohenden Kreditausfalls,

- Kreditkündigung und Verwendung der Sicherheiten,

2

- Konkurs oder Vergleich.

Alle übrigen Unternehmen wurden der Klasse der guten Unternehmen

zugeordnet.

Um konjunkturelle Einflüsse auszuschließen, müssten idealerweise

Unternehmensdaten aus denselben Kalenderjahren verglichen werden. Auf

dieses Vorgehen wurde aufgrund eines zu geringen Datenbestands

verzichtet. Stattdessen wurden alle Bilanzen kritischer Unternehmen

zusammengefasst, die sich auf einen Zeitraum von 2 bis 3 Jahren vor

Eintreten des Kreditproblems beziehen. Die Datensätze der guten

Unternehmen wurden so ausgewählt, dass annähernd gleiche Häufigkeiten

in den einzelnen Bilanzjahren auftraten (vgl. Tabelle 1).

Anzahl Bilanzen

kritische

Unternehmen

gute Unternehmen

1990

3

1991

8

1992

64

1993

94

1994

34

Gesamt

203

1

7

61

95

39

203

Tabelle 1: Verteilung der Bilanzen nach Jahren

Um eine Verzerrung der Untersuchungsergebnisse durch unterschiedliche

Rechtsformen und Unternehmensgrößen zu vermeiden, wurde darüber

hinaus eine ähnliche Verteilung bezüglich dieser Parameter in den Gruppen

der kritischen und guten Unternehmen angestrebt (vgl. Tabellen 2 bis 4; die

Abweichungen in der Spalte "Gesamt" im Vergleich zu Tab. 1 sind dadurch

zu erklären, dass für einige Unternehmen 2 Bilanzjahre zur Verfügung

standen):

Anzahl Unternehmen

kritische

Unternehmen

gute Unternehmen

Personengesellschaften

(inkl. GmbH & Co. KG)

71

Kapitalgesellschaften

Gesamt

54

125

87

49

136

Tabelle 2: Verteilung der Unternehmen nach Rechtsform

3

Anzahl Unternehmen

kritische

Unternehmen

gute Unternehmen

unter 1,4 Mio. DM 1,4 - 3 Mio. DM 3 - 8 Mio. DM

42

43

40

52

42

42

Gesamt

125

136

Tabelle 3: Verteilung der Unternehmen nach Umsatzgröße

Anzahl Unternehmen

kritische

Unternehmen

gute Unternehmen

unter 0,65 Mio.

DM

44

0,65 - 1,4 Mio. 1,4 - 4 Mio. DM Gesamt

DM

39

42

125

52

42

42

136

Tabelle 4: Verteilung der Unternehmen nach Gesamtkapital

3 Getestete Kennzahlen

3.1 Definition der Kennzahlen

Für die Untersuchung wurden Kennzahlen ausgewählt, die beim

Kreditscoring im Genossenschaftsverband eingesetzt werden. Dies erschien

deshalb sinnvoll, weil das Kreditgeschäft der Genossenschaftsbanken

vorwiegend durch das Segment der kleinen mittelständischen Unternehmen

geprägt wird. Im Einzelnen fanden folgende Kennzahlen Eingang in die

Analyse:

Rentabilität:

K1 = Betriebsergebnis vor Steuern+Planm. Abschreibungen+Veränd. Pens. Rückstellungen/Gesamtkapital

Liquidität:

K2 = Betriebl. Nettoeinnahmen II/kurzfristiges Fremdkapital

Kreditoren:

K3 = Verbindlichkeiten inkl. Wechsel/Gesamtkapital

Kapitalstruktur:

K4 = Eigenkapital/Fremdkapital

4

Für alle Kennzahlen wurde ein Median-Test durchgeführt, mit dem Ergebnis

eines hochsignifikanten Lageunterschieds (Irrtumswahrscheinlichkeit <

0,01%) für gute und kritische Unternehmen. Bei der Kennzahl K3 war der

Median für die Klasse der kritische Unternehmen größer als für die Klasse

der guten Unternehmen, bei den übrigen Kennzahlen kleiner.

3.2 Aufbereitung der Kennzahlen

Um den Einfluss von Ausreißern zu mindern, wurde das Verfahren des

Winsorisierens verwendet (vgl. /SAC92/, S. 371). Hierbei werden die k

kleinsten bzw. größten Werte durch den (k+1)-kleinsten bzw. -größten Wert

ersetzt. Für die Kennzahlen K1, K2 und K3 wurde als untere Grenze der Wert

des 1. Dezils für die Klasse der kritischen Unternehmen und als obere

Grenze der Wert des 9. Dezils für die Klasse der guten Unternehmen

gewählt. Für die Kennzahl K3 wurde als untere Grenze der Wert des 1.

Dezils für die Klasse der guten Unternehmen und als obere Grenze der Wert

des 9. Dezils für die Klasse der kritischen Unternehmen gewählt.

4 Klassifikation mit multivariater linearer Diskriminanzanalyse

4.1 Untersuchungsmethode

Nach dem Ansatz von Fisher (/FIS36/) werden die zu untersuchenden

Kennzahlen K1, K2,..., Kr durch eine lineare Diskriminanzfunktion D - d. h.

durch Addition der zuvor mit Gewichtsfaktoren a1, a2, ..., ar multiplizierten

Kennzahlen - zusammengefasst:

D a1 K1 a2 K2 ... ar Kr .

Bei bekannten Gewichtsfaktoren kann durch Einsetzen der Kennzahlenwerte

in die Diskriminanzfunktion der zugehörige Diskriminanzwert berechnet

werden. Ein Unternehmen wird als kritisches Unternehmen klassifiziert,

falls der berechnete Diskriminanzwert unterhalb eines noch festzulegenden

Schwellenwerts liegt. Damit wird das r-dimensionale

Klassifizierungsproblem auf ein eindimensionales Problem reduziert.

Die Diskriminanzfunktion ist mit Hilfe der Lernstichprobe so zu bestimmen,

dass sich durch die resultierenden Diskriminanzwerte eine möglichst gute

Trennung der Klasse der kritischen Unternehmen von der komplementären

5

Klasse der guten Unternehmen ergibt. Nach dem von Fisher definierten

heuristischen Maß für die Trenngüte sind die Gewichtsfaktoren derart

festzulegen, dass der quadratische Abstand der Mittelwerte der beiden

Klassen relativ zur Summe der quadrierten Abweichungen in beiden Klassen

maximal wird. In einer Formel ausgedrückt: der Wert des Gütemaßes

( D1 D2 ) 2

s12 s22

ist zu maximieren. Dabei bedeuten:

1

Di

ni

ni

D

j 1

ij

(= arithmetisches Mittel der Diskriminanzfunktion für Klasse i),

ni

s (Dij Di )2

2

i

j 1

(= Summe der quadrierten Abweichungen vom Mittelwert für Klasse i),

wobei Dij den Wert der Diskriminanzfunktion für Bilanz j aus Klasse i und ni

die Anzahl der Bilanzen in Klasse i bezeichnen.

Eine Bilanz wird der Klasse 1 zugeordnet, falls der berechnete

Diskriminanzwert D näher bei D1 als bei D2 liegt, das heißt, falls

D

1

( D1 D2 ) .

2

Der heuristische Ansatz von Fisher kommt ohne Annahmen über die

statistische Verteilung der Kennzahlenwerte aus. Die resultierende

Entscheidungsregel ist zwar im Zwei-Klassen-Fall äquivalent zur

Maximum-Likelihood-Entscheidungsregel, falls die Kennzahlen

klassenweise multivariat normalverteilt und die Kovarianzmatrizen

klassenweise identisch sind (vgl. /FAH96/, S. 377 ff.). Der vielfach

vertretenen Meinung, eine Anwendungsvoraussetzung der linearen

Diskriminanzanalyse sei die multivariate Normalverteilung der Kennzahlen

und die Gleichheit der Kovarianzmatrizen für beide Klassen (vgl. z. B.

/BUR94/, /KER94/), ist jedoch nicht zuzustimmen. Dagegen sind Verfahren

zur Schätzung der Fehlerrate oder die in gängigen Statistikpaketen

angebotenen Tests zur Beurteilung der Trennschärfe der einzelnen

6

Gewichtsfaktoren nur mit großer Vorsicht anzuwenden, da diese auf den

genannten Verteilungsannahmen basieren.

Die Trenngüte einer Diskriminanzfunktion bezüglich der Lernstichprobe

erlaubt noch keine Aussage über ihre zu erwartende Trennfähigkeit für

Unternehmen außerhalb der Lernstichprobe. Eine Möglichkeit zur

Schätzung dieser Trennfähigkeit ist die Aufteilung der Gesamtstichprobe in

eine Lern- und eine Teststichprobe. Um den Umfang der Lernstichprobe

nicht zu reduzieren, wurde stattdessen das Verfahren der Kreuzvalidierung

verwendet (vgl. /WAH75/). Danach wird die Lernstichprobe L in mehrere

zufällig bestimmte disjunkte Teilmengen ungefähr gleicher Größe zerlegt:

t

L Li mit Li L j {} für i j .

i 1

Jede Teilmenge Li dient als Teststichprobe für eine Diskriminanzfunktion,

die mit der um Li reduzierten Lernstichprobe L - Li ermittelt wurde. Sei fi die

Fehlerrate für diese Teststichprobe, mi die Anzahl der Elemente von Li und n

die Anzahl der Elemente von L, so lautet die nach t-facher Kreuzvalidierung

geschätzte Gesamtfehlerrate:

f

1 t

mi f i .

n i 1

Im Grenzfall besteht jede Teststichprobe aus nur einem Element. Man

spricht dann von der leaving-one-out-Methode. Die geschätzte Fehlerrate

nach dieser Methode hat zwar den geringsten Bias, jedoch möglicherweise

eine große Varianz (vgl. /GLI78/). Aus diesem Grund wurde neben der

leaving-one-out-Methode das Verfahren der 5-fachen Kreuzvalidierung

verwendet.

Der Empfindlichkeit des Gütemaßes gegenüber Ausreißern (vgl. /HUB85/)

wurde durch Verwendung der winsorisierten Kennzahlenwerte anstelle der

Rohwerte Rechnung getragen (vgl. 3.2).

4.2 Ergebnisse

Der Alpha-Fehler (Fehlklassifikation kritischer Unternehmen) und der BetaFehler (Fehlklassifikation guter Unternehmen) für die Lernstichprobe sowie

die mit der leaving-one-out-Methode und der Methode der 5-fachen

7

Kreuzvalidierung geschätzten Fehlerraten ergeben sich aus folgender

Tabelle:

Lernstichprobe

Alpha-Fehler

Beta-Fehler

leaving-one-outMethode

25,62%

41,38%

25,62%

40,89%

5-fache

Kreuzvalidierung

27,42%

39,65%

Tabelle 5: Ergebnisse der linearen Diskriminanzanalyse

Das Klassifikationsergebnis konnte auch durch die Elimination aller

Unternehmen mit Einzelwertberichtigung oder Kreditkündigung aus der

Menge der kritischen Unternehmen nicht verbessert werden. In diesem Fall

enthält die Klasse der kritischen Unternehmen ausschließlich Insolvenzfälle

(55 Bilanzen). Zur Schätzung der Fehlerraten wurde die Klasse der guten

Unternehmen in 3 Teilmengen mit 50 und eine Teilmenge mit 53 Bilanzen

aufgeteilt. Mit je einer dieser Teilmengen und den Bilanzen der kritischen

Unternehmen wurden 4 getrennte Diskriminanzanalysen durchgeführt und

die Fehlerraten mit der leaving-one-out-Methode geschätzt. Anschließend

wurden die so erhaltenen Fehlerraten gemittelt. Es ergab sich ein AlphaFehler von 31,36% und ein Beta-Fehler 38,46%.

5 Klassifikation mit Neuronalen Netzen

5.1 Untersuchungsmethode

Nach den Pionierleistungen in den vierziger und fünfziger Jahren erlebt das

Forschungsgebiet der Neuronalen Netze seit Mitte der achtziger Jahre eine

Renaissance in einer ständig zunehmenden Zahl von Einsatzbereichen. Die

Verwendung Neuronaler Netze zur Bonitätsklassifikation verspricht u. a.

den Vorteil gegenüber der Diskriminanzanalyse, dass kein linearer

Zusammenhang zwischen Eingabe (Kennzahlenwerte) und der Ausgabe

(Diskriminanzwert) unterstellt wird.

Ein Neuronales Netz besteht aus Verarbeitungseinheiten (Neuronen) mit

gewichteten Kommunikationsverbindungen zwischen diesen Einheiten. Jede

Verarbeitungseinheit produziert in Abhängigkeit von den eintreffenden

Eingabesignalen ein Ausgabesignal, welches über die

Kommunikationsverbindungen - entsprechend den Verbindungsgewichten

verstärkt oder abgeschwächt - zu den anderen Verarbeitungseinheiten

weitergeleitet wird. Im Falle der Unternehmensklassifikation bestehen die

8

Eingabesignale aus den Unternehmenskennzahlen. Für jede Kennzahl steht

ein Eingabeneuron zur Verfügung. Die Ausgabesignale dieser Neuronen

werden dann direkt oder über "verborgene" Neuronen einem Ausgabeneuron

oder auch mehreren Ausgabeneuronen - z. B. je einem für jede Klasse zugeführt. Die Ausgabesignale der Ausgabeneuronen klassifizieren

daraufhin das Unternehmen als gefährdet oder nicht gefährdet.

Mit Hilfe eines geeigneten Lernverfahrens werden in der Trainingsphase die

Netzparameter (d. h. die Verbindungsgewichte und das

Ein/Ausgabeverhalten der Verarbeitungseinheiten) so eingestellt, dass die

Eingabedaten der Trainingsfälle zu den gewünschten Ausgabedaten führen.

Werden genügend viele Trainingsfälle gelernt, können komplexe - bei

Verwendung von nicht-linearen Ein/Ausgabefunktionen der

Verarbeitungseinheiten auch nicht-lineare - Beziehungen zwischen Ein- und

Ausgabedaten im Netz abgebildet werden, die über die Trainingsbeispiele

hinaus Gültigkeit haben.

Unter der Vielzahl möglicher Netztopologien sollen hier ausschließlich sog.

feed-forward-Netze untersucht werden. Bei diesen Netzen werden die

Neuronen in Schichten angeordnet, und das Ausgabesignal eines Neurons

wird nur an Neuronen der unmittelbar nachgelagerten Schicht weitergeleitet.

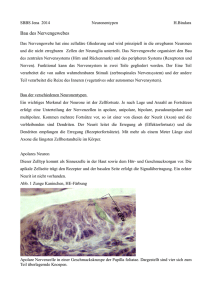

Für das betrachtete Klassifikationsproblem mit 4 Kennzahlen und 2 Klassen

bieten sich Netztopologien mit 4 Eingabeneuronen (pro Kennzahl ein

Neuron) und einem oder zwei Ausgabeneuronen an. Im Falle von zwei

Ausgabeneuronen (vgl. Abb. 1) könnte jede Klasse durch ein Neuron

repräsentiert und die Klassenzugehörigkeit durch das Neuron mit dem

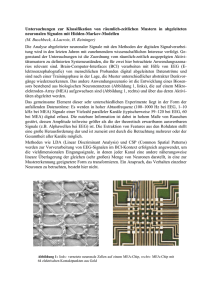

stärkeren Ausgabesignal bestimmt werden. Im Falle eines Ausgabeneurons

(vgl. Abb. 2) würde sich wie bei der Diskriminanzanalyse die

Klassenzugehörigkeit durch einen Vergleich der Stärke des Ausgabesignals

mit einem Schwellenwert ergeben. Offen ist die Anzahl der "verborgenen"

Schichten zwischen Ein- und Ausgabeneuronen sowie die Anzahl der

Neuronen in diesen Schichten.

9

Eingabeschicht

verborgene Schicht

Ausgabeschicht

1

2

5

7

3

6

8

4

Abb.1: feed-forward-Netz mit zwei Ausgabeneuronen

Eingabeschicht

verborgene Schicht

Ausgabeschicht

1

2

5

7

3

6

4

Abb.2: feed-forward-Netz mit einem Ausgabeneuron

10

Neben der Netztopologie muss das Ein/Ausgabeverhalten der einzelnen

Neuronen festgelegt werden. Üblicherweise wird das aus allen

Eingabesignalen resultierende Eingabesignal - für alle Neuronen in gleicher

Weise - durch Summenbildung berechnet. Zu dieser Summe wird eine

Konstante (der sog. Schwellenwert oder treshold) addiert. Der

Schwellenwert kann für die einzelnen Neuronen unterschiedlich gewählt

werden. Damit wird durch das Netz aus Abb. 1 folgende Funktion

repräsentiert:

y k ok ( wij o j ( wij K i j ) k ) , wobei

j

i

wij das Gewicht der Verbindung zwischen Neuron i und Neuron j bezeichnet,

oj(x) die Ausgabe von Neuron j bei Eingabe x und j der Schwellenwert von

Neuron j ist. yk bezeichnet den Wert der Netzausgabe für Neuron k (k = 6,7),

Ki den Wert der Netzeingabe für Neuron i (i = 1, ..., 4).

Die Funktionen oj werden meist für alle Neuronen einheitlich gewählt. Eine

gebräuchliche - und unserer Analyse zugrunde liegende Wahl - ist die

sigmoide Funktion

o( x)

1

.

1 ex

Ein häufig verwendetes Gütekriterium zur Bestimmung von Gewichten und

Schwellenwerten ist die Minimierung der quadratischen Abweichung

zwischen gewünschter und berechneter Netzausgabe, d. h. die Minimierung

der Fehlerfunktion

f (t pk y pk ) 2 , wobei

p

k

tpk die gewünschte Ausgabe von Neuron k für das Eingabemuster p und ypk

die durch das Netz berechnete Ausgabe von Neuron k für das Eingabemuster

p bedeuten.

Im Gegensatz zur Diskriminanzanalyse wird das Minimum der

Fehlerfunktion nicht direkt, sondern schrittweise bestimmt. Aufgrund der

Differenzierbarkeit der sigmoiden Funktion ist auch die Fehlerfunktion

differenzierbar nach Gewichten und Schwellenwerten. Daher wird bei den

gängigen Simulationsprogrammen für Neuronale Netze die Suche nach dem

11

Minimum der Fehlerfunktion mit dem Gradienten-Abstiegsverfahren - dem

sog. Backpropagation-Algorithmus - durchgeführt. Dabei werden Gewichte

und Schwellenwerte nach jeder Präsentation der Eingabemuster in Richtung

des negativen Gradienten verändert, bis der Wert der Fehlerfunktion

hinreichend klein ist.

Mit der verteilten Repräsentation des Wissens in Form der

Verbindungsgewichte und des Ein/Ausgabeverhaltens der

Verarbeitungseinheiten ist häufig ein gutes Näherungsverhalten verbunden.

Dies bedeutet, dass sich brauchbare Ergebnisse auch bei ungenauen oder

unvollständigen Eingaben erzielen lassen - eine Eigenschaft, die im Hinblick

auf die Beeinflussung von Bilanzdaten durch bilanzstrategische Maßnahmen

Vorteile verspricht.

Diese positive Eigenschaften werden allerdings erkauft durch eine hohe

Anzahl von Freiheitsgraden. Für ein Netz mit 4 Eingabe-, 2 verborgenen und

2 Ausgabeneuronen müssen beispielweise 12 Gewichte und 4

Schwellenwerte berechnet werden. Im Vergleich dazu erfordert die

Diskriminanzanalyse die Bestimmung von lediglich 4 Gewichtsfaktoren.

Es ist einleuchtend, dass genügend große Netze mit vielen "verborgenen"

Neuronen und vielen Kommunikationsverbindungen in der Lage sein

werden, innerhalb der Trainingsmenge die Klassifikationsaufgabe mit

gewünschter Genauigkeit zu lösen. Theoretische Überlegungen bestätigen

dies (vgl. z. B. /HOR91/). Derartige Netze leiden jedoch häufig unter einer

mangelhaften Generalisierungsfähigkeit. Das heißt, für nicht in der

Trainingsphase präsentierte Eingabedaten lassen sich mit Hilfe der gelernten

Ein/Ausgabefunktion in der Regel keine zutreffenden Ausgaben berechnen.

Damit wird auch die häufig in der Praxis vorgefundene paradoxe Situation

verständlich, dass verbesserte Verfahren zur Bestimmung des

Fehlerminimums in der Regel zu schlechteren Ergebnissen geführt haben.

Mit sub-optimalen Netzen (bezogen auf die Lernstichprobe) lassen sich

optimale Ergebnisse bezüglich der Generalisierung erzielen (vgl. /DIE95/).

Zur Schätzung der Fehlerrate wurde aufgrund des hohen Aufwands für das

Netztraining ausschließlich das Verfahren der 5-fachen Kreuzvalidierung

verwendet, wobei als Startgewichte für das Training der 5 Netze stets die mit

Hilfe der gesamten Lernstichprobe gelernten Gewichte eingesetzt wurden.

Dieses Vorgehen trägt einer problematischen Eigenschaft des verwendeten

Lernalgorithmus zur Fehlerminimierung Rechnung: Ein Problem dieses

Algorithmus ist, dass u. U. anstelle des globalen Minimums der

Fehlerfunktion nur ein lokales Minimum gefunden wird. Das beschriebene

12

Vorgehen bei der Kreuzvalidierung stellt sicher, dass die Schätzung der

Fehlerrate nicht mit Netzen erfolgt, die andere Minima der Fehlerfunktion

repräsentieren (vgl. /MOO95/).

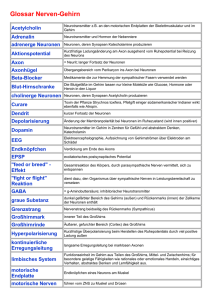

Als Eingabedaten wurden die von Ausreißern bereinigten winsorisierten

Kennzahlenwerte verwendet. Die Form der sigmoiden Funktion (vgl. Abb.

2) lässt erkennen, dass Änderungen der Eingabewerte mit großem Abstand

vom Schwellenwert fast keine Änderungen des Ausgabewerts hervorrufen.

1

0.8

0.6

0.4

0.2

-6

-4

-2

2

4

6

Abb. 3: sigmoide Funktion mit Schwellenwert : f ( x)

1

1 e ( x )

Aus diesem Grund wurden die winsorisierten Kennzahlenwerte durch eine

lineare Transformation auf Werte zwischen 0 und 1 abgebildet. Die zu

lernenden Ausgabewerte wurden auf 0.2 für die Klasse der kritischen und

0.8 für die Klasse der guten Unternehmen festgelegt.

5.2 Ergebnisse

Eine Möglichkeit zur Vermeidung unnötig großer und damit an die

Lernstichprobe "über-angepasster" Netze stellen die sog. Pruning-Verfahren

dar. Bei diesen Verfahren werden während des Trainings Gewichte oder

Neuronen nach bestimmten Kriterien eliminiert (vgl. /ZEL94/, S. 319 ff.). In

unserer Untersuchung erwies sich ein solches Vorgehen als überflüssig.

Selbst ein 3-schichtiges Neuronales Netz mit 400 Neuronen in der

verborgenen Schicht und einem Ausgabeneuron (dies entspricht 2000

Gewichten und 401 Schwellenwerten) konnte die Klassifizierungsaufgabe

nicht besser lösen als ein kleines Netz mit nur 2 Neuronen in der

verborgenen Schicht und einem Ausgabeneuron. Daher werden die

Ergebnisse nur für dieses Netz dargestellt (vgl. Tab. 6).

13

Das Netztraining wurde beendet, nachdem sich ein stabiler der Wert für die

Fehlerfunktion sowie für die Klassifikationsleistung eingestellt hatte. Dies

war nach ca. 150 000 Lernschritten der Fall.

Lernstichprobe

Alpha-Fehler

Beta-Fehler

5-fache

Kreuzvalidierung

32,08%

35,07%

30,05%

34,98%

Tabelle 6: Ergebnisse für ein feed-forward-Netz mit 2 Neuronen in einer

verborgenen Schicht und einem Ausgabeneuron.

6 Zusammenfassende Bewertung

Die Diskriminanzanalyse mit dem in 3.1 beschriebenen Kennzahlensystem

führt zu einem ähnlichen Klassifikationsergebnis wie das in einer früheren

Untersuchung (vgl. /JAC97/) verwendete Kennzahlensystem. Mit Hilfe der

nicht-linearen Untersuchungsmethode der Neuronalen Netze konnten keine

Verbesserungen erzielt werden.

Aufgrund des erheblich höheren Entwicklungsaufwands für Neuronale

Netze ist das Verfahren der Diskriminanzanalyse vorzuziehen. Die bessere

Nachvollziehbarkeit der Unternehmensklassifikation mit Hilfe einer

Diskriminanzfunktion spricht ebenfalls für diese Empfehlung. Die

Diskriminanzfunktion kommt mit 4 Gewichten und einer linearen

Verknüpfungsvorschrift aus. Im Vergleich dazu erfordert das verwendete

Neuronale Netz 10 Gewichte, 3 Schwellenwerte und eine nicht-lineare

Verknüpfungsvorschrift.

Des Weiteren lässt sich aus dem Untersuchungsergebnis folgende Hypothese

ableiten, die jedoch durch weitere Analysen mit einer umfangreicheren

Datenbasis zu verifizieren wäre:

Die vergleichsweise schlechten Ergebnisse bei der Bonitätsklassifikation

kleiner Unternehmen mit Hilfe von Bilanz- und Jahresabschlussdaten sind

weder auf das verwendete Kennzahlensystem noch auf die verwendete

Untersuchungsmethode zurückzuführen.

Es ist vielmehr zu vermuten, dass die Ergebnisse durch andere Faktoren

bestimmt werden. Nach Feststellungen der Bundesbank sinkt der Anteil der

Bankkredite an der Bilanzsumme mit zunehmender Unternehmensgröße.

14

Beträgt er bei westdeutschen Unternehmen mit einem Umsatz bis zu 10 Mio.

DM 34%, so beläuft er sich bei Firmen mit über 100 Mio. DM Umsatz auf

nur noch 7% /BUN01/. Daraus ergibt sich eine stärkere Abhängigkeit der

wirtschaftlichen Lage kleinerer Unternehmen von den Kreditentscheidungen

der Banken. Es ist offensichtlich, dass dadurch die Bonitätsklassifikation

erschwert wird. Nicht nur die unternehmerische Tätigkeit selbst, sondern

auch die Entscheidungen der kreditgebenden Banken beeinflussen die

Klassenzugehörigkeit. Ein weiterer Grund für die relativ hohe Anzahl von

Fehlklassifikationen ist sicherlich auf den begrenzten Aussagewert der

Bilanzen kleinerer Unternehmen zurückzuführen. Aus steuerlichen Gründen

oder haftungsmäßigen Aspekten verlagern vielfach die "geschäftsführenden

Unternehmer" Einkommen und Vermögen in den Privatbereich. Dies führt

zu verzerrten Werten für den Gewinn oder das Eigenkapital.

7 Literatur

/BAE96/ Baetge, J. [u.a.]: Bonitätsklassifikationen von Unternehmen mit

Neuronalen Netzen, Wirtschaftsinformatik 38. Jg. Heft 3, 1996, S. 273 - 281.

[BUN01] Deutsche Bundesbank, Pressenotiz vom 9. März 2001: Zu "Basel

II",

http://www.bundesbank.de/by/de/pressenotizen/notizen/basel140301.htm

/BUR94/ Burger, A: Zur Klassifikation von Unternehmen mit neuronalen

Netzen und Diskriminanzanalysen, Zeitschrift für Betriebswirtschaft 64. Jg.,

1994, S. 1165 - 1179.

/DIE95/ Dietterich, T.: Overfitting and Undercomputing in Machine

Learning, ACM Computing Surveys, Vol. 27, No. 3, 1995, S. 326 - 327.

/FAH96/ Fahrmeir, L., Häußler, W., Tutz, G.: Disriminanzanalyse, in:

Multivariate Statistische Verfahren, 2. überarbeitete Aufl., hrsg. von Ludwig

Fahrmeir, Alfred Hamerle und Gerhard Tutz, Walter de Gruyter, Berlin,

New York, 1996, S. 357 - 435.

/FIS36/ Fisher, R. A.: The use of multiple measurement in taxonomic

problems, Ann. Eugenics 7, 1936, S. 179 - 188.

/GLI78/ Glick, N.: Additive estimators for probabilities of correct

classification, Pattern Recognition 10, 1978, S. 211 - 222.

15

/HAU95/ Hauschildt, J., Leker, J.: Bilanzanalyse unter dem Einfluß

moderner Analyse- und Prognoseverfahren, Betriebswirtschaftliche

Forschung und Praxis 3, 1995, S. 249 - 268.

/HOR91/ Hornik, K.: Approximation capabilities of multilayer feedforward

networks, Neural Networks, Vol. 4, 1991, S. 251 - 257.

/HUB85/ Huber, P. J.: Projection Pursuit, Ann. Statist. 13, 1985, S. 435 525.

/JAC97/ Jacobs, J., Weinrich, G., Goede, K.: Der Nutzen von ScoringModellen bei der Bilanzauswertung kleiner mittelständischer Unternehmen,

BBK 15, Fach 19, 1997, S. 423 - 432

/KER94/ Kerling, M., Podding, P.: Klassifikation von Unternehmen mittels

KNN, in: Neuronale Netze in der Ökonomie: Grundlagen und

finanzwirtschaftliche Anwendungen, hrsg. von H. Rehkugler u. H. G.

Zimmermann, Vahlen, München, 1994, S. 427 - 490.

/MOO95/ Moody, J., Utans, J.: Architecture Selection Strategies for Neural

Networks: Application to Corporate Bond Rating Prediction, in: Neural

Networks in the Capital Markets, hrsg. von A.-P. Refenes, Wiley, Chichester

[u. a.], 1995, S. 277 - 300.

/ODO90/ Odom, M. D., Sharda, R.: A Neural Network Model for

Bankruptcy Prediction, IEEE, Proceedings of the International Joint

Conference on Neural Networks, San Diego, 1990, Vol. II, S. 163 - 168.

/SAC92/ Sachs, L.: Angewandte Statistik, 7. völlig neu bearb. Aufl.,

Springer, Berlin [u. a.], 1992.

/WAH75/ Wahba, G., Wold, S.: A completely automatic french curve:

Fitting spline functions by cross-validation, Communications in Statistics, 4,

1, 1975, S. 1 -17.

/ZEL94/ Zell, A.: Simulation Neuronaler Netze, Addison-Wesley, Bonn [u.

a.], 1994.

16