Generalisierte additive Modelle

Werbung

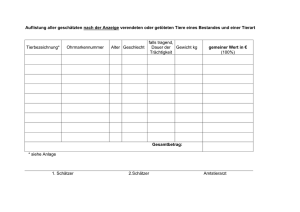

Generalisierte additive Modelle Seminar: Statistische Analysen zur Wirkung von Luftschadstoffen Stefanie Sprung 8.11.2004 Überblick Lineare Modelle Verschiedene Splines Optimierung: Validierung AIC Freiheitsgrade GAM Beispiel 2 Lineares Modell Y f ( x) f ( X 0 ,..., X p ) X Kovariablen, Y Responsevariablen Y 0 X 0 ... p X p Additiver linearer Zusammenhang zwischen Y und X Y 0 X 0 ... p X p Mit zufälliger Störgröße ε 3 Polynom 3. Grades y i f ( z i ) i 0 1 z i 2 z i2 3 z i3 i Rückführung des Modells auf einfaches lineares Modell mit: 2 3 x1i z i , x 2i z i , x3i z i Designmatrix 1 z1 z12 z13 X : : : : 1 z z 2 z 3 n n n 4 Schätzung Basierend auf KQ-Schätzung yˆ Eˆ ( y ) Xˆ X ( X ' X ) 1 X ' y Py P ist Projektionsmatrix rgP= spP= rgX= Anzahl der Spalten =Anzahl der freien Parameter 5 Smoother Problem: bei manchen Datensätzen gibt es keine einfache Transformation Lösung: Ersetzen der linearen Beziehung durch: Y 0 1 x Y f (x) f unspezifische Funktion, die bestimmten Glattheitsforderungen genügt (etwa f stetig, stetig differenzierbar etc.) 6 Basisfunktionsansätze Approximiere die unbekannte Funktion durch möglichst flexiblen Funktionenraum f ( x) 0 B0 ( x) 1 B1 ( x) ... p B p ( x) Darstellung der Funktion f als Linearkombination einer endlichen Menge von Basisfunktionen 7 Polynome vom Grad p einfacher Basisansatz basiert auf Polynome Y 0 1 x 2 x 2 ... p x p als Basisfunktionen verwenden wir 2 p B ( x ) 1 , B ( x ) x , B ( x ) x ,..., B ( x ) x 0 i 1 2 p Problem: Wahl von p? 8 Polynomial Splines Intervall [a,b] R und Knoten a-ξ1< ξ2<....< ξm-b Funktion s:[a,b]->R heißt Spline-Funktion vom Grad l (Ordnung l+1), wenn S ist Polynom (max Grad k) auf [ξ j, ξ j+1] j=0,..,m S besitzt stetige Ableitungen der Ordnung l-1 auf [a,b] Menge der Polynomsplines ist ein Vektorraum der Ordnung m+(l-1) (Anzahl der Knoten + Grad) 9 B-Splines 1 B ( z) 0 B ( z) j z 0 j l j j 1 sonst z j j l Basisfunktion für Splines j l 1 z l 1 B ( z) B j 1 ( z ) j j l 1 j 1 l 1 j Dann erhalten wir für z [a,b] s( z ) m 1 l B j j ( z) j l 1 10 B-Splines zur Berechnung benötigen wir 2l zusätzliche Knoten l 1 l 2 ... 1 ... m m1 ... ml Knotenmenge bildet erweiterte Partition äquidistante Knotenwahl: Intervall [xmin,xmax] xmax xmin h und erhalten j xmin ( j 1) h Knoten m 1 Wie viele Knoten sollen spezifiziert werden? Wo sollen die Knoten plaziert werden? 11 Bilder B-Spline 12 P-Splines definiere eine relativ große Anzahl äquidistanter Knoten (ca. 20-40) um ausreichende Flexibilität des Splineraums zu gewähren zu starke Abweichungen benachbarter Regressionskoeffizienten βj werden durch Strafterme basierend auf quadrierte Differenzen k-ter Ordnung bestraft 13 P-Spline unbekannte Funktion f durch einen Spline vom Grad l approximieren p f ( x) j B j ( x) j 0 Bj ist eine B-Spline Basis 14 P-Splines penalisierte Residuenquadratsumme n p i 1 j 0 SP( ) ( yi j B j ( xi )) 2 k p k 2 ( ) j j k 1 Differenzenoperator k-ter Ordnung p Strafterm-> Verhindert zu starke Anpassung an Daten, k ( j ) damit überfitten j k 1 Glättungsparameter λ 15 Glättungsspline x1<x2<…<xn n SP( f ) ( y i f ( xi )) 2 ( f ' ' ( x)) 2 dx ->min i 1 Lösung: natürliche kubische Splines fˆ ist Polynom 3.Grades auf [xi;xi+1] für alle i f´´(xi) ist stetig in allen Beobachtungen f´´(x1)=f´´(xn)=0 d.h. am Rand verschwindet die 2. Ableitung 16 kubische Splines a<x1<...<xn<b eine Unterteilung des Intervalls [a,b] zusätzliche Randbedingung: s‘‘(a)=0, s‘‘(b)=0 in den Intervallen [a,xn] und [xn,b] ist s linear bei Glättungssplines mehr Basisfunktionen notwendig n penalisierter KQ-Kriterium SP( ) ( yi s( xi )) 2 (s' ' ( x)) 2 dx p i 1 wobei s( x) j B j ( x) ein NKS in B-Spline Basis ist j 1 17 lokale Polynome Nächste Nachbar Schätzer Lokale polynomiale Regression Locally-weighted running-line smoother im statistischen Programmpaket loess k nahsten Nachbarn 18 Nächste Nachbar Schätzer fˆ ( x) „Mittelwert“ der Responsebeobachtungen in einer Nachbarschaft formal: fˆ ( xi ) Ave jN ( x ) ( y j ) Ave Mittelwertoperator und N(xi) eine Nachbarschaft von xi symmetrische Nachbarschaft k nächsten Nachbarn (unsymmetrische Nachbarschaft) i 19 Mittelwertoperatoren Running mean Schätzer: arithmetisches Mittel der Beobachtung in N(xi) zur Bestimmung von fˆ ( x) Running median Schätzer: Median der Beobachtung in N(xi), nichtlinearer Glätter Running line Schätzer: Beim Running line Schätzer definieren wir fˆ ( xi ) ˆ0 ˆ1 xi KQ-Schätzer basierend auf Beobachtungen 20 Lokale polynomiale Regression Taylorapproximation p f ' ' ( x) f ( xi ) f ( x) f ' ( x)( xi x) ( xi x)² ... 0 j ( xi x) j 2 j 1 gewichtete Residuenquadratsumme x x w ( x, x ) wobei w ( x, x ) K y ( x x ) als Schätzer bedingter Erwartungswert p n j i 1 i 0 j 1 j i fˆ ( x) E (Y | X x) i i i yd ( x, y)dy d ( x) 21 Berechnung der lokalen Polynome K nächste Nachbar von x0 wird identifiziert, bezeichnet als N(x0) ( x 0 ) max N ( x0 ) | x o x1 | wird berechnet, Distanz des weitesten nahsten Nachbarn von x0 Gewichte wi sind zugewiesen zu jedem Punkt in N(x0), sie benutzen das tri-kubsiche Gewichtsfunktion: 22 Berechnung der lokalen Polynome | x xi | ) wi K ( ( x ) mit definierten Gewichte (1 u 3 ) 3 K (u ) 0 0≤u≤1 fˆ ( x ) bestimmen durch gewichtete lineare Regression 23 Glättungsparameterwahl λ steuert den Ausgleich zwischen Bias und Variabilität λopt minimiert ein Kriterium n MSE ( ) 1n E fˆ ( xi ) f ( xi )² i 1 mean average squared error 1 n PSE ( ) E ( y i* fˆ ( xi ))² n i 1 predicted squared-error 24 Kreuz-Validierung Leaving one out 1 n CV ( ) ( y i fˆi ( xi ))² n i 1 Schätzung aller Daten ohne (yi,xi) Summe der neuen Gewichte Σ(sij/(1-sii))=1 S ij ( ) ˆf ( x ) yj i j 1 1 S ii ( ) i n j i 25 Generalisierte Kreuz-Validierung Rechentechnisch einfacher n GCV ( ) 1 (y i 1 i fˆ ( xi ))² n (1 1 sp ( S ( )))² n Sii durch Spur ersetzt 26 Additive Modelle y i f ( xi1 ,...xip ) i Additivität der Einflußgrößen wird beibehalten, während der lineare Einfluss fallen gelassen wird y i i i 0 f1 ( xi1 ) ... f p ( xip ) i f1,...,fp sind unbekannte „glatte“ Funktionen 27 AIC-Statistik n AIC i 1 ( y i ˆi )² 2ˆ ² sp ( R ) ˆ ² Erste Term bestraft eine mangelnde Anpassung an die Daten Zweite Term bestraft die hohe Modellkomplexität Menge des AIC hat Form des AkaikeInformationskriterium Matrix R ist Gesamtsmoothermatrix ̂ Ry 28 Freiheitsgrade SST =SSM+SSE n-1 = p +n-p-1 Freiheitsgrade σ²=SSE/n-p -> erwartungstreuer Schätzer df=sp(Sλ) (alternativ: n-sp(2Sλ-SλSλT ) oder sp(SλSλT)) Freiheitsgrade df jerr sp(2R RR T ) sp(2R( j ) R( j ) R(Tj ) ) Freiheitsgrade der Fehler 29 Projektionsmatrix df(model)=tr(S) df(error)=E(RSS)=σ²(n-tr(2S-SST) S ist symmetrisch und idempotent Für polynomiale Regression, RegressionsSplines df(error)=σ²(n-tr(S)) 30 Generalisierte Lineare Modelle yi i b( i ) d ( y | , , w , x ) exp w c ( y , , w ) i i i i i i i i Bedingte Verteilung gehört Exponentialfamilie Es gilt: an E ( yi | xi ) i b' ( i ) b' ' ( i ) Var ( yi | xi ) wi Erwartungswertr hängt über Responsefunktion ab i xi ' i h(i ) 31 Generalisierte additive Modelle Lineare Prädiktor wird durch additiven ersetzt i 0 f1 ( xi1 ) ... f p ( xip ) Unbekannte Funktionen könne durch KQAlgorithmus und Backfitting Algorithmus geschätzt werden Residuenquadratsumme wird durch Devianzen ersetzt 32 Generalisierte additive Modelle li ( ˆ i ) Loglikelihood in Abhängigkeit vom geschätzten Erwartungswert ˆ i h(ˆi ). n Devianz: D( y, ˆ ) : 2 (li ( ˆ i ) li ( yi )) i 1 Je höher Devianz, desto schlechter Anpassung 1 / nD( y, ˆ ) GCV ( ) (1 sp ( R) / n)² AIC D 2sp ( R) 33 6 4 2 0 RES5 8 10 12 Generalisiertes lineares Modell 50 100 150 200 PMME 34 6 4 2 0 RES5 8 10 12 Polynom 3. Grades 50 100 150 200 PMME 35 6 4 2 0 RES5 8 10 12 Kubischer Spline mit 3 Knoten 50 100 150 200 PMME 36 6 4 2 0 RES5 8 10 12 Kubischer Spline mit 7 Knoten 50 100 150 200 PMME 37 6 4 2 0 RES5 8 10 12 Lokal gewichteter Spline 50 100 150 200 PMME 38 6 4 2 0 RES5 8 10 12 Smoothing Spline 50 100 150 200 PMME 39 Quellenangabe Studie „Assesing Confounding, Effect Modification, and Thresholds in the Association between Ambient Particles and Daily Deaths“ Joel Schwarz „Generalized Additive Models“ Hastie/Tibsherani „Multivariate Statistical Modelling Based on Generalized Linear Models“ Fahrmeir/Tutz „Computerintensive Verfahren der Statistik“ Stefan Lang 40