Teil V Wahrscheinlichkeitsrechnung Ziel der

Werbung

Ziel der Wahrscheinlichkeitsrechnung

Aussagen über Experimente und Prozesse mit

„unsicherem“ Ausgang.

Teil V

Beispiele

Würfeln

Wahrscheinlichkeitsrechnung

Ziehen von Losen aus einer Urne

Glücksspiele (Lotto, Roulette,. . . )

Lebensdauer von technischen Bauteilen

Genauigkeit von Messungen

Literatur:

U. Krengel. Einführung in die Wahrscheinlichkeitstheorie und

Statistik. Vieweg, 1991.

358 / 469

357 / 469

Experiment: Wurf eines Würfels

Frage: Was ist die Wahrscheinlichkeit für eine gerade Zahl

als Ergebnis?

Das Ereignis „gerade Zahl“ entspricht der

Teilmenge M = {2, 4, 6} ⊂ Ω des Ergebnisraums.

Mögliche Ergebnisse: Zahlen 1, 2, 3, 4, 5, 6

Annahme: Alle Ergebnisse sind „gleich wahrscheinlich“

Das bedeutet: Wenn man „sehr oft“ würfelt, treten alle

Ergebnisse „gleich häufig auf“, jedes Ergebnis tritt also in etwa

1/6–tel aller Fälle auf.

Wahrscheinlichkeit: p(M) = 1/2 = p({2}) + p({4}) + p({6}).

=> Zuordnung einer Wahrscheinlichkeit

zu allen Teilmengen von Ω.

Abstraktion des Experimentes:

Interpretation der Wahrscheinlichkeit:

Menge der möglichen Ergebnisse: Ω = {1, 2, 3, 4, 5, 6}

Wahrscheinlichkeit p(M) = a bedeutet:

Bei sehr häufiger Wiederholung des Experimentes tritt der Fall

„Ergebnis liegt in M“ etwa im a–fachen aller Fälle auf.

Zuordnung von Wahrscheinlichkeiten:

p({1}) = p({2}) = p({3}) = p({4}) = p({5}) = p({6}) = 1/6

Bezeichnung: Die Menge P(Ω) = {M | M ⊂ Ω}

aller Teilmengen von Ω heißt Potenzmenge von Ω.

359 / 469

360 / 469

Bemerkungen

Für die leere Menge ∅ gilt p(∅) = 0

denn wegen Ω ∩ ∅ = ∅ folgt

Definition

Ein endlicher Wahrscheinlichkeitsraum (Ω, p) besteht aus

1 = p(Ω) = p(Ω ∪ ∅) = p(Ω) + p(∅) = 1 + p(∅)

einer endlichen Menge Ω von möglichen Ergebnissen

einer Abbildung p : P(Ω) → [0, 1] mit folgenden

Eigenschaften:

Analog folgt für jede Menge M ⊂ Ω

p(M) = 1 − p(Ω \ M)

p(Ω) = 1

M1 , M2 ⊂ Ω, M1 ∩ M2 = ∅ => p(M1 ∪ M2 ) = p(M1 ) + p(M2 )

(Additivität)

Bei einem endlichen Wahrscheinlichkeitsraum

ist p eindeutig definiert durch die

Elementarwahrscheinlichkeiten p({ω}) für ω ∈ Ω.

Für M ⊂ Ω gilt:

X

p(M) =

p({ω})

Die Menge Ω heißt Ergebnismenge oder Ergebnisraum.

Die Abbildung p : P(Ω) → [0, 1] heißt

Wahrscheinlichkeitsverteilung oder Wahrscheinlichkeitsmaß.

ω∈M

361 / 469

362 / 469

Beispiel: Wurf zweier Würfel

Frage:

2 Möglichkeiten für die Ergebnismenge:

1

Sind bei einem Wurf zweier Würfel die Ergebnisse „1 und 1“

und „1 und 2“ (ohne Berücksichtigung der Reihenfolge) „gleich

wahrscheinlich“ oder nicht?

Mit Berücksichtigung der Reihenfolge:

Ω1 = (i, j) | i, j ∈ {1, . . . , 6}

Die Ergebnisse {(1, 2)} und {(2, 1)} sind verschieden

Zuordnung von Elementarwahrscheinlichkeiten:

Antwort:

1 1

1

· =

6 6

36

(36 gleich wahrscheinliche Ergebnisse)

Wir wählen als Ergebnisraum Ω1 , also den eines Wurfes zweier

Würfel mit Berücksichtigung der Reihenfolge.

p1 ({(i, j)}) =

2

1

„1 und 1“: p1 ({(1, 1)} = 36

„1 und 2“: p1 ({(1, 2), (2, 1)}) = 2 ·

Ohne Berücksichtigung der Reihenfolge:

Ω2 = (i, j) | i, j ∈ {1, . . . , 6}, i ≤ j

1

36

=

1

18

Elementarwahrscheinlichkeiten: ?

363 / 469

364 / 469

Laplacesches Zufallsexperiment

Urnenexperimente

Aus einer Urne mit n durchnummerierten Kugeln / Losen zieht

man sukzessive m Kugeln / Lose.

Ein Zufallsexperiment, dessen Ergebnismenge Ω aus einer

endlichen Zahl von Elementen mit gleicher Wahrscheinlichkeit

besteht, heißt Laplacesches Zufallsexperiment.

2 Varianten:

Der zugehörige Wahrscheinlichkeitsraum heißt ein

Laplacescher Wahrscheinlichkeitsraum

mit Zurücklegen:

Nach jedem Zug wird die Nummer der gezogenen Kugel

notiert und die Kugel zurückgelegt

Die zugehörige Wahrscheinlichkeitsverteilung p heißt

Gleichverteilung oder Laplace–Verteilung oder kurz

L(Ω)–Verteilung. Dabei gilt:

#(M)

p(M) =

#(Ω)

ohne Zurücklegen:

Gezogene Kugeln werden nicht wieder zurückgelegt.

Jede Zahl kann dann höchstens einmal auftreten und man

kann maximal n mal ziehen.

wenn #(M) die Anzahl der Elemente der Menge M bezeichnet.

Für jede Variante kann man die Fälle

mit Berücksichtigung der Reihenfolge

Der Wurf zweier Würfel ist ein Laplacesches Zufallsexperiment,

wenn man als Ergebnismenge Ω1 wählt, also die Reihenfolge

berücksichtigt.

ohne Berücksichtigung der Reihenfolge

unterscheiden.

366 / 469

365 / 469

Urnenexperiment mit Zurücklegen mit Reihenfolge

Urnenexperiment ohne Zurücklegen mit Reihenfolge

Experiment „m aus n“

Experiment „m aus n“

Ergebnismenge:

Ergebnismenge

Ω = ω ∈ {1, . . . , n}m | ωi 6= ωj für i 6= j

Ω = {1, 2, . . . , n}m

= (n1 , n2 , . . . , nm ) | nj ∈ {1, . . . , n} für j = 1, . . . , m

Anzahl der Elemente:

#(Ω) = n(n − 1)(n − 2) · · · (n − m + 1) =

Anzahl der Elemente:

#(Ω) = n

· · · · · n} = nm

| · n {z

m mal

n!

(n − m)!

mit n! = 1 · 2 · · · · · n

Elementarwahrscheinlichkeiten:

Elementarwahrscheinlichkeiten:

1

p({ω}) = m

n

(alle Ergebnisse sind gleich wahrscheinlich)

p({ω}) =

367 / 469

(n − m)!

n!

368 / 469

Beispiel 1

Beispiel 2

Anzahl der Permutationen (Vertauschungen) einer Menge mit n

Elementen

Darstellung als Urnenexperiment:

Wahrscheinlichkeit für 5 aufeinanderfolgende Zahlen beim Wurf

von 5 Würfeln.

Sukzessive Auswahl „n aus n“ ohne Zurücklegen mit

Reihenfolge

Darstellung als Urnenexperiment:

=> Es gibt n! Permutationen

Jeder Wurf entspricht einem Zug einer Zahl aus einer Urne mit

6 Elementen

Statt „einmal 5 Würfel“ kann man „5 mal einen Würfel“ werfen

Satz

Die Anzahl der Permutationen einer n–elementigen Menge ist

n!.

=> Urnenexperiment „5 aus 6“

370 / 469

369 / 469

Beispiel 3

Gewinnwahrscheinlichkeit beim Lotto „6 aus 49“

Ereignis „5 aufeinanderfolgende Zahlen“

bei Ergebnismenge Ω = {1, 2, . . . , 6}5

(mit Berücksichtigung der Reihenfolge!):

M = ω ∈ Ω | {ω1 , . . . , ω5 } = {1, 2, 3, 4, 5}

oder {ω1 , . . . , ω5 } = {2, 3, 4, 5, 6}

Urnenexperiment „6 aus 49“ ohne Zurücklegen ohne

Reihenfolge

Vorhandener Tipp: {a1 , a2 , a3 , a4 , a5 , a6 }

Ereignis „6 Richtige“ bei Ergebnisraum

Ω = ω ∈ {1, . . . , 49}6 | ωi 6= ωj für i 6= j

(also mit Berücksichtigung der Reihenfolge!):

M = ω ∈ Ω | {ω1 , . . . , ω6 } ∈ {a1 , a2 , . . . , a6 }

Anzahl: #(M) = 2 · 5!

Wahrscheinlichkeit:

2 · 5!

#(M)

5

5

P(M) =

=

=

= 0,0308 · · ·

=

5

4

#(Ω)

6

162

2·3

Anzahl: #(M) = 6!

(Anzahl der Permutationen von {a1 , a2 , . . . , a6 })

Ein Ereignis bezeichnet eine Teilmenge der Ergebnismenge

Wahrscheinlichkeit:

#(M)

1·2·3·4·5·6

1

p(M) =

=

=

#(Ω)

49 · 48 · 47 · 46 · 45 · 44

13.983.816

371 / 469

372 / 469

Verallgemeinerung: Auswahl „m aus n“

Urnenexperiment ohne Zurücklegen ohne Reihenfolge

Ziel:

Anzahl der Möglichkeiten, m Elemente aus n Elementen ohne

Berücksichtigung der Reihenfolge auszuwählen.

Ergebnisraum für Urnenexperiment „m aus n“:

Ω = ω = (ω1 , . . . , ωm ) ∈ {1, . . . , n}m | ω1 < ω2 < · · · < ωm

Mit Berücksichtigung der Reihenfolge:

(Anordnung der Ergebnisse in aufsteigender Reihenfolge)

Urnenexperiment „m aus n“ ohne Zurücklegen

n!

=>

Möglichkeiten.

(n − m)!

Jedes Ergebnis ohne Berücksichtigung der Reihenfolge

entspricht m! Ergebnissen mit Berücksichtigung der

Reihenfolge

Anzahl der Elemente: Entspricht der Anzahl der Möglichkeiten,

m Elemente aus n Elementen auszuwählen:

n

#(Ω) =

m

Elementarwahrscheinlichkeiten:

1

(n − m)!m!

p({ω}) = =

n!

n

m

Resultat: Es gibt

n!

n

=

m

(n − m)!m!

Möglichkeiten, m Elemente aus n Elementen ohne

Berücksichtigung der Reihenfolge auszuwählen.

373 / 469

374 / 469

Urnenexperiment mit Zurücklegen ohne Reihenfolge

Mögliche Wahl der Ergebnismenge:

Ω = ω = (ω1 , . . . , ωm ) ∈ {1, . . . , n}m | ω1 ≤ ω2 ≤ · · · ≤ ωm

Die Elementarwahrscheinlichkeiten sind hier nicht alle gleich,

d.h. Ω ist kein Laplacescher Ergebnisraum:

(Anordnen der Ergebnisse in aufsteigener Reihenfolge)

Z.B. haben für n = 6, m = 2 (Wurf zweier Würfel) die

Ergebnisse (1, 2) und (1, 1) unterschiedliche

1

1

Wahrscheinlichkeiten p({(1, 2)}) = 18

, p({(1, 1)}) = 36

.

Anzahl der Elemente: Nicht direkt ersichtlich.

Man kann eine bijektive Abbildung

e= ω

Φ:Ω→Ω

e ∈ {1, . . . , n + m − 1}m | ω

e1 < ω

e2 < · · · < ω

em

Fazit: Es ist einfacher, als Ergebnismenge die eines

Urnenexperimentes mit Zurücklegen mit Reihenfolge zu wählen

und das Ereignis als Menge aller Permutationen der Elemente

des Ereignisses ohne Berücksichtigung der Reihenfolge zu

definieren.

Φ(ω) = ω

e mit ω

ej = ωj + j − 1 für j = 1, . . . , m

konstruieren.

Beispiel: Φ(1, 1, 2, 3, 3, 5) = (1, 2, 4, 6, 7, 10)

Es gilt:

e =

#(Ω) = #(Ω)

n+m−1

m

375 / 469

376 / 469

Hypergeometrische Verteilung

Das Ereignis M = „` rote Kugeln“ setzt sich zusammen aus:

Aus einer Urne mit n roten und m schwarzen Kugeln wählen wir

zufällig k Kugeln aus.

Wie groß ist die Wahrscheinlichkeit für genau ` rote Kugeln als

Ergebnis?

Mathematische Beschreibung:

Nummerierung der Kugeln von 1 bis n für rote und n + 1 bis

n + m für schwarze Kugeln.

Urnenexperiment „k aus n + m“ ohne Zurücklegen ohne

Reihenfolge.

Auswahl

von ` roten aus n roten Kugeln

n

=>

Möglichkeiten

`

Auswahl

von

k − ` schwarzen aus m schwarzen Kugeln

m

=>

Möglichkeiten

k −`

n

m

Insgesamt: #(M) =

`

k −`

Wahrscheinlichkeit:

n

m

`

k −`

p(M) = n+m

k

Ergebnisraum:

Ω = ω ∈ {1, . . . , n + m}k | ω1 < ω2 < . . . < ωk

n+m

#(Ω) =

k

(für 0 ≤ ` ≤ min{k , n})

378 / 469

377 / 469

Das Galton–Brett

Schräg / senkrecht gestellte Platte mit n Reihen aus

Hindernissen/Nägeln, an denen eine herunterfallende Kugel

jeweils nach links bzw. rechts abgelenkt wird. Nach den n

Reihen befinden sich von 0 bis n durchnummerierte Behälter,

in denen die Kugel aufgefangen wird.

Direkte Beschreibung:

Wahrscheinlichkeitsraum (Ω, p) mit

Ω = {0, . . . , n}, ω ∈ Ω = Anzahl der roten Kugeln

n

m

`

k −`

p({`}) = n+m

k

Diese Verteilung heißt hypergeometrische Verteilung oder

H(n, m, k )–Verteilung

0 1 2 3 4 5

379 / 469

380 / 469

Frage: Mit welcher Wahrscheinlichkeit fällt die Kugel

in den k –ten Behälter?

Interpretation als Urnenexperiment:

k –ter Behälter bedeutet:

k Ablenkungen nach rechts, n − k Ablenkungen nach links.

Auswahl „n aus 2“ mit Zurücklegen, wobei eine Ziffer „1“ einer

Ablenkung nach links und „2“ einer Ablenkung nach rechts

entspricht.

Aufteilen der k Ablenkung nach rechts auf die n Stufen:

Auswahl „k aus n“ (ohne Zurücklegen ohne Reihenfolge)

n

=>

Möglichkeiten.

k

n

−n

=> Wahrscheinlichkeit für Behälter k : 2

k

Urnenexperiment mit Reihenfolge

=> Ergebnisraum: Ω = {1, 2}n

Anzahl Elemente: #(Ω) = 2n

Elementarwahrscheinlichkeit: p({ω}) = 2−n

Wenn man als Ergebnisse die Nummer des Behälters wählt,

e = {0, . . . , n}

hat man die Ergebnismenge Ω

n

−n

e({k }) = 2

und die Elementarwahrscheinlichkeiten p

k

382 / 469

381 / 469

Verallgemeinerung des Galton–Bretts

Unterschiedliche Wahrscheinlichkeiten:

Direkte Beschreibung:

Wahrscheinlichkeit p für Ablenkung nach rechts,

q = 1 − p für Ablenkung nach links.

Wahrscheinlichkeitsraum (Ω, p) mit

Ω = {0, . .

. , n}

(Menge der Behälternummern)

n

p({k }) =

pk (1 − p)n−k

k

Ergebnisraum: Ω = {1, 2}n

Einzelwahrscheinlichkeit für Ereignis ω ∈ Ω mit

k mal „2“ (Ablenkung nach rechts) und

n − k mal „1“ (Ablenkung nach links):

Diese Verteilung heißt Binomialverteilung oder

B(n, p)–Verteilung.

p({ω}) = pk (1 − p)n−k

Anwendung: Anzahl eingetretener Ereignisse bei mehrfacher

Wiederholung eines Zufallsexperiments

für ω = Permutation von (1, . . . , 1, 2, . . . , 2)

| {z } | {z }

n−k mal

k mal

Wahrscheinlichkeit für „Kugel fällt in Behälter k “:

n

e

p({k }) =

pk (1 − p)n−k

k

383 / 469

384 / 469

Beispiel

Zufallsvariablen

Bei vielen Zufallsexperimenten ist nicht das genaue Ergebnis

ω ∈ Ω von Interesse, sondern eine bestimmte Größe X = X (ω),

die von ω abhängt.

In einem Hörsaal sitzen 105 Personen.

Beispiel:

Die Zahl derer, die heute Geburtstag haben, ist B(n, p)–verteilt

1

mit n = 105, p = 365

.

Beim Galton–Brett ist am Ende nicht der durch ω ∈ {1, 2}n

codierte Weg interessant, sondern die Nummer k ∈ {0, . . . , n}

des Behälters, in den die Kugel am Ende fällt.

Die Wahrscheinlichkeit, dass genau zwei Personen heute

Geburtstag haben, ist

1 2 364 103

105

= 0,03089 · · · ∼ 3%

p({2}) =

2

365

365

Definition

Sei (Ω, p) ein Wahrscheinlichkeitsraum und X eine Menge.

Dann heißt eine Funktion X : Ω → X Zufallsvariable.

Die durch pX (A) := p({ω ∈ Ω | X (ω) ∈ A}) definierte Funktion

pX : P(X ) → [0, 1] heißt Verteilung der Zufallsvariablen.

386 / 469

385 / 469

Beispiel 1: Wurf zweier Würfel

Beispiel 2: Galton–Brett

Wahrscheinlichkeitsraum (Ω, p) mit Ω = {1, . . . , 6}2 ,

1

p({(i, j)}) = 36

(d.h. mit Reihenfolge)

Ω = {1, 2}n

p({ω}) = pk (1 − p)n−k

für ω = Permutation von (1, . . . , 1, 2, . . . , 2)

| {z } | {z }

Beispiele für Zufallsvariablen:

X : Ω → X := {ω = (ω1 , ω2 ) ∈ Ω | ω1 ≤ ω2 }

(

(i, j) für i ≤ j

X ((i, j)) =

(j, i) für j ≤ i

n−k mal

n

X

Zufallsvariable X : Ω → {0, . . . , n}, X ({ω}) =

k mal

(ωj − 1)

j=1

(Nummer des Behälters, in den die Kugel fällt)

n

pk (1 − p)n−k

Verteilung von X : pX ({k }) =

k

(Binomialverteilung)

(Abbildung des Ergebnisses mit Reihenfolge auf das

Ergebnis ohne Reihenfolge)

X : Ω → X := {2, . . . , 12}, X ((i, j)) = i + j

(Summe der Augenzahlen)

387 / 469

388 / 469

Bedingte Wahrscheinlichkeiten

Häufig hat man die Aufgabe, aus der Kenntnis oder Annahme

eines Ereignisses die Wahrscheinlichkeit eines anderen

Ereignisses abzuschätzen.

Bemerkung

Statt eine Zufallsvariable einzuführen, könnte man auch direkt

(X , pX ) als neuen Wahrscheinlichkeitsraum definieren.

Die Einführung von Zufallsvariablen ist trotzdem sinnvoll, weil

man

1

2

Beispiel: Test für eine Krankheit.

Von einer Krankheit ist bekannt, dass sie bei 1% aller Personen

auftritt.

dadurch „komplizierte“ Wahrscheinlichkeitsräume durch

Zufallsvariablen über „einfache“ Wahrscheinlichkeitsräume

ersetzen kann

Ein Testverfahren für diese Krankheit liefert ein positives

Ergebnis bei

98% aller kranken und

2% aller gesunden

verschiedene Varianten eines Zufallsexperimentes durch

verschiedene Zufallsvariablen über demselben

Wahrscheinlichkeitsraum beschreiben kann

Personen

Frage: Wie groß ist die Wahrscheinlichkeit, dass eine Person

mit positivem Testergebnis wirklich krank ist?

389 / 469

Definition

Sei (Ω, p) ein Wahrscheinlichkeitsraum, A, B ⊂ Ω zwei

Ereignisse. Dann ist

p(A ∩ B)

p(A|B) =

p(B)

Ereignisraum Ω aller Personen

Elementarwahrscheinlichkeit: p({ω}) =

Wahrscheinlichkeitsverteilung: p(M) =

1

#(Ω) .

#(M)

#(Ω) für

M⊂Ω

Teilmengen

die bedingte Wahrscheinlichkeit von A unter der Bedingung B

K ⊂ Ω der kranken Personen

G ⊂ Ω der gesunden Personen

P ⊂ Ω der Personen mit positivem Testergebnis

K ∩ P der Kranken mit positivem Testergebnis

G ∩ P der Gesunden mit positivem Testergebnis

Für unser Beispiel gilt

0,02 · 0,99 · #(Ω)

p(G ∩ P) =

= 0,0198

#(Ω)

p(P) = 0,02 · 0,99 + 0,98 · 0,01 = 0,0296

0,0198

p(G|P) =

= 0, 66 · · · > 1/2 !

0,0296

Wahrscheinlichkeit, dass eine Person mit positivem

Testergebnis gesund ist:

p(G|P) =

390 / 469

#(G ∩ P)

#(G ∩ P) #(Ω)

p(G ∩ P)

=

·

=

#(P)

#(Ω)

#(P)

p(P)

Das heißt, eine Person mit positivem Testergebnis ist (bei

diesem Beispiel) mit größerer Wahrscheinlichkeit gesund als

krank!

391 / 469

392 / 469

Rechenregeln für bedingte Wahrscheinlichkeiten

Beweis

p(B)

p(Ω ∩ B)

=

=1

p(B)

p(B)

und für A1 , A2 ⊂ Ω, A1 ∩ A2 = ∅:

p((A1 ∩ B) ∪ (A2 ∩ B))

p((A1 ∪ A2 ) ∩ B)

=

p(A1 ∪ A2 |B) =

p(B)

p(B)

p(A1 ∩ B) + p(A2 ∩ B)

p(A1 ∩ B) p(A2 ∩ B)

+

=

=

p(B)

p(B)

p(B)

= p(A1 |B) + p(A2 |B)

Zu (i): Es gilt p(Ω|B) =

Satz

Sei (Ω, p) ein Wahrscheinlichkeitsraum, B ⊂ Ω. Dann gilt:

(i) pB (A) := p(A|B) ist ein Wahrscheinlichkeitsmaß auf Ω, d.h.

p(Ω|B) = 1 und für A1 , A2 ⊂ Ω mit A1 ∩ A2 = ∅ gilt

p(A1 ∪ A2 |B) = p(A1 |B) + p(A2 |B)

(ii) Formel von der totalen Wahrscheinlichkeit:

Für B1 , B2 ⊂ Ω mit B1 ∪ B2 = Ω und B1 ∩ B2 = ∅ sowie

A ⊂ Ω gilt:

p(A) = p(A|B1 ) p(B1 ) + p(A|B2 ) p(B2 )

Zu (ii): Mit p(A|Bi )p(Bi ) = P(A ∩ Bi ) folgt

p(A|B1 ) p(B1 ) + p(A|B2 ) p(B2 ) = p(A ∩ B1 ) + p(A ∩ B2 )

= p((A ∩ B1 ) ∪ (A ∩ B2 )) = p(A ∩ (B1 ∪ B2 )) = p(A)

(iii) Formel von Bayes:

Für A ⊂ Ω mit P(A) 6= 0 und B1 , B2 wie in (ii) folgt

p(B1 |A) =

Zu (iii): Mit (ii) folgt p(A|B1 ) p(B1 ) + p(A|B2 ) p(B2 ) = p(A)

und dann mit p(A|B1 ) p(B1 ) = p(A ∩ B1 )

p(A ∩ B1 )

p(A|B1 )p(B1 )

=

= p(B1 |A)

p(A|B1 ) p(B1 ) + p(A|B2 ) p(B2 )

p(A)

p(A|B1 ) p(B1 )

p(A|B1 ) p(B1 ) + p(A|B2 ) p(B2 )

394 / 469

393 / 469

Beispiel

Ziehen zweier Kugeln ohne Zurücklegen aus einer Urne mit

zwei roten und drei schwarzen Kugeln

Bedingte Wahrscheinlichkeiten:

p(A|B1 ) = 1/4 (Auswahl einer roten Kugel aus einer Urne

mit einer roten und drei schwarzen Kugeln)

Frage: Wie groß ist die Wahrscheinlichkeit, dass beide Kugeln

dieselbe Farbe haben?

p(A|B2 ) = 1/2 (Auswahl einer schwarzen Kugel aus einer Urne

mit zwei roten und zwei schwarzen Kugeln)

Definition von Ereignissen:

Formel von der totalen Wahrscheinlichkeit =>

A — beide Kugeln haben dieselbe Farbe

B1 — die erste gezogene Kugel ist rot

B2 — die erste gezogene Kugel ist schwarz

p(A) = p(A|B1 ) p(B1 ) + p(A|B2 ) p(B2 )

1 2 1 3

2+6

2

= · + · =

=

4 5 2 5

20

5

Es gilt: B1 ∩ B2 = ∅, B1 ∪ B2 = Ω

Wahrscheinlichkeiten p(B1 ) = 2/5, p(B2 ) = 3/5

395 / 469

396 / 469

Stochastische Unabhängigkeit

Beispiel

Eine Münze wird zweimal geworfen.

Zwei Ereignisse A und B sollen stochastisch unabhängig

heißen, wenn die Wahrscheinlichkeit für das Eintreten von A

unabhängig davon ist, ob (gleichzeitig) B eintritt oder nicht.

Beschreibung als Urnenexperiment:

Auswahl „2 aus 2“ mit Zurücklegen und Reihenfolge.

Ergebnisraum: Ω = {1, 2}2 , #(Ω) = 22 = 4

Dabei bedeutet z.B. ωj = 1 „Zahl“ und ωj = 2 „Bild“ beim j–ten

Wurf.

Konkret muss dann gelten: p(A|B) = p(A)

Dies ist äquivalent zu

Einzelwahrscheinlichkeit: p({ω}) = 1/4.

p(A ∩ B)

= p(A) bzw. p(A ∩ B) = p(A) p(B)

p(B)

Ereignisse:

A — „Zahl“ beim 1. Wurf, A = {(1, 1), (1, 2)}

B — „Zahl“ beim 2. Wurf, B = {(1, 1), (2, 1)}

C — dasselbe Ergebnis beim 1. und 2. Wurf,

C = {(1, 1), (2, 2)}

Definition

Sei (Ω, p) ein Wahrscheinlichkeitsraum.

Zwei Ereignisse A, B ⊂ Ω heißen (stochastisch) unabhängig ⇔

Es gilt p(A) = p(B) = p(C) = 1/2 und

p(A ∩ B) = 1/4, p(A ∩ C) = 1/4, p(B ∩ C) = 1/4

p(A ∩ B) = p(A) p(B)

Die Ereignisse A, B, C sind also paarweise unabhängig.

398 / 469

397 / 469

Diskrete Wahrscheinlichkeitsräume

Frage: Gilt auch p(A ∩ B ∩ C) = p(A) p(B) p(C)?

Antwort: A ∩ B ∩ C = {(1, 1)}

p(A ∩ B ∩ C) = 1/4 6= p(A) p(B) p(C)

Bei vielen Anwendungen hat man abzählbar unendlich viele

mögliche Ereignisse.

Definition

Sei (Ω, p) ein Wahrscheinlichkeitsraum.

Ereignisse A1 , A2 , . . . , Am ⊂ Ω heißen (stochastisch)

unabhängig ⇔ für jede Auswahl Ai1 , . . . , Ai` mit

i1 , . . . , i` ∈ {1, . . . , m}, ij 6= ik für j 6= k , gilt

Beispiel: Wir würfeln einen Würfel solange, bis zum ersten mal

eine „Sechs“ auftritt.

Wie groß ist die Wahrscheinlichkeit, dass das beim k –ten Wurf

der Fall ist?

Antwort: Bei den ersten k − 1 Würfen darf jeweils keine 6

auftreten (das passiert jeweils mit Wahrscheinlichkeit 5/6)

beim k –ten Wurf muss eine 6 auftreten (das passiert mit

Wahrscheinlichkeit 1/6.

k −1

5

1

Folgerung: p({k }) =

6

6

p(Ai1 ∩ Ai2 ∩ · · · ∩ Ai` ) = p(Ai1 ) p(Ai2 ) · · · p(Ai` )

Drei Ereignisse A, B, C sind also unabhängig, wenn

p(A ∩ B) = p(A) p(B), p(A ∩ C) = p(A) p(C),

p(B ∩ C) = p(B) p(C), p(A ∩ B ∩ C) = p(A) p(B) p(C).

Beim Beispiel des zweifachen Wurfes zweier Münzen sind die

Ereignisse A = {(1, 1), (1, 2)}, B = {(1, 1), (2, 1)} und

C = {(1, 1), (2, 2)} nicht stochastisch unabhängig.

Die möglichen Ergebnisse k sind hier nicht beschränkt, der

zugehörige Wahrscheinlichkeitsraum ist (Ω, p) mit Ω = N.

399 / 469

400 / 469

Definition

Ein (unendlicher) diskreter Wahrscheinlichkeitsraum (Ω, p) ist

definiert durch eine abzählbare Ergebnismenge

Ω = {ωj | j ∈ N} und eine Wahrscheinlichkeitsverteilung

p : P(Ω) → [0, 1] mit den Eigenschaften

Bemerkungen

Bei der Summe

X

p(Ω) = 1

M1 , M2 ⊂ Ω, M1 ∩ M2 = ∅ => p(M1 ∪ M2 ) = p(M1 ) + p(M2 )

(Additivität)

Die Wahrscheinlichkeitsverteilung p ist eindeutig definiert durch

die Einzelwahrscheinlichkeiten p({ω}) für ω ∈ Ω. Dabei gilt

X

p(A) =

p({ω})

p(Ω) =

ω∈A

∞

X

p({ω})

ω∈A

p({ωj }) = 1

handelt es sich im Fall #(A) = ∞ um den Grenzwert einer

absolut konvergenten Reihe. Bei absolut konvergenten

Reihen hängt der Grenzwert nicht von der Reihenfolge der

Summanden ab.

Einen endlichen Wahrscheinlichkeitsraum bezeichnet man

ebenfalls als diskreten Wahrscheinlichkeitsraum.

Die bisher eingeführten Begriffe wie bedingte

Wahrscheinlichkeit und unabhängige Ereignisse und deren

Eigenschaften gelten auch für diskrete

Wahrscheinlichkeitsräume

j=1

402 / 469

401 / 469

Die Geometrische Verteilung

Satz

Die geometrische Verteilung hat kein Gedächtnis:

Für das Ereignis An = {n + 1, n + 2, n + 3, . . .} dass mehr als n

Versuche nötig sind, gilt:

Wir wiederholen ein Zufallsexperiment mit Erfolgswahrscheinlichkeit q so lange, bis zum ersten Mal der Erfolg eintritt.

p(An+m |An ) = p(Am )

Sei k die Anzahl der Versuche bis zum ersten Erfolg. Es gilt:

p({k }) = (1 − q)k −1 q

Beweis:

p(An ) =

Diese Verteilung heißt geometrische Verteilung oder

G(q)–Verteilung.

∞

X

p({k }) =

= (1 − q)n q

∞

X

`=0

Anwendungen:

(1 − q)k −1 q

k =n+1

k =n+1

Der zugehörige Wahrscheinlichkeitsraum ist Ω = N.

∞

X

(1 − q)` =

(1 − q)n q

= (1 − q)n

1 − (1 − q)

und damit

Wartezeit bis zum Eintreten eines Ereignisses

p(An+m ∩ An )

p(An+m )

=

p(An )

p(An )

n+m

(1 − q)

=

= (1 − q)m = p(Am )

(1 − q)n

p(An+m |An ) =

Lebensdauer von Geräten (d.h. Wartezeit bis zum Ausfall)

403 / 469

404 / 469

Die Poisson–Verteilung

k

Für p({X = k }) = e−λ λk ! gilt:

Ein Zufallsexperiment mit Erfolgswahrscheinlichkeit p werde n

mal wiederholt.

∞

X

Die Zufallsvariable X misst die Anzahl der Erfolge.

k =0

k =0

λk

k!

eine Wahrscheinlichkeitsverteilung auf Ω = N ∪ {0}

p({X = k }) = e−λ

Sei nun n groß und p klein, p = λ/n. Dann gilt:

k λ

λ n−k

n

p({X = k }) =

1−

k

n

n

n · (n − 1) · · · · · (n − k + 1) λk

λ n−k

=

1−

k!

n

nk

1 n n−1

n−k +1 k

λ n

λ −k

=

·

· ··· ·

λ

1−

1−

k ! |n

n

n }

n

n

{z

| {z } |

{z

}

→ e−λ

∞

X

1 k

λ = e−λ eλ = 1

k!

Damit definiert

Dann ist X binomialverteilt, und zwar B(n, p)–verteilt.

→1 für n→+∞

p({X = k }) = e−λ

Diese Verteilung heißt Poisson–Verteilung oder

P(λ)–Verteilung.

Die Poisson–Verteilung mit Parameter λ ist eine Näherung für

die Binomialverteilung B(n, p) bei großem n und kleinem p mit

λ = np.

Sie ist anwendbar, wenn man die Anzahl des Auftretens von

Ereignissen mit geringer Wahrscheinlichkeit bei vielen

Wiederholungen des Zufallsexperimentes abschätzen will.

→e−λ für n→∞ →1 für n→∞

λk

k!

406 / 469

405 / 469

Beispiel

Der Erwartungswert

In einem Hörsaal sitzen 105 Personen.

Sei X : Ω → R eine reellwertige Zufallsvariable.

Die Zahl derer, die heute Geburtstag haben, ist etwa

P(λ)–verteilt mit λ = n p, n = 105, p = 1/365, also

λ = 105/365.

Wir betrachten den Mittelwert

n

1X

Die Wahrscheinlichkeit, dass genau zwei Personen heute

Geburtstag haben, ist etwa

λ2

p({2}) = e−λ

= 0,03103 · · · ∼ 3%

2!

Das Ergebnis mit der Binomialverteilung ist (siehe S. 385)

n

X (ωj )

j=1

der Ergebnisse von vielen durch ω1 , . . . , ωn ∈ Ω beschriebenen

Wiederholungen des Zufallsexperiments.

Sei Ω ein diskreter Wahrscheinlichkeitsraum.

Dann approximiert n p({ω}) die Zahl der Ergebnisse ω bei n

Versuchen. Es gilt also (für großes n bzw. n → ∞)

p({2}) = 0,03089 · · ·

Ein Vorteil der Poisson–Verteilung besteht darin, dass man nur

einen Parameter λ hat, den man aus nur einer Information /

Messung (näherungsweise) bestimmen kann. Man muss nicht

p und n wie bei der Binomialverteilung kennen, sondern nur

λ = p · n.

n

X

1X

1X

X (ωj ) ∼

X (ω) n p({ω}) =

X (ω) p({ω})

n

n

j=1

407 / 469

ω∈Ω

ω∈Ω

408 / 469

Erwartungswert der Binomialverteilung

Sei X eine B(n, p)–verteilte Zufallsvariable. Dann gilt:

n

X

n

E(X ) =

k

pk (1 − p)n−k

k

Definition

Sei (Ω, p) ein diskreter Wahrscheinlichkeitsraum und

X : Ω → R eine reellwertige Zufallsvariable. Dann heißt

X

E(X ) =

X (ω) p({ω})

k =0

=

n

X

k =1

n

X

n · (n − 1) · · · · · · (n − k + 1) k

p (1 − p)n−k

k!

k

(n − 1) · · · · · · (n − k + 1) k

p (1 − p)n−k

(k − 1)!

k =1

n X

n−1

pk −1 (1 − p)n−1−(k −1)

= np

k −1

ω∈Ω

=

der Erwartungswert von X .

= np

n

k =1

n−1 X

k =0

n−1 k

p (1 − p)n−1−k = np(p + (1 − p))n−1 = np

k

409 / 469

Erwartungswert der geometrischen Verteilung

410 / 469

Erwartungswert der Poisson–Verteilung

Sei X eine G(p)–verteilte Zufallsvariable. Dann gilt:

E(X ) =

∞

X

k p(1 − p)

k −1

= p f (1 − p) mit f (x) :=

k =1

∞

X

k x k −1

k =0

Gliedweise Integration liefert f (x) =

F (x) =

∞

X

F 0 (x)

xk =

k =0

=>

f (x) = F 0 (x) =

Für eine P(λ)–verteilte Zufallsvariable gilt

mit

E(X ) =

1

1−x

∞

X

k e−λ

k =0

−λ

= λe

∞

∞

k =1

k =0

X λk −1

X λk

λk

= λ e−λ

= λ e−λ

k!

(k − 1)!

k!

λ

e =λ

1

(1 − x)2

und

E(X ) = p f (1 − p) =

p

p

1

= 2=

2

p

(1 − (1 − p))

p

411 / 469

412 / 469

Anwendung

Eigenschaften des Erwartungswerts

Für eine konstante Zufallsvariable X (ω) = α gilt:

X

X

X

E(X ) =

X (ω) p({ω}) =

α p({ω}) = α

p({ω}) = α

Auf der Erde habe es in den letzten 100.000 Jahren etwa 10

Einschläge von Meteoriten oberhalb einer bestimmten Größe

gegeben.

ω∈Ω

Wie wahrscheinlich ist das Auftreten mindestens eines

entsprechenden Einschlags in den nächsten 1.000 Jahren?

ω∈Ω

ω∈Ω

Der Erwartungswert ist linear: Sind X , Y : Ω → R zwei

Zufallsvariablen und α, β ∈ R, so gilt

X

E(α X + β Y ) =

(α X + βY )(ω) p({ω})

Modell:

Die Anzahl der Einschläge in 1.000 Jahren ist Poisson–verteilt

mit Erwartungswert λ = 10/100 = 0,1.

ω∈Ω

=

Wahrscheinlichkeit für mindestens einen Meteoriteneinschlag:

X

α X (ω) + βY (ω) p({ω})

ω∈Ω

λ0

= 1 − e−λ

p({1, 2, . . .}) = 1 − p({0}) = 1 − e−λ

0!

= 0,09516 · · · ∼ 9,5%

=α

X

X (ω) p({ω}) + β

ω∈Ω

X

Y (ω) p({ω})

ω∈Ω

= α E(X ) + β E(Y )

413 / 469

Die Varianz

414 / 469

Rechenregeln

Satz

Sei (Ω, p) ein Wahrscheinlichkeitsraum, X : Ω → R eine

Zufallsvariable und α, β ∈ R. Dann gilt:

V (X ) = E X 2 − (E(X ))2

Die Varianz ist ein Maß für die mittlere Abweichung vom

Erwartungswert.

Definition

Sei (Ω, p) ein Wahrscheinlichkeitsraum und X : Ω → R eine

reellwertige Zufallsvariable. Dann heißt

V (X ) = E (X − E(X ))2

V (αX + β) = α2 V (X )

Beweis

Zu (i): Mit der Linearität des Erwartungswerts folgt

V (X ) = E (X − E(X ))2 = E X 2 − 2 E(X ) X + (E(X ))2

= E X 2 − 2 E(X ) E(X ) + (E(X ))2 = E X 2 − (E(X ))2

die Varianz von X . Die Wurzel

σX :=

p

V (X )

Zu (ii):

V (αX + β) = E (αX + β − E(αX + β))2

heißt Standardabweichung von X .

= E (αX + β − (αE(X ) + β))2

2

= E α2 (X − E(X ))2 = α2 E X − E(X ) = α2 V (X )

415 / 469

416 / 469

Varianz der Binomialverteilung

Mit

B(n, p)–Verteilung:

n

p({X = k }) =

pk (1 − p)n−k für k = 0, 1, . . . , n

k

n

X

n

E X2 =

k2

pk (1 − p)n−k

k

k =0

n

X

n

k (k − 1) + k

=

pk (1 − p)n−k

k

k =0

n

n

X

X

n

n

k

n−k

=

k (k − 1)

p (1 − p)

+

k

pk (1 − p)n−k

k

k

k =0

k =0

|

{z

}

n(n − 1) · · · (n − k + 1)

n

k (k − 1)

= k (k − 1)

k

k (k − 1) · · · 1

(n − 2)(n − 3) · · · (n − 2 − (k − 2) + 1)

= n(n − 1)

(k − 2)(k − 3) · · · 1

n−2

= n(n − 1)

k −2

folgt:

n

X

n

k (k − 1)

pk (1 − p)n−k

k

k =2

n

X

n−2

=

n(n − 1)

p2 pk −2 (1 − p)n−2−(k −2)

k −2

k =2

= n(n − 1)p

=E(X )=np

2

n−2 X

n−2

k =0

k

pk (1 − p)n−2−k

2

= n(n − 1)p (p + (1 − p))n−2 = n(n − 1)p2

418 / 469

417 / 469

Varianz der geometrischen Verteilung

G(p)–Verteilung: p({X = k }) = p(1 − p)k −1 , k ∈ N.

∞

X

2

E X =

k 2 p(1 − p)k −1

Insgesamt erhält man:

E X 2 = n(n − 1)p2 + np

V (X ) = E X 2 − (E(X ))2 = n(n − 1)p2 + np − (np)2

=

k =1

∞

X

k −1

k (k − 1)p(1 − p)

+

∞

X

k =1

k =1

|

= np(1 − p)

= p(1 − p)

kp(1 − p)k −1

∞

X

{z

=E(X )=1/p

k (k − 1)(1 − p)k −2 +

k =2

1

p

Weiter gilt:

∞

∞

X

X

k −2

00

k (k − 1)(1 − p)

= f (1 − p) mit f (x) =

xk =

k =2

=> f 0 (x) =

419 / 469

}

k =0

1

1−x

1

2

, f 00 (x) =

2

(1 − x)

(1 − x)3

420 / 469

Überabzählbare Wahrscheinlichkeitsräume

=>

Beispiel:

E X 2 = p(1 − p)

=

p2

2p(1 − p)

2

1

+ 3

+ =

3

p

p3

p

(1 − (1 − p))

Zwei Personen beschließen, sich zwischen 12 Uhr und 13 Uhr

zum Mittagessen treffen. Jeder der beiden kommt zu einem

zufällig ausgewählten Zeitpunkt und soll genau 20 Minuten auf

den anderen warten. Wie groß ist die Wahrscheinlichkeit, dass

sich beide treffen?

2p − p2

p3

2p − p2

1

V (X ) = E X 2 − (E(X ))2 =

− 2

p3

p

p − p2

1−p

=

=

3

p

p2

Mathematische Beschreibung:

Variable t ∈ [0, 1] bedeutet: Ankunft t Stunden nach 12 Uhr.

Zwei Ankunftszeiten t1 , t2 ∈ [0, 1]

=> Zufallsvariable ω = (t1 , t2 ) ∈ [0, 1]2

=> Wahrscheinlichkeitsraum Ω = [0, 1]2

mit überabzählbar vielen Elementen.

421 / 469

422 / 469

Lösung:

Ereignis „beide Personen treffen sich“:

Menge A = {(t1 , t2 ) ∈ [0, 1]2 | |t1 − t2 | ≤ 1/3} ⊂ Ω

Betrachte Zerlegung von Ω in kleine Rechtecke der Form

Qij = ((i − 1)h, ih] × ((j − 1)h, jh], h = 1/n, i, j = 1, . . . , n.

t2

Ω

A

t1

Insgesamt: n2 Rechtecke

Zuordnung von Wahrscheinlichkeiten:

Wahrscheinlichkeit für ω ∈ Qij :

Jeder Zeitpunkt t1 , t2 soll gleichwahrscheinlich sein.

1

=h

n

1

p({t2 ∈ ((j − 1)h, jh]}) = = h

n

1

2

p(Qij ) = 2 = h = |Qij | mit der Fläche |Qij | von Qij .

n

p({t1 ∈ ((i − 1)h, ih]}) =

Problem:

Wir können nicht jedem ω ∈ Ω eine feste Wahrscheinlichkeit

zuordnen, da Ω unendlich viele Elemente hat, und damit

1

p({ω}) = ∞

(= 0?) sein müsste.

423 / 469

424 / 469

Messbare Mengen

[

Approximation für Menge A: Ah :=

Sei Ω ⊂ Rn .

Qij

Wir wollen auf Ω ein Wahrscheinlichkeitsmaß definieren durch

|A|

für A ⊂ Ω

p(A) =

|Ω|

Qij ⊂A

X

Wahrscheinlichkeit p(Ah ) =

|Qij | = |Ah |

i,j=1,...,n

Qij ⊂A

Grenzübergang h → 0: p(A) = |A|

Frage: Kann man jeder beliebigen Teilmenge des R (bzw. Rn )

eine Länge (bzw. eine Fläche, ein Volumen) zuordnen?

Folgerung: p(A) ist proportional zur Fläche von A.

Antwort: Nein!

Lösung des Beispiels: p(A) = 1 − 2 ·

1 2 2

4 5

· · =1− =

2 3 3

9 9

Folgerung: Wir können p nicht auf der gesamten

Potenzmenge P(Ω) definieren.

Eine Menge M ⊂ Rn , der wir ein n–dimensionales Volumen |M|

zuordnen können, heißt messbar.

426 / 469

425 / 469

Beispiele für messbare Mengen

Wahrscheinlichkeitsraum, 1. Versuch

Ein Wahrscheinlichkeitsraum (Ω, M , p) besteht aus einer

Ergebnismenge Ω, einem System messbarer Teilmengen

M ⊂ P(Ω) und einer Abbildung p : M → [0, 1] mit folgenden

Eigenschaften:

(i) p(Ω) = 1

(ii) Aj ∈ M für j ∈ N, Aj ∩ Ak = ∅ für j 6= k =>

[ X

∞

p

Aj =

p(Aj )

Intervalle I = (a, b) (oder I = (a, b] oder I = [a, b]) in R:

|I| = b − a

Quader

Q = (a, b) = {x ∈ Rn | ai < xi < bi für i = 1, . . . , n}:

|Q| =

n

Y

(bi − ai )

i=1

j∈N

In Teil I der Vorlesung (Integration) wurde eine Menge A

als messbar bezeichnet, wenn das (Riemann-) Integral

(

Z

Z

1 für x ∈ A

1 dx =

χA (x) dx mit χA (x) =

0 für x ∈

/A

A

Rn

existiert. Dann ist:

Damit man die Bedingungen (i)–(ii) an p : M → [0, 1]

formulieren kann, muss M folgende Bedingungen erfüllen:

(i) Ω ∈ M

(ii) A ∈ M => Ω \ A ∈ M

S

(iii) Aj ∈ M für j ∈ N => j∈N Aj ∈ M

Z

|A| =

j=1

Ein System M ⊂ P(Ω) mit diesen Eigenschaften heißt eine

σ–Algebra.

1 dx

A

427 / 469

428 / 469

Borelsche σ–Algebra

Auf Bn kann man in eindeutiger Weise eine Abbildung

Die kleinste σ–Algebra in Rn , in der alle Intervalle bzw. alle

Quader enthalten sind, heißt Borelsche σ–Algebra, sie wird mit

Bn bezeichnet.

µ : Bn → [0, +∞]

definieren, die auf der Menge der Intervalle bzw. Quader die

Länge bzw. das Volumen liefert, das sogenannte

Lebesgue–Maß.

Sie besteht aus allen Mengen, die man durch Bilden von

(möglicherweise unendlich vielen) Schnitt- und

Vereinigungsmengen aus Intervallen bzw. Quadern

konstruieren kann.

Damit kann man eine allgemeinere Definition des Integrals

konstruieren, das sog. Lebesgue–Integral, so dass

Z

χA (x) dx für alle A ∈ Bn existiert

Problem:

Die Borelsche σ–Algebra ist größer als die Menge

Z

n

A ⊂ R das Riemann–Integral

χA (x) dx existiert

Rn

Das Lebesgue–Integral wird hier nicht näher beschrieben, da

man (fast) alle praktisch relevanten Fälle auch mit dem

Riemann–Integral lösen kann.

Rn

Beispiel: A = (0, 1) ∩ Q (Q Menge der rationalen Zahlen):

Z

A ∈ B1 , aber

χA (x) dx existiert nicht

R

430 / 469

429 / 469

Wahrscheinlichkeitsraum, korrekte Definition

Beispiele für Wahrscheinlichkeitsräume

(i) Jeder endliche oder diskrete Wahrscheinlichkeitsraum

(Ω, p) mit M = P(Ω)

|A|

(ii) Ω ⊂ Rn , Ω ∈ Bn , M = {A ∩ Ω | A ∈ Bn }, p(A) =

|Ω|

Diese Wahrscheinlichkeitsverteilung heißt Gleichverteilung

Definition

Ein Wahrscheinlichkeitsraum (Ω, M , p) besteht aus einer

Ergebnismenge Ω, einer σ–Algebra M ⊂ P(Ω) und einer

Abbildung p : M → [0, 1] mit folgenden Eigenschaften:

(iii) Ω, M wie in (ii),

(i) p(Ω) = 1

Z

(ii) Aj ∈ M für j ∈ N, Aj ∩ Ak = ∅ für j 6= k =>

[ X

∞

p

Aj =

p(Aj )

j∈N

p(A) =

f (x) dx

A

mit einer integrierbaren Funktion f : A → R mit den

Eigenschaften

j=1

Die Abbildung p heißt Wahrscheinlichkeitsverteilung oder

Wahrscheinlichkeitsmaß.

f (x) ≥ 0 für alle x ∈ Ω

Z

f (x) dx = 1

Ω

431 / 469

432 / 469

Eindimensionale Wahrscheinlichkeitsverteilungen

Definition

Sei (Ω, M , p) ein Wahrscheinlichkeitsraum mit Ω ⊂ Rn .

Die Wahrscheinlichkeitsverteilung p habe die Dichte f : Ω → R

⇔

Z

p(A) =

f (x) dx für alle A ∈ M

Ziel: Beschreibung von Wahrscheinlichkeitsverteilungen

auf Ω = R

1. Möglichkeit: Dichte f : R → R der W.-Verteilung p

Z

p(A) =

f (x) dx

A

A

Problem: Nicht jede Verteilung hat eine Dichte.

Beispiel:

|A|

1

, denn

hat die Dichte f (x) =

|Ω|

|Ω|

Z

Z

1

1

|A|

dx =

1 dx =

|Ω| A

|Ω|

A |Ω|

Die Gleichverteilung p(A) =

Beispiel: Fortsetzung der geometrischen Verteilung auf R

(

(1 − p)k −1 p für x = k ∈ N

p({x}) =

0

sonst

Die Existenz einer Dichte bedeutet, dass die

Wahrscheinlichkeitsverteilung über ein Kontinuum verteilt ist,

und die Einzelwahrscheinlichkeiten p({ω}) alle gleich Null sind.

433 / 469

Verteilungsfunktion

434 / 469

Beispiel: Geometrische Verteilung

Definition

Sei p eine Wahrscheinlichkeitsverteilung auf Ω ⊂ R. Dann heißt

F : R → [0, 1], F (x) := p({y ∈ R | y ≤ x}) = p((−∞, x])

(

(1 − p)k −1 p

Sei p({x}) =

0

Für x ∈ [n, n + 1) mit n ∈ N gilt:

n

n

X

X

F (x) = p((−∞, x]) =

p({k }) =

(1 − p)k −1 p

die Verteilungsfunktion von p.

k =1

Beispiel: Gleichverteilung auf [0, 1].

Für A = (a, b) ⊂ [0, 1] gilt: p(A) = (b − a)

=p

Damit folgt:

F (x) = p((−∞, x])

0 für x < 0

= x für x ∈ [0, 1]

1 für x > 1

für x = k ∈ N

sonst

n−1

X

(1 − p)k = p

k =0

k =1

1 − (1 − p)n

= 1 − (1 − p)n

1 − (1 − p)

Mit [x] := max{n ∈ Z | n ≤ x} folgt

(

1 − (1 − p)[x]

F (x) =

0

1

für x ≥ 1

für x < 1

1

435 / 469

436 / 469

Eigenschaften der Verteilungsfunktion

Satz

Für die Verteilungsfunktion F einer

Wahrscheinlichkeitsverteilung auf R gilt:

Verteilungsfunktion der Geometrischen Verteilung für p = 1/2:

(i) F ist monoton steigend

1

(ii)

lim F (x) = 0, lim F (x) = 1

x→−∞

x→+∞

(iii) F ist rechtsseitig stetig, d.h.

lim F (x + h) = F (x) für alle x ∈ R.

1

2

3

4

h→0

h>0

5

(iv) Die Wahrscheinlichkeitsverteilung hat eine Dichte f

⇔ F ist differenzierbar

In diesem Fall gilt f (x) = F 0 (x)

Eigenschaft (iii) bedeutet, dass die Verteilungsfunktion an

Sprungstellen immer den rechtsseitigen Grenzwert annimmt

437 / 469

438 / 469

Beweisskizze

Zu (iv): Falls F differenzierbar ist, gilt:

Z x

Z

F (x) = p((−∞, x]) =

F 0 (y ) dy =

Zu (i): Für x < y gilt wegen (−∞, x] ⊂ (−∞, y ]:

F (x) = p((−∞, x]) ≤ p((−∞, y ]) = F (y )

−∞

Zu (ii):

lim F (n) = lim p((−∞, n]) = p

n→−∞

n→−∞

∞

\

(−∞, −n]

A

Jede Menge A ∈ B1 lässt sich durch (unendliche) Schnitte und

Vereinigungen aus Intervallen konstruieren.

Jedes Intervall (a, b] hat die Form

= p(∅) = 0

lim F (n) = lim p((−∞, n]) = p

n→∞

n→∞

(−∞,x]

Die Wahrscheinlichkeitsverteilung p hat eine Dichte f ⇔

Z

p(A) =

f (y ) dy für alle A ∈ B1

!

n=1

∞

[

F 0 (y ) dy

!

(−∞, n]

= p(R) = 1

n=1

(a, b] = (−∞, b] \ (−∞, a]

Zu (iii):

lim F (x + 1/n) = lim p((−∞, x + 1/n])

n→∞

n→∞

!

∞

\

=p

(−∞, x + 1/n] = p((−∞, x]) = F (x)

=> p hat eine Dichte ⇔

Z

Z

p((−∞, x]) =

f (y ) dy =

(−∞,x]

x

f (y ) dy für alle x ∈ R

−∞

n=1

439 / 469

440 / 469

Exponentialverteilung

Verteilungsfunktion der G(qh )–Verteilung:

ph ([0, kh]) =

Ziel: Verteilung der Wartezeit t ∈ [0, +∞) bis zum

erstmaligen Eintreten eines bestimmten Ereignisses

2h

3h

F (x) = lim ph ([0, x]) = 1 − lim

h→0

h→0

(1 − λh)x/h

{z

}

|

x h→0

= 1 − e−λx

→ e−λx

Das ist die Verteilungsfunktion der Exponentialverteilung für

x ∈ [0, ∞)

(k−1)h kh

Wahrscheinlichkeit für Eintreten des Ereignisses in Ik ,h :

qh ∼ h,

Grenzübergang h → 0 bei qh = λh und festem kh = x:

= (1−λh)1/h

I k,h

h

p(I`,h ) = 1 − (1 − qh )k (s. S. 436)

`=1

Ansatz: Unterteilung der kontinuierlichen Zeitachse [0, +∞)

in kleine Intervalle Ik ,h = ((k − 1)h, kh] mit k ∈ N, h > 0.

0

k

X

Die Dichte der Exponentialverteilung ist

qh = λh mit λ > 0

f (x) = F 0 (x) = λ e−λx

Verteilung für „Ereignis tritt erstmals im Intervall Ik ,h ein“:

Die Exponentialverteilung ist eine kontinuierliche Version der

geometrischen Verteilung.

G(qh )–Verteilung, ph (Ik ,h ) = (1 − qh )k −1 qh

441 / 469

Reellwertige Zufallsvariablen

442 / 469

Transformationsregeln für Verteilungsfunktionen

Definition

Sei (Ω, M , p) ein Wahrscheinlichkeitsraum.

Eine Abbildung X : Ω → R heißt Zufallsvariable ⇔

X −1 ((−∞, x]) := ω ∈ Ω | X (ω) ≤ x ∈ M für alle x ∈ R

Satz

Sei FX die Verteilungsfunktion einer reellwertigen

Zufallsvariablen X und Y = αX + β mit α > 0, β ∈ R.

Dann hat Y die Verteilungsfunktion

x − β FY (x) = FX

α

Falls X eine Dichte fX hat, dann hat Y die Dichte

1 x − β fY (x) = fX

α

α

Die Verteilung pX der Zufallsvariablen X ist gegeben durch

pX (A) := p({ω ∈ Ω | X (ω) ∈ A}) = p X −1 (A) für alle A ∈ B1

Die Verteilungsfunktion FX von pX heißt auch

Verteilungsfunktion der Zufallsvariablen X .

Falls pX eine Dichte fX hat, dann heißt fX auch Dichte der

Zufallsvariablen X .

Bemerkung:

Beweis: Wegen Y = αX + β ≤ x ⇔ X ≤ x−β

α folgt

= FX

FY (x) = p({Y ≤ x}) = p X ≤ x−β

α

Die Bedingung X −1 ((−∞, x]) ∈ M für alle x ∈ R stellt sicher,

dass X −1 (A) ∈ M für alle A ∈ B1 . Sie ist eine Voraussetzung

für die Existenz der Verteilung pX von X .

Falls FX eine Dichte fX hat, dann gilt FX0 (x) = fX (x) und

1

FY0 (x) = α1 FX0 x−β

= α fX x−β

α

α

443 / 469

x−β α

444 / 469

Erwartungswert und Varianz

Motivation: Rückführung auf Definition für diskrete

Zufallsvariable

Definition

Sei X eine reellwertige Zufallsvariable mit Dichte

f : R → [0, +∞). Dann sind Erwartungswert E(X ) und Varianz

V (X ) definiert durch

Z ∞

E(X ) =

x f (x) dx

Z−∞

∞

V (X ) =

(x − E(X ))2 f (x) dx

Für kleines h (und stetige Dichte f ) gilt:

Z x+h

f (x) h ∼

f (y ) dy = p({X ∈ (x, x + h)})

x

Mit xn = nh, n ∈ Z, gilt

Z ∞

∞

X

x f (x) dx ∼

xn f (xn )(xn+1 − xn )

−∞

−∞

∼

n=−∞

∞

X

xn p({X ∈ (xn , xn+1 )})

n=−∞

Eigenschaften: Für Zufallsvariable X , Y und α, β ∈ R gilt

V (X ) = E X 2 − (E(X ))2

und analog

Z

E(αX + βY ) = α E(X ) + β E(Y )

∞

(x − E(X ))2 f (x) dx

−∞

V (αX + β) = α2 V (X ) für α > 0

∼

∞

X

(xn − E(X ))2 p({X ∈ (xn , xn+1 )})

n=−∞

446 / 469

445 / 469

Beispiel: Exponentialverteilung

(

λ e−λx

Dichte der Exponentialverteilung: f (x) =

0

Folgerung aus dieser Motivation:

für x > 0

für x ≤ 0

Erwartungswert:

Z ∞

Z ∞

E(X ) =

x f (x) dx =

xλ e−λx dx

−∞

0

h

i∞ Z ∞

1

1 −λx ∞

−λx

−λx

= −xe

+

e

dx = − e

=

λ

λ

0

0

0

Varianz:

Z ∞

h

i∞ Z ∞

E X2 =

x 2 λ e−λx dx = − x 2 e−λx

+

2x e−λx dx

0

0

0

Z

2 ∞

2

=

xλ e−λx dx = 2

λ 0

λ

2

2

1

1

=> V (X ) = 2 −

= 2

λ

λ

λ

Satz

Ist X eine reellwertige Zufallsvariable, Φ : R → R und

Y := Φ(X ).

dann gilt

Z ∞

E(Y ) =

Φ(x) f (x) dx

−∞

447 / 469

448 / 469

Die Standard–Normalverteilung

Graph der Dichte:

(N(µ, σ 2 )–Verteilung)

Die Normalverteilung

ist eine der

wichtigsten Wahrscheinlichkeitsverteilungen auf R.

Sie wird häufig für die Beschreibung der Streuung von Daten

um einen Mittelwert verwendet.

Die Standard–Normalverteilung (N(0, 1)–Verteilung) ist

gegeben durch die Dichte

1

2

ϕ(x) = √ e−x /2

2π

Sie hat die Verteilungsfunktion

Z x

1

2

√ e−y /2 dy

Φ(x) =

2π

−∞

Symmetrieeigenschaften:

ϕ(x) = ϕ(−x)

Φ(−x) = 1 − Φ(x)

Für diese Funktion gibt es keine analytische Formel

449 / 469

450 / 469

Approximation der B(n, p)–Verteilung

Erwartungswert:

Z ∞

Z

E(X ) =

x ϕ(x) dx =

−∞

∞

−∞

x

2

√ e−x /2 dx = 0

2π

Varianz:

2

2

2

Z

∞

Wir betrachten n Zufallsexperimente mit

Erfolgswahrscheinlichkeit p

Die Zufallsvariable Xn misst die Anzahl der Erfolge

=> Xn ist B(n, p)–verteilt

x2

2

√ e−x /2 dx

2π

V (X ) = E X − (E(X )) = E X =

−∞

Z ∞

x

2

√ x e−x /2 dx

=

2π

−∞

Z ∞

x −x 2 /2 ∞

1

2

√

√

= −

e

+

e−x /2 dx

2π

2π −∞

−∞

Z

∞

√

√

2

Mit Substitution z = x/ 2 und

e−z dy = π

Erwartungswert: E(Xn ) = np =: µn

Varianz: V (Xn ) = np(1 − p) =: σn2 mit σn =

p

np(1 − p)

Neue Zufallsvariable Yn = α Xn + β

Wahl von α, β so, dass E(Yn ) = 0, V (Yn ) = 1:

!

E(Yn ) = α E(Xn ) + β = αµn + β = 0

V (Yn ) =

−∞

(siehe S. 281/282) folgt:

Z ∞

1 √

1

2 √

π=1

V (X ) = √

e−z 2 dz = √

π

2π −∞

α2 V (X

n)

=

α2 σn2

!

=1

=>

α = 1/σn

β = −µn /σn

=>

Yn =

451 / 469

1

µn

Xn −

σn

σn

452 / 469

Folgerung

Sei X eine B(n, p)–verteilte Zufallsvariable

p mit Erwartungswert

µ = np und Standardabweichung σ = np(1 − p) und

Satz (de Moivre–Laplace)

Sei Xn eine B(n, p)–verteilte Zufallsvariable

Yn =

p

1

µn

Xn −

mit µn = np, σn = np(1 − p)

σn

σn

Y =

µ

1

X−

σ

σ

Dann gilt

Dann gilt für die Verteilungsfunktion FYn von Yn :

Z x

1

2

n→∞

√ e−y /2 dy = Φ(x)

FYn (x) := p({Yn ≤ x}) →

2π

−∞

FY (y ) ∼ Φ(y )

Aus dem Transformationssatz (S. 444) folgt für X = σY + µ

x − µ

x − µ

∼Φ

FX (x) = FY

σ

σ

Andere Formulierung des Satzes:

Ist Xn eine B(n, p)–verteilte Zufallsvariable, dann konvergiert

die Verteilungsfunktion von Yn = σ1n Xn − µσnn mit µn = np,

p

σn = np(1 − p) für n → +∞ gegen die

Standard–Normalverteilung.

Satz

Die Verteilungsfunktion der B(n, p)–Verteilung wird für großes n

approximiert durch

x − µ

p

FX (x) ∼ Φ

mit µ = np, σ = np(1 − p)

σ

454 / 469

453 / 469

Beispiel 1

Wir wollen die Wahrscheinlichkeit abschätzen, dass beim Wurf

von 600 Würfeln die Anzahl der gewürfelten 6–en zwischen 90

und 110 liegt.

Definition (Normalverteilung)

Eine Wahrscheinlichkeitsverteilung auf R mit der

Verteilungsfunktion

x − µ

Φµ,σ (x) = Φ

σ

Die Zufallsvariable X messe die Anzahl der 6–en

=> X ist B(600, 1/6)–verteilt

=> gesucht ist

p(90 ≤ X ≤ 110) = pX ([90, 110]) = FX (110) − FX (89)

q

q

q

1

1 5

500

250

Mit µ = 600 · 6 = 100, σ = 600 · 6 · 6 =

6 =

3 folgt:

x − µ

q

3

FX (x) ∼ Φ

=Φ

250 (x − 100)

σ

und damit

q

q

3

3

p(90 ≤ X ≤ 110) ∼ Φ

10

−

Φ

−

11

250

250

heißt Normalverteilung zu den Parametern µ (Erwartungswert)

und σ 2 (Varianz), oder kurz N(µ, σ 2 )–Verteilung.

Die Dichte der N(µ, σ 2 )–Verteilung ist

1

1 x − µ

2

2

ϕµ,σ (x) = ϕ

= √ σe−(x−µ) /(2σ )

σ

σ

2π

∼ 0,757 ∼ 76%

455 / 469

456 / 469

Beispiel 2

Xn

n

Der Fehler ist kleiner als 1%

Schätzer für p: pn =

Ein Meinungsforschungsinstitut wird von Partei A beauftragt,

durch eine Meinungsumfrage das Wahlergebnis der Partei in

einer bevorstehenden Wahl zu schätzen.

⇔ |pn − p| ≤ 0,01 ⇔ |Xn − np| ≤ 0, 01n

Aufgabenstellung: Ermittle n so, dass

Es sollen so viele Personen befragt werden, dass das Ergebnis

mit einer Wahrscheinlichkeit von mindestens 95% bis auf einen

Fehler von höchstens 1% genau ist.

p({|Xn − np| ≤ 0,01n}) ≥ 0,95

Xn ist B(n, p)–verteilt => Verteilungsfunktion

FXn (x) = p({Xn ≤ x}) ∼ Φ √ x−np

Wieviele Personen müssen dafür befragt werden?

Daten:

np(1−p)

Anteil p der Wähler von Partei A (unbekannt)

Anzahl n der zu befragenden Personen (zu bestimmen)

{|Xn − np| ≤ 0,01n} = {np − 0,01n ≤ Xn ≤ np + 0,01n} =>

Die Zufallsvariable Xn misst die Anzahl der befragten Personen,

die angeben, für Partei A zu stimmen.

p({|Xn − np| ≤ 0,01 n}) = FXn (n(p + 0, 01)) − FXn (n(p − 0,01))

√ !

= Φ √ 0,01n

− Φ √−0,01n

= 2 Φ √0,01 n − 1 ≥ 0,95

np(1−p)

np(1−p)

p(1−p)

458 / 469

457 / 469

Mehrdimensionale Wahrscheinlichkeitsräume

=>

Eine n–dimensionale Wahrscheinlichkeitsverteilung ist

eine Wahrscheinlichkeitsverteilungen auf Ω ⊂ Rn , oder

die W.–Verteilung einer Zufallsvariablen X : Ω → Rn

√ !

Φ √0,01 n ≥ 0,975

p(1−p)

Mit

Eine n–dimensionale W.-Verteilung kann man beschreiben

mit einer Dichte f : Rn → [0, ∞),

Z

p(A) =

f (x) dx für alle A ∈ Bn

Φ−1 (0,975)

∼ 1,96 folgt:

√

p

√ !

0,01 n !

p

≥ 1,96 ⇔ n ≥ 100 p(1 − p)1,96

p(1 − p)

A

(falls eine Dichte existiert), oder

mit einer Verteilungsfunktion F : Rn → R,

Wegen p(1 − p) ≤ 1/4 folgt, dass es sicher ausreicht,

n ≥ (50 · 1,96)2 = 9604

F (x) = p({ω ∈ Ω | ωj ≤ xj für j = 1, . . . , n})

zu wählen.

= p((−∞, x1 ] × · · · × (−∞, xn ])

Beispiel: Die Gleichverteilung auf A ⊂ Rn hat die Dichte

(

1/|A| für x ∈ A

f (x) =

0

sonst

459 / 469

460 / 469

Eine Zufallsvariable X : Ω → Rn kann man auffassen als Vektor

(X1 , . . . , Xn )> von eindimensionalen Zufallsvariablen

Xj : Ω → R.

Satz

Seien X1 , . . . , Xn : Ω → R unabhängige Zufallsvariable und

X = (X1 , . . . , Xn )> : Ω → Rn .

Sei Fj die Verteilungsfunktion von Xj , j = 1, . . . , n. Dann ist

Definition

Zufallsvariablen X1 , . . . , Xn : Ω → R heißen unabhängig ⇔

Die Ereignisse {Xj ∈ Mj }, j = 1, . . . , n, sind stochastisch

unabhängig für alle M1 , . . . , Mn ∈ B1 .

F (x) = F1 (x1 ) · F2 (x2 ) · · · · · Fn (xn )

die Verteilungsfunktion von X .

Wenn Xj die Dichte fj hat, j = 1, . . . , n, dann hat X die Dichte

f (x) = f1 (x1 ) · f2 (x2 ) · · · · · fn (xn )

Erinnerung:

Umgekehrt gilt: Hat X eine W.-Verteilung F oder eine Dichte f

der oben angegebenen Form, dann sind X1 , . . . , Xn unabhängig

und haben die W.–Verteilungen Fj bzw. die Dichten fj ,

j = 1, . . . , n.

Ereignisse A1 , . . . , An sind stochastisch unabhängig ⇔

p(Ai1 ∩ · · · ∩ Ai` ) = p(Ai1 ) · · · p(Ai` )

für alle i1 , . . . , i` ∈ {1, . . . , n} mit ij 6= ik für j 6= k

462 / 469

461 / 469

Beispiel: n–dimensionale Normalverteilung

Beweis: Der Einfachheit halber sei n = 2. Es gilt:

F (x) = p({ω ∈ Ω | X1 (ω) ∈ (−∞, x1 ], X2 (ω) ∈ (−∞, x2 ]})

Sei Xj eine N(µj , σj2 )–verteilte Zufallsvariable für j = 1, . . . , n,

und seien X1 , . . . , Xn unabhängig.

Dann hat X = (X1 , . . . , Xn )> die Dichte

= p({X1 ∈ (−∞, x1 ]}) · p({X2 ∈ (−∞, x2 ]})

= F1 (x1 ) · F2 (x2 )

f (x) = f1 (x1 ) · · · · · fn (xn )

1

1

2

2

2

2

=√

e−(x1 −µ1 ) /(2σ1 ) · · · · · √

e−(xn −µn ) /(2σn )

2πσ1

2πσn

1

2

2

2

2

=

e−(x1 −µ1 ) /(2σ1 )−···−(xn −µn ) /(2σn )

n/2

(2π) σ1 · · · · · σn

Sind f1 und f2 Dichten von X1 und X2 , dann folgt:

Z x1

Z x2

f1 (y1 ) dy1

f2 (y2 ) dy2

F (x) = F1 (x1 ) · F2 (x2 ) =

−∞

−∞

Z

=

f1 (y1 ) f2 (y2 ) d(y1 , y2 )

(−∞,x1 ]×(−∞,x2 ]

Z

=

f (y ) dy

Im Fall gleicher Varianzen σj2 = σ 2 für alle j folgt

(−∞,x1 ]×(−∞,x2 ]

f (x) =

mit f (y ) = f (y1 , y2 ) = f1 (y1 ) f2 (y2 ).

Dies genügt, da sich jedes A ∈ B2 durch (unendliche) Schnitte

und Vereinigungen von Mengen der Form (−∞, x1 ] × (−∞, x2 ]

erzeugen lässt.

1

2

2

e−|x−µ| /(2σ)

n/2

n

(2π) σ

mit µ = (µ1 , . . . , µn )> .

Das ist die Dichte der n–dimensionalen Normalverteilung.

463 / 469

464 / 469

Beweis:

FY (y ) = p({Y ≤ y })

= p({X1 + X2 ≤ y })

Satz

Seien X1 , X2 : Ω → R unabhängige Zufallsvariablen mit Dichten

f1 und f2 . Dann hat Y = X1 + X2 die Dichte

Z ∞

fY (y ) =

f1 (x) f2 (y − x) dx =: (f1 ∗ f2 )(y )

= pX ({x ∈ R2 | x1 + x2 ≤ y })

Z

=

f1 (x1 ) f2 (x2 ) d(x1 , x2 )

f1 (x1 ) f2 (x2 ) dx2 dx1

=

−∞

−∞

x 1 +x2 =y

{x∈R2 | x1 +x2 ≤y }

Z ∞ Z y −x1

−∞

Den Ausdruck f1 ∗ f2 ,

Z ∞

Z

(f1 ∗ f2 )(y ) =

f1 (x) f2 (y − x) dx =

x2

x1

−∞

Mit Substitution z = z(x2 ) = x1 + x2 folgt:

Z ∞Z y

FY (y ) =

f1 (x1 ) f2 (z − x1 ) dz dx1

−∞ −∞

Z y Z ∞

Z

=

f1 (x1 ) f2 (z − x1 ) dx1 dz =

∞

f1 (y − x) f2 (x) dx

−∞

nennt man Faltung von f1 und f2 .

−∞ −∞

Z ∞

y

f (z) dz

−∞

f1 (x) f2 (z − x) dx

wobei f (z) =

−∞

466 / 469

465 / 469

Beispiel

Seien X1 und X2 unabhängige, exponentialverteilte

Zufallsvariable mit Parametern λ1 und λ2 .

Dichte fY (y ) = λ1 λ2 e−λ2 y

(

λj e−λj x

Dichte der Exponentialverteilung: fXj (x) =

0

für x > 0

für x ≤ 0

"

fY (y ) = λ1 λ2 e−λ2 y

e(λ2 −λ1 )x

λ2 − λ1

#y

fX1 (x) fX2 (y − x) dx

= λ1 λ2 e−λ2 y

0

2 −λy

Z

fY (y ) = λ e

Sei y ≥ 0. Dann folgt:

fY (y ) =

e(λ2 −λ1 )y − 1

λ2 − λ1

#

Für λ1 = λ2 = λ gilt:

Für y < 0 gilt fY (y ) = 0.

Z

"

λ1 λ2

=

e−λ1 y − e−λ2 y

λ2 − λ1

∞

−∞

e(λ2 −λ1 )x dx

Für λ1 6= λ2 folgt

Dichte von Y :

fY (y ) =

y

0

Gesucht: Dichte fY von Y = X1 + X2

Z

Z

y

1 dx = λ2 y e−λy

0

y

λ1 e

−λ1 x

λ2 e

−λ2 (y −x)

dy

0

= λ1 λ2 e−λ2 y

Z

y

e(λ2 −λ1 )x dx

0

467 / 469

468 / 469

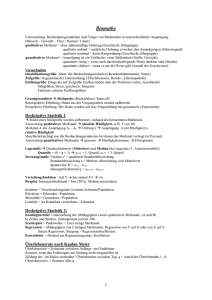

Zusammenfassung: Verteilungen

Diskrete Verteilungen:

Name

Ω

Binomial–V.

{0, . . . , n}

Geometr. V.

N

Poisson–V.

N ∪ {0}

p({k })

n

pk (1 − p)n−k

k

E

V

np

np(1 − p)

pk −1 p

1

p

λk

k!

1−p

p2

λ

λ

e−λ

Verteilungen auf Ω = R:

Name

Exponential–V.

Normalverteilung

Dichte

(

−λx

λe

für x > 0

0

für x ≤ 0

1

2

2

√

e−(x−µ) /(2σ )

2πσ

E

1

λ

V

1

λ2

µ

σ

469 / 469