Einiges über die Brown`sche Bewegung

Werbung

Einiges über die Brown’sche Bewegung

Gunther Leobacher und Friedrich Pillichshammer

Inhaltsverzeichnis

1 Definition und Existenz einer Brown’schen Bewegung

1

2 Einige elementare Eigenschaften der Brown’schen Bewegung

8

3 Die Verteilung des Maximums der Brown’schen Bewegung

11

4 Die Nullstellen der Brown’schen Bewegung

13

5 Eine Pfadeigenschaft der Brown’schen Bewegung

16

6 Brown’sche Bewegungmit Drift

18

1

Definition und Existenz einer Brown’schen Bewegung

Einer der einfachsten nicht-trivialen Zeit-stetigen stochastischen Prozesse ist die sog.

Brown’sche Bewegung welche oft auch Wiener Prozess genannt wird. Dieser Prozess ist benannt nach dem schottischen Botaniker Robert Brown, welcher bei der Beobachtung von

kleinen in Flüssigkeit schwimmenden Partikeln eine erratische Zickzack-Bewegung feststellte. Die Brown’sche Bewegung spielt eine zentrale Rolle in der Theorie der stochastischen Prozesse und sie tritt in verschiedensten Anwendungen auf wie zB. der Beschreibung

von Finanzmärkten (Aktienkurse). Vor allem aber stellt sie einen wichtigen Bauteil für

die Konstruktion anderer stochastischer Prozesse dar. Wir betrachten hier nur die eindimensionale Brown’sche Bewegung.

Man kann sich die Brown’sche Bewegung vorstellen als Zeit-stetige Approximation

einer symmetrischen Irrfahrt auf Z, wobei die Schrittgröße normiert (verkleinert) wird

und die Zeitsprünge gegen 0 gehen.

Definition 1 Einen stochastischen Prozess B = (B(t))t≥0 nennt man (standard-)Brown’sche Bewegung wenn er folgende Eigenschaften erfüllt:

1. B(0) = 0,

2. B hat unabhängige Anstiege, dh. für 0 ≤ u < v ≤ s < t sind B(v) − B(u) und

B(t) − B(s) unabhängige Zufallsvariablen,

3. für 0 ≤ s < t ist B(t) − B(s) ∼ N(0, t − s),

1

1.2

1.2

1

1

0.8

0.8

0.6

0.6

0.4

0.4

0.2

0.2

0

0

-0.2

-0.2

-0.4

-0.4

0

0.2

0.4

0.6

0.8

1

1.2

1.2

1

1

0.8

0.8

0.6

0.6

0.4

0.4

0.2

0.2

0

0

-0.2

-0.2

-0.4

-0.4

-0.6

0

0.2

0.4

0.6

0.8

1

0

0.2

0.4

0.6

0.8

1

-0.6

0

0.2

0.4

0.6

0.8

1

2

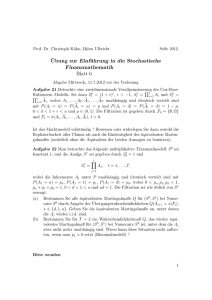

Abbildung 1: Verschiedene Irrfahrten, auf R mit m N(0, σm

)-verteilten unabhängigen

Sprüngen. σm ist dabei so gewählt, dass die Summe aller Sprünge Varianz 1 hat, also

2

m · σm

= 1. Die Bilder zeigen Graphen für m = 16, 64, 256, 4096.

4. B ist stetig mit Wahrscheinlichkeit 1, dh.

P(B ∈ C([0, ∞))) = 1.

Wir werden das Wort standard“ meist weglassen. Es gibt allerdings leicht verall”

gemeinerte Begriffe, welche auch den Namen Brown’sche Bewegung“ tragen, etwa die

”

Brown’sche Bewegung mit Startpunkt a ∈ R bzw. zufälligem Startpunkt X. Weiters

werden wir später auch ein Brown’sche Bewegung mit Drift betrachten.

Wir werden nun zeigen, dass eine Brown’sche Bewegung existiert.

Satz 1 (Wiener) Eine Brown’sche Bewegung existiert.

Wir benötigen einige Vorbereitungen.

Definition 2 Seien X1 , . . . , Xn Zufallsvariable auf der gleichen Ereignismenge Ω mit

gemeinsamer Verteilungsfunktion FX1 ,...,Xn . Die gemeinsame charakteristische Funktion

von X1 , . . . , Xn ist definiert als

ψX1 ,...,Xn (u1 , . . . , un ) := E ei(u1 X1 +···+un Xn )

Z ∞

Z ∞

=

···

ei(u1 x1 +···+un xn ) dFX1 ,...,Xn (x1 , . . . , xn ).

−∞

−∞

Lemma 1 Die Zufallsvariable X1 , . . . , Xn sind genau dann unabhängig, wenn

ψX1 ,...,Xn (u1 , . . . , un ) = ψX1 (u1) · · · ψXn (un ).

2

Beweis. Einfache Übung.

2

Lemma 2 Es gilt

Z

∞

2

−u2 /2

e

x

e−x /2

du ≤

.

x

Beweis. Mit Produktintegration folgt

Z ∞

Z ∞

1 −u2 /2

1 −u2 /2 ∞

2

e−u /2 du.

e

du = − e

−

2

x

u

u

x

x

Also gilt

2

e−x /2

=

x

Z

∞

x

1

1+ 2

u

−u2 /2

e

du ≥

Z

∞

e−u

2 /2

du.

x

2

Lemma 3 Seien X1 , X2 zwei Zufallsvariable mit gemeinsamer Dichtefunktion

f (x) = p

1

1

Det(2πD)

e− 2 (x−µ)D

−1 (x−µ)⊤

wobei x = (x1 , x2 ) ∈ R2 , µ = (µ1 , µ2 ) und D eine reelle, symmetrische, positiv definite

2 × 2-Matrix ist. Dann sind X1 , X2 genau dann unabhängig, wenn Cov(X1 , X2 ) = 0.

Beweis. Da D positiv definit ist, muss

2

σ1

ρσ1 σ2

.

D=

ρσ1 σ2 σ22

sein mit σ1 , σ2 ∈ R und |ρ| < 1 (Übung). O.B.d.A. gilt σ1 , σ2 ∈ (0, ∞).

Wir schreiben nun f als

f (x1 , x2 ) =

2πσ1 σ2

1

p

−

(1 − ρ2 )

e

1

2(1−ρ2 )

„

(x1 −µ1 )2

(x −µ )2

2ρ(x1 −µ1 )(x2 −µ2 )

+ 2 22

−

σ1 σ2

σ2

σ

1

2

«

.

Mittels Integration erhält man nun

E(Xi ) = µi

und

V (Xi ) = σi2

für i ∈ {1, 2} und Cov(X1 , X2 ) = ρσ1 σ2 . Falls Cov(X1 , X2 ) = 0, dann ist also ρ = 0 und

somit gilt

(x −µ )2

(x −µ )2

− 1 21

− 2 22

1

1

2σ

2σ

1

2

√

e

e

.

f (x1 , x2 ) = √

2πσ1

2πσ2

Also sind X1 und X2 unabhängig.

Die Umkehrung ist bekannterweise auch richtig.

2

Wir kommen nun zum Beweis von Satz 1.

3

Beweis. Wir konstruieren zuerst eine Brown’sche Bewegung auf dem Intervall [0, 1].

Für N = 0, 1, 2, . . . sei DN die Menge der ganzzahligen Vielfachen von 2−N in [0, 1],

dh.

k

N

DN =

: k ∈ {0, . . . , 2 }

2N

und weiters

\

DN .

D :=

N ∈N0

Wir sagen (B(t))t∈DN ist eine Brown’sche Bewegung mit Index DN , falls B(0) = 0

und für alle 0 ≤ t0 < t1 < . . . < tn in DN die Zuwächse

B(t1 ) − B(t0 ), . . . , B(tn ) − B(tn−1 )

unabhängige, normal-verteilte Zufallsvariable mit Erwartungswert 0 und Varianzen t1 −

t0 , . . . , tn − tn−1 sind.

Für jedes t ∈ D seien Y (t) unabhängige Zufallsvariable mit Y (t) ∼ N(0, 1).

Wir werden nun wie folgt vorgehen: Wir konstruieren induktiv für jedes N ∈ N0 eine

Brown’sche Bewegung mit Index DN . Daraus erhalten wir eine Brown’sche Bewegung mit

Index D welche wir stetig für t ∈ [0, 1] erweitern. Am Ende zeigen wir, dass man dadurch

eine Brown’sche Bewegung auf [0, 1] erhält.

Für t ∈ D0 = {0, 1} sei

0

falls t = 0,

B(t) =

Y (1) sonst.

Dann ist (B(t))t∈D0 eine Brown’sche Bewegung mit Index D0 .

Angenommen (B(t))t∈DN−1 ist eine Brown’sche Bewegung mit Index DN −1 . Sei t ∈

DN \ DN −1 , dh. t ist von der Form t = (2k + 1)2−N . Seien r := t − 2−N und s := t + 2−N

sodass also r, s ∈ DN −1 .

Wir definieren nun die Zufallsvariable

1

B(r) + B(s)

Z(t) := (N +1)/2 Y (t) und B(t) :=

+ Z(t).

2

2

Dann gilt

B(t) − B(r) =

B(s) − B(r)

B(r) + B(s)

+ Z(t) − B(r) =

+ Z(t)

2

2

und

B(r) + B(s)

B(s) − B(r)

− Z(t) =

− Z(t).

2

2

Also sind B(t) − B(r) und B(s) − B(t) normal-verteilte Zufallsvariable und

B(s) − B(t) = B(s) −

E(B(t) − B(r)) = E(B(s) − B(t)) = 0

und

1

E((B(s) − B(r))2 ) + E((B(s) − B(r))Z(t)) + E(Z(t)2 )

4

1

V (B(s) − B(r)) + E(B(s) − B(r))E(Z(t)) + V (Z(t))

=

4

1

1

s−r

+ N +1 = N = t − r.

=

4

2

2

E((B(t) − B(r))2 ) =

4

B (N −1)

B (N −1)

k

2N−1

Z (N )

B (N )

k

2N−1

∈ DN −1

2k+1

2N

2k+1

2N

k+1

2N−1

2k+1

2N−1

∈ DN \ DN −1

k+1

2N−1

∈ DN −1

Abbildung 2: Der Prozess (B (N ) (t))t∈[0,∞) .

Analog zeigt man

E((B(s) − B(t))2 ) =

1

= s − t.

2N

Damit folgt nun

B(t) − B(r) ∼ N(0, t − r)

und

B(s) − B(t) ∼ N(0, s − t).

Weiters ist

1

E ((B(t) − B(r))(B(s) − B(t))) = E

(B(s) − B(r))2 − Z(t)2

4

1

=

V (B(s) − B(r)) − V (Z(t))

4

1

s−r

− N +1 = 0.

=

4

2

Mit Hilfe von Lemma 3 folgt nun, dass B(t) − B(r) und B(s) − B(t) unabhängig sind.

Weiters sind die beiden Zuwächse sicher von allen Zuwächsen über Intervalle außerhalb

von (r, s) unabhängig, da sie ja aus B(s) − B(r) und Y (t) konstruiert wurden. Somit ist

(B(t))t∈DN eine Brown’sche Bewegung mit Index DN .

Für jedes N ∈ N0 sei nun (B (N ) (t))t≥0 jener stetige Prozess, den man durch lineare

Interpolation aus (B(t))t∈DN erhält. Weiters sei (siehe Abbildung 2),

Z (N ) (t) := B (N ) (t) − B (N −1) (t).

Für t ∈ DN −1 ist natürlich Z (N ) (t) = 0. Für t ∈ DN \ DN −1 ist

Z (N ) (t) = B(t) −

Y (t)

B(t − 2−N ) + B(t + 2−N )

= Z(t) = N+1 .

2

2 2

5

Sei nun (siehe Abbildung 2)

MN := sup |Z (N ) (t)| = sup |B (N ) (t) − B (N −1) (t)| =

0≤t≤1

0≤t≤1

Da DN \ DN −1 genau 2N −1 Elemente enthält gilt

x/2

P MN > √

= P

2N −1

sup

t∈DN \DN−1

!

|Y (t)| > x

1

≤ 2 P(Y (1) > x) = 2 √

2π

N

N

sup

t∈DN \DN−1

|Y (t)|

2

N+1

2

.

≤ 2N −1 P (|Y (1)| > x)

Z

∞

2

− t2

e

x

x2

2N e− 2

√

dt ≤

,

2π x

√

wobei wir Lemma 2 verwendet haben. Wir wählen nun x = 2 N − 1 und erhalten

√

N

2N e−2N +2

2

N −1

√

≤√

≤c 2

P MN > √

e

2π 2 N − 1

2N −1

mit einer Konstanten c > 0. Also gilt

√

X X 2 N

N −1

<∞

P MN > √

≤c

2

N −1

e

2

N ≥1

N ≥1

und mit Hilfe des ersten Borel-Cantelli Lemmas folgt nun

√

N −1

unendlich oft = 0.

P MN > √

2N −1

Also gibt es ein größtes N (abhängig von ω) mit MN >

Wahrscheinlichkeit 1, dass

√

N −1

MN ≤ √

2N −1

und somit folgt mit Wahrscheinlichkeit 1, dass

X

MN < ∞.

√

√ N −1 .

2N−1

Für große N gilt nun mit

N ≥1

Die Folge {{B (N ) (t) : 0 ≤ t ≤ 1} : N ≥ 1} ⊆ C([0, 1]) ist mit Wahrscheinlichkeit 1

eine Cauchy-Folge, da für n < m gilt

sup B (n) (t) − B (m) (t) ≤ Mn+1 + · · · + Mm → 0

0≤t≤1

für n, m → ∞ (mit Wahrscheinlichkeit 1). Da C([0, 1]) ein vollständiger, metrischer Raum

ist existiert nun limN →∞ B (N ) in C([0, 1]) mit Wahrscheinlichkeit 1. Wir definieren also

limN →∞ B (N ) falls der Grenzwert existiert,

B :=

0

sonst (auf einer Menge mit Wahrscheinlichkeit 0).

Wir zeigen noch, dass B eine Brown’sche Bewegung auf [0, 1] ist.

6

1. Es ist B(0) = 0.

2. Die Pfade von B sind mit Wahrscheinlichkeit 1 stetig, da B der gleichmäßige Grenzwert stetiger Funktionen ist.

3. Für t > s ist

B(t) − B(s) = lim B

(n)

n→∞

fast sicher und

B

(n)

⌊t2n ⌋

2n

−B

Für n → ∞ folgt

(n)

⌊s2n ⌋

2n

⌊t2n ⌋

2n

∼N

−B

(n)

⌊s2n ⌋

2n

⌊t2n ⌋ ⌊s2n ⌋

0, n − n

2

2

.

B(t) − B(s) ∼ N(0, t − s),

da aus Konvergenz fast sicher die Konvergenz in Verteilung folgt.

4. B hat unabhängige Anstiege, da dies für B (N ) gilt und diese Eigenschaft beim

Grenzübergang erhalten bleibt. Das sieht man zB. unter Verwendung von charakteristischen Funktionen. Sei 0 ≤ u < v < s < t. Dann gilt mit Hilfe von Lemma

1,

E eiθ1 (B(t)−B(s)) eiθ2 (B(v)−B(u))

(N)

(N)

(N)

(N)

= lim E eiθ1 (B (t)−B (s)) eiθ2 (B (v)−B (u))

N →∞

(N)

(N)

(N)

(N)

= lim E eiθ1 (B (t)−B (s)) E eiθ2 (B (v)−B (u))

N →∞

= E eiθ1 (B(t)−B(s)) E eiθ2 (B(v)−B(u)) .

Nach Lemma 1 sind B(t) − B(s) und B(v) − B(u) unabhängig.

Wie erhält man nun eine Brown’sche Bewegung auf [0, ∞)?

Seien dazu B1 , B2 , B3 , . . . unabhängige Brown’sche Bewegungen auf [0, 1]. Für t ∈

[n, n + 1) definieren wir nun

B(t) :=

n

X

k=1

Bk (1) + Bn+1 (t − n).

Dann ist B eine Brown’sche Bewegung auf [0, ∞), denn es gilt:

1. B(0) = 0.

2. Sei 0 ≤ s < t, wobei s ∈ [m, m + 1) und t ∈ [n, n + 1) mit m, n ∈ N0 und m ≤ n.

Für m < n gilt

!

m

n

X

X

Bk (1) + Bm+1 (s − m)

Bk (1) + Bn+1 (t − n) −

B(t) − B(s) =

=

=

k=1

n

X

k=m+1

n

X

k=m+2

k=1

Bk (1) + Bn+1 (t − n) − Bm+1 (s − m)

Bk (1) + Bn+1 (t − n) + Bm+1 (1) − Bm+1 (s − m).

7

Da Bk (1) ∼ N(0, 1), Bn+1 (t − n) ∼ N(0, t − n) und Bm+1 (1) − Bm+1 (s − m) ∼

N(0, 1 − s + m) und wegen der Unabhängigkeit der entsprechenden Zufallsvariablen

folgt nun

B(t) − B(s) ∼ N(0, n − m − 1 + t − n + 1 − s + m) = N(0, t − s).

Falls n = m, dann gilt die Aussage trivialerweise auch.

3. Sei 0 ≤ u < v ≤ s < t und seien u ∈ [l, l + 1), v ∈ [k, k + 1), s ∈ [m, m + 1) und

t ∈ [n, n + 1) mit l, k, m, n ∈ N0 und l ≤ k ≤ m ≤ n. Seien zunächst l < k und

m < n. Dann ist

B(v) − B(u) =

k

X

i=l+2

Bi (1) + Bk+1 (v − k) + Bl+1 (1) − Bl+1 (u − l)

und

B(t) − B(s) =

n

X

i=m+2

Bi (1) + Bn+1 (t − n) + Bm+1 (1) − Bm+1 (s − m).

Falls k < m, dann sieht man sofort, dass B(v) − B(u) unabhängig von B(t) − B(s)

ist. Sei also k = m. Es ist Bk+1 (v−k) unabhängig von Bk+1 (1)−Bk+1 (s−k) da v ≤ s

und somit v − k ≤ s − k. Also ist B(v) − B(u) unabhängig von B(t) − B(s). Falls

l = k = m = n, dann ist trivialerweise B(v) − B(u) unabhängig von B(t) − B(s).

Betrachte den Fall l < k = m = n. Dann ist B(t) −B(s) = Bk+1 (t−k) −Bk+1 (s −k)

unabhängig von Bk+1 (v − k) und somit von B(v) − B(u). Die restlichen Fälle kann

man sich analog überlegen.

4. Nach Konstruktion ist B(t) genau dann stetig auf [0, ∞), wenn Bk (t) für alle k ∈ N

auf [0, 1] stetig ist. Also gilt

!

∞

\

P(B ∈ C([0, ∞))) = P

[Bk ∈ C([0, 1])]

k=1

= 1−P

≥ 1−

Damit ist Satz 1 vollständig bewiesen.

2

∞

X

k=1

∞

[

k=1

!

[Bk 6∈ C([0, 1])]

P(Bk 6∈ C([0, 1])) = 1.

2

Einige elementare Eigenschaften der Brown’schen

Bewegung

Wir werden hier einige einfache Eigenschaften der Brown’schen Bewegung zusammenfassen.

8

Eigenschaft 1 Sei (B(t))t≥0 eine Brown’sche Bewegung und sei s > 0 fest gewählt. Dann

ist der Prozess (Bs (t))t≥0 definiert durch

Bs (t) = B(t + s) − B(s),

∀t ≥ 0

wieder eine Brown’schen Bewegung. Diese Eigenschaft nennt man Differentialeigenschaft der Brown’schen Bewegung.

Beweis. Es gilt:

1. Bs (0) = B(s) − B(s) = 0.

2. Zu zeigen, dass Bs unabhängige Anstiege hat, ist eine einfache Übung.

3. Für 0 ≤ t1 < t2 gilt

Bs (t2 ) − Bs (t1 ) = B(t2 + s) − B(t1 + s) ∼ N(0, t2 − t1 ).

4. Falls B(t) stetig ist, dann auch B(s+t) und somit auch Bs (t) = B(t+s)−B(s).

2

Eigenschaft 2 Sei (B(t))t≥0 eine Brown’sche Bewegung. Dann ist auch (−B(t))t≥0 eine

Brown’sche Bewegung. Diese Eigenschaft nennt man Symmetrie der Brown’schen

Bewegung.

Beweis. Der Beweis dieser Eigenschaft ist eine einfache Übung.

2

Eigenschaft

3 Sei (B(t))t≥0 eine Brown’sche Bewegung und sei c > 0. Dann ist auch

√

( cB(t/c))t≥0 eine Brown’sche Bewegung. Diese Eigenschaft nennt man Skalierungseigenschaft der Brown’schen Bewegung.

Beweis. Es gilt:

√

√

1. cB(0/c) = cB(0) = 0.

2. Für 0 ≤ s < t gilt

√

√

√

cB(t/c) − cB(s/c) = c(B(t/c) − B(s/c)) ∼ N(0, s − t).

|

{z

}

∼N (0,(t−s)/c)

3. Für 0 ≤ u < v ≤ s < t gilt 0 ≤ u/c < v/c ≤ s/c < t/c und somit sind

B(v/c) − B(u/c)

und

B(t/c) − B(s/c)

√

unabhängig. Diese Unabhängigkeit bleibt erhalten, wenn man mit c multipliziert.

√

4. Falls B(t) auf [0, ∞) stetig ist, dann ist auch cB(t/c) auf [0, ∞) stetig.

2

9

Eigenschaft 4 Sei (B(t))t≥0 eine Brown’sche Bewegung. Sei 0 ≤ s < t und sei A ∈ B(R)

(die Borelsche σ-Algebra auf R). Dann gilt1

P(B(t) ∈ A|B(s) = x) = P(B(t) − B(s) ∈ A − x|B(s) = x)

= P(B(t) − B(s) ∈ A − x),

da B(t) − B(s) und B(s) = B(s) − B(0) unabhängig sind. Wegen B(t) − B(s) ∼

N(0, t − s) gilt also

Z

y2

1

P(B(t) ∈ A|B(s) = x) = p

e− 2(t−s) dy

2π(t − s) A−x

Z

(y−x)2

1

= p

e− 2(t−s) dy =: p(A, x, t − s).

2π(t − s) A

Die Brown’sche Bewegung ist also ein Markov Prozess mit stationären Übergangswahrscheinlichkeiten.

Eigenschaft 5 Sei 0 < s < t. Dann sind B(s) und B(t) abhängig. Wir berechnen nun

die Korrelation der beiden Zufallsvariablen. Es gilt

Cov(B(s), B(t)) =

=

=

=

E((B(s) − E(B(s)))(B(t) − E(B(t))))

E(B(s)B(t)) = E(B(s)(B(s) + B(t) − B(s)))

E(B(s)2 ) + E((B(s) − B(0))(B(t) − B(s)))

V (B(s)) + E((B(s) − B(0)))E((B(t) − B(s))) = s.

Die Brown’sche Bewegung ist also ein Gauß’scher Prozess mit Kovarianzfunktion

min{s, t}. Weiters ist

r

s

s

∈ (0, 1).

Korr(B(s), B(t)) = √ √ =

t

s t

Eigenschaft 6 Sei (B(t))t≥0 eine Brown’sche Bewegung und sei a > 0. Sei Ta := inf{t :

B(t) = a} (Ta ist eine Zufallsvariable!). Wir definieren nun den Prozess (Ba (t))t≥0

durch (siehe Abbildung 3),

B(t)

falls t ≤ Ta ,

Ba (t) =

2a − B(t) falls t > Ta .

Dann ist (ohne Beweis) (Ba (t))t≥0 eine Brown’sche Bewegung. Diese Eigenschaft

nennt man Reflexionseigenschaft der Brown’schen Bewegung. Bemerkung: Man kann

zeigen, dass P(Ta < ∞) = 1.

Eigenschaft 7 Sei (B(t))t≥0 eine Brown’sche Bewegung und sei a > 0. Sei Ta wie oben

e

e

definiert. Dann ist (B(t))

t≥0 , definiert durch B(t) := B(Ta +t)−B(Ta ), eine Brown’sche Bewegung welche unabhängig ist vom Pfad von B bis zum Zeitpunkt Ta . Diese

Eigenschaft folgt aus der sog. strong independent increments property der Brown’schen Bewegung (ohne Beweis).

1

Streng genommen muss man sich och überlegen, was die Bedeutung der bedingten Wahrscheinlichkeit

hier ist: für P(A) > 0 ist P(B|A) = P(B ∩ A)/P(A). Aber P(B(s) = x) = 0.

10

1.6

1.4

1.2

1

a

0.8

0.6

0.4

0.2

0

-0.2

-0.4

-0.6

0

0.2

0.4

0.6

0.8

1

Ta

Abbildung 3: Reflexion der Brown’schen Bewegung.

3

Die Verteilung des Maximums der Brown’schen

Bewegung

Für 0 ≤ t sei

M(t) := max B(s).

0≤s≤t

Dann ist M(t) eine Zufallsvariable. Da eine stetige Funktion auf einem kompakten Intervall ein Maximum annimmt, existiert M(t) mit Wahrscheinlichkeit 1.

Wir werden nun die Dichte- und Verteilungsfunktion und den Erwartungswert von

M(t) bestimmen. Dazu benötigen wir zunächst ein Hilfsresultat.

Proposition 1 Sei (B(t))t≥0 eine Brown’sche Bewegung. Für a > 0 und y ≥ 0 gilt dann

P(B(t) ≤ a − y, M(t) ≥ a) = P(B(t) ≥ a + y).

Beweis. Zunächst ist klarerweise M(t) ≥ a genau dann, wenn

Ta = inf{s : B(s) = a} ≤ t.

Weiters gilt

Ta = Ta∗ := inf{s : Ba (s) = a}.

Darum, und da B ∼ Ba gilt nun

P(B(t) ≤ a − y, M(t) ≥ a) =

=

=

=

=

11

P(B(t) ≤ a − y, Ta ≤ t)

P(Ba (t) ≤ a − y, Ta ≤ t)

P(2a − B(t) ≤ a − y, Ta ≤ t)

P(B(t) ≥ a + y, Ta ≤ t)

P(B(t) ≥ a + y),

da für y ≥ 0 aus B(t) ≥ a + y folgt, dass Ta ≤ t.

2

Nun erhalten wir folgendes Resultat.

Korollar 1 Für a ≥ 0 ist

√ Z ∞

x2

2

P(M(t) ≥ a) = 2P(B(t) ≥ a) = √

e− 2t dx.

πt a

Beweis. Mit Proposition 1 für y = 0 gilt

P(M(t) ≥ a) = P(M(t) ≥ a, B(t) ≤ a) + P(M(t) ≥ a, B(t) > a)

= P(B(t) ≥ a) + P(M(t) ≥ a, B(t) > a)

Z ∞

2

x2

= 2P(B(t) ≥ a) = √

e− 2t dx.

2πt a

2

Nun erhalten wir folgenden Satz.

Satz 2 Sei a ≥ 0. Die Verteilungsfunktion von M(t) lautet

Z ar

2 − x2

P(M(t) ≤ a) =

e 2t dx.

πt

0

Die Dichtefunktion von M(t) ist gegeben durch

r

fM (t) (x) =

2 − x2

e 2t .

πt

Beweis. Aus Korollar 1 folgt

P(M(t) ≤ a) = 1 − P(M(t) ≥ a)

√ Z ∞

x2

2

= 1− √

e− 2t dx

πt

√ Z ∞ a

√ Z ∞

2

x2

2

2

− x2t

= √

e

e− 2t dx

dx − √

πt

πt a

r Z0 a

x2

2

e− 2t dx.

=

πt 0

Durch ableiten erhält man die Dichtefunktion.

2

Korollar 2 Es gilt

E(M(t)) =

r

2t

.

π

Beweis. Es gilt

E(M(t)) =

r

2

πt

Z

∞

0

2

− x2t

xe

r

dx = −t

12

2

πt

Z

0

∞

r

x x2

2t

− 2t

e

−

.

dx =

t

π

2

Wir bestimmen noch Dichte- und Verteilungsfunktion und Erwartungswert der Zufallsvariable Ta .

Korollar 3 Für t ≥ 0 ist

P(Ta ≤ t) =

und für x > 0 gilt

r

2

πt

Z

∞

x2

e− 2t dx

a

a2

3

a

fTa (x) = √ e− 2x x− 2 .

2π

Beweis. Es gilt

P(Ta ≤ t) = P(M(t) ≥ a)

und die Formel für die Verteilungsfunktion folgt aus Satz 2. Durch Differentiation der

Verteilungsfunktion erhält man die Dichtefunktion,

r Z ∞

x2

d

d

2

fTa (t) = P(Ta ≤ t) =

e− 2t dx.

dt

dt πt a

Es ist

r

2

πt

Z

∞

2

− x2t

e

a

r Z ∞

2

2

− u2

e

dx =

du

π a/√t

!

Z a/√t

2

u

a

1

− 2

du = 2 1 − N √

= 2 1− √

e

t

2π −∞

wobei N(x) die Verteilungsfunktion einer N(0, 1) verteilten Zufallsvariable ist. Da

a2

1

a

′

N √ = √ e− 2t

t

2π

folgt die Behauptung.

2

Es gilt also

E(Ta ) =

Z

∞

0

4

√

a2

a

e− 2t dt = ∞.

2πt

Die Nullstellen der Brown’schen Bewegung

Sei 0 < t0 < t1 . Wie groß ist die Wahrscheinlichkeit, dass ein brownscher Pfad eine

Nullstelle im Intervall (t0 , t1 ) hat? Zur Beantwortung dieser Frage benötigen wir zwei

Hilfsresultate.

Lemma 4 Sei X ∼ N(0, 1). Für a ≥ 0 gilt dann

r Z a

x2

2

P(|X| ≤ a) =

e− 2 dx

π 0

und

f|X| (a) =

wobei f|X| die Dichtefunktion von |X| ist.

r

13

2 − a2

e 2

π

Beweis. Es ist

1

P(|X| ≤ a) = P(−a ≤ X ≤ a) = √

2π

Z

a

2

− x2

e

−a

r Z a

x2

2

e− 2 dx.

dx =

π 0

Die Dichtefunktion erhält man durch Differentiation der Verteilungsfunktion nach a. 2

Lemma 5 Seien X1 und X2 unabhängige, N(0, 1)-verteilte Zufallsvariable. Dann ist die

X1

Cauchy-verteilt mit Parameter a = 0 und b = 1. Dh. für x ∈ R gilt

Zufallsvariable |X

2|

f X1 (x) =

|X2 |

bzw.

F X1 (x) =

|X2 |

1

π(1 + x2 )

1 1

+ arctan(x).

2 π

Beweis. Sei Y := X1 /|X2 | und DY (a) := P(Y ≤ a). Dann gilt

Z ∞

1 − DY (a) = P(Y > a) = P(X1 > a|X2 |) =

P(X1 > av)f|X2 | (v) dv.

0

Es ist

P(X1 > av) = 1 − N(av).

Also gilt (unter Verwendung von Lemma 4)

d

(1 − DY (a))

da Z

∞

d

(1 − N(av))f|X2 | (v) dv

−

da 0

Z ∞

N ′ (av)vf|X2 | (v) dv

0

r

Z ∞

1 − (av)2

2 − v2

√ e 2 v

e 2 dv

π

2π

0

Z

1 ∞ −v2 a2 +1

2

e

v dv

π 0

Z ∞

a2 +1

1 1

1

e−v 2 dv =

.

2π 0

π a2 + 1

fY (a) = −

=

=

=

=

=

Weiters gilt

Z

x

1

FY (x) =

fY (a) da =

π

−∞

Z

x

−∞

1

1 1

da

=

+ arctan(x).

a2 + 1

2 π

2

Nun zur eigentlichen Fragestellung.

Satz 3 Für 0 < t0 < t1 gilt

2

P(B(t) = 0 für ein t ∈ (t0 , t1 )) = arccos

π

14

r t0

.

t1

Beweis. Sei n(0, t, a) die Dichtefunktion einer N(0, t)-verteilten Zufallsvariable. Mit der

Markoveigenschaft der Brown’schen Bewegung gilt

P(B(t) = 0 f. e. t ∈ (t0 , t1 ))

Z ∞

=

P(B(t) = 0 f. e. t ∈ (t0 , t1 )|B(t0 ) = a)fB(t0 ) (a) da

−∞

Z ∞

=

P(B(t − t0 ) = 0 f. e. t − t0 ∈ (0, t1 − t0 )|B(t0 − t0 ) = a)n(0, t0 , a) da

−∞

Z ∞

=

P(B(t) = 0 f. e. t ∈ (0, t1 − t0 )|B(0) = a)n(0, t0 , a) da.

−∞

Sei nun m(t) := min0≤s≤t B(s). Dann gilt

P(B(t) = 0 f. e. t ∈ (t0 , t1 ))

Z ∞

=

P(m(t1 − t0 ) ≤ 0|B(0) = a) n(0, t0 , a) da

|

{z

}

0

Z

=

=

Korollar1

=

=

0

=P(M (t1 −t0 )≥0|B(0)=−a)

+

P(M(t1 − t0 ) > 0|B(0) = a)n(0, t0 , a) da

−∞

Z ∞

2

P(M(t1 − t0 ) ≥ 0|B(0) = −a)n(0, t0 , a) da

0

Z ∞

2

P(M(t1 − t0 ) ≥ a|B(0) = 0)n(0, t0 , a) da

0

Z ∞

2

2P(B(t1 − t0 ) ≥ a) n(0, t0 , a) da

{z

}

|

0

2

Z

0

∞

P(B(t1 −t0 )≥a)+P(B(t1 −t0 )≤−a)

P(B(t1 − t0 ) ≥ a)n(0, t0 , a) da + 2

|

Z

0

∞

P(B(t1 − t0 ) ≤ −a)n(0, t0 , −a) da .

{z

}

2

R0

−∞

P(B(t1 −t0 )≤a)n(0,t0 ,a) da

Da B(t) ∼ (−B(t)) gilt P(B(t1 − t0 ) ≤ a) = P(B(t1 − t0 ) ≥ −a) und somit folgt

P(B(t) = 0 f. e. t ∈ (t0 , t1 ))

Z ∞

= 2

P(B(t1 − t0 ) ≥ |a|)n(0, t0 , a) da

−∞

Z ∞

= 2

P(B(t1 ) − B(t0 ) ≥ |a|)n(0, t0 , a) da

−∞

Z ∞

= 2

P(B(t1 ) − B(t0 ) ≥ |a| | B(t0 ) = a)n(0, t0 , a) da

−∞

= 2P(B(t1 ) − B(t0 ) ≥ |B(t0 )|),

da B(t1 ) − B(t0 ) und B(t0 ) unabhängig sind.

√

Es ist B(t1 ) − B(t0 ) ∼ N(0, t1 − t0 ), also

√ B(t1 ) − B(t0 ) ∼ X1 t1 − t0 mit X1 ∼ N(0, 1)

und B(t0 ) ∼ N(0, t0 ), also B(t0 ) ∼ X2 t0 mit X2 ∼ N(0, 1). Damit gilt mit Hilfe von

15

β

√

α

√

t1

√

t0

π

2

t1 − t0

Abbildung 4: Beweis für arccos

q t0

t1

=

π

2

− arctan

q

t0

t1 −t0

.

Lemma 5,

√

√

P(B(t) = 0 f. e. t ∈ (t0 , t1 )) = 2P(X1 t1 − t0 ≥ |X2 t0 |)

r

X1

t0

= 2P

≥

|X2 |

t1 − t0

r

1 1

t0

= 2 1 − − arctan

2 π

t1 − t0

r

t0

2 π

.

− arctan

=

π 2

t1 − t0

p

p

Betrachte

nun

Abbildung

4.

Es

ist

sin

α

=

t

/t

,

cos

β

=

t0 /t1 und cos α =

0

1

p

p

(t1 − t0 )/t1 . Also ist tan α = t0 /(t1 − t0 ) und wir erhalten

r r

t0

t0

π

π

arccos

= β = − α = − arctan

.

t1

2

2

t1 − t0

Damit folgt dann die Behauptung.

2

5

Eine Pfadeigenschaft der Brown’schen Bewegung

Per Definition ist fast jeder Pfad einer standard Brown’schen Bewegung stetig auf [0, ∞).

In diesem Kapitel beschäftigen wir uns mit der Frage nach der Differenzierbarkeit eines

Brownschen Pfades. Es gilt

Satz 4 Fast alle Pfade einer Brown’schen Bewegung (B(t))t≥0 sind nirgends differenzierbar auf [0, ∞), da

B(t + h) − B(t) P ∀t ≥ 0 : lim sup = +∞ = 1.

h

h→0

Bevor wir obigen Satz beweisen, zeigen wir ein einfaches Lemma, welches aber bereits

einen Hinweis auf obiges Resultat gibt. Dieses Lemma werden wir später im Beweis von

Satz 4 benötigen.

16

Lemma 6 Sei M > 0. Für alle t ∈ [0, ∞) und n ∈ N gilt dann

B(t + n1 ) − B(t) M

≤M ≤ √

P .

1

n

n

1

1

Beweis. Da

√ (B(t))t≥01 eine Brown’sche Bewegung ist, folgt B(t + n ) − B(t) ∼ N(0, n ) und

somit ist n(B(t + n ) − B(t)) ∼ N(0, 1), also standard normalverteilt. Damit folgt

√

B(t + n1 ) − B(t) M

1

≤M

= P n(B(t + n ) − B(t)) ≤ √

P 1

n

n

r Z M/√n

Z M/√n

2

2

2

1

− x2

− x2

dx

=

dx.

e

e

= √

π 0

2π −M/√n

x2

Für alle x ∈ R ist e− 2 ≤ 1 und somit gilt

r

B(t + n1 ) − B(t) M

≤M ≤ 2√

P .

1

π n

n

p

Da 2/π < 1 folgt die Behauptung.

2

Beweis von Satz 4. Wegen der Differentialeigenschaft einer Brown’schen Bewegung reicht

es aus zu zeigen, dass

B(t + h) − B(t) = +∞ = 1.

P ∀t ∈ [0, 1) : lim sup h

h→0

Sei M ∈ [0, ∞) und

B(t + h) − B(t) ≤M .

A

:= ω : ∃t ∈ [0, 1) mit lim sup h

h→0

Wir zeigen nun P A(M ) = 0 für alle M ∈ [0, ∞). Daraus folgt dann die Behauptung.

Falls ω ∈ A(M ) , dann existiert ein t ∈ [0, 1) und ein n0 ∈ N, sodass für alle n ≥ n0 gilt

(M )

|B(s) − B(t)| ≤ 2M|t − s|

falls |t − s| ≤ n2 . Für n ∈ N definieren wir nun die Menge

2

An := ω : ∃t ∈ [0, 1) mit |B(s) − B(t)| ≤ 2M|t − s| falls |t − s| ≤

.

n

Dann gilt natürlich

An ⊆ An+1 ∀n ∈ N

und

Also folgt

P A(M ) ≤ P

∞

[

An

n=1

17

!

(M )

A

⊆

∞

[

n=1

= lim P(An ),

n→∞

An .

dh. wir haben P(An ) für große n ∈ N zu betrachten.

Für ω ∈ An gibt es ein t ∈ [0, 1) mit der Eigenschaft

|B(s) − B(t)| ≤ 2M|t − s|

j

i

falls |t − s| ≤ n2 . Sei nun i = sup j : 2n

≤ t , dh. 2n

≤t<

groß wählen, dass i ≤ 2n − 3. Dann gilt

i+1

.

2n

i

i

) − B( i+1

)| ≤ |B( 2n

) − B(t)| + |B(t) − B( i+1

)| ≤

|B( 2n

2n

2n

Da t < 1 kann man n so

2M

2n

+

2M

2n

≤

2M

.

n

Analog zeigt man auch

) − B( i+2

)| ≤

|B( i+1

2n

2n

3M

n

|B( i+2

) − B( i+3

)| ≤

2n

2n

und

5M

.

n

Sei nun

i

Yi,n := max |B( 2n

) − B( i+1

)|, |B( i+1

) − B( i+2

)|, |B( i+2

) − B( i+3

)| .

2n

2n

2n

2n

2n

Damit gilt für hinreichend große n ∈ N,

5M

für das zu t gehörige i

An ⊆

ω : ∃t ∈ [0, 1) mit Yi,n ≤

n

2n−3

[ 5M

=: Bn .

⊆

ω : Yi,n ≤

n

i=0

Also ist

lim P(An ) ≤ lim P(Bn ).

n→∞

n→∞

Mit Lemma 6 folgt nun

P(Bn ) ≤

2n−3

X

i=0

P

ω : Yi,n ≤

5M

n

≤

2n−3

X

i=0

5M

√

n

3

≤

2(5M)3

√

.

n

Somit ist limn→∞ P(Bn ) = 0 und auch P A(M ) = 0. Das Resultat folgt.

6

2

Brown’sche Bewegungmit Drift

In vielen Anwendungen benötigt man eine etwas verallgemeinerte Definition der Brown’schen Bewegung.

Definition 3 Sei (B(t))t≥0 eine Brown’sche Bewegung und sei µ ∈ R. Der Prozess

(Bµ (t))t≥0 mit Bµ (t) := B(t) + µt heißt Brown’sche Bewegung mit Drift µ.

Im Folgenden sei immer µ < 0 angenommen. Für a ∈ R gilt dann

√

B(t)

a

P(Bµ (t) ≥ a) = P (B(t) ≥ a − µt) = P √ ≥ √ − µ t

t

t

Z A/√t−µ√t

x2

1

e− 2 dx → 0,

= 1− √

2π −∞

18

1.2

B(t)

1

0.8

B(t) + µt

0.6

0.4

0.2

0

-0.2

-0.4

-0.6

0

0.2

0.4

t

0.6

0.8

1

Abbildung 5: Brown’sche Bewegung mit Drift.

falls t → ∞, da µ < 0. Also ist

lim Bµ (t) = −∞

t→∞

mit Wahrscheinlichkeit 1. Insbesondere gilt mit Wahrscheinlichkeit 1, dass

Mµ := sup Bµ (t) < ∞,

0≤t<∞

dh. fast jeder Pfad geht nach “unten”. Wir bestimmen nun die Wahrscheinlichkeitsverteilung

von Mµ . Gesucht ist also P(Mµ ≥ a) für a ∈ R.

Seien dazu zunächst a, b ≥ 0. Wir bestimmen P(Mµ < a + b). Um a + b zu erreichen,

muss man zunächst einmal a in endlicher Zeit Ta erreichen (siehe Abbildung 5). Hier

beginnt man eine neue Brown’sche Bewegung mit Drift welche unabhängig ist von dem,

was vor dem Zeitpunkt Ta geschieht. Mit dieser Brown’schen Bewegung mit Drift muss

man dann zu b kommen. Also gilt

P(Mµ > a + b) = P(Mµ > a)P(Mµ > b).

Für einen exakten Beweis dieser Tatsache würden wir die sog. “strong independent increments property” der Brown’schen Bewegung benötigen (siehe Eigenschaft 7).

Sei nun f (a) := P(Mµ > a), dann gilt also

f (a + b) = f (a)f (b).

Da f nicht die Nullfunktion ist folgt, dass f (0) = 1. Die Lösung dieser Funktionalgleichung

sind Exponentialfunktionen der Form f (a) = e−ca mit c > 0, dh.

P(Mµ > a) = e−ca .

19

Wir müssen nur noch die Konstante c > 0 bestimmen. Es gilt

e−ca = P(Mµ > a) = P(Bµ (t) = a für ein t ≥ 0)

= P(B(t) + µt = a für ein t ≥ 0).

Da µ < 0 folgt, dass Bµ erst nach B den Wert a erreicht. Der Prozess B erreicht a zum

ersten mal zum Zeitpunkt Ta . Damit ist obige Wahrscheinlichkeit gleich

P(B(Ta + t) + µ(Ta + t) = a für ein t ≥ 0)

= P(B(Ta + t) + µ(Ta + t) = B(Ta ) für ein t ≥ 0)

= P(B(Ta + t) − B(Ta ) + µt = −µTa für ein t ≥ 0)

= P(Bµ (t) = −µTa für ein t ≥ 0),

da B(Ta + t) − B(Ta ) eine Brown’sche Bewegung ist, und somit unabhängig ist vom Pfad

von B bis zu Ta (siehe Eigenschaft 7). Also gilt nun

e−ca = P(Bµ (t) = −µTa für ein t ≥ 0)

= P (Mµ ≥ µTa )

Z ∞

=

P(Mµ ≥ µy|Ta = y)fTa (y) dy,

0

wobei fTa die Dichtefunktion der Zufallsvariable Ta ist. Aus Korollar 3 wissen wir bereits,

dass für y ≥ 0 gilt

a2

3

a

fTa (y) = √ e− 2y y − 2 .

2π

Damit und da P(Mµ ≥ µy|Ta = y) = P(Mµ ≥ −µy) = ecµy folgt nun

Z ∞

√

2

− a2y − 23

−a 2c|µ|

−ca

cµy a

√

.

e

=

e

e y dy = e

2π

0

p

Somit ist c = 2c|µ| bzw. c = −2µ. Es gilt also folgender Satz.

Satz 5 Für eine Brown’sche Bewegung (Bµ (t))t≥0 mit negativer Drift µ ist das Supremum

Mµ mit Wahrscheinlichkeit 1 endlich und exponential verteilt, dh. für x ≥ 0 gilt

P(Mµ > x) = e2µx .

20