Kapitel 1 Vektoren und Matrizen

Werbung

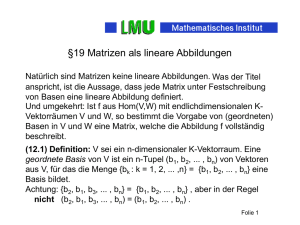

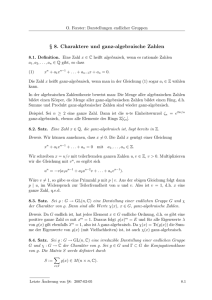

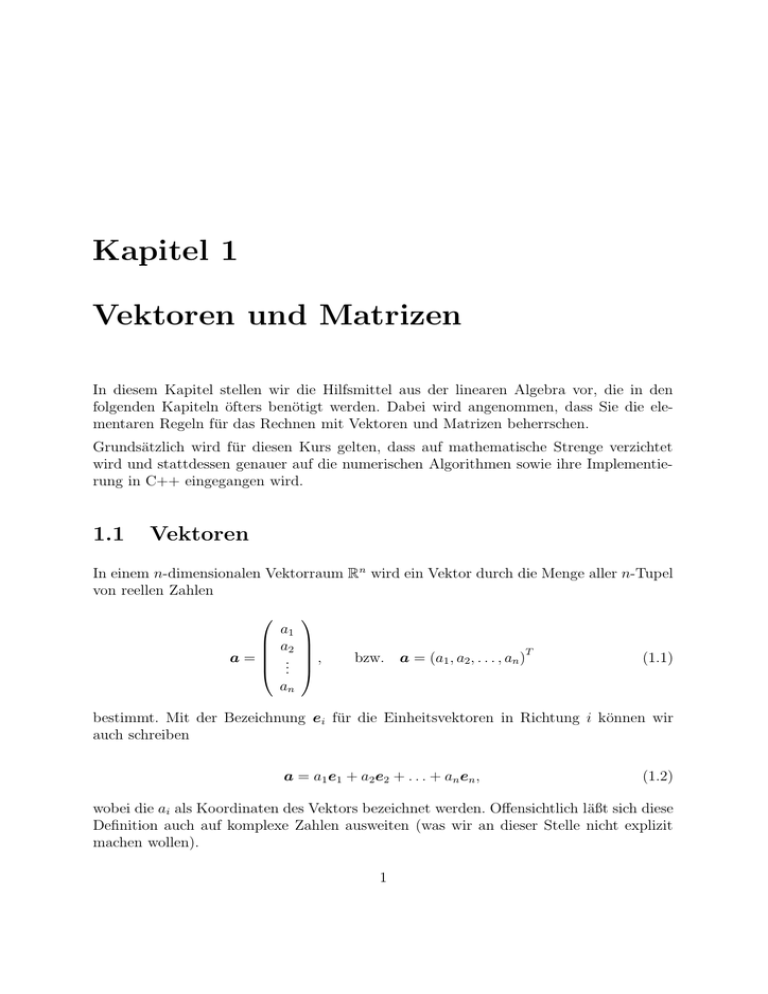

Kapitel 1 Vektoren und Matrizen In diesem Kapitel stellen wir die Hilfsmittel aus der linearen Algebra vor, die in den folgenden Kapiteln öfters benötigt werden. Dabei wird angenommen, dass Sie die elementaren Regeln für das Rechnen mit Vektoren und Matrizen beherrschen. Grundsätzlich wird für diesen Kurs gelten, dass auf mathematische Strenge verzichtet wird und stattdessen genauer auf die numerischen Algorithmen sowie ihre Implementierung in C++ eingegangen wird. 1.1 Vektoren In einem n-dimensionalen Vektorraum Rn wird ein Vektor durch die Menge aller n-Tupel von reellen Zahlen a= a1 a2 .. . an , bzw. a = (a1 , a2 , . . . , an )T (1.1) bestimmt. Mit der Bezeichnung ei für die Einheitsvektoren in Richtung i können wir auch schreiben a = a 1 e1 + a 2 e2 + . . . + a n en , (1.2) wobei die ai als Koordinaten des Vektors bezeichnet werden. Offensichtlich läßt sich diese Definition auch auf komplexe Zahlen ausweiten (was wir an dieser Stelle nicht explizit machen wollen). 1 2 KAPITEL 1. VEKTOREN UND MATRIZEN Normierung Bei numerischen Rechnungen benötigt man häufig Abschätzungen für die “Beträge” von a. Als solche wird man in der Regel die natürliche euklidsche Länge v u n uX t a2 i (1.3) i=1 verwenden. Es gibt jedoch Fälle, wo die Verwendung dieses Abstandes nicht möglich oder nicht zweckmäßig ist, sodass es wünschenswert ist, den Abstand allgemeiner zu definieren. Hierbei wird jedem a eine reelle Zahl kak mit folgendne Eigenschaften zugeordnet: 1. kak > 0 für a 6= 0 (0 ist der Nullvektor); 2. ka + bk ≤ kak + kbk 3. kαak = |α|kak für beliebige a und b; für jede Zahl α. Zur Unterscheidung kennzeichnet man die Normen häufig durch Indizes 1. kak1 = P |ai | . . . Summennorm; pP 2 2. kak2 = i |ai | . . . euklidsche Norm; i 3. kak∞ = maxi |ai | . . . Maximumnorm. Diese Normen sind Spezialfälle der Norm v u n uX p kakp = t |ai |p i=1 1 ≤ p ≤ ∞, p ganz. (1.4) Skalarprodukt Je zwei Elementen a und b können wir die Zahl a·b= X a i bi (1.5) i zuordnen. Wir bezeichnen sie als skalares Produkt von a und b. Diese Definition stimmt offenbar mit der Definition des skalaren oder inneren Produktes in der elementaren Vektoralgebra überein. Es gilt demnach 3 1.2. MATRIZEN kak2 = √ a·a (1.6) Das skalare Produkt genügt der sogenannnten Cauchyschen Ungleichung |a · b| ≤ kak2 kbk2 . (1.7) Lineare Abhängigkeit Insbesondere bei der Untersuchung numerischer Verfahren zur Lösung linearer Gleichungssysteme benötigt man den Begriff der linearen Unabhängigkeit oder Abhängigkeit von Vektoren. Die Vektoren a1 , a2 , . . . ak heißen linear abhängig, wenn es k Zahlen c1 , c2 , . . . ck ungleich Null gibt, sodass c 1 a1 + c 2 a2 + . . . c k ak = 0 (1.8) gilt. Andernfalls heißen die Vektoren a1 , a2 , . . . ak linear unabhängig. 1.2 Matrizen Wir betrachten die quadratische n × n Matrix A= a11 a12 a21 a22 .. .. . . an1 an2 . . . a1n . . . a2n .. , .. . . . . . ann (1.9) deren Elemente aij reelle oder komplexe Zahlen sind. Wir bezeichenen n als die Ordnung der Matrix A. Matrixmultiplikation Zwei Matrizen A und B derselben Ordnung n werden bezüglich der Vorschrift C = AB, cij = n X aik bkj (1.10) k=1 miteinander multipliziert. Manchmal schreibt man die Summe über k nicht explizit an; diese vereinfachende Schreibweise wird als Einsteinsche Summenkonvention bezeichnet. 4 KAPITEL 1. VEKTOREN UND MATRIZEN Einheitsmatrix Eine n × n-Matrix deren Diagonalemente gleich Eins und alle anderen Elemente gleich Null sind II = 1 0 .. . 0 ... 1 ... .. . . . . 0 0 ... 0 0 .. . 1 (1.11) heißt Einheitsmatrix. Wir werden sie mit II bezeichen. Für eine n × n-Matrix A gilt AII = IIA = A. Determinante Jeder n-reihigen quadratischen Matrix A läßt sich auf eindeutige Weise eine reelle oder komplexe Zahl zuordnen, die man als Determinante von A bezeichnet (siehe Kapitel 3). Inverse Matrix Existiert zu einer Matrix A eine Matrix mit der Eigenschaft AA−1 = A−1 A = II, (1.12) so heißt A−1 die inverse Matrix zu A. Bezeichnung von Matrizen Mit AT bezeichnen wir die zu A transponierte Matrix (aTij = aji ), mit A† die zu A konjugierte transponierte Matrix (a†ij = a∗ji ). Eine Matrix A symmetrisch, hermitesch, orthogonal, unitär, heißt wenn wenn wenn wenn A A AT A† = = = = AT A† A−1 A−1 gilt. Eigenwerte Die (reellen oder komplexen) Wurzeln des charakteristischen Polynoms 5 1.2. MATRIZEN p(λ) = det(A − λII) (1.13) heißen Eigenwerte von A. Eine reell-symmetrische oder hermitesche Matrix besitzt nur reelle Eigenwerte. 1.2.1 Matrixnormen Jeder Matrix A wird eine reelle Zahl kAk mit folgenden Eigenschaften zugeordnet: 1. kAk > 0 für A 6= 0 (0 ist die n × n-Nullmatrix); 2. kA + Bk ≤ kAk + kBk 3. kαAk = |α| kAk für alle A und B; für jede Zahl α; 4. kA Bk ≤ kAk kBk (Submultiplikativität). Dann heißt kAk Norm oder Matrixnorm von A. Eine Matrixnorm heißt verträglich mit einer Vektornorm kak wenn kAak ≤ kAk kak (1.14) für beliebige A und a gilt. Dies kann durch die zugeordnete Matrixnorm kAk = max kAxk kxk=1 (1.15) gewährleistet werden. Die zu den Vektornormen kak1 , kak2 und kak∞ zugeordneten Matrixnormen sind die folgenden: 1. kAk1 = maxj ( 2. kAk2 = Pn i=1 |aij |) . . . Norm der maximalen Spaltenbetragssumme; p größter Eigenwert von A† A . . . Spektralnorm; 3. kAk∞ = maxi P n j=1 |aij | . . . Norm der maximalen Zeilenbetragssumme. 6 KAPITEL 1. VEKTOREN UND MATRIZEN Spektralradius Das Maximum der Beträge der Eigenwerte von A bezeichnen wir als den Spektralradius ρ(A) = maxk |λk (A)| der Matrix. Ist A eine hermitesche bzw. reell-symmetrische Matrix, so gilt A† = A und q p kAk2 = größter Eigenwert von A† A = [ρ(A)]2 = ρ(A). 1.2.2 (1.16) Positiv definite Matrix Eine hermitesche Matrix A heißt positiv definit, wenn xT Ax > 0 für alle x (1.17) gilt. Durch Glg. (1.13) haben wir bereits die Eigenwerte einer quadratischen Matrix A definiert. Eine vom Nullvektor verschiedene Lösung von x Ax = λx (1.18) heißt ein zum Eigenwert λ gehöriger Eigenvektor von A. Hieraus folgt weiter xT Ax = λxT x. (1.19) Ist A positiv definit, so gilt demzufolge λ > 0, d.h. eine positiv definite Matrix besitzt nur positive Eigenwerte.