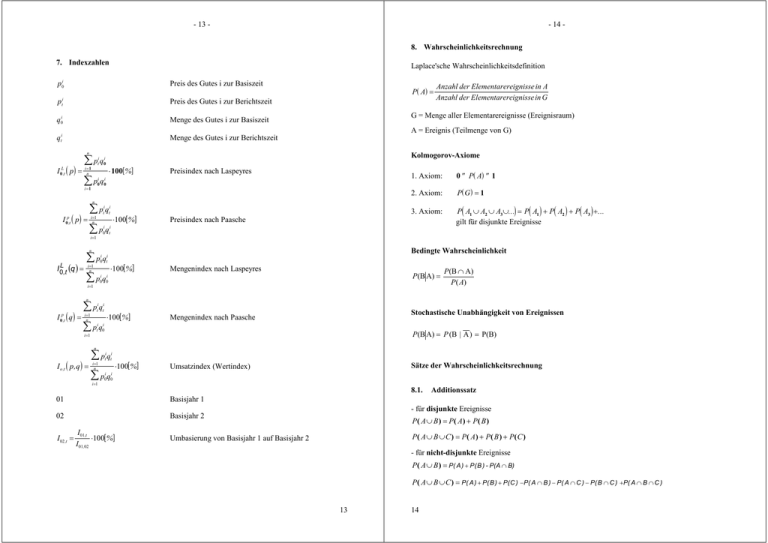

- 13 - 13 7. Indexzahlen pi Preis des Gutes i zur Basiszeit pt Preis

Werbung

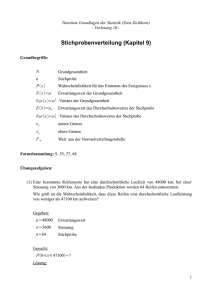

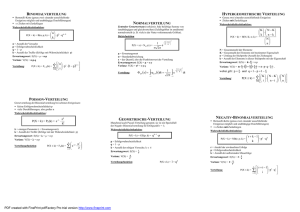

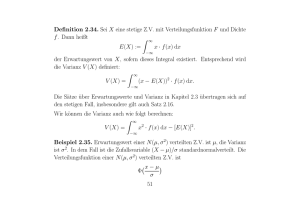

- 13 - - 14 8. Wahrscheinlichkeitsrechnung 7. Indexzahlen Laplace'sche Wahrscheinlichkeitsdefinition p0i p Preis des Gutes i zur Basiszeit i t P( A) = Preis des Gutes i zur Berichtszeit q0i Menge des Gutes i zur Basiszeit qti Menge des Gutes i zur Berichtszeit G = Menge aller Elementarereignisse (Ereignisraum) A = Ereignis (Teilmenge von G) n L 0 ,t Kolmogorov-Axiome ∑ pt q0 i I Anzahl der Elementarereignisse in A Anzahl der Elementarereignisse in G ( p) = i ⋅ 100[ %] i =1 n Preisindex nach Laspeyres ∑ p0 q0 i i i =1 1. Axiom: 0 ≤ P( A) ≤ 1 2. Axiom: P( G ) = 1 3. Axiom: P( A1 ∪ A2 ∪ A3 ∪...) = P( A1 ) + P( A2 ) + P( A3 ) +... gilt für disjunkte Ereignisse n ∑ I 0p,t ( p) = i=1 n ∑ i=1 pti qti ⋅100[ %] Preisindex nach Paasche p0i qti Bedingte Wahrscheinlichkeit n I 0L,t (q ) = ∑ p0i qti i=1 n ∑ i=1 ⋅100[ %] Mengenindex nach Laspeyres P(B A) = p0i q0i P (B ∩ A) P ( A) n I p 0 ,t ( q) = ∑ i=1 n ∑ pti qti ⋅100[ %] Stochastische Unabhängigkeit von Ereignissen Mengenindex nach Paasche i i t 0 pq i=1 P(B A) = P (B | A ) = P(B) n I o ,t ( p ,q ) = ∑ i=1 n ∑ i=1 pti qti ⋅100[ %] Sätze der Wahrscheinlichkeitsrechnung Umsatzindex (Wertindex) p0i q0i 8.1. 01 Basisjahr 1 02 Basisjahr 2 Additionssatz - für disjunkte Ereignisse I02 ,t I = 01,t ⋅100[ %] I01,02 P( A ∪ B ) = P( A) + P( B ) P( A ∪ B ∪ C ) = P( A) + P( B ) + P( C ) Umbasierung von Basisjahr 1 auf Basisjahr 2 - für nicht-disjunkte Ereignisse P ( A ∪ B ) = P( A ) + P ( B ) - P(A ∩ B) P ( A ∪ B ∪ C ) = P ( A ) + P ( B ) + P ( C ) −P ( A ∩ B ) − P ( A ∩ C ) − P ( B ∩ C ) + P ( A ∩ B ∩ C ) 13 14 - 15 8.2. - 16 - Multiplikationssatz f ( xi ) ≥ 0 Eigenschaften: ∑ für stochastisch unabhängige Ereignisse f ( xi ) = 1 i P( A ∩ B ) = P( A) ⋅ P( B ) Verteilungsfunktion P( X ≤ x ) = ∑ f ( xi ) P( A ∩ B ∩ C ) = P( A) ⋅ P( B ) ⋅ P( C ) xi ≤ x für stochastisch abhängige Ereignisse 0 ≤ F ( x) ≤ 1 Eigenschaften: P( A ∩ B ) = P ( A ) ⋅ P( B A ) für x1 ≤ x 2 gilt F ( x1 ) ≤ F ( x 2 ) = P ( B ) ⋅ P( A B ) P( A ∩ B ∩ C ) = P ( A ) ⋅ P( B A ) ⋅ P( C A ∩ B ) 8.3. Erwartungswert E ( X ) = ∑ xi f ( xi ) = µ Satz von der totalen Wahrscheinlichkeit i Die Ereignisse Ai sind disjunkt und bilden eine endliche Zerlegung der Grundgesamtheit. Für ein beliebiges Ereignis E innerhalb G gilt dann: n ( Var ( X ) = ∑ xi2 f ( xi ) − ( E ( X )) = σ2x ) 2 P ( E ) = ∑ P E Ai ⋅P (Ai ) i =1 Varianz i 9.2. Stetige Zufallsvariable n = ∑ ( E ∩ Ai ) Wahrscheinlichkeitsdichte i=1 8.4. ( Satz von Bayes ) P Aj E = ( ) ( P Aj ⋅ P E Aj n ) i dF ( x ) = F' ( x ) dx Eigenschaften: ( A ) ⋅ P( E A ) ∑P i=1 f ( x) = f ( x) ≥ 0 i +∞ ∫ f ( x)dx = 1 −∞ 9. Zufallsvariable, Wahrscheinlichkeitsverteilung 9.1. Verteilungsfunktion Diskrete Zufallsvariable x Wahrscheinlichkeitsfunktion F ( x ) = P( X ≤ x ) = ∫ −∞ P( X = xi ) = f ( xi ) 15 16 f ( v )dv - 17 - - 18 10.2. Hypergeometrische Verteilung Erwartungswert Parameter ∞ F ( X ) = ∫ x f ( x ) dx = µ = = = n N M −∞ Varianz ∞ Stichprobenumfang Umfang der Grundgesamtheit Zahl der Elemente in der Grundgesamtheit mit einer bestimmten Eigenschaft 2 Var ( X ) = ∫ x 2 f ( x ) dx − [ E ( x )] = σ2x P( X = x ) = f H ( x n , N , M ) −∞ f H ( x n, N , M ) = 10. Diskrete Verteilungen M x 10.1. Binomialverteilung Parameter E( X ) = n ⋅ Wahrscheinlichkeitsfunktion f B ( x n, p) = x p ⋅ ( 1 − p) x N − M n− x N n M N Varianz P( X = x ) = f B ( x n , p) n Erwartungswert n = Stichprobenumfang p = Erfolgswahrscheinlichkeit des Elementarereignisses Var ( X ) = n ⋅ n− x M N − M N −n ⋅ ⋅ N N N −1 10.3. Poissonverteilung Verteilungsfunktion Parameter P( X ≤ x ) = FB ( x ) µ Erwartungswert , Varianz Wahrscheinlichkeitsfunktion Erwartungswert P( X = x ) = f P ( x µ ) E( X ) = n⋅ p µ x e− µ x! Varianz f P ( x µ) = Var ( X ) = n ⋅ p ⋅ (1 − p ) Verteilungsfunktion P( X ≤ x ) = FP ( x µ ) Rekursionsformel 17 18 - 19 f ( x + 1 µ) = - 20 - ( P( X1 = x1 ,..., X k = xk ) = f AH x1 , x2 ,..., xk n , N 1 , N 2 ,... N k µ f ( x µ) x +1 Erwartungswert E( X ) = µ ( ) f AH x1 ,..., x k n , N1 ,..., N k = Varianz N1 N2 x1 x2 N Var ( X ) = µ k i=1 =n pi = Erfolgswahrscheinlichkeiten der Elementarereignisse Erwartungswert Wahrscheinlichkeitsfunktion E ( Xi ) = n ⋅ ( P( X 1 = x1 ,..., X k = xk ) = f M x1 , x2 ,..., xk n , p1 ,..., pk ( ) f M x1 , x2 ,..., xk n , p1 , p2 ,..., pk = k ∑ xi mit i=1 =n Ni N Varianz ) Var ( X i ) = n ⋅ n! p x1 ⋅ p2x2 ⋅...⋅ pkxk x1 ! x2 !... xk ! 1 k und ∑ pi = 1 i=1 Erwartungswert ( E( X ) = n ⋅ p ) i Varianz Var ( X i ) = n ⋅ pi ⋅ ( 1 − pi ) 10.5. Allgemeine hypergeometrische Verteilung n = Stichprobenumfang N i = Zahl der Elemente in der Grundgesamtheit mit einer bestimmten, für jedes i verschiedenen Eigenschaft Wahrscheinlichkeitsfunktion 19 20 Ni Ni N − n ⋅ 1 − ⋅ N N −1 N Nk xk ... n k und n = Stichprobenumfang Parameter Parameter ∑ xi mit 10.4. Multinomialverteilung i ∑ Ni i=1 =N )