Einführung in die Wahrscheinlichkeitsrechnung anhand realer Fälle

Werbung

Beschreibende Statistik anhand realer Situationen

Paula Lagares Barreiro∗

Frederico Perea Rojas-Marcos∗

Justo Puerto Albandoz∗

MaMaEuSch†

Management Mathematics for European Schools

94342 - CP - 1 - 2001 - 1 - DE - COMENIUS - C21

∗

Universität Sevilla

MaMaEuSch wurde unterstützt durch die EU mittels einer teilweisen Förderung im Rahmen des Socrates Programmes und einer teilweisen Förderung durch das Land Rheinland-Pfalz. Der Inhalt des Projektes

reflektiert nicht notwendigerweise den Standpunkt der EU, noch unterliegt es irgendeiner Verantwortung

seitens der EU.

†

Inhaltsverzeichnis

1 Zufall und Wahrscheinlichkeit

2

1.1 Ziele . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

2

1.2 Das

Spiel

”Mus”

3

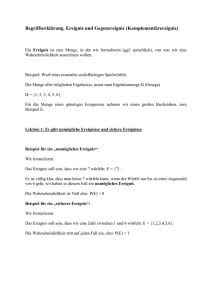

1.3 Zufällige Experimente . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

4

1.4 Zufällige Ereignisse und Ereignisfelder . . . . . . . . . . . . . . . . . . . . . . . . . .

4

1.4.1 Ergebnisse und zufällige Ereignisse . . . . . . . . . . . . . . . . . . . . . . . .

5

1.4.2 Konsistente und inkonsistente Ereignisse . . . . . . . . . . . . . . . . . . . . .

5

1.4.3 Das sichere Ereignis . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

6

1.4.4 Das unmögliche Ereignis . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

6

1.4.5 Das Komplement eines Ereignisses . . . . . . . . . . . . . . . . . . . . . . . .

7

1.5 Operationen an zufälligen Ereignissen . . . . . . . . . . . . . . . . . . . . . . . . . .

7

1.5.1 Vereinigung: ein Ereignis oder das andere . . . . . . . . . . . . . . . . . . . .

7

1.5.2 Durschnitt von Ereignissen: ein Ereignis und ein anderes . . . . . . . . . . . .

8

1.5.3 Differenz von Ereignissen . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

8

1.5.4 Eigenschaften der Operationen mit Ereignissen . . . . . . . . . . . . . . . . .

9

2 Wahrscheinlichkeit

10

2.1 Einleitung . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 10

2.1.1 Definition der Wahrscheinlichkeit über relative Häufigkeiten: empirische Wahrscheinlichkeit . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 10

2.1.2 Laplace’sche Regel: theoretische Wahrscheinlichkeit . . . . . . . . . . . . . . . 12

2.2 Ziehen mit Zurücklegen und Ziehen ohne Zurücklegen. Baum Diagramme . . . . . . 13

2.2.1 Ziehen mit Zurücklegen . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 14

2.2.2 Ziehen ohne Zurücklegen . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 15

2.3 Axiomatische Definition der Wahrscheinlichkeit . . . . . . . . . . . . . . . . . . . . . 15

2.4 Berechnung der Wahrscheinlichkeit in komplexeren Fällen . . . . . . . . . . . . . . . 17

2.4.1 Die bedingte Wahrscheinlichkeit . . . . . . . . . . . . . . . . . . . . . . . . . 17

2.4.2 Unabhängigkeit von zufälligen Ereignissen . . . . . . . . . . . . . . . . . . . . 18

2.4.3 Totale Wahrscheinlichkeit . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 20

2.4.4 Bayes’sche Regel . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 22

2.5 Antwort auf die anfängliche Frage . . . . . . . . . . . . . . . . . . . . . . . . . . . . 23

1

3 Eindimensionale Wahrscheinlichkeitsverteilungen

3.1 Zielsetzungen . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

3.2 Beispiel . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

3.3 Einleitung. Diskrete Zufallsvariablen und Wahrscheinlichkeitsverteilungen

3.4 Häufigkeits Cumulative Wahrscheinlichkeitsfunktionen . . . . . . . . . . .

3.5 Der Modus . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

3.6 Der Erwartungswert . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

3.7 Die Varianz . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

3.8 Resümee der anfänglichen Frage . . . . . . . . . . . . . . . . . . . . . . .

4 Ein

4.1

4.2

4.3

Beispiel einer diskreten Zufallsvariablen:

Ziele . . . . . . . . . . . . . . . . . . . . . . .

Beispiel . . . . . . . . . . . . . . . . . . . . .

Einleitung . . . . . . . . . . . . . . . . . . . .

4.3.1 Der Erwartungswert . . . . . . . . . .

4.3.2 Die Varianz . . . . . . . . . . . . . . .

5 Kontinuierliche

5.1 Ziele . . . .

5.2 Beispiel . .

5.3 Einleitung .

die Binomialverteilung

. . . . . . . . . . . . . . . .

. . . . . . . . . . . . . . . .

. . . . . . . . . . . . . . . .

. . . . . . . . . . . . . . . .

. . . . . . . . . . . . . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

28

28

28

29

31

33

34

34

37

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

38

38

38

39

43

44

Verteilungen: Normalverteilung

46

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 46

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 47

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 47

2

Kapitel 1

Zufall und Wahrscheinlichkeit

Lassen Sie uns das ”Mus” Spiel spielen. Die Karten sind ausgeteilt und es ist Zeit sich auf eine

Wette einzulassen. Wir müssen bedenken, dass wir nicht alleine spielen sondern gegen andere Spieler

antreten. Nervös betrachten wir die neuen Karten, die wir jedesmal bekommen. Welche Karte wird

es sein? Sind meine Karten besser als die der anderen?

Bevor wir beginnen werden wir uns die Spielregeln und das Ziel des ”Mus” Spiels genauer

ansehen.

1.1

Ziele

• Verständnis über das Konzept des zufälligen Experiments und dessen Unterscheidung von

dem deterministischen.

• Erkennen eines zufälligen Ereignisses nach einem Experiment und Kenntnis über den Unterschied zwischen dem Ereignis und dem Ergebnis.

• Finden von speziellen Ereignissen: das unmögliche und das sichere Ereignis.

• Arbeiten mit dem zufälligen Ereignis und Interpretieren der Ergebnisse nach Betrachten von

Vereinigung, Durchschnitt und Differenzen.

• Zuordnen eines einfachen zufälligen Ereignisses auf zwei Arten: von der relativen Häufigkeit

und von der Laplace’schen Formel.

• Verständnis über die bedingte Wahrscheilichkeit und deren Anwendung.

• Verständnis über die Unabhängigkeit von zufälligen Ereignissen und den WahrscheinlichkeitsRechenregeln.

• Arbeiten mit der totalen Wahrscheinlichkeit und der Baye’schen Formel; deren Unterschiede

und Anwendung der Rechenregeln.

3

1.2

Das Spiel ”Mus”

In dieser Klasse spielen wir ein einfaches Kartenspiel. Es spielen jeweils zwei pro Team gegen ein

anderes Team. Auch wird in diesem Spiel nicht um Geld gespielt. Viel wichtiger ist der Spass. Bevor

wir nun mit dem Spiel starten brauchen wir zunächst 40 Karten:

• Acht Asse

• Vier Vierer

• Vier Fünfer

• Vier Sechser

• Vier Siebener

• Vier Buben

• Vier Damen

• Vier Könige

Die Karten werden gemischt und jeder Spieler bekommt zufällig 4 Karten. Folgende Optionen stehen

zur Verfügung:

• Wenn man zwei gleiche Karten hat und die restlichen zwei sind unterschiedlich und unterscheiden sich von den ersten beiden, dann hat man ein Paar. Zum Beispiel ist dies ein Damenpaar:

(Fünf, Dame, Dame, As).

• Wenn man drei gleiche Karten hat und sich nur die vierte unterscheidet, dann hat man ein

Trio. Zum Beispiel: (Sechs, König, König, König)ist ein Königsdreier.

• Weisen die vier Karten zwei Paare auf dann hat man ein Doppel. Diese können verschieden oder gleich sein. Zum Beispiel sind: (As, König, König, As) und (As, As, As, As) zwei

verschiedene Doppel.

In diesem Spiel ist ein Doppel mehr wert als ein Trio und ein Trio ist wiederum besser als ein Paar.

Sollte ein Spieler zwei Paare, zwei Trio oder zwei Doppel haben dann ist jener Spieler der Gewinner,

der die höchsten Karten im Paar, im Trio oder im Paar aufweist.

Die Karten werden wie folgt von unten nach oben beginnend bewertet: As, Vier, Fünf, Sechs,

Sieben, Bube, Dame, König.

Zum Beispiel gewinnt jener Spieler mit einem Doppel von Königen und Assen gegen jenen Spieler

mit einem Doppel von Buben und Damen weil das höchste Paar vom ersten Spieler (Königs-Paar)

mehr wert ist als das höchste Paar des zweiten Spielers (Damen-Paar). Deswegen ist auch ein Paar

von Buben höher bewertet als ein Paar von Sechsen.

Sollten zwei Spieler dasselbe Doppel, denselben Trio, dasselbe Paar von gleichen Karten haben,

dann gewinnt jener Spieler dessen restliche Karte bzw. restliche Karten höherwertig sind. Haben

zwei Spieler identische vier Karten, dann gewinnt jener Speiler, der die Karten als erster bekommen

hat, d.h. der Spieler, der rechts vom Kartengeber sitzt.

4

Nehmen wir an vier Freunde spielen sehr oft dieses Spiel und haben bemerkt, dass ein Paar von

Königen, ein Trio von Königen oder Assen und irgendwelche Doppel zu einer bestimten Zeit immer

wieder vorkommen. Sie diskutieren nun welche Schritte für sie selbst am günstigsten wären. Was

denken Sie darüber?

Beantworten Sie die Frage jetzt noch nicht, sie wird in diesem Kapitel behandelt.

1.3

Zufällige Experimente

Beispiel 1.3.1 Stellen Sie sich folgende Situation vor: Die Karten des Spiels sind ausgeteilt. Wissen wir bereits vorher welche Karten wir bekommen haben?

Wie Sie sehen können wir nicht mit Sicherheit sagen welche Karten wir bekommen haben, da wir sie

nicht sehen. Wir können drei Könige und ein As oder vier Buben bekommen. Beide Möglichkeiten,

und natürlich viele mehr, können auftreten. Die Tatsache, dass wir vorher nicht wissen können

welche Karten wir bekommen heisst Zufälligkeit.

In unserem Fall haben wir ein Experiment: Nehmen Sie vier Karten von dem Stapel. Es können

dabei unterschiedlichste Kartenzusammenstellungen auftreten. Wir bezeichnen dieses Ereignis als

zufälliges Ereignis.

Wenn wir das Ergebnis eines Versuchs bereits im Voraus wissen, dann wird dies als bestimmtes

Ereignis bezeichnet. Zum Beispiel: Lassen wir einen Stein in unserer Hand plötzlich los, dann wird

er zu Boden fallen. Hier gibt es nur eine Möglichkeit, nämlich dass der Stein zu Boden fällt.

Zusammenfassend können wir also sagen, dass bei einem zufälligen Ereignis verschiedene Ergebnisse auftreten können, beim bestimmten Ereignis hingegen gibt es nur ein Endergebnis.

Übung 1.3.1 Beschreiben Sie zwei zufällige und zwei bestimmte Ereignisse.

Definition 1.3.1 (Zufälliges Ereignis) Ein zufälliges Ereignis ist ein Vorgang, der im Voraus

nicht bekannt ist.

1.4

Zufällige Ereignisse und Ereignisfelder

Haben wir das Konzept des zufälligen Experiments verstanden, dann werden wir uns sicherlich

fragen welche Resultate möglich sind.

Nachdem die Karten ausgeteilt wurden stehen eine Menge von möglichen Kartenkombinationen

zur Verfügung. So können wir zum Beispiel folgende vier Karten bekommen (As, König, As, Bube)

oder (Vier, König, Fünf, Sieben). Jede dieser Kombinationen wird als zufälliges Ereignis betrachtet.

Wie vorhin als zufälliges Ereignis definiert beschreibt z.B. (As, Sieben, Bube, Sechs) ein zufälliges

Ereignis.

Die Summe aller zufälligen Ereignisse wird als Ereignisfeld bezeichnet und wir kürzen es mit E

ab. In unserem Beispiel besteht das Ereignisfeld aus allen möglichen Ereignissen.

Übung 1.4.1 Lassen Sie uns folgendes zufälliges Ereignis genauer betrachten: Nehmen Sie eine

Karte zufällig von dem Kartenstapel.

Beschreiben Sie nun das Ereignisfeld dieses Experiments durch Auflisten aller möglichen zufälligen

Ereignisse.

5

Definition 1.4.1 (Ereignisfeld) Alle Ereignisse eines zufälligen Experiments werden im Ereignisfeld E zusammengefaßt.

Jede Teilmenge eines Ereignisfeldes ergibt ein Ereignis.

1.4.1

Ergebnisse und zufällige Ereignisse

Wir unterscheiden die verschiedenen Ergebnisse in zwei Gruppen: Ergebnisse und zufällige Ereignisse.

Stellen Sie sich vor, Sie betrachten die erste Karte ihrer vier Karten und es ist eine As. Stellen

sie sich folgende Ergebnisse vor:

• die erste Karte ist eine As

• die erste Karte ist weniger wert als die Sieben

Sie werden sicherlich bemerken, dass zwischen diesen zwei möglichen Ereignissen ein gravierender

Unterschied besteht. Im ersten Fall legen wir eine bestimmte Karte fest, während wir im zweiten

Fall nur einschränken, d.h. die Karte könnte eine As, eine Vier, eine Fünf oder eine Sechs sein.

Der zweite Fall (eine Karte weniger wert als Sieben zu ziehen) beschreibt also einen Versuch bei

dem mehrere zufällige Ereignisse möglich sind.

Zusammenfassend lässt sich aussagen, dass im ersten Fall ein einziges Ergebnis auftritt, während

im zweiten Fall ein zufälliges Ereignis beschrieben wird. Im ersten Fall sprechen wir von einen

Ergebnis und im zweiten Fall von einem zufälligen Ereignis.

Definition 1.4.2 Wir sagen, dass das Ergebnis eines zufälligen Ereignisses ein Ergebnis ist, wenn

es aus nur einem einzigen Element des Ereignisfeldes besteht. Ansonsten bezeichnen wir dies als

ein zufälliges Ereignis.

Beispiel 1.4.1 Überlegen Sie sich folgendes zufällige Experiment: Nehmen Sie von einem Kartenstapel zufällig eine Karte heraus. Das Ereignisfeld ist wie folgt: ”Karo As”, ”Karo Zweier”,..., ”Herz

König”

Das Ziehen des Herz Königs ist ein Ergebnis. Aber wenn wir nun das Ziehen des Königs betrachten, dann ist dies ein zufälliges Ereignis, weil es vier Möglichkeiten gibt: Ziehen des ”Herz Königs”,

”Ziehen des Karo Königs”, ”Ziehen des Schell Königs” und ”Ziehen des Pik Königs”.

1.4.2

Konsistente und inkonsistente Ereignisse

Lassen Sie uns zurückkehren zu unserem Kartenspiel. Jeder Spieler bekommt wiederum vier

Karten. Wir wollen nun zwei zufällige Ereignisse betrachten:

• Ereignis A=”Zwei von den vier Karten sind Könige”

• Ereignis B=”Zwei von den vier Karten sind Asse”

Ist es möglich, dass das Ereignis A und das Ereignis B zugleich eintreten? Ist es also möglich

zwei Könige und gleichzeitig zwei Asse zu ziehen? Ja es ist möglich ein Doppel von Königen und

Assen zu ziehen.

Da nun das Ereignis A und das Ereignis B zur gleichen Zeit auftreten können bezeichnen wir

sie als konsistente Ereignisse. Jedoch ist die Situation nicht immer so klar. Es gibt einen Anzahl an

Ereignissen, die niemals gleichzeitig auftreten können. Stellen Sie sich folgende zwei Ereignisse vor:

6

• Ereignis C = ”Drei von vier Karten sind Könige”

• Ereignis D = ”Zwei von vier Karten sind Asse”

Und wir fragen uns wiederum: Ist es möglich, dass das Ereignis C und das Ereignis D gleichzeitig

eintreten können? Ist es also möglich drei Könige und zwei Asse zu ziehen? Es ist unmöglich, da

wir ja nur vier Karten ziehen!

Das Ereignis C und das Ereignis D können also nicht im selben zufälligen Experiment vorkommen. Wir bezeichnen sie als inkonzistente Ereignisse.

Übung 1.4.2 Finden Sie ein Paar von konsistenten und ein Paar von inkonsistenten Ereignissen;

diese müssen von den gegebenen Beispielen unterschiedlich sein, sollen aber demselben zufälligen

Ereignis angehören.

Definition 1.4.3 Haben wir zwei zufällige Ereignisse in einem zufälligen Experiment, dann bezeichnen wir sie als konstistent, wenn sie gleichzeitig vorkommen können und als inkonsistent wenn

sie niemals zur gleichen Zeit eintreten können.

1.4.3

Das sichere Ereignis

Wir nehmen nun unseren Kartenstapel und teilen ihn in zwei Teile. In dem einen Teil befinden

sich die Asse (acht Karten) und im anderen Teil die restlichen 32 Karten. Wir betrachten nun den

Teil mit den Assen und ziehen willkürlich eine Karte. Können wir wissen welche Karte es sein wird?

Ja wir können. Wir können annehmen, dass die Karte eine As ist. Dises Beispiel beschreibt ein

sicheres Ereignis, ein Ereignis, dass mit Sicherheit eintritt.

Übung 1.4.3 Finden Sie nun in dem ”Mus” Spiel ein sicheres Ereignis mit ihren vier Karten.

Definition 1.4.4 Ein sicheres Ereignis ist ein zufälliges Ereignis eines zufälligen Experiments, das

immer eintritt.

Jedes Ereignisfeld besteht aus dem sicheren Ereignis.

1.4.4

Das unmögliche Ereignis

Jedoch können wir in demselben zufälligen Ereignis sicher sein, dass wir keine Sechs ziehen

werden, weil der Kartenstapel ja nur aus Assen besteht. Das zufällige Ereignis eine Sechs zu ziehen

ist daher ein unmögliches Ereignis.

Übung 1.4.4 Beschreiben Sie nun ein unmögliches Ereignis basierend auf dem ”Mus” Spiel, mit

vier Karten.

Definition 1.4.5 Wir sagen, ein zufälliges Ereignis ist ein unmögliches Ereignis, wenn es niemals

vorkommt.

7

1.4.5

Das Komplement eines Ereignisses

Nehmen wir wieder an, die Karten werden in zwei Stapel geteilt: im ersten Stapel befinden sich

alle Könige und alle Asse (16 Karten) und im zweiten der Rest der Karten (24 Karten). Wir ziehen

nun eine Karte vom ersten Stapel. Betrachten wir die Ereignisse:

• A=”Die gezogene Karte ist eine As”

• B=”Die gezogene Karte ist ein König”

Die spezielle Eigenschaft dieser Ereignisse ist, dass das Ereignis A niemals eintreten kann wenn

das Ereignis B eintritt, und umgekehrt kann auch das Ereignis B nicht eintreten wenn bereits A

vorkommt. Eines der beiden Ereignisse kommt immer vor. Beide sind inkonsistente Ereignisse, d.h.

sie können niemals gleichzeitig eintreten.

Das eine Ereignis ist jeweils das Komplement des anderen Ereignisses.

Übung 1.4.5 Beschreiben Sie komlementäre Ereignisse nachdem Sie willkürlich eine Karte des

”Mus” Spiels ziehen.

Definition 1.4.6 Zwei Ereignisse werden als Komplement bezeichnet, wenn sie inkonsistent sind

(Sie können niemals gleichzeitig eintreten) und eines immer vorkommt. Wenn wir das Ereignis mit

A bezeichnen dann wird das Komplement mit A oder Ac bezeichnet.

1.5

Operationen an zufälligen Ereignissen

Auf die selbe Weise wie wir mit Zahlen operieren (addieren, subtrahieren, multiplizieren,...) so

operieren wir auch mit zufälligen Ereignissen. Die Operationen unterscheiden sich dadurch, dass

bei zufälligen Ereignissen von Vereinigung, Durchschnitt und Differenz gesprochen wird.

1.5.1

Vereinigung: ein Ereignis oder das andere

Wir wollen nun wieder an das ”Mus” Speil denken, wo jeder Spieler 4 Karten bekommt. Das

zufällige Ereignis ist also das willkürliche Ziehen von vier Karten aus dem Kartenstapel. Lassen Sie

uns zwei mögliche Ereignisse dieses zufälligen Ereignisses beschreiben:

• A=”Besitzen von zwei Königen”

• B=”Besitzen einer As”

Nehmen wir nun an, dass unsere Karten (As, Bube, Sieben, Sieben) sind. Ist nun das Ereignis

A eingetreten? Nein, denn wir haben nicht zwei Könige unter unseren vier Karten. Ist das Ereignis

B eingetreten? Ja, denn wir haben eine As unter unseren vier Karten. In diesem Fall sagen wir,

dass das Ereignis A oder das Ereignis B eintritt und schreiben A ∪ B.

Haben wir nun zwei zufällige Ereignisse und eines der beiden oder sogar beide treten ein dann

sprechen wir vonA ∪ B.

8

Übung 1.5.1 Wiederum haben wir das Mus Spiel im Hinterkopf und spielen mit vier Karten.

Stellen sie sich folgende Ereignisse vor:

A=”Wir ziehen drei Könige”

B=”Wir ziehen drei Asse”

Beschreiben Sie nun ausgehend von dieser Angabe das Ereignis A ∪ B.

Definition 1.5.1 Gegeben sei ein Ereignis A und ein Ereignis B. Wir definieren das Ereignis A

oder B( und schreiben dafür A ∪ B) so, dass ein Ereignis der beiden oder sogar beide eintreten.

Bemerkung: Sind beide Ereignisse gegeben, dann ist auch A ∪ B gegeben.

1.5.2

Durschnitt von Ereignissen: ein Ereignis und ein anderes

Lassen Sie uns nun zwei neue zufällige Ereignisse betrachten, indem wir wieder vier Karten des

”Mus” Spielstaplels ziehen.

• A=”Ziehen von zwei Assen”

• B=”Ziehen von einer Sieben”

Stellen Sie sich vor wir erhalten folgende vier Karten: (As, König, Sieben, As). Ist nun das Ereignis

A eingetreten? Ja, denn wir haben zwei Asse unter unseren Karten. Wie sieht es mit dem Ereignis

B aus? Dieses ist auch eingetreten, da unsere dritte Karte eine Sieben ist. Beide Ereignisse A und

B sind eingetreten. Wir bezeichnen diese Ereignis mit A ∩ B.

Übung 1.5.2 Denken Sie über folgende zufällige Ereignisse, nach dem Ziehen von vier Karten,

nach:

• A=”Ziehen von zwei Königen”

• B=”Ziehen von zwei Assen”

Beschreiben Sie nun ein Ereignis in welchem das Ereignis A ∩ B eintritt und ein anderes Ereignis

in welchem A ∩ B eintritt.

Definition 1.5.2 Gegeben sei ein Ereignis A und ein Ereignis B. Das Ereignis A UND B ist

definiert als ein zufälliges Ereignis, in welchem sowohl A als auch B eintritt. Wir schreiben A ∩ B.

Beachten Sie: wenn der Durchschnitt zweier zufälliger Ereignisse das unmögliche Ereignis (∅)ist

dann sind die Ereignisse inkonstistent (siehe Definition der inkonstistenten Ereignisse). Wenn der

Durchschnitt nicht das unmögliche Ereignis ist, dann sind die beiden Ereignisse konstistent.

1.5.3

Differenz von Ereignissen

Wieder betrachten wir zwei neue Ereignisse:

• A= ”Ziehen von drei Buben”

• B= ”Ziehen eines Königs”

9

Nach dem Austeilen der Karten haben wir (Bube, As, Bube, Bube).

Ist das Ereignis A eingetreten? Natürlich, wir haben ja drei Buben unter unseren vier Karten.

Ist das Ereignis B auch eingetreten? Nein, denn in keiner unserer vier Karten läßt sich ein König

finden. Wir sagen nun, dass das Ereignis A minus B eingetreten ist und schreiben A \ B.

Immer wenn also ein Ereignis eintritt und ein anderes nicht dann sprechen wir von der Differenz

von zwei Ereignissen.

Übung 1.5.3 Sehen wir uns nun folgendes Experiment genauer an:

A= ”Wir habe zwei Asse”

B= ”Wir haben zwei Buben”

Versuchen Sie nun ein passendes Ereignis A \ B und ein passendes Ereignis B \ A zu beschreiben.

Definition 1.5.3 Gegeben sei ein Ereignis A und ein Ereignis B. Das Ereignis A \ B ist definiert

als das Eintreten des Ereignisses A und das Nicht- Eintreten des Ereignisses B.

1.5.4

Eigenschaften der Operationen mit Ereignissen

Die folgenden Eigenschaften sind von Bedeutung. Zuvor definieren wir das sichere Ereignis mit

E und das unmögliche Ereignis mit ∅. Das Ereignis A, B und C sind beliebige zufällige Ereignisse,

Teilmengen des Ereignisfeldes und Ac bezeichnet das Komplement des Ereignisses A.

Vereinigung:

A ∪ B = B ∪ A, A ∪ E = E, A ∪ ∅ = A, A ∪ Ac = E

Durchschnitt:

A ∩ B = B ∩ A,

A ∩ E = A,

A ∩ ∅ = ∅,

A ∩ Ac = ∅

Differenz:

A \ B = A ∩ Bc

De Morgan’sche Regel:

(A ∪ B)c = Ac ∩ B c ,

(A ∩ B)c = Ac ∪ B c

Zusätzliche Eigenschaften:

A ∪ (B ∩ C) = (A ∪ B) ∩ (A ∪ C),

A ∩ (B ∪ C) = (A ∩ B) ∪ (A ∩ C)

10

Kapitel 2

Wahrscheinlichkeit

2.1

Einleitung

Im vorigen Kapitel haben wir das zufällige Ereignis genauer betrachtet und sind zum Schluss

gekommen, dass wir hierbei keine Sicherheit über ein Ergebnis erhalten. In anderen Worten haben wir es mit einer Unsicherheit zu tun, die wir messen werden. Diese Zahl werden wir dann

Wahrscheinlichkeit benennen.

Nehmen wir zum Beispiel zufällig eine Karte vom Kartenstapel. Wir können im Voraus nicht

vorhersagen welche Karte es sein wird. Jedoch wissen wir, dass im Stapel mehr Asse als Siebener

sind und so wäre es naheliegend zu denken, dass die Wahrscheinlichkeit höher ist eine As als einen

Siebener zu ziehen. So hat die As eine höhere Wahrscheinlichkeit gezogen zu werden als die Sieben.

In diesem Kapitl möchten wir uns näher mit den verschiedenen Techniken der Häufigkeit des

Auftretens eines Ereignisses beschäftigen.

Übung 2.1.1 Schreiben Sie zwei Ereignisse, basierend auf den ”Mus” Spiel, zusammen von welchen

Sie denken, dass sie unterschiedlich oft eintreten (verschiedene Wahrscheinlichkeiten haben) und

erklären Sie warum.

2.1.1

Definition der Wahrscheinlichkeit über relative Häufigkeiten: empirische Wahrscheinlichkeit

Im obigen Teil definierten wir die Wahrscheinlichkeit als eine Zahl, die wir jedem Ereignis zuordnen. Mit dieser Zahl wollen wir auch die Häufigkeit des Eintretens eines zufälligen Ereignisses

beschreiben.

Ein direkter Weg die Wahrscheinlichkeit eines zufälligen Ereignisses zu bestimmen ist es eine Tabelle, in der die relativen Häufigkeiten des Ereignisses zu finden sind, anzusehen. Die Wahrscheinlichkeit

wird als empirische Wahrscheinlichkeit bezeichnet da sie nach dem Experiment erst aufgestellt werden kann. Wenn also ein Experiment n mal durchgeführt wurde und wir sehen, dass in k Fällen das

Ereignis eingetreten ist, dann bezeichnen wir dies mit A. Die Wahrscheinlichkeit des Auftretens des

11

Ereignisses A ist also

k

n,

und wir schreiben dafür P (A). D.h. also:

k

n

Beispiel 2.1.1 Nehmen wir an wir ziehen wiederum Karten vom Kartenstapel, eine nach der anderen. Nachdem wir die Karte gesehen haben legen wir sie wieder zurück bevor wir die nächste

ziehen. Schlussendlich erhalten wir folgende Häufigkeitstabelle:

P (A) =

Karte

As

Vier

Fünf

Sechs

Sieben

Bube

Dame

König

Relative Häufigkeit

38

200

17

200

21

200

24

200

21

200

23

200

18

200

38

200

Von dieser Tabelle können wir folgende Wahrscheinlichkeiten anlesen:

38

P(”Die Karte ist eine As”)= 200

= 00 19

17

P(”Die Karte ist eine Vier”)= 200 = 00 085

21

P(”Die Karte ist eine Fünf”)= 200

= 00 105

24

P(”Die Karte ist eine Sechs”)= 200 = 00 12

21 0

P(”Die Karte ist eine Sieben”)= 200

0 105

23

P(”Die Karte ist ein Bube”)= 200 = 00 115

18

P(”Die Karte ist eine Dame”)= 200

= 00 09

38

P(”Die Karte ist ein König”)= 200 = 00 19

Nehmen Sie an wir machen dies 1000 mal, dann erhalten wir folgende relative Häufigkeiten:

Karte Relative Häufigkeit

192

As

1000

111

Vier

1000

109

Fünf

1000

85

Sechs

200

87

Sieben

1000

116

Bube

1000

91

Dame

1000

209

König

1000

Ausgehend von dieser Tabelle können wir auf folgende neue Wahrscheinlichkeiten schließen:

192

P(”Die Karte ist eine As”)= 1000

= 00 192

111

P(”Die Karte ist eine Vier”)= 1000 = 00 111

109

= 00 109

P(”Die Karte ist eine Fünf”)= 1000

85

P(”Die Karte ist eine Sechs”)= 1000 = 00 085

87

P(”Die Karte ist eine Sieben”)= 1000

= 00 087

116

P(”Die Karte ist ein Bube”)= 1000 = 00 116

91

P(”Die Karte ist eine Dame”)= 1000

= 00 091

209

P(”Die Karte ist ein König”)= 1000 = 00 209

12

Wenn wir verstanden haben, dass die Wahrscheinlichkeit einen Zahl ist, die jedem zufälligen

Ereignis zugeschrieben wird, dann können wir sagen, dass das Ereignis ”die gezogene Karte ist

ein König” häufiger auftritt, bzw. eine höhere Wahrscheinlichkeit ausweist, als das Ereignis ”die

gezogene Karte ist eine Sieben”, da ja P(König) > P(Sieben).

Das Ereignis ”die gezogene Karte ist ein Bube” ist wahrscheinlicher als das Ereignis ”die gezogene Karte ist eine Dame ”,...

Bemerkung 2.1.1 Diese Möglichkeit der Wahrscheinlichkeitsbestimmung basiert auf dem Gesetz

der großen Zahlen für relative Häufigkeiten. Jedem Ereignis wird eine Zahl zugeordnet (die Wahrscheinlichkeit) sodass bei mehrfachen Wiederholen des zufälligen Experiments die relativen Häufigkeiten

des Ereignisses immer besser mit der Wahrscheinlichkeit des Ereignisses übereinstimmen. Je mehr

zufällige Experimente durchgeführt werden, desto besser stimmt die relative Häufigkeit mit der speziellen Zahl (Wahrscheinlichkeit) überein.

Nehmen wir etwa 100 Karten wie im vorigen Beispiel, dann ist die Zuverlässlichkeit der Wahrscheinlichkeit nicht so hoch als wie wenn man 200 Karten gezogen hätte. Und zieht man 10000 Karten

anstatt 1000 Karten, dann ist die Wahrscheinlichkeit näher an der wirklichen Wahrscheinlichkeit

als bei 1000 Karten.

In jedem Fall ist die Tabelle die man nach 1000 Durchführungen des Experiments erhält verlässlicher

als jene nach 200 Durchführungen.

Übung 2.1.2 Führen Sie folgendes Experiment durch: Teilen sie 20 mal die Karten des ”Mus”

Spiels aus und nehmen Sie vier Karten ohne sie zuzückzulegen und notieren sie sich ob in jeder

Austeilung: ein Paar, ein Trio, ein Doppel oder nichts davon aufgetreten ist.

Machen Sie nun eine Tabelle wo Sie die relative Häufigkeiten des Experiments eintragen und

bestimmen Sie dann die Wahrscheinlichkeit der zufälligen Ereignisse (Paar, Trio, Doppel, nichts).

Denken Sie, dass diese Wahrscheinlichkeiten zuverlässig sind? Warum?

Der nächste Abschnitt beschäftigt sich mit einem anderen Zugang zur Wahrscheinlichkeit. Hier

müssen wir nicht ein Experiment durchführen um auf die Wahrscheinlichkeiten zu kommen deshalb

ist dieser Zugang oft einfacher als jener den wir zuvor besprochen haben (relative Häufigkeiten).

2.1.2

Laplace’sche Regel: theoretische Wahrscheinlichkeit

Wie Sie gesehen haben ist die Wahrscheinlichkeit, über die relativen Häufigkeit definiert, oft zu

langwierig. Ein Experiment muss öfters wiederholt werden um ein vernünfiges Ergebnis zu erzielen.

Und selbst dann können wir nicht sicher sein die genaue Wahrscheinlichkeit zu erhalten.

Aus diesem Grund ist es nötig eine alternative, besser anwendbare Methode zur Berechnung der

Wahrscheinlichkeit einzuführen.

Stellen wir uns folgendes Beispiel vor: Wir haben den Stapel mit Karten des ”Mus” Spiels vor

uns liegen und ziehen nun eine Karte. Wir wollen nun die verschiedenen Wahrscheinlichkeiten aller

möglichen Ereignisse wissen.

Nun gut, logisch denken wir, dass der Kartenstapel ordentlich zusammengestellt ist und dass

wir eine Karte mit der selben Wahrscheinlichkeit ziehen wie alle anderen Karten. Es sind also keine

Karten fehlerhaft und so können wir irgendeine von den 40 Karten mit gleicher Wahrscheinlichkeit

13

ziehen. In diesem Fall sagen wir die Karten sind gleichwahrscheinlich. Ein anderes gleichwahrscheinliches Ergebnis wäre eine gewürfelte Nummer d.h. die Eins, Zwei,..., Sechs werden mit gleicher

Wahrscheinlichkeit gewürfelt. Ein anderes Beispiel ist das Münzenwerfen: Hier haben wir auch mit

gleicher Wahrscheinlichkeit entweder Kopf oder Zahl, natürlich unter der Voraussetzung dass die

Münze bzw. der Würfel nicht präpariert sind.

Kehren wir nun zu unserem Ausgangsbeispiel dem ”Mus” Spiel zurück. Wir haben 40 Karten,

alle mit gleichem Gewicht, Form,... Unter den 40 Karten befinden sich 8 Asse und so schließen wir

daraus, dass 40 Durchgängen die As 8 mal gezogen wurde. Dies ist jedoch sehr theoretisch und Sie

werden bemerken, dass Sie nicht immer 8 Asse nach 40 Durchgängen erhalten (Sie können auch

3 oder 12 Asse ziehen, je nach Zufall). Die Tatsache aber, dass sich 8 Asse in dem Kartenstapel

befinden gibt uns eine Idee, wie wahrscheinlich es sein kann eine As zu ziehen.

8

. Dies ist eine theoretische WahrWir sagen die Wahrscheinlichkeit eine As zu ziehen ist 40

scheinlichkeit und wir müssen die Durchgänge wiederholen. In der Praxis erhalten wir natürlich

nicht immer 8 Asse nach 40 Durchgängen. In diesem Fall, da wir gesamt 40 Karten haben kommen

wir zu dem Schluss, dass hier 40 mögliche Ergebnisse auftreten können (wir können 40 verschiedene

Karten vom Kartenstapel ziehen) und 8 Ergebnisse die wir anaysieren können, z.B. das Ziehen einer

As, da sie 8 Möglichkeiten hat aufzutreten.

Da wir nun die Konzepte eingeführt haben können wir zur Laplace’schen Definition der Berechnung der Wahrscheinlichkeit übergehen:

Definition 2.1.1 Wenn alle Ergebnisse eines zufälligen Experiments gleich wahrscheinlich sind

dann beschäftigen wir uns mit dem zufälligen Ereignis dieses zufälligen Experiments genannt A. Es

gilt:

Anzahl der Ergebnisse in A

P (A) =

Anzahl aller Ergebnisse

Die Anzahl der Ereignisse in A ist die Wahrscheinlichkeit des Auftretens des Ereignisses A.

Diese Definition war die erste formale Definition in der Geschichte und geht zurück auf Pierre

Simon de Laplace am Beginn des 19. Jahrhunderts.

Nach dieser Erklärung können Sie folgende Übung bewältigen:

Übung 2.1.3 Berechnen Sie, unter Verwendung der Laplace’ schen Regel, die Wahrscheinlichkeit

des Erhaltens jeder Karte nach zufälligem Ziehen einer Karte vom ”Mus” Spielkartenstapel.

2.2

Ziehen mit Zurücklegen und Ziehen ohne Zurücklegen.

Baum Diagramme

In diesem Abschnitt möchten wir gerne einige neue und kompliziertere zufällige Experimente

einführen. Anstatt immer nur eine Karte nach der anderen zu ziehen, ziehen wir nun mehrere

Karten. Nach Studieren dieses Unterkapitels werden Sie im Stande sein alle verschiedenen Schritte

im ”Mus” Spiel zu analysieren.

14

2.2.1

Ziehen mit Zurücklegen

Lassen Sie uns mit einer einfachen Situation beginnen. Wir ziehen zwei Karten vom ”Mus” Spiel

Kartenstapel, eine nach der anderen und mit Zurücklegen der Karte nachdem wir sie angesehen

haben. Dieser Vorgang wird als SZiehen mit Zurücklegen”bezeichnet.

Bezeichnen wir A1 mit dem Ereignis ”Die erste Karte ist ein König” und A2 mit dem Ereignis

”Die zweite Karte ist ein Bube”. Wir können uns nun fragen wie hoch die Wahrscheinlichkeit des

Eintretens beider Ereignisse zur selben Zeit ist; also die erste gezogene Karte ist ein König und die

zweite gezogene Karte ist ein Bube.

Um die Wahrscheinlichkeit des Ereignisses zu berechnen skizzieren wir folgendes Diagramm,

welches als Baum Diagramm bezeichnet wird:

Die Wahrscheinlichkeit, dass die erste Karte ein König und die zweite Karte ein Bube ist setzt

sich zusammen als Multiplikation des Pfades welcher zum gewünschten Ergebnis führt (Produktre8

4

1

gel): 40

= 50

· 40

Wenn wir uns nur für beide Karten (König und Bube) interessieren und uns die Reihenfolge

ihres Auftretens egal ist, dann haben wir entweder (König, Bube) oder (Bube, König).

Sei B1 das Ereignis ”Die erste Karte ist ein Bube” und B2 das Ereignis ”Die zweite Karte ist

ein König”. Für das Eintreten der Kombination (Bube, König) ist das Ereignis B1 ∩ B2 nötig.

Aus demselben Grund wie vorhin, unter Verwendung eines ähnlichen Baumdiagramms, erhalten

4

8

1

· 40

= 50

.

wir als Wahrscheinlichkeit für das Ziehen von (Bube, König) 40

Um nun die Wahrscheinlichkeit für das Erhalten von Bube und König, ohne Rücksicht auf

die Reihenfolge, zu berechnen müssen wir die Wahrscheinlichkeiten von vorhin addieren: ”(König,

1

1

1

+ 50

= 25

.

Bube) + (Bube, König )” (Additionsregel) Und wir erhalten 50

Übung 2.2.1 In dem zufälligen Experiment von vorhin berechnen Sie nun die Wahrscheinlichkeit,

dass beide Karten Asse sind. Zeichnen Sie auch ein passendes Baum Diagramm.

Im folgenden Abschnitt befassen wir uns nun mit dem Fall, dass die Karten nach dem Ziehen

und Ansehen nicht zurückgelegt werden.

15

2.2.2

Ziehen ohne Zurücklegen

In dem zufälligen Experiment von vorhin haben wir die Karten nach dem Ansehen wieder

zurückgelegt. Was passiert wenn wir die Karten nicht zurücklegen? Nun gut, die Sache ändert

sich, aber die Begründung ist ähnlich. Das einzige was sich ändert ist die zweite Wahrscheinlichkeit,

jene Wahrscheinlickeit beim zweiten Ziehen. Dies ist logisch den die Ausgangssituation ist in beiden

Fällen die gleiche. Am Anfang ziehen wir immer aus 40 Karten. Beim zweiten Ziehen stehen uns in

diesem Fall aber nur mehr 39 Karten zur Verfügung, da die erst Karte ja nicht zurückgelegt wird.

Wenn wir wie oben zuerst einen König und dann einen Buben ziehen möchten dann ist das

Baum Diagramm dasselbe. Die Wahrscheinlichkeit der zweiten Ziehung ändert sich jedoch.

Lassen Sie uns nun auch für diesen Fall die Wahrscheinlichkeit einen König und einen Buben

zu ziehen berechnen unter der Voraussetzung, dass wir die Karten nicht wieder zurücklegen. Dieses

Vorgehen wird als Ziehen ohne zurücklegen bezeichnet. Das Baum Diagramm dieses Experiments

sieht ähnlich aus wie das vorige:

8

4

In diesem Fall haben wir die Wahrscheinlichkeit des Ziehens von (König, Bube) 40

· 39

.

4

Beachten Sie, dass in diesem Fall der zweite Faktor 39 lautet, da wir beim zweiten Mal ja nur

mehr 39 Karten zur Verfügung in denen 4 Buben zu finden sind.

Auf einen vergleichbare Weise können wir auch die Wahrscheinlichkeit der Kombination (Bube,

4

8

König) berechnen. Sie ist: 40

· 39

.

Und wiederum müssen wir nur die einzelen Wahrscheinlichkeiten miteinander addieren (Additionsregel) wenn wir die Wahrscheinlichkeit des Ziehens eines Königs und eines Bubens, ohne

4

8

4

8

4

8

Rücksicht auf die Reihenfolge, berechnen möchten. Wir erhalten: 40

· 39

+ 40

· 39

= 2 40

· 39

Übung 2.2.2 Bearbeiten Sie dieselbe Übung wie zuvor nur unter der Voraussetzung dass ein SZiehen ohne zurücklegen”vorliegt.

2.3

Axiomatische Definition der Wahrscheinlichkeit

Wir wollen nun eine abstraktere Definition der Wahrscheinlichkeit einführen. Die folgenden

Grundprinzipien nehmen wir als wahr an und nennen sie Axiome. Die Axiome lauten:

16

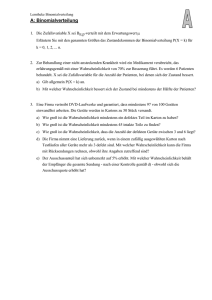

1. Für jedes Ereignis A ist dessen Wahrscheinlichkeit eine Zahl zwischen 0 und 1. Es gilt:

0 ≤ P (A) ≤ 1

2. P (E) = 1, wobei E das sichere Ereignis bezeichnet.

3. Sind A und B zwei inkonsistente Ereignisse dann gilt:

P (A ∪ B) = P (A) + P (B)

Von diesen Axiomen ausgehend können wir eine beträchtliche Anzahl an Eigenschaften der

Wahrscheinlichkeit ableiten:

1. Bezeichnen wir Ac als Komplement des Ereignisses A, dann gilt:

P (Ac ) = 1 − P (A)

Übung 2.3.1 Beweisen Sie diese Eigenschaft mit Hilfe der Axiome.

2. Haben wir eine Reihe von Ereignissen A1 , A2 , ..., An , und sind diese paarweise inkonsistent

(Ai ∩ Aj = ∅ ∀i 6= j), dann gilt:

P(

n

[

Ai ) =

i=1

n

X

P (Ai )

i=1

Sn

Als Spezialfall betrachten wir den Fall wenn die Reihe der Ereignisse A1 , A2 , ..., An i=1 Ai =

E erfüllt, wobei E das sichere Ereignis ist. In diesem Fall sagen wir, dass die Reihe

Pnder Ereignisse A1 , A2 , ..., An eine vollständige Reihe von Ereignissen darstellt, und es gilt: i=1 P (Ai ) = 1

3. Kann das Ereignisfeld in n Ergebnisse oder einzelne Ereignisse zerfallen, E = {x1 , ..., xn },

dann gilt:

P (x1 ) + P (x2 ) + ... + P (xn ) =

n

X

P (xi ) = 1

i=1

Spezialfall: Ist die Wahrscheinlichkeit in jedem einzelen Ereignis oder Ergebnis dasselbe,

P (xi ) = 1/n, und das Ereignis A besteht aus k Ergebnissen, dann gilt: P (A) = k/n, welches die Laplace’sche Regel darstellt.

4. Sind A und B zwei zufällige Ereignisse dann gilt:

P (A ∪ B) = P (A) + P (B) − P (A ∩ B)

Diese Eigenschaft trifft auch im Falle von drei Ereignissen zu, und wir erhalten:

P (A ∪ B ∪ C) = P (A) + P (B) + P (C) − P (A ∩ B) − P (A ∩ C) − P (B ∩ C) + P (A ∩ B ∩ C)

17

Beispiel 2.3.1 Gehen Sie von folgenden Experiment aus: Wir ziehen vier Karten vom ”Mus”

Kartenstapel ohne diese wieder zurückzulegen. Zusätzlich notieren wir uns ob die gezogene Karte

eine höhere Karte (Bube, Dame, König) ist oder nicht. Am Ende zählen wir die aufgetretenen

höheren Karten zusammen.

Denken Sie sich folgendes Ereignisfeld die Anzahl der höheren Karten, die wir gezogen haben

(0,1,2,3 ó 4).

a)Beschreiben Sie das Ergebnis und berechnen Sie deren Wahrscheinlichkeiten.

Die Ergebnisse lauten

Ai = ”wir haben i ... Karten, i = 0, 1, 2, 3, 4”

Da ja 16 höhere Karten im gesamten Kartenstapel existieren, wenden wir nun die Laplas’sche

Regel an. Die Wahrscheinlichkeit zufällig eine Karte vom ”Mus” Spielkartenstapel zu ziehen ist

2

24

3

16

40 = 5 und die Wahrscheinlichkeit dass die Karte keine höhere Karte ist 40 = 5 . Von diesen

Berechnungen und der vorigen Erklärungen sehen wir, dass die Wahrscheinlichkeit dieser Ereignisse

folgend berechnet wird:

3

2 3

2 3

2 3

2

P (A0 ) = ( )4 , P (A1 ) = 4 ( )3 , P (A2 ) = 6( )2 ( )2 , P (A3 ) = 4( )3 , P (A4 ) = ( )4

5

5 5

5 5

5 5

5

b)Wenn B = ”Wir haben eine höhere Karte gezogen ”, berechnen Sie P (B).

Es gilt dass B = Ac0 ,also, P (B) = P (Ac0 ) = 1 − P (A0 ) = 1 − ( 53 )4 =

c) C = ”Wir haben drei oder mehr höhere Karten gezogen ”

C = A3 ∪ A4 , also A3 ∩ A4 = ∅. Es gilt P (C) = P (A3 ∪ A4 ) = P (A3 ) + P (A4 ) = 4( 25 )3 35 + ( 25 )4 =

2.4

2.4.1

Berechnung der Wahrscheinlichkeit in komplexeren Fällen

Die bedingte Wahrscheinlichkeit

Wir teilen die Karten erneut. Es wird eine nach der anderen Karte ausgeteilt und wir erhalten

unsere Karten nach der 4. Runde, der letzten Runde. Der erste Spieler hat einen König, der zweite

Spieler hat eine As und der dritte Spieler hat einen Buben bekommen. Wie hoch ist die Wahrscheinlichkeit, dass wir eine As erhalten? Wenden wir die Laplac’sche Regel an dann beträgt die

7

, da ja bereits drei Karten ausgeteilt wurden und 37 Karten

Wahrscheinlichkeit eine As zu haben 37

übrigbleiben und eine As ist bereits an den zweiten Spieler gegangen. Folglich befinden sich noch 7

Asse im Kartenstapel. Stellen Sie sich nun vor kein Spieler hätte eine As erhalten. Was hoch wäre

dann die Wahrscheinlichkeit? In diesem Fall wären 8 Asse im Kartenstapel, folglich wäre die Wahr8

scheinlichkeit: 37

. Stellen Sie sich diesmal vor zwei Spieler hätten eine As bekommen. Wie hoch ist

6

in diesem Fall die Wahrscheinlichkeit eine As zu erhalten? Sie wäre 37

. Wie Sie sehen ändert sich

der Wert der Wahrscheinlichkeit eine As zu erhalten ständig und hängt auch von den Karten, die

unsere Rivalen erhalten haben ab. Also hängt die Wahrscheinlichkeit eines Ereignises auch davon

ab wieviel Infomationen wir vor dem Experiment erhalten. In diesem Fall ist die Information, die

wir zuvor erhalten, die Spielkarten unserer Gegner, d.h. wir wissen welche Karten nicht im Stapel

sein werden wenn wir an der Reihe sind.

In diesen Fällen ist es sehr einfach die Wahrscheinlichkeiten zu berechnen. Jedoch benötigen wir

für schwierigere Fälle eine Formel zur Berechnung der Wahrscheinlichkeiten.

Lassen Sie uns nun zum vorhin erklärten Beispiel zurückkehren. Bezeichnen wir das Ereignis

A mit ”Meine Karte ist eine As” A und das Ereignis B mit ”Die ersten drei Spieler haben: einen

18

König, eine As bzw. einen Buben erhalten”, dann müssen wir P (A) berechnen, wobei wir die

Karten der anderen Spieler wissen, d.h. wir wissen, dass das Ereignis B eingetreten ist. Wir wollen

die Wahrscheinlichkeit des Ereignisses A unter Voraussetzung des Ereignisses B berechnen und

schreiben A/B. Für die Berechnung wenden wir die Formel für die bedingte Wahrscheinlichkeit an,

die lautet:

P (A/B) =

P (A ∩ B)

P (B)

Wir müssen also P (A ∩ B) und P (B) berechnen. Zur Berechnung von P (B) wenden wir das

bereits kennengelernte Konzept ”Ziehen ohne zurücklegen” an und erhalten:

P (B) =

8 8 4

·

·

40 39 38

während es für das Eintreten von A ∩ B nötig ist dass die vier Spieler einen König, eine As, einen

Buben und eine As erhalten. Die Wahrscheinlichkeit von A ∩ B ist

P (A ∩ B) =

8 8 4 7

·

·

·

40 39 38 37

Nun wenden wir die Formel der bedingten Wahrscheinlichkeit an:

P (A/B) =

P (A ∩ B)

=

P (B)

8

40

·

8

40

8

39

·

·

8

39

4

38

·

·

4

38

7

37

=

7

37

In diesem Fall hätten wir auch ohne bedingte Wahrscheinlichkeit auskommen können, aber in

anderen Fällen ist sie unumgänglich.

Definition 2.4.1 Wir schreiben das Eintreten des Ereignisses A unter der Bedingung von B als

A/B. Es gilt:

P (A ∩ B)

P (A/B) =

P (B)

2.4.2

Unabhängigkeit von zufälligen Ereignissen

Lassen Sie uns nochmals die Erklärungen von vorhin und das Beispiel im Unterkapitel über die

Baum Diagramme betrachten.

Wenn Sie sich erinnern haben wir einige Operationen durchführen müssen um die Wahrscheinlichkeit zu berechnen, nur es handelte sich eher um einen einfachen Fall. Überlegen Sie sich anstelle

der zwei möglichen Ergebnisse (König oder nicht König im ersten Durchgang und Bube oder nicht

Bube im zweiten Durchgang) drei Ergebnisse. Es wären dann neun Wahrscheinlichkeiten im Gesamten, wenn wir vier mögliche Ergebnisse nach jedem Durchgang hätten dann hätten wir 16

Wahrscheinlichkeiten nach dem zweiten Durchgang. Allgemein: Wenn wir n Ergebnisse in jedem

Durchgang haben dann haben wir nach zwei Durchgängen n2 Fälle zu untersuchen. Das ist sehr

viel. Und das nur bei zwei Durchgängen. Wenn die Anzahl der Durchgänge 3 beträgt dann hätten

wir n3 mögliche Ergebnisse. Bei 4 hätten wir n4 ,... Die Baum Diagramm Technik kommt hier nicht

mehr zum Tragen denn bei grösseren Zahlen ist es fast unmöglich einen Baum zu zeichnen.

19

Es gibt einen einfacheren Weg die Wahrscheinlichkeit von diesen Ereignissen zu berechnen. Es

bedarf jedoch zuvor noch einer Einführung eines neuen Konzepts: der Unabhängigkeit von zufälligen

Ereignissen.

Definition 2.4.2 Gegeben sei ein zufälliges Experiment und zwei Ereignisse dieses Experiments,

bezeichnet mit A und B. Wir erklären die beiden Ereignisse für unabhängig, wenn es für das Eintreten des einen Ereignisses nicht nötig ist, dass das andere Ereignis eintritt.

In anderen Worten: Zwei Ereignisse A und B sind unabhängig wenn die Wahrscheinlichkeit von A

gleich der bedingten Wahrscheinlichkeit A unter der Bedingung von B und umgekehrt ist.

P (A/B) = P (A)

and

P (B/A) = P (B)

Zwei Ereignisse A und B werden als unabhängig bezeichnet wenn die Wahrscheinlichkeit von A und

B gleich dem Produnkt der Wahrscheinlichkeit von A und B ist.

P (A ∩ B) = P (A) · P (B)

Dieses Erkenntnis wird häufig bei der Berechnung von Wahrscheinlichkeiten in der Wiederholung

von zufälligen Experimenten angewendet. Also wenn wir ein zufälliges Ereignis n mal wiederholen

und wir wissen, dass das Resultat nach einigen Malen unabhängig von den vorigen ist und wir

zusätzlich die Wahrscheinlichkeit des Eintretens von Ai in jeder Wiederholung, ∀ i = 1, ..., n, berechnen dann erhalten wir die Wahrscheinlichkeit für alle Ereignisse. Es ist dies der Durchschnitt

aller Ereignisse: A1 ∩ A2 ∩ ... ∩ An ,

P (A1 ∩ A2 ∩ ... ∩ An ) = P (A1 ) · P (A2 ) · ... · P (An )

Beispiel 2.4.1 Ziehen wir zufällig zwei Karten von dem ”Mus” Spiel mit zurücklegen. Wie hoch ist

die Wahrscheinlichkeit, dass beide Karten höhere Karten sind? Wie hoch ist die Wahrscheinlichkeit

dass keine Karte eine höhere Karte ist? Wie hoch ist die Wahrscheinlichkeit dass eine der beiden

Karten eine höhere Karte ist und die andere nicht?

Bezeichnen wir das Ereignis ”Die erste Karte ist eine höhere Karte” mit A und das Ereignis

”Die zweite Karte ist eine höhere Karte”mit B, dann erhalten wir das Ereignis ”Beide Karten sind

höhere Karten” mit A ∩ B. Natürlich sind dies alles unabhängige Ereignisse, da wir ja Ziehen mit

zurücklegen und sich daher auch die Ausgangsbedingungen bei jedem Durchgang nicht unterscheiden.

Es gilt:

16 16

P (A ∩ B) = P (A) · P (B) =

·

40 40

Das Ereignis ”Keine der beiden Karten ist eine höhere Karte” wird auf folgende Weise durch

die Ereignisse A und B repräsentiert: Ac ∩ B c . Es sind auch dies zufällig Ereignisse daher wird die

Wahrscheinlichkeit dieser Ereignisse so berechnet:

P (Ac ∩ B c ) = P (Ac ) · P (B c ) = (1 − P (A)) · (1 − P (B)) =

24 24

·

40 40

Das Ereignis ”Eine Karte ist eine höhere Karte, die andere nicht” wird auf folgende Weise durch

die Ereignisse A und B repräsentiert: Ac ∩ B und A ∩ B c . Es kann möglich sein, dass die erste

Karte eine höhere Karte ist und die zweite nicht und umgekehrt. Das Ereignis das wir untersuchen

20

möchten ist die Vereinigung beider Ereignisse (Ac ∩ B) ∪ (A ∩ B c ). Da sie unabhängige Ereignisse

sind, Zerlegung wegen (Ac ∩ B) ∩ (A ∩ B c ) ⊂ A ∩ Ac = ∅ ⇒ (Ac ∩ B) ∩ (A ∩ B c ) = ∅), kann die

Wahrscheinlichkeit dieses Ereignisses folgend berechnet werden:

(P (Ac ∩B)∪(A∩B c )) = P ((Ac ∩B))+P ((A∩B c )) = P (Ac )·P (B)+P (A)·P (B c ) =

24 16 16 24

· + ·

40 40 40 40

Sie können nun erkennen welches der drei Ereignisse eher eintritt.

Übung 2.4.1 Überlegen Sie sich folgendes Experiment: Ziehen Sie willkürlich zwei Karten vom

Kartenstapel mit zurücklegen. Sie legen die Karte also nachdem sie sie gesehen haben wieder zurück

bevor Sie die nächste ziehen. Addieren Sie Werte der Karten im ”Mus” Spiel. Beantworten Sie

folgende Fragen:

a) Beschreiben Sie das Ereignisfeld, das sichere und das unmögliche Ereignis des Experiments.

b)Berechnen Sie die Wahrscheinlichkeit der Summe der Karten mit Wert 20.

c) Berechnen Sie die Wahrscheinlichkeit der Summe der Karten mit Wert sechs oder weniger

als sechs.

Übung 2.4.2 Wiederholen Sie die Übung aber diesmal mit dem Konzept des Ziehens ohne zurücklegen,

d.h. sie legen die Karte nicht wieder auf den Stapel zurück.

2.4.3

Totale Wahrscheinlichkeit

Stellen Sie sich vor wir ziehen zwei Karten von Kartenstapel ohne diese zurückzulegen. Wir

betrachten zunächst die erste und dann die zweite Karte. Wir groß ist die Wahrscheinlichkeit, dass

die zweite Karte ein König ist? Mit dem Wissen das wir bereits haben, können wir sagen, dass wenn

die erste Karte ein König war die Wahrscheinlichkeit für die zweite Karte ein König zu sein gleich

7

39 ist.

Ist jedoch die erste Karte kein König, dann ist die Wahrscheinlichkeit für die zweite Karte ein

8

. Hier wird deutlich, dass es von der ersten Karte abhängt mit welcher

König zu sein gleich 39

Wahrscheinlichkeit eine bestimmte Karte als zweite Karte gezogen wird. Im Teilkapitel über die

bedingte Wahrscheinlichkeit haben wir vorteilhaft begonnen. Wir kannten nämlich die erste Karte.

Nun wissen wir dies nicht mehr. Wie können wir dieses Problem nun lösen? Wir müssen in diesem

Fall beide Wahrscheinlichkeiten berücksichtigen. Die erste Karte kann also ein König oder irgendeine

andere Karte sein. Lösung des Problems:

Überlegen Sie sich folgende zufällige Ereignisse:

1. A1 = ”Die erste Karte ist ein König”

2. A2 = ”Die zweite Karte ist ein König”

Wir wollen P (A2 ) berechnen. WAlso werden wir sehen, ob das Ereignis A1 eintritt oder nicht. Wie

können wir das machen? Nunja wir werden einfach P (A2 ) in verschiedene Wahrscheinlichkeiten aufteilen, die ein Rechnen erleichtern. Dazu werden wir auf die Operationen, die wir bei den zufälligen

Ereignissen angewendet hatten, zurückgreifen.

Wir nehmen an A1 sei das Komplement des Ereignisses A1 , dann erhalten wir:

A1 ∪ A1 = E,

A1 ∩ A1 = ∅

21

Weiters gilt:

A2 = A2 ∩ E =⇒ A2 = (A2 ∩ A1 ) ∪ (A2 ∩ A1 )

und:

(A2 ∩ A1 ) ∩ (A2 ∩ A1 ) = ∅

es gilt:

P (A2 ) = P (A2 ∩ A1 ) + P (A2 ∩ A1 )

Wenden wir nun die Formel der bedingten Wahrscheinlichkeit an, dann erhalten wir:

P (A2 ∩ A1 ) = P (A2 /A1 )P (A1 )

und

P (A2 ∩ A1 ) = P (A2 /A1 )P (A1 )

Jetzt können wir die zwei Wahrscheinlichkeiten leicht berechnen. Die Laplace’sche Regel und

die Techniken, die wir bei den Ziehungen ohne zurücklegen behandelt haben, ermöglichen uns ein

Lösen und es ergibt sich:

P (A2 /A1 )P (A1 ) =

7 8

·

39 40

und

8 32

= ... = 00 2

·

39 40

Wie Sie an diesem Beispiel gesehen haben wurde die Wahrscheinlichkeit in zwei Summanden

aufgeteilt. Im ersten Summanden setzen wir voraus, dass die erste Karte ein König ist, A1 , und im

zweiten nehmen wir an die erste Karte ist kein König, A1 .

Die Ereignisse A1 und A1 haben zwei wichtige Eigenschaften

P (A2 /A1 )P (A1 ) =

A1 ∩ A1 = ∅ y A1 ∪ A1 = E

Diese Technik kann als allgemeingültige Regel benutzt werden:

Haben wir eine Reihe inkonsistenter Ereignisse A1 , A2 , ..., An in Paaren (Ai ∩ Aj = ∅ ∀i 6= j),

und gilt dass A1 ∪ A2 ∪ ... ∪ An = E, (stimmen sie mit diesen Bedingungen übererein so ist

diese Reihe eine komplette Reihe der Ereignisse), dann ist die Wahrscheinlichkeit eines Ereignisses

S ⊂ E gleich mit

P (S) = P (A1 ) · P (S/A1 ) + P (A2 ) · P (S/A2 ) + ... + P (An ) · P (S/An )

und diese Formel wird als Formel der Totalen Wahrscheinlichkeit bezeichnet.

Der schwierigste Teil des Anwendens der Formel über die Totale Wahrscheinlichkeit ist es eine

geeignete Reihe von Ereignissen zu wählen. Eine schlecht gewählte Reihe von Ereignissen bringt

noch größere Schwierigkeiten mit sich. Also ist es nötig geeignete Ereignisse herauszufinden, denn

eine schlechte Wahl von Ereignissen einer kompletten Reihe von Ereignissen hilft nicht das Problem

zu lösen.

22

Übung 2.4.3 Finden Sie die Wahrscheinlichkeit, in demselben Experiment wie am Anfgang dieses

Kapitels, sodass die zweite Karte keine höhere Karte ist.

Übung 2.4.4 Lassen Sie uns mit folgender Übung fortfahren: Wir teilen drei Karten im Zuge des

”Mus” Spiels aus. Berechnen Sie zuvor eine komplette Reihe von Ereignissen und wenden Sie die

Formel der Totalen Wahrscheinlichkeit darauf an, sodass die dritte Karte eine As ist. Wie hoch ist

die Wahrscheinlichkeit, dass die dritte Karte keine As ist?

Vorschlag: Wählen Sie als komplette Reihe von Ereignissen die Anzahl der gezogenen Assen als die

zwei ersten Karten.

2.4.4

Bayes’sche Regel

Lassen Sie uns zurückgehen auf das vorige Beispiel und dessen Situation. Wir haben zwei Karten

ohne zurücklegen gezogen. Es stellt sich nun eine neue Frage: Wie hoch ist die Wahrscheinlichkeit,

dass die erste Karte ein König ist wobei wir bereits wissen, dass die zweite Karte ein König ist.

Diese Frage klingt wie eine Fragen, die wir im vorigen Kapitel bereits behandeln hätten können.

Es besteht aber ein bedeutender Unterschied: In diesem Fall haben wir ein Experiment bereits

durchgeführt (wir haben die zweite Karte schon gesehen)und fragen uns nun welche Karte die erste

war. Nennen wir die Eeignisse A1 und A2 wie zuvor, dann berechnen wir:

P (A1 /A2 )

Wenden nun die Formel der bedingten Wahrscheinlichkeit an und erhalten:

P (A1 /A2 ) =

P (A1 ∩ A2 )

P (A2 )

Ändern wir nun den Nenner entsprechend der Formel für die Totale Wahrscheinlichkeit und

wenden die Formel der bedingten Wahrscheinlichkeit im Zähler an, dann sehen wir:

P (A1 /A2 ) =

P (A2 /A1 )P (A1 )

P (A2 /A1 )P (A1 ) + P (A2 /A1 )P (A1 ))

Diese Berechnung ist nun einfacher als jene im vorigen Kapitel. Es ergibt sich:

P (A1 /A2 ) =

7 8

39 40

1

5

=

7

39

Im Allgemeinen wird die Bayes’sche Formel wie folgt angewandt:

Gegeben sei eine vollständige Reihe von Ereignissen A1 , A2 , ..., An und ein Ereignis S. Wir

möchten die Wahrscheinlichkeit des Auftretens des Ereignisses Ai berechnen wobei wir wissen,

dass nachdem wir das Experiment durchgeführt haben das Ereignis S eintritt, d.h. wir werden

P (Ai /S) berechnen. Wegen vorhin gilt:

P (Ai /S) =

P (Ai ∩ S)

P (S/Ai ) · P (Ai )

= Pn

P (S)

i=i P (S/Ai ) · P (Ai )

23

wobei P (Ai ) die Wahrscheinlichkeit a priori des Ereignisses Ai ist (sie ist bereits im Vorhinein

bekannt) und P (Ai /S) die Wahrscheinlichkeit a posteriori, da sie erst berechnet wird wenn das

Experiment durchgeführt wurde.

Wie auch schon im Kapitel über die bedingte Wahrscheinlichkeit hervorgegangen ist, ist es

auch hier bei der Anwendung der Bayes’schen Formel nötig eine geeignete Reihe von vollständigen

Ereignissen zu wählen (CSE), welches den schwierigsten Teil darstellt.

Übung 2.4.5 Sie spielen wieder das ”Mus” Spiel und ziehen diesmal zwei Karten. Berechnen Sie

die Wahrscheinlichkeit eine Sieben beim ersten Ziehen zu erhalten wobei die wissen, dass die zweite

gezogene Karte ein Bube ist.

Übung 2.4.6 Nun ziehen wir zufällig vier Karten vom Kartenstapel. Wir wissen, dass die erste

Karte eine As ist. Wie hoch ist die Wahrscheinlichkeit, dass auch die erste Karte eine As ist? Wie

hoch ist die Wahrscheinlichkeit, dass die erste Karte ein Bube ist?

Hinweis: Für die zwei Fragen müssen Sie zwei verschiedene vollstängige Reihen von Ereignissen

wählen.

2.5

Antwort auf die anfängliche Frage

Am Beginn dieser Arbeit stellten wir folgendes Beispiel vor: Vier Freunde spielten das ”Mus

Spiel”. Sie erhielten acht Paare von Königen, sechs Trios von Assen oder Königen und fünf Doppel.

Die Freunde unterhielten sich welche dieser Kombinationen am ehesten eintritt und kamen zu keiner

Einigung. Also halfen wir ihnen. Die folgenden Ereignisse benennen wir:

• RR = ”Erhalten eines Paares von Königen”

• M = ”Erhalten eines Trios von Assen oder Königen ”

• D = ”Erhalten irgendeines Doppels”

Wir werden nun die Wahrscheinlichkeit berechnen ein Paar von Königen zu erhalten, also P (RR).

Um dieses Paar zu erhalten müssen wir (offensichtlich) zwei Könige und zwei andere Karten ausser

Königen haben. Dise können auch nicht gleich sein, da wir sonst ein Doppel von Königen und

anderen zwei Karten hätten.

Nun werden wir zwei Fälle unterscheiden. Im ersten Fall haben wir eine As und im zweiten Fall

nicht, da die Anzahl der Asse im Kartenstapel unterschiedlich der anderen Karten ist.

Ereignis B sei nun ”Erhalten einer As”. Nach Anwendung der Regel für die Totale Wahrscheinlichkeit ergibt sich:

P (RR) = P (RR/B)P (B) + P (RR/B)P (B) = P (RR ∩ B) + P (RR ∩ B)

Wir bezeichnen das Ereignis A mit dem Erhalten einer As und C und C 0 als Erhalten von

unterschiedlichen Karten ausser Königen oder Assen und wiederum unterschiedlich dann könnte

ein Paar von Königen folgend aussehen:

(R, R, A, C)

24

Haben wir eine As oder

(R, R, C, C‘)

, haben wir keine As und die Karten (R, R, A, C) mit allen möglichen Variationen in der Anordnung

ergibt das Ereignis RR∩B. Die anderen Karten (R, R, C, C 0 ) mit allen möglichen Anornungen ergibt

das Ereignis RR ∩ B.

Lassen Sie uns zunächst die Wahrscheinlichkeit berechnen, dass nach dem Austeilen folgende Karten in dieser Ordnung erhalten wurden (R, R, A, C). Dann werden wir berechnen wieviele

mögliche Variationen es gibt und da ja alle die gleiche Wahrscheinlichkeit aufweisen brauchen wir

nurmehr die Wahrscheinlichkeiten zu multiplizieren. Lassen Sie uns P (R, R, A, C) berechnen. Die

8

, die Wahrscheinlichkeit dass die zweite

Wahrscheinlichkeit dass die erste Karte ein König ist ist 40

7

Karte auch ein König ist ist 39 . Die Wahrscheinlichkeit der dritten Karte eine As zu sein beträgt

8

38 , während die Wahrscheinlichkeit der vierten Karte eine andere Karte als ein König oder eine As

24

zu sein gleich 37

ist. Es gilt:

8 7 8 24

P (R, R, A, C) =

40 39 38 37

Lassen Sie uns die Wahrscheinlichkeit nun in einem anderen Auftreten der Karten berechnen

um zu sehen, dass die Wahrscheinlichkeit dieselbe ist. Zum Beispiel:

P (A, R, C, R) =

8 8 24 7

8 7 8 24

=

= P (R, R, A, C)

40 39 38 37

40 39 38 37

Dies könnte man nun auch für die anderen Variationen durchrechnen. Es müsste aber nun einsichtig

sein dass sie alle gleich sind.

Wenn einmal die Wahrscheinlichkeit eines dieser gefunden wurde, dann kann man die Anzahl

der möglichen Variationen der Karten leicht berechnen.

Wir haben eine Variation von vier Karten in welcher zwei Karten doppelt auftreten. Die allgemeine Formel für Variation mit Wiederholung von n Elementen wo n1 Elemente von derselben Art

sind, n2 Elemente einer anderen Art,... und nk wieder einer anderen Art

Vnn1 ...nk =

n!

n1 ! · n2 ! · ... · nk !

In unserem Fall also

P (R, R, A, C) =

4!

24

=

= 12

2!1!1!

2

Wir erhalten:

P (RR ∩ B) = 12

8 7 8 24

40 39 38 37

Um P (RR∩B) zu erhalten müssen wir mit einem ähnlichen Prozess fortfahren. Als erstes werden

wir P (R, R, C, C 0 ) berechnen. Nun folgt das Anwenden der Laplace’schen Regel Karte für Karte.

Dies ergibt:

8 7 24 20

P (R, R, C, C 0 ) =

40 39 38 37

Wiederum sind alle Variationen gleich. Es existieren 12 mögliche Anordnungen, die durch Variation mit Wiederholung von 4 Elementen entstehen, wobei zwei Elemente wiederholt werden. Dies

25

ergibt 12 mögliche Anordnungen. Sie sind alle gleich wahrscheinlich und die Wahrscheinlichkeit ein

Paar von Königen und keiner As ist

P (RR ∩ B) = 12

8 7 24 20

40 39 38 37

Nach der Formel für die Totale Wahrscheinlichkeit ergibt sich:

P (RR) = P (RR ∩ B) + P (RR ∩ B) = 12

8 7 8 24

8 7 24 20

+ 12

= 00 255

40 39 38 37

40 39 38 37

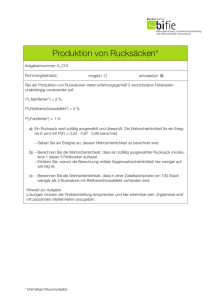

Nun wollen wir P (M ) berechnen. Das Trio kann aus Königen oder Assen bestehen. Also kann

die erste Karte ein König oder eine As sein. Die zweite Karte muss ein König sein wenn die erste

Karte einer war, und muss eine As sein wenn die erste Karte eine As war. Mit der dritten Karte ist

es dasselbe. Die vierte Karte darf nicht dieselbe sein wie die drei Karten zuvor denn sonst hätten

wir ein Doppel und kein Trio. Die Wahrscheinlichkeit ein Trio von Assen oder Königen zu erhalten

ist also:

8 7 6 32

8 7 6 32

16 7 6 32

+

=

40 39 38 37 40 39 38 37

40 39 38 37

und alle sind gleich wahrscheinlich. Nehmen wir an der erste Summand sein die Wahrscheinlichkeit ein Trio von Königen zu erhaltenund, die zweite die Wahrscheinlichkeit ein Trio von Assen

zu erhalten. Dies sind inkonstistente Ereignisse und daher brauchen nur die Wahrscheinlichkeiten

addiert zu werden um auf das Ergebnis zu kommen.

Um die Anzahl der möglichen Anordungen zu berechnen ziehen wir die Formel für die Variation

mit Wiederholung zu Hilfe. In diesem Fall haben wir vier Elemente in welchen drei gleich sind und

4!

4

eines unterschiedlich. Also haben wir V3,1

= 3!

= 4 mögliche Anordnungen derselben Karten.

Da sie gleich wahrscheinlich sind müssen wir nur die Wahrscheinlichkeiten einer Anordnung mit

der Anzahl der möglichen Anordnungen multiplizieren. Es ergibt sich:

P (M ) = 4

16 7 6 32

= 00 039

40 39 38 37

Schießlich möchten wir noch die Wahrscheinlichkeit berechnen ein Doppel im ”Mus” Spiel zu

erhalten. Dazu werden wir das Ereignis des Erhaltens irgendeines Doppels aufspalten in die verschiedenen Doppel die wir erhalten können, abhängig davon ob wir Könige, Asse oder beide haben.

Wir können folgende Doppel erhalten:

8 7 8 7

1. Könige-Asse (R, R, A, A). P (R, R, A, A) = 40

39 38 37 Hier liegt eine Variation von vier Ele4!

4

menten vor die in Paaren dieselben sind, also gibt es V2,2

= 2!2!

= 6 mögliche Anordnungen.

Die Wahrscheinlichkeit des Erhaltenes eines Doppels von Königen und Assen ist daher

6

8 7 8 7

40 39 38 37

26

2. Ein Doppel von Königen und einer anderen Karte, die keine As oder ein König ist, ist

8 7 24 3

(R, R, C, C). P (R, R, C, C) = 40

39 38 37

4

Auch in diesem Fall haben wir V2,2

=

Erhaltens eines Doppels dieser Art

4!

2!2!

6

= 6 Variationen, also ist die Wahrscheinlichkeit des

8 7 24 3

40 39 38 37

3. Ein Doppel von Assen und einer anderen Karte ausser König und As ist (A, A, C, C). P (A, A, C, C) =

8 7 24 3

4!

4

40 39 38 37 Wieder haben wir V2,2 = 2!2! = 6 Variationen, Also ist die Wahrscheinlichkeit des

Erhaltens dieses Doppels

8 7 24 3

6

40 39 38 37

8 7 6 5

4. Könige-Könige (R,R,R,R). Es gilt dass P (R, R, R, R) = 40

39 38 37 und da alle Karten gleich

sind haben wir nur eine einzige Anordnung und folglich ist die Wahrscheinlichkeit des Erhaltens diese Doppels

8 7 6 5

40 39 38 37

8 7 6 5

5. Asse-Asse (A,A,A,A). Es gilt dass P (A, A, A, A) = 40

39 38 37 und es ist wiederum jede Karte

gleich also gibt es nur eine Anordnung. Die Wahrscheinlichkeit des Erhaltens des Doppels

Asse-Asse ist

8 7 6 5

40 39 38 37

6. Das Ereignis ”Erhalten eines Doppels ausgenommen von Königen und Asse und die Karten des

Doppels unterscheiden sich” kann wie folgt bezeichnet werden (C,C,C’,C’), y P (C, C, C 0 , C 0 ) =

4!

24 3 20 3

4

40 39 38 37 . Für die möglichen Anordnungen haben wir wieder V2,2 = 2!2! = 6. Die Wahrscheinlichkeit des Erhaltens dieses Doppels ist daher

6

24 3 20 3

40 39 38 37

7. Das letzte möglich Doppel ist jenes in welchem alle vier Karten gleich sind, wobei die Karten

keine Könige und Asse sind. Das ergibt folgende Kombination (C, C, C, C).

3 2 1

Die Wahrscheinlichkeit des Eintretens ist 24

40 3 38 37 und da jede Karte dieselbe ist haben wir

auch nur eine mögliche Anordnung. Die Wahrscheinlichkeit des Erhaltens dieses Doppels ist

daher

24 3 2 1

40 3 38 37

Diese Doppel die wir soeben nummeriert haben sind alle disjunkt (inkonsistent) und ihre Vereinigung

ergibt das Ereignis D = ”Erhalten irgendeines Doppels”. Die Wahrscheinlichkeit P (D) ist gleich der

Summe der Wahrscheinlichkeiten von den vorigen Doppeln. Nach der exakten Berechnung ergibt

sich

P (D) = 00 035

27

Kurz gilt

P (RR) = 00 255

P (M ) = 00 039

P (D) = 00 035

Das Ereignis des Paars von Königen ist unter den dreien am wahrscheinlichsten. Während die

Ereignisse ”Ziehen eines Trios von Königen oder Assen” und ”Ziehen von irgendeinen Doppel” sehr

ähnliche Wahrscheinlichkeiten liefern.

Mit diesen Berechnungen sind wir nun in der Lage Auskunft über die Frage, die sich die Freunde

gestellt haben, zu geben. Obwohl es wahrscheinlicher ist ein Paar von Königen als ein Doppel zu

erhalten muss dies nicht in Realität so sein. Wenn wir also sagen, dass ein Ereignis wahrscheinlicher

ist als ein anderes heisst das nicht, dass dieses Ereignis immer und immer häufiger als ein anderes

Ereignis eintritt. Theoretisch hat es eine höhere Wahrscheinlichkeit einzutreten als die anderen. Bei

der Wahrscheinlichkeitsrechnung sehen Sie den Unterschied zwischen Theorie und Praxis sehr gut.

28

Kapitel 3

Eindimensionale

Wahrscheinlichkeitsverteilungen

3.1

Zielsetzungen

• Verständnis des Konzept der Wahrscheinlichkeitsveteilung und Begründungen.

• Berechnen der Dichte- Wahrscheinlichkeitsfunktion (DP F ) und der Cumulative Wahrscheinlichkeitsfunktion (CP F ) einer Wahrscheinlichkeitsverteilung.

• Verständnis des Konzepts des Modalwertes, des Medians oder Erwartungswertes, der Varianz

einer diskreten Wahrscheinlichkeitsverteilung und deren Berechnung von der DP F oder von

der CP F .

3.2

Beispiel

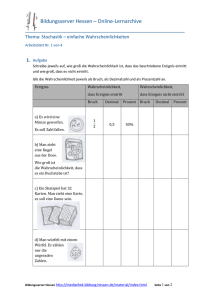

Ein Börsenanleger hat 1000000 Euro zum Investieren an der Börse zur Verfügung. Er überlegt

sich zwei Möglichkeiten:

• Anlegen des Geldes bei der Bank und Vergewisserung eines 16%igen Gewinns.

• Investitionsvorhaben.

Eine Marktuntersuchung, durchgeführt von einem Börsen Analytiker besagt dass das Investitionsvorhaben von vorhin folgende Gewinne mit den eigenen Wahrscheinlichkeiten erzielt:

29

Gewinn (%)

30

25

20

15

10

5

0

Wahrscheinlichkeit

0’15

0’2

0’25

0’15

0’1

0’1

0’05

Der Anleger muss nun eine Entscheidung treffen wie er sein Geld am besten anlegt. Zwei Fragen

können gestellt werden:

Der Anleger vertraut dem Konzept des erwarteten Gewinns (das Geld das er durchschnittlich

gewinnen würde wenn er mehrmals anlegt). Wie werden wir uns entscheiden? Ziehen wir den erwarteten Gewinn des Investmentvorhabens, um mehr zu gewinnen, vor?

Eine andere Möglichkeit wäre: Der Anleger will nicht viel riskieren und will zumindest 16%

Gewinn mit 70%iger Wahrscheinlichkeit. Was machen wir in diesem Fall?

Wir werden diese Problem lösen, indem wir die Wahrscheinlichkeitsverteilung zu Hilfe ziehen, ein

Konzept das noch genauer erklärt wird.

3.3

Einleitung. Diskrete Zufallsvariablen und Wahrscheinlichkeitsverteilungen

Zuvor haben wir gelernt wie man die Wahrscheinlichkeiten von verschiedenen zufälligen Ereignissen bestimmt. Jede auf eine andere Weise. Dieses Kapitel beschäftigt sich nun mit allgemeinen

Techniken, die explizit erklärt werden.

Im vorigen Beispiel ist eine Tabelle mit den Wahrscheinlichkeiten des Erhaltens von verschiedenen Gewinnen nach dem Investitionsplan. Mit Hilfe dieser Tabelle werden wir entscheiden wie wir

das Geld anlegen werden. Bevor wir nun fortfahren sei nochmals erwähnt, dass die Schlüsse die wir

ziehen werden theoretischer Natur sind. Es ist also möglich dass wir uns für eine Variante entscheiden und wegen der Zufälligkeit der Ereignisse diese Variante falsch ist und unsere Berechnungen

verwift. Weiters gibt uns die Wahrscheinlichkeit nur eine grobe Idee von der Höhe des Profits.

Lassen Sie uns nun mit der Analyse des Problems beginnen.

Wir wollen nun das Konzept der zufälligen Variablen genauer betrachten.

Bei unserem Problem haben wir ein zufälliges Experiment vorausgesetzt, nämlich den Gewinn

den wir nach dem Investmentplan machen. Nach dem zufälligen Experiment können wir in den

verschiedenen Fällen unterschiedliche Gewinne erzielen. Und diese möglichen Gewinne sind nun die

Resultate unseres zufälligen Experiments.

Wir benennen

X = ”Gewinn nach Befolgung des Investitionsplans ”

30

und sagen X ist eine diskrete zufällige Variable und die möglichen Werte die diese Variable annehmen kann sind die Ergebnisse.

In diesem Fall kann die zufällige Variable X sieben Ergebnisse oder Werte liefern (alle verschiedenen Gewinne) die wir mit x und einen Index für jeden einzelen Fall bezeichnen. Die diskrete

zufällige Variable X kann die Werte x1 , x2 , x3 , x4 , x5 , x6 , x7 annehmen, wobei

1. x1 = 0 =⇒ P (X = x1 ) = 00 05

2. x2 = 5 =⇒ P (X = x2 ) = 00 1

3. x3 = 10 =⇒ P (X = x3 ) = 00 1

4. x4 = 15 =⇒ P (X = x2 ) = 00 15

5. x5 = 20 =⇒ P (X = x5 ) = 00 25

6. x6 = 25 =⇒ P (X = x6 ) = 00 2

7. x7 = 30 =⇒ P (X = x7 ) = 00 15

Die Reihe von Werten die eine diskrete Zufallsvariable annehmen kann und die ihre Wahrscheinlichkeit wird als diskrete Wahrscheinlichkeitsverteilung bezeichnet.

P (X = x1 ) = 00 05,

P (X = x2 ) = 00 1,

P (X = x5 ) = 00 2,

P (X = x3 ) = 00 1,

P (X = x6 ) = 00 25,

P (X = x4 ) = 00 15,

P (X = x7 ) = 00 15,

Logischerweise ist die Summe aller dieser Wahrscheilichkeiten gleich 1. Dies kommt von der

Tatsache, dass wenn eine diskrete Zufallsvariable ihre Werte in der Reihe {x1 , ..., xn } annimmt, d.h.

P (X ∈ {x1 , ..., xn }) = 1

weil in jedem Fall die Zufallsvariable einen dieser Werte annehmen wird und dies ist was wir

mit dem sicheren Ereignis bezeichnen. Da sie auch disjunkte (inkonsistente) Ereignisse sind kann

die Zufallsvariable X auch nicht zwei verschiedene Werte zur selben Zeit annehmen. Es gilt:

P (X = x1 ) + ... + P (X = xn ) = P (X = x1 ∪ ... ∪ X = xn ) = P (X ∈ {x1 , ..., xn }) = 1

Wir definieren eine diskrete Zufallsvariable und ihre Wahrscheinlichkeitsverteilung wie folgt:

Definition 3.3.1 Eine zufällige Variable ist ein numerisches Ergebnis eines zufälligen Experiments.

Wir sagen X ist eine diskrete Zufllsvariable wenn sie ihre Werte innerhalb eines Reihe annimmt x1 , x2 , ..., xn , ... und wenn wir sie abzählen können (endlich oder unendlich) mit eigner

Wahrscheinlichkeit

P [X = x1 ], P [X = x2 ], ..., P [X = xn ], ... und es gilt 0 ≤ P [X = xn ] ≤ 1, ∀n

P∞

und i=1 P [X = xi ] = 1. Die vorigen Wahrscheinlichkeiten bilden eine Wahrscheinlichkeitsverteilung für die Variable X, d.h., die Wahrscheinlichkeitsverteilung einer Zufallsvariablen X ist die

Funktion die jedem möglichen Werte die Wahrscheinlichkeit des Wertes zuordnet.

31

In unserer Studie über diskrete Zufallsvariablen werden wir speziell jene Variablen betrachten die

einen Wert innerhalb einer endlichen Reihe annehmen. Als Beispiel dafür dient die Situation die

anfangs beschrieben wurde. Hier sind nur sieben Möglichkeiten vorhanden.

Als Wiederholung dieses Abschnitts wollen wir uns an die Zufallsvariable und die Wahrscheinlichkeitsverteilung erinnern.

Die Zufallsvariable ist X = ”Gewinn nach Befolgung des Investitionsplans” und deren Wahrscheinlichkeitsverteilung ist

P (X = x1 ) = 00 05,

P (X = x2 ) = 00 1,

P (X = x5 ) = 00 2,

P (X = x3 ) = 00 1,

P (X = x6 ) = 00 25,

P (X = x4 ) = 00 15,

P (X = x7 ) = 00 15,

wobei x1 = 0, x2 = 5, x3 = 10, x4 = 15, x5 = 20, x6 = 25 und x7 = 30.

3.4

Häufigkeits Cumulative Wahrscheinlichkeitsfunktionen

Wie Sie bereits bemerkt haben, haben wir zuvor die Ereignisse x1 , ..., x7 mit den unterschiedlichen

Gewinnen in aufsteigender Reihenfolge benannt. Wir haben x1 mit dem niedrigsten Gewinn, der 0,

x2 mit dem Gewinn 5,... und x7 mit dem größten Gewinn, der 30, gleichgesetzt.

Dies haben wir keinesfalls zufällig und ohne Grund so zugeordnet. Es dient zur Definition einer

neuen Funktion, die die Zufallsvariable X benötigt. Die Funktion charakterisiert X eindeutig, die

Cumulative Wahrscheinlichkeitsfunktion, die wir später genauer behandeln werden.

Zuvor werden wir die zweite Frage des Problems beantworten. Der Anleger möchte mit einer

Wahrscheinlichkeit, höher als 0’7, mindestens 16% Gewinns beim Investitionsplan erzielen. Wenn

dies nicht zu seinem Willen geschieht dann werde er sein Geld bei einer Bank anlegen, die ihm die

16% Gewinn gewährt.

Basierend auf den Zufallsvariablen möchte er, dass P (X > 16) ≥ 00 7. Wie berechnet man dies?

Es ist ziemlich einfach. Man nimmt die möglichen Werte die die diskrete Zufallsvariable X annehmen

kann und addiert ihre Wahrscheinlichkeiten. Man erhält in diesem konkreten Beispiel:

P (X > 16) = P (X = 20) + P (X = 25) + P (X = 30) =

= P (X = x5 ) + P (X = x6 ) + P (X = x7 ) = 00 25 + 00 2 + 00 15 = 00 6

So ergibt sich, dass die Wahrscheinlichkeit einen Gewinn von mehr als 16% zu machen bei nur

0’6 liegt und nicht bei 0’7, sowie es der Anleger versichert haben wollte. Der Anlegeer steigt also in

diesem Fall mit einem Anlegern bei einer Bank, die ihm den 16%igen Gewinn gewährt, besser aus.

Nun wollen wir aber die Funktion definieren welche wir vorhin erwähnten und welche die Zufallsvariable eindeutig charakterisiert. Mit Hilfe diese Funktion, der Cumulative Wahrscheinlichkeitsfunktion (CPF), wird es uns auch möglich sein die vorhin gestellte Frage zu beantworten. Wir

definieren:

32

Definition 3.4.1 Hat man die möglichen Werte, die eine diskrete Zufallsvariable X annehmen

kann in aufsteigender Reihenfolge x1 , ..., xn , dann definieren wir die Funktion

F : R −→ [0, 1]

wie folgt

F (x) = P (X ≤ x)

∀x ∈ R