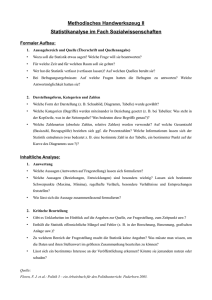

Einführung in die Statistik “The aim of computing is insight, not

Werbung

Handout Einführung in die Statistik mit Beispielen aus der Biologie Thomas Fabbro Version 2013-12-05 (213) “The aim of computing is insight, not numbers.” 1 Was ist Statistik? Die Statistik als Disziplin (“statistics” Mehrzahl) beschäftigt sich mit dem Sammeln, Organisieren, Analysieren, Interpretieren und Präsentieren von Daten (nach Dodge, Cox und Commenges 2006). Abbildung 1: Die Abbildung zeigt den Zusammenhang der wichtigsten Grundbegriffe der Statistik: Population, zufälliges Ziehen, Stichprobe, Untersuchungseinheit, Variable und Messwert. 2 2 Variablen Es gibt viele verschiedene Möglichkeiten, wie man Variablen in verschiedene Typen einteilen kann. Je nach Typ gibt es dann unterschiedliche statistische Verfahren die man anwenden kann. Wir werden hier die Einteilung kennen lernen, wie sie von unserer Software R verwendet wird. Messbare und Zählbare Variablen numeric für kontinuierlich Variablen, alle Zwischenschritte sind möglich integer für Ganze Zahlen Kategorielle Variablen factor für Kategorien (z. B. “Fabaceae”, “Rosaceae”, “Apiaceae”). Kategorien lassen sich weiter unterteilen in solche die man ordnen kann nach Grösse (z. B. Schulnoten: “schlecht”, “genügend”, “gut”) und in solche die sich nicht ordnen lassen (z. B. “Rhamnus alpina”, “Sorbus aucuparia”, “Quercus pubescens”). Leider ist es sehr schwierig geordnete kategorielle Daten als solche zu analysisren und darum ist für uns diese Unterteilung nur nebensächlich. logical Eine Variable die nur die Werte TRUE oder FALSE annehmen kann (z. B. “männlich”, “weiblich”). Für die statistischen Belange kann man sagen, dass dies ein spezieller factor mit genau zwei Kategorien ist. 2.1 Beschreiben von kontinuierlichen Variablen Es gibt zwei Arten wie man Variablen beschreiben kann entweder durch Kenngrössen oder mit graphischen Darstellungen. Oft erlauben graphische Darstellungen eine bessere Charakterisierung. Bevor wir jedoch uns die einzelnen graphischen Darstellungen genauer ansehen, wollen wir uns überlegen, welche Charakteristika wir beschreiben könnten. In der folgenden Liste sind für die wichtigsten 3 Charakteristika auch gleich die bekanntesten Kenngrössen angegeben. Lage Mittelwert, Median, Modus Streuung Spannweite, Quartilsabstand, Varianz Form Schiefe: z. B. rechtsschief (=linkssteil), linksschief (=rechtssteil) Wölbung: steilgipflig, flachgipflig weitere Begriffe: symmetrisch, unimodal, bimodal, multimodal Häufung (”cluster”) Werte treten in Klumpen auf. Körnung (”granularity”) Nur bestimmte Werte treten auf. Nicht alle Kenngrössen sind gleich robust gegenüber Ausreissern. Ein Mass wie robust die Kenngrössen sind ist der sogenannte “Breakdown Point”. 3 Boxplot Das Originalrezept von Tukey, dem Erfinder des Boxplots, lautet : Drawing the box: Find the median. Then find the median of the data values whose ranks are less than or equal to the rank of the median. This will be a data value or it will be half way between two data values. Drawing the whiskers: The maximum length of each whisker is 1.5 times the interquartile range (IQR). To draw the whisker above the 3rd quartile, draw it to the largest data value that is less than or equal to the value that is 1.5 IQRs above the 3rd quartile. Any data value larger than that should be marked as an outlier. Heute gibt es viel verschiedene Formen, wie man einen Boxplot zeichnen kann. Es gibt Leute die verwenden anstelle des Median den Mittelwert. Es ist daher gut, wenn man immer angibt wie man den Boxplot konstruiert hat. Boxplot ● 0 1 2 3 4 5 6 gemessene Werte Abbildung 2: Boxplot: Histogramm Der grosse Vorteil eines Histogramms ist, dass diese Form der Abbildung sehr intuitiv verständlich ist. 4 Dichte 0.0 0.1 0.2 0.3 0.4 Histogramm 0 1 2 3 4 5 6 gemessene Werte Abbildung 3: Histogramm Ein grosser Nachteil ist jedoch, dass das Aussehen eines Histogramms sehr stark von der Wahl der Kästchenbreite und des Startpunktes abhängig ist. Anzahl Kästchen: 4 Startpunkt: 0 4 6 8 10 12 2 4 6 8 10 12 0.20 0.15 Density 0.05 0.00 0 2 4 6 8 10 12 6 8 10 12 4 6 8 10 0.20 x 12 Density 0.15 0.05 Density 0 2 4 6 8 10 12 0.00 0.05 0.00 0.05 0.00 4 2 Startpunkt: −1.8 0.10 0.20 0.10 0.15 frequency 0.15 0.10 frequency 0.05 2 0 x Startpunkt: −1.2 0.25 0.20 0.30 Anzahl Kästchen: 16 0.00 0 0.10 0.10 Density 0.05 0 0.15 2 Anzahl Kästchen: 8 0.10 0 0.00 0.00 0.00 0.05 0.10 frequency 0.15 0.15 0.15 0.10 0.05 frequency Startpunkt: −0.6 0.20 Anzahl Kästchen: 2 0 2 4 6 8 10 12 −2 0 2 4 6 8 10 12 Abbildung 4: Vier Ansichten der selben Messwerte die durch eine unterschiedliche Wahl der Kästchenbreite und des Startpunktes entstanden sind. Empirische Dichte Der Vorteil dieser Abbildung gegenüber einem Histogramm ist, dass man keinen Startpunkt mehr wählen muss. 5 0.0 0.1 0.2 0.3 0.4 Dichte Dichte "gaussian kernel" 0.0 0.1 0.2 0.3 0.4 "uniform kernel" 0 1 2 3 4 5 6 0 1 gemessene Werte 2 3 4 5 6 gemessene Werte Abbildung 5: Empirische Dichte: Links mit einem uniformen Kernel (hier nur abgebildet um zu verstehen, was ein Kernel ist), rechts mit einem gaussschen Kernel. 2.2 Wahrscheinlichkeitsverteilung In der Statistik gehen wir davon aus, dass eine Population unendlich gross ist. Um die Werte in einer Population beschreiben zu können verwenden wir Wahrscheinlichkeitsverteilungen. Das ist eine mathematische Beschreibung welche die Form, die Streuung und die Lage exakt festlegt. 0.25 χ2df=3 Dichte 0.20 6.25 0.15 0.10 0.05 0.1 0.04 0.00 0 1 2 3 4 5 6 7 8 9 x Abbildung 6: Wir sehen die Wahrscheinlichkeitsverteilung für einen Wert der χ2df=3 verteilt ist. χ2 ist der Name der Verteilung und der Parameter dieser Verteilung heisst “df” und ist im Beispiel drei. 6 2.3 Quantile-Quantile-Diagramm Theoretische Quantile (der Normalverteilung) ● ● 1 ● ● ● 0 ● ● ● −1 ● ● 0 1 2 3 4 5 6 Empirische Quantile entstprechen den geordneten Beobachtungen Abbildung 7: Quantile-Quantile-Diagramm, Normalverteilungs-Diagramm 2.4 Verteilung einer Statistik Dichte Varianz P n 1 2 s2 = n−1 i=1 (xi − x̄) Dichte Mittelwert Pn x̄ = n1 i=1 xi s2 x • Jede Statistik folgt einer “eigenen” Verteilung • Die Streuung ist von der Grösse, n, der Stichprobe abhängig • Die Form der Verteilung ist von der Grösse der Stichprobe unabhängig 2.4.1 Der Zentrale Grenzwertsatz Die Verteilung des Mittelwertes aus n-Messwerten nähert sich für wachsende n immer mehr einer Normalverteilung und dies unabhängig von der Verteilung aus welcher die Messwerte gezogen wurden. 7 1.0 0.8 0.8 Dichte Dichte 1.0 0.6 0.6 0.4 0.4 0.2 0.2 2 4 6 8 10 2 1.0 1.0 0.8 0.8 0.6 0.4 0.2 0.2 4 6 8 6 8 10 0.6 0.4 2 4 Mittelwerte aus 5 Messwerten Dichte Dichte Mittelwerte aus 1 Messwerten 10 2 Mittelwerte aus 25 Messwerten 4 6 8 10 Mittelwerte aus 50 Messwerten Abbildung 8: Empirische Dichte des Mittelwertes einer Stichprobe der Grösse 1, 5, 25 und 50 aus einer χ2 -Verteilung mit λ = 3, jeweils mit 9999 Ziehungen. 2.5 Vertrauensintervall Vertrauensintervalle nehmen eine sehr wichtige Stellung in der Statistik ein da Ihnen zwei sehr wichtige Funktionen zukommen. Erstens erlauben sie die Genauigkeit eines Schätzers zu beschreiben und zweitens erlauben sie eine Interpretation ensprechend einem statistischen Test. Ich finde ein Schätzer darf nie alleine stehen und muss immer von einem (meist 95% -)Vertrauensintervall begleitet werden. Nur so kann man beurteilen, wie genau die Schätzung ist. 3 Design 3.1 Zusammenhänge In der Wissenschaft dreht sich alles um Zusammenhänge. Daher ist es wichtig, dass wir ein Vokabular haben um Zusammenhänge zu beschreiben. Folgende Liste beschreibt einige Aspekte von Zusammenhängen. • Stärke • Folgerichtigkeit • Spezifität • Zeitlichkeit • Biologischer Gradient 8 • Plausibilität • Stimmigkeit • Experiment • Analogie Um einen Zusammenhang zu untersuchen gibt es zwei grundsätzlich unterschiedliche Wege, die sich darin unterscheiden, ob das “Exposure” zugeteilt wird oder ob die “Exposure”-Zuteilung nur gemessen oder beobachtet wird. 3.2 Fehler: zufällige und systematische Die Wahl des richtigen Designs zum Untersuchen eines Zusammenhanges hängt in erster Linie davon ab, welche Fehler erwartet werden. Man unterscheidet zufällige und systematische Fehler. Zufälliger Fehler Systematischer Fehler, Bias Diese beiden Fehler treten in Kombination auf, zwei Beispiele: Für die zufälligen Fehler haben wir die Statistik, welche es uns erlaubt, die Stichprobengrösse zu berechnen. Viel schwieriger ist der Umgang mit systematischen Fehlern und diese können bei allen Schritten des wissenschaftlichen Arbeitens auftreten: 9 • Literatursuche • Festlegen und Auswählen der Studienpopulation • Durchführen der experimentellen Intervention (“Exposure”) • Messen von “Exposure” und “Outcome” • Analysieren der Daten • Interpretieren der Analyse • Publizieren der Resultate Anhand ihrer Struktur kann man die systematischen Fehler folgendermassen einteilen. Confounding Bias “Exposure” und “Outcome” haben eine gemeinsame Ursache. Selection Bias Ein gemeinsamer Effekt von “Exposure” und “Outcome” wird berücksichtigt. Information Bias Systematisch fehlerhafte Information über“Exposure”,“Outcome” oder andere Variabeln welche für die Studie herangezogen werden. Confounding Bias Zufällige“Exposure”-Zuweisung erlaubt es,“Confounding” durch bekannte und unbekannte Variablen zu verhindern. Dies ist ein grosser Vorteil von experimenteller Wissenschaft. Durch das Anpassen der Datenanalyse lässt sich confounding Bias nur sehr beschränkt “korrigieren”. Es braucht dazu sehr viel Fachwissen, welches oft nicht vorhanden ist, um mögliche “Confounder” zu identifizieren, zu messen und mit gewissen Annahmen in der Analyse zu berücksichtigen. gemeinsame Ursache "Exposure" "Outcome" Abbildung 9: Struktur welche zu einem Confounding Bias führt. 10 Selection Bias Selection Bias kann bei allen wissenschaftlichen Arbeiten auftreten. Selbst bei einem experimentellen Design kann es durch fehlende Werte zu Selection Bias kommen. gemeinsame Ursache "Exposure" "Outcome" Abbildung 10: Struktur welche zu einem selection Bias führt. Information Bias Information Bias ist unabhängig von der kausalen Struktur und kommt durch fehlerhafte Informationen über Exposure, Outcome oder andere Variablen zustande. Wenn kategoriale Messgrössen handelt spricht man auch von “Missclassification Bias”. 4 Testen Ein Wissenschaftler nutzt alle Informationen die er hat (dazu gehört in der Regel viel Fachwissen) und Beobachtungen (eigentlich Stichprobe) um eine Hypothese zu formulieren. Um eine Hypothese zu testen werden entweder weitere Beobachtungen (hoffentlich in einer strukturierten, vordefinierten Form) gemacht oder es wird ein Experiment durchgeführt. Lange war es die Ansicht, dass es die Aufgabe der Wissenschaft sei Hypothesen zu beweisen. Die Wissenschaftstheorie des Falsifikationismus, nach Karl R. Popper, verlangt jedoch, dass man statt Hypothese zu beweisen, diese hinterfragen soll. So genügt zum Beispiel ein schwarzer Schwan um die Hypothese zu verwerfen, dass alle Schwäne weiss sind. In der Statistik nutzt man diesen Mechanismus indem man nicht eine Hypothese testet, sondern indem man ein sich gegenseitige ausschliessendes Paar von Null- und Alternativhypothese aufstellt. H0 H0 akzeptieren verwerfen H0 wahr (1-α) Typ I Fehler, α 1 − α: Vertrauensniveau 1 − β: Power 11 HA wahr Typ II Fehler, β (1-β) Glossar “Breakdown Point” Der “Breakdown Point” ist ein Mass dafür, wie robust ein Schätzwert ist. Er entspricht dem Anteil an falschen (z. B. beliebig grossen) Messwerten welche es erträgt, bevor ein Schätzwert ein beliebig falsches (z. B. grosses) Resultat annimmt. Mittelwert 0 Median 0.5 - Seite(n) 3 Daten Die Statistik beschäftigt sich in der Regel mit Messungen von mehreren Untersuchungseinheiten, daher gilt immer “data is plural”. - Seite(n) 2 Ganze Zahl . . . , −4, −3, −2, −1, 0, 1, 2, 3, 4, . . .- Seite(n) 3 Hypothese Eine Hypothese ist ein Erklärungsvorschlag für ein Phänomen. In der Wissenschaft beschäftigt man sich mit Hypothesen welche getestet werden können. Gemäss der Wissenschaftstheorie des Falsifikationismus kann eine Hypothese mit empirischer Forschung nicht bewiesen, sondern nur wiederlegt werden. Daher treten in der Statistik Hypothesen immer als sich gegenseitg ausschliessendes Gegensatzpaar auf. Nullhypothese, H0 : In der Regel die langweilige Version, z. B. es gibt keinen Unterschied. Alternativhypothese, H1 oder HA In der Regel innovativ. Es ist wichtig sich immer wieder klar zu werden, dass die Hypothesen sich auf die Population beziehen, daher formuliert man die Nullhypothese auch als H0 : µa − µb = 0 mit dem griechischen Alphabet.- Seite(n) 11 kontinuierlich 3 Median auch Zentralwert, “median” Sind alle Werte einer Stichprobe sortiert, steht der Median in der Mitte, der Median teilt die Stichprobe in zwei gleich grosse Hälften. Hat die Stichprobe eine gerade Anzahl an Untersuchungseinheiten, dann wählt man in der 12 Regel den Mittelwert der beiden mittleren Werte. Der Median ist ein sehr robustes Mass für die Lage. x[(n+1)/2] wenn n ungerade ist m= (1) 1 2 (x[n/2] + x[n/2+1] ) wenn n gerade ist - Seite(n) 3, 4 Messwert (auch Beobachtung, Merkmalsausprägung, Wert der Variable, “variate”) Eine einzelne Messung einer Variable. Ein Beispiel: Population = alle erwachsenen Menschen, Untersuchungseinheit = einzelne Personen, Variable = Körpergewicht, Messwert = 182cm - Seite(n) 2 Mittelwert auch Mittel, Durchschnitt, “mean” Der arithmetische Mittelwert entspricht der Summe aller Messwerte geteilt durch die Anzahl der Messwerte. n 1X xi (2) x̄ = n i=1 - Seite(n) 3, 4 Modus auch Modalwert, “mode” Entspricht dem häufigsten Wert in einer Stichprobe.- Seite(n) 3 Parameter Ein Parameter ist eine Grösse welche normalerweise eine Verteilung oder eine Charakteristik der Population beschreibt. Wir werden das griechische Alphabet verwenden um die Parameter zu bezeichnen und dadurch betonen, dass es sich um eine Charakteristik der Population handelt.- Seite(n) 6 Population auch Grundgesamtheit, statistische Population, “population” Die Gesamtheit aller Untersuchungseinheiten für die ein Rückschluss gezogen werden soll. Auch wenn die Populationen in den meisten biologischen Anwendungen endlich gross sind, werden wir sie “de facto” als unendlich gross behandeln.- Seite(n) 2, 6 Quantil Wie der Median eine Stichprobe teilt so dass die Hälfte der Messwert kleiner und die Hälfte grösser sind, so unterteilt ein α Quantil die Stichprobe im Verhältnis α zu 1 − α. x[αn+1/2] wenn αn ungerade ist m= (3) 1 (x + x ) wenn αn gerade ist [αn] [αn+1] 2 - Seite(n) 7 13 Quartilsabstand auch Interquartilsabstand, Quartils-Differenz, “interquartile range” - Seite(n) 3 Schiefe - Seite(n) 3 Schätzwert auch Schätzer, “estimate” Wendet man eine Statistik auf die Beobachtungen einer Stichprobe an, erhält man einen Schätzwert.- Seite(n) 6 Spannweite - Seite(n) 3 Statistik Die Statistik als Disziplin (“statistics” Mehrzahl) beschäftigt sich mit dem Sammeln, Organisieren, Analysieren, Interpretieren und Präsentieren von Daten (nach Dodge, Cox und Commenges 2006).- Seite(n) 1 Statistik Eine Statistik (auch Schätzfunktion, Stichprobenfunktion, “statistic” in der Einzahl) ist eine Funktion der Daten. Wendet man diese auf die Beobachtungen einer Stichprobe an, erhält man einen Schätzwert.- Seite(n) 7 Stichprobe Eine Stichprobe ist eine Teilmenge der Population. Die Anhahl der Untersuchungseinheiten einer Stichprobe bezeichnet man als Stichprobengrösse oder als Stichprobenumfang. Wenn eine Stichprobe durch zufälliges Ziehen aus der Population gezogen wird bezeichnet man sie auch als Zufallsstichprobe. Eine Zufallsstichprobe ist die Voraussetzung für die meisten statistischen Verfahren. - Seite(n) 2, 11 Untersuchungseinheit (auch Einheit, Elemente, Erhebungseinheit, Merkmalsträger, “sampling unit”) Sie sind die Grundeinheit einer statistischen Analyse. Dabei kann eine Untersuchungseinheit einer Person, einem Versuch, einem Betrieb, einer Pflanze einer Zelle oder einer Probefläche entsprechen. Wichtig für die Wahl einer Untersuchungseinheit ist, dass diese hinsichtlich dem Zusammenhang den man untersuchen möchte unabhängig sind, sonst muss man spezielle statistische Verfahren anwenden. An einer Untersuchungseinheit werden oft mehrere Variable gemessen. In einem einfachen Datenset entspricht jeweils eine Zeile einer Untersuchungseinheit. - Seite(n) 2 14 Variable auch Messgrösse, Merkmal, statistische Variable Eine Variable ist eine Eigenschaft hinsichtlich derer sich die Untersuchungseinheiten einer Stichprobe unterscheiden. Der Philosoph und Mathematiker René Descartes hat eingeführt, dass man Buchstaben am Anfang des Alphabetes, z.B. a, b, c für Konstanten und Buchstaben am Ende des Alphabetes, z.B. x, y, z für Variablen verwendet. Beide, Konstanten und Variablen werden in der Regel kursiv verwendet. Die Auswahl der Variablen liegt in der Verantwortung des Wissenschaflters, z. B. dem Biologen und nicht in der Verantwortung des Statistikers.- Seite(n) 2, 3 Varianz Die Varianz einer Stichprobe misst die Streuung einer kontinuierlichen Variable. n 1 X (xi − x̄)2 (4) s2 = n − 1 i=1 Die Masseinheit der Varianz entspricht dem Quadrat der Masseinheit der Variable (z. B. m2 für die Varianz wenn die Variable in m gemessen wurde).- Seite(n) 3 Vertrauensintervall auch Konfidenzintervall, “confidence interval” Das Vertrauensintervall ist ein Intervall-Schätzer für einen Parameter. Es wird häufig verwendet um anzugeben wie verlässlich ein Schätzer ist. Das Vertrauensintervall wird aus den Messwerten einer Stichprobe berechnet. Es variert daher von Stichprobe zu Stichprobe. Wenn wir mehrmals ein Stichprobe ziehen und jeweils das Vertrauensintervall berechnen, dann gibt uns das Vertrauensniveau (häufig 0.95 oder 95%) an, welcher Anteil an solchen Vertrauensintervallen den Parameter enthalten. Häufiger wird fälschlicherweise angenommen, dass das Vertrauensintervall den Parameter mit der Wahrscheinlichkeit des Vertrauensniveaus, z. B. 95%, enthält. Sobald wir eine Stichprobe gezogen haben und das Vertrauensintervall berechnet haben, dann enthält dieses Intervall den Parameter oder nicht.- Seite(n) 8 Wölbung - Seite(n) 3 15 Literatur Dodge, Y., D. Cox und D. Commenges (2006). The Oxford dictionary of statistical terms. Oxford University Press, USA. 16