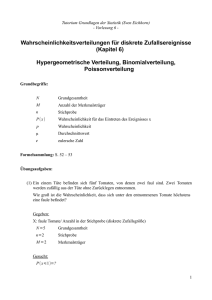

Peter Hautz Skript zur Einführung Version 3.1

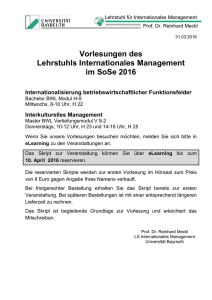

Werbung