3 Stetige Zufallsvariablen

Werbung

3

Stetige Zufallsvariablen

Eine Zufallsvariable heißt stetig, falls zu je zwei

Werten a < b auch jeder Zwischenwert im Intervall

[a, b] möglich ist

Beispiele:

X = „Alter“, X = „Körpergröße“, X = „Temperatur“,

X = „Intelligenzquotient“

In der Praxis kommen häufig Variablen vor, die als

quasistetig aufzufassen sind. Quasistetig bedeutet,

dass eine Zufallsvariable extrem viele Ausprägungen

besitzt und die Wahrscheinlichkeit eines einzelnen möglichen Wertes vernachlässigbar klein ist. Solche Merkmale werden in der Statistik wie stetige Zufallsvariablen behandelt.

Beispiele:

X = „Einkommen“, X = „Vermögen“, X = „Umsatz

einer Firma“,

Statistik_II@finasto

3–1

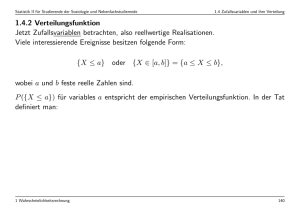

3.1

Wahrscheinlichkeitsverteilungen

Modellierung von stetigen Zufallsvariablen:

• P [X = x] = 0 für einen einzelnen möglichen

Wert x

• Ansatz: Man betrachtet Intervalle und zugehörige Wahrscheinlichkeiten

P [X ∈ [a, b]]

Wahrscheinlichkeiten stetiger

blen

Für stetige Zufallsvariablen X gilt

P [a ≤ X ≤ b] =

Zufallsvaria-

P [a < X ≤ b] = P [a ≤ X < b]

= P [a < X < b]

und

P [X = x] = 0

Statistik_II@finasto

für jedes x ∈ R

3–2

Die Verteilung einer stetigen Zufallsvariablen lässt sich

durch die zugehörige Dichtefunktion charakterisieren. Wahrscheinlichkeiten ergeben sich als Flächen unter der Dichtefunktion.

Analogie (Statistik I): Histogramm eines stetigen Merkmals

• Gruppierung anhand von Klassen benachbarter

Intervalle [c0 , c1 ), [c1 , c2 ), . . . , [ck−1 , ck ) der gleichen

Klassenbreite δ

• Berechnung der relativen Häufigkeit fj für jede

Klasse [cj−1 , cj )

• Histogrammwerte innerhalb jeder Klasse: fj /δ

• Fläche des Histogramms über [cj−1 , cj ) = fj

Verhalten für großes n:

• fj nahe an P [cj−1 ≤ X < cj ]

• Falls n → ∞ und gleichzeitig δ → 0, so konvergiert das Histogramm gegen eine Funktion

f (x) ≥ 0 (=Dichtefunktion)

P [a ≤ X ≤ b] = Fläche von f (x) über [a, b]

∫ b

=

f (x)dx

a

Statistik_II@finasto

3–3

Stetige Zufallsvariable

0

Histogramm

0.2

0.4

n=50

0

Histogramm

0.2

0.4

n=500

0

Histogramm

0.2

0.4

n=5000

0

0.2

Dichte

0.4

Model

Statistik_II@finasto

3–4

Flächen und Integrale:

Für eine positive Funktion f (x) ≥ 0 gilt

∫ b

f (x)dx = Fläche von f (x) über [a, b]

a

Man betrachte eine allgemeine Funktion g(x) mit

positiven und negativen Werten.

• positiver Teil von g(x):

g+ (x) = max{0, g(x)}

• negativer Teil von g(x):

g− (x) = min{0, g(x)}

∫

b

⇒

g(x)dx = Fläche von g+ (x) über [a, b]

a

− Fläche von g− (x) über [a, b]

Statistik_II@finasto

3–5

Stetige Zufallsvariablen und Dichten

X stetige Zufallsvariable: Es existiert eine Funktion

f (x), so dass für jedes Intervall [a, b]

∫ b

P [a ≤ X ≤ b] =

f (x)dx

a

f heißt (Wahrscheinlichkeits-) Dichte von X

Eigenschaften von Dichten:

• Positivität: f (x) ≥ 0

• Normierung: Die Gesamtfläche zwischen

x-Achse und f (x) ist gleich 1,

∫ ∞

P [−∞ < X < ∞] =

f (x)dx = 1

−∞

Verteilungsfunktion einer stetigen Zufallsvariablen

∫

F (x) = P [X ≤ x] =

Statistik_II@finasto

x

f (t)dt

−∞

3–6

Wahrscheinlichkeitsdichte:

Z 1

f (x)

0;

f (x)dx = 1:

+

1

Verteilungsfunktion:

F

F

(x) monoton wachsend

(

1) = 0

;

F

1) = 1

(+

1

Verteilungsfunktion

1

Dichtefunktion

:

0.8

0.6

F(x)

f(x)

0.6

0.8

F(x)

0.4

0.4

f(x)

0.2

0.2

F(b)

F(b)

b

0

b

-3

-2

-1

0

x

Statistik_II@finasto

1

2

3

-3

-2

-1

0

1

2

3

x

3–7

Die Verteilungsfunktion ist ein zentrales Werkzeug zur

Berechnung von Wahrscheinlichkeiten. Die Verteilungsfunktion einer stetigen Zufallsvariable besitzt folgende

Eigenschaften:

• F (x) ist eine stetige, monoton wachsende Funktion, 0 ≤ F (x) ≤ 1.

• F (a) = P [X < a]

• P [X ≥ a] = P [X > a] = 1 − F (a)

• P [a ≤ X ≤ b] = P [a < X < b] = F (b) − F (a)

Interpretation von Dichten:

• f (x) groß für alle Werte in einem Intervall [a, b]:

Es besteht eine relativ hohe Wahrscheinlichkeit,

dass X einen Wert in [a, b] annimmt

• f (x) sehr klein für alle Werte in einem Intervall

[c, d]: Es besteht eine sehr geringe Wahrscheinlichkeit, dass X einen Wert in [c, d] annimmt

Statistik_II@finasto

3–8

Klassifikation von Verteilungen

symmetrisch, unimodal

0.4

0.3

0.2

0.1

0.0

-3

-2

-1

0

1

2

3

rechtssteil

linkssteil

0.6

0.6

0.4

0.4

0.2

0.2

0.0

0.0

0

1

2

3

-4

4

-3

bimodal

-2

-1

multimodal

1.0

4

0.8

3

0.6

2

0.4

1

0.2

0.0

0

-3

-2

-1

Statistik_II@finasto

0

1

2

3

-2.5

-2.0

-1.5

-1.0

-0.5

0.0

0.5

1.0

1.5

2.0

2.5

3–9

3.0

Spezialfall: Stetige Gleichverteilung

Stetige Gleichverteilung

Eine stetige Zufallsvariable mit Ausprägungen in einem Intervall [a, b] heißt gleichverteilt, falls für jedes Teilintervall [c, d] ⊂ [a, b] gilt

d−c

P [c ≤ X ≤ d] =

b−a

Man schreibt: X ∼ U (a, b)

Wahrscheinlichkeitsdichte

fU (x) =

1

b−a

FU (x) =

Statistik_II@finasto

für a ≤ x ≤ b

0

sonst

0

für x < a

Verteilungsfunktion

x−a

b−a

für a ≤ x ≤ b

1

für x > b

3–10

Stetige Gleichverteilung auf [1, 6]

0.15

0.05

0.1

f(x)

0.2

0.25

Dichtefunktion (stetige Gleichverteilung)

1

2

3

4

x

5

6

0.5

0

f(x)

1

Verteilungsfunktion (stetige Gleichverteilung)

0

Statistik_II@finasto

1

2

3

x

4

5

6

7

3–11

Beispiel: Wartezeit auf eine Straßenbahn

• Ideale Welt: An einer bestimmten Haltestelle hält

jeweils genau alle 20 Minuten eine Straßenbahn

• Eine Person kommt ohne Kenntnis des Fahrplans

zu einer zufälligen Zeit an die Haltestelle

X = „Wartezeit (in Minuten) auf die nächste Straßenbahn“

⇒

X ∼ U (0, 20)

P [0 ≤ X ≤ 20] = 1

10

= 0, 5

20

10

P [X ≥ 10] = 1 −

= 0, 5

20

10

5

P [5 ≤ X ≤ 10] =

−

= 0, 25

20 20

P [X ≤ 10] =

Statistik_II@finasto

3–12

3.2

Verteilungsparameter

Erwartungswert

Diskrete Zufallsvariable:

µ = E(X) =

∑

xi f (xi )

i≥1

Stetige Zufallsvariable:

∫

∞

µ = E(X) =

−∞

x · f (x)dx

Rechenregeln:

• Y = aX + b, a, b beliebig

E(Y ) = E(aX + b) = aE(X) + b

• Für zwei Zufallsvariablen X und Y

E(X + Y ) = E(X) + E(Y )

Beispiel: X ∼ U (a, b) → E(X) =

Statistik_II@finasto

a+b

2

3–13

Beispiele: Zwei Verteilungen mit

∫ x

E(X) =

x · f (x)dx = 0

−∞

y

0.3

0

0

0.1

0.1

0.2

0.2

y

0.3

0.4

0.5

Wahrscheinlichkeitsdichte f(x)

0.4

Wahrscheinlichkeitsdichte f(x)

-5

0

x

5

-3

-2

-1

1

2

3

1

2

3

x f(x)

0

-0.5

-0.2

-0.1

0

y

y

0.1

0.2

0.5

x f(x)

0

x

-5

E(X) = 0

Statistik_II@finasto

0

x

5

-3

-2

-1

0

x

E(X) = 0

3–14

Beispiele mit E(X) = 0 und E(X) > 0

0

0.1

0.2

y

0.3

0.4

Wahrscheinlichkeitsdichte f(x)

-5

0

x

5

-0.2

-0.1

0

y

0.1

0.2

x f(x)

-5

0

x

5

E(X) = 0

0

0.1

0.2

y

0.3

0.4

Wahrscheinlichkeitsdichte f(x)

-5

0

x

5

0

0.2

y

0.4

x f(x)

-5

0

x

5

E(X) = 1

0

0.1

0.2

y

0.3

0.4

Wahrscheinlichkeitsdichte f(x)

-5

0

x

5

0

0.2

0.4

y

0.6

0.8

x f(x)

-5

0

x

5

E(X) = 2

Statistik_II@finasto

3–15

Varianz

Diskrete Zufallsvariable:

2

σ = Var(X) =

∑

(xi − µ)2 f (xi )

i≥1

Stetige Zufallsvariable:

∫

σ 2 = Var(X) =

∞

−∞

(x − µ)2 · f (x)dx

√

σ = Var(X) heißt Standardabweichung

Rechenregeln:

• Var(X) = E(X − µ)2 = E(X 2 ) − µ2

• Y = aX + b, a, b beliebig

Var(Y ) = Var(aX + b) = a2 · Var(X)

• Für unabhängige Zufallsvariablen X und Y

Var(X + Y ) = Var(X) + Var(Y )

Beispiel: X ∼ U (a, b) ⇒ Var(X) =

Statistik_II@finasto

(b−a)2

12

3–16

• Der Erwartungswert µ = E(X) ist ein Lageparameter, der Aufschluss über das Zentrum der Verteilung gibt.

• Die Standardabweichung ist ein Maß für die

Dispersion

Ungleichung von Tschebyscheff:

1

P [|X − µ| > kσ] ≤ 2

k

für alle k > 0

1

k2

[µ − kσ, µ + kσ] heißt zentrales Schwankungsintervall

⇒ P [µ − kσ ≤ X ≤ µ + kσ] ≥ 1 −

k

P [µ − kσ ≤ X ≤ µ + kσ]

2

≥1−

3

≥1−

4

≥1−

1

4 = 0, 75

1

9 ≈ 0, 89

1

16 = 0, 9375

Achtung: Die Ungleichung gibt nur eine untere Schranke für die Wahrscheinlichkeit. Genauere Berechnungen

auf der Basis spezieller Verteilungsmodelle.

Statistik_II@finasto

3–17

Beispiel:

X

EX

Zufallsvariable

mit ( ) = 0,

(Dichte = Glockenkurve)

V ar(X ) = 1

Y

0

0.2

0.4

k=1: P(-1<X<1) = 0.6827

-4

-2

0

X

2

4

Y

0

0.2

0.4

k=2: P(-2<X<2) = 0.9545

-4

-2

0

X

2

4

Y

0

0.2

0.4

k=3: P(-3<X<3) = 0.9973

-4

-2

0

X

2

4

Y

0

0.2

0.4

k=4: P(-4<X<4) = 0.9999

-4

Statistik_II@finasto

-2

0

X

2

4

3–18

Beispiel:

X

EX

Zufallsvariable

mit ( ) = 0,

(Dichte = schiefe Dichte)

V ar(X ) = 1

0

Y

0.2

k=1: P(-1<X<1) = 0.5443

-3

-2

-1

0

1

2

X

3

4

5

6

7

6

7

6

7

6

7

0

Y

0.2

k=2: P(-2<X<2) = 0.9089

-3

-2

-1

0

1

2

X

3

4

5

0

Y

0.2

k=3: P(-3<X<3) = 0.9579

-3

-2

-1

0

1

2

X

3

4

5

0

Y

0.2

k=4: P(-4<X<4) = 0.9808

-3

Statistik_II@finasto

-2

-1

0

1

2

X

3

4

5

3–19

Weitere Verteilungsparameter einer stetigen Zufallsvariable X

Modus: xmod ist ein Wert, für den die Dichtefunktion

f (x) maximal wird.

Median: xmed ist der Wert, für den gilt:

F (xmed ) = P [X ≤ xmed ] = P [X ≥ xmed ] = 1−F (xmed ) =

Quantile: Für 0 < p < 1 ist das p-Quantil xp der

Wert, für den

F (xp ) = P [X ≤ xp ] = p

und

1 − F (xp ) = P [X ≥ xp ] = 1 − p

gilt.

Median und Quantile sind eindeutig bestimmt, wenn

die Verteilungsfunktion F streng monoton ist.

Statistik_II@finasto

3–20

1

2

Illustration: Quantil xp

Verteilungsfunktion: P [X ≤ xp ] = F (xp ) = p

1.0

F(x)

0.8

p

0.6

0.4

0.2

0.0

-3

-2

-1

0

1

xp

2

3

Dichte: Das Quantil xp teilt die Gesamtfläche von f

über der x-Achse in zwei Teile der Größen

p = P [X ≤ xp ] und 1 − p = P [X ≥ xp ] auf.

0.4

0.3

0.2

0.1

p

1-p

0.0

-3

Statistik_II@finasto

-2

-1

0

xp

1

2

3

3–21

Lageregeln

Symmetrische Verteilung: xmod = xmed = µ

xmod = xmed = µ

Linkssteile Verteilung: xmod ≤ xmed ≤ µ

xmod xmed

µ

Rechtssteile Verteilung: µ ≤ xmed ≤ xmod

µ

Statistik_II@finasto

xmed xmod

3–22

3.3

Die Exponentialverteilung

Exponentialverteilung

Eine stetige Zufallsvariable X mit nichtnegativen

Werten heißt exponentialverteilt mit Parameter

λ > 0, kurz X ∼ Ex(λ), wenn sie die Dichte

λe−λx für x ≥ 0

fEx (x) =

0

sonst

besitzt.

Es gilt:

E(X) = λ1 ,

Var(X) =

1

λ2

Dichten der Exponentialverteilung

1.0

λ=1

0.8

0.6

0.4

λ=0,5

0.2

0.0

0

2

Statistik_II@finasto

4

6

8

10

3–23

Verteilungsfunktion

1 − e−λx für x ≥ 0

FEx (x) =

0

für x < 0

Zusammenhang mit der Poisson-Verteilung:

Anzahl des Auftretens eines Ereignisses

Y =

„A“ in einem festen Zeitintervall [0, 1]

Yt =

Anzahl des Auftretens des Ereignisses

„A“ in dem Zeitintervall [0, t]

Y ∼ P o(λ)

⇒

Yt ∼ P o(λt)

Für

X = Wartezeit bis zum ersten Auftreten

des Ereignisses „A“

gilt dann

X ∼ Ex(λ),

denn

P [X ≤ t] = 1 − P [Yt = 0] = 1 − e−λt

Statistik_II@finasto

3–24

3.4

Die Normalverteilung

(Gauß-Verteilung)

Normalverteilung

Eine Zufallsvariable X heißt normalverteilt mit

Parametern µ ∈ R und σ 2 > 0, kurz X ∼ N (µ, σ 2 ),

wenn sie die Dichte

(

)

2

1

(x − µ)

f (x) = √

exp −

für x ∈ R

2

2σ

2πσ

besitzt.

Es gilt: E(X) = µ, Var(X) = σ 2

• Die Normalverteilung wird auch als Gauß-Verteilung

und die Dichte als Gauß-Kurve bezeichnet

• Die Normalverteilung spielt eine zentrale Rolle

in der induktiven Statistik. Bei sehr vielen Zufallsphänomenen wird angenommen, dass sie zumindest approximativ normalverteilt sind.

• Normalverteilungen sind unimodal und symmetrisch un ihren Mittelwert µ

Statistik_II@finasto

3–25

Gauß-Kurven mit µ = 0 und σ 2 = 0.25, 1, 4

N(0,0.25)

0.8

0.6

0.4

N(0,1)

0.2

N(0,2)

0.0

-4

-2

0

2

4

Gauß-Kurven mit µ = −1, 0, 2 und σ 2 = 1

N(0,1)

0.4

N(2,1)

N(-1,1)

0.3

0.2

0.1

0.0

-4

-2

0

2

4

Gauß-Kurven mit verschiedenen µ und σ 2

N(2,0.16)

1.0

0.8

0.6

N(0,1)

0.4

N(-1,2.25)

0.2

0.0

-4

Statistik_II@finasto

-2

0

2

4

3–26

Spezialfall mit µ = 0, σ 2 = 1:

Standardnormalverteilung N (0, 1)

Dichte der Standardnormalverteilung N (0, 1):

( 2)

1

x

ϕ(x) = √ exp −

für x ∈ R

2

2π

Verteilungsfunktion:

∫

Φ(x) =

∫

x

x

ϕ(t)dt =

−∞

−∞

( 2)

1

t

√ exp −

dt

2

2π

• Die Standardnormalverteilung ist symmetrisch zum

Nullpunkt,

Φ(−x) = 1 − Φ(x)

• Die Werte von Φ(z) sind tabelliert.

Statistik_II@finasto

3–27

Die Quantile der Standardnormalverteilung

Die Quantile der Standardnormalverteilung sind durch

Φ(zp ) = p

bestimmt. Wegen der Symmetrie gilt

zp = −z1−p

p

50%

75%

90%

95%

97,5%

99%

zp

0 = xmed

0,675

1,282

1,645

1,960

2,326

0.4

φ(x)

0.3

0.2

0.1

1-p

1-p

0.0

-3

Statistik_II@finasto

-2

-zp

-1

0

1

zp

2

3

3–28

Rückführung einer allgemeinen N (µ, σ 2 )-Verteilung auf

die Standardnormalverteilung:

Standardisierung:

Ist X ∼ N (µ, σ 2 ), so ist die standardisierte Zufallsvariable

X −µ

Z=

σ

standardnormalverteilt, d.h. Z ∼ N (0, 1)

Für die Verteilungsfunktion F von X gilt:

(

)

x−µ

x−µ

F (x) = Φ

= Φ(z) mit z =

σ

σ

Quantile: Für 0 < p < 1 berechnet sich das pQuantil xp der N (µ, σ)-Verteilung durch

zp =

xp − µ

bzw xp = µ + σzp

σ

⇒ P [a ≤ X ≤ b] = F (b) − F (a)

(

)

(

)

b−µ

a−µ

=Φ

−Φ

σ

σ

Statistik_II@finasto

3–29

Beispiel: Füllmenge von Bier

In einer Abfüllanlage werden Flaschen mit nominal

50 cl Bier gefüllt. Die Anlage arbeitet jedoch nicht

vollständig exakt. Im Mittel werden tatsächlich 50 cl

eingefüllt, die Standardabweichung beträgt jedoch 1,2

cl.

Modell:

X = „Füllmenge“ ∼ N (50, 1.44)

(

)

52 − 50

P [X ≤ 52] = F (52) = P Z ≤

1, 2

= P [Z ≤ 1, 67] = Φ(1, 67) = 0, 953

P [X ≥ 49] = 1 − F (49)

(

)

49 − 50

= 1 − Φ(−0, 833)

=1−Φ

1, 2

= 1 − (1 − Φ(0, 833)) = 0, 797

Statistik_II@finasto

3–30

Zentrale Schwankungsintervalle

Ist X ∼ N (µ, σ 2 ), so gilt für α > 0

P [µ − z1−α/2 σ ≤ X ≤ µ + z1−α/2 σ] = 1 − α

Für z1−α/2 = k erhält man die Bereiche

P [µ − σ ≤ X ≤ µ + σ] = 0, 6827

k=1:

k=2:

P [µ − 2σ ≤ X ≤ µ + 2σ] = 0, 9545

k=3:

P [µ − 3σ ≤ X ≤ µ + 3σ] = 0, 9973

1−α

α/2

µ−z1-α/2 σ

Statistik_II@finasto

α/2

µ

µ+z1-α/2 σ

3–31

Beispiel: Füllmenge von Bier

X = „Füllmenge“ ∼ N (50, 1.44)

Frage: Zwischen welchen Werten liegt die tatsächliche Füllmenge mit einer Wahrscheinlichkeit von

95%?

0, 95 = 1 − α ⇒ α = 0, 05, z1−α/2 = z0,975 = 1, 96

⇒ P [µ − 1, 96σ ≤ X ≤ µ + 1, 96σ] = 1 − α = 0, 95

Anwendung auf Füllmenge: P [47, 65 ≤ X ≤ 52, 35] =

0, 95

95%

2,5%

2,5%

µ−1.96σ

Statistik_II@finasto

µ

µ+1.96σ

3–32

Eigenschaften der Normalverteilung:

Lineare Transformation

Für X ∼ N (µ, σ 2 ) ist die linear transformierte Variable Y = aX + b wieder normalverteilt mit

Y ∼ N (aµ + b, a2 σ 2 )

Addition

2

Sind X ∼ N (µX , σX

) und Y ∼ N (µY , σY2 ) normalverteilt und unabhängig, so gilt

2

X + Y ∼ N (µX + µY , σX

+ σY2 )

Verallgemeinerung: Sind Xi ∼ N (µi , σi2 ) unabhängig, so ist jede Linearkombination Y = a1 X1 +

. . . + an Xn normalverteilt mit

Y ∼ N (a1 µ1 + . . . + an µn , a21 σ12 + . . . + a2n σn2 )

Statistik_II@finasto

3–33

Der zentrale Grenzwertsatz

Zufallsvariable X (diskret oder stetig)

Beispiele: X =”Geschlecht einer zufällig ausgewählten

Person” (0/1 falls weiblich/männlich); X =”Einkommen

einer zufällig ausgewählten Person”,

Einfache Zufallsstichprobe des Umfangs n (bzw. nmalige unabhängige Wiederholung des Zufallsexperiments):

• Folge X1 , . . . , Xn von Zufallsvariablen, die jeweils

eine einzelne Ziehung (Wiederholung) beschreiben

• Alle Xi haben die gleiche Verteilung wie X und

X1 , . . . , Xn sind voneinander unabhängig,

µ = E(X) = E(Xi ),

σ 2 = Var(X) = Var(Xi )

X1 , . . . , Xn - unabhängig und identisch verteilte Zufallsvariablen (mit Mittelwert µ und Varianz σ 2 )

Statistik_II@finasto

3–34

Man betrachte nun den Mittelwert:

n

∑

1

• X̄ = n

Xi (Zufallsvariable!!)

i=1

• x̄ =

1

n

n

∑

xi tatsächlich beobachteter (realisierter)

i=1

numerischer Wert (z.B. x̄ = 0, 0456)

Zentraler Grenwertsatz

Seien X1 , . . . , Xn unabhängig und identisch verteilte

Zufallsvariablen mit Mittelwert µ und Varianz σ 2 .

Dann gilt

(

)

X̄ − µ

√ ≤ z → Φ(z) für n → ∞

P

σ/ n

Mit anderen Worten: Für großes n gilt approximativ

(

)

2

σ

X̄ ∼ N µ,

n

Folgerung für Summen von Zufallsvariablen:

n groß, so gilt approximativ

n

∑

Xi ∼ N (nµ, nσ 2 )

i=1

Anmerkung: Die asymptotische Normalität von X̄ gilt

unabhängig von der Struktur der Verteilung der Xi (diese

Verteilung ist natürlich für alle Stichprobenumfänge n die

gleiche (z:B. Exponentialverteilung, Bernoulli, etc.)

Statistik_II@finasto

3–35

Beispiel:

N = 7 Kugeln: 10, 11, 11, 12, 12, 12, 16

X: „Zahl auf einer zufällig gezogenen Kugel“

x

10

11

12

16

f (x)

1/7

2/7

3/7

1/7

µ = E(X) = 12,

σ 2 = Var(X) = 22/7 = 3.143

Einfache Zufallsstichprobe (n = 2): Unabhängig

und identisch verteilte Zufallsvariablen X1 und X2

X1 : „Zahl auf der 1. gezogenen Kugel“

X2 : „Zahl auf der 2. gezogenen Kugel“

Mögliche Realisationen:

2.Kugel

1.Kugel

10

11

11

12

12

12

16

10

(10;10)

10;11

10;11

10;12

10;12

10;12

10;16

11

11;10

(11;11)

11;11

11;12

11;12

11;12

11;16

11

11;10

11;11

(11;11)

11;12

11;12

11;12

11;16

12

12;10

12;11

12;11

(12;12)

12;12

12;12

12;16

12

12;10

12;11

12;11

12;12

(12;12)

12;12

12;16

12

12;10

12;11

12;11

12;12

12;12

(12;12)

12;16

16

16;10

16;11

16;11

16;12

16;12

16;12

(16;16)

Statistik_II@finasto

3–36

Mögliche Stichprobenmittelwerte x̄

2. Kugel

1. Kugel

10

11

11

12

12

12

16

10

(10)

10,5

10,5

11

11

11

13

11

10,5

(11)

11

11,5

11,5

11,5

13,5

11

10,5

11

(11)

11,5

11,5

11,5

13,5

12

11

11,5

11,5

(12)

12

12

14

12

11

11,5

11,5

12

(12)

12

14

12

11

11,5

11,5

12

12

(12)

14

16

13

13,5

13,5

14

14

14

(16)

Wahrscheinlichkeitsverteilung von X̄

x

10

10.5

11

11.5

12

13

13,5

14

16

f (x)

1

49

4

49

10

49

12

49

9

49

2

49

4

49

6

49

1

49

E(X) = 12 = µ,

Var(X) = 22/14 = σ 2 /2

Für wachsendes n gibt es immer mehr mögliche Werte

von X ⇒ Übergang zu einer quasistetigen Verteilung,

die sich für genügend großes n durch eine Normalverteilung approximieren lässt

(

)

22/7

X̄ ∼ N 12,

n

Statistik_II@finasto

3–37

Verteilungen der Zufallsvariablen Xi

E(X)

E(X)

Zugehörige Verteilungen des Mittelwertes X̄ =

E(X)

E(X)

E(X)

E(X)

E(X)

1

n

∑n

i=1

E(X)

n=2

E(X)

E(X)

E(X)

E(X)

E(X)

E(X)

n=4

E(X)

E(X)

n = 30

Statistik_II@finasto

3–38

Xi

Verhalten von X̄ für n → ∞:

σ

σ

√

√

P [µ − z1−α/2

≤ X̄ ≤ µ + z1−α/2

]≈1−α

n

n

Die Länge 2z1−α/2 √σn dieser zentralen Schwankungsintervalle wird für steigendes n immer kleiner.

n=1600

n=100

α/2

1−α

1−α

α/2

α/2

µ

Beispiel: σ = 1, α = 0, 05 ⇒ z1−α/2 √σn =

α/2

µ

1,96

√

n

n = 100

P [µ − 0, 196 ≤ X̄ ≤ µ + 0, 196] ≈ 0, 95

n = 1600

P [µ − 0, 049 ≤ X̄ ≤ µ + 0, 049] ≈ 0, 95

⇒ Für großes n ist zu erwarten, dass der beobachtete Mittelwert x̄ sehr nahe am Erwartungswert

µ der Zufallsvariablen liegt (Gesetz der großen

Zahlen)

Statistik_II@finasto

3–39

Anwendung des zentralen Grenzwertsatzes: Approximation der Binomialverteilung

Zentraler Grenzwertsatz

Sei X ∼ B(n, p). Für großes n gilt approximativ

X − np

Z=√

∼ N (0, 1)

np(1 − p)

bzw.

X ∼ N (np, np(1 − p))

Faustregeln: np ≥ 5, n(1 − p) ≥ 5

Anwendung (mit Stetigkeitskorrektur):

(

)

x − 0, 5 − np

P [X < x] ≈ Φ √

np(1 − p)

)

(

x + 0, 5 − np

P [X ≤ x] ≈ Φ √

np(1 − p)

⇒ P [x1 ≤ X ≤ x2 ]

)

)

(

(

x2 + 0, 5 − np

x1 − 0, 5 − np

√

√

≈Φ

−Φ

np(1 − p)

np(1 − p)

Statistik_II@finasto

3–40

3.5

Spezielle Verteilungsmodelle

χ2 -Verteilung

Seien X1 , . . . , Xn unabhängige und identisch

N (0, 1)-verteilte Zufallsvariablen. Dann heißt die

Verteilung von

χ2 = X12 + · · · + Xn2

Chi-Quadrat-Verteilung mit n Freiheitsgraden,

kurz χ2 ∼ χ2 (n).

Es gilt:

E(χ2 ) = n,

Var(χ2 ) = 2n

Dichten der χ2-Verteilung

0.5

n=2

0.4

0.3

0.2

n=5

0.1

n=10

0.0

0

Statistik_II@finasto

5

10

15

20

3–41

• Die Dichten der χ2 -Verteilung sind linkssteil, nähern sich jedoch für große n der Gauß-Kurve an

(zentraler Grenzwertsatz)

• n > 30: χ2 (n) ≈ N (n, 2n)

• Wichtige Quantile der χ2 (n)-Verteilung sind tabelliert. Für n > 30 benutzt man eine Normalverteilungsapproximation

χ2p;n

√

1

= (zp + 2n − 1)2

2

Anwendungsbereich: Verfahren der inferentiellen

Statistik (Anpassungstests, Tests im Zusammenhang

mit Varianzen); spezielle Lebensdauermodelle

Statistik_II@finasto

3–42

t-Verteilung, Student-Verteilung

Seien X ∼ N (0, 1) und Y ∼ χ2n unabhängig. Dann

heißt die Verteilung von

X

√

T =

Y /n

t-Verteilung mit n Freiheitsgraden, kurz T ∼ t(n).

Es gilt:

E(T ) = 0, (n > 1),

n

, (n > 2)

Var(T ) = n−2

Dichten der Student-Verteilung

0.4

n=10

0.3

0.2

0.1

n=1

0.0

-4

Statistik_II@finasto

-2

0

2

4

3–43

• Die Dichten der t-Verteilung sind symmetrisch um

0. Im Vergleich zu ϕ besitzen sie für kleine n größere Enden, d.h. die Flächen unter den Dichtekurven für kleine und große Werte x sind größer.

• n groß (n > 30): t(n) ≈ N (0, 1)

• Wichtige Quantile der t(n)-Verteilung sind tabelliert. Für n > 30 benutzt man eine Normalverteilungsapproximation

tp;n ≈ zp

Anwendungsbereich: Verfahren der inferentiellen Statistik (Tests im Zusammenhang mit Mittelwerten); robuste

Statistik (Modellierung von Daten mit einem hohen Anteil

extremer Werte)

Statistik_II@finasto

3–44

Fisher-Verteilung

Seien X ∼ χ2 (m) und Y ∼ χ2 (n) unabhängig. Dann

heißt die Verteilung von

X/m

F =

Y /n

Fisher- oder F -Verteilung mit den Freiheitsgraden m und n, kurz F ∼ F (m, n).

n

Es gilt: E(F ) = n−2

(für n > 2)

Anwendungsbereich: Quantile der F -verteilung (tabelliert) werden bei Testverfahren in der Regressions- und

Varianzanalyse benötigt

Dichten der F-Verteilung

F(50,50)

1.2

F(2,10)

0.8

F(10,3)

0.4

0.0

0

Statistik_II@finasto

1

2

3

4

3–45