10.1 Über den Begriff “Stochastik” Die Wahrscheinlichkeitsrechnung

Werbung

10.1 Über den Begriff “Stochastik”

Die Wahrscheinlichkeitsrechnung ist eine Teildisziplin von

Stochastik.

Dabei kommt das Wort “Stochastik” aus dem Griechischen :

“die Kunst des Vermutens” (von “Vermutung, Ahnung, Ziel”).

in seinem Buch

Dieser Begriff wurde von Jacob Bernoulli

“Ars conjectandi” geprägt (1773), in dem

das erste Gesetz der großen Zahlen

bewiesen wurde.

Jacob Bernoulli I.(1654-1705)

1

Stochastik kann man in folgende Gebiete unterteilen:

• Wahrscheinlichkeitsrechnung

Wahrscheinlichkeitstheorie (Grundlagen)

• Statistik

(Umgang mit den Daten)

• Stochastische Prozesse

(Theorie zufälliger Zeitreihen und Felder)

2

10.2 Bemerkungen zur Geschichte

Die Ursprünge der Wahrscheinlichkeitstheorie liegen im

Dunklen der alten Zeiten. Ihre Entwicklung ist in der ersten

Phase den Glücksspielen zu verdanken.

Die ersten Würfelspiele konnte man in Alt-Ägypten, I. Dynastie

(ca. 3500 v. Chr.) nachweisen.

Auch später im klassischen Griechenland und im römischen

Reich waren solche Spiele Mode

Kaiser Augustus (63 v. Chr. -14 n. Chr.)

Kaiser Claudius (10 v.Chr. - 54 n. Chr.).

3

Ursprünge der Versicherungen

Gleichzeitig gab es erste wahrscheinlichkeitstheoretische

Überlegungen in der Versicherung und im Handel.

Die älteste uns bekannte Form der Versicherungsverträge

stammt aus dem Babylon (ca. 4000-3000 Jahre vor Chr.,

Verträge über die Seetransporte von Gütern).

Die ersten Sterbetafeln in der Lebensversicherung stammen

von dem römischen Juristen Ulpian (220 v.Chr.).

Die erste genau datierte Lebensversicherungspolice stammt

aus dem Jahre 1347, Genua.

4

Der erste Wissenschaftler, der sich mit diesen Aufgaben aus der

Sicht der Mathematik befasst hat, war

Gerolamo Cardano (1501-1576),

Erfinder der Cardan–Welle.

In seinem Buch “Liber de ludo alea” sind zum ersten Mal

Kombinationen von Ereignissen beim Würfeln beschrieben,

die vorteilhaft für den Spieler sind. Er hat auch als erster die

Anzahl vorteilhafter Ereignisse

Anzahl aller Ereignisse

als Maß für Wahrscheinlichkeit entdeckt.

5

Klassische Wahrscheinlichkeitstheorie (XVII-XVIII Jh.)

Diese Entwicklungsperiode beginnt mit dem Briefwechsel

zwischen Blaise Pascal und Pierre de Fermat.

Sie diskutierten Probleme, die von Chevalier de Méré (Antoine

Gombaud (1607-1684)) gestellt wurden.

Anbei ist eines seiner Probleme:

Was ist wahrscheinlicher ?

mindestens eine 6 bei 4 Würfen eines Würfels oder

mindestens ein Paar (6,6) bei 24 Würfen von 2 Würfeln zu

bekommen?

Die Antwort:

5 4

P(mind. eine 6 in 4 Würfen) = 1 – P(keine 6) = 1 - ( ) = 0,516

P(mind.1x (6,6) in 24 Würfen von 2 Würfeln) =

6

35 24

1-( )

36

= 0,492

6

Entwicklung analytischer Methoden (XVIII-XIX Jh.)

Abraham de Moivre,

Thomas Bayes,

Pierre Simon de Laplace

Carl Friedrich Gauß,

Simeon Denis Poisson

Entwicklung der Theorie der Beobachtungsfehler

und Theorie des Schießens (Artilleriefeuer)

Erste nicht–klassische Verteilungen

wie Binomial– und Normal-Verteilung, Poisson–Verteilung

zentraler Grenzwertsatz von De Moivre.

7

Entwicklung analytischer Methoden (XVIII-XIX Jh.)

„St.Petersburger Schule von Wahrscheinlichkeiten“

P.L. Tschebyschew

A.A. Markow

A.M. Ljapunow

Einführung von

Zufallsvariablen,

Erwartungswerten,

Wahrscheinlichkeitsfunktionen,

Markow–Ketten.

8

Moderne Wahrscheinlichkeitstheorie (XX Jh.)

David Hilbert,

8.8.1900,II. Mathematischer Kongress in Paris, Problem Nr. 6:

Axiometrisierung von physikalischen Disziplinen,

wie z.B. Wahrscheinlichkeitstheorie.

Antwort darauf:

A.N. Kolmogorow

führt Axiome der Wahrscheinlichkeitstheorie ein

basierend auf der Maß– und Integrationstheorie von

Borel und Lebesgue (1933) .

9

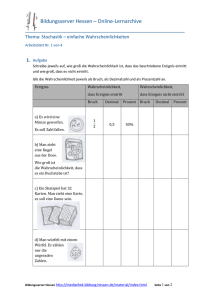

10.3 Typische Problemstellungen der Stochastik

Bemerkung:

Auf diesen „Kreislauf“ bezieht sich der Qualitätsregelkreis PDCA

PLAN

DO

CONTROLL

ACT

in der modernen Qualitätslehre.

10

10.3 Typische Problemstellungen der Stochastik

1.

Modellierung von Zufallsexperimenten, d.h. deren

adäquate theoretische Beschreibung.

2.

Bestimmung von

o Wahrscheinlichkeiten von Ereignissen

o Mittelwerten und Varianzen von Zufallsvariablen

o Verteilungsgesetzen von Zufallsvariablen

3. Näherungsformel und Lösungen mit Hilfe von

Grenzwertsätzen

4. Schätzung von Modellparametern in der Statistik, Prüfung

statistischer Hypothesen

11

Wahrscheinlichkeitstheorie

befasst sich mit (im Prinzip unendlich oft) wiederholbaren

Experimenten, in Folge derer ein Ereignis auftreten kann (oder

nicht).

Solche Ereignisse werden “zufällige Ereignisse” genannt.

Sei A ein solches Ereignis. Wenn n(A) die Häufigkeit des

Auftretens von A in n Experimenten ist, so hat man bemerkt,

n(A)

dass

→ c geht.

𝒏

Diese Konstante c nennt man “Wahrscheinlichkeit von A” und

bezeichnet sie mit P(A)* .

*P(ropability)

12

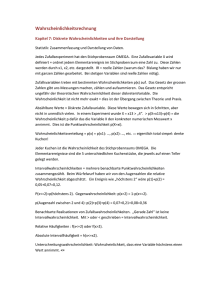

𝒏(𝑨)

Relative Häufigkeit

des Ereignisses „KOPF“

𝒏

beim n-maligen Münzwurf

13

Man kann leicht feststellen, dass

n(A)

𝑛

=> P(A) =

1

2

≈ für große n.

𝟏

𝟐

Um dies zu verifizieren,

hat Buffon in XVIII Jh. 4040 mal eine faire Münze geworfen,

n(A) 2048

davon war 2048 mal Kopf, so dass

=

= 0,508.

4040

𝑛

Pierson hat es 24.000 mal gemacht:

n(A) 12012

es ergab n(A) = 12012 und somit

=

= 0,5005.

𝑛

24000

In den Definitionen, die wir bald geben werden, soll diese

n(A)

empirische Begriffsbildung in P(A) = 𝐥𝐢𝐦

ihren Ausdruck

𝒏→∞

𝒏

finden.

14

10.4 Ereignisse

Sei E ein Grundraum und

Ω ⊂ E sei die Menge von Elementarereignissen 𝜔(Grundmenge).

Ω kann als Menge der möglichen Versuchsergebnisse interpretiert werden. Man nennt Ω manchmal auch Grundgesamtheit

oder Stichprobenraum.

Definition Ereignis

Eine Teilmenge A von Ω (A ⊂ Ω ) wird Ereignis genannt.

Dabei ist { 𝜔 } ⊂ Ω ein Elementarereignis,

das das Versuchsergebnis 𝜔 darstellt.

Falls bei einem Versuch das Ergebnis 𝜔 ∈ A erzielt wurde, so

sagen wir, dass A eintritt.

15

Beispiele

1. einmaliges Würfeln:

Ω = { 1, 2, 3, 4, 5, 6} E = N

2. n–maliger Münzwurf:

Ω = { (𝜔1 , 𝜔2 , … , 𝜔𝑛 ) : 𝜔𝑖 ∈ { 0, 1 } }

E = Nn =

1; falls ein “Kopf” im i–ten Wurf

0; sonst

16

Definition

Ein Zufallsexperiment ist ein Experiment mit folgenden

Eigenschaften:

1. Das Experiment ist unter gleichen äußeren Bedingungen

beliebig oft wiederholbar.

2. Das Experiment besitzt mehrere sich gegenseitig

ausschließende Ergebnisse.

3. Die Ergebnisse im Experiment sind zufallsbedingt.

17

Verknüpfungen von Ereignissen

Die Vereinigung (oder Summe) A∪B von Ereignissen

bedeutet:

Entweder tritt A ein oder B oder A und B gleichzeitig.

Der Durchschnitt (oder Produkt) A∩B von Ereignissen

bedeutet:

Die Ereignisse A und B treten gleichzeitig ein.

Das zu A komplementäre Ereignis 𝐀 bedeutet:

Das Ereignis A tritt nicht ein.

18

Beispiele

Zufallsexperiment Roulette

Die Elementarereignisse im Roulette sind die Zahlen

0,1,2,...,36.

Wir definieren zwei Ereignisse A und B, um sie zu verknüpfen:

A = "Alle geraden Zahlen",

A = {2,4,6,...,36}

B = "Alle Zahlen im 1.Drittel",

B = {1,2,3,...,12}.

Dann bedeuten:

A∪B = {1,2,3,...,11,12, 14,16,...,36}

A∩B = {2,4,6,8,10,12}

A=E\A= {0,1,3,5,...35}.

19

Beispiele

Zufallsexperiment Roulette

Die Elementarereignisse im Roulette sind die Zahlen

0,1,2,...,36.

Wir definieren zwei Ereignisse A und B, um sie zu verknüpfen:

A = "Alle geraden Zahlen",

A = {2,4,6,...,36}

B = "Alle Zahlen im 1.Drittel",

B = {1,2,3,...,12}.

Dann bedeuten:

A∪B = {1,2,3,...,11,12, 14,16,...,36}

A∩B = {2,4,6,8,10,12}

A=E\A= {0,1,3,5,...35}.

20

Beispiele

Zufallsexperiment Wurf mit zwei Würfeln

Die Elementarereignisse sind die 36 Zahlenpaare

(1,1),(1,2),...,(6,6).

Wir definieren zwei Ereignisse für die Verknüpfung:

A = "Beide Augenzahlen sind gleich":

A={(1,1),(2,2),...,(6,6)}

B="Der zweite Würfel hat die Augenzahl 5":

B={(1,5),(2,5),...(6,5)}

Dann bedeuten:

A∪B={(1,1),(2,2),...(6,6),(1,5),(2,5),...,(6,5)},

A∩B = {(5,5),

A=E\A = {(1,2),1,3)...,(2,1),(2,3)(2,4),...,(6,5)}

21

Zweckdienlich zur Berechnung von Problemen in der

Wahrscheinlichkeitstheorie sind die so genannten

De Morgan´schen Regeln:

Für zwei beliebige Ereignisse A und B gelten folgende

Regeln:

1. A ∪ B = 𝐀 ∩ 𝐁

2. A ∩ B = 𝐀 ∪ 𝐁

22

Tabelle: Wahrscheinlichkeitstheoretische Bedeutung von

Mengenoperationen

23

10.5 Wahrscheinlichkeiten

Laplace-Experiment

Wird ein Zufallsexperiment mit einer endlichen Ergebnismenge E

hinreichend oft wiederholt und zeigt sich dabei, dass keines der

Elementarereignisse gegenüber einem anderen bevorzugt

auftritt, so werden alle Ereignisse stets näherungsweise gleich

häufig auftreten

und wir sprechen von einem Laplace-Experiment.

Beispiele:

Wurf mit einer Münze

Wurf mit einem Würfel

24

Beispiel

Bei dem Ziehen einer Kugel aus einer Urne, die drei weiße und

zwei schwarze Kugeln enthält, gibt es die zwei Elementarereignisse:

A = Ziehen einer weißen Kugel,

B = Ziehen einer schwarzen Kugel.

1

5

3

2

4

Die Möglichkeit, eine weiße Kugel zu ziehen, ist größer als die

Möglichkeit, eine schwarze Kugel zu ziehen. Es liegt daher kein

Laplace-Experiment vor.

Wenn wir die Kugeln zusätzlich durchnummerieren und damit

unterscheiden, so erhalten wir ein Zufallsexperiment mit 5

gleichmöglichen Elementarereignissen und damit ein Laplace25

Experiment.

Mit dem Laplace- Experiment können wir einen ersten

Wahrscheinlichkeitsbegriff formulieren.

Besteht eine Ergebnismenge aus n gleichmöglichen Elementarereignissen, so wird für das einzelne Elementarereignis 𝒆𝒊

mit 1 ≤ i ≤ n definitionsgemäß die folgende positive Zahl als

Wahrscheinlichkeit definiert:

𝟏

P(𝒆𝒊 ) = 𝐩𝐢 =

.

𝒏

Setzt sich ein Ereignis A zusammen aus den g Elementen 𝒆𝒌 mit

1 ≤ k ≤ g, so wird die Wahrscheinlichkeit für das Eintreffen von A

definiert durch die Formel

P(A) =P({ 𝒆𝟏 , 𝒆𝟐 ,..., 𝒆𝒈 }) =

𝒈

𝒌=𝟏 P(𝒆𝒌 )=

𝟏

𝒈

𝒌=𝟏 𝒏

𝒈

𝒏

= ,

worin der Buchstabe g auch symbolisieren soll, dass es sich um

die für das Zufallsexperiment günstigen Fälle handelt.

26

Streng mathematisch müssten wir in der Schreibweise unterscheiden zwischen

P(𝒆𝒌 ), worin

𝒆𝒌 ein Element ist, und

P({𝒆𝒌 }), worin nun {𝒆𝒌 } ein Ereignis bzw. eine Teilmenge

symbolisiert. Darauf wollen wir aber verzichten.

Gemäß dieser Definition gilt natürlich für die Wahrscheinlichkeit

P(A) eines beliebigen Ereignisses stets:

P(A) ≤ 1,

und für das sichere Ereignis gilt:

P(E) = 1.

Außerdem gilt offensichtlich

P(𝐀) =1 - P(A).

Beispiele

1. Wurf mit einem Würfel ( 1 von 6 )

2. Roulette ( 1 von 37 )

3. Ziehung einer Kugel aus einer Urne ( 1 von 5, siehe oben )

4. Lottoziehung ( 6 von 49 )

5. Wie groß ist die Wahrscheinlichkeit P(B) bei zehnmaligem

Kartenziehen mindestens einen Buben zu ziehen?

27

In allen fünf Beispielen basiert die Berechnungsmöglichkeit

darauf, dass alle unterscheidbaren Elementarereignisse gleichwahrscheinlich waren. Dies ist aber meist nicht der Fall.

Wir müssen deshalb den Wahrscheinlichkeitsbegriff

verallgemeinern, um auch Zufallsexperimente mit nicht

gleichmöglichen Elementarereignissen untersuchen zu können.

28

Absolute und relative Häufigkeit

Die meisten Experimente erfüllen nicht die Voraussetzungen

eines Laplace-Experimentes. Wiederholen wir ein Experiment

hinreichend häufig, so werden wir aber feststellen, dass die

Ereignisse auf lange Dauer gewissen Gesetzmäßigkeiten

unterliegen, im Gegensatz zur zufälligen Unregelmäßigkeit der

einzelnen Ergebnisse.

Anhand dieser Erkenntnis werden wir den einzelnen Ereignissen

Wahrscheinlichkeiten zuordnen. Dabei werden wir den

Begriff der relativen Häufigkeit verwenden.

29

Die mathematische Aussage

"Das Ereignis A besitzt die Wahrscheinlichkeit P(A)"

soll dann folgenden Sachverhalt beschreiben:

Wenn sich mit wachsender Anzahl n der Ausführungen eines

Zufallexperiments die Schwankungen in der relativen Häufigkeit

ℎ𝑛 (A) klein werden und sich einem festen Zahlenwert

P(A) nähern, so werden wir diesen Zahlenwert definieren als

Wahrscheinlichkeit P(A) des Zufallexperiments, P(A) ≈ ℎ𝑛 (A),

falls n genügend groß ist.

Wir sagen auch, die relativen Häufigkeiten stabilisieren sich

für hinreichend viele Ausführungen um einen festen

Zahlenwert.

Für das Rechnen mit Wahrscheinlichkeiten werden wir

axiomatisch die Regeln formulieren, die für das Rechnen mit

relativen Häufigkeiten gelten. Dazu müssen wir zunächst die

Begriffe absolute Häufigkeit und relative Häufigkeit definieren

30

und anhand geeigneter Beispiele diskutieren.

Definition Absolute Häufigkeit

Bei einer n-fachen Ausführung eines Zufallsexperimentes

werden die einzelnen Ereignisse A, B, ... mit gewissen

absoluten Häufigkeiten H(A), H(B), ... auftreten. Wir ermitteln

die absoluten Häufigkeiten durch Abzählen.

Definition Relative Häufigkeit

Die relative Häufigkeit 𝒉𝒏 (A) eines Ereignisses A bei einer nfachen Ausführung eines Zufallsexperimentes errechnen wir,

indem wir die absolute Häufigkeit 𝐇𝐧 (A) durch einfaches

Abzählen ermitteln und dann den Quotienten bilden:

𝐡𝐧 (A) =

𝐇𝐧 (𝐀)

𝐧

.

31

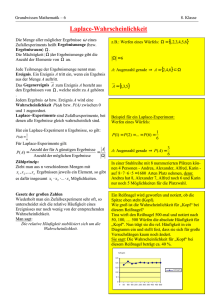

Beispiel Augenzahl mit zwei identischen Würfeln

Wir würfeln mit zwei identischen Würfeln und untersuchen das

Zufallsereignis "Summe der beiden Augenzahlen".

In diesem Beispiel unterscheiden wir die Würfel nicht und

erklären die Summe der Augenzahlen als Elementarereignis.

Die 11 möglichen Elementarereignisse 2,3,...,12 sind nun nicht

gleichmöglich; es handelt sich um kein Laplace-Experiment.

Um die Wahrscheinlichkeiten der einzelnen Elementarereignisse

zu erforschen, führen wir umfangreiche Würfelserien durch. Die

Anzahlen n der Ausführungen betragen 𝒏𝟏 , 𝒏𝟐 und 𝒏𝟑 .

Wir zählen die Häufigkeiten der einzelnen Ereignisse absolut

und relativ und untersuchen, ob sich die relativen Häufigkeiten

an bestimmten Zahlenwerten stabilisieren.

Unsere Untersuchung stellen wir tabellarisch und grafisch dar:

𝒏𝟏 = 190, 𝒏𝟐 = 428 und 𝒏𝟑 = 997.

32

33

34

35

Zur Postulierung einer Wahrscheinlichkeit für die einzelnen

Elementarereignisse benötigen wir deren relative Häufigkeiten für

große n.

In der Tabelle und in der Grafik werden die relativen Häufigkeiten

für zunehmende Anzahlen n der Ausführungen dargestellt.

Außerdem ist die Wahrscheinlichkeit eingetragen, die

sich für ein Laplace-Element ergibt.

Nun handelt es sich in diesem Beispiel nicht um ein LaplaceElement; ansonsten wäre ja der ganze Aufwand zur Ermittlung

der Wahrscheinlichkeiten überflüssig.

Wir können aber aus unserem Experiment ein LaplaceExperiment machen, indem wir die Würfel gedanklich einfärben

und in die 36 gleichmöglichen Elementarereignisse

{(1,1),(1,2),...,(6,5),(6,6)} zerlegen.

Wir haben nun ein Laplace-Experiment.

36

Die Wahrscheinlichkeit seiner Elementarereignisse beträgt

Wir definieren die Teilmengen { A, B, C,...} durch

A = "Summe der Augenzahlen ist 2",

B = "Summe der Augenzahlen ist 3",

C = " Summe der Augenzahlen ist 4", ... u.s.w.

1

.

36

Ereignis A besteht aus einem günstigen Element A = {(1,1)},

1

die Laplace-Wahrscheinlichkeit von A ist also = 0,27.

36

Ereignis B besteht aus 2 Elementen B = {(1,2),(2,1)}, besitzt also

2

1

die Wahrscheinlichkeit = = 0,05. u.s.w.

36

18

Die exakten Wahrscheinlichkeiten sind in der Tabelle mit

angezeigt.

37

Ziehen einer Kugel

In einem Behälter befinden sich schwarze und weiße Kugeln

unbekannter Anzahlen. Durch zufälliges Herausnehmen

entstehen folgende relativen Häufigkeiten:

n

414

856

1803

3612

schwarz

54,35%

56,66%

58,01%

58,19%

weiß

45,65%

43,34%

41,99%

41,81%

38

Ziehen einer Kugel

In einem Behälter befinden sich schwarze und weiße Kugeln

unbekannter Anzahlen. Durch zufälliges Herausnehmen

entstehen folgende relativen Häufigkeiten:

Offensichtlich pendeln sich die relativen Häufigkeiten ℎ𝑠 bzw. ℎ𝑤

der schwarzen bzw. weißen Kugeln auf näherungsweise 0,582

bzw. 0,418 ein.

Wir erwarten, dass die relativen Häufigkeiten der beiden

Ereignisse sich in der Nähe dieser beiden Werte stabilisieren.

Wir werden die stabilen Werte der relativen Häufigkeiten großer

Stückzahlen als Maßzahl für die Wahrscheinlichkeit des

Eintreffens für die schwarzen bzw. weißen Kugeln postulieren.

39

Die Einführung eines empirischen Wahrscheinlichkeitsbegriffes

P(A) ≈ 𝒉𝒏 (A) aus den Messreihen bedarf aber einiger unterstützender Regeln.

Diese Regeln entsprechen den Eigenschaften, die wir bei den

relativen Häufigkeiten beobachten.

Bei einer n-fachen Ausführung eines Zufallexperimentes

beobachten wir die nachstehenden Gesetzmäßigkeiten für die

relativen Häufigkeiten der Ergebnismenge E:

40

1. Die relative Häufigkeit ℎ𝑛 (A) eines beliebigen Ereignisses A

ist eine nicht-negative Zahl, die höchstens 1 sein kann:

0 ≤ 𝒉𝒏 ≤ 1.

2. Für das sichere Ereignis E gilt: 𝒉𝒏 (E)=1.

3. Für sich ausschließende Ereignisse A, B gilt:

𝐡𝐧 (A∪B) = 𝐡𝐧 (A)+𝒉𝒏 (B) .

4. Für zwei beliebige Ereignisse A und B gilt:

𝒉𝒏 (A∪B) = 𝒉𝒏 (A) + 𝒉𝒏 (B) - 𝒉𝒏 (A∩B),

worin ℎ𝑛 (A∩B) das Ereignis beschreibt, in dem A und B

gleichzeitig eintreten.

5. Mit zunehmender Anzahl der Versuche n stabilisiert sich im

Regelfall die relative Häufigkeit 𝒉𝒏 (A) eines zufälligen

Ereignisses A und schwankt immer weniger um einen

bestimmten Wert A.

41

Axiomatik des Wahrscheinlichkeitsbegriffes

Jedem Ereignis A eines Zufallsexperimentes mit der

Ergebnismenge E können wir eine reelle Zahl P(A) ≈ 𝒉𝒏 (A)

zuordnen. Diese Zahl nennen wir Wahrscheinlichkeit des

Experiments und fordern von ihr folgende Eigenschaften:

Axiom 1: P(A) ist eine nicht-negative Zahl, die höchstens gleich

1 ist:

0 ≤ P(A) ≤ 1.

Axiom 2: Für das sichere Ereignis (Ergebnismenge E) soll

gelten

P(A) = 1.

Axiom 3: Für sich paarweise ausschließende Ereignisse A, B,

C... gilt:

P(A∪B∪C...) = P(A) + P(B) + P(C) + ...

Axiom 4: Für beliebige Ereignisse A und B (die sich nicht

notwendig gegenseitig ausschließen) gilt:

P(A∪B) = P(A) + P(B) - P(A∩B),

worin P(A∩B) die Wahrscheinlichkeit des Ereignisses eschreibt,

42

in dem A und B gleichzeitig auftreten.

Wahrscheinlichkeit P(A) eines Ereignisses A für LaplaceExperimente

P(A) =P({ 𝒆𝟏 , 𝒆𝟐 ,..., 𝒆𝒈 }) =

𝒈

𝒌=𝟏 P(𝒆𝒌 )=

𝟏

𝒈

𝒌=𝟏 𝒏

=

𝒈

,

𝒏

Wahrscheinlichkeit P(A) eines Ereignisses A für beliebige

Experimente

P(A) ≈ 𝒉𝒏 (A) ,

worin 𝒉𝒏 (A) die „stabilisierte" relative Häufigkeit des Ereignisses

A für hinreichend große Anzahlen n von Ausführungen des

Zufallexperimentes ist und die obige Axiomatik erfüllt.

Wir bezeichnen die Art der Festlegung der Wahrscheinlichkeit

für beliebige Experimente durch einen Näherungswert der

relativen Häufigkeit auch als eine statistische oder

empirische Definition. Diese empirische Definition muss im

Einklang mit den vorausgestellten Axiomen sein.

43

Wir leiten aus den Axiomen zwei weitere Eigenschaften her, die

in den Rechenanwendungen bedeutsam sind.

1.Für das unmögliche Ereignis ∅ ist die Wahrscheinlichkeit Null:

P(∅) = 0.

2. Für das zu A komplementäre Ereignis 𝐀 gilt:

P(𝑨) = 1 - P(A).

Das Gerüst der Axiomen gibt uns die Regeln, wie wir mit

Wahrscheinlichkeiten zu rechnen haben, die wir im Anschluss

an Axiom 4 definiert haben.

Durch die Einführung von Wahrscheinlichkeiten für die

Ereignisse haben wir den Ereignisraum erweitert zum

sogenannten Wahrscheinlichkeitsraum.

44

Definition Wahrscheinlichkeitsraum

Den Elementarereignissen 𝒆𝒊 aus der Ergebnismenge

E = { 𝒆𝟏 , 𝒆𝟐 ,...} eines Zufallexperimentes ordnen wir eine reelle

Wahrscheinlichkeit p(𝒆𝒊 ) = 𝐩𝐢 so zu, dass folgende Aussagen

erfüllt sind:

p(𝒆𝒊 ) ≥ 0 für alle i und

𝒏

𝒊=𝟏 𝒑𝒊

= 𝒑𝟏 + 𝒑𝟐 + 𝒑𝟑 + … = 1

Der Ereignisraum wird dadurch zum Wahrscheinlichkeitsraum.

Die Wahrscheinlichkeit P(A) einer Teilmenge A von Elementarereignissen (Ereignis 𝐀 𝐢 )

ist definiert als

Summe der Wahrscheinlichkeiten 𝐩𝒊 der in A enthaltenen

Elementarereignisse:

P(A) =

𝒏

𝒊=𝟏 p(𝒆𝒊 ) =

𝒏

𝒊=𝟏 𝐩𝒊

45

Bedingte Wahrscheinlichkeit

Es seien A und B Ereignisse, die bei einem Experiment

auftreten können. Manchmal interessiert die Frage:

Wie groß ist die Wahrscheinlichkeit, dass ein Ereignis B eintrifft,

wenn wir zusätzlich das Ereignis A als vorgegeben

voraussetzen?

46

Ereignisbäume

Für komplizierte Zufallsprozesse, die aus mehreren

nacheinander ablaufenden Zufallsexperimenten bestehen, gibt

es ein anschauliches Hilfsmittel, den sogen. Ereignisbaum.

© www.brinkmann-du.de

47

Ereignisbäume

Beispiel:

© www.brinkmann-du.de

48

Ereignisbäume

Beispiel:

In einer Urne sind 100 Kugeln, 70 Kugeln sind aus Holz, 30 aus

Kunststoff. Von den Holzkugeln sind 25 Stück rot gefärbt, 45

grün. Von den Kunststoffkugeln sind 10 rot und 20 grün.

Wie groß ist die Wahrscheinlichkeit, eine grüne Kugel gezogen

zu haben, wenn man weiß, das die gezogene Kugel aus

Kunststoff ist.

Um die im Baumdiagramm noch fehlenden Wahrscheinlichkeiten

auszurechnen, verwendet man die Pfadmultiplikationsregel:

P(A) • 𝐏𝐀 (𝑩 ) = P ( A ∩ B )

© www.brinkmann-du.de

49

Ereignisbäume

Regeln:

Berechnung von Wahrscheinlichkeiten bei mehrstufigen

Zufallsexperimenten mit Hilfe des Ereignisbaums

(sogenannte Pfadregeln)

1. Die Wahrscheinlichkeiten längs eines Pfades werden

miteinander multipliziert.

2. Führen mehrere Pfade zum gleichen Ergebnis, so addieren

sich ihre Wahrscheinlichkeiten.

50

Bedingte Wahrscheinlichkeit

Es seien A und B Ereignisse, die bei einem Experiment

auftreten können. Manchmal interessiert die Frage:

Wie groß ist die Wahrscheinlichkeit, dass ein Ereignis B eintrifft,

wenn wir zusätzlich das Ereignis A als vorgegeben

voraussetzen?

Zur Verdeutlichung nehmen wir ein Laplace - Experiment an,

indem n gleichmögliche Elementarereignisse eintreffen können,

von denen

• in k Fällen das Ereignis A,

• in l Fällen das Ereignis B, und schließlich

• in m Fällen das Ereignis A∩B, also A und B gleichzeitig,

eintrifft.

51

Bedingte Wahrscheinlichkeit

Aus der klassischen Wahrscheinlichkeitsdefinition gemäß

Laplace ergeben sich folgende Wahrscheinlichkeiten für die

einzelnen Ereignisse:

P(A) =

𝒌

𝒏

, P(B) =

𝒍

𝒏

, P(A∩B) =

𝒎

𝒏

.

Die Wahrscheinlichkeit von B, unter der zusätzlichen Bedingung,

dass wir nur Fälle untersuchen, in denen A vorkommt,

beschreiben wir durch den Ausdruck P(B|A).

Zur Berechnung dieser Zahlengröße überlegen wir uns, dass wir

nur die Fälle zur Untersuchung zulassen, in denen A eintrifft.

Dies sind k Fälle. Unter diesen gibt es m Möglichkeiten für ein

gleichzeitiges Eintreffen von B. Die Wahrscheinlichkeit für B,

unter der Bedingung, dass A vorliegt, beträgt dann:

P(A∩B) 𝒎 𝒏

P(B|A) =

=

P(A)

𝒌

𝒏

=

𝒎

𝒌

52

Beispiel: 1 Würfel

A : Augenzahl ist gerade

B : Augenzahl durch 3 teilbar

A∩B

A

= { 2, 4, 6 }

B

= { 3, 6 }

A∩B = { 6 }

k =3

l =2

m=1

Beispiel: 2 Würfel mit 𝐴𝑖 = { u, v } mit u,v ∈ { 1, 2, 3, 4, 5, 6 }

A : u=1 oder v=1

A = {(1,1); (1,2); …; (1,6); (2,1); (3,1);…; (6,1) }

B : u + v=5

B = { (1,4); (2,3); (3,2); (4,1) }

A∩B = { (1,4); (4,1) }

k = 11

l =4

m =2

53

Bedingte Wahrscheinlichkeit

Sind nun E und F zwei Ereignisse zu irgendeinem Experiment

(nicht notwendig ein Laplace-Experiment), so nennen wir den

Ausdruck P(E|F) die Wahrscheinlichkeit des Eintreffens

von E unter der Hypothese, dass F eingetroffen ist.

Für den Ausdruck P(E|F) gelten folgende Regeln:

1. Schließen sich E und F gegenseitig aus, so ist P(E|F) = 0.

2. Die Wahrscheinlichkeit des gleichzeitigen Eintreffens von E

und F lässt sich anhand der bedingten Wahrscheinlichkeit so

berechnen:

P(E∩F) = P(E) · P(F|E) = P(F) · P(E|F).

Multiplikationssatz

54

Beispiel: 2 Würfel mit 𝐴𝑖 = { u, v } mit u,v ∈ { 1, 2, 3, 4, 5, 6 }

E : u+v = 0 mod 4

E = {(1,3); (3,1);(2,2);

(2,6); (6,2);(3;5); (5,3); (4,4);

(6,6) }

F:u=3

F = { (3,1);(3,2); … ;(3,6) }

E∩ F =

k = 9

l =6

m =0

55

Beispiel: 2 Würfel mit 𝐴𝑖 = { u, v } mit u,v ∈ { 1, 2, 3, 4, 5, 6 }

E : u+v = 0 mod 4

E = {(1,3); (3,1);(2,2);

(2,6); (6,2);(3;5); (5,3); (4,4);

(6,6) }

F : u + v = 1 mod 2

F = { ….}

k = 9

l = 18

56

3. Für drei gleichzeitig eintreffende Ereignisse heißt der

Multiplikationssatz so:

P( A ∩ B ∩ C ) = P( A ) · P( B|A ) · P( C|A∩B) .

Darin bedeutet P(C|A∩B) die Wahrscheinlichkeit für das

Eintreffen des Ereignisses C unter der Wahrscheinlichkeit,

dass die Ereignisse A und B bereits eingetreten sind.

57

Beispiel: 2 Würfel mit 𝐴𝑖 = { u, v } mit u,v ∈ { 1, 2, 3, 4, 5, 6 }

A : u gerade, v ungerade

B : u+v = 0 mod 3

C : u = 3 oder v = 3

58

3. Für drei gleichzeitig eintreffende Ereignisse heißt der

Multiplikationssatz so:

P( A ∩ B ∩ C ) = P( A ) · P( B|A ) · P( C|A∩B) .

Darin bedeutet P(C|A∩B) die Wahrscheinlichkeit für das

Eintreffen des Ereignisses C unter der Wahrscheinlichkeit,

dass die Ereignisse A und B bereits eingetreten sind.

4. Zwei Ereignisse E und F heißen unabhängig, wenn die

Beziehung gilt:

P(E∩F) = P(E) · P(F).

Dann folgt aus

P(E∩F) = P(E) · P(F|E) = P(F) · P(E|F) : P(F|E) = P(F)

und

P(E|F) = P(E).

Mit anderen Worten: Die Wahrscheinlichkeit, dass E eintrifft, ist

unabhängig davon, ob F eingetroffen ist oder nicht, und

umgekehrt.

59

Hilfsmittel Kombinatorik ( siehe Mathematik 1 )

Statistische Untersuchungen, bei denen ein Ereignis wiederholt

beobachtet wird, können wir unterscheiden in Vorgänge, bei

denen sich nach jeder Beobachtung der Grundzustand wieder

herstellt, und in Ereignisse, die sich mit jeder Durchführung

verändern.

Wenn wir ein Würfelexperiment durchführen, so kehren wir nach

jedem Wurf zur Ausgangssituation zurück, weil sich der Würfel

nicht verändert.

Wenn wir aus einem Stapel Karten ziehen und sie nicht

zurückstecken, so verändern wir mit jeder entnommenen Karte

die Basis für die Zugwiederholung. Diese Situation tritt auch

beim Ziehen der Lottozahlen ein. Die Wahrscheinlichkeit

6

erfolgreich zu sein, ist mit dem ersten Zug offenbar ,

anschliessend

5

48

, dann

4

47

49

u.s.w.

60

Wir unterscheiden zwischen "Ziehen mit Zurücklegen" und

"Ziehen ohne Zurücklegen".

Vorgänge, die sich bei jeder Durchführung verändern, lassen

sich mit den Rechenregeln der bedingten Wahrscheinlichkeit im

Regelfall einfacher lösen.

Beispiele

1. In einem Behälter liegen 20 Glühbirnen, darunter sind 5

defekte. Wie groß ist die Wahrscheinlichkeit, keine defekte

zu erhalten, wenn wir zwei Glühbirnen entnehmen?

2. Ein Nahrungsmittel bestehe aus 3 Komponenten.

Die Wahrscheinlichkeit, dass die Komponenten nicht durch

Umweltgifte belastet sind, betrage bei einer Komponenten

10%; bei den zwei anderen jeweils 15%. Wie groß ist die

Wahrscheinlichkeit einer einwandfreien Nahrung?

3. Ziehung der Lottozahlen (6 aus 49)

61

ohne

Wiederholung

Kombinationen

k-ter

Ordnung

Variationen

K-ter

Ordnung

C(n;k) =

𝒏

𝒌

V(n;k) =

𝒏!

𝒏 −𝒌 !

ohne

Zurücklegen

mit

Wiederholung

𝐂𝐰 (n;k) =

𝒏+𝒌−𝟏

𝒌

𝑽𝒘 (n;k) = 𝒏𝒌

Ungeordnete

Stichproben

Geordnete

Stichproben

mit

Zurücklegen

62

63

Totale Wahrscheinlichkeit

Für eine beliebige Partition 𝐄𝟏 , 𝐄𝟐 , … , 𝐄𝒏 und ein beliebiges

Ereignis A ⊂ 𝛀 gilt

P( A ) =

𝒏

𝒌=𝟏 𝐏

𝐀 ∩ 𝐄𝐤 =

𝒏

𝒌=𝟏 𝐏

𝐄𝐤 𝐏 𝑨| 𝐄𝐤

( „Formel für die totale Wahrscheinlichkeit“ )

64

Definition Partition

Die Zerteilung der Ereignismenge Ω in unvereinbare (disjunkte)

Ereignisse 𝐄𝟏 , 𝐄𝟐 , … , 𝐄𝒏 nennt man eine Partition von Ω .

Ω = 𝐄𝟏 ∪ 𝐄𝟐 ∪ … ∪ 𝐄𝐧

𝐄𝐣 ∩ 𝐄𝐤 = ∅

Bemerkung:

Der einfachste Fall einer Partition ist 𝐄 = 𝐄𝟏 + 𝐄𝟐 => 𝐄𝟏 = 𝐄𝟐

65

Formel von Bayes

Für eine beliebige Partition 𝐄𝟏 , 𝐄𝟐 , … , 𝐄𝒏 und ein beliebiges

Ereignis A ⊂ 𝛀 gilt, die Wahrscheinlichkeit, dass eines der

Ereignisse 𝐄𝒋 unter der Bedingung von A eintritt, ist

𝐏 𝐄𝐣 𝐏 𝐀| 𝐄𝐣

P( 𝐄𝐣 | A ) =

𝐏(𝐀)

=

𝐏 𝐄𝐣 𝐏 𝐀| 𝐄𝐣

𝒏

𝒌=𝟏 𝐏

𝐄𝐤 𝐏 𝑨| 𝐄𝐤

Bayes ´sche Klassifizierung

Bayes´ SPAM – Filter

Optimale Stoppstrategie

( Quelle: Teschl, Teschl, Band 2 )

66

Beispiel: PC Hersteller hat 3 Lieferanten

Anteil

𝜶

40%

𝜷

25%

𝜸

35%

Ausschuß

2%

1%

3%

a. Wie groß ist die Wahrscheinlichkeit, dass ein geliefertes

Produkt fehlerhaft ( Ereignis A ) ist ?

A : Produkt ist fehlerhaft .

P(𝛼) = 0,40

P(A|𝛼) = 0,02

P(𝛽) = 0,25

P(A|𝛽) = 0,01

P(𝛾) = 0,35

P(A|𝛾) = 0,03

P(A) = P(𝜶) P(A|𝜶)

+ P(𝜷) P(A|𝜷) + P(𝜸) P(A|𝜸)

= 0,40 • 0,02 + 0,25 • 0,01 + 0,35 • 0,03

= 0,021

= 2,1%

67

Beispiel: PC Hersteller hat 3 Lieferanten

Anteil

𝜶

40%

𝜷

25%

𝜸

35%

Ausschuß

2%

1%

3%

b. Wie groß ist die Wahrscheinlichkeit, dass ein defektes

Produkt vom Lieferant 𝛼 stammt ?

Mit Hilfe des Multiplikationssatzes

P(E∩F) = P(E) · P(F|E) = P(F) · P(E|F)

P(𝜶) P(A|𝜶) = P(A) P(𝜶|A)

P(𝜶) P(A|𝜶)

P(𝜶|A) =

P(A)

0,40 • 0,02

P(𝛼|A) =

= 38%

0,021

68