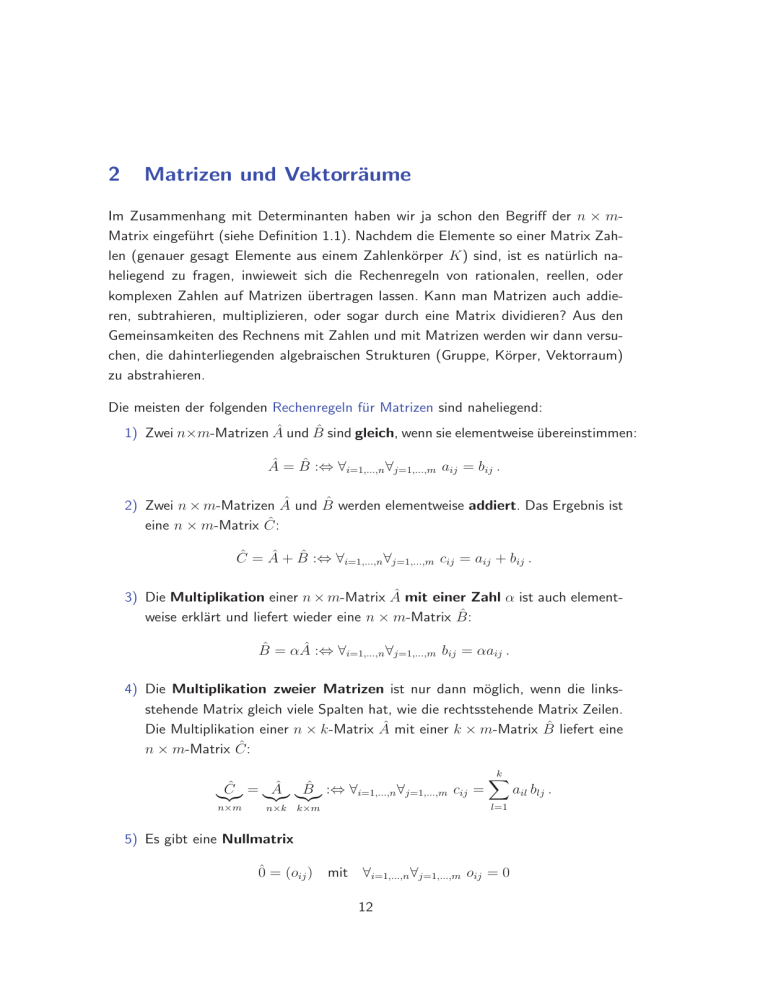

2 Matrizen und Vektorräume

Werbung

2

Matrizen und Vektorräume

Im Zusammenhang mit Determinanten haben wir ja schon den Begriff der n × mMatrix eingeführt (siehe Definition 1.1). Nachdem die Elemente so einer Matrix Zahlen (genauer gesagt Elemente aus einem Zahlenkörper K) sind, ist es natürlich naheliegend zu fragen, inwieweit sich die Rechenregeln von rationalen, reellen, oder

komplexen Zahlen auf Matrizen übertragen lassen. Kann man Matrizen auch addieren, subtrahieren, multiplizieren, oder sogar durch eine Matrix dividieren? Aus den

Gemeinsamkeiten des Rechnens mit Zahlen und mit Matrizen werden wir dann versuchen, die dahinterliegenden algebraischen Strukturen (Gruppe, Körper, Vektorraum)

zu abstrahieren.

Die meisten der folgenden Rechenregeln für Matrizen sind naheliegend:

1) Zwei n×m-Matrizen  und B̂ sind gleich, wenn sie elementweise übereinstimmen:

= B̂ :⇔ ∀i=1,...,n ∀j=1,...,m aij = bij .

2) Zwei n × m-Matrizen  und B̂ werden elementweise addiert. Das Ergebnis ist

eine n × m-Matrix Ĉ:

Ĉ = Â + B̂ :⇔ ∀i=1,...,n ∀j=1,...,m cij = aij + bij .

3) Die Multiplikation einer n × m-Matrix  mit einer Zahl α ist auch elementweise erklärt und liefert wieder eine n × m-Matrix B̂:

B̂ = α :⇔ ∀i=1,...,n ∀j=1,...,m bij = αaij .

4) Die Multiplikation zweier Matrizen ist nur dann möglich, wenn die linksstehende Matrix gleich viele Spalten hat, wie die rechtsstehende Matrix Zeilen.

Die Multiplikation einer n × k-Matrix  mit einer k × m-Matrix B̂ liefert eine

n × m-Matrix Ĉ:

Ĉ = |{z}

B̂ :⇔ ∀i=1,...,n ∀j=1,...,m cij =

|{z}

|{z}

n×m

n×k

k×m

k

X

l=1

5) Es gibt eine Nullmatrix

0̂ = (oij ) mit ∀i=1,...,n ∀j=1,...,m oij = 0

12

ail blj .

und eine (quadratische) Einheitsmatrix

1̂ = (lij ) mit ∀i=1,...,n ∀j=1,...,n lij = δij ,

δij =

(

1

0

i=j

,

i 6= j

wobei δij das sog. Kronecker-Symbol (Kronecker-Delta) ist.

Bemerkung — Für entsprechend dimensionierte Nullmatrizen und Einheits-

matrizen gilt:

= |{z}

0̂ = |{z}

|{z}

0̂

0̂ |{z}

|{z}

n×n n×m

und

n×m

n×m m×m

= |{z}

1̂ = |{z}

1̂ |{z}

|{z}

.

|{z}

n×n n×m

n×m m×m

n×m

Bemerkung — Die Addition von Matrizen ist assoziativ

(Â + B̂) + Ĉ = Â + (B̂ + Ĉ)

und kommutativ

+ B̂ = B̂ +  .

Bemerkung — Die Matrizenmultiplikation ist assoziativ ((ÂB̂)Ĉ = Â(B̂ Ĉ))

aber im Allgemeinen nicht kommutativ! Ein nicht verschwindender

Kommutator

[Â, B̂] := ÂB̂ − B̂ Â

ist Ausdruck für die Nichtvertauschbarkeit zweier Matrizen bei Multiplikation.

Beispiel 2.1 — Nichtkommutativität der Matrizenmultiplikation:

=

0 1

1 0

!

,

B̂ =

1 0

0 −1

!

⇒

ÂB̂ =

0 −1

1 0

!

= −B̂ Â

Bemerkung — Wird eine Summe von Matrizen mit einer Zahl multipliziert,

so gilt das Distributivgesetz:

α( + B̂) = α + αB̂ .

Ein weiteres Distributivgesetz gilt, wenn eine Summe von Zahlen mit einer

Matrix multipliziert wird:

(α + β) = α + β  .

13

Ferner gilt auch Distributivität, wenn eine Summe von Matrizen mit einer

Matrix multipliziert wird

Â(B̂ + Ĉ) = ÂB̂ + ÂĈ

bzw. (Â + B̂)Ĉ = ÂĈ + B̂ Ĉ .

Es wurde ja schon einige Male festgestellt, dass die Koeffizienten von Matrizen allgemein Elemente aus einem Körper sein können und nicht nur auf etwa reelle Zahlen

beschränkt sind. In der Folge wollen wir uns genauer ansehen, was man unter einem

“Körper” versteht. Bevor wir die algebraische Struktur eines Körpers untersuchen, ist

es allerdings zweckmäßig den Begriff der Gruppe einzuführen.

Definition 2.1 — Eine Gruppe (G, ◦) besteht aus einer nicht-leeren Menge G

und einer Verknüpfung, die jedem geordneten Paar (a, b) von Elementen

aus G eindeutig ein mit a◦b bezeichnetes Element aus G zuordnet. Formal

stellt die Verknüpfung ◦ eine Abbildung der Produktmenge G × G in G

dar,

◦:

G×G→G

(a, b) 7→ a ◦ b

(Abgeschlossenheit)

die folgende Eigenschaften aufweisen soll:

i) ∀ a, b, c ∈ G : (a ◦ b) ◦ c = a ◦ (b ◦ c)

(Assoziativität)

ii) ∃ e ∈ G : e ◦ a = a ◦ e = a , ∀ a ∈ G

(neutrales Element)

iii) ∀ a ∈ G ∃ a−1 ∈ G : a−1 ◦ a = a ◦ a−1 = e

(inverses Element)

Gilt zusätzlich die Eigenschaft

iv) ∀ a, b ∈ G : a ◦ b = b ◦ a

(Kommutativität)

so spricht man von einer kommutativen (oder abelschen) Gruppe.

Bemerkung — Es existiert genau ein neutrales Element e. Ist dieses Element

linksneutral (e ◦ a = a), so ist es auch rechtsneutral (a ◦ e = a) und

umgekehrt. Zu jedem a ∈ G gibt es genau ein a−1 . Ist dieses Element

linksinvers (a−1 ◦ a = e), so ist es auch rechtsinvers (a ◦ a−1 = e) und

umgekehrt.

14

Beispiel 2.2 — Die ganzen Zahlen mit der üblichen Addition als Verknüpfung

bilden eine Gruppe (Z, +). Analoges gilt für (Q, +), (R, +), (C, +). In

allen Fällen ist e = 0 und a−1 = −a.

Beispiel 2.3 — (N, +) bildet keine Gruppe, da 0 ∈

/ N und somit kein neutrales

Element in N vorhanden ist. (N0 , +) mit N0 = N ∪ {0} weist zwar ein

neutrales Element auf, es fehlen aber noch immer die inversen Elemente.

Es ist also auch keine Gruppe.

Beispiel 2.4 — Rationale Zahlen ohne Null mit der üblichen Multiplikation als

Verknüpfung bilden eine Gruppe (Q\{0}, ·). Analoges gilt für (R\{0}, ·),

(C \ {0}, ·). In allen Fällen ist e = 1 und a−1 = 1/a.

Beispiel 2.5 — Ganze Zahlen ohne Null (Z \ {0}, ·) mit der üblichen Multipli-

kation als Verknüpfung bilden keine Gruppe. Es gibt zwar ein neutrales

Element, aber i.A. (außer für ±1) kein inverses.

Beispiel 2.6 — Die Menge aller n × m-Matrizen mit ganzzahligen Matrixele-

menten ({Â | Â ist eine n × m-Matrix mit aij ∈ Z}, +) ist mit der oben

definierten, elementweisen Matrizenaddition eine Gruppe. Analoges gilt

für aij ∈ Q, R, oder C.

Beispiel 2.7 — (General Linear Group) Reelle, quadratische n × n Matrizen

mit nicht-verschwindender Determinante bilden bezüglich der oben definierten Matrizenmultiplikation eine Gruppe:

GL(n, R) := ({ |  ist n × n-Matrix mit aij ∈ R und det  6= 0}, ·)

Die Forderung det  6= 0 garantiert für jede Matrix  die Existenz ihrer

inversen Matrix Â−1 , sodass  · Â−1 = Â−1 ·  = 1̂. Die praktische

Berechnung von Â−1 wird weiter unten besprochen.

Beispiel 2.8 — (Symmetrische Gruppe) Die Menge Sn aller Permutationen von

n Elementen (siehe Definition 1.3) bildet bezüglich der Hintereinanderausführung ◦ die sog. “symmetrische Gruppe” (Sn , ◦) (oder kurz Sn ).

15