Prüfungstutorat: Angewandte Methoden der Politikwissenschaft

Werbung

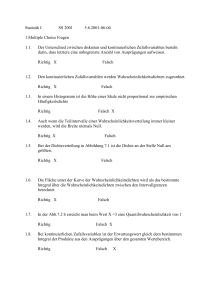

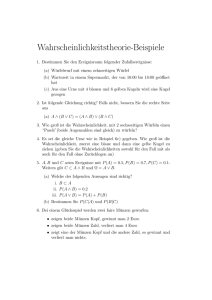

Prüfungstutorat: Angewandte Methoden der Politikwissenschaft Polito Seminar Carl Schweinitz 10.12.2014 Übersicht 1. 2. 3. 4. 5. 6. 7. Einheiten und Variablen Skalen und ihre Transformation Deskriptive Statistik Wahrscheinlichkeitstheorie Zufallsvariablen Verteilungsfunktionen Erhebung von Stichproben Quellen: Steenbergen, Marco. Vorlesung Angewandte Methoden der Politikwissenschaften. Was ich nicht mache • • • • • Mathe help desks R Interpretation von Graphiken Chi²-, t-, F-Verteilungen (auswendig lernen…) Aber: Fragen gerne! 1. Einheiten und Variablen • Einheiten: – Objekte über die wir empirische Aussagen treffen – Ein Sample/Stichprobe ist ein Teil einer Population (=Universum aller relevanten Objekte) – Inferentielle Statistik wird benutzt um vom Sample auf die Population zu schliessen • Attribute: – – – – Charakteristika von Einheiten Konstante: variiert nicht Variable: variiert zwischen Einheiten Abhängige und unabhängige Variablen 2. Messung, Skalen, und Transformation • Messung: Zuteilung von Zahlen, die einen bekannten, empirischen Zusammenhang zwischen Objekten darstellen • Skalen: – – – – Nominalskala (Geschlecht/Gender) Ordinalskala (Zustimmung) Intervallskala (Temperatur in Celsius) Verhältnisskala (Distanz in Meter) • Transformationen: – – – – Nominalskala – alle Transformationen, die Unterschied behalten Ordinalskala – positiv monotone Transformation Intervallskala – affine und positiv lineare Transformation Verhältnisskala – positiv lineare Transformation 3. Deskriptive Statistik - univariat • Wieso: Datenchaos ordnen/visualisieren und Muster erkennen • Wie: Tabellen & Graphiken mit Frequenzen, Proportionen und Prozenten. • Kontinuierliche Variablen: – Gruppieren in sog. Klassen („bins“). – Klassenbreite: 3. Deskriptive Statistik – multivariat • 2 x 2 Tabellen: relatives Risiko (relative risk ratio) & Odds Ratio Kurzsichtig Stolpern Ja Nein Ja 15 5 Nein 3 25 • Relatives Risiko? • Odds Ratio? 3. Deskriptive Statistik – multivariat • 2 x 2 Tabellen: relatives Risiko (relative risk ratio) & Odds Ratio Kurzsichtig Stolpern Ja Nein Ja 15 5 Nein 3 25 • Relatives Risiko? 𝑅𝑅 = • Odds Ratio? 15 15+3 5 25+5 =5 3. Deskriptive Statistik – multivariat • 2 x 2 Tabellen: relatives Risiko (relative risk ratio) & Odds Ratio Kurzsichtig Stolpern Ja Nein Ja 15 5 Nein 3 25 • Relatives Risiko? 𝑅𝑅 = • Odds Ratio? 𝑂𝑅 = 15 3 5 25 15 15+3 5 25+5 = =5 15 ∗25 3 ∗5 = 25 3. Deskriptive Statistik – multivariat • Nominale / ordinale Werte: – Camér‘s 𝜐 – nominale mit nominalen oder ordinalen Variablen • 0 bis 1; 1 perfekte Assoziierung – Goodman and Kruskal‘s 𝛾 – ordinale mit ordinalen Variablen • 0 bis 1; 1 perfekte Assoziierung 4. Wahrscheinlichkeitstheorie - Grundlagen • Wahrscheinlichkeit: – Logisch: deduktiv; Münzwurf, Würfel – Subjektiv: Grad der subjektiven Überzeugung, dass eine bestimmte Aussage wahr ist; Obama tritt morgen zurück – Frequentistisch: induktiv, basierend auf Beobachtung von einer Menge an Versuchen; Autounfall, Krankheiten, etc. • Gesetz der grossen Zahlen: Wenn die Anzahl der Beobachtungen genügend gross genug ist, ist die relative Frequenz von 𝑗 eine genügend gute Approximation an Pr(𝑗). 4. Wahrscheinlichkeitstheorie - Rechnen • Basiert auf Kombinatorik (siehe basta14lec4a) • Stichprobenraum (sample space) = volles Ereignisset 𝑆 mit jedem Event als Subset: ℇ ⊂ 𝑆 • Events und ihre Wahrscheinlichkeiten können kombiniert werden: – Komplemente ( 𝐴 & 𝐴 ) : – Schnittmenge ( 𝐴 ∩ 𝐵 ): – Vereinigung ( 𝐴 ∪ 𝐵 ): Pr 𝐴 = 1 − Pr(𝐴) Pr 𝐴 ∩ 𝐵 = Pr 𝐴|𝐵 ∗ Pr(𝐵) Pr 𝐴 ∪ 𝐵 = Pr 𝐴 + Pr 𝐵 − Pr(𝐴 ∩ 𝐵) 5. Zufallsvariablen • Die Werte einer Zufallsvariablen sind durch Zufall beeinflusst. • Diskrete (bspw. Demonstrationen) oder kontinuierliche (bspw. GDP/capita) Werte. • Diskrete ZV: Probability Mass Function (PMF) 𝑓 𝑦 = Pr(𝑌 = 𝑦) • Kontinuierliche ZV: Probability Density Funktion (PDF) 𝑎 𝑓 𝑦 𝑑𝑦 = Pr(𝑎 ≤ 𝑦 ≤ 𝑏) 𝑏 • Kumulative Verteilungsfunktionen F 𝑦 = 𝑦𝑖≤𝑦 Pr(𝑌 = 𝑦𝑖 ) ; 𝐹 𝑦 = 𝑦 𝑓 −∞ 𝑦 𝑑𝑦 5. Zufallsvariablen: Beispiel 1 Die Temperatur ist heute uniform zwischen 0 und 10°C verteilt. 1. Was ist die Wahrscheinlichkeit, genau 1°C zu messen? 2. Mit welcher Wahrscheinlichkeit messen wir einen Wert zwischen 0 und 3°C am Thermometer? 3. Mit welcher Wahrscheinlichkeit messen wir 1°C, 2°C, oder 7°C und höher? 4. Wie hoch ist die Wahrscheinlichkeit, 12°C zu messen? 5. Zufallsvariablen: Support & Parameter • Support / Träger: Menge an Werten von 𝑌 für die 𝑓(𝑦) > 0 • Parameter: Bestimmen die Form der Verteilung – – – – Mittelwert Varianz Schiefe (skewness) Wölbung (kurtosis) • Beispiel: – Zeichne eine rechtsschiefe, leptokurtische Normalverteilung mit beliebigem Mittelwert und beliebiger Varianz. 5. Zufallsvariablen: Multivariate Verteilungen • Bivariate Wahrscheinlichkeitsfunktion: 𝑓 𝑦1 , 𝑦2 = Pr 𝑌1 = 𝑦1 ∩ 𝑌2 = 𝑦2 • Marginale Verteilung: Verteilung von nur einer ZV (𝑦1 ) unabhängig von der zweiten ZV (𝑦2 ) • Konditionale / bedingte Verteilung: Verteilung von 𝑦1 bei einem bestimmten Wert von 𝑦2 -> 𝑓(𝑦1 |𝑦2 ) • Statistische Unabhängigkeit: 𝑓 𝑦1 𝑦2 = 𝑓(𝑦1 ) 5. Zufallsvariablen: Beispiel 2 • Bsp: 𝑌1 = 1,2 ; 𝑌2 = 1,2 ; 𝑓 𝑦1 , 𝑦2 = • Pr 𝑌1 = 2, 𝑌2 = 2 ? • Pr 𝑌1 = 2 ? • Pr 𝑌1 = 2|𝑌2 = 2 ? 4 9𝑦1 𝑦2 5. Zufallsvariablen: Beispiel 2 y2 y1 1 2 1 4/9 2/9 2 2/9 1/9 • Bsp: 𝑌1 = 1,2 ; 𝑌2 = 1,2 ; 𝑓 𝑦1 , 𝑦2 = • Pr 𝑌1 = 2, 𝑌2 = 2 -> 1/9 • Pr 𝑌1 = 2 ? • Pr 𝑌1 = 2|𝑌2 = 2 ? 4 9𝑦1 𝑦2 5. Zufallsvariablen: Beispiel 2 y2 y1 1 2 1 4/9 2/9 2 2/9 1/9 • Bsp: 𝑌1 = 1,2 ; 𝑌2 = 1,2 ; 𝑓 𝑦1 , 𝑦2 = • Pr 𝑌1 = 2, 𝑌2 = 2 -> 2 9 1 9 1 9 • Pr 𝑌1 = 2 -> + = • Pr 𝑌1 = 2|𝑌2 = 2 ? 1 3 4 9𝑦1 𝑦2 5. Zufallsvariablen: Beispiel 2 y2 y1 1 2 1 4/9 2/9 2 2/9 1/9 • Bsp: 𝑌1 = 1,2 ; 𝑌2 = 1,2 ; 𝑓 𝑦1 , 𝑦2 = • Pr 𝑌1 = 2, 𝑌2 = 2 -> 2 9 1 9 1 9 • Pr 𝑌1 = 2 -> + = • Pr 𝑌1 = 2|𝑌2 = 2 -> 2 1 3 1 9 1 = + 9 9 1 3 4 9𝑦1 𝑦2 5. Zufallsvariablen: Zusammenfassen • Mittelwert: – Diskret – Kontinuierlich • Varianz: – Diskret – Kontinuierlich • Kovarianz: – Diskret – Kontinuierlich 5. Zufallsvariablen: Korrelation & kond. Mittel • Korrelation: -> Lineare Assoziation zwischen 𝑌1 und 𝑌2 auf einer Skala von -1 bis 1 • Konditionales Mittel: 5. Zufallsvariablen: Erwartungen & Momente • Erwartungswert = Mittelwert: 𝐸 𝑌 = 𝜇 • Momente: – Mittelwert – Varianz – Schiefe (skewness) <0 linksschief; >0 rechtsschief – Wölbung (kurtosis) – 𝛾4 − 3 = 𝑒𝑥𝑐𝑒𝑠𝑠 𝑘𝑢𝑟𝑡𝑜𝑠𝑖𝑠 <0 platykurtisch ; >0 leptokurtisch 6. Verteilungsfunktionen • Bernoulliverteilung: – Dichotom (nur zwei Ereignisse im Möglichkeitenraum); Münzwurf • Binomialverteilung: – Nur diskrete Werte von 0 – n – Beschreibt Serie von n Bernoulli-Prozessen • Poissonverteilung: – Für Variablen deren Mittel und Varianz gleich sind – Oft „count“-Daten (Demonstrationen, Tote, etc.) 6. Verteilungsfunktionen • Normalverteilung – Kontinuierliche Werte von −∞ bis ∞ – PDF: 𝜇= Mittelwert 𝜎= Standardabweichung Generell: 𝑌~𝑁(𝜇, 𝜎) – Median = Mode = Mittel – Wölbung = Schiefe = 0 – Standard Normalverteilung: 𝑍~𝑁 0,1 ; 95%: -1.96 – 1.96 – Z-Transformation (von realer zur standard NV): 𝑧 = • Chi²-Verteilung, t-Verteilung, F-Verteilung. 𝑦−𝜇 𝜎 7. Stichprobenerhebung • Zufällige vs. Bewusste Auswahl • Randomisiert: jedes Mitglied der untersuchten Population hat dieselbe Wahrscheinlichkeit (>0), gezogen zu werden. – Simple random sampling – Stratified sampling – Cluster sampling • Was unterscheidet die verschiedenen Samplingmethoden und wann werden sie angewendet? 7. Stichprobenerhebung • Zufällige vs. bewusste Auswahl • Randomisiert: jedes Mitglied der untersuchten Population hat dieselbe Wahrscheinlichkeit (>0), gezogen zu werden. – Simple random sampling – Stratified sampling – Cluster sampling • Was unterscheidet die verschiedenen Samplingmethoden und wann werden sie angewendet? 7. Stichprobenerhebung • Stichprobenverteilung: – Wahrscheinlichkeitsverteilung eines statistischen Wertes der Stichprobe (bzw. des Mittels) auf Grundlage der hypothetischen Ziehung aller möglichen Proben der Größe 𝑛. • Normalverteilte Werte: – In einem Sample ist der Mittelwert einer normalverteilten Variable normalverteilt um den wahren Mittelwert der Variable in der Grundgesamtheit. • Central Limit Theorem: – Gegeben eine genügend grosse Stichprobe, so ist jeder Mittelwert normalverteilt um den (wahren) Mittelwert 𝜇 mit einer Varianz von 𝜎2 . 𝑛