Grundlagen der Quantenmechanik und Statistik

Werbung

Grundlagen der

Quantenmechanik und Statistik

Teil II: Thermodynamik und Statistik

Vorlesungen an der Ruhruniversität Bochum

K.–U. Riemann

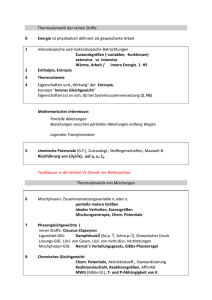

Inhaltsverzeichnis

1. Einführung

1.1 Temperatur und Zustandsgrößen

- Extensive und intensive Größen

- Thermodynamisches Gleichgewicht

1

1.2 Thermodynamik und Statistik

2

1.3 Ideales Gas und elementare Statistik

- Verteilungsfunktionen im µ–Raum, Mittelwerte

- Definition der Temperatur T und des Drucks

- Thermische und kalorische Zustandsgleichung des idealen Gases

3

1.4 Die Maxwell-Boltzmannverteilung

5

2. Thermodynamik

2.1 Zustandsgrößen und totale Differentiale

- Der nullte Hauptsatz: Zustandsgröße Temperatur

8

2.2 Der erste Hauptsatz

- Arbeit und Wärme, Energiesatz

- Verbot des perpetuum mobile erster Art

9

2.3 Der zweite Hauptsatz

- Die Entropie als Zustandsgröße beim idealen Gas

- Der Carnotsche Kreisprozeß

- Verbot des perpetuum mobile zweiter Art

- Die Entropie als universelle Zustandsgröße

- Entropie und Gleichgewicht, Zeitrichtung

11

2.4 Die thermodynamischen Potentiale

- Legendretransformationen

- Freie Energie, Enthalpie und Gibbssches Potential

Maxwellrelationen

- Extremaleigenschaften des thermodynamischen Gleichgewichts

17

2.5 Variable Teilchenzahl

- Das chemische Potential µ

- Das Potential J(T, V, µ) = −pV

- Die Entropie des idealen Gases

- Mischungsentropie und Gibbssches Paradoxon

20

i

2.6 Anwendungen: Reaktionsgleichgewichte

- Gleichgewicht bei Stoffumwandlungen

- Dampfdruck und Clausius–Clapeyron–Gleichung

- Chemische Reaktionen und Massenwirkungsgesetz

22

2.7 Das Nernstsche Theorem

25

3. Die Grundlagen der Statistik

3.1 Shannons Informationsentropie

- Der Informationsgehalt einer unkorrelierten Zeichenkette

- Korrelationen

27

3.2 Die physikalische Entropie

- Makro– und Mikrozustände

30

3.3 Ideales Gas und µ–Raum–Statistik

- Das Boltzmannsche H–Funktional

- Maxwellverteilung und maximale Unkenntnis

- Zerlegung des µ–Raums in Zellen h3

- Ununterscheidbarkeit und korrigierte Abzählung

- Die Sackur–Tetrode–Formel

31

3.4 Die statistischen Gesamtheiten

- Mikro– und Makro–Nebenbedingungen

- Die Maximierung der Entropie

- Lagrangeparameter und intensive Zustandsgrößen

35

3.5 Die mikrokanonische Gesamtheit

38

3.6 Die kanonische Gesamtheit

39

3.7 Die großkanonische Gesamtheit

41

3.8 Die Äquivalenz der Gesamtheiten

- Energieschwankungen in der kanonischen Gesamtheit

- Dichteschwankungen in der großkanonischen Gesamtheit

- Phasenübergänge

43

3.9 Klassische Γ–Raum–Statistik

- Phasenraumdichte und Gesamtheiten

- Die klassische und halbklassische Zustandssumme

45

4. Anwendungen

4.1 Der Gleichverteilungs–Satz

49

ii

4.2 Das klassische ideale Gas

- Rotationsfreiheitsgrade des mehratomogen Gases

50

4.3 Der ideale Festkörper

- Das Dulong–Petitsche Gesetz

- Das Einstein–Modell

53

4.4 Eingefrorene Freiheitsgrade

- Vibrations– und Rotationstemperatur

56

4.5 Das Problem idealer Quantengase

- Der Fehler bei korrigierter Boltzmannabzählung

- Zustände und Besetzungszahlen

- Die Zustandssumme und das Problem der Nebenbedingung

- Der halbklassische Grenzfall

57

4.6 Fermi–Dirac– und Bose–Einstein–Statistik

- Die Separation der großkanonische Zustandssumme

- Besetzungszahlen bei Fermionen und Bosonen

- Fermi–, Bose– und Boltzmann–Verteilung

- Die Thermodynamik der Quantengase

61

4.7 Quantengase geringer Dichte

- Druckänderung und Entartungsgrad

65

4.8 Das hochentartete Fermigas

- Fermisee, Fermikante und Fermitemperatur

- Nullpunktsenergie und Nullpunktsdruck

- Metallelelektronen

- Weiße Zwerge

67

4.9 Das entartete Bosegas

- Die Bose–Einstein–Kondensation

- Der λ–Punkt des 4 He

70

4.10 Das Photonengas

- Strahlung als hochrelativistisches Bosegas

- Das Stefan–Boltzmann–Gesetz

- Das Plancksche und Rayleigh–Jeanssche Strahlungsgesetz

73

5. Probleme der Statistik

5.1 Meß–, Zeit– und Scharmittel

- Das Problem der a priori–Wahrscheinlichkeiten

- Mikrozustände und Ergode

- Mesung und Zeitmittelwert

iii

75

- Die Reproduzierbarkeit von Meßergebnissen

- Zeitmittel und Scharmittel

5.2 Die Ergoden– und die Quasi–Ergoden–Hypothese

77

5.3 Der Poincarésche Wiederkehreinwand

78

5.4 Irreversibilität und Zeitumkehr

- µ–Raum und Boltzmanns H–Theorem

- Γ–Raum und Liouvillesatz

- Entropie und effektives Phasenraumvolumen

- Die Zeit als Ordnungsparameter

- Das Problem der Zeitrichtung

79

Literaturhinweise

82

iv

1

Einführung

1.1

Temperatur und Zustandsgrößen

Das ausgehende 18. Jahrhundert ahnte noch nichts von den grundlegenden Umwälzungen, die hundert Jahre später das mechanistische Weltbild erschütterten. Die

analytische Mechanik galt im wesentlichen als abgeschlossen, die Lehre von der Elektrizität machte beeindruckende Fortschritte, und die ersten Wärmekraftmaschinen

wurden entwickelt. Wie die Elektrizität so wurde auch die “Wärme” als ein zusätzliches akzidentelles Attribut der Materie angesehen: So wie eine Metallkugel eine

elektrische Ladung tragen kann, so kann sie auch eine oder bestimmte “Wärmemenge” aufnehmen. Zum generellen Stand der wissenschaftlichen Erkenntnis merken wir

an, daß 1775 — zehn Jahre nach dem Bau der ersten “modernen” Dampfmaschine

durch J. Watt — die französische Akademie beschloß, keine Konstruktionsvorschläge für ein perpetuum mobile mehr zur Prüfung anzunehmen.

Sowohl der Wunsch, den Wirkungsgrad der Wärmekraftmaschinen zu verbessern,

als auch Bedürfnisse der aufblühenden Chemie führten dann im 19. Jahrhundert zur

systematischen Entwicklung der Thermodynamik, einer makroskopisch–phänomenologischen Theorie der Wärme. Ziel der Thermodynamik ist es, Gesetzmäßigkeiten

zwischen den Zustandsgrößen eines Systems aufzufinden. Unter den Zustandsgrößen versteht man makroskopische Parameter (z. B. Druck p und Volumen V ),

die den thermodynamischen Zustand des Systems eindeutig festlegen. Ein Teil der

Aufgabe ist daher, zu ermitteln, welche Parameter und Meßgrößen überhaupt zu

den Zustandsgrößen gehören. Daß diese Frage keineswegs trivial ist, mag man daran sehen, daß gerade der “Wärmeinhalt” (etwa einer Wärmeflasche) nicht zu den

Zustandsgrößen gehört.

Es zeigt sich, daß der Zustand eines thermodynamischen Systems nur dann eindeutig durch wenige makroskopische Parameter — also Zustandsgrößen — beschrieben

werden kann, wenn sich das System im thermodynamischen Gleichgewicht befindet. Das “Gleichgewicht” können wir im Augenblick noch nicht präzise definieren;

notwendige Voraussetzung ist in jedem Fall die (Quasi–)Stationarität. Einen ersten

Schritt weiter kommen wir, wenn wir extensive und intensive Zustandsgrößen unterscheiden. Extensiv sind solche Zustandsgrößen, (z. B. Energie E und Volumen V ),

die sich bei der Zusammensetzung des Systems aus Teilsystemen additiv verhalten1 .

Intensive Zustandsgrößen (z. B. der Druck p) ändern sich dagegen nicht, wenn man

das System verdoppelt. Eine wichtige Gleichgewichtsbedingung ist nun, daß intensive

Größen in allen Teilsystemen gleich sind.

1

In dieser Annahme liegt eine Idealisierung “großer” Systeme, in denen Oberflächeneffekte gegenüber Volumeneffekten vernachläßigt werden können.

1

Zu den intensiven Zustandsgrößen gehört insbesondere die Temperatur, ein Parameter, der zunächst der alltäglichen Erfahrung (kalt, warm, heiß) entnommen ist,

und der innerhalb der Thermodynamik axiomatisch eingeführt und definiert wird.

1.2

Thermodynamik und Statistik

Der axiomatische Aufbau der Thermodynamik arbeitet mit nur wenigen Begriffen,

die sich als leistungsfähig und universell anwendbar erwiesen haben. Daher ist die

mathematische Formulierung der Thermodynamik auch äußerst knapp und elegant.

Wenn die Thermodynamik trotzdem häufig als schwierigstes Teilgebiet der theoretischen Physik empfunden wird, so liegt das daran, daß die Theorie sehr abstrakt und

der Anschauung wenig zugänglich ist. Es gab daher von Anfang an Bemühungen,

die Thermodynamik aus elementaren Grundprinzipien der übrigen physikalischen

Disziplinen herzuleiten und zu verstehen.

Hintergrund solcher Bemühungen war eine frühe Vermutung über den Zusammenhang zwischen der Temperatur und der (mittleren) Teilchenenergie einer atomistischen Beschreibung der Materie, welche die gleichzeitig sich entwickelnde Chemie

mit sich brachte. (Die “Atomhypothese” blieb allerdings bis in die Anfänge des 20.

Jahrhunderts umstritten!)

Die alternative mikroskopische Theorie, welche die Axiome der Thermodynamik

begründet, ihre abstrakten Begriffe mit konkreten Inhalten füllt und last not least

die thermodynamischen Materialeigenschaften explizit zu berechnen erlaubt, ist die

statistische Mechanik.

Wie in der Quantenmechanik werden wir also auch in diesem Teil der Vorlesung

statistische Betrachtungen durchführen und mangelnde Detailkenntnis durch Wahrscheinlichkeitsaussagen ersetzen — aber aus einem andern Grund als in der Quantenmechanik: Dort war uns die Statistik von der prinzipiellen Unmöglichkeit, den

Ort und Impuls eines Teilchens — und damit seine Bahn — genau anzugeben, aufgezwungen worden. Formales Kennzeichen dieser prinzipiellen Unmöglichkeit war

die Naturkonstante h̄, die unsere mögliche Kenntnis über ein Teilchen begrenzt. In

der Wärmelehre betreiben wir Statistik aus der praktischen2 Unmöglichkeit, ∼ 1023

Teilchenkordinaten und –impulse zu berechnen. Das können wir nicht und wollen

wir nicht: Ein einziger Koordinatensatz für L = 6 · 1023 Teilchen würde 1022 Seiten,

also 1019 Bücher, also 1014 Universitätsbibliotheken füllen!

Stattdessen wollen wir die “verborgenen Parameter”, nämlich die individuellen Koordinaten und Impulse des Vielteilchen–Systems statistisch beschreiben und die makroskopischen Zustandsgrößen aus mikroskopischen Teilcheneigenschaften über Gesetzmäßigkeiten großer Zahlen konstruieren.

2

Die prinzipielle Unmöglichkeit der Quantenmechanik mag hinzukommen: Wir betreiben dann

Quantenstatistik.

2

Mehr oder weniger trivial ist das für die extensiven Zustandsgrößen: Sie setzen sich ja

additiv aus den entsprechenden Größen von Teilsystemen zusammen und lassen sich

damit letztlich direkt auf die mikroskopischen Teilcheneigenschaften zurückführen.

Die erste Aufgabe einer elementaren Statistik besteht also darin, intensive Größen

wie Druck oder Temperatur zu erklären und zu berechnen.

1.3

Ideales Gas und elementare Statistik

Wir greifen diese erste Aufgabe der elementaren Statistik auf, ehe wir im nächsten

Kapitel das Gerüst der Thermodynamik aufbauen und im dritten Kapitel eine systematische Statistik betreiben. Dazu betrachten wir das Modell des klassischen idealen

Gases.

Die mikroskopischen Bausteine des idealen Gases sind Massenpunkte, die keinen

Raum beanspruchen und keine Kräfte aufeinander ausüben. Viele reale Gase —

insbesondere leichte Edelgase (He) bei hoher Temperatur und niedriger Dichte —

kommen diesem Ideal recht nahe.

Entsprechend unserem Vorhaben, das ideale Gas statistisch zu beschreiben, fragen

wir nicht nach den einzelnen Teilchenorten und –geschwindigkeiten, sondern nach

der Wahrscheinlichkeit, am Ort r ein oder mehrere Teilchen der Geschwindigkeit v

anzutreffen. Genauer fragen wir nach der Verteilungsfunktion f (r, v, t), welche

die Dichte der Teilchen im sogenannten µ–Raum mit den Koordinaten r und v

repräsentiert. Wir erwarten also, im sechs–dimensionalen Volumenelement dτµ =

d3 rd3 v bei (r, v)

dN = f (r, v, t)d3 rd3 v

(1)

Teilchen zu finden. Eine Integration über alle Geschwindigkeiten liefert die Dichte

n(r, t) =

Z

f (r, v, t)d3 v

(2)

im Konfigurationsraum. Integrieren wir schließlich noch über die Ortskoordinaten,

so erhalten wir die gesamte Teilchenzahl

N=

Z

n(r, t)d3 r =

Z

f (r, v, t)d3 rd3 v

(3)

unseres Systems.

Die Wahrscheinlichkeit, daß die Geschwindigkeit eines beliebig herausgegriffenen

Teilchens im Volumenelement d3 v bei v liegt, ist also durch

1

f (r, v, t)d3 v

n

3

gegeben. Daraus ergeben sich die Mittelwerte

hAi =

1

n

Z

A(v)f (r, v, t)d3v

(4)

beliebiger Funktionen A(v) der Teilchengeschwindigkeiten. Als besonders wichtiges

Beispiel für solche Mittelwerte nennen wir die mittlere kinetische Energie hεkin i der

Gasmoleküle. Diese mittlere Teilchenenergie benutzen wir, um die Temperatur T

zu definieren:

3

m 2

hv i = kT .

2

2

hεkin i =

(5)

T ist dabei die absolute Temperatur. Sie wird in K (Kelvin) gemessen und unterscheidet sich von der bürgerlichen Temperatur in Celsiusgraden lediglich durch

eine additive Konstante: Der Schmelzpunkt des Eises liegt bei T0 = 273.2 K. Zur

Anpassung an diese historische Temperaturskala wird in der energetischen Temperaturdefinition der Gl. (5) die Boltzmannkonstante k = 1.38 · 1023 Ws/K benutzt.

(k ist also eine Maßsystemskonstante und keine Naturkonstante.)

Nach der Definition der Temperatur wollen wir auch den Druck des idealen Gases

bestimmen. Unter dem Druck verstehen wir die Kraft, die das ideale Gas auf jede

Einheitsfläche der Gefäßwand ausübt. Wir gehen von der Vorstellung aus, daß diese

Kraft auf dem mittleren Impulsübertrag der Gasmoleküle, die an der Gefäßwand

reflektiert werden, beruht. Ein Flächenelement dA – etwa in z–Richtung – wird je

Zeiteinheit von

Z

dN = dA

vz f (v)d3 v

vz >0

Molekülen getroffen. Dabei bezeichnet f wieder die Verteilungsfunktion der Moleküle. Ein einzelnes Molekül mit der Geschwindigkeitskomponente vz überträgt den

Impuls 2mvz . Der gesamte Impulsübertrag je Zeiteinheit, also die Kraft, ist daher

durch

Z

Z

2

3

dK = 2dA

mvz f (v)d v = dA mvz2 f (v)d3 v

vz >0

gegeben. Für das Integral gilt bei isotroper Verteilungsfunktion offenbar aus Symmetriegründen [vgl. Gl. (5)]

Z

mvz2 f (v)d3 v

1

=

3

Z

1

mv2 f (v)d3 v = n3kT .

3

Da der Druck durch p = dK/dA definiert ist, folgt so die thermische Zustandsgleichung des idealen Gases

p = nkT

oder pV = N kT .

4

(6)

Unter einer thermischen Zustandsgleichung verstehen wir allgemein eine Beziehung

zwischen der Temperatur und den übrigen Zustandsgrößen (hier Druck p und Volumen V oder Dichte n = N/V ), welche die Systemeigenschaften charakterisieren.

Neben der thermischen Zustandsgleichung benutzt man noch eine kalorische Zustandsgleichung, welche den gesamten Energieinhalt U des Systems angibt. Wegen

der Definition der Gl. (5) folgt für das (einatomige) ideale Gas die einfache kalorische

Zustandsgleichung

3

U = N hεkin i = N kT .

2

(7)

Wir betrachten abschließend ein ideales Gas in einem äußeren Kraftfeld −∇Φ(r)

(z. B. im Schwerefeld, Φ = mgz). Anhand eines quaderförmigen infinitesimalen

Volumenelements überlegt man sich dazu leicht, daß der Gradient ∇p eine Volumenkraft

dKp = −∇p d3 r

beschreibt. Diese Volumenkraft muß im Gleichgewicht die äußere Volumenkraft

dKΦ = −n ∇Φ d3 r

kompensieren. Daraus folgt

1

kT

∇Φ = − ∇p = − ∇n .

n

n

Im Gleichgewicht darf die Temperatur nicht vom Ort abhängen. Daher können wir

integrieren und erhalten Φ = −kT ln n+const oder

Φ

n = n0 e− kT .

(8)

Das Verhältnis n/n0 nach Gl. (8) wird als Boltzmannfaktor bezeichnet. Speziell

im homogenen Schwerefeld erhält man daraus die barometrische Höhenformel

n(z) = n0 e−

mgz

kT

bzw. p(z) = p0 e−

mgz

kT

,

(9)

welche (bei konstanter Temperatur, wir sind im Gleichgewicht!) die Dichte nz bzw.

den Druck pz in der Höhe z mit der Dichte n0 bzw. dem Druck p0 am Erdboden in

Beziehung bringt.

1.4

Die Maxwellverteilung

Im vorigen Abschnitt haben wir die Verteiungsfunktion zur Formulierung wichtiger

Mittelwerte benutzt. Sie enthält darüber hinaus die gesamte physikalisch relevante Information über ein System. Ihre Berechnung unter allgemeinen Bedingungen

5

ist Aufgabe der Kinetik, einer Verallgemeinerung der Statistik, die wir in dieser

Vorlesung nicht behandeln. In der Statistik fragen wir nur nach der Gleichgewichts–

Verteilung.

Daß wir für das ideale Gas überhaupt eine bestimmte Gleichgewichtsverteilung erwarten können, bedarf einer Erläuterung. Die Verteilungsfunktion eines homogenen

Systems wechselwirkungsfreier Teilchen zeigt nämlich keine Tendenz zu irgendeiner

“Relaxation”. Wir setzen beim idealen Gas also doch einen Rest an Wechselwirkung der Gasmoleküle untereinander (und/oder mit den Gefäßwänden) voraus, der

ausreicht, jeden beliebigen speziellen Ausgangszustand bald in ein völliges “Chaos”,

eben das thermodynamische Gleichgewicht, zu überführen.

Die Gleichgewichtsverteilung fM des idealen Gases wurde 1860 von Maxwell angegeben und wird daher als Maxwellverteilung bezeichnet. Sie darf natürlich nicht

von der Zeit abhängen. Für ein homogenes System ohne äußere Kräfte gilt also

fM (v) = ng(v) .

(10)

Die Funktion g bestimmte Maxwell durch eine genial einfache Überlegung:

1. g muß isotrop sein, also

g(v) = g(vx2 + vy2 + vz2 ) .

2. Die Wahrscheinlichkeiten der einzelnen Geschwindigkeitskomponenten vx , vy

und vz müssen unkorreliert sein, d.h,

g(v) = h(vx2 )h(vy2 )h(vz2 ) .

Es gilt also (mit x = vx2 , y = vy2 und z = vz2 ) die Funktionalgleichung

g(x + y + z) = h(x)h(y)h(z) ,

und durch logarithmisches Differenzieren nach x folgt

h0 (x)

g 0 (x + y + z)

=

.

g(x + y + z)

h(x)

Nun hängt die rechte Seite dieser Gleichung aber gar nicht von y und z ab; also ist

die linke Seite konstant:

g 0 (x)

= −α d.h. g(x) = Ce−αx

g(x)

Mit dem Integral

Z∞

e

−αx2

dx =

−∞

6

2

oder g(v) = Ce−αv .

r

π

α

und der Normierung

Z

π

gd v = C

α

3

3/2

=1

folgt daher

α

fM (v) = n

π

3/2

2

e−αv .

Im Gleichtgewicht sind die Geschwindigkeiten also Gauss–verteilt. Die Konstante

α repräsentiert die Breite der Verteilung oder das mittlere Geschwindigkeitsquadrat:

1Z 2

v fM (v)d3 v

hv i =

n

3/2

Z

α

d

2

= −

e−αv d3 v

π

dα

3

d

, also

= −α3/2 α−3/2 =

dα

2α

3

α =

.

2hv2 i

2

Mit der Temperaturdefinition in Gl. (10) erhalten wir α = m/2kT und

m

fM (v) = n

2πkT

3/2

mv2

e− 2kT .

(11)

Entsprechend ihrer sehr allgemein gehaltenen Herleitung ist die Maxwellverteilung von fundamentaler Bedeutung für unzählige Anwendungen (nicht nur beim

idealen Gas). Sie enthält bereits in komprimierter Form die gesamte Information

der klassischen Thermodynamik und Statistik des idealen Gases. Um so erstaunlicher ist die Tatsache, daß sie in der Quantenstatistik ihre Gültigkeit verliert. Das

muß uns im Moment um so mehr überraschen, als wir bei ihrer Herleitung nirgendwo

von den Bewegungsgleichungen der klassischen Mechanik Gebrauch gemacht haben.

Wir werden auf dieses Problem im Abschnitt 4.5 zurückkommen.

Faßt man den Boltzmannfaktor (9) mit der Maxwellverteilung (11) zusammen, so

erhält man die Maxwell–Boltzmann–Verteilung

fM B (r, v) = n0

m

2πkT

3/2

e−

Φ+mv2 /2

kT

.

(12)

Sie zeigt, daß die Dichte fM B im µ–Raum exponentiell mit der Gesamtenergie ε =

Φ + mv2 /2 der Gasmoleküle fällt. Wir hätten diesen Zusammenhang auch aus der

Wechselwirkungsfreiheit und dem Boltzmannfaktor erahnen können.

7

2

2.1

Thermodynamik

Zustandsgrößen und totale Differentiale

Wie bereits in der Einführung angedeutet, geben wir nun einen kurzen Abriß der

Thermodynamik, bei dem es wesentlich um die Definition bestimmter Zustandsgrößen im Gleichgewicht geht. Nehmen wir an, der makroskopische Gleichgewichtszustand sei durch die Variablen x1 , x2 , . . . , xn eindeutig charakterisiert. Dann ist jede

Funktion

y = f (x1 , x2 , . . . , xn )

(13)

eine Zustandsfunktion und kann selbst als eine Zustandsgröße benutzt werden. Häufig

ist eine interessierende Größe y nicht explizit, sondern durch eine Differentialform

(Pfaffsche Form)

δy =

X

ai (x1 , x2 , . . . , xn ) dxi

(14)

i

gegeben, und es stellt sich die Frage, ob Gl. (14) eine Zustandsgröße y definiert. Wir

benutzen darum das Differential–Symbol δ an Stelle von d, um auszudrücken, daß

sich durch Gl. (14) nicht notwendigerweise eine Zustandsfunktion (13) definieren

läßt. Notwendige (und hinreichende) Voraussetzung ist vielmehr, daß

ai =

∂f

∂xi

und folglich

∂ai

∂aj =

=

∂xj

∂xi

∂2f

∂xi ∂xj

(15)

gilt. Eine Differentialform (14), welche die Bedingung (15) erfüllt, heißt total. Eine

totale Differentialform ist integrabel und definiert eine Zustandsfunktion y. Für

totale Differentiale ersetzen wir das Symbol δ wieder durch das vertraute d und

schreiben

dy =

X

ai (x1 , x2 , . . . , xn ) dxi .

i

Als Zustandsvariable benutzen wir (immer)

8

(16)

— den Druck p und das Volumen V

sowie (je nach Bedarf) verschiedene makroskopische Parameter wie

— das Magnetfeld H und die Magnetisierung M

— die Spannung U und die Ladung q

— die Federkraft K und die Auslenkung x usw.

Wer glaubt, daß solche weiteren Parameter nichts in einer Theorie der Wärme zu

suchen haben, der sei an die Curietemperatur, an den thermoelektrischen Effekt, an

eine Autobatterie im Winter oder an die thermischen Spannungen in Bauelementen

erinnert.

Die Teilchenzahl N betrachten wir, wenn nichts anderes gesagt wird, als fest vorgegeben. Ist sie variabel (offenes System, chemische Reaktionen), gehört auch sie

zu den Zustandsvariablen. Und schließlich gibt es eine Zustandsgröße, die ganz im

Zentrum der Thermodynamik steht. Ihrer zentralen Bedeutung entsprechend führt

man sie oft axiomatisch durch einen Hauptsatz ein:

• Nullter Hauptsatz der Thermodynamik:

Es gibt eine Zustandsgröße Temperatur. Die Temperatur T charakterisiert

die Klasse aller Systeme, die miteinander im Gleichgewicht stehen.

Wir werden hier nicht den abstrakten Weg gehen, den Temperaturbegriff von dieser

axiomatischen Definition ausgehend schrittweise mit physikalischem Inhalt zu füllen,

sondern wir werden unter Bezug auf Abschnitt 1.3 die Temperatur als wohldefinierte

Größe betrachten.

In den obigen Beispielen haben wir jeweils zwei Zustandsvariablen zu Paaren (Y, X)

zusammengefaßt. Das erste Element Y eines Paares repräsentiert dabei eine intensive und das zweite Element X “die konjugierte” extensive Zustandsvariable. Das

R

Produkt konjugierter Zustandsvariablen (genauer: das Integral Y dX) stellt jeweils

eine Energie dar. Tatsächlich liegt im Energiesatz der Ausgangspunkt, aus dem die

formale Theorie entwickelt wird. Für die Zustandsvariablen Temperatur und Teilchenzahl fehlen uns noch die konjugierten Größen. Ihre Definition ist ein Kernpunkt

des abstrakten Formalismus.

2.2

Der erste Hauptsatz

Wir greifen die Bemerkung zum Energiesatz am Ende des vorigen Abschnitts auf

und notieren die Energieänderung unseres Systems in der Form

9

δU = δQ + δA .

(17)

Gl. (17) soll zunächst ausdrücken, daß die Energieänderung nicht allein durch die

am System geleistete Arbeit

δA = −pdV

"

+

X

#

Yi dXi ,

i

(18)

sondern außerdem durch eine “Wärmezufuhr” δQ beschrieben wird.

Bei der Arbeitsleistung δA berücksichtigen wir grundsätzlich die Druckarbeit −pdV

und je nach Bedarf zusätzliche Terme Yi dXi (s. o.), die verschiedene Formen mechanischer, elektromagnetischer oder auch chemischer Energie repräsentieren können.

Die eckigen Klammern sollen andeuten, daß wir diese zusätzlichen Terme meistens

weglassen, da wir nicht mit ihnen arbeiten.

Bezüglich der Wärmezufuhr δQ verlassen wir uns zunächst auf unsere naive Erfahrung und denken an einen Tauchsieder oder an einen Eiswürfel. Häufig werden

wir die Wärmezufuhr in der Form δQ = cdT beschreiben können, wobei c eine

“Wärmekapazität” bedeutet.

In unserer rein formalen Anschrift der Energiezufuhr haben wir bewußt das Symbol

δ für die Differentiale δU , δA und δQ benutzt. Dagegen besagt das Symbol d in

dV , dXi und dT , daß wir V , Xi und T als Zustandsgrößen betrachten und daß die

Differentiale deshalb total sind. Der erste Hauptsatz behauptet nun, daß dU ebenfalls

ein totales Differential ist. Wir können das axiomatisch fordern (s. u.), ziehen aber

vor, von der physikalischen Formulierung auszugehen:

• Erster Hauptsatz (physikalisch):

Es gibt kein perpetuum mobile erster Art.

Ein perpetuum mobile ist dabei eine Maschine, die “aus nichts” Energie erzeugt.

Nach hinreichend vielen Frustrationen ist die Menschheit nämlich zu dem Schluß

gekommen, daß die Energie (wobei wir das relativistische mc2 einschließen) eine

universelle Erhaltungsgröße ist, die weder aus dem Nichts geschaffen werden noch zu

nichts vergehen kann. Und wenn ich in der Mechanik durch Reibung Energie verliere,

so tritt eben diese Energie als “Wärmeenergie” wieder in Erscheinung. Mit einer

thermodynamischen Maschine, die einen Zyklus C durchläuft, kann ich demnach

weder Energie gewinnen noch verlieren:

I

C

δU = 0 .

Aus der Wegunabhängigkeit des Integrals folgt aber unmittelbar, daß sich U eindeutig als Zustandsfunktion definieren läßt oder daß das Differential dU total ist:

10

• Erster Hauptsatz (axiomatisch):

Die innere Energie U ist eine (extensive) Zustandsgröße mit dem Differential

dU = δQ + δA .

2.3

(19)

Der zweite Hauptsatz

Nachdem U als Zustandsgröße ausgewiesen ist, greifen wir die naheliegende Frage

nach einem “Wärmestoff” auf und fragen, ob auch Q eine Zustandsgröße und damit

δQ = dU − δA

ein totales Differential ist. Wir können diese Frage für ein spezielles System, bei dem

wir bereits über alle Information verfügen, rein rechnerisch entscheiden: Das ideale

Gas.

Aus den Zustandsgleichungen

3

U = N kT

2

und pV = N kT

folgt sofort

3

dU = N k dT

2

und

δA = −pdV = −

N kT

dV .

V

Damit erhalten wir das Differential

δQ = N k

3

T

dT + dV

2

V

.

(20)

Ist dieses Differential total? Wir fassen Q als Funktion von T und V auf und rechnen

∂ 3

= 0 und

∂V 2

∂ T 1

6= 0 .

=

∂T V V

V

δQ ist also kein totales Differential, es gibt daher keine Zustandsgröße Q und —

entgegen der vermeintlichen Alltagserfahrung mit der Wärmeflasche — keinen wohldefinierten “Wärmeinhalt” oder “Wärmestoff”!

11

Dagegen fällt uns förmlich ins Auge, daß wir Gl. (20) durch einen einfachen “integrierenden Faktor” integrabel machen können: Die Differentialform

δQ

dV

3 dT

dS =

= Nk

+

T

2 T

V

!

(21)

ist offenbar total und läßt sich sofort zu der eigenartigen Zustandsfunktion

S = Nk

3

ln T + ln V + C(N ) ,

2

(22)

die den Namen Entropie trägt, integrieren. Dabei ist C eine Integrationskonstante.

Da wir die Teilchenzahl N konstant gehalten haben, müssen wir damit rechnen, daß

in C noch eine Abhängigkeit von N “versteckt” ist.

Die Entropie — die unserer direkten Anschauung kaum zugänglich ist und deren

allgemeine Bedeutung wir bisher noch keineswegs postuliert haben — kontrolliert

den Wirkungsgrad einer einfachen Wärmekraftmaschine, die mit dem idealen Gas

arbeitet: der Carnot–Maschine.

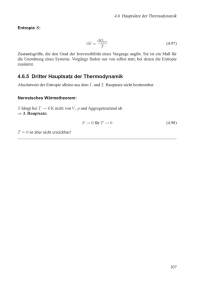

Diese idealisierte Maschine arbeitet zwischen zwei Temperaturniveaus T0 und T1 mit

einem Zyklus, dessen Weg in der p–V –Ebene unten skizziert ist. Der Zyklus werde

in der Reihenfolge (1)–(2)–(3)–(4)–(1)– . . . periodisch durchlaufen, die Wege (1)–(2)

und (3)–(4) sind Isothermen, also Kurven konstanter Temperatur, und die Wege

(2)–(3) und (4)–(1) Adiabaten, also Wege ohne Wärmezu– oder –abfuhr (δQ = 0).

1

p

T1

2

4

T0

3

V

Während eines Zyklus wird auf dem Weg (1)–(2) die Wärme Q12 aus dem “Wärmebad” der Temperatur T1 aufgenommen und auf dem Weg (3)–(4) die Wärme −Q34

an das Wärmebad der Temperatur T0 < T1 abgegeben. Der Überschuß

∆Q = Q12 + Q34 = −∆A

12

wird von der Maschine in mechanische Arbeit |∆A| = −∆A umgesetzt. (Denn U ist

Zustandsgröße!)

Während als kühlendes Wärmebad (T0 ) die natürliche Umgebung gewählt werden

kann, muß die Temperatur T1 > T0 durch eine Heizung aufrecht erhalten werden.

Q12 ist also die Primärenergie, die je Zyklus von außen in die Maschine “investiert”

werden muß. Diese Primärenergie wird mit dem Wirkungsgrad

ηC =

|∆A|

Q12 + Q34

=

Q12

Q12

in mechanische Arbeit umgesetzt. Und nun kommt die Entropie ins Spiel: Aus

I

dS =

I

Q12 Q34

δQ

=

+

=0

T

T1

T0

folgt ohne jede Rechnung Q34 = −Q12 T0 /T1 und

ηC = 1 −

T0

.

T1

(23)

Ehe wir die physikalischen Konsequenzen besprechen, machen wir uns bewußt, daß

wir das Ergebnis praktisch ohne Rechnung erhalten haben. Wir haben keine Wärmekapazitäten (cp , cV , Übungen!) berechnet, brauchten keine “Adiabatengleichung”

(Übungen!) herzuleiten und haben kein Integral

∆A =

I

pdV

ausgewertet. Wir haben den Carnotschen Wirkungsgrad ηC einzig und allein aus der

Kenntnis, daß U und S Zustandsgrößen sind, erhalten.

Und nun zur Physik: Der Wirkungsgrad der Carnotschen Maschine hängt vom

Verhältnis der Temperaturen ab und ist immer kleiner als eins. Für den Besitzer einer Carnot–Maschine ist Wärmeenergie also nicht so wertvoll wie mechanische oder elektrische Energie, die vollständig in Arbeit umgesetzt werden kann.

Die Wärmeenergie ist um so wertvoller, je höher das obere Temperaturniveau T1

bei der Umsetzung gewählt werden kann. Erst für T1 = ∞ oder T0 = 0 wird die

Wärmeenergie — bezogen auf die Carnotmaschine — “vollwertig”.

Dem Besitzer einer Carnotmaschine steht nicht nur eine Wärmekraftmaschine zur

Verfügung, sondern auch eine Klimaanlage, mit der er im Sommer kühlen und im

Winter heizen kann. Durchläuft man den Zyklus nämlich in umgekehrter Richtung,

so erhält man eine ”Wärmepumpe”, die von außen Arbeitsleistung aufnimmt, um

Wärme von dem niedrigeren Temperaturniveau T0 in das höhere Temperaturniveau

13

T1 zu “pumpen”. Da aus dem niedrigen Niveau noch Wärme aufgenommen wird,

ist der “Heiz–Wirkungsgrad”

η̄C =

−Q12

1

=

∆A

ηC

(24)

der Wärmepumpe größer als eins.

Der Besitzer zweier Carnotmaschinen CM und CM0 kann nun folgendes amüsante

Spiel treiben: Er schafft sich zwei gemeinsame Wärmebäder (T0 und T1 ) für seine

beiden Maschinen und läßt CM0 als Wärmekraftmaschine laufen. Mit der gewonnen Arbeitleistung treibt er CM als Wärmepumpe an und pumpt die von CM0

“verbrauchte” Wärme ins obere Wärmebad zurück. Dieses Spiel ist besonders ökologisch, denn als Gesamtwirkung für die Umwelt passiert — rein gar nichts: Es wird

effektiv weder Arbeit geleistet noch verbraucht und den Temperaturniveaus wird

effektiv weder Wärme entzogen noch zugeführt.

Nachdem sich obiger Maschinenbesitzer lange genug an seinem Spiel erfreut hat,

kommt ihm ein genialer Gedanke: Ich ersetze, so überlegt er, die Carnotsche

Wärmekraftmaschine CM0 durch eine Hightech–Wärmekraftmaschine HM mit einem Wirkungsgrad

ηH > η C .

Nun kann ich meinen Maschinenpark ständig laufen lassen, ohne das obere Wärmebad effektiv zu belasten, und gleichzeitig ständig eine Nettoarbeitsleistung entnehmen. Die Energie entnehme ich dabei der unerschöpflichen Umwelt (Atmosphäre,

Meer, . . . ) als Wärmebad T0 .

Leider haben sich an dieser und an ähnlichen genialen Ideen schon viele Genies frustriert, so viele, daß die Menschheit daraus gelernt und den folgenden Satz formuliert

hat:

• Zweiter Hauptsatz (physikalisch):

Es gibt kein perpetuum mobile zweiter Art.

Dabei versteht man unter einem perpetuum mobile zweiter Art eine periodisch arbeitende Maschine, die nichts weiter bewirkt, als einem Temperaturbad T0 Wärme

zu entziehen und in Arbeit umzuwandeln.

Eine solche Maschine würde zwar den Energiesatz nicht verletzen, sie wäre wegen der

universellen Verfügbarkeit eines Temperaturbades aber einem “echten” perpetuum

mobile de facto gleichwertig. Eine äquivalente Formulierung des Hauptsatzes lautet

• Es gibt keine periodisch arbeitende Maschine, die nichts weiter bewirkt, als

Wärme von einem niedrigen Temperaturniveau T0 in ein höheres Temperaturniveau T1 zu transportieren (Clausius).

14

Damit ist klar, daß die Hightech–Maschine keinen höheren Wirkungsgrad haben

kann als die Carnotsche. Falls sie ebenfalls reversibel arbeitet, kann sie aber auch

keinen niedrigeren haben. Denn dann brauchte ich die Rolle der Maschinen CM

und HM ja nur zu vertauschen, um ein perpetuum mobile zweiter Art zu bauen. Als

unmittelbare Folge des zweiten Hauptsatzes gilt also der Satz

• Alle reversibel arbeitenden Wärmekraftmaschinen haben denselben Wirkungsgrad

T0

.

(25)

η = ηC = 1 −

T1

Damit sind unsere obigen Feststellungen über mehr oder weniger wertvolle Formen

der Wärmeenergie also nicht mehr auf die Carnotsche Maschine oder das ideale

Gas als Arbeitssubstanz beschränkt, sondern gelten universell. Das aber heißt —

wenn wir uns an die Herleitung der Formel für ηC zurückbesinnen und infinitesimale

Zyklen untersuchen — daß auch die Eigenschaft der Entropie, eine Zustandsgröße

zu sein, universell ist. Damit kommen wir zu der axiomatischen Formulierung des

zweiten Hauptsatzes:

• Zweiter Hauptsatz (axiomatisch):

Die Entropie S ist eine (extensive) Zustandsgröße mit dem Differential

dS =

δQrev

.

T

(26)

Mit dem Index rev wollen wir dabei an eine ganz wichtige Voraussetzung unserer

Argumentation erinnern: Die reversible Prozeßführung. Mit “dissipativen” Prozessen

(z. B. Reibung) kann man nämlich auf irreversible Weise Wärme erzeugen. Eine

Maschine mit Dissipation arbeitet irreversibel und hat einen kleineren Wirkungsgrad

als die Carnotsche. Durchläuft eine solche Maschine einen vollen Zyklus, so bleibt

die Entropie nicht erhalten. Die Berechnung der Entropie nach der Formel dS =

δQ/T setzt also reversible Prozeßführung voraus.

Und was ist, wenn der Prozeß nicht reversibel geführt wird? Dann bleibt die Feststellung, daß eine andere Maschine keinen höheren Wirkungsgrad haben kann als

die (reversibel arbeitende!) Carnotsche, weiterhin gültig, läßt sich aber nicht mehr

durch Vertauschung der Maschinen umkehren. Statt Gl. (25) haben wir also allgemein

η ≤ ηC = 1 −

T0

,

T1

Wenn wir die Rechnung rückwärts verfolgen, finden wir daraus

15

(27)

Q12 Q34

+

≤ 0.

T1

T0

Dieses Ergebnis läßt sich (z. B. über gekoppelte infinitesimale Kreisprozesse) zur

Clausiusschen Ungleichung

I

δQ

≤0

T

(28)

verallgemeinern. Wir wollen diese Beziehung auf einen beliebigen Weg von A nach B

anwenden. Um zu einem vollen Umlauf zu kommen, schließen wir die Kurve durch

einen reversiblen Rückweg. Damit können wir die Clausiussche Ungleichung auch

in der Form

SB − S A ≥

ZB

A

δQ

.

T

(29)

schreiben. Fassen wir nun Subsysteme, in denen irreversible Prozesse ablaufen dürfen,

zu einem thermisch abgeschlossenen Gesamtsystem (δQ = 0) zusammen, so gilt offenbar

SB ≥ S A ,

in Worten :

• Die Entropie eines thermisch abgeschlossenen Systems kann nur zunehmen.

Dieser Satz, der auch als zweiter Teil des zweiten Hauptsatzes3 bezeichnet wird, prägt

der Physik erstmals eine Zeitrichtung auf. Dieser Umstand hat im 19. Jahrhundert

maßgeblich dazu beitragen, daß der Begründung der Thermodynamik durch die

Statistik lange mit großer Skepsis begegnet wurde.

In einem abgeschlossenen System wird die Entropie also ständig zunehmen — bis

sie schließlich ihren maximalen Wert annimmt: Das Gleichgewicht ist erreicht. Dies

ist denn auch der Ausgangspunkt, das Gleichgewicht, von dem nun schon so oft

die Rede war, in aller Strenge zu definieren. Auf dieses Gleichgewicht und auf die

reversiblen Prozesse, die von einem Gleichgewichtszustand zu einem anderen Gleichgewichtszustand führen, beschränkt sich die “eigentliche” Thermodynamik, die wir

hier behandeln.

3

Der erste Teil postuliert S als Zustandsgröße.

16

2.4

Die thermodynamischen Potentiale

Wir beschränken uns im folgenden wieder grundsätzlich auf reversible Prozesse, ohne

durch eine Kennzeichnung explizit daran zu erinnern. Dann gilt δQ = T dS und wir

können den ersten und zweiten Hauptsatz in der Form

dU = T dS − p dV [+

P

i

Yi dXi ]

(30)

zusammenfassen, in der nur noch Zustandsgrößen und totale Differentiale vorkommen. Die innere Energie U erscheint hier als Funktion der “natürlichen Variablen” S,

V und (je nach Bedarf) Xi und wird ein thermodynamisches Potential genannt:

U = U (S, V, [Xi ]) .

(31)

Die natürliche Variable S ist häufig unbequem: Die Entropie haben wir längst noch

nicht “verstanden”, und einer Messung ist sie auch nicht leicht zugänglich. Da ein

Thermometer schön einfach und handlich ist, möchten wir S gern durch die “konjugierte” Temperatur

∂U

∂S

T =

!

(32)

V

ersetzen. Umformungen solcher Art sind uns von der Mechanik vertraut: Dort haben

wir die die generalisierten Geschwindigkeiten q̇k durch die kanonischen Impulse

pk =

∂L

∂ q̇k

ersetzt, indem wir von der Lagrangefunktion L(qk , q̇k ) zur Hamiltonfunktion

H(qk , pk ) = −L +

X

pk q̇k

k

übergegangen sind. Eine solche Legendretransformation führen wir nun auch in der

Thermodynamik durch, indem wir ausgehend von der inneren Energie U (S, V, [Xi ])

die freie Energie

F (T, V, [Xi ]) = U − T S

(33)

bilden. Die freie Energie ist ebenfalls ein thermodynamisches Potential. Daß dieses

Potential tatsächlich von den natürlichen Variablen T , V [und Xi ] abhängt, erkennt

man, wenn man unter Beachtung von (30) und (32) das Differential

17

dF = −S dT − p dV [+

P

i

Yi dXi ]

(34)

bildet. Dieses Differential macht auch den Namen verständlich: Wir können daraus

nämlich ablesen, daß die freie Energie diejenige Energie beschreibt, die bei konstanter

Temperatur in Arbeitsleistung umgesetzt werden kann. Energien wie die elektrische

Feldenergie oder die mechanische Energie einer gespannten Feder (usw.) sind in

diesem Sinne als freie Energien zu betrachten!

In ganz analoger Weise kann man auch die Variable V durch die konjugierte Variable

p ersetzen und erhält als neues Potential die Enthalpie

H(S, p, [Xi ]) = U + pV

(35)

mit dem Differential

dH = T dS + V dp [+

Yi dXi ] .

P

i

(36)

Dieses Potential eignet sich besonders zur Beschreibung adiabatischer Prozesse bei

konstantem Druck.

Schließlich und endlich können wir sowohl S als auch V ersetzen und erhalten das

Gibbssche Potential oder die freie Enthalpie

G(T, p, [Xi ]) = U − T S + pV

(37)

mit dem Differential

dG = −S dT + V dp [+

P

i

Yi dXi ] .

(38)

Dieses Potential bleibt konstant, wenn man Vorgänge bei konstanter Temperatur

und konstantem Druck untersucht. Es ist daher das Lieblingspotential der Chemiker.

Grundsätzlich ist jedoch zu beachten, daß alle thermodynamischen Potentiale äquivalent sind: Besitzt man irgendein thermodynamisches Potential als Funktion seiner

natürlichen Variablen4 , so besitzt man die gesamte thermodynamische Information.

Denn alle Zustandsgrößen lassen sich daraus durch bloßes Differenzieren berechnen. Beispielsweise erhält man sofort die thermische Zustandsgleichung p = p(T, V ),

wenn man die freie Energie nach V differenziert. Die Wahl des einen oder anderen

Potentials ist also allein eine Frage der Bequemlichkeit.

Wir können unsere vier Potentiale U , F , H und G mit ihren wechselnden natürlichen

Variablen S, T , V und p in der folgenden kleinen Tabelle zusammenfassen:

4

Vgl. L(q, q̇) und H(q, p) in der Mechanik.

18

S

H

p

U V

&

% F

G T

In der Mitte der Seiten dieses Quadrats steht jeweils eins der thermodynamischen

Potentiale, und an den benachbarten Ecken findet man die zugehörigen natürlichen

Variablen. Die Reihenfolge der Symbole kann man sich mit dem Merkspruch

Schöne Und Vornehme Frauen Tragen Große prächtige Hüte

ins Gedächtnis rufen (vorausgesetzt, man behält, welche Attribute durch “und”

verbunden sind). Das Pfeilkreuz in der Mitte soll die Vorzeichen der partiellen Ableitungen andeuten. Beispielsweise gilt

∂F

∂T

!

= −S ,

V

“weil” man sich bei der Anschrift dieser Gleichung gegen die Pfeilrichtung bewegt.

Aus dem Diagramm lassen sich nach dem Schema

∂ 2f

∂ 2f

=

∂x∂y

∂y∂x

auch ein paar nützliche Beziehungen ablesen, die als Maxwellrelationen bezeichnet

werden. Als Beispiel notieren wir

∂S

∂V

!

=

T

∂p

∂T

!

V

"

∂2F

=−

∂T ∂V

#

,

(39)

gehen aber nicht weiter auf die Bedeutung5 der Maxwellrelationen ein. Die Effizienz

der thermodynamischen Potentialen bei der Lösung konkreter Probleme demonstrieren wir im Abschnitt 2.7.

Wir beenden diesen Abschnitt mit einem ergänzenden Hinweis zum thermischen

Gleichgewicht. Im vorigen Abschnitt hatten wir aus der Clausiussche Ungleichung [vgl. Gln. (28) und (29)]

dS ≥

5

δQ

T

Vgl. aber die Analogie zwischen Gl. (39) und der Clausius–Clapeyron–Beziehung (50).

19

gefolgert, daß das Gleichgewicht eines abgeschlossenen Systems durch eine maximale

Entropie ausgezeichnet ist. Betrachten wir statt eines abgeschlossenen Systems nun

ein System im Wärmebad (konstante Temperatur T und konstantes Volumen V ), so

wird

dF = dU −T dS ≤ dU −δQ = δA = 0 .

Der Gleichgewichtszustand eines isothermen und isochoren Systems ist also durch

ein Minimum der freien Energie ausgezeichnet. In ähnlicher Weise läßt sich für

andere Nebenbedingungen zeigen, daß im Gleichgewicht jeweils dasjenige thermodynamische Potential minimal wird, dessen natürliche Variable konstant gehalten

werden:

- S, V [, Xi ] fest =⇒

U minimal,

- T , V [, Xi ] fest =⇒

F minimal,

- T , p [, Xi ] fest =⇒

G minimal,

- S, p [, Xi ] fest =⇒

H minimal.

2.5

Variable Teilchenzahl

Bisher haben wir die Teilchenzahl N konstant gehalten und als Variable ignoriert. In offenen Systemen und in Systemen mit chemischen Reaktionen werden die

Teilchenzahlen Nk aber selbst zu interessanten Zustandsgrößen. Eine “versteckte”

Abhängigkeit der Entropie von der Teilchenzahl haben wir im Zusammenhang mit

der Entropieformel (22) des idealen Gases bereits angedeutet. Wollen wir eine solche

Abhängigkeit berücksichtigen, so müssen wir die bisherige Definition

δQ

dU + pdV [−

dS =

=

T

T

P

i

Yi dXi ]

durch

dU + pdV [−

dS =

T

P

i

Yi dXi ]

+

X

k

∂S

∂Nk

!

dNk

U,V,Xi

verallgemeinern. Damit erhält der kombinierte erste und zweite Hauptsatz die Form

dU = T dS − p dV +

X

k

20

µk dNk [+

P

i

Yi dXi ]

(40)

wobei die chemischen Potentiale µk durch die partiellen Ableitungen

∂S

∂Nk

!

U,V,Xi

=−

µk

T

(41)

definiert sind. Der Zusatzterm

+

X

µk dNk

k

tritt dann unverändert auch in den Differentialen der thermodynamischen Potentiale

F , H und G hinzu. Die chemischen Potentiale treten also formal als die konjugierten

Variablen zu den Teilchenzahlen auf.

Um ihre Bedeutung und die Namensgebung wenigstens zu erahnen, betrachten wir

wie gewohnt ein homogenes System, in dem sich bei einer Halbierung des Systems

auch die thermodynamischen Potentiale halbieren6 , also extensiv sind. Wir haben

dann insbesondere

G(T, p, λNk ) = λG(T, p, Nk ) .

Differenziert man nach λ und setzt λ = 1, so erhält man wegen (∂G/∂Nk )T,p = µk

die Gibbs–Duhem–Relation

G(T, p, Nk ) =

X

N k µk .

(42)

k

Die chemischen Potentiale geben also an, welchen Beitrag ein einzelnes Teilchen (bei

konstanter Temperatur und konstantem Druck) zum Gibbschen Potential G liefert.

Wir würden auf diese formalen und wenig anschaulichen Betrachtungen ja gern

verzichten, aber leider benötigen wir die chemischen Potentiale zur Definition eines

weiteren thermodynamischen Potentials

J(T, V, µk ) = F −

X

k

Nk µk = F − G = −pV

(43)

mit dem Differential

dJ = −S dT − p dV −

6

X

Nk dµk .

k

Wir schließen damit insbesondere Oberflächeneffekte aus.

21

(44)

Dieses Potential ohne feste Teilchenzahl ist nämlich unverzichtbar für eine elegante

Formulierung der Quantenstatistik.

Damit wollen wir den abstrakten Formalismus abschließen und uns explizit mit der

Entropie des idealen Gases befassen. Wir betrachten wieder die Gl. (22) und überlegen, wie die Integrationskonstante C(N ) von N abhängen muß. Die Entropie wird

nur dann wie gefordert extensiv, wenn die Klammer [. . . ] in Gl. (22) eine intensive

Größe beschreibt, die sich bei einer Verdoppelung des Systems nicht ändert. Mit

einer Entropiekonstante σ0 folgt daher C(N ) = σ0 − ln N und

S = Nk

3

V

ln T + ln + σ0 .

2

N

(45)

Im nächsten Abschnitt werden wir hieraus das chemische Potential des idealen Gases

berechnen. Hier wollen wir auf eine viel interessantere Folgerung hinaus:

Wir betrachten zwei verschiedene ideale Gase A und B gleicher Dichte und gleicher

Temperatur (⇒ gleicher Druck!) in zwei getrennten Teilvolumina VA und VB . Diese

beiden Gase haben eine Gesamtentropie

3

VA

VB

3

S0 = NA k ln T + ln

+ σA + NB k ln T + ln

+ σB .

2

NA

2

NB

Wenn wir nun die Trennwand zwischen den beiden Teilvolumina entfernen, steht

beiden Gasen das gesamte Volumen V = VA + VB zur Verfügung und wir erhalten

die größere Entropie

S1 = N A k

V

V

3

3

ln T + ln

+ σA + NB k ln T + ln

+ σB .

2

NA

2

NB

Die Differenz

V

V

+ NB ln

∆S = S1 − S0 = k NA ln

VA

VB

(46)

wird als Mischungsentropie bezeichnet. Die Entropie ändert sich also nicht nur bei

Wärmezufuhr, sondern auch bei einer Mischung verschiedener Komponenten. Und

hieran schließt sich sofort das Gibbssche Paradoxon an: Was wird aus der Entropie,

wenn ich immer ähnlichere und schließlich nicht mehr unterscheidbare Gase mische?

2.6

Anwendungen: Reaktionsgleichgewichte

In unserer “abgespeckten” Thermodynamik können wir uns den üblichen Katalog

von Anwendungen nicht leisten und wollen nur exemplarisch demonstrieren, wie man

22

mit dem abstrakten Formalismus konkrete Probleme löst. Dazu betrachten wir ein

System aus verschiedenen Komponenten Ak , die gemäß einer “Reaktiongleichung”

X

νk Ak = 0

(47)

k

ineinander umgewandelt werden können. Dabei denken wir sowohl an chemische

Reaktionen wie

2H2 + O2 − 2H2 O = 0

(also νH2 = 2, νO2 = 1 und νH2 O = −2) als auch an Phasenübergänge. So werden

wir das Gleichgewicht zwischen einer Flüssigkeit F und ihrem Dampf D durch die

Reaktionsgleichung

F−D=0

(also νF = 1 und νD = −1 beschreiben.

Wir betrachten unser System nun bei vorgegebener Temperatur T und vorgegebenem Druck p. Dann ist das Gleichgewicht durch ein Minimum des Gibbsschen

Potentials ausgezeichnet. Da T und p nicht verändert werden, gilt im Gleichgewicht

also

dG =

X

k

∂G

∂Nk

!

dNk =

T,p

X

µk dNk = 0 .

Entsprechend der Reaktionsgleichung (47) verhalten sich die Änderungen der Teilchenzahlen wie die νk :

dNk ∼ νk .

Damit erhalten wir die allgemeine Gleichgewichtsbeziehung (T , p fest!)

X

νk µk (T, p) = 0 ,

(48)

k

die noch einmal besonders deutlich macht, wie die chemischen Potentiale zu ihrem

Namen kommen.

Wir wollen sie aber zunächst auf das Gleichgewicht zwischen Flüssigkeit und Dampf

anwenden. Um in der abstrakten Formulierung

23

µD (T, p) = µF (T, p)

(49)

die Dampfdruckkurve p = pD (T ) zu erkennen, gehen wir von den Gibbs–Duhem–

Relationen

µk =

Gk

= gk (T, p) ,

Nk

k = D, F

des Dampfes und der Flüssigkeit aus7 und bilden die Differentiale

dµk = dgk = −sk dT + vk dp .

Dabei bezeichnet sk = Sk /Nk die spezifische Entropie und vk = Vk /Nk das spezifische

Volumen. Aus Gl. (49) folgt damit die Differentialgleichung

(sD − sF )dT = (vD − vF )dp .

Berücksichtigen wir schließlich noch, daß die Entropieänderung beim Übergang vom

flüssigen zum dampfförmigen Zustand durch

sD − s F =

qD

T

mit der spezifischen Verdampfungswärme qD verknüpft ist, so erhalten wir die berühmte Clausius–Clapeyron–Beziehung8

qD

dpD

=

dT

T (vD − vF )

(50)

für die Änderung des Dampfdrucks pD mit der Temperatur T .

Wir kehren nun zu Gl. (48) zurück und werten sie für chemische Reaktionen zwischen

idealen Gasen aus. Um aus Gln. (41) und (45) das chemische Potential µk eines

idealen Gases zu berechnen, bilden wir am einfachsten (warum?) zunächst die freie

Energie9

Nk

3

− σk

Fk = Uk − T Sk = Nk kT (1 − ln T ) + ln

2

V

7

Genau hier verlieren wir Aussagen über den Dampfdruck kleiner Tröpfchen.

Vgl. hierzu auch die Maxwellrelation (39)!

9

Unsere Formulierung ist eigentlich nur für einatomige Gase gültig; die generelle Form bleibt

aber auch bei Molekülgasen erhalten.

8

24

und erhalten

µk =

∂Fk

∂Nk

!

T,V

3

Nk

− σk .

= kT + kT (1 − ln T ) + ln

2

V

Ersetzen wir Nk durch den Partialdruck

pk =

Nk kT

,

V

so folgt

µk = kT ln pk − ck (T ) ,

wobei wir uns die genaue Spezifizierung von ck (T ) schenken. Damit erhält Gl. (48)

die Form

X

νk ln pk =

X

ck (T ) .

k

k

Gehen wir vom Logarithmus zum Numerus über, so erhalten wir das Massenwirkungsgesetz

Y

pνkk = C(T ) .

(51)

k

2.7

Das Nernstsche Theorem

Unsere Thermodynamik ist im wesentlichen “abgeschlossen” und wir brauchen keine

neue Zustandsgröße mehr einzuführen. Ein gewisser Mangel der bisherigen Theorie

liegt aber darin, daß die Entropie nur differentiell definiert ist. Es gibt nämlich Fälle,

in denen zwei verschiedene Zustände nicht durch einen reversiblen Weg verbunden

werden können. In solchen Fällen kann das Ergebnis einer thermodynamischen Rechnung von der richtigen Wahl der Entropiekonstanten abhängen. Zur Behebung dieses

Mangels formulierte Nernst 1905 im Einklang mit der Erfahrung sein berühmtes

Theorem

• Die Entropie eines Systems am absoluten Nullpunkt ist eine von allen Zustandsgrößen unabhängige Konstante, die man zu Null wählen darf.

25

Dieses Theorem wurde später auch als dritter Hauptsatz der Thermodynamik

bezeichnet.

Die wichtigste Konsequenz dieses Satzes ist, daß sämtliche spezifischen Wärmen für

T → 0 verschwinden. Hiermit kommen wir jedoch (u. a.) in ernsthafte Schwierigkeiten mit dem idealen Gas, für das wir unabhängig von der Temperatur

cV =

∂U

∂T

!

V

3

= N k 6= 0

2

finden. Auch die Entropieformel (41) strebt nicht gegen eine universelle Konstante,

sondern divergiert für T → 0. Daß es in der Natur keinen Stoff gibt, der für T → 0 als

ideales Gas angesehen werden kann, ist nur ein schwacher Trost für das prinzipielle

Versagen des Modells. Außerdem treten ganz analoge Diskrepanzen auch bei der

spezifischen Wärme des Festkörpers auf.

Wir stehen mit diesen Problemen wieder am Beginn des 20. Jahrhunderts und

müssen die Diskrepanzen zum Nernstschen Theorem mit den “schwarzen Wolken”

aus Teil I der Vorlesung in Verbindung bringen: Der dritte Hauptsatz formuliert

einen makroskopischen Quanteneffekt!

Was aber haben wir in der Maxwell–Boltzmann–Statistik des Abschnitts 1.3

falsch gemacht? Wo ist überhaupt spezifiziert worden, ob unsere Gasteilchen den

Newtonschen Gesetzen oder der Schrödingergleichung folgen? Es ist an der

Zeit, daß wir eine systematische Statistik entwickeln, in der wir klassische Teilchen

und Quantenzustände sauber unterscheiden können.

26

3

3.1

Die Grundlagen der Statistik

Shannons Informationsentropie

Im ersten Kapitel hatten wir erläutert, daß es nicht nur unmöglich, sondern auch

nicht wünschenswert ist, die detaillierte mikroskopische Information eines makroskopischen Systems festzulegen: Die Informationsmenge wäre einfach zu groß. Stattdessen haben wir uns entschlossen, uns mit der Verteilungsfunktion zu begnügen. Wie

detailliert ist die verbleibende Information? Brauchen wir immer noch Bibliotheken, um sie zu notieren? Und wodurch zeichnet sich die Gleichgewichtsverteilung

aus? Wir hatten den Übergang zum Gleichgewicht bereits intuitiv mit einem totalen “Chaos” in Verbindung gebracht. Wird bei diesem Übergang alle Information

zerstört?

Wenn wir diese Frage beantworten wollen, stehen wir vor dem Problem, ein Maß für

Information zu definieren. Mit genau dem Problem hat man sich jedoch außerhalb

der Physik in der Nachrichtentechnik und in der Datenverarbeitung befaßt: Welchen

Speicherplatz benötige ich, um ein Bild zu speichern? Wie hängt die Auflösung des

Fernsehbildes von der Breite des Übertragungskanals ab? Wieviel Information kann

ich noch aus einem “verrauschten” Signal retten? . . .

Wenn wir die Information messen wollen, gehen wir naiv von der Länge des Textes

oder der Zahl der Zeichen aus. Da ein Zeichen einer Bilderschrift sicherlich “informativer” ist als ein Zeichen des lateinischen Alphabets, wollen wir die Zeichen universell

codieren und benutzen dazu “binäre Digits” oder “bit”s. Zur Codierung eines Zeichens einer modernen Schreibmaschine benutzt man 8 bit oder ein “byte”. Für einen

Text von 1000 Zeichen (ca. 12 Seite) benötigt man also eine Speicherkapazität von

8000 bit oder 1k (kilobyte). Dabei ist der Text aber nicht optimal gespeichert, er läßt

sich “komprimieren”. Denn die einzelnen Zeichen zi (i = 1, . . . , n) des Alphabets haben eine verschiedene a priori – Wahrscheinlichkeit pi . Da ein ‘e’ in deutschen Texten

wesentlich häufiger vorkommt als ein ‘y’, ist es ökonomisch, das ‘e’ mit weniger bit

zu codieren als das ‘y’ (vgl. das Morsealphabet!).

Zu einer wesentlich besseren Codierung kommen wir (vereinfachend), wenn wir die

Zeichen zi unter Ausnutzung der Normierung

n

X

pi = 1

i=1

durch Teilintervalle Zi der Länge pi des Grundintervalls I = (0, 1) repräsentieren:

Z1

Z2

Z3

...

Zn−1

Zn

1

0

27

Das Grundintervall I teilen wir in die Teilintervalle I0 = (0, 12 ) und I1 = ( 21 , 1),

die Teilintervalle Iν weiter in Iν,0 und Iν,1 , usw. Bei der fortgesetzten Halbierung

notieren wir jeweils, ob Zi (mehr) in der linken (0) oder rechten (1) Hälfte von Iν1 ,...

liegt. Nach m Schritten erhalten wir ein Teilintervall Iν1 ,...,νm der Länge 2−m , welches

das Zeichen zi eindeutig festlegt, wenn

2−m ≤ pi

oder m ≥ −log2 pi

gilt. Zur Übermittlung des Zeichens zi ≡ {ν1 , . . . νm } benötigen wir also

σi = − log2 pi

(52)

bit, und es bietet sich an, diese bit–Zahl σi als Informationsmaß des Zeichens zi zu

definieren.

Der Nachricht z1 , z2 , . . . zN entspricht demnach dem Informationsgehalt σ1 + σ2 +

. . . + σN . In vielen Fällen wird die genaue Zeichenfolge einer Nachricht aber nicht

bekannt sein oder soll variabel sein. Beispielsweise möchte man wissen, welche Information verloren geht, wenn etwa jedes zehnte Zeichen verrauscht, und bei der

Festlegung der Breite von Fernsehkanälen wird man sich nicht an einem bestimmten

Bild, sondern an typischen Bildern orientieren wollen. Darum interessiert sich der

Nachrichtentechniker für den mittleren Informationsgehalt σ eines Zeichens oder ΣN

einer Nachricht von N Zeichen. Da die einzelnen Zeichen zi mit der Wahrscheinlichkeit (also der relativen Häufigkeit) pi in den Nachrichten vorkommen, gilt

σ = hσi i = −

n

X

pi log2 pi

und ΣN = N σ .

(53)

i=1

σ bzw. ΣN wird als die Shannon–Entropie bezeichnet. Diese Shannon–Entropie mißt also

— den mittleren Informationsgehalt einer Nachricht von N Zeichen oder

— die Unkenntnis, die ich im Mittel habe, wenn ich nicht weiß, welche N Zeichen

übermittelt werden (oder verloren gehen).

So ganz optimal ist unsere Codierung noch nicht, wenn wir nur die Wahrscheinlichkeiten der einzelnen Zeichen berücksichtigen. Tritt beispielsweise in einem deutschen

Text das Zeichen ‘q’ auf, so wird das Zeichen ‘u’ nahezu mit Sicherheit und nicht mit

der geringen Wahrscheinlichkeit pu ≈ 0.032 folgen. Die generelle Bedeutung solcher

Korrelationen demonstrieren wir an den vier Zufallstexten im folgenden Kasten,

bei denen Zweierkorrelationen berücksichtigt wurden, die jeweils einem deutschen,

einem englischen, einem griechischen und einem lateinischer Mustertext entnommen

wurden.

28

Zufallstexte mit deutschen, englischen, griechischen und lateinischen Zweierkorrelationen

la epekalierses es matasin kai gar sphilon gyn

lon en the anthron allai olyto theon toi os

ypephroys er o dethos oi otimon thlontestelgemin agon os mylien popioikopolla thai de

rhyron o kai zen allagchthosthygai eripon ai

lio thygarnes bron er on ede neseta men moterioi diayto gar on toi alai ai oron ai elgeipersesoi oysko tiathe epeessethreitai esin olos

ike ithioi allos nostar thaliesechthioys thytar

alla alion de alyta emin agamoronden lon dedenaas polytayran ei sphelge estheoy agchon

os bes dysoion kai mnaio ide amphe enon de

ekio pan ieion ein kaieses patai atha pso ois mon

kai ampimoron ai alge de pto gathrotimenia on

aparnes pos ektaon kra kaipotioon o te o oieripyn

brie zuvon benfliedas mich altesst weil so er

wenken nauess schlagefunsen bein fues suesst

gekommen recht ueher benfliesseisch aer ihr

zert gelie tigel das guter fuch niecht glutztesstenst gaehlein gen warachen uer ben du

im ense nur zu er fund krit ge kommen fuchaechein und kann rech dantescht und gekommen wir winauchreiehle nichein bachlatter eifer gutesch aerge sch kankt so eren gan win

daralt leist willein nundem naugel weilt so

isch in warag der bedarf siedas in dem brie zwen

fuesst mag war fuchs gelent der ein der gel gutes ich mich weichrie vor schatt ein ver alt in

ich alte zer und icht glum was scht maenseheinbaues sch alle nicht er better alten wein was

gluten dir so ein das fueheie kann walden du

esst eiden nich danz mage kanz maetten ues ihm

eist uns so ergelen nur weier ben im beisst und

int un nacher den den was genkt wollenkt gant

gesch win dant ge wier kuesch weillt und sehrisch aldeifeit leinachant mit und kuesst und

lust die zu mit weim nich dem nocharter dant

en scherem uesch dant leit gel sprauescht es

gann wart leine was gutes guten wir

ultinguae atentus aquavit eos prae ate atriona

ditinciaes quod suitaeper gibusculibus etii cumi

spe mo pra se omnissimos rhen aus ex imincitano

proximo prattine rhelvet apis rhelgars los mos

belgallia eos mi inessi prattiea celvetiissimone

aus rhodanisse aque ex persuliae flum pelvetur

pelliae flum prattiam fergit imus etitium pelvetiniur pelvet aus manimuscum is etiontut suntentertermanobtinibuscultini estare contianis

eanis etinissimus eost quod alliquitallum pertium pratii a colum no pe a imuscum qui sunt

attiuminen sequit imperfaciae culinibuscu los

facitiontercaus belvetia dia his fluntessequitisperuntu a eos essi torio providiffemanobtiae

eos los eos mo qui sequi attios

of the of hout bithe yeader had the bed day

sculler a stild mis sfly of bern hiche rom barringe ande lande last gone drown thery gonevold dream the whishe of his the ande facrown

theame waswit beed was quilligs las com offelvedrown dooness animajes quilled prfn th a

maked ant inge a losess to

Aber auch die Zweierkorrelationen sind noch nicht der Weisheit letzter Schluß. Wenn

in einer deutschen Zeichenfolge die Sequenz ‘sc’ vorkommt, wird vermutlich ein ‘h’

folgen, und in dem Wort ‘Wur?el’ wird höchst wahrscheinlich das sonst sehr wenig

wahrscheinliche ‘z’ (pz ≈ 0.014) fehlen. Das heißt aber, daß im allgemeinen neben

den Zweier– auch Dreier–, gelegentlich Sechser– und unter Umständen sogar noch

höhere Korrelationen berücksichtigt werden müssen.

Zu einer Zeichenfolge von N Zeichen müssen wir also genau genommen die Wahrscheinlichkeiten p{iN } sämtlicher Sequenzen

{iN } ≡ (zi1 , zi2 , . . . , ziN )

bestimmen und ihr die Shannon–Entropie

ΣN = −

X

{iN }

p{iN } log2 p{iN }

(54)

zuordnen. Wegen der ungeheuren Zahl möglicher Zeichenketten wird das aber im allgemeinen kaum möglich sein, und man wird sich mit Näherungen begnügen müssen,

in denen alle Korrelationen ab der Ordnung k vernachlässigt sind. Gl. (53) repräsentiert in dem Sinne die Näherung, die man erhält, wenn man bereits die Korrelationen

der Ordnung k = 2 (also alle Korrelationen) vernachlässigt.

29

3.2

Die physikalische Entropie

Das Reizwort “Entropie” ist gefallen und macht uns neugierig, was denn wohl die

Thermodynamik mit der Informatik zu tun hat. Ein makroskopisches System der

Thermodynamik (bzw. Statistik) ist ein komplexes Vielteilchensystem, das eine ungeheuer große Anzahl verschiedener mikroskopischer Zustände (i) einnehmen kann,

die mit der makroskopischen Festlegung weniger Parameter (p, V , T , . . . ) oder auch

der Vorgabe der Verteilungsfunktion verträglich sind. Hat der i–te Mikrozustand

dabei die Wahrscheinlichkeit pi , so ist

Σ=−

X

pi log2 pi

i

die Informationsentropie oder das Shannonsche Maß für die Unbestimmtheit des

Makrozustands: Diese Entropie ist nichts anderes als die Zahl der bits, die im

Mittel benötigt wird, um anzugeben, durch welchen der vielen Mikrozustände der

eine betrachtete Makrozustand gerade realisiert wird. Die “Nachricht” über den

betrachteten Zustand eines idealen Gases könnte also etwa so aussehen:

• Makrozustand:

N = 6 · 1023 V = 0.027 m3

T = 300 K .

• Mikrozustand: (Teilchennummer, x,y,z,vx ,vy ,vz in m bzw. in m/s):

– 1, 0.271459, 0.142877, 0.093945, -327.753, 108.693, -197.782

– 2, 0.176783, 0.264834, 0.112216, 156.658, -217.983, 403.334

..

.

(1014 Bibliotheken)

..

.

– 6 · 1023 , 0.135791, 0.246802, 0.257913, -398.765, 0, 123.456 .

Die Informationsentropie Σ, also die Zahl der bits in den 1014 Bibliotheken, ist

natürlich unbequem groß. Es ist daher praktisch, Σ mit einer kleinen Zahl c, etwa c =

k ln 2 (k = Boltzmannkonstante) zu multiplizieren und die physikalische Entropie

eines Makrozustands durch die Shannonformel

S = k ln2 Σ = −k

X

pi ln pi

(55)

i

zu definieren10 . Die Summe läuft dabei über die ungeheure(!) Anzahl sämtlicher

Mikrozustände des gesamten Vielteilchensystems.

10

Mit dieser Definition sind wir nicht auf das Gleichgewicht beschränkt. Die Shannonformel

gibt uns vielmehr die Möglichkeit, S auch außerhalb der reversiblen Thermodynamik eindeutig zu

definieren!

30

Was hat die so definierte physikalische Shannonentropie nun mit der Entropie zu

tun, die wir in der Thermodynamik kennengelernt haben? Wir wollen diese Frage

zunächst an unserem Standard–Versuchsmodell, dem idealen Gas, untersuchen.

3.3

Ideales Gas und µ–Raum–Statistik

Das ideale Gas bestehe aus N unkorrelierten Teilchen. Wie bei der Nachricht mit

unkorrelierten Zeichen [vgl. Gl. (53)] können wir die Shannonentropie daher nach

dem Muster

S = N s mit s = −k

X

pi ln pi

i

bilden, wobei sich die pi im Gegensatz zu Gl. (55) nun nur auf die Zustände eines

Teilchens im µ–Raum (6 Koordinaten r und v) beziehen. Dabei bietet es sich an,

durch die Interpretation

pi → f (r, v, t)

d3 rd3 v

N

von der Summe zum Integral über zu gehen, also

S = −k

Z

f ln pi d3 rd3 v

zu definieren. Hierbei stehen wir allerdings vor einem kleinen Problem: Während die

Ersetzung pi → f d3 rd3 v/N die Summe problemlos in das Integral überführt, müssen

wir uns bei der Festlegung von pi im Logarithmus fragen, welche Mikrozustände

wir überhaupt unterscheiden wollen. Im Augenblick begnügen wir uns damit, das

Phasenvolumen in typische “Zellen” der Größe ∆µ zu zerlegen und setzen

pi ∼

∆µ

f (r, v, t) .

N

Damit erhalten wir

S = −k

Z

f ln

∆µ

f d3 rd3 v = kH + const ,

N

(56)

wobei H (eigentlich griech. “H” = groß “Eta” für “Entropie”) das Boltzmannsche

Funktional

H=−

Z

f ln f d3 rd3 v

31

(57)

bezeichnet. Mit den Gln. (56) bzw. (57) haben wir die Entropie für beliebige Verteilungsfunktionen unahängig vom Gleichgewicht definiert. Was soll das Gleichgewicht

auszeichnen? In der Thermodynamik hatten wir das Gleichgewicht bei vorgegebenen

U , V und N durch eine maximale Entropie charakterisiert. Fragen wir uns also, für

welches f die Funtion H maximal wird und bilden die Variation

δH = −

Z

(1 + ln f )δf d3 rd3 v .

Wenn wir dabei über ein festes Volumen V integrieren, müssen wir noch die beiden

Nebenbedingungen

δN =

Z

δU =

m

2

δf d3 rd3 v = 0 und

Z

v 2 δf d3 rd3 v = 0

berücksichtigen. Mit zwei Lagrangeparametern α und β erhalten wir also

δH = −

Z

[ln f + α + βv 2 ] δf d3 rd3 v .

Da nun δf frei gewählt werden kann, folgt als Bedingung für ein maximales H, daß

die Klammer [ ] verschwinden muß oder

f = exp(−α − βv 2 ) .

Im Einklang mit der völlig verschiedenen Argumentation im Abschnitt 1.3 finden

wir als Gleichgewichtsbedingung also wieder die Maxwellverteilung. Mit den alten

Bezeichnungen setzen wir deshalb

m

2πkT

3/2

2πkT

V

ln

+ ln

N

m

!3/2

f (v) =

N

V

mv 2

e− 2kT

in Gl. (57) ein und erhalten

H =

Z

V

2πkT

= N ln + N ln

N

m

2πkT

V

= N ln + ln

N

m

32

mv 2

+

f d3 rd3 v

2kT

!3/2

!3/2

+

N mhv 2 i

kT 2

3

+ .

2

Für die Gleichgewichtsentropie folgt also aus Gl. (56)

3

V

ln T + ln + σ0

S = Nk

2

N

2πk

mit σ0 = ln

m

!3/2

+ ln

(58)

N

3

+ .

∆µ 2

Erfreuen wir uns zunächst an dem schönen Erfolg, den wir hiermit erzielt haben:

Gl. (58) stimmt nämlich in der Form genau mit Gl. (45) überein. Unsere Informationsentropie ist also für das ideale Gas im Gleichgewicht identisch mit der thermodynamischen Entropie. Unsere Rechnung hat weiter gezeigt, daß die Entropie der

Gleichgewichtsverteilung maximal wird.

Gl. (58) liefert uns schließlich sogar die Konstante σ0 , die wir mit den Mitteln der

Thermodynamik nicht festlegen konnten. Gerade hierin zeigen sich aber noch zwei

gravierende Mängel: σ0 hängt nämlich erstens von der willkürlichen Zellgröße ∆µ

und zweitens — was eindeutig falsch ist! — von der Teilchenzahl N ab.

Bezüglich des ersten Mangels könnten wir die Wahl von ∆µ an unsere Meßgenauigkeit anpassen. Damit erhielte die Entropie aber einen “subjektiven” Beitrag, der

vom Beobachter abhängt und das Geschick des Experimentators, und nicht das

System beschreibt. Diese Überlegung ruft natürlich Erinnerungen wach, und wir

denken daran, daß es auch eine objektive, prinzipielle Begrenzung der Meßgenauigkeit bei der Festlegung der µ–Raum–Koordinaten gibt: Aus der Heisenbergschen

Unschärferelation

∆x∆px = m∆x∆vx ≥ h

bietet es sich zwanglos an,

∆µ = h3 /m3

als universelle Zellgröße zu wählen. Etwas überraschend ist allerdings, daß die quantenmechanische Konstante h nun in die Formel für die Entropie des klassischen

idealen Gases eingeht.

Die Quantenmechanik steckt auch hinter dem zweiten Mangel: Entgegen unserer

Rechnung darf σ0 nicht von N abhängen, da S extensiv sein soll. Unser Fehler beruht

darauf, daß wir falsch “gezählt” haben. Wir haben die Entropie des N –Teilchen–

Systems nämlich nach dem selben Schema wie die Entropie einer Nachricht aus N

Zeichen gebildet. Die Information der Nachricht hängt natürlich von der Reihenfolge

der Zeichen ab; der physikalische Mikrozustand unseres idealen Gases ändert sich

aber nicht, wenn wir Teilchen vertauschen. Die Quantenmechanik sagt uns nämlich,

33

daß identische Teilchen prinzipiell ununterscheidbar sind. Darum erhalten wir keinen

neuen Mikrozustand, wenn wir zwei Teilchen vertauschen oder wenn wir sämtliche

Teilchen irgendwie permutieren.

Die Zahl der Mikrozustände ist daher um den Faktor N ! kleiner als wir angenommen haben, und darum brauchen wir log2 N ! weniger bits, um anzugeben, durch

welchen Mikrozustand der betrachtete Makrozustand gerade realisiert wird. Oder

anders ausgedrückt: Unsere Unkenntnis über den Systemzustand, die nach der Festlegung der makroskopischen Parameter bleibt, ist um log2 N ! bits kleiner als in der

Rechnung angesetzt. Den Ansatz S = N s für die Entropie des idealen Gases müssen

wir also durch den “korrigierten” Ansatz

S = N s − k ln N !

(59)

ersetzen. Mit der Stirlingformel11

ln N ! → N (ln N − 1) (N → ∞)

folgt schließlich die universelle Konstante

2πmk

σ0 = ln

h2

!3/2

+

5

.

2

Setzen wir diese Konstante in Gl. (58) ein, erhalten wir die Sackur–Tetrode–

Formel

V

S = N k ln

N

2πmkT

h2

!3/2

e

5/2

e5/2

= N k ln

nλ3T

"

#

(60)

für die Entropie des einatomigen12 idealen Gases. Dabei bezeichnet n die Dichte und

λT = √

h

2πmkT

(61)

die “thermische de Broglie–Wellenlänge”.

Haben wir mit der Festlegung ∆µ = h3 /m3 und der “korrigierten Boltzmannabzählung” (Faktor 1/N !) nun endlich die Quantenmechanik gebührend berücksichtigt?

RN

P

ln N ! = N

ln n ≈ 0 ln x dx = (x ln x − x)|N

Formel mit

0 = N ln N − N . (Eine verbesserte

n=1

√

R ∞ N −x

der Korrektur ln 2πN erhält man mit der Sattelpunktsmethode aus N ! = 0 x e dx.)

12

Bei mehratomigen Gasen gibt Gl. (60) den Translationsanteil und muß durch die Beiträge der

Rotation und ggf. Vibration ergänzt werden.

11

34

Leider nein! Denn Gl. (60) divergiert weiterhin für T → 0 und verletzt den dritten

Hauptsatz. Es sieht also so aus, als müssten wir von der unkorrelierten µ–Raum–

Statistik Abschied nehmen und die Grundgleichung (55) unter Berücksichtigung von

Korrelationen auswerten. Das wird sicherlich ohnehin nötig sein, wenn wir die gegenseitige Wechselwirkung der Teilchen berücksichtigen wollen. Woher kommt aber

eine Korrelation beim idealen Quantengas?

3.4

Die statistischen Gesamtheiten

Im vorigen Abschnitt konnten wir aus der Bedingung, daß S maximal werden sollte,

die korrelationsfreie µ–Raum–Verteilung fM bestimmen. Nun soll die Korrelation —

zumindest im Prinzip — berücksichtigt werden. Wir werden daher von Gl. (55) ausgehen und versuchen, die Wahrscheinlichkeiten pi aller Mikrozustände des Systems

so zu bestimmen, daß die Entropie maximal wird. Den betrachteten Makrozustand

berücksichtigen wir durch Nebenbedingungen. Wir unterscheiden dabei die folgenden

Möglichkeiten:

1. Wir realisieren die Repräsentation des gewünschten Makrozustands, indem

wir sogleich adaptierte Mikrozustände auswählen. Beispielsweise können wir

die Energie U vorschreiben und dann ausschließlich Mikrozustände der gleicher

Energie Ei = U betrachten. Wir sagen dann, daß die einzelnen Mikrozustände

einer Mikro–Nebenbedingung genügen.

2. Wir realisieren den gewünschten Makrozustand, indem wir die Mittelwerte

bestimmter Parameter vorschreiben. Im obigen Beispiel würden wir also lediglich hEi i = U verlangen. In solchen Fällen sagen wir, daß die Gesamtheit der

Mikrozustände eine Makro–Nebenbedingung erfüllt.

Offenbar beziehen sich Mikro–Nebenbedingungen auf extensive Größen, die sich für

jeden Mikrozustand definieren lassen (z. B. die Energie Ei = U ). Durch die entsprechende Makro–Nebenbedingung wird dagegen die konjugierte intensive Größe (z. B.

hEi i → T ) festgelegt. (Wir werden das noch im Detail sehen.) Natürlich können für

verschiedene Größen Mikro– und Makro–Nebenbedingungen parallel benutzt werden. Dabei wollen wir wie folgt vorgehen:

1. Wir berücksichtigen alle Mikrozustände (i), die mit den Mikro–Nebenbedingungen verträglich sind. Mit dieser Auswahl sind die Mikro–Nebenbedingungen

bereits erfüllt, sie gehen also nicht weiter in die Rechnung ein.

2. Wir variieren die Wahrscheinlichkeiten pi und bestimmen pi so, daß die Variation δS verschwindet. Bei der Variation berücksichtigen wir die Makro–

Nebenbedingungen durch Lagrangeparameter.

35

Wir werden sehen, daß die Lagrangeparameter im wesentlichen die oben erwähnten intensiven Größen repräsentieren. Mit der Wahl der Mikro– bzw. Makro–Nebenbedingungen legen wir also bereits den verwendeten Variablensatz fest. Der Anschluß

an die Thermodynamik erfolgt dann, indem wir aus der Entropie das zu diesem Variablensatz passende thermodynamische Potential berechnen. Bevor wir dies konkret

durchführen und diskutieren, wollen wir die formale Variationsrechnung abhandeln.

Diese ist im wesentlichen identisch mit der Berechnung der Maxwellverteilung im

vorigen Abschnitt.

Aus der allgemeinen Formel (55)

X

S = −k

pi ln pi

i

für die Entropie bilden wir die Variation

δS = −k

X

(ln pi + 1)δpi .

(62)

i

Eine Nebenbedingung (mathematischer Natur) haben wir immer zu erfüllen: Die

Normierung der pi , also

g=

X

i

pi − 1 = 0 oder

X

δg =