kq

Werbung

OLS-Schätzung:

asymptotische Eigenschaften

Stichwörter:

Konvergenz in Wahrscheinlichkeit

Konvergenz in Verteilung

Konsistenz

asymptotische Verteilungen

nicht-normalverteilte Störgrößen

zufällige Regressoren

o1-8.tex/0

Das Lineare Modell

Lineares Modell

y = Xβ + u

oder

yt = x0tβ + ut,

t = 1, . . . , n

Annahmen der klassischen Regressionstheorie:

(a) Xit fix (nicht zufällig) für alle i, t

(b) E{ut} = 0 für alle t

(c) Var{ut} = σ 2 für alle t

(d) Cov{us, ut} = 0 für alle s und t 6= s

(e) u ∼ N (0, σ 2I)

OLS-Schätzer b = (X 0X)−1X 0y, σ̂ 2 = e0e/(n − k) sind

erwartungstreue Schätzer, haben minimale Varianz unter allen linearen, erwartungstreuen Schätzern, erlauben t- und

F -Test

o1-8.tex/1

Kritische Annahmen

sind

(a) [nicht zufällige Xit] und

(e) [normalverteilte Störgrößen]

• fixe Xit bedeutet: geplantes Experiment, keine Meßfehler; ist in ökonometrischer Praxis kaum erfüllt

Konsequenz von zufälligen Xit: Sei Yt = Xtβ + ut, Xt

und ut unabhängig; dann gilt

x0 y

x0 u

b = 0 =β+ 0

xx

xx

E{b} = β

Var{b} = σ 2 E{(x0x)−1}

d.h., b ist erwartungstreu; minimale Varianz ?

• Normalität der Störgrößen hat Normalität der OLS-Schätzer

etc. zur Folge

Konsequenzen des Nichtzutreffens dieser Annahmen?

o1-8.tex/2

Statistische Inferenz bei großen

Stichproben

Exakte Stichprobenverteilungen (von Schätzern, Teststatistiken, etc.) oft schwierig herzuleiten

Alternative: asymptotische Verteilung auf Basis einer bekannten Grenzverteilung (n → ∞)

Asymptotische Verteilung: näherungsweise Verteilung

fr endliches n, die aus einer Grenzverteilung abgeleitet ist

Beispiel: Für X gelte: E{X} = µ, Var{X} = σ 2;

Stichprobe X1, . . . , Xn: Stichprobenmittelwert X̄n hat Grenzverteilung N (0, 1):

√ X̄n − µ d

n

→ N (0, 1) ;

σ

asymptotische Verteilung des Stichprobenmittelwertes:

σ2

a

X̄n ∼ N µ,

n

o1-8.tex/3

Asymptotische Theorie

der Ökonometrie dient zur

• Rechtfertigung der KQ-Schätzer bei Verzicht auf Annahmen (a) und (e)

• Untersuchung der Eigenschaften der ML-Schätzer

• Untersuchung der Eigenschaften der Hilfsvariablen-Schätzer

o1-8.tex/4

Konvergenz-Begriffe

Konvergenz reeller Zahlenfolgen {an}:

Beispiel: an = 3 + n1 konvergiert gegen Grenzwert a = 3

zu jedem δ existiert ein N (δ), sodaß

|an − 3| =

1

<δ

n

für alle n > N (δ)

z.B.: δ = 0.5: n > N = 2: |an − 3| < 0.5

Stochastische Konvergenz:

Folge {an} enthält Zufallsvariable a1, . . . , an, . . .

• Konvergenz von Folgen von Zufallsvariablen

Gibt es eine fixe Zahl (oder eine Zufallsvariable) c, gegen

die die Folge {an} strebt?

• Konvergenz von Folgen von Verteilungen

Gibt es eine Verteilung F , gegen die die Folge der Verteilungen {Fn} der {an} strebt?

o1-8.tex/5

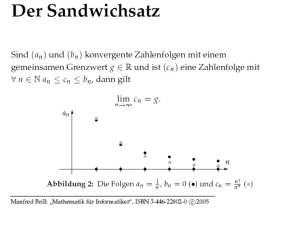

Konvergenz in Wahrscheinlichkeit

die Grenzübergänge gelten im Folgenden stets für n → ∞

Folge von Zufallsvariablen {an} konvergiert in Wahrscheinlichkeit oder konvergiert schwach gegen die fixe

Zahl c, wenn für jedes δ > 0 gilt:

lim P {|an − c| > δ} = 0

n→∞

Wir schreiben:

p

plim an = c oder an → c ;

plim heißt “plim-Operator”.

Beispiel: Die Zufallsvariable an nimmt 0 und n an mit

P {an = 0} = 1 −

1

,

n

P {an = n} =

Für n > δ gilt

P {an > δ} =

1

;

n

es folgt

lim P {an > δ} = n→∞

lim

n→∞

oder plim an = c.

o1-8.tex/6

1

=0

n

1

n

Konvergenz im quadratischen Mittel

Für an aus der Folge {an} mit E{an} = µn und Var{an} =

σn2 gelte lim µn = c und lim σn2 = 0; dann konvergiert

{an} im quadratischen Mittel gegen c.

Die Richtigkeit kann mittels der Tschebyscheff’schen Ungleichung gezeigt werden:

σn2

P (|an − µn| > δ) ≤ 2 → 0 ;

nδ

Grenzübergang auf beiden Seiten zeigt, dass die linke Seite

gegen Null geht.

Konvergenz im quadratischen Mittel impliziert schwache Konvergenz (aber nicht umgekehrt!)

Beispiel: Die Folge der Stichprobenmittelwerte {X̄n}, n =

1, 2, . . ., von X1, . . . , Xn mit E{Xi} = µ und Var{Xi} =

σ 2, i = 1, . . . , n, konvergiert in Wahrscheinlichkeit gegen µ:

lim Var{X̄n} = lim σ 2/n = 0.

o1-8.tex/7

Konsistenz

Sei θ̂n Schätzer eines Parameters θ; gilt plim θ̂n = θ, so heißt

θ̂n konsistenter Schätzer von θ.

Zum Feststellen der Konsistenz: Konvergenz im quadratischen Mittel und daraus abgeleitete Kriterien einfacher anzuwenden als schwache Konvergenz.

Zwei Schwache Gesetze der Großen Zahlen:

• Kintschin’s Theorem: Die Xn aus der Folge {Xn}

seien IID mit E{Xn} = µ; dann gilt: plim X̄n = µ

• Tschebischeff ’s Theorem: Für Xn aus der Folge

{Xn} gelte E{Xn} = µn, Var{Xn} = σn2 , lim µn = µ

und lim σn2 = 0; dann gilt: plim Xn = µ.

o1-8.tex/8

Rechenregeln

Für beliebige Folgen {an}, {bn} gilt:

(a) Slutsky Theorem: Für plim an = c und eine stetige,

von n unabhängige Funktion g gilt

plim[g(an)] = g(c)

(b) plim(an ± bn) = plim an ± plim bn

(c) plim(an.bn) = plim an. plim bn

(d) plim(an/bn) = plim an/ plim bn, wenn plim bn 6= 0

Die Zufallsvariablen an und bn (mit entsprechendem c) können

auch Zufallsvektoren oder Zufallsmatrizen sein.

Eine Erweiterung der schwachen Konvergenz: Schwache

Konvergenz gegen eine Zufallsvariable a:

plim(an − a) = 0

bedeutet nicht, daß an schwach gegen eine fixe Zahl a, sondern, daß an − a schwach gegen 0 konvergiert !

o1-8.tex/9

Konvergenz in Verteilung: Beispiele

Beispiel: Seien Xi, i = 1, . . . , n, unabhängig und nach

N (0, σ 2) verteilt;

X̄n √

Tn−1 =

n

sn

P

mit s2 = (Xi − X̄n)2/(n − 1) ist verteilt nach der tVerteilung mit n − 1 Freiheitsgraden, E{Tn−1} = 0 und

Var{Tn−1} = (n − 1)/(n − 3);

d

Tn−1 →

N (0, 1) .

Beispiel: Der Mittelwert von beliebig aber identisch verteilten, unabhängigen Zufallsvariablen Xi folgt asymptotisch

einer Normalverteilung.

o1-8.tex/10

Konvergenz in Verteilung

an aus der Folge von Zufallsvariable {an} habe die Verteilung

Fn; sei lim Fn(x) = F (x) für alle x, in denen F stetig; dann

d

sagt man, an konvergiert in Verteilung gegen a (an →

a); F heißt Grenzverteilung.

Die an (mit entsprechenden Fn und a) können auch Zufallsvektoren oder Zufallsmatrizen sein

Rechenregeln: Für beliebige Folgen {an}, {bn} von Zufallsvariablen gilt:

d

b folgt

1. Aus plim an = c und bn →

d

(a) an + bn →

c + b,

d

(b) an.bn →

c.b,

d

(c) bn/an →

b/c, wenn c 6= 0.

d

d

2. Aus bn →

b und plim(an − bn) = 0 folgt an →

b.

d

b und stetigem, von n unabhängigem g folgt:

3. Aus bn →

d

g(bn) → g(b).

o1-8.tex/11

Grenzwertsätze

Zentraler Grenzwertsatz (Lindberg-Levy): Für Xn

aus der Folge {Xn} von Zufallsvariablen gelte E{Xn} = µ

P

und Var{Xn} = σ 2; für X̄n = ( i Xi)/n gilt unter allgemeinen Bedingungen

√

d

n(X̄n − µ) →

N (0, σ 2)

Wir sagen auch, N (µ, σ 2) ist die asymptotische Verteilung,

2

σ

a

,

µ,

X̄n ∼

N

n

d.i. die bei großem, aber endlichen n näherungsweise gültige

Verteilung von X̄n.

o1-8.tex/12

Grenzwertsätze, Forts.

Verallgemeinerung für nicht gleiche Varianzen

Zentraler Grenzwertsatz (Lindberg-Feller): Für Xn

aus der Folge {Xn} von Zufallsvariablen gelte E{Xn} = µ

P

und Var{Xn} = σn2 ; für X̄n = ( i Xi)/n gilt unter allgemeinen Bedingungen

√

d

n(X̄n − µn) →

N (0, σ̄ 2)

mit

σ̄ 2 = n→∞

lim

n

1 X

σi2

n i=1

Cramér’s Theorem: Für die Folge {An} von Zufallsmatrizen gelte plim An = A, für die Folge {bn} von Zufallsvekd

d

toren gelte bn →

b ∼ N (0, Q); dann gilt: Anbn →

Ab ∼

N (0, AQA0)

o1-8.tex/13

Konsistenz des KQ-Schätzers b

Sei yn der n-Vektor der Yt; analog Xn und un:

yn = Xnβ + un

mit X fix, un ∼ D(0, σ 2In)

Der KQ-Schätzers bn = (Xn0 Xn)−1Xn0 yn

• ist erwartungstreu

• hat minimale Varianz σ 2(Xn0 Xn)−1

• ist er konsistent?

Tschebischeff’s Theorem: bn konsistent, wenn lim Var{bn} =

0

Übliche Annahme (ohne Index n geschrieben):

lim n−1X 0X = Q,

Q nichtsingulär

Dann ist b konsistenter Schätzer:

lim Var{b} = lim σ 2(X 0X)−1 = lim σ 2n−1(n−1X 0X)−1

σ 2 −1

= lim Q = 0

n

Achtung! bei Trend

Alternative Annahme: lim(X 0X)−1 = 0

o1-8.tex/14

Konsistenz des Schätzers σ̂ 2

Schätzer ist definiert zu

σ̂ 2 =

1 0

ee

n−k

Aus e = y − Xb = X(β − b) + u folgt bei Konsistenz von

plim b = β

plim(e − u) = plim X(β − b) = 0

d.h., e (et) konvergiert schwach gegen u (ut)

e0e/(n − k) konvergiert schwach gegen u0u/(n − k) oder

u0u/n

Aus Kintschin’s Theorem folgt

plim

1X 2

ut = E{u2t } = σ 2

n

Die Annahme lim n−1X 0X = Q mit nichtsingulärem Q stellt

sicher

• Konsistenz von b

• Konsistenz von σ̂ 2

o1-8.tex/15

Asymptotische Verteilung von b

b − β = (X 0X)−1X 0u

b − β = (X 0X)−1X 0u = n−1/2(n−1X 0X)−1(n−1/2X 0u)

√

n(b − β) = (n−1X 0X)−1(n−1/2X 0u)

Aus

plim(n−1X 0X)−1 = Q−1

d

n−1/2X 0u →

Z ∼ N (0, σ 2Q)

folgt:

√

d

n(b − β) →

Q−1Z ∼ N (0, σ 2Q−1)

√

n(b − β) ∼

˙ N (0, σ 2Q−1)

σ 2 −1

b−β ∼

˙ N (0, Q )

n

σ 2 −1

b ∼

˙ N (β, Q )

n

b ∼

˙ N [β, σ 2(X 0X)−1]

o1-8.tex/16

Test auf lineare Restriktionen

Die Hypothese H0: Hβ = h (g lineare Restriktionen) für

die Regressionskoeffizienten β des Modells y = Xβ + u ist

zu testen.

Aus

√

d

n(b − β) →

Q−1Z ∼ N (0, σ 2Q−1)

folgt unter H0

√

d

n(Hb − h) →

HQ−1Z ∼ N (0, σ 2HQ−1H 0)

Damit gilt

(Hb − h)0[HQ−1H 0]−1(Hb − h) d

n

→ T ∼ χ2g

2

σ

Näherungsweise gilt

(Hb − h)0[H(X 0X)−1H 0]−1(Hb − h)

∼

˙ χ2g

2

σ

Zur praktischen Berechnung macht man Gebrauch von

(Hb − h)0[H(X 0X)−1H 0]−1(Hb − h) = SR − S

wobei S die nicht restringierte Summe der Fehlerquadrate,

SR die restringierte Summe der Fehlerquadrate ist.

o1-8.tex/17

Zufällige unabhängige Variable X

• Erwartungswert von b:

0

−1 0

E{b} = β + E{(X X) X u}

E{(X 0X)−1X 0u} = 0,

wenn X und u unabhängig

dann gilt Var{b} = σ 2 E{(X 0X)−1}

• Konsistenz von b:

b = β + (n−1X 0X)−1n−1X 0u

plim b = β,

wenn plim n−1X 0X = Q (nichtsingulär)

plim n−1X 0u = 0

• Asymptotische Verteilung von b:

√

d

n(b − β) →

N (0, σ 2Q−1)

wenn plim n−1X 0X = Q (nichtsingulär)

d

n−1/2X 0u →

N (0, σ 2Q)

Kann nur für konkrete Verteilung von X beurteilt werden!

o1-8.tex/18