Robustheit

Werbung

Robustheit

Jan Mathias Köhler

Philosophische Grundlagen der Statistik - Seminar

Betreuer: Prof. Dr. Thomas Augustin

München, 27.01.11

Robustheit

1 / 41

1

Einleitung

Geschichtliche Einbettung

Notwendigkeit der Robustheit (Historisches Beispiel)

Definition von Robustheit

2

Maße der Robustheit (für Stichproben)

Bruchpunkt

Empirische Einflussfunktion

Sensitivitätsfunktion

3

Einflussfunktion - Maß der Robustheit

Definition

Maße der Einflussfunktion

4

M-Schätzer

Definition

Beispiel für Lokationsschätzung

Einflussfunktion und Bruchpunkt (M-Schätzer)

5

Kritische Würdigung

Robustheit

2 / 41

Einleitung

1

Geschichtliche Einbettung

Entwicklung bis 1885: Ignoranz

Robuste Methoden“ zum Umgang mit Ausreißern, v.a. bei linearer Regression

”

Nur subjektive Verfahren: bspw. Kriterien zum Löschen von Ausreißern oder

gewichteter Mittelwert

Entwicklung bis 1963: Erkenntnisschub

1886 (Newcomb): Im Ggsatz zur erwarteten Normalverteilung (NV) haben wahre

Datenverteilungen heavy tails → Lösung durch Mischung von NVen

1931 (Pearson): χ2 und F -Test (für Varianz) sind sensibel bei Abweichung von den

Modellannahmen

1940: Entwicklung der nonparametrischen Statistik

1953 (Box): verwendet erstmals den Begriff robust“

”

1960 (Tukey)[2]: Zeigt erstmals die große Sensitivität von Statistiken bei kleinen

Abweichungen von den Annahmen auf

1

Quelle: [1]

Robustheit

3 / 41

Einleitung

Geschichtliche Einbettung

Entwicklung ab 1964: Durchbruch

1964 (Huber): Minimax-Verfahren & M-Schätzer

1968 (Hampel): Einflussfunktion & Bruchpunkt

Standardwerke: Huber (1981) [3] und Hampel (1986) [4]

2000 – 2010

Huber

(1964) [5]

Hampel

(1968) [6]

Huber

(1981) [3]

Hampel

(1986) [4]

Alle Felder

Stat.& Prob.

464

183

71

39

2009

535

1070

426

Tabelle: Anzahl an Referenzen zu Basis-Veröffentlichungen der Robustheit.

Quelle: ISI Web of Knowledge Abfrage vom 11.01.11.

Robustheit

4 / 41

Einleitung

Notwendigkeit der Robustheit (Historisches Beispiel)

Artikel von Tukey (1960) [2]

In realen Daten liegen meist heavy-tails vor (gezeigt u.a. von

Box/Anderson 1955 [7] und Student (1927) [8])

Diese leichte Abweichung der Daten von der Normalverteilung führt

zu falschen“ Schätzungen

”

Tukey zeigt dies durch Konstruktion einer Datenmenge mit

Kontamination2

Unterschiede der wahren“ von der verschmutzten Verteilung mit dem

”

Auge kaum sichtbar

2

Mischverteilung von zwei Normalverteilungen, wobei das Mischungsverhältnis der Kontaminationsgrad ist.

Robustheit

5 / 41

Einleitung

Notwendigkeit der Robustheit (Historisches Beispiel)

Verschmutzung in den Daten

Normalverteilte Daten mit Kontamination vom Grad γ (nach [2], S. 454)

0.4

f(x)=(1−γ)φ(0,1)+γφ(0, 3)

0.2

0.1

0.0

f(x)

0.3

γ=0

γ=0.05

γ=0.1

γ=0.5

−4

−2

0

2

4

x

Robustheit

6 / 41

Einleitung

Notwendigkeit der Robustheit (Historisches Beispiel)

γ=0.05

−3

−1

●

0

5

●●●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●●●

−5

−3 −1

1

3

γ=0

1 2 3

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●●

●

−3

−1

1 2 3

γ=0.5

●

●●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●●

●

●

●●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●

●●

●

−3

−1

0

5

γ=0.1

−10

0

5

Theoretische Quantile

−5

Quantile der verschmutzten Daten

Q-Q-Plot der verschmutzten Daten

1 2 3

−3

Robustheit

−1

1 2 3

7 / 41

Einleitung

Notwendigkeit der Robustheit (Historisches Beispiel)

Exkurs: Definition von Effizienz

Effizienz betrachtet den Vergleich von zwei erwartungstreuen Schätzern

θ̂1 (X) und θ̂2 (X) des Parameters θ anhand ihrer Varianz.

Relative Effizienz von Schätzer θ̂1 (X) bzgl. θ̂2 (X)

η(θ̂1 (X)) =

V ar[θ̂2 (X)]

V ar[θ̂1 (X)]

Relative Effizienz eines Schätzer θ̂1 (X)

Es gilt V ar[θ̂1 (X)] ≥ I(θ)−1 (Cramer-Rao-Ungleichung)

−1

⇒ η ∗ (θ̂1 (X)) = I(θ)

V ar[θ̂1 (X)]

Asymptotisch effizienzter Schätzer θ̂1 (X), wenn gilt

lim η ∗ (θ̂1 (X)) = 1

n→∞

Robustheit

8 / 41

Einleitung

Notwendigkeit der Robustheit (Historisches Beispiel)

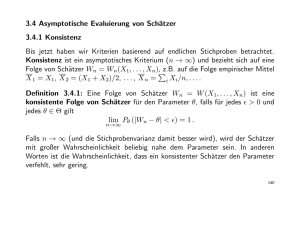

Vergleich von Schätzern für Skalenparameter σ̂ und M AD

Simulation von 1000 Datensätzen aus f (x) = (1 − γ) · φ[0,1] + γ · φ[0,3] (d.h. der mit

Grad γ verschmutzten Standardnormalverteilung)

γ

0

0.01

0.03

0.05

0.1

0.2

0.35

0.5

θˆ1 = σ̂

V ar(θˆ1 )[10−2 ]

θˆ2 = M AD 1

V ar(θˆ2 )[10−2 ]

η(θˆ1 )

1.0020

0.0523

1.0000

0.1335

2.5537

1.0383

0.083

1.0054

0.1433

1.7267

1.1136

0.1405

1.0237

0.1374

0.9782

1.1824

0.1847

1.0377

0.1532

0.8296

1.3418

0.2599

1.0796

0.1600

0.6156

1.61

0.3278

1.1772

0.1919

0.5855

1.9486

0.4073

1.3581

0.2385

0.5857

2.2369

0.4028

1.5954

0.3718

0.9232

1

MAD: median absolute deviation (Median d. abs. Abweichungen) M AD(X) = med|Xi − X̃| mit X̃ =

median(X)

Resultat

Der robustere Schätzer M AD ist weniger anfällig auf Verschmutzung

M AD weißt bei Verschmutzung ab γ ≥ 0.03 eine höhere Effizienz auf als σ̂

Robustheit

9 / 41

Einleitung

Definition von Robustheit

Hubers (1981) Sicht der Robustheit

robustness signifies insensitivity to small deviations from the

”

assumptions“ ([3], S. 1)

Das häufigste Problem sind heavy-tails der Dichten, z.B. aufgrund

von Ausreißern

Ziele von robusten Statistiken - Huber

hohe Effizienz

kleine Abweichungen von den Modellannahmen sollten das Ergebnis

nur minimal beeinflussen

große Abweichungen sollten keine Katastrophe verursachen

(–> Minimax Ansatz)

Robustheit

10 / 41

Einleitung

Definition von Robustheit

Hampels (1986) Sicht der Robustheit

robust statistics ... [relates] to deviations from idealized assumptions

”

in statistics“ ([4], S. 7)

robustness theories can be viewed as stability theories of statistical

”

inference“ ([4], S. 8)

Ziele von robusten Statistiken - Hampel

Die Struktur der Daten soll gefunden werden

Stark abweichende Datenpunkte,

bzw. Datenpunkte mit Einfluss auf den Schätzer sollen gefunden

werden

Abweichungen von der angenommenen Korrelationsstruktur, wie z.B.

serielle Korrelation, soll behandelt werden

Robustheit

11 / 41

Einleitung

Definition von Robustheit

Zusammenfassung Robustheit

Robustheit = Unempfindlichkeit bei Abweichungen von den

Modellannahmen

Robuste Statistik als Mittel zwischen Parametrischer und

Nonparametrischer Statistik

Robuste Statistiken sollen durch Ausreißer wenig beeinflußt werden

...every specialist may see robustness theories under a different angle“

”

([4], S. 7)

Robustheit

12 / 41

Maße der Robustheit (für Stichproben)

1

Einleitung

2

Maße der Robustheit (für Stichproben)

Bruchpunkt

Empirische Einflussfunktion

Sensitivitätsfunktion

3

Einflussfunktion - Maß der Robustheit

4

M-Schätzer

5

Kritische Würdigung

Robustheit

13 / 41

Maße der Robustheit (für Stichproben)

Bruchpunkt

Bruchpunkt

Definition Maximaler Bias (nach [10], S. 488)

B(; x; θ̂) = sup |θ̂(x) − θ̂(x∗ )| : dn (x, x∗) < Definition Bruchpunkt

b(x; θ̂) = inf B(; x; θ̂) = ∞

dn (x, x∗) = n1 #(i : xi 6= x∗i , i = 1, ..., n): Anteil an unterschiedlichen

Datenpunkten zwischen der ursprünglichen x und der veränderten

Stichprobe x∗

inf : Der kleinste Anteil an unterschiedlichen Datenpunkten wird

gesucht, so dass

B(; x; θ̂) = ∞: der maximale Bias unendlich ist

⇒ Bruchpunkt: Kleinster Anteil der Daten, welcher geändert werden muss,

damit Schätzer zusammenbricht.

Robustheit

14 / 41

Maße der Robustheit (für Stichproben)

Bruchpunkt

Beispiel für Bruchpunkt

Mittelwert X

b(X; X) =

1

n

und damit

lim b(X; X) = 0

n→∞

Veranschaulichung: Es reicht nur einen Wert x∗i auf x∗i = xi + c zu

verändern. Nun ist |x − x∗ | = | nc |.

Median X̃

(

b(X̃; X) =

1

2

1

2

lim b(X̃; X) =

n→∞

1

2n

1

n

1

2

+

−

für n ungerade

für n gerade

Robustheit

15 / 41

Maße der Robustheit (für Stichproben)

Empirische Einflussfunktion

Empirische Einflussfunktion

Definition

EIFi (x∗i ; θ̂, x1 , ..., xn ) = θ̂(x1 , ...x∗i , ..., xn )

Die empirische Einflussfuntkon (EIF) gibt an, was der neue

Schätzwert ist, wenn eine Beobachtung xi durch x∗i ersetzt wird.

Alternative Definition durch Hinzufügen von neuem Wert x∗n+1 statt

Ersetzen eines Wertes möglich.

Robustheit

16 / 41

Maße der Robustheit (für Stichproben)

Empirische Einflussfunktion

Die empirische Einflussfunktion für den Mittelwert, den Median und das 20%-gestutzte

Mittel mit Hinzufügen von neuem Wert x∗n+1 (nach [4], S. 94)

Mit Daten

> x <- sample(seq(40,60, length = 100), 20, replace = T)

[1] 40.40 40.81 41.41 41.62 42.22 44.65 45.05 45.66 47.68 48.69

[11]49.29 49.70 52.12 53.54 54.34 54.55 57.58 58.59 58.79 59.19

49.5

49.0

48.5

EIF(x;θ^)

50.0

X =49.293

~

X =48.990

X0.2=49.048

30

40

50

60

70

xStern

n+1

Robustheit

17 / 41

Maße der Robustheit (für Stichproben)

Sensitivitätsfunktion

Sensitivitätsfunktion

Definition

SC(x∗n ; θ̂, x1 , ...xn−1 ) = n[θ̂(x1 , ..., xn−1 , x∗n ) − θ̂(x1 , ...xn−1 )]

Im Vgl. zur EIF hier nun Wert x∗n hinzugefügt

Einfluss von x∗n auf Schätzer θ̂ sinkt mit mehr Datenpunkten, daher

SC(...) = n · ...

⇒ SC misst, welchen Einfluss eine neue Beobachtung x∗n auf den

Schätzwert hat?

⇒ Am Wert von SC erkennt man, ab welcher Beobachtung x∗n ein

Schätzer robuster ist.

Robustheit

18 / 41

Maße der Robustheit (für Stichproben)

Sensitivitätsfunktion

20

Die Sensitivitätsfunktion für den Mittelwert, den Median und das 20%-gestutzte Mittel

0

−10

−20

SC(x;θ^)

10

X =49.293

~

X =48.990

X0.2=49.048

30

40

50

60

70

xStern

n

Robustheit

19 / 41

Maße der Robustheit (für Stichproben)

Sensitivitätsfunktion

Überleitung zur Einflussfunktion

Ist θ̂ ein Schätzer abhängig von einer empirischen Verteilungsfunktion

Fn−1 , also θ̂(x1 , ..., xn−1 ) = θ̂(Fn−1 ) so gilt

SC(x∗n ; θ̂, x1 , ..., xn−1 ) = n[θ̂(x1 , ..., xn−1 , x∗n ) − θ̂(x1 , ..., xn−1 )]

⇓ θ̂(x1 , ..., xn ) = θ̂(Fn )

SC(x∗n ; θ̂, F ) = [θ̂{(1 − n1 )Fn−1 + n1 δx∗n } − θ̂(Fn−1 )]/ n1

θ̂(Fn−1 ): Schätzwert vor Hinzufügen von x∗n

δx∗n : Diracmaß zu x∗n

θ̂{(1 − n1 )Fn−1 + n1 δx∗n }: Schätzer der an der Stelle x∗n kontaminierten

Verteilung

Zusammenhang zur Einflussfunktion: Die Kontamination beträgt t := 1/n.

Für n → ∞ gilt t → 0 und SC(x∗n ; θ̂, Fn ) konvergiert ( in vielen

”

Situationen“ [4], S. 94) zur Einflussfunktion IF (x∗n ; θ̂, F ).

Robustheit

20 / 41

Einflussfunktion - Maß der Robustheit

1

Einleitung

2

Maße der Robustheit (für Stichproben)

3

Einflussfunktion - Maß der Robustheit

Definition

Maße der Einflussfunktion

4

M-Schätzer

5

Kritische Würdigung

Robustheit

21 / 41

Einflussfunktion - Maß der Robustheit

Definition

Einflussfunktion (Influence function)

Definition

IF (x; θ̂, F ) = θ̂x0 (F ) = lim

t→0+

θ̂{(1 − t)F + tδx } − θ̂(F )

t

IF ist unabhängig von einer Stichprobe (im Gegensatz zu bisher

erwähnten Verfahren)

IF beschreibt, wie sich der Schätzer θ̂ durch eine infinitesimale

Verschmutzung an der Stelle x verändert

Art Sekantensteigung“

”

Robustheit

22 / 41

Einflussfunktion - Maß der Robustheit

Definition

3

Die Einflussfunktion für den Mittelwert, den Median und die Huber-Schätzer für k=0.5,

1, 1.5 bei Standardnormalverteilung (nach [4], S. 45)

0

−1

−2

−3

IF(x;θ^F)

1

2

X

~

X

k=0.5

k=1

k=1.5

−3

−2

−1

0

1

2

3

x

Robustheit

23 / 41

Einflussfunktion - Maß der Robustheit

Definition

Beispiel am Mittelwert

Der Schätzer basiert auf θ̂(F ) =

R

Einsetzen in IF (x; θ̂, F ) = lim

θ̂{(1 − t)F + tδx } − θ̂(F )

liefert

t

t→0+

udF (u)

R

R

u d[(1 − t)F + tδx ](u) − u dF (u)

=

lim

+

t R

t→0

R

R

(1 − t) u dF (u) + t u dδx (u) − u dF (u)

lim

=

t

t→0+

mit

R

R

u dδx (u) = x und u dF (u) = c, c ∈ R

(1 − t)c + tx − c

=

t

t→0+

tx − tc

lim

=x−c

+

t

t→0

lim

also IF (x; θ̂, F ) = x − c

Robustheit

24 / 41

Einflussfunktion - Maß der Robustheit

Maße der Einflussfunktion

Maße der Einflussfunktion

am Beispiel der Einflussfunktion des Tukey biweight-Schätzers (M-Schätzer)

(nach [4], S. 44)

local−shift

sensitivity

0

IF(x;θ^T)

rejection

point

gross−error sensitivity

x

Robustheit

25 / 41

Einflussfunktion - Maß der Robustheit

Maße der Einflussfunktion

gross-error sensitivity γ ∗ und B-Robustheit

Definition gross-error sensitivity

γ ∗ = sup |IF (x; θ̂, F )|

x

gross-error sensitivity ist ein quantitatives Maß für die Robustheit

gibt das Maximum der Einflussfunktion an

Definition B-Robustheit

γ ∗ < ∞ ⇒ θ̂ ist B(ias)-robust

wenn das Maximum der IF endlich ist, ist θ̂ B-robust

optimaler B-robuster Schätzer: θ̂ kann nicht gleichzeitig bzgl. V (θ̂, F )

und γ ∗ verbessert werden

Robustheit

26 / 41

Einflussfunktion - Maß der Robustheit

Maße der Einflussfunktion

local-shift sensitivity λ∗ und Rejection point ρ∗

Definition

)−IF (x;θ̂,F |)

local-shift sensitivity λ∗ = sup |IF (x0 ;θ̂,F

|x0 −x|

x6=y

Maß für kleine Veränderungen in den Daten, z.B. durch Runden,

lokale Innacuracies

Misst den Einfluss auf den Schätzer, wenn x auf x0 verändert wird

λ∗ ist die Steigung von IF im Punkt x

Definition

Rejection point ρ∗ = inf {IF (x; θ̂, F ) = 0 : |x| > r}

r>0

ρ∗ =ab welcher Größe r hat ein Ausreißer keinen Einfluss mehr auf

den Schätzer

Falls kein r vorhanden, ist ρ∗ = ∞

Robustheit

27 / 41

Einflussfunktion - Maß der Robustheit

Maße der Einflussfunktion

Wünschenswerte Eigenschaften der Einflussfunktion

(nach Hampel (1974 [9]))

Begrenzte gross-error sensitivity (also θ̂ soll B-robust sein)

Niedrige local-shift-sensitivity

Niedrigen (endlichen) rejection point

Robustheit

28 / 41

M-Schätzer

1

Einleitung

2

Maße der Robustheit (für Stichproben)

3

Einflussfunktion - Maß der Robustheit

4

M-Schätzer

Definition

Beispiel für Lokationsschätzung

Einflussfunktion und Bruchpunkt (M-Schätzer)

5

Kritische Würdigung

Robustheit

29 / 41

M-Schätzer

Definition

Herleitung vom M-Schätzer

iid

(nach [10], S. 486 f.) Ausgehend von X = (X1 , ...Xn ) mit Xi ∼ F ist

ML-Schätzer (maximum likelihood)

Pn

i=1 −logf (xi ; θ)

→ min!

θ

Problem: Likelihood ist nicht robust gegen Ausreißer

Lösung: Ersetze −logf (x; θ) durch robustere Funktion ρ(x; θ)

M-Schätzer (maximum likelihood type)

Pn

i=1 ρ(xi ; θ)

⇒

→ min!

θ

∂

ρ(x

;

θ)

=

i

i=1 ∂θ

Pn

Pn

i=1 Ψ(xi ; θ)

!

=0

Jeder Schätzer θ̂, der diese Gleichung erfüllt heißt M-Schätzer

Für ρ(xi ; θ) = −logf (xi ; θ), erhält man ML-Schätzer.

Robustheit

30 / 41

M-Schätzer

Definition

Weitere Aspekte eines M-Schätzer

(vgl. [5], S. 74 ff.)

Weitere Bedingung

ρ ist eine nicht-konstante Funktion

Unter weiteren Regularitätsbedingungen gilt:

([5], Lemma 3) θ̂ ist konsistent“: θ̂ → c f.s. und in Verteilung

a

√ ”

([5], Lemma 4) n θ̂(x) − c ∼ N 0, V ar(Ψ, F )

Robustheit

31 / 41

M-Schätzer

Beispiel für Lokationsschätzung

Beispiel für Lokationsschätzung

Ein Lokationsschätzer θ̂ wird so erdacht, dass gilt

Pn

i=1 zi

:=

Pn

i=1

xi −θ̂

S

=0

mit S =Schätzung der Datenstreuung

Große zi , d.h. große Abweichungen xi von θ̂ sollen um die Schätzung

robuster zu machen, vermindert einfließen

Konstruiere Ψ(zi ) =

−k für

z für

k für

zi < −k

|zi | ≤ k

zi > k

d.h. Ψ(zi ) gibt an, wie stark zi in die Schätzung von θ̂ einfließt

Robustheit

32 / 41

Ψ(z) für Huber-Schätzer (k = 1.5) und ML-Schätzer

für ML-Schätzer bei Standardnormalverteilung ist

Ψ(z) =

∂

ρ(z; θ)

∂θ

=

∂

∂θ

− logf (xi ; θ)

∼N (0,1)

=

√

z · log( 2π) ≈ 0.9189 · z

0

−2

−1

Ψ(z)

1

2

ML−Schätzer N(0,1)

Huber−Schätzer k=1.5

−3

−2

−1

0

1

2

3

z

Ψ(z) für Huber-Schätzer

Für −k ≤ z ≤ k gehen die Beobachtungen vollständig in die Schätzung von θ̂ ein,

für |z| < k nur mit konstantem Wert k.

M-Schätzer

Beispiel für Lokationsschätzung

Gewichtsfunktion

Ψ(z)

z

konstruierbar

0.5

0.6

0.7

w(z)

0.8

0.9

1.0

Gewichtsfunktion w(z) =

−3

−2

−1

0

1

2

3

z

w(z) gibt an, wie stark der Wert der Abweichung einer Beobachtung von θ̂ für die

Schätzung von θ̂ gewichtet wird.

Robustheit

34 / 41

M-Schätzer

Beispiel für Lokationsschätzung

Ψ-Kurven bekannter M-Schätzer

1.5

>library(MASS)

0.0

−0.5

−1.0

−1.5

Ψ(z)

0.5

1.0

Huber k=0.5

Huber k=1

Huber k=1.5

Hampel a=1.2,b=2,c=2.5

Tukey Biweight c=2.5

−3

−2

−1

0

1

2

3

z

Robustheit

35 / 41

M-Schätzer

Einflussfunktion und Bruchpunkt (M-Schätzer)

Einflussfunktion eines M-Schätzers

IF (x; F, θ̂) = − R ψ(x; θ̂(F ))

∂

∂θ ψ(x, θ̂(F ))

dF (x)

Herleitung in [3], S. 45

IF (x; F, θ̂) ∝ ψ(x, θ̂(F ))

⇒ (i) rejection point, gross-error sensitivity und local-shift sensitivity

kann aus der Ψ-Funktion hergeleitet werden

⇒ (ii) Möglichkeit zur Konstruktion von robusten Schätzern

Robustheit

36 / 41

M-Schätzer

Einflussfunktion und Bruchpunkt (M-Schätzer)

Bruchpunkt eines M-Schätzers

Bruchpunkt eines M-Schätzers (nach [3], S. 53)

b(θ̂; x) =

η

1+η

mit

ψ(−∞) ψ(+∞)

η = min −

,−

ψ(+∞) ψ(−∞)

Maximales ∗ = 0.5 für ψ(−∞) = ψ(+∞)

∗ = 0, wenn ψ unbeschränkt ist, also ψ(∞) = ∞

Robustheit

37 / 41

Kritische Würdigung

1

Einleitung

2

Maße der Robustheit (für Stichproben)

3

Einflussfunktion - Maß der Robustheit

4

M-Schätzer

5

Kritische Würdigung

Robustheit

38 / 41

Kritische Würdigung

Kritische Würdigung - die schlechte Nachricht

Keine einheitliche Definition ( As Huber (1972) pointed out robustness was

”

defined rather vaguely from the start by Box & Anderson (1955) and it has not

gained in precision with time.“) (Bickel (1976) [11], S. 146)

Robustheit eines Schätzers nicht einziges Kriterium für dessen Qualität (wichtig

auch Effizienz, Konsistenz, Suffizienz und Erwartungstreue)

Lösung der Nullstelle der Ψ-Funktion bei M-Schätzern i.A. nicht explizit lösbar.

Lösung z.B. durch iteratives Newton-Raphson Verfahren.

Viele Simulationsstudien über robuste Verfahren beruhen meist auf kleinen

Abweichungen der Normalverteilung. Übertrag auf echte Daten ergibt teilweise

anderes Bild. (Stigler (1977) [12], S. 1057)

Trotz vieler Simulationsstudien, unklar, wann welcher robuster Schätzer

(L-,R-,S-,M-Schätzer, etc.) am Besten einzusetzen. [12]

Stigler (2010 [13], S. 9) über die Princeton Study (1972 [14]) At

”

another extreme it could be seen as a fruitless exercise in self-indulgent ad hockery,

beating a small and uninterestingly limited problem to death by computer overkill.

Robustheit

39 / 41

Kritische Würdigung

Kritische Würdigung - die gute Nachricht

Parametrische Modelle sind nur Annäherung an die Realität, nichtparametrische

Verfahren nutzen nicht alle vorhandenen Informationen. Kompromiss führt zu

robusten Verfahren.

Parametrische Verfahren gehen von (exakten) Verteilungsannahmen aus. Bei

realten Daten treffen diese selten zu (z.B. exakte Normalverteilung).

Höhere Effizienz von robusten Statistiken, falls die Annahmen nicht exakt zutreffen.

Robuste Verfahren nun für viele Gebiete entwickelt (Lokations- und

Skalenschätzung, Überlebensanalyse, GLM, Zeitreihen,...)

Verteilungsfamilie nie exakt bekannt. Für Menge von Verteilungsfamilien F der

Form

F = (1 − γ) · F0 + γ · G

(gross-error model)

durch robuste Verfahren beinahe optimale (i.S.d. Effizienz) Schätzungen möglich.

Robustheitsmaße (Einflussfunktion, Bruchpunkt,...) vorhanden zur Beurteilung von

verschiedenen Schätzern.

Robustheit

40 / 41

Kritische Würdigung

The hallmark of good science is that it uses models and ’theories’ but

”

never believes them“

- Martin Bradbury Wilk - George E. P. Box -

Robustheit

41 / 41

Literatur

[1] K. Schmidt. Die historische Entwicklung der robusten Statistik. In Wissenschaftstheorien und Wissenstransformation im 20. Jahrhundert, Seminar des Instituts der Statistik der

Ludwig-Maximilians-Universität, Wildbad-Kreuth, März 2010.

[2] J.W. Tukey. A survey of sampling from contaminated distributions, chapter 39, pages 448–

485. Contributions to probability and statistics: essays in honor of Harlod Hotelling, Band

2. Stanford University Press, 1960.

[3] P.J. Huber. Robust statistics. Wiley Series in Probability and Mathematical Statistics, 1981.

[4] F.R. Hampel, E.M. Ronchetti, P.J. Rousseeuw, and W.A. Stahel. Robust statistics. Wiley

New York, 1986.

[5] P.J. Huber. Robust estimation of a location parameter. The Annals of Mathematical Statistics, 35(1):73–101, 1964.

[6] F.R. Hampel. Contributions to the theory of robust estimation. PhD thesis, 1968.

[7] G.E.P. Box and S.L. Andersen. Permutation theory in the derivation of robust criteria and

the study of departures from assumption. Journal of the Royal Statistical Society. Series B

(Methodological), 17(1):1–34, 1955.

[8] Student. Errors of routine analysis. Biometrika, 19(1):151–164, 1927.

[9] F.R. Hampel. The influence curve and its role in robust estimation. Journal of the American

Statistical Association, 69(346):383–393, 1974.

[10] H. Rinne. Taschenbuch der Statistik. Harri Deutsch Verlag, 2008.

[11] P.J. Bickel, S. Holm, B. Rosén, E. Spjøtvoll, S. Lauritzen, S. Johansen, and O. BarndorffNielsen. Another look at robustness: a review of reviews and some new developments [with

discussion and reply]. Scandinavian Journal of Statistics, 3(4):145–168, 1976.

[12] S.M. Stigler. Do robust estimators work with real data? The Annals of Statistics, 5(6):1055–

1098, 1977.

[13] S.M. Stigler. The changing history of robustness. In International Conference on Robust

Statistics, Juni Prag, 2010.

[14] D.F. Andrews, P.J. Bickel, F.R. Hampel, P.J. Huber, W.H. Rogers, and J.W. Tukey. Robust

estimates of location: survey and advances. Princeton University Press, 1972.

2