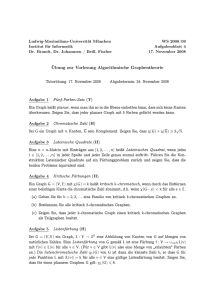

VO Diskrete Mathematik

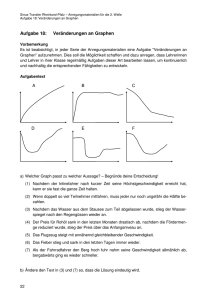

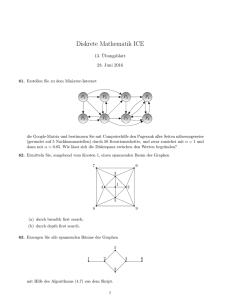

Werbung

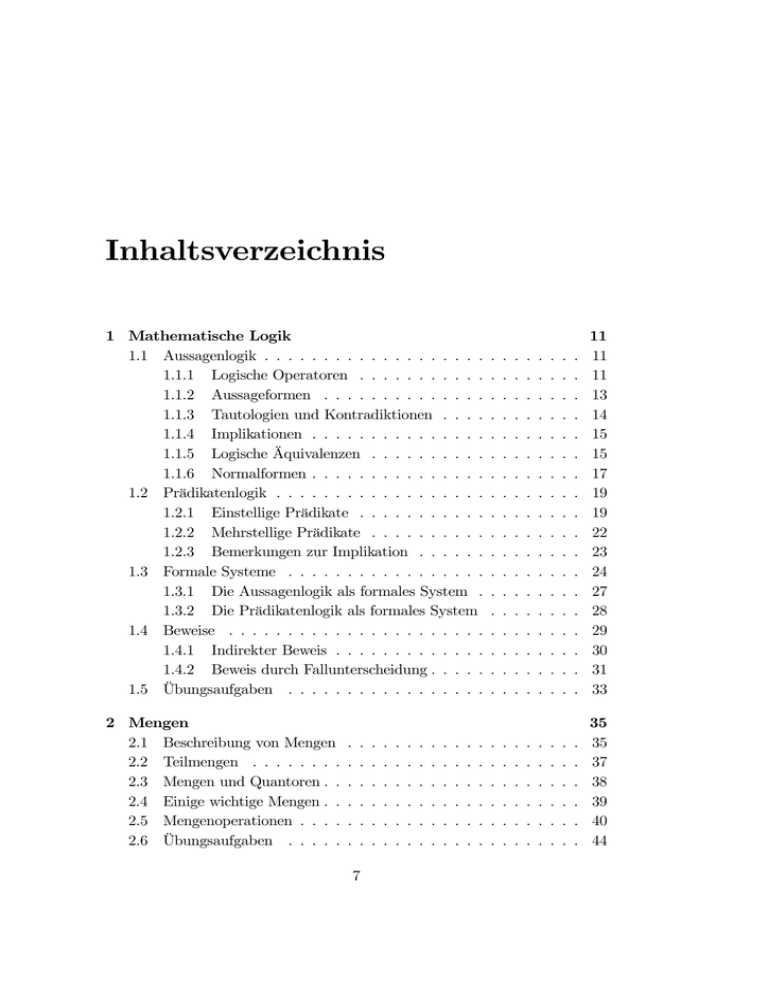

Inhaltsverzeichnis

1 Mathematische Logik

1.1 Aussagenlogik . . . . . . . . . . . . . . . . . . .

1.1.1 Logische Operatoren . . . . . . . . . . .

1.1.2 Aussageformen . . . . . . . . . . . . . .

1.1.3 Tautologien und Kontradiktionen . . . .

1.1.4 Implikationen . . . . . . . . . . . . . . .

1.1.5 Logische Äquivalenzen . . . . . . . . . .

1.1.6 Normalformen . . . . . . . . . . . . . . .

1.2 Prädikatenlogik . . . . . . . . . . . . . . . . . .

1.2.1 Einstellige Prädikate . . . . . . . . . . .

1.2.2 Mehrstellige Prädikate . . . . . . . . . .

1.2.3 Bemerkungen zur Implikation . . . . . .

1.3 Formale Systeme . . . . . . . . . . . . . . . . .

1.3.1 Die Aussagenlogik als formales System .

1.3.2 Die Prädikatenlogik als formales System

1.4 Beweise . . . . . . . . . . . . . . . . . . . . . .

1.4.1 Indirekter Beweis . . . . . . . . . . . . .

1.4.2 Beweis durch Fallunterscheidung . . . . .

1.5 Übungsaufgaben . . . . . . . . . . . . . . . . .

2 Mengen

2.1 Beschreibung von Mengen

2.2 Teilmengen . . . . . . . .

2.3 Mengen und Quantoren . .

2.4 Einige wichtige Mengen . .

2.5 Mengenoperationen . . . .

2.6 Übungsaufgaben . . . . .

.

.

.

.

.

.

.

.

.

.

.

.

7

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

11

11

11

13

14

15

15

17

19

19

22

23

24

27

28

29

30

31

33

.

.

.

.

.

.

35

35

37

38

39

40

44

8

3 Relationen

3.1 Allgemeines . . . . . . . . . .

3.2 Graphen . . . . . . . . . . . .

3.2.1 Gerichtete Graphen . .

3.2.2 Ungerichtete Graphen

3.2.3 Pfade . . . . . . . . .

3.2.4 Teilgraphen . . . . . .

3.2.5 Kreise . . . . . . . . .

3.2.6 Anwendungen . . . . .

3.3 Äquivalenzrelationen . . . . .

3.4 Ordnungsrelationen . . . . . .

3.5 Hüllen von Relationen . . . .

3.6 Übungsaufgaben . . . . . . .

INHALTSVERZEICHNIS

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

4 Funktionen

4.1 Grundbegriffe . . . . . . . . . . . . . .

4.2 Wichtige Eigenschaften von Funktionen

4.3 Zusammensetzung von Funktionen . .

4.4 Einschränkung von Funktionen . . . .

4.5 Bild und Urbild von Mengen . . . . . .

4.6 Umkehrung von Funktionen . . . . . .

4.7 Fixpunkte . . . . . . . . . . . . . . . .

4.8 Übungsaufgaben . . . . . . . . . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

5 Zahlen

5.1 Natürliche Zahlen . . . . . . . . . . . . . .

5.1.1 Das Wohlordnungsaxiom . . . . . .

5.1.2 Das Induktionsprinzip . . . . . . .

5.1.3 Varianten des Induktionsprinzips .

5.2 Folgen . . . . . . . . . . . . . . . . . . . .

5.3 Rekursionen . . . . . . . . . . . . . . . . .

5.3.1 Rekursiv definierte Folgen . . . . .

5.3.2 Allgemeine Summen und Produkte

5.3.3 Auflösung von Rekursionen . . . .

5.4 Ganze Zahlen . . . . . . . . . . . . . . . .

5.5 Division mit Rest . . . . . . . . . . . . . .

5.5.1 Division von natürlichen Zahlen . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

47

47

49

49

50

52

53

53

54

55

58

63

64

.

.

.

.

.

.

.

.

67

67

69

71

72

72

74

76

77

.

.

.

.

.

.

.

.

.

.

.

.

79

79

79

80

82

83

84

84

85

86

88

90

90

INHALTSVERZEICHNIS

9

5.5.2

5.5.3

5.5.4

5.5.5

Division von ganzen Zahlen . . . . . . . . . . . .

Ziffernentwicklungen von ganzen Zahlen . . . . .

Restklassen und Kongruenzen . . . . . . . . . . .

Der größte gemeinsame Teiler und der euklidische

gorithmus . . . . . . . . . . . . . . . . . . . . . .

5.6 Rationale Zahlen . . . . . . . . . . . . . . . . . . . . . .

5.7 Übungsaufgaben . . . . . . . . . . . . . . . . . . . . . .

. .

. .

. .

Al. .

. .

. .

. 91

. 92

. 94

6 Permutationen

6.1 Zyklendarstellung . . . . . . . . . . . . . . . . . . . . . . . .

6.2 Transpositionen . . . . . . . . . . . . . . . . . . . . . . . . .

6.3 Übungsaufgaben . . . . . . . . . . . . . . . . . . . . . . . .

107

. 108

. 110

. 113

7 Zählen (Kombinatorik)

7.1 Anzahl der Elemente einer Menge . . . . . . . . . . . . . .

7.2 Anzahl von Funktionen und Teilmengen . . . . . . . . . .

7.2.1 Beliebige Funktionen und Teilmengen . . . . . . . .

7.2.2 Injektive Funktionen . . . . . . . . . . . . . . . . .

7.2.3 Bijektive Funktionen . . . . . . . . . . . . . . . . .

7.2.4 k-elementige Teilmengen und monotone Funktionen

7.2.5 Surjektive Funktionen und Partitionen . . . . . . .

7.2.6 Multinomialkoeffizienten . . . . . . . . . . . . . . .

7.3 Anwendungsbeispiel: Fehlerkorrigierende Codes . . . . . .

7.4 Das Einschluss-Ausschluss-Prinzip . . . . . . . . . . . . . .

7.4.1 Fixpunktfreie Permutationen . . . . . . . . . . . . .

7.4.2 Ein anderer Beweis der Formel für die

Stirling’schen Zahlen 2. Art . . . . . . . . . . . . .

7.5 Elementare Wahrscheinlichkeiten . . . . . . . . . . . . . .

7.5.1 Ereignisse . . . . . . . . . . . . . . . . . . . . . . .

7.5.2 Wahrscheinlichkeiten . . . . . . . . . . . . . . . . .

7.6 Übungsaufgaben . . . . . . . . . . . . . . . . . . . . . . .

.

.

.

.

.

.

.

.

.

.

.

115

. 115

. 121

. 121

. 122

. 123

. 124

. 130

. 132

. 134

. 137

. 138

.

.

.

.

.

.

.

.

.

.

.

.

.

.

151

. 151

. 151

. 152

. 153

8 Graphen

8.1 Grundbegriffe . . . . . . . . . . . . . . .

8.1.1 Isomorphie von Graphen . . . . .

8.1.2 Einige wichtige spezielle Graphen

8.1.3 Eckengrade . . . . . . . . . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

. 98

. 105

. 105

139

140

140

141

147

10

INHALTSVERZEICHNIS

8.2

8.3

8.4

8.5

8.6

8.7

8.8

8.9

8.10

8.1.4 Adjazenzlisten . . . . . . . . . .

Wege und Wanderungen . . . . . . . .

8.2.1 Eulersche Wege . . . . . . . . .

8.2.2 Hamiltonsche Kreise . . . . . .

Adjazenzmatrizen . . . . . . . . . . . .

Bäume . . . . . . . . . . . . . . . . . .

8.4.1 Wurzelbäume . . . . . . . . . .

8.4.2 Aufspannende Bäume . . . . . .

Kreisfreie Digraphen . . . . . . . . . .

Bewertete Graphen und Digraphen . .

8.6.1 Kürzeste Wege . . . . . . . . .

8.6.2 Minimale aufspannende Bäume

Färbung von Graphen . . . . . . . . .

Planare Graphen . . . . . . . . . . . .

Multigraphen . . . . . . . . . . . . . .

Übungsaufgaben . . . . . . . . . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

9 Algebraische Strukturen

9.1 Halbgruppen . . . . . . . . . . . . . . . . . . .

9.2 Gruppen . . . . . . . . . . . . . . . . . . . . . .

9.2.1 Definitionen und Beispiele . . . . . . . .

9.2.2 Untergruppen . . . . . . . . . . . . . . .

9.2.3 Die Gruppe der primen Restklassen . . .

9.2.4 Anwendungsbeispiel: Verschlüsselung von

9.3 Ringe und Körper . . . . . . . . . . . . . . . . .

9.4 Polynome . . . . . . . . . . . . . . . . . . . . .

9.4.1 Polynomringe über Körpern . . . . . . .

9.5 Isomorphismen und Homomorphismen . . . . .

9.5.1 Isomorphismen . . . . . . . . . . . . . .

9.5.2 Der Körper der komplexen Zahlen . . . .

9.5.3 Homomorphismen . . . . . . . . . . . . .

9.6 Übungsaufgaben . . . . . . . . . . . . . . . . .

A Testaufgaben mit Lösungen

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

. . . . . . .

. . . . . . .

. . . . . . .

. . . . . . .

. . . . . . .

Nachrichten

. . . . . . .

. . . . . . .

. . . . . . .

. . . . . . .

. . . . . . .

. . . . . . .

. . . . . . .

. . . . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

158

159

160

164

165

167

169

179

182

186

188

196

199

203

210

212

215

. 215

. 219

. 219

. 221

. 226

. 232

. 234

. 238

. 241

. 244

. 244

. 248

. 251

. 256

259

Kapitel 1

Mathematische Logik

1.1

Aussagenlogik

Im allgemeinen Sprachgebrauch verwendet man das Wort ”Aussage” für beliebige sprachliche Ausdrücke, die keine Fragen oder Befehle sind. In der

Mathematik interessiert man sich dagegen vor allem für Aussagen, die nur

entweder wahr oder falsch sein können (”zweiwertige Logik”). Die Aussagenlogik (engl. ”propositional calculus”) dient zur Formalisierung des Umgangs

mit solchen Aussagen (”propositions”). Je nachdem, ob eine Aussage wahr

oder falsch ist, ordnen wir ihr den Wahrheitswert (”truth value”) W oder

F zu.

Aussagen werden im Folgenden mit Kleinbuchstaben mit oder ohne Indizes

bezeichnet: p, q, . . . , p1 , p2 , . . ..

Statt ”p ist wahr” sagt man oft auch ”p gilt”.

1.1.1

Logische Operatoren

Mit Hilfe der folgenden logischen Operatoren (”Junktoren”, ”logical connectives”) können aus gegebenen Aussagen neue Aussagen gebildet werden. Diese Operatoren werden durch ”Wahrheitstafeln” definiert, die den

Wahrheitswert der neuen Aussage in Abhängigkeit von den Wahrheitswerten

der gegebenen Aussagen enthalten.

11

12

KAPITEL 1. MATHEMATISCHE LOGIK

Einstellige Operatoren:

¬ : Negation, ”nicht”:

¬p

F

W

p

W

F

¬p ist also genau dann wahr, wenn p falsch ist.

Andere Schreibweisen: ∼ p, p0 .

Theoretisch gibt es noch drei weitere einstellige Operatoren:

p

W

F

v1 (p) v2 (p) v3 (p)

W

F

W

W

F

F

Diese sind jedoch uninteressant: Bei v1 (p) und v2 (p) hängt der Wahrheitswert

gar nicht von p ab, und v3 (p) hat in jedem Fall denselben Wahrheitswert wie

p.

Zweistellige Operatoren:

∧ : Konjunktion, ”und”;

∨ : Disjunktion, ”oder”;

→: Subjunktion, ”wenn ... dann”;

↔: Bijunktion, ”genau dann ... wenn”:

p

W

W

F

F

q

W

F

W

F

p∧q

W

F

F

F

p∨q

W

W

W

F

p→q

W

F

W

W

p↔q

W

F

F

W

Die Disjunktion wird oft auch als ”nichtausschließendes Oder” bezeichnet:

p ∨ q ist wahr, wenn nur eine der beiden Aussagen p, q wahr ist; p ∨ q ist aber

auch wahr, wenn beide Aussagen p, q wahr sind.

Es gibt klarerweise insgesamt 24 = 16 zweistellige logische Operatoren. Die

restlichen 12 haben aber nur untergeordnete Bedeutung.

1.1. AUSSAGENLOGIK

13

Bemerkungen zur Subjunktion:

• Die Aussage ”Wenn es heute regnet, dann bleibe ich zu Hause.” ist

nur in dem Fall falsch, dass es heute regnet und ich nicht zu Hause

bleibe. Durch die Sprechweise ”wenn ... dann” wird allerdings oft eine

Kausalbeziehung suggeriert. Davon ist aber nicht die Rede!

Beispiel: Sei p die Aussage 0 = 1 und q die Aussage 2 + 2 = 4. Dann

ist auf Grund der Definition der Subjunktion folgende Aussage wahr:

0 = 1 → 2 + 2 = 4.

Man wird aber normalerweise nicht sagen ”Wenn 0 = 1, dann ist 2+2 =

4.”.

• Besonders bemerkenswert ist die Tatsache, dass p → q auf jeden Fall

wahr ist, wenn p falsch ist. Das heißt also, dass (im Sinne der Subjunktion) aus einer falschen Aussage jede beliebige Aussage folgt (”ex falso

quodlibet”). Zum Beispiel sind folgende Aussagen wahr:

a) Wenn man jeden Winkel mit Zirkel und Lineal in drei gleiche Teile

teilen kann, dann bin ich der Kaiser von China.

b) Jedes Element der leeren Menge ist eine Primzahl. (D.h.: x ∈ ∅ → x

ist eine Primzahl.)

1.1.2

Aussageformen

Durch ein- oder mehrmalige Anwendung von logischen Operatoren kann

man aus elementaren Aussagen kompliziertere Aussagen aufbauen, deren

Wahrheitswert aufgrund obiger Wahrheitstafeln in jedem Fall berechnet werden kann. Wir sprechen dann von einer Verknüpfung von Aussagen (”compound proposition”).

Beispiel (”entweder - oder”, ”ausschließendes Oder”, ”exclusive or”):

(p ∧ (¬q)) ∨ ((¬p) ∧ q) :

p

W

W

F

F

q

W

F

W

F

p ∧ ¬q

F

W

F

F

¬p ∧ q

F

F

W

F

(p ∧ (¬q)) ∨ ((¬p) ∧ q)

F

W

W

F

14

KAPITEL 1. MATHEMATISCHE LOGIK

Man kann die hier vorkommenden Symbole p, q, . . . auch als Variablen ansehen, d.h. als ”Platzhalter”, für die beliebige Aussagen eingesetzt werden können. Dann nennt man so eine Verknüpfung auch Aussageform.

Damit nicht so viele Klammern nötig sind, vereinbart man für die logischen

Operatoren gewisse Prioritäten (ähnlich wie bei den algebraischen Operatoren). Die in der folgenden Liste weiter links stehenden Operatoren werden

vor den weiter rechts stehenden durchgeführt:

¬, ∧, ∨, →, ↔

a ∨ ¬b → c ↔ a bedeutet also dasselbe wie ((a ∨ (¬b)) → c) ↔ a. Das

obige ”entweder-oder” können wir jetzt kürzer so schreiben: p ∧ ¬q ∨ ¬p ∧ q.

Deutlicher ist aber vielleicht: (p ∧ ¬q) ∨ (¬p ∧ q).

1.1.3

Tautologien und Kontradiktionen

Definition 1.1 Eine Aussageform in den Variablen p, q, . . . heißt Tautologie (”tautology”), wenn sie immer wahr ist, unabhängig von den Wahrheitswerten der Variablen p, q, . . . . Sie heißt Widerspruch oder Kontradiktion

(”contradiction”), wenn sie immer falsch ist.

Beispiele für Tautologien:

• p ∨ ¬p

• (¬p ∨ q) ↔ (p → q), bzw. ohne Klammern: ¬p ∨ q ↔ p → q.

Beweis:

p

W

W

F

F

q

W

F

W

F

¬p ∨ q

W

F

W

W

Beispiele für Kontradiktionen:

• p ∧ ¬p

• (p ∨ q) ∧ (¬p ∧ ¬q)

p→q

W

F

W

W

(¬p ∨ q) ↔ (p → q)

W

W

W

W

1.1. AUSSAGENLOGIK

1.1.4

15

Implikationen

Definition 1.2 Wenn A und B zwei Aussageformen sind, sodass A → B

eine Tautologie ist, dann schreiben wir

A⇒B

und sagen ”aus A folgt B” oder ”A impliziert B” (”A implies B”). Man

nennt A ⇒ B dann eine Implikation.

Die folgenden aussagenlogischen Gesetze bilden eine Reihe von Beispielen

dazu. Sie haben besondere Bedeutung für das logische Schließen (siehe die

beiden nächsten Teilkapitel ”Formale Systeme” und ”Beweise”):

p⇒p∨q

p∧q ⇒p

p ∧ (p → q) ⇒ q

(p → q) ∧ (q → r) ⇒ (p → r)

(p ∨ q) ∧ (p → r) ∧ (q → r) ⇒ r

Abschwächung zur Disjunktion

Abschwächung der Konjunktion

Gesetz zum ”modus ponens”

Transitivitätsgesetz

Gesetz der Fallunterscheidung

Alle diese Gesetze kann man wieder leicht mit Wahrheitstafeln beweisen.

Bemerkung zum Transitivitätsgesetz:

Statt (p → q) ∧ (q → r) schreibt man bei mathematischen Beweisen meist

einfach p → q → r. Entsprechend sind auch längere Subjunktionsketten zu

verstehen. Z.B.: p → q → r → s heißt (p → q) ∧ (q → r) ∧ (r → s). Analoges

gilt für die Implikation: A ⇒ B ⇒ C heißt z.B., dass (A → B) ∧ (B → C)

eine Tautologie ist, und daher gilt dann auch A ⇒ C.

In der ”reinen” Logik werden solche Ketten dagegen meist so interpretiert:

(p → q) → r bzw. ((p → q) → r) → s.

1.1.5

Logische Äquivalenzen

Definition 1.3 Wenn A und B zwei Aussageformen sind, sodass A ↔ B

eine Tautologie ist, so heißen sie logisch äquivalent (”logically equivalent”),

und wir schreiben

A ⇔ B.

16

KAPITEL 1. MATHEMATISCHE LOGIK

Beispiele:

a) ¬p ∨ q ⇔ p → q.

b) ”Heute regnet es nicht, oder ich bleibe zu Hause.” ist logisch äquivalent

mit ”Wenn es heute regnet, dann bleibe ich zu Hause.”.

Die folgenden aussagenlogischen Gesetze sind ebenfalls logische Äquivalenzen (Beweis mit Wahrheitstafeln).

• Kommutativität:

• Assoziativität:

p∧q ⇔q∧p

p∨q ⇔q∨p

(p ∧ q) ∧ r ⇔ p ∧ (q ∧ r)

(p ∨ q) ∨ r ⇔ p ∨ (q ∨ r)

In diesen Fällen kann man daher die Klammern weglassen.

• Distributivität:

p ∧ (q ∨ r) ⇔ (p ∧ q) ∨ (p ∧ r)

p ∨ (q ∧ r) ⇔ (p ∨ q) ∧ (p ∨ r)

(analog zum gewöhnlichen Distributivgesetz, mit ∧ an Stelle der Multiplikation und ∨ an Stelle der Addition bzw. umgekehrt)

• Absorption:

• de Morgan-Regel:

p ∧ (p ∨ q) ⇔ p

p ∨ (p ∧ q) ⇔ p

¬(p ∧ q) ⇔ ¬p ∨ ¬q

¬(p ∨ q) ⇔ ¬p ∧ ¬q

(nach Augustus de Morgan, 1806 - 1871, Cambridge/London).

• Regel für doppelte Verneinung:

¬(¬p) ⇔ p

• Kon- oder Disjunktion mit einer wahren Aussage w:

w∧a ⇔ a

w∨a ⇔ w

1.1. AUSSAGENLOGIK

17

• Kon- oder Disjunktion mit einer falschen Aussage f :

f ∧a ⇔ f

f ∨a ⇔ a

1.1.6

Normalformen

Auf Grund der folgenden logischen Äquivalenzen kann man jede Verknüpfung

von Aussagen (bzw. Aussageformen) allein mit Hilfe der Operatoren ¬ und

→ ausdrücken:

p ∧ q ⇔ ¬(p → ¬q)

p ∨ q ⇔ ¬p → q

p ↔ q ⇔ (p → q) ∧ (q → p)

Der entstehende Ausdruck heißt dann (∧, ∨, ↔)-freie Normalform.

Beispiel: (b → a) ∧ (¬b → (c ∨ a)) ⇔ (b → a) ∧ (¬b → (¬c → a)) ⇔

¬((b → a) → ¬(¬b → (¬c → a)))

Diese Normalform werden wir im Abschnitt ”Formale Systeme” verwenden.

Wie wir schon wissen, gilt p → q ⇔ ¬p ∨ q. Daher kann man jede Aussageform mit ∧, ∨ und ¬ ausdrücken. Auf Grund der de Morgan-Formeln und der

Distributivität kann man schließlich folgende Gestalt erreichen (disjunktive

Normalform):

A1 ∨ A2 ∨ . . . ∨ An

wobei jedes Ai die Form Pi,1 ∧ Pi,2 ∧ . . . ∧ Pi,ki hat und die Pi,j entweder

Aussagenvariable oder deren Negationen bezeichnen. Das ist also eine Disjunktion von Konjunktionen. Dabei kann ki auch = 1 sein, d.h. Ai kann

einfach eine Aussagenvariable oder deren Negation sein. Auch n kann = 1

sein. Dann handelt es sich nur um eine Disjunktion von Aussagenvariablen

oder Negationen davon.

Beispiel:

c → (a ∨ b) ∧ (¬a ∨ ¬b)

⇔ ¬c ∨ ((a ∨ b) ∧ (¬a ∨ ¬b))

⇔ ¬c ∨ ((a ∨ b) ∧ ¬a) ∨ ((a ∨ b) ∧ ¬b)

⇔ ¬c ∨ (a ∧ ¬a) ∨ (b ∧ ¬a) ∨ (a ∧ ¬b) ∨ (b ∧ ¬b)

⇔ ¬c ∨ (b ∧ ¬a) ∨ (a ∧ ¬b)

18

KAPITEL 1. MATHEMATISCHE LOGIK

⇔ (a ∧ ¬b) ∨ (¬a ∧ b) ∨ ¬c.

Bemerkung: Die disjunktive Normalform ist i.a. nicht eindeutig, selbst wenn

man die Bestandteile alphabetisch ordnet. So könnte man z.B. die letzte

Aussageform auch so schreiben:

(a ∧ ¬b ∧ c) ∨ (¬a ∧ b ∧ c) ∨ ¬c.

Es gibt aber eine besonders ausgezeichnete Normalform, die hier nur

an dem soeben behandelten Beispiel erklärt werden soll. Wir gehen von der

entsprechenden Wahrheitstafel aus:

a

W

W

W

W

F

F

F

F

b

W

W

F

F

W

W

F

F

c

W

F

W

F

W

F

W

F

a ∧ ¬b ¬a ∧ b

F

F

F

F

W

F

W

F

F

W

F

W

F

F

F

F

¬c

F

W

F

W

F

W

F

W

(a ∧ ¬b) ∨ (¬a ∧ b) ∨ ¬c

F

W

W

W

W

W

F

W

Wir betrachten nun die Zeilen der Wahrheitstafel, wo ganz rechts ein W

steht, und bilden nun für jede solche Zeile die Konjunktion von a, b, c oder

deren Negationen, je nachdem ob in der entsprechenden Spalte ein W oder

F steht. Schließlich bilden wir die Disjunktion aller dieser Konjunktionen:

(a∧b∧¬c)∨(a∧¬b∧c)∨(a∧¬b∧¬c)∨(¬a∧b∧c)∨(¬a∧b∧¬c)∨(¬a∧¬b∧¬c).

Es ist nicht schwer einzusehen, dass diese Aussageform zu der obigen logisch

äquivalent ist. Auf diese Weise kann man für jede nicht kontradiktorische

Aussageform eine eindeutig bestimmte ausgezeichnete disjunktive Normalform ermitteln.

Analog zur disjunktiven Normalform kann man jede logische Verknüpfung als

Konjunktion von Disjunktionen darstellen (konjunktive Normalform).

Beispiel:

(a ∧ ¬b) ∨ (¬a ∧ b) ∨ ¬c

⇔ ((a ∨ b) ∧ (¬a ∨ ¬b)) ∨ ¬c

⇔ (a ∨ b ∨ ¬c) ∧ (¬a ∨ ¬b ∨ ¬c)

Hier kann man sich ähnlich wie vorhin überlegen, dass es für jede nicht tautologische Aussageform eine ausgezeichnete konjunktive Normalform gibt, die

1.2. PRÄDIKATENLOGIK

19

eindeutig bestimmt ist. Man geht dabei von den Zeilen der Wahrheitstafel

aus, wo ganz rechts ein F steht und bildet die Konjunktion der entsprechenden Negationen. Für obiges Beispiel ergibt sich auf diese Weise:

(¬a ∨ ¬b ∨ ¬c) ∧ (a ∨ b ∨ ¬c),

also dasselbe wie vorhin, nur in umgekehrter Reihenfolge.

1.2

1.2.1

Prädikatenlogik

Einstellige Prädikate

Die Aussagenlogik reicht bei weitem nicht aus, um die für die Wissenschaft

bedeutsamen Überlegungen zu formalisieren. Z.B. kann damit der folgende

einleuchtende Schluss nicht formal begründet werden:

Aus den beiden Aussagen

”Alle Metalle leiten den elektrischen Strom.”

”Kupfer ist ein Metall.”

folgt

”Kupfer leitet den elektrischen Strom.”

Die Prädikatenlogik (”predicate calculus”) stellt nun eine Erweiterung der

Aussagenlogik dar, in der nicht nur der Wahrheitswert, sondern auch die

Struktur von Aussagen berücksichtigt wird, indem man Subjekt und Prädikat

unterscheidet. In der Aussage ”Kupfer ist ein Metall.” ist zum Beispiel

s = ”Kupfer” das Subjekt und P = ”ist ein Metall” das Prädikat. Diese

Aussage schreiben wir dann so: P (s).

Wenn P irgendein Prädikat und s irgendein Subjekt ist, so bedeutet P (s),

dass das Prädikat P auf das Subjekt s zutrifft. P gibt also so etwas wie eine

Eigenschaft an.

Bei der ersten der obigen Aussagen kommt noch etwas für den logischen

Schluss Wesentliches hinzu: das Wort ”alle”. Etwas umständlicher könnten

wir die Aussage auch so formulieren:

”Für alle x gilt:

Wenn x ein Metall ist, dann leitet x den elektrischen Strom.”

20

KAPITEL 1. MATHEMATISCHE LOGIK

Bezeichnen wir die Prädikate ”ist ein Metall” und ”leitet den elektrischen

Strom” mit M bzw. S und kürzen wir ”für alle x gilt” mit ∀x ab, so lautet

die Aussage:

(∀x) (M(x) → S(x)).

Das Zeichen ∀ heißt Allquantor (”universal quantifier”). Von gleicher Bedeutung ist der Existenzquantor ∃ (”existential quantifier”): ∃x heißt ”es gibt

(mindestens) ein x, sodass”. Bezeichnet z.B. P das Prädikat ”ist Primzahl”,

so ist folgende Aussage wahr, da es bekanntlich unendlich viele Primzahlen

gibt:

(∃x) (P (x) ∧ (x > 1010 )).

Etwas kürzere Schreibweise: ∀x : M(x) → S(x) bzw. ∃x : P (x) ∧ (x > 1010 ).

Viele mathematische Aussagen enthalten sowohl Existenz- als auch Allquantoren. Sei z.B. N das Prädikat ”ist eine natürliche Zahl”. Dann gilt:

(∀n) (N(n) → (∃x)(P (x) ∧ (x > n)))

(in Worten: Zu jeder natürlichen Zahl n gibt es eine Primzahl, die größer als

n ist).

Existenz- und Allquantor werden zusammen als Quantoren bezeichnet.

V

Andere Schreibweise für die Quantoren: Statt ∀x schreibt man auch , statt

x

W

∃x auch .

x

Ein Symbol, das nach einem Quantor steht, heißt gebundene Variable

(”bound variable”). Dadurch kommt zum Ausdruck, dass man dafür nicht

etwas anderes einsetzen darf, also z.B. eine Aussage oder eine Zahl. Es ist

nur eine Umbenennung des Symbols erlaubt: (∃x)P (x) bedeutet dasselbe wie

(∃y)P (y). ”Echte” Variable, wie wir sie z.B. bei Aussageformen besprochen

haben, werden zum Unterschied als freie Variable (”free variable”) bezeichnet.

Manchmal möchte man ausdrücken, dass es genau ein x mit einer bestimmten

Eigenschaft P gibt (und nicht mehrere). Man schreibt dafür

(∃!x) P (x).

Das ist eigentlich eine Abkürzung für

(∃x)(P (x) ∧ (∀x0 )(P (x0 ) → x0 = x)).

1.2. PRÄDIKATENLOGIK

21

Der Beweis einer solchen Aussage besteht daher meist aus zwei Teilen:

1. Existenz, 2. Eindeutigkeit.

Beispiel: (∃!x)(N(x) ∧ x2 = 9), wobei N dieselbe Bedeutung wie vorhin hat.

Existenz: Sei x = 3. Dann ist x2 = 9.

Eindeutigkeit: Sei x0 eine natürliche Zahl mit x02 = 9. Dann folgt auf Grund

der bekannten Eigenschaften der natürlichen Zahlen leicht: x0 = 3 (siehe

Kapitel 5.1).

Eine genaue Darstellung der Prädikatenlogik geht über den Rahmen dieses

Buches weit hinaus (siehe z.B. [9]). In großen Teilen der Mathematik wird nur

die Schreibweise der Prädikatenlogik verwendet, um mathematische Sachverhalte klar ausdrücken zu können. Darüber hinaus ist es nützlich, die folgenden

Regeln zu kennen. Diese erleichtern oft die Formulierung der Negation einer

komplizierteren Aussage, wie man sie etwa beim indirekten Beweis braucht.

(Siehe Abschnitt 1.4.1.)

Negation einer All- bzw. Existenzaussage:

¬(∀x)P (x) ⇔ (∃x) (¬P (x))

¬(∃x)P (x) ⇔ (∀x)(¬P (x))

(Die zweite Formel entsteht aus der ersten durch Negation und Vertauschung

von linker und rechter Seite.)

Das Zeichen ”⇔” bedeutet hier, dass es sich um eine Bijunktion handelt,

die für jedes beliebige Prädikat P wahr ist. Wir sprechen wieder von einer

logischen Äquivalenz.

Die erste Formel lautet in Worten: ”Nicht alle x haben die Eigenschaft P .”

ist gleichbedeutend mit ”Es gibt ein x, das die Eigenschaft P nicht hat.”.

Die zweite Formel könnte man etwa so ausdrücken: ”Es gibt kein x mit der

Eigenschaft P .” ist gleichbedeutend mit ”Alle x haben die Eigenschaft ¬P .”.

Liest man diese Formeln von rechts nach links, so sieht man, dass der Existenzquantor durch den Allquantor und umgekehrt ausgedrückt werden kann.

Ersetzt man P (x) durch P (x) → Q(x), so erhält man:

¬(∀x)(P (x) → Q(x)) ⇔ (∃x)(P (x) ∧ ¬Q(x)).

Konkrete Beispiele dafür:

22

KAPITEL 1. MATHEMATISCHE LOGIK

• Sei P = ”ist Österreicher” und Q = ”ist deutschsprachig”. Dann ergibt

sich: ”Nicht alle Österreicher sind deutschsprachig.” ist gleichbedeutend

mit ”Es gibt mindestens einen Österreicher, der nicht deutschsprachig

ist.”.

• Sei P (x) = ”x ist eine gerade natürliche Zahl ≥ 4” und Q(x) = ”x ist

Summe zweier Primzahlen”. Dann erhalten wir mit der Negation der

letzten Formel zwei äquivalente Formulierungen der berühmten Goldbach’schen Vermutung: ”Jede gerade natürliche Zahl ≥ 4 ist Summe

zweier Primzahlen.” und ”Es gibt keine gerade natürliche Zahl ≥ 4, die

nicht Summe zweier Primzahlen ist.”. (Christian Goldbach, 1690-1764,

war eigentlich Jurist, hatte aber mit führenden Mathematikern seiner

Zeit brieflichen Kontakt, insbesondere mit Leonhard Euler.)

Ersetzt man in der letzten Formel Q(x) durch Q(x) ∧ R(x) bzw. Q(x) ∨ R(x),

so ergibt sich:

¬(∀x)(P (x) → Q(x) ∧ R(x)) ⇔ (∃x)(P (x) ∧ (¬Q(x) ∨ ¬R(x)))

¬(∀x)(P (x) → Q(x) ∨ R(x)) ⇔ (∃x)(P (x) ∧ (¬Q(x) ∧ ¬R(x)))

Als Negation einer Allaussage erhält man also eine Existenzaussage, bei der

∧ und ∨ vertauscht und die einzelnen Teilaussagen negiert sind.

Beispiele:

• Die Negation von ”Alle Schweden sind groß und blond” ist ”Es gibt

(mindestens) einen Schweden, der nicht groß oder nicht blond ist”.

• Die Negation von ”Für alle linearen Gleichungssysteme ist die Anzahl

der Lösungen ≤ 1 oder unendlich.” lautet ”Es gibt ein lineares Gleichungssystem, dessen Lösungsanzahl > 1 und endlich ist.” (Welche

dieser beiden Aussagen wahr ist, hängt davon ab, ob der zugrundeliegende

Körper endlich oder unendlich ist; siehe Vorlesungen oder Bücher über

Lineare Algebra, z.B. [21].)

1.2.2

Mehrstellige Prädikate

Mehrstellige Prädikate drücken Beziehungen zwischen zwei oder mehr Subjekten bzw. Objekten aus.

Beispiele:

1.2. PRÄDIKATENLOGIK

23

a) Sei P das Prädikat ”ist verheiratet mit”. Dann steht P (x, y) für den Satz

”x ist mit y verheiratet”. In diesem Fall handelt es sich um eine symmetrische

Beziehung: (∀x)(∀y)(P (x, y) ↔ P (y, x)).

Kürzere Schreibweise: ∀x, y : P (x, y) ↔ P (y, x).

b) Sei T = ”ist Teiler von”. Das ist eine nichtsymmetrische Beziehung. Es

gilt aber folgende Transitivität: (∀x)(∀y)(∀z) (T (x, y) ∧ T (y, z) → T (x, z)).

(Genau genommen bedeutet hier T (x, y) ”x und y sind natürliche Zahlen,

und x ist ein Teiler von y”.)

c) Sei P (x, y, z) = (x < y) ∧ (y < z). Dafür schreibt man meist kürzer:

x < y < z.

Weiters sei Z(x, y, z) = ”y liegt zwischen x und z” und N (x) = ”x ist eine

natürliche Zahl”. Dann gilt:

(∀x)(∀y)(∀z) (N(x) ∧ N(y) ∧ N(z) → (Z(x, y, z) ↔ P (x, y, z) ∨ P (z, y, x))).

1.2.3

Bemerkungen zur Implikation

Seien A und B zwei Aussagen, in denen eine oder mehrere freie Variablen

x, y, . . . vorkommen. Dann bedeutet

A ⇒ B,

dass

(∀x)(∀y) . . . A → B.

Man nennt das wieder eine Implikation (vgl. Definition 1.2) und sagt wieder

”aus A folgt B” oder ”A impliziert B”. In analoger Weise verwendet man

auch das Zeichen ⇔.

Häufig wird eine der folgenden Ausdrucksweisen für A ⇒ B verwendet:

”A ist hinreichend (”sufficient”) für B” (oder: ”A ist eine hinreichende

Bedingung für B”),

”B ist notwendig (”necessary”) für A” (oder ”B ist eine notwendige Bedingung für A”).

Beispiele:

1) Sei U = ”a und b sind ungerade ganze Zahlen”, und G = ”a + b ist eine

gerade ganze Zahl”. Dann ist U hinreichend für G, denn es gilt U ⇒ G.

24

KAPITEL 1. MATHEMATISCHE LOGIK

Aber U ist keine notwendige Bedingung für G, da auch die Summe von zwei

geraden Zahlen wieder gerade ist.

2) Sei P = ”x ist eine mehrstellige Primzahl” und E = ”Die Einerstelle von

x ist entweder 1, 3, 7 oder 9”.

Es gilt P ⇒ E, denn wenn die Einerstelle von x eine gerade Zahl ist, so

ist auch x gerade, und wenn die Einerstelle gleich 5 ist, dann ist x durch 5

teilbar. E ist also eine notwendige Bedingung dafür, dass x eine mehrstellige

Primzahl ist. E ist jedoch nicht hinreichend: z.B. ist 21 keine Primzahl.

3) Sei D = ”x ist durch 3 teilbar” und Z = ”Die Ziffernsumme von x ist

durch 3 teilbar”. Dann gilt D ⇔ Z, das heißt Z ist eine notwendige und

hinreichende Bedingung für D.

1.3

Formale Systeme

Mathematische Theorien können als ”formale Systeme” aufgefasst werden.

(Andere Bezeichnungen: ”Kalkül”, ”Kodifikat”.)

Definition 1.4 Ein formales System (”formal system”) besteht aus

• Symbolen (”symbols”),

• zulässigen Ausdrücken (engl. ”well-formed formulas”),

• Axiomen (”axioms”),

• Ableitungsregeln (”rules of inference”).

Dabei versteht man unter einem Ausdruck endlich viele hintereinander

geschriebene Symbole.

Es muss klargestellt sein, welche Symbole verwendet werden dürfen und

welche Ausdrücke zulässig sind.

Die Axiome sind ganz bestimmte zulässige Ausdrücke, von denen man ausgeht.

Die Ableitungsregeln geben an, wie man von einem oder mehreren Ausdrücken zu einem neuen Ausdruck übergehen kann.

1.3. FORMALE SYSTEME

25

Schreibweise:

A1 , . . . , An

A

Das heißt: Von A1 , . . . , An kann man zu A übergehen. Wenn das formale

System etwas mit logischem Schließen zu tun hat, dann betrachtet man die

Axiome als ”wahr” und sagt statt ”zu A übergehen” auch ”auf A schließen”.

Wenn man einen Ausdruck aus den Axiomen mit Hilfe der Ableitungsregeln

erhalten kann, so nennt man diesen Ausdruck Satz, Theorem oder ableitbarer Ausdruck. Die dabei auftretenden Zwischenschritte ergeben zusammen etwas, was man einen formalen Beweis oder auch eine Ableitung oder

Herleitung (”deduction”) des Satzes nennt:

Definition 1.5 Ein formaler Beweis (”formal proof”) eines zulässigen

Ausdrucks S ist eine Folge von zulässigen Ausdrücken A1 , . . . , An−1 , An mit

An = S, sodass sich jeder Ausdruck aus den Axiomen und den vorhergehenden Ausdrücken auf Grund der Ableitungsregeln des Systems ergibt. [11]

Bemerkung: Für ”S ist ein ableitbarer Ausdruck” schreibt man auch: ` S.

Beispiele:

a) Das ”pg-System” [18]:

Symbole: p, g, -

(Die Beistriche gehören nicht zu den Symbolen.)

zulässige Ausdrücke: alle Zeichenketten der Form X p Y g Z, wobei X,Y,Z

Platzhalter für einen oder mehrere Striche - sind.

Axiom: - p - g - Ableitungsregeln:

1)

XpYgZ

XpY-gZ-

2)

XpYgZ

X-pYgZ-

Beispiel für einen Satz: - - p - - - g - - - - Ein formaler Beweis dieses Satzes:

Axiom: - p - g - -

26

KAPITEL 1. MATHEMATISCHE LOGIK

Regel 1): - p - - g - - nochmals Regel 1): - p - - - g - - - Regel 2): - - p - - - g - - - - -

Dieses System besitzt eine einfach zu erkennende Interpretation:

X p Y g Z kann man als X + Y = Z interpretieren, wenn man eine Folge von

n Strichen mit der Zahl n identifiziert.

b) Viele Spiele lassen sich als formale Systeme auffassen, z.B. das Schachspiel:

Symbole: a,b,c,d,e,f,g,h,1,2,3,4,5,6,7,8,T,S,L,D,K,W,B

zulässige Ausdrücke: alle Symbolfolgen, die eine ”Stellung” beschreiben (lässt

sich relativ leicht formalisieren);

Axiom: die Anfangsstellung

Wa2b2c2d2e2f2g2h2Ta1Sb1Lc1Dd1Ke1Lf1Sg1Th1

Ba7b7c7d7e7f7g7h7Ta8Sb8Lc8Dd8Ke8Lf8Sg8Th8

Ableitungsregeln: Sämtliche Regeln des Schachspiels, entsprechend formalisiert.

”Sätze”: alle Stellungen, die unter Beachtung der Regeln zustandekommen

können.

Beweis eines ”Satzes”: Eine Folge von Stellungen, die von der Ausgangsstellung zu dem betrachteten ”Satz” führt.

Hauptprobleme: Wie kann man feststellen, ob ein gegebener zulässiger

Ausdruck ein Satz ist? Wie findet man einen Beweis zu einem gegebenen

Satz?

Im pg-System ist das kein Problem: XpYgZ ist genau dann ein Satz, wenn die

Anzahl der Striche in X plus die Anzahl der Striche in Y gleich der Anzahl

der Striche in Z ist. Auch die Beweise sind im pg-System sehr einfach, wie

wir an obigem Beispiel gesehen haben.

Bemerkung: Wenn man bereits einen oder mehrere Sätze bewiesen hat, dann

kann man diese natürlich zur Herleitung eines weiteren Satzes benützen; man

muss nicht immer bis zu den Axiomen zurückgehen.

1.3. FORMALE SYSTEME

27

Wir interessieren uns natürlich hauptsächlich für formale Systeme, die für

die Mathematik und/oder Informatik von Bedeutung sind.

1.3.1

Die Aussagenlogik als formales System

Die Aussagenlogik ist ein wichtiges Beispiel für ein formales System. Um mit

möglichst wenigen Axiomen und Schlussregeln auszukommen, betrachten wir

die (∧, ∨, ↔)-freie Form.

Symbole:

Kleinbuchstaben mit oder ohne Indizes (diese stehen für (elementare) Aussagen), sowie die Zeichen ¬, →, (, ).

Zulässige Ausdrücke:

a) Aussagesymbole.

b) Wenn P und Q zulässige Ausdrücke sind, dann sind auch (P ), (¬P )

und (P → Q) zulässige Ausdrücke.

Alle Verknüpfungen von Elementaraussagen stellen also zulässige Ausdrücke

dar. Zur Vereinfachung der Schreibweise vereinbart man, dass äußerste Klammern weggelassen werden können, und dass ¬ stärker als → bindet.

Axiome:

Seien P, Q, R zulässige Ausdrücke.

1. P → (Q → P )

2. (P → (Q → R)) → ((P → Q) → (P → R))

3. (¬Q → ¬P ) → (P → Q)

28

KAPITEL 1. MATHEMATISCHE LOGIK

Ableitungsregel:

P, P → Q

Q

Das bedeutet: Von den beiden Aussagen P und P → Q kann man auf Q

schließen. Diese Regel heißt modus ponens.

Wenn man die Verknüpfungen dieses formalen Systems so interpretiert, wie

wir es im Abschnitt ”Aussagenlogik” getan haben, so sieht man mit Hilfe der

Wahrheitstafeln, dass jeder Satz dieses Systems eine Tautologie ist: die Axiome sind Tautologien, und die Ableitungsregel liefert aus zwei Tautologien

wieder eine Tautologie.

Man kann sogar zeigen, dass in diesem System jede Tautologie ableitbar ist.

(Das ist die sogenannte ”Vollständigkeit” des Aussagenkalküls, siehe z.B.

[24].) Überdies ist es möglich, relativ leicht (eventuell maschinell) für jeden

gegebenen Ausdruck zu entscheiden, ob er ein Satz ist. Im Allgemeinen ist

die Situation nicht so einfach!

Die konkrete Herleitung eines Satzes ist allerdings schon für einfache Beispiele

oft recht mühsam.

Beispiel: Herleitung von a → a:

Axiom 1 mit P = a und Q = (b → a) ergibt a → ((b → a) → a).

Axiom 2 mit P = a, Q = (b → a) und R = a ergibt (a → ((b → a) → a)) →

((a → (b → a)) → (a → a)).

Nach dem modus ponens können wir auf (a → (b → a)) → (a → a) schließen.

Axiom 1: a → (b → a).

Nochmalige Anwendung des modus ponens ergibt daher a → a.

1.3.2

Die Prädikatenlogik als formales System

Die genaue Beschreibung ist sehr kompliziert und wird hier nicht durchgeführt. Die Axiome der Prädikatenlogik enthalten jedenfalls die Axiome der

Aussagenlogik. Ableitungsregeln sind u.a. der modus ponens und folgende

Regel [4]:

(∀x)P (x)

P (a)

1.4. BEWEISE

29

D.h. also: Wenn P (x) für alle x wahr ist, dann kann man in P (x) für x etwas beliebiges einsetzen, z.B. a, und man erhält eine wahre Aussage. Damit

können wir jetzt z.B. den zu Beginn des Abschnitts ”Prädikatenlogik” formulierten Schluss formalisieren:

Seien M, S die Prädikate ”ist ein Metall” bzw. ”leitet Strom”, und k sei das

Subjekt ”Kupfer”. Dann schließen wir so:

(∀x)(M(x) → S(x))

M(k) → S(k)

Mit dem modus ponens erhalten wir die gewünschte Aussage:

M(k), M(k) → S(k)

.

S(k)

1.4

Beweise

Man kann jede mathematische Theorie als formales System auffassen, das

die Aussagen- und Prädikatenlogik umfasst. Ein Beweis eines Satzes S ist

dann eine Folge von zulässigen Ausdrücken A1 , . . . , An−1 , An mit An = S,

sodass sich jeder Ausdruck aus den Axiomen und den vorhergehenden Ausdrücken auf Grund der Ableitungsregeln des Systems ergibt. Man braucht

dabei natürlich nicht bei jedem Satz wieder von vorne anzufangen, sondern

kann auf bereits bewiesene Sätze zurückgreifen.

In der Praxis werden mathematische Beweise allerdings fast nie im Sinne

eines formalen Beweises angegeben, da dies in den meisten Fällen viel zu

kompliziert und auch für den Leser schwer durchschaubar wäre. Mathematische Beweise dienen u.a. dazu,

1. sich selbst zu überzeugen, dass man richtig überlegt hat;

2. die wesentlichen Ideen, die der Beweis enthält, zu vermitteln;

3. andere Mathematiker zu überzeugen, dass es prinzipiell möglich ist,

diese Ideen zu einem formalen Beweis auszubauen;

4. den inneren Aufbau und die Zusammenhänge zwischen den Sätzen einer

Theorie verständlich zu machen.

In Vorlesungen und Lehrbüchern kommt noch ein weiterer wichtiger

Zweck hinzu:

30

KAPITEL 1. MATHEMATISCHE LOGIK

5. den Studierenden die mathematische Denkweise nahezubringen und sie

dadurch zu befähigen, mathematische Literatur zu verstehen und selbständig mathematische Probleme zu lösen.

In Hinblick auf die Informatik sind zusätzlich folgende Aspekte von

Bedeutung:

6. Beweise führen oft zu programmierbaren Verfahren (Algorithmen);

7. Abschätzungen von Rechenzeit- und Speicherplatzbedarf erfordern oft

mathematische Beweistechniken;

8. in vielen Fällen ist es nötig oder wünschenswert, die Korrektheit eines

Programms zu beweisen und nicht nur durch Tests abzusichern;

9. und gerade deswegen ist das automatische Beweisen ein wichtiges Teilgebiet der Informatik, zu dessen Verständnis man mit der Natur mathematischer Beweise vertraut sein muss.

Sprache und Symbolik der Logik dienen oft dazu, größere Klarheit zu erreichen, auch wenn man keinen formalen Beweis angeben will.

Für die Praxis ist wichtig, dass man für das Finden eines Beweises oft

ein großes Maß an Intuition (anschauliches oder gefühlsmäßiges Erkennen)

und Vorstellungsvermögen braucht, der Beweis selbst aber unabhängig von

solchen Dingen sein muss.

1.4.1

Indirekter Beweis

Viele Sätze haben die Form P → Q. Man nennt dann P die Voraussetzung

(”premise”) und Q die Behauptung (”conclusion”). Um einen solchen Satz

zu beweisen, ist es oft einfacher, ”indirekt” zu schließen.

Es gibt zwei Varianten des indirekten Beweises:

a) Man beweist (direkt) den Satz ¬Q → ¬P . Auf Grund des Axioms

(¬Q → ¬P ) → (P → Q) kann man daraus mit dem modus ponens auf

P → Q schließen.

b) Man zeigt, dass sich aus P ∧ ¬Q ein Widerspruch ergibt (”proof by contradiction”). Genauer: man beweist

(P ∧ ¬Q) → (R ∧ ¬R)

1.4. BEWEISE

31

für eine bestimmte Aussage R. Nun ist aber folgende Aussage eine

Tautologie, wie man mit einer Wahrheitstafel leicht nachprüfen kann:

((P ∧ ¬Q) → (R ∧ ¬R)) → (P → Q)

Da im System der Aussagenlogik jede Tautologie ableitbar ist, können

wir mit dem modus ponens auf P → Q schließen.

Die Negation der Behauptung, hier ¬Q, nennt man oft indirekte Annahme. Bei einem indirekten Beweis leitet man also aus der indirekten

Annahme einen Widerspruch zur Voraussetzung her.

Beispiele kommen in den nächsten Kapiteln immer wieder vor (z.B. Beweis

von Satz 3.20 und Beweis der Eindeutigkeit bei Satz 5.9).

1.4.2

Beweis durch Fallunterscheidung

Wenn sich P in der Form V1 ∨ V2 darstellen lässt, so kann man den Satz

P → Q beweisen, indem man statt dessen die beiden Sätze V1 → Q und

V2 → Q beweist, denn es gilt

(V1 → Q) ∧ (V2 → Q) ⇒ ((V1 ∨ V2 ) → Q),

was man wieder mit einer Wahrheitstafel überprüfen kann. Wenn P eine

Disjunktion von drei oder mehr Voraussetzungen ist, geht es natürlich analog.

Beispiel 1.6 Für jede natürliche Zahl x ist die Zahl x3 + x gerade.

Sei dazu N = ”ist eine natürliche Zahl”, G = ”ist eine gerade natürliche

Zahl” und U = ”ist eine ungerade natürliche Zahl”. N (x) bedeutet also

dasselbe wie G(x) ∨ U (x). Zum Beweis von N(x) ⇒ G(x3 + x) (das heißt:

(∀x)(N(x) → G(x3 + x)) ) gehen wir daher so vor:

1. Fall: x gerade. D.h. wir wollen zeigen: G(x) ⇒ G(x3 + x).

Beweis: G(x) heißt (∃k)(N(k) ∧ x = 2k). Daher gilt mit so einem k:

x3 + x = (2k)3 + (2k) = 8k3 + 2k = 2(4k3 + k),

und wir sehen, dass x3 + x gerade ist.

2. Fall: x ungerade. Zu zeigen: U (x) ⇒ G(x3 + x).

32

KAPITEL 1. MATHEMATISCHE LOGIK

Beweis: U(x) heißt (∃k)(N(k) ∧ x = 2k − 1). Daher:

x3 + x = (2k − 1)3 + (2k − 1) = 8k 3 − 3 · 4k2 + 3 · 2k − 1 + 2k − 1 =

2(4k3 − 6k2 + 4k − 1),

und wir sehen wieder, dass x3 + x gerade ist.

(Das Zeichen

zeigt das Ende eines Beweises an.)

Manchmal verläuft der Beweis für zwei oder mehrere Fälle völlig analog.

Dann führen wir den Beweis nur für einen Fall durch und sagen etwa: ”Ohne

Beschränkung der Allgemeinheit (kurz: O.B.d.A.) können wir annehmen,

dassdieser Fall vorliegt.”.

Bevor wir uns ein typisches Beispiel ansehen, noch eine einfache, aber wichtige

Definition.

Definition 1.7 Sei x eine reelle Zahl.

½

x

falls x ≥ 0,

|x| :=

−x

falls x < 0.

|x| heißt der (absolute) Betrag (engl. ”absolute value”) von x.

Wir setzen hier die reellen Zahlen als bekannt voraus. Wir könnten uns aber

auch auf die ganzen oder rationalen Zahlen beschränken (siehe Abschnitte

2.4, 5.4 und 5.6).

Bemerkung: Durch Fallunterscheidung sieht man sofort, dass für alle reellen

Zahlen x gilt: x ≤ |x| und −x ≤ |x| .

Jetzt zu einem Beispiel für ”o.B.d.A.”:

Beispiel 1.8 Für beliebige reelle Zahlen x, y gilt

|x − y| ≤ |x| + |y| .

(”Dreiecksungleichung”)

Beweis:

Auf Grund der Definition des absoluten Betrages ist es naheliegend, folgende

zwei Fälle zu unterscheiden:

1.5. ÜBUNGSAUFGABEN

33

1. x − y ≥ 0, d.h. x ≥ y.

2. x − y < 0, d.h. x < y.

Da es nichts schadet, wenn wir den Fall x−y = 0 zweimal behandeln, können

wir als 2. Fall auch x − y ≤ 0 nehmen. Dann geht der Beweis aber in beiden

Fällen völlig analog, es werden nur die Rollen von x und y vertauscht. Wir

sagen daher: Sei o.B.d.A. x ≥ y. Dann ist |x − y| = x−y = x+(−y) ≤ |x|+|y|

auf Grund der vorhergehenden Bemerkung.

Die folgende einfache Regel für den absoluten Betrag kann man ebenso leicht

beweisen (Übungsaufgabe 10):

|xy| = |x||y|.

1.5

Übungsaufgaben

1. Stellen Sie die folgenderweise definierte logische Operation ¤ zunächst

mit Hilfe von ¬ und ∧ dar, und dann mit Hilfe von ¬ und →:

p

W

W

F

F

q

W

F

W

F

p¤q

F

F

F

W

Wie könnte man diese Operation sprachlich ausdrücken?

2. Beweisen Sie mit Hilfe von Wahrheitstafeln die folgenden aussagenlogischen Gesetze:

a) (p ∨ q) ∧ ¬p ⇒ q

b) (p → q) ∧ (q → r) ⇒ (p → r)

c) p ⇒ (q → p)

3. Überprüfen Sie mit Hilfe von Wahrheitstafeln die folgenden logischen

Äquivalenzen auf ihre Richtigkeit:

a) p → q ⇔ p ∧ ¬q → ¬p

b) p → q ⇔ ¬p → ¬q

c) (p ∧ ¬q) → (r ∧ ¬r) ⇔ p → q

(Prinzip des indirekten Beweises)

Wenn eine dieser Formeln nicht stimmt, versuchen Sie eine ähnliche

gültige Formel zu finden.

34

KAPITEL 1. MATHEMATISCHE LOGIK

4. Bestimmen Sie alle drei Normalformen für

a) (p → q) ∧ (r → s),

b) p → (q → s).

5. Formulieren Sie die Negationen der folgenden Aussagen so, dass kein

Negationszeichen vor einer Klammer steht:

a) (¬p ∧ q) ∨ (q → r),

b) ((p → q) → r) → (p ∨ q).

6. Beweisen Sie das Gesetz zum Modus ponens: p ∧ (p → q) ⇒ q.

7. Formulieren Sie in geeigneter Weise die Negationen der folgenden Aussagen:

a) (∀a)(∃b)(P (x, b) → Q(x, a)),

b) ∃x : (R(x) ∧ (∀y)(P (x, y)),

c) Es gibt eine Konstante c > 0, sodass für alle natürlichen Zahlen m

die Ungleichung K(m, a) > c · m1−a gilt.

d) Zu jedem ε > 0 gibt es eine Zahl δ > 0, sodass für alle Zahlen x mit

|x| < δ die Beziehung |P (x)| < ε gilt.

8. Studieren Sie das folgende formale System:

Symbole: a, b.

Zulässige Ausdrücke: Alle Zeichenketten, die sich aus den Symbolen

bilden lassen.

Axiom: a.

Ableitungsregeln:

XaY

XbaY

,

XaY

XaaY

,

wobei X, Y Platzhalter für irgendwelche Zeichenketten sind (eventuell

auch leer).

Welche Ausdrücke lassen sich ableiten?

9. Leiten Sie im formalen System der Aussagenlogik die folgende Formel

ab:

¬q → (q → p)

(Überlegen Sie sich dazu folgenden ”Hilfssatz”:

Wenn (im formalen System der Aussagenlogik) P → Q und Q → R

ableitbar sind, dann ist auch P → R ableitbar.)

10. Beweisen Sie |xy| = |x||y| für beliebige reelle Zahlen x, y.

Kapitel 2

Mengen

Man kann die Mengenlehre als formales System definieren und behandeln.

Das ist aber sehr kompliziert. Hier wird die Mengenlehre ”naiv” dargestellt,

d.h. wir ignorieren die subtilen Schwierigkeiten, die sich bei der exakten formalen Behandlung ergeben (siehe z.B. [14]). Wir verwenden aber dennoch,

soweit sinnvoll, Schreibweise und Formeln der mathematischen Logik.

Eine Menge (engl. ”set”) ist eine Zusammenfassung von Objekten, welche

die Elemente der Menge genannt werden. Wesentlich dabei ist, dass für

jedes Objekt eindeutig feststellbar sein muss, ob es ein Element der Menge

ist oder nicht.

x ∈ M bedeutet: ”x ist ein Element der Menge M”. Man sagt dafür auch

kurz ”x aus M” oder ”x in M”.

Statt ¬(x ∈ M) schreibt man meist x ∈

/ M.

Die Anzahl der Elemente einer Menge M bezeichnen wir mit |M| . Man nennt

|M| auch die Kardinalzahl (”cardinality”) von M und schreibt dafür auch

card M oder #M.

2.1

Beschreibung von Mengen

Zur Beschreibung von Mengen werden vor allem die folgenden zwei Möglichkeiten verwendet:

35

36

KAPITEL 2. MENGEN

a) durch Aufzählen ihrer Elemente:

Die Elemente der Menge werden, durch Beistriche getrennt, aufgeschrieben,

und das Ganze wird mit geschwungenen Klammern eingeschlossen. Das ist

vor allem für Mengen mit wenigen Elementen geeignet, z.B.: M = {2, 3, 5, 8}.

Einige wesentliche Aspekte dabei:

• Es kommt nicht auf die Reihenfolge der Elemente an:

{1, 3, 2} = {1, 2, 3}.

• Mehrfach vorkommende Elemente zählen nur einfach:

{1, 3, 1, 2, 2, 1} = {1, 2, 3} = {1, 1, 1, 2, 3, 3}

• Die Elemente einer Menge können selbst wieder Mengen sein:

A = {1, 2, 3, {1, 2}, {1, 3}, 4, 5, {1}, 7}.

Wenn alle Elemente von A Mengen sind, dann nennt man A auch eine

Familie von Mengen.

Eine Menge {a} mit nur einem Element a heißt auch Einermenge (von a)

(”singleton”). Sie darf nicht mit dem Element a verwechselt werden.

Eine besondere Menge ist die leere Menge (”empty set”). Sie enthält kein

Element. Bezeichnung: ∅, manchmal auch {}.

Bei Mengen mit vielen Elementen werden die Elemente oft unter Zuhilfenahme von ” . . . ” aufgezählt. Das ist allerdings nur sinnvoll, wenn kein Zweifel

über die ausgelassenen Elemente besteht.

Beispiele:

a) Mengen von aufeinanderfolgenden natürlichen Zahlen:

{1, 2, . . . , 100}, {1, . . . , n}.

b) Mengen mit leicht erkennbarem Bildungsgesetz, auch mit unendlich vielen

Elementen:

{3, 6, 9, 12, . . .}.

2.2. TEILMENGEN

37

b) durch Angabe einer charakteristischen Eigenschaft:

Sei P ein einstelliges Prädikat. Dann bedeutet {x | P (x)} die Menge aller x,

für die P (x) wahr ist. Andere Schreibweise: {x : P (x)}.

Beispiele:

a) N = {x | x ist eine natürliche Zahl} = {1, 2, 3, . . .}.

b) {x | x ∈ N ∧ (∃k ∈ N)(x = 3k)} = {3, 6, 9, 12, . . .}.

(Kurzschreibweise: { 3k | k ∈ N }.)

2.2

Teilmengen

Definition 2.1 Seien A und B Mengen. A heißt Teilmenge (”subset”) von

B, wenn jedes Element von A auch Element von B ist. Bezeichnung: A ⊂ B.

In formaler Schreibweise:

A ⊂ B :⇔ (∀x)(x ∈ A → x ∈ B).

(Der Doppelpunkt vor dem Äquivalenzzeichen bedeutet, dass die linke Seite

durch die rechte Seite definiert wird.)

Die durch das Zeichen ⊂ ausgedrückte Beziehung heißt auch Inklusion. Für

A ⊂ B sagt man auch ”A ist in B enthalten”. (Für das Zeichen ∈ sollte man

dann aber nicht das Wort ”enthalten” verwenden!)

Zu den Teilmengen einer Menge B zählen auch ∅ und B selbst, denn die

Aussagen x ∈ ∅ → x ∈ B und x ∈ B → x ∈ B sind für alle x wahr (siehe

Abschnitt 1.1.1). Die von B verschiedenen Teilmengen von B werden auch

echte Teilmengen (”proper subsets”) genannt.

Andere Bezeichnungsweise: Oft verwendet man das Symbol ”⊂” nur für echte

Teilmengen und bezeichnet die allgemeine Inklusion dann mit ”⊆”.

Definition 2.2 Die Menge aller Teilmengen von A heißt Potenzmenge

(”power set”) von A. Bezeichnung: P(A).

38

KAPITEL 2. MENGEN

Wir können auch sagen: Die Potenzmenge von A ist die Familie aller Teilmengen von A.

Beispiel: P({1, 2, 3}) = {∅, {1}, {2}, {3}, {1, 2}, {1, 3}, {2, 3}, {1, 2, 3}}.

Wir sehen, dass die Potenzmenge einer Menge mit 3 Elementen 8 Elemente

hat, und 8 = 23 . Wir werden uns später überlegen (Satz 7.19), dass allgemein

gilt: |P(A)| = 2|A| . Das erklärt den Namen ”Potenzmenge”.

Zwei Mengen sind gleich, wenn sie dieselben Elemente haben. Das heißt:

A = B ⇔ (A ⊂ B) ∧ (B ⊂ A).

Die Gleichheit von zwei komplizierteren Mengen A, B wird oft dadurch bewiesen, dass man zuerst A ⊂ B und dann B ⊂ A zeigt.

Sei M eine Menge und P ein Prädikat. Dann ist {x | x ∈ M ∧ P (x)} die

Teilmenge von M, die aus allen Elementen besteht, für die P (x) wahr ist.

Dafür schreibt man meist kürzer:

{x ∈ M | P (x)}.

Beispiel: {x ∈ N | x > 10} = {11, 12, 13, . . .}.

2.3

Mengen und Quantoren

In der Mathematik kommen oft Aussagen vor, die eine der beiden folgenden

Formen haben:

”Für alle x aus M gilt P (x).”, ”Es gibt ein x aus M, sodass P (x) gilt.”. Die

folgende Tabelle enthält rechts die formale Schreibweise für diese Aussagen

und links eine äquivalente kürzere Form, die von den meisten Mathematikern

bevorzugt wird.

(∀x ∈ M) P (x)

:⇔

(∀x)(x ∈ M → P (x))

(∃x ∈ M) P (x)

:⇔

(∃x)(x ∈ M ∧ P (x))

Andere Variante: ∀x ∈ M : P (x) bzw. ∃x ∈ M : P (x).

Beispiele: Sei N die Menge der natürlichen Zahlen und P die Menge der

Primzahlen. Die folgenden Aussagen a), b) und c) sind wahr, aber d) ist

falsch:

2.4. EINIGE WICHTIGE MENGEN

39

a) ∀x ∈ P : (x = 2) ∨ (∃k ∈ N : x = 2k + 1). (Jede Primzahl außer 2 ist

ungerade.)

b)(∃x ∈ N)(∀y ∈ N)(x ≤ y). (Es gibt eine kleinste natürliche Zahl.)

c)(∀x ∈ N)(∃y ∈ N)(x < y). (Zu jeder natürlichen Zahl gibt es eine größere

natürliche Zahl.)

d)(∃y ∈ N)(∀x ∈ N)(x < y). (Es gibt eine natürliche Zahl, die größer als

alle natürlichen Zahlen ist.)

Hier sehen wir, dass es bei ∀ und ∃ auf die Reihenfolge ankommt!

2.4

Einige wichtige Mengen

N := Menge der natürlichen Zahlen (”positive integers”) = {1, 2, 3, . . .}.

(Der Doppelpunkt vor dem Gleichheitszeichen bedeutet wieder, dass die linke

Seite durch die rechte Seite definiert wird.)

Z := Menge der ganzen Zahlen (”integers”) = {0, 1, −1, 2, −2, . . .}.

Q := Menge der rationalen Zahlen (”rational numbers”):

{x | (∃p ∈ Z)(∃q ∈ Z)(q 6= 0 ∧ x = p/q}.

Etwas übersichtlicher ist folgende Schreibweise:

p

Q = { | p ∈ Z ∧ q ∈ Z ∧ q 6= 0}.

q

R := Menge der reellen Zahlen (”real numbers”) (= Menge aller Zahlen,

die sich durch endliche oder unendliche Dezimalbrüche darstellen lassen. Genaueres: siehe Vorlesungen und Bücher über ”Analysis”, z.B. [30]). Wichtige

Teilmengen von R sind die Intervalle (”intervals”):

[a, b] := {x ∈ R | a ≤ x ≤ b} (abgeschlossenes Intervall),

(a, b) := {x ∈ R | a < x < b} (offenes Intervall),

[a, b) := {x ∈ R | a ≤ x < b}, (a, b] := {x ∈ R | a < x ≤ b} (rechts bzw.

links halboffenes Intervall).

40

KAPITEL 2. MENGEN

2.5

Mengenoperationen

(auch ”Boole’sche Operationen”, nach George Boole (1815-1864))

Definition 2.3 Durchschnitt (”intersection”) von A und B:

A ∩ B := {x | x ∈ A ∧ x ∈ B}.

Wenn A ∩ B = ∅, so sagt man: A und B sind disjunkt (”disjoint”).

Definition 2.4 Vereinigung (”union”) von A und B:

A ∪ B := {x | x ∈ A ∨ x ∈ B}.

Definition 2.5 Differenz (”difference”, auch ”relative complement”) von

A und B:

A \ B := {x | x ∈ A ∧ x ∈

/ B}.

Oft sind alle Mengen, die man betrachtet, Teilmengen einer festen Grundmenge (”universal set”). Diese ist z.B. in der Zahlentheorie meist die Menge

Z der ganzen Zahlen.

Definition 2.6 Sei G die Grundmenge. Dann versteht man unter dem Komplement (”complement”) von A die Menge G\A. Bezeichnung: A0 , auch Ac ,

{A oder A.

Aus den aussagenlogischen Gesetzen ergeben sich praktisch unmittelbar die

folgenden Regeln für den Umgang mit Mengen (”Boole’sche Algebra”):

• Kommutativität:

• Assoziativität:

A∩B =B∩A

A∪B =B∪A

(A ∩ B) ∩ C = A ∩ (B ∩ C)

(A ∪ B) ∪ C = A ∪ (B ∪ C)

Es hat also einen Sinn, wenn man A ∩ B ∩ C bzw. A ∪ B ∪ C schreibt,

und analog für mehr als drei Mengen. Für den Durchschnitt bzw. die

2.5. MENGENOPERATIONEN

41

Vereinigung von n Mengen A1 , . . . , An schreibt man

n

T

Ai bzw.

i=1

und es gilt dann:

n

\

i=1

n

[

i=1

n

S

Ai ,

i=1

Ai : = {x | ∀ i ∈ {1, . . . , n} : x ∈ Ai }

Ai : = {x | ∃ i ∈ {1, . . . , n} : x ∈ Ai }

Das lässt sich ohne weiteres auch auf unendliche Familien von Mengen

übertragen. Sei F irgendeine Familie von Mengen.

\

F : = {x | ∀ A ∈ F : x ∈ A }

[

F : = {x | ∃ A ∈ F : x ∈ A }

(Andere Schreibweise:

\

A bzw.

A∈F

[

A.)

A∈F

Beispiel: Sei Ak := {n ∈ N | n ≥ k} und F := {X | ∃ kT∈ N :

X =SAk }. (Kurzschreibweise: F := {Ak | k ∈ N}.) Dann ist F = ∅

und F = N.

∞

∞

T

S

Ak = ∅ bzw.

Ak = N.)

(Wir könnten auch schreiben:

k=1

k=1

Klarerweise gilt für jede Menge A aus F :

\

[

F ⊂ A und A ⊂

F.

• Distributivität:

A ∪ (B ∩ C) = (A ∪ B) ∩ (A ∪ C)

A ∩ (B ∪ C) = (A ∩ B) ∪ (A ∩ C)

• de Morgan-Regel:

(A ∩ B)0 = A0 ∪ B 0

(A ∪ B)0 = A0 ∩ B 0

• Regel für das doppelte Komplement:

(A0 )0 = A

42

KAPITEL 2. MENGEN

Die folgenden Regeln liefern einen Zusammenhang zwischen Inklusion und

Durchschnitt bzw. Vereinigung:

A⊂B ⇔ A∩B =A

A⊂B ⇔ A∪B =B

Auch das kann man leicht mit Wahrheitstafeln beweisen: Bezeichnen wir mit

a bzw. b die Aussagen ”x ∈ A” bzw. ”x ∈ B”, so sehen wir, dass sich die

letzte Regel aus folgender logischen Äquivalenz ergibt:

a → b ⇔ a ∨ b ↔ b.

Definition 2.7 Symmetrische Differenz von A und B:

A ∆ B := (A \ B) ∪ (B \ A).

(Wir könnten auch schreiben: A ∆ B := {x | entweder x ∈ A oder x ∈ B}.)

Eine andere, äquivalente Definition der symmetrischen Differenz ist folgende:

A ∆ B := (A ∪ B) \ (A ∩ B).

Auch für ∆ gelten einige leicht zu beweisende Regeln, wie z.B. Kommutativität und Assoziativität.

Eine besondere Rolle spielt die folgende Operation (siehe Kapitel 3 und 4).

Sie ist nach Cartesius = René Descartes (1596-1650) benannt.

Definition 2.8 Cartesisches Produkt (”cartesian product”) von A und

B:

A × B := { (x, y) | x ∈ A ∧ y ∈ B }.

Dabei bedeutet (x, y) ein (geordnetes) Paar. Der Unterschied zur Menge

{x, y} besteht darin, dass es in (x, y) auf die Reihenfolge ankommt, d.h. wir

gehen von folgendem Axiom aus:

(x, y) = (x0 , y 0 ) ⇔ x = x0 ∧ y = y 0 .

Auch (x, x) ist ein geordnetes Paar, wogegen {x, x} eine Menge mit nur einem

Element ist.

Beispiel: {1, 2} × {2, 4, 6} = {(1, 2), (1, 4), (1, 6), (2, 2), (2, 4), (2, 6)}.

2.5. MENGENOPERATIONEN

43

Die Elemente von A × B kann man sich in einer rechteckigen Anordnung

vorstellen:

2

4

6

1 (1, 2) (1, 4) (1, 6)

2 (2, 2) (2, 4) (2, 6)

Bemerkungen:

1) ∅ × A = A × ∅ = ∅ für jede Menge A.

2) Im Allgemeinen ist das cartesische Produkt nicht kommutativ: Wenn A

und B zwei verschiedene nicht leere Mengen sind, dann gilt A × B 6= B × A.

Beweis: Wenn A 6= B, dann gibt es ein a aus A, das nicht in B liegt,

oder umgekehrt. Wir müssten also eigentlich zwei Fälle unterscheiden. Da

die beiden Fälle aber durch Vertauschung von A und B ineinander übergehen, können wir sagen: Sei ohne Beschränkung der Allgemeinheit (o.B.d.A.)

a∈A ∧ a∈

/ B. Da wir B 6= ∅ voraussetzen, gibt es ein Element b ∈ B.

Dann gilt (a, b) ∈ A × B, aber (a, b) ∈

/ B × A, da ja a ∈

/ B. Also folgt:

A × B 6= B × A.

Das cartesische Produkt von drei Mengen wird analog definiert:

A × B × C := { (x, y, z) | x ∈ A ∧ y ∈ B ∧ z ∈ C}.

(x, y, z) heißt (geordnetes) Tripel:

(x, y, z) = (x0 , y 0 , z 0 ) ⇔ x = x0 ∧ y = y 0 ∧ z = z 0 .

Meist unterscheidet man nicht zwischen (x, y, z) und den Paaren ((x, y), z),

(x, (y, z)). Dann gilt folgendes Assoziativgesetz:

A × B × C = (A × B) × C = A × (B × C).

In analoger Weise kann man auch das cartesische Produkt von n Mengen

A1 , . . . , An für beliebiges n ∈ N definieren. Die Elemente sind dann die

(geordneten) n-Tupel (x1 , . . . , xn ) mit xi ∈ Ai für alle i ∈ {1, . . . , n}. Statt

n-Tupel sagt man auch endliche Folge (”finite sequence”) (der Länge n).

Definition 2.9 Sei A eine Menge. Dann heißen

A2 := A × A, A3 := A × A × A, usw.

die cartesischen Potenzen (”cartesian powers”) von A.

44

KAPITEL 2. MENGEN

Beispiele:

1) R2 = {(x, y) | x ∈ R ∧ y ∈ R}, oder etwas kürzer: {(x, y) | x, y ∈ R}.

Diese Menge dient als Modell der Ebene.

Analog ist R3 ein Modell des dreidimensionalen Raums, und daher nennt

man für eine beliebige natürliche Zahl n die Menge Rn den n-dimensionalen

(euklidischen) Raum. Wenn x = (x1 , . . . , xn ) ∈ Rn , so heißen die Zahlen

xi Koordinaten von x. Die Elemente des Rn kann man sich als Punkte

oder Vektoren vorstellen. (Siehe Vorlesungen und Bücher über ”Lineare

Algebra”, z.B. [2]).

2) Z2 = {(x, y) | x, y ∈ Z}. Diese Menge können wir als die Menge aller

Punkte der Ebene mit ganzzahligen Koordinaten auffassen. Solche Punkte

heißen auch ”Gitterpunkte” der Ebene. Analog ist Zn die Menge aller

Gitterpunkte des Rn .

2.6

Übungsaufgaben

1. Vereinfachen Sie:

a) A ∩ (B \ A),

b) (A \ B) ∪ (A ∩ B),

c) (A ∩ B) ∪ (A ∩ B ∩ (C \ A)) ∪ ((B \ A) ∩ C)

2. Beweisen Sie:

a) A ∩ (B ∆ C) = (A ∩ B) ∆ (A ∩ C),

b) A ∆ B ⊂ (A ∆ C) ∪ (B ∆ C).

3. Beweisen Sie:

a) A × (B ∪ C) = (A × B) ∪ (A × C),

b) A × (B ∩ C) = (A × B) ∩ (A × C).

4. Stimmt die folgende Formel: A \ (B \ C) = (A \ B) \ C ?

(Wenn ja, dann beweisen Sie die Formel; wenn nein, dann geben Sie

ein Gegenbeispiel an!)

5. Unter welchen Voraussetzungen stimmen die folgenden Formeln?

a) P(A ∪ B) = P(A) ∪ P(B),

b) P(A ∩ B) = P(A) ∩ P(B),

c) A × (B \ C) = (A × B) \ (A × C),

2.6. ÜBUNGSAUFGABEN

45

d) (A ∪ B) × C = (A ∪ C) × (B ∪ C).

6. Für a = (a1 , a2 ) ∈ R2 sei G(a) := {x ∈ R2 | ∃λ ∈ R : x = (λa1 , λa2 )}.

a) Was bedeutet G(a) anschaulich?

b) Sei F = {G(a) | a ∈ R2 }. Was ist

T

F bzw.

S

F?

46

KAPITEL 2. MENGEN

Kapitel 3

Relationen

3.1

Allgemeines

Seien A, B zwei Mengen. (A 6= B wird nicht vorausgesetzt.) Unter einer ”Relation” zwischen A und B versteht man umgangssprachlich eine ”Beziehung”

zwischen den Elementen von A und denen von B. (Beispiele: ”a kennt b”,

”a ist größer als b” für a ∈ A = Menge der männlichen Studenten, b ∈ B =

Menge der weiblichen Studenten.) Wenn wir für a ∈ A und b ∈ B nur die

zwei Möglichkeiten zulassen, dass die betrachtete Relation gilt oder nicht, so

wird die Relation durch die Menge aller Paare (a, b) bestimmt, sodass für a

und b die Relation gilt. Das führt zu folgender Definition:

Definition 3.1 Eine (binäre) Relation (”binary relation”) zwischen den

Elementen von A und B ist eine Teilmenge von A × B.

Man sagt auch: ”Relation von A nach B.” Eine Teilmenge von A × A heißt

auch ”Relation auf A”.

Statt (x, y) ∈ R schreibt man in diesem Zusammenhang meist x R y. Man

kann das auch so ausdrücken: x steht zu y in der Relation R.

Beispiele:

1) {(x, y) ∈ N × N | x ≤ y}. Das ist eine Relation auf N, und zwar ein

Beispiel für eine Ordnungsrelation (siehe Abschnitt 3.4).

2) Sei A = {0, 1, 2, . . . , 255} und B die Menge der in einem (gewöhnlichen)

Computer darstellbaren Zeichen. C sei die Menge

{(a, b) ∈ A × B | a ist der ASCII-Code von b}.

47

48

KAPITEL 3. RELATIONEN

Es gilt z.B. 33 C ”!” und 122 C ”z”, wenn wir die Zeichen der Deutlichkeit

halber mit Anführungsstrichen schreiben. In diesem Fall gibt es zu jedem

a ∈ A genau ein b ∈ B, sodass aRb; und andererseits gibt es zu jedem b ∈ B

genau ein a ∈ A, sodass aRb. So etwas nennt man eine bijektive Abbildung

(siehe Kapitel 4).

3) Auf jeder Menge A können wir die Gleichheitsrelation

{(x, y) ∈ A × A | x = y}

betrachten. Diese heißt auch die Identität auf A. Wir bezeichnen sie mit IA

oder kurz I.

4) Wenn A und B beliebige Mengen sind, dann ist auf Grund unserer Definition auch die leere Menge eine Relation zwischen den Elementen von A

und B, da ja ∅ ⊂ A × B. Man nennt ∅ in diesem Zusammenhang auch leere

Relation.

5) A × B ist natürlich auch eine Relation von A nach B. Sie wird manchmal

universelle Relation genannt.

Definition 3.2 Sei R eine Relation auf A. Die Relation

{(x, y) ∈ A × A | (y, x) ∈ R}

heißt die Umkehrrelation (”inverse relation”) von R.

Bezeichnungen für die Umkehrrelation: R−1 , manchmal auch R← .

Definition 3.3 Eine Relation R auf einer Menge A heißt

reflexiv, wenn ∀x ∈ A : xRx;

symmetrisch, wenn ∀x, y ∈ A : xRy → yRx;

antisymmetrisch, wenn ∀x, y ∈ A : xRy ∧ yRx → x = y;

transitiv, wenn ∀x, y, z ∈ A : xRy ∧ yRz → xRz.

Die obigen Beispiele haben folgende Eigenschaften:

1) reflexiv, antisymmetrisch, transitiv;

2) ist keine Relation auf einer Menge;

3.2. GRAPHEN

49

3) reflexiv, symmetrisch, antisymmetrisch, transitiv;

4) symmetrisch, antisymmetrisch, transitiv;

5) reflexiv, symmetrisch, transitiv.

(Bei 4) und 5) muss natürlich A = B vorausgesetzt werden.)

Bemerkungen: Sei R eine Relation auf A. Dann gilt:

a) R ist reflexiv ⇔ IA ⊂ R.

b) R ist symmetrisch ⇔ R = R−1 .

c) R ist antisymmetrisch ⇔ R ∩ R−1 ⊂ IA .

Eine Relation R auf einer Menge A liefert in natürlicher Weise auch auf jeder

Teilmenge von A eine Relation:

Definition 3.4 Sei R eine Relation auf A, und S ⊂ A. Dann heißt folgende

Relation Einschränkung (”restriction”) von R auf S:

R|S := { (x, y) ∈ S × S | xRy }

Z.B. kann man die natürliche Ordnungsrelation auf N als Einschränkung der

natürlichen Ordnungsrelation auf Z auffassen.

3.2

3.2.1

Graphen

Gerichtete Graphen

Man erhält eine anschauliche Darstellung einer Relation R auf einer Menge

V , wenn man die Elemente von V als Punkte (oder kleine Kreise) darstellt

und für jedes Paar (x, y) ∈ R einen Pfeil von x nach y zeichnet.

50

KAPITEL 3. RELATIONEN

Beispiel: Sei V = {1,2,3,4,5,6}, R = {(1,2),(2,1),(1,3),(1,5),(4,2),(4,3),(4,4)}.

2

1

4

6

3

5

Definition 3.5 Sei R eine Relation auf der Menge V. Das Paar D = (V, R)

heißt gerichteter Graph (”directed graph”, kurz ”digraph”). Die Elemente

von V heißen Ecken (”vertices”), die Elemente von R heißen Kanten

(”edges”) von D.

(Das Wort ”Digraph” wird auch im Deutschen verwendet.)

Bei einem gerichteten Graphen kommt es also nicht auf die Lage der Ecken

oder die Form der Kanten an! Der ”abstrakte” gerichtete Graph ist etwas

anderes als seine zeichnerische Darstellung.

Definition 3.6 Wenn (a, b) eine Kante ist, so heißt a der Anfangspunkt

(”initial vertex”, ”tail”) und b der Endpunkt (”terminal vertex”, ”head”)

der Kante. Wir sagen auch, die Kante geht von a nach b. Eine Kante der

Form (x, x) heißt Schlinge (”loop”).

3.2.2

Ungerichtete Graphen

Sei D = (V, R) ein gerichteter Graph, und R sei eine symmetrische Relation.

Dann treten alle Kanten paarweise auf: Mit (x, y) ist auch (y, x) eine Kante.

Wenn D keine Schlingen besitzt, kann man daher in diesem Fall die Relation

durch die zweielementigen Mengen {x, y} angeben, für die (x, y) und (y, x)

Kanten sind. Wenn es Schlingen gibt, so kann man diese durch einelementige

Mengen {x} mit x ∈ V darstellen.

3.2. GRAPHEN

51

Definition 3.7 Sei V eine beliebige Menge und E eine Menge von einoder zweielementigen Teilmengen von V. Dann heißt G = (V, E) ein (ungerichteter) Graph. Die Elemente von V heißen wieder Ecken, die von E

Kanten von G.

Bemerkung: Dieser Begriff hat nichts mit Funktionsgraphen (siehe Kapitel

4) zu tun!

Definition 3.8 Ein Graph ohne Schlingen heißt einfacher Graph (”simple

graph”).

Bemerkung: Manchmal wird generell vorausgesetzt, dass keine Schlingen auftreten, d.h. man versteht dann unter einem ”Graphen” einen einfachen Graphen.

Zur Veranschaulichung eines ungerichteten Graphen werden für jede Kante

die beiden zugehörigen Ecken durch eine Linie verbunden. Es kommt wieder

nicht auf die Gestalt der Linie oder die Lage der Ecken an.

Beispiel: Sei V = {1, 2, 3, 4} und E = {{1, 2}, {1, 3}, {1, 4}, {2, 3}}.

4

3

1

2

Zu jedem Graphen G gibt es einen zugehörigen gerichteten Graphen G0 : Für

G = (V, E) ist G0 = (V, R) mit R = {(x, y) ∈ V × V | {x, y} ∈ E} . Jede

ungerichtete Kante {x, y} wird also durch zwei gerichtete Kanten (x, y), (y, x)

ersetzt. Für das letzte Beispiel sieht das so aus:

4

3

1

2

52

KAPITEL 3. RELATIONEN

Umgekehrt kann man aus jedem gerichteten Graphen D einen ungerichteten

Graphen U(D) machen, indem man (x, y) durch {x, y} ersetzt. U(D) heißt

der D zugrundeliegende (ungerichtete) Graph (”underlying graph”).

Dabei geht natürlich Information verloren!

Bei einem ungerichteten Graphen kann man nicht zwischen Anfangs- und

Endpunkt einer Kante unterscheiden, man nennt daher oft beide Ecken einer

Kante ”Endpunkte”.

3.2.3

Pfade