Wahrscheinlichkeitsräume und Zufallsvariablen

Werbung

Kapitel 1

Wahrscheinlichkeitsräume und

Zufallsvariablen

1.1

W-Räume

Definition 1.1 (W-Maß, W-Raum)

Sei (M, A) ein Messraum, (d.h. M ist eine nicht-leere Menge und A ist eine Sigma-Algebra in M ).

Ein Wahrscheinlichkeitsmaß (W-Maß) oder eine Wahrscheinlichkeitsverteilung (W-Verteilung) auf A ist

ein Maß P auf A mit P (M ) = 1.

Wenn P ein W-Maß auf A ist, dann heißt das Tripel (M, A, P ) ein Wahrscheinlichkeitsraum (W-Raum).

Sprechweisen: Wenn (M, A, P ) ein W-Raum ist, dann nennen wir jedes A ∈ A ein Ereignis und

P (A) die Wahrscheinlichkeit des Ereignisses A.

Bemerkung zur Notation: Neben meiner Standard-Bezeichnung (M, A, P ) für einen W-Raum

werde ich als Bezeichnung für einen weiteren W-Raum oft verwenden (insbes. im Zusammenhang mit

Zufallsvariablen): (Ω, A, P) .

Lemma 1.2 (Diskrete W-Verteilung und Zähldichte)

Sei M eine abzählbare (nicht-leere) Menge, und A = P(M ) (die Potenzmenge von M ).

(a) Sei P eine W-Verteilung auf P(M ) und bezeichne f die Zähldichte von P , d.h.

¡

¢

f : M −→ R , f (x) := P {x} ∀ x ∈ M . Dann erfüllt f die Bedingung

X

f (x) ≥ 0 ∀ x ∈ M

und

f (x) = 1 ,

(∗)

x∈M

und es gilt

P (A) =

X

f (x) ∀ A ⊆ M .

x∈A

(b) Sei umgekehrt f eine reelle Funktion auf M , die die Bedingung (∗) erfüllt; dann ist durch

X

P (A) =

f (x) ∀ A ⊆ M .

x∈A

eine W-Verteilung auf P(M ) definiert, und f ist die Zähldichte dieser W-Verteilung P .

Bemerkung:

Wenn M abzählbar und P eine W-Verteilung auf P(M ) sind, dann nennen wir P eine diskrete W-Verteilung

und (M, P(M ), P ) einen diskreten W-Raum, für den wir auch einfacher (M, P ) schreiben.

1

Norbert Gaffke: Vorlesung “Einführung in die Wahrscheinlichkeitstheorie und Statistik”, Sommersemester 2010

Kapitel 1: Wahrscheinlichkeitsräume und Zufallsvariablen

Definition 1.3 (Spezielle diskrete W-Verteilungen)

In den nachfolgend genannten Fällen (1) – (6) wird jeweils eine abzählbare Menge M spezifiziert und

durch Angabe einer Zähldichte f eine W-Verteilung P auf P(M ) definiert.

(1) Sei M irgendeine endliche (nicht-leere) Menge. Die Gleichverteilung auf M , Abk.: P = U(M ) ,

ist durch die konstante Zähldichte definiert:

1

f (x) =

für alle x ∈ M .

|M |

(2) Sei M = { 0, 1, . . . , n } für ein gegebenes n ∈ N, und sei noch p ∈ [ 0 , 1 ] gegeben.

Die Binomialverteilung zu den Parameterwerten n und p, Abk.: P = Bi(n, p), ist durch die

Zähldichte definiert:

µ ¶

n x

f (x) =

p (1 − p)n−x für alle x = 0, 1, . . . , n .

x

(3) Sei M = { 0, 1, . . . , n } für ein gegebenes n ∈ N, und seien noch N ∈ N, s ∈ N0 mit N ≥ s und

N ≥ n gegeben. Die hypergeometrische Verteilung zu den Parameterwerten N , s und n,

Abk.: P = Hyp(N, s, n) , ist durch die Zähldichte definiert:

¡ s ¢ ¡N −s¢

f (x) =

x

¡Nn−x

¢

für alle x = 0, 1, . . . , n .

n

(4) Seien M = N0 und λ eine gegebene positive reelle Zahl. Die Poisson-Verteilung zum Parameterwert λ, Abk.: P = Poi(λ) , ist durch die Zähldichte definiert:

f (x) = e−λ ·

λx

x!

für alle x ∈ N0 .

©

ª

(5) Seien M = x ∈ N : x ≥ r mit einem gegebenen r ∈ N, und sei noch p ∈ ( 0 , 1) gegeben.

Die negative Binomialverteilung zu den Parameterwerten r und p, Abk.: P = NegBi(r, p) , ist

durch die Zähldichte definiert:

µ

¶

x−1

f (x) = pr

(1 − p)x−r für alle x ∈ {r, r + 1, r + 2, . . . } .

r−1

Im Fall r = 1, d.h. M = N und f (x) = p (1 − p)x−1 für alle x ∈ N ,

heißt NegBi(r, p) auch die geometrische Verteilung zum Parameterwert p, Abk.: Geo(p) .

n

o

Pk

k

(6) Sei M = x = (x1 , x2 , . . . , xk ) ∈ N0 : j=1 xj = n , für gegebene k ∈ N, k ≥ 2, und n ∈ N,

Pk

und seien noch p1 , p2 , . . . , pk ∈ [ 0 , 1 ] mit

j=1 pj = 1 gegeben. Die Multinomialverteilung

zu den Parameterwerten n und p1 , p2 , . . . , pk , Abk.: P = Mu(n; p1 , p2 , . . . , pk ) , ist durch die

Zähldichte definiert:

n!

f (x) =

px1 px2 · · · pxk k ∀ x = (x1 , x2 , . . . , xk ) ∈ M .

x1 ! x2 ! · · · xk ! 1 2

Bemerkung:

Die W-Verteilungen in (2) - (4) werden bisweilen als W-Verteilungen auf ganz B 1 (statt auf P(M )) aufgefasst.

k

Allgemeiner: Wenn M ⊆ Rk eine nicht-leere Borel’sche Menge ist und P ein W-Maß auf BM

ist, dann ist P

k

k

auch als W-Maß P auf ganz B auffassbar durch P (A) := P (A ∩ M ) ∀ A ∈ B .

Entsprechend lassen sich Multinomialverteilungen in (6) als W-Verteilungen auf ganz B k auffassen.

2

Norbert Gaffke: Vorlesung “Einführung in die Wahrscheinlichkeitstheorie und Statistik”, Sommersemester 2010

Kapitel 1: Wahrscheinlichkeitsräume und Zufallsvariablen

3

Lemma 1.4 (W-Verteilungen mit µ-Dichten)

Seien (M, A, µ) ein Maßraum, f : (M, A) −→ (R, B1 ) und f erfülle die Bedingung:

Z

f (x) ≥ 0 ∀ x ∈ M ,

und

f dµ = 1 .

M

Z

Dann ist durch P = f · µ , d.h. P (A) =

f dµ ∀ A ∈ A , eine W-Verteilung P auf A gegeben.

A

Definition 1.5 (Spezielle (1-dim.) Lebesgue-stetige W-Verteilungen)

In den nachfolgenden Fällen (1)–(6) wird jeweils eine W-Verteilung P auf (R, B1 ) durch eine λλ1 Dichte f definiert.

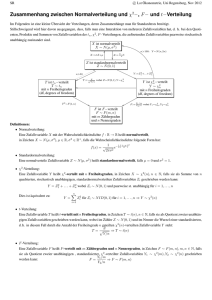

(1) Seien β ∈ R und σ ∈ ( 0 , ∞) gegeben. Die Normalverteilung zu den Parameterwerten β und σ 2 ,

Abk.: P = N(β, σ 2 ) , ist definiert durch die λλ1 -Dichte:

µ

¶

1

1 ³ x − β ´2

f (x) = √

exp −

∀ x ∈ R.

2

σ

σ 2π

(2) Seien a, b ∈ R mit a < b gegeben. Die Rechteck-Verteilung oder die Gleichverteilung auf dem

Intervall ( a , b ) , Abk.: P = R(a, b) , ist definiert durch die λλ1 -Dichte:

f (x) =

1

b−a

1 ( a , b ) (x) ∀ x ∈ R .

(3) Sei λ ∈ ( 0 , ∞) gegeben. Die Exponentialverteilung zum Parameterwert λ, Abk.: P = Exp(λ) ,

ist definiert durch die λλ1 -Dichte:

¡

¢

f (x) = λ exp −λ x 1 ( 0 , ∞) (x) ∀ x ∈ R .

(4) Seien c, λ ∈ ( 0 , ∞) gegeben. Die Weibull-Verteilung zu den Parameterwerten c und λ,

Abk.: P = Wei(c, λ) , ist definiert durch die λλ1 -Dichte:

³

´

(

c λc xc−1 exp −(λx)c

, falls x > 0

f (x) =

∀ x ∈ R.

0

, sonst

(5) Seien c, λ ∈ ( 0 , ∞) gegeben. Die Gamma-Verteilung zu den Parameterwerten c und λ,

Abk.: P = Ga(c, λ) , ist definiert durch die λλ1 -Dichte:

( c

¡

¢

λ

xc−1 exp −λx

, falls x > 0

Γ(c)

∀ x ∈ R,

f (x) =

0

, sonst

wobei Γ die Gamma-Funktion bezeichnet, d.h.

Z ∞

Γ(c) =

tc−1 exp( −t ) dt .

0

(6) Seien β ∈ R und σ ∈ ( 0 , ∞) gegeben. Die Log-Normalverteilung zu den Parameterwerten β und

σ 2 , Abk.: P = LogN(β, σ 2 ) , ist definiert durch die λλ1 -Dichte:

µ

¶

1

1

1 ³ ln(x) − β ´2

f (x) = √

exp −

∀ x ∈ ( 0 , ∞) ; f (x) = 0 ∀ x ≤ 0 .

2

σ

σ 2π x

Norbert Gaffke: Vorlesung “Einführung in die Wahrscheinlichkeitstheorie und Statistik”, Sommersemester 2010

Kapitel 1: Wahrscheinlichkeitsräume und Zufallsvariablen

Definition 1.6 (Mehrdimensionale Normalverteilungen)

Seien β ∈ Rk und V eine positiv definite (reelle) k × k Matrix. Die W-Verteilung P auf B k mit der

λλk -Dichte

³

´

¡

¢−1/2

f (x) = (2π)−k/2 det(V )

exp − 21 (x − β)0 V −1 (x − β)

∀ x ∈ Rk ,

(Vektoren x und β hier als Spaltenvektoren geschrieben),

heißt die (k-dimensionale) Normalverteilung zu den Parameterwerten β und V , Abk.: P = N(β, V ) .

1.2

Zufallsvariablen

Aus der Maßtheorie sind die Begriffe messbare Abbildung und Bildmaß bekannt. Diese werden in der

W-Theorie spezialisiert zu den Begriffen Zufallsvariable und Verteilung einer Zufallsvariablen, (wobei

die in der W-Theorie übliche Notation etwas gewöhnungsbedürftig ist).

Definition 1.7 (Zufallsvariable und ihre Verteilung)

Seien (Ω, A, P) ein W-Raum, (M, A) ein Messraum und X : (Ω, A) −→ (M, A) eine messbare

Abbildung. Dann heißt X eine Zufallsvariable (auf Ω mit Werten in M ). Das Bildmaß PX heißt die

Verteilung der Zufallsvariablen X .

Bemerkung: Offensichtlich ist PX ein W-Maß auf A.

Weitere Notation: Für ein Urbild X −1 (A) , wobei A ∈ A, schreibt man {X ∈ A} , und daher

PX (A) = P({X ∈ A}) = P(X ∈ A) .

Weitere Schreibweisen/Sprechweisen, Beispiele:

X ist eine normal-(β, σ 2 )-verteilte Zufallsvariable oder

Kurzschreibweise: X ∼ N(β, σ 2 )

X ist eine N(β, σ 2 )-verteilte Zufallsvariable

bedeutet: X : (Ω, A) −→ (R, B 1 ) , wobei (Ω, A, P) ein W-Raum ist, und PX = N(β, σ 2 ) .

X ist eine binomial-(n, p)-verteilte Zufallsvariable oder X ist eine Bi(n, p)-verteilte Zufallsvariable

Kurzschreibweise: X ∼ Bi(n, p)

¡

¢

bedeutet: X : (Ω, A) −→ {0, 1, . . . , n}, P({0, 1, . . . , n}) oder X : (Ω, A) −→ (R, B1 ) , wobei (Ω, A, P) ein

W-Raum ist, und PX = Bi(n, p) .

Wir betrachten jetzt reelle Zufallsvariablen, d.h.

X : (Ω, A) −→ (R, B1 ) .

Lemma 1.8 (Lineare Transformation einer λ

λ1 -stetig verteilten ZV’en)

Sei X eine reelle Zufallsvariable, deren Verteilung die λλ1 -Dichte fX besitzt, und seien α0 , α1 ∈ R,

α1 6= 0. Dann besitzt die Verteilung der linear transformierten Zufallsvariablen Y = α1 X + α0 die

λλ1 –Dichte

¡

¢

1

fY (y) =

fX (y − α0 )/α1

∀ y ∈ R.

|α1 |

4

Norbert Gaffke: Vorlesung “Einführung in die Wahrscheinlichkeitstheorie und Statistik”, Sommersemester 2010

Kapitel 1: Wahrscheinlichkeitsräume und Zufallsvariablen

5

Korollar 1.9

(a) Wenn X ∼ N(β, σ 2 ) und α0 , α1 ∈ R mit α1 6= 0, dann α1 X + α0 ∼ N(α1 β + α0 , α12 σ 2 ) .

(b) Wenn X ∼ R(a, b) und α0 , α1 ∈ R mit α1 6= 0, dann:

Im Fall α1 > 0 :

α1 X + α0 ∼ R(α1 a + α0 , α1 b + α0 ) ;

im Fall α1 < 0 :

α1 X + α0 ∼ R(α1 b + α0 , α1 a + α0 ) .

(c) Wenn X ∼ Exp(λ) und α1 > 0, dann α1 X ∼ Exp(λ/α1 ) .

(d) Wenn X ∼ Wei(c, λ) und α1 > 0, dann α1 X ∼ Wei(c , λ/α1 ) .

(e) Wenn X ∼ Ga(c, λ) und α1 > 0, dann α1 X ∼ Ga(c , λ/α1 ) .

Bemerkung: Log-Normalverteilung

Wenn X ∼ LogN(β, σ 2 ) , dann ist Y := ln(X) ∼ N(β, σ 2 ) . Daher rührt die Bezeichnung Log-Normalverteilung.

Dabei ist i.A. Y = ln(X) nur eine P-fast-überall auf Ω definierte Zufallsvariable, da X(ω) > 0 P-f.s. Der Einfachheit halber sei hier vorausgesetzt, dass X(ω) > 0 ∀ ω ∈ Ω.

Jetzt betrachten wir Rk -wertige Zufallsvariablen oder k-dimensionale Zufallsvariablen, d.h.

X = (X1 , . . . , Xk )t : (Ω, A) −→ (Rk , B k ) ,

(Vektoren des Rk hier als Spaltenvektoren geschrieben).

Lemma 1.10 (Reguläre lineare Transformation einer λ

λk -stetig verteilten ZV’en)

Sei X eine Rk -wertige Zufallsvariable, deren Verteilung die λλk -Dichte fX besitzt. Seien A eine reguläre (reelle) k × k Matrix und c ∈ Rk . Dann besitzt die Verteilung der linear transformierten

Zufallsvariablen Y = AX + c die λλk -Dichte

fY (y) =

¡

¢

1

fX A−1 (y − c) ,

| det(A)|

y ∈ Rk .

Im Fall einer ` × k Matrix A mit ` < k und Rang(A) = ` ist die Verteilung der linear transformierten

Zufallsvariablen Y = AX + c ebenfalls Lebesgue-stetig (sofern die Verteilung von X Lebesgue-stetig

ist), wobei jetzt c ∈ R` , aber die Formel für die Lebesgue-Dichte fY ist komplizierter. Für den Fall einer

normalverteilten k-dimensionalen Zufallsvariablen X haben wir das folgende Resultat:

Theorem 1.11 (Lineare Transformation normalverteilter k-dim. ZV’en)

Sei X ∼ N(β, V ) mit einem β ∈ Rk und einer positiv definiten k × k Matrix V .

Seien A eine ` × k Matrix mit Rang(A) = ` und c ∈ R` . Dann:

AX + c ∼ N(Aβ + c , AV A0 ) .

Folgerung:

Wenn X = (X1 , . . . , Xk )0 ∼ N(β, V ) , wobei β = (β1 , . . . , βk )0 ∈ Rk und V = (vij )1≤i,j≤k positiv

definit, dann gilt für die Komponentenvariablen von X :

Xi ∼ N(βi , vii ) ∀ i = 1, . . . , k .

Norbert Gaffke: Vorlesung “Einführung in die Wahrscheinlichkeitstheorie und Statistik”, Sommersemester 2010

Kapitel 1: Wahrscheinlichkeitsräume und Zufallsvariablen

1.3

Modellierung von Zufallsexperimenten

Der Begriff Zufallsexperiment steht hier für jeden realen Vorgang, der vom Zufall beeinflusst wird.

Typischerweise liefert ein Zufallsexperiment ein Ergebnis, das “zufällig” (zumindest teilweise) ist.

Beispiele für Zufallsexperimente:

• Glücksspiele (z.B. Münzwurf, Würfeln, Lotto)

• 0-1-Experimente (Bernoulli-Experimente), wobei z.B. “1” für Erfolg und “0” für Misserfolg steht

(z.B. Therapie, Platzierung, Schießen). Das betrachtete Zufallsexperiment kann die einmalige

Durchführung eines 0-1-Experimentes sein oder auch eine mehrmalige (z.B. die 10-malige) “unabhängige” Durchführung eines 0-1-Experimentes. Den Begriff der (stochastischen) Unabhängigkeit werden wir später mathematisch präzise fassen (s. Kap. 2).

• Zufällige Anzahlen (z.B. Anzahl von Kunden oder Aufträgen, Anzahl von Verkehrsunfällen,

Anzahl radioaktiver Zerfälle)

• Lebensdauern / Ausfallzeitpunkte (z.B. von technischen Bauteilen, von Lebewesen)

• Industrielle Fertigung: Quantitative Charakteristika gefertigter Produkte (z.B. elektr. Widerstände, Festigkeit von Materialien, geometrische Abmessungen von techn. Bauteilen)

Mathematisches Modell eines Zufallsexperiments: Ein W-Raum (M, A, P ) , wobei:

(a) die Menge M alle möglichen Ergebnisse des Zufallsexperiments enthält.

Die Festlegung der Ergebnismenge M kann ruhig auch ‘Redundanzen’ beinhalten, d.h. Elemente x als

‘mögliche Ergebnisse’ einbeziehen, die praktisch gar nicht möglich sind (das hat manchmal gewisse Vorteile

für die mathematischen Darstellungen). Die Gesamtheit solcher Elemente wird dann im Schritt (b) die

Wahrscheinlichkeit Null erhalten.

Desweiteren ist A eine geeignete Sigma-Algebra in M .

Diese ergibt sich i.d.R. kanonisch, z.B. A = P(M ) im Fall einer abzählbaren Menge M oder A = B 1 im

Fall M = R.

(b) Die W-Verteilung P ist geeignet festzulegen (“Verteilungsannahme”) entsprechend dem konkret

zu beschreibenden Zufallsexperiment.

Das ist i.d.R. der schwierigere Teil der Modellbildung. Im Fall einer abzählbaren Ergebnismenge M ,

z.B. einer endlichen Menge, bedeutet dies: Für jedes mögliche Ergebnis x ∈ M ist die Wahrscheinlichkeit

seines Eintretens festzulegen, d.h.

f (x) = P ({x}) ,

x∈M,

(Zähldichte von P ).

Im allgemeinen Fall ist das natürlich komplizierter; im Prinzip ist für jede messbare Teilmenge A ⊆ M die

W’keit P (A) anzugeben, dass das Ergebnis x des Zufallsexperiments in A liegt. Angenehm ist hier z.B. die

Beschreibung der W-Verteilung P durch eine Lebesgue-Dichte (wenn möglich) im Fall (M, A) = (R, B1 )

oder (M, A) = (Rn , B n ) .

“Ausgeschmückte” Modellformulierung mit Zufallsvariablen

Gegeben sei ein weiterer (“fiktiver”) W-Raum (Ω, A, P) , (der i.d.R. nicht weiter spezifiziert wird), und

eine Zufallsvariable

X : (Ω, A) −→ (M, A) ,

(die i.d.R. ebenfalls nicht näher spezifiziert wird, außer ihrer Verteilung, s. unten).

Ein Ergebnis x ∈ M des Zufallsexperiments wird als Wert der Zufallsvariablen X aufgefasst, (der Zufall

wählt ein Element ω ∈ Ω und das Ergebnis des Zufallsexperiments ist dann x = X(ω)). Die Verteilung PX

der Zufallsvariablen X ist geeignet festzulegen: PX = P . Wir sehen also, dass effektiv wiederum der

W-Raum (M, A, P ) das Modell darstellt.

6

Norbert Gaffke: Vorlesung “Einführung in die Wahrscheinlichkeitstheorie und Statistik”, Sommersemester 2010

Kapitel 1: Wahrscheinlichkeitsräume und Zufallsvariablen

7

Beispiele: Modelle für einige einfache Zufallsexperimente

(1) Würfeln (einmal).

M = {1, 2, 3, 4, 5, 6} und P = U(M ), d.h.

Zähldichte von P : f (x) = 1/6

∀ x = 1, 2, . . . , 6 .

Oder: Eine Zufallsvariable X mit Werten in M = {1, 2, 3, 4, 5, 6} , die auf M gleichverteilt ist:

P(X = x) = 1/6

∀ x = 1, 2, . . . , 6 .

(2) Würfeln (zweimal, unabhängig voneinander). Ein Würfel wird zweimal geworfen (erster Wurf und

zweiter Wurf), oder es werden zwei ‘unterscheidbare’ Würfel (Würfel Nr. 1 und Würfel Nr. 2) gleichzeitig

geworfen.

©

ª

M = x = (x1 , x2 ) : x1 , x2 ∈ {1, 2, 3, 4, 5, 6} , P = U(M ) , d.h.

Zähldichte von P : f (x) = 1/36 ∀ x = (x1 , x2 ) ∈ M .

Oder: X = (X1 , X2 ) eine Zufallsvariable mit Werten in M = {1, 2, . . . , 6}2 , die auf M gleichverteilt

ist:

P(X = x) = 1/36 ∀ x = (x1 , x2 ) ∈ M ,

was man auch so schreibt, mit den beiden Komponentenvariablen X1 und X2 , die jeweils Zufallsvariablen

mit Werten in {1, 2, . . . , 6} sind :

P( X1 = x1 , X2 = x2 ) = 1/36

∀ x1 , x2 = 1, 2 . . . , 6 .

Die (typische) Schreibweise “X1 = x1 , X2 = x2 ” steht dabei für das Ereignis (Teilmenge von Ω) :

©

ª

©

ª

X1 = x1 , X2 = x2 = ω ∈ Ω : X1 (ω) = x1 und X2 (ω) = x2 .

(3) Lotto-Ziehung ‘6 aus 49’ ohne Zusatzzahl.

©

ª

M = x = (x1 , x2 , . . . , x6 ) : 1 ≤ x1 < x2 < . . . < x6 ≤ 49 , xi ∈ N (1 ≤ i ≤ 6) ,

±¡ ¢

P = U(M ), also Zähldichte von P : f (x) = 1 49

∀x∈M.

6

(4) 0-1-Experiment (einmalige Durchführung).

½

M = {0, 1} ;

P mit Zähldichte f (x) =

p

1−p

, falls x = 1

, falls x = 0

,

d.h. P = Bi(1, p) ,

wobei p ∈ [ 0 , 1 ] die ‘Erfolgswahrscheinlichkeit’ ist. Interessanter sind mehrmalige unabhängige Durchführungen des 0-1-Experiments:

(5) 0-1-Experiment (n-malige “unabhängige” Durchführung).

©

ª

M = {0, 1}n = x = (x1 , x2 , . . . , xn ) : xi ∈ {0, 1} ∀ i ,

f (x) = pS(x) (1 − p)n−S(x)

∀ x = (x1 , . . . , xn ) ∈ M ,

P mit Zähldichte

n

X

wobei S(x) =

xi .

i=1

Oder: X = (X1 , X2 , . . . , Xn ) eine Zufallsvariable mit Werten in M = {0, 1}n , d.h. mit {0, 1}-wertigen

Komponentenvariablen X1 , X2 , . . . , Xn , und die Verteilung von X ist gegeben durch

¡

¢

P X1 = x1 , X2 = x2 , . . . , Xn = xn = pS(x) (1 − p)n−S(x) ∀ x = (x1 , . . . , xn ) ∈ M .

Mit Hilfe des Begriffs der stochastischen Unabhängigkeit (s. Kap. 2) lässt sich das Modell einfacher (und

anschaulicher) so formulieren:

n stochastisch unabhängige {0, 1}-wertige Zufallsvariablen X1 , X2 , . . . , Xn mit Xi ∼ Bi(1, p) für alle

i = 1, 2, . . . , n , also P(Xi = 1) = p und P(Xi = 0) = 1 − p ∀ i .

(6) Eine zufällige Anzahl, binomial-verteilt. Betrachten wir z.B. das folgende Zufallsexperiment: Ein

0-1-Experiment (mit Erfolgswahrscheinlichkeit p ∈ [ 0 , 1 ] ) wird n-mal unabhängig durchgeführt, und

als Ergebnis wird lediglich die Anzahl der erzielten Erfolge festgehalten. Modell: M = { 0, 1, 2, . . . , n }

(klar); gar nicht so klar ist die geeignete W-Verteilung (Begründung später): P = Bi(n, p) .

Andere Modellformulierung: X eine Bi(n, p)-verteilte Zufallsvariable.

Norbert Gaffke: Vorlesung “Einführung in die Wahrscheinlichkeitstheorie und Statistik”, Sommersemester 2010

Kapitel 1: Wahrscheinlichkeitsräume und Zufallsvariablen

8

Weitere Beispiele zur Modellierung

(1) Zufällige Anzahlen.

Z.B.: Die Anzahl der Ankünfte von Kunden oder Aufträgen in einer Service-Station in einem definierten Zeitraum; die Anzahl von Verkehrsunfällen in einer definierten Region in einem definierten Zeitraum; die Anzahl verkaufter Produkte in einem definierten Zeitraum; die Anzahl registrierter Impulse in

der

¡ Umgebung

¢ einer radioaktiven Substanz in einem definierten Zeitraum. Ein oft verwendetes Modell:

N0 , Poi(λ) , mit einem geeigneten λ ∈ ( 0 , ∞). Oder mit Hilfe einer Zufallsvariablen formuliert: Die

zufällige (oder zufällig erscheinende) Anzahl wird durch eine Poisson-verteilte Zufallsvariable beschrieben,

d.h.

¡

¢

λx

∀ x ∈ N0 .

X : (Ω, A) −→ N0 , P(N0 ) , P( X = x ) = e−λ

x!

(2) Zufällige Lebensdauern.

Z.B.: Lebensdauer eines technischen Bauteils (z.B. Glühlampe, elektronisches Bauteil) oder auch Lebensdauer eines Lebewesens. Die einfachsten gebräuchlichen Modelle hierfür sind:

Im Fall einer diskreten Lebensdauer (Werte in N) Modellierung durch eine geometrisch-verteilte Zufallsvariable, d,h,

¢

X : (Ω, A) −→ (N, P(N) , P( X = x ) = p(1 − p)x−1 ∀ x ∈ N ,

mit einem geeigneten p ∈ ( 0 , 1 ).

Im Fall einer kontinuierlichen Lebensdauer (Werte in ( 0 , ∞)) Modellierung durch eine exponentialverteilte Zufallsvariable, d.h. X : (Ω, A) −→ (R, B1 ), und PX besitzt die Lebesgue-Dichte

f (x) = λ exp(−λ x ) 1 ( 0 , ∞) (x) ,

(x ∈ R) ,

mit einem geeigneten λ ∈ ( 0 , ∞).

(3) Industrielle Fertigung

Charakteristikum eines gefertigten Produkts, das naturgemäß einer zufälligen (oder zufällig erscheinenden) Schwankung unterliegt, z.B. Dicke eines Bleches, Länge eines Stiftes, Widerstand eines elektrischen

Bauteils. Oft verwendet: Modellierung durch eine normalverteilte Zufallsvariable, oder auch Modellierung

durch eine lognormal-verteilte Zufallsvariable, wobei die Parameterwerte β und σ 2 der Normalverteilung

bzw. der Log-Normalverteilung geeignet festzulegen sind.

Normalverteilte und auch lognormal-verteilte Zufallsvariablen werden noch in vielen weiteren Situationen

verwendet, z.B. bei zufälligen Lebensdauern oder Projektdauern, Erträgen oder Umsätzen.