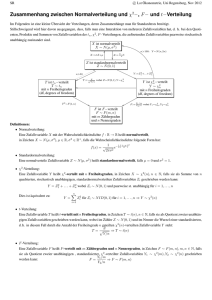

Wahrscheinlichkeitsräume (Teschl/Teschl 2, Kap. 26)

Werbung

Wahrscheinlichkeitsräume (Teschl/Teschl 2, Kap. 26)

Ein Wahrscheinlichkeitsraum

I eine Menge

Ω

(Ω, P)

ist

(Menge aller möglichen Ausgänge eines

Zufallsexperiments)

versehen mit

P : P(Ω) → [0, 1] (Wahrscheinlichkeit):

Teilmenge von Ω (Ereignis) wird eine Zahl zwischen

I einer Abbildung

Jeder

0 und 1 zugeordnet (Wahrscheinlichkeit, dass das Ereignis

eintritt)

mit folgenden Eigenschaften (KolmogorovAxiome):

1.

2.

P(Ω) = 1 (sicheres Ereignis),

P(A ∪ B) = P(A) + P(B), falls A ∩ B = ∅

(Additionsregel für unvereinbare Ereignisse).

wahrscheinlichkeit13.pdf, Seite 1

Beispiel fairer Würfel

Ω = {1, ..., 6} mit P({i}) = P(i) =

Augenzahlen i = 1, 2, ..., 6.

bzw. allgemeiner

P(A) =

1

6

· #A

1

6 für jede der möglichen

für jede Teilmenge

(#A bezeichnet die Anzahl der Elemente von

A⊂Ω

A).

Z. B. entspricht das Ereignis

Augenzahl ist nicht durch 3 teilbar der Menge

A = {1, 2, 4, 5}

mit

Für die Ereignisse

C:

P(A) =

B:

4

6

=

2

3.

Augenzahl durch 3 teilbar und

Augenzahl durch 5 teilbar gilt

B = {3, 6}, C = {5} ⇒ B ∩ C = ∅

und

B ∪ C = {3, 5, 6}

und somit

P(B ∪ C ) = P(B) + P(C ) =

1

3

+

1

6

=

1

2

= 50%.

wahrscheinlichkeit13.pdf, Seite 2

Folgerungen aus den KolmogorovAxiomen

I

I

I

P(A ∪ B) = P(A) + P(B) − P(A ∩ B) für beliebige A, B ,

P(A) ≤ P(B), falls A ⊂ B (Monotonie),

P(A) = 1 − P(A),

c

wobei A = A = Ω \ A das Komplementärereignis zu A

bezeichnet.

I

P(∅) = 0

(unmögliches Ereignis)

Beispiel

P(Augenzahl

durch 2 oder 3 teilbar )

= P({2, 4, 6}) + P({3, 6}) − P({6}) =

1

2

+ 13 −

1

6

=

2

3.

wahrscheinlichkeit13.pdf, Seite 3

Bestimmung von Wahrscheinlichkeiten

ist auf unterschiedliche Weise möglich. Die wichtigsten sind:

I durch ein Symmetrieprinzip:

Ein Zufallsexperiment hat endlich viele mögliche

Ausgänge, die alle als gleichwahrscheinlich angenommen

werden (Beispiel Augenzahl eines Würfels). Man spricht

von einem LaplaceExperiment.

I durch Schätzung anhand von Beobachtungen

I durch Berechnung ausgehend von bekannten

Wahrscheinlichkeiten

(Beispiel: Wahrscheinlichkeit, bei dreimaligem Würfeln

mindestens eine 6 zu erhalten)

wahrscheinlichkeit13.pdf, Seite 4

Ein Laplace-Experiment

ist ein Zufallsexperiment, bei dem alle möglichen Ausgänge

gleich wahrscheinlich sind.

Ω

ist dabei endliche Menge mit

P({x}) =

1

n

für alle

x ∈A

=

1

n

· #A =

1

n

Elementen mit

(Gleichverteilung).

Für eine beliebige Teilmenge

P(A) =

n

A⊂Ω

folgt dann

mal Zahl der Elemente von

A

Zahl der günstigen durch Zahl der möglichen Fälle.

Beispiele

I fairer Würfel

I Münzwurf:

P (Wappen) = P (Zahl) =

1

2

= 50%

I Ziehen einer Spielkarte aus 32:

Die Wahrscheinlichkeit, dass ein Ass gezohen wird, ist

4/32

=

1

8

= 12, 5%.

wahrscheinlichkeit13.pdf, Seite 5

Beispiel Lotto

Es gibt

49

6

Möglichkeiten, 6 aus 49 Zahlen zu ziehen.

Die Wahrscheinlichkeit für eine bestimmte Zahlenkombination

ist damit 1/

49

6

= 1/13.983.816 < 0, 00001%

(Ziehen ohne Zurücklegen ohne Berücksichtigung der Reihenfolge)

Andere Urnenmodelle

Mit Berücksichtung der Reihenfolge gibt es beim Ziehen von 6

aus 49 Zahlen

49

49!

43! Möglichkeiten

· 48 · ... · 44 =

⇒ P({x}) =

43!

49!

= 1/10.068.347.520

Mit Zurücklegen (d. h. Zahlen können mehrfach gezogen

werden) und Berücksichtigung der Reihenfolge gibt es

49

6

Möglichkeiten

⇒ P({x}) = 49−6 = 1/13.841.287.201

wahrscheinlichkeit13.pdf, Seite 6

Zwei Würfel

Es gibt 36 Möglichkeiten, jede hat Wahrscheinlichkeit 1/36.

Ω = {(i, j) : 1 ≤ i, j ≤ 6}

mit

P(i, j) =

1

36 .

Mit

A = {(2, 1), (2, 2), (2, 3), (2, 4), (2, 5), (2, 6)}

(erster Würfel 2)

und

B = {(1, 3), (2, 3), (3, 3), (4, 3), (5, 3), (6, 3)}

(zweiter Würfel 3)

ist

1

6 und

1

P(2, 3) = 36

=

P(A) = P(B) =

P(A ∩ B) =

P(A) · P(B)

Unabhängigkeit

A

und

B

heiÿen unabhängig, wenn

P(A ∩ B) = P(A) · P(B)

Interpretation: Das Eintreten von Ereignis

Einuss auf die Wahrscheinlichkeit von

B

A

hat keinen

und umgekehrt.

wahrscheinlichkeit13.pdf, Seite 7

Beispiele

A = Augenzahl des ersten Würfels

B = Augensumme gerade ist

P(A) = P(B) = 12 und P(A ∩ B) = 14 ,

I Mit

gerade und

also sind die beiden Ereignisse unabhängig.

A = erster Würfel 4 und B = Augensumme

1

1

ist P(A) = , P(B) =

6

12 und

1

1

P(A ∩ B) = P(4, 6) = 36

6= 16 · 12

,

also sind A und B nicht unabhängig.

Mit A = erste gezogene Spielkarte ist ein Ass

und B = zweite Karte ist ein Bube ist

P(A) = P(B) = 81 und

4

1

P(A ∩ B) = 18 · 31

= 62

6= 81 · 18 ,

I Mit

I

10

d. h. die beiden Ereignisse sind nicht unabhängig.

wahrscheinlichkeit13.pdf, Seite 8

Bedingte Wahrscheinlichkeit

Unabhängigkeit umformuliert:

P(A ∩ B) = P(A) · P(B) ⇔ P(A) = P(A ∩ B)/P(B).

Allgemein deniert man die bedingte Wahrscheinlichkeit von

unter

B

als

P(A|B) =

P(A ∩ B)

.

P(B)

Interpretation: Wahrscheinlichkeit für

dass

B

A

A,

wenn bekannt ist,

eingetreten ist.

Bemerkungen

I

I

P(A|B) ist nur deniert, wenn P(B) > 0.

Falls P(A), P(B) > 0, so gilt

A und B unabhängig ⇔ P(A|B) = P(A) ⇔ P(B|A) = P(B).

wahrscheinlichkeit13.pdf, Seite 9

Beispiele bei zwei Würfeln

I

A:

Augensumme 10,

Dann ist

P(A) =

⇒ P(A|B) =

P(B|A) =

I

I

1/36

1/6

1/36

1/12

=

3

36

=

1

3

B : erster Würfel 4,

1

= 12

,

P(B) = 61 , P(A ∩ B) =

1

6

6= P(A) =

6= P(B) =

1

36

1

12 sowie

1

6.

A: Augensumme 7, B : erster Würfel 6,

1

P(A|B) = 11//36

6 = 6 = P(A) sowie

P(B|A) = 61 = P(B),

d. h. A und B sind unabhängig.

A: 6 Richtige beim Lotto,

B : die ersten 5 gezogenen Zahlen stimmen,

1

P(A|B) = 44

≈ 2, 27% > P(A) sowie

P(B|A) = 1 6= P(B).

wahrscheinlichkeit13.pdf, Seite 10

Beispiel Kartenspiel (mit 32 Karten)

Es werden zwei Karten (ohne Zurücklegen) gezogen. Wie groÿ

ist die Wahrscheinlichkeit, dass zwei Asse gezogen werden?

Mit

A=

erste Karte ist ein Ass

und

B=

zweite Karte ist ein Ass

ist

P(A) =

4

32

=

1

8 und

P(B|A) =

(da unter der Annahme, dass

A

3

31

eingetreten ist, unter den

verbleibenden 31 Karten noch 3 Asse sind).

Daraus kann jetzt die gesuchte Wahrscheinlichkeit berechnet

werden:

P(A ∩ B) = P(A) · P(B|A) =

1

8

·

3

31

=

3

248

≈ 0, 012 = 1, 2%

wahrscheinlichkeit13.pdf, Seite 11

Totale Wahrscheinlichkeit

Sind

A

sowie

und

B

Ereignisse, so gilt

B = (A ∩ B) ∪ (A ∩ B)

(A ∩ B) ∩ (A ∩ B) = ∅.

Aus den KolmogorovAxiomen folgt daher

P(B) = P(A ∩ B) + P(A ∩ B)

= P(A) · P(B|A) + P(A) · P(B|A).

Allgemeiner gilt

P(B) =

wenn

Pn

k=1

P(Ak ) · P(B|Ak ),

Ω = A1 ∪ ... ∪ An

mit

Ai ∩ Aj = ∅

eine Zerlegung des

Wahrscheinlichkeitsraumes ist.

Im letzten Kartenbeispiel

Mit

P(B|A) =

4

31 erhält man

P(B) = P(A) · P(B|A) + P(A) · P(B|A) =

1

8

·

3

31

+ 87 ·

4

31

=

1

8.

wahrscheinlichkeit13.pdf, Seite 12

Weiteres Beispiel

Es werden EMails untersucht, die zum Teil Spam sind.

Betrachtet werden die Ereignisse

S =Mail

ist Spam sowie

G =Mail

enthält das Wort Gewinn

Aus Erfahrungswerten seien folgende Wahrscheinlichkeiten

bekannt:

P(S) = 0, 25, P(G |S) = 0, 19

und

P(G |S) = 0, 01,

d. h. jede 4. Mail ist Spam und 19% aller Spammails sowie 1%

aller NichtSpamMails enthalten das Wort Gewinn. Es folgt

P(G ) = P(S) · P(G |S) + P(S) · P(G |S) = 0, 055,

also enthalten 5, 5% aller Mails das Wort Gewinn.

wahrscheinlichkeit13.pdf, Seite 13

Formel von Bayes

Nach Denition der bedingten Wahrscheinlichkeit gilt für

Ereignisse

A

und

B

P(A ∩ B) = P(A) · P(B|A)

sowie

P(A ∩ B) = P(B) · P(A|B)

Durch Gleichsetzen dieser beiden Ausdrücke erhält man mit

der Formel der totalen Wahrscheinlichkeit den Satz von Bayes:

P(A|B) =

P(A) · P(B|A)

P(A) · P(B|A)

=

,

P(B)

P(A) · P(B|A) + P(A) · P(B|A)

bzw. bei einer Zerlegung

Ω = A1 ∪ ... ∪ An

P(Ak ) · P(B|Ak )

P(Ak |B) = Pn

.

i=1 P(Ai ) · P(B|Ai )

wahrscheinlichkeit13.pdf, Seite 14

Anwendung: Bayes'scher Spamlter

Im letzten Beispiel:

P(S) = 0, 25

(25% SpamMails),

P(G |S) = 0, 19

(19% davon enthalten das Wort Gewinn)

P(G |S) = 0, 01

(1% der übrigen Mails enthalten das Wort Gewinn)

Dann folgt

P(S) · P(G |S)

P(S) · P(G |S) + P(S) · P(G |S)

0, 25 · 0, 19

=

≈ 0, 864,

0, 25 · 0, 19 + 0, 75 · 0, 01

P(S|G ) =

d. h. eine Mail mit dem Wort Gewinn ist zu 86, 4% Spam.

wahrscheinlichkeit13.pdf, Seite 15

Zuvallsvariablen (Teschl/Teschl Kap. 27)

Eine (reellwertige) Zufallsvariable auf einem

Wahrscheinlichkeitsraum

(Ω, P)

ist eine Abbildung

X : Ω → R,

d. h. jedem Elementarereignis

X (ω)

ω∈Ω

wird eine reelle Zahl

zugeordnet.

Damit ist jeder Teilmenge

A⊂R

eine Wahrscheinlichkeit

P(X ∈ A) = P({ω ∈ Ω : X (ω) ∈ A})

zugeordnet. Man spricht von von der

Wahrscheinlichkeitsverteilung (oder kurz Verteilung) von

X.

wahrscheinlichkeit13.pdf, Seite 16

Ereignisse

A ⊂ R, der die

Wahrscheinlichkeit P(X ∈ A) zugeordnet wird. Ist A = [a, b]

ein Intervall, so schreibt man P(X ∈ [a, b]) = P(a ≤ X ≤ b).

Ein Ereignis entspricht jetzt einer Teilmenge

Beispiel Augensumme von zwei Würfeln

Ω = {1, ..., 6} × {1, ..., 6} = {(i, j) : 1 ≤ i, j ≤ 6}

1

P(i, j) = 36

für alle (i, j) (Gleichverteilung).

Gegeben

mit

Die Augensumme wird beschrieben durch die Zuvallsvariable

X (i, j) = i + j

Mit

A:

Augensumme

≥ 10

für alle

(i, j) ∈ Ω.

ist dann z. B.

P(X ∈ A) = P(X ≥ 10) = P{ω : X (ω) ≥ 10}

= P{(4, 6), (5, 5), (5, 6), (6, 4), (6, 5), (6, 6)} =

6

36

=

1

6

wahrscheinlichkeit13.pdf, Seite 17

Bemerkungen

I In Anwendungen beschreiben Zufallsvariablen in der Regel

beobachtete bzw. zu untersuchende Zufallsgröÿen,

während der zugrunde liegende Wahrscheinlichkeitsraum

im Hintergrund den Mechanismus modelliert, der die

Wahrscheinlichkeiten festlegt.

In der Praxis werden oft nur Zufallsvariablen und ihre

Verteilung betrachtet, ohne dass dazu ein

Wahrscheinlichkeitsraum explizit angegeben wird.

X entspricht einer

Wahrscheinlichkeitsfunktion P mit R als

Wahrscheinlichkeitsraum, die Teilmengen A ⊂ R

Wahrscheinlichkeiten P(A) = P(X ∈ A) zuordnet, welche

I Die Verteilung einer Zufallsvariable

den KolmogorovAxiomen genügen.

wahrscheinlichkeit13.pdf, Seite 18

Diskrete Zufallsvariablen

Eine Zufallsvariable heiÿt diskret, wenn sie nur endlich oder

abzählbar viele Werte

pi = P(X = xi ) > 0

x1 , x2 , x3 , ...

annimmt mit

und

X

P(X = xi ) = 1

i

(im Fall von abzählbar unendlich vielen Werten handelt es sich

bei der Summe formal um eine unendliche Reihe).

Die Verteilung von

X

ist durch die

pi = P(X = xi )

eindeutig

festgelegt.

Beispiel

Die Augenzahl

X

eines fairen Würfels nimmt die Werte 1, 2,

3, 4, 5 und 6 an mit

P(X = 1) = P(X = 2) = P(X = 3)

= P(X = 4) = P(X = 5) = P(X = 6) =

1

6.

wahrscheinlichkeit13.pdf, Seite 19

Weitere Beispiele

I Die Augensumme von zwei Würfeln ist eine diskrete

Zufallsvariable mit Werten 2, 3, ..., 12.

Z. B. ist

P(X = 2) =

1

36 und

P(X = 7) =

6

36

=

1

6.

I Man würfelt mit einem Würfel so lange, bis die erste

Sechs fällt. Gibt

X

die benötigte Zahl der Würfe an, so ist

pi = P(X = i) =

Begründung:

X =i

1

6

i−1

·

5

6

für

i ≥1

bedeutet dass die ersten

i − 1 Würfe

5 i−1

keine Sechs sind,wofür die Wahrscheinlichkeit

und im

i ten

6

ist,

Wurf dann eine Sechs fällt, wofür die

Wahrscheinlichkeit

1

6 ist. Unter der Annahme, dass die

einzelnen Augenzahlen unabhängig sind, erhält man die

Gesamtwahrscheinlichkeit als Produkt. Man spricht von

einer geometrischen Verteilung.

wahrscheinlichkeit13.pdf, Seite 20

Bemerkung zur geometrischen Verteilung

mit

X

P(X = i) =

1

6

·

5 i−1

6

kann beliebige Werte

i ∈N

annehmen, es handelt sich

somit um eine diskrete Verteilung mit abzählbar unendlich

vielen Werten.

Betrachtet man die Summe über alle

Einzelwahrscheinlichkeiten, so erhält man die aus unendlich

vielen Summanden bestehende Summe (Reihe )

P(X = 1) + P(X = 2) + P(X = 3) + P(X = 4) + ...

2

3

= 61 + 16 · 56 + 16 · 56 + 16 · 65 + ...

h

i

5

5 2

5 3

1

·

1

+

+

+

+

...

=6

6

6

6

wahrscheinlichkeit13.pdf, Seite 21

Fortsetzung geometrische Verteilung

Beim Ausdruck in eckigen Klammern handelt es sich um eine

geometrische Reihe der Form

P∞

k=0

q k = 1 + q + q 2 + ...

= limn→∞ (1 + q + q 2 + ... + q n ) = limn→∞

mit

q=

1−q n+1

1−q

=

1

1−q

5

6 (die vorletzte Gleichheit kann durch vollständige

Induktion nach

n

bewiesen werden).

Es folgt, dass der Klammerausdruck den Wert

1

1− 56

=

1

1/6

=6

hat.

Die Gesamtsumme der Wahrscheinlichkeiten beträgt somit

1

6

· 6 = 1,

womit gezeigt ist, dass es sich tatsächlich um eine

Wahrscheinlichkeitsverteilung handelt.

wahrscheinlichkeit13.pdf, Seite 22

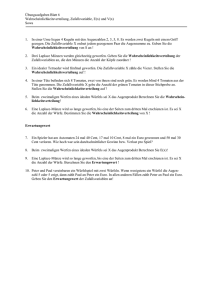

Graphische Darstellung

Die Verteilung einer diskreten Zufallsvariable kann graphisch in

einem Stabdiagramm dargestellt werden.

Verteilung der Augensumme zweier Würfel.

wahrscheinlichkeit13.pdf, Seite 23

Geometrische Verteilung

Verteilung der Anzahl

X

der bis zur ersten Sechs benötigten

Würfe.

wahrscheinlichkeit13.pdf, Seite 24

Bemerkung

Die Verteilung einer diskreten Zufallsvariable deniert eine

Wahrscheinlichkeitsfunktion auf der endlichen (oder

abzählbaren) Menge

M = {x1 , x2 , x3 , ...} ∈ R.

In den meisten Anwendungen ist

M

eine Teilmenge der ganzen

Zahlen.

A ⊂ R gilt dann

P

P(X ∈ A) = P(A ∩ M) = xi ∈A P(X = xi ),

Für eine beliebige Teilmenge

wobei die Summe über diejenigen

xi ∈ A

i

gebildet wird, für die

liegt.

Beispiel: Ist

das Intervall

X die Augenzahl

A = (−2; 3)

eines (fairen) Würfels, so gilt für

P(X ∈ A) = P(−2 < X < 3)

= P(X = 1) + P(X = 2) =

1

6

+

1

6

=

1

3.

wahrscheinlichkeit13.pdf, Seite 25

Stetige Zufallsvariablen

In vielen Anwendungen (z. B. bei der Modellierung zufälliger

Zeiten, Längen etc.) ist es sinnvoll, Zufallsgröÿen zu

betrachten, die beliebige Werte in einem reellen Intervall

annehmen können.

In solchen Fällen kann die Verteilung nicht mehr durch die

Wahrscheinlichkeit

P(X = xi )

einzelner Punkte festgelegt

werden.

Man spricht von einer stetigen Zufallsvariablen

X,

wenn

einzelne Punkte die Wahrscheinlichkeit Null haben, d. h.

P(X = x) = 0

für alle

x ∈R

gilt.

wahrscheinlichkeit13.pdf, Seite 26

Beispiel

Die Gleichverteilung im Intervall [0, 1] ist dadurch

charakterisiert, dass die Wahrscheinlichkeit, dass

X

einen Wert

in einem Teilintervall annmimmt, gleich der Länge dieses

Teilintervalls ist:

P(X ∈ [a, b]) = b − a

für alle

a, b

mit 0

≤ a ≤ b ≤ 1.

So ist z. B. die Wahrscheinlichkeit, dass eine in [0; 1]

X einen

0, 15 = 15%.

gleichverteilte Zufallsvariable

0,4 annimmt, gleich

Wert zwischen 0,25 und

( 15% aller reellen Zahlen zwischen aus dem Intervall [0; 1]

liegen zwischen 0,25 und 0,4.)

wahrscheinlichkeit13.pdf, Seite 27

Dichten

Bei stetigen Zufallsvariablen

X

kann die Wahrscheinlichkeit

eines Teilintervalls oft als Fläche unter einem

Funktionsgraphen

f (x)

Eine solche Funktion

f

interpretiert werden.

heiÿt Dichte der

Wahrscheinlichkeitsverteilung von

X.

Denition

Eine Wahrscheinlichkeitsdichte ist eine Funktion

f :R→R

mit folgenden Eigenschaften:

I

I

I

f : R → R ist stückweise stetig

f (x) ≥ 0

ist auf (−∞, ∞) uneigentlich

Rf ∞

f (x) dx = 1.

−∞

integrierbar mit

wahrscheinlichkeit13.pdf, Seite 28

Dichte einer Zufallsvariable

Eine Zufallsvariable

mit

a≤b

X

hat die Dichte

f,

wenn für alle

a, b ∈ R

gilt

Z

P(X ∈ [a, b]) = P(a ≤ X ≤ b) =

b

f (x) dx.

a

Beispiel

Die auf [0, 1] gleichverteilte Zufallsvariable

f (x) =

1

für 0

0

sonst

≤x ≤1

X

hat die Dichte

.

Bemerkung

Hat

alle

Ra

X die Dichte f , so folgt P(X = a) = a f (x) dx = 0

a ∈ R, d. h. nur stetige Zufallsvariablen können eine

für

Dichte haben. Auÿerdem folgt

P(X ∈ [a, b]) = P(X ∈ (a, b)) = P(a < x < b)

für alle

a < b.

wahrscheinlichkeit13.pdf, Seite 29

Beispiel Gleichverteilung

Die Gleichverteilung auf dem Intervall

1

f (x) =

Der Funktionswert von

x =b

f

b−a

für

0

für

[a, b]

a<x <b

x < a und

für

hat die Dichte

x >b

an den Unstetigkeitsstellen

x =a

und

kann dabei beliebig deniert werden.

Beispiel Normalverteilung

Die StandardNormalverteilung hat die Dichte

1

f (x) = √

2π

e

−x 2 /2

für

x ∈R

(Gauÿsche Glockenkurve)

wahrscheinlichkeit13.pdf, Seite 30

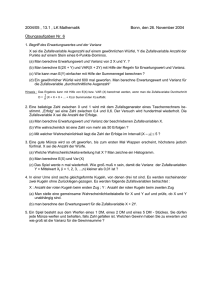

Dichte der StandardNormalverteilung

Die gelbe Fläche entspricht der Wahrscheinlichkeit, dass eine

standardnormalverteilte Zufallsvariable einen Wert zwischen

und

b

a

annimmt.

wahrscheinlichkeit13.pdf, Seite 31

Exponentialverteilung

Die Exponentialverteilung mit Parameter

f (x) =

Dichte

f (x)

mit Parameter

k e−kx

0

k=

k >0

hat die Dichte

≥0

x <0

für 0

für

3

2 , die markierte Fläche

entspricht der Wahrscheinlichkeit, dass eine Zufallsvariable mit

Dichte

f (x)

einen Wert zwischen 1 und 2 annimmt.

wahrscheinlichkeit13.pdf, Seite 32

Beispiel zur Berechnung der Wahrscheinlichkeiten

Ist die Zufallsvariable

k=

X

exponentialverteilt mit Parameter

3

2 , so ist die Wahrscheinlichkeit, dass

X

einen Wert

zwischen 1 und 2 annimmt

2

Z

P(1 ≤ X ≤ 2) = P(1 < X < 2) =

Z

f (x) dx =

1

1

2

3 − 32 x

2e

dx

2

= −e− x = −e−3 + e−3/2 ≈ −0, 05 + 0, 22 = 17%

3

2

1

(Stammfunktion mit linearer Substitution). Analog erhält man

P(X ≥ 2) =

R∞

2

3 − 32 x

2e

∞

dx = −e− x = 0 + e−3 ≈ 5%

3

2

2

Bemerkung

Durch die Exponentialverteilung kann die Lebensdauer von

Bauteilen modelliert werden, die keinem Verschleiÿ unterliegen.

wahrscheinlichkeit13.pdf, Seite 33

Der Erwartungswert

einer diskreten Zufallsvariable

X

µ = EX = E (X ) =

ist deniert als

X

xi · P(X = xi ),

i

d. h. die Summe wird gebildet über alle möglichen Werte der

Zufallsvariablen, die mit ihrer jeweiligen Wahrscheinlichkeit

multipliziert werden.

Interpretation: Der Erwartungswert entspricht dem

durchschnittlichen Wert, den eine Zufallsgröÿe annimmt.

Beispiele

Erwartungswert der Augenzahl eines Würfels:

EX = 1 · 61 + 2 · 16 + 3 · 61 + 4 · 61 + 5 · 16 + 6 ·

1

6

= 3 21 ,

Augensumme zweier Würfel:

EX = 2 ·

1

36

+3·

+8·

5

36

2

36

+4·

+9·

4

36

3

36

+5·

+ 10 ·

3

36

4

36

+6·

+ 11 ·

2

36

5

36

+7·

+ 12 ·

6

36

1

36

=

7.

wahrscheinlichkeit13.pdf, Seite 34

Bemerkung

Im Fall einer diskreten Zufallsvariablen mit unendlich vielen

Werten führt die Berechnung des Erwartungswertes auf eine

unendliche Reihe, d. h. eine Summe mit unendlich vielen

Summanden, die als Grenzwert deniert ist.

Dieser Grenzwert existiert nicht in allen Fällen. Somit ist der

Erwartungswert einer diskreten Zufallsvariable nur dann

deniert, wenn der entsprechende Grenzwert existiert (die

Reihe konvergiert).

wahrscheinlichkeit13.pdf, Seite 35

Beispiel

Wie oft muss man durchschnittlich würfeln, bis die erste 6

fällt? Antwort: 6 mal, denn:

X

Für die Anzahl

P(X = i) =

1

6

·

der benötigten Würfe gilt

5 i−1

für

6

i = 1, 2, 3, ...

Für den Erwartungswert folgt

0

1

2

EX = 1 · 61 · 56 + 2 · 61 · 56 + 3 · 16 · 65 + ...

P∞

P

5 i−1

1

5 i−1

1

·

=

·

= 16 · 36 = 6.

i

·

= ∞

i

·

i=1

i=1

6

6

6

6

Dabei wurde benutzt, dass für jede reelle Zahl

x

mit

|x| < 1

gilt

i−1

= limn→∞

i=1 i · x

P∞

=

1

+ 2x + 3x 2 + ... + (n − 1) · x n

1

(1−x)2

Diese Identität kann mit durch Betrachtung von Potenzreihen

hergeleitet werden.

wahrscheinlichkeit13.pdf, Seite 36

Erwartungswert einer Zufallsvariable mit Dichte

Hat

X

die Dichte

f,

so ist der Erwartungswert deniert als

Z

∞

x · f (x) dx,

µ = EX = E (X ) =

−∞

falls das uneigentliche Integral existiert.

Beispiel

X gleichverteilt in [0; 1], so erhält man mit der Dichte

f (x) = 1 für 0 ≤ x ≤ 1 und f (x) = 0 sonst

1

R∞

R1

EX = −∞ x · f (x) dx = 0 x · 1 dx = 21 x 2 = 12 − 0 = 21

Ist

0

wahrscheinlichkeit13.pdf, Seite 37

Bemerkung

Nicht jede Zufallsvariable hat einen Erwartungswert.

Voraussetzung dafür ist, dass die entsprechende Reihe bzw.

das uneigentliche Integral konvergiert.

Beispiel

Wegen

R∞

dx

−∞ 1+x 2

1

∞

= arctan x =

−∞

π

2

−

−π

2

=π

1

·

eine Wahrscheinlichkeitsdichte. Eine

π 1+x 2

Zufallsvariable X mit der Dichte f (x) heiÿt Cauchyverteilt.

ist

f (x) =

Da das Integral

R∞

x · f (x) dx =

−∞

R∞

x

−∞ 1+x 2

dx =

1

2 ln(1

∞

+ x 2 )

divergiert,

−∞

ist der Erwartungswert einer Cauchyverteilten Zufallsvariable

nicht deniert.

wahrscheinlichkeit13.pdf, Seite 38

Beispiel: Erwartungswert der Exponentialverteilung

Ist

X

exponentialverteilt mit Parameter

1 −x/5

Dichte f (x) = e

für x ≥ 0 sowie f

5

k = 15 , so liefert die

(x) = 0 für x < 0 mit

partieller Integration

R∞

x · f (x) dx = 51 0 x · e−x/5 dx

∞

R∞

1

−x/5 ) − − 0 e−x/5 dx

= 5 · x · (−5e

0

∞

= 0 + −5e−x/5 = 0 + 5 = 5

EX =

R∞

−∞

0

Allgemeiner

Ist

X

exponentialverteilt mit Parameter

Z

∞

x · ke

EX =

0

−kx

dx =

lim

b→∞

k,

so ist

−x e−kx −

1 −kx

e

k

b

= 1

k

0

wahrscheinlichkeit13.pdf, Seite 39

Linearität des Erwartungswertes

Sind

X

und

Y

Zufallsvariablen und ist

E (X + Y ) = E (X ) + E (Y )

Beispiel zwei Würfel: Stellen

X

c ∈ R,

sowie

und

Y

so gilt

E (cX ) = cE (X ).

die Augenzahl jeweils

eines Würfels dar, so gilt für die Augensumme

E (X + Y ) = EX + EY = 3, 5 + 3, 5 = 7.

Verallgemeinerung

E (c1 X1 + ... + cn Xn ) = c1 EX1 + ... + cn EXn

für Zufallsvariablen

X1 , ..., Xn

und

c1 , ..., cn ∈ R.

Monotonie des Erwartungswertes

X ≤ Y ⇒ EX ≤ EY .

wahrscheinlichkeit13.pdf, Seite 40

Satz

Ist

X

g : R → R eine (stetige)

g (X ) = g ◦ X : Ω → R wieder eine

eine Zufallsvariable und

Funktion, so ist durch

Zufallsvariable deniert.

Für deren Erwartungswert gilt

P

Eg (X ) =

Beispiel: (1) Ist

i g (xi ) · P(X = xi ),

R∞

g (x) · f (x) dx,

−∞

X

falls

X

diskret ist,

falls

X

die Dichte

f

hat

die Augenzahl eines Würfels, so gilt

E (X 2 ) = 1 · 16 + 4 · 16 + 9 · 16 + 16 · 16 + 25 · 61 + 36 · 16 =

X gleichverteilt in [0; 1],

1

R1 3

1 4

3

EX = 0 x dx = 4 x = 41

(2) Ist

91

6

= 15, 16.

so ist

0

wahrscheinlichkeit13.pdf, Seite 41

Varianz

Die Varianz (mittlere quadratische Abweichung)

Var(X )

= V (X ) = σ 2

einer Zufallsvariable

die Streuung der Werte von

µ = E (X ).

X

X

ist ein Maÿ für

um dem Erwartungswert

Sie ist deniert als

σ 2 = σX2 = Var(X ) = E (X − µ)2 = E X 2 − (EX )2 ≥ 0.

p

Die Standardabweichung ist deniert als σ = σX =

Var(X ).

Bemerkung

Die Varianz

σ2

Erwartungswert

einer diskreten Zufallsvariable mit

µ

kann auf zweierlei Weise berechnet werden:

hP

i

2

P(X

=

x

)

·

x

− µ2

σ 2 = E (X 2 ) − µ2 =

i

i

i

P

σ 2 = E (X − µ)2 = i P(X = xi ) · (xi − µ)2

oder

Beide Rechnungen liefern (natürlich) das selbe Ergebnis.

wahrscheinlichkeit13.pdf, Seite 42

Beispiel

Für die Varianz der Augenzahl eines fairen Würfels erhält man

I

I

2

2

σ2 =

E (X ) − (EX )

1

2

2

3

2

2

2

·

1 +2 +3 +4 +5 +6

−

6

3

1 2

2

= 61 · 91 − 12 14 = 15 16 − 12 41 = 35

12 = 2, 916

P

2

2

2

σ =E

(X − µ) = i P(X = xi ) · (xi − µ)

=

1

6

· (1 − 3, 5)2 + (2 − 3, 5)2 + (3 − 3, 5)2

+ (4 − 3, 5)2 + (5 − 3, 5)2 + (6 − 3, 5)2

=

=

1

6

1

6

· (6, 25 + 2, 25 + 0, 25 + 0, 25 + 2, 25 + 6, 25)

· 17, 5 =

35

12

Die Standardabweichung wird dann in jedem Fall als

und hat den Wert

σ=

√

σ=

√

σ2

σ 2 ≈ 1, 708.

wahrscheinlichkeit13.pdf, Seite 43

Weiteres Beispiel

Beim Werfen eines Würfels betrage der Gewinn 6 Euro bei

einer gewürfelten 6 und 2 Euro, falls die gewürfelte Augenzahl

ungerade (d. h. 1, 3 oder 5) ist. Bei einer 2 oder 4 ist der

Gewinn Null.

Ist

X

X

die Zufallsvariable, die den Gewinn beschreibt, so kann

die Werte 0, 2 und 6 annehmen mit

P(X = 6) =

1

6,

P(X = 2) =

3

6

=

1

2 und

P(X = 0) =

2

6

=

1

3.

Es folgt

µ = EX =

1

3

· 0 + 12 · 2 + 61 · 6 = 2

Der Erwartungswert des Gewinns entspricht einem fairen

Einsatz, bei dem keiner der beteiligten Spieler einen

strukturellen Vorteil hätte.

wahrscheinlichkeit13.pdf, Seite 44

Fortsetzung Beispiel

Zur Berechnung der Varianz

2

E (X )

σ2

des Gewinns kann zunächst

berechnet werden:

E (X 2 ) =

1

3

· 02 + 21 · 22 + 16 · 62 = 0 + 2 + 6 = 8

⇒ σ 2 = E (X 2 ) − µ2 = 8 − 22 = 4.

Alternativ kann gerechnet werden

σ 2 = E (X − µ)2 = 31 (0 − 2)2 + 12 (2 − 2)2 + 61 (6 − 2)2

=

4

3

+0+

16

6

=

12

3

=4

Für die Standardabweichung gilt

σ=

√

4

= 2.

wahrscheinlichkeit13.pdf, Seite 45

Varianz von Zufallsvariablen mit Dichte

f (x)

Auch hier gibt es analog zwei Rechenwege:

R∞

σ 2 = E (X 2 ) − (EX )2 = ∞ x 2 · f (x) dx − µ2

R∞

σ 2 = E (X − µ)2 = ∞ (x − µ)2 · f (x) dx

oder

Beispiel Gleichverteilung

Ist

X

die Gleichverteilung im Intervall [0; 10], so hat

Dichte

X

die

≤ x ≤ 10,

x < 0 oder x > 10

10

R 10

1 2

x = 5 − 0 = 5.

µ = EX = 0 x · 0, 1 dx = 20

f (x) =

Es folgt

1

10 ,

0,

falls 0

falls

0

wahrscheinlichkeit13.pdf, Seite 46

Berechnung der Varianz im Beispiel

Mit

Z

2

10

2

x · 0, 1 dx =

E (X ) =

0

1

10

1 3 10

· x 3

0

=

1000

= 33, 3

30

erhält man

σ 2 = V (X ) = E (X 2 ) − µ2 = 33, 3 − 52 =

25

3

= 8, 3.

Alternativ rechnet man (mit linearer Substitution)

2

2

Z

σ = E (X − µ) =

0

Die

(x − 5)2 ·

1

10

dx =

1

30 (x

10

− 5)3 0

25

1

· (−53 ) = 2 · 30

· 125 =

3

q

25

√5

Standardabweichung ist σ =

3 = 3 ≈ 2, 887.

=

1

30

· 53 −

10

1

30

wahrscheinlichkeit13.pdf, Seite 47

Weiteres Beispiel

X exponentialverteilt mit Parameter k = 1, so ist

EX = k1 = 1 und

∞

R ∞ 2 −x

2

2

−x E (X ) = 0 x · e dx = −(x + 2x + 2) · e Ist

0

= 0 − (−2) = 2

Es folgt

(mit zweimaliger partieller Integration)

V (X ) = E (X 2 ) − (EX )2 = 2 − 1 = 1

Bemerkung

Ebenso wie nicht jede Zufallsvariable einen Erwartungswert

hat, hat auch nicht jede Zufallsvariable eine endliche Varianz.

Die Varianz ist nur deniert, wenn der Erwartungswert

µ = EX

deniert ist und

EX 2

endlich ist, d. h. die zugehörige

Summe bzw. das uneigentliche Integral konvergiert.

wahrscheinlichkeit13.pdf, Seite 48

Varianz transformierter Zufallsvariablen

Für eine Zufallsvariable

X

und eine Konstante

d ∈R

gilt

V (X + d) = V (X ),

d. h. eine Verschiebung ändert die Varianz nicht.

Weiter gilt für

c ∈R

V (c · X ) = c 2 · V (X ),

d. h. eine Skalierung um den Faktor

c

wirkt sich quadratisch

auf die Varianz aus, die Standardabweichung ändert sich

entsprechend um den Faktor

|c|.

Allgemein gilt damit

V (c · X + d) = c 2 · V (X )

für

c, d, ∈ R.

wahrscheinlichkeit13.pdf, Seite 49

Beispiel

Ist X die Augenzahl eines Würfels und beträgt der Gewinn

G = 5X − 18 die fünache Augenzahl minus einem Einsatz

von 18 Euro, so ist die Varianz des Gewinns

35

V (G ) = V (5X − 18) = 52 · V (X ) = 25 · 12

≈ 72, 9,

p

V (X ) ≈ 8, 54.

die Standardabweichung ist σ =

Dabei hat der Einsatz keinen Einuss auf Varianz und

Standardabweichung.

Standardisierung

Ist

X

eine Zufallsvariable mit Erwartungswert

Varianz

V (X ) = σ

2

EX = µ

und

, so hat die standardisierte Zufallsvariable

Z=

X −µ

σ

Erwartungswert 0 und Varianz 1.

wahrscheinlichkeit13.pdf, Seite 50

Weiteres Beispiel

Ist

X

gleichverteilt in [0; 1], so ist

E (X 2 ) =

R1

0

x 2 dx =

1

3

⇒ V (X ) =

EX =

1

3

−

1

2 und

1 2

1

= 12

.

2

a, b ∈ R ist die Zufallsvariable

Y = a + (b − a) · X gleichverteilt im Intervall [a, b],

Für beliebige

Es ist

EY = a + (b − a) ·

Insbesondere ist für

1

2

=

b = −a =

b−a

2

und

V (Y ) =

(b−a)2

√

3 die im Intervall

12

[−

.

√

3;

√

3]

gleichverteilte Zufallsvariable

X−

Z=√

1

2

1/12

=

√

12

·X −

1

2

√

12

√

√

=− 3+2· 3·X

standardisiert.

wahrscheinlichkeit13.pdf, Seite 51

Unabhängigkeit

Zwei Zufallsvariablen

beliebige Teilmengen

P(X ∈ A

und

X und Y sind

A, B ⊂ R gilt

unabhängig, wenn für

Y ∈ B) = P(X ∈ A) · P(Y ∈ B).

Satz

I

I

I

X und Y sind genau dann unabhängig, wenn für alle

x, y ∈ R gilt

P(X ≤ x und Y ≤ y ) = P(X ≤ x) · P(Y ≤ y ).

Zwei diskrete Zufallsvariablen X und Y sind genau dann

unabhängig, wenn für alle x, y gilt

P(X = x und Y = y ) = P(X = x) · P(Y = y ).

Sind X und Y unabhängig, so auch g (X ) und h(Y ) für

Funktionen g und h .

wahrscheinlichkeit13.pdf, Seite 52

Bemerkung

In Anwendungen muss die Unabhängigkeit von Zufallsvariablen

in der Regel nicht nachgerechnet werden, sondern ist eine

Konsequenz von Modellannahmen.

Wenn aus dem Modell hervorgeht, dass der Wert einer

Zufallsvariable

X

keinen Einuss auf die Verteilung einer

anderen Zufallsvariablen

Y

hat, so werden

X

und

Y

als

unabhängig angenommen.

Beispiel

Bezeichnen

X

und

Y

die jeweiligen Augenzahlen zweier

Würfel, so werden sie (in der Regel) als unabhängig

vorausgesetzt. Unter dieser Annahme lassen sich dann weitere

Wahrscheinlichkeiten wie z. B. die Verteilung der Augensumme

X +Y

berechnen.

wahrscheinlichkeit13.pdf, Seite 53

Satz

Sind

X und Y unabhängig, so gilt E (X · Y ) = E (X ) · E (Y )

V (X + Y ) = V (X ) + V (Y ).

sowie

Beispiel

Die Augensumme zweier Würfel hat die Varianz

und die Standardabweichung

σ=

q

35

6

35

12

+

35

12

= 5 56

≈ 2, 415

(da die Augenzahl eines Würfels Varianz

35

12 hat).

Warnungen

I Während

E (X + Y ) = EX + EY

für beliebige

Zufallsvariablen gilt, setzten die Gleichungen

E (X · Y ) = EX · EX

Unabhängigkeit von

V (X + Y ) = V (X ) + V (Y )

X und Y voraus.

und

die

I Da die Standardabweichung mit Hilfe der nichtlinearen

Wurzelfunktion berechnet wird, gilt nicht

σX +Y = σX + σY

wahrscheinlichkeit13.pdf, Seite 54

Erweiterung

Sind

X1 , X2 , ..., Xn

unabhängige Zufallsvariablen, so gilt

V (X1 + X2 + ... + Xn ) = V (X1 ) + V (X2 ) + ... + V (Xn )

Beispiel

Die Augensumme von 12 Würfeln hat

· 3, 5 = 42, Varianz

√

Standardabweichung

35 ≈ 5, 916.

Erwartungswert 12

12

·

35

12

= 35

und

Die Augensumme von 420 Würfeln hat Erwartungswert 1470,

Varianz 1225 und Standardabweichung 35.

Betrachtet man dagegen die 12fache Augenzahl 12X eines

V (12X√) = 122 · V (X ) = 420

σ12X = 420 ≈ 20, 49.

Würfels, so gilt für die Varianz

und die Standardabweichung

wahrscheinlichkeit13.pdf, Seite 55

Beispiel: 2 Würfel

X

Beschreiben

und

Y

die Augenzahl jeweils eines Würfels, so

folgt aus der Unabhängigkeit, dass für das Produkt

XY

der

und

Z

Augenzahlen gilt

E (XY ) = E (X ) · E (Y ) = 3, 52 = 12, 25

Ist

Z

die Zufallsvariable mit

Z=

1,

falls beide Augenzahlen gerade,

0

sonst

, so sind

X

nicht unabhängig.

Es ist

EZ = 0 · P(Z = 0) +· P(Z = 1) = 0 · 34 + 1 ·

E (X · Z )

1

4

=

1

4.

bestimmt man wie folgt: Mit Wahrscheinlichkeit

1

jeweils

12 ist

X · Z = 2,

4 bzw. 6 (erster Würfel 2, 4 oder 6

und zweiter Würfel gerade), in allen anderen Fällen ist

X · Z = 0.

Es folgt

E (X · Z ) =

1

12

·2+

1

12

·4+

1

12

· 6 + 34 · 0 = 1 6= E (X ) · E (Z ).

wahrscheinlichkeit13.pdf, Seite 56

Die Kovarianz

zweier beliebiger Zufallsvariablen

Cov(X , Y )

Sind

X

und

Y

X

und

Y

ist deniert als

= E (X · Y ) − E (X ) · E (Y )

unabhängig, so ist

E (XY ) = E (X ) · E (Y ) ⇒ Cov(X , Y ) = 0.

Die Umkehrung gilt nicht allgemein, zwei Zufallsvariablen mit

Kovarianz 0 müssen nicht unabhängig sein.

X

und

Y

heiÿen unkorreliert, falls Cov(X , Y )

korreliert, falls Cov(X , Y )

Cov(X , Y )

>0

= 0,

positiv

und negativ korreliert, falls

< 0.

wahrscheinlichkeit13.pdf, Seite 57

Satz

Für beliebige Zufallsvariablen

I

I

X

und

Y

gilt

V (X + Y ) = V (X ) + V (Y ) + 2Cov(X , Y )

2

Cov(X , Y ) ≤ V (X ) · V (Y )

mit Gleichheit genau dann, wenn eine der beiden

Zufallsvariablen konstant ist oder es Konstanten

gibt, sodass

c, d ∈ R

Y = cX + d .

Der Korrelationskoezient

zweier Zufallsvariablen mit

Standardabweichungen

σX

X

und

und

σY

ρ(X , Y ) = ρXY =

Y

mit

ist deniert als

Cov(X , Y )

σX · σY

wahrscheinlichkeit13.pdf, Seite 58

Beispiel

X

und

Y

bezeichnen die Augenzahlen zweier Würfel,

Zufallsvariable mit

und

Z =0

Dann ist

Cov(X , Z )

die

falls beide Augenzahlen gerade sind

sonst.

= E (XZ ) − E (X )E (Z ) = 1 − 27 ·

Folglich sind

Mit

Z =1

Z

V (X ) =

X

und

35

12 und

Z

1

4

=

1

8

= 0, 125.

positiv korreliert.

V (Z ) =

ρXY = q

3

16 folgt weiter

1

8

35

12

1

·

3

16

=√

35

≈ 0, 169

wahrscheinlichkeit13.pdf, Seite 59

Eigenschaften

I Cov(X , Y )2

≤ V (X ) · V (Y )

besagt, dass der

Korrelationskoezient immer zwischen

I

−1

und 1 liegt.

ρXY = 1 bedeutet eine positive lineare Korrelation der

Y = cX + d mit c > 0, ρXY = −1 eine negative

lineare Korrelation Y = cX + d mit c < 0.

Ein Korrelationskoezient nahe 1 oder −1 bedeutet, dass

zwischen X und Y annähernd ein linearer

Form

Zusammenhang besteht.

I Mit den standardisierten Zufallsvariablen

Ŷ =

X̂ =

X −EX

und

σX

Y −EY

ist

σY

ρXY = Cov(X̂ , Ŷ ) = ρ(X̂ , Ŷ ).

wahrscheinlichkeit13.pdf, Seite 60

Verteilungsfunktion

Ist

X

eine Zufallsvariable mit der Dichte

F (x) =

Rx

−∞

f (ξ) dξ

Damit gilt für

eine Stammfunktion von

a, b ∈ R

mit

Die oben denierte Funktion

stetigen Zufallsvariale

x ∈R

ist

F (x) =

X.

Rx

−∞

so ist

f (x).

a<b

P(a < X < b) = P(a ≤ X ≤ b) =

Für

f (x),

F (x)

Rb

a

f (x) dx = F (b) − F (a).

heiÿt Verteilungfunktion der

f (ξ) dξ = P(X ≤ x).

Beispiel

Eine in [0, 1] gleichverteilte Zufallsvariable hat die

Verteilungsfunktion

F (x) =

0

für

x

für

1

für

x ≤ 0,

0 < x < 1,

x ≥1

wahrscheinlichkeit13.pdf, Seite 61

Verteilungsfunktion

F (x)

einer im Intervall [0, 1]

gleichverteilten Zufallsvariable

wahrscheinlichkeit13.pdf, Seite 62

Weitere Beispiele

I Eine in

[a, b]

gleichverteilte Zufallsvariable hat die

Verteilungsfunktion

F (x) =

0

x−a

b−a

1

für

für

für

x ≤ a,

a < x < x,

x ≥b

I Eine exponentialverteilte Zufallsvariable mit Parameter

k > 0 hat

R x die Verteilungsfunktion

F (x) = 0 k e−kξ dξ = 1 − e −kx für x ≥ 0

I Für die Verteilungsfunktion

Z

x

Φ(x) =

−∞

1

√

2π

e

−ξ 2 /2

dξ

de Standardnormalverteilung lässt sich kein expliziter

Ausdruck angeben.

wahrscheinlichkeit13.pdf, Seite 63

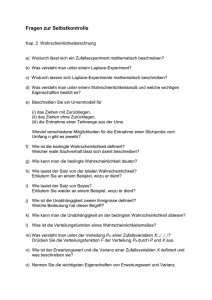

Verteilungsfunktion der Exponentialverteilung

F (x) = 1 − e −kx

für

k = 5, k = 1

und

k = 0, 2.

wahrscheinlichkeit13.pdf, Seite 64

Verteilungsfunktion der Standardnormalverteilung

wahrscheinlichkeit13.pdf, Seite 65

Verteilungsfunktion einer diskreten Zufallsvariable

Durch

F (x) = P(X ≤ x)

kann die Verteilungsfunktion für

beliebige reellwertige, also auch diskrete, Zufallsvariablen

deniert werden.

Beispiel Augensumme

Ist

x < 2,

Für 2

so gilt

≤x <3

X

zweier Würfel

F (x) = P(X ≤ x) = 0.

ist

F (x) = P(X ≤ x) = P(X = 2) =

≤x <4

F (x) = P(X ≤ x) = P(X = 2) + P(X = 3) =

Für 3

ist

...

Für

x ≥ 12

Somit hat

ist

3

36

1

36 .

=

1

12 .

F (x) = P(X ≤ 12) = 1.

F (x)

an den Stellen

x = 2, 3, 4, ..., 12

jeweils eine

Sprungstelle und ist zwischen diesen Sprungstellen konstant.

wahrscheinlichkeit13.pdf, Seite 66

Verteilungsfunktion Augensumme zweier Würfel

F (x)

hat Sprungstellen an den Stellen

x = 2, 3, 4, ..., 12

und

ist auf den Intervallen dazwischen jeweils konstant.

wahrscheinlichkeit13.pdf, Seite 67

Eigenschaften von Verteilungsfunktionen

Für die Verteilungsfunktion

F (x)

F

einer beliebigen

X gilt

0 ≤ F (x) ≤ 1 für alle x ∈ R

x 7→ F (x) ist monoton wachsend.

Zufallsvariable

I

I

F (x)

F (x) existieren für alle x0 ∈ R und es ist

F (x0 ) = limx→x + F (x) (F ist rechtsseitig stetig).

limx→−∞ F (x) = 0 und limx→∞ F (x) = 1.

I Die rechts- und linksseitigen Grenzwerte limx→x +

0

und limx→x0 −

0

I

Bemerkungen

I Jede Funktion mit den obigen Eigenschaften ist

Verteilungsfunktion einer Zufallsvariable.

I Jede reellwertige Zufallsvariable besitzt eine

Verteilungsfunktion.

wahrscheinlichkeit13.pdf, Seite 68

Weitere Eigenschaften

a < b ist

P(X ∈ (a, b]) = P(a < X ≤ b) = F (b) − F (a)

(denn P(a < X ≤ b) = P(X ≤ b) − P(X ≤ a))

Für alle x0 ∈ R ist

I Für

I

P(X = x0 ) =

lim F (x)− lim F (x)

x→x0 +

x→x0 −

= F (x0 )−

lim F (x)

x→x0 −

Folgerung

I

F

x0 , wenn P(X = x0 ) = 0 gilt.

F an der Stelle x0 eine Sprungstelle, so entspricht

P(X = x0 ) der Sprunghöhe.

F ist genau dann stetig auf R, wenn P(X = x) = 0 für

alle x ∈ R.

In diesem Fall ist F Verteiungsfunktion einer stetigen

ist genau dann stetig in

Hat

I

Zufallsvariablen.

wahrscheinlichkeit13.pdf, Seite 69

Bemerkungen

I Nicht jede stetige Zufallsvariable besitzt eine Dichte

Ist die Verteilungsfunktion

F (x)

von

X

f (x).

(eventuell mit

Ausnahme endlich vieler Punkte, die dann die

Sprungstellen von f sind) dierenzierbar, so ist

f (x) = F 0 (x) Dichte von X .

Es gibt aber auch Zufallsvariablen, deren

Verteilungsfunktionen stetig, aber nicht dierenzierbar

sind.

Die für Anwendungen wichtigsten Zufallsvariablen sind

jedoch entweder diskret oder haben eine Dichte.

X stetig, so gilt P(X = x) = 0 für alle x ∈ R. Für

a < b folgt dann

P (a, b) = P(a < X < b) = P [a, b] = P(a ≤ X ≤ b)

= P (a, b] = P [a, b) = F (b) − F (a).

I Ist

wahrscheinlichkeit13.pdf, Seite 70

Zusammenfassung

(Berechnung von Wahrscheinlichkeiten)

X eine Zufallsvariable

für a, b ∈ R mit a < b :

Ist

P(X ≤ b) = F (b),

sowie

Ist

X

mit Verteilungsfunktion

F (x),

so gilt

P(a < X ≤ b) = F (b) − F (a)

P(X > a) = 1 − F (a).

stetig, so kann < und > durch ≤ und ≥ ersetzt

werden und umgekehrt.

Im allgemeinen Fall ist

P(a ≤ X ≤ b) = F (b) − F (a) + P(X = a),

P(a < X < b) = F (b) − F (a) − P(X = b),

P(X < b) = F (b) − P(X = b)

und

P(X ≥ a) = 1 − F (a) + P(X = a).

wahrscheinlichkeit13.pdf, Seite 71

Gesetz der groÿen Zahlen Beispiel

Für die Augensumme

Sn = X1 + ... + Xn

beim

nmaligen

Würfeln gilt

ESn =

n

X

EXi = n · 3, 5

und

V (Sn ) =

i=1

und

EX =

1

n

V (X ) =

V (Xi ) = n ·

i=1

Für die durchschnittliche Augenzahl

folgt

n

X

X = n1 Sn =

1

n

35

12

· (X1 + ... + Xn )

· ESn = 3, 5 = EX1 = ... = EXn

1

n2

· V (Sn ) =

1

n

·

35

12

Für die Standardabweichung erhält man

σX =

q

V (X ) =

√1

n

·

q

35

12

→0

für

n→∞

wahrscheinlichkeit13.pdf, Seite 72

Gesetz der groÿen Zahlen Voraussetzungen

Sie

(Xi )

eine Folge unabhängiger identisch verteilter (iid)

Zufallsvariablen mit Erwartunswert

σ 2 < ∞.

(d. h.

X1 , X2 , X3 ,

µ∈R

und Varianz

... haben alle die gleiche Verteilung und

insbesondere den gleichen Erwartungswert, unabhängig

bedeutet

P(X1 ∈ A1 ; X2 ∈ A2 ; ...; Xk ∈ Ax )

= P(X1 ∈ A1 ) · P(X2 ∈ A2 ) · ... · P(Xk ∈ Ak )

für beliebige

k

und

A1 , ..., Ak ∈ R)

Das arithmetische Mittel

Xn =

1

n

ist dann für alle n

2

µ und Varianz σn .

n

X

i=1

≥1

Xi =

1

n

(X1 + X2 + ... + Xn )

eine Zufallsvariable mit Erwartungswert

wahrscheinlichkeit13.pdf, Seite 73

Gesetz der groÿen Zahlen Satz

ε > 0 gilt

1

(X1 + X2 + ... + Xn ) − µ ≥ ε = 0,

lim P

n

n→∞

Für beliebiges

d. h. die Folge

(X n )

konvergiert stochastisch bzw. in

Wahrscheinlichkeit gegen

µ.

Der Beweis

erfolgt mit Hilfe der Ungleichung von Tschebysche.

wahrscheinlichkeit13.pdf, Seite 74

Bemerkungen

I Das Gesetz der groÿen Zahlen gilt auch noch unter

schwächeren Voraussetzungen, wo die

Xi

nicht

unabhängig und/oder nicht identisch verteilt sind.

I Das starke Gesetz der groÿen Zahlen besagt

X n = µ fast sicher (mit Wahrscheinlichkeit 1),

X n (ω) = µ für alle ω aus einer Teilmenge Ω̃

des

Wahrscheinlickeitsraumes Ω mit

zugrundeliegenden

P Ω̃ = 1.

limn→∞

d. h. limn→∞

wahrscheinlichkeit13.pdf, Seite 75

Bemerkung und Beispiel

Eine Zufallsvariable

X

mit Dichte

heiÿt (standard)Cauchyverteilt.

Sind

X1 , X2 ,

n≥1

f (x) =

1

π

·

1

1+x 2 für

x ∈R

... unabhängig und Cauchyverteilt, so ist für alle

auch

X n = n1 (X1 + ... + Xn )

standardCauchyverteilt.

Insbesondere gilt das Gesetz der groÿen Zahlen nicht für

Cauchyverteilte Zufallsvariablen. Dies liegt daran, dass diese

keinen Erwartungswert haben (das entsprechende uneigentliche

R∞

Integral

x · f (x) dx divergiert).

−∞

wahrscheinlichkeit13.pdf, Seite 76

Erweiterung: Hauptsatz der Statistik

X1 ,

Zu Zufallsvariablen

...,

Xn

ist die empirische

Verteilungsfunktion deniert als

F n (x) =

1

mal Anzahl der

n

Für festes

x

ist

F n (x)

Xi

relativen Anteil der

Xi

mit

Xi < x .

eine Zufallsvariable. Sie gibt den

wieder, deren Wert

≤x

ist.

Satz

Sind die

Xi

unabhängig und identisch verteilt mit

F (x), so gilt für festes x ∈ R

P F n (x) − F (x) > ε = 0,

Verteilungsfunktion

lim

n→∞

F n nähern

Verteilungsfunktion F an.

d. h. die empirischen Verteilungsfunktionen

n→∞

der erwarteten

und

ε>0

sich für

wahrscheinlichkeit13.pdf, Seite 77

Beispiel

Empirische Verteilungsfunktion

F 5 (x)

einer

exponentialverteilten Zufallsvariable mit Parameter

λ = 1.

wahrscheinlichkeit13.pdf, Seite 78

Hauptsatz der Statistik

F 50 (x)

und theoretische Verteilungsfunktion

F (x) = 1 − e−x .

wahrscheinlichkeit13.pdf, Seite 79