Kapitel 5 Lastmodelle

Werbung

Werner Sandmann: Modellierung und Analyse

Kapitel 5

Lastmodelle

5–1

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

Wozu Lastmodelle?

Bisher: Modelle für Systemstruktur bei gegebenen Verteilungen von Zeiten.

Verteilungen sollten natürlich adäquat das gegebene System modellieren.

Neben der Systemstruktur also Verkehrscharakteristika wichtig

➸ In welcher Form kommen Kunden/Aufträge in das System?

☞ Wieviele Kunden in bestimmtem Zeitraum?

☞ Welche zeitliche Abstände?

☞ Unabhängige Abstände?

→ Zwischenankunftszeitverteilungen → Ankunftsprozesse

➸ Was wollen die Kunden?

☞ Welche Art von Dienstanforderungen?

☞ Welche Auftragsgrößen?

☞ Unabhängige Auftragsgrößen?

→ Bedienzeitverteilungen

5–2

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

Modellierung von Verkehrscharakteristika

Adäquate Modellierung erfordert (falls möglich) Berücksichtigung von Erfahrungswerten

➸ Meßdaten, empirische Daten des zu untersuchenden Systems (falls System existiert

und Messungen möglich sind)

➸ Meßdaten, empirische Daten verwandter Systeme

(falls System nicht existiert, im Entwurf ist oder keine Messungen möglich sind)

➸ Expertenwissen, Erwartungen bzgl. des Verkehrs

Resultierende Fragestellungen

➸ Welcher Verteilungstyp modelliert die Daten adäquat?

→ Auswahl einer Verteilungsfamilie

➸ Welche Parameter hat die Verteilung?

→ Parameterschätzung

➸ Wie gut paßt die Verteilung zu den Daten?

→ Statistische Anpassungstest

5–3

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

Abschnitt 5.1

Ankunftsprozesse

5.1 Ankunftsprozesse

5–4

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.1 Ankunftsprozesse

Zählprozesse

Ankunftsprozesse sollen Ankünfte zählen.

Definition: Zählprozeß

Ein stochastischer Prozeß (Nt)t≥0 mit Werten in IN (also zustandsdiskret und

zeitstetig) heißt Zählprozeß, wenn

➸ N0 = 0,

➸ s < t ⇒ Ns ≥ Nt

(monoton wachsend),

➸ Nt − Ns = Anzahl der Ereignisse im Intervall (s, t].

Bei Ankunftsprozessen: Ereignisse = Ankünfte

➸ Zufallsvariable Nt ist die Gesamtzahl der Ankünfte bis zum Zeitpunkt t.

➸ Zufallsvariable Nt − Ns ist die Anzahl der Ankünfte im Intervall (s, t].

5–5

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.1 Ankunftsprozesse

Unabhängige und stationäre Zuwächse

Definition: Unabhängige Zuwächse

Ein stochastischer Prozeß (Nt)t≥0 hat unabhängige Zuwächse, wenn Ereignisse, die in nichtüberlappenden Zeitintervallen auftreten, unabhängig sind, d.h

für nichtüberlappende Intervalle (t1, t2), (t3, t4), . . . , (tn−1, tn) sind die Zufallsvariablen Nt2 − Nt1 , Nt4 − Nt3 , . . . , Ntn − Ntn−1 unabhängig.

Definition: Stationäre Zuwächse

Ein stochastischer Prozeß (Nt)t≥0 hat stationäre Zuwächse, wenn die Verteilung der Anzahl von Ereignissen in einem Intervall nur von der Länge des

Intervalls abhängt, d.h. für alle h > 0 und s, t > 0 mit s < t sind Nt − Ns

und Nt+h − Ns+h identisch verteilt.

Ein spezieller Zählprozeß mit unabhängigen und stationären Zuwächsen ist der

→ Poissonprozeß.

5–6

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.1 Ankunftsprozesse

5.1.1 Poissonprozesse

Definition: Poissonprozeß

Ein Zählprozeß (Nt)t≥0 mit unabhängigen und stationären Zuwächsen ist ein

Poissonprozeß mit Rate λ > 0, wenn die Wahrscheinlichkeit, daß genau ein

Ereignis in einem Intervall der Länge h auftritt, gleich λh + o(h) ist und die

Wahrscheinlichkeit, daß mehr als ein Ereignis in einem Intervall der Länge h

auftritt, gleich o(h) ist. Also

P (Nh = 1) = λh + o(h),

P (Nh > 1) = o(h).

Beachte: Wegen unabhängigen stationären Zuwächsen ist Intervall (0, h] spezielles aber

repräsentatives Intervall, also für alle h, t > 0

P (Nh = 1) = P (Nt+h − Nt = 1) = λh + o(h),

P (Nh > 1) = P (Nt+h − Nt > 1) = o(h).

5–7

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.1 Ankunftsprozesse

Erinnerung an Klein–Oh

Informell: Eine Größe ist gegenüber einer anderen Größe klein.

Formal f ist Klein–Oh von h“

”

f (h)

= 0.

h→0 h

¯

¯

¯ f (h) ¯

¯ < ǫ.

∀ǫ > 0 ∃δ > 0 : 0 < |h| < δ ⇒ ¯¯

h ¯

f = o(h) :⇔ lim

Das bedeutet

Beispiele

f (h)

h

= lim = 1 6= 0.

h→0 h

h→0 h

➸ Für f (x) = x ist f 6= o(h), denn lim

2

f

(h)

h

➸ Für f (x) = x2 ist f = o(h), denn lim

= lim

= lim h = 0.

h→0 h

h→0 h

h→0

f (h)

hr

➸ Für f (x) = x , r > 1 ist f = o(h), denn lim

= lim

= lim hr−1 = 0.

h→0 h

h→0 h

h→0

r

5–8

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.1 Ankunftsprozesse

Rechnen mit Klein–Oh

➸ Summe (damit auch Differenz)

Falls f = o(h) und g = o(h), dann f + g = o(h), denn

f (h) + g(h)

f (h)

g(h)

= lim

+ lim

= 0 + 0 = 0.

h→0

h→0 h

h→0 h

h

lim

➸ Multiplikation mit konstantem Faktor

Falls f = o(h) und c ∈ IR, dann c · f = o(h), denn

c · f (h)

f (h)

lim

= c · lim

= c · 0 = 0.

h→0

h→0 h

h

➸ Endliche Linearkombination

Falls f1 = o(h), . . . , fn = o(h) und c1, . . . , cn ∈ IR, dann (per Induktion)

n

X

ci · fi = o(h).

i=1

5–9

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.1 Ankunftsprozesse

Zurück zum Poissonprozeß

Nach Definition

➸ Wahrscheinlichkeit für genau eine Ankunft in einem Intervall der Länge h

P (Nh = 1) = λh + o(h).

➸ Wahrscheinlichkeit für mehr als eine Ankunft in einem Intervall der Länge h

P (Nh > 1) = o(h).

Damit Wahrscheinlichkeit für keine Ankunft in einem Intervall der Länge h

P (Nh = 0) = 1 − P (Nh = 1) − P (Nh > 1)

= 1 − λh − o(h) − o(h)

= 1 − λh + o(h).

Naheliegende Fragestellung

Wie sieht die Verteilung der Anzahl von Ankünften genau aus?

Der Clou: Berechnung mit Hilfe von Ableitungen → Differentialgleichungssystem.

5–10

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.1 Ankunftsprozesse

Wahrscheinlichkeit für keine Ankunft

Wegen unabhängigen und stationären Zuwächsen oBdA Intervall (0, t] mit t > 0.

Kurzschreibweise: Pn(t) := P (Nt = n),

n ∈ IN.

P0(t + h) = P0(t) · P (Nt+h − Nt = 0)

= P0(t) · P (Nh = 0)

= P0(t) · (1 − λh + o(h)).

Damit also

o(h)

P0(t + h) − P0(t)

= −λP0(t) +

h

h

−→ 0.

Grenzwert für h → 0 ist gerade die Ableitung, also (beachte zudem P0(0) = 1)

P0′ (t)

= −λP0(t)

⇒ P0(t) = e−λt.

Nur die Exponentialfunktion

f (x) = e−cx erfüllt

f ′(x) = −cf (x), f (0) = 1.

5–11

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.1 Ankunftsprozesse

Wahrscheinlichkeit für n Ankünfte

Jetzt n > 0. Dann können genau n Ankünfte bis t + h auf drei verschiedene Arten

auftreten.

➸ n Ankünfte bis zur Zeit t und keine Ankunft in (t, t + h],

➸ n − 1 Ankünfte bis zur Zeit t und genau eine Ankunft in (t, t + h],

➸ n − k, 1 < k ≤ n Ankünfte bis zur Zeit t und genau k Ankünfte in (t, t + h].

Summe der Wahrscheinlichkeiten

Pn(t + h) = Pn(t) · (1 − λh + o(h)) + λhPn−1(t) + o(h)

= Pn(t) − λhPn(t) + o(h)Pn(t) + λhPn−1(t) + o(h)

= Pn(t) − λhPn(t) + λhPn−1(t) + o(h)Pn(t) + o(h)

|

{z

}

o(h)

Also

Pn(t + h) − Pn(t)

o(h)

= −λPn(t) + λPn−1(t) +

.

h

h

5–12

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.1 Ankunftsprozesse

WK für n Ankünfte – Fortsetzung

Grenzwert für h → 0 ist gerade die Ableitung, also

Pn′ (t)

Pn(t + h) − Pn(t)

= lim

h→0

h

= lim −λPn(t) + λPn−1(t) +

h→0

o(h)

h

= −λPn(t) + λPn−1(t).

Beachte zudem Pn(0) = 0. Dann ist wieder die Exponentialfunktion der einzige Kandidat“

”

und

e−λt(λt)n

Pn(t) =

.

n!

Der Fall n = 0 paßt als Spezialfall.

Die Verteilung kennen wir aus der W–Rechnung:

Poissonverteilung mit Parameter λt.

5–13

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.1 Ankunftsprozesse

Verteilung der Anzahl der Ankünfte

Damit haben wir also bewiesen

Satz:

Die Anzahl der Ankünfte in einem Intervall der Länge t bei einem Poissonprozeß mit Rate λ ist Poissonverteilt mit Parameter λt.

Insbesondere wissen wir aus der W–Rechnung (hier jetzt für Parameter λt):

Erzeugende Funktionen

GNt (z) =

∞

X

(λt)k

k=0

k!

e−(λt)z k = eλtz e−λt = eλt(z−1),

G′Nt (z) = λteλt(z−1)

G′′Nt (z) = (λt)2eλt(z−1)

⇒ E[Nt] = λt

und

⇒ G′(1) = λt,

⇒ G′′(1) = (λt)2

VAR[Nt] = (λt)2 + (λt) − (λt)2 = λt.

5–14

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.1 Ankunftsprozesse

Rekursion für die Poissonverteilung

Ebenfalls aus der W–Rechnung bekannt

Satz: Rekursion für die Poissonverteilung

Für Poisson-verteilte ZV Nt mit Parameter λt gilt die Rekursion

P (Nt = 0) = λe−λt,

λt

P (Nt = n + 1) =

P (Nt = n),

n+1

n = 1, 2, . . .

Beweisla

(λt)n+1 −λt

λt (λt)n −λt

λt

P (Nt = n + 1) =

e =

·

e =

P (Nt = n).

(n + 1)!

n + 1 n!

n+1

Weitere Eigenschaften der Poissonverteilung siehe Folien zu AWR.

5–15

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.1 Ankunftsprozesse

Verteilung der Zwischenankunftszeiten

Bisher: Verteilung der Anzahl von Ankünften

Jetzt: Verteilung der Zeit zwischen zwei aufeinanderfolgenden Ankünften

➸ t1, t2, t3, . . . Ankunftszeitpunkte

➸ T1 = t1, T2 = t2 − t1, T3 = t3 − t2, . . .

Zwischenankunftszeiten

Wegen unabhängiger Zuwächse sind Ankünfte, die nach tn kommen unabhängig von

Ankünften vor tn

⇒ Die Zwischenankunftszeiten sind unabhängige ZV.

Ereignis {Tn > s} tritt genau dann ein, wenn die n–te Ankunft s Zeiteinheiten nach der

(n − 1)–ten Ankunft noch nicht passiert ist

⇒ Für alle s ≥ 0 und n ≥ 1 ist {Tn > s} = {Ntn−1+s − Ntn−1 = 0}.

⇒ P (Tn ≤ s) = 1 − P (Tn > s) = 1 − P (Ntn−1+s − Ntn−1 = 0) = 1 − P (Ns = 0)

= 1 − e−λs.

Exponentialverteilung!

5–16

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.1 Ankunftsprozesse

Zusammenhänge

Da P (Tn ≤ s) = 1 − e−λs für alle n gilt, ist Index n obsolet.

Damit also bewiesen

Satz:

Die Zwischenankunftszeiten in einem Poissonprozeß mit Rate λ sind unabhängig identisch exponentiell verteilt mit Parameter λ.

Außerdem gilt auch die Umkehrung: unabhängige identisch exponentiell verteilte

Zwischenankunftszeiten implizieren einen Poissonprozeß.

Poisson–Ankunftsprozeß

Expverteilte Zwischenzeiten

Poissonprozeß mit Rate λ

⇔ Mit Parameter λ exponentiell verteilte Zwischenankunftszeiten

⇔ Mit Parameter λt verteilte Anzahl von Ankünften in einem Zeitraum t

Gedächtnislosigkeit

5–17

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.1 Ankunftsprozesse

Exponentialverteilung und Klein–Oh

Sei T exponentiell verteilt mit Parameter λ > 0.

Dann gilt Gedächtnislosigkeit: P (T ≤ t + h | T > t) = P (T ≤ h).

Andererseits gilt

P (T ≤ h) = 1 − e−λh = 1 −

= 1−

∞

X

(−λh)n

n=0

n!

Ã

1 − λh +

= λh + (λh)2 ·

= λh + o(h).

⇒ P (T ≤ t + h | T > t) = λh + o(h).

∞

X

n=2

(−λh)n

n!

∞

X

(−λh)n−2

n=2

n!

!

5–18

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.1 Ankunftsprozesse

Gleichverteilung von Ankünften

Wenn in einem Zeitraum der Länge t eine Ankunft erfolgt, wann genau in diesem Intervall?

OBdA Intervall (0, t].

Sei X die ZV, die die Ankunftszeit beschreibt.

Dann gilt für alle x mit 0 < x < t

P (X ≤ x)

=

P (T1 ≤ x|Nt = 1)

=

P (Nx = 1 ∧ Nt − Nx = 0)

P (Nt = 1)

=

P (Nx = 1) · P (Nt−x = 0)

P (Nt = 1)

=

λxe−λx e−λ(t−x) x

= .

−λt

λte

t

bed WK

Stetige Gleichverteilung!

5–19

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.1 Ankunftsprozesse

Mischen und Aufspalten von Poissonprozessen

➸ Mischen: n unabhängige Poissonprozesse aus n verschiedenen Quellen

•

λ1

•

..

λ2

..

•

λn

λ = λ1 + · · · + λn

•

Das Mischen von n unabhängigen Poissonprozessen mit Raten λ1, . . . , λn ergibt einen

Poissonprozeß mit Rate λ = λ1 + · · · + λn.

➸ Aufspalten: n Ankünfte mit WK p1, . . . , pn, p1 +· · ·+pn = 1 verteilt auf n verschiedene

Ziele

p1 λ

p2 λ

•

λ

•

..

pn λ

Das zufällige Aufspalten mit Wahrscheinlichkeiten p1, . . . , pn eines Poissonprozesses

mit Rate λ ergibt n Poissonprozesse mit Raten p1λ1, . . . , pnλn.

5–20

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.1 Ankunftsprozesse

5.1.2 Bernoulliprozesse

Betrachte Folge unabhängiger identisch verteilter diskreter ZV X1, X2, . . . mit

P (Xi = 1) = p, P (Xi = 0) = 1 − p.

Bernoulliverteilung mit Erfolgswahrscheinlichkeit p.

Sei Sn = die Anzahl der Erfolge in n unabhängigen Bernoulli–Experimenten, also

Sn = X1 + · · · + Xn.

Definition: Bernoulliprozeß

Der (zeitdiskrete) stochastische Prozeß (Sn)n∈IN+ heißt Bernoulliprozeß.

Offensichtlich: Zustandsraum S = IN (→ zustandsdiskret).

Interpretation als Ankunftsprozeß: Ankunft =

b Erfolg.

5–21

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.1 Ankunftsprozesse

Eigenschaften

Aus der W–Rechnung bekannt

➸ Anzahl bis zum ersten Erfolg ist geometrisch verteilt mit Parameter p

☞ unabhängig davon, wann man Betrachtung beginnt.

⇒ Anzahl bis zum nächsten Erfolg ist geometrisch verteilt

(geometrische Verteilung gedächtnislos).

Variante: Anzahl der Mißerfolge (um 1 kleiner)

➸ Anzahl der Erfolge in n unabhängigen Experimenten ist binomial verteilt

mit Parametern n und k.

Folgerungen für Bernoulliprozesse

➸ Anzahl der Ankünfte bis zur Zeit (b

= Schritt, Experiment) n ist binomial verteilt.

➸ Zwischenankunftszeiten sind geometrisch verteilt.

5–22

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.1 Ankunftsprozesse

Erinnerung: Geometrische Verteilung

Definition: Geometrische Verteilung

Das durch

P (X = k) = (1 − p)k−1p = q k−1p,

k = 1, 2, . . .

festgelegte W-Maß P heißt geometrische Verteilung mit Parameter p, kurz

Geo(p), und die ZV X heißt geometrisch verteilt mit Parameter p.

Satz: Rekursion für die geometrische Verteilung

Für geometrisch verteilte ZV X mit Parameter p gilt die Rekursion

P (X = 1) = p,

P (X = k + 1) = (1 − p)P (X = k),

k = 1, 2, . . .

Wir haben auch eine andere geometrische Verteilung“ kennengelernt...

”

5–23

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.1 Ankunftsprozesse

Andere geometrische Verteilung?

Oft wird auch das W-Maß, das definiert ist durch

P (X̃ = k) = (1 − p)k p = q k p,

k = 1, 2, . . .

als geometrische Verteilung bezeichnet.

Unterschied

Anders als zuvor wird nicht die Anzahl der Versuche bis zum ersten Erfolg (inklusive

dieses erfolgreichen Versuchs) gezählt, sondern nur die Anzahl der Mißerfolge, also

X̃ = X − 1.

Gemeinsamkeiten

➸ Offensichtlich können die Kenngrößen der einen Version leicht aus denen der jeweils

anderen Version berechnet werden.

➸ Der Name geometrische Verteilung“ kommt daher, daß die Einzel-WK eine geometri”

sche Folge bilden.

5–24

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.1 Ankunftsprozesse

Kenngrößen der geometrischen Verteilung

Berechnung mit Hilfe erzeugender Funktionen (Index X weggelassen).

Starte Summe bei 1, da Wertemenge W (X) = {1, 2, . . .}.

G(z) =

∞

X

k=1

p(1 − p)

Damit jetzt leicht

k−1 k

z =

∞

X

pq

k−1 k

z = pz

k=1

∞

X

ℓ=0

p

G (z) =

,

(1 − qz)2

′

ℓ ℓ

q z = pz

∞

X

ℓ=0

pz

.

(qz) =

1 − qz

ℓ

2pq

G (z) =

(1 − qz)3

′′

und schließlich

1

E[X] = G (1) = ,

p

′

2q 1

1

q

VAR[X] = G (1) + G (1) − (G (1)) = 2 + − 2 = 2 .

p

p p

p

′′

′

′

2

5–25

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.1 Ankunftsprozesse

Erinnerung: Binomialverteilung

Definition: Binomialverteilung

Das durch

µ ¶

µ ¶

n k

n k n−k

P (X = k) =

p (1 − p)n−k =

p q ,

k

k

k = 1, 2, . . .

festgelegte W-Maß P heißt Binomialverteilung mit Parametern n und p, kurz

Bin(n, p), und die ZV X heißt binomialverteilt mit Parametern n und p.

Satz: Rekursion für die Binomialverteilung

Für binomialverteilte ZV X mit Parametern n und p gilt die Rekursion

P (X = 0) = q n,

P (X = k + 1) =

(n − k)p

· P (X = k),

(k + 1)q

k = 0, 1, 2, . . .

5–26

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.1 Ankunftsprozesse

Kenngrößen der Binomialverteilung

Wieder mit erzeugender Funktion (Index X weggelassen).

Beende Summe bei n, da Wertemenge W (X) = {0, 1, . . . , n}.

G(z) =

n µ ¶

X

n

k=0

k

pk q n−k z k = . . . = (pz + q)n.

Damit wieder leicht

G′(z) = n(pz + q)n−1p,

und

G′(1) = np,

G′′(z) = n(n − 1)(pz + q)n−2p

G′′(1) = n(n − 1)p2

und schließlich

E[X] = np,

VAR[X] = n(n − 1)p2 + np − n2p2 = −np2 + np = n(p(1 − p) = npq.

5–27

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.1 Ankunftsprozesse

Summe unabhängiger binomialverteilter ZV

Satz: Reproduktivität der Binomialverteilung

Seien die Zufallsvariablen X und Y binomialverteilt mit Parametern n1 und p

bzw. n2 und p. Dann ist ihre Summe X + Y binomialverteilt mit Parametern

n1 + n2 und p.

Beweis (mit Faltung schwierig)

Mit erzeugenden Funktionen (EF)

GX (z) = (pz + q)n1 ,

GY (z) = (pz + q)n2 .

Damit ist

GX+Y (z) = GX (z) · GY (z) = (pz + q)n1+n2 .

Das ist gerade die EF einer binomialverteilten ZV mit Parametern n1 + n2 und p

¤

5–28

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.1 Ankunftsprozesse

Zusammenhang zu Poissonprozessen

Bernoulliprozesse (BP) sind das diskrete Analogon zu Poissonprozessen (PP), denn

➸ Verteilung der Zwischenankunftszeiten

☞ PP: Exponentialverteilung, einzige stetige Verteilung mit Gedächtnislosigkeit

☞ BP: Geometrische Verteilung, einzige diskrete Verteilung mit Gedächtnislosigkeit

➸ Verteilung der Anzahl von Ankünften (in bestimmter Zeit)

☞ PP: Poissonverteilung

☞ BP: Binomialverteilung

Satz: Poisson-Approximation der Binomialverteilung

Für große n und kleine p nähert sich die Binomialverteilung der PoissonVerteilung an.

Genauer gesagt, für n → ∞ und np → λ konvergieren die gemäß der Binomialverteilung berechneten Wahrscheinlichkeiten gegen die gemäß der PoissonVerteilung berechneten Wahrscheinlichkeiten.

5–29

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.1 Ankunftsprozesse

5.1.3 Erneuerungsprozesse

Verallgemeinerung von Poissonprozessen

Betrachte Zählprozeß (Nt)t≥0 mit Zwischenankunftszeiten T1, T2, . . . (T0 := 0).

➸ ZV Tn bezeichnet Zeit zwischen dem (n − 1)-ten und dem n-ten Ereignis (b

= Ankunft).

Definition: Erneuerungsprozeß

Ein Zählprozeß (Nt)t≥0 ist ein Erneuerungsprozeß, wenn die Folge (Tn)n∈IN

der Zeiten zwischen je zwei aufeinanderfolgenden Ereignissen eine Folge unabhängiger identisch verteilter nichtnegativer ZV ist.

Also: Die Zwischenankunftszeiten sind unabhängig und identisch verteilt.

➸ Ereignisse/Ankünfte heißen auch Erneuerungen.

➸ ZV Sn = T1 + · · · + Tn ist die (Warte-)Zeit bis zur n-ten Erneuerung.

➸ Die Folge (Sn)n∈IN heißt auch Erneuerungsfolge.

Beachte:

Nt = sup{n ∈ IN : Sn ≤ t},

Nt ≥ n ⇔ Sn ≤ t.

5–30

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.1 Ankunftsprozesse

Einfache Beispiele

Münzwurf

➸ Tn Zeit zwischen (n − 1)-tem und n-tem Kopf“, iid.

”

➸ Sn = Zeit, zu der zum n-ten mal Kopf“ fällt.

”

➸ (Sn)n∈IN ist Erneuerungsfolge.

➸ Nt = Anzahl von Kopf“ bis (einschließlich) zur Zeit t.

”

➸ (Nt)t≥0 ist Erneuerungsprozeß.

Glühbirne (allg. technische Komponente), bei Ausfall wird ausgewechselt (erneuert!)

➸ Tn = Lebensdauer der n-ten Glühbirne, iid.

➸ Sn = Zeit, zu der die n-te Glühbirne ausfällt.

➸ (Sn)n∈IN ist Erneuerungsfolge.

➸ Nt = Anzahl der ausgewechselten Glühbirnen bis (einschließlich) zur Zeit t.

➸ (Nt)t≥0 ist Erneuerungsprozeß.

5–31

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.1 Ankunftsprozesse

Erneuerung und Markovketten

Betrachte homogene diskrete Markovkette (Xn)n∈IN mit Zustandsraum S = IN.

(0)

(0)

(0)

Anfangsverteilung π (0) = (π0 , π1 , . . .) mit π0 = P (X0 = 0) = 1

→ Start in Zustand 0.

Zähle Besuche in Zustand 0 (nach erstem Verlassen).

➸ Tn = Zeit zwischen (n − 1)-tem und n-ten Besuch in Zustand 0, iid.

➸ Sn = Zeit bis zum n-ten Besuch in Zustand 0.

➸ (Sn)n∈IN ist Erneuerungsfolge.

➸ Nt = Anzahl von Besuchen in Zustand 0 bis (einschließlich) zur Zeit t.

➸ (Nt)t≥0 ist Erneuerungsprozeß.

(Nt)t≥0 ist der mit Zustand 0 assoziierte Erneuerungsprozeß.

Analog für jeden anderen Zustand.

Genauso für homogene stetige Markovketten.

5–32

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.1 Ankunftsprozesse

Charakterisierung von Erneuerungsprozessen

Satz:

Ein Erneuerungsprozeß ist durch die Verteilung der Zwischenankunftszeiten

(Zwischenerneuerungszeiten) vollständig charakterisiert.

Beweis

Seien 0 < t1 < t2 < · · · < tn und 0 ≤ k1 ≤ k2 ≤ · · · kn.

Dann gilt

P (Nt1 = k1, Nt2 = k2, . . . , Ntn = kn)

= P (Sk1 ≤ t1, Sk1+1 > t1, Sk2 ≤ t2, Sk2+1 > t2, . . . , Skn ≤ tn, Skn+1 > tn),

und die gemeinsame Verteilung von S1, S2, . . . , Skn ist vollständig bestimmt durch die

Verteilung(sfunktion) der Zwischenankunftszeiten. ¤

5–33

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.1 Ankunftsprozesse

Zusammenhänge

Satz:

Die Prozesse (Nt)t≥0 und (Nt+T1 − 1)t≥0 sind stochastisch identisch.

→ Endlichdimensionale Verteilungen sind gleich.

Beweis

P (Nt1+T1 − 1 = k1, Nt2+T1 − 1 = k2, . . . , Ntn+T1 − 1 = kn)

= P (Nt1+T1 = k1 + 1, Nt2+T1 = k2 + 1, . . . , Ntn+T1 = kn + 1)

= P (Sk1+1 ≤ t1 + T1, Sk1+2 > t1 + T1, . . . , Skn+1 ≤ tn + T1, Skn+2 > tn + T1)

= P (Sk1+1 − T1 ≤ t1, Sk2+2 − T1 > t1, . . . , Skn+1 − T1 ≤ tn, Skn+2 − T1 > tn)

= P (Sk1 ≤ t1, Sk1+1 > t1, . . . , Skn ≤ tn, Skn+1 > tn)

= P (Nt1 = k1, Nt2 = k2, . . . , Ntn = kn).

5–34

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.1 Ankunftsprozesse

Zusammenhänge

Sei F die Verteilungsfunktion der Zwischenankunftszeiten.

Wegen Sn = T1 + · · · + Tn und T1, . . . , Tn iid folgt

P (Sn ≤ x) = Fn(x),

n ∈ IN,

wobei Fn die n–fache Faltung von F mit sich selbst bezeichnet.

Damit wegen Nt ≥ n ⇔ Sn ≤ t

P (Nt ≥ n) = P (Sn ≤ t) = Fn(t),

t ≥ 0, n ∈ IN.

Also

P (Nt = n) = P (Nt ≥ n) − P (Nt ≥ n + 1) = Fn(t) − Fn+1(t),

t ≥ 0, n ∈ IN.

5–35

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.1 Ankunftsprozesse

Erneuerungsfunktion

Definition: Erneuerungsfunktion

Für einen Erneuerungsprozeß (Nt)t≥0 heißt die Funktion

M (t) = E[Nt],

t≥0

die Erneuerungsfunktion von (Nt)t≥0.

Offensichtlich gilt

M (t) = E[Nt] =

∞

X

n=1

P (Nt ≥ n) =

∞

X

n=1

P (Sn ≤ t) =

∞

X

Beachte (vgl. W–Rechnung): Für nichtnegative diskrete ZV X gilt

∞

∞

X

X

P (X > n) =

P (X ≥ n).

E[X] =

n=0

Problem unendliche Summe?

n=1

n=1

Fn(t).

5–36

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.1 Ankunftsprozesse

Erneuerungsfunktion und Zwischenankunftsverteilung

Zusammenhang zwischen Erneuerungsfunktion und Verteilung der Zwischenankunftszeiten

Satz:

Die Erneuerungsfunktion kann eindeutig aus der Verteilung der Zwischenankunftszeiten bestimmt werden und umgekehrt.

Beweis (Bezeichnungen wie vorher)

Anwendung der Laplace–Stieltjes–Transformierten

∞

∞

∞

X

X

X

Fn∗(ϑ) =

(F ∗(ϑ))n = F ∗(ϑ) ·

(F ∗(ϑ))n =

M ∗(ϑ) =

n=1

n=1

n=0

F ∗(ϑ)

.

1 − F ∗(ϑ)

Umkehrung durch Auflösen nach F ∗(ϑ)

∗

M

(ϑ)

∗

.

F (ϑ) =

1 + M ∗(ϑ)

Wegen Eindeutigkeit der Laplace–Stieltjes–Transformierten ist der Satz damit bewiesen.

5–37

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.1 Ankunftsprozesse

Erneuerungsfunktion von Poissonprozessen

Betrachte Poissonprozeß (Nt)t≥0 mit Rate λ > 0.

Da die Zwischenankunftszeiten unabhängig und identisch (exponentiell) verteilt sind, ist

der Poissonprozeß ein Erneuerungsprozeß.

Wir wissen:

➸ Anzahl der Ankünfte in Zeitraum der Länge t ist Poissonverteilt mit Parameter λt, d.h.

P (Nt = n) = e−λt

λt

.

n!

➸ Erwartungswert der Poissonverteilung mit Parameter λt ist λt.

Damit ist also die Erneuerungsfunktion

M (t) = λt.

Wegen der Eindeutigkeit der Erneuerungsfunktion sind Poissonprozesse die einzigen Erneuerungsprozesse mit linearer Erneuerungsfunktion.

5–38

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.1 Ankunftsprozesse

Erneuerungssatz

Wichtige Eigenschaften (ohne Beweis)

Sei µ = E[Tn] (=: E[T ]) für alle n ∈ IN.

Für Erneuerungsprozesse (Nt)t≥0 gilt (sogar, wenn µ = ∞)

µ

¶

Nt 1

=

=1

fast sichere Konvergenz“.

P lim

t→∞ t

”

µ

Der Wert

1

heißt Rate des Erneuerungsprozesses.

µ

Satz: Erneuerungssatz

Sei (Nt)t≥0 ein Erneuerungsprozeß mit Rate 1/µ und Erneuerungsfunktion M.

Dann gilt

M (t) 1

= .

lim

t→∞

t

µ

5–39

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.2 Auswahl einer Verteilungsfamilie

Abschnitt 5.2

Auswahl einer

Verteilungsfamilie

5–40

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.2 Auswahl einer Verteilungsfamilie

Stand der Dinge

Modellierung von Ankünften: Ankunftsprozesse

Zwischenankunftszeiten unabhängige identisch verteilte ZV

➸ Erneuerungsprozesse: allgemeine Verteilung

☞ Poissonprozeß: Exponentialverteilung

☞ Bernoulliprozeß: Geometrische Verteilung

Modellierung von Bedienzeiten: keine speziellen Bedienprozesse

Bedienzeiten unabhängige identisch verteilte ZV

➸ allgemeine Verteilung

Erkenntnisse und Ergebnisse, die uns weiterhelfen, wenn die Zeiten unabhängig und

identisch sind und wenn wir die entsprechende Verteilung der Zwischenankunftszeiten kennen.

Offene Fragen also:

Wie wählt man geeignete Verteilungen?

5–41

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.2 Auswahl einer Verteilungsfamilie

Vorgehensweise

Prüfen/Rechtfertigen der Unabhängigkeit

Voraussetzung: Meßdaten verfügbar.

➸ Heuristisch mittels graphischer “Inspektion“

☞ Korrelationsdiagramme (correlation plot), Streudiagramme (scatter diagram)

➸ Unabhängigkeitstests; Anpassungstests verwendbar (→ Abschnitt 4.4)

Bestimmung einer Wahrscheinlichkeitsverteilung

Sind keine theoretischen Kenntnisse über die Verteilung verfügbar aber Meßdaten,

dann zwei Möglichkeiten

➸ Empirische Verteilung,

➸ Wahl einer zu den Daten möglichst gut passenden Verteilung.

Anhand von Meßdaten, Kenngrößen, statistischen Maßzahlen, Histogrammen

☞ zuerst Verteilungsfamilie (Exponential, Erlang, Normal, Geo, . . . ) ermitteln,

☞ dann deren Parameter schätzen (→ Abschnitt 4.3).

5–42

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.2 Auswahl einer Verteilungsfamilie

5.2.1 Kenngrößen und Statistische Maßzahlen

Zufallsvariable X , diskret oder stetig

Zur Erinnerung

➸ Erwartungswert µ = E[X], Varianz σ 2 = VAR[X], Standardabweichung σ.

➸ Momente

£ k¤

☞ E X das k-te Moment,

£ k¤

☞ E |X| das k-te absolute Moment,

£

¤

k

☞ E (X − E[X]) das k-te zentrale Moment,

£

¤

k

☞ E |X − E[X]| das k-te zentrale absolute Moment.

Der Erwartungswert ist also das erste Moment.

Die Varianz ist also das zweite zentrale Moment.

σ

➸ Variationskoeffizient ν = =

µ

p

VAR[X]

.

E[X]

5–43

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.2 Auswahl einer Verteilungsfamilie

Weitere Kenngrößen

Zufallsvariable X , diskret oder stetig

➸ Schiefe (Skewness):

➸ Exzeß (Kurtosis):

E[(X − E[X])3]

p

.

3

VAR[X]

E[(X − E[X])4]

− 3.

2

VAR[X]

Allgemeiner: Kumulanten

Ki[X] = E[X i] −

Speziell also (man prüfe das nach...)

➸ 1. Kumulante: Erwartungswert

➸ 2. Kumulante: Varianz

➸ 3. Kumulante: Schiefe

➸ 4. Kumulante: Exzeß

¶

i−1 µ

X

i−1

j=1

j−1

Kj [X]E[X i−j ].

5–44

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.2 Auswahl einer Verteilungsfamilie

Quantile

Zufallsvariable X , hier stetig mit Verteilungsfunktion F

p–Quantil, Quantilfunktion einer Verteilung/Verteilungsfunktion F

xp := Q(p) := F −1(p) = inf{x : F (x) ≥ p},

0 ≤ p ≤ 1.

➸ p–Quantil xp,

➸ Quantilfunktion Q = F −1.

Insbesondere: p–Quantil für monoton wachsende stetige Verteilungsfunktionen ist

eindeutige Lösung von

F (xp) = P (X ≤ xp) = p.

Speziell heißt das 0.5–Quantil auch Median.

5–45

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.2 Auswahl einer Verteilungsfamilie

Kenngrößen für zwei Zufallsvariablen

Zufallsvariablen X und Y , diskret oder stetig

➸ Kovarianz

KOV[X, Y ] := E[XY ] − E[X]E[Y ] = E [(X − E[X])(Y − E[Y ])]

☞ Varianz der Summe zweier ZV: VAR[X +Y ] = VAR[X]+VAR[Y ]+2KOV[X, Y ].

☞ Wegen E[XY ] = E[X]E[Y ] gilt für unabhängige ZV: KOV[X, Y ] = 0.

☞ Varianz der Summe zweier unabhängiger ZV: VAR[X + Y ] = VAR[X] + VAR[Y ].

➸ Korrelationskoeffizient

ρX,Y := p

KOV[X, Y ]

VAR[X]VAR[Y ]

.

☞ −1 ≤ ρX,Y ≤ 1.

☞ positiv korreliert, falls ρX,Y > 0,

☞ negativ korreliert, falls ρX,Y < 0,

☞ unkorreliert, falls ρX,Y = 0,

Unabhängige ZV sind unkorreliert, die Umkehrung gilt im allgemeinen nicht.

5–46

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.2 Auswahl einer Verteilungsfamilie

Meßdaten und Empirische Verteilungsfunktion

Meßdaten {x1, x2, . . . , xn}, interpretiert als Realisierungen einer Zufallsvariablen X.

Oft auch Stichprobe genannt, aber Begriff doppeldeutig, denn formal

➸ Stichprobe: X1, X2, . . . , Xn unabhängige identisch verteilte ZV,

➸ Meßdaten: x1, x2, . . . , xn Realisierung der Stichprobe.

Offensichtlich formal unterschiedlich, aber Stichprobe oft als Bezeichnung für Beides.

➸ Anzahl der Meßdaten mit xi ≤ x :

n

P

i=1

I{xi≤x}

(mit Indikatorfunktion I).

➸ Empirische Verteilungsfunktion Fn : IR → IR

n

1X

I{xi≤x}.

Fn(x) =

n i=1

☞ Treppenfunktion mit Sprungstellen x1, . . . , xn.

5–47

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.2 Auswahl einer Verteilungsfamilie

Statistische Maßzahlen

Analog zu Kenngrößen von ZV und Verteilungen statistische Maßzahlen zu Meßdaten.

x1 + · · · + x n

➸ Empirischer Mittelwert: x =

.

n

n

X

√

1

2

2

➸ Empirische Varianz: s =

(xi − x) . Empirische Streuung: s = s2.

n − 1 i=1

➸ Empirischer Variationskoeffizient c = s/x.

Entsprechendes für alle Momente und Kumulanten.

Geordnete Meßdaten x(1) ≤ x(2) ≤ · · · ≤ x(n), aufsteigende Sortierung der xi.

Index in Klammern =

b Position in der Sortierung.

➸ Variationsbreite (Spannweite): v = x(n) − x(1).

½

➸ Empirische Quantile

x(np),

falls np ganzzahlig,

x̃p =

x(⌊np+1⌋), sonst.

5–48

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.2 Auswahl einer Verteilungsfamilie

Zweidimensionale Meßdaten

Meßdaten (x1, y1), . . . , (xn, yn).

Empirische Mittelwerte seien x und y, empirische Streuungen sx und sy .

➸ Empirische Kovarianz:

sxy

1

=

n−1

n

X

1

(xi − x)(yi − y) =

n−1

i=1

➸ Empirischer Korrelationskoeffizient: rxy

sxy

=

.

sx sy

à n

X

i=1

Speziell für x1, . . . , xn als Realisierungen von iid ZV

sxixi+j

sj

= ,

s = sxj , sj := sxixi+j , rj := rxixi+j

sxi sxi+j s2

!

xiyi − nxy .

j = 0, 1, . . . , n

Später (in Abschnitt 4.3) analog zu allen statistischen Maßzahlen entsprechende Stan”

dardschätzer“ für Kenngrößen von Zufallsvariablen aus empirischen Daten.

5–49

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.2 Auswahl einer Verteilungsfamilie

5.2.2 Graphische Darstellungen

Prüfung von Unabhängigkeit

Heuristische graphische Methoden

➸ Korrelationsdiagramm

☞ Berechne Korrelation rj und zeichne sie als Funktion des Abstands“

”

(lag correlation).

☞ Falls ZV unabhängig sind, dann ist Korrelation für alle Paare jeweils Null.

☞ Daten sollten also Korrelation von ungefähr Null für alle Abstände zeigen.

➸ Streudiagramm

☞ Zeichne Paare (xi, xi+1) als Punkte.

☞ Falls positiv korreliert, dann liegen die Punkte auf Geraden mit positiver Steigung.

☞ Falls negativ korreliert, dann liegen die Punkte auf Geraden mit negativer Steigung.

☞ Falls ZV unabhängig sind, dann streuen die Werte völlig zufällig“.

”

☞ Daten sollten also unstrukturiert in der Ebene verteilte Punkte liefern.

5–50

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.2 Auswahl einer Verteilungsfamilie

Korrelations- und Streudiagramm

Beispiel für Meßdaten, die Realisierungen einer Exponentialverteilung mit Parameter λ = 1

sind, unabhängig identisch verteilt

Korrelationsdiagramm

Streudiagramm

5–51

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.2 Auswahl einer Verteilungsfamilie

Korrelations- und Streudiagramm

Beispiel für Wartezeiten in einem M/M/1–Modell mit Auslastung 0.8

Korrelationsdiagramm

Streudiagramm

Offensichtlich also abhängig (obwohl Zwischenankunfts- und Bedienzeiten unabhängig).

Mehr dazu in Kapitel 6.

5–52

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.2 Auswahl einer Verteilungsfamilie

Klasseneinteilung und Histogramm

➸ Klassen von Wertebereichen

[b0, b1), [b1, b2), . . . , [bK−1, bK )

gleicher Breite ∆b = bk − bk−1 für 0 < k < K.

☞ Einteilung so, daß alle Intervalle “hinreichend viele “ (> 5 ?) Werte enthalten.

☞ Gesamtbereich [b0, bK ) muß nicht alle Meßdaten enthalten,

ggf. Ausreißer vernachlässigen?

➸ Relative Häufigkeiten

|{xi ∈ [bk−1, bk )}|

rk =

,

n

➸ Histogramm

H(x) =

→ Graphische Darstellung

½

k = 1, . . . , K.

rk , falls bk−1 ≤ x < bk ,

0, sonst.

5–53

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.2 Auswahl einer Verteilungsfamilie

Histogramm

➸ Aussehen ist abhängig von ∆b und der Lage von b0,

☞ ggf. scheinbar sehr verschiedene Histogramme für gleiche Meßdaten.

➸ Histogramm “schätzt“ die wahre Dichte.

➸ Verteilung soll gewählt werden, deren Dichte ähnlich aussieht.

➸ Kenngrößen der Verteilung und statistische Maßzahlen sollen ähnlich sein.

Subjektive Komponente: Erraten einer Verteilung.

5–54

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.2 Auswahl einer Verteilungsfamilie

Quantilinspektion

Prüfung von Symmetrie/Schiefe, Form der Dichte der Verteilung

Betrachte spezielle (empirische) Quantile

➸ p = 0.5 : Median

➸ p = 0.25 und p = 0.75 : Quartile

➸ p = 0.125 und p = 0.875 : Oktile

➸ p = 0 und p = 1 : Extreme

Quantilzusammenfassung

➸ Berechne Median sowie Mittelwerte der Quartile, der Oktile und der Extreme

➸ Falls Verteilung symmetrisch, dann Median und alle Mittelwerte (etwa) gleich.

➸ Falls Verteilung rechtsschief (Dichte hängt“ nach rechts)

”

x0.5 < (x0.25 + x0.75)/2 < (x0.125 + x0.875)/2 < (x0 + x1)/2.

➸ Falls Verteilung linksschief (Dichte hängt“ nach links)

”

x0.5 > (x0.25 + x0.75)/2 > (x0.125 + x0.875)/2 > (x0 + x1)/2.

5–55

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.2 Auswahl einer Verteilungsfamilie

Beispiel

Typischer Ablauf der Verteilungsfindung“

”

Meßdaten aus n = 219 gemessenen Zwischenankunftszeiten innerhalb von 90 Minuten

➸ Anzahlen der Ankünfte in sechs aufeinanderfolgenden Perioden von jeweils 15 Minuten

waren in etwa gleich,

☞ deutet auf unabhängig und identisch verteilt hin.

➸ Statistische Maßzahlen (Zeiten in Minuten)

empirischer Mittelwert 0.399, empirischer Median 0.27, empirische Schiefe 1.458,

☞ deutet auf rechtsschiefe Verteilung hin.

➸ Außerdem empirischer Variationskoeffizient 0.953,

☞ deutet auf Exponentialverteilung hin.

Kenntnis möglichst vieler Kenngrößen von möglichst vielen Verteilungen ist wichtig!

Weiteres Vorgehen: graphische Methoden

5–56

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.2 Auswahl einer Verteilungsfamilie

Histogramm

Histogramme für verschiedene Klasseneinteilungen (verschiedene ∆b) deuten ebenfalls auf

Exponentialverteilung hin.

Wir sehen

Offensichtlich liefern die verschiedenen Klasseneinteilungen unterschiedlich deutliche Hinweise auf die Form der Dichte.

5–57

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.3 Parameterschätzung

Abschnitt 5.3

Parameterschätzung

5–58

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.3 Parameterschätzung

5.3.1 Grundbegriffe der Schätztheorie

Schätztheorie formal, in Kürze

Stichprobe {X1, X2, . . . , Xn} mit (unbekannter) Verteilung, die von verschiedenen Parametern abhängt.

Allgemeine Formalisierung

➸ Parameterraum Θ ⊆ IRk , k ∈ IN.

➸ Verteilung Pϑ, ϑ ∈ Θ.

➸ Funktion γ : Θ → Θ′ ⊆ IRj , j ∈ IN.

Zentrale Fragestellung

Wie kann man für reelle ZV X1, X2, . . . , Xn mit einer Verteilung Pϑ eine Funktion

γ schätzen?

Schätzproblem

Finde anhand von x = (x1, x2, . . . , xn), aufgefaßt als Realisierung des rellen ZVektors X = (X1, X2, . . . , Xn) eine Schätzung für den Wert von γ an der Stelle des

tatsächlichen Parameters ϑ.

5–59

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.3 Parameterschätzung

Schätzen reeller Verteilungsparameter

Stichprobe: iid reelle ZV X1, . . . , Xn; Realisierung x1, . . . , xn.

Verteilungsfunktion Fϑ

➸ Verteilungsfamilie bekannt,

➸ Parameter ϑ oder Funktion τ (ϑ) ist zu schätzen.

➸ Schätzer, Schätzfunktion Tn : IRn → IR,

➸ Schätzwert Tn(x1, . . . , xn),

➸ Schätzvariable Tn(X1, . . . , Xn).

Beachte: Schätzer sind Zufallsvariablen!

Abhängigkeit vom Parameter ϑ ausgedrückt durch Index

à Eϑ[Tn], Eϑ[X], VARϑ[Tn], VARϑ[X], fϑ, Fϑ, Pϑ(a ≤ Tn ≤ b), . . .

5–60

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.3 Parameterschätzung

Erwartungstreue von Schätzern

Schätzer soll mit großer WK Werte in der Nähe von τ (ϑ) annehmen.

Definition: Erwartungstreue

Ein Schätzer Tn : IR → IR heißt erwartungstreu für τ : Θ → IR, falls für alle

ϑ∈Θ

Eϑ[Tn(X1, . . . , Xn)] = τ (ϑ).

Erwartungstreue Standardschätzer“ (analog zu empirischen Maßzahlen)

”

1

➸ Stichprobenmittel X = (X1 + · · · + Xn)

n

erwartungstreuer Schätzer für den Erwartungswert.

n

X

1

➸ Stichprobenvarianz S 2 =

(Xi − X)2

n − 1 i=1

erwartungstreuer Schätzer für die Varianz. (Grund für n − 1 im Nenner!)

5–61

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.3 Parameterschätzung

Güte von Schätzern

➸ Erwartungstreue ist ein Gütekriterium, aber allein zu wenig.

➸ Bei Erwartungstreue im Mittel gute Schätzung.

➸ Schätzwerte streuen um τ (ϑ).

➸ Verzerrung (Bias): Eϑ[Tn] − τ (ϑ).

⇒ Varianz des Schätzers, also VAR[Tn], ist Gütekriterium.

Weiteres erstrebenswertes Ziel: je größer n, desto genauer die Schätzung.

Definition: Konsistenz

Sei für jedes n ∈ IN+ ein Schätzer Tn gegeben. Die Folge der Schätzer

T1, T2, . . . heißt konsistent für τ : Θ → IR, falls für alle ǫ > 0 und alle

ϑ∈Θ

lim Pϑ(|Tn(X1, . . . , Xn) − τ (ϑ)| > ǫ) = 0.

n→∞

5–62

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.3 Parameterschätzung

Zusammenhänge

Satz:

Ist T1, T2, . . . eine Folge erwartungstreuer Schätzer für τ : Θ → IR und gilt

für alle ϑ ∈ Θ

lim VARϑ[Tn(X1, . . . , Xn)] = 0,

n→∞

dann ist die Folge T1, T2, . . . konsistent.

Also: ein guter Schätzer sollte erwartungstreu sein und kleine Varianz haben.

denn

Eϑ[(Tn − τ (ϑ))2] = Eϑ[(Tn − Eϑ[Tn] + Eϑ[Tn] − τ (ϑ))2]

= Eϑ[(Tn − Eϑ[Tn])2 + 2(Tn − Eϑ[Tn])(Eϑ[Tn] − τ (ϑ)) + (Eϑ[Tn] − τ (ϑ))2]

= Eϑ[(Tn − Eϑ[Tn])2] + (Eϑ[Tn] − τ (ϑ))2

= VARϑ[Tn] + (Eϑ[Tn] − τ (ϑ))2.

5–63

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.3 Parameterschätzung

5.3.2 Maximum–Likelihood–Schätzer

Beispiel: Urnenmodell

Urne mit N Kugeln, M schwarze und N − M weiße; N bekannt, M unbekannt.

➸ Experiment: n mal Ziehen ohne Zurücklegen.

☞ Daraus soll die Anzahl schwarzer Kugeln geschätzt werden.

➸ Zufallsvariable X =

b Anzahl der gezogenen schwarzen Kugeln (Laplace–Annahme).

➸ Bekannt: Anzahl schwarzer Kugeln ist diskret hypergeometrisch verteilt:

¡M ¢ ¡N −M ¢

k · n−k

¡N ¢

P (X = k) =

.

n

Einfache Idee:

Wähle den Parameter, für den das beobachtete Ergebnis am wahrscheinlichsten ist.

Notation gemäß allgemeinem Schätzproblem:

Unbekannter zu schätzender Parameter ϑ = M

In diesem Fall also diskreter Parameter ϑ ∈ IN.

à Pϑ(X = k).

5–64

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.3 Parameterschätzung

Zahlenbeispiel 1

Beispiel: 10 Kugeln, 3 mal Ziehen ohne Zurücklegen, also N = 10, n = 3.

Beobachtung: 2 schwarze Kugeln gezogen.

Wahrscheinlichkeit:

Wertetabelle:

¡ϑ¢ ¡10−ϑ¢

ϑ(ϑ − 1)(10 − ϑ)

2 ·

¡10¢ 1 =

Pϑ(X = 2) =

.

240

3

ϑ

0

1

2

3

4

5

6

7

8

9

10

Pϑ(X = 2) 0.000 0.000 0.067 0.175 0.300 0.417 0.500 0.525 0.467 0.300 0.000

Beobachtung 2 schwarze Kugeln“ also am wahrscheinlichsten für ϑ = 7.

”

Wie verläßlich ist diese Schätzung?

5–65

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.3 Parameterschätzung

Zahlenbeispiel 2

Beispiel: gleiches Experiment wie vorher (bei gleicher Urne und Kugeln)

Beobachtung: keine schwarze Kugel.

Wahrscheinlichkeit:

Wertetabelle:

¡ϑ¢ ¡10−ϑ¢

(10 − ϑ)(9 − ϑ)(8 − ϑ)

0 ·

¡10¢ 3 =

Pϑ(X = 0) =

.

720

3

ϑ

0

1

2

3

4

5

6

7

8

9

10

Pϑ(X = 0) 1.000 0.700 0.467 0.292 0.167 0.083 0.033 0.008 0.000 0.000 0.000

Beobachtung keine schwarze Kugel“ also am wahrscheinlichsten für ϑ = 0.

”

Das kann aufgrund der ersten Beobachtung aber nicht sein!

Verbesserungsvorschlag: Berücksichtige beide Beobachtungen!

5–66

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.3 Parameterschätzung

Kombination der Beobachtungen

Betrachte beide Beobachtungen aus zwei Versuchen mit X1, X2, wobei X1, X2 iid wie X

verteilt sind.

à Wahrscheinlichkeit: Pϑ(X1 = 2, X2 = 0) = Pϑ(X1 = 2) · Pϑ(X2 = 0).

Wertetabelle:

ϑ

0

1

2

3

4

5

6

7

8

9

10

Pϑ(. . .) 0.000 0.000 0.031 0.051 0.050 0.035 0.017 0.004 0.000 0.000 0.000

Kombination beider Beobachtungen also am wahrscheinlichsten für ϑ = 3.

Noch mehr Beobachtungen, also noch mehr Experimente, sollten immer bessere Schätzung

liefern...

Beachte: im Beispiel konnten wir alle WK ausrechnen und dann größte WK ablesen.

Im folgenden Formalisierung und Verallgemeinerung, insbesondere für Parameter stetiger

Zufallsvariablen.

5–67

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.3 Parameterschätzung

Maximum–Likelihood–Schätzer

Betrachte reelle Zufallvariable X, diskret oder stetig, mit Dichte fϑ, ϑ ∈ Θ;

➸ stetig: Dichte wie üblich; diskret: Zähldichte mit fϑ(x) = P (X = x).

Definiere

➸ Likelihood–Funktion L : Θ × IRn → IR mit

L(ϑ, x1, . . . , xn) = fϑ(x1, . . . , xn) = fϑ(x1) · · · fϑ(xn), ϑ ∈ Θ, x1, . . . , xn ∈ IR.

➸ Maximum–Likelihood–Schätzwert ϑ̂ := ϑ̂(x1, . . . , xn) mit

∀ϑ ∈ Θ : L(ϑ̂, x1, . . . , xn) ≥ L(ϑ, x1, . . . , xn), x1, . . . , xn ∈ IR.

➸ Maximum–Likelihood–Schätzer (MLS)

Nimmt jede der Likelihood–Funktionen L(·, x1, . . . , xn) ein Maximum an, ist damit ein

Schätzer Tn : IRn → Θ definiert mit

Tn(X1, . . . , Xn) := ϑ̂(X1, . . . , Xn).

5–68

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

Maximum–Likelihood–Schätzung

Wesentliche Aufgaben bei Maximum–Likelihood–Schätzung

➸ Berechnung der Likelihood–Funktion L

☞ Produkt von Dichten.

➸ Maximierung der Likelihood–Funktion L

☞ Bestimmung von Extrema, kann schwierig sein.

Häufig nützlich

➸ Log–Likelihood–Funktion log L

L(ϑ, x1, . . . , xn) Ã log L(ϑ, x1, . . . , xn)

☞ Funktion log L hat die gleichen Extrema wie L,

☞ Funktion log L oft leichter zu maximieren als L.

➸ Besonders häufig natürlicher Logarithmus ln

☞ Umkehrfunktion der Exponentialfunktion (zur Basis e).

5.3 Parameterschätzung

5–69

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.3 Parameterschätzung

Poissonverteilung

Zufallsvariable X sei Poisson-verteilt mit Parameter λ > 0,

➸ Verteilung

ϑ := λ.

ϑk e−ϑ

P (X = k) =

.

k!

➸ Likelihood–Funktion

L(ϑ, x1, . . . , xn) =

➸ Log–Likelihood–Funktion

1

· ϑx1+···+xn · e−nϑ.

x1!x2! · · · xn!

ln L(ϑ, x1, . . . , xn) = − ln(x1!x2! · · · xn!) + (x1 + · · · + xn) · ln ϑ − nϑ.

➸ Ableitung nach ϑ und Nullsetzen

x1 + · · · + x n

∂ ln L x1 + · · · + xn

!

=

− n = 0 ⇒ ϑ̂ =

(ist tatsächlich Max.).

∂ϑ

ϑ

n

➸ MLS für ϑ :

X1 + · · · + Xn

(Stichprobenmittel, erwartungstreu).

ϑ̂ =

n

5–70

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.3 Parameterschätzung

Exponentialverteilung

Zufallsvariable X sei exponentialverteilt mit Parameter λ > 0,

ϑ := λ.

➸ Dichte

fϑ(x) = ϑe−ϑx.

➸ Likelihood–Funktion

L(ϑ, x1, . . . , xn) = ϑne−ϑ(x1+···+xn).

➸ Log–Likelihood–Funktion

ln L(ϑ, x1, . . . , xn) = n ln ϑ − ϑ(x1 + · · · + xn).

➸ Ableitung nach ϑ und Nullsetzen

∂ ln L n

n

1 x1 + · · · + x n

!

= − (x1 + · · · + xn) = 0 ⇒ ϑ̂ =

⇒

.

=

∂ϑ

ϑ

x1 + · · · + x n

n

ϑ̂

➸ MLS für ϑ und den Erwartungswert µ := 1/ϑ :

1 X1 + · · · + Xn

n

, µ̂ = =

(Stichprobenmittel, erwartungstreu).

ϑ̂ =

X1 + · · · + Xn

n

ϑ̂

5–71

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.3 Parameterschätzung

Normalverteilung

Zufallsvariable X sei normalverteilt mit Erwartungswert µ und Varianz σ 2.

➸ Dichte

fϑ(x) = √

1

2πσ 2

·e

(X−µ)2

−

2σ 2

=√

µ

(X − µ)

· exp −

2

2σ 2

2πσ

1

2

¶

.

Erwartungswert und Varianz sollen gemeinsam geschätzt werden.

➸ Parameter ϑ = (ϑ1, ϑ2) mit ϑ1 := µ und ϑ2 := σ 2.

➸ Dichte

fϑ(x) = √

1

·e

2πϑ2

(X−ϑ1 )2

− 2ϑ

2

➸ Likelihood–Funktion

L(ϑ1, ϑ2, x1, . . . , xn) =

µ

√

=√

1

2πϑ2

¶n

µ

1

(X − ϑ1)

· exp −

2ϑ2

2πϑ2

Ã

· exp −

1

·

2ϑ2

n

X

i=1

2

¶

.

!

(xi − ϑ1)2 .

5–72

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.3 Parameterschätzung

Maximierung der Likelihood–Funktion

Likelihood–Funktion

L(ϑ1, ϑ2, x1, . . . , xn) =

µ

√

1

2πϑ2

¶n

Ã

· exp −

1

·

2ϑ2

n

X

i=1

!

(xi − ϑ1)2 .

Log–Likelihood–Funktion

n

n

1 X

·

(xi − ϑ1)2.

ln L(ϑ1, ϑ2, x1, . . . , xn) = −n ln 2π − ln ϑ2 −

2

2ϑ2 i=1

√

Berechnung und Nullsetzen der partiellen Ableitungen

n

1 X

∂ ln L

!

=

·

(xi − ϑ1) = 0,

∂ϑ1

ϑ2 i=1

n

n

1 X

∂ ln L

!

= −

+ 2·

(xi − ϑ1)2 = 0.

∂ϑ2

2ϑ2 2ϑ2 i=1

5–73

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.3 Parameterschätzung

Nullsetzen der partiellen Ableitungen

Partielle Ableitungen

n

∂ ln L

1 X

!

=

·

(xi − ϑ1) = 0,

∂ϑ1

ϑ2 i=1

n

∂ ln L

n

1 X

!

=−

+ 2·

(xi − ϑ1)2 = 0.

∂ϑ2

2ϑ2 2ϑ2 i=1

Damit

n

X

1

ϑˆ1(x1, . . . , xn) =

xi = x,

n i=1

2

n

n

X

X

1

1

n−1 2

x i −

ϑˆ2(x1, . . . , xn) =

xj =

s.

n i=1

n j=1

n

⇒ Maximum–Likelihood–Schätzer für ϑ = (ϑ1, ϑ2) :

µ

¶

n−1 2

X,

S .

n

Beachte: Schätzer für die Varianz ist nicht erwartungstreu.

5–74

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.3 Parameterschätzung

5.3.3 Momentenmethode

Situation wie bisher, X1, . . . , Xn iid wie X.

Betrachte Momente von Xi :

mk (ϑ) = Eϑ[Xik ].

Idee: Schätze mk (ϑ) durch den Mittelwert der Xik , i = 1, . . . , n.

➸ k–tes Stichprobenmoment

n

1X k

m̂(ϑ) :=

Xi .

n i=1

Anwendung: wenn τ (ϑ) als Funktion der ersten K Momente dargestellt werden kann.

➸ τ (ϑ) = h(m1(ϑ), . . . , mK (ϑ)),

Schätzer h(m̂1(ϑ), . . . , m̂2(ϑ)).

Typische Situation: Darstellung existiert, wenn K die Dimension von Θ ist. Dann

➸ Berechnung der ersten K Momente als Funktion von ϑ ∈ Θ,

➸ Lösen des resultierenden Gleichungssystems.

5–75

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.3 Parameterschätzung

Poissonverteilung

Zufallsvariable X sei Poisson-verteilt mit Parameter λ > 0,

ϑ := λ.

➸ Erwartungswert ist λ bzw. ϑ, also m1 = λ = ϑ.

Momentenmethode liefert als Schätzer für ϑ

n

1X

ϑ̂ = m̂1 =

Xi = X.

n i=1

➸ Varianz ist ebenfalls λ bzw. ϑ, also m2 − m21 = λ = ϑ.

Momentenmethode liefert als Schätzer für ϑ

n

X

¡

¢2

1

2

ϑ̂ = m̂2 − m̂1 =

Xi − X .

n i=1

Offensichtliches Problem: Schwäche der Momentenmethode

Momentenmethode–Schätzer ist nicht immer eindeutig.

5–76

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.3 Parameterschätzung

5.3.4 Kleinste–Quadrate–Schätzer

Lineare Regression

Gegeben: zweidimensionale Meßreihe (x1, y1), . . . , (xn, yn).

Vermutung: linearer Zusammenhang.

➸ Y Ergebnis eines Zufallsexperimentes, x eine erklärende Variable.“

”

Lineares Regressionsmodell

☞ Y = αx + β + ǫ, α, β ∈ IR mit N (0, σ 2)-verteilter Zufallvariable ǫ.

☞ Zwischen Erwartungswert von Y und der Variable x gibt es lineare Abhängigkeit,

denn E[Y ] = αx + β.

☞ Beeinflussung durch Zufall wird durch ZV ǫ ausgedrückt.

Regressionsgerade

y = αx + β,

α, β ∈ IR.

Gesucht: Schätzwerte für die Regressionssteigung α und den Achsenabschnitt β.

Regressionskoeffizienten

5–77

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.3 Parameterschätzung

Regressionsmodell

Also

➸ Lineares Regressionsmodell ist einfaches Modell zur Beschreibung der Abhängigkeit

eines Zufallsexperimentes von einer erklärenden Variablen.

☞ Einfluß der Luftfeuchtigkeit auf die Ernte etc.

Unabhängige Experimente bei verschiedenen Werten x1, . . . , xn

➸ Zufallsvariablen Y1, . . . , Yn,

➸ Yi = αx + β + ǫi mit unabhängigen N (0, σ 2)-verteilten ZV ǫi.

➸ Zufallsvariablen Y1, . . . , Yn sind also unabhängig aber nicht identisch verteilt!

Graphische Darstellung

➸ Punkte (xi, yi) in zweidimensionalem Koordinatensystem,

➸ wegen der ǫi (Zufallseinfluß) streuen diese um die Regressionsgerade herum.

5–78

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.3 Parameterschätzung

Maximum–Likelihood–Schätzer

Jedes Yi hat N (αx + β, σ 2)–Verteilung, also Dichte

µ

¶

1

1

· exp − 2 (yi − αx − β)2 .

fYi (yi) = √

2σ

2πσ 2

Parameter ϑ = (α, β, σ 2).

➸ Likelihood–Funktion

L(ϑ, y1, . . . , yn) =

Ã

1

1

·

exp

−

2σ 2

(2πσ 2)n/2

➸ Log–Likelihood–Funktion

n

X

i=1

!

(yi − αx − β)2 .

n

n

1 X

2

ln L(ϑ, y1, . . . , yn) = − ln(2πσ ) − 2

(yi − αx − β)2.

2

2σ i=1

➸ Berechnung und Nullsetzen der Ableitung (bei festem σ) führt zu Minimierung von

n

X

(yi − αx − β)2.

Q(α, β) :=

i=1

5–79

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

Kleinste–Quadrate–Schätzer

Die Maximum–Likelihood–Methode führt hier also geradewegs zur

Methode der kleinsten Quadrate

Schätzer α̂ und β̂, so, daß

n ³

X

i=1

yi − α̂xi − β̂

´2

!

= min .

Lösung

Kleinste–Quadrate–Schätzer (erwartungstreu)

α̂ =

n

P

(Xi − X)(Yi − Y )

i=1

n ¡

P

i=1

Xi − X

¢2

,

β̂ = Y − α̂X.

Beweis/Herleitung eigentlich typischerweise in der Statistik...

5.3 Parameterschätzung

5–80

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

Abschnitt 5.4

Anpassungstests

5.4 Anpassungstests

5–81

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.4 Anpassungstests

5.4.1 Heuristische Methoden

Histogramm-Dichte-Vergleich

➸ Zeichne Histogramm und Dichte in einem Bild,

➸ Vergleiche: Ähnlichkeiten/Unterschiede.

Hier am Beispiel empirischer Daten und angepaßter

Exponentialverteilung

5–82

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.4 Anpassungstests

Verteilungsfunktionen

Vergleich von Verteilungsfunktion F̂ der geschätzten Verteilung mit empirischer Vf Fn

➸ Ähnlichkeiten/Unterschiede sind schwieriger zu sehen als bei Histogramm/Dichte.

➸ Stattdessen Differenz beider Verteilungsfunktionen: F̂ (x) − Fn(x).

Hier am Beispiel empirischer Daten und angepaßter Exponentialverteilung

5–83

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.4 Anpassungstests

Wahrscheinlichkeits- und Quantildiagramme

Betrachte geordnete Meßdaten x(1) ≤ x(2) ≤ · · · ≤ x(n).

➸ Modifizierte empirische Verteilungsfunktion, nur an den Stellen x(1), . . . , x(n) definiert.

☞ F̃n(x(i)) =

i

n

= Anteil beobachteter Daten ≤ x(i), i = 1, . . . , n;

☞ justiere zu F̂n(x(i)) =

i−0.5

n .

➸ Für wahre“ Verteilungsfunktion F ist F (x(i)) ≈ i−0.5

, i = 1, . . . , n.

n

”

➸ Falls F̂ nah beim wahren F, dann F̂ (x(i)) ≈ i−0.5

n , i = 1, . . . , n.

P-P-Plot (für diskrete und stetige Verteilungen)

³

´

➸ Paare i−0.5

n , F̂ (x(i) ) bilden in etwa Gerade von (0, 0) nach (1, 1),

➸ empfindlich gegen Fehler in der Mitte der Verteilung.

Q-Q-Plot (für stetige Verteilungen)

³

´

−1

➸ Paare i−0.5

,

F̂

(x(i)) bilden in etwa Gerade von (x(1), x(1)) nach (x(n), x(n)),

n

➸ empfindlich gegen Fehler an den Enden (Tails) der Verteilungen.

5–84

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.4 Anpassungstests

P-P-Plot und Q-Q-Plot

Hier am Beispiel empirischer Daten und angepaßter Exponentialverteilung

P-P-Plot

Q-Q-Plot

5–85

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.4 Anpassungstests

5.4.2 Grundbegriffe der Testtheorie

Bezeichnungen wie bisher. Verteilung hänge von unbekanntem Parameter ϑ ∈ Θ ab.

Hypothesen: Annahmen über ϑ

➸ Nullhypothese H0 : ϑ ∈ Θ0 ⊆ Θ,

➸ Alternativhypothese H1 : ϑ ∈ Θ1 ⊆ Θ \ Θ0.

Beispiele

H 0 : ϑ = ϑ0 ,

H0 : ϑ ≤ ϑ0 ,

H0 : ϑ ≥ ϑ0 ,

H1 : ϑ 6= ϑ0

H1 : ϑ > ϑ0

H1 : ϑ < ϑ1

à zweiseitiger Test

à einseitiger Test

à einseitig Test

Test

➸ Entscheide aufgrund einer Testgröße/Teststatistik, ob Hypothesen abzulehnen sind.

➸ Signifikanztest: Ausrichtung auf Ablehnung von H0 (zugunsten von H1).

➸ Alternativtest: Gleichbehandlung von H0 und H1.

5–86

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.4 Anpassungstests

Signifikanztest

Fehler 1. Art: Nullhypothese wird abgelehnt, obwohl sie richtig ist.

Fehler 2. Art: Nullhypothese wird nicht abgelehnt, obwohl sie falsch ist.

Durchführung: Stichprobe X = (X1, . . . , Xn), Realisierung/Meßdaten x = (x1, . . . , xn).

➸ Bilde Stichprobenfunktion T (X);

☞ Berechne Testgröße/Teststatistik t = T (x) ∈ IRn;

➸ Lege Ablehnungsbereich (kritischen Bereich) K ⊆ IRn für H0 fest;

☞ in Abhängigkeit von der Testgröße so, daß WK für Fehler 1. Art höchstens α ist;

☞ Signifikanzniveau α; Signifikanztest zum Niveau α;

➸ Lehne H0 ab, falls t ∈ K; Unterschied signifikant.

Beachte: Nicht-Ablehnung bedeutet nicht Akzeptanz, nur daß H0 aufgrund von x nicht

abgelehnt werden kann.

5–87

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.4 Anpassungstests

Statistische Anpassungstests

Nichtparametrische Tests (Verteilungsfreie Tests)

➸ H0 und H1 beziehen sich nicht auf einzelne Parameter sondern auf ganze Verteilungsfunktion F.

Anpassungstests (goodness of fit tests)

➸ Einseitiger nichtparametrischer Test;

➸ Nullhypothese H0 : F = F̂ mit vorgegebener (z.B. geschätzter) Verteilungsfunktion

F̂ .

Beispiele

➸ Chi-Quadrat-Anpassungstest (χ2-Anpassungstest)

➸ Kolmogorov-Smirnov-Test

➸ Anderson-Darling-Test

Im folgenden χ2-Anpassungstest und Kolmogorov-Smirnov-Test...

5–88

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.4 Anpassungstests

5.4.3 Chi-Quadrat-Anpassungstest

➸ Zerlege Wertebereich der Daten (nicht notwendigerweise äquidistant) in Klassen

☞ [a0, a1), [a1, a2), [ak−1, ak ]

(ggf. a0 = −∞, ak = ∞);

➸ Vergleiche Anzahl von Daten in den Intervallen mit zu testender Verteilung

☞ Nj = Anzahl der Daten im j-ten Intervall,

☞ pj = erwarteteter Anteil von Daten im j-ten Intervall, wenn zu Verteilung richtig,

Z aj

X

fˆ(x)dx bzw. pj =

p̂(x).

pj =

aj−1

aj−1 ≤aj

⇒ npj = erwartete Anzahl von Daten im j-ten Intervall.

☞ Falls Verteilung nah bei der wahren Verteilung, dann Nj ≈ npj .

➸ Testgröße

t=

k

X

(Nj − npj )2

j=1

npj

k

X

Nj2

=

− n.

np

j

j=1

5–89

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.4 Anpassungstests

Warum Chi-Quadrat?

➸ Zugehörige Stichprobenfunktion ist bei Gültigkeit von H0 annähernd χ2-verteilt mit

k − 1 Freiheitsgraden.

➸ Faustregel: hinreichend gut, wenn für alle j = 1, . . . , k : npj ≥ 5

☞ Ändere ggf. die Klasseneinteilung durch Zusammenfassung benachbarter Klassen.

➸ Ablehnung von H0, falls t ≥ χ2k−1,1−α,

t ≥ χ2k−1,1−α ist (1 − α)-Quantil der χ2-Verteilung mit k − 1 Freiheitsgraden

→ Tabellen der χ2-Verteilung.

Offensichtlich

➸ Vorteil: allgemeine Anwendbarkeit.

➸ Nachteil: außer Faustregel keine Vorschrift zur Klasseneinteilung.

Beispiele → Übung?

5–90

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.4 Anpassungstests

5.4.4 Kolmogorov-Smirnov-Test

Voraussetzung: stetige Verteilung

➸ Testgröße t = dn = sup |Fn(x) − F̂ (x)|

x∈IR

mit empirischer Verteilungsfunktion Fn.

➸ Berechnung der Testgröße

d+

n

d−

n

=

=

max

i∈{1,...,n}

max

i∈{1,...,n}

µ

µ

¶

i

− F̂ (x(i)) ,

n

¶

i−1

F̂ (x(i)) −

,

n

−

dn = max(d+

n , dn ).

➸ Ablehnung von H0, falls t ≥ Kn,1−α,

Kn,1−α kritische Werte der Kolmogorov-Verteilung → Tabellen.

5–91

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.5 Ausblick auf Netzlastmodelle

Abschnitt 5.5

Ausblick auf Netzlastmodelle

5–92

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.5 Ausblick auf Netzlastmodelle

5.5.1 Netzverkehrscharakteristika

In konventionellen Lastmodellen werden wesentliche Eigenschaften heutiger Kommunikationssysteme nicht oder nur unzureichend erfaßt.

Messungen zeigen

➸ Lastspitzen (bursty arrivals) Ã Gruppenankünfte

➸ Starke Abhängigkeiten aufeinanderfolgender Zwischenankunftszeiten

⇒ keine Erneuerungsprozesse

➸ Sogar weitreichende Abhängigkeiten (long range dependence)

z.B. bei Ethernet LAN, Internet WAN, ATM

à selbstähnlicher Verkehr (self similar traffic)

à fraktale Prozesse

Hervorgerufen wesentlich von

endlastigen Verteilungen (heavy-tailed distributions)

5–93

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

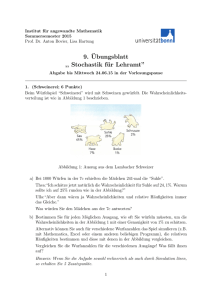

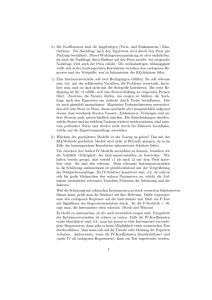

Poissonsche Lasten

Poissonsche Lasten auf verschiedenen Zeitskalen

5.5 Ausblick auf Netzlastmodelle

5–94

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

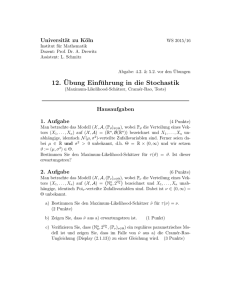

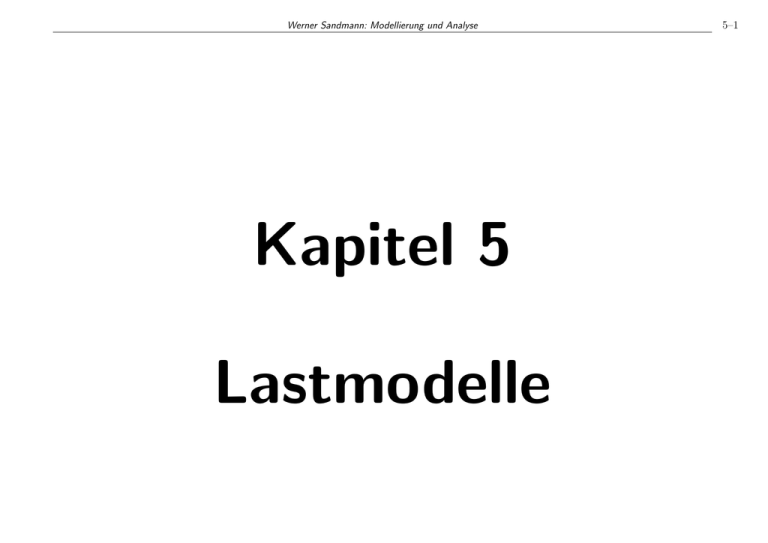

Fraktale Lasten

Fraktale Lasten auf verschiedenen Zeitskalen

5.5 Ausblick auf Netzlastmodelle

5–95

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.5 Ausblick auf Netzlastmodelle

5.5.2 Endlastige Verteilungen

Informell

Endlastige Verteilungen haben eine nicht zu vernachlässigende WK auch für sehr

große Werte.

Insbesondere: subexponentiell fallende Dichte.

Zu beobachten bei

Typische endlastige Verteilungen

➸ Dateigrößen im WWW,

➸ Pareto–Verteilung

➸ Benutzungsdauern von CPUs,

➸ Weibull–Verteilung

➸ Internet-Sitzungsdauern,

➸ Lognormal–Verteilung

➸ Anzahl von Paketen pro Sitzung,

➸ ...

➸ TCP-Verbindungen pro Sitzung,

Häufigste: Pareto

➸ ...

5–96

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.5 Ausblick auf Netzlastmodelle

Formale Definitionen

Endlastige Verteilung (heavy-tailed distribution)

lim P (X > x + y | X > x) = 1,

x→∞

y ≥ 0.

Gegeben sei eine endlastige Verteilungsfunktion F mit

F (x) = 1 − x−αJ(x), α > 0

bzw.

1 − F (x) = x−αJ(x), α > 0,

wobei J eine langsam variierende (slowly varying) Funktion ist, d.h

J(tx)

= 1.

∀t > 0 : lim

x→∞ J(x)

➸ α heißt Tail-Index von F,

➸ γ = 1/α heißt Extremwertindex (extreme value index, EVI) von F.

Für die Quantilfunktion gilt dann

µ ¶

−γ ˜ 1

,

Q(1 − p) = p J

p

wobei J˜ eine weitere langsam variierende Funktion ist.

5–97

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.5 Ausblick auf Netzlastmodelle

Pareto–Verteilung

Pareto–Verteilung

➸ Dichte und Verteilungsfunktion

aba

f (x) = a+1 ,

x

a > 0, x > b.

µ ¶a

b

,

F (x) = 1 −

x

a > 0, x > b.

➸ Erwartungswert existiert nur für a > 1, zweites Moment und Varianz nur für a > 2

ab

, a > 1;

E[X] =

a−1

➸ Tail- und Extremwertindex

ab2

E[X ] =

,

a−2

2

ab2

VAR[X] =

, a > 2.

(a − 2)(a − 1)2

µ ¶a

b

= x−aba.

1 − F (x) =

x

mit α = a, γ = 1/a und J(x) = ba, x ∈ IR und Quantilfunktion Q(1 − p) = p−γ b.

5–98

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.5 Ausblick auf Netzlastmodelle

5.5.3 Schätzung von Extremwertindizes

Schätzung von Tail–Index und Extremwertindex mittels Quantil–Schätzungen

➸ Für endlastige ZV X mit Verteilungsfunktion F (x) = 1 − x−αJ(x), α > 0 gilt

sowie

P (ln X > x) = P (X > ex) = 1 − F (ex) = e−αxJ(ex)

µ ¶

−γ ˜ 1

Q(1 − p) = p J

p

➸ Konsistenter Schätzer für Q(1 −

⇒

µ ¶

1

˜

ln Q(1 − p) = −γ ln p + ln J

.

p

j

) ist X(n−j+1) mit X(1) ≤ X(2) ≤ · · · ≤ X(n).

n+1

Graphische Überlegung

➸ Plottet man ln X(n−j+1) gegen − ln(j/(n + 1)), also die Veranschaulichung von

j

7→ ln X(n−j+1),

− ln

n+1

so fällt auf, daß dieser Plot ab einem bestimmten Punkt nahezu linear verläuft,

➸ γ kann also als Steigung einer Geraden interpretiert werden.

5–99

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.5 Ausblick auf Netzlastmodelle

Graphische Konstruktion

Wähle als einen solchen Punkt (ab dem der Plot nahezu linear verläuft)

µ

¶

k+1

(x, y) := − ln

, ln X(n−k) ,

n+1

also j = k + 1 bzw. k = j − 1.

Konstruiere für jeden Punkt rechts von (x, y) ein Steigungsdreieck mit (x, y).

Beachte dabei

j ≤k ⇒ n−j+1≥n−k+1>n−k

⇒ X(n−j+1) > X(n−k) ⇒ ln X(n−j+1) > ln X(n−k),

k

k+1

j

≤

<

j≤k ⇒

n+1 n+1 n+1

⇒ ln

k+1

j

k+1

j

< ln

⇒ − ln

> − ln

.

n+1

n+1

n+1

n+1

5–100

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.5 Ausblick auf Netzlastmodelle

Schätzung mittels Steigungen

Für j ∈ {1, . . . , k} ergeben sich die Steigungen

mj =

ln X(n−j+1) − ln X(n−k)

j

k+1

− ln n+1

+ ln n+1

ln X(n−j+1) − ln X(n−k)

¡ j

¢ ,

=

k+1

− ln n+1 − ln n+1

die nun zur Schätzung des Extremwertindex benutzt werden können.

Naheliegendster Schätzer ist das Stichprobenmittel der Steigungen

k

mk,n

1 X ln X(n−j+1) − ln X(n−k)

¡ j

¢

=

k+1

k j=1 − ln n+1 − ln n+1

k

1 X ln X(n−j+1) − ln X(n−k)

.

= −

j

k+1

k j=1

ln n+1 − ln n+1

5–101

Werner Sandmann: Modellierung und Analyse

Kapitel 5 Lastmodelle

5.5 Ausblick auf Netzlastmodelle

Hill–Schätzer

Quotient der mittleren Abweichungen von y– bzw. x– Koordinaten:

k ¡

k

¢ 1P

P

1

ln X(n−j+1) − ln X(n−k)

ln X(n−j+1) − ln X(n−k)

k

k

∆y k,n

j=1

j=1

=

=

.

k

k

¡

¡

¢¢

¡

¢

P

P

∆xk,n

j

j

1

k+1

1

k+1

−

ln

−

ln

−

ln

−

ln

k

n+1

n+1

k

n+1

n+1

j=1

j=1

Für große k ist Nenner ≈ 1

Hk,n

→ Hill–Schätzer

k

1X

=

ln X(n−j+1) − ln X(n−k).

k j=1

➸ Obige Schätzer hängen von k ab.

➸ Für verschiedene k jeweils verschiedene Schätzer mk,n, ∆y k,n/∆xk,n und Hk,n,

☞ dabei Tradeoff zwischen Varianz und Verzerrung der Schätzer.

➸ Wahl des Parameters k also kritisch bei der Schätzung von Extremwertindizes.

5–102