schönberg intervalle

Werbung

Splinekurven und -flächen im CAGD

Vorlesung, zuerst gehalten im Wintersemester 1998/99

Tomas Sauer

Version 1.0

Letzte Änderung: 21.1.2003

Statt einer Leerseite . . .

Maches sagt ich,

mehr noch wollt ich,

ließe zur Rede

Raum das Geschick.

Die Stimme weicht,

Wunden schwellen:

Wahres sprach ich;

will nun enden.

Die Edda, Das jüngere Sigurdlied

INHALTSVERZEICHNIS

1

Inhaltsverzeichnis

1 Eine kurze Geschichte der Splines

3

2 Warum Splines?

6

2.1 Interpolation durch Polynome . . . . . . . . . . . . . . . . . . . . . . . . . 6

2.2 Stückweise polynomiale Interpolation . . . . . . . . . . . . . . . . . . . . . 10

2.3 Minimalität und Namensgebung . . . . . . . . . . . . . . . . . . . . . . . . 12

3 Bézierflächen

3.1 Baryzentrische Koordinaten . . .

3.2 Der Algorithmus von de Casteljau

3.3 Bézierflächen . . . . . . . . . . .

3.4 Ableitungen von Bézierflächen . .

4 Blossoming

4.1 Blossoming

4.2 Blossoming

4.3 Blossoming

4.4 Blossoming

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

via de Casteljau . . . . . . . .

und Subdivision . . . . . . . .

und Ableitungen . . . . . . . .

und glattes Aneinanderkleben

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

15

15

18

19

23

.

.

.

.

28

28

31

33

35

5 Univariate Splines und Interpolation an den Knoten

39

5.1 Interpolation an einfachen Knoten . . . . . . . . . . . . . . . . . . . . . . . 39

5.2 Eine erste Basis der Splineräume . . . . . . . . . . . . . . . . . . . . . . . 44

5.3 Interpolation an Mittelwerten von Knoten . . . . . . . . . . . . . . . . . . 45

6 B–Splines

6.1 Der Algorithmus von de Boor . . . . . . . .

6.2 B–Splines . . . . . . . . . . . . . . . . . . .

6.3 Differenzierbarkeit von Splinekurven . . . .

6.4 Der Satz von Curry–Schoenberg . . . . . . .

6.5 Knoteneinfügen . . . . . . . . . . . . . . . .

6.6 Ableitungen und Integrale von Splinekurven

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

7 Interpolation und Approximation durch Splines

7.1 Der Satz von Schoenberg und Whitney . . . . . .

7.2 Totale Positivität der Kollokationsmatrizen . . . .

7.3 Variationsvermindernde Splineapproximation . . .

7.4 Approximationsordnung . . . . . . . . . . . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

46

47

49

53

56

58

61

.

.

.

.

65

66

70

72

73

8 Simplex–Splines

76

8.1 Geometrische Interpretation der B–Splines . . . . . . . . . . . . . . . . . . 76

8.2 Definition und Eigenschaften der Simplex–Splines . . . . . . . . . . . . . . 82

8.3 Kergin–Interpolation . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 90

2

INHALTSVERZEICHNIS

9 Simplex–Splines, B–Patches und Blossoming

95

9.1 B–Patches . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 95

9.2 Multivariate “B–Splines” . . . . . . . . . . . . . . . . . . . . . . . . . . . . 102

3

Geschichte muß doch wohl allein auf

Treu und Glauben angenommen

werden? Nicht?

Lessing, Nathan der Weise III,7

1

Eine kurze Geschichte der Splines

Auch wenn man gerne die Arbeiten [39, 40] von Schoenberg aus dem Jahr 1946 als die

“Geburtsstunde” der Splines bezeichnet, waren die B–Splines “wahrscheinlich Hermite

und sicherlich Peano” (Schoenberg in [41]) bekannt. Will man noch weiter in der Geschichte zurückgehen, so kann man sich auf die exponential Euler Splines berufen, die

bereits von Euler (1755), aber natürlich nicht unter diesem Namen, untersucht wurden.

Eine Zusammenfassung der “Ur- und Frühgeschichte” der Splines gibt beispielsweise die

Arbeit von Butzer, Schmidt und Stark [11].

Doch kehren wir wieder zurück zu Isaac J. Schoenberg, einem der profiliertesten und

vielseitigsten angewandten und nicht nur angewandten Mathematiker dieses Jahrhunderts. Im Rahmen seiner Tätigkeit im War Department at Aberdeen Proving Ground

während des zweiten Weltkriegs begann er, ausgehend von Approximationsproblemen,

mit der Untersuchung von Splines. Es ist einer der wenigen positiven Aspekte des Kriegs,

daß zur selben Zeit auch Haskell B. Curry, ansonsten eher der Algebra und abstrakten Logik zugetan, von diesem Ansatz Kenntnis bekam und ihn gemeinsam mit Schoenberg weiterentwickelte. Eine Kopie eines Briefes, in dem Curry von diesen Entwicklungen

erzählt, findet sich im Buch von Micchelli [27] (das sich beispielsweise mit den Themen

Subdivision, Splines mit verallgemeinerten Differenzierbarkeitseigenschaften, multivariate

Splines und Blossoming befaßt und schon deswegen sehr empfehlenswert ist). Trotzdem

beschäftigte sich auch Schoenberg zuerst einmal lange Zeit mit anderen Dingen, so daß die

berühmte Arbeit von Curry und Schoenberg [15] erst mit fast 20–jähriger Verspätung im

Jahre 1966 erschien. Einer der Gründe, warum Schoenberg seine Resultate über Splines

wieder “aus der Schublade” holte, war wohl die Tatsache, daß inzwischen auch andere

Mathematiker, allen voran Carl de Boor, die Splines entdeckt hatten und so Schoenbergs

Interesse neu weckten. Natürlich bestand einer der Gründe für das aufkeimende allgemeine Interesse an Splines im Bedarf an “guten” Typen von Kurven im Zusammenhang mit

den CAD–Systemen und den numerischen Berechnungen, die durch die Entwicklung der

Computertechnik in ganz neuen Größenordnungen durchgeführt wurden. Auf der anderen

Seite waren und sind Splines auch ein wichtiges theoretisches Hilfsmittel bei der Untersuchung von n–ten Weiten, wo sie eine wichtige Rolle als Minimallösungen bestimmter

Funktionale spielen. Inzwischen ist die Literatur zum Thema “Splines” gigantisch. Die beste, umfangreichste und via Internet zugängliche Bibliographie stammt von de Boor und

kann beispielsweise über seine WWW–Homepage http://www.cs.wisc.edu/~deboor abgerufen werden.

4

1 EINE KURZE GESCHICHTE DER SPLINES

In den meisten “klassischen” Lehrbüchern über Numerische Mathematik werden Splines (oft nur kubisch, das heißt von der Ordnung m = 3) als Lösung eines Interpolationsproblems an den einfachen Knoten tm+1 , . . . , tn eingeführt und beschrieben. Nicht, daß

das irgend etwas schlechtes wäre, gerade in diesem Zusammenhang zeigen die Splines ein

den Polynomen weit überlegenes Verhalten, da sie das oftmals katastrophale Oszillationsverhalten der Interpolationspolynome nicht mitmachen. Auf alle Fälle hat man es aber

in diesem Rahmen wegen der einfachen Knoten stets mit Funktionen aus C m−1 zu tun.

Eine Basis des zugehörigen Splineraums ist dann schnell angegeben: sie besteht aus allen

Polynomen vom Grad m sowie den abgebrochenen Potenzen

(t − ti )m

t ≥ ti ,

m

i = m + 1, . . . , n − 1.

(t − ti )+ =

0

t < ti ,

Klar – diese Funktionen sind alle linear unabhängig, stückweise polynomial und m − 1

mal stetig differenzierbar. Damit haben wir also m + 1 Polynome und n − m − 1 abgebrochene Potenzen, also n Basisfunktionen, und da wir, dank der B–Splines, wissen, daß der

Splineraum Dimension n hat, sind diese Funktionen ebenfalls eine Basis. Allerdings eine

Basis mit Nachteilen: die Basisfunktionen haben unendlichen Träger! Deswegen war man

interessiert an einer Basis des Splineraums dergestalt, daß alle Basisfunktionen möglichst

kleinen Träger haben – und das führte zu den B–Splines. Daß diese Funktionen dann auch

noch über eine Rekursionsformel verknüpft sind, wie Cox [14] und de Boor [4] zeigten,

macht sie nur noch sympathischer. Zudem haben die Basisfunktionen mit kompaktem

Träger noch einen weiteren Vorteil, den bereits Schoenberg weidlich ausnutzte: da zur

Berechnung von N m (t) stets nur die m Knoten “links von t” und die m Knoten “rechts

von t”, sowie die m + 1 zugehörigen Kontrollpunkte verwendet werden, gibt es überhaupt

keine Schwierigkeiten, auch unendliche Knotenfolgen ti , i ∈ Z, mit unendlichen Kontrollpolygonen di , i ∈ Z, zu betrachten. Und das ist mit einer Basis aus Polynomen und

abgebrochenen Potenzen nun doch etwas unschön, da hier an jedem Punkt eine unendliche Anzahl von Basisfunktionen beiträgt. Aber besser noch: sind die Knoten gleichverteilt,

also z.B. ti = i, i ∈ Z, (das sind genau die Cardinal B–Splines von Schoenberg [41]), dann

sind die B–Splines lediglich verschobene Kopien voneinander, genauer

Nim (x) = N0m (x − i),

i ∈ Z,

und man hat eigentlich nur einen B–Spline.

Aus den 70er und 80er Jahren gibt es eine Vielzahl von Arbeiten über Splines, die

für einige Zeit ein richtiges “Modethema” waren. Einen gewissen Überblick aus unterschiedlichen Perspektiven und von unterschiedlichen Zugängen her bieten beispielsweise

die Bücher von de Boor [5], Schumaker [42] oder Nürnberger [30]. Auf alle Fälle fand man

eine Vielzahl von Problemen und Gebieten, wo sich die Splines als mehr oder weniger

nützlich erwiesen.

Trotzdem geschah noch einmal das Wunder, daß auf einem eigentlich “abgegrasten”

Feld, das die (univariaten) Splines in den 80er Jahren mit Sicherheit waren, noch einmal

zarte Blüten (engl. “blossoms”) sprossen. Es war überraschenderweise wieder de Casteljau,

5

der zuerst auf die Zusammenhänge mit polaren Formen aufmerksam machte [12], wenn

auch in sehr schwer lesbarer Form. Die Anwendung von Blossoming auf Splinekurven geht

wohl auf Lyle Ramshaw [32] zurück (siehe auch und vor allem [33]). Die Darstellung in

diesem Skript folgt in weiten Zügen [35], die ihrerseits auf einer Arbeit von Hans–Peter

Seidel [44] basiert, welche im wesentlichen für meine Begeisterung für dieses Gebiet verantwortlich ist. Seidels Ziel war es übrigens, die neuen Einsichten, die das Blossoming

gewährte, auch auf Flächen (generell, auf den multivariaten Fall) zu übertragen. Obwohl

da einige Dinge ganz entschieden anders sind als bei den Kurven, gelang es doch, Splineflächen von hochgradiger Flexibilität zu konstruieren. Aber das ist eine andere Geschichte,

die in Kapitel 9 erzählt werden soll . . ..

6

2 WARUM SPLINES?

Πóλµoς πατ ήρ π άντ ων

Der Krieg ist der Vater aller Dinge

Heraklit, Frag. 53

2

Warum Splines?

2.1

Interpolation durch Polynome

In vielen Anwendungen spielt das folgende Interpolationsproblem eine wichtige Rolle:

Gegeben seien Punkte x0 , . . . , xn ∈ I ⊂ R, I ein kompaktes Intervall. Zu

vorgegebenen Werten f0 , . . . , fn ∈ R finde man eine stetige Funktion f : I →

R, so daß

f (xj ) = fj ,

j = 0, . . . , n.

Derartige mathematische Aufgaben entstehen zum Beispiel bei der Erstellung ballistischer

Tabellen, bzw. bei der Approximation heuristischer (d.h. gemessener) Tabellen, und genau

diese Problematik führte I. J. Schoenberg zur “Erfindung” der Splines während seiner

Tätigkeit in den “Ballistic Research Laboratories”, Aberdeen, Maryland, während des

zweiten Weltkriegs (daher das Zitat).

Natürlich hat das obige Interpolationsproblem unendlich viele Lösungen. Die “prominenteste” und “klassischste” sind sicherlich Polynome.

Satz 2.1 Zu vorgegebenen Knoten x0 < x1 < · · · < xn und Daten f0 , . . . , fn gibt es genau

ein Polynom p vom Höchstgrad n, so daß

p (xj ) = fj ,

j = 0, . . . , n.

(2.1)

Der “Standardbeweis” für die obige Aussage verwendet die Darstellung

p(x) =

n

X

j=0

fj

n

Y

x − xk

,

xj − xk

k=0

k6=j

die aber numerisch hochgradig instabil ist. Wir wollen einen anderen, algorithmischen

Weg gehen.

Algorithmus 2.2 (Aitken–Neville)

Gegeben: paarweise verschiedene Knoten x0 , . . . , xn , Daten f0 , . . . , fn und x ∈ R.

1. Setze fj0 (x) = fj , j = 0, . . . , n.

2.1 Interpolation durch Polynome

7

2. Für k = 1, . . . , n berechne

fjk (x) =

xj+k − x k−1

x − xj k−1

fj (x) +

f (x),

xj+k − xj

xj+k − xj j+1

j = 0, . . . , n − k.

(2.2)

3. Ergebnis: f0n (x).

Der Algorithmus von Aitken–Neville ist ein sogenanntes “Pyramidenschema”:

f0

↓

0

f0 (x)

f1

↓

0

f1 (x)

&.

f01 (x)

...

...

fn−1

↓

0

fn−1 (x)

...

..

.

&.

f0n−1 (x)

..

.

&.

f1n−1 (x)

fn

↓

0

fn (x)

&.

1

fn−1

(x)

&.

f0n (x)

Proposition 2.3 (Eigenschaften von Aitken–Neville)

1. Die Abbildung x 7→ f0n (x) ist ein Polynom vom Grad ≤ n.

2. Für k = 0, . . . , n gilt:

fjk (xm ) = fm ,

m = j, . . . , j + k,

(2.3)

insbesondere interpoliert p(x) = f0n (x).

Beweis: Eigenschaft 1. folgt sofort aus (2.2), und (2.3) beweisen wir durch Induktion über

k, wobei der Fall k = 0 genau der Initialisierungschritt im Algorithmus von Aitken-Neville

ist. Sie also (2.3) für ein k ≥ 0 bewiesen. Dann ist, nach (2.2) und Induktionsannahme,

fjk+1 (xj ) =

sowie

fjk+1 (xj+k+1 ) =

xj+k+1 − xj k

f (xj ) = fj ,

xj+k+1 − xj j

xj+k+1 − xj k

f (xj+k+1 ) = fj+k+1 .

xj+k+1 − xj j+1

Für m = j + 1, . . . , j + k haben wir schließlich nach Induktionsannahme daß fjk (xm ) =

k

fj+1

(xm ) = fm und daher

xj+k+1 − xm k

xm − xj

k

fj (xm ) +

fj+1

(xm )

xj+k+1 − xj

xj+k+1 − xj

xj+k+1 − xm + xm − xj

=

fm = fm ,

xj+k+1 − xj

fjk+1 (xm ) =

8

2 WARUM SPLINES?

also gilt (2.3) auch für k + 1, womit der Beweis beendet ist.

Beweis von Satz 2.1: Die Existenz eines Interpolationspolynoms haben wir, wenn auch

etwas umständlich, bewiesen. Die Eindeutigkeit folgt sofort aus der Tatsache, daß jedes

Polynom vom Grad ≤ n mit n + 1 Nullstellen das Nullpolynom sein muß.

Übung 2.1 Zeigen Sie: jedes Polynom vom Grad ≤ n, das an n+1 Punkten verschwindet,

ist das Nullpolynom.

♦

Wenn man also mit Polynomen so gut interpolieren kann, warum verwendet man sie

dann nicht durchgehend? Schauen wir uns ein Beispiel an . . .

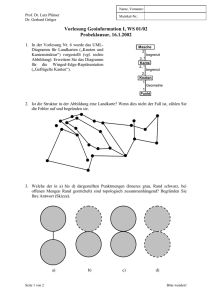

Beispiel 2.4 Wir betrachten I = [0, 1], xj = nj , fj = xj (1 − xj ), j = 0, . . . , n. Abbildung 2.1 zeigt diese Funktion und ein Interpolationspolynom vom Grad 30. So weit, so

gut. Stört man jedoch den Wert an der Stelle 21 um 1%, dann verändern sich die Interpolationspolynome vom Grad 10 und 20 dramatisch – dies sind die beiden anderen

Funktionen. Mit anderen Worten: ist auch nur ein Meßwert gestört, dann wirkt sich eine

höhere Anzahl von Meßwerten möglicherweise sogar negativ aus.

Abbildung 2.1: Beispiele für Interpolation einer (gestörten) Parabel. Links die Funktion selbst, dann ein Interpolant vom Grad 30 sowie Interpolanten vom Grad 10 und

20, wobei der Wert im Scheitelpunkt um 1% gestört ist.

Definition 2.5 (Der Interpolationsoperator und seine Norm)

Seien x0 , . . . , xn ∈ I ⊂ R, I kompakt gegeben.

1. Der lineare Operator Ln : C(I) → Πn , definiert durch

Ln f (xj ) = f (xj ) ,

j = 0, . . . , n,

heißt der Interpolationsoperator bezüglich x0 , . . . , xn .

2. Die Norm eines linearen Operators L : X → Y zwischen zwei Banachräumen X

und Y ist definiert als

kLk = sup kLf kY .

kf kX =1

2.1 Interpolation durch Polynome

9

3. Auf C(I) wählen wir die Norm

kf k∞ = max |f (x)| .

x∈I

4. Für einen Operator L : C(I) → C(I), insbesondere für Ln , wählen wir

kLf k∞

f ∈C(I) kf k∞

kLk∞ = sup

Der folgende Satz (ohne Beweis) zeigt, daß die Wahl der Interpolationspunkte die

Norm des Interpolationsoperators stark beeinflußt.

Satz 2.6 (Normen von polynomialen Interpolationsoperatoren)

Sei I = [−1, 1].

1. Wählt man die Knoten äquidistant, d.h. setzt man

xj =

2j − n

,

n

j = 0, . . . , n,

dann gibt es eine von n unabhängige Konstante C > 0, so daß

kLn k∞ ≥ C en/2 ,

n ∈ N0 .

(2.4)

2. Wählt man die Knoten als Tschebyscheff–Knoten, d.h. setzt man

xj = cos

(2j − 1)π

,

2n

j = 0, . . . , n,

dann ist

kLn k∞ ≤

2

log n + 4,

π

n ∈ N0 .

(2.5)

Definition 2.7 Die Zahlen λn = kLn k∞ bezeichnet man auch als Lebesguekonstanten.

Korollar 2.8 (Verhalten der Interpolation)

1. Bei der Wahl äquidistanter Knoten divergiert die Folge der Interpolationspolynome

Ln f , n ∈ N0 , auch für “brave” Funktionen (Runge–Beispiel).

2. Wählt man Tschebyscheff–Knoten, dann konvergiert die Folge Ln f , n ∈ N0 , für alle

f ∈ C 1 [−1, 1].

10

2 WARUM SPLINES?

Beweis: Die zweite Aussage beweist man, indem man die polynomiale Bestapproximation

verwendet, d.h. man definiert für f ∈ C(I) die Zahlen

En (f ) = min kf − pk∞

p∈Πn

und erhält

kf − Ln f k∞ ≤ (1 + λn ) En (f ).

(2.6)

Außerdem ergibt sich aus den Jackson–Sätzen der Approximationstheorie, daß

f ∈ C 1 [−1, 1]

⇒

lim n En (f ) = 0.

n→∞

Kombiniert man diese beiden Gleichungen, dann ist, im Falle der Tschebyscheff–Knoten

2

lim kf − Ln f k∞ ≤ lim 5 + log n En (f ) = 0.

n→∞

n→∞

π

Übung 2.2

1. Beweisen Sie die Abschätzung (2.6).

2. Programmieren Sie den Algorithmus von Aitken–Neville

√ und betrachten Sie das

Verhalten der Interpolanten von x 7→ |x| und x 7→ 1 + x auf [−1, 1] bezüglich

äquidistanter Knoten und Tschebyscheff–Knoten.

♦

Ein weiterer Nachteil der Polynome ist ihre Globalität: ändert man einen Interpolationswert ab, so verändert sich die gesamte Kurve und oftmals (siehe Beispiel 2.4) wirkt sich

das auch noch umso stärker aus, je weiter man von diesem Interpolationspunkt entfernt

ist.

2.2

Stückweise polynomiale Interpolation

Nun kann man oftmals die Interpolationspunkte nicht frei wählen, sondern sie stammen aus einem Meßprozeß und sind dann möglicherweise auch noch äquidistant. Es gibt

aber einen ganz einfachen Interpolationsoperator, der nicht nur die optimale Norm 1

hat, sondern der auch noch gleichmäßig konvergiert, solange nur die Interpolationspunkte

gleichmäßig verteilt sind.

Übung 2.3 Zeigen Sie: ist L : C(I) → C(I) ein Interpolationsoperator, dann ist kLk∞ ≥

1.

♦

2.2 Stückweise polynomiale Interpolation

11

Definition 2.9 Es sei I = [a, b] ⊂ R ein kompaktes Intervall und

a = x0 < x1 < · · · < xn−1 < xn = b

eine geordnete Knotenmenge. Der stückweise lineare Interpolant S1 f zu f ∈ C(I) bezüglich

der Knotenmenge x0 , . . . , xn ist definiert als

xj+1 − x

x − xj

S1 f (x) =

f (xj ) +

f (xj+1 ) ,

x ∈ [xj , xj + 1] , j = 0, . . . , n − 1.

xj+1 − xj

xj+1 − xj

(2.7)

Proposition 2.10 (Eigenschaften von S1 )

1. Der Interpolant S1 f ist eine stückweise affine stetige Funktion.

2. kS1 k∞ = 1.

3. Ist xnj : j = 0, . . . , n n∈N eine Folge von Knotenmengen mit xn0 = a, xnn = b,

0

n ∈ N0 und

lim max (xj+1 − xj ) = 0,

n→∞ j=0,...,n−1

dann konvergieren die zugehörigen Interpolationsoperatoren S1n f gleichmäßig gegen

f für jedes f ∈ C(I).

Beweis: Die erste Aussage ist trivial, die zweite folgt aus

|S1 f (x)| ≤ max |f (xj )| ≤ max |f (x)|

j=0,...,n

x∈I

und S1 1 ≡ 1. Für die dritte Aussage benutzt man schließlich die gleichmäßige Stetigkeit

von f .

Proposition 2.10 zeigt, daß der stückweise lineare Interpolant wesentlich “bräver” als

das Interpolationspolynom ist, nur ist die resultierende Funktion leider gerade mal stetig

und nicht besonders ästhetisch. Also zieht man sich auf stückweise polynomiale Funktionen

zurück und fordert zusätzlich noch Differenzierbarkeit.

Definition 2.11 Es sei I = [a, b] ⊂ R ein kompaktes Intervall und

a = x0 < x1 · · · < xn−1 < xn = b

eine geordnete Knotenmenge. Eine Funktion f : I → R heißt (polynomialer) Spline der

Ordnung m und der Glattheit k bezüglich der Knotenmenge x0 , . . . , xn wenn

1. f ∈ C k (I),

2. die Einschränkung von f auf die offenen Intervalle (xj , xj+1 ), j = 0, . . . , n − 1, ist

ein Polynom vom Höchstgrad m.

Beispiel 2.12 Die Interpolationsfunktion S1 f ist ein Spline der Ordnung 1 und der Glattheit 0.

Wir werden später sowohl die Existenz von Splines wie auch einige ihrer Interpolationsund Approximationseigenschaften herleiten.

12

2 WARUM SPLINES?

2.3

Minimalität und Namensgebung

Woher kommt aber nun der Name “Spline” für diese Funktionen? Ist er ein Akronym,

beispielsweise für “Stückweise polynomiale lineare Iterpolationsoperatoren mit (guten)

numerischen Eigenschaften” (immerhin war Schoenberg deutschstämmig)? Natürlich nicht!

Ein Spline ist ein Kurvenlineal, das im Schiffbau schon lange verwendet wurde. Hierbei

wird ein schmaler Metallstreifen so ausgerichtet, daß er vorgegebe Knoten passiert und

damit eine glatte (nicht knicken!) interpolierende Kurve bildet. Die Physik dahinter ist,

daß der Metallstreifen, faul wie er ist, sich so formt, daß die Biegeenergie minimiert wird.

Eine Näherung für die Biegeenergie einer Funktion f ∈ C 2 (I) ist die Halbnorm

sZ

(f 00 (x))2 dx.

|f |2,2 =

(2.8)

I

Und diese Näherung, bzw. ihre “physikalische” Interpretation ist gerade der Grund für

die Namensgebung.

Satz 2.13 Es sei I = [a, b] ⊂ R ein kompaktes Intervall und

a = x0 < x1 < · · · < xn−1 < xn = b

eine geordnete Knotenmenge. Zu beliebigem f ∈ C 2 (I) sei S3,2 f ein Spline der Ordnung

3 mit Glattheit 2, der

f (xj ) = S3,2 f (xj ) ,

j = 0, . . . , n

(2.9)

und

(S3,2 f )00 (x0 ) = (S3,2 f )00 (xn ) = 0

(2.10)

|f |2,2 ≥ |S3,2 f |2,2 .

(2.11)

erfüllt. Dann gilt

Bemerkung 2.14 (Kubische Splines und Minimalität)

1. Ein Spline der Ordnung 3 heißt kubischer Spline.

2. Der kubische Spline der Ordnung 3 und Glattheit 2, der (2.10) erfüllt, heißt natürlicher Spline.

3. Natürlich sind Splines der Ordnung m nur bis zur Glattheit m − 1 interessant –

ansonsten wären sie ja Polynome.

4. Satz 2.13 sagt also, daß der interpolierende natürliche Spline (sofern es ihn gibt)

unter allen C 2 –Lösungen eines Interpolationsproblems die geringste “Biegeenergie”

im Sinne von (2.8) besitzt.

5. In [7] findet man die folgende Aussage:

2.3 Minimalität und Namensgebung

13

Die Extremaleigenschaft des interpolierenden Splines wird häufig für die

große praktische Nützlichkeit der Splines verantwortlich gemacht. Dies ist

jedoch glatter “Volksbetrug” . . ..

Beweis von Satz 2.13: Wir beginnen mit

Z

2

2

|f − S3,2 f |2,2 =

f 00 (x) − (S3,2 f )00 (x) dx

ZI

2

2

=

(f 00 (x)) − 2f 00 (x)(S3,2 f )00 (x) + (S3,2 f )00 (x) dx

I

Z

2

= |f |2,2 − 2

f 00 (x) − (S3,2 f )00 (x) (S3,2 f )00 (x) dx − |S3,2 f |22,2 . (2.12)

I

Nun zerlegen wir den mittleren Term von (2.12) in

x

n−1 Zj+1

X

j=0 x

j

f 00 (x) − (S3,2 f )00 (x) (S3,2 f )00 (x) dx.

Da auf jedem der Intervalle (xj , xj+1 ) der Spline ein Polynom vom Grad 3 ist, ist er dort

unendlich oft differenzierbar und erhalten mit partieller Integration für j = 0, . . . , n − 1

x

Zj+1

f 00 (x) − (S3,2 f )00 (x) (S3,2 f )00 (x) dx

xj

x

Zj+1

xj+1

0

00

0

f 0 (x) − (S3,2 f )0 (x) (S3,2 f )(3) (x) dx

−

f (x) − (S3,2 f ) (x) (S3,2 f ) (x)

=

xj

xj

xj+1

xj+1

− (f (x) − (S3,2 f (x))) (S3,2 f )(3) (x)

f 0 (x) − (S3,2 f )0 (x) (S3,2 f )00 (x)

=

xj

xj

+

x

Zj+1

(f (x) − S3,2 f (x)) (S3,2 f )(4) (x) dx.

(2.13)

xj

Nun verschwindet der zweite Term in (2.13) wegen (2.9) und der dritte Term da (S3,2 f )(4) =

0. Also ist

Z

f 00 (x) − (S3,2 f )00 (x) (S3,2 f )00 (x) dx

I

=

x

n−1 Zj+1

X

j=0 x

j

=

n−1

X

j=0

f 00 (x) − (S3,2 f )00 (x) (S3,2 f )00 (x) dx

xj+1

f 0 (x) − (S3,2 f )0 (x) (S3,2 f )00 (x)

xj

= − f 0 (x0 ) − (S3,2 f )0 (x0 ) (S3,2 f )00 (x0 ) + f 0 (xn ) − (S3,2 f )0 (xn ) (S3,2 f )00 (xn ),

14

2 WARUM SPLINES?

was wegen (2.10) verschwindet. Also wird (2.12) zu

0 ≤ |f − S3,2 f |22,2 = |f |22,2 − |S3,2 f |22,2 ,

oder eben (2.11).

Übung 2.4 Zeigen Sie, daß für n ≥ 2 der natürliche Spline die eindeutige Minimallösung

im Sinne von Satz 2.13 ist, d.h. gilt |f |2,2 = |S3,2 f |2,2 , dann ist f = S3,2 f .

♦

15

Grundlagenforschung betreibe ich,

wenn ich nicht weiß, was ich tue

Wernher von Braun

3

Bézierflächen

Bézierflächen bilden eine wichtige Grundlage für das Verständnis und die Untersuchung

von Splines.

3.1

Baryzentrische Koordinaten

Wir beginnen mit einem wichtigen geometrischen Konzept, nämlich mit dem Begriff der

baryzentrischen Koordinaten im Rd . Dazu ein bißchen Notation. Für eine endliche Menge

V := {vj : j = 0, . . . , n} ⊂ Rd bezeichnen wir mit

( n

)

n

X

X

[V] = [vj : j = 0, . . . , n] =

uj vj : uj ≥ 0,

uj = 1 ⊂ Rd

(3.1)

j=0

j=0

die konvexe Hülle von V und mit

hVi = hvj : j = 0, . . . , ni =

( n

X

uj vj :

j=0

n

X

)

uj = 1

⊂ Rd

(3.2)

j=0

die affine Hülle von V.

Die Punkte vj , j = 0, . . . , n, befinden sich in allgemeiner Position wenn die Vektoren

yj = vj − v0 ,

j = 1, . . . , n,

linear unabhängig sind (das bedeutet insbesondere daß n ≤ d). Ist außerdem n = d, dann

heißt das Simplex [V] nichtdegeneriert.

Lemma 3.1 Für V = {vj : j = 0, . . . , d} sind die folgenden Bedingungen äquivalent.

1. [V] ist nichtdegeneriert.

2. hVi = Rd .

3. die Determinante

1

τ (V) = v0

. . . 1 =

. . . vd 1 . . . 1 v0,1 . . . vd,1 .. . .

. . .. .

v0,d . . . vd,d 16

3 BÉZIERFLÄCHEN

der Matrix

1 ... 1

v 0 . . . vd

∈ Rd+1×d+1

ist nicht Null.

Beweis: 1 ⇒ 2: nach der Annahme kann jedes x ∈ Rd (eindeutig) geschrieben werden

als

d

X

x = v0 +

aj (vj − v0 ) = (1 − a1 − · · · − ad ) v0 + a1 v1 + · · · + ad vd

j=1

und mit

u0 = 1 −

d

X

aj ,

uj = aj , j = 1, . . . , d,

j=1

erhält man die gewünschte Darstellung.

2 ⇒ 3: sei

d

X

x=

uj vj ∈ hVi ,

j=0

dann sind die Koeffizienten u0 , . . . , ud Lösungen des linearen Gleichungssystems

u0

1 . . . 1 ..

1

.

. =

v 0 . . . vd

x

ud

Damit dieses Gleichungssystem für alle x ∈ Rd lösbar ist, muß die Matrix von Null

verschiedene Determinante haben.

3 ⇒ 1: da, nach Spaltenumformungen,

1

0

...

0

= v1 − v0 . . . vd − v0 ,

0 6= τ (V) = v0 v1 − v0 . . . vd − v0 müssen die Vektoren linear unabhängig sein.

Ist n < d und sind Punkte v0 , . . . , vn gegeben, so können diese natürlich kein d–

dimensionales Simplex mehr aufspannen. Man spricht in diesem Fall dann von allgemeiner Lage, wenn [vj : j = 0, . . . , n] wenigstens noch ein n–dimensionales Simplex ist oder,

äquivalent, wenn es eine Matrix A ∈ Rd×n mit Rang n gibt, so daß

hvj : j = 0, . . . , ni = v0 + A Rn .

Diese Situation wird später bei den multivariaten Splines gelegentlich auftreten.

Nehmen wir also an, daß d + 1 Punkte vj , j = 0, . . . , d, in allgemeiner Lage gegeben

seien und beginnen wir mit dem Fall d = 1. Dann haben wir also zwei Punkte v0 < v1 ∈ R

3.1 Baryzentrische Koordinaten

17

und wir betrachten einen Punkt t ∈ [v0 , v1 ]. Der Punkt t teilt das Intervall [v0 , v1 ] im

Verhältnis t − v0 : v1 − t und es gilt die Identität

t=

v1 − t

t − v0

v0 +

v1 ,

v1 − v0

v1 − v0

denn

v1 − t

t − v0

v1 v0 − tv0 + tv1 − v1 v0

v1 − v0

v0 +

v1 =

=t

= t.

v1 − v0

v1 − v0

v1 − v0

v1 − v0

Außerdem ist

v1 − t

t − v0

+

=1

v1 − v0 v1 − v0

und die beiden Werte sind genau dann nichtnegativ, wenn t ∈ [v0 , v1 ].

Definition 3.2 Sei V = {vj : j = 0, . . . , d} ⊂ Rd die Eckenmenge des nichtentarteten

Simplex ∆ = [V]. Die baryzentrischen Koordinaten eines Punktes x ∈ Rd bezüglich ∆

sind der Vektor

u (x|∆) = (uj (x|∆) : j = 0, . . . , d) ∈ Rd+1 ,

so daß

x=

d

X

uj (x|∆) vj ,

j=0

d

X

uj (x|∆) = 1.

(3.3)

j=0

Wieder sind die baryzentrischen Koordinaten Lösungen des Gleichungssystems

1 ... 1

1

u (x|∆) =

(3.4)

v 0 . . . vd

x

und die Kramer’sche Regel liefert

uj (x|∆) =

wobei

τj (x|V) = τj (x|V)

,

τ (V)

j = 0, . . . , d,

1 ...

1

1

1

v0,1 . . . vj−1,1 x1 vj+1,1

.. . .

..

..

..

.

.

.

.

.

v0,d . . . vj−1,d xd vj+1,d

Bemerkung 3.3 Die baryzentrischen Koordinaten sind

... 1

. . . vd,1

.

..

. ..

. . . vd,d

(3.5)

1. affine Polynome in x.

2. Fundamentallösungen des Interpolationsproblems p(vj ) = yj , j = 0, . . . , d, d.h., es

gilt

uj (vk |∆) = δjk ,

j, k = 0, . . . , d.

(3.6)

18

3 BÉZIERFLÄCHEN

Aus Gleichung (3.5) folgt aber auch die geometrische Interpretation der baryzentrischen Koordinaten: da nämlich τ (V) das (vorzeichenbehaftete) Volumen des Simplex ∆

ist und τj (x|V) demzufolge das Volumen des Teilsimplex [v0 , . . . , vj−1 , x, vj+1 , . . . , vd ], sind

also die baryzentrischen Koordinaten nichts anderes als die Volumenanteile des jeweiligen

Subsimplex. Daher auch der Name als “Schwerpunktskoordinaten”.

Wir werden in Zukunft immer von nichtentarteten Simplizes ∆ ⊂ Rd und der zugehörigen Eckenmenge V ⊂ Rd sprechen, wobei wir immer annehmen, daß die Elemente

der Eckenmenge in allgemeiner Lage sind.

3.2

Der Algorithmus von de Casteljau

Wir wollen nun Flächen modellieren, die über Simplizes parametrisiert sind, also Abbildungen p : ∆ → RN , wobei ∆ ⊂ Rd ein nichtentartetes Simplex mit Eckenmenge V und

N ≥ 1 egal ist. “Modellieren” heißt hierbei, daß die Fläche durch eine endliche Anzahl

von Koeffizienten beschrieben wird, die ein Anwender festlegen und modifizieren kann.

Beispiel 3.4 Seien c0 , . . . , cn irgendwelche Punkte im RN . Dann ist

p(x) =

n

X

cj xj ,

x ∈ [v0 , v1 ]

j=0

eine (polynomiale) Kurve, die durch die “Kontrollpunkte” c0 , . . . , cn festgelegt ist.

Der Raum RN , in dem die Kontrollpunkte liegen, ist eigentlich irrelevant: durch separate

Behandlung der einzelnen Koordinaten der Kurve

p1 (x)

..

p(x) =

.

pN (x)

könnte man sich stets auch auf den Fall N = 1 beschränken.

Wir werden gleich ein einfaches Verfahren angeben, polynomiale Flächen zu konstruieren, deren Kontrollpunkte auch noch geometrische Information bieten. Doch zuerst etwas

Terminologie.

Definition 3.5 Ein Vektor α = (α0 , . . . , αd ) ∈ Nd+1

von nichtnegativen ganzen Zahlen

0

heißt ein Multiindex. Unter der Länge von α verstehen wir die Zahl

|α| =

d

X

αj .

j=0

Alle (homogenen) Multiindizes der Länge n ∈ N0 werden zusammengefaßt in

Γn = α ∈ Nd+1

:

|α|

=

n

.

0

(3.7)

Mit ej ∈ Γ1 , j = 0, . . . , d, bezeichnen wir die Einheitsvektoren ej,k = δjk , j, k = 0, . . . , d.

3.3 Bézierflächen

19

Algorithmus 3.6 (de Casteljau)

Gegeben: Kontrollpunkte cα , α ∈ Γn , und x ∈ ∆.

1. Bestimme u (x|∆).

2. Setze c0α (x) = cα , α ∈ Γn .

3. Für k = 1, . . . , n setze

ckα (x)

=

d

X

uj (x|∆) ck−1

α+ej (x),

α ∈ Γn−k .

(3.8)

j=0

4. Ergebnis: p(x) = cn0 (x).

Bemerkung 3.7

1. Jeder Schritt

h im Algorithmus von

i de Casteljau unterteilt jeden der d–dimensionalen

k−1

Simplizes cα+ej : j = 0, . . . , d , α ∈ Γn−k in genau derselben Weise, wie der Punkt

x ∈ ∆ das Simplex ∆ unterteilt.

h

i

2. Manche der Simplizes ck−1

:

j

=

0,

.

.

.

,

d

können sehr wohl degeneriert sein – für

α+ej

die Bestimmung des “Schwerpunkts” mittels u (x|∆) ist das vollkommen irrelevant.

3. Man kann jeden Schritt des Algorithmus auch als eine lineare Interpolation ansehen,

siehe auch Bemerkung 3.3.

4. Der Algorithmus von des Casteljau ist eine Verallgemeinerung von Kegelschnittkonstruktionen, die auf Steiner zurückgehen.

3.3

Bézierflächen

Als nächstes zeigen wir, daß der Algorithmus von de Casteljau polynomiale Flächen vom

Grad n erzeugt, die man sogar explizit angeben kann.

Definition 3.8

1. Für einen Multiindex α ∈ Nd+1

definiert man den Multinomialkoeffizienten

0

|α|

|α|!

=

,

α

α0 ! · · · αd !

und setzt diese auf Zd+1 fort, indem man den Multinomialkoeffizient auf Null setzt,

wenn α eine negative Komponente enthält.

20

3 BÉZIERFLÄCHEN

Abbildung 3.1: Der Algorithmus von de Casteljau für d = 1 und die dabei enstehende

Kurve

2. Die Bernstein–Bézier–Basispolynome sind definiert als

|α| α

|α|!

u (x|∆) =

Bα (x) =

uα0 (x|∆) · · · uαd d (x|∆) ,

α

α0 ! · · · αd ! 0

α ∈ Nd+1

0 . (3.9)

3. Konvention: Bα ist definiert für α ∈ Zd+1 wobei Bα ≡ 0 falls α 6∈ Nd+1

0 .

Übung 3.1 Zeigen Sie: das Polynom Bα nimmt sein Maximum an der Stelle mit den

baryzentrischen Koordinaten α/|α| an.

♦

Übung 3.2 Zeigen Sie: die Basispolynome bilden eine nichtnegative Teilung der Eins,

d.h.,

X

Bα ≡ 1.

α∈Γn

♦

Lemma 3.9 (Rekursionsformel für die Basispolynome)

Für α ∈ Nd+1

0 , α 6= 0, gilt

Bα (x) =

d

X

j=0

uj (x|∆) Bα−ej (x).

(3.10)

3.3 Bézierflächen

21

Beweis: Folgt sofort aus

X

d

d

X

αj |α|

|α|

(|α| − 1)!

=

=

α

|α| α

α0 ! · · · αj−1 ! (αj − 1)!αj+1 · · · αd !

j=0

j=0

αj >0

αj >0

d X

=

j=0

|α| − 1

α − ej

Satz 3.10 (Darstellung für Bézier–Flächen)

Für k = 0, . . . , n und α ∈ Γn−k gilt

X

ckα (x) =

cα+β Bβ (x),

(3.11)

β∈Γk

also insbesondere für k = n

p(x) = cn0 (x) =

X

cα Bα (x)

(3.12)

α∈Γn

Definition 3.11 Wir bezeichnen mit RN (Γn ) die Menge

RN (Γn ) = (cα : α ∈ Γn ) : cα ∈ RN , α ∈ Γn

und schreiben, für c ∈ RN (Γn ),

Bn c :=

X

cα Bα (x)

α∈Γn

für die zugehörige Bézierfläche.

Beweis von Satz 3.10: Induktion über k. Da B0 ≡ 1 ist der Fall k = 0 klar. Sei also

(3.11) für ein k ≥ 0 bewiesen. Dann gilt für α ∈ Γn−k−1 nach (3.8), unter Verwendung

der Induktionshypothese und mit (3.10)

ck+1

α (x) =

d

X

uj (x|∆) ckα+ej (x) =

j=0

=

d

X

=

uj (x|∆)

j=0

X

uj (x|∆) cα+β Bβ−ej (x) =

j=0 β∈Γk+1

X

d

X

X

cα+ej +β Bβ (x)

β∈Γk

X

β∈Γk+1

cα+β

d

X

uj (x|∆) Bβ−ej (x)

j=0

cα+β Bβ (x).

β∈Γk+1

Als nächstes stellen wir ein paar wichtige Eigenschaften der Bézierfläche Bn c zusammen, die mehr oder weniger direkt aus dem Algorithmus von de Casteljau folgen:

22

3 BÉZIERFLÄCHEN

Convex hull property: die Fläche liegt innerhalb der konvexen Hülle des Kontrollnetzes,

Bn c (∆) ⊂ [cα : α ∈ Γn ] .

(3.13)

Endpoint interpolation: die Fläche interpoliert in der Eckenmenge V,

Bn c (vj ) = cnej .

(3.14)

Beweis: (3.13) ergibt sich, da nach (3.8) für alle x ∈ ∆, k = 1, . . . , n und α ∈ Γn−k

ckα (x) ∈ ck−1

β (x) : β ∈ Γn−k+1 ,

also

Bn c(x) ∈ cn−1

α (x) : α ∈ Γ1 ⊆ · · · ⊆ [cα : α ∈ Γn ] .

(3.14) folgt sofort aus der Tatsache, daß uj (vk |∆) = δjk , j, k = 0, . . . , d, und daher

Bn c (vj ) = cn0 (vj ) = cn−1

ej (vj ) = · · · = cnej .

Lemma 3.12 Die Bernstein–Bézier–Basispolynome bilden eine Basis des Vektorraums

Πn aller Polynome vom Totalgrad höchstens n.

Beweis: Da die baryzentrischen Koordinaten Polynome

vom Totalgrad 1 sind, ist natürn+d

lich Bα ∈ Πn , α ∈ Γn . Nachdem außerdem #Γn = d = dim Πn , genügt es, die lineare

Unabhängigkeit der Basispolynome nachzuweisen, was wir per Induktion über n ∈ N0 tun

werden. Der Fall n = 0 ist klar, da B0 = 1 nicht die Nullfunktion und damit trivialerweise

linear unabhängig ist. Nehmen wir also an, wir hätten Lemma 3.12 für ein n ≥ 0 bewiesen

und wählen wir c ∈ R (Γn+1 ) so, daß für alle x ∈ ∆

0 = Bn+1 c(x) = cn+1

(x) .

0

Wir zeigen jetzt, daß c dann der Nullvektor sein muß. Dazu nehmen wir uns die niederdimensionalen Seiten

∆k = [vj : j = 0, . . . , k] = {x ∈ ∆ : uk+1 (x|∆) = · · · = ud (x|∆) = 0} ,

k = 0, . . . , d,

vor und beweisen induktiv über k = 0, . . . , d, daß

cα = 0,

α ∈ {β ∈ Γn+1 : βk+1 = · · · = βd = 0} .

(3.15)

Der Fall k = 0 ist nichts anderes als die Endpunkt–Interpolation (3.14). Um von k − 1

nach k zu kommen wählen wir x ∈ ∆k und erhalten

X

Bn+1 c(x) =

cα Bα .

(3.16)

αk+1 =···=αd =0

3.4 Ableitungen von Bézierflächen

23

Da ∆k−1 ⊂ ∆k ergibt sich nach Induktionsannahme außerdem, daß cα = 0, αk = · · · =

αd = 0, also wird (3.16) zu

X

Bn+1 c =

cα Bα

α∈Γm , αk >0

αk+1 =···=αd =0

X

= (n + 1)uk (x|∆)

α∈Γm , αk >0

αk+1 =···=αd =0

=

X

α∈Γn

αk+1 =···=αd =0

cα

Bα−ek

αk

cα+ek

Bα .

αk + 1

Auf diesen Ausdruck können wir schließlich die Induktion über n anwenden was uns (3.15)

liefert und damit den Beweis vervollständigt.

Übung 3.3 Beweisen Sie die Graderhöhungsformel: definiert man, für c ∈ RN (Γn ), ein

Kontrollpolyeder b

c ∈ RN (Γn+1 ) durch

d

X

βj

b

cβ =

cβ−ej ,

n+1

j=0

β ∈ Γn+1 ,

♦

dann ist Bn c = Bn+1b

c.

3.4

Ableitungen von Bézierflächen

Nun wenden wir uns den Richtungsableitungen von Bézierflächen zu, die uns, wie wir

sehen werden, geometrische Information liefern werden.

Definition 3.13 Ein Vektor y ∈ Rd+1 heißt (baryzentrische) Richtung, wenn y0 + · · · +

yd = 0. Die Richtungsableitung Dy entlang der baryzentrischen Richtung y ist für f ∈

C 1 (∆) definiert als

d

X

∂f

.

(3.17)

Dy f =

yj

∂uj (·|∆)

j=0

Für y ∈ Rd gilt entsprechend

Dy f =

d

X

j=1

yj

∂f

.

∂xj

(3.18)

Bemerkung 3.14 Da

xj =

d

X

k=0

uk (·|∆) vk,j ,

d.h.

∂xj

= vk,j

∂uk (·|∆)

24

3 BÉZIERFLÄCHEN

ist

d

d

X ∂f

X

∂f

∂xk

∂f

=

=

vj,k

= vjT ∇f = Dvj f

∂uj (·|∆) k=1 ∂xk ∂uj (·|∆) k=1

∂xk

(3.19)

und

Dy f =

d X

d

X

∂f

= y T V ∇f = DyT V f,

∂xk

yj vj,k

j=0 k=1

V = [v0 . . . vd ] ∈ R(d+1)×d .

(3.20)

P

Die Nebenbedingung

yj = 0 kommt daher, daß man y als Differenz zweier baryzentrischer Koordinaten auffaßt, d.h.,

y = u (x|∆) − u (x0 |∆) ,

x, x0 ∈ ∆.

Besondere Richtungsableitungen sind die achsenparallelen Richtungsableitungen Dej −ek ,

j, k = 0, . . . , d. Ihnen entsprechen nach (3.20) im Rd die Richtungen vj − vk . Außerdem

bilden sie eine Basis aller Richtungsableitungen, denn jede baryzentrische Richtung y ∈

Rd+1 kann, für jedes k ∈ {0, . . . , d}, geschrieben werden als

!

d

X

X

X

y=

yj ej =

yj (ej − ek ) + yk +

yj ek .

j=0

j6=k

j6=k

|

{z

=0

}

Auch die Richtungsableitungen von Bernstein–Bézier–Basispolynomen sind sehr einfach.

Lemma 3.15 Für eine baryzentrische Richtung y ∈ Rd+1 und α ∈ Nd0

Dy Bα = |α|

d

X

yj Bα−ej .

(3.21)

j=0

Insbesondere, für j, k = 0, . . . , d,

Dej −ek Bα = |α| Bα−ej − Bα−ek .

Beweis: Da Bα =

|α|

α

(3.22)

uα ist, falls αj > 0

|α|!

|α − ej | α−ej

∂

α−ej

Bα =

αj u

= |α|

u

= |α|Bα−ej ,

∂uj

α0 ! · · · αd !

α − ej

und falls αj = 0 ergibt sich

∂

B

∂uj α

= 0. Damit folgt (3.21) sofort.

Definition 3.16 Für j = 0, . . . , d sind die Shiftoperatoren Ej : RN (Γn ) → RN (Γn−1 )

definiert als

(Ej c)α = cα+ej ,

α ∈ Γn−1 .

3.4 Ableitungen von Bézierflächen

25

Mit diesem Lemma beweisen wir dann die folgende Formel für die Richtungsableitungen von Bézierflächen.

Satz 3.17 Seien y1 , . . . , ym achsenparallele Richtungen, d.h.

yi = eji − eki ,

i = 1, . . . , m.

Dann ist

Dy1 · · · Dym Bn c =

X

n!

(Ej1 − Ek1 ) · · · (Ejm − Ekm ) cα Bα

(n − m)! α∈Γ

(3.23)

n−m

Beweis: Es genügt, den Fall m = 1 zu betrachten, der Rest folgt induktiv. Nun ist nach

Lemma 3.15

X

X

Dej −ek Bn c =

cα Dej −ek Bα =

cα |α| Bα−ej − Bα−ek

α∈Γn

α∈Γn

X

= n

α∈Γn−1

X

cα+ej − cα+ek Bα = n

(Ej − Ek ) cα Bα .

α∈Γn−1

Satz 3.18 Sei y ∈ Rd+1 eine baryzentrische Richtung. Dann ist, für k ≥ 1,

X X

n!

cα+β Bα (·) Bβ (y)

Dyk Bn c =

(n − k)! α∈Γ β∈Γ

n−k

(3.24)

k

Bemerkung 3.19 Die Notation Bβ (y) ist ein leichter Mißbrauch und steht lediglich für

|β| β

Bβ (y) =

y .

β

Beweis von Satz 3.18: Induktion über k. Im Fall k = 1 ergibt sich mit (3.21)

Dy Bn c = n

X

α∈Γn

cα

d

X

yj Bα−ej = n

j=0

d

X X

yj cα+ej Bα = n

α∈Γn−1 j=0

X X

cα+β Bα (·)Bβ (y),

α∈Γn−1 β∈Γ1

für k > 1 ergeben die Induktionshypothese und (3.10)

X

X

Dyk Bn c = Dy Dyk−1 Bn c = Dy

cα+β Bα (·)Bβ (y)

α∈Γn−k+1 β∈Γk−1

=

X

X

cα+β Bβ (y)

=

X

X

yj Bα−ej (·)

j=0

α∈Γn−k+1 β∈Γk−1

n

X

n

X

yj cα+β+ej Bβ (y)Bα (·)

α∈Γn−k β∈Γk−1 j=0

=

X X

α∈Γn−k β∈Γk

cα+β Bα (·)

n

X

j=0

yj Bβ−ej (y) =

X X

α∈Γn−k β∈Γk

cα+β Bα (·)Bβ (y).

26

3 BÉZIERFLÄCHEN

Kombinieren wir (3.24) mit (3.11), dann ergibt sich die folgende Beziehung.

Korollar 3.20 Sei y ∈ Rd+1 eine baryzentrische Richtung. Dann ist, für k ≥ 1,

Dyk Bn c(x) =

X

n!

cn−k

(x) Bβ (y),

(n − k)! β∈Γ β

x ∈ ∆.

(3.25)

k

Insbesondere gilt:

1. Die Zwischenergebnisse des Algorithmus von de Casteljau liefern die entsprechenden

Ableitungen “frei Haus” mit:

Dy Bn c(x) = n

d

X

yj cn−1

ej (x),

x ∈ ∆.

(3.26)

j=0

2. Die Ableitungen an den Ecken von V werden durch die entsprechenden Kontrollpunkte an den Ecken bestimmt:

Dyk Bn c (vj ) =

X

n!

c(n−k)ej +β Bβ (y),

(n − k)! β∈Γ

j = 0, . . . , d.

(3.27)

k

3. Die Tangentialebenen an den Ecken vj werden erzeugt von

(Ek − Ej ) c(n−1)ej = c(n−1)ej +ek − cnej ,

k = 0, . . . , d, k 6= j,

j = 0, . . . , d.

Bemerkung 3.21 (Kontrollpunkte und Ableitungen)

1. Die Richtungsableitungen in Satz 3.17 übernehmen die Rolle der partiellen Ableitungen und sind durch entsprechende Differenzen der Kontrollpunkte definiert.

2. In seinem Buch führt Bézier die Bézierkurven sogar genau auf diese Art ein: Werte

und Ableitungen an den Enden des Intervalls sollen durch Differenzen der Kontrollpunkte definiert sein.

Übung 3.4 Zeigen Sie: es gibt genau ein quadratisches Polynom, das an den Ecken vj ,

j = 0, . . . , d, vorgegebene Werte und Tangentialebenen besitzt.

♦

3.4 Ableitungen von Bézierflächen

Abbildung 3.2: Bestimmung einer Richtungsableitung aus den Zwischenpunkten des

Algorithmus von de Casteljau.

Abbildung 3.3: Ableitungen und Kontrollpunkte in einer und in zwei Variablen. Die

Tangentialebene im Eckpunkt wird durch die Differenz der Kontrollpunkte festgelegt.

27

28

4 BLOSSOMING

Nur selten treffen mathematisches

Können und leicht faßliche

Darstellung zusammen

Egmont Colerus

4

Blossoming

Das sogenannte “Blossoming Principle”, oder auch der Übergang zu “polaren Formen”,

wird später eine wesentliches Hilfsmittel zum Verständnis der univariaten B–Splines und

zur Konstruktion multivariater B–Splines sein.

4.1

Blossoming via de Casteljau

Im Algorithmus von de Casteljau, Algorithmus 3.6, haben wir, um eine vernünftige polynomiale Kurve zu bekommen, in jedem Iterationsschritt die baryzentrischen Koordinaten

desselben Punktes x verwendet. Erlauben wir uns jetzt den Spaß, in jedem Schritt einen

anderen Punkt zu verwenden, so kommen wir zu allgemeineren Abbildungen, die sich aber

als extrem hilfreich erweisen werden.

Algorithmus 4.1 (Modifizierter de Castejau)

Gegeben: c ∈ RN (Γn ) und x1 , . . . , xn ∈ Rd .

1. Setze c0α () = cα , α ∈ Γn .

2. Für k = 1, . . . , n setze

ckα

(x1 , . . . , xk ) =

d

X

uj (xk |∆) ck−1

α+ej (x1 , . . . , xk−1 ) ,

α ∈ Γn−k .

(4.1)

j=0

3. Setze P c (x1 , . . . , xn ) = cn0 (x1 , . . . , xn ).

Als erstes ein paar Eigenschaften der Funktion P c : Rd

n

→ RN .

Proposition 4.2 Die Funktion P c ist eine symmetrische multiaffine Form mit Diagonale

Bn c, d.h.,

1. (Symmetrie) ist σ eine Permutation von {1, . . . , n}, dann gilt

P c xσ(1) , . . . , xσ(n) = P c (x1 , . . . , xn )

(4.2)

4.1 Blossoming via de Casteljau

29

2. (Affinität in jeder Koordinate) sind y0 , . . . , yk in allgemeiner Position und ist xj ∈

∆0 := [y0 , . . . , yk ] für ein j ∈ {1, . . . , n}, dann gilt

P c (x1 , . . . , xn ) =

d

X

uk (xj |∆0 ) P c (x1 , . . . , xj−1 , yk , xj+1 . . . , xn ) .

(4.3)

k=0

3. (Diagonale) für x ∈ ∆

P c (x, . . . , x) = Bn c(x)

(4.4)

Beweis: Da die Menge aller Permutationen von {1, . . . , d} durch die Permutationen

erzeugt wird, die zwei aufeinanderfolgende Elemente vertauschen, genügt es, für j =

1, . . . , n − 1 zu zeigen, daß

P c (x1 , . . . , xn ) = P c (x1 , . . . , xj−1 , xj+1 , xj , xj+2 , . . . , xn )

(4.5)

Nach (4.1) ist (4.5) bewiesen, wenn wir zeigen können, daß

j+1

cj+1

α (x1 , . . . , xj−1 , xj , xj+1 ) = cα (x1 , . . . , xj−1 , xj+1 , xj ) ,

α ∈ Γn−j−1 .

(4.6)

Zu diesem Zweck wenden wir (4.1) zweimal an und erhalten

cj+1

α (x1 , . . . , xj−1 , xj , xj+1 )

d

X

uk (xj+1 |∆) cjα+ek (x1 , . . . , xj−1 , xj )

=

=

k=0

d

X

uk (xj+1 |∆)

k=0

=

=

=

d

X

l=0

d

X

d

X

ul (xj |∆) cj−1

α+ek +el (x1 , . . . , xj−1 )

l=0

ul (xj |∆)

d

X

uk (xj+1 |∆) cj−1

α+ek +el (x1 , . . . , xj−1 )

k=0

ul (xj |∆) cjα+el (x1 , . . . , xj−1 , xj+1 )

l=0

cj+1

α

(x1 , . . . , xj−1 , xj+1 , xj ) ,

und damit (4.6) und (4.5).

Die beiden anderen Eigenschaften folgen unmittelbar: (4.3) ist eine Konsequenz aus der

Tatsache, daß baryzentrische Koordinaten affine Polynome sind (Bemerkung 3.3) und

(4.4) ist wahr, da für x1 = · · · = xn = x Algorithmus 4.1 zum Algorithmus von de

Casteljau mutiert – und der berechnet ja bekanntlich Bn c(x).

Bemerkung 4.3 Multiaffine Formen sind nicht unbedingt ein neues oder gar abwegiges Konzept: wir kennen ja auch eine (eigentlich “die”) alternierende Multilinearform,

nämlich die Determinante einer Matrix.

30

4 BLOSSOMING

Satz 4.4 (Blossoming Principle)

Zu jedem vektorwertigen

Polynom p ∈ ΠN

n gibt es genau eine symmetrische n–affine Form

n

d

N

(Blossom) P : R

→ R und umgekehrt, so daß

x ∈ Rd .

p(x) = P (x, . . . , x) ,

(4.7)

Beweis: Mit Proposition 4.2 ist der Beweis denkbar einfach. Sei also p ∈ ΠN

n , dann

schreiben wir p in seiner Bézierdarstellung als

X

p = Bn c(p) =

cα (p) Bα ,

cα (p) ∈ RN , α ∈ Γn ,

α∈Γn

und Proposition 4.2 zeigt, daß das so definierte P c(p) eine symmetrische n–affine Form

ist.

Umgekehrt sei V Kantenmenge eines nichtentarteten Simplex ∆ ⊂ Rd und P eine

beliebige n–affine Form. Dann ist

X

P (x, . . . , x) =

P (v0 , . . . , v0 , . . . , vd , . . . , vd ) Bα ,

(4.8)

| {z }

| {z }

α∈Γn

α0

αd

was wir durch Induktion über n beweisen werden. Klar ist aber, daß (4.8) zeigt, daß

P (x, . . . , x) ein Polynom vom Grad n ist. Machen wir uns also an (4.8). Im Falle n = 0

ist P () konstant, genauso wie die Polynome vom Grad 0. Sei also (4.8) für ein n ≥ 0

bewiesen und sei P eine (n + 1)–affine Form. Dann ist

P (x, . . . , x) =

| {z }

d

X

n+1

j=0

uj (x|∆) P (vj , x, . . . , x)

| {z }

(4.9)

n

und die Funktionen P j := (vj , ·) sind n–affine Formen, j = 0, . . . , d. Nach der Induktionsannahme gilt also

X

P j (x, . . . , x) =

P j (v0 , . . . , v0 , . . . , vd , . . . , vd ) Bα ,

j = 0, . . . , d,

| {z }

| {z }

α∈Γn

α0

αd

und setzt man das in (4.9) ein, so erhält man mit Hilfe der Rekursionsformel aus Lemma 3.9

P (x, . . . , x) =

| {z }

n+1

=

d

X

uj (x|∆)

j=0

d

X

α∈Γn

uj (x|∆)

j=0

=

d

X

j=0

X

X

α∈Γn

uj (x|∆)

X

α∈Γn

P j (v0 , . . . , v0 , . . . , vd , . . . , vd ) Bα

| {z }

| {z }

α0

αd

P (vj , v0 , . . . , v0 , . . . , vd , . . . , vd ) Bα

| {z }

| {z }

α0

αd

P (v0 , . . . , v0 , . . . , vj , . . . , vj , . . . , vd , . . . , vd ) Bα

| {z }

| {z }

| {z }

α0

αj +1

αd

4.2 Blossoming und Subdivision

=

d

X

uj (x|∆)

j=0

=

X

α∈Γn+1

=

X

α∈Γn+1

31

X

α∈Γn+1

P (v0 , . . . , v0 , . . . , vd , . . . , vd ) Bα−ej

| {z }

| {z }

α0

αd

P (v0 , . . . , v0 , . . . , vd , . . . , vd )

| {z }

| {z }

α0

αd

d

X

uj (x|∆) Bα−ej

j=0

P (v0 , . . . , v0 , . . . , vd , . . . , vd )Bα ,

| {z }

| {z }

α0

αd

und damit ist (4.8) bewiesen.

Bleibt noch die Eindeutigkeit, doch auch hier hilft uns (4.8). Zuerst ist einmal klar,

daß (4.7) jeder n–affinen Form genau ein Polynom zuweist. Seien umgekehrt P , Q zwei

n–affine Formen, so daß

p(x) = P (x, . . . , x) = Q (x, . . . , x) ,

x ∈ Rd .

Nach (4.8) und wegen der Eindeutigkeit der Bézier–Darstellung ist dann aber

P (v0 , . . . , v0 , . . . , vd , . . . , vd ) = Q(v0 , . . . , v0 , . . . , vd , . . . , vd ),

| {z }

| {z }

| {z }

| {z }

α0

αd

α0

α ∈ Γn ,

αd

und damit P = Q.

Definition 4.5 Es seien v0 , . . . , vd ∈ Rd . Wir fassen diese Punkte zu einem Vektor v =

(vj : j = 0, . . . , d) zusammen und verwenden die (multiplikative) Kurzschreibweise

v α = v0α0 · · · vdαd = v0 , . . . , v0 , . . . , vd , . . . , vd .

| {z }

| {z }

α0

αd

Die Identität (4.8), die wir im Beweis von Satz 4.4 verwendet haben, liefert uns auch

eine schöne Formel für die Bézierdarstellung von Polynomen.

Korollar 4.6 Sei V = {v0 , . . . , vd } Eckenmenge eines nichtentarteten Simplex in Rd ,

d n

p ∈ ΠN

→ RN die zugehörige multiaffine Form. Dann gilt

n und P : R

X

p(x) =

P (v α ) Bα (x),

x ∈ Rd .

(4.10)

α∈Γn

4.2

Blossoming und Subdivision

Als nächstes sehen wir, daß der Algorithmus von de Casteljau als ein weiteres “Abfallprodukt” die Einschränkungen von Bézierflächen auf Subsimplizes berechnet.

Proposition 4.7 Zu c ∈ RN (Γn ) sei P die Polarform von p = Bn c. Dann haben, für

x ∈ ∆, die Zwischenpunkte des Algorithmus von de Casteljau die Form

(4.11)

ckβ (x) = P xk , v β ,

β ∈ Γn−k .

32

4 BLOSSOMING

Beweis: Induktion über k. Für k = 0 haben wir, wegen (4.10),

c0β (x) = cβ = P v β ,

β ∈ Γn ,

also (4.11). Für k > 0 verwenden wir (3.8) und die Induktionshypothese und erhalten

(β ∈ Γn−k )

ckβ (x)

=

d

X

uj (x|∆)

k−1

cβ+e

(x)

j

j=0

= P

=

d

X

uj (x|∆) P vj , xk−1 , v β

j=0

d

X

uj (x|∆) vj , x

k−1

,v

β

!

j=0

= P x, xk−1 , v β = P xk , v β .

Definition 4.8 (Subsimplizes und Einschränkung)

1. Sei Ω ⊂ Rd . Eine (endliche oder unendliche) Familie {∆i ⊂ Ω : i ∈ I} von Simplizes

heißt simpliziale Zerlegung von Ω wenn

[

∆i

und

dim (∆j ∩ ∆k ) < d, j 6= k ∈ I.

Ω=

i∈I

2. Für x ∈ ∆ und j = 0, . . . , d sei Vj (x) = x ∪ (V \ {vj }) und ∆j (x) = [Vj (x)] die

zugehörige Komponente der simplizialen Zerlegung.

3. Für x ∈ ∆ ist die Einschränkung einer Bézierfläche Bn c auf eines der Subsimplizes

∆j , j = 0, . . . , d, geschrieben als Bn c|∆j , das Resultat von Algorithmus 3.6 mit

∆ = ∆j auf passende Kontrollpunkte cj ∈ R (Γn ).

Korollar 4.9 Zu x ∈ ∆ und j = 0, . . . , d setze

α

j

cj,α = cα−α

(x),

j ej

α ∈ Γn .

Dann gilt

Bn c|∆j (x) = Bn cj .

(4.12)

Beweis: Sei P die Polarform zu Bn c. Nach (4.10) haben die Kontrollpunkte von Bn c|∆j

die Form

αj−1

αj+1

αj

cj,α = P v0α0 , . . . , vj−1

, xαj , vj+1

(x).

, . . . , vdαd = P xαj , v α−αj ej = cα−α

j ej

Bemerkung 4.10 Durch einmalige Ausführung des Algorithmus von de Casteljau können

alle Kontrollpunkte der Einschränkungen auf ∆j (x) simultan bestimmt werden.

4.3 Blossoming und Ableitungen

33

Abbildung 4.1: Die Kontrollpunkte der beiden Teilkurven über den Algorithmus von

de Casteljau.

4.3

Blossoming und Ableitungen

In diesem Abschnitt werden wir eine wichtige Formel für die Ableitungen eines Polynoms

herleiten, die auf der Polarform basiert.

d

Satz 4.11 Sei y ∈ Rd und p ∈ ΠN

n . Dann ist, für k ≥ 0 und x ∈ R ,

Dyk p(x)

k

X

n!

k−j k

(−1)

P xn−j , (x + y)j .

=

(n − k)! j=0

j

(4.13)

Für baryzentrische Richtungen y ∈ Rd+1 gilt entsprechend

Dyk p(x)

k

X

j n!

k−j k

=

(−1)

P xn−j , x + y T V

.

(n − k)! j=0

j

(4.14)

Korollar 4.12 Sei d = 1 und p ∈ ΠN

n . Dann ist, für k ≥ 0 und x ∈ R,

k

X

n!

k−j k

(−1)

P xn−j , (x + 1)j .

p (x) =

(n − k)! j=0

j

(k)

(4.15)

Beweis von Satz 4.11: Wegen (3.20) sind die beiden Darstellungen (4.13) und (4.14)

äquivalent, weswegen es genügt, (4.13) zu beweisen.

34

4 BLOSSOMING

Abbildung 4.2: Der Algorithmus von de Casteljau zur Bestimmung der Einschränkung auf ein Subsimplex entsprechend (4.12).

Der Trick besteht darin, die Bézierdarstellung bezüglich eines geeigneten Simplex [W] zu

wählen, wobei wir

w0 = x,

w1 = x + y

setzen und w2 , . . . , wd so wählen, daß [W] nichtdegeneriert ist. Sei c ∈ RN (Γn ) das Kontrollpolygon zur Bézierdarstellung von p. Dann ist, unter Verwendung von Satz 3.17, der

Endpunkt–Interpolation und Korollar 4.6

Dyk p(x) = Dwk 1 −w0 p(x) = Dek1 −e0 Bn c (w0 ) =

n!

(E1 − E0 )k c(n−k)e0

(n − k)!

k

X

n!

k−j k

=

(−1)

c(n−k)e0 +(k−j)e0 +je1

(n − k)! j=0

j

k

X

n!

k−j k

(−1)

c(n−j)e0 +je1

=

(n − k)! j=0

j

k

X

n!

k−j k

(−1)

P xn−j , (x + y)j .

=

(n − k)! j=0

j

Bemerkung 4.13 Den Fall k = 1 kann man auch direkt über die Multiaffinität zeigen.

Dazu schreiben wir, für h ≥ 0, den Punkt x + hy “baryzentrisch” als

x + hy = (1 − h) x + h (x + y) .

4.4 Blossoming und glattes Aneinanderkleben

35

Also ist

p (x + hy) = P ((x + hy)n ) = P (1 − h) x + h (x + y), (x + hy)n−1

= (1 − h) P x, (x + hy)n−1 + h P x + y, (x + hy)n−1

..

.

k

X

k j

k−j

j

n−k

=

h (1 − h)k−j ,

P x , (x + y) , (x + hy)

j

j=0

k = 1, . . . , n,

..

.

n

X

=

P x

n−j

j=0

n j

, (x + y)

h (1 − h)n−j

j

j

und

p (x + hy) − p(x) =

n

X

P x

n−j

j

, (x + y)

j=0

n

− P (x )

n j

h (1 − h)n−j .

j

Der Summand mit j = 0 hat aber den Wert Null und damit ist

p(x + hy) − p(x)

h→0

h

n

X

n j−1

n−j

j

n

= lim

P x , (x + y) − P (x )

h (1 − h)n−j

h→0

j

j=1

= lim (1 − h)n−1 n P xn−1 , (x + y) − P (xn ) + O (h)

h→0

= n P xn−1 , (x + y) − P (xn ) .

Dy p(x) = lim

4.4

Blossoming und glattes Aneinanderkleben

Die wesentliche Anwendung des “Blossoming Principle” für die Splines besteht darin, daß

polare Formen es ermöglichen, Aussagen zu machen, wann zwei polynomiale Flächen glatt

aneinanderstoßen.

Definition 4.14 Zu f : Rd → RN ist die (baryzentrische) n–te Ableitung im Punkt

x ∈ ∆ definiert als die symmetrische Multilinearform

n

D f (x) [y1 , . . . , yn ] = Dy1 · · · Dyn f ,

yj ∈ R

d+1

,

d

X

yj,k = 0.

(4.16)

k=0

Lemma 4.15 (Ableitungen)

1. Die Diagonale der Multilinearform Dn [f ] hat die Form

X ∂ nf

(x) Bα (y).

Dn f (x) [y n ] =

∂uα

α∈Γ

n

(4.17)

36

4 BLOSSOMING

2. Gilt für f , g ∈ C n Rd und x ∈ Rd

Dn f (x) [y n ] = Dn g(x) [y n ] ,

y ∈ Rd+1 ,

d

X

yj = 0,

j=0

dann auch

∂ |α| f

∂ |α| g

(x)

=

(x),

∂uα

∂uα

|α| ≤ n.

Beweis: (4.17) folgt mit der üblichen Induktion aus (4.16), da

D

k+1

d

d

X

X ∂ k+1 f

X ∂ k+1 f X

k+1 f (·) y

=

yj

Bα (y) =

yj Bα−ej (y)

∂uα+ej

∂uα j=0

j=0

α∈Γ

α∈Γ

k

k+1

X ∂ k+1 f

Bα (y),

=

∂uα

α∈Γ

k+1

und 2) ergibt sich sofort aus 1) und der linearen Unabhängigkeit der Basispolynome. Definition 4.16

1. Zu Punkten w0 , . . . , wm ∈ Rd , m < d, in allgemeiner Lage schreiben wir

∆W = [wj : j = 0, . . . , m] ⊂ Rd

für das zugehörige m–Simplex und setzen w = (w0 , . . . , wm ).

2. Zwei Funktionen f , g ∈ C n (∆) haben einen glatten Übergang der Ordnung n in

∆W , falls

Dk f (x) = Dk g(x),

k = 0, . . . , n, x ∈ ∆W .

(4.18)

Bemerkung 4.17 Die Identität in (4.18) ist als (globale) Identität von Multilinearformen zu verstehen.

Satz 4.18 (Blossoming und glatte Übergänge)

Seien p, q ∈ ΠN

n und P , Q die zugehörigen polaren Formen. Außerdem sei W die Eckenmenge des m–Simplex ∆W . Dann sind äquivalent:

1. p und q haben einen glatten Übergang der Ordnung k in ∆W .

2. für alle t1 , . . . , tk ∈ Rd gilt

P (t1 , . . . , tk , wα ) = Q (t1 , . . . , tk , wα ) ,

α ∈ Nm+1

, |α| = n − k.

0

(4.19)

4.4 Blossoming und glattes Aneinanderkleben

37

Für unsere Splines werden wir die folgende einfache Form von Satz 4.18 brauchen.

Korollar 4.19 Sei d = 1, p, q, P , Q wie in Satz 4.18 und w ∈ R. Dann haben p und q

genau dann einen glatten Übergang der Ordnung k in w wenn

t1 , . . . , tk ∈ R.

(4.20)

P t1 , . . . , tk , wn−k = Q t1 , . . . , tk , wn−k ,

Beweis von Satz 4.18: Nach Lemma 4.15 ist (4.18) äquivalent zu

D f (x) y j = Dj g(x) y j ,

j

j = 0, . . . , k, y ∈ R

d+1

,

d

X

yj = 0.

(4.21)

j=0

2 ⇒ 1: wegen (4.14) ist

j

s n! X

j−s j

(−1)

P xn−s , x + y T V

(n − j)! s=0

s

j

s n! X

j−s j

=

(−1)

P xn−j , xj−s , x + y T V

(n − j)! s=0

s

X

j

s n! X

j−s j

(−1)

Bα (x|∆W ) P wα , xj−s , x + y T V

=

(n − j)! s=0

s α∈Γ

j

D p(x) y j = Dyj p(x) =

n−j

X

j

s n! X

j−s j

=

(−1)

Bα (x|∆W ) Q wα , xj−s , x + y T V

(n − j)! s=0

s α∈Γ

n−j

j

j

j

= Dy q(x) = D q(x) y .

1 ⇒ 2: wir schreiben p und q in ihrer Bézierdarstellung als p = Bn cp und q = Bn cq .

Nach Korollar 3.20, insbesondere Gleichung (3.25), wird aus (4.21) die Beziehung

X n−j

X n−j

n!

n!

cp,β (x)Bβ (y) = Dyj Bn cp (x) = Dyj Bn cq (x) =

c (x)Bβ (y),

(n − j)! β∈Γ

(n − j)! β∈Γ q,β

j

j

(4.22)

die für alle j = 0, . . . , k, y ∈ Rd+1 , y0 + · · · + yd = 0 und x ∈ ∆W gelten muß. Wegen der

linearen Unabhängigkeit der Basispolynome ergibt sich also

n−j

cn−j

p,β (x) = cq,β (x),

β ∈ Γj , j = 0, . . . , k.

Nach Proposition 4.7 heißt dies, daß

X

n−j

cn−j

, vβ =

Bα (x|∆W ) P wα , v β

p,β (x) = P x

α∈Γn−j

q

cn−j

q,β (x)

X

= Q xn−j , v β =

Bα (x|∆W ) Q wα , v β

α∈Γn−j

(4.23)

38

4 BLOSSOMING

also

P wα , v β = Q wα , vβ ,

α ∈ Γn−j , β ∈ Γj , j = 0, . . . , k.

(4.24)

Mit Hilfe der Indentität

P (t1 , . . . , tk , wα ) =

=

d

X

uj1 (t1 |∆) · · · ujk (tk |∆) P (vj1 , . . . , vjk , wα )

j1 =0

d

X

jk =0

d

X

d

X

uj1 (t1 |∆) · · · ujk (tk |∆) P v ej1 +···+ejk , wα

j1 =0

···

···

jk =0

folgt dann (4.19) unmittelbar aus dem Fall j = k in (4.24).

39

Jetzt geht’s lohos . . .

Anonymer Fußballfan

5

Univariate Splines und Interpolation an den Knoten

Das “Zielobjekt” dieses Abschnitts sind Splinekurven, definiert über einem Intervall [a, b] ⊂

R. Zuerst formalisieren wir Definition 2.11.

Definition 5.1 Sei I = [a, b] ⊂ R und T = (t0 , . . . , tn ).

1. T heißt Knotenfolge (für I), falls t0 ≤ t1 ≤ · · · ≤ tn und t0 = a, tn = b.

2. T heißt einfache Knotenfolge, falls t0 < · · · < tn .

3. ∆j := [tj , tj+1 ), j = 0, . . . , n − 1.

4. Den Vektorraum der Splinefunktionen der Ordnung m und der Glattheit k bezüglich

der Knotenmenge T wird mit Sm,k (T ) bezeichnet.

Bemerkung 5.2 Im Zusammenhang mit einer einfachen Knotenfolge T empfiehlt es

sich, den Splineraum Sm,m−1 (T ) zu betrachten. Geringere Differenzierbarkeit wird auf

mehrfache Knoten zurückgeführt werden.

5.1

Interpolation an einfachen Knoten

Wir beschäftigen uns jetzt nochmals mit dem Interpolationsproblem aus Kapitel 2 und

zeigen, daß es dafür immer Lösungen im Splineraum Sm,m−1 (T ) gibt.

Satz 5.3 Sei T ⊂ [a, b] eine einfache Knotenfolge und m, n ≥ 1. Dann gibt es, für alle

n

Y = (y 0 , . . . , y n ) ∈ RN , einen (m − 1)–dimensionalen affinen Raum SIm,m−1 (T ; Y) ⊂

(Sm,m−1 (T ))N von interpolierenden Splines, d.h.,

s (tj |T ) = y j ,

j = 0, . . . , n,

s ∈ SIm,m−1 (T ; Y) .

(5.1)

Bemerkung 5.4 Der “affine” Raum in Satz 5.3 kann auch folgendermaßen interpretiert

werden: es gibt einen (m − 1)–dimensionalen Raum S0m,m−1 (T ), von skalaren Splines, die

das homogene Interpolationsproblem

s (tj |T ) = 0,

lösen und

j = 0, . . . , n,

s ∈ S0m,m−1 (T ) ,

N

SIm,m−1 (T ; Y) = s∗ (·|T ) + S0m,m−1 (T ) ,

wobei s∗ irgendeine Lösung des Interpolationsproblems (5.1) ist.

40

5 UNIVARIATE SPLINES UND INTERPOLATION AN DEN KNOTEN

Korollar 5.5 Der Splineraum Sm,m−1 (T ) hat Dimension m + n.

Beweis: Der interpolierende Spline wird durch n + 1 Interpolationsbedingungen und

m − 1 zusätzliche Freiheitsgrade eindeutig bestimmt.

Definition 5.6 Zu einem Spline s ∈ Sm,m−1 (T ) bezeichnen wir mit

pj = s|(tj ,tj+1 ) ,

j = 0, . . . , n − 1,

die Polynomstücke von s und mit P j , j = 0, . . . , n − 1, die zugehörigen polaren Formen.

Beweis von Satz 5.3: Wir zeigen zuerst, daß p0 und die Interpolationsbedingungen den

interpolierenden Spline eindeutig bestimmen; sei also p0 irgendein Polynom vom Grad m,

so daß p0 (t0 ) = y 0 und p0 (t1 ) = y 1 .

Wir zeigen, induktiv über j = 0, . . . , n − 1, daß dann pj eindeutig festgelegt ist. Der Fall

j = 0 ist trivial. Ansonsten verwenden wir Korollar 4.19, da wegen der Glattheit der

Ordnung m − 1

m−k k

k

P j+1 tm−k

k = 0, . . . , m − 1,

(5.2)

j+1 , tj+2 = P j tj+1 , tj+2 ,

und, wegen der Interpolation,

P j+1 tm

j+2 = pj+1 (tj+2 ) = y j+2 .

(5.3)

Auf der anderen Seite bestimmen (5.2) und (5.3) aber alle Koeffizienten der Bézierdarstellung pj+1 = Bm c (·|∆j+1 ), also auch pj+1 .

Zur Dimension des Lösungsraums: p0 hat m+1 Bézierkoeffizienten bezüglich ∆0 von denen

zwei durch die Endpunktinterpolation festgelegt werden, die anderen m − 1 Koeffizienten

sind frei.

Korollar 5.7 Der natürliche Spline aus Satz 2.13 existiert für jede einfache Knotenfolge.

Beweis: Da m = 3 hat der Splineraum S03,2 (T ) die Dimension m − 1 = 2 und eine Basis,

sagen wir s1 und s2 . Diese beiden Splines können so gewählt werden, daß

s001 (t0 ) = s002 (tn ) = 1,

s001 (tn ) = s002 (t0 ) = 0.

Warum? Wir konstruieren beispielsweise s2 , indem wir wie im Beweis von Satz 5.3 mit

einem Polynom p0 beginnen, das zusätzlich p000 (t0 ) = 0 erfüllt. Wäre dann s002 (tn ) = 0, so

wäre s2 ein natürlicher Spline, der das homogene Interpolationsproblem löst und damit,

nach Satz 2.13, |s2 |2,2 = 0, denn die Nullfunktion ist ebenfalls eine Lösung des homogenen

Problems. Dann wäre s2 aber eine lineare Funktion und damit s2 = 0. Also ist s002 (tn ) 6= 0

und wir können es zu 1 normieren. Entsprechend konstruiert man s1 “von rechts nach

links”.

Ist schließlich s irgendeine Lösung des Interpolationsproblems, so ist

s∗ = s − s00 (t0 ) s1 − s00 (tn ) s2

der natürliche Splineinterpolant.

5.1 Interpolation an einfachen Knoten

41

Bemerkung 5.8 Nach Satz 5.3 lassen die Interpolationsbedingungen m−1 Freiheitsgrade

offen, die man “frei” verteilen kann. Ist nun m = 2r + 1 ungerade, so kann man an jedem

Endpunkt r zusätzliche Bedingungen vorgeben. Beispiele dafür sind

1. (Hermite–Interpolation): für vorgegebene zusätzliche Vektoren y j,k , j = 0, 1, k =

1, . . . , r, soll

s(k) (t0 ) = y 0,k ,

s(k) (tn ) = y 1,k ,

k = 1, . . . , r,

(5.4)

gelten.

2. (Natürliche Randbedingungen):

s(k) (t0 ) = s(k) (tn ) = 0,

k = r + 1, . . . , 2r.

(5.5)

3. (Periodizität): Es gilt y 0 = y n (geschlossene Kurve) und

s(k) (t0 ) = s(k) (tn ) ,

k = 1, . . . , 2r.

(5.6)

Aus Gründen der Einfachheit beschränken wir uns für den Rest dieses Abschnitts auf

N = 1. Das ist natürlich keine Einschränkung: man kann parametrische Kurven ja stets

komponentenweise behandeln.

Definition 5.9 (Splineinterpolanten)

1. Zu f ∈ C[a, b] und einer Knotenfolge T ist der natürliche Splineinterpolant der

Ordnung 2r + 1, geschrieben als S2r+1,2r (f ; T ), definiert durch

S2r+1,2r (f ; T ) (tj ) = f (tj ) ,

j = 0, . . . , n,

(5.7)

und

(j)

(j)

S2r+1,2r (f ; T ) (t0 ) = S2r+1,2r (f ; T ) (tn ) = 0,

j = r + 1, . . . , 2r.

(5.8)

2. Zu f ∈ C r [a, b] und einer Knotenfolge T ist der Hermite–Splineinterpolant der

H

Ordnung 2r + 1, geschrieben als S2r+1,2r

(f ; T ) definiert durch

H

S2r+1,2r

(f ; T ) (tj ) = f (tj ) ,

und

(j)

H

S2r+1,2r

(f ; T ) (t0 ) = f (j) (t0 ) ,

(j)

H

S2r+1,2r

(f ; T ) (tn ) = f (j) (tn ) ,

j = 0, . . . , n,

j = 1, . . . , r.

Dann ergibt sich die folgende Verallgemeinerung von Satz 2.13.

(5.9)

(5.10)

42

5 UNIVARIATE SPLINES UND INTERPOLATION AN DEN KNOTEN

Satz 5.10 (Minimalitätseigenschaften)

Für f ∈ C 2r [a, b] gilt

|S2r+1,2r (f ; T )|r+1,2 ≤ |f |r+1,2

(5.11)

und

H

S2r+1,2r (f ; T )

r+1,2

≤ |f |r+1,2

(5.12)

Beweis: Der Beweis ist fast analog zu dem von Satz 2.13. Wieder verwendet man, für

j = 0, . . . , n − 1, partielle Integration, um zu zeigen, daß

tj+1

Z

(r+1)

f (r+1) (x) − sf

(r+1)

(x) sf (x) dx

tj

=

=

f (r) (x) −

k

X

r−l

(−1)

(r)

sf (x)

f

(r−l)

tj+1

(r+1)

sf (x)

(x) −

−

tj

+(−1)k+1

(r)

(r+2)

f (r) (x) − sf (x) sf (x) dx

tj

(r−l)

sf (x)

l=0

tj+1

Z

tj+1

Z

(r−k)

f (r−k) (x) − sf

tj+1

(r+l+1)

sf

(x)

tj

(r+k+2)

(x) sf

(x) dx,

k = 1, . . . , r

tj

=

r

X

l=0

tj+1

(r−l)

(r+l+1)

(−1)r−l f (r−l) (x) − sf (x) sf

(x)

,

tj

H

(f ; T ) steht. Summation über j

wobei sf entweder für S2r+1,2r (f ; T ) oder für S2r+1,2r

ergibt dann, daß

Z (r+1)

(r+1)

f (r+1) (x) − sf (x) sf (x) dx

I

=

r

X

j=0

(−1)r−j

tn

(r−j)

(r+j+1)

f (r−j) (x) − sf (x) sf

(x) = 0.

t0

Korollar 5.11 Die natürlichen und Hermite–Splineinterpolanten aus Definition 5.9 sind

eindeutig für n ≥ r.

Die obige Einschränkung zeigt uns, daß ein gewisser Zusammenhang zwischen der

Ordnung der Splines und der Mindestanzahl der Knoten bestehen muß, damit die Splineinterpolanten wohldefiniert sind. Diese Mindestforderung ist äquivalent zur eindeutigen

polynomialen Interpolation. Ist aber nicht einmal das Interpolationspolynom vom Grad r

eindeutig (das ja auch ein interpolierender natürlicher Spline ist), dann kann es auch der

Spline nicht sein. Also:

5.1 Interpolation an einfachen Knoten

43

Korollar 5.12 Der natürliche Splineinterpolant ist genau dann eindeutig, wenn n ≥ r.

Beweis von Korollar 5.11: Seien s1 , . . . , s2r eine Basis von S02r+1,2r (T ). Außerdem

definieren wir eine Menge Λ von linearen Funktionalen entweder als

Λ = λ(f ) = f (j) (tk ) : j = r + 1, . . . , 2r, k = 0, n

(5.13)

im Falle natürlicher Randbedingungen oder als

Λ = λ(f ) = f (j) (tk ) : j = 1, . . . , r, k = 0, n

(5.14)

im Falle von Hermite–Randbedingungen. Als nächstes bemerken wir, daß es für jedes

0 6= s ∈ S02r+1,2r (T ) immer ein λ ∈ Λ gibt, so daß λ (s) 6= 0. Ansonsten wäre s eine Lösung

des homogenen Interpolationsproblems mit entsprechenden Randbedingungen, also, nach

Satz 5.10 ergäbe sich |s|r+1,2 = 0 und damit s|[a,b] ∈ Πr . Da aber s (tj ) = 0, j = 0, . . . , n

und n ≥ r, wäre dann aber s = 0. Damit müssen aber die Vektoren

λ1 (sj )

..

Λ (sj ) =

,

.

λ2r (sj )

j = 1, . . . , 2r,

linear unabhängig sein und damit ist die Matrix MΛ = [λj (sk ) : j, k = 1, . . . , 2r] nichtsingulär. Sei nun s∗ ∈ SI2r+1,2r (T ; Y) also irgendeine Lösung des Interpolationsproblems und

setzt man

−1

(2r)

(r+1)

(2r)

(t0 ) · · · s1 (t0 ) s1

(tn ) · · · s1 (tn )

..

..

..

..

..

..

AN =

.

.

.

.

.

.

(r+1)

(2r)

(r+1)

(2r)

s2r (t0 ) · · · s2r (t0 ) s2r (tn ) · · · s2r (tn )

(r+1)

s1

sowie

−1

(r)

(r)

s01 (t0 ) · · · s1 (t0 ) s01 (tn ) · · · s1 (tn )

..

..

..

..

...

..

AH =

,

.

.

.

.

.

(r)

(r)

s02r (t0 ) · · · s2r (t0 ) s02r (tn ) · · · s2r (tn )

dann ist

(s∗ )(r+1) (t0 )

..

.

(2r)

∗

(s ) (t0 )

(s∗ )(r+1) (t )

n

.

.

.

sf = s∗ − [s1 , . . . , s2r ] AN

(s∗ )(2r) (tn )

44

5 UNIVARIATE SPLINES UND INTERPOLATION AN DEN KNOTEN

der Splineinterpolant mit natürlichen Randbedingungen und

(s∗ )0 (t0 ) − y0,1