Stochastik für Informatiker und Bioinformatiker

Werbung

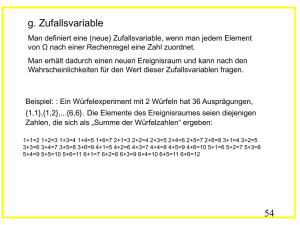

Stochastik für Informatiker und Bioinformatiker Prof. E. Teufl1 Sommersemester 2010 Stand: 1. Juni 2010 16:59 Ý 1 ² Mitschrift: Volodymyr Piven, Alexander Peltzer, Korrektur: Demen Güler, Sebastian Nagel Inhaltsverzeichnis Vorwort 2 0 Einleitung 3 1 Vorlesung 4 1 Wahrscheinlichkeitsräume . . . . . . . . . . . . . . . . . . . . . . . 5 2 Unabhängigkeit . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 8 3 Diskrete W!räume . . . . . . . . . . . . . . . . . . . . . . . . . . . . 8 4 Eine σ - Algebra auf R . . . . . . . . . . . . . . . . . . . . . . . . . 9 5 Zufallsvariable . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 9 6 Ungleichungen . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 18 Gesetz der großen Zahlen . . . . . . . . . . . . . . . . . . . . . . . . 18 Zentraler Grenzwertsatz . . . . . . . . . . . . . . . . . . . . . . . . . 19 7 1 Vorwort Beim vorliegenden Text handelt es sich um eine inoffizielle Mitschrift. Als solche kann sie selbstverständlich Fehler enthalten und ist daher für Übungsblätter und Klausuren nicht zitierfähig. Korrekturen und Verbesserungsvorschläge sind jederzeit willkommen und können an [email protected] oder [email protected] gerichtet werden. Der Text wurde mit LATEX2e in Verbindung mit dem AMS-TEX-Paket für die mathematischen Formeln gesetzt. c 2010 Volodymyr Piven und Alexander Peltzer. Es wird die Erlaubnis gegeben, dieses Dokument unter den Copyright Bedingungen der von der Free Software Foundation veröffentlichen GNU Free Documentation License (Version 1.2 oder neuer) zu kopieren, verteilen und/oder zu verändern. Eine Kopie dieser Lizenz ist unter http://www.gnu.org/copyleft/fdl.txt erhältlich. 2 Kapitel 0 Einleitung Dozent: • Professor Dr. Elmar Teufl Phone: +49 7071 29 78582 Email: [email protected] Vorlesungszeiten: • Dienstag 16-18 Uhr Hörsaalzentrum N9 Übungsleitung; • Hadrian Heil • http://www.mathematik.uni-tuebingen.de/ teufl/StochBioInf/ • Übungsmodus: Mittleres Ergebnis in Prozent ≥ 50% • Schlechtestes Ergebnis wird vor der Mitteilung gestrichen, 1. Übungsblatt ist Bonus. • 2maliges Vorrechnen in der Übungsgruppe ist Pflicht. • Klausur: letzte Vorlesungswoche + Nachklausur: Vor Beginn des Wintersemesters. Literatur: • U. Krengel: Einführung in die Wahrscheinlichkeitstheorie und Statistik • H.-O. Georgii: Stochastik 3 Kapitel 1 Vorlesung 3 Teile • Wahrscheinlichkeitstheorie (W! theorie) im endlichen und abzählbaren Fall • W!theorie im kontinuierlichen Fall (R) • Statistik Stochastik ? : gr. στoχασικoς = scharfsinnig im Vermuten Gesetzmäßigkeiten im Zufall Wahrscheinlichkeit Zufall: • Glückspiel: Würfelspiel, Lotto . . . • Natur: Meßergebnisse, Lebensdauer, . . . • Wirtschaft: Aktienkurse, . . . • Informatik: randomisierte Algorithmen, . . . 4 Beispiel (Würfel) • W! definiert via relative Häufigkeiten: Würfel wird 6 Millionen mal geworfen Etwa 1 Million Ergebnisse sind davon “1” • Modell des “realen” Würfels: Der Würfel ist fair/ideal. Jede Augenzahl (AZ) ist gleich wahrscheinlich. Eventuell ist das Modell nicht geeignet, die Annahmen im Modell falsch. Wahrscheinlichkeiten sind “a priori” bekannt. Dieser Zugang geht auf A.N. Kolmogorov zurück. §1 Wahrscheinlichkeitsräume Beispiel (Laplace’scher Wahrscheinlichkeitsraum) • Ω = {ω1 , ω2 , . . . , ωn } (n ∈ N = {1, 2, 3, . . .}) Grundraum, Elemente in Ω sind Elementarereignisse. • Wahrscheinlichkeit der Elementarereignisse sind gleich groß Anzahl der günstigen Fälle |A| = Anzahl P : P(Ω) → [0, 1] (probability) mit P(A) = |Ω| der möglichen Fälle P(Ω) = {∅, {ω1 }, {ω2 }, . . . , {ω1 , ω2 }, . . . , Ω} = {A ⊆ Ω} 1 Inbesondere A = {ω} ⊆ Ω : P({ω}) = |Ω| = P(ω), P(∅) = 0, P(Ω) = 1 (Ω, P) heißt Laplace’scher Wahrscheinlichkeitsraum. P heißt Gleichverteilung auf Ω – Bsp: Würfel: Ω = {1, 2, . . . , 6}, P(ω) = 1 6 – Bsp: Münzwurf: Ω = {Kopf, Zahl}, P(Kop f ) = P(Zahl) = 1 2 (Im Idealfall) ad Würfel: Einige Ereignisse: A = gerade Augenzahl = {2, 4, 6} B = Augenzahl ≥ 4 = {4, 5, 6} “gerade AZ” und “AZ ≥ 4” = {4, 6} = A ∩ B “gerade AZ” oder “AZ ≥ 4” = {2, 4, 5, 6} = A ∪ B • Notation: [ AZ gerade ] = {2, 4, 6} P(AZ gerade) = P[AZ gerade] • |A| |B| = |Ω| + |Ω| − |A∩B| |Ω| = P(A ∪ B) = P(A) + P(B) − P(A ∩ B) Insbesondere P(A ∩ B) = 0 ⇒ P(A ∪ B) = P(A) + P(B) |A∪B| |Ω| Beispiel Zweimaliger Wurf eines (fairen) Würfels. Ω = {(1, 1), (1, 2), . . . , (1, 6), (2, 1), . . . , (6, 6)} = {1, 2, . . . , 6}x{1, 2, . . . , 6} = {1, 2, . . . , 6}2 (Grundraum) |Ω| = 62 = 36 Alle Elementaren Ereignisse sollen gleich wahrscheinlich sein, das heißt |A| P : P(Ω) → [0, 1]istdurchP(A) = |Ω| gegeben. (Laplace’scher Wahrscheinlichkeitsraum) [ bei beiden Würfen keine 6 ] = {(1, 1), . . . , (1, 5), (2, 1), . . . , (2, 5), . . . , (5, 5)} = {1, 2, . . . 5}2 P[ bei beiden Würfen keine 6 ] = 52 = 25 P[bei beiden Würfen keine 6] = 25 36 [ Eine AZ 6 und eine weitere gerade Augenzahl ] = {(2, 6), (4, 6), (6, 6), (6, 4), (6, 2)} 5 P[ bei beiden Würfen keine 6 ] ist hiermit: 36 5 Beispiel Sei A = [mind eine AZ 6], B = [zwei gerade AZ] |A| = 11, |B| = 9 (aufzählen!) 9 ⇒ P(A) = 11 36 , P(B) = 36 , P(A ∩ B) = P[Eine AZ 6 und eine weitere gerade AZ] = 5 36 Beispiel P[Eine AZ 6 oder zwei gerade AZ] = P(A ∪ B) = P(A) + P(B) − P(A ∩ B) = 11 9 5 15 5 36 + 36 − 36 = 36 = 12 Also: Rechnen mit Mengen wichtig ! (A ∪ B, A ∩ B, A = Ω\A Komplement) Interpretation von ∩, ∪ in Worten! Axiome: Definition : ω , ∅ Grundraum mit Elementarereignissen F ⊆ P(Ω) Familie von Teilmengen von Ω mit: (A) ω ∈ F (B) A ∈ F ⇒ A = Ω\A ∈ F S An ∈ F (C) Für n ∈ N sei An ∈ F , dann ist n∈N T (Ebenso ist wegen (AZ) auch An ∈ F ) n∈N S 1.1 Bemerkung An = {x : ∃n ∈ N x ∈ An } n∈N T An = {x : ∀n ∈ N x ∈ An } n∈N F heißt σ- Algebra. s Elemente in F heißen Ereignisse. Sei P : F → [0, 1] eine Funktion mit: (P) P(Ω) = 1 (P) Für n ∈ N sei An ∈ F mit A1 ∩ A j = ∅ für i , j, dann gilt [ X P An = P(An ) n∈N n∈N (Konvergenz) P heißt Wahrscheinlichkeitsmaß (Ω, F , P) heißt Wahrscheinlichkeitsraum Beispiel: (Ω, P) Laplace’scher Wahrscheinlichkeitsraum, dann ist (Ω, P(Ω), P) ein Wahrscheinlichkeitsraum Bemerkung: (Ω, F , P) ein Wahrscheinlichkeitsraum ist; A, B ∈ F , dann gilt P(A ∪ B) + P(A ∩ B) = P(A) + P(B) Bedingte Wahrscheinlichkeiten: (Ω, P) Laplace-Raum mit |Ω| = n Elementen A, B ≤ Ω mit |A| = k, |B| = l P(A) = nk , P(B) = nl 6 Außerdem |A ∩ B| = m, das heißt P(A ∩ B) = mn Die bedingte Wahrscheinlichkeit von B gegeben A ist: P(B | A) = m n k n P(A ∩ B) = P(A) = m |A ∩ B| = k |A| (k , 0, P(A) , 0) Interpretation: P(B | A) ist die Wahrscheinlichkei, dass B eintritt unter der Voraussetzung , dass A schon eingetreten ist. 1.2 Definition (Ω, F , P) Wahrscheinlichkeitsraum, und A, B ∈ F mit P(A) > 0, dann setzen wir P(B | A) = P(B∩A) P(A) 1.3 Bemerkung Sei P(A) > 0 und P(B) > 0 dann gilt: P(A ∩ B) = P(B | A) P(A) = P(A | B) P(B) Beispiel (Würfeln) Ω = {1, .., 6}, F = P(Ω), P(A) = A = [AZ ≥ 2], B = [AZ ungerade] P(A) = 65 , P(B) = 36 = 12 , P(A ∩ B) = 26 = 13 P(A|B) = P(A∩B P(B) = 1 3 1 2 = 32 , P(B|A) = P(A∩B) P(A) = 1 3 5 6 = |A| |Ω| 2 5 1 2 1 1√ = P(A ∩ B) = P(A|B) P(B) = · = 3 3 2 3 2 5 1√ = P(A|B) P(A) = · = 3 6 3 Sei A ∈ F (A = Ω\A) und B ∈ F dann gilt: A und A sind disjunkt A ∩ A = ∅ B ∩ A undB ∩ A sind disjunkt. (B ∩ A) ∪ B ∩ A = B ∩ A ∪ A = B ∩ Ω = B P(B) = P (B ∩ A) ∪ B ∩ A = P (B ∩ A) + P B ∩ A = P(B|A)P(A) + P(B|A)P(A) Satz von der totalen W! 1.4 Satz S An ∈ F (endl. oder abzählbar viele) mit An = Ω und Ai ∩ A j = ∅ für i , j (paarweise n disjunkt), dann gilt: B ∈ F ⇒ P(B) = X P(B|An )P(An ) n „Satz von der totalen W!“ Folgerung: Voraussetzungen wie vorhin. Zusätzlich soll gelten: P(A) > 0 für alle n P(B|A )P(A ) und P(B) > 0. Dann gilt P(A j |B) = P P(B|Ajn )(P(Aj n ) „Formel von Bayes“ n 7 §2 Unabhängigkeit 2.1 Definition A, B ∈ F heißen (stochastisch) unabhängig, wenn P(A ∩ B) = P(A) · P(B) 2.2 Bemerkung Sei A, B ∈ F und P(B) > 0 und A, B unabh. P(B) P(A)· ⇒ P(A|B) = P(A∩B) = P(A) P(B) = P(B) Umgekehrt: Seien A, B ∈ F mit P(B) > 0 und P(A|B) = P(A), dann sind A, B unabh. Beispiel 2 × Würfel: Ω = {1, .., 6}2 , F = P(Ω) |A| 2 |Ω| = 6 = 36 P(A) = |Ω| . A = [AZ = 1 beim 1. Wurf ] = {(1, 1), (1, 2), (1, 3), (1, 4), (1, 5), (1, 6)} B = [AZ gerade beim 2. Wurf ] = {(1, 2), (2, 2), . . . , (6, 2), (1, 4), . . . , (6, 4), (1, 6), . . . , (6, 6)} |A| = 6, |B| = 3 · 6 = 18 1 6 = 16 , P(B) = 18 P(A) = 36 36 = 2 A ∩ B = {(1, 2), (1, 4), (1, 6)}, |A ∩ B| = 3 3 1 P(A ∩ B) = 36 = 12 P(A|B) = P(A∩B) P(B) = 3 36 18 36 = 3 18 = 1 6 P(A) = 16 , also sind A und B unabh. §3 Diskrete W!räume 3.1 Definition Ω endl. oder abz. F = P(Ω) Potenzmenge von Ω P ein W!maß auf Ω, F Dann (Ω, F , P) diskreter W!raum 3.2 Bemerkung Sei Ω = {w1 , w2 , w3 , . . .}, dann genügt es P({wk }) = P(wk ) für alle k P anzugeben, um das W!maß P zu beschreiben, da P(A) = P(w) gilt. w∈A 3.3 Bemerkung Ω = {w1 , w2 , . . .} endlich oder abzählbar, dann genügt P(w) = P({w}) festzulegen, um das W!maß P zu beschreiben, da X P(A) = P(w) w∈A Beispiel “unfaire Münze”: Ω = {Kopf, Zahl}, F = P(Ω) P(Kopf) = 13 , P(Kopf) = 23 Beispiel Ω = N, F = P(N) Für k ∈ N sei P(k) = 21k P 1 P (sinnvoll, da P(k) = =1) 2k k∈N k∈N P(A) = 8 X 1 2k k∈A 3.4 Definition Sei Ω ⊆ R endlich oder abzählbar. ∃ = P(Ω) Die Abbildung F : R → [0, 1] mit F(x) := P (Ω ∪ (−∞, x]) heißt Verteilungsfunktion von (Ω, F , P) Beispiel Ω = {0, 1}, P(0) = P(1) = 12 (F = P(Ω)) Die Sprünge im Schaubild sind genau die Stellen, an denen Elementarereignisse eintreten. Die Wahrscheinlichkeiten der Elementarereignisse sind hier genau die Höhe der Sprunghöhe. Bei 1 ist das: P ({0, 1} ∪ (−∞, 1]) = P({0, 1}) = 1; Bei 0 ist das: P ({0, 1} ∪ (−∞, 0]) = P(0) = 12 §4 Eine σ - Algebra auf R P(R) ist “groß“. Minimalansatz: Wir suchen die kleinste Σ-Algebra, die alle Intervalle enthält. 4.1 Definition Die Borel’sche Σ-Algebra B(R) ist die kleinste Σ- Algebra auf R , die alle Intervalle enthält, also Teilmengen von R der Form (a, b), [a, b), (a, b], [a, b], (−∞, b], (−∞, b), [a, +∞), (a, +∞) Es genügt hier folgende Intervalle zu betrachten: (−∞, x] für x ∈ R. 4.2 Definition P : B(R) → [0, 1] ein W!maß. Die Verteilungsfunktion F : R → [0, 1] ist F(x) = P ((−∞, x]) §5 Zufallsvariable Beispiel 2x Wurf eines Würfels: Ω = {1, . . . , 6}2 , F = P(Ω), P(A) = Augensumme (AS) = Summe der beiden Augenzahlen. |A| |Ω| [AS = 1] = ∅, [AS = 2] = {(1, 1)}, [AS = 3] = {(1, 2), (2, 1)}, [AS = 4] = {(1, 3), (2, 2), (3, 1)}, . . . Formel: AS: Ω → N (oder {2, 3, 4, . . . , 123) mit AS(i, j) = i + j [AS = k] = {(i, j) ∈ Ω : AS (i, j) = k} = AS−1 ({k}) Beispiel W1 : Ω → N oder {1, 2, . . . , 6} mit W1 (i, j) = i W2 : Ω → N mit W2 (i, j) = j ⇒ AS = W1 + W2 i+ j i j 9 5.1 Definition Sei Ω ein grundraum und F eine Σ-Algebra über Ω, Z eine Menge und Z eine Σ-Algebra über Z. Eine Abbildung X:Ω→Z heißt Zufallsvariable (ZV), wenn für alle B ∈ Z gilt: [X ∈ B] = {w ∈ Ω : X(w) ∈ B} ∈F 5.2 Bemerkung . • Wenn Z endlich oder abzählbar und Z = P(Z) ist, dann ist X:Ω→Z eine Zufallsvariable, wenn [X = x] ∈ F für alle x ∈ Z gilt. Wenn auch Ω endlich oder abzählbar ist, dann ist jede Abbildung X:Ω→Z eine Zufallsvariable. • Z = R, Z = B(R), dann ist X : Ω → R genau dann eine Zufallsvariable, wenn [X ∈ (−∞, x]] = [X ≤ x] ∈ F für alle x ∈ R gilt. 5.3 Definition (Ω, F , P) W!raum und A1 , . . . , An ∈ F A1 , . . . , An heißen unabhängig, wenn P(A1 ∪ A2 ∪ . . . ∪ An ) = P(A1 ) · P(A2 ) . . . P(An ) 5.4 Definition (Ω, F , P) W!raum, für i = 1, . . . , n sei Zi Menge und Zi Σ-Algebra auf Z, und sei für i = 1, . . . , n Xi : Ω → Zi eine Zufallsvariable. Die Zufallsvariable X1 , . . . , Xn heißen unabhängig, falls P[X1 ∈ B1 , X2 ∈ B2 , . . . , Xn ∈ Bn ] = P ([X1 ∈ B1 ] ∪ . . . ∪ [Xn ∈ Bn ]) = P[X1 ∈ B1 ] · · · P[Xn ∈ Bn ] für alle B1 ∈ Z1 , B2 ∈ Z2 , . . . , Bn ∈ Zn gilt. 5.5 Bemerkung . • Alle Zi sind endlich oder abzählbar, Zi = P(Zi ) X1 , . . . , Xn genau dann unabhängig, wenn P[X1 = x1 , X2 = x2 , . . . , Xn = xn ] = P[X1 = x1 ] · · · P[Xn = xn ] für alle x1 ∈ Z1 , . . . , xn ∈ Zn 10 • Zi = R und Zi = B(R). X1 , . . . , Xn sind genau dann unabhängig, wenn P[X1 ≤ x1 , . . . , Xn ≤ xn ] = P[X1 ≤ x1 ] · · · P[Xn ≤ xn ] für x1 , . . . , xn ∈ R gilt. Aus Alt mach Neu 1. Bedingungen: (Ω, F , P) W!raum und B ∈ F mit P(B) > 0. Setze PB (A) := P(A | B) Dann ist (Ω, F , PB ) ein W!raum. 2. Produkte : Für i = 1, 2, . . . , n sei (Ωi , Fi , Pi ) ein diskreter W!raum gegeben. (Fi = P(Ωi )) Setze: Ω := Ω1 × Ω2 × . . . × Ωn , F = P(Ω) Das W!maß P auf Ω wird druch P(w1 , w2 , . . . , wn = P1 (w1 )P2 (w2 ) · · · Pn (wn ) für (w1 , w2 , . . . , wn ) ∈ Ω1 × · · · × Ωn = Ω festgelegt. Beispiel Wie in den Übungen: (Ω1 , F1 , P1 ) W!raum zum Münzwurf. (Ω1 = {Kopf, Zahl}, F1 = P(Ω1 ), P1 (Kopf) = P1 (Zahl) = 21 ) (Ω2 , F2 , P2 ) W!raum zum Wurf eines Würfels: Ω2 = {1, 2, . . . , 6}, F2 = P(Ω2 ), P2 (i) = 1 6 Ω = Ω1 × Ω2 = {(Kopf, 1), (Kopf, 2), . . . , (Kopf, 6), (Zahl, 1), . . . , (Zahl, 6)} 1 P((Kopf, 1)) = P1 (Kopf) · P2 (1) = 21 · 16 = 12 , 1 P((x, i)) = 12 immer (x=Kopf, Zahl; i = 1, 2, . . . , 6) n-fache (unabhängige) Wiederholung: Ω1 = Ω2 = . . . = Ωn , P1 = P2 = . . . = Pn 3. Verteilung einer Zufallsvariablen: (Ω, F , P) sei ein W!raum und Z Menge, Z ΣAlgebra über Z. X : Ω → Z sei Zufallsvariable, als [Z ∈ B] ∈ F für alle B ∈ Z. Setze: P x (B) := P[X ∈ B], dann ist (Z, Z, P x ) ein W!raum und heißt Verteilung von X. |A| Beispiel Ω = {1, 2, . . . , 6}2 ; F = P(Ω), P(A) = |Ω| S : Ω → {2, 3, . . . , 12} mit S (i, j) = i + j P s ? (Z = {2, 3, . . . , 12}, Z = P(Z)) 1 P[s = 2] = P({(1, 1)}) = 36 , P[s = 3] = P({(1, 2), (2, 1)}) = 3 P[s = 4] = P({(1, 3), (2, 2), (3, 1)}) = 36 , ... 6 5 1 P[s = 7] = 36 , P[s = 8] = 36 , . . . , P[s = 12] = 36 k 2 3 4 5 6 7 8 9 1 2 3 4 5 6 5 4 P s (k) 36 36 36 36 36 36 36 36 Neuer W!raum: ({2, 3, . . . , 12}, P({1, . . . , 12}), P5 ) 2 36 , 10 11 12 3 36 2 36 1 36 5.6 Bemerkung Sei (Ω, |{z} F , P) diskreter W!raum und (Ωn , P(Ωn ), Pn ) die n-fache Wie=P(Ω) derholung und Xi : Ωn → Ω mit Xi (w1 , . . . , wn ) = wi für i = 1, 2, . . . , n, dann sind X1 , . . . , Xn unabhängig. 11 5.7 Definition ad 3.) ”Verteilung von ZV“ (Ω, F , P) W!raum und X : Ω → Z, ZV, wobei Z ⊆ R entweder endlich / abzählbar mit σ = P(Z) oder Z = R mit σ = B(R) Dann sei F x die Verteilungsfunktion von P x : P x (B) = P[X ∈ B] und F x : R → [0, 1] mit F x (x) = P[X ≤ x] F x heißt dann auch Verteilungsfunktion von X. Beispiel Erwartungswerte und Co. Adam und Eva spielen folgendes Würfelspiel: Adam wirft einen fairen Würfel. Bei AZ = 1, 2 muß Adam 1 Euro an Eva zahlen. Bei AZ = 3, 4, 5, 6 wird der Würfel erneut geworfen. Bei AZ = 1, 2 Adam an Eva 1 Euro. Bei AZ = 3, 4, 5, 6 Eva an Adam 1 Euro. Modell: Ω = {1, . . . , 6}2 (zweimaliger Wurf) X : Ω → {1, |{z} −1 } Gewinn von Adam Verlust P[X = −1] = P({{1, 2} × {1, 2, . . . , 6} ∪ disjunkt {3, 4, 5, 6} × {1, 2}) = P[X = 1] = 1 − P[X = −1] = P({3, 4, 5, 6} × {3, 4, 5, 6}) = Erwarteter Gewinn: (−1) · 16 36 = 2·6+4·2 36 = 5 9 4 9 4 1 5 + 1 · = − Euro 9 9 9 5.8 Definition (Ω, F , P) W!Raum, Z ⊆ R endlich oder abzählbar, mit Z = P(Z). Eine ZV X : Ω → Z heißt (reellwertige), diskrete Zufallsvariable. Sei X eine (reelwertige) diskrete ZV. Der Erwartungswert ist X E(X) = xP[X = x] x,x∈Z sofern die Summe absolut konvergiert. Ist f : R → R, dann sei E( f (x)) = X f (x)P[X = x] x sofern die Summe absolut konvergiert. Für f (x) = xn heißt X E(xn ) = xn P[X = x] x 12 das n-te Moment von X sofern die Summe absolut konvergiert. Wir sagen, X hat endlich n-tes Moment oder das n-te Moment von X existiert, wenn P n x P[X = x] absolut konvergiert. x (kurz E(X n ) < ∞) Falls µ = E(X) endlich, dann ist die Varianz von X: X Var(X) = E((X − µ)2 ) = (x − µ)2 P[X = x] x sofern die Summe absolut konvergiert. √ Die Standardabweichung ist σ(X) = Var(X) 5.9 Satz (Rechenregeln) X, Y (reelle) diskrete Zufallsvariablen. a, b, ∈ R 1) E(aX + b) = aE(X) + b M := aX + b; (Ω, F , P) X:Ω→Z⊆R M : Ω → {ax + bx ∈ Z} w 7→ aX(w) + b E(M) = a P x P P (ax m∈{ax+b:x∈Z}mP[M=m]= ∈Z xP[X = x] + b + b)P[X = x] = x P x P[X = x] 2) S = X + Y : Ω → {x + y x ∈ Z x , y ∈ Zy } Zx P x∈Z x ,y∈Zy Zy E(X + Y) = E(S ) | {z } P (x+y)P[X+Y=x+y]= s∈{x+y:x∈Z x ,y∈Zy } = E(X) + E(Y) sP[S =s] 3) Verschiebesatz: µ = E(X) Var(X) = E((X − µ)2 ) = E(X 2 − 2µX + µ2 ) = E(X 2 − 2µX) + µ2 = E(X 2 ) − E(−2µX) + µ2 = E(X 2 ) − 2µE(X) + µ2 = E(X 2 ) − (E(X))2 5.10 Bemerkung X = c konstante ZV, d.h. X(w) = c für alle w ∈ Ω. ⇒ E(X) = E(c) = c 13 Beispiel Für E(X) = ∞, X : Ω → N mit P 1 1 = n − n+1 = 1 . . . n∈N P P E(X) = nP[X = n] = n · P n∈N P[X = n] = 1 n(n + 1) = =∞ 1 n(n+1) n∈N n∈N 1 n(n+1) P n∈N 1 n+1 5.11 Bemerkung (Rechenregeln für die Varianz) 1) Var(aX + b) = a2 Var(X) Satz: X, Y reellwertige + diskrete ZV und X, Y unabhängig: E(XY) = E(X)E(Y) Var(X + Y) = Var(X) + Var(Y) Beispiel (Ω, F , P) W!Raum, Z ∈ R endlich/abzählbar, Z = P(Z) X : Ω → Z eine (reellwertige) diskrete Zufallsvariable. PX (B) = P[X ∈ B] Verteilung von X (W!maß auf (Z, Z) Schreibweise: X ∼ Px a) Bernoulli-Verteilung: p ∈ (0, 1) Z = {0, 1}, Z = P(Z), PX (0) = 1 − p, PX (1) = p Misserfolg Erfolg PX = Ber(p) X ∼ Ber(p) E(X) = 0 · P[X = 0] + 1 · P[X = 1] = 0 · (1 − p) + 1 · p = p Var(X) = p(1 − p) b) Gleichverteilung: Z endlich. Z = P(Z) PX (B) = PX = Unif(Z), X ∼ Unif(Z) |B| |Z| (B ⊆ Z) c) Binominalverteilung: n ∈ N, p ∈ (0, 1) X1 , . . . , Xn ∼ Ber(p) und X1 , . . . , Xn sind unabhängig (iid,independent and identically distributed) iid (Schreibweise: X1 , X2 , . . . , Xn ∼ Ber(p) X = X1 + X2 + . . . + Xn = Anzahl der Erfolge. Z = {0, 1, . . . , n}, Z = P(Z) PX (k) = P[X = k] = nk pk (1 − p)n−k PX = Bin(n, p), X ∼ Bin(n, p) E(X) = E(X1 + X2 + . . . + Xn ) = E(X1 ) + . . . + E(Xn ) = np |{z} |{z} Var(X) = Var(X1 + . . . + Xn ) = np(1 − p) = =P unabhängig =p Var(X1 ) + . . . + Var(Xn ) d) Geometrische Verteilung: p ∈ (0, 1) T = Zeitpunkt des ersten Erfolges bei Wiederholung eines Bernoulli-Experiments. Wie soll man das verstehen ? X1 , X2 , X3 , . . . unabhängige Zufallsvariablen mit Xn ∼ Ber(p) T = inf{n ∈ N : X1 = . . . = Xn−1 = 0, Xn = 1} 14 (Wobei : inf ∅ = +∞ ) Werte von T : N und ∞ unabh. P[T = n] = P[X1 = . . . = Xn−1 = 0, Xn = 1] = P[X1 = 0] P[X2 = 0] . . . P[Xn−1 = 0] P[Xn = 1] = (1 − p)n−1 · p | {z } | {z } | {z } =1−p =1−p =1−p P[T = ∞] ≤ P[T > n] = P[T > n] = P[X1 = . . . = Xn = 0] n→∞ 0] . . . P[Xn = 0] = (1 − p)n → 0 Also P[T = ∞] = 0! Damit: Wertebereich N ist ausreichend um T zu beschreiben. Geo(p) = PT , d.h. Geo(p)(n) = (1 − p)n−1 p für n ∈ N P (Insbesondere (1 − p)n−1 p = 1) n∈N P P E(T ) = n · P[T = n] = n(1 − p)n−1 p = 1p , Var(T ) = 1−p p2 n∈N unabh. = n∈N e) Poisson-Verteilung: ”Seltene Ereignisse“ Betrachte Xn ∼ Bin(n, pn = λn ), E(Xn ) = npn = n · Verhalten für große n : P[Xn = k] → ? λ n =λ n7→∞ P[Xn = k] = = = = ! n k p (1 − pn )n−k k n ! n λ k λ ( ) (1 − )n−k k n n n(n − 1) . . . (n − k + 1) λ k λ λ ( ) (1 − )k (1 − )−k k! n n n λk n(n − 1) . . . (n − k + 1) λ · · . . . · n (1 − )k k! n · n | {zn } |{z} |{z} →n → n λ −k |{z} −→e−λ (1 − ) →n | {zn } →1 −→ e−λ · λk! Poisson-Verteilung zu λ > 0: X ∼ Poi(λ) k n7→∞ P[X = k] = e−λ · λk für k = 0, 1, 2, . . . , (k ∈ N0 ) k! E(X) = Var(X) = λ Beispiel Rosinen im Kuchen: Xn ∼ Bin(n, n1 ) P[Xn = 0] = ? Annäherung: X ∼ Poi(1) (λ = 1) 1 P[Xn = k] ≈ P[X = k] = e−1 k!1 = ek! 1 P[Xn = 0] ≈ P[X = 0] = e P[Xn = 1] ≈ P[X = 1] = 1e Beispiel Rosinen im Kuchen: A(n) k = #Personen (oder Stücke) mit genau k Rosinen. 15 P[X1 = 1 (n) B(n) k = n Ak = relative Anzahl der Personen (oder Stücke) mit genau k Rosinen. (n) (n) (n) A(n) 0 + A1 + · · · + An = n, Ak = 0 für k > n (n) (n) (n) ⇒ B0 + B1 + · · · + Bn = 1 B(1) B(1) B(1) ··· 0 1 2 =0 (2) (2) (2) B0 B1 B(2) B ··· 2 3 =0 .. .. . . B(n) 0 ↓ B(n) 1 ↓ ··· B(n) n ↓ 1 e 1 e e−1 1k k! 1 ek! B(n) n+1 = 0 ↓ Poi(1)(k) Zufallsvariable mit Dichten 5.12 Definition Ein W!maß P auf (R, B(R)) hat Dichte f : R → [0, ∞], falls Rx F(x) = P((−∞, x]) = f (t)dt für alle x ∈ R. Eine Zufallsvariable X hat Dichte −∞ f : R → [0, ∞], wenn P x (die Verteilung von X) Dichte f hat. d.h.: F X (x) = P[X ≤ Rx x] = f (t)dt −∞ 5.13 Bemerkung f Dichte zu P, dann gilt P(B) = R∞ R f (t)dt. Insbesondere 1 = P(R) = B f (t)dt und P({x}) = −∞ Rx f (t)dt = 0 x R∞ Umgekehrt, sei f : R → [0, ∞) eine Fkt. mit f (x)dx = 1, dann ist P : B(R) → [0, 1] −∞ R mit P(B) = f (t)dt ein W!maß. B Beispiel f (x) = cx(1 − x)1[0,1] (x) 1 x ∈ A 1A (x) = 0 sonst x < [0, 1] : f (x) = 0 x ∈ [0, 1] : f (x) = cx(1 − x) ≥ 0 wenn c ≥ 0 2 R∞ R1 R1 f (x)dx = cx(1 − x)dx = cx − cx2 dx = cx2 − −∞ 0 0 cx3 1 3 x=0 = c 2 − c 3 −0 = c 6 =1⇒ c = 6 Also ist f (x) = 6x(1 − x)1[0,1] (x) eine Dichte. R∞ R1 P 12 , ∞ = f (x)dx = 6x(1 − x)dx = 12 1 2 1 2 Erwartungswerte von ZV mit Dichte X diskrete: E(X) = P x xP[X = x] R∞ x f (x)dx, heißt Erwartunswer von X (sofern 5.14 Definition X ZV mit Dichte: E(X) = −∞ R . . . existiert.) R∞ R g : R → R Fkt, E(g(X)) = g(x) f (x)dx. Insbesondere E(X n ) = xn f (x)dx. −∞ 16 Varianz: Var(X) = E((X − E(X))2 ) = R∞ (x − E(X))2 f (x)dx −∞ Rechenregeln: X, Y ZV mit Dichte a, b ∈ R • E(aX + b) = aE(X) + b • E(X + Y) = E(X) + E(Y) • Var(X) = E(X 2 ) − (E(X))2 • Var(aX + b) = a2 Var(X) • E(XY) = E(X)E(Y) X, Y Unabh. • Var(X + Y) = Var(X) X, Y Unabh. Beispiel Gleichverteilung auf [a, b], a < b 1 1[a,b] (x) f (x) = b−a E(X) =? Var(X) =? R∞ Rb 1 E(X) = dx = µ x f (x)dx = x b−a −∞ a Rb 1 Var(X) = (x − µ2 b−a dx = . . . = ψ2 a Beispiel (Exponentialverteilung) Parameter λ > 0, Exp(λ) ist das W!maß mit Dichte f (x) = λe−λx 1[0,∞) (x) X ZV mit X ∼ Exp(λ) : E(X) = λ = Var(X) Verteilungsfunktion von Exp(λ): Rx Für x < 0: F(x) = f (t)dt = 0 −∞ s = −λt R f (t)dt = λe−λt dt = ds = −λdt = λe s − λ1 ds 1 o − λ ds = dt R s s −λt x = − e ds = −e = −e |t=0 = −e−λx − (−1) = 1 − e−λx Rx x ≥ 0: F(x) = Rx −∞ R∞ E(X) = x f (x)dx = −∞ = (−0) − 0 · e −λx + R∞ R∞ x · λe−λx = −xe−λx |∞ x=0 − 0 R∞ 1 · (−e−λx )dx = . . . 0 −λx e dx = −0 − − λ1 e0 = 1 λ 0 Allgemein für Festes n: xn e−λx |{z} → 0 E(X ) = 2 R∞ −∞ x f (x)dx = 2 R∞ x→∞ x λe 2 −λx dx 0 2 Beispiel (Normalverleihung) 2 N(µ, σ ) ist für µ ∈ R, σ > 0 ist das W!maß mit Dichte x−µ 1 1 f (x) = √ 2 exp − 2 σ 2πσ 17 X ∼ N(µ, σ2 ), E(X) = µ, Var(X) = σ2 Standardnormalverteilung: N(0, 1) E (X) . Hier: X ∗ ∼ N(0, 1) Standartisierte von X: X ∗ = Xσ(X) 2 R∞ 1 √ Frage bei Dichte: exp − 12 x−µ dx = 1 2 σ −∞ Umformung: R∞ 2 2πσ e−x dx = √ π −∞ Verteilungsfkt von N(µ, σ2 )? 2 Rx 1 √ dt F(x) = exp − 12 t−µ 2 σ −∞ 2πσ Für µ = 0, σ = 1 ist F tabelliert. 2 5.15 Bemerkung X ZV: F X Vert.fkt., fX Dichte. Ebenso: P W!maß: F P Vert.fkt von P, fP Dichte von P. Insb. F N(0,1) , fN(0,1) §6 Ungleichungen X ZV (reellw., diskret oder mit Dichte), a ≥ 0. RX habe Dichte R f R aP[|X| ≥ a] = aP[X ∈ (−∞, −a] ∪ [a, ∞)] = a f (x)dx = a f (x)dx ≤ |x| f (x)dx ≤ | {z } A A A R∞ =A |x| f (x)dx = E(|X|) Markov-Ungleichung −∞ 6.1 Satz X ZV reellw. und a ≥ 0: Dann gilt aP[|X| ≥ a] ≤ E(|X|) Beispiel (Markov-Ungleichung) aP[|X| ≥ a] ≤ E(|X|) wenn E(|X|) < ∞. Folgerung: y := (X − E(X))2 ⇒ y ≥ 0 ⇒ |y| = y in Markov-Ungleichung einsetzen: a2 P[(X − E(X))2 geqa2 ] ≤ E((X − E(X))2 ) = Var(X) (Vorausgesetzt: Var(X) < ∞) a2 P[|X − E(X)| ≥ a] ≤ Var(X) (Chebyshev-Ungleichung) Gesetz der großen Zahlen X1 , X2 , X3 , . . . ZV, unabhängig, identisch verteilt. Für n ∈ N : S n = X1 + . . . + Xn Sei µ = E(Xi ), σ2 = Var(Xi ) ⇒ E(S n ) = E(X1 + . . . + Xn ) = E(X1 ) + . . .+ E(Xn ) = nµ, Var(S n ) = Var(X1 +. . .+ Xn ) = Var(X1 ) + . . .+Var(Xn ) = nσ2 |{z} |{z} | {z } | {z } µ 1 S n n µ σ2 = Durchschnittswert (arithmetisches Mittel) 18 σ2 ⇒ E( 1n S n ) = Sei > 0 fix: · nµ0µ, Var( 1n S n ) = n12 · nσ2 = 1n σ2 1 σ2 −→ 0 P[ S n − µ ≥ ] ≤ 2 n · n n7→∞ Das ist das schwache Gesetz der großen Zahlen. Diese Form der Konvergenz heißt Konvergenz in Wahrscheinlichkeit 1 n Mehr Aufwand:(ω, F , P) {w ∈ Ω : 1n S n (w) =⇒ µ} n7→∞ Ist Ereignis A ∈ F mit P(A) = 1 und es gilt: [ 1n S n −→ µ n7→∞ ∼ Beispiel X1 , X2 , . . . iidBer(p), E(Xn ) = p, Var(Xn ) = p(1 − p) (iid= independent und identically distributed) S n = X1 + . . . Xn ∼ Bin(n, p) 1 bei n Wiederholungen. n S n = mittlere Anzahl an ”Erfolgen“ 1 Schwaches Gesetz: P[ n S n − p ≥ ] ≤ p(1−p ≤ 412 n 2n √ 1 Informell: n S n ≈ µ, S n ≈ nµ + n · σZ X1 , X2 , X3 , . . . iid mit µ = E(X1 ) S n = X1 + X2 + . . . + Xn 1 ∞µ . . . n S nn → −→ Gesetz der großen Zahlen √ Informell: S n ≈ nµ + n · σ · Z wobei Z ≈ N(0, 1) S n ≈ Y wobei Y ≈00 nµ + PS n ≈ N(nµ, nσ2 ) §7 √ nσN(0, 1)00 −00 nµ + N(0, nσ2 )“ − N(nµ, nσ2 ) Zentraler Grenzwertsatz X1 , X2 , . . . ZV iid mit µ = E(X1 ), σ2 = Var(x1 ) = nσ2 −E(S n ) Standardisierte S nΛ = S√nVar(S = S√n −nµ n·σ n) ∗ ∗ (dann E(S n ) = 0, Var(S n ) = 1) Dann gilt: lim FS n∗ (x) = F N(0,1) (x) für x ∈ R n→∞ (Diese Form der Konvergenz heißt Konvergenz in Verteilung oder schwache Konvergenz.) Ist ρ = E(|X1 − µ|3 )∞ , dann gilt: c· p FS n∗ (x) − F N(0,1) (x) ≤ √ σ3 n Wobei C = 0, 7655 gewählt werden kann. (Satz Berry-Esseen) 19 7.1 Bemerkung FS n (x) = = = > ≈ P[S n ≤ x] S n − nµ x − nµ ≤ √ ] P[ √ nσ nσ x − nµ P[S n∗ ≤ √ ] nσ x − nµ FS n∗ ( √ nσ x − nµ F N(0,1) ( √ nσ Beispiel X1 , X2 , . . . iid mit X1 ∼ Ber(p) S n = X1 + . . . Xn ∼ Bin(n, p), µ = E(X1 ) = p, σ2 = Var(X1 ) = p(1 − p) ρ = = E(|X1 − µ|3 ) = |0 − µ|3 P[X1 = 0] + |1 − µ|3 P[X1 = 1] p3 (1 − p) + (1 − p)3 p = p(1 − p)(1 + 2p + 2p3 ) ≤ ∞ S n ∼ Bin(n, p): x − p FBin(n,p) (x) ≈ F N(0,1) p np(1 − p ! Etwa: P[a < S n ≤ b] = FBin (n, p)(b)−FBin(n,p) (a) ≈ F N(0,1) √ b−p np(1−p) ”Problem“: P[S n = a] = P[a − 1 < S n ≤ a] Beispiel Einschub: ”Erzeugung“ von Zufallszahlen X ∼ Uniform({0, . . . , m − 1}) ∼ Uniform({ m0 , m1 , m2 , . . . , m−1 m }) (Annäherung an Uniform([0, 1]) X m 20 ! −F N(0,1) √ a−p np(1−p) Index Arithmetisches Mittel, 19 Borel’sche Algebra, 9 Gesetz der Großen Zahlen, 19 Gesetz der grossen Zahlen, 19 Grenzwertsatz zentraler, 19 Konvergenz in Verteilung, 19 in Wahrscheinlichkeit, 19 schwache, 19 Moment, 12 Poissonverteilung, 15 Standardabweichung, 13 Teufl, Prof. Dr., 3 Unabhängigkeit, 10 Ungleichung Chebyshev, 18 Markov, 18 Verteilungsfunktion, 9, 12 Wahrscheinlichkeit Maß, 6 Raum, 6 Zufallsvariable, 10 diskrete, 12 Erwartungswert, 12 21