pdf:6

Werbung

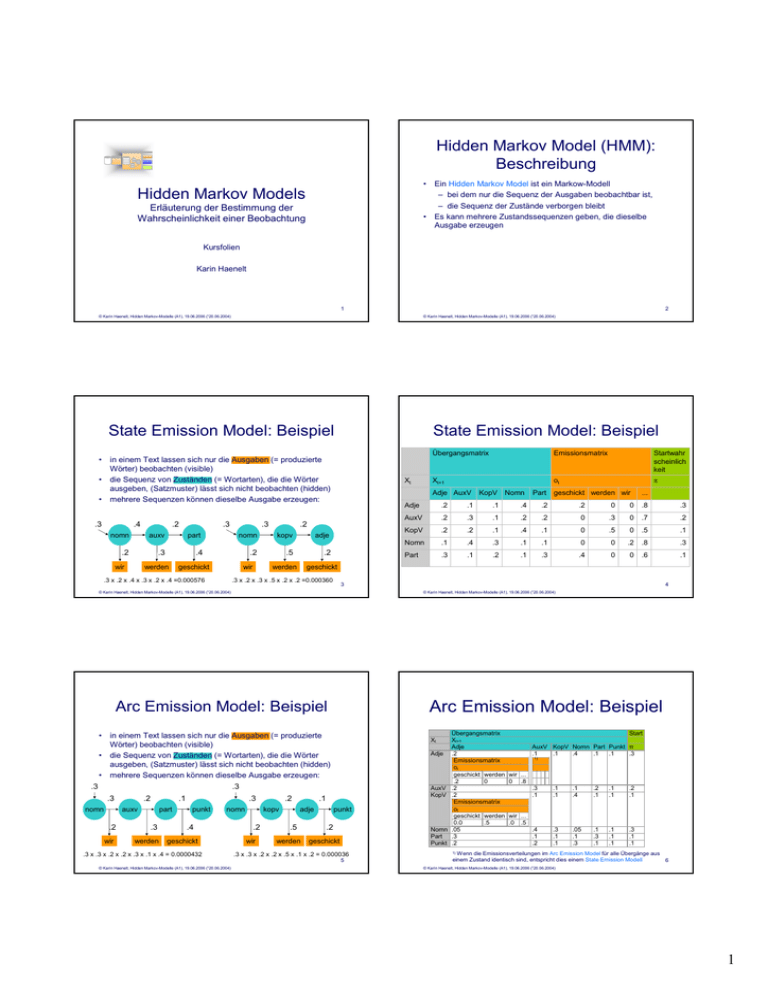

Hidden Markov Model (HMM):

Beschreibung

•

Hidden Markov Models

Erläuterung der Bestimmung der

Wahrscheinlichkeit einer Beobachtung

•

Ein Hidden Markov Model ist ein Markow-Modell

– bei dem nur die Sequenz der Ausgaben beobachtbar ist,

– die Sequenz der Zustände verborgen bleibt

Es kann mehrere Zustandssequenzen geben, die dieselbe

Ausgabe erzeugen

Kursfolien

Karin Haenelt

1

2

© Karin Haenelt, Hidden Markov-Modelle (A1), 19.06.2006 (120.06.2004)

© Karin Haenelt, Hidden Markov-Modelle (A1), 19.06.2006 (120.06.2004)

State Emission Model: Beispiel

State Emission Model: Beispiel

Übergangsmatrix

•

•

•

in einem Text lassen sich nur die Ausgaben (= produzierte

Wörter) beobachten (visible)

die Sequenz von Zuständen (= Wortarten), die die Wörter

ausgeben, (Satzmuster) lässt sich nicht beobachten (hidden)

mehrere Sequenzen können dieselbe Ausgabe erzeugen:

.3

.4

nomn

.2

auxv

.2

.3

part

.3

wir

.3

nomn

.4

werden

wir

.3 x .2 x .4 x .3 x .2 x .4 =0.000576

adje

.5

.2

werden

.3 x .2 x .3 x .5 x .2 x .2 =0.000360

•

nomn

.2

.1

auxv

.2

wir

part

.3

werden

.3

punkt

nomn

.4

wir

.3 x .3 x .2 x .2 x .3 x .1 x .4 = 0.0000432

.2

kopv

.2

geschickt

.2

.1

.1

.4

.2

.2

0

0

.8

.3

AuxV

.2

.3

.1

.2

.2

0

.3

0

.7

.2

KopV

.2

.2

.1

.4

.1

0

.5

0

.5

.1

Nomn

.1

.4

.3

.1

.1

0

0

.2

.8

.3

Part

.3

.1

.2

.1

.3

.4

0

0

.6

.1

4

Adje

AuxV

KopV

.1

punkt

adje

.5

werden

.2

Nomn

Part

Punkt

geschickt

5

© Karin Haenelt, Hidden Markov-Modelle (A1), 19.06.2006

...

Adje

Xt

.3 x .3 x .2 x .2 x .5 x .1 x .2 = 0.000036

(120.06.2004)

π

Part geschickt werden wir

Arc Emission Model: Beispiel

.3

.3

Nomn

© Karin Haenelt, Hidden Markov-Modelle (A1), 19.06.2006 (120.06.2004)

in einem Text lassen sich nur die Ausgaben (= produzierte

Wörter) beobachten (visible)

die Sequenz von Zuständen (= Wortarten), die die Wörter

ausgeben, (Satzmuster) lässt sich nicht beobachten (hidden)

mehrere Sequenzen können dieselbe Ausgabe erzeugen:

.3

ot

KopV

3

Arc Emission Model: Beispiel

•

Startwahr

scheinlich

keit

geschickt

© Karin Haenelt, Hidden Markov-Modelle (A1), 19.06.2006 (120.06.2004)

•

Xt+1

Adje AuxV

.2

kopv

.2

geschickt

Xt

Emissionsmatrix

Übergangsmatrix

Xt+1

Adje

.2

Emissionsmatrix

ot

geschickt werden

.2

0

.2

.2

Emissionsmatrix

ot

geschickt werden

0.0

.5

.05

.3

.2

Start

AuxV KopV Nomn Part Punkt π

.1

.1

.4

.1

.1

.3

1)

wir ...

0 .8

.3

.1

.1

.1

.1

.4

.2

.1

.1

.1

.2

.1

.4

.1

.2

.3

.1

.1

.05

.1

.3

.1

.3

.1

.1

.1

.1

.3

.1

.1

wir ...

.0 .5

1)

Wenn die Emissionsverteilungen im Arc Emission Model für alle Übergänge aus

einem Zustand identisch sind, entspricht dies einem State Emission Modell

6

© Karin Haenelt, Hidden Markov-Modelle (A1), 19.06.2006 (120.06.2004)

1

Hidden Markov Model: Definition

Arc Emission Model

Drei grundlegende Aufgaben, die

mit HMMs bearbeitet werden

Formal spezifiziert durch Fünf-Tupel (S , K , Π, A, B )

1.

2.

3.

S = {s1,..., sN}

Menge der Zustände

K = {k 1,..., kM } = {1,..., M }

Ausgabe-Alphabet

Π = {πi}, i ∈ S

A = {aij},

Wahrscheinlichkeiten

der Startzustände

N

i, j ∈ S

∑a

ij

j =1

B = {bijk},

i, j ∈ S ,

k∈K

Dekodierung: Wahrscheinlichkeit einer Beobachtung finden

Beste Pfad-Sequenz finden

Training: Aufbau des besten Modells aus Trainingsdaten

M

∑b

ijk

k =1

= 1 Wahrscheinlichkeiten

der Zustandsübergänge

= 1 Wahrscheinlichkeiten

der Symbolemissionen

7

Manning/Schütze, 2000: 326

© Karin Haenelt, Hidden Markov-Modelle (A1), 19.06.2006 (120.06.2004)

8

Manning/Schütze, 2000: 325

© Karin Haenelt, Hidden Markov-Modelle (A1), 19.06.2006 (120.06.2004)

Beschreibung der Aufgabe

Formel zur Berechnung

gegeben eine Sequenz von Beobachtungen O = (o1,..., oT )

Die Formel für diese Berechnung lautet:

O=(wir,werden,geschickt)

ein Modell 1) µ = ( A, B, Π )

P (O | µ )

Xt

Xt+1

ot

π

Adje AuxV KopV Nomn Part geschickt werden wir ...

Adje

.2

.1

.1

.4

.2

.2

0 0 .8

.3

AuxV

.2

.3

.1

.2

.2

0

.3 0 .7

.2

KopV

.2

.2

.1

.4

.1

0

.5 0 .5

.1

Nomn

.1

.4

.3

.1

.1

0

0 .2 .8

.3

Part

.3

.1

.2

.1

.3

.4

0 0 .6

.1

gesucht

= ∑ P(O | X , µ ) P ( X | µ )

X

T −1

∑ π X Π aX

=

X 1... Xt +1

t =1

1

b

X

t t + 1 X t X t + 1ot

state

transition

die Wahrscheinlichkeit P (O | µ )

Wenn die Emissionsverteilungen im Arc

P( wir , werden, geschickt | µ ) Emission Model für alle Übergänge aus einem

symbol

emission

1)

© Karin Haenelt, Hidden Markov-Modelle (A1), 19.06.2006 (120.06.2004)

Zustand identisch sind,

9

entspricht dies einem State Emission Modell

10

Herleitung der Formel für P(O|µ)

(1) Grundüberlegung

Die Emissionen O sind im Hidden Markov Model nicht

direkt, sondern nur über die Zustandsfolge zugänglich

(2) Überlegung

für eine Zustandsfolge X = (X1, …, XT+1) sind zugänglich:

Manning/Schütze, 2000: 326

© Karin Haenelt, Hidden Markov-Modelle (A1), 19.06.2006 (120.06.2004)

Herleitung: (2a): P(O|X,µ)

•

Die Wahrscheinlichkeit, dass eine bestimmte Zustandsfolge die

beobachtete Sequenz ausgibt, ist

P(( wir , werden, geschickt ) | (nomn, auxv, part ), µ )

T

(2a) P(O | X , µ ) = ∏ P (ot | X t , X t +1 , µ ) = bX1 X 2o1 bX 2 X 3o2 ...bX T X T +1oT

t =1

(2b) P( X | µ ) = πa X1 X 2 a X 2 X 3 ...a X T X T +1

(3) Überlegung

- Die Wahrscheinlichkeit einer Beobachtung nach

einer bestimmten Pfadsequenz ist (2a)×(2b)

- durch Umformung nach den Bayes-Regeln erhält man

Die Wahrscheinlichkeit einer Beobachtung ist die

Summe der Wahrscheinlichkeiten aller Möglichkeiten,

die diese Beobachtung ausgeben

P(O | µ ) = ∑ P (O | X , µ ) P ( X | µ )

X

© Karin Haenelt, Hidden Markov-Modelle (A1), 19.06.2006 (120.06.2004)

.4

nomn

.2

auxv

part

T

= Π P(ot | Xt , Xt + 1, µ )

.2

t =1

P(O, X | µ ) = P (O | X , µ ) P( X | µ )

(4) Überlegung

.3

P(O | X , µ )

= bX X O bX X O ...bX X

1 2 1

2 3 2

T T +1OT

.2

x

.3

x

.4

11

wir

.3

werden

.4

geschickt

=0.024

12

© Karin Haenelt, Hidden Markov-Modelle (A1), 19.06.2006 (120.06.2004)

2

Herleitung: (2b): P(X|µ)

•

Herleitung: (3): P(O|X,µ)P(X|µ)

Die Wahrscheinlichkeit, dass eine bestimmte Zustandsfolge

auftritt ist

.3x.4

.3

.4

nomn

.2

auxv

.2

a X 2 X 3 ... a X

x

Die Wahrscheinlichkeit, dass eine bestimmte Beobachtung und

eine bestimmte Zustandsfolge auftreten, ist

P ((wir, werden, geschickt) | (nomn, auxv, part ), µ ) ⋅

P ((nomn, auxv, part ) | µ )

P ((nomn, auxv, part ) | µ )

P( X | µ )

= πa X X

1 2

•

T X T +1

.2

.3

part

.3

wir

werden

.4

nomn

.4

.2

auxv

.2

= P (O | X , µ ) P ( X | µ )

geschickt

.0.024 x

=0.024

.0024

wir

part

.3

werden

=0.000576

13

© Karin Haenelt, Hidden Markov-Modelle (A1), 19.06.2006 (120.06.2004)

.4

geschickt

14

© Karin Haenelt, Hidden Markov-Modelle (A1), 19.06.2006 (120.06.2004)

Herleitung: (3):

P(O,X|µ) = P(O|X,µ)P(X|µ)

Herleitung: (3):

P(O,X|µ) = P(O|X,µ)P(X|µ)

verwendete Regeln

P (O | X , µ ) P ( µ ) P( X | µ )

=

P(µ )

P (O | X ∩ µ ) P( µ ∩ X )

=

P( µ )

P(O ∩ X ∩ µ )

P (O | X ∩ µ ) P ( µ ∩ X )

=

=

P(µ )

P( µ )

P (O ∩ X ∩ µ )

= P (O , X | µ )

=

P(µ )

P(O | X , µ ) P ( X | µ )

verwendete Regeln

P( A) P ( B | A) = P ( A ∩ B )

P( A ∩ B)

= P( A | B)

P( B)

P( A | B ) =

P (O ∩ X ∩ µ )

P ( A ∩ B ) = P ( A) P ( B | A)

P(µ )

P (O ∩ X ∩ µ )

P (O | X ∩ µ ) P ( µ ∩ X )

=

=

P(µ )

P(µ )

P (O | X ∩ µ ) P( µ ∩ X )

=

P( µ )

P (O | X , µ ) P ( µ ) P( X | µ )

=

= P (O | X , µ ) P( X | µ )

P(µ )

16

= P (O , X | µ ) =

15

© Karin Haenelt, Hidden Markov-Modelle (A1), 19.06.2006 (120.06.2004)

© Karin Haenelt, Hidden Markov-Modelle (A1), 19.06.2006 (120.06.2004)

Herleitung: (4):

P (O | µ )

Beobachtung & alle Pfadsequenzen

•

P( A ∩ B)

P( B)

Wahrscheinlichkeit, dass eine bestimmte Beobachtung nach

einem Modell auftritt = Summe der Wahrscheinlichkeiten dieser

Ausgabe aus den einzelnen Pfadsequenzen

Literatur

•

Manning, Christopher D.; Schütze, Hinrich (1999): Foundations of Statistical Natural

Language Processing. Cambridge, Mass., London: The MIT Press. (vgl.:

http://www.sultry.arts.usyd.edu.au/fsnlp)

von einem Pfad P(O, X | µ ) = P (O | X , µ ) P( X | µ )

zur Summe

aller Pfade

P(O | µ ) = ∑ P (O | X , µ ) P ( X | µ ) =

T −1

∑ π X Π aX

X 1... Xt +1

X

P(wir,werden,geschickt | Adje Adje Adje, µ)

+…

+ P(wir,werden,geschickt | Nomn AuxV Part, µ)

+…

+ P(wir,werden,geschickt | Nomn KopV Adje, µ)

+…

+ P(wir,werden,geschickt | Part Part Part, µ)

=

1

t =1

b

X

t t + 1 X t X t + 1ot

=0.0

.3 x .2 x .4 x .3 x .2 x .4 =0.000576

.3 x .2 x .3 x .5 x .2 x .2 =0.000360

=0.0

17

© Karin Haenelt, Hidden Markov-Modelle (A1), 19.06.2006

(120.06.2004)

=0.000936

18

© Karin Haenelt, Hidden Markov-Modelle (A1), 19.06.2006 (120.06.2004)

3