Kurzfassung: Wahrscheinlichkeitsrechnung

Werbung

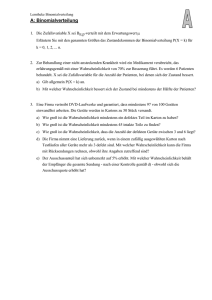

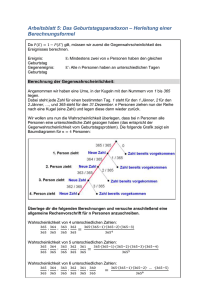

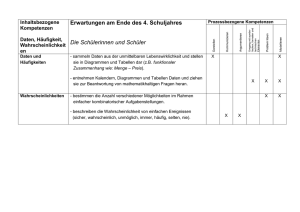

Elementare Begriffe der Wahrscheinlichkeitstheorie für die Sprachverarbeitung Kursfolien Karin Haenelt 1 Karin Haenelt, Grundlagen der Wahrscheinlichkeitsrechnung V5.0 10.06.2007 (1 04.05.2001), Übersicht • • • • • Wahrscheinlichkeitsfunktion P Wahrscheinlichkeit und bedingte Wahrscheinlichkeit Bayes-Formeln abhängige und unabhängige Ereignisse Test zweier Ereignisse auf Abhängigkeit • • • • Beispiel Retrieval Beispiel Tagging Schätzwerte Evaluierung 2 Karin Haenelt, Grundlagen der Wahrscheinlichkeitsrechnung V5.0 10.06.2007 (1 04.05.2001), 1 Wahrscheinlichkeit Wahrscheinlichkeitsfunktion P Weist jedem möglichen Wert einer Zufallsvariablen eine Wahrscheinlichkeit zu PROB(ei) ≥ 0 für alle i PROB(ei) ≤ 1 für alle i Σi=1,n PROB(ei) = 1 PROB(Race=Win) = 0.2 PROB(Race=Lose) = 0.8 ----------------------------------Σi=1,n PROB(RACEi) = 1.0 3 Karin Haenelt, Grundlagen der Wahrscheinlichkeitsrechnung V5.0 10.06.2007 (1 04.05.2001), Übersicht • • • • • Wahrscheinlichkeitsfunktion P Wahrscheinlichkeit und bedingte Wahrscheinlichkeit Bayes-Formeln abhängige und unabhängige Ereignisse Test zweier Ereignisse auf Abhängigkeit • • • • Beispiel Retrieval Beispiel Tagging Schätzwerte Evaluierung 4 Karin Haenelt, Grundlagen der Wahrscheinlichkeitsrechnung V5.0 10.06.2007 (1 04.05.2001), 2 Bedingte Wahrscheinlichkeit Bedingte Wahrscheinlichkeit P(A) Wahrscheinlichkeit (a priori Wahrscheinlichkeit) Gesamtmenge A P(A|B) A∩B B - betrachtet eine Teilmenge aus der Gesamtmenge - P(A) / P(Gesamtmenge) = P(A) / 1 = P(A) Bedingte Wahrscheinlichkeit (a posteriori Wahrscheinlichkeit) Gesamtmenge A - Wahrscheinlichkeit, dass Ereignis A eintritt A∩B B - Wahrscheinlichkeit - dass Ereignis A eintritt, - wenn Ereignis B eingetreten ist - betrachtet eine Teilmenge aus einer Teilmenge - P(A|B) = P(A B) / P(B) 5 Karin Haenelt, Grundlagen der Wahrscheinlichkeitsrechnung V5.0 10.06.2007 (1 04.05.2001), Manning/Schütze,2000,42 2 Bedingte Wahrscheinlichkeit Das Pferd „Harry“ und das Wetter Rennen Gesamt bei Regen gewonnen verloren gelaufen 20 80 15 15 100 30 5 65 15 15 Einfache Wahrscheinlichkeit P(A) betrachtet Teilmengen aus der Gesamtmenge, Beispiele P( win) = .2 P( win) / P( gesamt ) P( win ∩ rain) = .15 P( win ∩ rain) / P( gesamt) Bedingte Wahrscheinlichkeit P(A|B) betrachtet Teilmengen aus einer Teilmenge, Beispiel P( win | rain) = .5 P ( win ∩ rain) / P(rain) 6 Karin Haenelt, Grundlagen der Wahrscheinlichkeitsrechnung V5.0 10.06.2007 (1 04.05.2001), 2 Bedingte Wahrscheinlichkeit Bedingte Wahrscheinlichkeit Definition P(A | B) = P(A ∩ B) P(B) P(Win | Rain) = P(Win ∩ Rain) P(Rain) Schreibvarianten P(A | B) = P(A, B) P(B) P(Win | Rain) = .15 = .5 .30 P(A | B) = P(A & B) / P(B) P(A|B) ≠ P(B|A) A A∩B 5 65 15 B P(Rain | Win) = P(Rain ∩ Win) P(Win) P(Rain | Win) = .15 = .75 .20 15 7 Karin Haenelt, Grundlagen der Wahrscheinlichkeitsrechnung V5.0 10.06.2007 (1 04.05.2001), Übersicht • • • • • Wahrscheinlichkeitsfunktion P Wahrscheinlichkeit und bedingte Wahrscheinlichkeit Bayes-Formeln abhängige und unabhängige Ereignisse Test zweier Ereignisse auf Abhängigkeit • • • • Beispiel Retrieval Beispiel Tagging Schätzwerte Evaluierung 8 Karin Haenelt, Grundlagen der Wahrscheinlichkeitsrechnung V5.0 10.06.2007 (1 04.05.2001), P(A | B) = P(A ∩ B) P(B) Theorem von Bayes ermöglicht Berechnung von P(B|A) aus P(A|B) Regel von Bayes P(A ∩ B) = P(B) · P(A ∩ B) / P(B) = P(B) · P(A|B) 0.3 · .15 / 0.3 = 0.3 · = P(A) · P(A ∩B) / P(A) 0.2 · .15 / 0.5 = 0.15 = P(A) ·P(B|A) 0.2 = 0.2 · 0.75 = 0.15 Theorem von Bayes P(A|B )= P(A ∩ B) / P(B) = P(B) · P(A|B) / P(B) 0.3 · 0.5 / 0.3 = 0.50 = P(A) ·P(B|A) / P(B) 0.2 · 0.75 / 0.3 = 0.50 Herleitung durch Umformung Karin Haenelt, Grundlagen der Wahrscheinlichkeitsrechnung V5.0 10.06.2007 (1 04.05.2001), 9 5 A:win A∩B 15 B:rain 65 15 Theorem von Bayes ermöglicht Berechnung von P(B|A) aus P(A|B) Regel von Bayes P(A ∩ B) = P(B) · P(A ∩ B) / P(B) = P(B) · P(A|B) 0.3 · .15 / 0.3 = 0.3 · = P(A) · P(A ∩B) / P(A) 0.2 · .15 / 0.5 = 0.15 = P(A) ·P(B|A) 0.2 = 0.2 · 0.75 = 0.15 Theorem von Bayes P(A|B )= P(A ∩ B) / P(B) = P(B) · P(A|B) / P(B) 0.3 · 0.5 / 0.3 = 0.50 = P(A) ·P(B|A) / P(B) 0.2 · 0.75 / 0.3 = 0.50 Herleitung durch Umformung Karin Haenelt, Grundlagen der Wahrscheinlichkeitsrechnung V5.0 10.06.2007 (1 04.05.2001), 10 Übersicht • • • • • Wahrscheinlichkeitsfunktion P Wahrscheinlichkeit und bedingte Wahrscheinlichkeit Bayes-Formeln abhängige und unabhängige Ereignisse Test zweier Ereignisse auf Abhängigkeit • • • • Beispiel Retrieval Beispiel Tagging Schätzwerte Evaluierung 11 Karin Haenelt, Grundlagen der Wahrscheinlichkeitsrechnung V5.0 10.06.2007 (1 04.05.2001), unabhängige Ereignisse • • Zwei Ereignisse sind voneinander unabhängig, wenn gilt: P(A|B) = P(A) P(A ∩ B) = P(A) · P(B) Typisches Beispiel: Es werden zwei Würfel geworfen. Sei A das Ereignis: der 1. Wurf ist eine 1: P(A) = 1/6 Sei B das Ereignis: der 2. Wurf ist eine 6: P(B) = 1/6 Wahrscheinlichkeit A und B: P(A∩B) = 1/6 · 1/6 = 1/36 12 Karin Haenelt, Grundlagen der Wahrscheinlichkeitsrechnung V5.0 10.06.2007 (1 04.05.2001), Übersicht • • • • • Wahrscheinlichkeitsfunktion P Wahrscheinlichkeit und bedingte Wahrscheinlichkeit Bayes-Formeln abhängige und unabhängige Ereignisse Test zweier Ereignisse auf Abhängigkeit • • • • Beispiel Retrieval Beispiel Tagging Schätzwerte Evaluierung 13 Karin Haenelt, Grundlagen der Wahrscheinlichkeitsrechnung V5.0 10.06.2007 (1 04.05.2001), Test zweier Ereignisse auf Unabhängigkeit Rennen P(win|rain) 5 65 15 40 40 alle Rennen bei Regen bei Regen (Beispiel 1) (Beispiel 2) gewonnen 20 15 10 verloren 80 15 40 Gesamt 100 30 50 P(win) Ergebnis: die Ereignisse „win“ und „rain“ sind Beispiel 1 .50 ≠ .20 abhängig Beispiel 2 .20 = .20 unabhängig P(win ∩ rain) 10 10 15 Beispiel 1 .15 P(win) · P(rain) Ergebnis: die Ereignisse „win“ und „rain“ sind ≠ .2 × .3 = .06 abhängig Beispiel 2 .10 = .2 × .5 = .10 unabhängig Karin Haenelt, Grundlagen der Wahrscheinlichkeitsrechnung V5.0 10.06.2007 (1 04.05.2001), 14 abhängige und unabhängige Ereignisse • diese Formeln gelten in beiden Fällen, da die rechte und die linke Seite formal äquivalent sind P(A ∩ B) = P(A) ·P(B | A) = P(B) · P(A | B) P(A | B) = P(A ∩ B) / P(B) P(win ∩ rain) = P(win|rain) · P(rain) = P(rain|win) · P(win) Beispiel 1 .15 = .5 · .3 = .75 · .2 Beispiel 2 .10 = .2 · .5 = .5 · .2 P(win|rain) = P(win ∩rain) / P(rain) Beispiel 1 .5 .15 / .3 Beispiel 2 .2 .10 /.5 Karin Haenelt, Grundlagen der Wahrscheinlichkeitsrechnung V5.0 10.06.2007 (1 04.05.2001), 15 Übersicht • • • • • Wahrscheinlichkeitsfunktion P Wahrscheinlichkeit und bedingte Wahrscheinlichkeit Bayes-Formeln abhängige und unabhängige Ereignisse Test zweier Ereignisse auf Abhängigkeit • • • • Beispiel Retrieval Beispiel Tagging Schätzwerte Evaluierung 16 Karin Haenelt, Grundlagen der Wahrscheinlichkeitsrechnung V5.0 10.06.2007 (1 04.05.2001), 4 Beispiel 4 Beispiel „Retrieval“ Dokumente Gesamt relevante Dokumente mit Term i ohne Term i 20 80 15 15 100 30 R 5 15 R 65 15 P(wi = 1 ∩ R) .15 P(wi = 1 | R) = = = .5 P(R) .30 17 Karin Haenelt, Grundlagen der Wahrscheinlichkeitsrechnung V5.0 10.06.2007 (1 04.05.2001), Übersicht • • • • • Wahrscheinlichkeitsfunktion P Wahrscheinlichkeit und bedingte Wahrscheinlichkeit Bayes-Formeln abhängige und unabhängige Ereignisse Test zweier Ereignisse auf Abhängigkeit • • • • Beispiel Retrieval Beispiel Tagging Schätzwerte Evaluierung 18 Karin Haenelt, Grundlagen der Wahrscheinlichkeitsrechnung V5.0 10.06.2007 (1 04.05.2001), 4 Beispiel 5 Beispiel „Tagging“ Vereinfachter Fall des Part-of-Speech Tagging bzw. der Wortartdisambiguierung: Es ist zu bestimmen, Ob „flies“ ein Nomen (N) oder ein Verb (V) ist Allen, 1995, S. 191/192 19 Karin Haenelt, Grundlagen der Wahrscheinlichkeitsrechnung V5.0 10.06.2007 (1 04.05.2001), 4 Beispiel Beispiel Zu lösende Aufgabe P( N | flies ) = P( flies ∩ N ) / P ( flies ) P (V | flies ) = P( flies ∩ V ) / P( flies ) Schätzwerte aus Beispieldaten P ( flies ) ≅ 1.000 / 1.273.00 = .00078 P( flies ∩ N ) ≅ 400 / 1.273.00 = .00031 P( flies ∩V ) ≅ 600 / 1.273.00 = .00047 a... flies flies z... Beispiel.Corpus . N 400 V 600 . . 1.273.000 vgl. Allen, 1995, S. 191/192 Ergebnis P(V | flies ) = P( flies ∩ V ) / P( flies ) = .00047 / .00078 = .6 20 Karin Haenelt, Grundlagen der Wahrscheinlichkeitsrechnung V5.0 10.06.2007 (1 04.05.2001), 4 Beispiel Beispiel Anwendung des Ergebnisses Ein Algorithmus, der „flies“ immer die Kategorie V zuweist, - arbeitet im Beispielfall in 60% aller Fälle korrekt Zur Verbesserung der Methode ist die Betrachtung von Kontext erforderlich Allen, 1995, S. 192 21 Karin Haenelt, Grundlagen der Wahrscheinlichkeitsrechnung V5.0 10.06.2007 (1 04.05.2001), Übersicht • • • • • Wahrscheinlichkeitsfunktion P Wahrscheinlichkeit und bedingte Wahrscheinlichkeit Bayes-Formeln abhängige und unabhängige Ereignisse Test zweier Ereignisse auf Abhängigkeit • • • • Beispiel Retrieval Beispiel Tagging Schätzwerte Evaluierung 22 Karin Haenelt, Grundlagen der Wahrscheinlichkeitsrechnung V5.0 10.06.2007 (1 04.05.2001), 5 Schätzwerte Schätzwerte Tatsächliche Wahrscheinlichkeit Berechnung für vorliegende Daten Geschätzte Wahrscheinlichkeit Verwendung bekannter Daten für Vorhersage zukünftiger Fälle Sprachtechnologische Anwendungen arbeiten mit geschätzten Wahrscheinlichkeiten Allen, 1995, S. 192 23 Karin Haenelt, Grundlagen der Wahrscheinlichkeitsrechnung V5.0 10.06.2007 (1 04.05.2001), 5 Schätzwerte Schätzwerte • Verwendung der Werte von n beobachteten Fällen zur Lösung der Fälle n+1 ... n+m • Zuverlässig bei großen Beispielmengen • Problematisch bei kleinen Beispielmengen Allen, 1995, S. 192 24 Karin Haenelt, Grundlagen der Wahrscheinlichkeitsrechnung V5.0 10.06.2007 (1 04.05.2001), 5 Schätzwerte Maximum Likelihood Estimator (MLE) Einfache Verhältnisschätzung Berechnung X xi Hi Beispiel P(X=xi) ≅ Hi / Σi Hi Zufallsvariable Wert der Zufallsvariablen Häufigkeitswert des Ereignisses X=xi Hi = |xi| MLE: P(Categ=V) ≅ |V| / |N| + |V| = 6 / 10 = .6 flies N 4 flies V 6 vgl. Allen, 1995, S. 194 25 Karin Haenelt, Grundlagen der Wahrscheinlichkeitsrechnung V5.0 10.06.2007 (1 04.05.2001), 5 Schätzwerte Expected Likelihood Estimator (ELE) Einfache Verhältnisschätzung + kleiner Korrekturwert Berechnung X xi Hi P(X=xi) ≅ Hi / Σi Hi Zufallsvariable Wert der Zufallsvariablen Häufigkeitswert des Ereignisses X=xi Hi = |xi| + 0.5 ELE: Zur Vermeidung von Null-Werten Allen, 1995, S. 194 26 Karin Haenelt, Grundlagen der Wahrscheinlichkeitsrechnung V5.0 10.06.2007 (1 04.05.2001), 5 Schätzwerte Expected Likelihood Estimator (ELE) Beispiel 1 Wort w P(X=xi) ≅ Hi / Σi Hi erscheint nicht im Corpus Schätzung der Wahrscheinlichkeit, dass w in einer von 40 Wortklassen erscheint: P(Categ=V|w) ≅ |V| / Σi Hi = 0+0.5 / 40 (0+0.5) = .5/20 = .025 Kleiner Wert reflektiert die Tatsache, dass zu w keine Information vorhanden ist Allen, 1995, S. 195 27 Karin Haenelt, Grundlagen der Wahrscheinlichkeitsrechnung V5.0 10.06.2007 (1 04.05.2001), 5 Schätzwerte Expected Likelihood Estimator (ELE) Beispiel 2 P(Categ = V | flies ) ≅ Hi / ΣiHi Klasse Categ Freq 1 N 4 4+0.5 4.5 2 V 6 6+0.5 = 6.5 6+0.5 6.5 .. .. 0 38 x (0+0.5) 19.0 40 .. 0 40 = 6.5 / H2 ∑i=1 Hi = 30.0 0.216 • ergibt sehr kleinen Wert im Vergleich zur Intuition • bei geringen Datenmengen schlagen nicht belegte Klassen stark auf das Ergebnis durch vgl. Allen, 1995, S. 195 28 Karin Haenelt, Grundlagen der Wahrscheinlichkeitsrechnung V5.0 10.06.2007 (1 04.05.2001), Übersicht • • • • • Wahrscheinlichkeitsfunktion P Wahrscheinlichkeit und bedingte Wahrscheinlichkeit Bayes-Formeln abhängige und unabhängige Ereignisse Test zweier Ereignisse auf Abhängigkeit • • • • Beispiel Retrieval Beispiel Tagging Schätzwerte Evaluierung 29 Karin Haenelt, Grundlagen der Wahrscheinlichkeitsrechnung V5.0 10.06.2007 (1 04.05.2001), 6 Evaluierung Evaluierung Erfordert Aufteilung des Corpus in - Trainingsmenge Zur Gewinnung der Schätzwerte - Testmenge Zur Evaluierung der Algorithmen Typische Trainingsmenge: 10-20% des Corpus Cross-Validation: Iteratives Testen mit Auswahl verschiedener Teile des Corpus Als Trainings- und Testmenge Allen, 1995, S. 195 30 Karin Haenelt, Grundlagen der Wahrscheinlichkeitsrechnung V5.0 10.06.2007 (1 04.05.2001), Literatur • Allen, James (1995): Natural Language Understanding. 2nd edition. Addison-Wesley Publishing Co. • Manning, Christopher D.; Schütze, Hinrich (1999): Foundations of Statistical Natural Language Processing. Cambridge, Mass., London: The MIT Press. (vgl.: http://www.sultry.arts.usyd.edu.au/fsnlp) • Schüler DUDEN Mathematik I, Mannheim; Leipzig; Wien; Zürich: Dudenverlag, 61999 31 Karin Haenelt, Grundlagen der Wahrscheinlichkeitsrechnung V5.0 10.06.2007 (1 04.05.2001), Versionen • • • • • V 5.0: 10.06.2007 V 4.2: 18.06.2006, V 4.1: 17.06.2006, V 4.0: 31.10.2005, V 3.0: 07.11.2004, V 2.0: 04.05.2002 V 1.0: 04.05.2001 32 Karin Haenelt, Grundlagen der Wahrscheinlichkeitsrechnung V5.0 10.06.2007 (1 04.05.2001),